JP6852478B2 - 通信端末、通信プログラム及び通信方法 - Google Patents

通信端末、通信プログラム及び通信方法 Download PDFInfo

- Publication number

- JP6852478B2 JP6852478B2 JP2017048205A JP2017048205A JP6852478B2 JP 6852478 B2 JP6852478 B2 JP 6852478B2 JP 2017048205 A JP2017048205 A JP 2017048205A JP 2017048205 A JP2017048205 A JP 2017048205A JP 6852478 B2 JP6852478 B2 JP 6852478B2

- Authority

- JP

- Japan

- Prior art keywords

- data

- voice

- communication terminal

- voice data

- communication

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/26—Speech to text systems

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/22—Procedures used during a speech recognition process, e.g. man-machine dialogue

- G10L2015/221—Announcement of recognition results

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/22—Procedures used during a speech recognition process, e.g. man-machine dialogue

- G10L2015/225—Feedback of the input speech

Description

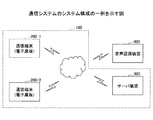

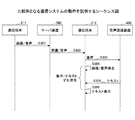

以下に図面を参照して、第一の実施形態について説明する。図1は、通信システムのシステム構成の一例を示す図である。

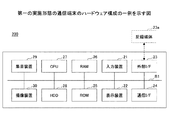

以下に図面を参照して、第二の実施形態について説明する。第二の実施形態では、コンテンツデータを受信してから音声データを再生するまでのコンテンツ保持期間に応じて、音声データに対する加工を行う点が、第一の実施形態と相違する。よって、以下の第二の実施形態の説明では、第一の実施形態との相違点についてのみ説明し、第一の実施形態と同様の機能構成を有するものには、第一の実施形態の説明で用いた符号を付与し、その説明を省略する。

200、200A 通信端末

210 集音部

220 入力部

230 出力部

240 コンテンツ保持部

250 バッファ処理部

260 通信部

270 保持期間取得部

280 加工判定部

290 音声加工部

300 サーバ装置

400 音声認識装置

Claims (7)

- 集音装置により集音した音声データの送受信を行う通信端末であって、

前記音声データを前記通信端末とネットワークを介して接続された音声認識装置へ送信し、前記音声認識装置から前記音声データの音声認識結果であるテキストデータを受信する通信部と、

前記音声データを再生し、前記音声データが再生されている期間中に前記テキストデータを表示装置に表示させる出力部と、

前記音声データに対する加工を行うか否かを判定する加工判定部と、

前記音声データに対し、前記音声データの再生時間を延ばす加工を行う音声加工部と、を有し、

前記加工判定部は、前記音声データの受信が開始されてから、前記テキストデータを受信するまでの期間が、所定の期間よりも長いとき、前記音声加工部による加工を行うものと判定する、通信端末。 - 前記通信部により、前記音声データの受信が開始されてから、前記テキストデータの受信が完了するまでの期間、受信した前記音声データを保持させるバッファ処理部を有し、

前記出力部は、

前記テキストデータの受信が完了した後に、前記音声データの再生と、前記テキストデータの表示と、を同時に開始する、請求項1記載の通信端末。 - 前記音声加工部は、

加工後の前記音声データの再生時間が、前記音声データの受信が開始されてから、前記テキストデータを受信するまでの期間よりも長くなるように、前記音声データの加工を行い、

前記出力部は、

加工後の前記音声データが再生されている期間中に前記テキストデータを表示装置に表示させる、請求項1又は2記載の通信端末。 - 前記所定の期間は、

前記音声データの受信が開始されてから、前記テキストデータを受信するまでの期間の平均である、請求項2又は3記載の通信端末。 - 前記音声データは、

前記表示装置に表示された画像の画像データ、前記表示装置に対して、入力された文字や画像を示すストローク情報の少なくとも何れかを含むコンテンツデータに含まれる、請求項1乃至4の何れか一項に記載の通信端末。 - 集音装置により集音した音声データの送受信を行う通信端末による通信方法であって、前記通信端末が、

前記音声データを前記通信端末とネットワークを介して接続された音声認識装置へ送信し、前記音声認識装置から前記音声データの音声認識結果であるテキストデータを受信する手順と、

前記音声データを再生し、前記音声データが再生されている期間中に前記テキストデータを表示装置に表示させる手順と、

前記音声データに対する加工を行うか否かを判定する手順と、

前記音声データに対し、前記音声データの再生時間を延ばす加工を行う手順と、を有し、

前記判定する手順において、前記音声データの受信が開始されてから、前記テキストデータを受信するまでの期間が、所定の期間よりも長いとき、前記加工を行う手順による加工を行うものと判定する、通信方法。 - 集音装置により集音した音声データの送受信を行う通信端末において実行される通信プログラムであって、

前記音声データを前記通信端末とネットワークを介して接続された音声認識装置へ送信し、前記音声認識装置から前記音声データの音声認識結果であるテキストデータを受信する処理と、

前記音声データを再生し、前記音声データが再生されている期間中に前記テキストデータを表示装置に表示させる処理と、

前記音声データに対する加工を行うか否かを判定する処理と、

前記音声データに対し、前記音声データの再生時間を延ばす加工を行う処理と、通信端末に実行させ、

前記判定する処理において、前記音声データの受信が開始されてから、前記テキストデータを受信するまでの期間が、所定の期間よりも長いとき、前記加工を行う処理による加工を行うものと判定する、処理を前記通信端末に実行させる、通信プログラム。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017048205A JP6852478B2 (ja) | 2017-03-14 | 2017-03-14 | 通信端末、通信プログラム及び通信方法 |

| US15/900,913 US10468029B2 (en) | 2017-03-14 | 2018-02-21 | Communication terminal, communication method, and computer program product |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017048205A JP6852478B2 (ja) | 2017-03-14 | 2017-03-14 | 通信端末、通信プログラム及び通信方法 |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2018151533A JP2018151533A (ja) | 2018-09-27 |

| JP2018151533A5 JP2018151533A5 (ja) | 2020-11-05 |

| JP6852478B2 true JP6852478B2 (ja) | 2021-03-31 |

Family

ID=63519507

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2017048205A Active JP6852478B2 (ja) | 2017-03-14 | 2017-03-14 | 通信端末、通信プログラム及び通信方法 |

Country Status (2)

| Country | Link |

|---|---|

| US (1) | US10468029B2 (ja) |

| JP (1) | JP6852478B2 (ja) |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11049053B2 (en) | 2018-03-29 | 2021-06-29 | Ricoh Company, Ltd. | Communication terminal, sharing system, communication method, and non-transitory recording medium storing program |

| JP7119939B2 (ja) * | 2018-11-19 | 2022-08-17 | トヨタ自動車株式会社 | 情報処理装置、情報処理方法およびプログラム |

| JP7205697B2 (ja) * | 2019-02-21 | 2023-01-17 | 株式会社リコー | 通信端末、共用システム、表示制御方法およびプログラム |

Family Cites Families (28)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| TW329518B (en) * | 1995-12-08 | 1998-04-11 | Sony Co Ltd | Information data recording-replaying device |

| US5920025A (en) * | 1997-01-09 | 1999-07-06 | Yamaha Corporation | Automatic accompanying device and method capable of easily modifying accompaniment style |

| US7668718B2 (en) * | 2001-07-17 | 2010-02-23 | Custom Speech Usa, Inc. | Synchronized pattern recognition source data processed by manual or automatic means for creation of shared speaker-dependent speech user profile |

| JP2003209600A (ja) * | 2002-01-11 | 2003-07-25 | Canon Inc | 通話システム、通話端末、方法、プログラム、及びコンピュータ読み取り可能な記憶媒体 |

| JP2004304601A (ja) * | 2003-03-31 | 2004-10-28 | Toshiba Corp | Tv電話装置、tv電話装置のデータ送受信方法 |

| US9710819B2 (en) * | 2003-05-05 | 2017-07-18 | Interactions Llc | Real-time transcription system utilizing divided audio chunks |

| JP4127668B2 (ja) * | 2003-08-15 | 2008-07-30 | 株式会社東芝 | 情報処理装置、情報処理方法、およびプログラム |

| KR100629997B1 (ko) * | 2004-02-26 | 2006-09-27 | 엘지전자 주식회사 | 오디오 신호의 인코딩 방법 |

| US8125508B2 (en) * | 2006-01-24 | 2012-02-28 | Lifesize Communications, Inc. | Sharing participant information in a videoconference |

| EP2044804A4 (en) * | 2006-07-08 | 2013-12-18 | Personics Holdings Inc | PERSONAL HEARING AID AND METHOD |

| JP5046589B2 (ja) * | 2006-09-05 | 2012-10-10 | 日本電気通信システム株式会社 | 電話システムと通話補助方法とプログラム |

| US20090037171A1 (en) * | 2007-08-03 | 2009-02-05 | Mcfarland Tim J | Real-time voice transcription system |

| JP2010230948A (ja) * | 2009-03-27 | 2010-10-14 | Hitachi East Japan Solutions Ltd | コンテンツ配信システムおよびテキスト表示方法 |

| WO2011014927A1 (en) * | 2009-08-07 | 2011-02-10 | Access Innovation Media Pty Ltd | System and method for real time text streaming |

| JP5014449B2 (ja) | 2010-02-26 | 2012-08-29 | シャープ株式会社 | 会議システム、情報処理装置、会議支援方法、情報処理方法、及びコンピュータプログラム |

| US8797380B2 (en) * | 2010-04-30 | 2014-08-05 | Microsoft Corporation | Accelerated instant replay for co-present and distributed meetings |

| JP5727777B2 (ja) * | 2010-12-17 | 2015-06-03 | 株式会社東芝 | 会議支援装置および会議支援方法 |

| CN102270449A (zh) * | 2011-08-10 | 2011-12-07 | 歌尔声学股份有限公司 | 参数语音合成方法和系统 |

| US8699677B2 (en) * | 2012-01-09 | 2014-04-15 | Comcast Cable Communications, Llc | Voice transcription |

| GB2502944A (en) * | 2012-03-30 | 2013-12-18 | Jpal Ltd | Segmentation and transcription of speech |

| US20140123178A1 (en) * | 2012-04-27 | 2014-05-01 | Mixaroo, Inc. | Self-learning methods, entity relations, remote control, and other features for real-time processing, storage, indexing, and delivery of segmented video |

| KR101939253B1 (ko) * | 2012-05-21 | 2019-01-16 | 엘지전자 주식회사 | 음성 녹음 중에 탐색을 용이하게 하는 방법 및 이를 구현한 전자기기 |

| EP2901448A4 (en) * | 2012-09-26 | 2016-03-30 | Nokia Technologies Oy | METHOD, APPARATUS AND COMPUTER PROGRAM PRODUCT FOR CREATING AUDIO COMPOSITION SIGNAL |

| US9542936B2 (en) * | 2012-12-29 | 2017-01-10 | Genesys Telecommunications Laboratories, Inc. | Fast out-of-vocabulary search in automatic speech recognition systems |

| KR102063766B1 (ko) * | 2013-09-17 | 2020-01-08 | 엘지전자 주식회사 | 이동 단말기 및 그것의 제어방법 |

| CN103632666B (zh) * | 2013-11-14 | 2016-09-28 | 华为技术有限公司 | 语音识别方法、语音识别设备和电子设备 |

| US9641563B1 (en) | 2015-11-10 | 2017-05-02 | Ricoh Company, Ltd. | Electronic meeting intelligence |

| US11112963B2 (en) * | 2016-05-18 | 2021-09-07 | Apple Inc. | Devices, methods, and graphical user interfaces for messaging |

-

2017

- 2017-03-14 JP JP2017048205A patent/JP6852478B2/ja active Active

-

2018

- 2018-02-21 US US15/900,913 patent/US10468029B2/en active Active

Also Published As

| Publication number | Publication date |

|---|---|

| JP2018151533A (ja) | 2018-09-27 |

| US10468029B2 (en) | 2019-11-05 |

| US20180268819A1 (en) | 2018-09-20 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US20030080973A1 (en) | Image recording and replay apparatus | |

| JP6060989B2 (ja) | 音声録音装置、音声録音方法、及びプログラム | |

| CN101228582B (zh) | 支持音频缩略图功能的音频再现方法及设备 | |

| US10834503B2 (en) | Recording method, recording play method, apparatuses, and terminals | |

| JP2008271157A (ja) | 音声強調装置及び制御プログラム | |

| JP6852478B2 (ja) | 通信端末、通信プログラム及び通信方法 | |

| CN104580888A (zh) | 一种图像处理方法及终端 | |

| JP6280215B2 (ja) | ビデオ会議端末、セカンダリストリームデータアクセス方法およびコンピュータ記憶媒体 | |

| CN103973955A (zh) | 一种信息处理方法及电子设备 | |

| JP4572615B2 (ja) | 情報処理装置および方法、記録媒体、並びにプログラム | |

| JP6801539B2 (ja) | 情報処理システム、情報処理装置、情報処理プログラム及び情報処理方法 | |

| US20100157097A1 (en) | Voice recordable terminal and its image processing method | |

| JP2016063477A (ja) | 会議システム、情報処理方法、及びプログラム | |

| JP2012178028A (ja) | アルバム作成装置、アルバム作成装置の制御方法、及びプログラム | |

| JP7087779B2 (ja) | 端末装置、会議システム、端末装置の制御方法、及びプログラム | |

| JP4191221B2 (ja) | 記録再生装置、同時記録再生制御方法、および同時記録再生制御プログラム | |

| JP2013183280A (ja) | 情報処理装置、撮像装置、及びプログラム | |

| JP6635093B2 (ja) | 画像記録装置、画像記録方法及びプログラム | |

| JP6802264B2 (ja) | 表示装置、出力装置、および情報表示方法 | |

| WO2018225368A1 (ja) | 医療用画像記録装置 | |

| JP2004215123A (ja) | 画像再生装置、画像再生方法及び画像再生プログラム | |

| JP2007047291A (ja) | 音声通訳システムおよび音声通訳方法 | |

| JP7397084B2 (ja) | データ作成方法及びデータ作成プログラム | |

| JP3266761B2 (ja) | 話速変換装置および話速変換装置の利用方法 | |

| JP7051987B2 (ja) | 出力装置および情報表示方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20200116 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20200914 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20201027 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20201104 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20201225 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20210209 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20210222 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 6852478 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |