JP6745879B2 - 身体部内の超音波プローブを追跡するためのシステム - Google Patents

身体部内の超音波プローブを追跡するためのシステム Download PDFInfo

- Publication number

- JP6745879B2 JP6745879B2 JP2018526762A JP2018526762A JP6745879B2 JP 6745879 B2 JP6745879 B2 JP 6745879B2 JP 2018526762 A JP2018526762 A JP 2018526762A JP 2018526762 A JP2018526762 A JP 2018526762A JP 6745879 B2 JP6745879 B2 JP 6745879B2

- Authority

- JP

- Japan

- Prior art keywords

- ultrasound

- image

- probe

- ray image

- processing unit

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus for radiation diagnosis, e.g. combined with radiation therapy equipment

- A61B6/12—Devices for detecting or locating foreign bodies

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus for radiation diagnosis, e.g. combined with radiation therapy equipment

- A61B6/44—Constructional features of apparatus for radiation diagnosis

- A61B6/4417—Constructional features of apparatus for radiation diagnosis related to combined acquisition of different diagnostic modalities

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus for radiation diagnosis, e.g. combined with radiation therapy equipment

- A61B6/52—Devices using data or image processing specially adapted for radiation diagnosis

- A61B6/5211—Devices using data or image processing specially adapted for radiation diagnosis involving processing of medical diagnostic data

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus for radiation diagnosis, e.g. combined with radiation therapy equipment

- A61B6/52—Devices using data or image processing specially adapted for radiation diagnosis

- A61B6/5211—Devices using data or image processing specially adapted for radiation diagnosis involving processing of medical diagnostic data

- A61B6/5223—Devices using data or image processing specially adapted for radiation diagnosis involving processing of medical diagnostic data generating planar views from image data, e.g. extracting a coronal view from a 3D image

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus for radiation diagnosis, e.g. combined with radiation therapy equipment

- A61B6/52—Devices using data or image processing specially adapted for radiation diagnosis

- A61B6/5211—Devices using data or image processing specially adapted for radiation diagnosis involving processing of medical diagnostic data

- A61B6/5229—Devices using data or image processing specially adapted for radiation diagnosis involving processing of medical diagnostic data combining image data of a patient, e.g. combining a functional image with an anatomical image

- A61B6/5247—Devices using data or image processing specially adapted for radiation diagnosis involving processing of medical diagnostic data combining image data of a patient, e.g. combining a functional image with an anatomical image combining images from an ionising-radiation diagnostic technique and a non-ionising radiation diagnostic technique, e.g. X-ray and ultrasound

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus for radiation diagnosis, e.g. combined with radiation therapy equipment

- A61B6/54—Control of apparatus or devices for radiation diagnosis

- A61B6/547—Control of apparatus or devices for radiation diagnosis involving tracking of position of the device or parts of the device

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/08—Detecting organic movements or changes, e.g. tumours, cysts, swellings

- A61B8/0833—Detecting organic movements or changes, e.g. tumours, cysts, swellings involving detecting or locating foreign bodies or organic structures

- A61B8/0841—Detecting organic movements or changes, e.g. tumours, cysts, swellings involving detecting or locating foreign bodies or organic structures for locating instruments

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/08—Detecting organic movements or changes, e.g. tumours, cysts, swellings

- A61B8/0833—Detecting organic movements or changes, e.g. tumours, cysts, swellings involving detecting or locating foreign bodies or organic structures

- A61B8/085—Detecting organic movements or changes, e.g. tumours, cysts, swellings involving detecting or locating foreign bodies or organic structures for locating body or organic structures, e.g. tumours, calculi, blood vessels, nodules

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/08—Detecting organic movements or changes, e.g. tumours, cysts, swellings

- A61B8/0883—Detecting organic movements or changes, e.g. tumours, cysts, swellings for diagnosis of the heart

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/12—Diagnosis using ultrasonic, sonic or infrasonic waves in body cavities or body tracts, e.g. by using catheters

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/42—Details of probe positioning or probe attachment to the patient

- A61B8/4245—Details of probe positioning or probe attachment to the patient involving determining the position of the probe, e.g. with respect to an external reference frame or to the patient

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/42—Details of probe positioning or probe attachment to the patient

- A61B8/4245—Details of probe positioning or probe attachment to the patient involving determining the position of the probe, e.g. with respect to an external reference frame or to the patient

- A61B8/4263—Details of probe positioning or probe attachment to the patient involving determining the position of the probe, e.g. with respect to an external reference frame or to the patient using sensors not mounted on the probe, e.g. mounted on an external reference frame

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/44—Constructional features of the ultrasonic, sonic or infrasonic diagnostic device

- A61B8/4416—Constructional features of the ultrasonic, sonic or infrasonic diagnostic device related to combined acquisition of different diagnostic modalities, e.g. combination of ultrasound and X-ray acquisitions

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/46—Ultrasonic, sonic or infrasonic diagnostic devices with special arrangements for interfacing with the operator or the patient

- A61B8/461—Displaying means of special interest

- A61B8/466—Displaying means of special interest adapted to display 3D data

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/48—Diagnostic techniques

- A61B8/483—Diagnostic techniques involving the acquisition of a 3D volume of data

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/52—Devices using data or image processing specially adapted for diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/5215—Devices using data or image processing specially adapted for diagnosis using ultrasonic, sonic or infrasonic waves involving processing of medical diagnostic data

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/52—Devices using data or image processing specially adapted for diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/5215—Devices using data or image processing specially adapted for diagnosis using ultrasonic, sonic or infrasonic waves involving processing of medical diagnostic data

- A61B8/5238—Devices using data or image processing specially adapted for diagnosis using ultrasonic, sonic or infrasonic waves involving processing of medical diagnostic data for combining image data of patient, e.g. merging several images from different acquisition modes into one image

- A61B8/5261—Devices using data or image processing specially adapted for diagnosis using ultrasonic, sonic or infrasonic waves involving processing of medical diagnostic data for combining image data of patient, e.g. merging several images from different acquisition modes into one image combining images from different diagnostic modalities, e.g. ultrasound and X-ray

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T17/00—Three dimensional [3D] modelling, e.g. data description of 3D objects

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T19/00—Manipulating 3D models or images for computer graphics

- G06T19/20—Editing of 3D images, e.g. changing shapes or colours, aligning objects or positioning parts

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/30—Determination of transform parameters for the alignment of images, i.e. image registration

- G06T7/33—Determination of transform parameters for the alignment of images, i.e. image registration using feature-based methods

- G06T7/344—Determination of transform parameters for the alignment of images, i.e. image registration using feature-based methods involving models

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

- G06T7/75—Determining position or orientation of objects or cameras using feature-based methods involving models

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H50/00—ICT specially adapted for medical diagnosis, medical simulation or medical data mining; ICT specially adapted for detecting, monitoring or modelling epidemics or pandemics

- G16H50/20—ICT specially adapted for medical diagnosis, medical simulation or medical data mining; ICT specially adapted for detecting, monitoring or modelling epidemics or pandemics for computer-aided diagnosis, e.g. based on medical expert systems

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus for radiation diagnosis, e.g. combined with radiation therapy equipment

- A61B6/44—Constructional features of apparatus for radiation diagnosis

- A61B6/4429—Constructional features of apparatus for radiation diagnosis related to the mounting of source units and detector units

- A61B6/4435—Constructional features of apparatus for radiation diagnosis related to the mounting of source units and detector units the source unit and the detector unit being coupled by a rigid structure

- A61B6/4441—Constructional features of apparatus for radiation diagnosis related to the mounting of source units and detector units the source unit and the detector unit being coupled by a rigid structure the rigid structure being a C-arm or U-arm

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus for radiation diagnosis, e.g. combined with radiation therapy equipment

- A61B6/48—Diagnostic techniques

- A61B6/486—Diagnostic techniques involving generating temporal series of image data

- A61B6/487—Diagnostic techniques involving generating temporal series of image data involving fluoroscopy

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10116—X-ray image

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10132—Ultrasound image

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20212—Image combination

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30004—Biomedical image processing

- G06T2207/30048—Heart; Cardiac

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2210/00—Indexing scheme for image generation or computer graphics

- G06T2210/41—Medical

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2219/00—Indexing scheme for manipulating 3D models or images for computer graphics

- G06T2219/20—Indexing scheme for editing of 3D models

- G06T2219/2016—Rotation, translation, scaling

Description

超音波プローブ、

X線画像取得ユニット、及び

処理ユニット

を含む。

少なくとも1つの入力ユニット、及び

処理ユニット

を含む。

a)超音波プローブが位置付けられている身体部の一部のX線画像を取得するステップと、

b)身体部の一部内の超音波プローブの第1の幾何学的位置情報を、X線画像を利用して決定するステップと、

c)身体特徴部を含む少なくとも1つの超音波画像を超音波プローブによって、X線画像の取得時点よりも後の時点に超音波画像を取得することを含めて、取得するステップと、

g)後の時点における身体部内の超音波プローブの第2の幾何学的位置情報を、第1の幾何学的位置情報と、身体特徴部を含む少なくとも1つの超音波画像とを利用して決定するステップと

を有する。

i)超音波プローブの第2の幾何学的位置情報を表すデータを出力するステップ

を有する。

h)第1の幾何学的位置情報及び第2の幾何学的位置情報の関数としてのある閾値が超えられた場合に、超音波プローブが位置されている身体部の一部の第2のX線画像を取得するステップを有する。

d)少なくとも1つの超音波画像を利用して、身体特徴部の少なくとも1つの位置に対して超音波プローブの少なくとも1つの位置を決定するステップを有し、

ステップg)は、身体特徴部の少なくとも1つの位置に対して超音波プローブの少なくとも1つの位置を利用するステップを含む。

e)モデルベースのセグメンテーションを使用する身体特徴部のセグメント化データを、その身体特徴部を含む少なくとも1つの超音波画像を利用して決定するステップを有し、

ステップg)は、身体特徴部のセグメント化データを利用するステップを含む。

f)基準位置としての身体特徴部の位置を、その身体特徴部を含む少なくとも1つの超音波画像を利用して決定するステップを有し、

ステップg)は、身体特徴部の基準位置を利用するステップを含む。

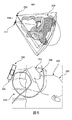

1.超音波プローブは、2D−3D位置合わせによって、X線画像中で位置特定することができる。2D−3D位置合わせにより、X線画像中でプローブの位置及び配向が得られる。

2.たとえば心臓である身体特徴部は、超音波画像においてセグメント化される。超音波画像のセグメンテーションにより、超音波ボリューム内の心臓の輪郭が得られる。

3.X線画像中のプローブの2D−3D位置合わせにより、超音波プローブによって画像化されている超音波ボリュームが分かり、X線画像中で場所を特定することができる。このようにして、たとえば心臓の輪郭をX線画像の上に描くことができる。

1.2D−3D位置合わせを使用してX線画像中のプローブの位置特定するための、プローブの3Dモデルが知られる(たとえば、ナノCT画像を取得することにより)。次に、プローブの所与の推定の配向に対し、モデルの投影像、いわゆるデジタル再構築放射線写真(DRR)が、画像中のプローブが位置特定されるべき実際の1つ又は複数のX線画像と比較される。この処理は数回繰り返され、DDRとX線画像の間の類似性が画像比較メトリックを使用して評価される。自由度(並進運動及び回転)が、DDRとX線画像が最適に一致するように調整される。言い換えると、位置及び配向のパラメータが、DDRとX線画像の間の画像類似メトリックを最大にすることによって最適化される。この位置合わせ処理は、Gaoらの論文、Registration of 3D trans−esophageal echocardiography to X−ray fluoroscopy using image−based probe tracking、Medical Image Analysis 16(2012)、38〜49頁で詳細に論じられている。

2.超音波画像における、たとえば心臓のモデルベースのセグメンテーションは、たとえば、N個の点と、これらの点をつなぐT個の三角形とから成る三角形メッシュである平均モデルを含む。その最初の形状は、たとえば平均的又は典型的な形状を表す。次に、モデルは、いくつかのステップで1つの画像に適合される。まず、一般的な位置(たとえば重心)及び配向が決められ、それに応じて画像にメッシュが配置される。モデル訓練中に、各三角形は、それがどの特定の画像特徴を検索すべきかを学習した。次いで、適合中に、各三角形はこれらの画像特徴を検索して、引力のセットを得る(このセットから、いわゆる外部エネルギーが導き出される)。この外部エネルギーに基づいて、モデルは、大域又は局所アフィン変換のパラメータを推定することによって、連続して適合される(エネルギーが最小化される)。最終ステップで、局所変形が外部力に基づいて可能になる。同時に、いわゆる内部エネルギーが、平均形状からのあまりに大きい偏差にペナルティを科す。複数回の反復の後、メッシュの形状は画像に適合された。どのメッシュ部分がどの解剖学的構造に属するかが分かっているので、これにより解剖学的コンテキストが画像に加わる。CT画像に適用されるが本明細書では超音波画像に適用されているセグメンテーションアルゴリズムが、Ecabertらの論文、Automatic Model−Based Segmentation of the Heart in CT Images、IEEE Transactions on Medical Imaging,Vol.27,No.9、2008年9月、1189〜1201頁で詳細に論じられている。

3.ステップ2で、解剖学的コンテキストが超音波画像において局所的に確立される。ステップ1により、超音波プローブ(したがって、超音波画像の座標系)と大域空間(すなわち、X線画像も)の間の関係が分かっているので、解剖学的コンテキスト(たとえば、セグメンテーションメッシュ又は特別な目印)は、X線画像上に表示することができる。

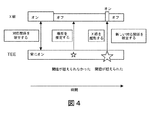

1.X線画像及びTEE画像が取得される瞬間に開始する。

2.TEE画像中で、したがってまた、大域空間内で心臓を検出し(TTEE,Xvolを使用して)、それによって心臓の位置を検出できるようにする。

3.X線画像データがないもっと後の瞬間では、決定された心臓位置を基準として使用する。

4.TEE画像だけのセグメンテーション結果からTEEプローブの動きを検出する。

5.検出されたTEEプローブの動きを使用して、

a.現在のTEEプローブの推定の位置を与える(X線画像を取得せずに)

b.検出されたTEEプローブの動きが特定の閾値を超える場合、新しいX線画像の取得を起動して、TEEプローブの新しい絶対位置を決定する。

c.追跡されたTEEプローブを静止X線画像上にTEEプローブの3Dモデルを使用して仮想的に表示する。

Claims (16)

- 超音波プローブ、X線画像取得ユニット、及び処理ユニットを含む、身体部内の超音波プローブの位置を追跡するためのシステムであって、

前記X線画像取得ユニットは、前記超音波プローブが位置付けられている身体部の一部のX線画像を取得し、

前記処理ユニットは、前記身体部の一部内の前記超音波プローブの第1の幾何学的位置情報を、前記X線画像を利用して決定し、

前記超音波プローブは、身体特徴部を含む少なくとも1つの超音波画像を取得し、前記少なくとも1つの超音波画像は、前記身体部の一部のX線画像の取得時点よりも後の時点に取得される超音波画像を含む、システムにおいて、

前記処理ユニットは、さらに、前記後の時点における前記身体部内の前記超音波プローブの第2の幾何学的位置情報を、前記第1の幾何学的位置情報と、前記身体特徴部を含む前記少なくとも1つの超音波画像とを利用して決定することを特徴とする、システム。 - 前記少なくとも1つの超音波画像は、前記身体部の一部の前記X線画像の取得時点と実質的に同じ時点で取得される超音波画像を含む、請求項1に記載のシステム。

- 前記X線画像取得ユニットは、前記処理ユニットが、前記第1の幾何学的位置情報及び前記第2の幾何学的位置情報の関数としてのある閾値が超えられたと決定する場合に、前記超音波プローブが位置付けられている身体部の一部の第2のX線画像を取得する、請求項1又は2に記載のシステム。

- 前記処理ユニットは、前記少なくとも1つの超音波画像を利用することによって、前記身体特徴部の少なくとも1つの位置に対して前記超音波プローブの少なくとも1つの位置を決定し、前記処理ユニットにより前記超音波プローブの前記第2の幾何学的位置情報を決定することは、前記身体特徴部の前記少なくとも1つの位置に対して前記超音波プローブの前記少なくとも1つの位置を利用することを含む、請求項1乃至3の何れか一項に記載のシステム。

- 前記処理ユニットは、前記身体特徴部を含む前記少なくとも1つの超音波画像を利用することによって、モデルベースのセグメンテーションを使用する前記身体特徴部のセグメント化データを決定し、前記処理ユニットにより前記超音波プローブの前記第2の幾何学的位置情報を決定することは、前記身体特徴部の前記セグメント化データを利用することを含む、請求項1乃至4の何れか一項に記載のシステム。

- 前記処理ユニットは、前記身体特徴部を含む前記少なくとも1つの超音波画像を利用することによって、前記身体特徴部の位置を基準位置として決定し、前記処理ユニットにより前記超音波プローブの前記第2の幾何学的位置情報を決定することは、前記身体特徴部の前記基準位置を利用することを含む、請求項1乃至5何れか一項に記載のシステム。

- 前記処理ユニットにより前記身体部の一部内の前記超音波プローブの第1の幾何学的位置情報を決定することは、前記超音波プローブの三次元モデルの利用を含む、請求項1乃至6の何れか一項に記載のシステム。

- 前記処理ユニットは、前記超音波プローブの前記三次元モデルの投影像と前記X線画像とを比較する、請求項7に記載のシステム。

- 前記処理ユニットは、前記三次元モデルと前記X線画像の間の類似点を、画像比較メトリックを利用して、繰り返し決定する、請求項7又は8に記載のシステム。

- 前記処理ユニットは、前記三次元モデルの位置及び/又は配向を、前記画像比較メトリックを最大にすることによって、最適にする、請求項9に記載のシステム。

- 前記処理ユニットは、前記三次元モデルの少なくとも1つの並進自由度の調整、及び/又は前記三次元モデルの少なくとも1つの回転自由度の調整を含めて、前記三次元モデルと前記X線画像を比較する、請求項7乃至9の何れか一項に記載のシステム。

- 少なくとも1つの入力ユニット及び処理ユニットを含む、身体部内の超音波プローブの位置を追跡するためのワークステーションであって、

前記少なくとも1つの入力ユニットは、超音波プローブが位置付けられた身体部の一部のX線画像を提供し、

前記処理ユニットは、前記身体部の一部内の前記超音波プローブの第1の幾何学的位置情報を、前記X線画像を利用して決定し、

前記少なくとも1つの入力ユニットは、身体特徴部を含む少なくとも1つの超音波画像を提供し、前記少なくとも1つの超音波画像は前記超音波プローブによって取得され、超音波画像は前記身体部の一部の前記X線画像の取得時点よりも後の時点に取得される、ワークステーションにおいて、

前記処理ユニットは、さらに、後の時点における前記身体部内の前記超音波プローブの第2の幾何学的位置情報を、第1の幾何学的位置情報と前記身体特徴部を含む前記少なくとも1つの超音波画像とを利用して決定することを特徴とする、ワークステーション。 - 身体部内の超音波プローブの位置を追跡するための、請求項1乃至11の何れか一項に記載のシステムを動作させる方法であって、

a)前記X線画像取得ユニットが、前記超音波プローブが位置付けされている前記身体部の一部のX線画像を取得するステップと、

b)前記処理ユニットが、前記身体部の一部内の超音波プローブの第1の幾何学的位置情報を、前記X線画像を利用して決定するステップと、

c)前記超音波プローブが、前記X線画像の取得時点よりも後の時点で、前記超音波プローブによって、身体特徴部を含む少なくとも1つの超音波画像を取得するステップと

を含む、方法において、

d)前記処理ユニットが、前記後の時点における前記身体部内の前記超音波プローブの第2の幾何学的位置情報を、前記第1の幾何学的位置情報と前記身体特徴部を含む前記少なくとも1つの超音波画像とを利用して決定するステップを更に有することを特徴とする、方法。 - 身体部内の超音波プローブの位置を追跡するための、請求項12に記載のワークステーションを動作させる方法であって、

a)前記少なくとも1つの入力ユニットが、前記超音波プローブが位置付けられた前記身体部の一部のX線画像を提供するステップと、

b)処理ユニットが、前記身体部の一部内の超音波プローブの第1の幾何学的位置情報を、前記X線画像を利用して決定するステップと、

c)前記少なくとも1つの入力ユニットが、身体的特徴を含む少なくとも1つの超音波画像を提供するステップであり、前記少なくとも1つの超音波画像が前記超音波プローブによって取得され、超音波画像が前記身体部の一部の前記X線画像の取得時点よりも後の時点に取得される当該ステップと

を含む、方法において、

d)前記処理ユニットが、前記後の時点における前記身体部内の前記超音波プローブの第2の幾何学的位置情報を、前記第1の幾何学的位置情報と前記身体特徴部を含む前記少なくとも1つの超音波画像とを利用して決定するステップを更に有することを特徴とする、方法。 - プロセッサにより実行されたとき、請求項13に記載の方法を実施する、請求項1乃至11の何れか一項に記載のシステム、又は、請求項14に記載の方法を実施する、請求項12に記載のワークステーションを制御するための、コンピュータプログラム。

- 請求項15に記載のコンピュータプログラムを記憶した、コンピュータ可読媒体。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP15196173 | 2015-11-25 | ||

| EP15196173.7 | 2015-11-25 | ||

| PCT/EP2016/078756 WO2017089509A1 (en) | 2015-11-25 | 2016-11-25 | System for tracking an ultrasonic probe in a body part |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2019190027A Division JP2020032198A (ja) | 2015-11-25 | 2019-10-17 | 身体部内の超音波プローブを追跡するためのシステム |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2018535019A JP2018535019A (ja) | 2018-11-29 |

| JP2018535019A5 JP2018535019A5 (ja) | 2019-01-24 |

| JP6745879B2 true JP6745879B2 (ja) | 2020-08-26 |

Family

ID=54703893

Family Applications (2)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2018526762A Active JP6745879B2 (ja) | 2015-11-25 | 2016-11-25 | 身体部内の超音波プローブを追跡するためのシステム |

| JP2019190027A Pending JP2020032198A (ja) | 2015-11-25 | 2019-10-17 | 身体部内の超音波プローブを追跡するためのシステム |

Family Applications After (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2019190027A Pending JP2020032198A (ja) | 2015-11-25 | 2019-10-17 | 身体部内の超音波プローブを追跡するためのシステム |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US10426414B2 (ja) |

| EP (1) | EP3349660B1 (ja) |

| JP (2) | JP6745879B2 (ja) |

| CN (1) | CN108289651B (ja) |

| WO (1) | WO2017089509A1 (ja) |

Families Citing this family (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR102114417B1 (ko) * | 2013-06-11 | 2020-05-22 | 삼성메디슨 주식회사 | 영상 정합 방법 및 장치 |

| US10529088B2 (en) * | 2016-12-02 | 2020-01-07 | Gabriel Fine | Automatically determining orientation and position of medically invasive devices via image processing |

| JP2018175227A (ja) * | 2017-04-10 | 2018-11-15 | 富士フイルム株式会社 | 医用画像表示装置、方法およびプログラム |

| US10341456B2 (en) * | 2017-11-20 | 2019-07-02 | Marc Berger | Caching sticker profiles within a sticker communication system |

| JP7204424B2 (ja) * | 2017-11-24 | 2023-01-16 | キヤノンメディカルシステムズ株式会社 | 医用画像診断装置及び医用画像処理装置 |

| JP7258907B2 (ja) * | 2018-03-19 | 2023-04-17 | コーニンクレッカ フィリップス エヌ ヴェ | 複数方式画像化位置合わせ |

| WO2019219861A1 (en) * | 2018-05-18 | 2019-11-21 | Koninklijke Philips N.V. | Multi-modal image registration |

| US11638569B2 (en) | 2018-06-08 | 2023-05-02 | Rutgers, The State University Of New Jersey | Computer vision systems and methods for real-time needle detection, enhancement and localization in ultrasound |

| CN110772280B (zh) * | 2018-07-31 | 2023-05-23 | 佳能医疗系统株式会社 | 超声波诊断装置和方法以及图像处理装置和方法 |

| EP3836843A4 (en) * | 2018-08-13 | 2022-02-16 | Rutgers, the State University of New Jersey | ARTIFICIAL VISION SYSTEMS AND METHODS FOR REAL-TIME LOCATION OF NEEDLES IN ULTRASOUND IMAGES |

| US10820871B1 (en) | 2019-08-09 | 2020-11-03 | GE Precision Healthcare LLC | Mobile X-ray imaging system including a parallel robotic structure |

| CN113303888A (zh) * | 2021-06-25 | 2021-08-27 | 山东大学齐鲁医院(青岛) | 一种超声介入疗法病灶定位装置 |

| CN113712631A (zh) * | 2021-09-02 | 2021-11-30 | 南京广慈医疗科技有限公司 | 一种随机分布三维相控阵探头的制备方法 |

Family Cites Families (16)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP3167367B2 (ja) | 1991-09-09 | 2001-05-21 | 株式会社東芝 | 循環器診断装置 |

| JP3668822B2 (ja) | 1996-11-11 | 2005-07-06 | 株式会社島津製作所 | 医用画像処理装置 |

| EP4197447A1 (en) * | 2004-08-16 | 2023-06-21 | Corindus, Inc. | Image-guided navigation for catheter-based interventions |

| JP4835245B2 (ja) * | 2006-04-19 | 2011-12-14 | 株式会社島津製作所 | 循環器用画像診断装置 |

| US7916919B2 (en) * | 2006-09-28 | 2011-03-29 | Siemens Medical Solutions Usa, Inc. | System and method for segmenting chambers of a heart in a three dimensional image |

| DE102009043069A1 (de) | 2009-09-25 | 2011-04-07 | Siemens Aktiengesellschaft | Visualisierungsverfahren und Bildgebungssystem |

| CN102651999B (zh) | 2009-12-09 | 2015-07-22 | 皇家飞利浦电子股份有限公司 | 超声和x射线系统的组合 |

| US9687204B2 (en) | 2011-05-20 | 2017-06-27 | Siemens Healthcare Gmbh | Method and system for registration of ultrasound and physiological models to X-ray fluoroscopic images |

| CN102824699B (zh) * | 2011-06-13 | 2015-08-05 | 重庆微海软件开发有限公司 | 一种治疗系统及其超声监控方法 |

| US9155470B2 (en) * | 2012-01-24 | 2015-10-13 | Siemens Aktiengesellschaft | Method and system for model based fusion on pre-operative computed tomography and intra-operative fluoroscopy using transesophageal echocardiography |

| US20130303907A1 (en) | 2012-05-11 | 2013-11-14 | Volcano Corporation | Device and System For Imaging and Blood Flow Velocity Measurement |

| JP5677399B2 (ja) * | 2012-10-31 | 2015-02-25 | キヤノン株式会社 | 情報処理装置、情報処理システム、情報処理方法、及びプログラム |

| WO2014072890A1 (en) * | 2012-11-06 | 2014-05-15 | Koninklijke Philips N.V. | Enhancing ultrasound images |

| EP2938260B1 (en) | 2012-12-28 | 2019-11-06 | Koninklijke Philips N.V. | Real-time scene-modeling combining 3d ultrasound and 2d x-ray imagery |

| BR112015018841A2 (pt) * | 2013-02-11 | 2017-07-18 | Koninklijke Philips Nv | sistema de imageamento por ultrassom, método para detectar ao menos um contorno de camada de tecido de um objeto de exame, e, programa de computador |

| WO2014126955A1 (en) | 2013-02-13 | 2014-08-21 | Siemens Aktiengesellschaft | Method and apparatus for image fusion based planning of c-arm angulation for structural heart disease |

-

2016

- 2016-11-25 CN CN201680069152.4A patent/CN108289651B/zh active Active

- 2016-11-25 EP EP16801241.7A patent/EP3349660B1/en active Active

- 2016-11-25 US US15/777,863 patent/US10426414B2/en active Active

- 2016-11-25 WO PCT/EP2016/078756 patent/WO2017089509A1/en active Application Filing

- 2016-11-25 JP JP2018526762A patent/JP6745879B2/ja active Active

-

2019

- 2019-10-17 JP JP2019190027A patent/JP2020032198A/ja active Pending

Also Published As

| Publication number | Publication date |

|---|---|

| US20180333112A1 (en) | 2018-11-22 |

| EP3349660A1 (en) | 2018-07-25 |

| WO2017089509A1 (en) | 2017-06-01 |

| US10426414B2 (en) | 2019-10-01 |

| JP2020032198A (ja) | 2020-03-05 |

| CN108289651B (zh) | 2019-07-12 |

| EP3349660B1 (en) | 2019-03-27 |

| CN108289651A (zh) | 2018-07-17 |

| JP2018535019A (ja) | 2018-11-29 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6745879B2 (ja) | 身体部内の超音波プローブを追跡するためのシステム | |

| JP7195279B2 (ja) | 画像の三次元再構成及び改善された対象物定位のために、放射状気管支内超音波プローブを用いるための方法 | |

| US9811913B2 (en) | Method for 2D/3D registration, computational apparatus, and computer program | |

| US9265468B2 (en) | Fluoroscopy-based surgical device tracking method | |

| US8126239B2 (en) | Registering 2D and 3D data using 3D ultrasound data | |

| JP5243754B2 (ja) | 画像データの位置合わせ | |

| US6782287B2 (en) | Method and apparatus for tracking a medical instrument based on image registration | |

| US20080300478A1 (en) | System and method for displaying real-time state of imaged anatomy during a surgical procedure | |

| JP6316572B2 (ja) | 体内プローブ追跡システムにおける患者の動きの補正 | |

| JP5547070B2 (ja) | 対象の骨の取り込み投影画像におけるモーションアーチファクトを修正するための方法、および画像処理システム、コンピュータプログラムコード、およびコンピュータ読み取り可能な媒体 | |

| JP5896737B2 (ja) | 呼吸測定器、呼吸測定器の作動方法、及び呼吸測定コンピュータプログラム | |

| WO2015051622A1 (zh) | 超声融合成像方法、超声融合成像导航系统 | |

| JP2009022754A (ja) | 放射線画像の位置揃えを補正する方法 | |

| JP2014509895A (ja) | 血管インターベンションプロシージャにおいてインターベンション装置の正確な誘導を支援する画像表示を提供する画像診断システム及び方法 | |

| CN110301883B (zh) | 用于导航管状网络的基于图像的向导 | |

| JP6349278B2 (ja) | 放射線撮像装置、画像処理方法及びプログラム | |

| CN114886560A (zh) | 使用标准荧光镜进行局部三维体积重建的系统和方法 | |

| US20150015582A1 (en) | Method and system for 2d-3d image registration | |

| CN108430376B (zh) | 提供投影数据集 | |

| Choi et al. | X-ray and magnetic resonance imaging fusion for cardiac resynchronization therapy | |

| Gao et al. | Rapid image registration of three-dimensional transesophageal echocardiography and X-ray fluoroscopy for the guidance of cardiac interventions | |

| WO2016131955A1 (en) | Automatic 3d model based tracking of deformable medical devices with variable appearance | |

| TWI836493B (zh) | 註冊二維影像資料組與感興趣部位的三維影像資料組的方法及導航系統 | |

| TWI836492B (zh) | 註冊二維影像資料組與感興趣部位的三維影像資料組的方法及導航系統 | |

| TWI836491B (zh) | 註冊二維影像資料組與感興趣部位的三維影像資料組的方法及導航系統 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20181206 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20181206 |

|

| A871 | Explanation of circumstances concerning accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A871 Effective date: 20181206 |

|

| A975 | Report on accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A971005 Effective date: 20181214 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20190108 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20190404 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20190618 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20200804 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6745879 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |