JP6739064B1 - 撮像装置 - Google Patents

撮像装置 Download PDFInfo

- Publication number

- JP6739064B1 JP6739064B1 JP2020006969A JP2020006969A JP6739064B1 JP 6739064 B1 JP6739064 B1 JP 6739064B1 JP 2020006969 A JP2020006969 A JP 2020006969A JP 2020006969 A JP2020006969 A JP 2020006969A JP 6739064 B1 JP6739064 B1 JP 6739064B1

- Authority

- JP

- Japan

- Prior art keywords

- subject

- sound collection

- sound

- target

- unit

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/50—Constructional details

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/67—Focus control based on electronic image sensor signals

- H04N23/671—Focus control based on electronic image sensor signals in combination with active ranging signals, e.g. using light or sound signals emitted toward objects

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/50—Constructional details

- H04N23/53—Constructional details of electronic viewfinders, e.g. rotatable or detachable

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/50—Constructional details

- H04N23/55—Optical parts specially adapted for electronic image sensors; Mounting thereof

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/57—Mechanical or electrical details of cameras or camera modules specially adapted for being embedded in other devices

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/58—Means for changing the camera field of view without moving the camera body, e.g. nutating or panning of optics or image sensors

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/61—Control of cameras or camera modules based on recognised objects

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/61—Control of cameras or camera modules based on recognised objects

- H04N23/611—Control of cameras or camera modules based on recognised objects where the recognised objects include parts of the human body

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/63—Control of cameras or camera modules by using electronic viewfinders

- H04N23/631—Graphical user interfaces [GUI] specially adapted for controlling image capture or setting capture parameters

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/63—Control of cameras or camera modules by using electronic viewfinders

- H04N23/633—Control of cameras or camera modules by using electronic viewfinders for displaying additional information relating to control or operation of the camera

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/667—Camera operation mode switching, e.g. between still and video, sport and normal or high- and low-resolution modes

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/67—Focus control based on electronic image sensor signals

- H04N23/675—Focus control based on electronic image sensor signals comprising setting of focusing regions

Abstract

Description

実施の形態1では、本開示に係る撮像装置の一例として、画像認識技術に基づいて被写体を検出し、検出した被写体の大きさに応じた収音エリアの制御、及び収音する音声を強調する収音ゲインの制御を行うデジタルカメラについて説明する。

スルー画像、動画像及び静止画像は、それぞれ本実施形態における撮像画像の一例である。イメージセンサ115は、本実施形態における撮像部の一例である。

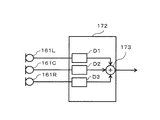

本実施形態におけるビーム形成部172の詳細を、以下説明する。

図3は、デジタルカメラ100において定義される収音エリアの例を示す。図3は、収音エリアを、デジタルカメラ100を中心とする円の扇形領域によって例示しており、X,YおよびZ軸は、それぞれデジタルカメラ100の水平画角方向、垂直画角方向および光学系110におけるレンズの光軸方向に対応する。本実施形態のデジタルカメラ100では、水平画角方向は、マイクロフォン素子161R,161Cおよび161Rが並ぶ方向と一致する。

以上のように構成されるデジタルカメラ100の動作について説明する。以下では、デジタルカメラ100による動画撮影時の動作を説明する。

コントローラ135は、バッファメモリ125を介して、画像処理エンジン120から受け付ける画像データと音声処理エンジン170から受け付ける音声データとの間で、同期を取って動画をメモリカード142に記録する。また、コントローラ135は逐次、表示モニタ130にスルー画像を表示させる。ユーザは、表示モニタ130のスルー画像により随時、撮影の構図等を確認することができる。動画撮影の動作は、操作部150におけるユーザの操作に応じて開始/終了される。

図4及び図5を用いて、本実施形態に係るデジタルカメラ100の動作の概要を説明する。

図4のステップS3における収音対象の選別処理の詳細を、図6〜7を用いて説明する。

図4のステップS4における収音エリアの決定処理の詳細を、図8〜9を用いて説明する。

(1)図4のステップS5について

図4のステップS5における顔認識を用いた収音制御の詳細を、図10〜12を用いて説明する。

図4のステップS6における顔認識を用いない収音制御(S6)の詳細を、図13を用いて説明する。

図14を用いて、本実施形態に係るデジタルカメラ100が各種情報を表示する動作の概要を説明する。

図15は、本実施形態に係るデジタルカメラ100の動作を例示するフローチャートである。図15のフローチャートに示す各処理は、実施の形態1における図4のフローチャートと同様に、例えばデジタルカメラ100のコントローラ135によって実行される。図15におけるステップS2,S4〜S6の処理は実施の形態1(図4)と同様であり、以下ではその説明を省略する。

図18は、本実施形態のデジタルカメラ100における収音対象の選別処理(図15のS3A)を例示するフローチャートである。以下、図15のステップS52において収音対象の追加または除外操作が入力された(S52でYES)場合の例について説明する。本実施形態では、実施の形態1における図6のフローチャートに示す処理に加え、ステップS52で入力された操作に応じて収音対象を決定する処理が実行される。図18におけるステップS10〜S12,S13〜S17の処理は実施の形態1(図6)と同様であり、以下ではその説明を省略する。

図15のステップS51における収音対象の表示処理(S51)の詳細を、図19を用いて説明する。

以上のように、上記の実施の形態のデジタルカメラ100は、表示モニタ130(表示部)と、イメージセンサ115(撮像部)と、マイク用のA/Dコンバータ165(音声取得部)と、顔認識部122(検出部)と、コントローラ135(制御部)とを備える。表示モニタ130は、情報を表示する。イメージセンサ115は、被写体を撮像して画像データを生成する。マイク用のA/Dコンバータ165は、イメージセンサ115による撮像中に収音される音声を示す音声信号を取得する。顔認識部122は、イメージセンサ115によって生成された画像データにおいて、被写体に対応する被写体領域の一例として顔領域R1,R2及びR3を検出する。コントローラ135は、顔認識部122によって検出された顔領域R1〜R3に応じて、音声信号における収音対象とする被写体及びAF対象の被写体(主要被写体)を決定する。コントローラ135は、顔認識部122によって複数の顔領域R1〜R3が検出されたとき、AF対象で且つ収音対象とする被写体を示すAF枠11及び収音アイコン12(第1の識別情報)と、主要被写体とは異なる被写体で且つ収音対象を示す検出枠13及び収音アイコン12(第2の識別情報)とを区別して表示モニタ130に表示するように制御する(S1A,S51)。

以上のように、本出願において開示する技術の例示として、上記の各実施の形態を説明した。しかしながら、本開示における技術は、これに限定されず、適宜、変更、置き換え、付加、省略などを行った実施の形態にも適用可能である。また、上記の各実施の形態で説明した各構成要素を組み合わせて、新たな実施の形態とすることも可能である。

115 イメージセンサ

120 画像処理エンジン

122 顔認識部

125 バッファメモリ

130 表示モニタ

135 コントローラ

145 フラッシュメモリ

150 操作部

11 AF枠

12,12A,12B 収音アイコン

13 検出枠

Claims (10)

- 情報を表示する表示部と、

被写体を撮像して画像データを生成する撮像部と、

前記撮像部による撮像中に収音される音声を示す音声信号を取得する音声取得部と、

前記画像データにおいて前記被写体に対応する被写体領域を検出する検出部と、

前記検出部によって検出された被写体領域に応じて、前記音声信号における収音対象とする被写体及び主要被写体を決定する制御部と

を備え、

前記制御部は、

前記検出部によって複数の被写体領域が検出されたとき、前記主要被写体で且つ収音対象とする被写体を示す第1の識別情報と、前記主要被写体とは異なる被写体で且つ前記収音対象を示す第2の識別情報とを区別して、前記表示部に表示するように制御する

撮像装置。 - 前記制御部は、前記収音対象ではない被写体を示す第3の識別情報を、前記第1の識別情報及び前記第2の識別情報と区別して、前記表示部に表示させる

請求項1に記載の撮像装置。 - 前記第1の識別情報は、前記主要被写体であるか否かを示す第1の識別表示において前記主要被写体と識別して、且つ前記収音対象であるか否かを示す第2の識別表示において前記収音対象と識別し、

前記第2の識別情報は、前記第1の識別表示において前記主要被写体でないと識別して、且つ前記第2の識別表示において前記収音対象と識別し、

前記第3の識別情報は、前記第1の識別表示において前記主要被写体でないと識別して、且つ前記第2の識別表示において前記収音対象でないと識別する

請求項2に記載の撮像装置。 - 前記表示部に表示された情報に基づいて、前記収音対象から特定の被写体を除外するユーザ操作と、特定の被写体を前記収音対象に追加するユーザ操作との少なくとも一方を入力する操作部をさらに備える、

請求項1から3のいずれか1つに記載の撮像装置。 - 前記制御部は、

前記被写体領域の大きさに応じて、前記収音対象とする被写体を決定し、

前記収音対象に決定した被写体を含めるように、前記音声信号において前記被写体からの音声を収音する収音エリアを制御する

請求項1から4のいずれか1つに記載の撮像装置。 - 前記検出部は、前記被写体領域として前記画像データにおける人の顔領域を検出する

請求項1から5のいずれか1つに記載の撮像装置。 - 前記制御部は、前記主要被写体に合焦するように、前記撮像部の撮像動作を制御する

請求項1から6のいずれか1つに記載の撮像装置。 - 情報を表示する表示部と、

被写体を撮像して画像データを生成する撮像部と、

前記撮像部による撮像中に収音される音声を示す音声信号を取得する音声取得部と、 前記画像データにおいて前記被写体に対応する被写体領域を検出する検出部と、

前記検出部によって検出された被写体領域に応じて、前記音声信号における収音対象としない被写体及び主要被写体を決定する制御部と

を備え、

前記制御部は、

前記検出部によって複数の被写体領域が検出されたとき、前記主要被写体で且つ前記収音対象とする被写体を示す第1の識別情報と、前記主要被写体とは異なる被写体で且つ前記収音対象としない被写体を示す第3の識別情報とを区別して、前記表示部に表示するように制御する

撮像装置。 - 情報を表示する表示部と、

被写体を撮像して画像データを生成する撮像部と、

前記撮像部による撮像中に収音される音声を示す音声信号を取得する音声取得部と、

前記画像データにおいて前記被写体に対応する被写体領域を検出する検出部と、

前記検出部によって検出された被写体領域に応じて、前記音声信号における収音対象とする被写体、前記音声信号における収音対象としない被写体及び主要被写体を決定する制御部と

を備え、

前記制御部は、

前記検出部によって複数の被写体領域が検出されたとき、前記主要被写体で且つ前記収音対象とする第1の被写体と、前記主要被写体とは異なり且つ前記収音対象とする第2の被写体と、前記主要被写体とは異なり且つ前記収音対象としない第3の被写体とを夫々区分する情報を前記表示部に表示するように制御する

撮像装置。 - 前記表示部に表示された情報に基づいて、前記収音対象から特定の被写体を除外するユーザ操作と、特定の被写体を前記収音対象に追加するユーザ操作との少なくとも一方を入力する操作部をさらに備える、

請求項8又は9に記載の撮像装置。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2020006969A JP6739064B1 (ja) | 2020-01-20 | 2020-01-20 | 撮像装置 |

| CN202011513532.7A CN113141448B (zh) | 2020-01-20 | 2020-12-18 | 摄像装置 |

| US17/150,283 US11258940B2 (en) | 2020-01-20 | 2021-01-15 | Imaging apparatus |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2020006969A JP6739064B1 (ja) | 2020-01-20 | 2020-01-20 | 撮像装置 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP6739064B1 true JP6739064B1 (ja) | 2020-08-12 |

| JP2021114716A JP2021114716A (ja) | 2021-08-05 |

Family

ID=71949354

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2020006969A Active JP6739064B1 (ja) | 2020-01-20 | 2020-01-20 | 撮像装置 |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US11258940B2 (ja) |

| JP (1) | JP6739064B1 (ja) |

| CN (1) | CN113141448B (ja) |

Families Citing this family (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2022051280A (ja) * | 2020-09-18 | 2022-03-31 | キヤノン株式会社 | 焦点調節装置及び方法、及び撮像装置 |

| US11671696B2 (en) | 2021-04-19 | 2023-06-06 | Apple Inc. | User interfaces for managing visual content in media |

| US11696017B2 (en) * | 2021-05-19 | 2023-07-04 | Apple Inc. | User interface for managing audible descriptions for visual media |

| US11917293B2 (en) | 2021-07-08 | 2024-02-27 | Panasonic Intellectual Property Management Co., Ltd. | Imaging device |

| CN115942108A (zh) * | 2021-08-12 | 2023-04-07 | 北京荣耀终端有限公司 | 一种视频处理方法及电子设备 |

Family Cites Families (27)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4941895B2 (ja) * | 2007-04-19 | 2012-05-30 | カシオ計算機株式会社 | 音データ付き画像記録装置及びプログラム |

| JP4896838B2 (ja) * | 2007-08-31 | 2012-03-14 | カシオ計算機株式会社 | 撮像装置、画像検出装置及びプログラム |

| US8218033B2 (en) | 2007-09-10 | 2012-07-10 | Sanyo Electric Co., Ltd. | Sound corrector, sound recording device, sound reproducing device, and sound correcting method |

| JP2009156888A (ja) | 2007-12-25 | 2009-07-16 | Sanyo Electric Co Ltd | 音声補正装置及びそれを備えた撮像装置並びに音声補正方法 |

| JP5214394B2 (ja) | 2008-10-09 | 2013-06-19 | オリンパスイメージング株式会社 | カメラ |

| US20100123785A1 (en) * | 2008-11-17 | 2010-05-20 | Apple Inc. | Graphic Control for Directional Audio Input |

| JP2010200084A (ja) * | 2009-02-26 | 2010-09-09 | Nikon Corp | 撮像装置 |

| JP5801026B2 (ja) * | 2009-05-28 | 2015-10-28 | 株式会社ザクティ | 画像音響処理装置及び撮像装置 |

| JP2010283706A (ja) * | 2009-06-08 | 2010-12-16 | Hitachi Ltd | ビデオカメラ |

| JP2011041096A (ja) * | 2009-08-14 | 2011-02-24 | Nec Corp | 携帯端末、並びにこれに用いる集音制御方法及びプログラム |

| JP2011071962A (ja) * | 2009-08-28 | 2011-04-07 | Sanyo Electric Co Ltd | 撮像装置及び再生装置 |

| KR20110038313A (ko) * | 2009-10-08 | 2011-04-14 | 삼성전자주식회사 | 영상촬영장치 및 그 제어방법 |

| JP5748422B2 (ja) * | 2010-06-29 | 2015-07-15 | 株式会社ザクティ | 電子機器 |

| WO2012063103A1 (en) * | 2010-11-12 | 2012-05-18 | Nokia Corporation | An Audio Processing Apparatus |

| JP5857674B2 (ja) * | 2010-12-22 | 2016-02-10 | 株式会社リコー | 画像処理装置、及び画像処理システム |

| JP5929535B2 (ja) * | 2012-06-13 | 2016-06-08 | ソニー株式会社 | エフェクト制御装置、エフェクト制御方法、およびプログラム |

| EP2680616A1 (en) * | 2012-06-25 | 2014-01-01 | LG Electronics Inc. | Mobile terminal and audio zooming method thereof |

| EP2958339B1 (en) * | 2013-02-15 | 2019-09-18 | Panasonic Intellectual Property Management Co., Ltd. | Directionality control system and directionality control method |

| JP2014200058A (ja) * | 2013-03-11 | 2014-10-23 | パナソニック株式会社 | 電子機器 |

| KR102089638B1 (ko) * | 2013-08-26 | 2020-03-16 | 삼성전자주식회사 | 전자장치의 음성 녹음 방법 및 장치 |

| CA2874715C (en) * | 2014-12-15 | 2022-03-15 | Ibm Canada Limited - Ibm Canada Limitee | Dynamic video and sound adjustment in a video conference |

| US10027888B1 (en) * | 2015-09-28 | 2018-07-17 | Amazon Technologies, Inc. | Determining area of interest in a panoramic video or photo |

| WO2017163688A1 (en) * | 2016-03-24 | 2017-09-28 | Panasonic Intellectual Property Management Co., Ltd. | Monitoring system and monitoring method |

| KR102465227B1 (ko) * | 2016-05-30 | 2022-11-10 | 소니그룹주식회사 | 영상 음향 처리 장치 및 방법, 및 프로그램이 저장된 컴퓨터 판독 가능한 기록 매체 |

| US20180070008A1 (en) * | 2016-09-08 | 2018-03-08 | Qualcomm Incorporated | Techniques for using lip movement detection for speaker recognition in multi-person video calls |

| CN107360387A (zh) * | 2017-07-13 | 2017-11-17 | 广东小天才科技有限公司 | 一种视频录制的方法、装置及终端设备 |

| US10778900B2 (en) * | 2018-03-06 | 2020-09-15 | Eikon Technologies LLC | Method and system for dynamically adjusting camera shots |

-

2020

- 2020-01-20 JP JP2020006969A patent/JP6739064B1/ja active Active

- 2020-12-18 CN CN202011513532.7A patent/CN113141448B/zh active Active

-

2021

- 2021-01-15 US US17/150,283 patent/US11258940B2/en active Active

Also Published As

| Publication number | Publication date |

|---|---|

| CN113141448A (zh) | 2021-07-20 |

| JP2021114716A (ja) | 2021-08-05 |

| CN113141448B (zh) | 2024-03-19 |

| US20210227145A1 (en) | 2021-07-22 |

| US11258940B2 (en) | 2022-02-22 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6739064B1 (ja) | 撮像装置 | |

| JP4497211B2 (ja) | 撮像装置、撮像方法及びプログラム | |

| JP6271990B2 (ja) | 画像処理装置、画像処理方法 | |

| JP4582423B2 (ja) | 撮像装置、画像処理装置、撮像方法、及び画像処理方法 | |

| US10070038B2 (en) | Image processing apparatus and method calculates distance information in a depth direction of an object in an image using two images whose blur is different | |

| JP5036599B2 (ja) | 撮像装置 | |

| JP2009027298A (ja) | 撮像装置および撮像装置の制御方法 | |

| CN108462830B (zh) | 摄像装置及摄像装置的控制方法 | |

| JP5371845B2 (ja) | 撮影装置及びその表示制御方法並びに3次元情報取得装置 | |

| JP2008271240A (ja) | 撮像装置、画像処理装置、撮像方法、及び画像処理方法 | |

| JP5901782B2 (ja) | 画像処理装置、撮像装置、画像処理方法及び画像処理プログラム | |

| EP2866430B1 (en) | Imaging apparatus and its control method and program | |

| US10412321B2 (en) | Imaging apparatus and image synthesis method | |

| JP5144724B2 (ja) | 撮像装置、画像処理装置、撮像方法、及び画像処理方法 | |

| JP2011175281A (ja) | 撮像装置及びそのプログラム | |

| JP2011217103A (ja) | 複眼撮影方法および装置 | |

| JP7209358B2 (ja) | 撮像装置 | |

| KR20140116014A (ko) | 화상 취득 장치, 화상 취득 방법 및 기록매체 | |

| JP5117889B2 (ja) | 画像処理装置及び画像処理方法 | |

| US11490001B2 (en) | Imaging apparatus | |

| JP6793369B1 (ja) | 撮像装置 | |

| JP2003241066A (ja) | カメラ | |

| JP7204387B2 (ja) | 画像処理装置およびその制御方法 | |

| JP6486453B2 (ja) | 画像処理装置、画像処理方法、プログラム | |

| JP4771524B2 (ja) | 撮像装置及びそのプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20200304 |

|

| A871 | Explanation of circumstances concerning accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A871 Effective date: 20200304 |

|

| A975 | Report on accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A971005 Effective date: 20200529 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20200602 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20200616 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20200630 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20200703 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 6739064 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |