JP6610185B2 - 画像処理装置 - Google Patents

画像処理装置 Download PDFInfo

- Publication number

- JP6610185B2 JP6610185B2 JP2015222049A JP2015222049A JP6610185B2 JP 6610185 B2 JP6610185 B2 JP 6610185B2 JP 2015222049 A JP2015222049 A JP 2015222049A JP 2015222049 A JP2015222049 A JP 2015222049A JP 6610185 B2 JP6610185 B2 JP 6610185B2

- Authority

- JP

- Japan

- Prior art keywords

- viewpoint position

- user

- video

- image

- terminal

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Description

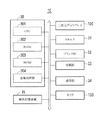

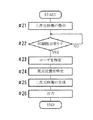

図1には第1の実施形態の画像処理装置1の構成が示されている。また、図2には視点位置特定部13の構成の例が、図3にはオブジェクトの三次元データ110の例が、図4にはオブジェクトが配置された全体座標系とユーザUの視座標系との関係の例が、図5には提示された三次元映像120に対するユーザUの視点位置S1の例が、図6には各視点位置でのオブジェクトの二次元映像152の例が、それぞれ示されている。

〔第2の実施形態〕

次に、第2の実施形態の画像処理装置1Bについて説明する。

〔複合機としての実施形態〕

次に、上に述べた画像処理装置1,1Bを、コピー機、プリンタ、およびファクシミリ機などの機能を集約した複合機として実施した形態について説明する。つまり、本実施形態の複合機1Cは、上に述べた画像処理装置1,1Bの機能を備えたMFP(Multi-functional Peripheral :多機能機)であるが、画像処理装置1,1Bの機能については既に説明したのでここでの説明は省略する。

1C 複合機(画像処理装置)

11 記憶部

12 三次元映像提示部(三次元映像提示手段)

12C 三次元ディスプレイ(三次元映像提示手段)

13 視点位置特定部(視点位置特定手段)

14 二次元映像生成部(二次元映像生成手段)

15 出力部(出力手段)

16 出力指示部

17 端末指令受信部(端末指令受信手段)

21,21C 携帯端末

30 制御部

110 三次元データ

120 三次元映像

130 ユーザ画像処理部(ユーザ画像処理手段)

131 ユーザ特定部(ユーザ特定手段)

132a〜d カメラ

133a〜d カメラ

140 二次元映像

152,153 二次元映像

S1 視点位置

S3a 端末位置情報

S3b 写真画像

S3c 拡大縮小情報

Claims (10)

- オブジェクトの三次元データに基づいて、ユーザの視点位置の移動によって当該オブジェクトの見え方が変化する三次元映像を、ユーザに提示する三次元映像提示手段と、

提示された前記三次元映像に対するユーザの視点位置を特定する視点位置特定手段と、

前記視点位置特定手段により特定された視点位置から見たときの前記オブジェクトの二次元映像を前記三次元データに基づいて生成する二次元映像生成手段と、

前記二次元映像を所定の形式で出力する出力手段と、

ユーザが保持する携帯端末から無線通信によって送信される端末指令を受信する端末指令受信手段とを有し、

前記端末指令受信手段は、当該携帯端末において検出された端末位置情報および当該携帯端末において撮影された前記三次元映像の写真画像を含む前記端末指令を受信したときに、前記端末位置情報および前記写真画像を前記視点位置特定手段に送り、

前記視点位置特定手段は、前記端末位置情報および前記写真画像に基づいて前記視点位置を特定する、

ことを特徴とする画像処理装置。 - オブジェクトの三次元データに基づいて、ユーザの視点位置の移動によって当該オブジェクトの見え方が変化する三次元映像を、ユーザに提示する三次元映像提示手段と、

提示された前記三次元映像に対するユーザの視点位置を特定する視点位置特定手段と、

前記視点位置特定手段により特定された視点位置から見たときの前記オブジェクトの二次元映像を前記三次元データに基づいて生成する二次元映像生成手段と、

前記二次元映像を所定の形式で出力する出力手段と、

ユーザが保持する携帯端末から無線通信によって送信される端末指令を受信する端末指令受信手段とを有し、

前記端末指令受信手段は、当該携帯端末において検出された端末位置情報を含む前記端末指令を受信したときに、前記端末位置情報を前記視点位置特定手段に送り、前記携帯端末において撮影された前記三次元映像およびその背景の写真画像を含む前記端末指令を受信したときに、前記写真画像を前記二次元映像生成手段に送り、

前記二次元映像生成手段は、前記三次元データに基づいて生成した前記オブジェクトの前記二次元映像と前記写真画像に含まれる背景とを合成して得られる二次元画像を生成し、

前記視点位置特定手段は、前記端末位置情報に基づいて前記視点位置を特定する、

ことを特徴とする画像処理装置。 - 前記視点位置特定手段は、

前記三次元映像提示手段の近辺に配置され、前記三次元映像提示手段により提示された前記三次元映像を見ているユーザを撮影するカメラと、

前記カメラによって撮影された画像におけるユーザの眼球の位置に基づいて前記視点位置を特定するユーザ画像処理手段と、

を有する請求項1または2記載の画像処理装置。 - 前記カメラとして複数のカメラが設けられ、

前記ユーザ画像処理手段は、前記複数のカメラによって撮影された複数の画像に基づいて、前記視点位置を特定する、

請求項3記載の画像処理装置。 - 前記ユーザ画像処理手段は、前記ユーザについて設定された左右いずれかの眼球の位置に基づいて前記視点位置を特定する、

請求項4記載の画像処理装置。 - 前記カメラによって撮影される画像に複数のユーザが写っているときに、そのうちの1人を前記視点位置を特定するためのユーザとして特定するユーザ特定手段を有する、

請求項3ないし5のいずれかに記載の画像処理装置。 - 前記ユーザ特定手段は、

前記出力手段に出力させるための出力指示が与えられたときに、当該出力指示に関連した動作を行ったユーザを、前記視点位置を特定するためのユーザとして特定する、

請求項6記載の画像処理装置。 - 前記端末指令受信手段は、拡大縮小情報を含む前記端末指令を受信したときに、前記拡大縮小情報を前記出力手段に送り、

前記出力手段は、前記拡大縮小情報に基づいて拡大または縮小された前記二次元映像を出力する、

請求項1または2記載の画像処理装置。 - 前記出力手段は、前記視点位置と前記三次元映像との距離がより大きい場合に、前記二次元映像の拡大率をより大きくして出力する、

請求項1ないし8のいずれかに記載の画像処理装置。 - 前記出力手段は、前記二次元映像をシート状の用紙に印刷する印刷装置である、

請求項1ないし9のいずれかに記載の画像処理装置。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015222049A JP6610185B2 (ja) | 2015-11-12 | 2015-11-12 | 画像処理装置 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015222049A JP6610185B2 (ja) | 2015-11-12 | 2015-11-12 | 画像処理装置 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2017087610A JP2017087610A (ja) | 2017-05-25 |

| JP6610185B2 true JP6610185B2 (ja) | 2019-11-27 |

Family

ID=58766867

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2015222049A Active JP6610185B2 (ja) | 2015-11-12 | 2015-11-12 | 画像処理装置 |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP6610185B2 (ja) |

Family Cites Families (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2004030408A (ja) * | 2002-06-27 | 2004-01-29 | Mitsubishi Research Institute Inc | 三次元画像表示装置及び表示方法 |

| JP2005100367A (ja) * | 2003-09-02 | 2005-04-14 | Fuji Photo Film Co Ltd | 画像生成装置、画像生成方法、及び画像生成プログラム |

| JP4926826B2 (ja) * | 2007-05-25 | 2012-05-09 | キヤノン株式会社 | 情報処理方法および情報処理装置 |

| JP6058282B2 (ja) * | 2011-05-19 | 2017-01-11 | 東芝メディカルシステムズ株式会社 | 医用画像診断装置及び画像処理装置 |

| JP2013250757A (ja) * | 2012-05-31 | 2013-12-12 | Canon Inc | 画像処理装置、画像処理方法及びプログラム |

| JP5838179B2 (ja) * | 2013-04-30 | 2016-01-06 | 京セラドキュメントソリューションズ株式会社 | 印刷プレビュープログラムおよび電子機器 |

-

2015

- 2015-11-12 JP JP2015222049A patent/JP6610185B2/ja active Active

Also Published As

| Publication number | Publication date |

|---|---|

| JP2017087610A (ja) | 2017-05-25 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP4072674B2 (ja) | 画像処理装置および方法、記録媒体、並びにプログラム | |

| EP2346263B1 (en) | GUI providing method, and display apparatus and 3D image providing system using the same | |

| US8872892B2 (en) | Image processing apparatus and image processing method as well as image processing system for processing viewpoint images with parallax to synthesize a 3D image | |

| JP4488996B2 (ja) | 多視点画像作成装置、多視点画像作成方法および多視点画像作成プログラム | |

| US9741152B2 (en) | Image processing apparatus, image processing method, and computer program | |

| EP2597502A1 (en) | Imaging device, method for controlling same, and program | |

| US9270934B2 (en) | 3D video communication apparatus and method for video processing of 3D video communication apparatus | |

| JP5577931B2 (ja) | 画像処理装置、画像処理方法およびプログラム | |

| CN114286142A (zh) | 一种虚拟现实设备及vr场景截屏方法 | |

| KR20150003576A (ko) | 삼차원 영상 생성 또는 재생을 위한 장치 및 방법 | |

| WO2017118662A1 (en) | Spherical virtual reality camera | |

| JP4717853B2 (ja) | ファイル生成方法および装置並びに立体画像の表示制御方法および装置 | |

| JP2012015619A (ja) | 立体表示装置及び立体撮影装置 | |

| JP6610185B2 (ja) | 画像処理装置 | |

| JP4129786B2 (ja) | 画像処理装置および方法、記録媒体、並びにプログラム | |

| JP2006211383A (ja) | 立体画像処理装置、立体画像表示装置、及び立体画像生成方法 | |

| JP5367747B2 (ja) | 撮像装置および撮像方法、ならびに、撮像システム | |

| JP5744642B2 (ja) | 画像処理装置および画像処理方法、プログラム。 | |

| JP4165158B2 (ja) | 画像処理装置および方法、記録媒体、並びにプログラム | |

| JP4200718B2 (ja) | 画像処理装置および方法、記録媒体、並びにプログラム | |

| JP4200717B2 (ja) | 画像処理装置および方法、記録媒体、並びにプログラム | |

| JP2013250757A (ja) | 画像処理装置、画像処理方法及びプログラム | |

| JP4129787B2 (ja) | 画像処理装置および方法、記録媒体、並びにプログラム | |

| WO2013136832A1 (ja) | 立体画像表示制御装置および立体画像表示制御方法 | |

| WO2019161717A1 (zh) | 光栅图片的生成方法、装置及存储介质 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20180719 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20190808 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20190820 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20190925 Free format text: JAPANESE INTERMEDIATE CODE: A821 Effective date: 20190925 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20191001 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20191014 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6610185 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |