JP6348093B2 - 入力データから検出対象物の像を検出する画像処理装置および方法 - Google Patents

入力データから検出対象物の像を検出する画像処理装置および方法 Download PDFInfo

- Publication number

- JP6348093B2 JP6348093B2 JP2015218357A JP2015218357A JP6348093B2 JP 6348093 B2 JP6348093 B2 JP 6348093B2 JP 2015218357 A JP2015218357 A JP 2015218357A JP 2015218357 A JP2015218357 A JP 2015218357A JP 6348093 B2 JP6348093 B2 JP 6348093B2

- Authority

- JP

- Japan

- Prior art keywords

- feature point

- image

- point

- feature

- model pattern

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/40—Extraction of image or video features

- G06V10/44—Local feature extraction by analysis of parts of the pattern, e.g. by detecting edges, contours, loops, corners, strokes or intersections; Connectivity analysis, e.g. of connected components

- G06V10/443—Local feature extraction by analysis of parts of the pattern, e.g. by detecting edges, contours, loops, corners, strokes or intersections; Connectivity analysis, e.g. of connected components by matching or filtering

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/74—Image or video pattern matching; Proximity measures in feature spaces

- G06V10/75—Organisation of the matching processes, e.g. simultaneous or sequential comparisons of image or video features; Coarse-fine approaches, e.g. multi-scale approaches; using context analysis; Selection of dictionaries

- G06V10/757—Matching configurations of points or features

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J19/00—Accessories fitted to manipulators, e.g. for monitoring, for viewing; Safety devices combined with or specially adapted for use in connection with manipulators

- B25J19/02—Sensing devices

- B25J19/04—Viewing devices

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/28—Determining representative reference patterns, e.g. by averaging or distorting; Generating dictionaries

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/40—Software arrangements specially adapted for pattern recognition, e.g. user interfaces or toolboxes therefor

- G06F18/41—Interactive pattern learning with a human teacher

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

- G06T7/75—Determining position or orientation of objects or cameras using feature-based methods involving models

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/77—Determining position or orientation of objects or cameras using statistical methods

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/77—Processing image or video features in feature spaces; using data integration or data reduction, e.g. principal component analysis [PCA] or independent component analysis [ICA] or self-organising maps [SOM]; Blind source separation

- G06V10/778—Active pattern-learning, e.g. online learning of image or video features

- G06V10/7784—Active pattern-learning, e.g. online learning of image or video features based on feedback from supervisors

- G06V10/7788—Active pattern-learning, e.g. online learning of image or video features based on feedback from supervisors the supervisor being a human, e.g. interactive learning with a human teacher

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/60—Type of objects

- G06V20/64—Three-dimensional objects

- G06V20/647—Three-dimensional objects by matching two-dimensional images to three-dimensional objects

Description

・対象物の形状の個体差

・大きな視差

ここでいう視差とは、対象物が立体的だったり対象物の稜線の角が丸かったりした場合に、対象物と視覚センサの相対位置が変わることにより、画像に映る輪郭線の位置関係にズレが生じることを指す。

特許文献2に記載の方法では人工的な方法で変動を加えており、実際の検出対象物の個体差や環境に起因するばらつきをモデルに反映させることはできない。

実施形態における説明では、以下のように記号を使用する。説明を明確にするために、記号についてまず説明する。

P_i: モデルパターンのi番目の第1の特徴点(iは1からNP)

NI: 入力画像の数

I_j: j番目の入力画像(jは1からNI)

NQ_j: j番目の入力画像I_jから抽出された第2の特徴点の数

Q_jk: j番目の入力画像I_jから抽出されたk番目の第2の特徴点(kは1からNQ_j)

NT_j: j番目の入力画像I_jから検出された対象物の像の数

T_jg: j番目の入力画像I_jから検出されたg番目の対象物の像(gは1からNT_j)

NT:全ての入力画像から検出された対象物の像の総数(NT=ΣNT_j)

NO_jg: j番目の入力画像I_jから抽出された第2の特徴点Q_jkのうち、対象物の像T_jgを構成する特徴点の数(NO_jg < NQ_j)

O_jgn: j番目の入力画像I_jから抽出された第2の特徴点Q_jkのうち、対象物の像T_jgを構成する特徴点以外の特徴点のn番目のもの(非対応点)(nは1からNO_jg)

NO_i: モデルパターンのi番目の特徴点P_iに対応すると判定された対応点の数(NO_i <= NT)

O_im: モデルパターンのi番目の特徴点P_iに対応するm個目の対応点(mは1からNO_i)

NC: 特徴点候補の数

C_h: h番目の特徴点候補(hは1からNC個)

NO_h: 特徴点候補C_hに対応すると判定された対応点の数(NO_h < NT)

O_hp: 特徴点候補C_hに対応するp番目の対応点(pは1からNO_h)

図1に示すように、画像処理装置21は、画像処理部22、モデルパターン記憶部26および検出結果記憶部27を有する。画像処理装置21には、視覚センサ10、操作盤31、表示装置32等が接続される。画像処理部22は、対象物検出部23、対応点選択部24およびモデルパターン修正部25を含む。モデルパターン記憶部26は、教示されたモデルパターンを記憶する。検出結果記憶部27は、教示されたモデルパターンを使用して入力データから対象物を検出した検出結果を記憶する。画像処理装置21に含まれる各部分は、CPU、ROM、RAM等を有するコンピュータ上でソフトウェアにより実現される。後述する第1乃至第3実施形態は、ソフトウェアにより実現される処理内容が異なる。

図4を用いて、第1実施形態において画像処理部22が実行する処理内容を説明する。

ステップS101で、画像処理部22がモデルパターンを作成し、作成したモデルパターンをモデルパターン記憶部26に記憶する。

モデルパターンを構成する第1の特徴点P_iの位置姿勢はどのような形式で表してもよいが、一例としては、モデルパターンに座標系100を定義し(以下、モデルパターン座標系100)、モデルパターンを構成する特徴点の位置t_Pi(i=1〜NP)や姿勢v_Pi(i=1〜NP)をモデルパターン座標系100から見た位置ベクトルや方向ベクトルなどで表現する方法が挙げられる。

ステップS201で、モデルパターンとして教示したい対象物1を視覚センサ(カメラ)10の視野内に配置し、対象物1の画像を撮像する。この時のカメラ10と対象物1の位置関係は、対象物1を検出するときと同じになるようにして行うことが望ましい。

ステップS202で撮像した画像において、対象物1が映った領域を矩形や円形でモデルパターン指定領域として指定する。

図12において、撮像した画像において画像座標系210が定義され、その中で対象物1の像1Aを含むようにモデルパターン指定領域(ここでは矩形領域)220を指定する。モデルパターン指定領域220は、使用者が表示装置32で画像を見ながら操作盤31により入力した指示を画像処理部22が受けて設定しても、画像処理部22が画像における輝度勾配の大きい箇所を像1Aの輪郭として求め、像1Aが内部に含まれるように自動的に指定してもよい。

本実施形態では、特徴点としてエッジ点を用いたが、本実施形態で使用可能な特徴点がエッジ点に限定されるわけではなく、たとえばSIFTのような特徴点を使用してもよい。画像からSIFT特徴点を抽出する方法は、非特許文献2等に記載されており、周知である。

2.予め、カメラをキャリブレーションしておく。これにより、ローカル座標系で表現された3次元点をカメラ画像上の2次元点に変換することができる。

3.ローカル座標系にCADデータとして表現された対象物を仮想的に配置する。配置されたCADデータはローカル座標系で表現される。カメラと対象物の相対関係は、実際に対象物の検出を行うときの相対関係と大体同じになるようにする。

4.輪郭線から所定の間隔で輪郭線上の3次元点群を取得する。必要があれば、CADデータの中からモデルパターンとして使う輪郭線を指定する。

5.3次元点群をカメラ画像上に投影し、画像座標系上の2次元点群を求める。CADデータ上で明暗の向きを指定すれば、輝度勾配の方向も付加することができる。ここで、明暗の向きとは、輪郭線を境界とする二つの領域のどちらが明るいかを示すものである。

6.求められた画像座標系上の2次元点群をモデルパターン座標系で表現するように変換し、第1の特徴点としてモデルパターン記憶部に記憶する。

まず、入力画像I_jから第2の特徴点を抽出する。第2の特徴点はモデルパターンを作成する際に第1の特徴点を抽出した方法と同じ方法で抽出すればよい。本実施形態では、入力画像からエッジ点を抽出し、第2の特徴点とする。説明のため、入力画像I_jから抽出されたNQ_j個の第2の特徴点をQ_jk(k=1〜NQ_j)とする。第2の特徴点Q_jkは入力画像I_jに関連づけて検出結果記憶部27に記憶する。この時点では、第2の特徴点Q_jkの位置や姿勢は画像座標系210で表現されている。

a00=cosθ

a01=-sinθ

a02=x

a10=sinθ

a11=cosθ

a12=y

ただし、(x、y)は画像上での位置、θは画像上での回転移動量である。

a00=s・cosθ

a01=-s・sinθ

a02=x

a10=s・sinθ

a11=s・cosθ

a12=y

ただし、sは教示されたモデルパターンの大きさと対象物の像T_jgの大きさの比である。

ステップS104で、各入力画像I_j(j=1〜NI)から検出された対象物の像T_jg(j=1〜NI、g=1〜NT_j)の検出位置R_Tjgに基づいて、入力画像I_jから抽出された第2の特徴点Q_jk(j=1〜NI, k=1〜NQ_j)のうち、モデルパターンを構成する第1の特徴点P_iに対応するものを対応点として選択する。

説明のため、モデルパターンを構成する第1の特徴点P_iの位置姿勢をそれぞれ同次変換行列R_Piで表すことにする。R_Piは以下のように記述できる。

b01=-vy_Pi

b02= tx_Pi

b10= vy_Pi

b11= vx_Pi

b12= ty_Pi

ただし、t_Pi =(tx_Pi, ty_Pi)はモデルパターン座標系でのP_iの位置、v_Pi =(vx_Pi, vy_Pi)はモデルパターン座標系でのP_iの姿勢である。

同様に、入力画像I_jから抽出した第2の特徴点_Q_jkの位置姿勢も、同次変換行列R_Qjkで表すことにする。

R_Pi'=R_Tjg・R_Pi (1)

R_Qjk'=R_Tjg-1・R_Qjk (2)

(ア)第1の特徴点の位置姿勢R_Pi’と全ての第2の特徴点の位置姿勢R_Qjkとの距離を計算し、最も距離が近い第2の特徴点Q_jkを選択する。

(イ)入力画像I_jの画素数と同じ要素数の2次元配列に、第2の特徴点の位置姿勢R_Qjkをその位置の画素に対応する2次元配列の要素に格納し、2次元配列の第1の特徴点の一意姿勢R_Piに対応する画素近傍を2次元的に探索し、最初に見つかった第2の特徴点Q_jkを選択する。

2.第2の特徴点Q_jkの位置t_Qjkを通り、第2の特徴点Q_jkの姿勢v_Qjkに直交する直線をL1とする。

3.L1とL2の交点Tと第1の特徴点P_iの位置t_Pi’との距離d_giを計算する。この場合には、距離d_giは符号付き距離となる。

このように距離を計算すると、第1の特徴点P_iの輝度勾配の方向と直交する方向のズレは無視することになる。

計測領域の矩形の位置姿勢R_Cとすると、R_C'はR_CとR_Tjgに基づいて次式で算出できる。

R_C' = R_Tjg・R_C

4.モデルパターンの計測領域の輝度値の統計量と検出結果T_jgの計測領域の輝度値の統計量の差が閾値以上であれば、その検出結果は妥当でないとして除外する。

上記2〜4の処理を検出結果T_jg(g=1〜NT_j)それぞれに対して行う。

(ア)検出結果記憶部27に記憶されている、第1の特徴点P_iに対応するNO_i個の対応点_O_imのモデルパターン座標系から見た位置姿勢R_Oim’を取得する。

(イ)次に、図14に示すように、NO_i個の対応点O_imをそれぞれについて、対応点O_imの位置姿勢R_Oim’の位置成分t_Oim’から第1の特徴点P_iの位置姿勢R_Piの位置成分t_Piを引いた誤差ベクトルV_imを計算する。誤差ベクトルV_imはNO_i個得られることになる。得られた誤差ベクトルは図18のような形態でモデルパターン記憶部26に記憶する。

外れ値を除去した後で、再度確率分布を求め直すなどして、平均誤差ベクトルを求めればよい。

以上の処理を、モデルパターンを構成するすべての第1の特徴点P_iについて行う。

d_i = (Σd_im)/NO_i

V_i = d_i・v_Pi

特徴点P_iの位置t_Piに、計算した平均誤差ベクトルV_iを加算する。

このようにする場合には、特徴点P_iの位置t_Piは輝度勾配の方向にのみ修正されることになる。

1.ある対象物を撮像した画像から作成したモデルパターンは、対象物のある個体の形状を反映したものであるため、全ての個体に対して最適なものではない。この方法を使うことで、対象物の平均的な形状をモデルパターンとすることができる。更に対象物の個体による形状の違いだけでなく、対象物の置かれた位置やカメラの位置の違いにより、対象物の見え方が異なる場合がある。このような見え方の違いも含めてモデルパターンを平均化することができる。

第2実施形態では、モデルパターンの第1の特徴点に対応しなかった第2の特徴点についてもその対応点の物理量の統計量を求め、求めた統計量に基づいて、モデルパターンの第1の特徴点を新たに追加する。

ステップS301〜S303は、第1実施形態のS101〜S103と同じである。S301〜S303を実施することによって、S103の終了段階と同じように、入力画像I_jから対象物の像がNT_j個検出されたとする。また、検出された像T_jg(g=1〜NT_j)の検出位置をR_Tjgとする。

検出結果記憶部27に記憶されている、対象物の像T_jgの非対応点O_jgn(n=1〜NO_jg)のそれぞれについて、画像座標系から見たO_jgnの位置姿勢R_Ojgnと、対象物の像T_jgの位置姿勢R_Tjgに基づいて前述の式(2)により、モデルパターン座標系からみた非対応点O_jgnの位置姿勢R_Ojgn’を算出する。R_Ojgn’がモデルパターン指定領域の内側であるかをチェックし、領域外であればそのO_jgnを対象物の像T_jgの非対応点から除外する。ここで使用するモデルパターン指定領域は、モデルパターンを作成するために使用したものとは別の領域を新たに指定してもよい。

なお、特徴点候補として追加する際に、非対応点O_jgnの物理量を用いて更に絞り込んでも良い。例えば、輝度勾配の大きさが閾値より小さい非対応点は特徴点候補として追加しないようにしてもよい。

ステップS307で、特徴点候補C_hのそれぞれについて、対応点O_hp(p=1〜NO_h)の物理量の統計量を算出する。ここでは、ある特徴点候補C_hに対応する対応点の数がNO_h個である場合、対応点の選択に使った対象物の像の総数はNT個に対して、その特徴点が対象物の像に現れた割合(NO_h+1)/NTを計算し統計量とする。

・特徴点候補C_hと対応点O_hpの間の、位置の誤差、輝度勾配の方向の誤差、距離、の平均、分散、確率分布

位置姿勢に関する統計量を計算するためには、対応点O_hpの位置姿勢R_Ohpをモデルパターン座標系から見た位置姿勢R_Ohp’に変換する必要がある。これには前述の式(2)が使える。

・対応点O_hpの輝度勾配の大きさの平均、分散、確率分布

・対応点が見つかった個数NO_h

例えば、ある特徴点候補C_hに対応する対応点の数がNO_h個である場合、対応点の選択に使った対象物の像の総数はNT個であるので、その特徴点が対象物の像に現れた割合は(NO_h+1)/NTとなる。特徴点が対象物の像に現れた割合が所定の閾値より小さい場合は、その特徴点候補は対象物の像に頻出するとは言えないので、モデルパターンに特徴点として追加するのは妥当ではないと考えることができる。

第2実施形態は、上記の手順には限らず様々な形態が考えられる。

第3実施形態では、モデルパターンの特徴点に対応する対応点の物理量の統計量に基づいて、モデルパターンを構成する第1の特徴点に判定指標を追加し、対象物検出部23において判定指標を利用することで検出の信頼性を向上する。

図10は、第3実施形態における処理を示すフローチャートである。

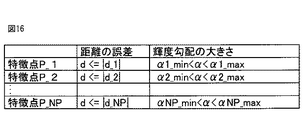

ステップS406で、計算した統計量から判定指標W_iを求める。S405で計算した統計量を用いて、それぞれ以下のような判定指標を求められる。

(ウ)輝度勾配の大きさの確率分布p(x)を用いて、ある輝度勾配の大きさを取り得る確率が一定の値以上であるかを判定指標にする。ある輝度勾配の大きさを取り得る確率が、ある閾値p_minより大きければ許容するようにする。この場合には、正規混合分布を規定するパラメータπb、μαb、σαb(b=1〜NB)と閾値p_minとを判定指標の中に保持することになる。

ステップS408で、対象物検出部23で、モデルパターン記憶部26に記憶された判定指標を使用して、対象物を検出する。

2.画像Inewから対象物を検出する。検出には、S103同様、任意の手法を用いることがある。これにより、対象物の像T_x(x=1〜NTX)がNTX個求まったとする。以下の3〜6の処理を、全ての対象物の像T_xに対して実施する。

6.モデルパターンを構成する第1の特徴点の数NPと見つかった対応点の数NOを使用して、NO/NPを求めることで、モデルパターンと像T_xの一致度を0.0から1.0の間の値で表現できる。

S_i = 1 - |d_i|/d_max

対象物検出部で判定指標を用いる方法はこれに限らない。例えば、ICPアルゴリズムにおいても、モデルパターンを構成する第1の特徴点の対応点を選択するステップが存在する。この対応点を選択するステップで、判定指標を用いて、第1の特徴点と第2の特徴点の一致/不一致を決定することができる。

これにより、対象物検出部において、より正確に判定された対応点を用いて検出を行うことができる。

2.対応点選択部において、第1の特徴点P_iと第2の特徴点Q_jkの距離diが-3σdから3σdの範囲内であるかどうかを評価して、範囲内であれば妥当、範囲外であれば妥当でないとする。

3.妥当であると判断された第2の特徴点Q_jkのみを対応点として、以降の処理を行う。

これにより、より正確に判定された対応点を用いて、所定の物理量の統計量を計算することができる。

3次元センサが出力する3次元点群を構成する個々の3次元点を、そのまま本願発明のモデルパターンを構成する第1の特徴点として利用することができる。第1実施形態と同じように、指定した領域内の3次元点を第1の特徴点としてモデルパターンを作成すればよい。

入力データを構成する3次元点が対象物の面上の点である場合は、各特徴点の物理量として特徴点の位置に加えて、法線の向きを利用することができる。3次元点群における法線の求め方の一例は、非特許文献6などで周知である。

法線の向きや方向ベクトルは特徴点の姿勢として使用することができる。

更に3次元センサが3次元点と共に輝度の情報や色の情報を出力する場合、特徴点の物理量としての輝度の情報や色の情報を付加することができる。もちろん、近傍の3次元点の輝度を用いれば、特徴点の物理量として輝度勾配を算出することも可能である。

入力データが3次元点群であっても、対象物を検出し、その位置姿勢を求めることは可能である。例えば、非特許文献8のような手法がある。

また、入力データが3次元点群であっても、ICPアルゴリズムを使うことができる。もちろん、3次元点群から対象物を検出する手法はこれらに限られるものではない。

・第1の特徴点P_iの法線と第2の特徴点Q_jkの近傍点群からもとめた平面との交点を求め、その交点と第1の特徴点の距離を計算する。

第4実施形態の画像処理装置では、ロボット装置の画像処理装置の検出結果に基づく動作が成功した場合にのみ、その場合の対象物の画像をモデルパターンの修正に反映し、動作が失敗した場合の対象物の画像はモデルパターンの修正に反映しないようにする。

ステップS502の画像の入力およびステップS503の対象物の検出も他の実施形態と同じであり、画像処理装置の検出結果を利用する動作毎に行われる。

ステップS505で検出結果の良否を判定し、良の場合(動作が成功した場合)はステップS506に進み、不良の場合(動作が失敗した場合)はステップS507に戻る。

ステップS507で、あらかじめ決められた検出不良(動作失敗)の場合の対処動作、たとえば動作に失敗した対象物を除いたり、その画像を記録するなどの動作を行った後、ステップS502に戻る。

2 作業台

10 視覚センサ

11 ロボット

12 ハンド

13 ロボット制御装置

20 視覚センサ制御装置

21 画像処理装置

22 画像処理部

23 対象物検出部

24 対応点選択部

25 モデルパターン修正部

26 モデルパターン記憶部

27 検出結果記憶部

31 操作盤

32 表示装置

Claims (12)

- 対象物の形状を表す複数の第1の特徴点の集合であるモデルパターンに基づいて、視覚センサで撮像した入力データ中に前記対象物の像を検出する画像処理装置であって、

対象物が撮像された一乃至複数の入力データのそれぞれについて、該入力データから抽出した複数の第2の特徴点と、前記モデルパターンを構成する複数の第1の特徴点とのマッチングを行って前記対象物の一乃至複数の像を検出する対象物検出部と、

前記一乃至複数の入力データから検出した一乃至複数の対象物の像のそれぞれについて、該像を構成する複数の第2の特徴点から前記モデルパターンを構成する前記複数の第1の特徴点に対応する第2の特徴点を選択し、該第2の特徴点を対応点として該第1の特徴点に関連付けて記憶する対応点選択部と、

前記モデルパターンを構成する複数の第1の特徴点のそれぞれについて、該第1の特徴点に関連づけられた前記複数の対応点の所定の物理量の統計量を算出し、算出した前記所定の物理量の統計量に基づいて該第1の特徴点を修正するモデルパターン修正部と、

を備えることを特徴とする画像処理装置。 - 前記対応点選択部は、

前記モデルパターンを構成する複数の第1の特徴点のそれぞれについて、前記第1の特徴点に関連づけられた前記複数の対応点の所定の物理量の統計量に基づいて、前記対応点選択における対応/不対応を判定するための判定指標を求め、該判定指標を該第1の特徴点に関連付けて記憶し、

前記モデルパターンを構成する複数の第1の特徴点のそれぞれについて、前記入力データから抽出された前記第2の特徴点の前記所定の物理量と、該第1の特徴点に関連付けられた前記判定指標とに基づいて、該第1の特徴点と該第2の特徴点が一致しているか否かを判断する

ことを特徴とする請求項1に記載の画像処理装置。 - 前記対応点選択部は、

前記検出した一乃至複数の対象物の像のそれぞれについて、該像を構成する複数の第2の特徴点のうち前記モデルパターンを構成する第1の特徴点のいずれとも対応しない一乃至複数の第2の特徴点を特徴点候補として記憶し、

記憶した前記一乃至複数の特徴点候補に対応する第2の特徴点を選択すると共に、該第2の特徴点を対応点として該特徴点候補に関連付けて記憶し、

前記モデルパターン修正部はさらに、記憶された前記一乃至複数の特徴点候補のそれぞれについて、該特徴点候補に関連づけられた複数の対応点の所定の物理量の統計量を算出すると共に、該所定の物理量の統計量に基づいて前記モデルパターンに該特徴点候補を第1の特徴点として追加する

ことを特徴とする請求項1に記載の画像処理装置。 - 対象物の形状を表す複数の第1の特徴点の集合であるモデルパターンを使用して、視覚センサで撮像した入力データ中に前記対象物の像を検出する画像処理装置であって、

対象物が撮像された一乃至複数の入力データのそれぞれについて、該入力データから抽出した複数の第2の特徴点と、前記モデルパターンを構成する複数の第1の特徴点とのマッチングを行って前記対象物の一乃至複数の像を検出する対象物検出部と、

前記一乃至複数の入力データから検出した一乃至複数の対象物の像のそれぞれについて、該像を構成する複数の第2の特徴点から前記モデルパターンを構成する前記複数の第1の特徴点に対応する第2の特徴点を選択し、該第2の特徴点を対応点として該第1の特徴点に関連付けて記憶すると共に、前記モデルパターンを構成する複数の第1の特徴点毎に、前記対応点の所定の物理量について所定の統計量を算出すると共に、算出された前記所定の統計量に基づいて、前記マッチングにおける一致/不一致を判定するための判定指標を求め、該判定指標を該第1の特徴点に関連付けて記憶する対応点選択部と、

を備え、

前記対象物検出部はさらに、前記モデルパターンを構成する複数の第1の特徴点のそれぞれについて、前記入力データから抽出された前記第2の特徴点の前記所定の物理量と、該第1の特徴点に関連付けられた前記判定指標とに基づいて、該第1の特徴点と該第2の特徴点が一致しているか否かを判断する

ことを特徴とする画像処理装置。 - 前記記憶される判定指標は、前記算出された所定の統計量を含むことを特徴とする、請求項2または4に記載の画像処理装置。

- 前記視覚センサはカメラであり、前記入力データは濃淡画像またはカラー画像であることを特徴とする請求項1乃至5のいずれか1項に記載の画像処理装置。

- 前記視覚センサは3次元センサであり、前記入力データは距離画像または3次元点群(ポイントクラウド)であることを特徴とする請求項1乃至5のいずれか1項に記載の画像処理装置。

- 前記対応点選択部は、前記一乃至複数の対象物の像から妥当でない対象物の像を除外し、妥当な対象物の像からのみ対応点を選択することを特徴とする請求項1に記載の画像処理装置。

- 前記モデルパターン修正部は、第1の特徴点に関連づけられた前記複数の対応点から妥当でない対応点を除外し、妥当な対応点のみを使用して前記所定の物理量の統計量を計算することを特徴とする請求項1に記載の画像処理装置。

- 対象物の形状を表す複数の第1の特徴点の集合であるモデルパターンに基づいて、視覚センサで撮像した入力データ中に前記対象物の像を検出する画像処理方法であって、

対象物が撮像された一乃至複数の入力データのそれぞれについて、該入力データから抽出した複数の第2の特徴点と、前記モデルパターンを構成する複数の第1の特徴点とのマッチングを行って前記対象物の一乃至複数の像を検出する第1ステップと、

前記一乃至複数の入力データから検出した一乃至複数の対象物の像のそれぞれについて、該像を構成する複数の第2の特徴点から前記モデルパターンを構成する前記複数の第1の特徴点に対応する第2の特徴点を選択し、該第2の特徴点を対応点として該第1の特徴点に関連付けて記憶する第2ステップと、

前記モデルパターンを構成する複数の第1の特徴点のそれぞれについて、該第1の特徴点に関連づけられた前記複数の対応点の所定の物理量の統計量を算出し、算出した前記所定の物理量の統計量に基づいて該第1の特徴点を修正する第3ステップと、

を備えることを特徴とする画像処理方法。 - 前記第2ステップと前記第3ステップの間に、

前記モデルパターンを構成する複数の第1の特徴点のそれぞれについて、該第1の特徴点に関連づけられた前記複数の対応点から妥当でない対応点を除外するステップを備えることを特徴とする請求項10に記載の画像処理方法。 - 前記第1ステップと前記第2ステップの間に、

前記検出した一乃至複数の対象物の像から、妥当でない対象物の像を除外するステップを備えることを特徴とする請求項10に記載の画像処理方法。

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015218357A JP6348093B2 (ja) | 2015-11-06 | 2015-11-06 | 入力データから検出対象物の像を検出する画像処理装置および方法 |

| DE102016013274.4A DE102016013274A1 (de) | 2015-11-06 | 2016-10-28 | Bildverarbeitungsvorrichtung und verfahren zur erkennung eines bilds eines zu erkennenden objekts aus eingabedaten |

| CN201610959441.3A CN106682673B (zh) | 2015-11-06 | 2016-11-03 | 图像处理装置以及方法 |

| US15/343,215 US11227144B2 (en) | 2015-11-06 | 2016-11-04 | Image processing device and method for detecting image of object to be detected from input data |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015218357A JP6348093B2 (ja) | 2015-11-06 | 2015-11-06 | 入力データから検出対象物の像を検出する画像処理装置および方法 |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2017091079A JP2017091079A (ja) | 2017-05-25 |

| JP2017091079A5 JP2017091079A5 (ja) | 2017-08-31 |

| JP6348093B2 true JP6348093B2 (ja) | 2018-06-27 |

Family

ID=58584873

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2015218357A Active JP6348093B2 (ja) | 2015-11-06 | 2015-11-06 | 入力データから検出対象物の像を検出する画像処理装置および方法 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US11227144B2 (ja) |

| JP (1) | JP6348093B2 (ja) |

| CN (1) | CN106682673B (ja) |

| DE (1) | DE102016013274A1 (ja) |

Families Citing this family (21)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP6126437B2 (ja) | 2013-03-29 | 2017-05-10 | キヤノン株式会社 | 画像処理装置および画像処理方法 |

| WO2015008798A1 (ja) * | 2013-07-18 | 2015-01-22 | 三菱電機株式会社 | 目標類識別装置 |

| US20160012594A1 (en) * | 2014-07-10 | 2016-01-14 | Ditto Labs, Inc. | Systems, Methods, And Devices For Image Matching And Object Recognition In Images Using Textures |

| JP6333871B2 (ja) * | 2016-02-25 | 2018-05-30 | ファナック株式会社 | 入力画像から検出した対象物を表示する画像処理装置 |

| JP6487493B2 (ja) * | 2017-05-18 | 2019-03-20 | ファナック株式会社 | 画像処理システム |

| EP3404583A1 (en) * | 2017-05-19 | 2018-11-21 | MVTec Software GmbH | System and method for model adaptation |

| CN110245667A (zh) * | 2018-03-08 | 2019-09-17 | 中华映管股份有限公司 | 物件辨识方法及其装置 |

| JP6574920B1 (ja) * | 2018-07-06 | 2019-09-11 | 楽天株式会社 | 画像処理システム、画像処理方法、及びプログラム |

| JP6836561B2 (ja) | 2018-09-20 | 2021-03-03 | ファナック株式会社 | 画像処理装置及び画像処理方法 |

| US11029146B2 (en) * | 2018-10-18 | 2021-06-08 | Cyberoptics Corporation | Three-dimensional sensor with counterposed channels |

| JP6863946B2 (ja) * | 2018-10-31 | 2021-04-21 | ファナック株式会社 | 画像処理装置 |

| JP7378934B2 (ja) * | 2019-01-29 | 2023-11-14 | キヤノン株式会社 | 情報処理装置、情報処理方法及びシステム |

| KR20210030147A (ko) * | 2019-09-09 | 2021-03-17 | 삼성전자주식회사 | 3d 렌더링 방법 및 장치 |

| CN110880003B (zh) * | 2019-10-12 | 2023-01-17 | 中国第一汽车股份有限公司 | 一种图像匹配方法、装置、存储介质及汽车 |

| DE112021000477T5 (de) * | 2020-01-06 | 2022-12-01 | Fanuc Corporation | Objekterkennungsvorrichtung und modellmusterbewertungsvorrichtung |

| DE112021000595T5 (de) * | 2020-01-17 | 2022-12-01 | Fanuc Corporation | Bildverarbeitungssystem |

| JP7324317B2 (ja) * | 2020-02-04 | 2023-08-09 | ファナック株式会社 | 画像処理装置 |

| DE112021002846T5 (de) | 2020-05-18 | 2023-03-02 | Fanuc Corporation | Maschinenlernvorrichtung und Maschinenlernsystem |

| CN112476489B (zh) * | 2020-11-13 | 2021-10-22 | 哈尔滨工业大学(深圳) | 基于自然特征的柔性机械臂同步测量方法及系统 |

| JPWO2022239202A1 (ja) | 2021-05-13 | 2022-11-17 | ||

| CN115205354B (zh) * | 2022-06-23 | 2023-04-07 | 中国人民解放军国防科技大学 | 基于ransac和icp点云配准的相控阵激光雷达成像方法 |

Family Cites Families (36)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE2149149C3 (de) | 1971-10-01 | 1978-08-31 | Kloeckner-Humboldt-Deutz Ag, 5000 Koeln | Verfahren zur Regelung einer Brennanlage für feinkörniges Gut mit mehreren parallelgeschalteten Vorerhitzungseinrichtungen für das Aufgabegut |

| DE2357653A1 (de) | 1973-11-19 | 1975-05-28 | Siemens Ag | Magnetschwebefahrzeug mit einem synchronen linearmotor |

| JPH0737085A (ja) | 1993-06-29 | 1995-02-07 | Kawasaki Steel Corp | 基準パターン作成装置 |

| KR100414432B1 (ko) * | 1995-03-24 | 2004-03-18 | 마츠시타 덴끼 산교 가부시키가이샤 | 윤곽추출장치 |

| US6980690B1 (en) * | 2000-01-20 | 2005-12-27 | Canon Kabushiki Kaisha | Image processing apparatus |

| US7065242B2 (en) * | 2000-03-28 | 2006-06-20 | Viewpoint Corporation | System and method of three-dimensional image capture and modeling |

| US7171048B2 (en) * | 2002-04-10 | 2007-01-30 | National Instruments Corporation | Pattern matching system utilizing discrete curve matching with a mapping operator |

| JP3854229B2 (ja) * | 2003-01-07 | 2006-12-06 | 株式会社東芝 | 画像処理装置 |

| US7340089B2 (en) * | 2004-08-17 | 2008-03-04 | National Instruments Corporation | Geometric pattern matching using dynamic feature combinations |

| AU2005286823B2 (en) * | 2004-09-17 | 2009-10-01 | Cyberextruder.Com, Inc. | System, method, and apparatus for generating a three-dimensional representation from one or more two-dimensional images |

| JP2008528949A (ja) * | 2004-11-23 | 2008-07-31 | ケアストリーム ヘルス インコーポレイテッド | 自動形状分類の方法 |

| JP4613617B2 (ja) * | 2005-01-07 | 2011-01-19 | ソニー株式会社 | 画像処理システム、学習装置および方法、並びにプログラム |

| KR100647322B1 (ko) * | 2005-03-02 | 2006-11-23 | 삼성전자주식회사 | 객체의 모양모델 생성장치 및 방법과 이를 이용한 객체의특징점 자동탐색장치 및 방법 |

| KR100817656B1 (ko) * | 2005-03-15 | 2008-03-31 | 오므론 가부시키가이샤 | 화상 처리 방법, 3차원 위치 계측 방법 및 화상 처리 장치 |

| JP4093273B2 (ja) * | 2006-03-13 | 2008-06-04 | オムロン株式会社 | 特徴点検出装置、特徴点検出方法および特徴点検出プログラム |

| JP4843415B2 (ja) * | 2006-08-30 | 2011-12-21 | 株式会社東芝 | パターン評価方法およびプログラム |

| JP4950787B2 (ja) * | 2007-07-12 | 2012-06-13 | 株式会社東芝 | 画像処理装置及びその方法 |

| JP4926116B2 (ja) * | 2008-04-16 | 2012-05-09 | 株式会社日立ハイテクノロジーズ | 画像検査装置 |

| CN101609506B (zh) * | 2008-06-20 | 2012-05-23 | 索尼株式会社 | 用于识别图像中的模型对象的装置及方法 |

| JP5080416B2 (ja) | 2008-10-15 | 2012-11-21 | ファナック株式会社 | 入力画像から検出対象物の像を検出する画像処理装置 |

| US8204301B2 (en) * | 2009-02-25 | 2012-06-19 | Seiko Epson Corporation | Iterative data reweighting for balanced model learning |

| JP5287550B2 (ja) * | 2009-07-01 | 2013-09-11 | 富士通株式会社 | 生体認証システム,生体認証方法,生体認証装置,生体情報処理装置,生体認証プログラムおよび生体情報処理プログラム |

| WO2011086889A1 (ja) * | 2010-01-12 | 2011-07-21 | 日本電気株式会社 | 特徴点選択システム、特徴点選択方法および特徴点選択プログラム |

| US20140050392A1 (en) * | 2012-08-15 | 2014-02-20 | Samsung Electronics Co., Ltd. | Method and apparatus for detecting and tracking lips |

| JP5263437B2 (ja) * | 2012-09-07 | 2013-08-14 | カシオ計算機株式会社 | 三次元モデリング装置、三次元モデリング方法、ならびに、プログラム |

| CN110909825A (zh) * | 2012-10-11 | 2020-03-24 | 开文公司 | 使用概率模型在视觉数据中检测对象 |

| JP6044293B2 (ja) | 2012-11-19 | 2016-12-14 | 株式会社Ihi | 3次元物体認識装置および3次元物体認識方法 |

| JP6126437B2 (ja) * | 2013-03-29 | 2017-05-10 | キヤノン株式会社 | 画像処理装置および画像処理方法 |

| EP2808828B1 (en) * | 2013-05-31 | 2020-08-05 | Omron Corporation | Image matching method, image matching device, model template generation method, model template generation device, and program |

| US9715761B2 (en) * | 2013-07-08 | 2017-07-25 | Vangogh Imaging, Inc. | Real-time 3D computer vision processing engine for object recognition, reconstruction, and analysis |

| WO2015008798A1 (ja) * | 2013-07-18 | 2015-01-22 | 三菱電機株式会社 | 目標類識別装置 |

| GB2518589B (en) * | 2013-07-30 | 2019-12-11 | Holition Ltd | Image processing |

| JP6557943B2 (ja) * | 2014-01-15 | 2019-08-14 | オムロン株式会社 | 画像照合装置、画像センサ、処理システム、画像照合方法 |

| US9646201B1 (en) * | 2014-06-05 | 2017-05-09 | Leap Motion, Inc. | Three dimensional (3D) modeling of a complex control object |

| JP6372198B2 (ja) * | 2014-07-01 | 2018-08-15 | セイコーエプソン株式会社 | ロボットシステム及び処理装置 |

| JP6426968B2 (ja) * | 2014-10-08 | 2018-11-21 | キヤノン株式会社 | 情報処理装置およびその方法 |

-

2015

- 2015-11-06 JP JP2015218357A patent/JP6348093B2/ja active Active

-

2016

- 2016-10-28 DE DE102016013274.4A patent/DE102016013274A1/de active Pending

- 2016-11-03 CN CN201610959441.3A patent/CN106682673B/zh active Active

- 2016-11-04 US US15/343,215 patent/US11227144B2/en active Active

Also Published As

| Publication number | Publication date |

|---|---|

| CN106682673B (zh) | 2019-08-20 |

| CN106682673A (zh) | 2017-05-17 |

| DE102016013274A1 (de) | 2017-05-11 |

| JP2017091079A (ja) | 2017-05-25 |

| US11227144B2 (en) | 2022-01-18 |

| US20170132451A1 (en) | 2017-05-11 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6348093B2 (ja) | 入力データから検出対象物の像を検出する画像処理装置および方法 | |

| JP6573354B2 (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| JP5671281B2 (ja) | 位置姿勢計測装置、位置姿勢計測装置の制御方法及びプログラム | |

| US10430650B2 (en) | Image processing system | |

| US11830216B2 (en) | Information processing apparatus, information processing method, and storage medium | |

| JP6736257B2 (ja) | 情報処理装置、情報処理方法、プログラム | |

| US11654571B2 (en) | Three-dimensional data generation device and robot control system | |

| JP6836561B2 (ja) | 画像処理装置及び画像処理方法 | |

| US10771776B2 (en) | Apparatus and method for generating a camera model for an imaging system | |

| JP2017091079A5 (ja) | ||

| CN107680125B (zh) | 在视觉系统中自动选择三维对准算法的系统和方法 | |

| JP6860620B2 (ja) | 情報処理装置、情報処理方法、及びプログラム | |

| CN110415304B (zh) | 一种视觉标定方法及系统 | |

| JP6936974B2 (ja) | 位置姿勢推定装置、位置姿勢推定方法及びプログラム | |

| JP2017130067A (ja) | 衛星映像の位置正確度改善のための自動映像処理システム及びその方法 | |

| JP5976089B2 (ja) | 位置姿勢計測装置、位置姿勢計測方法、およびプログラム | |

| JP2730457B2 (ja) | 視覚に基く三次元位置および姿勢の認識方法ならびに視覚に基く三次元位置および姿勢の認識装置 | |

| JP6863946B2 (ja) | 画像処理装置 | |

| US20210042576A1 (en) | Image processing system | |

| Kim et al. | Mesh modelling of 3D point cloud from UAV images by point classification and geometric constraints | |

| CN109242894B (zh) | 一种基于移动最小二乘法的图像对齐方法及系统 | |

| EP2953096B1 (en) | Information processing device, information processing method, system and carrier means | |

| KR101775124B1 (ko) | 위성영상의 위치 정확도 개선을 위한 자동영상처리시스템 및 방법 | |

| US20230011093A1 (en) | Adjustment support system and adjustment support method | |

| WO2021157528A1 (ja) | 画像処理装置 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20170719 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20170922 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20171003 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20171201 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20180508 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20180530 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6348093 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |