JP5511450B2 - 画像処理装置、画像処理方法及びプログラム - Google Patents

画像処理装置、画像処理方法及びプログラム Download PDFInfo

- Publication number

- JP5511450B2 JP5511450B2 JP2010059160A JP2010059160A JP5511450B2 JP 5511450 B2 JP5511450 B2 JP 5511450B2 JP 2010059160 A JP2010059160 A JP 2010059160A JP 2010059160 A JP2010059160 A JP 2010059160A JP 5511450 B2 JP5511450 B2 JP 5511450B2

- Authority

- JP

- Japan

- Prior art keywords

- caption

- area

- expression

- text

- metadata

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000012545 processing Methods 0.000 title claims description 151

- 238000003672 processing method Methods 0.000 title claims description 7

- 230000014509 gene expression Effects 0.000 claims description 192

- 238000000605 extraction Methods 0.000 claims description 44

- 238000004364 calculation method Methods 0.000 claims description 38

- 210000000746 body region Anatomy 0.000 claims description 4

- 230000000694 effects Effects 0.000 claims description 2

- 230000010365 information processing Effects 0.000 claims 1

- 238000000034 method Methods 0.000 description 112

- 230000008569 process Effects 0.000 description 94

- 238000006243 chemical reaction Methods 0.000 description 18

- 230000006870 function Effects 0.000 description 16

- 238000010586 diagram Methods 0.000 description 12

- 239000000284 extract Substances 0.000 description 5

- 238000004458 analytical method Methods 0.000 description 4

- 230000006835 compression Effects 0.000 description 3

- 238000007906 compression Methods 0.000 description 3

- 238000012937 correction Methods 0.000 description 3

- 230000000877 morphologic effect Effects 0.000 description 3

- 230000005540 biological transmission Effects 0.000 description 2

- 239000003086 colorant Substances 0.000 description 2

- 238000004891 communication Methods 0.000 description 2

- 238000003058 natural language processing Methods 0.000 description 2

- 230000002093 peripheral effect Effects 0.000 description 2

- 230000011218 segmentation Effects 0.000 description 2

- 230000002238 attenuated effect Effects 0.000 description 1

- 230000008859 change Effects 0.000 description 1

- 230000000052 comparative effect Effects 0.000 description 1

- 238000004590 computer program Methods 0.000 description 1

- 238000007796 conventional method Methods 0.000 description 1

- 238000005034 decoration Methods 0.000 description 1

- 238000011161 development Methods 0.000 description 1

- 230000018109 developmental process Effects 0.000 description 1

- 238000005315 distribution function Methods 0.000 description 1

- 238000009499 grossing Methods 0.000 description 1

- 230000008676 import Effects 0.000 description 1

- 238000010422 painting Methods 0.000 description 1

- 238000007591 painting process Methods 0.000 description 1

- 238000013139 quantization Methods 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

- 238000009877 rendering Methods 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V30/00—Character recognition; Recognising digital ink; Document-oriented image-based pattern recognition

- G06V30/40—Document-oriented image-based pattern recognition

- G06V30/41—Analysis of document content

- G06V30/416—Extracting the logical structure, e.g. chapters, sections or page numbers; Identifying elements of the document, e.g. authors

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/768—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using context analysis, e.g. recognition aided by known co-occurring patterns

Landscapes

- Engineering & Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Theoretical Computer Science (AREA)

- Artificial Intelligence (AREA)

- Multimedia (AREA)

- General Physics & Mathematics (AREA)

- Physics & Mathematics (AREA)

- Computing Systems (AREA)

- Medical Informatics (AREA)

- Software Systems (AREA)

- General Health & Medical Sciences (AREA)

- Evolutionary Computation (AREA)

- Databases & Information Systems (AREA)

- Health & Medical Sciences (AREA)

- Processing Or Creating Images (AREA)

- Information Retrieval, Db Structures And Fs Structures Therefor (AREA)

- Document Processing Apparatus (AREA)

- Character Input (AREA)

Description

例えば、文書から抽出したオブジェクトの近傍にそのオブジェクトを説明する文字列(キャプション)を付し、これをメタデータとして関連付けることで、オブジェクトを検索できるようにする方法が存在する。

以下、本発明を実施するための形態について図面を用いて説明する。

データ処理部218は、図3に示すように、領域分割部(領域抽出部)301、属性情報付加部302、文字認識部303、メタデータ処理部304、フォーマット変換部305から構成される。データ処理部218では、入力された画像データ300に対し各処理部301〜305において所定の処理を行い、最終的に電子文書310が生成されて出力される。

図4は、メタデータ処理部304の内部構成を示すブロック図である。

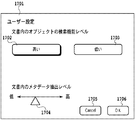

次に、上述のステップ706におけるメタデータの抽出・付与処理の詳細について、図8のフローチャートを用いて説明する。この処理は2つに大別される。1つはアンカー表現及びキャプション表現の抽出に関する第1の抽出(図8(a))であり、もう1つは本文中の説明文の抽出に関する第2の抽出である(図8(b))。アンカー表現及びキャプション表現の抽出に関する処理が先に実行され、その後、本文中の説明文の抽出に関する処理が実行される。

次に、図8のステップ807における処理の詳細について、図10のフローチャートを用いて詳しく説明する。

図10のステップ1006における類似度の計算について、図11のフローチャートを参照しつつ、上述した2組の組合せ(キャプション912と本文領域908の第1の組合せ/キャプション918と本文領域908の第2の組合せ)の場合を例に説明する。

・・・(式1)

類似度S=1×1×0.5

となる。そして、キャプション単語は「AAA」の1つだけなので、得られた類似度S=0.5が、ステップ1112において初期値「0」に加算されて、ステップ1113に進む。ステップ1113では、変数Nの値が1減算されて、N=「2」となり、ステップ1108に戻る。以後、同様の処理が2回繰り返され、説明文言語「カメラ」と「風景」についても類似度Sが算出されて、その度に類似度Sが更新される。もっとも、説明文言語「カメラ」と「風景」は、唯一のキャプション単語である「AAA」と単語列が一致しないことから、ステップ1111で算出される類似度Sの値は共に「0」となる。したがって、最終的に得られる類似度Sの値は、0.5+0+0=0.5となる。

次に、実施例2として、図8のステップ807における処理、すなわち、選択されたアンカー表現を含む本文中の説明文を抽出し、それとオブジェクト領域とを対応付ける処理の効率を向上させることが可能な態様について、図14及び図15を参照しつつ説明する。

実施例1や実施例2においては、写真等のオブジェクト領域と本文中の説明文とを対応付けるに当り、算出した類似度の大小関係のみに基づいて判断していた。ここでは、類似度の算出後に、類似度の大きさが所定の閾値に達しているかどうかを判定する処理を行い、閾値に達している場合にのみ、オブジェクト領域と本文中の説明文とを対応付ける態様について説明する。

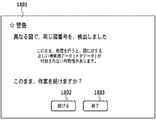

次に、実施例4として、特定のアンカー表現を含んだキャプションを有するオブジェクトが複数存在することが判明した時点で、ユーザにその旨の警告表示を行う態様について説明する。

また、本発明は、以下の処理を実行することによっても実現される。即ち、上述した実施形態の機能を実現するソフトウェア(プログラム)を、ネットワーク又は各種記憶媒体を介してシステム或いは装置に供給し、そのシステム或いは装置のコンピュータ(またはCPUやMPU等)がプログラムを読み出して実行する処理である。

Claims (10)

- 複数ページの画像それぞれを、複数の領域に分割する領域分割手段と、

前記分割された複数の領域それぞれに対し、当該領域に応じた属性を付加する属性情報付加手段と、

前記属性情報付加手段によってキャプションの属性が付加されたキャプション領域と本文の属性が付加された本文領域とに対し、文字認識処理を行う文字認識手段と、

前記キャプション領域が付随するオブジェクト領域に対して、メタデータを関連づけるメタデータ処理手段と、

を有し、

前記メタデータ処理手段は、

前記キャプション領域に対する前記文字認識処理の結果から、所定の文字列で構成されるアンカー表現と、当該アンカー表現を除く文字列で構成されるキャプション表現とを抽出する第1抽出手段と、

同じアンカー表現を含むキャプション領域が付随しているオブジェクト領域が、複数存在するか否かを判定する第1判定手段と、

前記本文領域に対する前記文字認識処理の結果から、前記アンカー表現を含む説明文を抽出する第2抽出手段と、

前記第1判定手段で前記同じアンカー表現を含むキャプション領域が付随しているオブジェクト領域が1つであると判定した場合、前記第2抽出手段で抽出された説明文から得られるメタデータを、当該オブジェクト領域に関連付ける第1関連付け手段と、

前記第1判定手段で前記同じアンカー表現を含むキャプション領域が付随しているオブジェクト領域が複数存在すると判定した場合、当該アンカー表現を含むキャプション領域それぞれのキャプション表現と、前記第2抽出手段で抽出される当該アンカー表現を含む説明文それぞれとの間の類似度を、当該キャプション表現に含まれる単語、および、当該説明文に含まれる単語どうしの一致の程度に基づいて計算する類似度計算手段と、

前記類似度計算手段で計算された類似度に基づいて前記複数のオブジェクト領域それぞれに最適な説明文を判定し、当該判定された最適な説明文から得られるメタデータを当該オブジェクト領域に関連付ける第2関連付け手段と、

を有することを特徴とする画像処理装置。 - 前記オブジェクト領域は、前記属性情報付加手段によって、写真、図、表のいずれかの属性が付加された領域であることを特徴とする請求項1に記載の画像処理装置。

- 前記第2関連付け手段は、前記類似度計算手段で計算された類似度が最も大きい説明文を当該オブジェクト領域に対する最適な説明文とし、当該最適な説明文から得られるメタデータを当該オブジェクト領域に関連付けることを特徴とする請求項1又は2に記載の画像処理装置。

- 前記メタデータ処理手段は、

前記第2抽出手段で抽出される説明文が、前記オブジェクト領域と同一のページ画像内に存在するか否か判定する第2判定手段を更に有し、

前記第2抽出手段で抽出される説明文が前記オブジェクト領域と同一のページ画像内に存在すると前記第2判定手段で判定された場合、前記類似度計算手段での類似度の計算を行うことなく、当該同一のページ画像から抽出された説明文から得られるメタデータを、当該同一のページ画像内に存在する前記オブジェクト領域に関連付けることを特徴とする請求項1乃至3のいずれか1項に記載の画像処理装置。 - 前記メタデータ処理手段は、前記第1判定手段で前記同じアンカー表現を含むキャプション領域が付随しているオブジェクト領域が複数存在すると判定した場合、その旨の警告表示を行うことを特徴とする請求項1乃至4のいずれか1項に記載の画像処理装置。

- 前記領域分割手段で分割された複数の領域に関する情報と、前記オブジェクト領域に関連付けられたメタデータとを用いて、所定のフォーマットの電子文書を生成する生成手段を更に備えたことを特徴とする請求項1乃至5のいずれか1項に記載の画像処理装置。

- オブジェクトと、当該オブジェクトのキャプションと、当該オブジェクトのアンカー表現を含む本文と、を取得する取得手段と、

前記取得されたキャプション中の単語と、前記アンカー表現に対応する、前記取得された本文に含まれる表現中の単語との一致の程度に基づいて、前記取得されたオブジェクトと、前記取得された本文に含まれる前記表現と、を関連付ける関連付け手段と、

前記関連付けがなされた前記オブジェクトと、前記取得された本文とを含む所定フォーマットの文書データを生成する生成手段と、

を有することを特徴とする画像処理装置。 - 文書中のオブジェクトを検索可能な電子文書データを生成する画像処理装置における画像処理方法であって、

領域分割手段が、複数ページの画像それぞれを、複数の領域に分割する領域分割ステップと、

属性情報付加手段が、前記分割された複数の領域それぞれに対し、当該領域に応じた属性を付加する属性情報付加ステップと

文字認識手段が、前記属性情報付加ステップでキャプションの属性が付加されたキャプション領域と本文の属性が付加された本文領域とに対し、文字認識処理を行う文字認識ステップと、

メタデータ処理手段が、前記キャプション領域が付随するオブジェクト領域に対して、メタデータを関連づけるメタデータ処理ステップと、

を含み、

前記メタデータ処理ステップは、さらに、

前記キャプション領域に対する前記文字認識処理の結果から、所定の文字列で構成されるアンカー表現と、当該アンカー表現を除く文字列で構成されるキャプション表現とを抽出する第1抽出ステップと、

同じアンカー表現を含むキャプション領域が付随しているオブジェクト領域が、複数存在するか否かを判定する第1判定ステップと、

前記本文領域に対する前記文字認識処理の結果から、前記アンカー表現を含む説明文を抽出する第2抽出ステップと、

前記第1判定ステップで前記同じアンカー表現を含むキャプション領域が付随しているオブジェクト領域が1つであると判定した場合、前記第2抽出ステップで抽出された説明文から得られるメタデータを、当該オブジェクト領域に関連付ける第1関連付けステップと、

前記第1判定ステップで前記同じアンカー表現を含むキャプション領域が付随しているオブジェクト領域が複数存在すると判定した場合、当該アンカー表現を含むキャプション領域それぞれのキャプション表現と、前記第2抽出ステップで抽出される当該アンカー表現を含む説明文それぞれとの間の類似度を、当該キャプション表現に含まれる単語、および、当該説明文に含まれる単語どうしの一致の程度に基づいて計算する類似度計算ステップと、

前記類似度計算ステップで計算された類似度に基づいて前記複数のオブジェクト領域それぞれに最適な説明文を判定し、当該判定された最適な説明文から得られるメタデータを当該オブジェクト領域に関連付ける第2関連付けステップと

を含むことを特徴とする画像処理方法。 - 文書データを生成する画像処理装置における画像処理方法であって、

取得手段が、オブジェクトと、当該オブジェクトのキャプションと、当該オブジェクトのアンカー表現を含む本文と、を取得する取得ステップと、

関連付け手段が、前記取得されたキャプション中の単語と、前記アンカー表現に対応する、前記取得された本文に含まれる表現中の単語との一致の程度に基づいて、前記取得されたオブジェクトと、前記取得された本文に含まれる前記表現と、を関連付ける関連付けステップと、

生成手段が、前記関連付けがなされた前記オブジェクトと、前記取得された本文とを含む所定フォーマットの文書データを生成する生成ステップと、

を有することを特徴とする画像処理方法。 - コンピュータを、請求項1乃至7のいずれか1項に記載の各手段として機能させるためのプログラム。

Priority Applications (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2010059160A JP5511450B2 (ja) | 2010-03-16 | 2010-03-16 | 画像処理装置、画像処理方法及びプログラム |

| US13/039,588 US8355578B2 (en) | 2010-03-16 | 2011-03-03 | Image processing apparatus, image processing method, and storage medium |

| CN201110059803.0A CN102196130B (zh) | 2010-03-16 | 2011-03-11 | 图像处理装置及图像处理方法 |

| DE102011005579A DE102011005579A1 (de) | 2010-03-16 | 2011-03-15 | Bildverarbeitungsvorrichtung, Bildverarbeitungsverfahren und Speichermedium |

| GB1104436.9A GB2478845B (en) | 2010-03-16 | 2011-03-16 | Image processing apparatus, image processing method, and storage medium |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2010059160A JP5511450B2 (ja) | 2010-03-16 | 2010-03-16 | 画像処理装置、画像処理方法及びプログラム |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2011192145A JP2011192145A (ja) | 2011-09-29 |

| JP2011192145A5 JP2011192145A5 (ja) | 2013-05-02 |

| JP5511450B2 true JP5511450B2 (ja) | 2014-06-04 |

Family

ID=43981069

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2010059160A Active JP5511450B2 (ja) | 2010-03-16 | 2010-03-16 | 画像処理装置、画像処理方法及びプログラム |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US8355578B2 (ja) |

| JP (1) | JP5511450B2 (ja) |

| CN (1) | CN102196130B (ja) |

| DE (1) | DE102011005579A1 (ja) |

| GB (1) | GB2478845B (ja) |

Families Citing this family (20)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2011008446A (ja) * | 2009-06-24 | 2011-01-13 | Fuji Xerox Co Ltd | 画像処理装置 |

| JP2013077150A (ja) * | 2011-09-30 | 2013-04-25 | Fujitsu Broad Solution & Consulting Inc | ファイル管理プログラム、情報処理装置およびファイル管理方法 |

| KR101949993B1 (ko) * | 2011-10-01 | 2019-02-19 | 삼성전자주식회사 | 이미지 처리 장치에서 멀티 포맷 템플릿 이미지를 생성하는 방법 및 장치, 그리고 그에 따른 저장 매체 |

| US8929666B2 (en) * | 2011-10-01 | 2015-01-06 | Samsung Electronics Co., Ltd | Method and apparatus of generating a multi-format template image from a single format template image |

| US9542538B2 (en) | 2011-10-04 | 2017-01-10 | Chegg, Inc. | Electronic content management and delivery platform |

| US8756497B2 (en) * | 2011-11-28 | 2014-06-17 | Chegg, Inc. | Navigating an electronic document by visual object elements |

| CN104346615B (zh) * | 2013-08-08 | 2019-02-19 | 北大方正集团有限公司 | 版式文档中复合图的提取装置和提取方法 |

| KR102016545B1 (ko) * | 2013-10-25 | 2019-10-21 | 한화테크윈 주식회사 | 검색 시스템 및 그의 동작 방법 |

| US9842281B2 (en) * | 2014-06-05 | 2017-12-12 | Xerox Corporation | System for automated text and halftone segmentation |

| US9785658B2 (en) | 2014-10-07 | 2017-10-10 | Sap Se | Labelling entities in a canonical data model |

| US10395402B2 (en) * | 2015-05-26 | 2019-08-27 | Canon Information And Imaging Solutions, Inc. | Apparatus, system and method for embedding data in an image file |

| US20170264941A1 (en) * | 2016-03-10 | 2017-09-14 | Sony Corporation | Internet-centric dvr to dvr transfer of customer-selected content |

| US10034027B2 (en) | 2016-03-10 | 2018-07-24 | Sony Corporation | Automatic MSO-based transfer of DVR content to new location of customer |

| US10643065B2 (en) | 2018-06-21 | 2020-05-05 | Atlassian Pty Ltd | Techniques for document creation based on image sections |

| JP2020030820A (ja) * | 2018-08-20 | 2020-02-27 | アイビーリサーチ株式会社 | 文献解析装置、文献解析方法、文献解析プログラム及び文献解析システム |

| EP3633634A1 (en) * | 2018-10-02 | 2020-04-08 | Onfido Ltd | Character authenticity determination |

| JP7180408B2 (ja) * | 2019-01-25 | 2022-11-30 | 富士フイルムビジネスイノベーション株式会社 | 画像処理装置および画像処理プログラム |

| JP7353771B2 (ja) * | 2019-02-28 | 2023-10-02 | キヤノン株式会社 | プログラム、記憶媒体、情報処理装置の制御方法、及び情報処理装置 |

| JP7317561B2 (ja) * | 2019-04-19 | 2023-07-31 | キヤノン株式会社 | タッチパネルを用いた文字入力のための画像処理装置、その制御方法及びプログラム |

| JP2024073690A (ja) * | 2022-11-18 | 2024-05-30 | キヤノン株式会社 | 画像形成装置 |

Family Cites Families (20)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP3694149B2 (ja) * | 1997-07-07 | 2005-09-14 | 株式会社リコー | 画像検索装置、画像検索用キーテキストの生成方法、並びにその装置としてコンピュータを機能させるためのプログラムおよびその方法をコンピュータに実行させるためのプログラムを記録したコンピュータ読み取り可能な記録媒体 |

| JPH1166196A (ja) * | 1997-08-15 | 1999-03-09 | Ricoh Co Ltd | 文書画像認識装置およびその装置としてコンピュータを機能させるためのプログラムを記録したコンピュータ読み取り可能な記録媒体 |

| JP4366011B2 (ja) | 2000-12-21 | 2009-11-18 | キヤノン株式会社 | 文書処理装置及び方法 |

| US7287222B2 (en) | 2002-01-31 | 2007-10-23 | Canon Kabushiki Kaisha | Information processing apparatus and method that determines effectiveness of metadata for editing information content |

| JP4335492B2 (ja) | 2002-03-05 | 2009-09-30 | キヤノン株式会社 | 動画像管理方法及び装置 |

| US7050630B2 (en) * | 2002-05-29 | 2006-05-23 | Hewlett-Packard Development Company, L.P. | System and method of locating a non-textual region of an electronic document or image that matches a user-defined description of the region |

| JP3950777B2 (ja) | 2002-09-30 | 2007-08-01 | キヤノン株式会社 | 画像処理方法、画像処理装置および画像処理プログラム |

| JP4350414B2 (ja) | 2003-04-30 | 2009-10-21 | キヤノン株式会社 | 情報処理装置及び情報処理方法ならびに記憶媒体、プログラム |

| JP4269811B2 (ja) * | 2003-07-09 | 2009-05-27 | 株式会社日立製作所 | 携帯電話 |

| JP3796500B2 (ja) * | 2003-11-21 | 2006-07-12 | キヤノン株式会社 | 画像処理装置及びその制御方法、プログラム |

| JP4646797B2 (ja) | 2005-02-01 | 2011-03-09 | キヤノン株式会社 | 画像処理装置及びその制御方法、プログラム |

| JP4626509B2 (ja) * | 2005-12-19 | 2011-02-09 | セイコーエプソン株式会社 | 画像一覧表示におけるユーザの利便性向上 |

| JP2007249429A (ja) * | 2006-03-14 | 2007-09-27 | Ricoh Co Ltd | 電子メール編集装置、画像形成装置、電子メール編集方法、およびその方法をコンピュータに実行させるプログラム |

| US7627571B2 (en) | 2006-03-31 | 2009-12-01 | Microsoft Corporation | Extraction of anchor explanatory text by mining repeated patterns |

| JP2009211554A (ja) * | 2008-03-05 | 2009-09-17 | Canon Inc | 画像処理装置、画像処理方法、コンピュータプログラム、および記憶媒体 |

| JP5173566B2 (ja) * | 2008-05-07 | 2013-04-03 | キヤノン株式会社 | 画像処理装置及びその制御方法、プログラム |

| JP5147535B2 (ja) | 2008-05-20 | 2013-02-20 | キヤノン株式会社 | 画像処理装置、画像処理方法およびプログラム |

| JP2009301335A (ja) * | 2008-06-13 | 2009-12-24 | Ricoh Co Ltd | 画像処理装置、画像処理方法及びコンピュータプログラム |

| JP5121599B2 (ja) | 2008-06-30 | 2013-01-16 | キヤノン株式会社 | 画像処理装置、画像処理方法およびそのプログラムならびに記憶媒体 |

| JP5733907B2 (ja) | 2010-04-07 | 2015-06-10 | キヤノン株式会社 | 画像処理装置、画像処理方法、コンピュータプログラム |

-

2010

- 2010-03-16 JP JP2010059160A patent/JP5511450B2/ja active Active

-

2011

- 2011-03-03 US US13/039,588 patent/US8355578B2/en active Active

- 2011-03-11 CN CN201110059803.0A patent/CN102196130B/zh active Active

- 2011-03-15 DE DE102011005579A patent/DE102011005579A1/de active Pending

- 2011-03-16 GB GB1104436.9A patent/GB2478845B/en active Active

Also Published As

| Publication number | Publication date |

|---|---|

| CN102196130B (zh) | 2014-02-19 |

| US8355578B2 (en) | 2013-01-15 |

| GB2478845A (en) | 2011-09-21 |

| JP2011192145A (ja) | 2011-09-29 |

| DE102011005579A1 (de) | 2011-11-10 |

| CN102196130A (zh) | 2011-09-21 |

| GB2478845B (en) | 2013-08-14 |

| GB201104436D0 (en) | 2011-04-27 |

| US20110229035A1 (en) | 2011-09-22 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5511450B2 (ja) | 画像処理装置、画像処理方法及びプログラム | |

| JP5274305B2 (ja) | 画像処理装置、画像処理方法、コンピュータプログラム | |

| JP5733907B2 (ja) | 画像処理装置、画像処理方法、コンピュータプログラム | |

| JP5528121B2 (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| US7831107B2 (en) | Image processing apparatus, image processing method, and program | |

| JP5111268B2 (ja) | 画像処理装置、画像処理方法、そのプログラムおよび記憶媒体 | |

| US8203748B2 (en) | Image processing apparatus, control method therefor, and program | |

| JP5743443B2 (ja) | 画像処理装置、画像処理方法、コンピュータプログラム | |

| US8412705B2 (en) | Image processing apparatus, image processing method, and computer-readable storage medium | |

| JP5249387B2 (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| JP2004265384A (ja) | 画像処理システム及び情報処理装置、並びに制御方法及びコンピュータプログラム及びコンピュータ可読記憶媒体 | |

| US20090274369A1 (en) | Image processing device, image processing method, program, and storage medium | |

| JP7262993B2 (ja) | 画像処理システム、画像処理方法、画像処理装置 | |

| JP2004363786A (ja) | 画像処理装置 | |

| US8181108B2 (en) | Device for editing metadata of divided object | |

| CN111126273B (zh) | 图像处理方法、装置、电子设备以及存储介质 | |

| US9870632B2 (en) | Information processing apparatus and non-transitory computer readable medium | |

| JP5353325B2 (ja) | 文書データ生成装置と文書データ生成方法 | |

| US20090290797A1 (en) | Image processing for storing objects separated from an image in a storage device | |

| US8295602B2 (en) | Image processing apparatus and image processing method | |

| JP2009223363A (ja) | 文書処理装置および文書処理プログラム | |

| JP2004348467A (ja) | 画像検索装置及びその制御方法、プログラム | |

| JP7570843B2 (ja) | 画像処理装置、画像形成システム、画像処理方法、およびプログラム | |

| JP2013131942A (ja) | 画像処理装置 | |

| JP2023096759A (ja) | 画像処理装置、画像処理方法、及びプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20130313 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20130313 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20131213 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20131217 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20140205 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20140225 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20140325 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 5511450 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |