JP5259798B2 - 映像解析方法およびシステム - Google Patents

映像解析方法およびシステム Download PDFInfo

- Publication number

- JP5259798B2 JP5259798B2 JP2011204623A JP2011204623A JP5259798B2 JP 5259798 B2 JP5259798 B2 JP 5259798B2 JP 2011204623 A JP2011204623 A JP 2011204623A JP 2011204623 A JP2011204623 A JP 2011204623A JP 5259798 B2 JP5259798 B2 JP 5259798B2

- Authority

- JP

- Japan

- Prior art keywords

- histogram

- comparison

- optic

- optic flow

- feature

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/20—Analysis of motion

- G06T7/269—Analysis of motion using gradient-based methods

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

- G06F16/70—Information retrieval; Database structures therefor; File system structures therefor of video data

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/24—Classification techniques

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/40—Extraction of image or video features

- G06V10/50—Extraction of image or video features by performing operations within image blocks; by using histograms, e.g. histogram of oriented gradients [HoG]; by summing image-intensity values; Projection analysis

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/103—Static body considered as a whole, e.g. static pedestrian or occupant recognition

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- General Physics & Mathematics (AREA)

- Physics & Mathematics (AREA)

- Multimedia (AREA)

- Data Mining & Analysis (AREA)

- Human Computer Interaction (AREA)

- Computer Vision & Pattern Recognition (AREA)

- General Engineering & Computer Science (AREA)

- Bioinformatics & Cheminformatics (AREA)

- Bioinformatics & Computational Biology (AREA)

- Evolutionary Biology (AREA)

- Evolutionary Computation (AREA)

- Artificial Intelligence (AREA)

- Life Sciences & Earth Sciences (AREA)

- Databases & Information Systems (AREA)

- Image Analysis (AREA)

- Image Processing (AREA)

- Traffic Control Systems (AREA)

Description

Claims (17)

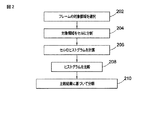

- 映像シーケンスの特徴を分類する方法であって、

前記映像シーケンスのフレームの、前記特徴を含んでいる対象領域を選択すること、

前記対象領域を複数のセルに分割すること、

前記複数セルのセル内のオプティックフローのヒストグラムを計算すること、

セル対についての前記オプティックフローのヒストグラムを比較すること、

前記比較の結果の少なくとも一部に基づいて前記特徴をクラスに割り当てること、を含み、

各セルのオプティックフローは、大きさと方向を示す複数のベクトルを含み、前記オプティックフローのヒストグラムを計算することは、前記ベクトルの方向に基づいて、セル内のオプティックフローの各ベクトルをビンに割り当てることを含み、

前記ベクトルの方位範囲が180度の場合には、セル対についての符号付きオプティックフローのヒストグラム比較により出力されるスカラー値に基づく特徴量を前記比較の結果とし、

前記ベクトルの方位範囲が360度の場合には、前記セル対についてのオプティックフローのヒストグラム比較をヒストグラム交差を用いて行い、各ビン対の比較和から計算されたスカラー値に基づく特徴量を前記比較の結果とすることを含む、方法。 - 前記対象領域の画像解析を行うことをさらに含み、前記特徴をクラスに割り当てることは、前記画像解析と、前記比較の結果とに基づく請求項1の方法。

- 画像解析を行なうことは、前記対象領域に対応する静止画像について勾配方向ヒストグラムを計算することを含む請求項2の方法。

- 前記特徴をクラスに割り当てることは、ランダム決定森分類器を使用することを含む請求項1乃至3のいずれかの方法。

- 前記特徴をクラスに割り当てることは、前記映像シーケンス中の歩行者に前記特徴が一致するかどうか判断することを含む請求項1乃至4のいずれかの方法。

- 前記フレームの前記オプティックフローを複数のチャネルとして記憶することをさらに含み、各チャネルは、前記オプティックフローのベクトルの方位範囲に対応する請求項1の方法。

- 前記オプティックフローは、インテグラルイメージとして記憶される請求項6の方法。

- 各セルの前記オプティックフローから前記対象領域について全体的に観察されたオプティックフローを減じることにより、前記映像シーケンスのカメラモーション補正を行うことをさらに含む請求項1乃至7のいずれかの方法。

- コンピュータ上で実行されたとき、映像シーケンスの特徴を分類する命令をプロセッサに実行させるプログラムであって、前記命令は、

前記映像シーケンスのフレームの、前記特徴を含んでいる対象領域を選択すること、

前記対象領域を複数のセルに分割すること、

前記複数セルのセル内のオプティックフローのヒストグラムを計算すること、

セル対についての前記オプティックフローのヒストグラムを比較すること、

前記比較の結果の少なくとも一部に基づいて前記特徴をクラスに割り当てること、を含み、

各セルのオプティックフローは、大きさと方向を示す複数のベクトルを含み、前記オプティックフローのヒストグラムを計算することは、前記ベクトルの方向に基づいて、セル内のオプティックフローの各ベクトルをビンに割り当てることを含み、

前記ベクトルの方位範囲が180度の場合には、セル対についての符号付きオプティックフローのヒストグラム比較により出力されるスカラー値に基づく特徴量を前記比較の結果とし、

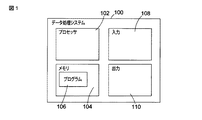

前記ベクトルの方位範囲が360度の場合には、前記セル対についてのオプティックフローのヒストグラム比較をヒストグラム交差を用いて行い、各ビン対の比較和から計算されたスカラー値に基づく特徴量を前記比較の結果とすることを含む、プログラム。 - 映像シーケンスのフレームを受け取るように動作可能な入力モジュールと、

記憶モジュールと、

前記フレームの前記特徴を含んでいる対象領域を選択し、前記対象領域を複数のセルに分割し、前記複数セルのセル内のオプティックフローのヒストグラムを計算し、セル対についての前記オプティックフローのヒストグラムを比較し、前記比較の結果の少なくとも一部に基づいて前記特徴をクラスに割り当てるように動作可能なプロセッサと、

前記特徴に割り当てられたクラスを示す情報を出力するように動作可能な出力モジュールと、を具備し、

各セルのオプティックフローは、大きさと方向を示す複数のベクトルを含み、前記オプティックフローのヒストグラムを計算することは、前記ベクトルの方向に基づいて、セル内のオプティックフローの各ベクトルをビンに割り当てることを含み、

前記ベクトルの方位範囲が180度の場合には、セル対についての符号付きオプティックフローのヒストグラム比較により出力されるスカラー値に基づく特徴量を前記比較の結果とし、

前記ベクトルの方位範囲が360度の場合には、前記セル対についてのオプティックフローのヒストグラム比較をヒストグラム交差を用いて行い、各ビン対の比較和から計算されたスカラー値に基づく特徴量を前記比較の結果とすることを含む、映像解析システム。 - 前記プロセッサは、前記対象領域の画像解析を行うように動作可能であって、前記特徴をクラスに割り当てることは、前記画像解析と前記比較の結果とに基づく請求項10のシステム。

- 前記プロセッサは、前記対象領域に対応する、静止画像の勾配方向ヒストグラムを計算することにより画像解析を行なうように動作可能である請求項11のシステム。

- 前記プロセッサは、ランダム決定森分類器を用いて前記特徴をクラスに割り当てるように動作可能である請求項10乃至12のいずれかのシステム。

- 前記プロセッサは、前記特徴が前記映像シーケンスの歩行者に一致するかどうか判断することによって前記特徴をクラスに割り当てるように動作可能である請求項10乃至13のいずれかのシステム。

- 前記フレームのオプティックフローを複数のチャネルとして記憶するためのストレージをさらに具備し、各チャネルは、前記オプティックフローのベクトルの方位範囲に対応する請求項10のシステム。

- 前記オプティックフローは、インテグラルイメージとして記憶される請求項15のシステム。

- 前記プロセッサは、各セルの前記オプティックフローから前記対象領域について全体的に観察されたオプティックフローを減じることにより、映像シーケンスのカメラモーションを補償するように動作可能である請求項10乃至16のいずれかのシステム。

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| GB1016496.0A GB2484133B (en) | 2010-09-30 | 2010-09-30 | A video analysis method and system |

| GB1016496.0 | 2010-09-30 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2012084140A JP2012084140A (ja) | 2012-04-26 |

| JP5259798B2 true JP5259798B2 (ja) | 2013-08-07 |

Family

ID=43243321

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2011204623A Expired - Fee Related JP5259798B2 (ja) | 2010-09-30 | 2011-09-20 | 映像解析方法およびシステム |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US8750614B2 (ja) |

| JP (1) | JP5259798B2 (ja) |

| GB (1) | GB2484133B (ja) |

Families Citing this family (18)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| GB2484133B (en) * | 2010-09-30 | 2013-08-14 | Toshiba Res Europ Ltd | A video analysis method and system |

| US9141196B2 (en) | 2012-04-16 | 2015-09-22 | Qualcomm Incorporated | Robust and efficient learning object tracker |

| KR101407952B1 (ko) | 2012-11-09 | 2014-06-17 | 전창현 | 엘리베이터 방범시스템 및 방법 |

| US9251121B2 (en) * | 2012-11-21 | 2016-02-02 | Honeywell International Inc. | Determining pushback direction |

| KR101467360B1 (ko) * | 2013-07-04 | 2014-12-03 | 성균관대학교산학협력단 | 이동 방향별 보행자 계수 방법 및 장치 |

| CN103336965B (zh) * | 2013-07-18 | 2016-08-31 | 国家电网公司 | 基于轮廓差异及区块主方向直方图的前景与特征提取方法 |

| US9514364B2 (en) | 2014-05-29 | 2016-12-06 | Qualcomm Incorporated | Efficient forest sensing based eye tracking |

| KR101529620B1 (ko) * | 2014-07-28 | 2015-06-22 | 성균관대학교산학협력단 | 이동 방향별 보행자 계수 방법 및 장치 |

| JP6372282B2 (ja) * | 2014-09-26 | 2018-08-15 | 富士通株式会社 | 画像処理装置、画像処理方法及びプログラム |

| MA41117A (fr) | 2014-12-05 | 2017-10-10 | Myfiziq Ltd | Imagerie d'un corps |

| US10713501B2 (en) * | 2015-08-13 | 2020-07-14 | Ford Global Technologies, Llc | Focus system to enhance vehicle vision performance |

| ITUB20153491A1 (it) * | 2015-09-08 | 2017-03-08 | Pitom S N C | Metodo e sistema per rilevare la presenza di un individuo in prossimita di un veicolo industriale |

| CN105208339A (zh) * | 2015-09-24 | 2015-12-30 | 深圳市哈工大交通电子技术有限公司 | 一种监控视频识别车辆碰撞的事故检测方法 |

| US10242581B2 (en) | 2016-10-11 | 2019-03-26 | Insitu, Inc. | Method and apparatus for target relative guidance |

| DE102017113794A1 (de) * | 2017-06-22 | 2018-12-27 | Connaught Electronics Ltd. | Klassifizierung statischer und dynamischer Bildsegmente in einer Fahrerassistenzvorrichtung eines Kraftfahrzeugs |

| CN108205888B (zh) * | 2017-12-22 | 2021-04-02 | 北京奇虎科技有限公司 | 一种判断乘客进出站的方法及装置 |

| JP7156120B2 (ja) * | 2019-03-22 | 2022-10-19 | 株式会社デンソー | 物体認識装置 |

| CN112926385B (zh) * | 2021-01-21 | 2023-01-13 | 中广(绍兴柯桥)有线信息网络有限公司 | 监控设备的视频处理方法及相关产品 |

Family Cites Families (14)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP3377743B2 (ja) * | 1998-01-20 | 2003-02-17 | 三菱重工業株式会社 | 移動体識別装置 |

| US6647131B1 (en) * | 1999-08-27 | 2003-11-11 | Intel Corporation | Motion detection using normal optical flow |

| US7778466B1 (en) * | 2003-12-02 | 2010-08-17 | Hrl Laboratories, Llc | System and method for processing imagery using optical flow histograms |

| JP3846494B2 (ja) * | 2004-07-13 | 2006-11-15 | 日産自動車株式会社 | 移動障害物検出装置 |

| KR100738522B1 (ko) * | 2004-12-21 | 2007-07-11 | 삼성전자주식회사 | 비디오 감시 시스템에서 카메라/물체 움직임 구분 및 객체추출 장치 및 그 방법 |

| KR100729660B1 (ko) * | 2005-12-09 | 2007-06-18 | 한국전자통신연구원 | 장면 전환 길이를 이용한 디지털 비디오 인식 시스템 및 방법 |

| JP4956273B2 (ja) * | 2007-05-17 | 2012-06-20 | 日本放送協会 | 投球球種識別装置、識別器生成装置、投球球種識別プログラム及び識別器生成プログラム |

| EP2179398B1 (en) * | 2007-08-22 | 2011-03-02 | Honda Research Institute Europe GmbH | Estimating objects proper motion using optical flow, kinematics and depth information |

| CN102582664A (zh) * | 2007-10-26 | 2012-07-18 | 松下电器产业株式会社 | 拥塞推定装置 |

| JP2012523641A (ja) * | 2009-04-14 | 2012-10-04 | コーニンクレッカ フィリップス エレクトロニクス エヌ ヴィ | ビデオコンテンツ解析のためのキーフレーム抽出 |

| US8451384B2 (en) * | 2010-07-08 | 2013-05-28 | Spinella Ip Holdings, Inc. | System and method for shot change detection in a video sequence |

| GB2484133B (en) * | 2010-09-30 | 2013-08-14 | Toshiba Res Europ Ltd | A video analysis method and system |

| US8774499B2 (en) * | 2011-02-28 | 2014-07-08 | Seiko Epson Corporation | Embedded optical flow features |

| US8842883B2 (en) * | 2011-11-21 | 2014-09-23 | Seiko Epson Corporation | Global classifier with local adaption for objection detection |

-

2010

- 2010-09-30 GB GB1016496.0A patent/GB2484133B/en not_active Expired - Fee Related

-

2011

- 2011-09-20 JP JP2011204623A patent/JP5259798B2/ja not_active Expired - Fee Related

- 2011-09-22 US US13/239,602 patent/US8750614B2/en not_active Expired - Fee Related

Also Published As

| Publication number | Publication date |

|---|---|

| JP2012084140A (ja) | 2012-04-26 |

| US8750614B2 (en) | 2014-06-10 |

| GB201016496D0 (en) | 2010-11-17 |

| US20120082381A1 (en) | 2012-04-05 |

| GB2484133A (en) | 2012-04-04 |

| GB2484133B (en) | 2013-08-14 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5259798B2 (ja) | 映像解析方法およびシステム | |

| US11948350B2 (en) | Method and system for tracking an object | |

| Gavrilescu et al. | Faster R-CNN: an approach to real-time object detection | |

| US9008423B2 (en) | Method and apparatus for detecting and recognizing object using local binary patterns | |

| Zhang et al. | Pedestrian detection in infrared images based on local shape features | |

| JP4999101B2 (ja) | 効率的なマルチクラス対象物検出のためにブースト分類器を組み合わせる方法 | |

| US8116534B2 (en) | Face recognition apparatus and face recognition method | |

| US9008365B2 (en) | Systems and methods for pedestrian detection in images | |

| US8345921B1 (en) | Object detection with false positive filtering | |

| CN107301378B (zh) | 图像中多分类器集成的行人检测方法和系统 | |

| CN107273832B (zh) | 基于积分通道特征与卷积神经网络的车牌识别方法及系统 | |

| US20120070041A1 (en) | System And Method For Face Verification Using Video Sequence | |

| CN111783665A (zh) | 一种动作识别方法、装置、存储介质和电子设备 | |

| Hong et al. | Fast multi-feature pedestrian detection algorithm based on histogram of oriented gradient using discrete wavelet transform | |

| Promlainak et al. | Thai traffic sign detection and recognition for driver assistance | |

| KR102594422B1 (ko) | 그라운드에 프로젝트된 오브젝트의 무게 중심을 예측하는 오브젝트 디텍터를 학습하는 방법, 학습된 오브젝트 디텍터를 이용하여 서로 다른 뷰잉 프러스텀을 가지는 복수의 카메라로부터 촬영된 특정 공간 내에서 동일한 오브젝트를 식별하는 방법, 그리고, 이를 이용한 학습 장치 및 오브젝트 식별 장치 | |

| Ponsa et al. | Cascade of classifiers for vehicle detection | |

| CN112347967A (zh) | 一种复杂场景下融合运动信息的行人检测方法 | |

| Shamimullah et al. | A hybrid approach for vehicle detection and counting using machine learning algorithms | |

| Hbali et al. | Object detection based on HOG features: Faces and dual-eyes augmented reality | |

| KR20170104756A (ko) | 국부지역별 크기 특정 차량 분류 방법 및 이를 이용한 차량검출방법 | |

| Thomas et al. | Discovery of compound objects in traffic scenes images with a cnn centered context using open cv | |

| Brehar et al. | Object detection in monocular infrared images using classification–regresion deep learning architectures | |

| Negri et al. | Pedestrian detection on CAVIAR dataset using a movement feature space | |

| US20140348429A1 (en) | Occupancy detection |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20120927 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20121030 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20130104 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20130402 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20130424 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20160502 Year of fee payment: 3 |

|

| LAPS | Cancellation because of no payment of annual fees |