JP4649640B2 - 画像処理方法、画像処理装置、及びコンテンツ作成システム - Google Patents

画像処理方法、画像処理装置、及びコンテンツ作成システム Download PDFInfo

- Publication number

- JP4649640B2 JP4649640B2 JP2004334336A JP2004334336A JP4649640B2 JP 4649640 B2 JP4649640 B2 JP 4649640B2 JP 2004334336 A JP2004334336 A JP 2004334336A JP 2004334336 A JP2004334336 A JP 2004334336A JP 4649640 B2 JP4649640 B2 JP 4649640B2

- Authority

- JP

- Japan

- Prior art keywords

- image

- moving

- moving object

- image processing

- processing method

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Landscapes

- Studio Circuits (AREA)

- Image Analysis (AREA)

Description

2、11、31、41・・・カメラ

3、13、33、43・・・タブレット

4・・・プロジェクタ

5・・・スキャンコンバータ

6、50・・・録画用コンピュータ

7、12、32、42・・・マイクロホン

8、60・・・ビデオサーバ

10・・・主参加者用コンピュータ

20・・・会議用表示サーバ

30、40・・・参加者用コンピュータ

100・・・ネットワーク

Claims (9)

- コンピュータを用いてデジタル画像に対する処理を行う画像処理方法であって、

入力動画像の各フレーム画像に対して輪郭抽出処理を行い、輪郭抽出フレーム画像を生成する輪郭抽出ステップと、

前記輪郭抽出フレーム画像のフレーム間差分演算を行い、前記フレーム間差分演算を行って生成した差分画像と、動体画像バッファに蓄積されている前フレームの動体抽出フレーム画像とを合成し、その合成画像を現フレームの動体抽出フレーム画像として生成するするとともに、その合成画像によって前記動体画像バッファを更新する動体抽出ステップと、

前記動体抽出フレーム画像に基づいて、前記入力動画像における動体領域を識別するマスクデータを生成するマスクデータ生成ステップと、

前記マスクデータを利用して、前記入力動画像における動体領域画像を他の画像と合成する画像合成ステップとを備える画像処理方法であって、

前記動体抽出ステップは、前記差分画像と前フレームの動体抽出フレーム画像との合成割合を前記差分画像の平均輝度値に応じて変更する画像処理方法。 - 請求項1項記載の画像処理方法であって、

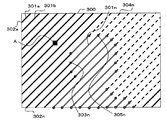

前記マスクデータ生成ステップは、前記動体抽出フレーム画像を、複数の走査直線に沿ってその走査直線の両側から走査するステップと、前記走査直線上の画素のうち、前記走査において最初に閾値以上となった画素間のすべての画素を含む領域を動体領域と認識するステップとを含む画像処理方法。 - 請求項2記載の画像処理方法であって、

前記複数の走査直線は、斜め方向の直線である画像処理方法。 - 請求項1ないし3のいずれか1項記載の画像処理方法であって、

前記マスクデータ生成ステップは、前記動体領域の輪郭近傍の合成割合を減少させたマスクデータを生成する画像処理方法。 - 請求項1ないし4のいずれか1項記載の画像処理方法における各ステップを、コンピュータに実行させるための画像処理プログラム。

- 請求項5記載の画像処理プログラムをインストールしたコンピュータを含む画像処理装置。

- 請求項5記載の画像処理プログラムをインストールしたコンピュータと、

前記コンピュータによる前記画像合成ステップで得られた合成画像データに基づく表示用合成画像信号を生成するビデオ信号生成手段と、

前記表示用合成画像信号に基づくデジタル動画データを含む動画ファイルを生成する動画ファイル生成手段とを備えるコンテンツ作成システム。 - 請求項7記載のコンテンツ作成システムを利用して生成した前記動画ファイルを講義ビデオとして出力する講義ビデオ作成システム。

- 請求項7記載のコンテンツ作成システムを利用して生成した前記デジタル動画データを、テレビ会議参加者の端末装置に配信する手段を備えるテレビ会議システム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2004334336A JP4649640B2 (ja) | 2004-11-18 | 2004-11-18 | 画像処理方法、画像処理装置、及びコンテンツ作成システム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2004334336A JP4649640B2 (ja) | 2004-11-18 | 2004-11-18 | 画像処理方法、画像処理装置、及びコンテンツ作成システム |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2006148425A JP2006148425A (ja) | 2006-06-08 |

| JP4649640B2 true JP4649640B2 (ja) | 2011-03-16 |

Family

ID=36627606

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2004334336A Expired - Fee Related JP4649640B2 (ja) | 2004-11-18 | 2004-11-18 | 画像処理方法、画像処理装置、及びコンテンツ作成システム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP4649640B2 (ja) |

Families Citing this family (10)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP5243365B2 (ja) * | 2009-08-10 | 2013-07-24 | 日本電信電話株式会社 | コンテンツ生成装置,コンテンツ生成方法およびコンテンツ生成プログラム |

| EP2718840A4 (en) * | 2011-06-08 | 2015-03-04 | Vidyo Inc | SYSTEMS AND METHODS FOR ENHANCING INTERACTIVE CONTENT SHARING IN VIDEO COMMUNICATION SYSTEMS |

| JP5949481B2 (ja) | 2012-03-14 | 2016-07-06 | 富士通株式会社 | 画像処理方法、プログラム及び装置 |

| GB2517730A (en) * | 2013-08-29 | 2015-03-04 | Mediaproduccion S L | A method and system for producing a video production |

| JP2015072627A (ja) * | 2013-10-03 | 2015-04-16 | 株式会社リコー | 画像処理装置及び画像合成方法 |

| JP6623876B2 (ja) | 2016-03-24 | 2019-12-25 | 富士通株式会社 | 描画処理装置、方法、及びプログラム |

| WO2018008077A1 (ja) * | 2016-07-05 | 2018-01-11 | 三菱電機株式会社 | 画像投影装置 |

| CN114694434B (zh) * | 2020-12-28 | 2023-12-01 | 康立 | 基于深度学习的视频教学课程智能生成方法及系统 |

| CN113538270A (zh) * | 2021-07-09 | 2021-10-22 | 厦门亿联网络技术股份有限公司 | 一种人像背景虚化方法和装置 |

| WO2024089725A1 (ja) * | 2022-10-24 | 2024-05-02 | 株式会社ソニー・インタラクティブエンタテインメント | 画像処理装置および画像処理方法 |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH1066086A (ja) * | 1996-08-19 | 1998-03-06 | Nec Off Syst Ltd | 動画像処理方式 |

| JP2000224410A (ja) * | 1998-08-31 | 2000-08-11 | Hitachi Software Eng Co Ltd | 画像合成装置および画像合成方法 |

| JP2002190029A (ja) * | 2000-12-21 | 2002-07-05 | Canon Inc | 画像処理装置、画像処理システム、画像処理方法、及び記憶媒体 |

| JP2004295416A (ja) * | 2003-03-26 | 2004-10-21 | Matsushita Electric Works Ltd | 画像処理装置 |

-

2004

- 2004-11-18 JP JP2004334336A patent/JP4649640B2/ja not_active Expired - Fee Related

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH1066086A (ja) * | 1996-08-19 | 1998-03-06 | Nec Off Syst Ltd | 動画像処理方式 |

| JP2000224410A (ja) * | 1998-08-31 | 2000-08-11 | Hitachi Software Eng Co Ltd | 画像合成装置および画像合成方法 |

| JP2002190029A (ja) * | 2000-12-21 | 2002-07-05 | Canon Inc | 画像処理装置、画像処理システム、画像処理方法、及び記憶媒体 |

| JP2004295416A (ja) * | 2003-03-26 | 2004-10-21 | Matsushita Electric Works Ltd | 画像処理装置 |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2006148425A (ja) | 2006-06-08 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP4763312B2 (ja) | 動画像データの符号化方法、復号化方法、これらを実行する端末装置、及び双方向対話型システム | |

| JP2009510877A (ja) | 顔検出を利用したストリーミングビデオにおける顔アノテーション | |

| KR100889367B1 (ko) | 네트워크를 통한 가상 스튜디오 구현 시스템 및 그 방법 | |

| JP2006197505A (ja) | カメラ制御装置、カメラシステム、電子会議システムおよびカメラ制御方法 | |

| WO2007019514A3 (en) | Network panoramic camera system | |

| US8467509B2 (en) | Video displaying apparatus, video displaying system and video displaying method | |

| JP7249766B2 (ja) | 情報処理装置、システム、情報処理装置の制御方法、及び、プログラム | |

| JP4649640B2 (ja) | 画像処理方法、画像処理装置、及びコンテンツ作成システム | |

| JP2011527841A (ja) | 画像処理装置およびそれを用いた撮像装置 | |

| KR20110052933A (ko) | 촬영장치 및 촬영영상 제공방법 | |

| JP7334470B2 (ja) | 映像処理装置、ビデオ会議システム、映像処理方法、およびプログラム | |

| US20180268819A1 (en) | Communication terminal, communication method, and computer program product | |

| CN114531564A (zh) | 处理方法及电子设备 | |

| JP2006014119A (ja) | 撮影画像送受信システム | |

| JP4565232B2 (ja) | 講義ビデオ作成システム | |

| JP2004266670A (ja) | 撮像装置及び方法、画像情報提供システム並びにプログラム | |

| CN110913118A (zh) | 视频处理方法、装置及存储介质 | |

| US20230292011A1 (en) | Information processing system, image-capturing device, and display method | |

| KR102029604B1 (ko) | 실시간 방송 편집 시스템 및 편집 방법 | |

| JP6004978B2 (ja) | 被写体画像抽出装置および被写体画像抽出・合成装置 | |

| JP2004007283A (ja) | 映像配信システム、プログラム及び記録媒体 | |

| JP2011066745A (ja) | 端末装置、通信方法および通信システム | |

| JP7026839B1 (ja) | リアルタイムデータ処理装置 | |

| WO2023189520A1 (ja) | 情報処理システム、情報処理方法、及び、プログラム | |

| JP2008228014A (ja) | 映像会議システム、会議映像処理方法、プログラム及び記録媒体 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| RD04 | Notification of resignation of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7424 Effective date: 20060425 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20071025 |

|

| RD04 | Notification of resignation of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7424 Effective date: 20071129 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20100824 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20101020 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20101109 |

|

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20101124 |

|

| R150 | Certificate of patent or registration of utility model |

Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20131224 Year of fee payment: 3 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| LAPS | Cancellation because of no payment of annual fees |