JP4357155B2 - アニメーション画像の生成プログラム - Google Patents

アニメーション画像の生成プログラム Download PDFInfo

- Publication number

- JP4357155B2 JP4357155B2 JP2002153887A JP2002153887A JP4357155B2 JP 4357155 B2 JP4357155 B2 JP 4357155B2 JP 2002153887 A JP2002153887 A JP 2002153887A JP 2002153887 A JP2002153887 A JP 2002153887A JP 4357155 B2 JP4357155 B2 JP 4357155B2

- Authority

- JP

- Japan

- Prior art keywords

- model

- vertex

- target point

- coordinates

- user model

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T13/00—Animation

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2210/00—Indexing scheme for image generation or computer graphics

- G06T2210/44—Morphing

-

- Y—GENERAL TAGGING OF NEW TECHNOLOGICAL DEVELOPMENTS; GENERAL TAGGING OF CROSS-SECTIONAL TECHNOLOGIES SPANNING OVER SEVERAL SECTIONS OF THE IPC; TECHNICAL SUBJECTS COVERED BY FORMER USPC CROSS-REFERENCE ART COLLECTIONS [XRACs] AND DIGESTS

- Y10—TECHNICAL SUBJECTS COVERED BY FORMER USPC

- Y10S—TECHNICAL SUBJECTS COVERED BY FORMER USPC CROSS-REFERENCE ART COLLECTIONS [XRACs] AND DIGESTS

- Y10S345/00—Computer graphics processing and selective visual display systems

- Y10S345/949—Animation processing method

- Y10S345/956—Language driven animation

-

- Y—GENERAL TAGGING OF NEW TECHNOLOGICAL DEVELOPMENTS; GENERAL TAGGING OF CROSS-SECTIONAL TECHNOLOGIES SPANNING OVER SEVERAL SECTIONS OF THE IPC; TECHNICAL SUBJECTS COVERED BY FORMER USPC CROSS-REFERENCE ART COLLECTIONS [XRACs] AND DIGESTS

- Y10—TECHNICAL SUBJECTS COVERED BY FORMER USPC

- Y10S—TECHNICAL SUBJECTS COVERED BY FORMER USPC CROSS-REFERENCE ART COLLECTIONS [XRACs] AND DIGESTS

- Y10S345/00—Computer graphics processing and selective visual display systems

- Y10S345/949—Animation processing method

- Y10S345/956—Language driven animation

- Y10S345/957—Actor

Landscapes

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Processing Or Creating Images (AREA)

Description

【発明の属する技術分野】

本発明は、特に、発話に対応した口の動きを表す顔面アニメーションに適したアニメーション画像の生成プログラムに関する。

【0002】

【従来の技術】

近年、コンピュータグラフィック(CG)技術を用いて3次元(3D)アニメーション画像を作成し、映像表示することが行われている。

【0003】

ここで、アニメーションの一形態として、キャラクタの瞬間々の発話、感情に対応して顔の口の状態、表情の状態の動き映像を表示することが行われる。これまで、かかる動き映像の作成においては、キャラクタの動きの1コマ毎に顔のモデルのアニメーションパターン画像を作成すること即ち、顔面モデルの頂点を動かしたり、モデルに組み込まれた「骨」を動かしたりして画像が作成されていた。

【0004】

このようにCGでの発話、表情の顔アニメーションを作成する場合、映像の1コマ毎に顔のモデルのアニメーションパターン画像を作成する。それらを時間軸に沿って並べ、連続的に再生していた。

【0005】

したがって,ある一つのキャラクタモデルの顔面アニメーションを作成する場合,アニメーション生成作業に先だって,全ての表情形状と,全ての発話形状の画像を作成する。さらにそれらの画像を組み合わせて全体を作成する。

【0006】

さらに、あるキャラクタモデルAの形状データは他のキャラクタモデルBの顔形状には使用する事が出来ない。したがって、同様の画像データを登場モデルの全てについて作成しなければならず、膨大なコストと製作時間が必要となる。

【0007】

ここで,ある3次元コンピュータグラフィック(3DCG)モデルを変形する時,スケルトンと呼ばれる「擬似的な関節機構」を用いる方法が従来から使用されている。しかし,顔は人体の腕や足のように関節で動いている訳ではないので,発話や表情をスケルトンを用いて作成する事は難しい。

【0008】

また、Wrapデフォメーションという従来方法では、あるモデル形状Aの変更を別モデル形状Bに反映させるという方法がある。かかるWrapデフォメーションによる計算例は、次の通りである。

【0009】

モデルA、モデルBの頂点数を共に6とすると、

モデルAの頂点1(X座標)= w1xモデルB頂点1(X座標)+w2xモデルB頂点2(X座標)+w3xモデルB頂点3(X座標)+w4xモデルB頂点4(X座標)+w5xモデルB頂点5(X座標)+w6xモデルB頂点6(X座標)

モデルAの頂点1(Y座標)=・・・上記と同様・・

モデルAの頂点1(Z座標)=・・・上記と同様・・

但し、wn(n=1〜6)はモデルBの各頂点からモデルAの特定頂点への重み係数である。

【0010】

上記の計算例から理解できる様に、モデル相互の頂点数が少ない場合(10点程度)では計算量は多くなく、無理なく計算動作が可能である。しかし、一般の3DCGで使用される顔モデルのように1000点から10数万点の頂点数となる場合は、計算量が膨大となり、現在のパーソナルコンピュータではほとんど現実的な結果は得られない。

【0011】

【発明が解決しようとする課題】

かかる従来のアニメーション生成方法における制作者による作業量並びに計算処理が大きくなるという問題に鑑み、本発明の目的は、複雑な設定なしに容易にアニメーション画像をCGにより生成可能とする、特に、複数種の顔面アニメーション画像をCGにより生成するのに好適なアニメーション画像の生成プログラムを提供することにある。

【0012】

さらに、本発明の目的は、パーソナルコンピュータによって容易に計算処理が可能なアニメーション画像をCGにより生成可能とするプログラムを提供することにある。

【0013】

【課題を解決するための手段】

上記の課題を達成する本発明の第1の側面は,記憶媒体と演算手段を備えたコンピュータシステムで実行されるフィッティング情報を生成プログラムであって,前記演算手段に,前記記憶媒体に格納された標準モデルの特定頂点と前記記憶媒体に格納されたユーザーモデルの特定頂点とを選択制御するステップと,前記選択された標準モデルの特定頂点を第一の目標点とし,前記ユーザーモデルの特定頂点を第二の目標頂点として,前記第一の目標頂点を前記第二の目標頂点に対応付けるように制御するステップと,前記第一の目標頂点の座標を,前記第二の目標頂点の座標に近似するように制御して,フィッティング情報を生成するステップと,を実行させることを特徴とする。

【0015】

前記フィッティング情報に,更にテキスト又は音声に対応した変形が定義されてもよい。

【0016】

前記頂点の近似制御は,アフイン変換により行うことができる。

【0017】

さらに,前記アフイン変換を,複数回に分けて実行するようにしてもよい。

【0018】

さらに,上記の課題を達成する本発明の第2の側面は,記憶媒体と演算手段を備えたコンピュータシステムで実行されるフィッティング情報を生成プログラムであって,前記演算手段に,前記記憶媒体に格納された基準となる標準モデルの顔面画像の目標点を有し,顔面の特定位置を指定可能なワイヤーフレームデータと,ユーザーモデルの顔面画像の読み出しを制御するステップと,ユーザにより設定される前記ワイヤーフレームデータによる前記ユーザーモデルの顔面画像に座標位置を特定するように制御するステップと,

前記ワイヤーフレームデータにより特定されるユーザーモデルの顔面画像の目標座標に前記標準モデルの目標点座標をアフイン変換させてフィッティング情報を生成するステップと,を実行させることを特徴とする。

【0020】

前記演算手段に,さらに,前記アフイン変換された標準モデルの顔面画像の頂点から前記ユーザーモデルにレイを飛ばし,前記ユーザーモデルとの投影点を新たな頂点として前記標準モデルの三角形を補正するステップを実行させることができる。

【0022】

更に,前記デフォメーションの定義を与える処理として,前記制御手段に,前記ユーザーモデルから標準モデルにレイを飛ばし,前記標準モデルとの交点を投影点とするステップと,前記投影点を内包する標準モデルの三角形の前記入力されるテキストもしくは,音声に対応する変形の前後の頂点により得られるアフイン変換行列と,前記投影点との積から移動ベクトルを算出するステップと,前記移動ベクトルを前記対象としている投影点に対応するユーザーモデルの頂点に加算して変形させるステップを,行わせてもよい。

【0023】

更にまた,上記の課題を達成する本発明の第3の側面は,記憶媒体と演算手段を備えたコンピュータシステムで実行されるフィッティング情報生成プログラムであって,前記演算手段に,前記記憶媒体に格納された標準モデルの特定位置の座標と前記記憶媒体に格納されたユーザーモデルの特定位置の座標とを選択制御するステップと,前記選択された標準モデルの特定位置の座標を第一の目標点とし,前記ユーザーモデルの特定位置の座標を第二の目標点として,前記第一の目標点を前記第二の目標点に対応付けるように制御するステップと,前記第一の目標点の座標を,前記第二の目標点の座標に近似するように制御して,フィッティング情報を生成するステップと,を実行させることを特徴とする。

また,上記の課題を達成する本発明の第4の側面は,記憶媒体と演算手段を備えたコンピュータシステムで実行されるアニメーション画像生成プログラムであって,前記演算手段に,前記記憶媒体に格納された標準モデルの特定頂点と前記記憶媒体に格納されたユーザーモデルの特定頂点とを選択制御するステップと,前記選択された標準モデルの特定頂点を第一の目標点とし,前記ユーザーモデルの特定頂点を第二の目標頂点として,前記第一の目標頂点を前記第二の目標頂点に対応付けるように制御するステップと,前記第一の目標頂点の座標を,前記第二の目標頂点の座標に近似するように制御して,フィッティング情報を生成するステップと,前記記憶媒体に格納された標準モデルのアニメーションデータと前記フィッティング情報とに基づき、前記ユーザーモデルをアニメーション処理するステップと,を実行させることを特徴とする。

上記の課題を達成する本発明の第4の側面は,記憶媒体と演算手段を備えたコンピュータシステムで実行される,フィッティング情報生成方法であって,前記演算手段により, 前記記憶媒体に格納された標準モデルの特定位置の座標と前記記憶媒体に格納されたユーザーモデルの特定位置の座標とを選択制御し,前記選択された標準モデルの特定位置の座標を第一の目標点とし,前記ユーザーモデルの特定位置の座標を第二の目標点として,前記第一の目標点を前記第二の目標点に対応付けるように制御し,前記第一の目標点の座標を,前記第二の目標点の座標に近似するように制御して,フィッティング情報を生成する,ことを特徴とする。

また,記の課題を達成する本発明の第5の側面は,コンピュータシステムであって,標準モデルとユーザーモデルを格納する記憶媒体と,演算手段を備え,前記演算手段が,前記記憶媒体に格納された標準モデルの特定位置の座標と前記記憶媒体に格納されたユーザーモデルの特定位置の座標とを選択制御し,前記選択された標準モデルの特定位置の座標を第一の目標点とし,前記ユーザーモデルの特定位置の座標を第二の目標点として,前記第一の目標点を前記第二の目標点に対応付けるように制御し,前記第一の目標点の座標を,前記第二の目標点の座標に近似するように制御して,フィッティング情報を生成する,ことを特徴とする。

【0024】

以下に図面に従い説明される発明の実施の形態例から、さらに本発明の特徴が明らかになる。

【0025】

【発明の実施の形態】

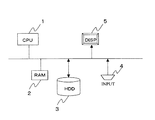

図1は、本発明のアニメーション画像生成プログラムを実行する一般的なパーソナルコンピュータシステムの構成例ブロック図である。

【0026】

なお、以下の実施の形態例においては、アニメーション画像として、発話に対応した顔の動きを表示する顔面アニメーションを例にして説明するが、本発明の適用はこれに限定されるものではない。

【0027】

図1の構成において、本発明の適用例としての顔面アニメーション画像生成プログラムのデータを演算するCPU1,作業用メインメモリ2,顔面アニメーション画像生成プログラムを格納するハードディスクを含む補助記憶装置3を有する。

【0028】

さらに、CG製作者によるコマンド等の入力のためのキーボード等の入力装置4及び、作業中及び完了後の画像及び音声を表示する、ディスプレイモニタ及びスピーカを含む表示装置5が接続される。

【0029】

本発明の適用例である顔面アニメーション画像生成プログラムは、その一部として標準モデルについての顔面アニメーション画像プログラムが既に作成され、補助記憶装置3に格納されている。

【0030】

すなわち,標準モデルにより,所定の発話に対応した口の動きを表すアニメーション及び,感情に対応した顔面の変化を表す複数のアニメーション生成アルゴリズムが用意されている。ここで,標準モデルによるアニメーション画像の生成の手法は,例えば,著書「3Dフェイシャル・アニメーション頭部の造形&リップシンクテクニック」ビル・フレミング著,風工舎等に記載され,更に既に市販されている例えば,Maya:Alis Wavefront株式会社製品,SoftImage:アビッドジャパン株式会社製品,3D Studio:オートデスク株式会社ディスクリートディビジョン製品等のプログラムを使用して,標準モデルによるアニメーション画像の生成が可能である。

【0031】

さらに、顔面アニメーション画像生成プログラムの一部として顔面の特定位置を指定できるワイヤーフレームデータが補助記憶装置3に格納されている。

【0032】

さらに、CG作成者は、登場するキャラクモデルに対応したモデル顔面画像を生成し、その画像データを用意しておくことが必要である。

【0033】

つぎに、上記を前提として本発明の顔面アニメーション画像生成プログラムによる顔面アニメーション画像生成の工程を説明する。

【0034】

図2は、本発明の顔面アニメーション画像生成プログラムによる顔面アニメーション画像生成の工程の一実施例を示すフロー図である。かかるフロー図の工程は、補助記憶装置3に格納された顔面アニメーション画像生成プログラムによりCPU1を制御して実行される。

【0035】

図2において、CG作成者は、入力装置4により複数のユーザーモデルの一つを選択する(処理工程P1)。ついで、ワイヤーフレーム表示の指示を行う(処理工程P2)。

【0036】

表示されたワイヤーフレームを用いてフィッティング情報ファイルを作成する(処理工程P3)。

【0037】

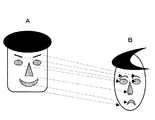

ここで、フィッティングとは、標準モデルAの画像を選択されたユーザーモデルBの画像に座標変換することを意味する。

【0038】

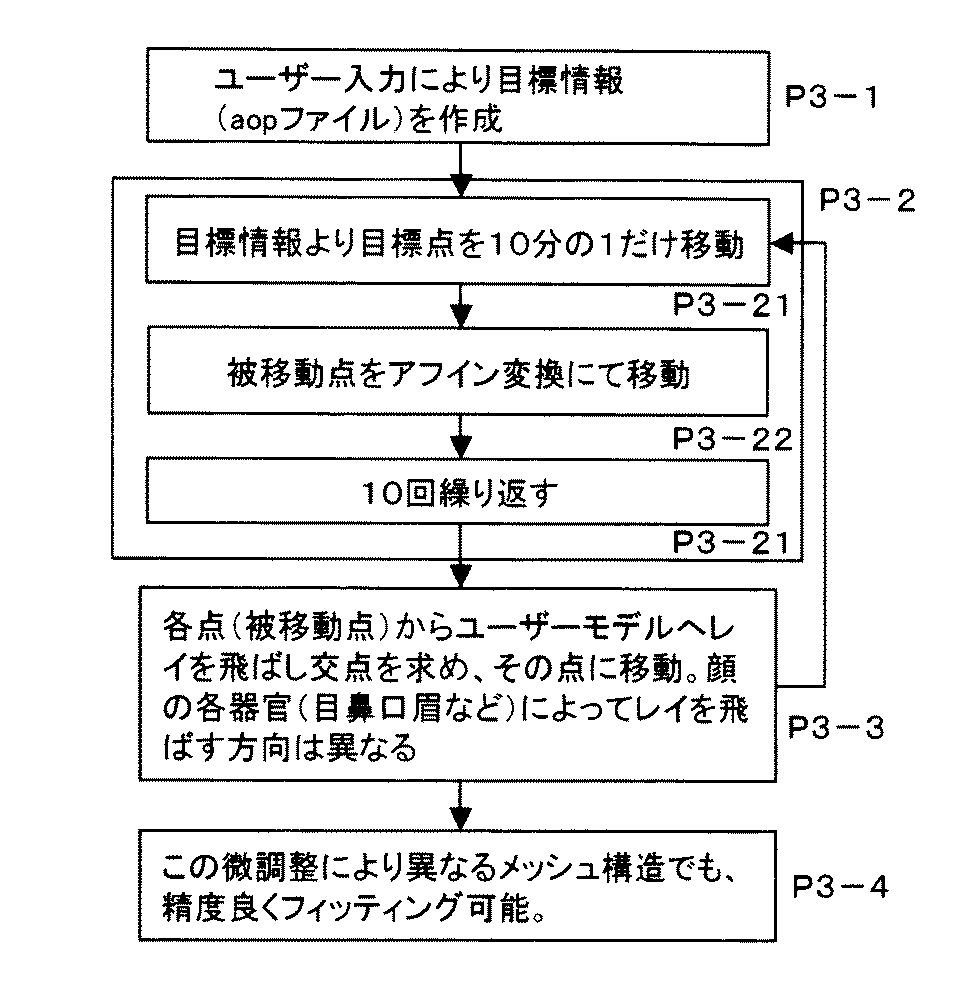

図3は、フィッティング情報ファイルを作成する詳細フロー図である。フィッティング情報の作成のために先ず目標情報を作成する(処理工程P3−1)。

【0039】

図4に示すように標準モデルAの特定位置(目標点)、例えば標準モデルAの顔面の特定位置として、顔の輪郭、眉毛,目、鼻、口等の部位を、ユーザーモデルBの画像の対応部位に目標位置として対応づける。

【0040】

図5は、標準モデルAの特定位置(目標点)を示すワイヤーフレームFをユーザーモデルBに合わせた状態を示す図である。CG作成者は、標準モデルAの特定位置(目標点)を示すワイヤーフレームFを用い、図5aに示すユーザーモデルBに重ねる様に変形して、図5bに示すように標準モデルAの特定位置をユーザーモデルBの画像に対応づけ、目標情報ファイル(aop:auto-fitting outline position)を得る。

【0041】

次いで、この目標情報ファイルで特定されるユーザーモデルBの目標座標に標準モデルAの座標をアフイン変換する(処理工程P3−2)。この時、標準モデルAとユーザーモデルBの目標座標までの距離を実施例として10分割し、10ステップで徐々にアフイン変換していく(処理工程P3−21〜P3−23)。これにより大きな変形により誤差を生じることが回避される。

【0042】

図6は、このアフイン変換を徐々に行う様子を示す図である。標準モデルAのワイヤーフレームFで特定される複数の目標点をユーザーモデルBに対応付けるように、10ステップに分けて徐々にアフイン変換によって、近づけていく。

【0043】

図6において示されるaopファイル内部は、ユーザーモデルBの複数の目標点の3次元座標を示している。この座標は、先に説明したようにワイヤーフレームFで特定される目標店の座標に対応する。

【0044】

ここで、図7によりアフイン変換について説明する。いま、図7において、三角形A(標準モデルに相当)を三角形B(ユーザーモデルに相当)にアフイン変換することを考える。三角形Aは、3つの頂点座標(x1,y1)(x2,y2)(x3,y3)を有している。内部の点Pは、これら3頂点の座標から特定される。三角形Bは、3つの頂点座標(x1B,y1B)(x2B,y2B)(x3B,y3B)を有している(図7A参照)。

【0045】

先ず三角形Aの頂点(x1,y1)を三角形Bの頂点(x1B,y1B)との距離の1/10の点にある座標点(x1’,y1’)に移動し(図7B参照)、次いで、同様に第2の頂点(x2,y1)を(x2’,y2’)に移動し(図7C参照)、更に第3の頂点(x3,y3)を(x3’,y3’)に移動する(図7D参照)。

【0046】

この過程を10回繰り返すことにより、三角形Aが、三角形Bに移動する。これに対応して合計30回のアフイン変換後に内部の点Pも図7Dに示すように三角形Bの内部に移動する。

【0047】

ここで、アフイン変換を式で表すと次のようである。

【0048】

同一平面上にある3点を行列に直すと、

【数1】

これら三点をアフィン行列Tで移動した点を行列に直すと、

【数2】

この三点も同一平面上の点である。

【0049】

以上から

【数3】

よってアフイン変換行列Tは,

【数4】

【0050】

但し:

【数5】

は,行列xの逆行列を表す。

【0051】

図3において、フィッティングを精度よく行うための微調整処理を行う(処理工程P3−3、P3−4)。これは、顔面モデルの各器官(目、鼻、口、眉)等を詳細に表現することが必要であるためである。

【0052】

図8A,8Bは、これを説明する図である。図8Aは、先に説明したアフイン変換により標準モデルAを、ユーザーモデルBにフィティングした状態を示す図である。ユーザーモデルBの目標座標T1〜T4に標準モデルBの対応する目標点を合わせている。

【0053】

このとき、ユーザーモデルBに対し、標準モデルAの目標点P0が、突き出た状態になっている。したがって、さらに微調整する必要がある。

【0054】

図8Bは、この突き出た頂点P0を微調整することを説明する図である。図8Bにおいて、標準モデルAの突き出た頂点P0から前記頂点P0の法線方向に、ユーザーモデルBにレイ(RAY)を飛ばし、その先端とユーザーモデルBとの交点を投影点P1とする(処理工程P3−3)。したがって、これにより頂点P0と頂点T1〜T4で形成される三角形は、頂点P1と頂点T1〜T4で形成される三角形に変形され、よりユーザーモデルBに近似される(処理工程P3−4)。

【0055】

これにより、標準モデルAのアニメーションの動きに対応してユーザーモデルAに同様の動きを与えることが可能である。

【0056】

図9は、フィティング処理前の標準のモデルAとユーザーモデルBのフレーム画像である。また、図10は、フィティング処理後の標準のモデルAとユーザーモデルBのフレーム画像である。これらの図を比較すると、図10において標準モデルAはフィッティング前のユーザーモデルBに近似されたフレーム画像を示している。

【0057】

図11は、フィッティング後のユーザーモデルBにフィッティングされた3次元画像であり、図12は、図11のユーザーモデルBの3次元画像を回転して斜めから見た図である。

【0058】

上記のようにユーザーモデルBに標準モデルAをフィッティングしたデータを用いて、標準モデルAのアニメーション画像生成プログラムを適用することによりユーザーモデルBのアニメーション画像を容易に得ることが可能である。

【0059】

更に、標準モデルAの複数のユーザーモデルBに対して同様にフィッティング行うことにより、複数のユーザーモデルのアニメーション画像を容易に生成することができる。

【0060】

次に、オペレータにより入力されるテキストあるいは音声に対応したモデルの口の動きのアニメーションを与えることが重要である。このために図2において、発話に対応してユーザーモデルに変形(デフォメーション)の定義を与える処理(処理工程P4)が行われる。

【0061】

図13は、このデフォメーション定義を与える処理(処理工程P4)の詳細動作フロー図である。図14は、この動作フローに対応する説明図である。

【0062】

図13において、図14Aに示すようにユーザーモデルBから標準モデルAにレイ(RAY)を飛ばす(処理工程P4−1)。このとき、飛ばしたレイと標準モデルとの交点を投影点PRとする(処理工程P4−2)。

【0063】

このとき、テキストや音声により標準モデルAの顔面がアニメーション(変形)する(処理工程P4−3)。これにより、標準モデルAのアニメーションによって、投影点PRを内包する標準モデルAの三角形(図14Bにおいて、頂点abcを有する三角形)が変形する(処理工程P4−4)。

【0064】

変形後の三角形の頂点a'b'c'と、変形前の三角形の頂点abcの6頂点によりアフイン変換行列が求まる。このアフイン変換行列と投影点の積からと投影点の移動ベクトル(PR→PR’)が取得できる(処理工程P4−6)。

【0065】

この移動ベクトルを、現在対象としている投影点PRに対応するユーザーモデルの頂点(レイを飛ばした頂点)に加算して、図14Cに示すように、ユーザーモデルを変形して、アニメーションとさせる(処理工程P4−7)。

【0066】

次に、図2に戻り説明すると、このように生成されたアニメーションアルゴリズムにおいて、発話データにその発話時のユーザーモデルの感情をパラメータとして付加する(処理工程P5)

すなわち、ユーザーモデルの発話時の怒り、悲しみ、笑い等の感情に対応しても顔面に表情としての変形が現れる。したがって、あらかじめ、ユーザーモデルの感情に対応する複数のパラメータをアニメーション作成モードとして用意しておく。これを上記に生成されたユーザーモデルにモードに対応して選択する(処理工程P5)。

【0067】

このようにして得られたユーザーモデルに基づいて、標準モデルのアニメーション作成プログラムを実行することにより、任意のユーザーモデルに対して容易にアニメーション画像を生成することが可能である。

【0068】

【発明の効果】

上記に図面に従い、実施の形態を説明したように本発明の適用により、複数のアニメーション画像を、標準モデルのアニメーション生成アルゴリズムから容易に得ることができる。さらに、複数種の異なるユーザーモデルに対しても同様にアニメーション画像を生成することが可能である。

【図面の簡単な説明】

【図1】本発明の顔面アニメーション画像生成プログラムを実行する一般的なパーソナルコンピュータシステムの構成例ブロック図である。

【図2】本発明の顔面アニメーション画像生成プログラムによる顔面アニメーション画像生成の工程の一実施例を示すフロー図である。

【図3】フィッティング情報ファイルを作成する詳細フロー図である。

【図4】フィッティング情報ファイルを作成を説明する図である。

【図5】標準モデルAの特定位置(目標点)を示すワイヤーフレームFをユーザーモデルBに合わせた状態を示す図である。

【図6】アフイン変換を徐々に行う様子を示す図である。

【図7】アフイン変換を説明する図である。

【図8】フィッティングにおける微調整処理を説明する図である。

【図9】フィティング処理前の標準のモデルAとユーザーモデルBのフレーム画像である。

【図10】フィティング処理後の標準のモデルAとユーザーモデルBのフレーム画像である。

【図11】フィッティング後のユーザーモデルBにフィッティングされた3次元画像である。

【図12】図11のユーザーモデルBの3次元画像を回転して斜めから見た図である。

【図13】デフォメーション定義を与える処理(処理工程P4)の詳細動作フロー図である。

【図14】デフォメーション定義を与える処理(処理工程P4)動作フローに対応する説明図である。

【符号の説明】

1 CPU

2 メインメモリ

3 補助記憶装置

4 入力装置

5 表示装置

Claims (7)

- 記憶媒体と演算手段を備えたコンピュータシステムで実行されるプログラムであって、

前記演算手段を、

前記記憶媒体に格納された標準モデルの特定頂点座標と前記記憶媒体に格納されたユーザーモデルの特定頂点座標とを選択させる手段として、

前記選択された標準モデルの特定頂点座標を第一の目標点とし、前記ユーザーモデルの特定頂点座標を第二の目標点として、前記第一の目標点の座標を前記第二の目標点の座標に対応付ける手段として、

前記対応付けられた第一の目標点と前記第二の目標点をアフィン変換により近似させてフィッティング情報を生成する手段として、更に、

前記アフィン変換された標準モデルの突き出た頂点から前記頂点の法線方向に、前記ユーザモデルにレイを飛ばし、前記ユーザーモデルとの交点を投影点とする新たな頂点で前記標準モデルの三角形を補正する手段として、

機能させることを特徴とするフィッティング情報生成プログラム。 - 請求項1において、

さらに、前記演算手段を、

前記ユーザーモデルから標準モデルにレイを飛ばし、前記標準モデルとの交点を投影点とする手段として、

前記投影点を内包する標準モデルの三角形に入力される前記テキストもしくは、音声に対応する変形の前後の頂点により得られるアフィン変換行列と、前記投影点との積から移動ベクトルを算出する手段として、

前記移動ベクトルを前記対象としている投影点に対応するユーザーモデルの頂点に加算して変形させる手段として、

機能させることを特徴とするフィッティング情報生成プログラム。 - 記憶媒体と演算手段を備えたコンピュータシステムで実行されるプログラムであって、

前記演算手段を、

前記記憶媒体に格納された基準となる標準モデルの顔面画像の目標点を有し、顔面の特定位置座標を指定可能なワイヤーフレームデータと、ユーザーモデルの顔面画像の読み出しを行う手段として、

ユーザにより設定される前記ワイヤーフレームデータにより、前記ユーザーモデルの顔面画像に座標位置を特定する手段として、

前記ワイヤーフレームデータにより特定されるユーザーモデルの顔面画像の目標座標に前記標準モデルの目標点座標をアフィン変換させてフィッティング情報を生成する手段として、

前記アフィン変換された標準モデルの顔面画像の突き出た頂点から前記頂点の法線方向に、前記ユーザーモデルにレイを飛ばし、前記ユーザーモデルとの投影点とする新たな頂点として前記標準モデルの三角形を補正する手段として、

機能させることを特徴とするフィッティング情報生成プログラム。 - 記憶媒体と演算手段を備えたコンピュータシステムで実行されるプログラムであって、

前記演算手段を、前記記憶媒体に格納された標準モデルのアニメーションデータと、請求項1乃至3のいずれかに記載のフィッティング情報生成プログラムの実行により生成されたフィッティング情報とに基づき、前記ユーザーモデルをアニメーション処理する手段として機能させる

ことを特徴とするアニメーション画像生成プログラム。 - 請求項1乃至4のいずれかに記載されたプログラムが格納された記録媒体。

- 記憶媒体と演算手段を備えたコンピュータシステムで実行される、フィッティング情報生成方法であって、

前記演算手段により、

前記記憶媒体に格納された標準モデルの特定頂点座標と前記記憶媒体に格納されたユーザーモデルの特定頂点座標とを選択させ、

前記選択された標準モデルの特定頂点座標を第一の目標点とし、前記ユーザーモデルの特定頂点座標を第二の目標点として、前記第一の目標点の座標を前記第二の目標点の座標に対応付けを行わせ、

前記第一の目標点と前記第二の目標点をアフィン変換により近似させてフィッティング情報を生成させ、

前記ユーザーモデルに対して、前記アフィン変換された標準モデルの突き出た頂点から前記頂点の法線方向に、前記ユーザモデルにレイを飛ばし、前記ユーザーモデルとの投影点とする新たな頂点で前記標準モデルの三角形を補正させる、

ことを特徴とするフィッティング情報生成方法。 - 標準モデルとユーザーモデルを格納する記憶媒体と、演算手段を備え、

前記演算手段が、

前記記憶媒体に格納された標準モデルの特定頂点座標と前記記憶媒体に格納されたユーザーモデルの特定頂点座標とを選択する手段として、

前記選択された標準モデルの特定頂点座標を第一の目標点とし、前記ユーザーモデルの特定頂点座標を第二の目標点として、前記第一の目標点の座標を前記第二の目標点の座標に対応付ける手段として、

前記対応付けられた第一の目標点と前記第二の目標点をアフィン変換により近似させてフィッティング情報を生成する手段として、

前記ユーザーモデルに対して、前記アフィン変換された標準モデルの突き出た頂点から前記頂点の法線方向に、前記ユーザモデルにレイを飛ばし、前記ユーザーモデルとの交点を投影点前記標準モデルの三角形を補正する手段として

機能することを特徴とするコンピュータシステム。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2002153887A JP4357155B2 (ja) | 2002-05-28 | 2002-05-28 | アニメーション画像の生成プログラム |

| US10/441,194 US7477253B2 (en) | 2002-05-28 | 2003-05-20 | Storage medium storing animation image generating program |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2002153887A JP4357155B2 (ja) | 2002-05-28 | 2002-05-28 | アニメーション画像の生成プログラム |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2003346181A JP2003346181A (ja) | 2003-12-05 |

| JP2003346181A5 JP2003346181A5 (ja) | 2005-12-02 |

| JP4357155B2 true JP4357155B2 (ja) | 2009-11-04 |

Family

ID=29770811

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2002153887A Expired - Fee Related JP4357155B2 (ja) | 2002-05-28 | 2002-05-28 | アニメーション画像の生成プログラム |

Country Status (2)

| Country | Link |

|---|---|

| US (1) | US7477253B2 (ja) |

| JP (1) | JP4357155B2 (ja) |

Families Citing this family (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4559092B2 (ja) * | 2004-01-30 | 2010-10-06 | 株式会社エヌ・ティ・ティ・ドコモ | 携帯通信端末及びプログラム |

| US8115774B2 (en) * | 2006-07-28 | 2012-02-14 | Sony Computer Entertainment America Llc | Application of selective regions of a normal map based on joint position in a three-dimensional model |

| US8749543B2 (en) * | 2006-08-15 | 2014-06-10 | Microsoft Corporation | Three dimensional polygon mesh deformation using subspace energy projection |

| US20080117215A1 (en) * | 2006-11-20 | 2008-05-22 | Lucasfilm Entertainment Company Ltd | Providing A Model With Surface Features |

| US8379026B2 (en) * | 2006-12-29 | 2013-02-19 | Intel Corporation | Multiresolution ray intersection |

| JP5863440B2 (ja) * | 2010-12-28 | 2016-02-16 | キヤノン株式会社 | 情報処理装置および方法 |

| CN112631322B (zh) * | 2020-11-19 | 2023-05-09 | 一飞(海南)科技有限公司 | 生成集群无人机表演动画的方法、系统、无人机及终端 |

Family Cites Families (15)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US4600919A (en) * | 1982-08-03 | 1986-07-15 | New York Institute Of Technology | Three dimensional animation |

| US6232965B1 (en) * | 1994-11-30 | 2001-05-15 | California Institute Of Technology | Method and apparatus for synthesizing realistic animations of a human speaking using a computer |

| JP3551538B2 (ja) | 1995-04-27 | 2004-08-11 | 株式会社日立製作所 | 三次元モデルの作成方法および装置 |

| US5923337A (en) * | 1996-04-23 | 1999-07-13 | Image Link Co., Ltd. | Systems and methods for communicating through computer animated images |

| US5999194A (en) * | 1996-11-14 | 1999-12-07 | Brunelle; Theodore M. | Texture controlled and color synthesized animation process |

| JPH1166345A (ja) | 1997-08-11 | 1999-03-09 | Sega Enterp Ltd | 画像音響処理装置および記録媒体 |

| JPH11149565A (ja) | 1997-11-18 | 1999-06-02 | Sega Enterp Ltd | 画像音響処理装置、画像音響処理方法および記録媒体 |

| IT1315446B1 (it) * | 1998-10-02 | 2003-02-11 | Cselt Centro Studi Lab Telecom | Procedimento per la creazione di modelli facciali tridimensionali apartire da immagini di volti. |

| US6504541B1 (en) * | 1998-10-21 | 2003-01-07 | Tele Atlas North America, Inc. | Warping geometric objects |

| US6573889B1 (en) * | 1999-02-08 | 2003-06-03 | Adobe Systems Incorporated | Analytic warping |

| US6967658B2 (en) * | 2000-06-22 | 2005-11-22 | Auckland Uniservices Limited | Non-linear morphing of faces and their dynamics |

| US6664956B1 (en) * | 2000-10-12 | 2003-12-16 | Momentum Bilgisayar, Yazilim, Danismanlik, Ticaret A. S. | Method for generating a personalized 3-D face model |

| US6888549B2 (en) * | 2001-03-21 | 2005-05-03 | Stanford University | Method, apparatus and computer program for capturing motion of a cartoon and retargetting the motion to another object |

| US6876364B2 (en) * | 2001-08-13 | 2005-04-05 | Vidiator Enterprises Inc. | Method for mapping facial animation values to head mesh positions |

| JP2004021866A (ja) * | 2002-06-19 | 2004-01-22 | Matsushita Electric Ind Co Ltd | オブジェクト形状変形装置 |

-

2002

- 2002-05-28 JP JP2002153887A patent/JP4357155B2/ja not_active Expired - Fee Related

-

2003

- 2003-05-20 US US10/441,194 patent/US7477253B2/en not_active Expired - Fee Related

Also Published As

| Publication number | Publication date |

|---|---|

| JP2003346181A (ja) | 2003-12-05 |

| US20040085320A1 (en) | 2004-05-06 |

| US7477253B2 (en) | 2009-01-13 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5344358B2 (ja) | 演技から作り出される顔アニメーション | |

| US8139068B2 (en) | Three-dimensional animation of soft tissue of characters using controls associated with a surface mesh | |

| Mattheyses et al. | Audiovisual speech synthesis: An overview of the state-of-the-art | |

| KR101819535B1 (ko) | 표정 제어점에 기초한 강체 영역의 표현 방법 및 장치 | |

| US8154544B1 (en) | User specified contact deformations for computer graphics | |

| US8035643B2 (en) | Animation retargeting | |

| EP1345179A2 (en) | Method and apparatus for computer graphics animation | |

| JP2008033940A (ja) | ランタイム・コンピュータ・グラフィックス・アニメーション・エンジンにおけるメッシュ用変形データからスケルトン用アニメーション・データへの変換、スキニング、およびシェーディング | |

| US8358311B1 (en) | Interpolation between model poses using inverse kinematics | |

| JP5109192B2 (ja) | モーションキャプチャにおけるfacs(顔の表情符号化システム)解決法 | |

| CN116583881A (zh) | 用于体积视频数据的数据流、设备和方法 | |

| JP4357155B2 (ja) | アニメーション画像の生成プログラム | |

| US9342912B1 (en) | Animation control retargeting | |

| Li et al. | A survey of computer facial animation techniques | |

| Orvalho et al. | Transferring the rig and animations from a character to different face models | |

| US8237719B1 (en) | Pose-structured animation interface | |

| CA3184824A1 (en) | Systems and methods for computer animation using an order of operations deformation engine | |

| US10748328B2 (en) | Recording medium, information processing apparatus, influence degree deriving method, and image generation method | |

| US8228335B1 (en) | Snapsheet animation visualization | |

| JP2001209823A (ja) | ビデオゲームにおける三次元オブジェクト変形方法及びビデオゲーム装置、並びにビデオゲーム用のプログラムを記録したコンピュータ読み取り可能な記録媒体 | |

| Müller et al. | Realistic speech animation based on observed 3-D face dynamics | |

| JPH08297751A (ja) | 三次元モデルの作成方法および装置 | |

| US8704828B1 (en) | Inverse kinematic melting for posing models | |

| JP6827337B2 (ja) | 手話cg生成装置及びプログラム | |

| JP4358752B2 (ja) | 統計力学的衝突の方法と装置 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20050527 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20051003 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20051018 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20071214 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20071225 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20080221 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20080325 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20080424 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20080521 |

|

| A911 | Transfer to examiner for re-examination before appeal (zenchi) |

Free format text: JAPANESE INTERMEDIATE CODE: A911 Effective date: 20080602 |

|

| A912 | Re-examination (zenchi) completed and case transferred to appeal board |

Free format text: JAPANESE INTERMEDIATE CODE: A912 Effective date: 20080620 |

|

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20090804 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120814 Year of fee payment: 3 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 4357155 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120814 Year of fee payment: 3 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120814 Year of fee payment: 3 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120814 Year of fee payment: 3 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20130814 Year of fee payment: 4 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20130814 Year of fee payment: 4 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| S531 | Written request for registration of change of domicile |

Free format text: JAPANESE INTERMEDIATE CODE: R313531 |

|

| S533 | Written request for registration of change of name |

Free format text: JAPANESE INTERMEDIATE CODE: R313533 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| LAPS | Cancellation because of no payment of annual fees |