JP2019117375A - 撮像装置及びその制御方法及びプログラム - Google Patents

撮像装置及びその制御方法及びプログラム Download PDFInfo

- Publication number

- JP2019117375A JP2019117375A JP2018207634A JP2018207634A JP2019117375A JP 2019117375 A JP2019117375 A JP 2019117375A JP 2018207634 A JP2018207634 A JP 2018207634A JP 2018207634 A JP2018207634 A JP 2018207634A JP 2019117375 A JP2019117375 A JP 2019117375A

- Authority

- JP

- Japan

- Prior art keywords

- imaging

- sound

- detection

- detected

- unit

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

- 238000003384 imaging method Methods 0.000 title claims abstract description 325

- 238000000034 method Methods 0.000 title claims description 119

- 238000001514 detection method Methods 0.000 claims abstract description 256

- 230000008859 change Effects 0.000 claims description 9

- 230000001133 acceleration Effects 0.000 claims description 7

- 239000000203 mixture Substances 0.000 abstract description 3

- 238000012545 processing Methods 0.000 description 95

- 230000008569 process Effects 0.000 description 90

- 230000003287 optical effect Effects 0.000 description 23

- 230000005236 sound signal Effects 0.000 description 19

- 238000004091 panning Methods 0.000 description 16

- 210000003128 head Anatomy 0.000 description 13

- 238000010586 diagram Methods 0.000 description 11

- 230000006870 function Effects 0.000 description 9

- 230000009467 reduction Effects 0.000 description 8

- 238000009434 installation Methods 0.000 description 7

- 230000004048 modification Effects 0.000 description 5

- 238000012986 modification Methods 0.000 description 5

- 238000005070 sampling Methods 0.000 description 5

- 230000000694 effects Effects 0.000 description 4

- 230000004913 activation Effects 0.000 description 2

- 238000004891 communication Methods 0.000 description 2

- 230000007423 decrease Effects 0.000 description 2

- 230000035945 sensitivity Effects 0.000 description 2

- 230000009471 action Effects 0.000 description 1

- 230000003213 activating effect Effects 0.000 description 1

- 238000004364 calculation method Methods 0.000 description 1

- 230000006835 compression Effects 0.000 description 1

- 238000007906 compression Methods 0.000 description 1

- 238000009795 derivation Methods 0.000 description 1

- 238000013461 design Methods 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 239000000284 extract Substances 0.000 description 1

- 210000000887 face Anatomy 0.000 description 1

- 238000009432 framing Methods 0.000 description 1

- 230000000873 masking effect Effects 0.000 description 1

- 238000005259 measurement Methods 0.000 description 1

- 230000007246 mechanism Effects 0.000 description 1

- 230000004044 response Effects 0.000 description 1

- 238000004904 shortening Methods 0.000 description 1

- 230000001360 synchronised effect Effects 0.000 description 1

- 230000007704 transition Effects 0.000 description 1

- 230000001960 triggered effect Effects 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R1/00—Details of transducers, loudspeakers or microphones

- H04R1/20—Arrangements for obtaining desired frequency or directional characteristics

- H04R1/32—Arrangements for obtaining desired frequency or directional characteristics for obtaining desired directional characteristic only

- H04R1/40—Arrangements for obtaining desired frequency or directional characteristics for obtaining desired directional characteristic only by combining a number of identical transducers

- H04R1/406—Arrangements for obtaining desired frequency or directional characteristics for obtaining desired directional characteristic only by combining a number of identical transducers microphones

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L25/00—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00

- G10L25/48—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 specially adapted for particular use

- G10L25/51—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 specially adapted for particular use for comparison or discrimination

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/50—Constructional details

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/50—Constructional details

- H04N23/51—Housings

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/695—Control of camera direction for changing a field of view, e.g. pan, tilt or based on tracking of objects

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/698—Control of cameras or camera modules for achieving an enlarged field of view, e.g. panoramic image capture

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R1/00—Details of transducers, loudspeakers or microphones

- H04R1/08—Mouthpieces; Microphones; Attachments therefor

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/22—Procedures used during a speech recognition process, e.g. man-machine dialogue

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/08—Speech classification or search

- G10L2015/088—Word spotting

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/22—Procedures used during a speech recognition process, e.g. man-machine dialogue

- G10L2015/223—Execution procedure of a spoken command

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R2201/00—Details of transducers, loudspeakers or microphones covered by H04R1/00 but not provided for in any of its subgroups

- H04R2201/40—Details of arrangements for obtaining desired directional characteristic by combining a number of identical transducers covered by H04R1/40 but not provided for in any of its subgroups

- H04R2201/401—2D or 3D arrays of transducers

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R3/00—Circuits for transducers, loudspeakers or microphones

- H04R3/005—Circuits for transducers, loudspeakers or microphones for combining the signals of two or more microphones

Landscapes

- Engineering & Computer Science (AREA)

- Signal Processing (AREA)

- Health & Medical Sciences (AREA)

- Multimedia (AREA)

- Acoustics & Sound (AREA)

- Physics & Mathematics (AREA)

- Otolaryngology (AREA)

- General Health & Medical Sciences (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Human Computer Interaction (AREA)

- Computational Linguistics (AREA)

- Studio Devices (AREA)

- Obtaining Desirable Characteristics In Audible-Bandwidth Transducers (AREA)

- Circuit For Audible Band Transducer (AREA)

- Details Of Cameras Including Film Mechanisms (AREA)

- Accessories Of Cameras (AREA)

Abstract

Description

撮像手段を有する撮像装置であって、

前記撮像手段を駆動する駆動手段と、

ユーザのいる方向を検出する第一の検出手段と、

前記撮像装置の動きを検出する第二の検出手段と、

音声を集音するための複数の集音手段と、

前記複数の集音手段を用いて前記音声の音源の方向を検出する第三の検出手段と、

制御手段と、を有し、

前記制御手段は、前記第一の検出手段によって検出したユーザのいる方向と、および、前記第二の検出手段によって検出した前記撮像装置の動きとに基づいて、2つ以上の集音手段を前記複数の集音手段から決定し、

前記第三の検出手段は、前記決定された2つ以上の集音手段を用いて音声の音源の方向を検出し、

前記第三の検出手段が前記決定された2つ以上の集音手段を用いて音声の音源の方向を検出した場合、前記制御手段は前記第三の検出手段が検出した音源の方向に、前記撮像手段の撮像方向を向けるよう前記駆動手段を制御することを特徴とする。

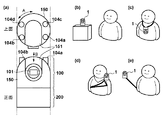

図1は、第1の実施形態に係る撮像装置1のブロック構成図である。撮像装置1は、光学レンズユニットを含み、撮像する撮像方向(光軸方向)が可変の可動撮像部100、及び、可動撮像部100の駆動制御および、撮像装置全体を制御する中央制御部(CPU)を含む支持部200で構成される。

θ[a‐b]=acos(I[a‐b]/d[a‐b])

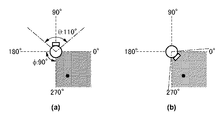

しかしながら、2つのマイクで求めた音方向は、求めた音源方向とθ[a−b]と[a‐b]’(図9(a))との区別ができない。つまり、2つの方向のいずれであるのかまでは特定できない。

条件:ΔT1<ε かつ ΔT2<ε

条件:ΔT3<ε 且つ ΔT4<ε

第2の実施形態を説明する。装置構成は、上記第1の実施形態と同じであるとし、その説明は省略し、異なる点について説明する。

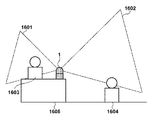

本第3の実施形態は、図6のステップS217の自動動画記録のジョブに適用した例を説明する。図16は、撮像装置1が演壇1605上に固定されており、被写体(の顔)1603、1604が異なる高さとなっている模式図である(一方の人物が起立しており、他方が着席していると考えるとわかりやすい)。

第4の実施形態を説明する。本第4の実施形態は、音方向検出部2044が検出する音方向の検出精度を可変にする例を説明する。音方向検出部2044による音方向の検出原理については既に説明したが、音方向の検出精度を高くするためには、単位時間当たりの検出回数を上げて、その平均値を求めることである。しかし、単位時間値の検出回数を増やすことは、音方向検出部2044の負担の増加、すなわち、可動率を上げることになり、撮像装置1の消費電力の増大になる。

本発明は、上述の実施形態の1以上の機能を実現するプログラムを、ネットワーク又は記憶媒体を介してシステム又は装置に供給し、そのシステム又は装置のコンピュータにおける1つ以上のプロセッサがプログラムを読出し実行する処理でも実現可能である。また、1以上の機能を実現する回路(例えば、ASIC)によっても実現可能である。

Claims (20)

- 撮像手段を有する撮像装置であって、

前記撮像手段を駆動する駆動手段と、

ユーザのいる方向を検出する第一の検出手段と、

前記撮像装置の動きを検出する第二の検出手段と、

音声を集音するための複数の集音手段と、

前記複数の集音手段を用いて前記音声の音源の方向を検出する第三の検出手段と、

制御手段と、を有し、

前記制御手段は、前記第一の検出手段によって検出したユーザのいる方向と、および、前記第二の検出手段によって検出した前記撮像装置の動きとに基づいて、2つ以上の集音手段を前記複数の集音手段から決定し、

前記第三の検出手段は、前記決定された2つ以上の集音手段を用いて音声の音源の方向を検出し、

前記第三の検出手段が前記決定された2つ以上の集音手段を用いて音声の音源の方向を検出した場合、前記制御手段は前記第三の検出手段が検出した音源の方向に、前記撮像手段の撮像方向を向けるよう前記駆動手段を制御する

ことを特徴とする撮像装置。 - 前記第三の検出手段によって検出した音声の音源の方向に複数の候補があった場合、前記第一の検出手段によって検出したユーザのいる方向ではない方向に前記撮像手段の撮像方向を向けるよう前記制御手段は前記駆動手段を制御する

ことを特徴とする請求項1に記載の撮像装置。 - 前記第二の検出手段は前記撮像装置の動きを、前記撮像装置の加速度および角速度に基づいて検出することを特徴とする請求項1または2に記載の撮像装置。

- 前記複数の集音手段は、すべての前記集音手段が直線上に並ばないように配置されることを特徴とする請求項1から3のいずれか1項に記載の撮像装置。

- 撮像手段と、

前記撮像手段を駆動する駆動手段と、

音声を集音するための複数の集音手段と、

前記複数の集音手段を用いて集音した音声の音源の方向を検出する検出手段と、

制御手段と、を有し、

前記制御手段は前記撮像手段によって撮像した画像データに基づいて、撮影の必要のない領域を設定し、

前記検出手段によって検出した音声の音源の方向が、前記撮影の必要のない領域にない場合、前記撮像手段の撮像方向が前記検出手段によって検出した音声の音源の方向に向くよう前記制御手段は前記駆動手段を制御する

ことを特徴とする撮像装置。 - 前記制御手段は、前記撮像手段によって撮像した画像データの輝度が所定の閾値よりも暗い場合、または画像データに映る被写体と前記撮像装置との距離が所定の閾値より小さい場合、その撮像方向を撮影の必要のない領域として設定することを特徴とする請求項5に記載の撮像装置。

- 前記撮像装置が持ち運ばれていると判断した場合、前記制御手段は前記撮影の必要のない領域を再度設定する

ことを特徴とする請求項5または6に記載の撮像装置。 - 前記駆動手段を所定の時間駆動するよう制御した後、前記制御手段はさらに前記撮像手段によって撮像した画像データに基づいて、現在の撮像手段の撮像方向が撮影の必要な領域かどうかを判断し、その判断にしたがって撮影の必要のない領域を再度設定する

ことを特徴とする請求項5または6に記載の撮像装置。 - 撮像手段と、

前記撮像手段をパン動作およびチルト動作によって駆動する駆動手段と、

音声を集音するための複数の集音手段と、

前記複数の集音手段を用いて前記音声の音源の方向のパン角を検出する検出手段と、

制御手段と、を有し、

前記制御手段は前記撮像手段によって被写体を撮像した場合、前記被写体の方向を向いた前記撮像手段の撮像方向のパン角およびチルト角を被写体情報として記録し、

前記検出手段によって検出したパン角と前記被写体情報に含まれるパン角と比較しその2つの角度の差が閾値以下だった場合、前記制御手段は前記検出手段によって検出したパン角および前記被写体情報に含まれるチルト角に撮像手段の撮像方向を向けるよう前記駆動手段を制御し、

前記検出手段によって検出したパン角と前記被写体情報に含まれるパン角と比較しその2つの角度の差が閾値を超える場合、前記制御手段は、前記検出手段によって検出したパン角にいる被写体に前記撮像手段の撮像方向を向けるよう前記駆動手段を制御する

ことを特徴とする撮像装置。 - 前記制御手段は前記検出手段によって検出したパン角および前記被写体情報に含まれるチルト角に撮像手段の撮像方向を向けるよう前記駆動手段を制御し、

前記制御手段は前記検出手段によって検出したパン角および前記被写体情報に含まれるチルト角の方向に被写体を検出した場合、前記制御手段は前記被写体情報を現在の撮像手段の撮像方向のパン角およびチルト角になるよう更新し、

ことを特徴とする請求項9に記載の撮像装置。 - 前記制御手段は前記検出手段によって検出したパン角および前記被写体情報に含まれるチルト角に撮像手段の撮像方向を向けるよう前記駆動手段を制御し、

前記検出手段によって検出したパン角および前記被写体情報に含まれるチルト角の方向に被写体を検出しない場合、前記制御手段は前記被写体情報を削除する

ことを特徴とする請求項9または10に記載の撮像装置。 - 前記検出手段によって検出したパン角との差が閾値以下になる被写体情報が複数ある場合、

前記制御手段は前記複数の被写体情報のそれぞれのチルト角が所定の範囲内に入るようチルト角を決定し、

前記制御手段は、前記検出手段によって検出したパン角および前記決定したチルト角の方向に前記撮像手段の撮像方向を向けるよう前記駆動手段を制御する

ことを特徴とする請求項9から11のいずれか1項に記載の撮像装置。 - 撮像手段と、

前記撮像手段を駆動する駆動手段と、

音声を集音するための複数の集音手段と、

前記複数の集音手段を用いて前記音声の音源の方向を所定の角度の分解能で検出する検出手段と、

制御手段と、

前記制御手段は、前記所定の角度を前記撮像手段の画角より小さくなるように設定し、

前記集音手段によって音声を集音した場合、前記検出手段によって前記所定の角度の分解能で検出した音声の音源の方向に前記撮像手段の撮像方向を向けるよう前記駆動手段を前記制御手段は制御する

ことを特徴とする撮像装置。 - 前記制御手段は、前記撮像手段のズーム倍率を増加させた場合、前記撮像手段の画角より小さくなるように前記所定の角度を大きくするよう設定し、

前記制御手段は、前記撮像手段のズーム倍率を減少させた場合、前記撮像手段の画角より小さくなるように前記所定の角度を小さくするよう設定する

ことを特徴とする請求項13に記載の撮像装置。 - さらに音声による指示を認識する認識手段を有し、

前記認識手段が前記撮像手段のズーム倍率を変更する指示を認識した場合、前記制御手段は、前記撮像手段のズーム倍率を前記指示に従って変更する

ことを特徴とする請求項13または14に記載の撮像装置。 - 撮像手段と、

前記撮像手段を駆動する駆動手段と、

音声を集音するための複数の集音手段と、

前記複数の集音手段を用いて前記音声の音源の方向を検出する検出手段と、を有する撮像装置の制御方法であって、

ユーザのいる方向を検出する第一の検出ステップと、

前記撮像装置の動きを検出する第二の検出ステップと、

前記第一の検出ステップで検出したユーザのいる方向と、および、前記第二の検出ステップで検出した前記撮像装置の動きとに基づいて、2つ以上の集音手段を前記複数の集音手段から決定する決定ステップと、

前記決定ステップで決定された2つ以上の集音手段を用いて音声の音源の方向を前記検出手段によって検出する検出ステップと、

前記検出ステップで音声の音源の方向を検出した場合、前記検出ステップで検出した音源の方向に、前記撮像手段の撮像方向を向けるよう前記駆動手段を制御するステップと、を有する

ことを特徴とする制御方法。 - 撮像手段と、

音声を集音するための複数の集音手段と、を有する撮像装置の制御方法であって、

前記複数の集音手段を用いて集音した音声の音源の方向を検出する検出ステップと、

前記撮像手段によって撮像した画像データに基づいて、撮影の必要のない領域を設定する設定ステップと、

前記検出ステップによって検出した音声の音源の方向が、前記設定ステップで設定した前記撮影の必要のない領域にない場合、前記撮像手段の撮像方向が前記検出ステップによって検出した音声の音源の方向に向くよう駆動する駆動ステップと、を有する

ことを特徴とする制御方法。 - 撮像手段と、

前記撮像手段をパン動作およびチルト動作によって駆動する駆動手段と、

音声を集音するための複数の集音手段と、を有する撮像装置の制御方法であって、

前記撮像手段によって被写体を撮像した場合、前記被写体の方向を向いた前記撮像手段の撮像方向のパン角およびチルト角を被写体情報として記録する記録ステップと、

前記複数の集音手段を用いて前記音声の音源の方向のパン角を検出する検出ステップと、

前記検出ステップで検出したパン角と前記記録ステップで記録した前記被写体情報に含まれるパン角と比較しその2つの角度の差が閾値以下だった場合、前記検出ステップで検出したパン角および前記記録ステップで記録した前記被写体情報に含まれるチルト角に撮像手段の撮像方向を向けるよう前記駆動手段を制御するステップと、

前記検出ステップで検出したパン角と前記記録ステップで記録した前記被写体情報に含まれるパン角と比較しその2つの角度の差が閾値を超える場合、前記検出ステップで検出したパン角にいる被写体に前記撮像手段の撮像方向を向けるよう前記駆動手段を制御するステップと、を有する

ことを特徴とする制御方法。 - 撮像手段と、

前記撮像手段を駆動する駆動手段と、

音声を集音するための複数の集音手段と、を有する撮像装置の制御方法であって、

前記複数の集音手段を用いて前記音声の音源の方向を所定の角度の分解能で検出する検出ステップと、

前記所定の角度を前記撮像手段の画角より小さくなるように設定する設定ステップと、

前記集音手段によって音声を集音した場合、前記検出ステップで前記所定の角度の分解能で検出した音声の音源の方向に前記撮像手段の撮像方向を向けるよう前記駆動手段を制御するステップと、を有する

ことを特徴とする制御方法。 - コンピュータを請求項1から15の何れか1項に記載の撮像装置の各手段として機能させるための、コンピュータが読み取り可能なプログラム。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201880083608.1A CN111527739A (zh) | 2017-12-26 | 2018-11-19 | 摄像设备及其控制方法和记录介质 |

| PCT/JP2018/042695 WO2019130908A1 (ja) | 2017-12-26 | 2018-11-19 | 撮像装置及びその制御方法及び記録媒体 |

| US16/910,622 US20200329202A1 (en) | 2017-12-26 | 2020-06-24 | Image capturing apparatus, control method, and recording medium |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017250108 | 2017-12-26 | ||

| JP2017250108 | 2017-12-26 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2019117375A true JP2019117375A (ja) | 2019-07-18 |

| JP2019117375A5 JP2019117375A5 (ja) | 2021-12-09 |

Family

ID=67304516

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2018207634A Pending JP2019117375A (ja) | 2017-12-26 | 2018-11-02 | 撮像装置及びその制御方法及びプログラム |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US20200329202A1 (ja) |

| JP (1) | JP2019117375A (ja) |

| CN (1) | CN111527739A (ja) |

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2021135368A (ja) * | 2020-02-26 | 2021-09-13 | キヤノン株式会社 | 撮像装置及びその制御方法、プログラム、記憶媒体 |

| US11627247B2 (en) | 2020-10-27 | 2023-04-11 | Canon Kabushiki Kaisha | Imaging apparatus capable of automatically capturing image of subject, control method, and storage medium |

| US12003857B2 (en) | 2020-10-29 | 2024-06-04 | Canon Kabushiki Kaisha | Image capturing apparatus capable of recognizing voice command, control method, and recording medium |

Families Citing this family (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN108391057B (zh) * | 2018-04-04 | 2020-10-16 | 深圳市冠旭电子股份有限公司 | 摄像头拍摄控制方法、装置、智能设备及计算机存储介质 |

| KR102514487B1 (ko) * | 2018-06-07 | 2023-03-27 | 엘지이노텍 주식회사 | 카메라 모듈 및 그의 깊이 정보 추출 방법 |

| CN114363512B (zh) * | 2021-09-30 | 2023-10-24 | 北京荣耀终端有限公司 | 一种视频处理的方法及相关电子设备 |

| US20240073518A1 (en) * | 2022-08-25 | 2024-02-29 | Rovi Guides, Inc. | Systems and methods to supplement digital assistant queries and filter results |

| CN118072744B (zh) * | 2024-04-18 | 2024-07-23 | 深圳市万屏时代科技有限公司 | 基于声纹的语言识别方法及装置 |

Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2002344957A (ja) * | 2001-05-11 | 2002-11-29 | Hitachi Kokusai Electric Inc | 画像監視装置 |

| JP2009188792A (ja) * | 2008-02-07 | 2009-08-20 | Sony Corp | 画像送信装置、画像受信装置、画像送受信システム、画像送信プログラムおよび画像受信プログラム |

| JP2009194900A (ja) * | 2008-01-17 | 2009-08-27 | Canon Inc | 撮像装置及びその制御方法 |

| JP2012175533A (ja) * | 2011-02-23 | 2012-09-10 | Sanyo Electric Co Ltd | 電子機器 |

| JP2012235257A (ja) * | 2011-04-28 | 2012-11-29 | Panasonic Corp | 撮影装置 |

Family Cites Families (10)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US5508734A (en) * | 1994-07-27 | 1996-04-16 | International Business Machines Corporation | Method and apparatus for hemispheric imaging which emphasizes peripheral content |

| JPH09289609A (ja) * | 1996-04-24 | 1997-11-04 | Aiphone Co Ltd | カメラ監視装置 |

| GB2395081A (en) * | 2002-10-31 | 2004-05-12 | Hewlett Packard Co | Image capture system |

| JP2006014054A (ja) * | 2004-06-28 | 2006-01-12 | Nec Access Technica Ltd | カメラ付携帯電子機器による接写防止方法及びカメラ付携帯電子機器 |

| JP2009177480A (ja) * | 2008-01-24 | 2009-08-06 | Yamaha Corp | 撮影装置 |

| JP5141392B2 (ja) * | 2008-06-20 | 2013-02-13 | カシオ計算機株式会社 | 撮像装置、周音範囲表示方法及びプログラム |

| US20140156833A1 (en) * | 2012-11-22 | 2014-06-05 | Perch Communications Inc. | System and method for automatically triggered synchronous and asynchronous video and audio communications between users at different endpoints |

| CN103595953B (zh) * | 2013-11-14 | 2017-06-20 | 华为技术有限公司 | 一种控制视频拍摄的方法和装置 |

| EP3316589B1 (en) * | 2015-06-25 | 2024-02-28 | Panasonic Intellectual Property Management Co., Ltd. | Video synchronization device and video synchronization method |

| JP6058184B1 (ja) * | 2016-03-10 | 2017-01-11 | 株式会社コロプラ | ヘッドマウントディスプレイシステムを制御するための方法、および、プログラム |

-

2018

- 2018-11-02 JP JP2018207634A patent/JP2019117375A/ja active Pending

- 2018-11-19 CN CN201880083608.1A patent/CN111527739A/zh active Pending

-

2020

- 2020-06-24 US US16/910,622 patent/US20200329202A1/en not_active Abandoned

Patent Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2002344957A (ja) * | 2001-05-11 | 2002-11-29 | Hitachi Kokusai Electric Inc | 画像監視装置 |

| JP2009194900A (ja) * | 2008-01-17 | 2009-08-27 | Canon Inc | 撮像装置及びその制御方法 |

| JP2009188792A (ja) * | 2008-02-07 | 2009-08-20 | Sony Corp | 画像送信装置、画像受信装置、画像送受信システム、画像送信プログラムおよび画像受信プログラム |

| JP2012175533A (ja) * | 2011-02-23 | 2012-09-10 | Sanyo Electric Co Ltd | 電子機器 |

| JP2012235257A (ja) * | 2011-04-28 | 2012-11-29 | Panasonic Corp | 撮影装置 |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2021135368A (ja) * | 2020-02-26 | 2021-09-13 | キヤノン株式会社 | 撮像装置及びその制御方法、プログラム、記憶媒体 |

| JP7393245B2 (ja) | 2020-02-26 | 2023-12-06 | キヤノン株式会社 | 撮像装置及びその制御方法、プログラム、記憶媒体 |

| US11627247B2 (en) | 2020-10-27 | 2023-04-11 | Canon Kabushiki Kaisha | Imaging apparatus capable of automatically capturing image of subject, control method, and storage medium |

| US12003857B2 (en) | 2020-10-29 | 2024-06-04 | Canon Kabushiki Kaisha | Image capturing apparatus capable of recognizing voice command, control method, and recording medium |

Also Published As

| Publication number | Publication date |

|---|---|

| US20200329202A1 (en) | 2020-10-15 |

| CN111527739A (zh) | 2020-08-11 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2019117375A (ja) | 撮像装置及びその制御方法及びプログラム | |

| US11265477B2 (en) | Image capturing apparatus and non-transitory recording medium | |

| JP7292853B2 (ja) | 撮像装置及びその制御方法及びプログラム | |

| CN111901524B (zh) | 对焦方法、装置和电子设备 | |

| US8823814B2 (en) | Imaging apparatus | |

| JP2012220959A (ja) | 入力された発話の関連性を判定するための装置および方法 | |

| JP5596408B2 (ja) | デジタルカメラ、その制御方法、及びプログラム | |

| JP2010109477A (ja) | 撮像装置、その制御方法及びプログラム | |

| JP2022070464A (ja) | 撮像装置、制御方法、およびプログラム | |

| US11490001B2 (en) | Imaging apparatus | |

| WO2019130908A1 (ja) | 撮像装置及びその制御方法及び記録媒体 | |

| JP7607155B2 (ja) | 情報処理装置 | |

| JP7451235B2 (ja) | 撮像装置、制御方法、およびプログラム | |

| WO2019130909A1 (ja) | 撮像装置及びその制御方法及び記録媒体 | |

| JP7118746B2 (ja) | 撮像装置及びその制御方法及びプログラム | |

| CN107613194B (zh) | 一种对焦方法、移动终端及计算机可读存储介质 | |

| JP5712599B2 (ja) | 撮像装置及びプログラム | |

| US11245830B2 (en) | Image capture apparatus and control method for same, and storage medium | |

| WO2021140879A1 (ja) | 撮像装置、撮像装置の制御方法、プログラム | |

| JP2022071984A (ja) | 撮像装置、制御方法、およびプログラム | |

| JP2021111960A (ja) | 撮像装置、撮像装置の制御方法、プログラム | |

| JP2022030416A (ja) | 撮像装置、撮像装置の制御方法、およびプログラム | |

| JP2021164060A (ja) | 撮像装置、制御方法、およびプログラム | |

| JP2013201642A (ja) | 電子機器 | |

| CN116052039A (zh) | 鸟类搜寻系统、方法、装置、设备及存储介质 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| RD01 | Notification of change of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7421 Effective date: 20210103 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20210113 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20211101 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20211101 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20221219 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20230215 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20230526 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20230922 |