JP2017102897A - Avatar display system, user terminal, and program - Google Patents

Avatar display system, user terminal, and program Download PDFInfo

- Publication number

- JP2017102897A JP2017102897A JP2016183466A JP2016183466A JP2017102897A JP 2017102897 A JP2017102897 A JP 2017102897A JP 2016183466 A JP2016183466 A JP 2016183466A JP 2016183466 A JP2016183466 A JP 2016183466A JP 2017102897 A JP2017102897 A JP 2017102897A

- Authority

- JP

- Japan

- Prior art keywords

- user

- terminal

- avatar

- information

- image

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Abstract

Description

本発明は、アバター表示システム、ユーザ端末、及びプログラムに関する。 The present invention relates to an avatar display system, a user terminal, and a program.

特許文献1には、複数のユーザがそれぞれユーザステーションを使用してビデオ会議を行うビデオ会議システムにおいて、各ユーザの頭部の動きの情報を他のユーザのユーザステーションへ送り、その情報に基づいてアバターの頭部の動きをユーザの頭部の動きに対応するようにアニメ化する技術が開示されている。 In Patent Document 1, in a video conference system in which a plurality of users perform video conferences using user stations, information on the movements of the heads of each user is sent to the user stations of other users. A technique for animating the movement of the avatar's head to correspond to the movement of the user's head is disclosed.

しかしながら、特許文献1の技術では、アバターの頭部の動きは必ずユーザの頭部の動きに対応したものとなる。 However, in the technique of Patent Document 1, the movement of the avatar's head always corresponds to the movement of the user's head.

本発明は、上記の点に鑑みてなされたものであり、その目的の1つは、ユーザの頭部や視線の動きを他のユーザに対して選択的に公開することが可能なアバター表示システム、ユーザ端末、及びプログラムを提供することにある。 The present invention has been made in view of the above points, and one of its purposes is an avatar display system capable of selectively disclosing the movement of the user's head and line of sight to other users. It is to provide a user terminal and a program.

上述した課題を解決するために、本発明の一態様は、第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムであって、前記第1端末は、前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段と、前記第1ユーザに関する属性情報を記憶するユーザ属性記憶手段と、前記属性情報に基づいて、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段と、を備え、前記第2端末は、前記第1端末から前記第1ユーザのユーザ姿勢情報が受信された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段と、前記アバター画像を表示する表示手段と、を備える、アバター表示システムである。 In order to solve the above-described problem, an aspect of the present invention includes a first terminal used by a first user and a second terminal used by a second user, and an avatar image representing the first user is obtained. An avatar display system to be displayed on the second terminal, wherein the first terminal detects user posture information including at least one of a head direction and a line of sight of the first user, and the first User attribute storage means for storing attribute information relating to one user, based on the attribute information, disclosure permission / inhibition determining means for determining whether or not to disclose the user attitude information of the first user to the second user, Transmission means for transmitting the user posture information of the first user to the second terminal when it is determined to disclose the user posture information of the first user to the second user; The second terminal generates an avatar image representing the first user based on the user attitude information of the first user when the user attitude information of the first user is received from the first terminal. An avatar display system comprising generation means and display means for displaying the avatar image.

また、本発明の他の一態様は、第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムであって、前記第1端末は、前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段と、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段と、を備え、前記第2端末は、前記第1ユーザに関する属性情報に基づいて、前記第1端末から受信された前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段と、前記アバター画像を表示する表示手段と、を備える、アバター表示システムである。 Moreover, the other one aspect | mode of this invention is provided with the 1st terminal used by the 1st user, and the 2nd terminal used by the 2nd user, The avatar image showing the said 1st user is set to the said 2nd terminal. In the avatar display system to be displayed, the first terminal includes user posture detection means for detecting user posture information including at least one of a head direction and a line of sight of the first user, and a user posture of the first user. Transmitting means for transmitting information to the second terminal, wherein the second terminal receives the user attitude information of the first user received from the first terminal based on attribute information relating to the first user. When it is determined that the disclosure possibility determining means for determining whether or not to disclose to the second user and to disclose the user attitude information of the first user to the second user, the user of the first user Based on the energization information, image generating means for generating an avatar image representing the first user, and a display means for displaying the avatar image is an avatar display system.

また、本発明の他の一態様は、第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムにおける、前記第1端末としてのユーザ端末であって、前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段と、前記第1ユーザに関する属性情報を記憶するユーザ属性記憶手段と、前記属性情報に基づいて、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段と、を備えるユーザ端末である。 Moreover, the other one aspect | mode of this invention is provided with the 1st terminal used by the 1st user, and the 2nd terminal used by the 2nd user, The avatar image showing the said 1st user is set to the said 2nd terminal. A user terminal as the first terminal in the avatar display system to be displayed, the user posture detecting means for detecting user posture information including at least one of a head direction and a line of sight of the first user, and the first User attribute storage means for storing attribute information relating to the user, based on the attribute information, disclosure permission determination means for determining whether or not to disclose the user attitude information of the first user to the second user, Transmission means for transmitting the user attitude information of the first user to the second terminal when it is determined to disclose the user attitude information of one user to the second user. That is a user terminal.

また、本発明の他の一態様は、第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムにおける、前記第2端末としてのユーザ端末であって、前記第1端末から、前記第1端末において検出された前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を受信する受信手段と、前記第1ユーザに関する属性情報に基づいて、前記第1端末から受信された前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段と、前記アバター画像を表示する表示手段と、を備えるユーザ端末である。 Moreover, the other one aspect | mode of this invention is provided with the 1st terminal used by the 1st user, and the 2nd terminal used by the 2nd user, The avatar image showing the said 1st user is set to the said 2nd terminal. A user terminal as the second terminal in the avatar display system to be displayed, the user including at least one of the head direction and the line of sight of the first user detected at the first terminal from the first terminal Based on the receiving means for receiving the posture information and the attribute information on the first user, it is determined whether to disclose the user posture information of the first user received from the first terminal to the second user. When it is determined that the disclosure possibility determining means and the user posture information of the first user are disclosed to the second user, the first user information is determined based on the user posture information of the first user. Image generating means for generating an avatar image representing over The a user terminal and a display means for displaying the avatar image.

また、本発明の他の一態様は、第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムにおける、前記第1端末としてのユーザ端末を、前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段、前記第1ユーザに関する属性情報を記憶するユーザ属性記憶手段、前記属性情報に基づいて、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段、として機能させるためのプログラムである。 Moreover, the other one aspect | mode of this invention is provided with the 1st terminal used by the 1st user, and the 2nd terminal used by the 2nd user, The avatar image showing the said 1st user is set to the said 2nd terminal. User posture detection means for detecting user posture information including at least one of the head direction and the line of sight of the user's head in the user terminal as the first terminal in the avatar display system to be displayed, attributes relating to the first user User attribute storage means for storing information, public availability determination means for determining whether or not to disclose the user attitude information of the first user to the second user based on the attribute information, and the user attitude of the first user When it is determined that the information is to be disclosed to the second user, it is made to function as a transmission means for transmitting the user attitude information of the first user to the second terminal. Which is the program.

また、本発明の他の一態様は、第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムにおける、前記第2端末としてのユーザ端末を、前記第1端末から、前記第1端末において検出された前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を受信する受信手段、前記第1ユーザに関する属性情報に基づいて、前記第1端末から受信された前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段、前記アバター画像を表示する表示手段、として機能させるためのプログラムである。 Moreover, the other one aspect | mode of this invention is provided with the 1st terminal used by the 1st user, and the 2nd terminal used by the 2nd user, The avatar image showing the said 1st user is set to the said 2nd terminal. User attitude information including at least one of the first user's head direction and line of sight detected from the first terminal, the user terminal as the second terminal in the avatar display system to be displayed Receiving means for determining whether to disclose the user attitude information of the first user received from the first terminal to the second user based on attribute information relating to the first user. And means for displaying the first user based on the user posture information of the first user when it is decided to disclose the user posture information of the first user to the second user. Image generating means for generating an avatar image, a program for functioning as a display means for displaying the avatar image.

本発明によれば、ユーザの頭部や視線の動きを他のユーザに対して選択的に公開することが可能である。 According to the present invention, the movement of the user's head and line of sight can be selectively disclosed to other users.

[本発明の実施形態の説明]

最初に、本発明の実施形態の内容を列記して説明する。本発明の一実施形態は、以下のような構成を備える。

[Description of Embodiment of the Present Invention]

First, the contents of the embodiment of the present invention will be listed and described. One embodiment of the present invention has the following configuration.

(項目1)第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムであって、前記第1端末は、前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段と、前記第1ユーザに関する属性情報を記憶するユーザ属性記憶手段と、前記属性情報に基づいて、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段と、を備え、前記第2端末は、前記第1端末から前記第1ユーザのユーザ姿勢情報が受信された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段と、前記アバター画像を表示する表示手段と、を備える、アバター表示システム。 (Item 1) An avatar display system that includes a first terminal used by a first user and a second terminal used by a second user, and displays an avatar image representing the first user on the second terminal. The first terminal includes user posture detection means for detecting user posture information including at least one of the head orientation and line of sight of the first user, and user attribute storage means for storing attribute information relating to the first user. And, based on the attribute information, disclosure permission determination means for determining whether or not to disclose the user posture information of the first user to the second user, and the user posture information of the first user as the second user. And transmitting means for transmitting user attitude information of the first user to the second terminal when it is determined to be disclosed to the second terminal, the second terminal from the first terminal to the first terminal An image generating unit that generates an avatar image representing the first user based on the user posture information of the first user, and a display unit that displays the avatar image when the user posture information of the user is received; An avatar display system comprising:

(項目2)前記画像生成手段は、前記第1端末から前記第1ユーザのユーザ姿勢情報が受信されなかった場合に、前記第1ユーザを表すデフォルトのアバター画像を生成する、項目1に記載のアバター表示システム。 (Item 2) The item according to Item 1, wherein the image generation unit generates a default avatar image representing the first user when the user attitude information of the first user is not received from the first terminal. Avatar display system.

(項目3)前記属性情報は、コンピュータゲームにおける前記第1ユーザの経験値又は能力値を含む、項目1又は2に記載のアバター表示システム。

(Item 3) The avatar display system according to

(項目4)前記公開可否決定手段は、前記経験値又は能力値が所定値よりも大きい場合に前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定し、前記経験値又は能力値が所定値よりも小さい場合に前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開しないと決定する、項目3に記載のアバター表示システム。 (Item 4) When the experience value or ability value is larger than a predetermined value, the disclosure possibility determination unit determines that the user attitude information of the first user is disclosed to the second user, and the experience value or ability value 4. The avatar display system according to item 3, wherein when the value is smaller than a predetermined value, it is determined that the user posture information of the first user is not disclosed to the second user.

(項目5)前記属性情報は、前記第1ユーザと前記第2ユーザとのコミュニケーションの頻度、深度、又は近接度に関連する値を含む、項目1又は2に記載のアバター表示システム。

(Item 5) The avatar display system according to

(項目6)前記第1ユーザのユーザ姿勢情報に基づく前記アバター画像は、前記第1ユーザのユーザ姿勢情報によって示される方向に顔又は目の少なくとも一方を向けているアバターの画像である、項目1から5のいずれか1項に記載のアバター表示システム。 (Item 6) The avatar image based on the user posture information of the first user is an image of an avatar that faces at least one of a face or eyes in a direction indicated by the user posture information of the first user. 6. The avatar display system according to any one of 5 to 5.

(項目7)第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムであって、前記第1端末は、前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段と、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段と、を備え、前記第2端末は、前記第1ユーザに関する属性情報に基づいて、前記第1端末から受信された前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段と、前記アバター画像を表示する表示手段と、を備える、アバター表示システム。 (Item 7) An avatar display system that includes a first terminal used by a first user and a second terminal used by a second user, and displays an avatar image representing the first user on the second terminal. The first terminal includes user posture detection means for detecting user posture information including at least one of the head orientation and line of sight of the first user, and the user posture information of the first user to the second terminal. Transmitting means for transmitting, wherein the second terminal publishes user attitude information of the first user received from the first terminal to the second user based on attribute information relating to the first user. Based on the user attitude information of the first user when it is decided to disclose the user attitude information of the first user to the second user. Comprising image generating means for generating an avatar image representing the first user, and a display means for displaying the avatar image, the avatar display system.

(項目8)第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムにおける、前記第1端末としてのユーザ端末であって、前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段と、前記第1ユーザに関する属性情報を記憶するユーザ属性記憶手段と、前記属性情報に基づいて、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段と、を備えるユーザ端末。 (Item 8) In an avatar display system including a first terminal used by a first user and a second terminal used by a second user, and displaying an avatar image representing the first user on the second terminal. A user terminal as the first terminal, wherein user attitude detection means for detecting user attitude information including at least one of a head direction and a line of sight of the first user, and attribute information relating to the first user are stored. User attribute storage means, based on the attribute information, disclosure permission determination means for determining whether or not to disclose the user attitude information of the first user to the second user, and user attitude information of the first user. A user terminal comprising: transmission means for transmitting user attitude information of the first user to the second terminal when it is determined to be disclosed to the second user.

(項目9)第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムにおける、前記第2端末としてのユーザ端末であって、前記第1端末から、前記第1端末において検出された前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を受信する受信手段と、前記第1ユーザに関する属性情報に基づいて、前記第1端末から受信された前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段と、前記アバター画像を表示する表示手段と、を備えるユーザ端末。 (Item 9) In an avatar display system including a first terminal used by a first user and a second terminal used by a second user, and displaying an avatar image representing the first user on the second terminal. Receiving means for receiving user posture information including at least one of the head orientation and the line of sight of the first user detected at the first terminal from the first terminal as a user terminal as the second terminal And based on attribute information relating to the first user, disclosure permission determination means for determining whether or not to disclose the user attitude information of the first user received from the first terminal to the second user, An avatar representing the first user based on the user posture information of the first user when it is decided to disclose the user posture information of the first user to the second user User terminal comprising an image generating device which generates an image, and display means for displaying the avatar image.

(項目10)第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムにおける、前記第1端末としてのユーザ端末を、前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段、前記第1ユーザに関する属性情報を記憶するユーザ属性記憶手段、前記属性情報に基づいて、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段、として機能させるためのプログラム。 (Item 10) In an avatar display system that includes a first terminal used by a first user and a second terminal used by a second user, and displays an avatar image representing the first user on the second terminal. User posture detection means for detecting user posture information including at least one of the first user's head direction and line of sight as a user terminal as the first terminal, user attribute storage for storing attribute information relating to the first user Means for determining whether or not to disclose the user attitude information of the first user to the second user based on the attribute information; and the user attitude information of the first user to the second user. A program for functioning as transmission means for transmitting user attitude information of the first user to the second terminal when it is determined to be disclosed.

(項目11)第1ユーザによって使用される第1端末と第2ユーザによって使用される第2端末とを備え、前記第1ユーザを表すアバター画像を前記第2端末に表示させるアバター表示システムにおける、前記第2端末としてのユーザ端末を、前記第1端末から、前記第1端末において検出された前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を受信する受信手段、前記第1ユーザに関する属性情報に基づいて、前記第1端末から受信された前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段、前記アバター画像を表示する表示手段、として機能させるためのプログラム。 (Item 11) In an avatar display system that includes a first terminal used by a first user and a second terminal used by a second user, and displays an avatar image representing the first user on the second terminal. Receiving means for receiving, from the first terminal, user posture information including at least one of a head direction and a line of sight of the first user detected at the first terminal, the user terminal as the second terminal; Based on attribute information relating to the first user, disclosure permission determining means for determining whether or not to disclose the user attitude information of the first user received from the first terminal to the second user, the first user's When it is determined that the user posture information is disclosed to the second user, an avatar image representing the first user is displayed based on the user posture information of the first user. Image generating means for forming a display means, a program to function as displaying the avatar image.

[本発明の実施形態の詳細]

以下、図面を参照しながら本発明の実施形態について詳しく説明する。

[Details of the embodiment of the present invention]

Hereinafter, embodiments of the present invention will be described in detail with reference to the drawings.

図1は、本発明の一実施形態に係るアバター表示システム10の概略構成を示す図である。アバター表示システム10は、第1ユーザ101aによって使用される第1サブシステム(第1端末)100aと、第2ユーザ101bによって使用される第2サブシステム(第2端末)100bとを備える。第1サブシステム100aと第2サブシステム100bは、ネットワーク105を介して相互に通信可能に接続されている。ネットワーク105は、例えばインターネットやLAN(Local Area Network)などの、任意のタイプのネットワークであってよい。図1には2つのサブシステム100a及び100bのみが示されているが、アバター表示システム10は、それぞれが別個のユーザによって使用される任意の数の同様のサブシステムを含んでもよい。

FIG. 1 is a diagram showing a schematic configuration of an

第1サブシステム100aは、ヘッドマウントディスプレイ(Head Mounted Display:以下HMDと称する)120aと、画像生成装置200aとを備える。画像生成装置200aは、第1ユーザ101aに提示するための仮想現実空間を表す画像を生成して、生成した仮想現実空間画像をHMD120aに表示させる。HMD120aに表示される仮想現実空間画像は、第2ユーザ101bの顔や身体などの容姿を視覚的に表現したアバターを含む。第1ユーザ101aは、第2ユーザ101bのアバターを介して、仮想現実空間において第2ユーザ101bとコミュニケーションをすることができる。同様に、第2サブシステム100bは、HMD120bと、画像生成装置200bとを備える。画像生成装置200bは、第2ユーザ101bに提示するための仮想現実空間を表す画像を生成して、生成した仮想現実空間画像をHMD120bに表示させる。HMD120bに表示される仮想現実空間画像は、第1ユーザ101aのアバターを含む。第2ユーザ101bは、第1ユーザ101aのアバターを介して、仮想現実空間において第1ユーザ101aとコミュニケーションをすることができる。 The first subsystem 100a includes a head mounted display (hereinafter referred to as HMD) 120a and an image generation device 200a. The image generation device 200a generates an image representing a virtual reality space to be presented to the first user 101a, and displays the generated virtual reality space image on the HMD 120a. The virtual reality space image displayed on the HMD 120a includes an avatar that visually represents the appearance of the second user 101b such as the face and body. The first user 101a can communicate with the second user 101b in the virtual reality space via the avatar of the second user 101b. Similarly, the second subsystem 100b includes an HMD 120b and an image generation device 200b. The image generation device 200b generates an image representing the virtual reality space to be presented to the second user 101b, and displays the generated virtual reality space image on the HMD 120b. The virtual reality space image displayed on the HMD 120b includes the avatar of the first user 101a. The second user 101b can communicate with the first user 101a in the virtual reality space via the avatar of the first user 101a.

図2は、本発明の一実施形態に係るHMDシステム100のハードウェア構成図である。HMDシステム100は、図1に示された第1サブシステム100aと第2サブシステム100bのそれぞれに対応するものである。上述したように、HMDシステム100は、HMD120と、画像生成装置200とを備える。HMD120と画像生成装置200は、一例として有線ケーブル150によって電気的に接続され、相互に通信可能である。有線ケーブル150に代えて、無線接続が用いられてもよい。

FIG. 2 is a hardware configuration diagram of the

HMD120は、ユーザ101の頭に装着されて利用される表示デバイスである。HMD120は、ディスプレイ122と、アイトラッキングデバイス(Eye Tracking Device:以下ETDと称する)124と、センサ126とを備える。ETD124とセンサ126は、どちらか一方だけが択一的に設けられてもよい。HMD120は更に、不図示のスピーカ(ヘッドホン)を備えてもよい。

The

ディスプレイ122は、HMD120を装着したユーザ101の視界に画像を提示するように構成される。例えば、ディスプレイ122は、非透過型ディスプレイとして構成することができる。この場合、HMD120の外界の光景はユーザ101の視界から遮断され、ユーザ101の目にはディスプレイ122に映し出された画像だけが届けられる。ディスプレイ122には、例えば、コンピュータグラフィックスを用いて生成した画像が表示される。コンピュータグラフィックスによる画像の一例は、仮想現実空間(例えばコンピュータゲームで作り出される世界)を画像化した仮想現実空間画像である。上述したように、仮想現実空間画像は、HMD120を装着しているユーザ101がコミュニケーションをする相手ユーザのアバターを含む。このような例示的なアバターとして、コンピュータゲームのポーカーの相手プレイヤーを表すアバター、格闘ゲームの対戦相手を表すアバター、あるいは、仮想現実空間内でのチャットの相手を表すアバター等が用いられてよい。

The display 122 is configured to present an image to the field of view of the

ETD124は、ユーザ101の眼球の動きを追跡して、ユーザ101の視線がどちらの方向に向けられているかを検出するように構成される。例えば、ETD124は、赤外線光源と赤外線カメラとを備える。赤外線光源は、HMD120を装着したユーザ101の目に向けて赤外線を照射する。赤外線カメラは、赤外線で照射されたユーザ101の目の画像を撮像する。赤外線はユーザ101の目の表面で反射されるが、瞳と瞳以外の部分とで赤外線の反射率が異なる。赤外線カメラで撮像されたユーザ101の目の画像には、赤外線の反射率の違いが画像の明暗となって現れる。この明暗に基づいて、ユーザ101の目の画像において瞳が識別され、更に、識別された瞳の位置に基づいて、ユーザ101の視線の方向が検出される。

The ETD 124 is configured to track the movement of the eyeball of the

センサ126は、HMD120を装着したユーザ101の頭がどちらの方向を向いているかを検知するためのセンサである。センサ126としては、例えば、磁気センサ、角速度センサ、若しくは加速度センサのいずれか、又はこれらの組み合わせが用いられてよい。センサ126が磁気センサ、角速度センサ、又は加速度センサである場合、センサ126はHMD120に内蔵されて、HMD120の向きや動きに応じた値(磁気、角速度、又は加速度の値)を出力する。センサ126からの出力値を適宜の方法で加工することで、HMD120を装着したユーザ101の頭の向きが算出される。ユーザ101の頭の向きは、ユーザ101が頭を動かした際にその動きに追従するようにディスプレイ122の表示画像を変化させるのに利用されてよい。例えば、ユーザ101が頭を右(又は左、上、下)に向けると、ディスプレイ122には、仮想現実空間においてユーザの右(又は左、上、下)方向にある仮想的光景が映し出されるのであってよい。

The

なおセンサ126として、HMD120の外部に設けられたセンサを適用することとしてもよい。例えば、センサ126は、HMD120とは別体の、室内の固定位置に設置された赤外線センサであってよい。この赤外線センサを用いて、HMD120の表面に設けられた赤外線発光体又は赤外線反射マーカーを検知することにより、HMD120を装着したユーザ101の頭の向きを特定することができる。このようなタイプのセンサ126は、ポジショントラッキングセンサと呼ばれることもある。

Note that a sensor provided outside the

画像生成装置200は、HMD120に表示される画像を生成するための装置である。画像生成装置200は、プロセッサ202と、メモリ204と、ユーザ入力インターフェイス206と、通信インターフェイス208とを少なくとも備える。画像生成装置200は、例えば、パーソナルコンピュータ、ゲームコンソール、スマートフォン、タブレット端末等として実現することが可能である。

The

メモリ204には、少なくともオペレーティングシステムと画像生成プログラムとが格納されている。オペレーティングシステムは、画像生成装置200の全体的な動作を制御するためのコンピュータプログラムである。画像生成プログラムは、画像生成装置200が後述する画像生成処理の各機能を実現するためのコンピュータプログラムである。メモリ204はまた、画像生成装置200の動作によって生成されるデータを一時的又は永続的に記憶することもできる。メモリ204の具体例は、ROM(Read Only Memory)、RAM(Random Access Memory)、ハードディスク、フラッシュメモリ、光ディスク等である。

The

プロセッサ202は、メモリ204に格納されているプログラムを読み出して、それに従った処理を実行するように構成される。プロセッサ202がメモリ204に格納された画像生成プログラムを実行することによって、後述する画像生成処理の各機能が実現される。プロセッサ202は、CPU(Central Processing Unit)及びGPU(Graphics Processing Unit)を含む。

The

ユーザ入力インターフェイス206は、HMDシステム100のユーザ101から画像生成装置200を操作するための入力を受け取るように構成される。ユーザ入力インターフェイス206の具体例は、ゲームコントローラ、タッチパッド、マウス、キーボード等である。

The

通信インターフェイス208は、ネットワークを介して他の装置と通信するためのネットワークインターフェイスである。例えば図1に示された第1サブシステム100aの画像生成装置200aと第2サブシステム100bの画像生成装置200bは、それぞれの通信インターフェイス208を用いて、ネットワーク105を介して相互に通信する。

The

図3は、本発明の一実施形態に係る画像生成装置200の機能的な構成を示すブロック図である。画像生成装置200は、記憶部220及び処理部230を有する。処理部230は更に、ユーザ姿勢検出部231と、公開可否決定部232と、画像生成部233と、画像出力部234とを含む。記憶部220は、図1に示されたメモリ204に対応する。処理部230及び処理部230に含まれる各部231〜234は、図1に示されたプロセッサ202がメモリ204内の画像生成プログラムを読み出して実行することによって実現される、本発明に係る画像生成処理の機能を表す。

FIG. 3 is a block diagram showing a functional configuration of the

記憶部220には、ユーザ101に関する属性情報221が記憶されている。ユーザ101に関する属性情報221は、ユーザ間のコミュニケーションにおいてユーザ姿勢情報を相手に公開するか否かを判断するための材料として用いられるものである(詳細は後述する)。例えば、ユーザ101に関する属性情報221は、コンピュータゲームにおけるユーザ101の経験値や能力値を含んでよい。コンピュータゲームの具体例は、トランプ(ポーカー等)や花札などのカードゲーム、麻雀や将棋、囲碁などのテーブルゲーム、格闘ゲーム、ロールプレイングゲーム、テニスやサッカー、野球などのスポーツゲームを含む。ユーザ101の経験値は、ユーザ101がそのコンピュータゲームのプレイにどの程度習熟しているかを示す指標であり、例えばユーザ101がそのゲームの初心者であるか熟練者であるかを区別する。ユーザ101の能力値は、そのコンピュータゲームのプレイにおいてユーザ101が発揮できる能力のパラメータ設定値であり、例えば、格闘ゲーム等の対戦時における攻撃力や防御力などのパラメータ値を含む。経験値と能力値は、数値として表されてもよいし、あるいは「初心者・中級者・熟練者」や「攻撃力大・中・小」のような分類であってもよい。数値で表される場合、一例として、数値が大きいほど経験値や能力値が優れていることとしてよい。なお、経験値と能力値は、スキル、ランク、レベルといった呼称で呼ばれる概念を含む。

The

また、ユーザ101に関する属性情報221は、仮想現実空間におけるユーザ同士の関係性を表す指標値を含むのであってもよい。ユーザ同士の関係性として、例えば、ユーザ間のコミュニケーションの頻度、深度、近接度などの指標を用いることができる。コミュニケーションの頻度は、ユーザ101が別のあるユーザとのコミュニケーションや交流(ゲームの対戦や会話等)をどれくらい頻繁に行っているか(例えば、初対面か、週に1回一緒にオンラインプレイをするか等)を示す。コミュニケーションの深度は、ユーザ101と別のあるユーザとのコミュニケーションにおける質的な接触の強さを示し、例えば、どのような種類のゲームを一緒にプレイしたか(カードゲームか、格闘ゲームか、チャットか等)や、どのような形で交流したか(一対一で会ったのか、多人数の中の一人として会ったのか、挨拶を交わしただけか、趣味について語り合ったのか等)などの、ユーザ間のコミュニケーション体験の質に関する。コミュニケーションの近接度は、ユーザ101と別のあるユーザとの間に形成されている距離感や親密さの度合い(例えば、フレンド登録しているか否か等)を示す。これらの各指標は、数値化された値、又は「フレンド登録有り」のような分類のいずれであってもよい。

Further, the

記憶部220には、更に、仮想現実空間構成情報223が記憶されている。仮想現実空間構成情報223は、仮想現実空間画像を生成するのに必要な、仮想現実空間内に存在する様々なオブジェクト(アバターを含む)の配置位置、形状、色などに関するデータである。

The

ユーザ姿勢検出部231は、ユーザ101の頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出する。例えば、ユーザ姿勢検出部231は、センサ126からの出力値に基づいて、HMD120を装着したユーザ101の頭の向きを検出することとしてよい。あるいはまた、ユーザ姿勢検出部231は、ETD124から得られる赤外線画像に基づいて、ユーザ101の視線の方向を検出することとしてもよい。更に、ユーザ姿勢検出部231は、ユーザ101の頭の向きと視線の両方を検出するのであってもよい。

The user

公開可否決定部232は、属性情報221に基づいてユーザ姿勢情報(頭の向き及び/又は視線)の公開可否を決定する。決定方法の詳細については後述する。

The disclosure possibility determination unit 232 determines whether the user posture information (head direction and / or line of sight) is disclosure based on the

画像生成部233は、記憶部220に記憶されている仮想現実空間構成情報223に基づいて、コンピュータグラフィックス処理によって仮想現実空間画像を生成する。画像生成部233が生成する仮想現実空間画像の一例は、コンピュータゲーム(例えばポーカーなどのカードゲーム、格闘ゲーム、チャット等)の仮想現実空間を表現する画像である。仮想現実空間画像は、仮想現実空間内においてユーザ101がコミュニケーションをする相手ユーザのアバターを表す画像を含む。画像生成部233は、アバターに対応するユーザのユーザ姿勢情報がユーザ101への公開を許可されている場合、そのユーザ姿勢情報に基づいてアバター画像を制御する。例えば、画像生成部233は、ユーザ姿勢情報によって示される方向にアバターが顔や目を向けているアバター画像を生成することとしてよい。

The image generation unit 233 generates a virtual reality space image by computer graphics processing based on the virtual reality

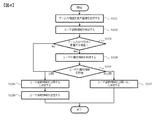

図4及び図5は、本発明の一実施形態に係る画像生成装置200の動作を示すフローチャートである。図4は、第1サブシステム100aの画像生成装置200aの動作に対応し、図5は、第2サブシステム100bの画像生成装置200bの動作に対応する。図4及び図5のフローチャートは、第1サブシステム100aの第1ユーザ101aを表すアバター画像を第2サブシステム100bのHMD120bに表示するための処理の一例を示す。以下では、コンピュータゲームのポーカーをプレイする事例を適宜参照して説明を行うが、これは本発明を限定するものではなく、本発明は、ユーザのアバターを表示する処理を実施する任意のシステムに適用可能である。

4 and 5 are flowcharts showing the operation of the

まず図4を参照すると、ステップS101において、画像生成装置200aの画像生成部233(以下、画像生成部233aと記す)は、コンピュータゲーム(ポーカー)の進行に応じた各場面を表すゲーム画像を生成する。ポーカーの場面は、例えば、カードを各プレイヤーに配る場面、各プレイヤーがチップを賭ける場面、各プレイヤーが自分の手札の一部を場に積まれたカードと交換する場面などからなる。画像生成部233aが生成する各場面のゲーム画像は、自分の手札を表す画像のほか、一緒にプレイしている他のプレイヤーの(例えば顔や上半身を描いた)アバター画像も含む。他のプレイヤーのアバターは、ポーカーが行われているテーブルの周りを取り囲んでいるように描かれてもよいし、単に画面を縦横に分割した1つ1つの画面エリアに各アバターが正面を向いて配置されるのであってもよい。 Referring first to FIG. 4, in step S101, the image generation unit 233 of the image generation device 200a (hereinafter referred to as the image generation unit 233a) generates a game image representing each scene according to the progress of the computer game (poker). To do. The poker scene includes, for example, a scene in which a card is dealt to each player, a scene in which each player places a chip, and a scene in which each player exchanges a part of his / her hand for a card placed on the field. The game image of each scene generated by the image generation unit 233a includes an avatar image (for example, depicting the face and upper body) of other players playing together with an image representing his / her hand. Other players' avatars may be drawn to surround the table where poker is being played, or each avatar will be facing the front in a single screen area that is simply divided vertically and horizontally. It may be arranged.

ステップS102において、画像生成装置200aのユーザ姿勢検出部231(以下、ユーザ姿勢検出部231aと記す)は、HMD120aを装着した第1ユーザ101aのユーザ姿勢情報を検出する。上述したように、ユーザ姿勢情報は、頭の向きと視線の少なくとも一方を含む。ユーザ姿勢検出部231aは、第1ユーザ101aの頭の向きをセンサ126からの出力値に基づいて、また、第1ユーザ101aの視線をETD124から得られる赤外線画像に基づいて、それぞれ検出する。

In step S102, the user posture detection unit 231 (hereinafter referred to as the user posture detection unit 231a) of the image generation device 200a detects the user posture information of the first user 101a wearing the HMD 120a. As described above, the user posture information includes at least one of the head direction and the line of sight. The user posture detection unit 231a detects the head direction of the first user 101a based on an output value from the

ステップS103において、画像生成装置200aの公開可否決定部232(以下、公開可否決定部232aと記す)は、コンピュータゲームの現在の場面が、ゲームのかけ引きに影響を与える場面であるか否かを判定する。例えば、ポーカーにおいてかけ引きに影響を与える場面とは、プレイヤーがチップを賭ける場面や、手札を場のカードと交換する場面である。反対に、最初にカードを各プレイヤーに配る場面は、ゲームのかけ引きに影響を与えない場面である。場面の判定のために、一例として公開可否決定部232aは、ゲームの進行を管理するための予め各場面に割り振られたゲーム進行フラグを用いることとしてよい。現在の場面がかけ引きに影響を与える場面である場合、処理はステップS104へ進み、そうでない場合、処理はステップS106へ進む。 In step S103, the disclosure determination unit 232 (hereinafter referred to as the disclosure determination unit 232a) of the image generation apparatus 200a determines whether or not the current scene of the computer game affects the game drawing. judge. For example, in poker, a scene that affects a transaction is a scene in which a player bets chips or a scene in which a hand is exchanged for a card in the field. On the other hand, the scene where cards are dealt to each player first is a scene that does not affect the game. In order to determine the scene, as an example, the disclosure permission / inhibition determination unit 232a may use a game progress flag assigned to each scene in advance for managing the progress of the game. If the current scene is a scene that affects the drawing, the process proceeds to step S104; otherwise, the process proceeds to step S106.

ステップS104において、公開可否決定部232aは、画像生成装置200aの記憶部220(以下、記憶部220aと記す)から第1ユーザ101aに関する属性情報221を取り出す。

In step S104, the disclosure permission / inhibition determining unit 232a extracts the

ステップS105において、公開可否決定部232aは、記憶部220aから取り出した第1ユーザ101aに関する属性情報221を評価する。属性情報221の評価結果に応じて、公開可否決定部232aは、第1ユーザ101aのユーザ姿勢情報を第2サブシステム100bの第2ユーザ101bに対して公開する(ステップS106)、又は公開しない(ステップS107)と決定する。

In step S105, the disclosure permission / inhibition determining unit 232a evaluates the

例えば、第1ユーザ101aに関する属性情報221は、第1ユーザ101aのコンピュータゲーム(ポーカー)の経験値や能力値を含む。一例として、公開可否決定部232aは、第1ユーザ101aの経験値又は能力値が所定の値よりも大きい(経験や能力が優れている)場合、ステップS106において、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開すると決定し、一方、第1ユーザ101aの経験値又は能力値が所定の値よりも小さい(経験や能力が劣っている)場合、ステップS107において、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開しないと決定する。例えば、公開可否決定部232aは、属性情報221が第1ユーザ101aをポーカーの熟練者に分類している場合、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開すると決定し(ステップS106)、属性情報221が第1ユーザ101aをポーカーの初心者に分類している場合、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開しないと決定する(ステップS107)。

For example, the

また例えば、第1ユーザ101aに関する属性情報221は、第1ユーザ101aと第2ユーザ101bとの関係性(コミュニケーションの頻度、深度、近接度等)を表す指標値を含む。一例として、公開可否決定部232aは、第1ユーザ101aが第2ユーザ101bを「フレンド登録」していることが属性情報221に示されている場合、ステップS106において、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開すると決定し、一方、第1ユーザ101aが第2ユーザ101bを「フレンド登録」していることが属性情報221に示されていない場合、ステップS107において、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開しないと決定する。あるいはこの反対に、公開可否決定部232aは、第1ユーザ101aが第2ユーザ101bを「フレンド登録」していない場合に、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開し(ステップS106)、第1ユーザ101aが第2ユーザ101bを「フレンド登録」している場合に、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開しない(ステップS107)こととしてもよい。更に、公開可否決定部232aは、「フレンド登録」の有無に限らず、第1ユーザ101aと第2ユーザ101bの間のコミュニケーションの頻度や深度を表す指標値の大小に応じて、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開するかしないかを決定してもよい。

Further, for example, the

なお、公開可否決定部232aは、上述したステップS103の判定においてコンピュータゲームの現在の場面がかけ引きに影響を与えない場面であった場合も、ステップS106において、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開すると決定する。 Even if the current scene of the computer game is a scene that does not affect the referral in the determination in step S103 described above, the disclosure permission / inhibition determination unit 232a obtains the user posture information of the first user 101a in step S106. It is determined to be disclosed to the second user 101b.

第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開することが決定(ステップS106)されると、ステップS108において、第1ユーザ101aのユーザ姿勢情報が通信インターフェイス208を介して第2サブシステム100bの画像生成装置200bへ送信される。一方、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開しないことが決定(ステップS107)されると、第1ユーザ101aのユーザ姿勢情報は第2サブシステム100bの画像生成装置200bへ送信されない。

When it is determined that the user posture information of the first user 101a is disclosed to the second user 101b (step S106), the user posture information of the first user 101a is transmitted to the second subsystem via the

次に図5を参照すると、ステップS201において、画像生成装置200bの画像生成部233(以下、画像生成部233bと記す)は、図4のステップS101と同様に、またステップS101と同期して、コンピュータゲーム(ポーカー)の進行に応じた各場面を表すゲーム画像を生成する。ただし、画像生成部233bが生成する各場面のゲーム画像は、第1サブシステム100aの第1ユーザ101aを表すアバター画像を含む。 Next, referring to FIG. 5, in step S201, the image generation unit 233 of the image generation device 200b (hereinafter referred to as the image generation unit 233b) is similar to step S101 of FIG. A game image representing each scene according to the progress of the computer game (poker) is generated. However, the game image of each scene generated by the image generation unit 233b includes an avatar image representing the first user 101a of the first subsystem 100a.

ステップS202において、画像生成部233bは、通信インターフェイス208を介して第1サブシステム100aの画像生成装置200aから第1ユーザ101aのユーザ姿勢情報が受信されたか否かを判定する。第1ユーザ101aのユーザ姿勢情報が受信された場合、処理はステップS203へ進み、受信されなかった場合、処理はステップS204へ進む。

In step S202, the image generation unit 233b determines whether user posture information of the first user 101a is received from the image generation device 200a of the first subsystem 100a via the

ステップS203において、画像生成部233bは、受信された第1ユーザ101aのユーザ姿勢情報に基づいて、ゲーム画像に含まれる第1ユーザ101aを表すアバター画像を制御する。一例として、画像生成部233bは、第1ユーザ101aを表すアバターが、第1ユーザ101aのユーザ姿勢情報(頭の向き及び/又は視線)によって示される方向に顔や目を向けているアバター画像を生成する。 In step S203, the image generation unit 233b controls the avatar image representing the first user 101a included in the game image based on the received user posture information of the first user 101a. As an example, the image generation unit 233b displays an avatar image in which the avatar representing the first user 101a faces the face or eyes in the direction indicated by the user posture information (head orientation and / or line of sight) of the first user 101a. Generate.

ステップS204において、画像生成部233bは、ゲーム画像に含まれる第1ユーザ101aを表すアバター画像をデフォルトの状態に制御する。一例として、画像生成部233bは、第1ユーザ101aを表すアバターがデフォルトの方向(例えば真正面)に顔や目を向けているアバター画像を生成する。 In step S204, the image generation unit 233b controls the avatar image representing the first user 101a included in the game image to a default state. As an example, the image generation unit 233b generates an avatar image in which the avatar representing the first user 101a faces or faces in a default direction (for example, directly in front).

ステップS205において、画像生成装置200bの画像出力部234は、画像生成部233bによって生成されたゲーム画像(第1ユーザ101aのアバター画像を含む)をHMD120bへ供給する。これにより、HMD120bにゲーム画像が表示される。

In step S205, the

このように、本発明の一実施形態に係るアバター表示システム10によれば、第1ユーザ101aに関する属性情報221に基づいて第1ユーザ101aのユーザ姿勢情報の公開が許可される場合には、第2サブシステム100bのHMD120bに表示されるゲーム画像において、第1ユーザ101aを表すアバターの顔や目の動きが、第1ユーザ101aのユーザ姿勢情報に応じて制御される。第1ユーザ101aのユーザ姿勢情報は、第1サブシステム100aのセンサ126又はETD124によって検出された、第1ユーザ101aの頭の向きや視線を示す。したがって、第2サブシステム100bのHMD120bに表示される第1ユーザ101aのアバターの顔や目の動きを、ユーザ姿勢情報の公開が許可されている場合にのみ、第1ユーザ101aの実際の頭の向きや視線に同期させることができる。

As described above, according to the

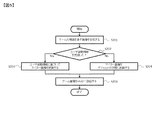

図6及び図7は、本発明の一実施形態に係る画像生成装置200の動作の別の例を示すフローチャートである。図6は、第1サブシステム100aの画像生成装置200aの動作に対応し、図7は、第2サブシステム100bの画像生成装置200bの動作に対応する。図6及び図7のフローチャートは、図4及び図5と同様、第1サブシステム100aの第1ユーザ101aを表すアバター画像を第2サブシステム100bのHMD120bに表示するための処理を示すが、ユーザ姿勢情報を公開するか否かの判断を第2サブシステム100b側で行う点が図4及び図5の場合と異なる。

6 and 7 are flowcharts showing another example of the operation of the

図6を参照すると、ステップS301及びステップS302の処理は、図4のステップS101及びステップS102の処理と同じである。次のステップS303において、第1ユーザ101aのユーザ姿勢情報が、その公開を許可するか否かの判断を行うことなく、通信インターフェイス208を介して第2サブシステム100bの画像生成装置200bへ送信される。即ち、図6のフローチャートに示される動作では、第1サブシステム100aから第2サブシステム100bへ無条件で第1ユーザ101aのユーザ姿勢情報が提供される。

Referring to FIG. 6, the processes in steps S301 and S302 are the same as the processes in steps S101 and S102 in FIG. In the next step S303, the user attitude information of the first user 101a is transmitted to the image generation device 200b of the second subsystem 100b via the

次に図7を参照すると、ステップS401の処理は図5のステップS201の処理と同じであり、第1ユーザ101aのアバター画像を含むゲーム画像が、画像生成部233bによって生成される。ゲーム画像は、コンピュータゲーム(ポーカー)の進行に応じた各場面を表す。 Next, referring to FIG. 7, the process of step S401 is the same as the process of step S201 of FIG. 5, and a game image including the avatar image of the first user 101a is generated by the image generation unit 233b. The game image represents each scene according to the progress of the computer game (poker).

ステップS402において、第1ユーザ101aのユーザ姿勢情報が、通信インターフェイス208を介して第1サブシステム100aの画像生成装置200aから受信される。

In step S402, the user attitude information of the first user 101a is received from the image generation device 200a of the first subsystem 100a via the

ステップS403の処理は、図4のステップS103の処理と同様であり、画像生成装置200bの公開可否決定部232(以下、公開可否決定部232bと記す)は、コンピュータゲームの現在の場面が、ゲームのかけ引きに影響を与える場面であるか否かを判定する。現在の場面がかけ引きに影響を与える場面である場合、処理はステップS404へ進み、そうでない場合、処理はステップS406へ進む。 The process of step S403 is the same as the process of step S103 of FIG. 4, and the disclosure possibility determination unit 232 (hereinafter referred to as the disclosure possibility determination unit 232b) of the image generation device 200b indicates that the current scene of the computer game is a game. It is determined whether or not this is a scene that affects the discount. If the current scene is a scene that affects the drawing, the process proceeds to step S404; otherwise, the process proceeds to step S406.

ステップS404において、公開可否決定部232bは、画像生成装置200bの記憶部220(以下、記憶部220bと記す)から第1ユーザ101aに関する属性情報221を取り出す。記憶部220bに記憶されている第1ユーザ101aの属性情報221は、例えば、第1ユーザ101aと第2ユーザ101bとの関係性(コミュニケーションの頻度、深度、近接度等)を表す指標値である。この属性情報(ユーザ間の関係性の指標値)は、第1ユーザ101aと第2ユーザ101bの双方に関するものであるので、第1サブシステム100a側の記憶部220aだけでなく、第2サブシステム100b側の記憶部220bにも記憶されていてよい。あるいはまた、第1ユーザ101aの属性情報221として、例えば、第1ユーザ101aのコンピュータゲームの経験値や能力値に関するデータが、予め、又は第1ユーザ101aのユーザ姿勢情報と一緒(ステップS304)に、画像生成装置200aから画像生成装置200bへ送られて、記憶部220bに記憶されるのであってもよい。

In step S404, the disclosure permission / inhibition determining unit 232b extracts the

ステップS405において、公開可否決定部232bは、記憶部220bから取り出した第1ユーザ101aに関する属性情報221を評価する。属性情報221の評価結果に応じて、公開可否決定部232bは、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに対して公開する(ステップS406)、又は公開しない(ステップS407)と決定する。ステップS405からステップS407までの各処理は、図4のステップS105からステップS107までの各処理と同じである。

In step S405, the disclosure permission / inhibition determining unit 232b evaluates the

第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開することが決定(ステップS406)されると、ステップS408において、画像生成部233bは、ステップS402で受信された第1ユーザ101aのユーザ姿勢情報に基づいて、ゲーム画像に含まれる第1ユーザ101aを表すアバター画像を制御する。一例として、画像生成部233bは、第1ユーザ101aを表すアバターが、第1ユーザ101aのユーザ姿勢情報(頭の向き及び/又は視線)によって示される方向に顔や目を向けているアバター画像を生成する(図5のステップS203と同様)。 When it is determined that the user posture information of the first user 101a is disclosed to the second user 101b (step S406), in step S408, the image generation unit 233b receives the user posture of the first user 101a received in step S402. Based on the information, an avatar image representing the first user 101a included in the game image is controlled. As an example, the image generation unit 233b displays an avatar image in which the avatar representing the first user 101a faces the face or eyes in the direction indicated by the user posture information (head orientation and / or line of sight) of the first user 101a. (Similar to step S203 in FIG. 5).

一方、第1ユーザ101aのユーザ姿勢情報を第2ユーザ101bに公開しないことが決定(ステップS407)されると、ステップS409において、画像生成部233bは、ゲーム画像に含まれる第1ユーザ101aを表すアバター画像をデフォルトの状態に制御する。一例として、画像生成部233bは、第1ユーザ101aを表すアバターがデフォルトの方向(例えば真正面)に顔や目を向けているアバター画像を生成する(図5のステップS204と同様)。 On the other hand, if it is determined not to disclose the user attitude information of the first user 101a to the second user 101b (step S407), in step S409, the image generation unit 233b represents the first user 101a included in the game image. Control the avatar image to the default state. As an example, the image generation unit 233b generates an avatar image in which the avatar representing the first user 101a faces or eyes in a default direction (for example, directly in front) (similar to step S204 in FIG. 5).

ステップS410の処理は図5のステップS205の処理と同じであり、画像生成部233bによって生成されたゲーム画像(第1ユーザ101aのアバター画像を含む)がHMD120bへ供給される。 The process of step S410 is the same as the process of step S205 of FIG. 5, and the game image (including the avatar image of the first user 101a) generated by the image generation unit 233b is supplied to the HMD 120b.

このように、図6及び図7の動作例においても、第2サブシステム100bのHMD120bに表示される第1ユーザ101aのアバターの顔や目の動きを、ユーザ姿勢情報の公開が許可されている場合にのみ、第1ユーザ101aの実際の頭の向きや視線に同期させることができる。 As described above, also in the operation examples of FIGS. 6 and 7, disclosure of user posture information is permitted for the movement of the face and eyes of the first user 101 a displayed on the HMD 120 b of the second subsystem 100 b. Only in this case, it is possible to synchronize with the actual head orientation and line of sight of the first user 101a.

以上、本発明の実施形態を説明したが、本発明はこれに限定されず、その要旨を逸脱しない範囲内において様々な変更が可能である。 As mentioned above, although embodiment of this invention was described, this invention is not limited to this, A various change is possible within the range which does not deviate from the summary.

10 アバター表示システム

100a 第1サブシステム(第1端末)

100b 第2サブシステム(第2端末)

101a 第1ユーザ

101b 第2ユーザ

105 ネットワーク

120a、120b ヘッドマウントディスプレイ(HMD)

200a、200b 画像生成装置

100 HMDシステム

150 有線ケーブル

122 ディスプレイ

124 アイトラッキングデバイス(ETD)

126 センサ

202 プロセッサ

204 メモリ

206 ユーザ入力インターフェイス

208 通信インターフェイス

220 記憶部

221 属性情報

223 仮想現実空間構成情報

230 処理部

231 ユーザ姿勢検出部

232 公開可否決定部

233 画像生成部

234 画像出力部

10 Avatar Display System 100a First Subsystem (First Terminal)

100b Second subsystem (second terminal)

101a First user 101b Second user 105 Network 120a, 120b Head mounted display (HMD)

200a, 200b

126

Claims (11)

前記第1端末は、

前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段と、

前記第1ユーザに関する属性情報を記憶するユーザ属性記憶手段と、

前記属性情報に基づいて、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、

前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段と、を備え、

前記第2端末は、

前記第1端末から前記第1ユーザのユーザ姿勢情報が受信された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段と、

前記アバター画像を表示する表示手段と、を備える、

アバター表示システム。 An avatar display system comprising a first terminal used by a first user and a second terminal used by a second user, wherein an avatar image representing the first user is displayed on the second terminal,

The first terminal is

User posture detection means for detecting user posture information including at least one of the head direction and line of sight of the first user;

User attribute storage means for storing attribute information relating to the first user;

Based on the attribute information, publishability determining means for deciding whether to disclose the user attitude information of the first user to the second user;

Transmission means for transmitting the user attitude information of the first user to the second terminal when it is determined to disclose the user attitude information of the first user to the second user;

The second terminal is

Image generation means for generating an avatar image representing the first user based on the user posture information of the first user when the user posture information of the first user is received from the first terminal;

Display means for displaying the avatar image,

Avatar display system.

前記第1端末は、

前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段と、

前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段と、を備え、

前記第2端末は、

前記第1ユーザに関する属性情報に基づいて、前記第1端末から受信された前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、

前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段と、

前記アバター画像を表示する表示手段と、を備える、

アバター表示システム。 An avatar display system comprising a first terminal used by a first user and a second terminal used by a second user, wherein an avatar image representing the first user is displayed on the second terminal,

The first terminal is

User posture detection means for detecting user posture information including at least one of the head direction and line of sight of the first user;

Transmission means for transmitting user attitude information of the first user to the second terminal,

The second terminal is

Based on attribute information relating to the first user, disclosure permission / non-permission determining means for determining whether to disclose the user attitude information of the first user received from the first terminal to the second user;

An image generating means for generating an avatar image representing the first user based on the user posture information of the first user when it is determined to disclose the user posture information of the first user to the second user;

Display means for displaying the avatar image,

Avatar display system.

前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段と、

前記第1ユーザに関する属性情報を記憶するユーザ属性記憶手段と、

前記属性情報に基づいて、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、

前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段と、

を備えるユーザ端末。 The first terminal in an avatar display system comprising a first terminal used by a first user and a second terminal used by a second user, wherein an avatar image representing the first user is displayed on the second terminal. As a user terminal,

User posture detection means for detecting user posture information including at least one of the head direction and line of sight of the first user;

User attribute storage means for storing attribute information relating to the first user;

Based on the attribute information, publishability determining means for deciding whether to disclose the user attitude information of the first user to the second user;

Transmitting means for transmitting the user posture information of the first user to the second terminal when it is determined to disclose the user posture information of the first user to the second user;

A user terminal comprising:

前記第1端末から、前記第1端末において検出された前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を受信する受信手段と、

前記第1ユーザに関する属性情報に基づいて、前記第1端末から受信された前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段と、

前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段と、

前記アバター画像を表示する表示手段と、

を備えるユーザ端末。 The 2nd terminal in an avatar display system provided with the 1st terminal used by the 1st user, and the 2nd terminal used by the 2nd user, and displaying the avatar picture showing the 1st user on the 2nd terminal As a user terminal,

Receiving means for receiving, from the first terminal, user posture information including at least one of a head direction and a line of sight of the first user detected at the first terminal;

Based on attribute information relating to the first user, disclosure permission / non-permission determining means for determining whether to disclose the user attitude information of the first user received from the first terminal to the second user;

An image generating means for generating an avatar image representing the first user based on the user posture information of the first user when it is determined to disclose the user posture information of the first user to the second user;

Display means for displaying the avatar image;

A user terminal comprising:

前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を検出するユーザ姿勢検出手段、

前記第1ユーザに関する属性情報を記憶するユーザ属性記憶手段、

前記属性情報に基づいて、前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段、

前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報を前記第2端末へ送信する送信手段、

として機能させるためのプログラム。 The first terminal in an avatar display system comprising a first terminal used by a first user and a second terminal used by a second user, wherein an avatar image representing the first user is displayed on the second terminal. User terminal as

User posture detection means for detecting user posture information including at least one of a head direction and a line of sight of the first user;

User attribute storage means for storing attribute information relating to the first user;

Based on the attribute information, disclosure permission / prohibition determining means for determining whether or not the user attitude information of the first user is disclosed to the second user;

A transmission means for transmitting the user posture information of the first user to the second terminal when it is determined to disclose the user posture information of the first user to the second user;

Program to function as.

前記第1端末から、前記第1端末において検出された前記第1ユーザの頭の向きと視線のうち少なくとも一方を含むユーザ姿勢情報を受信する受信手段、

前記第1ユーザに関する属性情報に基づいて、前記第1端末から受信された前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開するか否かを決定する公開可否決定手段、

前記第1ユーザのユーザ姿勢情報を前記第2ユーザに公開すると決定された場合に、前記第1ユーザのユーザ姿勢情報に基づいて、前記第1ユーザを表すアバター画像を生成する画像生成手段、

前記アバター画像を表示する表示手段、

として機能させるためのプログラム。

The 2nd terminal in an avatar display system provided with the 1st terminal used by the 1st user, and the 2nd terminal used by the 2nd user, and displaying the avatar picture showing the 1st user on the 2nd terminal User terminal as

Receiving means for receiving, from the first terminal, user posture information including at least one of a head direction and a line of sight of the first user detected at the first terminal;

Based on attribute information relating to the first user, disclosure permission / non-permission determining means for determining whether or not to disclose the user attitude information of the first user received from the first terminal to the second user;

An image generating unit configured to generate an avatar image representing the first user based on the user posture information of the first user when it is determined to disclose the user posture information of the first user to the second user;

Display means for displaying the avatar image;

Program to function as.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016183466A JP6707429B2 (en) | 2016-09-20 | 2016-09-20 | Avatar display system, user terminal, and program |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016183466A JP6707429B2 (en) | 2016-09-20 | 2016-09-20 | Avatar display system, user terminal, and program |

Related Parent Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2015234650A Division JP6017008B1 (en) | 2015-12-01 | 2015-12-01 | Avatar display system, user terminal, and program |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2020086579A Division JP6865878B2 (en) | 2020-05-18 | 2020-05-18 | Avatar display system, user terminal, and program |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2017102897A true JP2017102897A (en) | 2017-06-08 |

| JP2017102897A5 JP2017102897A5 (en) | 2019-01-24 |

| JP6707429B2 JP6707429B2 (en) | 2020-06-10 |

Family

ID=59017392

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2016183466A Active JP6707429B2 (en) | 2016-09-20 | 2016-09-20 | Avatar display system, user terminal, and program |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP6707429B2 (en) |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP6229089B1 (en) * | 2017-04-26 | 2017-11-08 | 株式会社コロプラ | Method executed by computer to communicate via virtual space, program causing computer to execute the method, and information processing apparatus |

| WO2019155735A1 (en) * | 2018-02-07 | 2019-08-15 | ソニー株式会社 | Information processing device, information processing method, and program |

| WO2021065928A1 (en) * | 2019-09-30 | 2021-04-08 | 株式会社バーチャルキャスト | Content distribution system, content distribution method, and content distribution program |

| CN113449228A (en) * | 2020-03-24 | 2021-09-28 | 北京沃东天骏信息技术有限公司 | Page rendering method and device |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2003110703A (en) * | 2001-10-02 | 2003-04-11 | Sony Corp | Information communication system, information communication method and computer program |

| JP2004185437A (en) * | 2002-12-04 | 2004-07-02 | Nippon Hoso Kyokai <Nhk> | Program, server, client and method for body information reflecting chatting |

| JP2010211613A (en) * | 2009-03-11 | 2010-09-24 | Omron Corp | Information processor, and information processing method, program, and system |

| JP2013009073A (en) * | 2011-06-23 | 2013-01-10 | Sony Corp | Information processing apparatus, information processing method, program, and server |

-

2016

- 2016-09-20 JP JP2016183466A patent/JP6707429B2/en active Active

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2003110703A (en) * | 2001-10-02 | 2003-04-11 | Sony Corp | Information communication system, information communication method and computer program |

| JP2004185437A (en) * | 2002-12-04 | 2004-07-02 | Nippon Hoso Kyokai <Nhk> | Program, server, client and method for body information reflecting chatting |

| JP2010211613A (en) * | 2009-03-11 | 2010-09-24 | Omron Corp | Information processor, and information processing method, program, and system |

| JP2013009073A (en) * | 2011-06-23 | 2013-01-10 | Sony Corp | Information processing apparatus, information processing method, program, and server |

Cited By (10)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP6229089B1 (en) * | 2017-04-26 | 2017-11-08 | 株式会社コロプラ | Method executed by computer to communicate via virtual space, program causing computer to execute the method, and information processing apparatus |

| JP2018185666A (en) * | 2017-04-26 | 2018-11-22 | 株式会社コロプラ | Method executed by computer to communicate through virtual space, program causing computer to execute the method and information processing device |

| US10432679B2 (en) | 2017-04-26 | 2019-10-01 | Colopl, Inc. | Method of communicating via virtual space and system for executing the method |

| WO2019155735A1 (en) * | 2018-02-07 | 2019-08-15 | ソニー株式会社 | Information processing device, information processing method, and program |

| JPWO2019155735A1 (en) * | 2018-02-07 | 2021-02-18 | ソニー株式会社 | Information processing equipment, information processing methods and programs |

| US11553009B2 (en) | 2018-02-07 | 2023-01-10 | Sony Corporation | Information processing device, information processing method, and computer program for switching between communications performed in real space and virtual space |

| JP7279646B2 (en) | 2018-02-07 | 2023-05-23 | ソニーグループ株式会社 | Information processing device, information processing method and program |

| WO2021065928A1 (en) * | 2019-09-30 | 2021-04-08 | 株式会社バーチャルキャスト | Content distribution system, content distribution method, and content distribution program |

| JP2021056884A (en) * | 2019-09-30 | 2021-04-08 | 株式会社バーチャルキャスト | Content distribution system, content distribution method and content distribution program |

| CN113449228A (en) * | 2020-03-24 | 2021-09-28 | 北京沃东天骏信息技术有限公司 | Page rendering method and device |

Also Published As

| Publication number | Publication date |

|---|---|

| JP6707429B2 (en) | 2020-06-10 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6017008B1 (en) | Avatar display system, user terminal, and program | |

| CN109643161B (en) | Dynamic entry and exit from virtual reality environments browsed by different HMD users | |

| US8593535B2 (en) | Relative positioning of devices based on captured images of tags | |

| CN109999491B (en) | Method and computer-readable storage medium for rendering images on a head-mounted display | |

| US9818225B2 (en) | Synchronizing multiple head-mounted displays to a unified space and correlating movement of objects in the unified space | |

| US20190217202A1 (en) | Simulation system, process method, and information storage medium | |

| US8611594B2 (en) | Dynamic display of virtual content on several devices using reference tags | |

| EP2478944B1 (en) | Apparatus and method for displaying player character showing special movement state in network game | |

| JP6097377B1 (en) | Image display method and program | |

| EP2605118A2 (en) | Input direction determination system, terminal, server, network system, and input direction determination method | |

| CN110755850B (en) | Team forming method, device, equipment and storage medium for competitive game | |

| JP6707429B2 (en) | Avatar display system, user terminal, and program | |

| JP2012212237A (en) | Image generation system, server system, program, and information storage medium | |

| JP7216493B2 (en) | game system and program | |

| JP6785325B2 (en) | Game programs, methods, and information processing equipment | |

| JP2019061434A (en) | Program, information processing apparatus, information processing system, and information processing method | |

| JP2020110376A (en) | Game program, method, and information processing device | |

| JP2017142816A (en) | Synchronization server and synchronization method | |

| JP2020179184A (en) | Game program, method, and information processor | |

| JP6865878B2 (en) | Avatar display system, user terminal, and program | |

| JP6114848B1 (en) | Synchronization server and synchronization method | |

| JP6219875B2 (en) | Network game system, game device, and program | |

| JP2019058324A (en) | Program, information processing device, information processing system, and information processing method | |

| JP5732093B2 (en) | Network game system, game device, and program | |

| JP2021037302A (en) | Game program, method, and information processing device |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| RD03 | Notification of appointment of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7423 Effective date: 20181129 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20181203 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20181203 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20190912 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20190930 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20200424 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20200520 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6707429 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |