JP2010075571A - 体部位自動判別システム - Google Patents

体部位自動判別システム Download PDFInfo

- Publication number

- JP2010075571A JP2010075571A JP2008249374A JP2008249374A JP2010075571A JP 2010075571 A JP2010075571 A JP 2010075571A JP 2008249374 A JP2008249374 A JP 2008249374A JP 2008249374 A JP2008249374 A JP 2008249374A JP 2010075571 A JP2010075571 A JP 2010075571A

- Authority

- JP

- Japan

- Prior art keywords

- user

- measurement point

- target range

- discrimination system

- contact

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Landscapes

- Massaging Devices (AREA)

Abstract

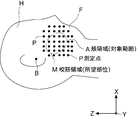

【解決手段】 顔面Fの硬さを検出するロボット11と、使用者Hが知覚可能となる信号を当該使用者Hに呈示する信号呈示装置12と、ロボット11によって検出された顔面Fの硬さに基づいて咬筋の存在範囲を特定する特定装置14とを備えて体部位自動判別システム10が構成されている。ロボット11では、顔面Fの頬領域Aに設定された測定点Pについて、使用者Hが頬領域Aに力を入れた場合とそうでない場合との顔面Fの硬さを検出する。特定装置14では、ロボット11での検出に基づき、頬領域Aに力を入れた場合とそうでない場合との顔面Fの硬さ若しくは位置の変化量から、頬領域Aの咬筋領域Mの位置を特定する。

【選択図】 図1

Description

前記体表の対象範囲内に設定された測定点について、前記使用者が前記対象範囲を動作させた場合とそうでない場合との前記体表の硬さ若しくは位置を検出するセンシング装置と、当該センシング装置での検出に基づき、前記対象範囲を動作させた場合とそうでない場合との前記体表の硬さ若しくは位置の変化量から、前記対象範囲内の所望部位の位置若しくは状態を特定する特定装置とを備える、という構成を採っている。

前記制御手段は、前記接触子を所定の押圧力で前記測定点に一定時間接触させるように前記移動手段の動作を制御し、

前記特定装置は、前記対象範囲を動作させた場合とそうでない場合との前記反力の変化量に基づき、前記測定点下での前記所望部位の存否を判定する、という構成を採用することができる。

前記特定装置では、前記各測定点の前記変化量の最大値を抽出した後で、当該最大値から0までの範囲を複数の数値範囲に区分し、前記各測定点の前記変化量がどの数値範囲に属するかによって、各測定点下での前記所望部位の存否を判定する、という構成を採るとよい。

11 ロボット(センシング装置)

12 信号呈示装置

14 特定装置

16 接触子

17 移動手段

18 制御装置(制御手段)

20 センサ

A 頬領域(対象範囲)

F 顔面(体表)

H 使用者

M 咬筋領域(存在範囲)

P 測定点

Claims (5)

- 使用者の体表下の所望部位を判別する体部位自動判別システムにおいて、

前記体表の対象範囲内に設定された測定点について、前記使用者が前記対象範囲を動作させた場合とそうでない場合との前記体表の硬さ若しくは位置を検出するセンシング装置と、当該センシング装置での検出に基づき、前記対象範囲を動作させた場合とそうでない場合との前記体表の硬さ若しくは位置の変化量から、前記対象範囲内の所望部位の位置若しくは状態を特定する特定装置とを備えたことを特徴とする体部位自動判別システム。 - 前記使用者が知覚可能な信号を当該使用者に呈示する信号呈示装置を更に備え、この信号呈示装置は、前記使用者が前記対象範囲を動作させた場合とそうでない場合との切り換えのタイミングで前記信号を前記使用者に呈示することを特徴とする請求項1記載の体部位自動判別システム。

- 前記センシング装置は、前記体表に接触する接触子と、当該接触子を移動させる移動手段と、当該移動手段の動作を制御する制御手段と、前記接触子の接触による前記体表からの反力を測定可能なセンサとを備え、

前記制御手段は、前記接触子を所定の押圧力で前記測定点に一定時間接触させるように前記移動手段の動作を制御し、

前記特定装置は、前記対象範囲を動作させた場合とそうでない場合との前記反力の変化量に基づき、前記測定点下での前記所望部位の存否を判定することを特徴とする請求項1又は2記載の体部位自動判別システム。 - 前記測定点は、前記対象範囲内に複数設定され、

前記特定装置では、前記各測定点の前記変化量の最大値を抽出した後で、当該最大値から0までの範囲を複数の数値範囲に区分し、前記各測定点の前記変化量がどの数値範囲に属するかによって、各測定点下での前記所望部位の存否を判定することを特徴とする請求項1、2又は3記載の体部位自動判別システム。 - 前記特定装置は、各測定点下での前記所望部位の存否から当該所望部位の存在範囲を特定することを特徴とする請求項4記載の体部位自動判別システム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2008249374A JP5234458B2 (ja) | 2008-09-28 | 2008-09-28 | 体部位自動判別システム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2008249374A JP5234458B2 (ja) | 2008-09-28 | 2008-09-28 | 体部位自動判別システム |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2010075571A true JP2010075571A (ja) | 2010-04-08 |

| JP5234458B2 JP5234458B2 (ja) | 2013-07-10 |

Family

ID=42206725

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2008249374A Expired - Fee Related JP5234458B2 (ja) | 2008-09-28 | 2008-09-28 | 体部位自動判別システム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP5234458B2 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2015229039A (ja) * | 2014-06-06 | 2015-12-21 | パナソニックIpマネジメント株式会社 | マッサージ機 |

Citations (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH04342078A (ja) * | 1991-05-20 | 1992-11-27 | Nippon Telegr & Teleph Corp <Ntt> | 表情認識装置 |

| JP2001212203A (ja) * | 2000-02-02 | 2001-08-07 | Akimasa Iguchi | つぼ検出装置 |

| JP2001269380A (ja) * | 2000-03-27 | 2001-10-02 | Sanyo Electric Co Ltd | マッサージ機 |

| JP2004081522A (ja) * | 2002-08-27 | 2004-03-18 | Matsushita Electric Works Ltd | マッサージ機 |

| JP2005205147A (ja) * | 2004-01-26 | 2005-08-04 | Shiyoufuu:Kk | 顎骨筋伸縮長さ測定装置 |

| JP2008029573A (ja) * | 2006-07-28 | 2008-02-14 | Kao Corp | 美容方法 |

| WO2008041457A1 (fr) * | 2006-09-29 | 2008-04-10 | Waseda University | Robot de massage, programme de commande associé et robot permettant de spécifier une partie du corps humain |

-

2008

- 2008-09-28 JP JP2008249374A patent/JP5234458B2/ja not_active Expired - Fee Related

Patent Citations (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH04342078A (ja) * | 1991-05-20 | 1992-11-27 | Nippon Telegr & Teleph Corp <Ntt> | 表情認識装置 |

| JP2001212203A (ja) * | 2000-02-02 | 2001-08-07 | Akimasa Iguchi | つぼ検出装置 |

| JP2001269380A (ja) * | 2000-03-27 | 2001-10-02 | Sanyo Electric Co Ltd | マッサージ機 |

| JP2004081522A (ja) * | 2002-08-27 | 2004-03-18 | Matsushita Electric Works Ltd | マッサージ機 |

| JP2005205147A (ja) * | 2004-01-26 | 2005-08-04 | Shiyoufuu:Kk | 顎骨筋伸縮長さ測定装置 |

| JP2008029573A (ja) * | 2006-07-28 | 2008-02-14 | Kao Corp | 美容方法 |

| WO2008041457A1 (fr) * | 2006-09-29 | 2008-04-10 | Waseda University | Robot de massage, programme de commande associé et robot permettant de spécifier une partie du corps humain |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2015229039A (ja) * | 2014-06-06 | 2015-12-21 | パナソニックIpマネジメント株式会社 | マッサージ機 |

Also Published As

| Publication number | Publication date |

|---|---|

| JP5234458B2 (ja) | 2013-07-10 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| Pöhlmann et al. | Evaluation of Kinect 3D sensor for healthcare imaging | |

| Lederman et al. | Sensing and displaying spatially distributed fingertip forces in haptic interfaces for teleoperator and virtual environment systems | |

| Gwilliam et al. | Human vs. robotic tactile sensing: Detecting lumps in soft tissue | |

| Schostek et al. | Review on aspects of artificial tactile feedback in laparoscopic surgery | |

| US10398517B2 (en) | Surgical tool positioning based on sensed parameters | |

| US9622684B2 (en) | Neural locating system | |

| Dai et al. | Milling state identification based on vibration sense of a robotic surgical system | |

| JP5288447B2 (ja) | 手術支援システム、接近状態検出装置及びそのプログラム | |

| JP5722794B2 (ja) | コンピュータ補助式ハンドツールの触診アルゴリズム | |

| US10537399B2 (en) | Surgical tool positioning based on sensed parameters | |

| JP2013052046A (ja) | 触力覚的情報提示装置 | |

| US20210307861A1 (en) | Communication of detected tissue characterization in a surgical robotic platform | |

| CN217310576U (zh) | 用于辅助医疗部件在患者体内推进的引导系统 | |

| US20180366035A1 (en) | System and method for image-guided procedure analysis and training | |

| CN109589091A (zh) | 选定ecg信道的交互式显示器 | |

| Cabibihan et al. | Influence of visual and haptic feedback on the detection of threshold forces in a surgical grasping task | |

| Ly et al. | Tumor depth and size perception using a pneumatic tactile display in laparoscopic surgery | |

| KR20130059307A (ko) | 의료 영상 데이터에 대한 물리적 검사의 향상을 위한 방법 및 장치 | |

| Talasaz et al. | Telerobotic palpation for tumor localization with depth estimation | |

| US10602985B2 (en) | Contact detection instrument | |

| JP5234458B2 (ja) | 体部位自動判別システム | |

| Tanaka et al. | Tactile sensing system including bidirectionality and enhancement of haptic perception by tactile feedback to distant part | |

| Wagner et al. | Force feedback in a three-dimensional ultrasound-guided surgical task | |

| Doria et al. | Enhancing the localization of uterine leiomyomas through cutaneous softness rendering for robot-assisted surgical palpation applications | |

| JP7536766B2 (ja) | 患者のストレスを視覚化するためのシステム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20110916 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20121214 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20121225 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20130215 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20130315 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20130315 |

|

| R150 | Certificate of patent or registration of utility model |

Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20160405 Year of fee payment: 3 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| LAPS | Cancellation because of no payment of annual fees |