JP2006508601A - ビデオカメラ - Google Patents

ビデオカメラ Download PDFInfo

- Publication number

- JP2006508601A JP2006508601A JP2004556510A JP2004556510A JP2006508601A JP 2006508601 A JP2006508601 A JP 2006508601A JP 2004556510 A JP2004556510 A JP 2004556510A JP 2004556510 A JP2004556510 A JP 2004556510A JP 2006508601 A JP2006508601 A JP 2006508601A

- Authority

- JP

- Japan

- Prior art keywords

- face

- video camera

- image

- video

- captured

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/172—Classification, e.g. identification

- G06V40/173—Classification, e.g. identification face re-identification, e.g. recognising unknown faces across different face tracks

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/61—Control of cameras or camera modules based on recognised objects

- H04N23/611—Control of cameras or camera modules based on recognised objects where the recognised objects include parts of the human body

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/66—Remote control of cameras or camera parts, e.g. by remote control devices

- H04N23/661—Transmitting camera control signals through networks, e.g. control via the Internet

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/67—Focus control based on electronic image sensor signals

- H04N23/675—Focus control based on electronic image sensor signals comprising setting of focusing regions

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/63—Control of cameras or camera modules by using electronic viewfinders

- H04N23/633—Control of cameras or camera modules by using electronic viewfinders for displaying additional information relating to control or operation of the camera

- H04N23/635—Region indicators; Field of view indicators

Abstract

Description

1.同じ目位置を有するように正規化された顔の画像のセット300の各顔を、小さいブロックに一様にサンプリングする。

2.後に説明する各ブロックの属性を算出する。

3.属性を、異なる値の処理しやすい数に量子化する。

4.次に、量子化属性を、そのブロック位置に関して1つの量子化値を生成するために組み合わせる。

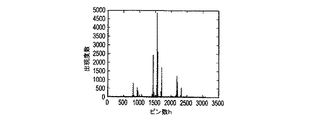

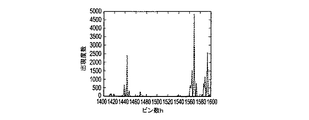

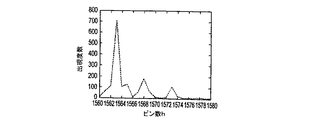

5.そして、1つの量子化値を、エントリとしてヒストグラム、例えば図5に示すヒストグラムに記録する。全てのトレーニング画像の全てのブロック位置に関する累積されたヒストグラム情報320は、顔の特徴の数学的モデルの基礎を形成する。

6.ウィンドウを、一連のブロックのように一様にサンプリングし、そして、各ブロックに関する属性を算出して、上述のステップ1〜4のように量子化する。

7.各ブロック位置の量子化属性値の対応する「確率(probability)」を、対応するヒストグラムから調べる。すなわち、各ブロック位置のそれぞれの量子化属性を生成し、そのブロック位置に関して予め生成されたヒストグラムと比較する。ヒストグラムが「確率」データを高める方法については後述する。

8.得られる全ての確率を互いに乗算して、ウィンドウを「顔」又は「顔でない」に分類するために、閾値と比較する最終の確率を形成する。「顔」又は「顔でない」の検出結果は絶対検出よりもむしろ確率ベースの方法であることは、言うまでもない。顔を含んでいない画像を間違って「顔」として検出(所謂誤検出(false positive))してしまうことがある。また、顔を含んでいる画像を間違って「顔でない」として検出(所謂見逃し検出(false negative))してしまうこともある。あらゆる顔検出システムの目標は、誤検出の割合及び見逃し検出の割合を減らすことであるが、現在の技術では、これらの割合をゼロに減らすことは、不可能ではないとしても困難である。

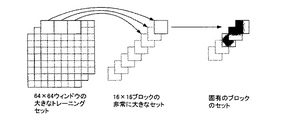

この実施例の属性は、所謂固有ブロックに基づいている。固有ブロックを、トレーニングセットのブロックの有効な具象的な才能(good representational ability)を有するように設計した。したがって、固有ブロックは、トレーニングセットからのブロックの大きなセットに対して重要な構成要素の解析を実行することによって生成された。この処理を、図6に示すとともに、付録Bにおいてより詳細に説明する。

実験を、トレーニングブロックの2の異なるセットによって行った。

まず最初に、トレーニングセットの25個の顔画像から得られる一組のブロックを用いた。16×16ブロックを、重ならないように、16画素毎にサンプリングした。このサンプリングを、図6に示す。図6から明らかなように、16×16ブロックは、個々の64×64トレーニング画像から生成される。これにより、全体的に合計400個のトレーニングブロックが生成される。

固有ブロックの第2セットを、トレーニングブロックのより大きなセットから生成した。これらのブロックは、トレーニングセット内の500個の顔画像から得られた。この場合、16×16ブロックを、8画素が重なるように、8画素毎にサンプリングした。各64×64個のトレーニング画像から、49個のブロックが生成され、これを合計24,500個のトレーニングブロックに適用した。

64×64顔画像内の各サンプリングされたブロック位置に対してヒストグラムを作成した。ヒストグラムの数は、ブロック間隔に依存する。例えば、16画素のブロック間隔の場合、16の可能なブロック位置があり、したがって、16個のヒストグラムが用いられる。

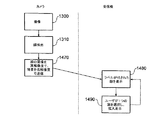

・顔画像の位置(i,j)から関連したブロックを抽出する処理410。

・ブロックの固有ブロックベースの属性を算出して、これらの属性から関連したビン数420を判定する処理。

・ヒストグラム430内の関連したビン数を増加させる処理。

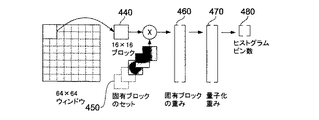

ヒストグラムビン数は、図10で示すように、以下の処理を用いて、所定のブロックから生成される。64×64ウィンドウ又は顔画像から16×16ブロック440を抽出する。ブロックは、一組の「固有ブロック重み(eigenblock weight)」を生成するためにA固有ブロックのセット450上で推定される。これらの固有ブロック重みは、この実行で用いられる「属性」である。固有ブロック重みは、−1〜+1の範囲を有する。この処理については、付録Bでより詳細に説明する。各重みを、一組の量子化属性470(wi,i=1,・・・,A)を生成するために、レベルLの固定量に量子化する。量子化重みを、以下のように、単一の値に結合する。

顔検出処理は、検定画像を64×64の移動ウィンドウ(moving 64x64 window)によってサンプリングして、各ウィンドウ位置における顔確率を算出する処理を含む。

顔でないモデルは、顔を含まない画像の属性の確率分布を示すヒストグラムの更なるセットを含む。このヒストグラムは、トレーニング画像が顔の代わりに顔でない画像を含む以外は、顔モデルと正確に同じ方法で生成される。

図12a〜12fは、上述したトレーニング処理によって生成されるヒストグラムの具体例を示す図である。

検定画像における異なる大きさの顔を検出するために、検定画像を係数の範囲(range of factors)によって拡大縮尺し(scale)、距離(distance、すなわち確率)マップを各尺度(scale)に対して生成する。図13a〜13cに、画像及びこれらの対応する距離マップを、3つの異なる尺度で示す。この手法は、最も小さい尺度(図13a)で大きな(中心の)対象に対して最良の応答(最高の確率又は最小の距離)を示し、大きな尺度でより小さい対象(主人物の左側)に対してより良い応答を示す。(マップ上のより暗い色は、反転マップにおけるより低い値、すなわちそこが顔であるというより高い確率を示す)。全ての尺度に対して最良の応答を示す位置を最初に検出ことによって、候補顔位置を異なる尺度に亘って抽出する。すなわち、最も高い確率(最も短い距離)を、全ての尺度で全ての確率マップ中で確定する。この候補位置は、顔としてラベルが付けられる第1の位置である。そして、その顔位置の中心に置かれるウィンドウは、各尺度の確率マップから削除される。削除されるウィンドウの大きさは、確率マップの尺度に比例する。

・各尺度で検定ウィンドウに関する属性を導く(図13a〜図13cに示すように)。

・それらの属性を「フルフェース」ヒストグラムデータと比較して、「フルフェース」の距離マップのセットを生成する。

・属性を「ズームイン」ヒストグラムデータと比較して、「ズームイン」の距離マップのセットを生成する。

・各尺度nについて、尺度n+3の「ズームイン」距離マップを、尺度nの「フルフェース」距離マップに組み合わせる。

・図13a〜図13cによって上述したように、組み合わせた距離マップから顔位置を導く。

顔追跡アルゴリズムについて説明する。追跡アルゴリズムは、画像シーケンスにおいて顔検出性能を向上させることを意図している。

・顔の数。

・各顔の「顔写真(Mugshot)」(個人の顔の画像を表す口語的な言葉、警察にファイルされている写真を照会する用語からきている)。

・各顔が最初に出現するフレーム番号。

・各顔が最後に出現するフレーム番号。

・各顔の識別(前のシーンで見られた顔に一致するか、顔のデータベースに一致したもの)−顔の識別には、顔の認識も必要とされる。

追跡アルゴリズムは、顔の存在を示す顔検出結果とともにフレームが供給されるまで、何もしない。

各既存のカルマンフィルタに対して、顔の次の位置が、以下の標準カルマンフィルタ予測方程式を用いて予測される。カルマンフィルタは、前状態(フレームk−1)、及びフィルタの現状態(フレームk)を推定する他の内部及び外部変数を用いる。

状態予測式:

状態推移行列(φ(k,k―1))は、次の状態の予測をどのようにして行うかを決定する。運動方程式を用い、φ(k,k―1)に対して次の行列を導くことができる。

肌色マッチングは、顔検出結果と良く一致する顔に対しては用いられない。肌色マッチングは、カルマンフィルタによって位置が予測された顔に対して実行されるだけであり、現フレーム内の顔検出結果に一致しない、したがってカルマンフィルタの更新に役立つ観測データがない顔に対しては実行されない。

この方法においては、追跡された顔で色の分布をモデル化するガウス分布を用いる代わりに、色ヒストグラムを用いる。

・2チャンネル(Cr、Cb)の代わりに3チャンネル(Y、Cr、Cb)を用いる。

・量子化レベルの数を変える。

・ウィンドウをブロックに分割して、各ブロックのヒストグラムを算出する。この方法では、色ヒストグラム法は、位置的に依存するようになる。この方法では、ヒストグラムの各対間のMSEを合計する。

・ウィンドウを分割するブロックの数を変える。

・実際に使用するブロックを変える。例えば、単に部分的に顔の画素を含む外側のブロックを省略する。

・3チャンネル(Y、Cr及びCb)。

・各チャンネルに対して8つの量子化レベル(すなわち、ヒストグラムは8×8×8=512ビン(bins)を含む)。

ウィンドウを16ブロックに分割する。

16個の全てのブロックを使用する。

この方法は、上述した第1の方法に基づいている。色マスク法は、顔の画素分布を記述するのに、ガウス分布肌色モデルを用いる。

(a)ガウス分布肌色モデルは、前フレームにおいて追跡された顔の中央に置かれた楕円状の領域のCr及びCbの平均値及び共分散を用いてシードされる。

(b)デフォルトのガウス分布肌色モデルは、前フレームのマスクを算出するために、及び現フレームにおいて距離画像を算出するための両方に、用いられる。

更新ステップは、状態予測及び観測データに基づいて、現在のフレームに対するフィルタの出力を適切なものにするために用いられる。更新ステップでは、予測された状態と観測された状態との間の誤差に基づいて、フィルタの内部変数も更新される。

・ピクチャのエッジから外れた顔及び/又は

・これらの顔をサポートする継続中の証拠がない顔(顔検出結果又は色マッチングより、カルマンフィルタ予測に基づく観測の割合が高い場合)

これらの顔については、関連するカルマンフィルタを除去し、ファイルにはデータを出力しない。

所定の顔の追跡の間に、許容されたカルマン予測顔位置の割合が、この閾値を超えた場合、追跡された顔は拒否される。この閾値は、現在0.8に設定している。

全てのフレームに亘る最後のパスの間に、所定の顔について、許容された顔検出割合がこの閾値を下回った場合、追跡された顔は拒否される。この閾値は、現在0.08に設定している。

全てのフレームに亘る最後のパスの間に、所定の顔について、発生回数がmin_framesより少ない場合、その顔は拒否される。このような場合が生じる可能性があるのは、シーケンスの最後の近くのみである。min_framesは、現在5に設定している。

全てのフレームに亘る最後のパスの間に、追跡されている所定の顔の発生回数が min_frames2であり、許容されたカルマン予測顔位置の割合がfinal_prediction_acceptance_ratio_thresholdを超えた場合、その顔は拒否される。このような場合が生じる可能性があるのは、シーケンスの最後の近くのみである。final_prediction_acceptance_ratio_thresholdは、現在0.5に設定してあり、min_frames2は、現在10に設定してある。

更に、追跡された顔の目の間隔が所定の最小距離を下回る場合、その顔を除外する。このような状況は、カルマンフィルタが目の間隔が狭くなっていると誤って判断し、例えば顔検出結果等、この判断を訂正する他の証拠がない場合に生じる。これを訂正しなければ、目の感覚は最終的に0になってしまう可能性がある。任意の変形例として、目の間隔に関する最小値又は下限を強制的に設定し、検出された目間隔が最小目間隔より小さい場合、検出処理はその目間隔を有する顔の探索を継続し、これより小さい目間隔を有する顔の探索は行わないようにしてもよい。

顔が追跡される場合、顔追跡が重複する可能性がある。重複が発生した場合、少なくとも幾つかのアプリケーションでは、追跡の1つを削除する必要がある。重複が発生した場合、どの顔追跡を持続するかを決定するために、一組の規則を用いる。

D:顔検出−現在の顔の位置は、新たな顔検出によって確認される。

S:肌色追跡−顔検出は行われていないが、適切な肌色追跡が行われている。

P:予測−適切な顔検出も肌色追跡も行われておらず、カルマンフィルタからの予測された顔位置が使用されている。

・番組の種類(例えば、ニュース、インタビュー、ドラマ)。

・例えば「遠くからのショット」、「カメラが接近する」(特定の種類のカメラショットに基づいて、顔のサイズのサブレンジが予測される)、各ショットに何人の人が含まれるか(これによっても、顔のサイズのサブレンジが予測される)等、ショットの詳細に関する脚本情報。

・スポーツ関連情報。スポーツは、多くの場合、固定されたカメラ位置から標準的なビュー及びショットを用いて撮像される。これらのメタデータにおいて特定することによって、顔のサイズのサブレンジを導き出すことができる。

顔追跡法は、以下のような3つの主な利点を有する。

・顔検出結果が得られないフレームにおいて、カルマンフィルタリング及び肌色追跡を用いることにより、見逃された顔を埋める(fill in)ことができる。これにより、画像シーケンス間に亘って、真の許容率を高めることができる。

・顔を連続的に追跡することにより、顔のリンクを提供できる。アルゴリズムは、将来のフレームにおいて検出された顔が同じ個人の顔であるか、他の個人の顔であるかを自動的に知ることができる。したがって、このアルゴリズムから、シーン内の顔の数やこれらの顔が存在するフレームに関する情報を含むシーンメタデータを容易に作成することができ、各顔の代表的な顔写真を作成することもできる。

・顔の誤検出は、画像間で連続することは希であるため、顔の誤検出率を低くすることができる。

(1)(色追跡/カルマン追跡ではなく)検出された顔を用いる。

(2)顔検出の間、確率が高かった、すなわち、少なくとも閾値確率を超えた顔を用いる。

(3)可能な限り64×64画素に近い顔を用い、これにより、再スケーリングによるアーチファクトを低減し、画質を改善する。

(4)(可能であれば)追跡の早い段階での顔すなわち、追跡シーケンスにおけるの所定の初期の部分(例えば、追跡シーケンスの最初から10%又は20のフレーム等)の顔を用いないこの期間は、顔がまだ遠くにある(すなわち、小さい)又は不鮮明である可能性が高いためである。

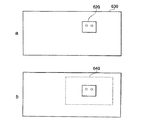

・まず、顔検出器1160によって検出された最も左上の顔を特定する。

・その顔の最も左上の極値(extreme)を検出する。これにより、クロッピングされる画像の左上角が定義される。

・最も右下の顔と、その顔の最も右下の極値とについて同様の処理を繰り返し、これにより、クロッピングされる画像の右下角が定義される。

・これらの2つの座標に基づいて、画像を長方形状に切り取る。

・最も左及び最も右の顔を特定する。

・ショットのアスペクト比を維持したまま、ピクチャの上半分の位置に顔が表示されるようにする。

1.エイチ・シュナイダーマン(H. Schneiderman)及びティー・カナデ(T. Kanade)著、「顔及び車に適用される3Dオブジェクト検出のための統計モデル(A statistical model for 3D object detection applied to faces and cars)」、コンピュータビジョン及びパーターン検出に関するIEEEコンファレンス2000(IEEE Conference on Computer Vision and Pattern Detection, 2000)

2.エイチ・シュナイダーマン(H. Schneiderman)及びティー・カナデ(T. Kanade)著、「オブジェクト検出のための局所的外観及び空間的関係の確率的モデリング(Probabilistic modelling of local appearance and spatial relationships for object detection)」、コンピュータビジョン及びパーターン検出に関するIEEEコンファレンス1998(IEEE Conference on Computer Vision and Pattern Detection, 1998)

3.エイチ・シュナイダーマン(H. Schneiderman)著、「顔及び車に適用される3Dオブジェクト検出のための統計的手法」、カーネギーメロン大学(Carnegie Mellon University)ロボティクス研究科(Robotics Institute)博士論文、2000年

4.イー・ヘルマス(E. Hjelmas)及びビー・ケー・ロウB.K. Low)著、「顔検出:概観(Face Detection: A Survey)」、コンピュータビジョン及び画像理解(Computer Vision and Image Understanding)第83号、pp.236〜274、2001年

5.エム−エイチ・ヤング(M.-H.Yang)、ディー・クレイグマン(D.Kriegman)及びエヌ・アフジャ(N.Ahuja)著、「画像における顔の検出:概観(Detecting Faces in Images: A Survey)」、パターン分析及びマシン知能に関するIEEEトランザクション(IEEE Trans. on Pattern Analysis and Machine Intelligence)、第24巻1号pp.34〜58、2002年1月

付録A:トレーニング顔セット

1個のデータベースは、屋内の背景の前に立つ数千個の題材(subject)の画像を格納している。上述の手法の実験に用いられる他のトレーニングデータベースは、正面から左右までの様々な範囲の角度から見た人間の頭の8ビットのグレースケール画像を一万個以上格納している。当業者にとっては明らかであるが、これらとは異なる様々なトレーニングセットを用いてもよく、任意として、ローカルの母集団の顔の特徴を反映するようプロファイルされたトレーニングセットを用いてもよい。

顔検出及び認識のための固有顔法(図4及び図5参照)において、各m×n顔画像は、それぞれ長さmnのベクトルによって表現されるようにが記録される。これにより、各画像は、mn次元空間内の点とみなすことができる。画像の組は、この大きな空間内の点の集合にマッピングされる。

固有ブロックは、以下のような手順で算出される。

(1)画像のトレーニングセットを用いる。これらを、それぞれm×nのサイズを有する画像ブロックに分割する。各ブロック位置について、それぞれが各画像におけるそのブロック位置から抽出された、次のような画像ブロックの組が得られる。

(3)ベクトルのトレーニングセット

(4)偏差ベクトルの組

(5)共分散行列Σを算出する。

(7)以下の式を解くことにより、全ての固有ベクトルからなる組P及び共分散行列Σの固有値λi,i=1,・・・,Nを求める。

未知の画像の顔への類似性、すなわち顔類似性(faceness)は、その画像が顔空間によってどれ程適切に表現できるかによって測定される。この処理は、トレーニング処理において用いたものと同じブロックのグリッドを用いて、ブロック毎に行う。

画像を顔空間に射影する前に、トレーニングセットに対して行った前処理と略々同様の前処理をこの画像に対して行う。

(1)m×nのサイズの検査画像ブロックI0を得る。

(2)元の検査画像ブロックI0を0と、1のL2ノルムとの平均値を有するように正規化し、正規化された検査画像ブロックIを生成する。

(3)画像の画素要素を辞書順に並べ替えることによって、偏差ベクトルを生成する。画像を長さN=mnの偏差ベクトルxに並べ替える。

(4)顔空間への射影は、偏差ベクトルxをその固有ブロック成分に変換する処理を含む。この処理は、M個の主固有ベクトル(固有ブロック)Pi,i=1,・・・,Mによる単純な乗算を含む。各重みyiは、以下のようにして求めることができる。

Claims (28)

- ビデオマテリアルを捕捉する撮像デバイスと、

上記捕捉されたビデオマテリアルにおいて人間の顔を検出し、該捕捉されたビデオマテリアルにおいて検出された顔の出現を特定する顔データを生成する顔検出器と、

上記捕捉されたビデオマテリアルを表すデータを伝送及び/又は記録するデータ取扱媒体と、

上記捕捉されたビデオマテリアル内の顔の検出に基づいて、上記データ取扱媒体によって送信又は保存されるデータを生成するプロセッサとを備えるビデオカメラ装置。 - 上記データ取扱媒体は、

上記捕捉されたビデオマテリアルを保存するための記録媒体と、

上記顔検出器によって生成された顔データを含む、上記捕捉されたビデオマテリアルに関連するメタデータを保存するメタデータ保存手段とを備えることを特徴とする請求項1記載のビデオカメラ装置。 - 上記メタデータ保存手段は、上記捕捉されたビデオマテリアルと同じ記録媒体にメタデータを保存するよう構成されていることを特徴とする請求項2記載のビデオカメラ装置。

- 上記メタデータ保存手段は、当該ビデオカメラ装置に接続可能なリムーバブルストレージデバイスを備えることを特徴とする請求項2記載のビデオカメラ装置。

- 上記メタデータ保存手段は、当該ビデオカメラ装置の外部のストレージデバイスと、当該ビデオカメラ装置及び該ストレージデバイスとの間の無線リンクとを備えることを特徴とする請求項2記載のビデオカメラ装置。

- 当該ビデオカメラ装置は、フォーカス、ズーム及び/又は絞りの設定を調整可能なレンズを備え、上記メタデータは、該レンズのフォーカス、ズーム及び/又は絞りの設定に関する情報のうちの少なくとも1つを含んでいることを特徴とする請求項2乃至5いずれか1項記載のビデオカメラ装置。

- 上記顔検出器は、上記レンズのフォーカス、ズーム及び/又は絞りの設定、及び/又は連続するビデオショットの開始点及び終了点に応じて動作することを特徴とする請求項6記載のビデオカメラ装置。

- 上記顔検出器は、上記捕捉されたビデオマテリアルの各フィールド又はフレーム内に人間の顔が存在している確率を検出し、

上記メタデータ保存手段は、上記捕捉されたビデオマテリアルの各連続するシーケンスから、該連続するシーケンスにおいて最も高い確率に関連付けられた、少なくとも1つの顔の表現を保存することを特徴とする請求項2乃至7いずれか1項記載のビデオカメラ装置。 - 当該ビデオカメラ装置は、単一の機器であることを特徴とする請求項1乃至8いずれか1項記載のビデオカメラ装置。

- 上記データ取扱媒体は、上記捕捉されたビデオマテリアルに関連する捕捉されたオーディオマテリアルを表すデータを保存する及び/又は伝送することを特徴とする請求項1乃至9いずれか1項記載のビデオカメラ装置。

- 音声検出器を備え、上記顔検出器は、捕捉されたオーディオマテリアルにおける音声の検出に応じて動作することを特徴とする請求項10記載のビデオカメラ装置。

- 2つ以上のマイクロホンに接続され、上記プロセッサ及び/又は顔検出器は、該マイクロホンからのオーディオ信号に応じて動作し、現在の話者の顔を特定することを特徴とする請求項10又は11記載のビデオカメラ装置。

- 上記顔検出器による顔検出に応じて、上記データ取扱媒体によって保存及び/又は伝送される少なくとも幾つかの捕捉された画像のサブセットを導出するロジックを備える請求項10乃至12いずれか1項記載のビデオカメラ装置。

- 上記サブセットは、少なくとも、上記顔検出器によって検出された各顔を含むクロッピングされた画像を含むことを特徴とする請求項13記載のビデオカメラ装置。

- 上記サブセットは、捕捉された画像に関して、それぞれが1つの検出された顔を表し、該捕捉された画像において検出された顔の数に等しい複数のクロッピングされた画像を含むことを特徴とする請求項13記載のビデオカメラ装置。

- 上記クロッピングされた画像のそれぞれの表示特性を選択するためのユーザ操作子を備える請求項15記載のビデオカメラ装置。

- 上記データ取扱媒体は、伝送媒体であり、上記ユーザ操作子は、該伝送媒体の遠隔ノードに設けられていることを特徴とする請求項16記載のビデオカメラ装置。

- 上記サブセットは、捕捉された画像に関して、単一の検出された顔を表すクロッピングされた画像を含むことを特徴とする請求項13記載のビデオカメラ装置。

- 画像の一部において顔が検出されたか否かに応じて、該画像の一部に適用されるデータ圧縮率を変更するロジックを備える請求項10乃至12いずれか1項記載のビデオカメラ装置。

- 顔が検出されない捕捉された画像の部分に対しては、より高いデータ圧縮率を適用することを特徴とする請求項19記載のビデオカメラ装置。

- 上記顔検出器による顔検出に応じて、上記顔データに基づいて、上記撮像デバイスのレンズのズーム及び/又は向きを制御するロジックを備える請求項10乃至12いずれか1項記載のビデオカメラ装置。

- それぞれが表示装置に接続された2つ以上の請求項10乃至21いずれか1項記載のビデオカメラ装置を備え、上記データ取扱媒体は、該2つ以上のビデオカメラ装置をリンクする伝送媒体であるビデオ会議システム。

- 請求項10乃至21いずれか1項記載のビデオカメラ装置を備える安全監視システム。

- ビデオマテリアルを捕捉する撮像デバイスと、記録媒体とを備えるビデオカメラ装置の動作方法において、

上記捕捉されたビデオマテリアルにおいて人間の顔を検出し、該捕捉されたビデオマテリアルにおいて検出された顔の出現を特定する顔データを生成するステップと、

上記捕捉されたビデオマテリアル内の顔の検出に基づいて、送信又は保存のために、上記捕捉されたビデオマテリアルを表すデータを生成するステップとを有する動作方法。 - 請求項24記載の動作方法を実行するプログラムコードを含むコンピュータソフトウェア。

- 請求項25記載のプログラムコードを提供する提供媒体。

- 当該提供媒体は、記録媒体であることを特徴とする請求項26記載の提供媒体。

- 当該提供媒体は、伝送媒体であることを特徴とする請求項26記載の提供媒体。

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| GB0227915A GB2395853A (en) | 2002-11-29 | 2002-11-29 | Association of metadata derived from facial images |

| PCT/GB2003/005224 WO2004051981A2 (en) | 2002-11-29 | 2003-11-28 | Video camera |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2006508601A true JP2006508601A (ja) | 2006-03-09 |

| JP2006508601A5 JP2006508601A5 (ja) | 2007-02-01 |

Family

ID=9948803

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2004556510A Pending JP2006508601A (ja) | 2002-11-29 | 2003-11-28 | ビデオカメラ |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US8384791B2 (ja) |

| EP (1) | EP1570649A2 (ja) |

| JP (1) | JP2006508601A (ja) |

| GB (1) | GB2395853A (ja) |

| WO (1) | WO2004051981A2 (ja) |

Cited By (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2006508463A (ja) * | 2002-11-29 | 2006-03-09 | ソニー・ユナイテッド・キングダム・リミテッド | 顔検出 |

| JP2008078713A (ja) * | 2006-09-19 | 2008-04-03 | Sony Corp | 記録装置および方法、プログラム、並びに再生装置および方法 |

| JP2010517488A (ja) * | 2007-01-30 | 2010-05-20 | ファーガソン パテント プロパティーズ リミテッド ライアビリティ カンパニー | 画像捕獲表示システム、ビデオ画像内の関心領域を用いてシステム同期型輝度制御を実行する方法、およびメタデータの使用 |

| KR101484001B1 (ko) | 2013-11-20 | 2015-01-20 | (주)나노인사이드 | 지역 미세 패턴을 이용한 얼굴 영상 분석 방법 |

| JP2017151972A (ja) * | 2012-09-05 | 2017-08-31 | インテル・コーポレーション | プラットフォーム及びイメージデバイスの間の通信プロトコル |

Families Citing this family (63)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4121026B2 (ja) | 2004-01-21 | 2008-07-16 | 富士フイルム株式会社 | 撮像装置および方法並びにプログラム |

| GB0412906D0 (en) * | 2004-06-09 | 2004-07-14 | Capture Ltd | Data compilation apparatus and method |

| EP1784006A4 (en) * | 2004-08-09 | 2012-04-18 | Nikon Corp | IMAGE FORMING DEVICE |

| JP2006211078A (ja) * | 2005-01-26 | 2006-08-10 | Casio Comput Co Ltd | デジタルカメラ、表示方法及びプログラム |

| CA2531296C (en) * | 2005-12-22 | 2015-11-24 | Bce Inc. | Delivering a supplemented cctv signal to one or more subscribers |

| JP4201025B2 (ja) * | 2006-06-30 | 2008-12-24 | ソニー株式会社 | 監視装置、監視システム及びフィルタ設定方法、並びに監視プログラム |

| JP4998026B2 (ja) | 2007-03-15 | 2012-08-15 | ソニー株式会社 | 画像処理装置、撮像装置、および画像表示制御方法、並びにコンピュータ・プログラム |

| US8116537B2 (en) * | 2007-04-04 | 2012-02-14 | Sony Corporation | Image recording device, player device, imaging device, player system, method of recording image, and computer program |

| KR101405933B1 (ko) * | 2007-07-12 | 2014-06-12 | 엘지전자 주식회사 | 휴대 단말기 및 휴대 단말기의 위치 정보 표시 방법 |

| US8170342B2 (en) | 2007-11-07 | 2012-05-01 | Microsoft Corporation | Image recognition of content |

| US8194156B2 (en) * | 2008-01-07 | 2012-06-05 | Sony Ericsson Mobile Communications Ab | EXIF object coordinates |

| CN103475837B (zh) | 2008-05-19 | 2017-06-23 | 日立麦克赛尔株式会社 | 记录再现装置及方法 |

| US8855360B2 (en) * | 2008-07-23 | 2014-10-07 | Qualcomm Technologies, Inc. | System and method for face tracking |

| US20100123776A1 (en) * | 2008-11-18 | 2010-05-20 | Kimberly-Clark Worldwide, Inc. | System and method for observing an individual's reaction to their environment |

| JP5385752B2 (ja) * | 2009-10-20 | 2014-01-08 | キヤノン株式会社 | 画像認識装置、その処理方法及びプログラム |

| US8379098B2 (en) * | 2010-04-21 | 2013-02-19 | Apple Inc. | Real time video process control using gestures |

| US8311337B2 (en) | 2010-06-15 | 2012-11-13 | Cyberlink Corp. | Systems and methods for organizing and accessing feature vectors in digital images |

| US8320644B2 (en) | 2010-06-15 | 2012-11-27 | Apple Inc. | Object detection metadata |

| US20120013750A1 (en) * | 2010-07-16 | 2012-01-19 | Gn Netcom A/S | Sound Optimization Via Camera |

| US8692907B2 (en) * | 2010-09-13 | 2014-04-08 | Sony Corporation | Image capturing apparatus and image capturing method |

| US8823769B2 (en) * | 2011-01-05 | 2014-09-02 | Ricoh Company, Ltd. | Three-dimensional video conferencing system with eye contact |

| US8587672B2 (en) | 2011-01-31 | 2013-11-19 | Home Box Office, Inc. | Real-time visible-talent tracking system |

| US9251854B2 (en) | 2011-02-18 | 2016-02-02 | Google Inc. | Facial detection, recognition and bookmarking in videos |

| US9026951B2 (en) | 2011-12-21 | 2015-05-05 | Apple Inc. | Device, method, and graphical user interface for selection of views in a three-dimensional map based on gesture inputs |

| US9208698B2 (en) | 2011-12-27 | 2015-12-08 | Apple Inc. | Device, method, and graphical user interface for manipulating a three-dimensional map view based on a device orientation |

| CN102547293B (zh) * | 2012-02-16 | 2015-01-28 | 西南交通大学 | 人脸区域时域依赖性与全局率失真优化相结合的会话视频编码方法 |

| KR101999137B1 (ko) * | 2013-01-03 | 2019-07-11 | 삼성전자주식회사 | 카메라를 구비하는 장치의 이미지 처리장치 및 방법 |

| CN103945105B (zh) * | 2013-01-23 | 2017-08-25 | 北京三星通信技术研究有限公司 | 一种智能拍照和分享照片的方法和设备 |

| JP2014220724A (ja) * | 2013-05-10 | 2014-11-20 | ソニー株式会社 | 表示制御装置、表示制御方法、およびプログラム |

| US20140341443A1 (en) * | 2013-05-16 | 2014-11-20 | Microsoft Corporation | Joint modeling for facial recognition |

| US9307191B2 (en) | 2013-11-19 | 2016-04-05 | Microsoft Technology Licensing, Llc | Video transmission |

| JP6292912B2 (ja) * | 2014-02-07 | 2018-03-14 | キヤノン株式会社 | 通信機器及び通信機器の制御方法 |

| US9614724B2 (en) | 2014-04-21 | 2017-04-04 | Microsoft Technology Licensing, Llc | Session-based device configuration |

| US9639742B2 (en) | 2014-04-28 | 2017-05-02 | Microsoft Technology Licensing, Llc | Creation of representative content based on facial analysis |

| US9773156B2 (en) | 2014-04-29 | 2017-09-26 | Microsoft Technology Licensing, Llc | Grouping and ranking images based on facial recognition data |

| US9430667B2 (en) | 2014-05-12 | 2016-08-30 | Microsoft Technology Licensing, Llc | Managed wireless distribution network |

| US9384335B2 (en) | 2014-05-12 | 2016-07-05 | Microsoft Technology Licensing, Llc | Content delivery prioritization in managed wireless distribution networks |

| US10111099B2 (en) | 2014-05-12 | 2018-10-23 | Microsoft Technology Licensing, Llc | Distributing content in managed wireless distribution networks |

| US9384334B2 (en) | 2014-05-12 | 2016-07-05 | Microsoft Technology Licensing, Llc | Content discovery in managed wireless distribution networks |

| US9874914B2 (en) | 2014-05-19 | 2018-01-23 | Microsoft Technology Licensing, Llc | Power management contracts for accessory devices |

| US20150350504A1 (en) * | 2014-06-03 | 2015-12-03 | 2P & M Holdings, LLC | RAW Camera Peripheral for Handheld Mobile Unit |

| US9367490B2 (en) | 2014-06-13 | 2016-06-14 | Microsoft Technology Licensing, Llc | Reversible connector for accessory devices |

| US9460493B2 (en) | 2014-06-14 | 2016-10-04 | Microsoft Technology Licensing, Llc | Automatic video quality enhancement with temporal smoothing and user override |

| US9373179B2 (en) | 2014-06-23 | 2016-06-21 | Microsoft Technology Licensing, Llc | Saliency-preserving distinctive low-footprint photograph aging effect |

| GB2528330B (en) * | 2014-07-18 | 2021-08-04 | Unifai Holdings Ltd | A method of video analysis |

| US9805662B2 (en) * | 2015-03-23 | 2017-10-31 | Intel Corporation | Content adaptive backlight power saving technology |

| KR102193567B1 (ko) * | 2015-06-17 | 2020-12-22 | 삼성전자주식회사 | 복수의 이미지를 디스플레이하는 전자 장치 및 이의 이미지 처리 방법 |

| US10210598B2 (en) * | 2015-06-17 | 2019-02-19 | Samsung Electronics Co., Ltd. | Electronic device for displaying a plurality of images and method for processing an image |

| US9864901B2 (en) * | 2015-09-15 | 2018-01-09 | Google Llc | Feature detection and masking in images based on color distributions |

| JP6579925B2 (ja) * | 2015-11-17 | 2019-09-25 | キヤノン株式会社 | 画像再生装置およびその制御方法ならびにプログラムならびに記録媒体 |

| US11069210B2 (en) * | 2017-06-28 | 2021-07-20 | Amazon Technologies, Inc. | Selecting a video frame for notification using audio/video recording and communication devices |

| CN109922249A (zh) * | 2017-12-12 | 2019-06-21 | 北京小米移动软件有限公司 | 图像采集单元控制方法和装置 |

| US10269164B1 (en) * | 2018-05-30 | 2019-04-23 | Whatsapp Inc. | Creating custom stickers for use on a messaging system |

| US10674072B1 (en) | 2019-05-06 | 2020-06-02 | Apple Inc. | User interfaces for capturing and managing visual media |

| US11770601B2 (en) | 2019-05-06 | 2023-09-26 | Apple Inc. | User interfaces for capturing and managing visual media |

| TWI719409B (zh) * | 2019-02-23 | 2021-02-21 | 和碩聯合科技股份有限公司 | 追蹤系統及其方法 |

| US11706521B2 (en) | 2019-05-06 | 2023-07-18 | Apple Inc. | User interfaces for capturing and managing visual media |

| WO2021107421A1 (ko) * | 2019-11-26 | 2021-06-03 | 한화테크윈 주식회사 | 사건 중심의 다채널 영상 백업 장치 및 그 방법과, 이를 포함한 네트워크 감시 카메라 시스템 |

| TWI731503B (zh) * | 2019-12-10 | 2021-06-21 | 緯創資通股份有限公司 | 活體臉部辨識系統與方法 |

| US11039074B1 (en) | 2020-06-01 | 2021-06-15 | Apple Inc. | User interfaces for managing media |

| US11212449B1 (en) | 2020-09-25 | 2021-12-28 | Apple Inc. | User interfaces for media capture and management |

| US11539876B2 (en) | 2021-04-30 | 2022-12-27 | Apple Inc. | User interfaces for altering visual media |

| US11778339B2 (en) | 2021-04-30 | 2023-10-03 | Apple Inc. | User interfaces for altering visual media |

Family Cites Families (36)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP0330455A3 (en) | 1988-02-22 | 1990-07-04 | Kabushiki Kaisha Toshiba | Image encoding apparatus |

| US5742329A (en) * | 1992-10-26 | 1998-04-21 | Canon Kabushiki Kaisha | Image pickup system and communication system for use in video conference system or the like |

| KR100276681B1 (ko) * | 1992-11-07 | 2001-01-15 | 이데이 노부유끼 | 비디오 카메라 시스템 |

| CN1039274C (zh) * | 1993-05-20 | 1998-07-22 | 株式会社金星社 | 电视摄象机中的变焦跟踪装置和跟踪方法 |

| US6088156A (en) * | 1993-06-28 | 2000-07-11 | Olympus Optical Co., Ltd. | Finder optical system |

| US6714665B1 (en) * | 1994-09-02 | 2004-03-30 | Sarnoff Corporation | Fully automated iris recognition system utilizing wide and narrow fields of view |

| DE19511713A1 (de) * | 1995-03-30 | 1996-10-10 | C Vis Computer Vision Und Auto | Verfahren und Vorrichtung zur automatischen Bildaufnahme von Gesichtern |

| DE19600958A1 (de) * | 1995-07-20 | 1997-01-23 | Fraunhofer Ges Forschung | Interaktives Überwachungssystem |

| JPH1051755A (ja) * | 1996-05-30 | 1998-02-20 | Fujitsu Ltd | テレビ会議端末の画面表示制御装置 |

| AUPO960197A0 (en) * | 1997-10-03 | 1997-10-30 | Canon Information Systems Research Australia Pty Ltd | Multi-media editing method and apparatus |

| US7630006B2 (en) * | 1997-10-09 | 2009-12-08 | Fotonation Ireland Limited | Detecting red eye filter and apparatus using meta-data |

| JPH11331827A (ja) * | 1998-05-12 | 1999-11-30 | Fujitsu Ltd | テレビカメラ装置 |

| US6593956B1 (en) * | 1998-05-15 | 2003-07-15 | Polycom, Inc. | Locating an audio source |

| WO2000016243A1 (en) * | 1998-09-10 | 2000-03-23 | Mate - Media Access Technologies Ltd. | Method of face indexing for efficient browsing and searching ofp eople in video |

| US6606398B2 (en) * | 1998-09-30 | 2003-08-12 | Intel Corporation | Automatic cataloging of people in digital photographs |

| US6408301B1 (en) * | 1999-02-23 | 2002-06-18 | Eastman Kodak Company | Interactive image storage, indexing and retrieval system |

| US6774917B1 (en) * | 1999-03-11 | 2004-08-10 | Fuji Xerox Co., Ltd. | Methods and apparatuses for interactive similarity searching, retrieval, and browsing of video |

| GB2359918A (en) * | 2000-03-01 | 2001-09-05 | Sony Uk Ltd | Audio and/or video generation apparatus having a metadata generator |

| AUPQ464099A0 (en) * | 1999-12-14 | 2000-01-13 | Canon Kabushiki Kaisha | Emotive editing system |

| GB2361097A (en) * | 2000-04-05 | 2001-10-10 | Sony Uk Ltd | A system for generating audio/video productions |

| US8296801B2 (en) * | 2000-04-10 | 2012-10-23 | Sony Corporation | Asset management system and asset management method |

| EP1158786A3 (en) | 2000-05-24 | 2005-03-09 | Sony Corporation | Transmission of the region of interest of an image |

| US20010055058A1 (en) * | 2000-06-08 | 2001-12-27 | Rajko Milovanovic | Method and system for video telephony |

| JP2001357404A (ja) * | 2000-06-14 | 2001-12-26 | Minolta Co Ltd | 画像抽出装置 |

| JP4469476B2 (ja) * | 2000-08-09 | 2010-05-26 | パナソニック株式会社 | 眼位置検出方法および眼位置検出装置 |

| JP3784289B2 (ja) * | 2000-09-12 | 2006-06-07 | 松下電器産業株式会社 | メディア編集方法及びその装置 |

| US6680745B2 (en) * | 2000-11-10 | 2004-01-20 | Perceptive Network Technologies, Inc. | Videoconferencing method with tracking of face and dynamic bandwidth allocation |

| US7088860B2 (en) * | 2001-03-28 | 2006-08-08 | Canon Kabushiki Kaisha | Dynamically reconfigurable signal processing circuit, pattern recognition apparatus, and image processing apparatus |

| JP4986346B2 (ja) * | 2001-08-09 | 2012-07-25 | パナソニック株式会社 | 撮像装置のレンズ駆動方法及び撮像装置並びにカメラシステム |

| TW530498B (en) * | 2001-08-14 | 2003-05-01 | Nat Univ Chung Cheng | Object segmentation method using MPEG-7 |

| US6606458B2 (en) * | 2001-09-05 | 2003-08-12 | Nisca Corporation | Automatic framing camera |

| US6879709B2 (en) * | 2002-01-17 | 2005-04-12 | International Business Machines Corporation | System and method for automatically detecting neutral expressionless faces in digital images |

| US20030161506A1 (en) * | 2002-02-25 | 2003-08-28 | Eastman Kodak Company | Face detection computer program product for redeye correction |

| US7206435B2 (en) * | 2002-03-26 | 2007-04-17 | Honda Giken Kogyo Kabushiki Kaisha | Real-time eye detection and tracking under various light conditions |

| US7233684B2 (en) * | 2002-11-25 | 2007-06-19 | Eastman Kodak Company | Imaging method and system using affective information |

| US7319780B2 (en) * | 2002-11-25 | 2008-01-15 | Eastman Kodak Company | Imaging method and system for health monitoring and personal security |

-

2002

- 2002-11-29 GB GB0227915A patent/GB2395853A/en not_active Withdrawn

-

2003

- 2003-11-28 WO PCT/GB2003/005224 patent/WO2004051981A2/en active Application Filing

- 2003-11-28 EP EP03812217A patent/EP1570649A2/en not_active Withdrawn

- 2003-11-28 US US10/537,275 patent/US8384791B2/en not_active Expired - Fee Related

- 2003-11-28 JP JP2004556510A patent/JP2006508601A/ja active Pending

Cited By (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2006508463A (ja) * | 2002-11-29 | 2006-03-09 | ソニー・ユナイテッド・キングダム・リミテッド | 顔検出 |

| JP2008078713A (ja) * | 2006-09-19 | 2008-04-03 | Sony Corp | 記録装置および方法、プログラム、並びに再生装置および方法 |

| US8762659B2 (en) | 2006-09-19 | 2014-06-24 | Sony Corporation | Storage apparatus and method, program, and playback apparatus and method |

| JP2010517488A (ja) * | 2007-01-30 | 2010-05-20 | ファーガソン パテント プロパティーズ リミテッド ライアビリティ カンパニー | 画像捕獲表示システム、ビデオ画像内の関心領域を用いてシステム同期型輝度制御を実行する方法、およびメタデータの使用 |

| JP2017151972A (ja) * | 2012-09-05 | 2017-08-31 | インテル・コーポレーション | プラットフォーム及びイメージデバイスの間の通信プロトコル |

| JP2020115350A (ja) * | 2012-09-05 | 2020-07-30 | インテル・コーポレーション | プラットフォーム及びイメージデバイスの間の通信プロトコル |

| JP7149031B2 (ja) | 2012-09-05 | 2022-10-06 | インテル・コーポレーション | プラットフォーム及びイメージデバイスの間の通信プロトコル |

| KR101484001B1 (ko) | 2013-11-20 | 2015-01-20 | (주)나노인사이드 | 지역 미세 패턴을 이용한 얼굴 영상 분석 방법 |

Also Published As

| Publication number | Publication date |

|---|---|

| WO2004051981A3 (en) | 2005-07-07 |

| EP1570649A2 (en) | 2005-09-07 |

| GB0227915D0 (en) | 2003-01-08 |

| WO2004051981A2 (en) | 2004-06-17 |

| US8384791B2 (en) | 2013-02-26 |

| US20060170791A1 (en) | 2006-08-03 |

| GB2395853A (en) | 2004-06-02 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP4381310B2 (ja) | メディア処理システム | |

| JP2006508601A (ja) | ビデオカメラ | |

| JP2006508601A5 (ja) | ||

| JP2006508463A (ja) | 顔検出 | |

| JP2006508461A (ja) | 顔検出及び顔追跡 | |

| US7336830B2 (en) | Face detection | |

| JP2006508462A (ja) | 顔検出 | |

| US7630561B2 (en) | Image processing | |

| US7636453B2 (en) | Object detection | |

| JP2004199669A (ja) | 顔検出 | |

| US20080013837A1 (en) | Image Comparison | |

| US7522772B2 (en) | Object detection | |

| JP2005190477A (ja) | オブジェクト検出 | |

| JP2005174353A (ja) | オブジェクト検出 | |

| GB2414613A (en) | Modifying pixels in dependence on surrounding test region |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20061128 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20061128 |

|

| RD03 | Notification of appointment of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7423 Effective date: 20080418 |

|

| RD04 | Notification of resignation of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7424 Effective date: 20080424 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20090407 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20091006 |