CN116419827A - 机器人控制装置以及机器人系统 - Google Patents

机器人控制装置以及机器人系统 Download PDFInfo

- Publication number

- CN116419827A CN116419827A CN202180072428.5A CN202180072428A CN116419827A CN 116419827 A CN116419827 A CN 116419827A CN 202180072428 A CN202180072428 A CN 202180072428A CN 116419827 A CN116419827 A CN 116419827A

- Authority

- CN

- China

- Prior art keywords

- robot

- image

- control

- coordinate system

- control device

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Programme-controlled manipulators

- B25J9/16—Programme controls

- B25J9/1628—Programme controls characterised by the control loop

- B25J9/1633—Programme controls characterised by the control loop compliant, force, torque control, e.g. combined with position control

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J13/00—Controls for manipulators

- B25J13/08—Controls for manipulators by means of sensing devices, e.g. viewing or touching devices

- B25J13/085—Force or torque sensors

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Programme-controlled manipulators

- B25J9/16—Programme controls

- B25J9/1679—Programme controls characterised by the tasks executed

- B25J9/1687—Assembly, peg and hole, palletising, straight line, weaving pattern movement

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Programme-controlled manipulators

- B25J9/16—Programme controls

- B25J9/1694—Programme controls characterised by use of sensors other than normal servo-feedback from position, speed or acceleration sensors, perception control, multi-sensor controlled systems, sensor fusion

- B25J9/1697—Vision controlled systems

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

- G06T7/74—Determining position or orientation of objects or cameras using feature-based methods involving reference images or patches

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Programme-controlled manipulators

- B25J9/16—Programme controls

- B25J9/1656—Programme controls characterised by programming, planning systems for manipulators

- B25J9/1658—Programme controls characterised by programming, planning systems for manipulators characterised by programming language

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B2219/00—Program-control systems

- G05B2219/30—Nc systems

- G05B2219/40—Robotics, robotics mapping to robotics vision

- G05B2219/40032—Peg and hole insertion, mating and joining, remote center compliance

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B2219/00—Program-control systems

- G05B2219/30—Nc systems

- G05B2219/40—Robotics, robotics mapping to robotics vision

- G05B2219/40099—Graphical user interface for robotics, visual robot user interface

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20092—Interactive image processing based on input by user

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30108—Industrial image inspection

- G06T2207/30164—Workpiece; Machine component

Landscapes

- Engineering & Computer Science (AREA)

- Robotics (AREA)

- Mechanical Engineering (AREA)

- Human Computer Interaction (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Manipulator (AREA)

Abstract

本发明提供一种能够使用于控制机器人的动作的控制中心的设定作业变得容易的机器人控制装置。一种机器人控制装置,其对搭载有末端执行器的机器人机械手(10)进行控制,该机器人控制装置具备:图像处理部,其使用用于进行机器人机械手的图像检测的特征提取模型和机器人机械手(10)的位置以及姿势信息,从拍到机器人机械手(10)的至少一部分的图像(M1、M2)中,检测出与在图像上指定的指定位置(P1、P2)对应的3维空间内的位置作为相对于机器人机械手(10)的相对位置;以及坐标系决定部,其将用于控制机器人机械手的动作的控制中心(101)设定为在3维空间内检测出的位置。

Description

技术领域

本发明涉及机器人控制装置以及机器人系统。

背景技术

在构筑使在臂前端部搭载有作为末端执行器的工具的机器人机械手执行规定的作业的机器人系统的情况下,需要设定工具坐标系等用于控制机器人机械手的动作的坐标系(例如,参照专利文献1)。

在设定工具坐标系的情况下,用户需要进行使机器人机械手从几个方向采取姿势的操作,以使工具的控制中心(一般为工具前端点)与基准位置一致。这样的操作有时被称为“修饰(touch up)”。例如,专利文献2记载了基于修饰的坐标系的设定。

现有技术文献

专利文献

专利文献1:日本特开2015-62991号公报

专利文献2:日本特开平3-251378号公报

发明内容

发明所要解决的课题

如上所述的修饰是复杂且需要时间的作业,对于不特别熟悉的初学者来说,成为容易引起错误的作业。期望能够使用于控制机器人的动作的控制中心的设定作业变得容易的机器人控制装置以及机器人系统。

用于解决课题的手段

本公开的一个方式是一种机器人控制装置,其对搭载有末端执行器的机器人机械手进行控制,该机器人控制装置具备:图像处理部,其使用用于进行所述机器人机械手的图像检测的特征提取模型和所述机器人机械手的位置以及姿势信息,从拍摄到所述机器人机械手的至少一部分的图像中,检测出与在所述图像上指定的指定位置对应的3维空间内的位置作为相对于所述机器人机械手的相对位置;以及坐标系决定部,其将用于控制所述机器人机械手的动作的控制中心设定为在所述3维空间内检测到的所述位置。

本公开的另一方式是一种机器人系统,其具备:机器人机械手,其搭载有末端执行器;机器人控制装置,其控制所述机器人机械手;示教操作装置,其与所述机器人控制装置连接,且具备拍摄装置;存储部,其存储用于进行所述机器人机械手的图像检测的特征提取模型;图像处理部,其使用所述特征提取模型和所述机器人机械手的位置以及姿势信息,根据由所述拍摄装置拍摄到的图像即拍摄到所述机器人机械手的至少一部分的图像,检测出与在所述图像上指定的指定位置对应的3维空间内的位置作为相对于所述机器人机械手的相对位置;以及坐标系决定部,其将用于控制所述机器人机械手的动作的控制中心设定为在所述3维空间内检测到的所述位置。

发明效果

根据上述结构,能够使用于控制机器人的动作的控制中心的设定变得容易。

根据附图所示的本发明的典型的实施方式的详细说明,本发明的这些目的、特征和优点以及其他目的、特征和优点将变得更加明确。

附图说明

图1是表示一实施方式的机器人系统的设备结构的图。

图2是表示机器人控制装置以及示教操作装置的功能结构的框图。

图3是表示控制中心以及坐标系设定处理的流程的流程图。

图4是表示包含检测标记的拍摄图像的例子的图。

图5是用于说明2个拍摄图像相对于臂前端部的拍摄方向的例子的图。

图6是用于说明平行移动凸缘坐标系来设定工具坐标系的状态的图。

图7是表示在图案匹配等中使用的拍摄图像的例子的图。

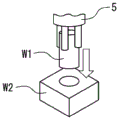

图8是表示利用机器人机械手进行圆柱嵌合的状态的图。

图9是表示对不同长度的嵌合工件分别设定了控制中心的状态的图。

图10是表示在凸缘与手之间配置有力传感器的状态的图。

图11是表示力控制的按压方向的设定操作的第一例的图。

图12是表示力控制的按压方向的设定操作的第二例的图。

图13是表示指定能够基于力控制进行动作的区域的操作的图。

图14是用于说明对多个卡盘手成为一体的手设定工具坐标系的情况的图。

具体实施方式

接下来,参照附图对本公开的实施方式进行说明。在参照的附图中,对相同的结构部分或功能部分标注相同的参照符号。为了容易理解,这些附图适当变更了比例尺。另外,附图所示的方式是用于实施本发明的一个例子,本发明并不限定于图示的方式。

图1是表示一实施方式的机器人系统100的设备结构的图。如图1所示,机器人系统100具备:搭载有作为末端执行器的手5的机器人机械手10(以下,记载为机器人10);控制机器人10的机器人控制装置20;以及与机器人控制装置20连接的示教操作装置30。示教操作装置30与机器人控制装置20的连接可以通过有线通信进行,也可以通过无线通信进行。

机器人10在本实施方式中设为6轴的垂直多关节机器人,但也可以使用其他类型的机器人。手5安装于机器人10的臂前端的凸缘面。

机器人控制装置20按照来自示教操作装置30的操作输入,或者按照存储在机器人控制装置20内的动作程序来控制机器人10的动作。此外,机器人控制装置20也可以具有作为具有CPU、ROM、RAM、存储装置、操作部、显示部、输入输出接口、网络接口等的一般的计算机的结构。

示教操作装置30具有进行针对机器人10的示教操作、与示教相关的各种设定的功能等。在图1中,使用平板型终端作为示教操作装置30,但作为示教操作装置30,能够使用示教操作盘、智能手机和其他各种可移动型的终端。此外,示教操作装置30也可以具有作为具有CPU、ROM、RAM、存储装置、操作部、显示部、输入输出接口、网络接口等的一般的计算机的结构。

本实施方式的示教操作装置30还具备作为拍摄装置的照相机34(参照图2)。如以下详细说明的那样,本实施方式的机器人控制装置20提供如下功能:使用示教操作装置30的照相机34以包含机器人10的一部分(例如工具前端部)的方式拍摄到的图像,设定成为机器人10的动作的控制对象的控制中心、坐标系(工具坐标系、力控制坐标系等)。

图2是表示机器人控制装置20以及示教操作装置30的功能结构的框图。如图2所示,机器人控制装置20具备动作控制部21、图像处理部22以及坐标系决定部23。另外,机器人控制装置20在存储部内存储有特征提取模型24。动作控制部21执行机器人10的动作控制。更具体而言,动作控制部21解释动作命令而算出针对机器人10的各轴马达的位置指令,根据位置指令执行各轴马达的伺服控制,由此执行机器人10的控制中心(例如,工具前端点)的位置控制。动作控制部21还可以具有进行手5的开闭动作的控制的功能。图像处理部22使用用于进行机器人10的图像检测的特征提取模型24和机器人10的位置以及姿势信息,从拍到机器人10的至少一部分的图像中,检测与在图像上指定的指定位置对应的3维空间内的位置作为相对于机器人10的相对位置。坐标系决定部23将用于控制机器人10的动作的控制中心设定为在3维空间内检测出的位置。

机器人10还可以为了执行力控制而搭载力传感器3。在图2中,示出了在机器人10搭载检测施加于臂前端的外力的力传感器3的情况下的结构例。例如如图10所示,力传感器3配置在手5与凸缘11之间。在机器人10是搭载力传感器3的结构的情况下,动作控制部21还具备执行使用力传感器3的力控制的力控制部25。

示教操作装置30具有:控制部31,其负责示教输入操作、各种设定功能的控制;显示部32,其显示与示教输入操作、各种设定功能相关的操作画面;以及操作部33,其用于进行各种输入操作。显示部32例如具有液晶显示器作为显示装置。作为一个例子,操作部33也可以由使用了触摸面板的软件键构成。示教操作装置30还具有照相机34作为拍摄装置。照相机例如可以是拍摄2维图像的二维照相机,也可以是例如通过立体法取得对象物的3维位置的3维照相机。由照相机34拍摄到的图像显示于显示部32。如后所述,用户通过在使用示教操作装置30的照相机34拍摄机器人10而得到的图像上指定控制中心的位置,能够进行用于控制机器人10的动作的控制中心以及坐标系的设定。示教操作装置30在来自机器人控制装置20的图像处理部22的控制下进行动作,在使拍摄图像显示在显示部32上之后,经由操作部33接受上述那样的指定操作。

接着,对用户在由示教操作装置30的照相机34拍摄到的图像上指定控制中心来设定控制中心以及坐标系的功能(以下,记载为控制中心以及坐标系设定处理)进行说明。图3是表示控制中心以及坐标系设定处理的流程的流程图。此外,控制中心以及坐标系设定处理主要在机器人控制装置20的CPU的控制下执行,示教操作装置30被用作用于由用户进行各种操作输入的操作终端。

首先,用户从不同的方向拍摄2张拍摄有机器人10的一部分(或检测标记)的图像(步骤S1)。将拍摄到的2张图像称为照相机图像M1、照相机图像M2。照相机图像M1例如是图4所示的图像。在图4的照相机图像M1的例子中,拍摄粘贴有3个检测标记C1-C3的机器人臂前端部、凸缘11以及手5。另外,照相机图像M2是从其他角度拍摄照相机图像M1的拍摄对象物而得到的图像。

照相机图像M1、照相机图像M2相对于作为拍摄对象的臂前端部的拍摄方向例如如图5所示。用户在照相机图像M1、照相机图像M2中分别指定想要作为用于进行机器人10的动作的控制的控制中心的位置(步骤S2)。作为用户在图像上指定位置的操作,可以有在触摸面板上进行点击(tap)的操作、操作其他指示设备来进行指定的例子。在此,如图5所示,用户指定手5的多个握持爪的中心位置作为想要作为控制中心的位置。在该情况下,用户在照相机图像M1、M2中分别指定手5的握持爪的中心位置。图像处理部22经由示教操作装置30接受这样的指定操作。将在照相机图像M1、M2上用户指定为手5的多个握持爪的前端的中心的位置分别设为指定位置P1、指定位置P2。

接着,图像处理部22使用用于提取机器人10的图像上的特征的特征提取模型24(检测标记、或者机器人10的3D模型),通过图像处理,检测3维空间内的指定位置与机器人10的相对位置(步骤S3)。在此,如图4所示,记载了在机器人10的臂前端部存在检测标记C1-C3的情况的例子。在该情况下,作为特征提取模型24,使用与检测标记C1-C3的图像的特征以及配置有关的信息。根据观察机器人10的角度,3个检测标记C1-C3的观察方式、观察的检测标记不同。图像处理部22通过对照相机图像M1、M2分别进行图像处理来检测3个检测标记C1-C3,并且通过解析3个检测标记C1-C3的外观来确定照相机图像M1、M2分别从凸缘11观察是从哪个方向拍摄到的。而且,在各图像上存在多个检测标记C1-C3,多个检测标记C1-C3之间的间隔根据特征提取模型24是已知的,因此图像处理部22能够获知图像的比例(scale)(即,图像上的大小与实际的尺寸的对应)。

通过上述图像处理,图像处理部22针对照相机图像M1、M2分别掌握相对于凸缘11的拍摄方向是图5所示的方向。此外,此时,图像处理部22还利用机器人10的当前的位置/姿势信息。在此,从1张照相机图像可知,图像上的指定位置在3维空间内存在于轴线上。在图5中,将与通过对照相机图像M1的图像处理而确定的、在3维空间内可能存在与指定位置P1对应的位置的轴线表示为轴线L1,将通过对照相机图像M2的图像处理而确定的、在3维空间内可能存在与指定位置P2对应的位置的轴线表示为轴线L2。即,指定位置P1在3维空间内位于轴线L1上,指定位置P2在3维空间内位于轴线L2上。在该情况下,轴线L1与轴线L2的交点101是用户指定的控制中心在3维空间内的位置。图像处理部22确定该交点101的位置。通过以上,求出与图像上的指定位置对应的3维空间内的位置(以机器人10为基准的相对位置)(步骤S3)。

如图6所示,针对机器人10,预先设定在凸缘面的中心位置具有原点的凸缘坐标系111。在步骤S4中,坐标系决定部23使已知的凸缘坐标系111的原点平行移动到在步骤S3中确定的控制中心(交点101)(平移)来设定工具坐标系112。

接下来,对作为特征提取模型24使用机器人10的3D模型并通过图案匹配来求出图像上的指定位置与机器人10的相对位置的方法进行说明。在该情况下,也与使用检测标记的情况同样地,使用户从不同的方向拍摄2张包含机器人10的一部分的图像(步骤S1)。在此,拍摄的图像之一是图7所示那样的包含臂前端侧的2个连杆及手5的照相机图像M3。在该情况下,另一个图像成为从不同角度对图7中的拍摄对象物进行拍摄而得到的图像。

用户在各个图像上指定想要作为控制中心的位置(步骤S2)。接着,图像处理部22求出各个图像中的指定位置与机器人10的相对位置(步骤S3)。具体地进行说明。在拍摄到的图像是图7所示那样的图像的情况下,图像处理部22使用机器人10的3D模型中的臂前端部的模型(以下,记为机器人模型)来进行图像检测。例如,图像处理部22也可以通过使用臂前端部的平坦部、凸部、凹部的形状、配置的信息,应用面部认证的技术,来确定映现在图像中的臂前端部的姿势,基于机器人10的当前的位置/姿势信息来确定图像的拍摄方向。或者,图像处理部22也可以通过边缘检测法从图像提取轮廓,在与机器人模型的轮廓(臂前端部的轮廓)之间执行图案匹配,确定映射在图像中的臂前端部的姿势,基于机器人10的当前的位置/姿势信息来确定图像的拍摄方向。

然后,作为根据2张图像求出的拍摄方向的轴线的交点,确定指定位置在3维空间内的位置(即,求出指定位置与机器人10的相对位置)(步骤S3)。接着,坐标系决定部23通过使凸缘坐标系平行移动到所确定的控制中心(交点)来设定工具坐标系(步骤S4)。

根据以上叙述的控制中心以及坐标系设定处理,用户通过示教操作装置30的照相机34进行拍摄机器人10的操作,仅通过进行在图像上指定想要作为控制中心的位置的操作,就能够完成控制中心以及坐标系的设定。即,能够使控制中心以及坐标系的设定操作变得容易。关于照相机34,不需要进行校准等复杂的作业。

另外,也可以拍摄3张以上的图像,根据通过与上述同样的方法从3张以上的图像得到的拍摄方向的轴线的交点求出控制中心。

以上是根据2张以上的图像来确定控制中心的情况的例子,但也能够根据1张图像来确定控制中心。对根据用户拍摄到的1张图像来确定控制中心在3维空间内的位置(相对于机器人10的相对位置)的例子进行说明。按照以下的顺序进行。

(A1)用户在从正侧面(沿着凸缘坐标系的Y轴方向)拍摄机器人10的臂前端部这样的限制下进行拍摄。

(A2)在这样的限制下拍摄到的图像上,用户指定想要作为控制中心的位置。另外,在该情况下,如图6所示,拍摄与凸缘坐标系111的XZ平面平行的图像。

(A3)图像处理部22根据图像中映出的检测标记的间隔来识别图像的比例,以图像内的凸缘中心(凸缘坐标系的原点)为基准,将图像上的指定位置识别为X、Z坐标位置。

(A4)由此,将与图像上的指定位置对应的3维空间上的位置确定为凸缘坐标系的X、Z坐标位置。

或者,作为从1张图像确定控制中心的方法,也可以使用如下的方法。在该情况下,以在凸缘坐标系的中心轴线上(即,Z轴上)设定控制对象的坐标系为前提。用户拍摄包含凸缘11的图像。关于拍摄图像的方向,如上述步骤(A1)那样从正侧面进行拍摄在操作上是优选的,但也可以不特别限制拍摄方向。图像处理部22接受在包含机器人10的凸缘11的部分的图像上,使凸缘坐标系在Z轴方向上移动的操作(例如,触摸以及滑动操作)。在该情况下,图像处理部22也可以在图像上重叠显示表示凸缘坐标系的图像。图像处理部22确定基于用户操作产生的凸缘坐标系在Z轴上的偏移量。

坐标系决定部23使凸缘坐标系平行移动到这样确定的控制中心的位置,设定工具坐标系。

这样,即使在使用1张图像的情况下,用户也仅通过进行在图像上指定想要作为控制中心的位置的操作,就能够完成控制中心以及坐标系的设定。关于照相机34,不需要进行校准等复杂的作业。

以上,对用户在拍摄图像上指定想要作为控制中心的位置的情况的例子进行了说明。在拍摄图像上的控制中心位置的指定也可以在机器人控制装置20(图像处理部22)侧自动地进行。例如,也可以采用如下方法:(1)将拍摄图像上的规定的位置(例如中心位置)设为指定位置;(2)在示教操作装置30搭载检测照相机34在3维空间内的位置的传感器(加速度传感器、陀螺仪传感器等),将设定图5的轴线L1、L2的情况下的起点(指定位置P1、P2)设为由传感器检测到的位置(在该情况下,示教操作装置30将拍摄图像和拍摄到该图像时的照相机34的位置信息提供给机器人控制装置20)。

接着,作为如上述那样进行设定控制中心的作业的情况下的具体例,对圆柱嵌合进行说明。圆柱嵌合是指,如图8所示,将由手5握持的圆柱状的工件W1插入到形成于工件W2的孔中的作业。在此,设想在将工件W1插入到孔的情况下,在工件W1的外表面与孔的内表面之间存在充分的间隙,不需要进行基于力控制的插入的情况。在该情况下,用户在工件W1的前端面的中心设定控制中心,设定以该控制中心为原点的工具坐标系。机器人控制装置20控制机器人10,以使工具坐标系的原点(控制中心)沿着孔的中心轴线移动而使工件W1移动直至到达孔的底部。

在使手5握持的圆柱状的工件的长度存在种类的情况下,用户对各个长度的工件设定控制中心(工具坐标系)。在9中示出了对长度分别不同的3种工件W11、W12、W13分别设定了控制中心201、202、203的状况。对各个控制中心201-203分别设定以铅垂下方为Z轴方向的工具坐标系(作为参考,参照图12的力控制坐标系113)。

接着,关于一边执行力控制一边进行的作业,说明通过在图像上指定与力控制有关的参数来进行设定的例子。在将嵌合工件插入到孔的状态下嵌合工件外表面与孔的内表面的间隙狭窄的情况下(例如,间隙为十几微米的情况下),嵌合工件以与孔的内表面始终接触的状态被插入。在该情况下,一边观察与嵌合工件相关的力,一边修正机器人10的姿势,同时进行插入嵌合工件的插入作业。在该情况下,如图10所示,构成为在手5与凸缘11之间配置力传感器3。力传感器3例如是将3轴(XYZ)的载荷和绕各轴的力矩作为检测值而输出的6轴力传感器。力传感器3检测在嵌合作业时施加于嵌合工件W21的力以及力矩。机器人控制装置20(动作控制部21以及力控制部25)通过观察力传感器3的输出来进行机器人10的位置/姿势的控制,以使得与设定于嵌合工件W21的前端面的中心的控制中心相关的力矩成为零。在进行力控制的情况下,力控制部25将如上述那样设定的控制中心用作力控制的控制点(进行力矩的计算等的基准点)。坐标系决定部23使凸缘坐标系平行移动到该控制点而设定为力控制坐标系(参照图12的力控制坐标系113)。

图像处理部22也可以构成为经由图像接受按压方向的设定作为与力控制相关的参数。对于经由图像设定作为力控制参数的按压方向的例子,参照图11、图12说明2个例子。

如图11所示,在图像M4中显示有机器人10的臂前端侧、力传感器3、手5、嵌合工件W21、工件W22以及由用户设定的控制中心204。在这样的图像M4中,图像处理部22为了辅助由用户进行的力控制的按压方向的设定,例如将沿着Z轴方向(铅垂下方)的箭头71显示为图像。在箭头71与期望的按压方向一致的情况下,用户例如能够点击并选择箭头71的图像。图像处理部22接受由用户进行的这样的选择操作。图像处理部22也可以在图像M4上显示X、Y、Z方向的3个箭头的图像,使用户选择所期望的按压方向。

如图12所示,在图像M5中显示有机器人10的臂前端侧、力传感器3、手5、嵌合工件W21、工件W22以及由用户设定的控制中心204。图像处理部22接受在这样的图像M5上用户通过轻拂(flick)操作指定按压方向、或者在图像上徒手描绘按压方向(在图12中为箭头72)的操作。然后,图像处理部22选择设定于嵌合工件W21的前端的力控制坐标系113的各轴中的、与轻拂操作的方向或者作为图像描绘的箭头72的方向最接近的轴的方向作为按压方向。在图12的例子的情况下,选择Z轴方向作为按压方向。

关于如以上记载那样确定的按压方向,力控制部25执行力控制。

接着,作为力控制的参数指定的其他例子,参照图13对能够执行力控制的深度方向(在此为Z轴方向)的范围的设定例进行说明。图13是说明图像处理部22在图像上进行能够执行力控制的深度方向的范围(工具的行进方向的范围)的设定作为与力控制相关的参数的例子的图。在图13所示的图像M6中,显示有机器人10的臂前端侧、力传感器3、手5、嵌合工件W21、工件W22、以及由用户设定的控制中心204。图像处理部22在这样的图像M6上,接受用户通过例如徒手描绘矩形框的图像(在图13中为矩形框73)来设定能够进行基于力控制的动作的深度方向(Z轴方向)的范围的操作。机器人控制装置20的力控制部25在控制中心(控制点)204在Z轴方向上处于矩形框73的范围内的情况下应用力控制。此外,该矩形框的指定也能够表现为能够执行力控制的区域的指定。

接着,对针对图14所示那样的多个卡盘手成为一体的手设定工具坐标系的情况的例子进行说明。图14所示的手150具备多个卡盘手151-153。卡盘手151、152、153分别握持工件W31、W32、W33。通过上述的方法,对工件W31-W33分别设定控制中心211、212、213。按照如下的顺序设定工具坐标系。在此,作为照相机34,使用能够检测对象物的3维位置的3D照相机。

(B1)图像处理部22根据包含手150的图像,对工件W31、W32、W33分别检测作为工件前端面的平面。作为通过图像处理来检测平面的方法,例如能够使用基于3维霍夫变换的平面检测法。由此,分别检测工件W31、W32、W33的前端面W31a、W32a、W33a。

(B2)接着,坐标系决定部23求出各前端面W31a、W32a、W33a相对于凸缘坐标系的Z方向的法线方向的旋转矩阵。然后,针对凸缘坐标系,坐标系决定部23将其原点分别平行移动到控制中心211、212、213,并且进行乘以针对各个前端面求出的旋转矩阵的操作,从而针对各个控制中心211、212、213设定工具坐标系。

此外,在根据拍摄有手150的图像已知拍摄方向、比例的状况下,坐标系决定部23也可以在通过上述(B1)检测出的工件前端面上的点(例如中心)设定工具坐标系的原点,自动地设定工具坐标系以使该工件前端面的法线方向与工具坐标系的Z轴方向一致。

如以上说明的那样,根据本实施方式,能够使用于控制机器人的动作的控制中心的设定变得容易。

以上,使用典型的实施方式说明了本发明,但只要是本领域技术人员,就能够理解在不脱离本发明的范围的情况下,能够对上述的各实施方式进行变更以及各种其他变更、省略、追加。

在上述的实施方式中,图2的框图所示的机器人系统内的功能的分配是一个例子,能够进行各种变形。例如,也可以有将图像处理部22的功能配置于示教操作装置30侧的结构例。

图2所示的机器人控制装置20的功能框图中的各功能块可以通过机器人控制装置20的CPU执行存储于存储装置的各种软件来实现,或者也可以通过以ASIC(ApplicationSpecific Integrated Circuit:专用集成电路)等硬件为主体的结构来实现。

执行上述的实施方式中的控制中心以及坐标系设定处理的程序能够记录于计算机可读取的各种记录介质(例如,ROM、EEPROM、闪存等半导体存储器、磁记录介质、CD-ROM、DVD-ROM等光盘)。

符号说明

3力传感器

5、150手

10机器人机械手

11凸缘

20机器人控制装置

21动作控制部

22图像处理部

23坐标系决定部

24特征提取模型

25力控制部

30示教操作装置

31控制部

32显示部

33操作部

34照相机

100机器人系统

C1、C2、C3检测标记。

Claims (12)

1.一种机器人控制装置,其对搭载有末端执行器的机器人机械手进行控制,其特征在于,所述机器人控制装置具备:

图像处理部,其使用用于进行所述机器人机械手的图像检测的特征提取模型和所述机器人机械手的位置以及姿势信息,从拍摄到所述机器人机械手的至少一部分的图像中,检测出与在所述图像上指定的指定位置对应的3维空间内的位置作为相对于所述机器人机械手的相对位置;以及

坐标系决定部,其将用于控制所述机器人机械手的动作的控制中心设定为在所述3维空间内检测到的所述位置。

2.根据权利要求1所述的机器人控制装置,其特征在于,

所述图像处理部使用拍摄有所述机器人机械手的至少一部分的图像、即从不同的方向拍摄所述机器人机械手的至少一部分而得到的2张以上的图像,检测与由该2张以上的图像分别指定的指定位置对应的所述3维空间内的位置。

3.根据权利要求1或2所述的机器人控制装置,其特征在于,

所述图像处理部接受在所述图像上基于用户操作的所述指定位置的指定。

4.根据权利要求1或2所述的机器人控制装置,其特征在于,

所述图像处理部自动地将所述指定位置设定为所述图像内的规定的位置。

5.根据权利要求1至4中的任一项所述的机器人控制装置,其特征在于,

所述机器人控制装置还具备用于执行力控制的力控制部,

所述力控制部将所述控制中心设定为进行所述力控制的控制点。

6.根据权利要求5所述的机器人控制装置,其特征在于,

所述图像处理部接受在所述图像上指定所述力控制的按压方向的操作。

7.根据权利要求5或6所述的机器人控制装置,其特征在于,

所述图像处理部接受在所述图像上指定能够执行所述力控制的区域的操作。

8.根据权利要求1至7中的任一项所述的机器人控制装置,其特征在于,

所述坐标系决定部设定以所述控制中心为原点的坐标系。

9.根据权利要求8所述的机器人控制装置,其特征在于,

在所述图像中拍摄有被作为所述末端执行器的手握持的工件,

所述图像处理部从所述图像中检测出所述工件的前端的平面,

所述坐标系决定部以所述平面的法线方向与所述坐标系的规定的轴一致的方式,以所述平面上的点为原点来设定所述坐标系,。

10.一种机器人系统,其特征在于,具备:

机器人机械手,其搭载有末端执行器;

机器人控制装置,其控制所述机器人机械手;

示教操作装置,其与所述机器人控制装置连接,且具备拍摄装置;

存储部,其存储用于进行所述机器人机械手的图像检测的特征提取模型;

图像处理部,其使用所述特征提取模型和所述机器人机械手的位置以及姿势信息,从由所述拍摄装置拍摄到的图像即拍摄到所述机器人机械手的至少一部分的图像中,检测出与在所述图像上指定的指定位置对应的3维空间内的位置作为相对于所述机器人机械手的相对位置;以及

坐标系决定部,其将用于控制所述机器人机械手的动作的控制中心设定为在所述3维空间内检测出的所述位置。

11.根据权利要求10所述的机器人系统,其特征在于,

在所述机器人机械手上搭载有力传感器,

所述机器人系统还具备基于所述力传感器的检测值来执行力控制的力控制部,

所述力控制部将所述控制中心设定为进行所述力控制的控制点。

12.根据权利要求10或11所述的机器人系统,其特征在于,

所述坐标系决定部设定以所述控制中心为原点的坐标系。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2020183920 | 2020-11-02 | ||

| JP2020-183920 | 2020-11-02 | ||

| PCT/JP2021/039711 WO2022092168A1 (ja) | 2020-11-02 | 2021-10-27 | ロボット制御装置及びロボットシステム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| CN116419827A true CN116419827A (zh) | 2023-07-11 |

Family

ID=81382643

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN202180072428.5A Pending CN116419827A (zh) | 2020-11-02 | 2021-10-27 | 机器人控制装置以及机器人系统 |

Country Status (6)

| Country | Link |

|---|---|

| US (1) | US20230321823A1 (zh) |

| JP (1) | JPWO2022092168A1 (zh) |

| CN (1) | CN116419827A (zh) |

| DE (1) | DE112021004632T5 (zh) |

| TW (1) | TW202218836A (zh) |

| WO (1) | WO2022092168A1 (zh) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE102022213568B3 (de) | 2022-12-13 | 2024-02-29 | Kuka Deutschland Gmbh | Kalibrieren einer Steuerung |

Family Cites Families (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH03251378A (ja) | 1990-02-28 | 1991-11-08 | Fanuc Ltd | ロボットのキャリブレーション方式 |

| JP3940998B2 (ja) * | 2002-06-06 | 2007-07-04 | 株式会社安川電機 | ロボット装置 |

| JP3708097B2 (ja) * | 2003-10-08 | 2005-10-19 | ファナック株式会社 | ロボットの手動送り装置 |

| JP6489776B2 (ja) | 2013-08-28 | 2019-03-27 | キヤノン株式会社 | 座標系校正方法、ロボットシステム、プログラム及び記録媒体 |

| JP6787966B2 (ja) * | 2018-10-02 | 2020-11-18 | ファナック株式会社 | 拡張現実と複合現実を用いたロボット制御装置及び表示装置 |

| JP7172466B2 (ja) * | 2018-11-08 | 2022-11-16 | 株式会社Ihi | ツールセンターポイントの設定方法及び設定装置 |

-

2021

- 2021-10-25 TW TW110139494A patent/TW202218836A/zh unknown

- 2021-10-27 CN CN202180072428.5A patent/CN116419827A/zh active Pending

- 2021-10-27 DE DE112021004632.2T patent/DE112021004632T5/de active Pending

- 2021-10-27 US US18/033,211 patent/US20230321823A1/en active Pending

- 2021-10-27 WO PCT/JP2021/039711 patent/WO2022092168A1/ja active Application Filing

- 2021-10-27 JP JP2022559210A patent/JPWO2022092168A1/ja active Pending

Also Published As

| Publication number | Publication date |

|---|---|

| JPWO2022092168A1 (zh) | 2022-05-05 |

| WO2022092168A1 (ja) | 2022-05-05 |

| TW202218836A (zh) | 2022-05-16 |

| US20230321823A1 (en) | 2023-10-12 |

| DE112021004632T5 (de) | 2023-06-29 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN108453701B (zh) | 控制机器人的方法、示教机器人的方法和机器人系统 | |

| JP3946711B2 (ja) | ロボットシステム | |

| JP6126183B2 (ja) | ターゲットマークを撮像するカメラを備えたロボットシステム | |

| US8565515B2 (en) | Three-dimensional recognition result displaying method and three-dimensional visual sensor | |

| JP4021413B2 (ja) | 計測装置 | |

| JP5471355B2 (ja) | 3次元視覚センサ | |

| US6816755B2 (en) | Method and apparatus for single camera 3D vision guided robotics | |

| EP2263837B1 (en) | Operation teaching system and operation teaching method | |

| JP6812095B2 (ja) | 制御方法、プログラム、記録媒体、ロボット装置、及び物品の製造方法 | |

| CN111482959A (zh) | 机器人运动视觉系统的自动手眼标定系统与方法 | |

| CN113379849B (zh) | 基于深度相机的机器人自主识别智能抓取方法及系统 | |

| US20190202058A1 (en) | Method of programming an industrial robot | |

| JPH07311610A (ja) | 視覚センサを用いた座標系設定方法 | |

| JP2005300230A (ja) | 計測装置 | |

| JP2018167334A (ja) | 教示装置および教示方法 | |

| JP2018051634A (ja) | ロボット制御装置、ロボット、ロボットシステムおよび姿勢特定装置 | |

| CN115803155A (zh) | 编程装置 | |

| JP2006026790A (ja) | 教示モデル生成装置 | |

| CN116419827A (zh) | 机器人控制装置以及机器人系统 | |

| CN115397634A (zh) | 取得机器人的控制坐标系中的视觉传感器的位置的装置、机器人系统、方法以及计算机程序 | |

| CN108000499B (zh) | 机器人视觉坐标的编程方法 | |

| JP7112528B2 (ja) | 作業座標作成装置 | |

| WO2019093299A1 (ja) | 位置情報取得装置およびそれを備えたロボット制御装置 | |

| WO2022176928A1 (ja) | 教示装置 | |

| WO2022074998A1 (ja) | 制御装置、ロボットアームシステム及びロボットアーム装置の制御方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination |