JP2004302011A - Device which conducts performance in synchronism with the operating timing of baton - Google Patents

Device which conducts performance in synchronism with the operating timing of baton Download PDFInfo

- Publication number

- JP2004302011A JP2004302011A JP2003093567A JP2003093567A JP2004302011A JP 2004302011 A JP2004302011 A JP 2004302011A JP 2003093567 A JP2003093567 A JP 2003093567A JP 2003093567 A JP2003093567 A JP 2003093567A JP 2004302011 A JP2004302011 A JP 2004302011A

- Authority

- JP

- Japan

- Prior art keywords

- baton

- timing

- sound

- data

- conductor

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Landscapes

- Electrophonic Musical Instruments (AREA)

Abstract

Description

【0001】

【発明の属する技術分野】本発明は、旋律を記述するデータ、例えばMIDI (Musical Instrument Digital Interface) 形式で記述されたデータによって、音源を制御して旋律を演奏もしくは再生する技術に関する。

【0002】

【従来の技術】旋律を記述するデータ、例えばMIDI形式で記述されたデータをコンピュータに入力し、そのデータに従ってコンピュータが音源を制御することによって、音源から旋律を発生させる技術が知られている。このときに、指揮者が意図する演奏速度と音量に調整する技術が特許文献1に記載されている。

特許文献1の技術では、指揮棒の動きから振りの周期と振幅を検出し、周期からテンポ信号を生成し、振幅から音量信号を生成し、生成されたテンポ信号と音量信号を音源制御用コンピュータに入力する。音源制御用コンピュータは、入力したテンポ信号と音量信号と旋律記述データに従って音源を制御するために、指揮者が意図するテンポと音量で旋律が演奏ないし再生される。

【0003】

【特許文献1】

特開平6―301381号公報

【0004】

【発明が解決しようとする課題】指揮者が意図するテンポと音量で旋律が演奏ないし再生されるというだけでは、自然な演奏にならない。

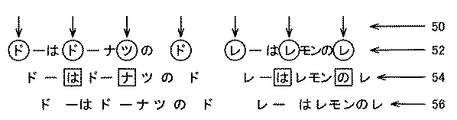

指揮者は指揮棒を振り下ろすタイミングでテンポを指定するのみならず、その振り下ろしタイミングで特定の音が発音されることを意図している。図5に例示する場合、振り下ろしタイミング50にあわせて旋律52が演奏されることを意図している。振り下ろしタイミング50にあわせて旋律54,56等が演奏されるとひどく不自然である。

指揮者が意図するテンポで旋律が演奏されるというだけでは、振り下ろしタイミングと旋律の関係が一意に決定されず、振り下ろしタイミング50にあわせて旋律52,54,56のいずれが演奏されるかは決まらない。旋律52,54,56のいずれでも、指揮者が意図するテンポになっている。

振り下ろしタイミング50にあわせた演奏が保証されるためには、振り降ろしタイミングにあわせて丸印で示す音が発生されるようにする必要があり、例えば四角に示す音が発生しないようにする必要がある。

従来の技術では、指揮者が意図するテンポで旋律が演奏されるというレベルに留まっており、指揮者が指揮棒を振り下ろすタイミングで指揮者が発音されたい音が発音されることが保証されていない。

本発明は、指揮者が意図するテンポで旋律が演奏されるというだけではなく、指揮者が指揮棒を振り下ろすタイミングで発音させたいと意図している音が発音されるようにする演奏技術を実現する。図5の例示の場合であれば、旋律が54,56のようには演奏されず、旋律52が演奏されるようにする演奏技術を実現する。

【0005】

【課題を解決するための手段と作用】本発明で創作された演奏装置は、記憶装置と、演奏制御装置と、タイミング制御装置とを有する。記憶装置は、旋律を記述するデータに、指揮棒が振り下ろされた時に発音させる音を特定する拍データを付加した楽曲データを記憶している。この記憶装置は、楽曲データを記憶したCDROM等のメディアをデータ読出し装置にセットすることで構成することもできるし、ハードディスク等で構成することもできる。演奏制御装置は、記憶装置から楽曲データを読み出し、読み出した楽曲データによって音源を制御するとともに、拍データで特定される音の発音を指示した時に拍タイミング信号を出力する。タイミング制御装置は、演奏制御装置から拍タイミング信号を入力する。また指揮棒の運動を示す信号を入力し、指揮棒が振り下ろされた時を特定し、前回に特定された時と今回に特定された時の時間差から指揮棒の振り周期を特定する。その上で、拍タイミング信号の入力時が指揮棒の振り下ろし時よりも早ければ指揮棒の振り周期を低速化したテンポ信号を演奏制御装置に出力し、拍タイミング信号の入力時が指揮棒の振り下ろし時よりも遅ければ指揮棒の振り周期を高速化したテンポ信号を演奏制御装置に出力する。

演奏制御装置とタイミング制御装置は、別々のコンピュータで構成してもよいし、同一のコンピュータで構成してもよい。また汎用コンピュータに代えて、専用のシーケンサないしプロセッサで構成してもよい。この場合でも、演奏制御装置とタイミング制御装置を別々のシーケンサないしプロセッサで構成してもよいし、同一のシーケンサないしプロセッサで構成してもよい。

【0006】

旋律を記述するデータは、音階と音長のデータは持っているものの、指揮棒が振り下ろされた時に発音する音を特定するデータは有していない。旋律記述データは、図5に例示する場合、旋律52のように演奏(ないし再生)するのか、旋律54のように演奏するのか、あるいは旋律56のように演奏するのかを指定する情報を備えていない。

そこで本発明では、指揮棒が振り下ろされた時に発音する音を特定する拍データを追加する。図5の場合、「ド、ド、ツ、ド、レ、レ、レ」の音を特定する拍データを追加する。これによって、旋律52を演奏すべきことが特定される。不自然ではあるけれども、「は、ナ、は、の」の音を特定するデータを追加することも可能であり、この場合には、旋律54を演奏すべきことが特定される。

電子楽器や演奏アクチュエータ付の楽器等の音源は、演奏制御装置によって制御されて発音する。このときに、演奏制御装置は旋律記述データによって音源を制御することから旋律が演奏(ないし再生)される。演奏制御装置は、拍データで特定された音の発音を指示した時に拍タイミング信号を出力する。先の例でいえば、「ド、ド、ツ、ド、レ、レ、レ」の音が発音されるたびに拍タイミング信号を出力する。

タイミング制御装置は、指揮棒の運動を示す信号(例えば指揮棒の運動を撮影した画像データや、指揮棒に取付けられた加速度センサの出力等)を入力し、指揮棒が振り下ろされた時を特定し、前回に特定された時と今回に特定された時の時間差から指揮棒の振り周期を特定する。即ち、指揮棒の振り下ろしタイミングと指揮者が意図しているテンポを認識する。さらに、タイミング制御装置は「ド、ド、ツ、ド、レ、レ、レ」の音が発音されるたびに拍タイミング信号を入力する。タイミング制御装置は、指揮棒の振り下ろしタイミングと拍タイミング信号の入力タイミングを比較する。拍タイミング信号の入力時が指揮棒の振り下ろし時よりも早ければ、演奏(ないし再生)が指揮者の意図よりも早く進行していることがわかる。この場合、タイミング制御装置は、指揮棒の振り周期から判明する指揮者の意図するテンポを低速化したテンポ信号を演奏制御装置に出力する。この結果、早すぎる演奏(ないし再生)がスローテンポ化され、次の指揮棒の振り下ろし時にあわせて意図する音を発音させられるようになる。逆に、拍タイミング信号の入力時が指揮棒の振り下ろし時よりも遅ければ、演奏(ないし再生)が指揮者の意図よりも遅れていることがわかる。この場合、タイミング制御装置は、指揮棒の振り周期から判明する指揮者の意図するテンポを高速化したテンポ信号を演奏制御装置に出力する。この結果、遅すぎる演奏(ないし再生)がアップテンポ化され、次の指揮棒の振り下ろし時にあわせて意図する音を発音させられるようになる。

上記のようにして、指揮者が意図するテンポで旋律が演奏されるというだけではなく、指揮者が指揮棒を振り下ろすタイミングで発音させたいと意図している音が発音されるように演奏(ないし再生)される。

【0007】

上記の演奏制御装置自体、即ち、指揮棒が振り下ろされた時に発音させる音を特定する拍データを旋律記述データに付加した楽曲データを読み出し、読み出した楽曲データによって音源を制御するとともに、拍データで特定される音の発音を指示した時に拍タイミング信号を出力する装置自体が本発明で創作された装置である。

【0008】

同様にタイミング制御装置自体、即ち、指揮棒が振り下ろされた時に発音するべき音の発音時に出力される拍タイミング信号を入力し、指揮棒の運動を示す信号を入力し、指揮棒が振り下ろされた時を特定し、前回に特定された時と今回に特定された時の時間差から指揮棒の振り周期を特定し、拍タイミング信号の入力時が指揮棒の振り下ろし時よりも早ければ指揮棒の振り周期を低速化したテンポ信号を出力し、拍タイミング信号の入力時が指揮棒の振り下ろし時よりも遅ければ指揮棒の振り周期を高速化したテンポ信号を出力する装置も本発明で創作された装置である。

【0009】

【実施の形態】以下で説明する実施例の主要な特徴を最初に列記する。

(形態1) 旋律データはMIDI形式で記述されており、旋律データが記憶されていないパート(チャネル)に拍データを追加する。追加した拍データは、音量がゼロであり、実際には演奏されない音を示す。この音は、指揮棒が振り下ろされた時に発音するべき音と同一タイミングに追加される。

(形態2) 演奏制御装置は、MIDI形式のデータに従って音源を制御して演奏ないし再生する装置であり、テンポ信号を入力して演奏ないし再生テンポを制御する。

(形態3) タイミング制御装置は、汎用コンピュータで構成され、補正されたテンポ信号をシンセサイザーに出力する。シンセサイザーは、入力されたテンポ信号を演奏制御装置が入力可能な形式に変換し、変換されたテンポ信号を演奏制御装置に出力する。

(形態4) タイミング制御装置は、拍タイミング信号の入力時と指揮棒の振り下ろし時の時間差の長短にあわせて、テンポの補正量を調整する。

(形態5) タイミング制御装置は、指揮棒の運動を撮影した画像データを分析して、指揮棒の振り下ろし時を特定する。

【0010】

【実施例】図1の10に、演奏(ないし再生)に用いる旋律データの記憶内容を模式的に示す。旋律データは、旋律を構成する音階と音長を示すデータをMIDI形式で記憶している。MIDI形式では、パート(ないしチャネル)毎に旋律データを記憶することができ、パート間の発音タイミング関係も記憶している。例えば、音6と音8は同時に発音するべきであることが記憶されている。旋律データは、指揮者が振る指揮棒にあわせて演奏することを予定しておらず、指揮棒が振り下ろされた時に発音するべき音を示すデータを持っていない。このために、図5に示した問題が生じる。

【0011】

演奏(ないし再生)に先立って、指揮棒が振り下ろされた時に発音するべき音を示すデータを追加する。そのためには、利用されていないパート(ないしチャネル)を利用する。図1の12に示すように、指揮棒が振り下ろされた時に発音するべき音(これを14,16とする)と同時に発音させる音18を、未使用パートNに加える。これを指揮棒が振り下ろされた時に発音するべき音の全てに実行する。音20,22に対して音24が追加される。

追加した音18,24の発音タイミングは、指揮棒の振り下ろし時に一致し、いわゆる拍のタイミングに一致する。パートNに記憶された音は音量がゼロで演奏されるので、実際には演奏されない。音18,24の発音タイミングを示す拍データを付加することによって、指揮棒が振り下ろされた時に発音する音が特定される。

拍データ18,24が追加された楽曲データ12は、MIDI演奏PC36で利用される。楽曲データ12は、CVD等のメディアに記憶してもいし、MIDI演奏PC36のハードディスクに記憶してもよい。前者の場合には、CVD等のメディアをMIDI演奏PC36にセットすることによって、MIDI演奏PC36内に楽曲データ12の記憶装置が構成される。後者の場合には、MIDI演奏PC36のハードディスクが楽曲データ12の記憶装置となる。

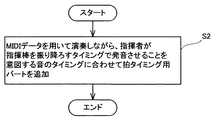

図2は、演奏開始前に実施する準備処理の手順を示し、処理S2で、上記の処理を実施する。

【0012】

演奏装置は、動画カメラ30と、指揮棒分析PC(パーソナルコンピュータ)32と、MIDIシンセサイザー34と、MIDI演奏PC36と、電子楽器や演奏アクチュエータ付の楽器等の音源38と、スピーカ40で構成されている。

動画カメラ30は、指揮者26が振る指揮棒の先端28を撮影し、撮影された映像信号を指揮棒分析PC32に送る。指揮棒分析PC32は、指揮棒先端28の高さの時間的変位(グラフ42)を分析し、指揮棒先端28が下死点に至ったタイミング(指揮棒が振り下ろされた時)t1、t2・・・を特定する。指揮棒分析PC32は、前回に特定された時(例えばt1)と今回に特定された時(例えばt2)の時間差(この場合T2)から、指揮棒の振り周期(T2)を特定する。指揮者26がテンポを変化させれば、指揮棒の振り周期Tが変化する。指揮棒分析PC32は、タイミング制御装置として利用される。指揮棒分析PC32は、指揮棒先端28の振りの振幅も特定する。

指揮棒分析PC32は、指揮棒先端28の高さの時間的変位(グラフ42)を分析し、指揮者が指定した演奏開始タイミングを特定する。指揮棒先端28の位置の分析で、指揮者が指定した演奏開始タイミングを特定できない場合に備えて、オペレータが手動で演奏開始タイミングを指揮棒分析PC32に入力するようにしてもよい。

【0013】

MIDIシンセサイザー34は、指揮棒分析PC32(汎用パーソナルコンピュータ)と、MIDI演奏PC36のインターフェイスとして利用され、信号を変換する。

【0014】

MIDI演奏PC36は、楽曲データ12を読み込み、読み込んだ楽曲データ12を利用して音源38を制御する。演奏制御装置に相当する。楽曲データ12は、音階と音長と、指揮棒が振り下ろされた時に発音する音を示すデータを持っているが、テンポと音量を指定するデータは持っていない。テンポと音量を指定するデータは、指揮棒分析PC32からMIDIシンセサイザー34を介してMIDI演奏PC36に送られる。MIDI演奏PC36は、指定されたテンポと音量で、旋律データで定められている音階と音長が得られるように、音源38を制御する。このときに、後記するようにして、指揮棒が振り下ろされた時に発音するべき音が、指揮棒の振り下ろしタイミングで演奏(ないし再生)されるようにする。

【0015】

MIDI演奏PC36は、拍タイミングで発音させるべき音(パートNに記述されている)の発音を音源38に指示した時に、パルス信号CをMIDIシンセサイザー34を介して指揮棒分析PC32に送る。パートNに記述されている音は音量がゼロで演奏されるので、実際には演奏されない。拍タイミングに同期させて音を発音したい場合には、パートNに記述されている音の音量をゼロ以外に設定すればよい。

【0016】

図3は、演奏時に指揮棒分析PC32が実行する処理手順を示す。ステップS4では、指揮棒先端28の位置の分析を実施し、指揮者が演奏開始を指示するときに行う位置の変化が観測されるのを待つ。指揮者が演奏開始を指示するときに行う位置の変化が観測された時に、指揮棒分析PC32はMIDIシンセサイザー34を介してMIDI演奏PC36に、演奏開始信号A,B(信号BはMIDI形式に変換された演奏開始信号)を送る(S6)。オペレータが手動で演奏開始タイミングに指揮棒分析PC32から演奏スタート信号Aを出力させてもよい。

図4は、演奏時にMIDI演奏PC36が実行する処理手順を示す。ステップS30では、演奏開始信号Bの入力を待つ。演奏開始信号Bが入力されると、予め設定されているテンポと音量で演奏(ないし再生)処理を開始する(ステップS32)。MIDI演奏PC36は、パートNに記述されている拍タイミングで発音させるべき音の発音を音源38に指示した時を待ち(ステップS34)、拍タイミングで発音するべき音の発音を音源38に指示した時に、パルス信号CをMIDIシンセサイザー34を介して指揮棒分析PC32に送る。パルス信号Cは、MIDIシンセサイザー34によって、指揮棒分析PC32が入力可能なパルス信号Dに変換される。

【0017】

指揮棒分析PC32は、図3のステップS8でパルス信号Dの入力を待つ。添え字nは、入力回数を示す。パルス信号Dnが入力されたら計時を開始し(S10)、指揮棒の振り下ろしタイミングtnが特定されるのを待つ。指揮棒の振り下ろしタイミングtnが特定されたら、パルス信号Dnが入力された時から指揮棒の振り下ろしタイミングtnまでの時間差をΔTに記憶する(S14)。

図1の参照番号44は、パルス信号D3が、振り下ろしタイミングt3よりも先に入力された場合を示し、この場合には、ステップS8がYESとなって、前記したステップS10からS14の処理が実行される。

この場合、指揮棒の振り下ろしタイミングt3よりも先に、指揮棒の振り下ろしタイミングt3で発音するべき音が発音されたことに相当する。即ち、演奏ないし再生が早すぎることに相当する。この場合には、指揮棒の振り下ろしタイミングt3で判明した指揮者の意図するテンポ(T3)よりも、ゆっくりと演奏ないし再生すれば、次の振り下ろしタイミングt4で発音するべき音が発音されるように修正されるはずである。図3のステップS16では、指揮者の意図するテンポTnよりも、演奏が早すぎる時間ΔTだけスローテンポ化したテンポを計算し、補正されたテンポを示す信号Eを出力する。

【0018】

図3のステップS8でパルス信号Dnの入力を待っている間に、指揮棒の振り下ろしタイミングtnが特定されると、ステップS18がYESとなる。先に指揮棒の振り下ろしタイミングtnが特定されたら計時を開始し(S20)、パルス信号Dnの入力を待つ。パルス信号Dnが入力されたら、指揮棒の振り下ろしタイミングtnからパルス信号Dnが入力された時までの時間差をΔTに記憶する(S24)。

図1の参照番号46は、振り下ろしタイミングt4がパルス信号D4よりも先に入力された場合を示し、この場合には、ステップS18がYESとなって、前記したステップS20からS24の処理が実行される。

この場合、指揮棒の振り下ろしタイミングt4よりも後に、指揮棒の振り下ろしタイミングt4で発音するべき音が発音されたことに相当する。即ち、演奏ないし再生が遅すぎることに相当する。この場合には、指揮棒の振り下ろしタイミングt4で判明した指揮者の意図するテンポ(T4)よりも、早く演奏ないし再生すれば、次の振り下ろしタイミングt5で発音するべき音が発音されるように修正されるはずである。図3のステップS26では、指揮者の意図するテンポTnよりも、演奏が遅すぎる時間ΔTだけアップテンポ化したテンポを計算し、補正されたテンポを示す信号Eを出力する。

タイミングt2に示すように、パルス信号D2の入力タイミングと指揮棒の振り下ろしタイミングt2が一致していれば、指揮棒の振り下ろしタイミングt2で発音するべき音がそのタイミングで発音されている。テンポを補正する必要がなく、指揮者の意図するテンポT2を示すテンポ信号Eを出力する。

【0019】

指揮棒分析PC32が出力したテンポ信号Eは、MIDIシンセサイザー34によってMIDI形式のテンポ信号Fに変換され、MIDI演奏PC36に入力される(図4のステップS38)。

【0020】

指揮棒分析PC32は、指揮棒先端28の振りの振幅も特定する。そして特定された振幅から音量を指定するデータGをMIDIシンセサイザー34に送る(図3のステップS28)。MIDIシンセサイザー34は、音量指定データGをMIDI形式の音量信号Hに変換し、MIDI演奏PC36に送る(図4のステップS38)。

MIDI演奏PC36は、入力したテンポ信号Fと音量信号Hに従って、MIDI形式で記述されている旋律を演奏する。MIDI形式のデータが終了し楽曲の演奏が終了するまでステップS34以降を繰り返す。指揮者26が指揮棒の動きを止めると、テンポが無限大に遅くされ、演奏は一時停止される。

【0021】

本技術によると、指揮棒分析PC32は、基本的には指揮棒の振りの周期Tで特定されるテンポを指定する(図3のステップS16、S24)ことから、指揮者の意図するテンポで演奏ないし再生されることになる。

その一方において、指揮棒が振り下ろされたタイミングとそのタイミングで発音するべき音の実際の発音タイミングとのズレによって演奏が早すぎのか遅すぎのかを判別し、演奏が早すぎれば演奏テンポを遅く補正し(図3のS16)、演奏が遅すぎれば演奏テンポを早く補正する(図3のS26)ことから、指揮棒が振り下ろされたタイミングとそのタイミングで発音するべき音の実際の発音タイミングとのズレがゼロとなるように補正され、指揮棒が振り下ろされたタイミングにおいてそのタイミングで発音するべき音が実際に発音するように演奏ないし再生される。

【0022】

【発明の効果】本発明によると、指揮者が意図するテンポで旋律が演奏されるというだけではなく、指揮者が指揮棒を振り下ろすタイミングで発音させたいと意図している音が実際に発音されるので、指揮者は違和感なく、愉快に快適に演奏装置を指揮することができる。

【図面の簡単な説明】

【図1】本発明の要点を網羅的に示す図。

【図2】準備段階の処理手順図。

【図3】タイミング制御装置が実行する処理手順図。

【図4】演奏制御装置が実行する処理手順図。

【図5】指揮棒の振りと旋律の進行の関係を示す図

【符号の説明】

10:MIDI形式の旋律データ

12:拍データが付加された楽曲データ

30:指揮棒撮影用カメラ

32:指揮棒分析PC(タイミング制御装置)

34:MIDIシンセサイザー

36:MIDI演奏PC(演奏制御装置)

38:音源[0001]

BACKGROUND OF THE INVENTION 1. Field of the Invention The present invention relates to a technique for playing or reproducing a melody by controlling a sound source using data describing a melody, for example, data described in a MIDI (Musical Instrument Digital Interface) format.

[0002]

2. Description of the Related Art There is known a technique in which melody is generated from a sound source by inputting data describing a melody, for example, data described in a MIDI format, to a computer and controlling the sound source by the computer in accordance with the data. At this time, a technique for adjusting the performance speed and volume intended by the conductor is described in Patent Document 1.

In the technique disclosed in Patent Document 1, a swing cycle and amplitude are detected from the movement of a baton, a tempo signal is generated from the cycle, a volume signal is generated from the amplitude, and the generated tempo signal and volume signal are used as a sound source control computer. To enter. In order to control the sound source according to the input tempo signal, volume signal and melody description data, the sound source control computer plays or reproduces the melody at the tempo and volume intended by the conductor.

[0003]

[Patent Document 1]

JP-A-6-301381

The melody is played or reproduced at the tempo and volume intended by the conductor, but does not provide a natural performance.

The conductor not only specifies the tempo at the timing of swinging down the baton, but also intends to produce a specific sound at the timing of swinging down the baton. In the example illustrated in FIG. 5, it is intended that the

Just because the melody is played at the tempo intended by the conductor, the relationship between the swing-down timing and the melody is not uniquely determined, and which of the

In order to guarantee the performance according to the swing-down

In the conventional technology, the melody is played at the tempo intended by the conductor, and the sound that the conductor wants to be pronounced is guaranteed when the conductor swings down the conductor bar. Absent.

The present invention provides a performance technique that not only plays a melody at a tempo intended by a conductor, but also plays a sound that the conductor intends to produce at the timing of swinging down a baton. Realize. In the case of the example shown in FIG. 5, a performance technique is realized in which the

[0005]

The performance device created by the present invention has a storage device, a performance control device, and a timing control device. The storage device stores music data in which beat data for specifying a sound to be generated when the baton is swung down is added to data describing the melody. This storage device can be configured by setting a medium such as a CDROM storing music data in the data reading device, or can be configured by a hard disk or the like. The performance control device reads out the music data from the storage device, controls the sound source based on the read music data, and outputs a beat timing signal when instructing the sound of the sound specified by the beat data. The timing control device inputs a beat timing signal from the performance control device. Also, a signal indicating the movement of the baton is input, the time when the baton is swung down is specified, and the swing cycle of the baton is specified from the time difference between the last specified time and the current specified time. In addition, if the beat timing signal is input earlier than the time when the baton swings down, a tempo signal with a slower batting cycle is output to the performance control device, and the beat timing signal is input when the beat timing signal is input. If it is later than the time of swinging down, a tempo signal in which the swing cycle of the baton is accelerated is output to the performance control device.

The performance control device and the timing control device may be constituted by separate computers, or may be constituted by the same computer. Instead of a general-purpose computer, a dedicated sequencer or processor may be used. Also in this case, the performance control device and the timing control device may be constituted by separate sequencers or processors, or may be constituted by the same sequencer or processor.

[0006]

Although the data describing the melody has the data of the scale and the pitch, it does not have the data specifying the sound to be pronounced when the baton is swung down. In the example shown in FIG. 5, the melody description data includes information for designating whether to play (or reproduce) the

Therefore, in the present invention, beat data for specifying a sound to be pronounced when the baton is swung down is added. In the case of FIG. 5, beat data for specifying the sound of “do, do, tsu, do, ret, ret, ret” is added. This specifies that the

A sound source such as an electronic musical instrument or a musical instrument with a performance actuator is controlled by a performance control device to generate sound. At this time, the melody is played (or reproduced) because the performance control device controls the sound source by the melody description data. The performance control device outputs a beat timing signal when instructing the sound generation of the sound specified by the beat data. In the previous example, a beat timing signal is output each time the sound of "do, do, tsu, do, rei, rei, rei" is produced.

The timing control device inputs a signal indicating the movement of the baton (for example, image data obtained by capturing the movement of the baton, an output of an acceleration sensor attached to the baton, etc.), and detects when the baton is swung down. The swing cycle of the baton is identified from the time difference between the time specified last time and the time specified this time. That is, the timing of swinging down the conductor bar and the tempo intended by the conductor are recognized. Further, the timing control device inputs a beat timing signal each time the sound of “do, do, tsu, do, ret, ret, ret” is produced. The timing control device compares the timing at which the baton swings down with the input timing of the beat timing signal. If the input of the beat timing signal is earlier than the time of the downstroke of the conductor bar, it is understood that the performance (or reproduction) is progressing faster than the conductor's intention. In this case, the timing control device outputs to the performance control device a tempo signal in which the tempo intended by the conductor, which is determined from the swinging cycle of the baton, is reduced. As a result, the premature performance (or reproduction) is made slow tempo, and the intended sound can be produced at the time of the next swinging down of the baton. Conversely, if the time when the beat timing signal is input is later than the time when the baton swings down, it can be understood that the performance (or reproduction) is behind the intention of the conductor. In this case, the timing control device outputs to the performance control device a tempo signal obtained by accelerating the tempo intended by the conductor, which is determined from the swing cycle of the baton. As a result, the performance (or reproduction) that is too slow is made up-tempo, and the intended sound can be produced at the time of the next swing of the baton.

As described above, not only the melody is played at the tempo that the conductor intends, but also the sound that the conductor intends to sound at the timing of swinging down the baton ( Or playback).

[0007]

The above-described performance control device itself, that is, music data in which beat data specifying a sound to be emitted when the baton is swung down is added to the melody description data, a sound source is controlled by the read music data, and The device itself that outputs a beat timing signal when instructing the generation of the sound specified by the above is the device created by the present invention.

[0008]

Similarly, the timing control device itself, that is, a beat timing signal output when a sound to be pronounced when the baton is swung down is input, a signal indicating the motion of the baton is input, and the baton is swung down. Identify the time when the command was performed, and determine the pitching cycle of the conductor from the time difference between the time specified last time and the time specified this time.If the beat timing signal is input earlier than the time when the commander swings down, conduct the command. The present invention also provides a device that outputs a tempo signal in which the bar swing cycle is slowed down and outputs a tempo signal in which the command bar swing cycle is accelerated if the input of the beat timing signal is slower than the command bar swing down. It is a device created.

[0009]

DESCRIPTION OF THE PREFERRED EMBODIMENTS The main features of the embodiment described below are listed first.

(Mode 1) The melody data is described in the MIDI format, and beat data is added to a part (channel) in which no melody data is stored. The added beat data has a volume of zero and indicates a sound that is not actually played. This sound is added at the same timing as the sound to be produced when the baton is swung down.

(Mode 2) A performance control device is a device that controls a sound source in accordance with MIDI format data to perform or reproduce and controls a performance or reproduction tempo by inputting a tempo signal.

(Mode 3) The timing control device is configured by a general-purpose computer, and outputs a corrected tempo signal to a synthesizer. The synthesizer converts the input tempo signal into a format that can be input by the performance control device, and outputs the converted tempo signal to the performance control device.

(Mode 4) The timing control device adjusts the tempo correction amount in accordance with the length of the time difference between when the beat timing signal is input and when the baton swings down.

(Mode 5) The timing control device analyzes image data obtained by photographing the motion of the baton, and specifies the time of swinging down the baton.

[0010]

DETAILED DESCRIPTION OF THE PREFERRED EMBODIMENTS Reference numeral 10 in FIG. 1 schematically shows the storage contents of melody data used for performance (or reproduction). The melody data stores, in MIDI format, data indicating the scales and pitches that make up the melody. In the MIDI format, melody data can be stored for each part (or channel), and the sounding timing relationship between parts is also stored. For example, it is stored that sounds 6 and 8 should be pronounced simultaneously. The melody data does not plan to play along with the conductor waving the conductor, and has no data indicating the sound to be produced when the conductor is swung down. This causes the problem shown in FIG.

[0011]

Prior to playing (or playing), data indicating the sound to be produced when the baton is swung down is added. For that purpose, a part (or channel) that is not used is used. As shown at 12 in FIG. 1, a sound 18 to be produced simultaneously with the sound to be produced when the baton is swung down (referred to as 14 and 16) is added to the unused part N. Do this for all sounds that should be pronounced when the baton is swung down. A

The sounding timing of the added sounds 18 and 24 coincides with the swinging down of the baton, and coincides with the so-called beat timing. Since the sound stored in part N is played at zero volume, it is not actually played. By adding beat data indicating the sound generation timing of the

The

FIG. 2 shows a procedure of a preparation process to be performed before the performance starts, and the above process is performed in a process S2.

[0012]

The playing device is composed of a

The

The conductor

[0013]

The

[0014]

The

[0015]

When the

[0016]

FIG. 3 shows a processing procedure executed by the conducting-

FIG. 4 shows a processing procedure executed by the

[0017]

The command

In this case, it is equivalent to that the sound to be produced at the timing t3 when the baton is swung down is generated before the timing t3 when the baton is swung down. That is, it means that the performance or the reproduction is too early. In this case, if the performance is performed or reproduced more slowly than the conductor's intended tempo (T3) determined at the timing t3 when the conductor is dropped, the sound to be generated at the next timing t4 is generated. It should be corrected as follows. In step S16 of FIG. 3, a tempo converted into a slow tempo by a time ΔT that is too early for the performance than the tempo Tn intended by the conductor is calculated, and a signal E indicating the corrected tempo is output.

[0018]

If the swing-down timing tn of the baton is specified while waiting for the input of the pulse signal Dn in step S8 of FIG. 3, step S18 becomes YES. When the timing of depressing the baton down tn is specified first, timing is started (S20), and input of the pulse signal Dn is waited. When the pulse signal Dn is input, the time difference from the timing at which the baton swings down tn to the time when the pulse signal Dn is input is stored in ΔT (S24).

In this case, it is equivalent to that the sound to be pronounced at the timing of the downstroke of the baton is generated after the timing t4 of downstroke of the baton. In other words, it means that performance or reproduction is too slow. In this case, if the performance is performed or reproduced earlier than the tempo (T4) intended by the conductor determined at the timing t4 when the conductor is dropped, the sound to be generated at the next timing t5 is generated. Should be corrected to In step S26 in FIG. 3, a tempo that is increased by a time ΔT that is too slow for the performance than the tempo Tn intended by the conductor is calculated, and a signal E indicating the corrected tempo is output.

As shown at the timing t2, if the input timing of the pulse signal D2 and the swing-down timing t2 of the baton match, the sound to be generated at the swing-down timing t2 of the baton is emitted at that timing. There is no need to correct the tempo, and the tempo signal E indicating the tempo T2 intended by the conductor is output.

[0019]

The tempo signal E output from the

[0020]

The command

The

[0021]

According to the present technology, the conductor

On the other hand, it is determined whether the performance is too early or too late based on the difference between the timing at which the baton is swung down and the actual sounding timing of the sound to be pronounced at that timing. The correction is made (S16 in FIG. 3), and if the performance is too slow, the performance tempo is corrected earlier (S26 in FIG. 3). Therefore, the timing at which the conductor is swung down and the actual sounding timing of the sound to be generated at that timing Is corrected so as to be zero, and at the timing when the baton is swung down, the sound to be produced at that timing is played or reproduced so that it is actually produced.

[0022]

According to the present invention, not only the melody is played at the tempo intended by the conductor, but also the sound that the conductor intends to produce at the timing of swinging down the baton is actually produced. Therefore, the conductor can comfortably and comfortably conduct the performance device without feeling uncomfortable.

[Brief description of the drawings]

FIG. 1 is a diagram comprehensively showing the main points of the present invention.

FIG. 2 is a processing procedure diagram of a preparation stage.

FIG. 3 is a processing procedure diagram executed by the timing control device.

FIG. 4 is a processing procedure diagram executed by the performance control device.

FIG. 5 is a diagram showing the relationship between the swing of the baton and the progress of the melody.

10: MIDI melody data 12: Music data to which beat data is added 30: Conducting bar photographing camera 32: Conducting bar analysis PC (timing control device)

34: MIDI synthesizer 36: MIDI performance PC (performance control device)

38: Sound source

Claims (3)

その記憶装置から楽曲データを読み出し、読み出した楽曲データによって音源を制御するとともに、拍データで特定される音の発音を指示した時に拍タイミング信号を出力する演奏制御装置と、

その拍タイミング信号を入力し、指揮棒の運動を示す信号を入力し、指揮棒が振り下ろされた時を特定し、前回に特定された時と今回に特定された時の時間差から指揮棒の振り周期を特定し、拍タイミング信号の入力時が指揮棒の振り下ろし時よりも早ければ指揮棒の振り周期を低速化したテンポ信号を演奏制御装置に出力し、拍タイミング信号の入力時が指揮棒の振り下ろし時よりも遅ければ指揮棒の振り周期を高速化したテンポ信号を演奏制御装置に出力するタイミング制御装置とを有する演奏装置。A storage device that stores music data in which beat data for specifying a sound to be pronounced when the baton is dropped down is added to data describing the melody,

A performance control device that reads out music data from the storage device, controls a sound source by the read music data, and outputs a beat timing signal when instructing sounding of a sound specified by the beat data;

Input the beat timing signal, input the signal indicating the movement of the baton, specify when the baton was swung down, and determine the time of the baton from the time difference between the time specified last time and the time specified this time. When the beat timing signal is input earlier than when the baton swings down, the swing cycle of the baton is output to the performance control device, and the beat timing signal is output to the performance control device. A timing control device for outputting to the performance control device a tempo signal in which the swinging cycle of the conductor bar is accelerated if it is later than when the bar is swung down.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003093567A JP2004302011A (en) | 2003-03-31 | 2003-03-31 | Device which conducts performance in synchronism with the operating timing of baton |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003093567A JP2004302011A (en) | 2003-03-31 | 2003-03-31 | Device which conducts performance in synchronism with the operating timing of baton |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2004302011A true JP2004302011A (en) | 2004-10-28 |

Family

ID=33406320

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2003093567A Pending JP2004302011A (en) | 2003-03-31 | 2003-03-31 | Device which conducts performance in synchronism with the operating timing of baton |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2004302011A (en) |

Cited By (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2007033844A (en) * | 2005-07-27 | 2007-02-08 | Sony Corp | Generating device for audio signal |

| JP2010261974A (en) * | 2009-04-28 | 2010-11-18 | Yamaha Corp | Signal control device |

| US8101843B2 (en) | 2005-10-06 | 2012-01-24 | Pacing Technologies Llc | System and method for pacing repetitive motion activities |

| CN102467902A (en) * | 2010-11-05 | 2012-05-23 | 卡西欧计算机株式会社 | Electronic percussion instrument |

| JP2012518192A (en) * | 2009-02-13 | 2012-08-09 | モベア エス.アー | Apparatus and method for controlling file reproduction of signal to be reproduced |

| US8933313B2 (en) | 2005-10-06 | 2015-01-13 | Pacing Technologies Llc | System and method for pacing repetitive motion activities |

-

2003

- 2003-03-31 JP JP2003093567A patent/JP2004302011A/en active Pending

Cited By (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2007033844A (en) * | 2005-07-27 | 2007-02-08 | Sony Corp | Generating device for audio signal |

| US8101843B2 (en) | 2005-10-06 | 2012-01-24 | Pacing Technologies Llc | System and method for pacing repetitive motion activities |

| US8933313B2 (en) | 2005-10-06 | 2015-01-13 | Pacing Technologies Llc | System and method for pacing repetitive motion activities |

| US10657942B2 (en) | 2005-10-06 | 2020-05-19 | Pacing Technologies Llc | System and method for pacing repetitive motion activities |

| JP2012518192A (en) * | 2009-02-13 | 2012-08-09 | モベア エス.アー | Apparatus and method for controlling file reproduction of signal to be reproduced |

| JP2010261974A (en) * | 2009-04-28 | 2010-11-18 | Yamaha Corp | Signal control device |

| CN102467902A (en) * | 2010-11-05 | 2012-05-23 | 卡西欧计算机株式会社 | Electronic percussion instrument |

| JP2012098637A (en) * | 2010-11-05 | 2012-05-24 | Casio Comput Co Ltd | Electronic percussion and program |

| US8664506B2 (en) | 2010-11-05 | 2014-03-04 | Casio Computer Co., Ltd. | Electronic percussion instrument and recording medium with program recorded therein |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JPH08234771A (en) | Karaoke device | |

| WO2014003072A1 (en) | Automated performance technology using audio waveform data | |

| JP4274152B2 (en) | Music synthesizer | |

| JPH11339060A (en) | Musical sound and image generating device | |

| JP5151245B2 (en) | Data reproducing apparatus, data reproducing method and program | |

| JP4802857B2 (en) | Musical sound synthesizer and program | |

| JP2004302011A (en) | Device which conducts performance in synchronism with the operating timing of baton | |

| JP3829780B2 (en) | Performance method determining device and program | |

| JP2005274851A (en) | Electronic music system and computer program applied to the same system | |

| JP2000029472A (en) | Karaoke machine | |

| JP4236533B2 (en) | Musical sound generator and program thereof | |

| JP3552675B2 (en) | Waveform generation method and apparatus | |

| WO2023032137A1 (en) | Data modification method, data reproduction method, program, data modification device | |

| JP3613191B2 (en) | Waveform generation method and apparatus | |

| JP4158443B2 (en) | Playback control device and program | |

| JPH0916171A (en) | Automatic playing device | |

| JP2862062B2 (en) | Karaoke equipment | |

| JP2003208169A (en) | Multi-media system, reproducing apparatus and reproducing/recording apparatus | |

| JP3867579B2 (en) | Multimedia system and playback apparatus | |

| JP3876896B2 (en) | Waveform generation method and apparatus | |

| JP2017015957A (en) | Musical performance recording device and program | |

| JPH08202357A (en) | Electronic instrument | |

| JP6060869B2 (en) | Karaoke device, program | |

| Lehdontie | Combining drum machines & samplers with acoustic drums | |

| JP2003208166A (en) | Musical sound reproducing/recording apparatus, recording apparatus, and recording method |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20050909 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20070525 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20070612 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20071204 |