WO2023120183A1 - 農業機械 - Google Patents

農業機械 Download PDFInfo

- Publication number

- WO2023120183A1 WO2023120183A1 PCT/JP2022/045042 JP2022045042W WO2023120183A1 WO 2023120183 A1 WO2023120183 A1 WO 2023120183A1 JP 2022045042 W JP2022045042 W JP 2022045042W WO 2023120183 A1 WO2023120183 A1 WO 2023120183A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- row

- agricultural machine

- image

- area

- region

- Prior art date

Links

Images

Classifications

-

- A—HUMAN NECESSITIES

- A01—AGRICULTURE; FORESTRY; ANIMAL HUSBANDRY; HUNTING; TRAPPING; FISHING

- A01B—SOIL WORKING IN AGRICULTURE OR FORESTRY; PARTS, DETAILS, OR ACCESSORIES OF AGRICULTURAL MACHINES OR IMPLEMENTS, IN GENERAL

- A01B69/00—Steering of agricultural machines or implements; Guiding agricultural machines or implements on a desired track

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/90—Determination of colour characteristics

Definitions

- This disclosure relates to agricultural machinery.

- a vision guidance system is being developed that detects rows of crops (rows of crops) or ridges in a field using an imaging device such as a camera, and controls traveling of work vehicles along the rows of crops or ridges that have been detected. .

- Patent Document 1 discloses a working machine that travels along ridges in cultivated land where crops are planted on ridges formed in rows. Patent Document 1 describes generating a planar projective transformation image after binarizing an original image obtained by photographing a cultivated land obliquely from above with an in-vehicle camera.

- the image recognition system may not always be able to continuously detect the row area.

- the present disclosure provides an agricultural machine capable of solving such problems.

- an agricultural machine includes an image recognition system that detects row regions of at least one of crops and ridges provided on the ground of a field from an acquired image; and a control device for controlling the traveling device, the traveling device being capable of operating in a row tracing traveling mode for controlling the traveling device to travel along the row region detected by the image recognition system. and a control device, wherein, when the image recognition system detects a defective portion of the row region or the end of the field during operation in the row following traveling mode, the controller causes the vehicle to travel for a predetermined time or a predetermined distance. continue.

- a computer-readable storage medium may include both volatile and non-volatile storage media.

- a device may consist of a plurality of devices. When the device is composed of two or more devices, the two or more devices may be arranged in one device, or may be divided and arranged in two or more separate devices. .

- the automatic steering mode is set to Since it is not released suddenly, the driver is not panicked. As a result, the driver has enough time to perform the operation for switching to manual steering, and it becomes possible to smoothly perform operations such as running or stopping running by manual steering.

- FIG. 1 is a block diagram schematically showing a basic configuration example of an agricultural machine in the present disclosure

- FIG. 1 is a block diagram showing a configuration example of an image recognition system

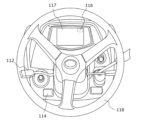

- FIG. FIG. 4 is a diagram schematically showing an arrangement example of switches and the like provided around the steering wheel of the agricultural machine

- FIG. 11 is a perspective view showing another example of a display device

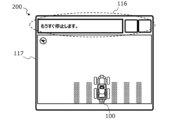

- FIG. 4 is a diagram schematically showing a display screen of an operating terminal that displays the operating state of agricultural machinery

- FIG. 10 is a diagram schematically showing a display screen of an operating terminal that displays another operating state of the agricultural machine

- FIG. 9 is a diagram schematically showing a display screen of an operating terminal that displays still another operating state of the agricultural machine

- FIG. 9 is a diagram schematically showing a display screen of an operating terminal that displays still another operating state of the agricultural machine;

- FIG. 9 is a diagram schematically showing a display screen of an operating terminal that displays still another operating state of the agricultural machine;

- FIG. 9 is a diagram schematically showing a display screen of an operating terminal that displays still another operating state of the agricultural machine;

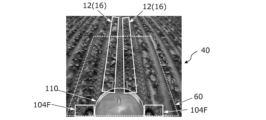

- FIG. 2 is a diagram schematically showing how an imaging device attached to an agricultural machine captures an image of the ground;

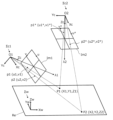

- FIG. 4 is a perspective view schematically showing the relationship between a body coordinate system ⁇ b and a camera coordinate system ⁇ c fixed with respect to agricultural machinery, and a world coordinate system ⁇ w fixed with respect to the ground.

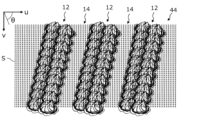

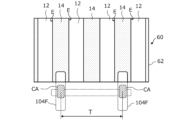

- FIG. 2 is a top view schematically showing a portion of a field in which a plurality of rows of crops are provided on the ground;

- 14 is a diagram schematically showing an example of an image acquired by the imaging device of the agricultural machine shown in FIG. 13;

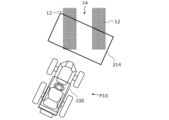

- FIG. FIG. 4 is a top view schematically showing a state in which the position and orientation (angle in the yaw direction) of the agricultural machine are adjusted;

- FIG. 16 is a diagram showing an example of an image acquired by the imaging device of the agricultural machine in the state of FIG. 15;

- 1 is a block diagram schematically showing a configuration example of a processing device according to a first embodiment of the present disclosure;

- FIG. 20 is a histogram of the green excess index (ExG) in the image of FIG. 19;

- FIG. 4 is a diagram showing an example of a top-view image (bird's-eye view image) classified into first pixels (for example, crop pixels) and second pixels (background pixels);

- FIG. 20 is a histogram of the green excess index (ExG) in the image of FIG. 19;

- FIG. 4 is a diagram showing an example of a top-view image (bird's-eye view image) classified into first pixels (for example, crop pixels) and second pixels (background pixels);

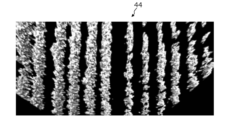

- FIG. 10 is a diagram showing an enhanced image obtained

- FIG. 3 is a perspective view schematically showing the positional relationship between each of the camera coordinate system ⁇ c1 and the camera coordinate system ⁇ c2 and the reference plane Re.

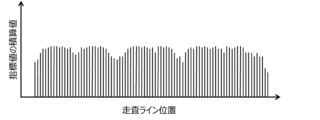

- FIG. 5 is a schematic diagram showing an example in which the direction of the rows of crops and the direction of the scanning lines in the top view image are parallel; 24 is a diagram schematically showing an example of an integrated value histogram obtained for the top view image of FIG. 23;

- FIG. 5 is a schematic diagram showing an example in which the direction of the row of crops and the direction of the scanning line in the top view image intersect;

- FIG. 26 is a diagram schematically showing an example of an integrated value histogram obtained for the top view image of FIG.

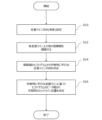

- FIG. 25 is a flow chart illustrating an example algorithm for determining crop row edge lines by a processing device in an embodiment of the present disclosure

- FIG. 22 is a diagram showing an integrated value histogram obtained from the top view image of FIG. 21

- 4 is a block diagram showing processing executed by a processing device according to an embodiment of the present disclosure

- FIG. FIG. 10 is a schematic diagram showing an example of a top view image in which a part of the row of crops is missing.

- 31 is a diagram schematically showing an example of an integrated value histogram obtained for the top view image of FIG. 30;

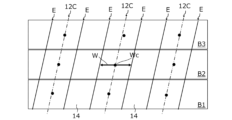

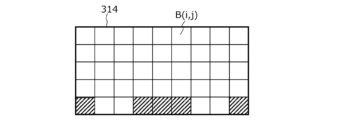

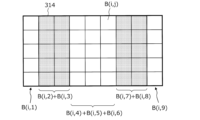

- FIG. 10 is a diagram for explaining how a top view image is divided into a plurality of blocks;

- 33 is a diagram schematically showing the relationship between the position of the scanning line and the integrated value of the index value in each block of FIG. 32;

- FIG. FIG. 34 is a diagram showing an example of a crop row center in each block in FIG. 33 and an approximate line for the crop row center;

- FIG. 35 is a top view showing an example of edge lines of crop rows determined based on the approximation lines of FIG. 34; For explaining a method of dividing part or all of the top view image into a plurality of blocks and determining the position of the edge line for each of the plurality of blocks when the crop row includes a curved portion. It is a diagram.

- FIG. 38 is a diagram schematically showing the relationship between the position of a scanning line and the integrated value (histogram) of index values in each block in FIG. 37;

- FIG. FIG. 38 is a diagram showing an example of a crop row center in each block in FIG. 37 and an approximate line for the crop row center;

- FIG. 39 is a top view showing an example of edge lines of crop rows determined based on the approximate curve of FIG. 38;

- FIG. 4 is a perspective view schematically showing rows of ridges provided on the ground; It is a figure which shows the image acquired at the time t from the imaging device.

- FIG. 10 is a diagram schematically showing a correspondence relationship of feature points between an image acquired from an imaging device at time t and an image acquired at time t+1;

- FIG. 4 is a perspective view schematically showing movement of feature points on ridges and an intermediate area (work passage) appearing in an image acquired by an imaging device;

- FIG. 3 is a diagram schematically showing the relationship between the amount of movement (first amount of movement) of feature points projected onto an image plane and the amount of movement (second amount of movement) of feature points projected onto a reference plane;

- FIG. 7 is a block diagram showing processing executed by a processing device according to the second embodiment of the present disclosure;

- FIG. 4 is a diagram showing the relationship between the average height of feature points on a scanning line and the position of the scanning line;

- FIG. 12 is a diagram illustrating a basic configuration example of an image recognition system according to a third embodiment of the present disclosure;

- FIG. 1 is a block diagram schematically showing a basic configuration example of an agricultural machine in the present disclosure

- FIG. 4 is a top view schematically showing an imaging range on the ground of time-series images acquired by an imaging device of an agricultural machine

- FIG. 4 is a top view schematically showing an imaging range on the ground of time-series images acquired by an imaging device of an agricultural machine

- FIG. 4 is a diagram schematically showing an example arrangement of rows of crops on the ground of a field and states at multiple positions of the agricultural machine during movement;

- FIG. 55 is a plan view schematically showing the positional relationship between the search area and the row of crops when the agricultural machine is at position P10 in FIG. 54;

- FIG. 55 is a diagram schematically showing the result of area classification of each block forming the search area when the agricultural machine is at position P10 in FIG. 54;

- FIG. 55 is a plan view schematically showing the positional relationship between the search area and the row of crops when the agricultural machine is at position P11 in FIG. 54;

- FIG. 55 is a diagram schematically showing the result of area classification of each block forming the search area when the agricultural machine is at position P11 in FIG. 54;

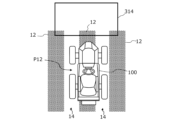

- FIG. 55 is a plan view schematically showing the positional relationship between the search area and the row of crops when the agricultural machine is at position P12 in FIG. 54;

- FIG. 55 is a diagram schematically showing the result of area classification of each block forming the search area when the agricultural machine is at position P12 in FIG. 54;

- FIG. 4 is a diagram showing an example of a search area of a top view image showing three rows of crops;

- FIG. 62 is a diagram schematically showing the relationship (histogram of integrated values) between the positions of scanning lines and the integrated values of index values obtained for each block in the search area in the top view image of FIG. 61;

- FIG. 63 is a diagram schematically showing an example of a two-dimensional block arrangement pattern formed by "row areas" detected in the search area of FIG.

- FIG. 10 is a diagram showing an example of a search area of a top-view image in which two rows of crops extending obliquely are captured

- FIG. 65 is a diagram schematically showing the relationship (histogram of integrated values) between the positions of scanning lines and the integrated values of index values obtained for each block in the search area in the top view image of FIG. 64

- FIG. 66 is a diagram schematically showing an example of a two-dimensional block arrangement pattern formed by "row areas" detected in the search area of FIG. 65

- 7 is a flow chart showing an example of a procedure for detecting a row region by a processing device

- 4 is a block diagram showing processing executed by a processing device according to an embodiment of the present disclosure

- FIG. 4 is a diagram showing blocks related to a path followed by wheels of an agricultural machine within a search area;

- FIG. 10 is a diagram showing another arrangement example of blocks within a search area;

- FIG. 10 is a diagram showing still another arrangement example of blocks within a search area;

- 1 is a perspective view showing an example of an appearance of an agricultural machine according to an embodiment of the present disclosure;

- FIG. 2 is a side view schematically showing an example of an agricultural machine with a work implement attached; It is a block diagram showing an example of a schematic structure of an agricultural machine and a working machine.

- Agricultural machinery in the present disclosure broadly includes machines that perform basic agricultural work such as “plowing”, “planting”, and “harvesting” in fields.

- Agricultural machines are machines having functions and structures for performing agricultural work such as tillage, sowing, pest control, fertilization, planting of crops, or harvesting on the ground in a field. These agricultural operations are sometimes referred to as “ground operations” or simply “operations.”

- ground operations or simply “operations.”

- a work vehicle such as a tractor functions alone as an “agricultural machine”

- the work machine (implement) attached to or towed by the work vehicle and the work vehicle as a whole can be regarded as one "agricultural machine”. It may work.

- Examples of agricultural machinery include tractors, riding machines, vegetable transplanters, mowers, and field mobile robots.

- FIG. 1 is a block diagram schematically showing a basic configuration example of an agricultural machine according to the present disclosure.

- the agricultural machine 100 in this example includes an image recognition system 1000 , a travel device 145 including steering wheels, and a control device 180 that controls the travel device 145 .

- the image recognition system 1000 comprises an imaging device 120, such as a camera mounted on the agricultural machine 100, for example, as shown in FIG. 2, and a processing device 122, which may be implemented by at least one computer.

- the image recognition system 1000 is configured to detect row regions of at least one of crops and ridges provided on the ground of a field from images acquired by the imaging device 120 . A method of detecting the row region by the image recognition system 1000 will be described later in detail.

- the agricultural machine 100 is capable of "following line running” in addition to running by normal manual steering.

- “Row following travel” means running by automatic steering along a row region detected by the image recognition system 1000 .

- the control device 180 controls the traveling device 145 to travel along the row area detected by the image recognition system 1000 .

- the orientation of the steered wheels during row following running is automatically controlled by, for example, a steering motor without the need for a person to operate the steering wheel.

- Such row following travel is performed by the control device so that the wheels of the traveling device (all wheels including the steering wheel) move through an area (working passage) between two adjacent row areas. 180 is executed to control the running gear 145 . Therefore, the image recognition system 1000 monitors the relationship between the position of the row area to be scanned (for example, the position of the "edge" of the row area) and the position of the wheel with high accuracy of several centimeters during row scanning. can do.

- wheel means “wheel with tire” or “wheel with endless track”.

- tire is used when referring to a tire portion of a wheel, for example, and the term “metal wheel” is used when referring to a metal “wheel” portion, for example.

- the image recognition system 1000 is configured not only to detect row regions in an image, but also to calculate the relative positions of the detected row regions with respect to the agricultural machine 100 with high accuracy.

- the position of the row area relative to the agricultural machine 100 is, for example, the coordinates of the row area in a local coordinate system fixed to the agricultural machine 100 .

- the row region coordinates do not need to be transformed into coordinates in the ground-fixed world coordinate system. Therefore, it is not necessary for the agricultural machine 100 during row-following travel to accurately measure its own position (for example, latitude and longitude) in the world coordinate system.

- the agricultural machine 100 is equipped with a self-position estimation device, the coordinates of the row region in the local coordinate system fixed to the agricultural machine 100 are converted into the coordinates in the world coordinate system fixed on the ground, and the row region Maps may be generated.

- the running speed of the agricultural machine 100 can be controlled according to the positions of operating members such as an accelerator pedal and a brake pedal operated by the driver (operator) during row following running.

- the travel speed of the agricultural machine 100 may also be automatically controlled by the controller 180 .

- the agricultural machine 100 in the present disclosure may be provided with a start switch 112 for commanding the start of row following travel. More specifically, the start switch 112 commands the start of row following travel in which the controller 180 controls the travel device 145 to travel along the row area detected by the image recognition system 1000 . Although the start switch 112 is connected to the control device 180 in the example of FIG. 1, it may be connected to the image recognition system 1000 as well.

- the start switch 112 can be provided around the driver's seat or around the steering wheel of the agricultural machine 100 .

- FIG. 3 is a diagram schematically showing an arrangement example of switches and the like provided around the steering wheel 118 of the agricultural machine 100.

- the start switch 112 is, for example, a lever that can be switched up, down, forward, and backward from a neutral position.

- the start switch 112 is one of the members operated by the operator of the agricultural machine 100 .

- the agricultural machine 100 is provided with various switches operated by the driver.

- a driver of the agricultural machine 100 is hereinafter referred to as an "operator".

- the control device 180 in the present disclosure is configured to continue running for a predetermined time or a predetermined distance when the image recognition system 1000 detects a missing point in the row region or the end of the field while operating in the row following traveling mode.

- examples of the "missing part of the row region" include a part where the crop row is missing due to the crop dying, a part where the ridge is broken, and a crop row or ridge. contains parts that are partially covered by some object. Furthermore, not only cases in which a crop row or ridge is actually damaged, but also an area that could not be correctly detected as a row area due to erroneous recognition by the image recognition system 1000 is included in the "missing part of the row area.” .

- the start switch 112 is operated to issue a line tracing start command.

- the image recognition system 1000 determines whether or not the vehicle is in a state where row tracing traveling is possible, and row tracing traveling can be restarted in the automatic steering mode only when row tracing traveling is possible.

- the "predetermined time” of automatic steering running that continues after the image recognition system 1000 loses track of the row region can be set, for example, within the range of 1 second or more and 5 seconds or less.

- the “predetermined distance” can be set from, for example, a range of 1 meter or more and 5 meters or less, or the length of the agricultural machine 100 .

- These “predetermined time” and “predetermined distance” may be determined by the control device 180 to different values according to the travel speed of the agricultural machine 100 .

- the control device 180 may store a table or formula that defines the relationship between the "predetermined time” and/or the "predetermined distance” and the running speed in the storage device.

- the distance traveled by the agricultural machine 100 may be determined by the control device 180 based on, for example, the number of rotations of the wheels obtained from the traveling device 145, or may be determined using a positioning system such as GNSS, or self-position estimation technology. may decide.

- the running time of the agricultural machine 100 can be determined by measuring with a timer. Also, the distance traveled by the agricultural machine 100 may be determined by the controller 180 based on the product of travel speed and travel time.

- control device 180 preferably controls the travel device 145 so that it travels along the extension of the route traveled by the agricultural machine 100 . Control device 180 may stop after continuing such running.

- the control device 180 controls the image recognition system 1000 to detect a new row region while the image recognition system 1000 continues traveling for a predetermined time or a predetermined distance. If detected, it may be configured to control the carriage 145 to travel along the new row region.

- the control device 180 may determine the "predetermined time” or the "predetermined distance” according to the working machine.

- the "predetermined distance” is based on the sum of the length of the agricultural machine 100 and the length of the working machine. It may be the distance that the work implement passes through the end of the farm field.

- the "predetermined time” may be the time for the work machine to pass through the defective portion of the row region or the end of the field, taking into consideration the work speed and the length of the work machine according to the type of the work machine.

- the distance and the time required for the work machine to pass the adjacent previous work end point are “predetermined distance”, “predetermined distance”, “predetermined distance”, and “predetermined You can set the time.

- the agricultural machine 100 may include notification means for notifying the operator of a stop advance notice when the image recognition system 1000 detects the end of the field.

- notification means include display devices that display icons, letters or symbols, light emitting devices such as LEDs, and acoustic devices that emit sounds or vibrations such as buzzers or speakers.

- a voice message such as "currently line tracing is not possible" is output.

- a sound device may emanate, or characters may be displayed on a display device.

- the display device 117 positioned around the steering wheel 118 may display a symbol indicating whether or not "following the line" is possible as a notification 116.

- a notification 116 may be displayed on the display device 117 indicating that the agricultural machine 100 is approaching the end of the field.

- FIG. 4 is a perspective view showing another example of the display device 117.

- the display device 117 may include an operation terminal 200 arranged around the driver's seat. On the display device 117 of the operation terminal 200, for example, as shown in FIG. 5, a notification 116 such as characters, symbols, etc. indicating that the end of the field is approaching can be displayed.

- the column areas displayed on the display device 117 are schematically illustrated as hatched bar-shaped areas.

- FIG. 6 shows an example of the display of the notification 116 that foretells that the agricultural machine 100 has reached the end of the field and will soon stop.

- FIG. 7 shows a display example of the notification 116 indicating that the agricultural machine 100 has passed the end of the field and stopped.

- This notification 116 may include information indicating that automatic steering has been switched to manual steering during row following running.

- FIG. 8 shows a display of a notice 116 that foretells that the image recognition system 1000 detects a defective portion of the row region during row-following running in the field, and that the vehicle automatically stops after running for a predetermined time or a predetermined distance. shows an example of

- FIG. 9 is an example of a display of a notification 116 indicating that the image recognition system 1000 has detected a defect in a row region during row tracing traveling in a field, but the row tracing traveling is to be continued by automatic steering without stopping. is shown.

- the image recognition system 1000 recognizes the position of the agricultural machine 100. It is desirable to determine whether or not the vehicle is in a state in which it is possible to follow the line on the basis of the positions of the wheels. When the image recognition system 1000 determines that it is not in a state in which line-following running is possible, a notification 116 indicating this may be displayed on the display device 117 .

- FIG. 10 shows an example of the notification 116 displayed on the display device 117 when the image recognition system 1000 determines that it is not possible to follow the line.

- the control device 180 is configured to execute the row following travel mode when the image recognition system 1000 detects a row area and also detects a work passage area having a predetermined width or more on both sides or one side of the row area. may have been

- the controller 180 determines whether the steered wheels can pass through the workpath area based on the workpath area and the position of the steered wheels, and if it determines that the steered wheels cannot pass the workpath area, the controller 180 determines that the workpath area cannot be passed. It can be configured to stop the contouring mode.

- the agricultural machine 100 may include a mode switch 114 for switching between automatic steering mode and manual steering mode, as shown in FIGS.

- the control device 180 can allow the start switch 112 to start following line running.

- the mode switch 114 for example, the steering motor can be energized for automatic steering.

- the image recognition system 1000 may also be configured to start image recognition processing for detecting row regions when the automatic steering mode is selected by the mode switch 114 .

- image recognition system 1000 When image recognition system 1000 starts image recognition processing in response to selection of the automatic steering mode by mode switch 114, image recognition system 1000 is configured to perform image processing in multiple stages. may be

- the mode switch 114 is provided around the steering wheel 118.

- mode switch 114 is a push button.

- the mode switch 114 is switched from an OFF state to an ON state, for example, when switching from the manual steering mode to the automatic steering mode. Conversely, when switching from the automatic steering mode to the manual steering mode, the ON state is switched to the OFF state.

- mode switch 114 is a switch that defines the start and end of the automatic steering mode.

- the start of the automatic steering mode does not mean that the automatic steering immediately starts following the line.

- control device 180 starts the line. Tracing running is started.

- row tracing traveling is started when the operator switches the start switch 112 downward from the neutral position, for example. Further, when the operator switches the start switch 112 upward from the neutral position, for example, during row tracing traveling, the signal output from the start switch 112 for instructing the start of row tracing traveling is stopped, or , the start switch 112 can output a signal instructing the train to stop running.

- the start switch 112 is a switch that turns on the row tracing running function of the agricultural machine 100.

- the control device 180 according to the present disclosure can operate even if there is an instruction to start row tracing running from the start switch 112. , may be configured so as not to immediately start line tracking.

- the image recognition system 1000 determines whether or not line-following traveling is possible, and that the command from the start switch 112 is valid only when it is determined that line-following traveling is possible. This processing and operation prevents row following running from starting when row following running is not possible, and makes it possible to avoid a situation where wheels trample a crop row or ridge.

- the traveling speed of the agricultural machine 100 can be controlled during row-following traveling according to the positions of operating members such as an accelerator pedal and a brake pedal operated by the operator.

- the travel speed of the agricultural machine 100 may also be automatically controlled by the controller 180 .

- FIG. 1 An embodiment of the image recognition system 1000 shown in FIG. 1 will be described below. Subsequently, embodiments of the agricultural machine 100 according to the present disclosure will be described in detail.

- the image recognition system 1000 in this embodiment includes an imaging device 120 attached to the agricultural machine 100 (FIG. 2).

- An imaging device 120 is fixed to the agricultural machine 100 to acquire time-series color images including at least a portion of the ground.

- FIG. 11 schematically shows how an imaging device 120 attached to an agricultural machine 100 such as a tractor or a riding management machine captures an image of the ground 10 .

- the agricultural machine 100 includes a vehicle body 110 that can travel, and an imaging device 120 is fixed to the vehicle body 110 .

- FIG. 11 shows a body coordinate system ⁇ b having mutually orthogonal Xb, Yb, and Zb axes.

- the body coordinate system ⁇ b is a coordinate system fixed to the agricultural machine 100, and the origin of the body coordinate system ⁇ b can be set near the center of gravity of the agricultural machine 100, for example. In the drawing, for ease of viewing, the origin of the body coordinate system ⁇ b is shown as being positioned outside the agricultural machine 100 .

- the Xb axis coincides with the traveling direction (the direction of arrow F) when the agricultural machine 100 travels straight.

- the Yb axis coincides with the rightward direction when the positive direction of the Xb axis is viewed from the coordinate origin, and the Zb axis coincides with the vertically downward direction.

- the imaging device 120 is, for example, an in-vehicle camera having a CCD (Charge Coupled Device) or CMOS (Complementary Metal Oxide Semiconductor) image sensor.

- the imaging device 120 in this embodiment is, for example, a monocular camera capable of capturing moving images at a frame rate of 3 frames per second (fps) or higher.

- FIG. 12 is a perspective view schematically showing the relationship between the body coordinate system ⁇ b, the camera coordinate system ⁇ c of the imaging device 120, and the world coordinate system ⁇ w fixed to the ground 10 described above.

- the camera coordinate system ⁇ c has mutually orthogonal Xc, Yc, and Zc axes

- the world coordinate system ⁇ w has mutually orthogonal Xw, Yw, and Zw axes.

- the Xw-axis and Yw-axis of the world coordinate system ⁇ w are on the reference plane Re extending along the ground 10 .

- the imaging device 120 is attached to a predetermined position of the agricultural machine 100 so as to face a predetermined direction. Therefore, the position and orientation of the camera coordinate system ⁇ c with respect to the body coordinate system ⁇ b are fixed in a known state.

- the Zc axis of the camera coordinate system ⁇ c is on the camera optical axis ⁇ 1.

- the camera optical axis ⁇ 1 is inclined from the traveling direction F of the agricultural machine 100 toward the ground 10, and the depression angle ⁇ is greater than 0°.

- a travel direction F of the agricultural machine 100 is generally parallel to the ground 10 on which the agricultural machine 100 travels.

- the depression angle ⁇ can be set, for example, within a range of 0° or more and 60° or less. When the position where the imaging device 120 is attached is close to the ground 10, the angle of depression ⁇ may be set to a negative value, in other words, the orientation of the camera optical axis ⁇ 1 may be set to have a positive elevation angle.

- the body coordinate system ⁇ b and the camera coordinate system ⁇ c translate with respect to the world coordinate system ⁇ w.

- the body coordinate system ⁇ b and the camera coordinate system ⁇ c may rotate with respect to the world coordinate system ⁇ w.

- the agricultural machine 100 does not rotate in the pitch and roll directions and moves substantially parallel to the ground 10 .

- FIG. 13 is a top view schematically showing part of a farm field in which a plurality of rows of crops 12 are provided on the ground 10.

- the crop row 12 is a row formed by continuously planting crops in one direction on the ground 10 of a field.

- a crop row 12 is a collection of crops planted on a ridge of a field.

- the shape of the crop row is complicated depending on the shape of the crops and the arrangement of the crops. be.

- the width of the crop row 12 varies as the crop grows.

- Each intermediate region 14 is a region sandwiched between two opposing edge lines E between two adjacent crop rows 12 .

- a plurality of crops are planted on one ridge in the width direction of the ridge, a plurality of rows of crops 12 are formed on one ridge. That is, a plurality of crop rows 12 are formed between rows of ridges.

- the edge line E of the row of crops 12 positioned at the edge in the width direction of the ridge serves as the reference for the intermediate region 14 . That is, the intermediate region 14 is located between the edge lines E of the row of crops 12 positioned at the edge in the width direction of the ridge among the edge lines E of the row of crops 12 .

- the intermediate area 14 functions as an area (work passage) through which the wheels of the agricultural machine 100 pass, the "intermediate area” may be referred to as a "work passage”.

- the "edge line" of a row of crops means a reference line segment (which may include a curved line) for defining a target route when the agricultural machine follows the row by automatic steering.

- Such reference line segments can be defined as the ends of a strip-shaped area (working path) through which the wheels of the agricultural machine are allowed to pass.

- FIG. 13 schematically shows one agricultural machine 100 entering a field in which a row of crops 12 is provided.

- the agricultural machine 100 includes left and right front wheels (steering wheels) 104F and left and right rear wheels 104R as traveling devices 145 to pull a working machine (implement) 300 .

- the front wheels 104F are steering wheels.

- the work passages 14 located on both sides of one row of crops 12 located in the center are marked with thick dashed arrows L and R, respectively.

- the front wheels 104F and the rear wheels 104R of the agricultural machine 100 move along the arrows L and R in the working path 14 so as not to step on the crop row 12.

- the image recognition system 1000 can detect the edge line E of the crop row 12 using the imaging device 120 attached to the agricultural machine 100. Therefore, the control device 180 and the travel device 145 operate to operate the front wheels (steering wheels).

- the agricultural machine 100 can travel in an automatic steering mode for row following traveling and a normal manual steering mode.

- Agricultural machine 100 may include a mode switch 114 shown in FIGS. 1 and 3 for the operator to switch between automatic steering mode and manual steering mode. The operator operates the mode switch 114 to select the automatic steering mode when the vehicle follows the line.

- the mode switch 114 selects the automatic steering mode, the image recognition system 1000 starts image recognition processing based on the image captured by the imaging device 120 .

- FIG. 14 is a diagram schematically showing an example of the image 40 acquired by the imaging device 120 of the agricultural machine 100 shown in FIG.

- a plurality of rows of crops 12 and an intermediate area (working path) 14 running parallel on the ground 10 theoretically meet at a vanishing point P 0 on the horizon 11 .

- the vanishing point P0 is located in the right region of the image 40 because, as shown in FIG. This is because it is inclined with respect to

- the automatic steering will cause the front wheels 104F and the rear wheels 104R of the agricultural machine 100 to move in the working path 14. along the arrows L, R may not be possible.

- the image recognition system 1000 determines whether or not row tracing traveling is possible based on the position and direction of the steering wheels (front wheels 104F). If the image recognition system 1000 determines that line following travel is not possible, the operator is notified of this fact. The operator adjusts the position and/or orientation of the agricultural machine 100 by manual steering in response to the notification.

- FIG. 15 is a top view schematically showing a state in which the position and orientation (angle in the yaw direction) of the agricultural machine 100 are adjusted by steering the agricultural machine 100 so as to reduce the positional error with respect to the target path (arrow C).

- FIG. 16 is a diagram showing an example of an image 40 acquired by the imaging device 120 of the agricultural machine 100 in such a state.

- the front wheels 104F and the rear wheels 104R of the agricultural machine 100 in the state of FIG. 15 are positioned on the lines indicated by the arrows L and R in the work passage 14, respectively.

- the operator manually steers the agricultural machine 100 to change to, for example, the state shown in FIG. 15, the image recognition system 1000 determines that line-following travel is possible. , the operator may be notified thereof. In this embodiment, after the notification, the image recognition system 1000 stops immediately until the operator instructs the start of line tracking by using the start switch 112 in FIG. 3 . In this state, when the operator operates the start switch 112 to issue a command to start row tracing traveling, the control device 180 permits the start of row tracing traveling by automatic steering.

- the rear wheels 104R respectively control the steering angle of the steered wheels so that they do not deviate from the working path 14.

- the image recognition system 1000 includes, as shown in FIG.

- the processing device 122 is connected to a control device 180 included in the agricultural machine 100 .

- the processing device 122 in FIG. 2 can be realized by an electronic control unit (ECU) for image recognition.

- the ECU is an in-vehicle computer.

- the processing device 122 is connected to the imaging device 120 by a serial signal line such as a wire harness so as to receive image data output by the imaging device 120 .

- a part of the image recognition processing executed by the processing device 122 may be executed inside the imaging device 120 (inside the camera module).

- FIG. 17 is a block diagram showing a hardware configuration example of the processing device 122.

- the processing device 122 includes a processor 20 , a ROM (Read Only Memory) 22 , a RAM (Random Access Memory) 24 , a communication device 26 and a storage device 28 . These components are interconnected via bus 30 .

- the processor 20 is a semiconductor integrated circuit and is also called a central processing unit (CPU) or a microprocessor.

- Processor 20 may include an image processing unit (GPU).

- the processor 20 sequentially executes a computer program describing a predetermined group of instructions stored in the ROM 22 to implement the processing required for column detection of the present disclosure.

- a part or all of the processor 20 may be an FPGA (Field Programmable Gate Array) equipped with a CPU, an ASIC (Application Specific Integrated Circuit), or an ASSP (Application Specific Standard Product).

- the communication device 26 is an interface for data communication between the processing device 122 and an external computer.

- the communication device 26 can perform wired communication such as CAN (Controller Area Network), or wireless communication conforming to the Bluetooth (registered trademark) standard and/or the Wi-Fi (registered trademark) standard.

- the storage device 28 can store data of an image acquired from the imaging device 120 or an image during processing.

- Examples of storage device 28 include a hard disk drive or non-volatile semiconductor memory.

- the hardware configuration of the processing device 122 is not limited to the above example. Some or all of processing device 122 need not be installed on agricultural machine 100 . By using the communication device 26, one or more computers located outside the agricultural machine 100 can function as part or all of the processing device 122. FIG. For example, a networked server computer may function as part or all of processing unit 122 . On the other hand, a computer mounted on agricultural machine 100 may perform all functions required of processing device 122 .

- such a processing device 122 acquires time-series color images from the imaging device 120 and performs operations S1, S2, and S3 described below.

- S1 Generate an enhanced image in which the color of the row of crops to be detected is enhanced from the time-series color images.

- S2 Generating a top view image of the ground viewed from above, in which the first pixels having the index value of the color of the row of crops equal to or larger than the threshold value and the second pixels having the index value smaller than the threshold value are classified from the enhanced image. do.

- S3 determining the position of the edge line of the crop row based on the index value of the first pixel;

- a time-series color image is a collection of images acquired by the imaging device 120 in a time-series manner. Each image is composed of a group of pixels in frame units. For example, if the imaging device 120 outputs images at a frame rate of 30 frames/second, the processing device 122 may acquire new images at intervals of approximately 33 milliseconds.

- the speed at which the agricultural machine 100 such as a tractor travels in a field is relatively low compared to the speed of general automobiles traveling on public roads, and can be, for example, about 10 kilometers per hour or less. At 10 kilometers per hour, the distance traveled in about 33 milliseconds is about 6 centimeters.

- the processing device 122 may acquire images at intervals of, for example, 100 to 300 milliseconds, and does not need to process all frame images captured by the imaging device 120 .

- the acquisition cycle of images to be processed by the processing device 122 may be automatically changed by the processing device 122 according to the travel speed of the agricultural machine 100 .

- FIG. 18 is an image corresponding to one frame of image 40 in time-series color images acquired by an imaging device (a monocular camera in this example) mounted on agricultural machinery.

- the image in FIG. 18 shows rows of crops (rows of crops) planted in rows on the ground of a field.

- rows of crops are arranged substantially parallel and evenly spaced on the ground, and the camera optical axis of the imaging device faces the direction of travel of the agricultural machine.

- the camera optical axis need not be parallel to the traveling direction of the agricultural machine, and may be incident on the ground ahead of the traveling direction of the agricultural machine.

- the mounting position of the imaging device is not limited to this example. When a plurality of imaging devices are attached to the agricultural machine, some of the imaging devices may face the camera optical axis in the direction opposite to the direction of travel or in the direction crossing the direction of travel.

- the processing device 122 in FIG. 2 generates an image (enhanced image) in which the color of the crop row to be detected is enhanced, based on the time-series color images acquired from the imaging device 120 .

- Crops have chlorophyll (chlorophyll) in order to receive sunlight (white light) and perform photosynthesis. Chlorophyll absorbs less green light than red and blue light. Therefore, the spectrum of sunlight reflected by crops exhibits relatively high values in the green wavelength range compared to the spectrum of sunlight reflected by the soil surface. As a result, crop color generally has a high green component and the "crop row color” is typically green. However, as will be described later, the "crop row color” is not limited to green.

- the image sensor in the imaging device 120 has a large number of photodetection cells arranged in rows and columns.

- Each photodetector cell corresponds to a picture element (pixel) that constitutes an image, and includes an R sub-pixel that detects the intensity of red light, a G sub-pixel that detects the intensity of green light, and an intensity of blue light. , including B sub-pixels for detecting .

- the output of light detected by the R subpixel, G subpixel, and B subpixel in each photodetector cell will be referred to as the R value, G value, and B value, respectively.

- the R value, G value, and B value may be collectively referred to as "pixel value" or "RGB value”.

- RGB value RGB value

- the enhanced image in which the color of the row of crops is emphasized means that the RGB value of each pixel in the color image acquired by the imaging device is set to a relatively large weight of the G value.

- This is an image converted into pixel values.

- Such conversion of pixel values for generating an enhanced image is defined, for example, as "(2 ⁇ G value ⁇ R value ⁇ B value)/(R value+G value+B value)".

- the denominator (R value+G value+B value) is a factor for normalization.

- rgb R value / (R value + G value + B value)

- g G value / (R value + G value + B value)

- b B value / (R value + G value + B value).

- ExG Excess Green Index

- FIG. 19 is a diagram showing an enhanced image 42 obtained by converting the RGB values in the image of FIG. 18 into "2 ⁇ grb".

- FIG. 19 pixels in which "r+b” is relatively small compared to g are displayed brightly, and pixels in which "r+b” is relatively large compared to g are displayed darkly.

- an image (enhanced image) 42 in which the color (in this example, "green") of the crop rows to be detected is enhanced is obtained.

- the brighter pixels in the image of FIG. 19 are pixels with a relatively large green component and belong to crop regions.

- NDVI Normalized Difference Vegetation Index

- each row of crop rows may be covered with a mulching sheet called "mulch".

- the "color of the crop row” is "the color of the objects arranged in a row over the crop”. Specifically, when the color of the sheet is black, which is an achromatic color, the "crop row color” means “black.” Also, if the color of the sheet is red, the “color of the crop row” means “red”. Thus, the "color of the crop row” means not only the color of the crop itself but also the color of the area defining the crop row (a color distinguishable from the color of the soil surface).

- the HSV color space is a color space composed of three components of hue (Hue), saturation (Saturation), and lightness (Value).

- hue Hue

- saturation saturation

- Value lightness

- the processing device 122 In operation S2, the processing device 122 generates a top view image classified from the enhanced image 42 into first pixels having a crop row color index value equal to or greater than a threshold and second pixels having an index value less than the threshold. do.

- a top view image is an image viewed from above the ground.

- FIG. 20 is a histogram of the green excess index (ExG) in the enhanced image 42 of FIG. The horizontal axis of the histogram is the green excess index (ExG), and the vertical axis is the number of pixels in the image (corresponding to the frequency of occurrence).

- FIG. 20 shows a dashed line indicating the threshold Th calculated by the discriminant analysis algorithm. Pixels of the enhanced image 42 are classified into two classes by this threshold Th.

- the occurrence frequency of pixels whose green excess index (ExG) is equal to or greater than the threshold is shown, and these pixels are estimated to belong to the crop class.

- the occurrence frequency of pixels whose green excess index (ExG) is less than the threshold is shown, and these pixels are considered to belong to the crop class such as soil. Presumed.

- the first pixel which is the pixel whose index value is greater than or equal to the threshold value, corresponds to the "crop pixel”.

- the second pixels whose index values are less than the threshold correspond to "background pixels".

- the background pixels correspond to objects other than the object to be detected, such as the surface of the soil, and the aforementioned intermediate region (working passage) 14 can be constituted by the background pixels.

- the threshold determination method is not limited to the above example, and the threshold may be determined using, for example, another method using machine learning.

- the detection target area can be extracted from the enhanced image 42. Further, by giving "zero” to the pixel value of the "second pixel” or removing the data of the second pixel from the image data, it is possible to mask the area other than the detection target. When determining the area to be masked, processing may be performed to include pixels with locally high values of the excess green index (ExG) as noise in the mask area.

- ExG excess green index

- FIG. 21 is a diagram showing an example of a top view image 44 seen from above the ground, classified into first pixels and second pixels.

- a top-view image 44 in FIG. 21 is an image created from the enhanced image 42 in FIG. 19 by an image conversion technique, which will be described later.

- the second pixels whose crop row color index value (in this example, the excess green index) is less than the threshold Th are black pixels (pixels whose lightness is set to zero).

- the area formed by the second pixels is mainly the area where the surface of the soil on the ground can be seen.

- black triangular areas exist at the left and right corners that are in contact with the lower side.

- This triangular area corresponds to the area that was not shown in the enhanced image 42 of FIG.

- a phenomenon is observed in which a line that should be straight is distorted in the peripheral portion of the image.

- image distortion is caused by the performance of the camera's lens and can be corrected using the camera's intrinsic parameters.

- Processing such as crop area enhancement, masking, and distortion correction can be referred to as preprocessing.

- Preprocessing may include processing other than such processing.

- a top-view image 44 in FIG. 21 is a bird's-eye view image of the reference plane Re parallel to the ground viewed from directly above in the normal direction of the reference plane Re.

- This bird's-eye view image can be generated from the enhanced image 42 of FIG. 19 by homography transformation (planar projective transformation).

- a homographic transformation is a type of geometric transformation that can transform a point on one plane in three-dimensional space to a point on any other plane.

- FIG. 22 shows the positional relationship between the camera coordinate system ⁇ c1 of the imaging device in the first orientation (position and orientation: pose) and the camera coordinate system ⁇ c2 of the imaging device in the second orientation, and the reference plane Re.

- the camera coordinate system ⁇ c1 is tilted so that its Zc axis obliquely intersects the reference plane Re.

- the imaging device in the first posture corresponds to the imaging device attached to the agricultural machine.

- the Zc axis of the camera coordinate system ⁇ c2 is orthogonal to the reference plane Re.

- the camera coordinate system ⁇ c2 is arranged such that the reference plane Re can be obtained as a bird's-eye view image viewed from directly above in the normal direction of the reference plane Re.

- a virtual image plane Im1 exists at a position separated by the focal length of the camera on the Zc axis from the origin O1 of the camera coordinate system ⁇ c1.

- the image plane Im1 is orthogonal to the Zc axis and the camera optical axis ⁇ 1.

- a pixel position on the image plane Im1 is defined by an image coordinate system having mutually orthogonal u and v axes.

- the coordinates of points P1 and P2 located on the reference plane Re are (X1, Y1, Z1) and (X2, Y2, Z2), respectively, in the world coordinate system ⁇ w.

- the reference plane Re is set so as to extend along the ground.

- Points P1 and P2 on the reference plane Re are transformed into points p1 and p2 on the image plane Im1 of the imaging device in the first posture, respectively, by perspective projection of the pinhole camera model.

- points p1 and p2 are located at pixel locations indicated by coordinates (u1, v1) and (u2, v2), respectively.

- a virtual image plane Im2 exists at a position separated by the focal length of the camera on the Zc axis from the origin O2 of the camera coordinate system ⁇ c2.

- the image plane Im2 is parallel to the reference plane Re.

- a pixel position on the image plane Im2 is defined by an image coordinate system having mutually orthogonal u * and v * axes.

- Points P1 and P2 on the reference plane Re are transformed into points p1 * and p2 * , respectively, on the image plane Im2 by perspective projection.

- points p1 * and p2 * are located at pixel locations indicated by coordinates (u1 * , v1 * ) and (u2 * , v2 * ), respectively.

- homography Given the positional relationship of the camera coordinate systems ⁇ c1 and ⁇ c2 with respect to the reference plane Re (world coordinate system ⁇ w), homography transforms an arbitrary point (u, v) on the image plane Im1 to correspond on the image plane Im2. We can find the point (u * , v * ) where Such a homography transformation is defined by a transformation matrix H of 3 rows ⁇ 3 columns when coordinates of points are expressed in a homogeneous coordinate system.

- the contents of the transformation matrix H are defined by the numerical values of h 11 , h 12 , . . . , h 32 as shown below.

- the contents of the transformation matrices H1 and H2 depend on the reference plane Re, so when the position of the reference plane Re changes, the contents of the transformation matrix H also change.

- the homography transformation By using such a homography transformation, it is possible to generate a top view image of the ground from the image of the ground acquired by the imaging device in the first posture (the imaging device attached to the agricultural machine).

- the coordinates of an arbitrary point on the image plane Im1 of the imaging device 120 are converted to the image plane Im2 of a virtual imaging device in a predetermined orientation with respect to the reference plane Re. Can be converted to point coordinates.

- the processing device 122 executes a software program based on the above algorithm to obtain a view of the ground 10 from above from the time-series color images or the preprocessed images of the time-series color images. generates a bird's-eye view image.

- the ground 10 may have irregularities such as ridges, ridges, and grooves. In such cases, the reference plane Re may be displaced upwards from the bottom of such irregularities. The displacement distance can be appropriately set according to the unevenness of the ground 10 on which the crops are planted.

- the attitude of the imaging device 120 changes, so the content of the conversion matrix H1 changes. can.

- the rotation angles of roll and pitch of the vehicle body 110 are measured by the IMU, the transformation matrix H1 and the transformation matrix H can be corrected according to the posture change of the imaging device.

- the processing device 122 in this embodiment classifies the first pixels having the index value of the color of the row of crops above the threshold value and the second pixels having the index value less than the threshold value from above the ground by the above-described method. After generating the seen top view image, operation S3 is performed.

- the processing unit 122 determines the position of the edge line of the crop row based on the index value of the first pixel. Specifically, the index values of the first pixels (pixels whose color index value is equal to or greater than a threshold value) are integrated along a plurality of scanning lines in the top view image.

- FIG. 23 is an example of a top view image 44 in which three crop rows 12 are shown.

- the crop row 12 direction is parallel to the image vertical direction (v-axis direction).

- FIG. 23 shows a large number of scanning lines (broken lines) S parallel to the image vertical direction (v-axis direction).

- the processing device 122 integrates index values of pixels located on a plurality of scanning lines S for each scanning line S to obtain an integrated value.

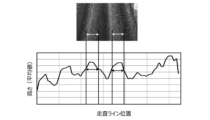

- FIG. 24 is a diagram schematically showing the relationship (histogram of integrated values) between the positions of the scanning lines S and the integrated values of the index values obtained for the top view image of FIG.

- the horizontal axis of FIG. 24 indicates the position of the scanning line S in the image horizontal direction (u-axis direction).

- the integrated value of the scanning line S is large.

- the second pixels (background pixels) belonging to the intermediate area (work path) 14 between the crop rows 12 the integrated value for that scan line S will be small. Note that in this embodiment the intermediate region (working path) 14 is masked and the index value for the second pixel is zero.

- the position of the edge line of each row of crops 12 is the position of the scanning line S having a value that is 80% of the peak of the integrated value of each row of crops 12 .

- the index values of the color of the crop row on each scanning line S are integrated. That is, the number of first pixels (the number of pixels) is not counted for the binarized top view image based on the classification of the first pixels and the second pixels.

- the count value of the first pixel is increases.

- accumulating the index value of the color of the crop row of the first pixels instead of the number of the first pixels suppresses erroneous determination due to fallen leaves and weeds. , to increase the robustness of column detection.

- FIG. 25 is an example of a top view image 44 in which the crop row 12 extends obliquely.

- the direction in which the crop row 12 extends in the image 40 acquired by the imaging device 120 may be slanted to the right or left in the image.

- the direction of the crop row 12 is inclined from the image vertical direction (v-axis direction) as in the example of FIG.

- FIG. 25 also shows a large number of scanning lines (broken lines) S parallel to the image vertical direction (v-axis direction).

- the processor 122 integrates the index values of the pixels positioned on the plurality of scanning lines S for each scanning line S to obtain an integrated value

- a histogram of integrated values as shown in FIG. 26 is obtained.

- FIG. 26 is a diagram schematically showing the relationship between the position of the scanning line S and the integrated value of the index values obtained for the top view image of FIG. From this histogram the edge lines of the crop row 12 cannot be determined.

- FIG. 27 is a flowchart showing an example of a procedure for searching for the direction (angle) of the scanning line S parallel to the direction of the crop row 12 by changing the direction (angle) of the scanning line S.

- step S10 the direction (angle) of the scanning line S is set.

- the clockwise angle is ⁇ with respect to the u-axis in the image coordinate system (see FIGS. 23 and 25).

- the search for the angle ⁇ can be set to a range of, for example, 60 to 120 degrees and an angle step of, for example, 1 degree.

- the angle ⁇ of the scanning line S is given as 60, 61, 62, .

- step S12 index values are integrated for pixels on the scanning line S extending in the direction of each angle ⁇ , and a histogram of integrated values is created. The histogram will show different distributions depending on the angle ⁇ .

- step S14 from the plurality of histograms obtained in this way, a histogram is selected that has a sharp boundary between unevenness as shown in FIG. Find the angle ⁇ of the scan line S that produces .

- step S16 the edge line of each crop row 12 is determined from the peak value of the histogram corresponding to the angle ⁇ obtained in step S14.

- the position of the scan line S having an integrated value of, for example, 0.8 times the peak can be taken as the edge line.

- a histogram of integrated values of the angle ⁇ on the scanning line S may be created.

- a characteristic quantity for example, depth of recess/height of convex portion, envelope differential value, etc. is calculated from the waveform of the histogram, and the direction of the crop row 12 and the direction of the scanning line S are determined based on the characteristic quantity. are parallel or not.

- the method for obtaining the angle ⁇ is not limited to the above example. If the direction in which the crop row extends is known by measurement, the orientation of the agricultural machine may be measured by an inertial measurement unit (IMU) mounted on the agricultural machine 100 to determine the angle ⁇ with respect to the direction in which the crop row extends.

- IMU inertial measurement unit

- FIG. 28 is a diagram showing an example of an integrated value histogram created from the top view image of FIG.

- the position of the edge line E is the position of the scanning line that is 0.8 times the peak value of the convex portion of the histogram located in the center.

- the peak of the convex portion becomes lower and the peak of the convex portion spreads.

- the distortion of the image is small at the center of the top view image, but the distortion of the image increases as the distance from the center to the left and right increases. This is due to the black triangular areas located on both sides of the lowering the integrated value.

- the crop row that should be accurately detected is the center or periphery of the image. Therefore, distortion in regions near the left and right ends of the top view image can be ignored.

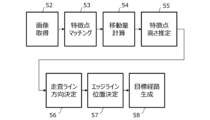

- FIG. 29 is a block diagram showing a series of processes executed by the processing device 122 in this embodiment.

- the processor 122 performs image acquisition 32, enhanced image generation 33, crop row extraction 34, and homography transformation 35 to generate a top view image 44 such as that shown in FIG. Obtainable.

- Processing unit 122 may also perform scanline orientation determination 36 and edgeline location determination 37 to obtain the location of the edgelines of the crop row.

- the processing device 122 or the path generation device that obtains the information indicating the position of the edge line from the processing device 122 can perform the target path generation 38 of the agricultural machine based on the edge line.

- the target path can be generated in such a way that the wheels of the agricultural machine are kept in the intermediate area (workpath) 14 between the edge lines E.

- the target path can be generated such that the widthwise central portion of the tire mounted on the metal wheel passes through the center of two edge lines located at both ends of the intermediate region (working passage) 14 .

- the target route even if the agricultural machine deviates from the target route by several centimeters during travel, it is possible to reduce the possibility that the tires will enter the crop row.

- the embodiments of the present disclosure it is possible to suppress the effects of weather conditions such as front light, backlight, fine weather, cloudy weather, and fog, and sunlight conditions that change depending on the working hours, and to detect crop rows with high accuracy. It was confirmed.

- the crop type cabbage, broccoli, radish, carrot, lettuce, Chinese cabbage, etc.

- growth state from seedling to mature state

- presence of disease presence of fallen leaves/weeds

- robustness even when soil color changes

- the homography transformation is performed after the step of obtaining the threshold value for binarization and extracting the crop area using pixels equal to or higher than the threshold value.

- the step of extracting crop regions may be performed after the homography transformation.

- homography transformation 35 may be performed between enhanced image generation 33 and crop row extraction 34, or between image acquisition 32 and enhanced image generation 33. may be performed between

- the image recognition system 1000 of this embodiment even if part of the crop row is lost at a defect location, the extension line of the target route generated from the edge line used for the row following travel up to that point is obtained, and the extension line is obtained. as the target route. Therefore, the agricultural machine 100 can temporarily travel along the extension line. Further, after the image recognition system 1000 detects the “missing point” or the “end of the field” in the row of crops, the integrated value of the pixel values increases while the running continues, and the integrated value histogram shows a convex area. When it appears, the target path is generated with this convex area as the row area of the new crop row.

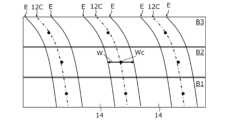

- FIG. 32 is a diagram for explaining a method of dividing part or all of the top view image into a plurality of blocks and determining the position of the edge line for each of the plurality of blocks.

- the processing device 122 divides part or all of the top view image 44 into a plurality of blocks. Then, the position of the edge line E of the crop row 12 is determined for each of the plurality of blocks. In the illustrated example, three blocks B1, B2, and B3 have a belt shape continuous in the horizontal direction of the image in the top view image. The processing device 122 can determine the edge line of the crop row based on the band shape in a direction different from the traveling direction of the agricultural machine 100 .

- FIG. 33 is a diagram schematically showing the relationship (integrated value histogram) between the position of the scanning line S and the integrated index value in each of the blocks B1, B2, and B3 of the top view image in FIG.

- the scanning line S when performing integration is always parallel to the image vertical direction.

- the index values are integrated block by block, and the direction (angle) of the scanning line S does not need to be changed.

- Both ends of the arrow W in FIG. 33 indicate the positions of the edge lines of the rows of crops determined in each of the blocks B1, B2, and B3.

- the crop row 12 direction is slanted with respect to the scan line S direction. Therefore, as described above, when a scanning line position showing a value 0.8 times the peak value of the integrated value histogram is adopted as the position of the edge line E of the crop row 12, such an edge line E corresponds to both ends of the "width" passing near the center of the crop row 12 in each of the blocks B1, B2, and B3.

- FIG. 34 shows the crop row center Wc in each of blocks B1, B2, and B3 in FIG.

- the crop row center Wc is obtained from the center of the arrow W that defines the edge line of the crop row obtained from the integrated value histogram of FIG. 33, and is located at the center of each block in the image vertical direction.

- FIG. 34 shows an example of the approximation line 12C for the crop row center Wc belonging to the same crop row 12.

- the approximation line 12C is, for example, a straight line obtained so as to minimize the root mean square distance (error) from the plurality of crop row centers Wc of each crop row 12 .

- Such an approximation line 12C corresponds to a line passing through the center of the crop row 12.

- FIG. 34 shows the crop row center Wc in each of blocks B1, B2, and B3 in FIG.

- the crop row center Wc is obtained from the center of the arrow W that defines the edge line of the crop row obtained from the integrated value histogram of FIG. 33, and is located

- FIG. 35 is a top view showing an example of the edge line E of the row of crops 12 determined from the approximation line 12C of FIG.

- the two edge lines E associated with each crop row 12 are spaced equal to the length of the arrow W and equidistant from the approximation line 12C.

- the edge line E of the crop row 12 can be obtained with a smaller amount of calculation without changing the direction (angle) of the scanning line.

- the length of each block in the image vertical direction can be set to correspond to a distance of 1 to 2 meters on the ground, for example.

- one image is divided into three blocks to obtain the integrated value histogram, but the number of blocks may be four or more.

- the shape of the block is not limited to the above example.

- a block can have a strip shape that is continuous in either the horizontal direction of the image or the vertical direction of the image in the top view image.

- the processing device 122 can divide the crop into strip-shaped blocks extending in a direction different from the traveling direction of the agricultural machine 100 and determine the edge line of the row of crops.

- FIG. 36 schematically shows how the crop row 12 of the top view image 44 includes a curved portion.

- FIG. 37 schematically shows integrated value histograms in each of the blocks B1, B2, and B3 of the top view image 44 of FIG.

- FIG. 38 is a diagram showing an example of the crop row center Wc in each of the blocks B1, B2, and B3 in FIG. 37 and the approximation line 12C for each crop row center Xc.

- the approximation line 12C in this example is, for example, a curve obtained so as to minimize the root mean square of the distance (error) of each crop row 12 from the crop row center Wc (for example, a higher-order curve such as a cubic curve). is.

- Such approximate line 12C corresponds to a curved line passing through the center of crop row 12 having curved portions.

- FIG. 39 is a top view showing an example of the edge line E of the row of crops 12 determined from the approximation line of FIG.

- Edge line E is generated in a manner similar to that described with reference to FIG. That is, the two edge lines E associated with each row of crops 12 are spaced equal to the length of the arrow W and equidistant from the approximation line 12C.

- the top view image is divided into a plurality of blocks and a histogram of integrated values is generated for each block, it becomes easier to determine the direction of the crop row, and the direction of the crop row can be easily obtained. Even if the direction changes on the way, it becomes possible to know the changed direction.

- Any of the above column detection methods can be implemented by being implemented in a computer and causing the computer to perform desired operations.

- the image recognition system 1000 can move along the crop row during temporary running until it stops. It becomes possible to maintain proper row-following running on a straight line or a curve.

- low position accuracy detection processing may be performed.

- This low positional accuracy detection process may be, for example, a process targeting some images selected from the time-series images acquired by the imaging device 120 .

- the number of scanning lines is increased, the length of each block in the vertical direction of the image is reduced, or the number of blocks is increased, thereby starting detection processing with improved positional accuracy. It is desirable to After the row area is detected and it is determined that row tracing traveling is possible, the operator issues a command to start row tracing traveling with the start switch 112, and then the detection processing with improved accuracy is started. good.

- the computational load of the processing device 122 can be effectively reduced.

- the above blocks can be set within a region (region of interest) selected from the image to determine row detection.

- image recognition system 1000 selects a region of interest to be subjected to image recognition processing, and performs processing to make the region of interest during row tracing traveling smaller than the region of interest before row following traveling. may Specifically, during row scanning, a relatively narrow range including the row region to be scanned may be selected as the region of interest.

- FIG. 40 is a perspective view schematically showing rows of ridges 16 provided on the ground 10.

- FIG. "Ridge” is a place where plants are planted for streaking or streaking, and is a convex portion that extends in a substantially straight line, with soil piled high at intervals.

- the cross-sectional shape of the ridges 16, perpendicular to the direction in which the ridges 16 extend, can be generally trapezoidal, semicylindrical, or semicircular.

- a ridge 16 having a trapezoidal cross-section is schematically depicted. Real ridges do not have a simple shape as shown in FIG. Between two adjacent ridges 16 is an intermediate region 14, called a ridge.

- the intermediate area 14 functions as a working passageway.

- the ridges 16 may be planted with crops or may be unplanted, with only the soil exposed as a whole. Also, each of the ridges 16 may be covered with mulch.

- the height, width and spacing of the ridges 16 do not need to be uniform and may vary from place to place.

- the height of the ridges 16 is generally the difference in height between the ridges.

- the “height” of the ridges 16 is defined by the distance from the reference plane Re described above to the top surface of each ridge 16 .

- the edge lines of the ridges 16 are clear. However, since the actual ridge 16 is a part of the ground 10 that is continuous from the intermediate region 14, and the "cross-sectional shape" of the ridge 16 varies as described above, the boundary between the ridge 16 and the intermediate region 14 is Not always clear.

- the edge lines of the ridges 16, i.e., the boundaries between the ridges 16 and the intermediate regions 14, are located on both sides of the peak of each ridge 16 and have a height that is a predetermined percentage of the peak. defined as a position. The position of the edge line is, for example, 0.8 times the height of the peak of each ridge 16 .

- the image recognition system 1000 also includes an imaging device 120 and a processing device 122 that performs image processing on time-series color images acquired from the imaging device 120, as shown in FIG.

- the hardware configuration of the processing device 122 is the same as the configuration of the processing device 122 in the first embodiment.

- the processing device 122 acquires time-series images from the imaging device 120 and performs operations S21, S22, and S23 described below.

- S21 From a plurality of images acquired at different times of the time-series images, a first movement amount within the image plane is obtained for each of the plurality of feature points by feature point matching.