WO2014050748A1 - 符号化装置および符号化方法、並びに、復号装置および復号方法 - Google Patents

符号化装置および符号化方法、並びに、復号装置および復号方法 Download PDFInfo

- Publication number

- WO2014050748A1 WO2014050748A1 PCT/JP2013/075518 JP2013075518W WO2014050748A1 WO 2014050748 A1 WO2014050748 A1 WO 2014050748A1 JP 2013075518 W JP2013075518 W JP 2013075518W WO 2014050748 A1 WO2014050748 A1 WO 2014050748A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- information

- reference image

- unit

- image

- encoding

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/53—Multi-resolution motion estimation; Hierarchical motion estimation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/30—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/44—Decoders specially adapted therefor, e.g. video decoders which are asymmetric with respect to the encoder

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/593—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving spatial prediction techniques

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/597—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding specially adapted for multi-view video sequence encoding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/90—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using coding techniques not provided for in groups H04N19/10-H04N19/85, e.g. fractals

- H04N19/91—Entropy coding, e.g. variable length coding [VLC] or arithmetic coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/90—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using coding techniques not provided for in groups H04N19/10-H04N19/85, e.g. fractals

- H04N19/96—Tree coding, e.g. quad-tree coding

Definitions

- the present technology relates to an encoding device and an encoding method, and a decoding device and a decoding method, and in particular, an encoding device and an encoding method that can share or predict information related to a reference image of an image having a hierarchical structure.

- the present invention relates to a method, a decoding apparatus, and a decoding method.

- MPEG compressed by orthogonal transform such as discrete cosine transform and motion compensation is used for the purpose of efficient transmission and storage of information.

- a device compliant with a method such as Moving (Pictures Experts Group) phase) is becoming popular in both information distribution at broadcast stations and information reception in general households.

- the MPEG2 (ISO / IEC 13818-2) system is defined as a general-purpose image encoding system, and is a standard that covers both interlaced and progressively scanned images, standard resolution images, and high-definition images. Widely used in a wide range of applications for consumer and consumer applications.

- a standard resolution interlaced scanning image having 720 ⁇ 480 pixels is 4 to 8 Mbps

- a high resolution interlaced scanning image having 1920 ⁇ 1088 pixels is 18 to 22 MBps.

- MPEG2 was mainly intended for high-quality encoding suitable for broadcasting, but it did not support encoding methods with a lower code amount (bit rate) than MPEG1, that is, a higher compression rate. With the widespread use of mobile terminals, the need for such an encoding system is expected to increase in the future, and the MPEG4 encoding system has been standardized accordingly. Regarding the MPEG4 image coding system, the standard was approved as an international standard in December 1998 as ISO / IEC 14496-2.

- 26L (ITU-T Q6 / 16 VCEG) is being standardized.

- H. 26L is known to achieve higher encoding efficiency than the conventional encoding schemes such as MPEG2 and MPEG4, although a large amount of calculation is required for encoding and decoding.

- H.264 Based on 26L, H. Standardization that incorporates functions that are not supported by 26L and achieves higher coding efficiency is performed as Joint® Model of Enhanced-Compression® Video® Coding. This standardization was implemented in March 2003 by H.C. It was internationally standardized under the names of H.264 and MPEG-4 Part10 (AVC (Advanced Video Coding)).

- AVC Advanced Video Coding

- HECT High Efficiency Video Coding

- JCTVC Joint Collaboration Collaboration Team Video Coding

- image encoding methods such as MPEG-2 and AVC have a scalable function for hierarchically encoding images. According to the scalable function, it is possible to transmit encoded data according to the processing capability on the decoding side without performing transcoding processing.

- an encoded stream of an image of a base layer (base layer) that is a base layer can be transmitted to a terminal having a low processing capability such as a mobile phone.

- an encoded stream of an image of a base layer and an enhancement layer (enhancement layer) that is a layer other than the base layer may be transmitted to a terminal having high processing capability such as a television receiver or a personal computer. it can.

- the HEVC method also has a scalable function. As described in Non-Patent Document 1, in the HEVC method, in addition to SPS (Sequence Parameter Set) and PPS (Picture Parameter Set), parameters related to the scalable function VPS (Video Parameter Set) is included.

- SPS Sequence Parameter Set

- PPS Physical Parameter Set

- Fig. 1 is a diagram showing an example of the syntax of VPS in HEVC version 1.

- VPS defines only parameters related to temporal scalability as shown in Fig. 1. Has been.

- HEVC version 2 standardization is planned to support scalable functions other than temporal scaleability.

- the present technology has been made in view of such a situation, and makes it possible to share or predict information related to a reference image of an image having a hierarchical structure.

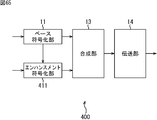

- the encoding device includes first reference image information that is information related to a first reference image used when encoding an image of a first layer of an image having a hierarchical structure, A setting unit configured to set reference image generation information used to generate the first reference image information using second reference image information that is information related to a second reference image of the images of the second hierarchy; An image of one layer is encoded using the first reference image, and an encoding unit that generates encoded data, the encoded data generated by the encoding unit, and the setting unit are set And a transmission unit that transmits the reference image generation information.

- the encoding method according to the first aspect of the present technology corresponds to the encoding device according to the first aspect of the present technology.

- first reference image information that is information relating to a first reference image used when encoding an image of a first layer of an image having a hierarchical structure

- a second layer Reference image generation information used for generating the first reference image information is set using second reference image information that is information related to the second reference image of the first image

- the first layer image is Encoding is performed using the first reference image to generate encoded data, and the encoded data and the reference image generation information are transmitted.

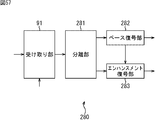

- the decoding device includes first reference image information that is information relating to a first reference image used when encoding an image of a first layer of an image having a hierarchical structure, Reference image generation information used for generating the first reference image information generated using second reference image information that is information related to the second reference image of the image of the first layer, and the first layer Based on a receiving unit that receives encoded data of an image, a generating unit that generates the first reference image information using the reference image generation information, and the first reference image information generated by the generating unit And a decoding unit that decodes the encoded data of the first layer image using the first reference image.

- the decoding method according to the second aspect of the present technology corresponds to the decoding device according to the second aspect of the present technology.

- first reference image information that is information relating to a first reference image used when encoding an image of a first layer of an image having a hierarchical structure

- second layer Reference image generation information used for generating the first reference image information generated using the second reference image information that is information related to the second reference image of the first image

- the first layer image Encoded data is received, the first reference image information is generated using the reference image generation information, and the code of the first layer image is generated based on the generated first reference image information.

- Data is decoded using the first reference picture.

- the encoding device according to the first aspect and the decoding device according to the second aspect can be realized by causing a computer to execute a program.

- a program to be executed by a computer is transmitted through a transmission medium or recorded on a recording medium, Can be provided.

- the encoding device of the first aspect and the decoding device of the second aspect may be independent devices, or may be internal blocks constituting one device.

- FIG. 32 is a block diagram illustrating a configuration example of a reference image setting unit in FIG. 31. It is a flowchart explaining the hierarchical decoding process of the decoding apparatus of FIG. It is a flowchart explaining the enhancement image generation process of FIG. It is a flowchart explaining the detail of the decoding process of FIG. It is a flowchart explaining the detail of the production

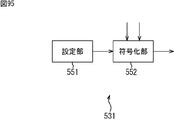

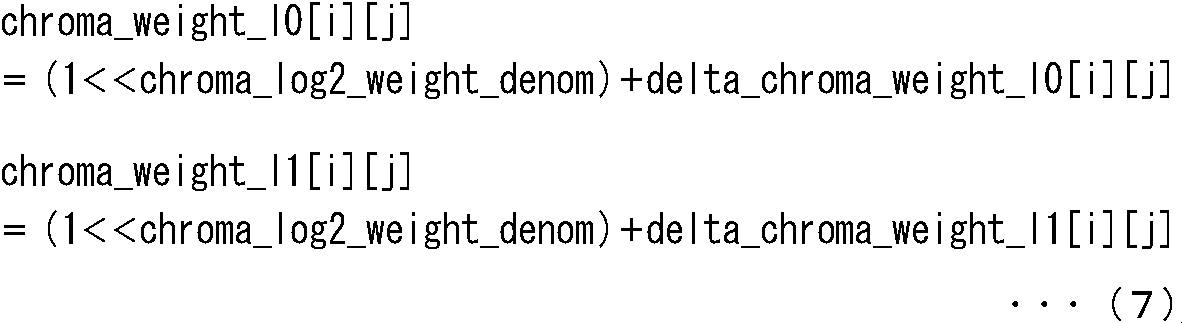

- FIG. 49 is a block diagram illustrating a configuration example of an encoding unit in FIG. 48. It is a block diagram which shows the structural example of the weight buffer of FIG. 49, and a weight setting part. It is a figure which shows the example of the syntax of the weighting information of an enhancement stream. It is a figure which shows the example of the syntax of the weighting information of an enhancement stream.

- FIG. 49 is a flowchart for describing enhancement stream generation processing of FIG. 48. It is a flowchart explaining the detail of the encoding process of FIG. It is a flowchart explaining the detail of the encoding process of FIG. 55 is a flowchart for describing details of the generation processing of FIG. 54. It is a block diagram which shows the structural example of 2nd Embodiment of the decoding apparatus to which this technique is applied.

- FIG. 58 is a block diagram illustrating a configuration example of an enhancement decoding unit in FIG. 57.

- FIG. 59 is a block diagram illustrating a configuration example of a decoding unit in FIG. 58.

- FIG. 60 is a block diagram illustrating a configuration example of a weight buffer and a weight setting unit in FIG. 59.

- FIG. 58 is a flowchart for describing hierarchical decoding processing of the decoding device in FIG. 57.

- 60 is a flowchart for describing details of a decoding process of the decoding unit in FIG. 59.

- 63 is a flowchart for describing details of the generation processing in FIG. 62. It is a figure explaining the outline

- FIG. 66 is a block diagram illustrating a configuration example of an enhancement encoding unit in FIG. 65.

- FIG. 67 is a block diagram illustrating a configuration example of an encoding unit in FIG. 66.

- FIG. 67 is a diagram illustrating an example of SPS syntax set by the setting unit of FIG. 66. It is a figure which shows the example of the syntax of the slice header of an enhancement stream. It is a figure explaining the effect in an encoding apparatus.

- Fig. 66 is a flowchart for describing hierarchical encoding processing of the encoding device in Fig. 65.

- FIG. 72 is a flowchart for describing details of an SPS setting process in the hierarchical encoding process of FIG. 71.

- FIG. FIG. 72 is a flowchart illustrating details of a copy flag setting process in the enhancement encoding process of FIG. 71.

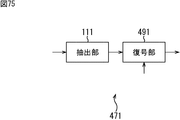

- FIG. 75 is a block diagram illustrating a configuration example of an enhancement decoding unit in FIG. 74.

- FIG. 76 is a block diagram illustrating a configuration example of a decoding unit in FIG. 75.

- FIG. 75 is a flowchart for describing enhancement image generation processing of an enhancement decoding unit in FIG. 74.

- FIG. 78 is a flowchart for describing details of the SPS extraction processing of FIG. 77.

- 78 is a flowchart for describing details of generation processing in the enhancement decoding processing of FIG. 77. It is a figure which shows the example of the syntax of SPS at the time of another copy flag setting.

- FIG. 1 shows the example of the syntax of the slice header of the enhancement stream at the time of setting mode use. It is a flowchart explaining the SPS setting process at the time of setting mode use. It is a flowchart explaining the copy flag setting process at the time of setting mode use. It is a flowchart explaining the SPS extraction process at the time of setting mode use. It is a flowchart explaining the production

- FIG. 95 is a block diagram illustrating a configuration example of an enhancement encoding unit in FIG. 94.

- FIG. 96 is a block diagram illustrating a configuration example of an encoding unit in FIG. 95.

- FIG. 96 is a diagram illustrating an example of SPS syntax set by the setting unit in FIG. 95. It is a figure which shows the example of the syntax of the slice header of an enhancement stream. It is a figure which shows the example of the syntax of RPS for a partial RPS copy flag.

- FIG. 95 is a flowchart for describing SPS setting processing of the encoding device in FIG. 94.

- FIG. FIG. 95 is a flowchart for describing details of a copy flag setting process of the encoding device in FIG. 94.

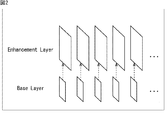

- FIG. 2 is a diagram for explaining spatial scalability.

- spatial scalability is a scalable function that encodes an image by layering it at a spatial resolution.

- a low resolution image is encoded as a base layer image

- a difference image between the high resolution image and the low resolution image is encoded as an enhancement layer image.

- the encoding device transmits only the encoded data of the base layer image to the decoding device with low processing capability, so that the decoding device can generate a low-resolution image. Further, the encoding device transmits the encoded data of the base layer and enhancement layer images to the decoding device having high processing capability, so that the decoding device decodes and synthesizes the base layer and enhancement layer images. High-resolution images can be generated.

- FIG. 3 is a diagram for explaining temporal scalability.

- temporal scalability is a scalable function that encodes images by layering them at the frame rate.

- an image with a low frame rate (7.5 fps in the example of FIG. 3) is encoded as a base layer image.

- a difference image between the image at the medium frame rate (15 fps in the example of FIG. 3) and the image at the low frame rate is encoded as an enhancement layer image.

- the difference image between the image at the high frame rate (30 fps in the example of FIG. 3) and the image at the medium frame rate is encoded as an enhancement layer image.

- the encoding device transmits only the encoded data of the base layer image to the decoding device with low processing capability, so that the decoding device can generate a low frame rate image. Further, the encoding device transmits the encoded data of the base layer and enhancement layer images to the decoding device having high processing capability, so that the decoding device decodes and synthesizes the base layer and enhancement layer images. High frame rate or medium frame rate images can be generated.

- FIG. 4 is a diagram for explaining SNR scalability.

- SNR scalability is a scalable function that encodes an image by layering it with SNR (signal-noise ratio). Specifically, in SNR scalability, a low SNR image is encoded as a base layer image, and a difference image between a high SNR image and a low SNR image is encoded as an enhancement layer image.

- the encoding device transmits only the encoded data of the base layer image to the decoding device with low processing capability, so that the decoding device can generate a low SNR image, that is, a low quality image. it can. Further, the encoding device transmits the encoded data of the base layer and enhancement layer images to the decoding device having high processing capability, so that the decoding device decodes and synthesizes the base layer and enhancement layer images.

- a high SNR image that is, a high-quality image can be generated.

- bit-depth scalability for encoding an image by layering the number of bits.

- an 8-bit video image is used as a base layer image

- a difference between a 10-bit video image and an 8-bit video image is used as an enhancement layer image and encoded.

- the YUV420 image is set as the base layer image

- the difference image between the YUV422 image and the YUV420 image is set as the enhancement layer image and encoded.

- FIG. 5 is a diagram illustrating an overview of the first embodiment to which the present technology is applied.

- reference image specifying information information for specifying a reference image as information about a reference image (hereinafter referred to as reference image specifying information) is shared between different hierarchies as well as between the same hierarchies. is expected.

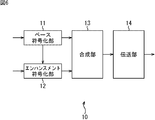

- FIG. 6 is a block diagram illustrating a configuration example of the first embodiment of the encoding device to which the present technology is applied.

- the 6 includes a base encoding unit 11, an enhancement encoding unit 12, a synthesizing unit 13, and a transmission unit 14, and encodes an image using a scalable function in accordance with a scheme equivalent to the HEVC scheme.

- a base layer image (hereinafter referred to as a base image) is input to the base encoding unit 11 of the encoding device 10 from the outside.

- the base encoding unit 11 is configured in the same manner as a conventional HEVC encoding device, and encodes a base image using the HEVC method.

- the base encoding unit 11 supplies the reference image specifying information of the reference image used when encoding the base image to the enhancement encoding unit 12.

- the base encoding unit 11 supplies an encoded stream including encoded data, SPS, PPS, and the like obtained as a result of encoding to the synthesizing unit 13 as a base stream.

- the enhancement coding unit 12 receives an enhancement layer image (hereinafter referred to as an enhancement image) from the outside.

- the enhancement encoding unit 12 encodes the enhancement image by a method according to the HEVC method.

- the enhancement encoding unit 12 uses the reference image specifying information of the base image and the reference image specifying information of the reference image used when encoding the enhancement image to generate reference image specifying information of the enhancement image.

- Reference image specific generation information reference image generation information

- the enhancement encoding unit 12 generates an encoded stream by adding reference image specifying generation information or the like to the encoded data of the enhancement image, and supplies the encoded stream to the synthesizing unit 13 as an enhancement stream.

- the synthesizing unit 13 synthesizes the base stream supplied from the base encoding unit 11 and the enhancement stream supplied from the enhancement encoding unit 12, and adds a VPS or the like to generate an encoded stream of all layers.

- the synthesizing unit 13 supplies the encoded stream of all layers to the transmission unit 14.

- the transmission unit 14 transmits the encoded stream of all layers supplied from the synthesis unit 13 to a decoding device described later.

- the encoding apparatus 10 shall transmit the encoding stream of all the layers here, it can also transmit only a base stream as needed.

- Example of base stream SPS syntax 7 and 8 are diagrams illustrating examples of SPS syntax included in the base stream.

- the SPS of the base stream relates to RPS (reference picture set) that is reference picture specifying information of a short term of a GOP (Group of picture) corresponding to the SPS. Contains information. Specifically, the SPS includes the number of RPSs (num_short_term_ref_pic_sets) included in the SPS and RPS (short_term_ref_pic_set). An index is assigned to RPS in order from 0.

- the SPS describes information related to long-term reference image specifying information. Specifically, the SPS includes a long-term flag (long_term_ref_pics_present_flag) indicating whether or not a long-term reference image is usable.

- long_term_ref_pics_present_flag indicating whether or not a long-term reference image is usable.

- the SPS when the long-term flag is 1 indicating that a long-term reference image is usable, the SPS includes the number of long-term reference image specifying information (num_long_term_ref_pics_sps) included in the SPS. Also included is information (lt_ref_pic_poc_lsb_sps) indicating the least significant bit of the POC (Picture Order Count) of the reference image as long term reference image specifying information. Furthermore, a reference flag (used_by_curr_pic_lt_sps_flag) indicating whether or not the reference image specified by the reference image specifying information is not referred to by itself is described. An index is assigned to the reference image specifying information of long term in order from 0.

- reference image specifying information when it is not necessary to particularly distinguish the RPS and long-term reference image specifying information, they are simply referred to as reference image specifying information.

- Example of syntax of slice header of base stream 9 to 11 are diagrams illustrating an example of syntax of a slice header that is a header added to encoded data included in a base stream in units of slices.

- the slice header of the base stream includes an RPS flag (short_term_ref_pic_set_sps_flag) indicating that the RPS of the corresponding slice is an RPS included in the SPS.

- RPS flag short_term_ref_pic_set_sps_flag

- the RPS flag is 0 indicating that the RPS of the corresponding slice is not the RPS included in the SPS

- the RPS of the corresponding slice is included in the slice header.

- RPS short_term_ref_pic_set (num_short_term_ref_pic_sets)

- whose index is num_short_term_ref_pic_sets.

- the slice header has an RPS index ( short_term_ref_pic_set_idx).

- the long term flag included in the corresponding SPS is 1, the number of reference image specifying information of the long term included in the SPS is indicated in the slice header.

- the number within SPS (num_long_term_sps) and the number outside SPS (num_long_term_pics), which is the number of long-term reference image specifying information included in the slice header, are included.

- the index (lt_idx_sps) of the long-term reference image specifying information included in the SPS among the long-term reference image specifying information in the corresponding slice. Is included.

- the slice header includes a reference image as long-term reference image specifying information not included in the SPS among the long-term reference image specifying information in the corresponding slice.

- Information (poc_lsb_sps) indicating the least significant bit of the POC and a reference flag (used_by_curr_pic_lt_flag) are included.

- FIG. 12 is a diagram illustrating an example of RPS syntax of a base stream.

- the RPS includes inter_ref_pic_set_prediction_flag.

- inter_ref_pic_set_prediction_flag indicates whether the reference image specifying information of the previous image that is an image preceding the encoding target image in the GOP of the encoding target image is used as the reference image specifying information of the encoding target image. Reference information to be shown.

- the reference information is 1 when indicating that the reference image specifying information of the previous image is used as the reference image specifying information of the encoding target image, and the reference image specifying information of the previous image is used as the reference image specifying information of the encoding target image. 0 indicates that it is not used.

- the RPS includes the previous image specifying information (delta_idx_minus1) for specifying the previous image.

- delta_idx_minus1 is a value obtained by subtracting 1 from the value obtained by subtracting the encoding number of the previous image from the encoding number (Coding Order) of the encoding target image.

- the encoding number is a number assigned to each image in the GOP from a small value in the encoding order.

- the RPS includes the difference between the reference image specifying information (POC) of the previous image and the reference image specifying information (POC) of the encoding target image.

- the sign (delta_rps_sign) and the absolute value of the difference (abs_delta_rps_minus1) are included.

- the RPS includes a flag (used_by_curr_pic_lt_flag) indicating whether or not to use the reference image specified by the reference image specifying information. Also, as shown in the 10th and 11th lines, when the flag (used_by_curr_pic_lt_flag) is 0 indicating that the reference image specified by the reference image specifying information is not used, the reference image is the RPS. A flag (use_delta_flag) indicating whether or not it is included is included.

- the RPS includes information indicating the number of reference images, POC, and the like.

- FIG. 13 is a block diagram illustrating a configuration example of the enhancement encoding unit 12 of FIG.

- the enhancement encoding unit 12 in FIG. 13 includes an encoding unit 21 and a setting unit 22.

- the encoding unit 21 of the enhancement encoding unit 12 uses an enhancement image for each frame input from the outside as an input signal.

- the encoding unit 21 encodes the input signal by a method according to the HEVC method with reference to the reference image specifying information from the base encoding unit 11, the reference image specifying generation information from the setting unit 22, and the like.

- the encoding unit 21 supplies the encoded data obtained as a result to the setting unit 22.

- the setting unit 22 sets reference image specific generation information.

- reference image specification generation information an index is assigned in order from 0 to the difference between the reference image specification information and the reference image specification information.

- the setting unit 22 supplies the reference image specifying generation information to the encoding unit 21.

- the setting unit 22 sets SPS, PPS, and the like including reference image specific generation information.

- the setting unit 22 generates an encoded stream from the set SPS and PPS and the encoded data supplied from the encoding unit 21, and supplies the encoded stream to the synthesizing unit 13 as an enhancement stream.

- FIG. 14 is a block diagram illustrating a configuration example of the encoding unit 21 in FIG. 13.

- a / D conversion unit 31 includes an A / D conversion unit 31, a screen rearrangement buffer 32, a calculation unit 33, an orthogonal transformation unit 34, a quantization unit 35, a lossless encoding unit 36, an accumulation buffer 37, and an inverse quantization unit. 38, inverse orthogonal transform unit 39, addition unit 40, deblock filter 41, adaptive offset filter 42, adaptive loop filter 43, frame memory 44, switch 45, intra prediction unit 46, motion prediction / compensation unit 47, prediction image selection unit 48, a reference buffer 49, a reference image setting unit 50, and a rate control unit 51.

- the A / D conversion unit 31 of the encoding unit 21 performs A / D conversion on an image in frame units input as an input signal, and outputs and stores the image in the screen rearrangement buffer 32.

- the screen rearrangement buffer 32 rearranges the stored frame-by-frame images in the order for encoding according to the GOP structure, the arithmetic unit 33, the intra prediction unit 46, and the motion prediction / compensation unit. Output to 47.

- the calculation unit 33 functions as an encoding unit, and performs encoding by calculating the difference between the predicted image supplied from the predicted image selection unit 48 and the image to be encoded output from the screen rearrangement buffer 32. . Specifically, the calculation unit 33 performs encoding by subtracting the predicted image supplied from the predicted image selection unit 48 from the encoding target image output from the screen rearrangement buffer 32. The computing unit 33 outputs the resulting image to the orthogonal transform unit 34 as residual information. When the predicted image is not supplied from the predicted image selection unit 48, the calculation unit 33 outputs the image read from the screen rearrangement buffer 32 as it is to the orthogonal transform unit 34 as residual information.

- the orthogonal transform unit 34 performs orthogonal transform on the residual information from the calculation unit 33 and supplies the generated orthogonal transform coefficient to the quantization unit 35.

- the quantization unit 35 quantizes the orthogonal transform coefficient supplied from the orthogonal transform unit 34 and supplies the resulting coefficient to the lossless encoding unit 36.

- the lossless encoding unit 36 acquires information indicating the optimal intra prediction mode (hereinafter referred to as intra prediction mode information) from the intra prediction unit 46. Further, the lossless encoding unit 36 acquires information indicating the optimal inter prediction mode (hereinafter referred to as inter prediction mode information), a motion vector, and the like supplied from the motion prediction / compensation unit 47 from the motion prediction / compensation unit 47. Further, the lossless encoding unit 36 acquires reference image specifying generation information, an RPS flag, and the like from the reference image setting unit 50.

- the lossless encoding unit 36 acquires offset filter information regarding the offset filter from the adaptive offset filter 42 and acquires filter coefficients from the adaptive loop filter 43.

- the lossless encoding unit 36 performs variable length coding (for example, CAVLC (Context-Adaptive Variable Length Length Coding)) and arithmetic coding (for example, CABAC) on the quantized coefficients supplied from the quantization unit 35. (Context-Adaptive

- variable length coding for example, CAVLC (Context-Adaptive Variable Length Length Coding)

- CABAC arithmetic coding

- the lossless encoding unit 36 uses intra prediction mode information or inter prediction mode information, a motion vector, reference image specifying generation information, an RPS flag, offset filter information, and a filter coefficient as encoding information related to encoding. Lossless encoding.

- the lossless encoding unit 36 adds the slice header to the encoded data using the lossless encoded information as a slice header and the lossless encoded coefficient as encoded data.

- the lossless encoding unit 36 supplies the encoded data to which the slice header is added to the accumulation buffer 37 for accumulation.

- the accumulation buffer 37 temporarily stores the encoded data supplied from the lossless encoding unit 36. Further, the accumulation buffer 37 supplies the stored encoded data to the setting unit 22 in FIG.

- the quantized coefficient output from the quantizing unit 35 is also input to the inverse quantizing unit 38.

- the inverse quantization unit 38 performs inverse quantization on the coefficient quantized by the quantization unit 35, and supplies the orthogonal transform coefficient obtained as a result to the inverse orthogonal transform unit 39.

- the inverse orthogonal transform unit 39 performs fourth-order inverse orthogonal transform on the orthogonal transform coefficient supplied from the inverse quantization unit 38 and supplies residual information obtained as a result to the addition unit 40.

- the addition unit 40 adds the residual information supplied from the inverse orthogonal transform unit 39 and the prediction image supplied from the prediction image selection unit 48 to obtain a locally decoded image.

- the adding unit 40 sets the residual information supplied from the inverse orthogonal transform unit 39 as a locally decoded image.

- the adder 40 supplies the locally decoded image to the deblocking filter 41 and also supplies it to the frame memory 44 for accumulation.

- the deblocking filter 41 performs adaptive deblocking filter processing for removing block distortion on the locally decoded image supplied from the adding unit 40 and supplies the resulting image to the adaptive offset filter 42. .

- the adaptive offset filter 42 performs an adaptive offset filter (SAO (Sample adaptive offset)) process that mainly removes ringing on the image after the adaptive deblock filter process by the deblock filter 41.

- SAO Sample adaptive offset

- the adaptive offset filter 42 determines the type of adaptive offset filter processing for each LCU (Largest Coding Unit) which is the maximum coding unit, and obtains an offset used in the adaptive offset filter processing.

- the adaptive offset filter 42 performs the determined type of adaptive offset filter processing on the image after the adaptive deblocking filter processing, using the obtained offset. Then, the adaptive offset filter 42 supplies the image after the adaptive offset filter processing to the adaptive loop filter 43.

- the adaptive offset filter 42 has a buffer for storing the offset.

- the adaptive offset filter 42 determines whether the offset used for the adaptive offset filter processing is already stored in the buffer for each LCU.

- the adaptive offset filter 42 determines that the offset used for the adaptive offset filter processing is already stored in the buffer, the adaptive offset filter 42 stores a storage flag indicating whether the offset is stored in the buffer, and the offset is stored in the buffer. Is set to a value (in this case, 1).

- the adaptive offset filter 42 stores, for each LCU, a storage flag set to 1, an index indicating the storage position of the offset in the buffer, and type information indicating the type of adaptive offset filter processing that has been performed. To the lossless encoding unit 36.

- the adaptive offset filter 42 stores the offset in the buffer.

- the adaptive offset filter 42 sets the storage flag to a value (in this case, 0) indicating that the offset is not stored in the buffer. Then, the adaptive offset filter 42 supplies the storage flag, offset, and type information set to 0 to the lossless encoding unit 36 as offset filter information for each LCU.

- the adaptive loop filter 43 is configured by, for example, a two-dimensional Wiener filter.

- the adaptive loop filter 43 performs an adaptive loop filter (ALF (Adaptive Loop Filter)) process for each LCU, for example, on the image after the adaptive offset filter process supplied from the adaptive offset filter 42.

- ALF Adaptive Loop Filter

- the adaptive loop filter 43 is configured so that the residual of the original image that is the image output from the screen rearrangement buffer 32 and the image after the adaptive loop filter processing is minimized for each LCU. A filter coefficient used in the processing is calculated. Then, the adaptive loop filter 43 performs adaptive loop filter processing for each LCU using the calculated filter coefficient on the image after the adaptive offset filter processing.

- the adaptive loop filter 43 supplies the image after the adaptive loop filter processing to the frame memory 44.

- the adaptive loop filter 43 supplies the filter coefficient to the lossless encoding unit 36.

- the adaptive loop filter processing is performed for each LCU, but the processing unit of the adaptive loop filter processing is not limited to the LCU. However, the processing can be efficiently performed by combining the processing units of the adaptive offset filter 42 and the adaptive loop filter 43.

- the frame memory 44 stores the image supplied from the adaptive loop filter 43 and the image supplied from the adder 40.

- the image stored in the frame memory 44 is output as a reference image to the intra prediction unit 46 or the motion prediction / compensation unit 47 via the switch 45.

- the intra prediction unit 46 uses the reference image read from the frame memory 44 via the switch 45 to perform intra prediction processing for all candidate intra prediction modes.

- the intra prediction unit 46 calculates cost function values for all candidate intra prediction modes based on the image read from the screen rearrangement buffer 32 and the predicted image generated as a result of the intra prediction process. (Details will be described later). Then, the intra prediction unit 46 determines the intra prediction mode that minimizes the cost function value as the optimal intra prediction mode.

- the intra prediction unit 46 supplies the predicted image generated in the optimal intra prediction mode and the corresponding cost function value to the predicted image selection unit 48.

- the intra prediction unit 46 supplies the intra prediction mode information to the lossless encoding unit 36 when the prediction image selection unit 48 is notified of selection of a prediction image generated in the optimal intra prediction mode.

- the cost function value is also called RD (Rate Distortion) cost. It is calculated based on a method of either High Complexity mode or Low Complexity mode as defined by JM (Joint Model) which is reference software in the H.264 / AVC format. H. Reference software in the H.264 / AVC format is published at http://iphome.hhi.de/suehring/tml/index.htm.

- D is the difference (distortion) between the original image and the decoded image

- R is the generated code amount including even the coefficient of orthogonal transformation

- ⁇ is the Lagrange undetermined multiplier given as a function of the quantization parameter QP.

- D is the difference (distortion) between the original image and the predicted image

- Header_Bit is the code amount of the encoding information

- QPtoQuant is a function given as a function of the quantization parameter QP.

- the motion prediction / compensation unit 47 performs motion prediction / compensation processing for all candidate inter prediction modes. Specifically, the motion prediction / compensation unit 47 selects all candidate inter prediction modes based on the image supplied from the screen rearrangement buffer 32 and the reference image read from the frame memory 44 via the switch 45. The motion vector is detected. The reference image is set by a user, for example. The motion prediction / compensation unit 47 performs compensation processing on the reference image based on the detected motion vector, and generates a predicted image.

- the motion prediction / compensation unit 47 calculates the cost function value for all candidate inter prediction modes based on the image and the predicted image supplied from the screen rearrangement buffer 32, and the cost function value. Is determined to be the optimal inter prediction mode. Then, the motion prediction / compensation unit 47 supplies the cost function value of the optimal inter prediction mode and the corresponding prediction image to the prediction image selection unit 48. In addition, the motion prediction / compensation unit 47, when notified of the selection of the predicted image generated in the optimal inter prediction mode from the predicted image selection unit 48, the inter prediction mode information, the corresponding motion vector, etc., is lossless encoding unit 36. The reference image specifying information is output to the reference image setting unit 50.

- the predicted image selection unit 48 Based on the cost function values supplied from the intra prediction unit 46 and the motion prediction / compensation unit 47, the predicted image selection unit 48 has a smaller corresponding cost function value of the optimal intra prediction mode and the optimal inter prediction mode. Are determined as the optimum prediction mode. Then, the predicted image selection unit 48 supplies the predicted image in the optimal prediction mode to the calculation unit 33 and the addition unit 40. Further, the predicted image selection unit 48 notifies the intra prediction unit 46 or the motion prediction / compensation unit 47 of selection of the predicted image in the optimal prediction mode.

- the reference buffer 49 stores the reference image specifying information of the reference image used at the time of encoding the base image supplied from the base encoding unit 11 of FIG.

- the reference image setting unit 50 compares the reference image specifying information supplied from the motion prediction / compensation unit 47 with the reference image specifying information stored in the reference buffer 49, and sets the prediction mode of the reference image specifying information of the enhancement image. decide.

- the prediction mode of the reference image specifying information includes a copy mode, a difference prediction mode, and a non-prediction mode.

- the copy mode is a prediction mode in which the reference image specifying information of the reference layer that is another layer to be referred to (the base layer in this case) is used as the reference image specifying information of the enhancement image.

- the difference prediction mode is a prediction in which the reference image specifying information of the enhancement image is predicted by adding the difference between the reference image specifying information of the enhancement image and the reference image specifying information of the reference layer and the reference image specifying information of the reference layer.

- the non-prediction mode is a prediction mode in which the reference image specifying information of the enhancement image is set independently of the reference image specifying information of the reference layer.

- the reference image setting unit 50 is the copy mode of the reference image specifying information as the reference image specifying generation information supplied from the setting unit 22 of FIG. At this time, 1 as the RPS flag is supplied to the lossless encoding unit 36.

- the prediction mode of the reference image specifying information as the reference image specifying generation information supplied from the setting unit 22 is not the copy mode, 0 is supplied as the RPS flag to the lossless encoding unit 36 and the copy mode is referred to. This is set as image specific generation information and supplied to the lossless encoding unit 36.

- the reference image setting unit 50 calculates the difference between the reference image specifying information of the enhancement image and the reference image specifying information of the base image. Then, the reference image setting unit 50 compares the calculated difference of the reference image specifying information with the difference of the reference image specifying information as the reference image specifying generation information supplied from the setting unit 22.

- the reference image setting unit 50 recognizes the corresponding index, supplies 1 as the RPS flag to the lossless encoding unit 36, and sets the index as reference image specifying generation information. And supplied to the lossless encoding unit 36.

- the reference image setting unit 50 supplies 0 as the RPS flag to the lossless encoding unit 36, and uses the calculated difference of the reference image specifying information as the reference image specifying generation information. This is set and supplied to the lossless encoding unit 36.

- the reference image setting unit 50 and the reference image specifying information as the reference image specifying generation information supplied from the setting unit 22 and the reference image specifying information supplied from the setting unit 22 Compare with information. Then, when both reference image specifying information is the same, the reference image setting unit 50 recognizes the corresponding index, supplies 1 as the RPS flag to the lossless encoding unit 36, and generates the index as the reference image specifying generation. Information is set and supplied to the lossless encoding unit 36.

- the reference image setting part 50 supplies 0 as an RPS flag to the lossless encoding part 36, and also uses the reference image specific information of an enhancement image as reference image specific generation information. And is supplied to the lossless encoding unit 36.

- the rate control unit 51 controls the quantization operation rate of the quantization unit 35 based on the encoded data stored in the storage buffer 37 so that overflow or underflow does not occur.

- FIG. 15 is a diagram for explaining Coding UNIT (CU), which is a coding unit in the HEVC scheme.

- CU is defined as a coding unit.

- the CU is also called Coding Tree Block (CTB) and plays the same role as a macroblock in the AVC method.

- CTB Coding Tree Block

- the CU is divided into Prediction Unit (PU) that is a unit of intra prediction or inter prediction, or is divided into Transform Unit (TU) that is a unit of orthogonal transformation.

- PU Prediction Unit

- TU Transform Unit

- the size of the CU is a square represented by a power-of-two pixel that is variable for each sequence.

- the size of the LCU (Largest Coding Unit) that is the largest CU is 128, and the size of the SCU (Smallest Coding Unit) that is the smallest CU is eight. Therefore, the layer depth (depth) of a 2N ⁇ 2N size CU layered for each N is 0 to 4, and the number of layer depths is 5. Further, when the value of split_flag is 1, the 2N ⁇ 2N size CU is divided into N ⁇ N size CUs, which are one layer below.

- Non-Patent Document 1 Information specifying the LCU and SCU sizes is included in the SPS. Details of the CU are described in Non-Patent Document 1.

- FIG. 16 is a block diagram illustrating a configuration example of the reference image setting unit 50 in FIG.

- 16 includes an acquisition unit 71, a determination unit 72, and a generation unit 73.

- the acquisition unit 71 of the reference image setting unit 50 acquires reference image specifying information from the motion prediction / compensation unit 47 of FIG. 14 and supplies the reference image specifying information to the determination unit 72 and the generation unit 73.

- the determination unit 72 reads the reference image specifying information of the base image from the reference buffer 49.

- the determining unit 72 compares the read reference image specifying information of the base image with the reference image specifying information supplied from the acquiring unit 71. Then, when the reference image identification information of the read base image is the same as the reference image identification information supplied from the acquisition unit 71, the determination unit 72 determines the prediction mode of the reference image identification information as the copy mode. .

- the determination unit 72 supplies the copy mode to the generation unit 73.

- the determination unit 72 determines whether the prediction mode of the reference image specifying information supplied as the reference image specifying generation information from the setting unit 22 in FIG. 13 is the copy mode. When it is determined that the prediction mode of the reference image specifying information supplied as the reference image specifying generation information is the copy mode, the determining unit 72 supplies 1 as the RPS flag to the lossless encoding unit 36 in FIG. On the other hand, when it is determined that the prediction mode of the reference image specific information supplied as the reference image specific generation information is not the copy mode, the determination unit 72 supplies 0 as the RPS flag to the lossless encoding unit 36, The copy mode is supplied to the lossless encoding unit 36 as reference image specifying generation information.

- the generation unit 73 reads the reference image specifying information of the base image from the reference buffer 49. Based on the input from the user, the generation unit 73 determines the prediction mode of the reference image specifying information to be the difference prediction mode or the non-prediction mode, and supplies it to the lossless encoding unit 36 as reference image specifying generation information.

- the generation unit 73 calculates a difference between the read reference image specifying information of the base image and the reference image specifying information supplied from the acquisition unit 71. To do. Then, the generation unit 73 compares the calculated difference of the reference image specifying information with the difference of the reference image specifying information as the reference image specifying generation information supplied from the setting unit 22.

- the generation unit 73 recognizes the corresponding index, supplies 1 as the RPS flag to the lossless encoding unit 36, and uses the index as the reference image specifying generation information, and the lossless encoding unit 36. To supply.

- the generation unit 73 supplies 0 as the RPS flag to the lossless encoding unit 36, and supplies the calculated difference to the lossless encoding unit 36 as reference image specifying generation information. To do.

- the generation unit 73 uses the reference image specifying information supplied from the acquisition unit 71 and the reference image specifying generation information supplied from the setting unit 22. To the reference image specifying information. Then, when both reference image specifying information is the same, the generating unit 73 recognizes the corresponding index, supplies 1 as the RPS flag to the lossless encoding unit 36, and uses the index as the reference image specifying generating information. This is supplied to the lossless encoding unit 36.

- the generation unit 73 supplies 0 as the RPS flag to the lossless encoding unit 36 and uses the reference image specifying information supplied from the acquisition unit 71 as the reference image specifying.

- the generated information is supplied to the lossless encoding unit 36.

- Example of SPS syntax for enhancement stream 17 and 18 are diagrams illustrating examples of SPS syntax set by the setting unit 22 of FIG.

- the SPS includes RPS prediction mode information (short_term_ref_pic_pred_mode) representing the prediction mode of RPS as reference image specifying generation information.

- the RPS prediction mode information is 0 when representing the copy mode, 1 when representing the differential prediction mode, and 2 when representing the non-prediction mode.

- the SPS when the RPS prediction mode information is other than 0, the SPS includes RPS and RPS differences for each RPS prediction mode. Indexes are assigned in order from 0 to the difference between RPS and RPS.

- the SPS includes a long-term flag (long_term_ref_pics_present_flag) as in the SPS of the base stream.

- the SPS has long term prediction mode information indicating the prediction mode of the reference image specifying information of the long term as reference image specifying generation information ( long_term_ref_pic_pred_mode) is included.

- the long term prediction mode information (long_term_ref_pic_pred_mode) is 0 when representing the copy mode, 1 when representing the differential prediction mode, and 2 when representing the non-prediction mode.

- the SPS includes the number of long-term reference image specifying information similar to the SPS of the base stream, the long-term reference image specifying Information and a reference flag are included as reference image specifying generation information.

- An index is assigned to the reference image specifying information of long term in order from 0.

- the SPS includes the number of long-term reference image specifying information included in the SPS and the long included in the SPS of the reference layer.

- Difference between the number of reference image identification information for term (diff_num_long_term_ref_pics_sps), difference between the reference image identification information for long term and the reference image identification information for long term included in the SPS of the reference layer (diff_lt_ref_pic_poc_lsb_sps) Is included as the reference image specific generation information.

- the SPS of the enhancement stream does not include a reference flag, and the reference flag is a reference layer reference flag.

- FIGS. 19 to 21 are diagrams illustrating a configuration example of the syntax of the slice header of the enhancement stream.

- the slice header of the enhancement stream includes an RPS flag, like the slice header of the base stream. Further, as shown in the 19th and 20th lines, when the RPS flag is 0, the RPS mode information of the corresponding slice is included in the slice header as the reference image specifying generation information.

- the slice header includes the RPS or RPS difference of the corresponding slice as an index for each RPS prediction mode. Is included as short_term_ref_pic_set where num_short_term_ref_pic_sets.

- the slice header contains the difference between the RPS or RPS of the corresponding slice.

- An index (short_term_ref_pic_set_idx) is included.

- the slice header includes long term prediction mode information as reference image specific generation information.

- the long term prediction mode information is 2

- the number in SPS and the number outside SPS are included in the slice header, as in the base stream, in the reference image specifying generation information. Included as

- the index (lt_idx_sps), the information (poc_lsb_sps), and the reference flag (used_by_curr_pic_lt_flag) are included in the slice header, as in the base stream. Included as

- the most significant bit flag (delta_poc_msb_cycle_lt) indicating whether or not the most significant bit information (delta_poc_msb_cycle_lt) indicating the most significant bit of the POC of the long-term reference image exists in the slice header.

- delta_poc_msb_present_flag is included.

- the long term prediction mode information is 1

- the slice header includes a difference between an index (lt_idx_sps), information (poc_lsb_lt), and reference layer information (poc_lsb_lt). (diff_poc_lsb_lt) is included as reference image specific generation information.

- the slice header of the enhancement stream does not include the reference flag and the most significant bit flag, and the reference flag and the most significant bit flag respectively include the reference layer reference flag and the most significant bit flag.

- the upper bit flag When the long-term prediction mode information is 1, the slice header of the enhancement stream does not include the reference flag and the most significant bit flag, and the reference flag and the most significant bit flag respectively include the reference layer reference flag and the most significant bit flag. The upper bit flag.

- the slice header includes the most significant bit information of the corresponding slice and the most significant bit information of the reference layer.

- the difference (diff_delta_poc_msb_cycle_lt) is included.

- FIG. 22 is a diagram illustrating an example of RPS syntax of an enhancement stream.

- the enhancement stream RPS includes reference information in the same manner as the base stream RPS.

- the RPS of the enhancement stream includes the previous image specifying information, code (like the RPS of the base stream). delta_rps_sign), an absolute value (abs_delta_rps_minus1), a flag (used_by_curr_pic_lt_flag), and a flag (use_delta_flag) are included as reference image specific generation information.

- the RPS when the reference information is 1 and the RPS prediction mode is 1, the RPS includes the previous image specifying information of the corresponding slice and the previous image specifying information of the reference layer. Difference (diff_delta_idx_minus1) and the difference (diff_abs_delta_rps_minus1) between the absolute value of the corresponding slice (abs_delta_rps_minus1) and the absolute value of the reference layer (abs_delta_rps_minus1).

- the slice header of the enhancement stream does not include the code (delta_rps_sign), the flag (used_by_curr_pic_lt_flag), and the flag (use_delta_flag), and the code (delta_rps_sign), the flag (used_by_curr_pic_lt_flag), And the flag (use_delta_flag) are a reference layer code (delta_rps_sign), a flag (used_by_curr_pic_lt_flag), and a flag (use_delta_flag), respectively.

- the RPS includes the number of reference images, the POC, and the like as in the RPS of the base stream. Contains information. Further, as shown in the 33rd to 40th lines, when the reference information is 0 and the RPS prediction mode is 1, the RPS includes information such as the number of reference images of the corresponding slice, information on the POC, and the reference. Differences from the number of layer reference images and information such as POC are included.

- FIG. 23 is a diagram illustrating an example of VPS syntax.

- the VPS includes information (vps_max_layer_minus1) indicating the number of layers of scalability. Further, as shown in the seventh line, the VPS includes information (vps_max_sub_layer_minus1) indicating the number of layers of temporalabilityscalability as in the conventional case.

- the VPS includes 0 as the difference (diff_ref_layer [0]) between the base layer and the reference layer as information for specifying the base layer whose index is 0. Further, as shown in the 16th and 17th lines, the VPS includes a difference (diff_ref_layer) of each enhancement layer.

- the reference layer ref_layer is expressed by the following equation (3) using the difference diff_ref_layer.

- the enhancement stream is generated without referring to the reference image specifying information of the other layers, like the base stream.

- FIG. 24 is a flowchart illustrating the hierarchical encoding process of the encoding device 10 of FIG. This hierarchical encoding process is started when a base image and an enhancement image are input from the outside.

- the base encoding unit 11 of the encoding device 10 encodes a base image input from the outside using the HEVC method.

- the base encoding unit 11 supplies the reference image specifying information of the reference image used when encoding the base image to the enhancement encoding unit 12.

- the base encoding unit 11 supplies a base stream including encoded data, SPS, PPS, and the like obtained as a result of encoding to the synthesizing unit 13 as a base stream.

- step S2 the enhancement encoding unit 12 performs an enhancement stream generation process for generating an enhancement stream from an enhancement image input from the outside. Details of the enhancement stream generation processing will be described with reference to FIG.

- step S3 the synthesizing unit 13 synthesizes the base stream supplied from the base encoding unit 11 and the enhancement stream supplied from the enhancement encoding unit 12, adds VPS and the like, and adds the encoded stream of all layers. Generate.

- the synthesizing unit 13 supplies the encoded stream of all layers to the transmission unit 14.

- step S4 the transmission unit 14 transmits the encoded stream of all layers supplied from the synthesis unit 13 to a decoding device to be described later.

- FIG. 25 is a flowchart for explaining the details of the enhancement stream generation process in step S2 of FIG.

- the setting unit 22 of the enhancement encoding unit 12 sets reference image specifying generation information and supplies the reference image specifying generation information to the encoding unit 21.

- the encoding unit 21 performs an encoding process that encodes an enhancement image in units of frames input from the outside as an input signal by a method according to the HEVC method. Details of this encoding process will be described with reference to FIGS. 26 and 27 described later.

- step S12 the setting unit 22 sets the SPS including the reference image specific generation information set in step S10.

- step S13 the setting unit 22 sets the PPS.

- step S ⁇ b> 14 the setting unit 22 generates an enhancement stream from the set SPS and PPS and the encoded data supplied from the encoding unit 21.

- step S15 the setting unit 22 supplies the enhancement stream to the synthesis unit 13, and ends the process.

- 26 and 27 are flowcharts illustrating details of the encoding process in step S11 of FIG.

- the A / D conversion unit 31 of the encoding unit 21 performs A / D conversion on the frame unit image input as the input signal, and outputs and stores the image in the screen rearrangement buffer 32.

- step S32 the screen rearrangement buffer 32 rearranges the stored frame images in the display order in the order for encoding according to the GOP structure.

- the screen rearrangement buffer 32 supplies the rearranged frame-unit images to the calculation unit 33, the intra prediction unit 46, and the motion prediction / compensation unit 47.

- step S33 the intra prediction unit 46 performs intra prediction processing in all candidate intra prediction modes. Further, the intra prediction unit 46 calculates cost function values for all candidate intra prediction modes based on the image read from the screen rearrangement buffer 32 and the predicted image generated as a result of the intra prediction process. Is calculated. Then, the intra prediction unit 46 determines the intra prediction mode that minimizes the cost function value as the optimal intra prediction mode. The intra prediction unit 46 supplies the predicted image generated in the optimal intra prediction mode and the corresponding cost function value to the predicted image selection unit 48.

- the motion prediction / compensation unit 47 performs motion prediction / compensation processing for all candidate inter prediction modes.

- the motion prediction / compensation unit 47 calculates cost function values for all candidate inter prediction modes based on the images supplied from the screen rearrangement buffer 32 and the predicted images, and the cost function values are calculated. The minimum inter prediction mode is determined as the optimal inter prediction mode. Then, the motion prediction / compensation unit 47 supplies the cost function value of the optimal inter prediction mode and the corresponding prediction image to the prediction image selection unit 48.

- step S ⁇ b> 34 the predicted image selection unit 48 selects one of the optimal intra prediction mode and the optimal inter prediction mode based on the cost function values supplied from the intra prediction unit 46 and the motion prediction / compensation unit 47 by the process of step S ⁇ b> 33. The one with the smallest cost function value is determined as the optimum prediction mode. Then, the predicted image selection unit 48 supplies the predicted image in the optimal prediction mode to the calculation unit 33 and the addition unit 40.

- step S35 the predicted image selection unit 48 determines whether or not the optimal prediction mode is the optimal inter prediction mode.

- the predicted image selection unit 48 notifies the motion prediction / compensation unit 47 of the selection of the predicted image generated in the optimal inter prediction mode.

- step S36 the motion prediction / compensation unit 47 supplies the inter prediction mode information and the motion vector to the lossless encoding unit 36.

- the reference buffer 49 stores the reference image specifying information of the base image supplied from the base encoding unit 11.

- the reference image setting unit 50 performs a generation process for generating reference image specific generation information of the reference image used in the motion prediction / compensation process. Details of this generation processing will be described with reference to FIG.

- step S35 when it is determined in step S35 that the optimal prediction mode is not the optimal inter prediction mode, that is, when the optimal prediction mode is the optimal intra prediction mode, the predicted image selection unit 48 performs the prediction generated in the optimal intra prediction mode.

- the intra prediction unit 46 is notified of the image selection.

- step S39 the intra prediction unit 46 supplies the intra prediction mode information to the lossless encoding unit 36, and the process proceeds to step S40.

- step S40 the calculation unit 33 performs encoding by subtracting the prediction image supplied from the prediction image selection unit 48 from the image supplied from the screen rearrangement buffer 32.

- the computing unit 33 outputs the resulting image to the orthogonal transform unit 34 as residual information.

- step S41 the orthogonal transform unit 34 performs orthogonal transform on the residual information from the calculation unit 33, and supplies the resulting orthogonal transform coefficient to the quantization unit 35.

- step S42 the quantization unit 35 quantizes the coefficient supplied from the orthogonal transform unit 34, and supplies the resulting coefficient to the lossless encoding unit 36 and the inverse quantization unit 38.

- the inverse quantization unit 38 inversely quantizes the quantized coefficient supplied from the quantization unit 35, and supplies the resulting orthogonal transform coefficient to the inverse orthogonal transform unit 39.

- step S44 the inverse orthogonal transform unit 39 performs inverse orthogonal transform on the orthogonal transform coefficient supplied from the inverse quantization unit 38, and supplies the residual information obtained as a result to the addition unit 40.

- step S45 the addition unit 40 adds the residual information supplied from the inverse orthogonal transform unit 39 and the prediction image supplied from the prediction image selection unit 48, and obtains a locally decoded image.

- the adder 40 supplies the obtained image to the deblock filter 41 and also supplies it to the frame memory 44.

- step S46 the deblocking filter 41 performs a deblocking filtering process on the locally decoded image supplied from the adding unit 40.

- the deblocking filter 41 supplies the resulting image to the adaptive offset filter 42.

- step S47 the adaptive offset filter 42 performs an adaptive offset filter process on the image supplied from the deblocking filter 41 for each LCU.

- the adaptive offset filter 42 supplies the resulting image to the adaptive loop filter 43. Further, the adaptive offset filter 42 supplies the storage flag, index or offset, and type information to the lossless encoding unit 36 as offset filter information for each LCU.

- step S48 the adaptive loop filter 43 performs an adaptive loop filter process for each LCU on the image supplied from the adaptive offset filter 42.

- the adaptive loop filter 43 supplies the resulting image to the frame memory 44.

- the adaptive loop filter 43 also supplies the filter coefficient used in the adaptive loop filter process to the lossless encoding unit 36.

- step S49 the frame memory 44 stores the image supplied from the adaptive loop filter 43 and the image supplied from the adder 40.

- the image stored in the frame memory 44 is output as a reference image to the intra prediction unit 46 or the motion prediction / compensation unit 47 via the switch 45.

- step S50 the lossless encoding unit 36 reversibly uses intra prediction mode information or inter prediction mode information, a motion vector, reference image specifying generation information, an RPS flag, offset filter information, and a filter coefficient as encoding information. Encode.

- step S51 the lossless encoding unit 36 performs lossless encoding on the quantized coefficient supplied from the quantization unit 35. Then, the lossless encoding unit 36 generates encoded data from the encoding information that has been losslessly encoded in the process of step S50 and the losslessly encoded coefficient, and supplies the encoded data to the accumulation buffer 37.

- step S52 the accumulation buffer 37 temporarily accumulates the encoded data supplied from the lossless encoding unit 36.

- step S53 the rate control unit 51 controls the rate of the quantization operation of the quantization unit 35 based on the encoded data stored in the storage buffer 37 so that overflow or underflow does not occur.

- step S54 the accumulation buffer 37 outputs the stored encoded data to the setting unit 22 in FIG. Then, the process returns to step S11 in FIG. 25 and proceeds to step S12.

- the intra prediction process and the motion prediction / compensation process are always performed, but in actuality, either one of them depends on the picture type or the like. Sometimes only.

- FIG. 28 is a flowchart for explaining the details of the generation process in step S38 of FIG.

- the acquisition unit 71 of the reference image setting unit 50 acquires the reference image specifying information of the enhancement image from the motion prediction / compensation unit 47, and supplies it to the determination unit 72 and the generation unit 73.

- the determination unit 72 and the generation unit 73 read the reference image specifying information of the base image from the reference buffer 49.

- step S72 the determination unit 72 determines whether the reference image specifying information of the enhancement image is the same as the reference image specifying information of the base image. If it is determined in step S72 that the reference image specifying information of the enhancement image is the same as the reference image specifying information of the base image, in step S73, the determining unit 72 determines the prediction mode of the reference image specifying information as the copy mode. To do.

- step S74 the determination unit 72 determines whether the copy mode is supplied as the reference image specifying generation information from the setting unit 22 of FIG. If it is determined in step S74 that the copy mode is supplied as the reference image specifying generation information, in step S75, the determination unit 72 sets the RPS flag to 1 and supplies it to the lossless encoding unit 36 in FIG. Then, the process returns to step S38 in FIG. 26 and proceeds to step S40.

- step S74 determines whether the copy mode is not supplied as the reference image specifying generation information. If it is determined in step S74 that the copy mode is not supplied as the reference image specifying generation information, the process proceeds to step S76.

- step S76 the determination unit 72 sets the RPS flag to 0 and supplies it to the lossless encoding unit 36, and supplies the copy mode to the lossless encoding unit 36 as reference image specifying generation information. Then, the process returns to step S38 in FIG. 26 and proceeds to step S40.

- step S72 determines whether or not to set the prediction mode of the reference image specifying information to the difference prediction mode based on the input from the user.

- step S77 If it is determined in step S77 that the prediction mode of the reference image specifying information is set to the difference prediction mode, the process proceeds to step S78.

- step S78 the generation unit 73 determines the prediction mode of the reference image specifying information as the difference prediction mode.

- step S79 the generation unit 73 obtains a difference between the reference image specifying information of the base image and the enhancement image.

- the generation unit 73 determines whether or not the difference calculated in step S79 is the same as the difference of the reference image specifying information to which the index supplied from the setting unit 22 is assigned.

- step S80 If it is determined in step S80 that the difference calculated in step S79 is the same as the difference in the reference image specifying information to which the index is assigned, the process proceeds to step S81.

- step S81 the generation unit 73 sets the RPS flag to 1 and supplies the set to the lossless encoding unit 36, and the index corresponding to the same difference as the difference of the reference image specifying information calculated in step S79 is the lossless code. To the conversion unit 36. Then, the process returns to step S38 in FIG. 26 and proceeds to step S40.

- step S80 determines whether the difference calculated in step S79 is not the same as the difference in the reference image specifying information to which the index is assigned.

- step S82 the generation unit 73 sets the RPS flag to 0 and supplies it to the lossless encoding unit 36, and also sends the difference between the difference prediction mode and the reference image specifying information calculated in step S79 to the lossless encoding unit 36. Supply. Then, the process returns to step S38 in FIG. 26 and proceeds to step S40.