WO2014002897A1 - 画像処理装置および方法 - Google Patents

画像処理装置および方法 Download PDFInfo

- Publication number

- WO2014002897A1 WO2014002897A1 PCT/JP2013/067109 JP2013067109W WO2014002897A1 WO 2014002897 A1 WO2014002897 A1 WO 2014002897A1 JP 2013067109 W JP2013067109 W JP 2013067109W WO 2014002897 A1 WO2014002897 A1 WO 2014002897A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- unit

- image

- orthogonal transformation

- skip

- processing

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/124—Quantisation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/12—Selection from among a plurality of transforms or standards, e.g. selection between discrete cosine transform [DCT] and sub-band transform or selection between H.263 and H.264

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/157—Assigned coding mode, i.e. the coding mode being predefined or preselected to be further used for selection of another element or parameter

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/44—Decoders specially adapted therefor, e.g. video decoders which are asymmetric with respect to the encoder

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/60—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

Definitions

- the present disclosure relates to an image processing apparatus and method, and more particularly to an image processing apparatus and method capable of suppressing image deterioration.

- MPEG2 (ISO / IEC 13818-2) is defined as a general-purpose image coding method, and is a standard that covers both interlaced and progressive scan images as well as standard resolution images and high definition images.

- MPEG2 is currently widely used in a wide range of applications for professional and consumer applications.

- the MPEG2 compression method for example, in the case of a standard resolution interlaced scan image having 720 ⁇ 480 pixels, a code amount (bit rate) of 4 to 8 Mbps is allocated.

- the MPEG2 compression method for example, in the case of a high resolution interlaced scanning image having 1920 ⁇ 10 88 pixels, a code amount (bit rate) of 18 to 22 Mbps is allocated. Thereby, a high compression rate and good image quality can be realized.

- MPEG2 was mainly intended for high-quality coding suitable for broadcasting, it did not correspond to a coding amount (bit rate) lower than that of MPEG1, that is, a coding method with a higher compression rate.

- bit rate bit rate

- MPEG4 coding amount

- the standard was approved as an international standard as ISO / IEC 14496-2 in December 1998.

- H.26L International Telecommunication Union Telecommunication Standardization Sector (ITU) Q6 / 16 Video Coding Expert Group (VCEG)

- ITU International Telecommunication Union Telecommunication Standardization Sector

- VCEG Video Coding Expert Group

- AVC Advanced Video Coding

- FRExt also includes 8x8 DCT and quantization matrix specified by MPEG-2 such as encoding tools required for business use such as RGB and 4: 2: 2 and 4: 4: 4. Standardization of (Fidelity Range Extension) was completed in February 2005.

- H.264 / AVC it has become a coding method capable of well representing film noise contained in a movie, and has been used for a wide range of applications such as Blu-Ray Disc (trademark).

- ITU-T and JCTVC Joint Collaboration Team-Video Coding

- ISO / IEC Joint Collaboration Team-Video Coding

- HEVC High Efficiency Video Coding

- Non-Patent Document 2 a method of "Intra Transform Skipping" is adopted (see, for example, Non-Patent Document 2).

- Transform Skip Transform skip, also referred to as orthogonal transform skip

- JCT-VC Joint Collaborative Team on Video Coding

- the coefficients of the block to which TransformSkip is applied are values in the spatial domain, and the coefficients of the other blocks are values in the frequency domain, and their characteristics are different from each other.

- the coding efficiency may be reduced by performing the coding process similarly to both the block to which TransformSkip is applied and the block to which the TransformSkip is applied without considering the difference in the characteristics.

- the present disclosure has been made in view of such a situation, and is intended to be able to suppress a reduction in image quality due to encoding / decoding processing.

- One aspect of the present disclosure is a decoding unit that decodes encoded data and generates a quantized coefficient, and a weighting coefficient that is applied to an orthogonal transformation skip block from which orthogonal transformation processing is skipped. And an inverse quantization unit that inversely quantizes the quantized coefficient of the orthogonal transformation skip block generated by

- the dequantization unit can use one of the weighting factors.

- the dequantization unit may dequantize the quantized coefficients of the orthogonal transform skip block having a block size of 4 ⁇ 4 using the weighting coefficients.

- the image processing apparatus may further include a receiver for receiving skip permission information transmitted as a picture parameter set and indicating whether to permit skipping of the orthogonal transformation process.

- the receiving unit further receives the transmitted weight coefficient, and the dequantizing unit inverse quantizes the quantized coefficient of the orthogonal transformation skip block using the weighting coefficient received by the receiving unit.

- the inverse quantization unit inverse quantizes the quantized coefficients of the non-orthogonal transformation skip block subjected to orthogonal transformation processing using a quantization matrix different from a weighting coefficient matrix obtained by matrixing the weighting coefficients.

- the signal processing apparatus further includes a transmission unit that receives a broadcast signal, extracts a signal of a desired channel, and demodulates the extracted signal to obtain encoded data, and the decoding unit is configured to receive the code obtained from the broadcast signal by the transmission unit. Data can be decoded.

- the decoding apparatus further comprises a demultiplexing unit for demultiplexing the transmitted coded data and demultiplexing the coded data into video coded data and voice coded data, and the decoding unit is configured to code the voice by the demultiplexing unit.

- the encoded data of the video separated from the data can be decoded.

- the encoded data may further include a reproduction unit that reproduces video data obtained by performing decoding by the decoding unit and inverse quantization by the inverse quantization unit.

- An audio codec unit may be further provided to perform encoding and decoding of audio data.

- the information processing apparatus may further include a reproduction unit that reads encoded data recorded in a storage medium, and the decoding unit can decode the encoded data read from the storage medium by the reproduction unit.

- Another aspect of the present disclosure is also the above-mentioned generated using a weighting factor applied to an orthogonal transformation skip block that decodes encoded data to generate quantized coefficients, and orthogonal transformation processing is skipped. It is an image processing method which dequantizes the quantized coefficient of orthogonal transformation skip block.

- orthogonal transform generated using weighting factors applied to orthogonal transform skip blocks in which coded data is decoded and quantized coefficients are generated and orthogonal transform processing is skipped.

- the quantized coefficients of the skip block are dequantized.

- image processing apparatus may be an independent apparatus or an internal block constituting one image decoding apparatus.

- an image can be decoded.

- reduction in image quality due to decoding can be suppressed.

- FIG. 4 shows the example of a sequence parameter set.

- FIG. 6 shows the example of a picture parameter set.

- FIG. 9 shows the example of a sequence parameter set.

- FIG. 9 shows the example of a picture parameter set.

- FIG. 11 shows the example of a picture parameter set.

- FIG. 11 shows the example of a picture parameter set.

- FIG. 11 shows the main structural examples, such as orthogonal transformation skip.

- It is a flowchart explaining the example of the flow of an encoding process.

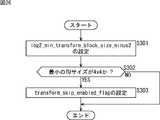

- It is a flowchart explaining the example of the flow of orthogonal transformation skip control processing.

- It is a flowchart explaining the example of the flow of orthogonal transformation processing.

- It is a flowchart explaining the example of the flow of quantization processing.

- It is a flowchart explaining the example of the flow of deblocking filter processing.

- It is a block diagram which shows the main structural examples of an image decoding apparatus.

- It is a block diagram which shows the main structural examples, such as an inverse orthogonal transformation skip part.

- FIG. 24 is a diagram illustrating an example main configuration of a multi-viewpoint image decoding device to which the present technology is applied. It is a figure which shows the example of a hierarchy image coding system. It is a figure which shows the main structural examples of the hierarchy image coding apparatus to which this technique is applied. It is a figure which shows the main structural examples of the hierarchy image decoding apparatus to which this technique is applied. It is a block diagram showing an example of main composition of a computer. It is a block diagram showing an example of a schematic structure of a television set. It is a block diagram which shows an example of a rough structure of a mobile telephone. It is a block diagram which shows an example of a rough structure of a recording and reproducing apparatus.

- FIG. 1 is a block diagram showing an example of the main configuration of an image coding apparatus.

- the image coding apparatus 100 shown in FIG. 1 codes image data using, for example, prediction processing of High Efficiency Video Coding (HEVC) or prediction processing according to the method.

- HEVC High Efficiency Video Coding

- the image coding apparatus 100 includes an A / D conversion unit 101, a screen rearrangement buffer 102, an operation unit 103, an orthogonal conversion unit 104, a quantization unit 105, a lossless coding unit 106, and a storage buffer 107. , An inverse quantization unit 108, and an inverse orthogonal transform unit 109. Further, the image coding apparatus 100 includes an arithmetic unit 110, a deblock filter 111, a frame memory 112, a selection unit 113, an intra prediction unit 114, a motion prediction / compensation unit 115, a predicted image selection unit 116, and a rate control unit 117. Have.

- the image coding apparatus 100 further includes an orthogonal transform skip unit 121.

- the A / D conversion unit 101 A / D converts the input image data, supplies the converted image data (digital data) to the screen rearrangement buffer 102, and stores it.

- the screen rearrangement buffer 102 rearranges the images of the stored display order in the frame order for encoding according to GOP (Group Of Picture), and arranges the images in which the frame order is rearranged,

- the data is supplied to the calculation unit 103.

- the screen rearrangement buffer 102 also supplies the image in which the order of the frames is rearranged to the intra prediction unit 114 and the motion prediction / compensation unit 115.

- the operation unit 103 subtracts the predicted image supplied from the intra prediction unit 114 or the motion prediction / compensation unit 115 via the predicted image selection unit 116 from the image read from the screen rearrangement buffer 102, and the difference information thereof Are output to the orthogonal transformation unit 104. For example, in the case of an image on which intra coding is performed, the operation unit 103 subtracts the predicted image supplied from the intra prediction unit 114 from the image read from the screen rearrangement buffer 102. Also, for example, in the case of an image on which inter coding is performed, the operation unit 103 subtracts the predicted image supplied from the motion prediction / compensation unit 115 from the image read from the screen rearrangement buffer 102.

- the orthogonal transformation unit 104 performs orthogonal transformation such as discrete cosine transformation or Karhunen-Loeve transformation on the difference information supplied from the arithmetic unit 103.

- the orthogonal transform unit 104 supplies the transform coefficient to the quantization unit 105.

- the quantization unit 105 quantizes the transform coefficient supplied from the orthogonal transform unit 104.

- the quantization unit 105 sets a quantization parameter based on the information on the target value of the code amount supplied from the rate control unit 117 and performs the quantization.

- the quantization unit 105 supplies the quantized transform coefficient to the lossless encoding unit 106.

- the lossless encoding unit 106 encodes the transform coefficient quantized in the quantization unit 105 by an arbitrary encoding method. Since the coefficient data is quantized under the control of the rate control unit 117, this code amount is the target value set by the rate control unit 117 (or approximate to the target value).

- the lossless encoding unit 106 acquires information indicating the mode of intra prediction from the intra prediction unit 114, and acquires information indicating the mode of inter prediction, differential motion vector information, or the like from the motion prediction / compensation unit 115.

- the lossless encoding unit 106 encodes these various types of information according to an arbitrary encoding method, and makes it part of header information of encoded data (also referred to as an encoded stream) (multiplexing).

- the lossless encoding unit 106 supplies the encoded data obtained by the encoding to the accumulation buffer 107 for accumulation.

- Examples of the coding method of the lossless coding unit 106 include variable-length coding and arithmetic coding.

- variable-length coding for example, H.264.

- Examples include CAVLC (Context-Adaptive Variable Length Coding) defined by the H.264 / AVC system.

- Examples of arithmetic coding include CABAC (Context-Adaptive Binary Arithmetic Coding).

- the accumulation buffer 107 temporarily holds the encoded data supplied from the lossless encoding unit 106.

- the accumulation buffer 107 outputs, at a predetermined timing, the held encoded data to, for example, a not-shown recording device (recording medium) or a transmission path at a later stage. That is, the accumulation buffer 107 is also a transmission unit that transmits the encoded data.

- the transform coefficient quantized in the quantization unit 105 is also supplied to the inverse quantization unit 108.

- the inverse quantization unit 108 inversely quantizes the quantized transform coefficient by a method corresponding to the quantization by the quantization unit 105.

- the inverse quantization unit 108 supplies the obtained transform coefficient to the inverse orthogonal transform unit 109.

- the inverse orthogonal transform unit 109 performs inverse orthogonal transform on the transform coefficient supplied from the inverse quantization unit 108 by a method corresponding to orthogonal transform processing by the orthogonal transform unit 104.

- the inverse orthogonal transform output (restored difference information) is supplied to the calculation unit 110.

- the calculation unit 110 predicts from the intra prediction unit 114 or the motion prediction / compensation unit 115 via the prediction image selection unit 116 the reconstructed difference information that is the inverse orthogonal transformation result supplied from the inverse orthogonal transformation unit 109.

- the images are added to obtain a locally decoded image (decoded image).

- the decoded image is supplied to the deblocking filter 111 or the frame memory 112.

- the deblocking filter 111 appropriately performs deblocking filter processing on the decoded image supplied from the computing unit 110.

- the deblocking filter 111 removes block distortion of the decoded image by performing deblocking filter processing on the decoded image.

- the deblocking filter 111 supplies the result of the filtering process (the decoded image after the filtering process) to the frame memory 112. As described above, the decoded image output from the calculation unit 110 can be supplied to the frame memory 112 without passing through the deblocking filter 111. That is, the filtering process by the deblocking filter 111 can be omitted.

- the frame memory 112 stores the supplied decoded image, and supplies the stored decoded image as a reference image to the selection unit 113 at a predetermined timing.

- the selection unit 113 selects the supply destination of the reference image supplied from the frame memory 112. For example, in the case of inter prediction, the selection unit 113 supplies the reference image supplied from the frame memory 112 to the motion prediction / compensation unit 115.

- the intra prediction unit 114 performs intra prediction (in-screen prediction) that generates a predicted image using pixel values in the processing target picture that is a reference image supplied from the frame memory 112 via the selection unit 113.

- the intra prediction unit 114 performs this intra prediction in a plurality of intra prediction modes prepared in advance.

- the intra prediction unit 114 generates predicted images in all candidate intra prediction modes, evaluates the cost function value of each predicted image using the input image supplied from the screen rearrangement buffer 102, and selects the optimum mode. select. When the optimal intra prediction mode is selected, the intra prediction unit 114 supplies the predicted image generated in the optimal mode to the predicted image selection unit 116.

- the intra prediction unit 114 appropriately supplies intra prediction mode information or the like indicating the adopted intra prediction mode to the lossless encoding unit 106, and causes the lossless encoding unit 106 to encode the information.

- the motion prediction / compensation unit 115 performs motion prediction (inter prediction) using the input image supplied from the screen rearrangement buffer 102 and the reference image supplied from the frame memory 112 via the selection unit 113.

- the motion prediction / compensation unit 115 performs motion compensation processing according to the detected motion vector to generate a predicted image (inter predicted image information).

- the motion prediction / compensation unit 115 performs such inter prediction in a plurality of inter prediction modes prepared in advance.

- the motion prediction / compensation unit 115 generates a prediction image in all candidate inter prediction modes.

- the motion prediction / compensation unit 115 evaluates the cost function value of each predicted image using the input image supplied from the screen rearrangement buffer 102, the information of the generated difference motion vector, and the like, and selects the optimal mode. .

- the motion prediction / compensation unit 115 selects the optimal inter prediction mode, the motion prediction / compensation unit 115 supplies the prediction image generated in the optimum mode to the prediction image selection unit 116.

- the motion prediction / compensation unit 115 supplies the lossless encoding unit 106 with information indicating the adopted inter prediction mode, and information necessary for performing processing in the inter prediction mode when decoding encoded data. And encoding.

- the necessary information includes, for example, information of the generated differential motion vector, and a flag indicating an index of a predicted motion vector as predicted motion vector information.

- the predicted image selection unit 116 selects the supply source of the predicted image to be supplied to the calculation unit 103 and the calculation unit 110.

- the prediction image selection unit 116 selects the intra prediction unit 114 as a supply source of a prediction image, and supplies the prediction image supplied from the intra prediction unit 114 to the calculation unit 103 and the calculation unit 110.

- the predicted image selection unit 116 selects the motion prediction / compensation unit 115 as a supply source of the predicted image, and the prediction image supplied from the motion prediction / compensation unit 115 is calculated by the calculation unit 103. And the calculation unit 110.

- the rate control unit 117 controls the rate of the quantization operation of the quantization unit 105 based on the code amount of the encoded data accumulated in the accumulation buffer 107 so as to prevent overflow or underflow.

- the orthogonal transformation skip unit 121 controls the execution of orthogonal transformation processing in the orthogonal transformation unit 104. Further, according to the control, the orthogonal transformation skip unit 121 performs quantization processing by the quantization unit 105, inverse quantization processing by the inverse quantization unit 108, inverse orthogonal transformation processing by the inverse orthogonal transformation unit 109, and deblocking. The deblocking filter processing by the filter 111 is controlled. Furthermore, the orthogonal transformation skip unit 121 supplies information necessary for orthogonal transformation processing skip and information about quantization and deblocking filter to the lossless encoding unit 106 and transmits the information from the accumulation buffer 107 to the decoding side. .

- a coding unit (Coding Unit)) is defined.

- a CU is also called a Coding Tree Block (CTB), and is a partial area of a picture-based image that plays the same role as a macroblock in the AVC system.

- CTB Coding Tree Block

- the latter is fixed at a size of 16 ⁇ 16 pixels, whereas the size of the former is not fixed, and is designated in the image compression information in each sequence.

- a CU maximum size (Largest Coding Unit)

- SCU Smallest Coding Unit

- split-flag 1 within the range not exceeding the size of the SCU.

- the size of LCU is 128 and the maximum hierarchical depth is 5.

- split_flag the value of split_flag is “1”

- a 2N ⁇ 2N-sized CU is divided into an N ⁇ N-sized CU, which is one level lower.

- a CU is divided into prediction units (Prediction Units (PUs)), which are regions serving as processing units for intra or inter prediction (partial regions of images in units of pictures), and regions serving as processing units for orthogonal transformation. It is divided into transform units (Transform Units (TUs)), which are (partial areas of an image in picture units).

- Prediction Units PUs

- transform units Transform Units (TUs)

- TUs Transform Units

- a macro block in the AVC method corresponds to an LCU

- a block (subblock) corresponds to a CU.

- a motion compensation block in the AVC scheme corresponds to a PU.

- the size of the LCU in the top layer is generally set to be larger than a macroblock of the AVC scheme, such as 128 ⁇ 128 pixels.

- the LCU also includes a macroblock in the AVC scheme

- the CU also includes a block (sub-block) in the AVC scheme.

- “block” used in the following description indicates an arbitrary partial area in a picture, and the size, shape, characteristics, and the like thereof are not limited. That is, the “block” includes, for example, any region (processing unit) such as TU, PU, SCU, CU, LCU, sub block, macroblock, or slice. Of course, other partial areas (processing units) are also included. When it is necessary to limit the size, the processing unit, etc., it will be described appropriately.

- Quantization matrix In HEVC, as in AVC, quantization of orthogonal transformation coefficients is performed for each orthogonal transformation processing unit. A quantization matrix is used for this quantization, but this quantization matrix is prepared for each size of the orthogonal transformation processing unit. However, transmitting a large quantization matrix such as 16 ⁇ 16 or 32 ⁇ 32, for example, may reduce the coding efficiency.

- a large quantization matrix (or a quantization matrix larger than a predetermined size) such as 16 ⁇ 16 or 32 ⁇ 32 is transmitted in an 8 ⁇ 8 size, as shown in FIG. It is upsampled by Hold and applied for each orthogonal transform size.

- DC components are separately transmitted.

- the information on the quantization matrix is a sequence parameter set (SPS (Sequence Parameter Set)) or a picture parameter set (PPS (Picture Parameter). Transmitted in Set)).

- SPS Sequence Parameter Set

- PPS Picture Parameter

- Transmitted in Set 4 and 5 show examples of sequence parameter sets.

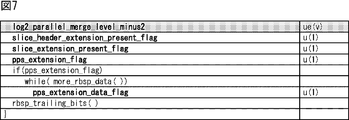

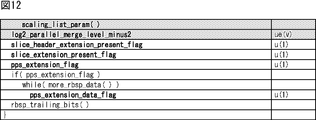

- 6 and 7 show examples of picture parameter sets.

- deblock filter Also, in HEVC, a deblocking filter is defined in a motion compensation loop, as in AVC.

- the deblocking filter is a filtering process that reduces block distortion that occurs at block boundaries.

- the deblocking filter process block boundaries are detected, and the type, strength, offset, and the like of the filter are determined based on the quantization parameter and the like at the block boundaries, and the filter process is performed.

- H.264 / MPEG-4 AVC reference software called JM (Joint Model) (available at http://iphome.hhi.de/suehring/tml/index.htm)

- JM Job Model

- JM JM it is possible to select two mode determination methods of High Complexity Mode and Low Complexity Mode described below. Both calculate the cost function value regarding each prediction mode Mode, and select the prediction mode which makes this the minimum as the optimal mode with respect to the said block thru

- ⁇ is the entire set of candidate modes for encoding the block or macroblock

- D is the difference energy between the decoded image and the input image when encoded in the prediction mode.

- ⁇ is a Lagrange undetermined multiplier given as a function of the quantization parameter.

- R is a total code amount in the case of encoding in this mode, including orthogonal transform coefficients.

- D is the difference energy between the predicted image and the input image, unlike in the case of the High Complexity Mode.

- QP2Quant QP

- HeaderBit is a code amount related to information belonging to the Header, such as a motion vector or a mode, which does not include an orthogonal transformation coefficient.

- Orthogonal transformation skip is a method of skipping (or skipping) orthogonal transformation processing.

- the image data (differential image data) is subjected to orthogonal transformation processing for each block to convert the information in the spatial domain in the block into the information in the frequency domain, thereby lowering the coefficients in the block.

- orthogonal transformation skip a block to which orthogonal transformation skip (Transform Skip) is applied is also referred to as orthogonal transformation skip block.

- a block to which orthogonal transformation skip is not applied (orthogonal transformation is performed) is also referred to as non-orthogonal transformation skip block.

- a flag is transmitted as to whether or not it is possible to apply orthogonal transform skip (Transform Skip) to the sequence. .

- a flag (transform_skip_enabled_flag) which is skip enable information indicating whether or not orthogonal transform skip (TransformSkip) is enabled (enable / disable) is set in the sequence parameter set (SPS (Sequence Parameter Set)) as shown in FIG. It is transmitted.

- SPS Sequence Parameter Set

- the skip permission information (transform_skip_enabled_flag) is set by, for example, the user.

- this value is 1, orthogonal transform skip (TransformSkip) can be applied to a 4 ⁇ 4 luminance orthogonal transform block or a 4 ⁇ 4 chrominance orthogonal transform block.

- the quantization matrix is a weighting factor for the frequency domain. That is, the quantization matrix is designed to apply to blocks of orthogonal transform coefficients. Therefore, applying such a quantization matrix to a block of spatial domain values (difference image data) may reduce the coding efficiency. That is, there is a risk of reducing the image quality.

- the orthogonal transformation skip is applied to an image in which high frequency components are likely to be generated. Therefore, the orthogonal transformation skip block is likely to differ greatly in the content of the image from the non-orthogonal transformation skip block. That is, block distortion is likely to occur at the boundary between the orthogonal transformation skip block and the non-orthogonal transformation skip block.

- the encoding process is controlled in accordance with whether or not the current block to be processed is an orthogonal transformation skip (TransformSkip) block. More specifically, it controls quantization processing (dequantization processing) of coding processing and deblocking processing.

- TransformSkip orthogonal transformation skip

- quantization processing is performed using a quantization matrix for non-orthogonal transformation skip blocks subjected to orthogonal transformation, and for orthogonal transformation skip blocks where orthogonal transformation is skipped.

- the weighting process is performed using a weighting factor of 1 instead of the quantization matrix. That is, quantization is performed on all the coefficients of the orthogonal transformation skip block, which is the current block, using the weighting factor of 1.

- quantization is performed on a 4 ⁇ 4 orthogonal transformation skip block (a matrix of difference values before orthogonal transformation) using a weighting factor matrix in which one weighting factor is matrixed.

- a weighting factor matrix in which one weighting factor is matrixed.

- This weighting factor is arbitrary. For example, they may be scalar values.

- the direct current component (DC) of the quantization matrix may be used as the weighting factor.

- the quantization matrix is a weighting factor in the frequency domain, but its DC component is a value in the frequency domain and also a value in the spatial domain. If only the direct current component of the quantization matrix having such a feature is used, even if it is applied to each coefficient of the orthogonal transformation skip block which is a value related to the space domain, it is difficult to lead to a reduction in coding efficiency.

- the weighting factor may be generated arbitrarily, for example, separately from the quantization matrix.

- the generation method is arbitrary.

- the weighting coefficients are arranged in 4 ⁇ 4 to generate a weighting coefficient matrix, and using the weighting coefficient matrix, a 4 ⁇ 4 orthogonal transformation skip block (before orthogonal transformation) is generated.

- the matrix of difference values is quantized.

- control such as improving the image quality more than the other parts is performed only for the part to which the orthogonal transformation skip block is applied (for example, CG image etc.). It can be done easily.

- the weighting coefficient may be calculated on the encoding side and the decoding side by the same method, or may be transmitted from the encoding side to the decoding side. Good.

- a quantized scalar value (weighting factor) to be applied to the orthogonal transformation skip block is transmitted when the value of the skip enable information (transform_skip_enabled_flag) is a value (for example, 1) which permits orthogonal transformation skipping.

- the value of the skip enable information (transform_skip_enabled_flag) is a value (for example, 1) which permits orthogonal transformation skipping.

- the first change is to transmit skip enable information (transform_skip_enabled_flag) earlier than the quantization matrix (scaling_list).

- the second modification is to transmit skip enable information (transform_skip_enabled_flag) also in PPS. This is because there is no parsing dependency between SPS and PPS.

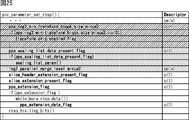

- the SPS is configured as shown in FIGS. 9 and 10

- the PPS is configured as shown in FIGS.

- the weighting factor may be generated by calculation of an average value or the like using, for example, the DC component of the quantization matrix applied to the quantization of the peripheral block located around the current block. This calculation method is arbitrary and may be other than the average.

- the weighting coefficients are arranged in 4 ⁇ 4 to generate a weighting coefficient matrix, and using the weighting coefficient matrix, a 4 ⁇ 4 orthogonal transformation skip block (before orthogonal transformation) is generated.

- the matrix of difference values is quantized.

- Orthogonal transformation skip TransformSkip

- TransformSkip TransformSkip

- the boundary between the orthogonal transformation skip block and the non-orthogonal transformation skip block is as follows. Adjust the strength of the deblocking filter to make it easy to apply the deblocking filter.

- the block boundary strength bS (Boundary Strength) value is incremented by 1.

- the bS value may be fixed to a large value such as 2 instead of +1 the bs value.

- adjustment of the filter strength is performed from parameters such as bs value, ⁇ , ⁇ , etc., but for boundaries of the orthogonal transform skip block and the non-orthogonal transform skip block regardless of the control result of such filter strength. May apply Strongfilter. By doing this, it is possible to apply a strong deblock filter more directly to the boundaries between the orthogonal transform skip block and the non-orthogonal transform skip block.

- the deblock filter can be more easily applied at the boundary between the orthogonal transformation skip block and the non-orthogonal transformation skip block, and the efficiency of the output image compression information can be improved. be able to.

- the method of making a deblocking filter easy to apply can be considered plural as mentioned above, you may combine and use the several method. Of course, the method may include methods other than those described above.

- FIG. 13 is a block diagram illustrating an exemplary main configuration of the orthogonal transformation skip unit 121 and the like.

- the orthogonal transformation skip unit 121 is configured to include a skip coding unit 131 and a skip determination unit 132.

- the skip encoding unit 131 obtains, from the orthogonal transformation unit 104, the orthogonal transformation coefficient and the orthogonal transformation difference value of the current block.

- the skip coding unit 131 performs coding processing when orthogonal transform skip is not applied, using the supplied orthogonal transform coefficient, and generates a cost function value.

- the skip coding unit 131 performs coding processing when orthogonal transform skip is applied using the supplied difference value before orthogonal transform, and generates a cost function value.

- the skip encoding unit 131 supplies those cost function values to the skip determination unit 132.

- the skip encoding unit 131 When the current block is larger than 4 ⁇ 4, the skip encoding unit 131 omits this process.

- the skip determination unit 132 supplies a control signal instructing to perform orthogonal transformation to the orthogonal transformation unit 104. Based on this control, the orthogonal transformation unit 104 performs orthogonal transformation of the current block.

- the skip determination unit 132 acquires, from the lossless encoding unit 106, skip permission information (transform_skip_enabled_flag) indicating whether to permit skipping of the orthogonal transformation process.

- the skip enable information (transform_skip_enabled_flag) is, for example, preset by the user or the like, and stored in the lossless encoding unit 106.

- the skip determination unit 132 supplies, to the orthogonal transformation unit 104, a control signal indicating whether or not to permit orthogonal transformation skip according to the skip enable information (transform_skip_enabled_flag).

- the skip determination unit 132 supplies a control signal for permitting orthogonal transformation skip to the orthogonal transformation unit 104.

- the skip determination unit 132 supplies the orthogonal transformation unit 104 with a control signal that prohibits the orthogonal transformation skip. .

- the skip determination unit 132 determines the optimal mode based on the cost function value supplied from the skip encoding unit 131. That is, it is determined whether or not to apply the orthogonal transformation skip (TransformSkip) to the current block.

- the skip determination unit 132 sets the determination result (information indicating the determined optimum mode) as a control signal to the orthogonal transformation unit 104, the quantization unit 105, the deblock filter 111, the inverse quantization unit 108, and the inverse orthogonal transformation unit It supplies to 109.

- the skip determination unit 132 generates skip identification information (TransformSkipFlag) for identifying the determination result (whether orthogonal transformation skip is applied to the current block), and supplies this to the lossless encoding unit 106. , To transmit.

- skip identification information TransformSkipFlag

- the orthogonal transformation unit 104 performs orthogonal transformation coefficients and orthogonal transformation differences of the current block in all modes not prohibited by the control signal supplied from the skip encoding unit 131, regarding the pre-orthogonal transformation difference values acquired from the arithmetic operation unit 103. Generate a value The orthogonal transformation unit 104 supplies the generated orthogonal transformation coefficient of the current block and the difference value before orthogonal transformation to the skip encoding unit 131. When orthogonal transformation skip is prohibited by the control signal, the orthogonal transformation unit 104 supplies only the orthogonal transformation coefficient of the current block to the skip encoding unit 131.

- the orthogonal transformation unit 104 acquires the control signal supplied from the skip determination unit 132, and performs processing of the designated mode according to the control. . That is, the orthogonal transformation unit 104 performs or skips the orthogonal transformation process, and supplies the orthogonal transformation coefficient difference value to the quantization unit 105 when skipping or executing the orthogonal transformation coefficient.

- the orthogonal transformation unit 104 can appropriately perform orthogonal transformation as necessary, and can suppress the reduction in encoding efficiency and can suppress the reduction in image quality due to encoding and decoding. .

- the orthogonal transformation unit 104 holds the orthogonal transformation coefficients and the pre-orthogonal transformation difference values of current blocks in all modes to be supplied to the skip encoding unit 131, and from among these, the control signal from the skip determination unit 132 It is also possible to select the orthogonal transformation coefficient or the pre-orthogonal transformation difference value of the mode according to the above and supply it to the quantization unit 105. By doing this, the process can be omitted and the load can be reduced.

- the quantization unit 105 is configured to include a quantization matrix setting unit 141, a weight coefficient generation unit 142, and a quantization processing unit 143.

- the quantization matrix setting unit 141 supplies the quantization coefficient set by the user or the like to the weight coefficient generation unit 142.

- the weight coefficient generation unit 142 acquires the control signal supplied from the skip determination unit 132.

- the weight coefficient generation unit 142 supplies the quantization matrix or the weight coefficient to the quantization processing unit 143 based on the control of the control signal.

- the weight coefficient generation unit 142 supplies the quantization matrix supplied from the quantization matrix setting unit 141 in the mode specified by the control signal to the quantization processing unit 143.

- the weight coefficient generation unit 142 when orthogonal transformation skip is applied, the weight coefficient generation unit 142 generates a weight coefficient, and supplies the generated weight coefficient to the quantization processing unit 143.

- the method of generating weighting factors is arbitrary.

- the DC component of the quantization matrix supplied from the quantization matrix setting unit 141 may be extracted and used as a weighting factor, or the weighting factor may be used separately from the quantization matrix supplied from the quantization matrix setting unit 141. It may be set, or the weighting factor may be calculated from the DC component of the quantization matrix of the peripheral block.

- the quantization processing unit 143 uses the quantization matrix or weighting factor supplied from the weighting factor generation unit 142, the quantization parameter or the like supplied from the rate control unit 117, and performs orthogonal processing supplied from the orthogonal transformation unit 104.

- the transform coefficient or the difference value before orthogonal transformation is quantized.

- the quantization processing unit 143 quantizes the orthogonal transformation coefficient of the current block using the quantization matrix, the quantization parameter, and the like. Further, when the pre-orthogonal transformation difference value is supplied from the orthogonal transformation unit 104, the quantization processing unit 143 quantizes the pre-orthogonal transformation difference value of the current block using a weighting factor, a quantization parameter, and the like.

- the quantization processing unit 143 supplies the quantized coefficients to the lossless encoding unit 106 and the inverse quantization unit 108. Also, if necessary, the quantization processing unit 143 supplies a parameter related to quantization, such as a weighting factor, to the lossless encoding unit 106 for transmission.

- a parameter related to quantization such as a weighting factor

- the quantization processing unit 143 can appropriately perform quantization so as to suppress the reduction in image quality. Therefore, the image coding apparatus 100 can suppress the reduction in image quality due to coding and decoding. In other words, the image coding apparatus 100 can improve the coding efficiency.

- the quantization processing unit 143 may supply the quantization matrix or the weighting factor applied to the quantization process to the inverse quantization unit 108 together with, for example, the quantized coefficient.

- the deblocking filter 111 is configured to include a boundary determination unit 151, an intensity adjustment unit 152, and a filtering unit 153.

- the boundary determination unit 151 acquires a control signal from the skip determination unit 132 for the current block. In addition, the boundary determination unit 151 acquires skip identification information (TransformSkipFlag) that identifies whether or not orthogonal transformation skip is applied to the peripheral blocks of the current block. The boundary determination unit 151 determines whether or not the block boundary to be processed is the boundary between the orthogonal transformation skip block and the non-orthogonal transformation skip block based on the information, and a control signal indicating the determination result is The signal is supplied to the strength adjustment unit 152.

- skip identification information TransformSkipFlag

- the strength adjustment unit 152 generates various parameters such as Bs value, ⁇ , ⁇ , and tc, and determines the strength of the deblocking filter based on those values and the control signal supplied from the boundary determination unit 151. That is, when the block boundary of the processing target is not the boundary between the orthogonal transformation skip block and the non-orthogonal transformation skip block, the intensity adjustment unit 152 performs decoding based on the generated values of various parameters such as Bs, ⁇ , ⁇ , and tc. Determine the strength of the block filter. In addition, when the block boundary to be processed is the boundary between the orthogonal transformation skip block and the non-orthogonal transformation skip block, the intensity adjustment unit 152 further determines the filter intensity in any method as described above based on the control signal. To strengthen,

- the strength adjustment unit 152 notifies the filtering unit 153 of the set filter strength.

- the filtering unit 153 performs deblocking filter processing on the pixel values before deblocking filter of the block boundary, which are supplied from the computing unit 110, using the filter strength supplied from the intensity adjusting unit 152.

- the filtering unit 153 supplies the deblock filtered pixel values to the frame memory 112 for storage. This information is used for intra and inter prediction processing.

- the deblocking filter 111 can perform filtering so that the deblocking filter is applied more strongly to the boundary between the orthogonal transformation skip block and the non-orthogonal transformation skip block. Therefore, the reduction in image quality is further suppressed. That is, the image coding apparatus 100 can suppress the reduction in image quality due to coding and decoding. In other words, the image coding apparatus 100 can improve the coding efficiency.

- step S101 the lossless encoding unit 106 generates skip permission information (transform_skip_enabled_flag) indicating whether to permit skipping of orthogonal transformation processing based on, for example, a user instruction or the like.

- This skip permission information (transform_skip_enabled_flag) is transmitted, for example, in the SPS.

- step S102 the A / D conversion unit 101 A / D converts the input image.

- step S103 the screen rearrangement buffer 102 stores the A / D converted image, and performs rearrangement from the display order of each picture to the encoding order.

- step S104 the intra prediction unit 114 performs intra prediction processing in the intra prediction mode.

- step S105 the motion prediction / compensation unit 115 performs inter motion prediction processing that performs motion prediction and motion compensation in the inter prediction mode.

- step S106 the predicted image selection unit 116 determines the optimal mode based on the cost function values output from the intra prediction unit 114 and the motion prediction / compensation unit 115. That is, the prediction image selection unit 116 selects one of the prediction image generated by the intra prediction unit 114 and the prediction image generated by the motion prediction / compensation unit 115.

- step S107 the computing unit 103 computes the difference between the image rearranged in the process of step S103 and the predicted image selected in the process of step S106.

- the amount of difference data is reduced compared to the original image data. Therefore, the amount of data can be compressed as compared to the case of encoding the image as it is.

- step S108 the orthogonal transformation skip unit 121 performs orthogonal transformation skip control processing.

- step S109 the orthogonal transformation unit 104 performs an orthogonal transformation process on the difference information generated by the process of step S107, in accordance with the process result of step S108.

- step S110 the quantization unit 105 quantizes the orthogonal transformation coefficient or the orthogonal transformation difference value obtained by the process of step S109 using the quantization parameter from the rate control unit 117 according to the process result of step S108. Do.

- step S111 the inverse quantization unit 108 corresponds the characteristic of the quantization unit 105 according to the processing result of step S108 to the quantized coefficient (also referred to as quantization coefficient) generated by the processing of step S111.

- the inverse orthogonal transformation unit 109 performs inverse orthogonal transformation processing on the orthogonal transformation coefficient or the pre-orthogonal transformation difference value obtained by the processing in step S111 according to the processing result in step S108.

- step S111 and step S112 The description of the details of each processing in step S111 and step S112 is omitted because the description of the same processing performed in the decoding processing can be applied mutatis mutandis.

- step S113 the calculation unit 110 adds the prediction image to the locally decoded difference information to generate a locally decoded image (an image corresponding to an input to the calculation unit 103).

- step S114 the deblocking filter 111 appropriately performs deblocking filter processing on the local decoded image obtained by the processing of step S113 in accordance with the processing result of step S108.

- step S115 the frame memory 112 stores the decoded image which has been subjected to the deblocking filter process in the process of step S114.

- the image not subjected to filter processing by the deblocking filter 111 is also supplied from the arithmetic unit 110 to the frame memory 112 and stored.

- step S116 the lossless encoding unit 106 encodes the coefficient quantized in the process of step S110. That is, lossless encoding such as variable-length encoding or arithmetic encoding is performed on data corresponding to the difference image.

- the lossless encoding unit 106 encodes information on the prediction mode of the prediction image selected in the process of step S106, and adds the information to encoded data obtained by encoding a differential image. That is, the lossless encoding unit 106 also encodes the optimal intra prediction mode information supplied from the intra prediction unit 114 or the information according to the optimal inter prediction mode supplied from the motion prediction / compensation unit 115, and the like. Append to data.

- the lossless encoding unit 106 further appropriately encodes information on orthogonal transformation and quantization and adds the information to encoded data.

- step S117 the accumulation buffer 107 accumulates the encoded data obtained by the process of step S116.

- the encoded data stored in the storage buffer 107 is appropriately read and transmitted to the decoding side via a transmission path or a recording medium.

- step S118 the rate control unit 117 prevents the overflow or underflow from occurring on the basis of the code amount (generated code amount) of the encoded data accumulated in the accumulation buffer 107 by the process of step S117. Control the rate of the quantization operation of Further, the rate control unit 117 supplies the information on the quantization parameter to the quantization unit 105.

- step S118 ends, the encoding process ends.

- the skip determination unit 132 determines whether the TransformSkip mode for performing orthogonal transformation skip is permitted based on the skip permission information (transform_skip_enabled_flag) in step S131.

- step S132 the skip determination unit 132 includes the TransformSkip mode in the candidate mode.

- step S134 the process proceeds to step S134.

- step S132 If it is determined in step S132 that the TransformSkip mode is not permitted, the process proceeds to step S133.

- step S133 the skip determination unit 132 removes the TransformSkip mode from the candidate modes.

- step S134 the process proceeds to step S134.

- step S134 the skip encoding unit 131 selects an unprocessed candidate mode.

- step S135 the skip encoding unit 131 determines whether the selected mode is an orthogonal transform (TransformSkip) mode.

- TransformSkip orthogonal transform

- step S136 the skip encoding unit 131 generates a weighting factor.

- step S139 the process proceeds to step S139.

- step S135 If it is determined in step S135 that the selected mode is not the orthogonal transform (TransformSkip) mode, the process proceeds to step S137.

- step S137 the skip encoding unit 131 orthogonally transforms the current block.

- step S138 the skip encoding unit 131 obtains a quantization matrix.

- step S139 the skip coding unit 131 performs coding using the orthogonal transformation coefficient obtained by the orthogonal transformation unit 104 or the difference value before orthogonal transformation, and generates a cost function value for the current mode.

- step S140 the skip encoding unit 131 determines whether all candidate modes have been processed. If there is an unprocessed candidate mode, the process returns to step S134 and repeats the subsequent processes. That is, each process of step S134 to step S140 is repeatedly performed until cost function values are generated for all modes.

- step S140 If it is determined in step S140 that all candidate modes have been processed, the process proceeds to step S141.

- step S141 the skip determination unit 132 determines the optimum mode based on the cost function value.

- step S142 the skip determination unit 132 generates skip identification information (TransformSkipFlag) based on the optimal mode.

- step S142 When the process of step S142 ends, the orthogonal transformation skip control process ends, and the process returns to FIG.

- step S151 the orthogonal transformation unit 104 determines whether or not the optimum mode selected by the skip determination unit 132 is orthogonal transformation skip (TransformSkip mode). If it is determined that the orthogonal transformation skip (TransformSkip mode) is performed, the process proceeds to step S152.

- the orthogonal transformation skip TransformSkip mode

- step S152 the orthogonal transformation unit 104 skips the orthogonal transformation process, and outputs the difference value before orthogonal transformation of the current block.

- step S151 in FIG. 16 If it is determined in step S151 in FIG. 16 that the orthogonal transformation skip (TransformSkip mode) is not performed, the process proceeds to step S153.

- step S153 the orthogonal transformation unit 104 orthogonally transforms the pre-orthogonal transformation difference value of the current block.

- step S154 the orthogonal transformation unit 104 outputs the obtained orthogonal transformation coefficient.

- step S161 the weight coefficient generation unit 142 determines whether the optimum mode selected by the skip determination unit 132 is orthogonal transform skip (TransformSkip mode). If it is determined that the orthogonal transformation skip (TransformSkip mode) is performed, the process proceeds to step S162.

- step S162 the weighting factor generation unit 142 generates a weighting factor.

- the process of step S162 ends, the process proceeds to step S164.

- step S161 If it is determined in step S161 that the orthogonal transformation skip (TransformSkip mode) is not performed, the process proceeds to step S163.

- step S163 the weight coefficient generation unit 142 acquires a quantization matrix.

- step S164 using the weighting factor generated in step S162 or the quantization matrix acquired in step S163, the quantization processing unit 143 quantizes the orthogonal transformation coefficient of the current block or the difference value before the orthogonal transformation coefficient. Perform.

- step S165 the quantization processing unit 143 supplies the quantization matrix and the applied weighting factors to the lossless encoding unit 106 for transmission.

- step S171 the intensity adjustment unit 152 acquires mode information, motion vectors, reference frame information, and the like.

- step S172 the intensity adjustment unit 152 detects block boundaries such as TUs and PUs.

- step S173 the strength adjustment unit 152 determines the Bs value based on these pieces of information.

- step S174 the intensity adjustment unit 152 calculates the quantization parameter (boundary QP) at the block boundary, using the quantization parameters of both blocks as QP_P and QP_Q as shown in the following equation (3).

- step S175 the intensity adjustment unit 152 determines the ⁇ and tc offset values using the boundary QP calculated as described above.

- step S176 the intensity adjustment unit 152 determines a filter (strong, weak, off) by the calculated offset process.

- step S177 the boundary determination unit 151 acquires the control signal of the current block from the skip determination unit 132, and acquires the skip identification information (TransformSkipFlag) of the neighboring blocks from the lossless encoding unit 106.

- the skip identification information TransformSkipFlag

- step S178 the boundary determination unit 151 determines whether the block boundary to be processed is a boundary between the orthogonal transformation skip block and the non-orthogonal transformation skip block.

- step S179 the intensity adjustment unit 152 adjusts the deblocking filter intensity.

- step S180 the process proceeds to step S180.

- step S178 If it is determined in step S178 that the block boundary to be processed is not the boundary between the orthogonal transformation skip block and the non-orthogonal transformation skip block, the process proceeds to step S180.

- step S180 the filtering unit 153 performs deblocking filter processing.

- the deblocking filter process ends, and the process returns to FIG.

- the image coding apparatus 100 can suppress a reduction in coding efficiency and can suppress a reduction in image quality due to coding and decoding.

- FIG. 19 is a block diagram showing an example of a main configuration of an image decoding device corresponding to the image coding device 100 of FIG.

- the image decoding apparatus 200 shown in FIG. 19 decodes the encoded data generated by the image encoding apparatus 100 by a decoding method corresponding to the encoding method.

- the image decoding apparatus 200 includes an accumulation buffer 201, a lossless decoding unit 202, an inverse quantization unit 203, an inverse orthogonal transformation unit 204, an operation unit 205, a deblock filter 206, a screen rearrangement buffer 207, and A D / A conversion unit 208 is provided.

- the image decoding apparatus 200 further includes a frame memory 209, a selection unit 210, an intra prediction unit 211, a motion prediction / compensation unit 212, and a selection unit 213.

- the image decoding apparatus 200 includes an inverse orthogonal transformation skip unit 221.

- the accumulation buffer 201 is also a receiving unit that receives the transmitted encoded data.

- the accumulation buffer 201 receives and stores the transmitted encoded data, and supplies the encoded data to the lossless decoding unit 202 at a predetermined timing.

- Information necessary for decoding such as prediction mode information is added to the encoded data.

- the lossless decoding unit 202 decodes the information supplied from the accumulation buffer 201 and encoded by the lossless encoding unit 106 in FIG. 1 using a method corresponding to the encoding method of the lossless encoding unit 106.

- the lossless decoding unit 202 supplies the quantized coefficient data of the differential image obtained by the decoding to the inverse quantization unit 203.

- the lossless decoding unit 202 determines whether the intra prediction mode is selected or the inter prediction mode is selected as the optimum prediction mode, and the information on the optimum prediction mode can be obtained by the intra prediction unit 211 and the motion prediction / compensation unit Among the modes 212, the mode is determined to be selected. That is, for example, when the intra prediction mode is selected as the optimal prediction mode in the image coding apparatus 100, information on the optimal prediction mode is supplied to the intra prediction unit 211. Also, for example, when the inter prediction mode is selected as the optimum prediction mode in the image coding apparatus 100, information on the optimum prediction mode is supplied to the motion prediction / compensation unit 212.

- the lossless decoding unit 202 supplies information necessary for inverse quantization, such as a quantization matrix and a quantization parameter, to the inverse quantization unit 203, for example. Furthermore, the lossless decoding unit 202 supplies, to the inverse orthogonal transformation skip unit 221, information necessary for the inverse orthogonal transformation, such as, for example, the skip enable information (transform_skip_enabled_flag) and the skip identification information (TransformSkipFlag).

- the inverse quantization unit 203 converts the quantized coefficient data obtained by being decoded by the lossless decoding unit 202 into the quantization method of the quantization unit 105 of FIG. Dequantize in a corresponding manner.

- this inverse quantization unit 203 is a processing unit similar to the inverse quantization unit 108 of the image coding apparatus 100 of FIG. 1. That is, the description of the dequantization unit 203 can be applied to the dequantization unit 108 as well. However, it is necessary to change and read data input / output destinations and the like according to the apparatus as appropriate.

- the inverse quantization unit 203 supplies the obtained coefficient data to the inverse orthogonal transform unit 204.

- the inverse orthogonal transformation unit 204 is a diagram of coefficient data (orthogonal transformation coefficient or difference value before orthogonal transformation) supplied from the inverse quantization unit 203 under the control of the inverse orthogonal transformation skip unit 221 as necessary. Inverse orthogonal transform is performed by a method corresponding to the orthogonal transform method of the one orthogonal transform unit 104.

- the inverse orthogonal transform unit 204 is a processing unit similar to the inverse orthogonal transform unit 109 of the image coding apparatus 100 in FIG. 1. That is, the description of the inverse orthogonal transform unit 204 can be applied to the inverse orthogonal transform unit 109 as well. However, it is necessary to change and read data input / output destinations and the like according to the apparatus as appropriate.

- the inverse orthogonal transformation unit 204 obtains decoded residual data corresponding to residual data before orthogonal transformation in the image coding apparatus 100 by this inverse orthogonal transformation processing.

- the decoded residual data obtained by the inverse orthogonal transform is supplied to the arithmetic unit 205. Further, the prediction image is supplied to the calculation unit 205 from the intra prediction unit 211 or the motion prediction / compensation unit 212 via the selection unit 213.

- Arithmetic unit 205 adds the decoded residual data and the predicted image to obtain decoded image data corresponding to the image data before the predicted image is subtracted by arithmetic unit 103 of image coding apparatus 100.

- the operation unit 205 supplies the decoded image data to the deblocking filter 206.

- the deblocking filter 206 appropriately applies deblocking filter processing to the supplied decoded image, and supplies it to the screen rearrangement buffer 207.

- the deblocking filter 206 removes block distortion of the decoded image by performing deblocking filter processing on the decoded image.

- the deblocking filter 206 is a processing unit similar to the deblocking filter 111 of the image coding apparatus 100 of FIG. 1.

- the deblocking filter 206 supplies the filter processing result (decoded image after filter processing) to the screen rearrangement buffer 207 and the frame memory 209. Note that the decoded image output from the arithmetic unit 205 can be supplied to the screen rearrangement buffer 207 or the frame memory 209 without passing through the deblocking filter 206. That is, the filtering process by the deblocking filter 206 can be omitted.

- the screen rearrangement buffer 207 rearranges the images. That is, the order of the frames rearranged for the order of encoding by the screen rearrangement buffer 102 in FIG. 1 is rearranged in the order of the original display.

- the D / A conversion unit 208 D / A converts the image supplied from the screen rearrangement buffer 207, and outputs the image to a display (not shown) for display.

- the frame memory 209 stores the decoded image to be supplied, and at a predetermined timing or based on an external request such as the intra prediction unit 211 or the motion prediction / compensation unit 212, the stored decoded image is referred to as a reference image As the selection unit 210.

- the selection unit 210 selects the supply destination of the reference image supplied from the frame memory 209.

- the selection unit 210 supplies the reference image supplied from the frame memory 209 to the intra prediction unit 211.

- the selection unit 210 supplies the reference image supplied from the frame memory 209 to the motion prediction / compensation unit 212.

- the intra prediction unit 211 performs intra prediction using the reference image acquired from the frame memory 209 in the intra prediction mode used by the intra prediction unit 114 in FIG. 1, and generates a prediction image.

- the intra prediction unit 211 supplies the generated predicted image to the selection unit 213.

- the motion prediction / compensation unit 212 acquires information (optimum prediction mode information, reference image information, and the like) obtained by decoding header information from the lossless decoding unit 202.

- the motion prediction / compensation unit 212 performs inter prediction using the reference image acquired from the frame memory 209 in the inter prediction mode indicated by the optimal prediction mode information acquired from the lossless decoding unit 202, and generates a prediction image.

- the selection unit 213 supplies the predicted image from the intra prediction unit 211 or the predicted image from the motion prediction / compensation unit 212 to the calculation unit 205. Then, the operation unit 205 adds the predicted image generated using the motion vector and the decoded residual data (difference image information) from the inverse orthogonal transform unit 204 to decode the original image. That is, the motion prediction / compensation unit 212, the lossless decoding unit 202, the inverse quantization unit 203, the inverse orthogonal transformation unit 204, and the operation unit 205 decode the coded data using a motion vector to generate an original image. It is also a decryption unit.

- the inverse orthogonal transformation skip unit 221 acquires information supplied from the encoding side via the lossless decoding unit 202, and controls execution of the inverse orthogonal transformation process in the inverse orthogonal transformation unit 204 based on the information. In addition, the inverse orthogonal transformation skip unit 221 controls the dequantization process by the dequantization unit 203 and the deblock filter process by the deblock filter 206.

- the image decoding apparatus 200 can appropriately decode the encoded data. Therefore, the image decoding apparatus 200 can suppress the reduction of the coding efficiency, and can suppress the reduction of the image quality due to the encoding / decoding.

- FIG. 20 is a block diagram illustrating an exemplary main configuration of the inverse orthogonal transformation skip unit 221 and the like.

- the inverse orthogonal transform skip unit 221 is configured to include a TransfomSkipFlag buffer 231 and a control signal generation unit 232.

- the TransfomSkipFlag buffer 231 acquires and holds the skip enable information (transform_skip_enabled_flag) and the skip identification information (TransfomSkipFlag) extracted from the encoded data (bit stream) in the lossless decoding unit 202.

- the TransfomSkipFlag buffer 231 supplies the control signal generating unit 232 with the skip enable information (transform_skip_enabled_flag) and the skip identification information (TransfomSkipFlag) held therein at predetermined timing or based on a request.

- the control signal generation unit 232 generates a control signal according to the skip enable information (transform_skip_enabled_flag) and the skip identification information (TransfomSkipFlag) supplied from the TransfomSkipFlag buffer 231, and the control signal is generated by the inverse quantization unit 203 and the inverse orthogonal transform unit 204. , And the deblocking filter 206.

- the control signal generation unit 232 supplies a control signal as follows. That is, the control signal generation unit 232 supplies the control signal instructing the inverse quantization unit 203 to perform inverse quantization using the quantization matrix. Also, the control signal generation unit 232 supplies a control signal instructing the inverse orthogonal transform unit 204 to perform inverse orthogonal transform. Furthermore, the control signal generation unit 232 supplies a control signal to notify the deblocking filter 206 that the block is not an orthogonal transformation skip block.

- orthogonal transform skip is permitted by the skip enable information (transform_skip_enabled_flag), and it is identified by the skip identification information (TransfomSkipFlag) that orthogonal transform skip is not applied when encoding the current block.

- the control signal generator 232 supplies a control signal as follows. That is, the control signal generation unit 232 supplies the control signal instructing the inverse quantization unit 203 to perform inverse quantization using the quantization matrix. Also, the control signal generation unit 232 supplies a control signal instructing the inverse orthogonal transform unit 204 to perform inverse orthogonal transform.

- control signal generation unit 232 supplies a control signal to notify the deblocking filter 206 that the block is not an orthogonal transformation skip block. That is, the control signal generation unit 232 may supply skip identification information (TransfomSkipFlag) to the deblocking filter 206 as a control signal.

- skip identification information TransfomSkipFlag

- the control signal generator 232 supplies control signals as follows. That is, the control signal generation unit 232 supplies the control signal instructing the inverse quantization unit 203 to perform inverse quantization using the weighting factor. Also, the control signal generation unit 232 supplies a control signal instructing the inverse orthogonal transform unit 204 not to perform the inverse orthogonal transform. Furthermore, the control signal generation unit 232 supplies a control signal to notify the deblocking filter 206 that the current block is the orthogonal transformation skip block. That is, the control signal generation unit 232 may supply skip identification information (TransfomSkipFlag) to the deblocking filter 206 as a control signal.

- the control signal generation unit 232 may supply skip identification information (TransfomSkipFlag) to the deblocking filter 206 as a control signal.

- the inverse quantization unit 203 is configured to include a quantization matrix buffer 241, a weighting factor generation unit 242, a quantization parameter buffer 243, and an inverse quantization unit 244.

- the quantization matrix buffer 241 acquires the quantization matrix extracted from the SPS or the like of the encoded data by the lossless decoding unit 202, and holds the quantization matrix. This quantization matrix is transmitted from the encoding side, and is used at the time of encoding. The quantization matrix buffer 241 supplies the held quantization matrix to the weight coefficient generation unit 242 at a predetermined timing or in response to a request. In addition, when the weighting factor applied at the time of encoding is transmitted from the encoding side, the quantization matrix buffer 241 acquires the weighting factor in the same manner as the quantization matrix, and the weighting factor generation unit 242 Supply.

- the weight coefficient generation unit 242 acquires the control signal supplied from the control signal generation unit 232. Based on the control of the control signal, the weighting factor generation unit 242 grasps whether or not the orthogonal transformation skip is applied to the current block at the time of encoding, and based on it, determines the quantization matrix or the weighting factor. The signal is supplied to the inverse quantization unit 244.