WO2013076978A1 - 画像処理方法および画像処理装置 - Google Patents

画像処理方法および画像処理装置 Download PDFInfo

- Publication number

- WO2013076978A1 WO2013076978A1 PCT/JP2012/007473 JP2012007473W WO2013076978A1 WO 2013076978 A1 WO2013076978 A1 WO 2013076978A1 JP 2012007473 W JP2012007473 W JP 2012007473W WO 2013076978 A1 WO2013076978 A1 WO 2013076978A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- parameter

- value

- block

- unit

- image processing

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/60—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding

- H04N19/61—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding in combination with predictive coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/117—Filters, e.g. for pre-processing or post-processing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/137—Motion inside a coding unit, e.g. average field, frame or block difference

- H04N19/139—Analysis of motion vectors, e.g. their magnitude, direction, variance or reliability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/157—Assigned coding mode, i.e. the coding mode being predefined or preselected to be further used for selection of another element or parameter

- H04N19/159—Prediction type, e.g. intra-frame, inter-frame or bidirectional frame prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/80—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation

- H04N19/82—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation involving filtering within a prediction loop

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/85—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using pre-processing or post-processing specially adapted for video compression

- H04N19/86—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using pre-processing or post-processing specially adapted for video compression involving reduction of coding artifacts, e.g. of blockiness

Definitions

- the present invention relates to an image processing method and an image processing apparatus that perform image filtering using a deblocking filter.

- the hybrid moving image encoding process is not limited to the ISO / IEC standards (MPEG-X standards such as MPEG-1, MPEG-2 and MPEG-4) but also the ITU-T standards (H.261 and H.263, etc.). .26X standard).

- a video signal indicating an image sequence composed of a series of frames is input to a moving image encoding apparatus that performs hybrid moving image encoding processing.

- an input image (frame) is divided into a plurality of blocks, and the encoding process is performed in units of the divided blocks.

- the block having the maximum size is referred to as a maximum coding unit LCU (Large Coding Unit).

- the size of the maximum encoding unit LCU is, for example, 64 ⁇ 64 pixels in HEVC.

- an LCU is further divided into coding units CU (coding unit) such as 16 ⁇ 16 pixels, and an image is coded in units of CUs.

- the coding unit CU may be divided into a smaller size prediction unit PU (Prediction Unit) and a transform unit TU (Transform Unit).

- PU Prediction Unit

- TU Transform Unit

- the block size may vary depending on the type of image content.

- the encoding method may be different for each block.

- Block noise is particularly prominent when coarse quantization is performed in the quantization process. Such block noise has a negative effect on human visual perception. That is, block noise reduces image quality.

- H As a method for reducing block noise, for example, H.

- the deblocking filter is used for the reconstructed image referred to in the prediction process.

- JCT-VC “WD3: Working Draft 3, of High-Efficiency Video Coding”, JCTVC-E603, March 2011, section 8.6.1.

- JCT-VC “Common test conditions and software reference configurations”, JCTVC-F900, July 2011.

- JCT-VC “WD4: Working Draft 4 of High-Efficiency Video Coding”, JCTVC-F803_d2, July 2011.

- An object of the present invention is to provide an image processing method and an image processing apparatus that perform a filtering process using a deblocking filter that can increase and reduce the adaptability to block noise.

- an image processing method for performing filtering processing on an image block using a plurality of deblocking filters having different filter strengths.

- a first parameter calculating step for calculating a first parameter indicating a boundary strength between image blocks; and a second parameter for calculating a second parameter indicating a limit value of the deblocking filter based on the first parameter and the quantization parameter.

- the adaptability to block noise can be further increased in an image processing method and an image processing apparatus using a deblocking filter.

- FIG. 1 is a block diagram illustrating a configuration example of the moving picture coding apparatus according to the first embodiment.

- FIG. 2A is a diagram illustrating an example of two encoded block units CU adjacent in the horizontal direction.

- FIG. 2B is a diagram illustrating an example of two encoded block units CU adjacent in the vertical direction.

- FIG. 3A is a diagram illustrating an example of pixel values in two encoded block units CU adjacent in the horizontal direction.

- 3B is a diagram illustrating a more detailed example of the adjacent block A and the processing target block B illustrated in FIG. 2A.

- FIG. 4A is a diagram illustrating a processing procedure of filtering processing in the comparative example.

- FIG. 4B is a diagram illustrating two blocks adjacent in the horizontal direction.

- FIG. 4C is a diagram showing two blocks adjacent in the vertical direction.

- FIG. 5 is a flowchart showing a processing procedure for calculating the boundary strength BS in the comparative example.

- FIG. 6 is a block diagram illustrating a configuration example of a deblocking filter processing unit of the video encoding device in the embodiment.

- FIG. 7A is a diagram illustrating a processing procedure of filtering processing in the embodiment.

- FIG. 7B is a diagram illustrating two blocks adjacent in the horizontal direction.

- FIG. 7C is a diagram showing two blocks adjacent in the vertical direction.

- FIG. 8 is a flowchart illustrating a processing procedure for calculating the boundary strength BS and setting the offset value t c _offset of the threshold value t c in the embodiment.

- FIG. 8 is a flowchart illustrating a processing procedure for calculating the boundary strength BS and setting the offset value t c _offset of the threshold value t c in the embodiment.

- FIG. 9A is a diagram illustrating an example of pixels used for strong filtering.

- FIG. 9B is a diagram illustrating an example of pixels that are filtered by strong filtering.

- FIG. 10A is a diagram illustrating an example of pixels used in weak filtering.

- FIG. 10B is a diagram illustrating an example of pixels that are filtered by weak filtering.

- FIG. 11 is a flowchart showing a processing procedure for calculating the boundary strength BS and setting the offset value t c _offset of the threshold value t c in the comparative example.

- FIG. 12A is a diagram illustrating the coding efficiency of the comparative example and the coding efficiency of the embodiment.

- FIG. 12B is a diagram illustrating the coding efficiency of the comparative example and the coding efficiency of the embodiment.

- FIG. 12A is a diagram illustrating the coding efficiency of the comparative example and the coding efficiency of the embodiment.

- FIG. 13 is a flowchart showing a processing procedure for calculating the boundary strength BS in the first modification.

- FIG. 14 is a diagram illustrating the coding efficiency of the comparative example and the coding efficiency of the embodiment.

- FIG. 15 is a diagram illustrating a setting example of the threshold value t c in the first modification.

- FIG. 16 is a diagram illustrating a setting example of the threshold value t c in the second modification.

- FIG. 17 is a diagram illustrating a setting example of the threshold value t c in the third modification.

- FIG. 18A is a diagram illustrating a processing procedure of filtering processing in the fourth modification.

- FIG. 18B is a diagram illustrating a setting example of the threshold value t c in the fourth modification.

- FIG. 19 is a block diagram illustrating a configuration example of the moving picture decoding apparatus according to the second embodiment.

- FIG. 20 is a block diagram illustrating a configuration example of the moving picture coding apparatus according to the second embodiment.

- FIG. 21 is an overall configuration diagram of a content supply system that realizes a content distribution service.

- FIG. 22 is an overall configuration diagram of a digital broadcasting system.

- FIG. 23 is a block diagram illustrating a configuration example of a television.

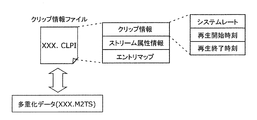

- FIG. 24 is a block diagram illustrating a configuration example of an information reproducing / recording unit that reads and writes information from and on a recording medium that is an optical disk.

- FIG. 25 is a diagram illustrating a structure example of a recording medium that is an optical disk.

- FIG. 26A illustrates an example of a mobile phone.

- FIG. 26A illustrates an example of a mobile phone.

- FIG. 26B is a block diagram illustrating a configuration example of a mobile phone.

- FIG. 27 is a diagram showing a structure of multiplexed data.

- FIG. 28 is a diagram schematically showing how each stream is multiplexed in the multiplexed data.

- FIG. 29 is a diagram showing in more detail how the video stream is stored in the PES packet sequence.

- FIG. 30 is a diagram illustrating the structure of TS packets and source packets in multiplexed data.

- FIG. 31 is a diagram illustrating a data structure of the PMT.

- FIG. 32 shows the internal structure of multiplexed data information.

- FIG. 33 shows the internal structure of stream attribute information.

- FIG. 34 is a diagram showing steps for identifying video data.

- FIG. 27 is a diagram showing a structure of multiplexed data.

- FIG. 28 is a diagram schematically showing how each stream is multiplexed in the multiplexed data.

- FIG. 29 is a diagram showing in more detail how

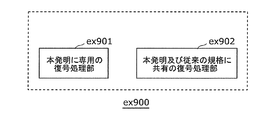

- FIG. 35 is a block diagram illustrating a configuration example of an integrated circuit that realizes the moving picture coding method and the moving picture decoding method according to each embodiment.

- FIG. 36 is a diagram showing a configuration for switching the driving frequency.

- FIG. 37 is a diagram showing steps for identifying video data and switching between driving frequencies.

- FIG. 38 is a diagram showing an example of a look-up table in which video data standards are associated with drive frequencies.

- FIG. 39A is a diagram illustrating an example of a configuration for sharing a module of a signal processing unit.

- FIG. 39B is a diagram illustrating another example of a configuration for sharing a module of a signal processing unit.

- a video encoding apparatus In a hybrid video encoding process, a video encoding apparatus generally performs prediction processing to generate predicted image data, and performs conversion processing on residual image data between input image data and predicted image data. Alternatively, quantization processing or both are executed.

- the prediction process generally, spatial prediction or temporal prediction is used.

- spatial prediction prediction is performed using spatially close blocks among already encoded blocks.

- temporal prediction prediction is performed using blocks that are temporally close among already encoded blocks.

- prediction residual data (prediction residual block) is converted from a spatial (pixel) region to a frequency region, and a conversion coefficient is generated. The purpose of this transformation is to reduce the correlation of the input blocks.

- the transform coefficient is quantized to generate a quantized coefficient.

- the quantization is performed by irreversible compression.

- a moving image encoding device generates an encoded video signal by performing entropy encoding on a quantized coefficient, and further compressing (reversibly compressing) the already compressed quantized coefficient. To do.

- the moving image encoding apparatus encodes decoding control information necessary for decoding the encoded bitstream. This decoding control information is, for example, information related to spatial prediction and / or temporal prediction, quantization amount, and the like.

- the moving image encoding device generates an encoded bit stream including an encoded video signal and decoding control information.

- FIG. 1 is a block diagram illustrating a configuration example of a moving image encoding apparatus using H.264 / MPEG-4 AVC or HEVC.

- the moving image encoding apparatus 100 includes a subtraction unit 105, a conversion unit 110, a quantization unit 120, an inverse quantization / inverse conversion unit 130, an addition unit 140, a deblocking filter processing unit 150, a sample adaptation.

- An offset processing unit 155, an adaptive loop filter processing unit 165, a frame memory 170, a prediction unit 180, and an entropy encoding unit 190 are provided.

- the subtractor 105 subtracts predicted image data (predicted image signal s5) corresponding to the encoding target block from the input image data of the encoding target block included in the input signal s0 for each block. Prediction error data (prediction error signal e0) is generated.

- the conversion unit 110 performs conversion from the image domain to the frequency domain on the generated prediction error data (prediction error signal e0).

- the quantization unit 120 performs a quantization process on the prediction error data (prediction error signal e1) converted into the frequency domain, and calculates a quantization coefficient.

- the quantization unit 120 converts the prediction error data using a two-dimensional discrete cosine transform (DCT).

- DCT discrete cosine transform

- the quantization coefficients calculated by DCT tend to concentrate on low frequency components.

- the quantization unit 120 may convert the prediction error data using integer conversion or the like.

- the inverse quantization / inverse transform unit 130 performs an inverse quantization process on the prediction error data (prediction error signal e2) quantized by the quantization unit 120, and further performs an inverse conversion from the frequency domain to the image domain. Perform the conversion process. Note that the prediction error signal e3 is different from the original prediction error signal e0 due to the influence of a quantization error also called quantization noise in the quantization process.

- the adder 140 performs prediction image data (prediction image signal s5) and prediction error data (prediction error) subjected to inverse quantization processing and inverse transformation processing by the inverse quantization / inverse transformation unit 130 for each encoding target block.

- the reconstructed image data (reconstructed image signal s1) is generated by adding the signal e3).

- the deblocking filter processing unit 150 performs a filtering process on the reconstructed image data (reconstructed image signal s1).

- the deblocking filter processing unit 150 performs a filtering process on the CU edge, the PU edge, and the TU edge.

- the CU edge means an edge caused by block noise or the like in quantization processing at the boundary between two adjacent coding units CU.

- an edge at the boundary between two prediction units (PU) is referred to as a PU edge

- an edge at the boundary between two transform units (TU) is referred to as a TU edge.

- the deblocking filter processing unit 150 includes a plurality of deblocking filters having different strengths and a filter control unit that controls the plurality of deblocking filters.

- the deblocking filter processing unit 150 includes two types of narrowband and wideband deblocking filters.

- H.M. In H.264 / MPEG-4AVC, when block noise is large, a strong (narrow band) low-pass filter is used as a deblocking filter.

- a weak (broadband) low-pass filter is used as the deblocking filter.

- the strength of the low-pass filter is determined by the prediction signal s ′ and the quantized prediction error signal e ′.

- the deblocking filter generally smoothes the block edge, the subjective quality of the decoded image is improved. Furthermore, since the reconstructed image data (reconstructed image signal s2) after the filtering process is used to generate predicted image data by motion compensation in the prediction unit 180, the prediction error of the predicted image data is reduced. Therefore, the encoding efficiency is improved.

- the sample adaptive offset processing unit 155 provides processing for giving an offset value for approximating the original pixel value in units of pixels to the reconstructed image data (reconstructed image signal s2) filtered by the deblocking filter processing unit 150. I do.

- the adaptive loop filter processing unit 165 includes an adaptive loop filter, and performs processing for compensating image distortion caused by compression on the reconstructed image data (reconstructed image signal s3) output from the sample adaptive offset processing unit 155. Do.

- a Wiener filter having a filter coefficient determined so as to minimize the mean square error between the reconstructed image signal s1 and the input image signal S0 is generally used.

- the sample adaptive offset processing unit 155 and the adaptive loop filter processing unit 165 can improve the adaptability with respect to the original image in units of pixels, and can improve the quality.

- reconstructed image data to which the adaptive loop filter is applied (reconstructed image signal s4) is stored in units of frames.

- the prediction unit 180 includes an intra prediction unit that generates a predicted image using spatial prediction (intra prediction) and an inter prediction unit that generates a predicted image using temporal prediction (inter prediction). ing.

- the prediction unit 180 can change the prediction type for each frame or block.

- the intra prediction unit generates intra prediction image data of the encoding target block by performing intra prediction using the reconstructed image data in units of blocks stored in the frame memory 170.

- the inter prediction unit performs inter prediction using the reconstructed image data in units of frames stored in the frame memory 170 and the motion vector derived by motion detection or the like, thereby performing inter prediction image data of the block to be encoded. Is generated.

- the motion vector may be determined by the resolution of a spatial subpixel such as 1 ⁇ 2 pixel or 1 ⁇ 4 pixel.

- the entropy encoding unit 190 generates an encoded bitstream by performing variable length encoding processing on the prediction error data (prediction error signal e2).

- variable-length encoding process for example, encoding is performed using a run-length code. The amount of data is further reduced by the variable length encoding process.

- the filtering process using the deblocking filter includes a control process for setting a filter and a filtering process for executing a process on the encoding target block CU in accordance with the setting of the control process.

- the control process includes (1) a process for determining whether or not to execute a filtering process, and (2) a process for selecting a deblocking filter to be used.

- the selection process includes calculation of each parameter that defines the operation of the deblocking filter, for example, calculation of t c indicating the limit range of the filter process.

- the filtering process using the deblocking filter is applied to the edge of the block boundary due to block noise, and not applied to the edge of the input image that is not block noise. This is because, for example, if a filtering process using a deblocking filter is applied to the edge of an input image that is not block noise, the image may become unnecessarily smooth or image distortion may occur. . Further, if the filtering process using the deblocking filter is not performed on the edge of the block boundary due to the block noise, the block noise may remain.

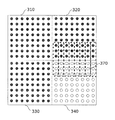

- FIG. 2A is a diagram illustrating pixels used in the determination process of whether or not the filtering process can be performed at the boundary between two coding block units CU adjacent in the horizontal direction.

- FIG. 2B is a diagram illustrating pixels used in the determination process for determining whether or not the filtering process can be performed at the boundary between two encoded block units CU adjacent in the vertical direction.

- block 340 is a processing target block, and adjacent blocks 310, 320, and 330 are processed (encoded or decoded) blocks.

- a pixel row 360 composed of pixels arranged in a line in the horizontal direction is set for each row.

- the pixel row 360 is composed of a total of 6 pixels, 3 pixels on both sides of the boundary.

- FIG. 2A is a diagram illustrating pixels used in the determination process of whether or not the filtering process can be performed at the boundary between two coding block units CU adjacent in the horizontal direction.

- block 340 is a processing target block

- adjacent blocks 310, 320, and 330 are processed

- a pixel column 370 composed of pixels arranged in a row in the vertical direction is set for each column.

- the pixel column 370 is composed of a total of 6 pixels, 3 pixels on both sides of the boundary. Executability determination processing is executed in units of pixel columns.

- FIG. 3A is a graph illustrating an example of the pixel value of each pixel included in the pixel row 360 illustrated in FIG. 2A.

- 3B is a diagram showing a more detailed example of the adjacent block 330 (block A in FIGS. 3A and 3B) and the processing target block 340 (block B in FIGS. 3A and 3B) shown in FIG. 2A.

- a line 410 (row 410) shown in FIG. 3A indicates a boundary between the block A and the block B.

- a pixel pr c is a pixel included in the block A.

- Pixel qr c is a pixel included in the block B. Note that r is an index for specifying a column, and is 0, 1,... In order from the line 410 side.

- C is an index for specifying a row, and is 0, 1,...

- H. In H.264 / MPEG-4AVC execution determination processing is performed by the following method.

- H. In H.264 / MPEG-4AVC the absolute value of the first derivative (first derivative) in the adjacent block A and the processing target block B is evaluated (for example, see Patent Document 1).

- the determination using the pixel row 360 illustrated in FIG. 2A will be described. The determination here is performed for all pixel rows in units of pixel rows.

- the pixels p0 and q0 are determined to execute the filtering process when the conditions expressed by the following Expressions 1 to 3 are satisfied.

- the pixel p1 is filtered when the condition expressed by the following Expression 4 is also satisfied.

- the pixel q1 is filtered when the condition shown in Expression 5 below is also satisfied.

- Equations 1 to 5 correspond to the evaluation of the primary differentiation in the first block and the primary differentiation in the second block.

- QP is a quantization parameter indicating the amount of quantization (quantization step size) applied in the quantization process

- ⁇ and ⁇ are scalar constants.

- QP New is a quantization parameter derived based on the quantization parameters QPA and QPB used for the first block A and the second block B, respectively, as shown in the following Expression 6.

- FIGS. 3A and 3B the process for determining whether or not to execute the filtering process in HEVC will be described with reference to FIGS. 3A and 3B.

- the absolute value of the second derivative (second derivative) in the adjacent block A and the processing target block B is evaluated.

- whether or not execution is possible is determined in units of blocks using the two pixel rows 430 of the third row and the sixth row from the top.

- an evaluation value d p and an evaluation value d q for determining whether or not execution is possible are calculated using the following Expression 7.

- the evaluation value d p and the evaluation value d q correspond to the evaluation results of the second derivative in the first block and the second derivative in the second block.

- FIG. 4A is a flowchart illustrating a processing procedure of filtering processing.

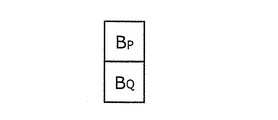

- FIG. 4B shows two blocks B P and B Q adjacent in the horizontal direction.

- FIG. 4C shows two blocks B P and B Q adjacent in the vertical direction.

- step S1000 the filter control unit of the deblocking filter processing unit 150 shown in FIG. 1 calculates the boundary strength BS as the first parameter.

- the value of the boundary strength BS is an integer of 0 or more. Details of the calculation procedure of the boundary strength BS will be described later.

- step S1010 when it is determined in step S1010 that the BS is an integer (Yes in S1010), in step S1020, the filter control unit sets a threshold value t c that defines the output range of the deblocking filter and the deblocking filter to be used. A threshold value ⁇ for selection is calculated. Details of the calculation method of the threshold value t c that defines the output range of the deblocking filter and the threshold value ⁇ for selecting the deblocking filter will be described later.

- step S1030 the filter control unit selects a deblocking filter based on the threshold value ⁇ . This selection includes not selecting a deblocking filter. Specifically, the filter control unit selects either a strong filter, a weak filter, or no filter based on the threshold value ⁇ .

- the filter control unit filters the block boundary to be processed using a narrowband deblocking filter (S1032).

- the filter control unit filters a block boundary to be processed using a wideband deblocking filter (S1034).

- the filter control unit does not perform filtering (S1036).

- the edge of the block boundary of the reconstructed image data can be smoothed, and the image quality of the reconstructed image can be improved.

- FIG. 5 is a flowchart showing the processing procedure of the boundary strength BS calculation processing in step S1000.

- the boundary strength BS there is a correlation between the value of the boundary strength BS and the magnitude of the block noise. Generally, the stronger the boundary strength BS, the larger the block noise.

- a determination condition of the boundary strength BS (i) whether a block is an intra-coded image, (ii) whether it is a CU edge, (iii) a cbf flag (having a coefficient) (Flag indicating whether or not) is 0, (iv) whether or not the reference pictures of the two blocks in contact with the boundary are the same, and (v) the absolute difference value of the pixel values is greater than a predetermined determination value Whether or not is set.

- the determination conditions in setting the boundary strength BS include other factors such as whether or not the motion vector used for motion compensation prediction of the encoding target block and the motion vector used for motion compensation prediction of the adjacent block are the same. Determination conditions may be used.

- step S210 the filter control unit 153 (FIG. 6) of the deblocking filter processing unit 150 (FIGS. 1 and 6) determines whether or not at least one of the blocks BP and BQ is an intra-coded image.

- an intra-encoded image I picture

- an inter-encoded image or the like For this reason, when at least one of the blocks BP and BQ is an intra-coded image, a relatively large value is set as the boundary strength.

- step S212 the filter control unit 153 determines that the block boundary currently being processed is the coding unit CU. It is determined whether it is a boundary (whether it is a CU edge).

- the value of the boundary strength BS is set to 4 (step S216).

- the value of the boundary strength BS is 3 (S214).

- step S210 If it is determined in step S210 that both the blocks BP and BQ are not intra-coded images (NO in S210), whether or not the value of either the flag cbf-P or the flag cbf-Q is not 0 Is determined (S220).

- the flag cbf-P is a flag indicating whether or not the block BP has a coefficient. When the value is not 0, it indicates that there is a coefficient. When the value is 0, it indicates that there is no coefficient. Show.

- the flag cbf-Q is a flag indicating whether or not the block BQ has a coefficient.

- the value of the boundary strength BS is set to 2 in step S222.

- the flag cbf-P or flag if one of cbf-Q is determined not to be 0 (NO in S220)

- the reference picture index RefIdx-P is an index indicating a picture to be referred to in the prediction process of the block BP .

- the reference picture index RefIdx-Q is an index indicating a picture to be referred to in the prediction process of the block BQ .

- the value of the boundary strength BS is set to 1.

- the parameter AbsHor is represented by the absolute value of the difference between the horizontal components of the motion vector used in the prediction process of the block BP and the motion vector used in the prediction process of the block BQ .

- the parameter AbsVer is represented by the absolute value of the difference between the vertical components of the motion vector used in the block B P prediction process and the motion vector used in the block B Q prediction process.

- 3 is used as the determination value of the parameters AbsHor and AbsVer.

- the present invention is not limited to this.

- the value of the boundary strength BS is set to 1 (S242).

- the boundary strength BS is set to 0 (S244).

- the deblocking filter processing unit 150 performs filtering using a stronger filter as the value of the boundary strength BS is larger. When the value of the boundary strength BS is 0, the deblocking filter processing unit 150 does not execute the filtering process.

- Equation 9 a two-dimensional encoding table using the quantization parameter QP and the boundary strength BS value as indices is used as shown in Equation 9 below. There is a method for deriving t c .

- the threshold t c is derived using a one-dimensional encoding table with variable t c _offset as an index. There is a way to do it.

- the parameter t c _offset is calculated based on the value of the boundary strength BS derived in step S1000 in FIG. 4A.

- the filter control unit sets 0 to t c _offset when the boundary strength BS is 2 or less, and sets 2 to t c _offset when the strengthening strength BS is greater than 2. Then, the parameter t c is determined by the following expression 10.

- a deblocking filtering method is an image processing method for performing filtering processing on an image block using a plurality of deblocking filters having different filter strengths, and is adjacent

- a first parameter calculating step for calculating a first parameter indicating a boundary strength between the two image blocks to be calculated, and a second parameter indicating a limit value of the deblocking filter based on the first parameter and the quantization parameter.

- the second parameter Tc is used for selecting the deblocking filter, it is possible to further increase the adaptability to block noise in the filtering process using the deblocking filter. Thereby, it is possible to further improve the image quality of the image after the filtering process.

- the second parameter may be calculated using a linear sum of the first parameter and the quantization parameter.

- the second parameter Tc is defined based on the linear sum of the first parameter (boundary strength BS) and the quantization parameter QP, the second parameter Tc is derived by a simple calculation. It becomes possible. This eliminates the need for a large memory space. Furthermore, according to the deblocking filtering method of the present configuration, the second parameter Tc is defined based on the linear sum of the first parameter (boundary strength BS) and the quantization parameter QP. Can be reduced.

- the deblocking filter is selected using the second parameter Tc derived by such a simple calculation, the processing amount of the processing related to the selection can be reduced, and the processing efficiency can be improved.

- the second parameter Tc is defined based on the linear sum of the first parameter (boundary strength BS) and the quantization parameter QP. It becomes possible to improve.

- the second parameter may be calculated such that the value increases as the value of the first parameter increases. Further, for example, in the second parameter calculation step, the second parameter may be calculated such that the value increases as the value of the quantization parameter increases.

- the image processing method having the above configuration since the second parameter Tc (for example, the threshold value of the loop filter) is changed according to the boundary strength BS, the image quality of the image after the filtering process can be improved.

- the second parameter Tc for example, the threshold value of the loop filter

- the second parameter is set according to the boundary strength BS.

- a filter adapted to the image can be set.

- the threshold value may be calculated such that the value increases as the value of the second parameter increases.

- the threshold value can be set appropriately.

- a first threshold value for selecting one deblocking filter from the plurality of deblocking filters and a second threshold value for determining whether to select a deblocking filter are: It may be determined that one blocking filter is selected from the plurality of deblocking filters, or that no deblocking filter is used.

- an execution feasibility determining step of determining whether to perform the filtering process using the first parameter before executing the selecting step may be included.

- a first determination step for determining whether at least one of the two adjacent image blocks is a block to be intra-encoded a first determination step for determining whether at least one of the two adjacent image blocks is a block to be intra-encoded

- the first determination step A step of setting a first fixed value as the first parameter when it is determined that at least one of the two adjacent image blocks is intra-encoded.

- the first parameter calculation step when it is determined in the first determination step that both of the two adjacent image blocks are blocks that are not intra-encoded, the first parameter is set to You may have the step which sets the 2nd fixed value different from said 1st fixed value.

- the two adjacent blocks are further included.

- a value of the first parameter is set using a second determination step for determining whether at least one of the two image blocks includes at least one non-zero transform coefficient, and a determination result of the second determination step. Steps may be included.

- the first parameter calculation step further includes the two adjacent images when the first determination step determines that both of the two adjacent image blocks are blocks that are not intra-encoded. Whether or not the second determination step for determining whether or not at least one of the blocks includes at least one non-zero transform coefficient and the two adjacent image blocks have different reference indexes indicating reference pictures in inter coding And a third determination step for determining whether or not at least one of the absolute difference value of the horizontal motion vector component and the absolute difference value of the vertical motion vector component between the two adjacent image blocks has a predetermined threshold value.

- a setting step of setting the first fixed value in the first parameter when set, and setting a second fixed value different from the first fixed value in the other case in the other cases. May be.

- the image processing method includes a compression step of compressing a prediction error block between an encoding target block composed of a plurality of pixels and a prediction block, and decoding the compressed prediction error block to convert the prediction block A reconstructing step for adding and generating a reconstructed block; a filtering step for performing the first parameter calculating step, the second parameter calculating step, and the selecting step for the reconstructed block; and a filtering step A prediction step for generating a prediction block by using the reconstructed block after execution of a coding step, and an encoding step for generating an encoded bitstream by encoding the compressed prediction error block Also good.

- the image processing method includes an acquisition step of acquiring an encoded bitstream including a decoding target block, a step of generating a reconstructed block by decoding the decoding target block and adding a prediction block, A filtering block that performs the first parameter calculation step, the second parameter calculation step, and the selection step with respect to the reconstructed block, and a prediction block that uses the reconstructed block after the filtering step is performed.

- a prediction step for generating is generating.

- an image processing apparatus is an image processing apparatus that performs filtering processing on an image block using a plurality of deblocking filters having different filter strengths, and is adjacent to the image processing apparatus.

- a first parameter calculating unit for calculating a first parameter indicating a boundary strength between two image blocks, and a second parameter for calculating a second parameter indicating a limit value of the deblocking filter based on the first parameter and the quantization parameter.

- a second parameter calculation unit, and a second parameter calculation unit comprising: a two-parameter calculation unit; and a selection unit that selects a deblocking filter used in the filtering process from the plurality of deblocking filters using a threshold value determined based on the second parameter. Is the sum of the first parameter and the quantization parameter It is calculated as the value of the second parameter.

- Embodiment 1 The image processing method and image processing apparatus according to Embodiment 1 will be described with reference to FIGS. 1 to 3B and FIGS. 7A to 9.

- an example in which the image processing method and the image processing device are applied to a moving image encoding method and a moving image encoding device will be described.

- the configuration of the moving picture encoding apparatus according to the present embodiment is the same as that of the moving picture encoding apparatus of the comparative example shown in FIG.

- the moving picture coding apparatus according to the present embodiment is different from the moving picture coding apparatus 100 of the comparative example in the configuration of the deblocking filter processing unit 150.

- the deblocking filter processing unit 150 includes a plurality of deblocking filters having different strengths and a filter control unit that controls the plurality of deblocking filters.

- FIG. 6 is a block diagram illustrating a configuration example of the deblocking filter processing unit 150.

- the deblocking filter processing unit 150 includes a first deblocking filter 151, a second deblocking filter 152, and a filter control unit 153.

- the first deblocking filter is a strong deblocking filter with a narrow band.

- the second deblocking filter is a wide band weak deblocking filter.

- the number and structure of a deblocking filter are not restricted to this.

- the filter control unit 153 includes a boundary strength calculation unit 154, a Tc calculation unit 155, and a filter selection unit 156.

- a process for determining whether or not to execute the filtering process (corresponding to an execution determination process) and (2) a process for selecting a deblocking filter to be used are executed.

- the (1) The process for determining whether or not to execute the filtering process is the same as that in the comparative example.

- FIG. 7A is a flowchart illustrating a processing procedure of the filtering processing according to the present embodiment.

- FIG. 7B shows two blocks B P and B Q adjacent in the horizontal direction.

- FIG. 7C shows two blocks B P and B Q adjacent in the vertical direction.

- step S100 the boundary strength calculation unit 154 of the filter control unit 153 calculates the boundary strength BS as the first parameter (first parameter calculation step).

- Figure 8 is a flowchart showing the procedure of setting the offset value t c _offset calculation process and the threshold t c of boundary strength BS in the present embodiment.

- the value of the boundary strength BS is an integer of 0 or more.

- the boundary strength BS calculation procedure (S210 to S244) is the same as that in the comparative example.

- the boundary strength calculation unit 154 sets the offset value t c _offset of the threshold value t c according to the value of the boundary strength BS as shown in FIG.

- the value of the BS is different, also different values of t c _offset.

- t c _offset 3

- t c _offset 2

- BS 2

- T c _offset 0.

- the value of t c _offset is constant regardless of the boundary strength BS (AVC), or the same t c _offset is assigned to a plurality of boundary strength BSs (HEVC).

- step S110 when it is determined in step S110 that the BS is an integer (Yes in S110), in step S120, the Tc calculation unit of the filter control unit 153 calculates a threshold t c that defines the output range of the deblocking filter. (Second parameter calculation step).

- the threshold value t c is set using a tabular function with a value obtained by combining the boundary strength BS and the quantization parameter QP, for example, a value considering t c _offset as a total value. Is done.

- the value of t c _offset is also different, so the number of values taken by the threshold value t c tends to be larger than that in the comparative example. Thereby, the adaptability of a deblocking filter can be improved.

- the filter control unit 153 calculates a threshold value ⁇ for selecting a deblocking filter to be used.

- the threshold value ⁇ can be expressed as a function ( ⁇ (QP)) of the quantization parameter QP.

- step S130 the filter selection unit 156 of the filter control unit 153 selects a deblocking filter based on the threshold value t c and the threshold value ⁇ (selection step). This selection includes not selecting a deblocking filter. Specifically, the filter selection unit 156 first determines whether or not to select a strong filter based on the threshold value ⁇ .

- the threshold values ⁇ and t c are both expressed as a function of the quantization parameter QP.

- the quantization parameter QP may be set for a part of an image or the like.

- the value of the threshold ⁇ is derived based on QP using a lookup table.

- strong filtering is performed by the first deblocking filter 151 (S132). Details of the strong filtering will be described later.

- the filter selection unit 156 further determines whether to select a weak filter or no filter.

- the filter selection unit 156 calculates the discriminant value ⁇ (absolute value) using the following expression 12.

- a weak filter is selected when the following expression 13 is satisfied.

- weak filtering is performed by the second deblocking filter 152 (S134). Details of the weak filtering will be described later.

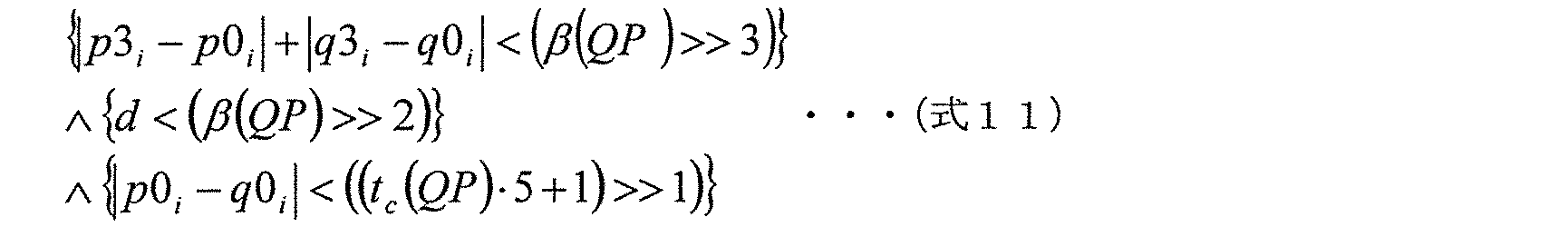

- the first deblocking filter 151 uses the pixels p3 i , p2 i , p1 i , p0 i , q0 i , q1 i , q2 i , q3 i according to the HEVC model and uses the pixels p2 i , p1 i. , P0 i , q0 i , q1 i , q2 i are filtered.

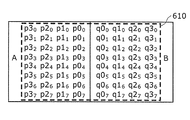

- FIG. 9A is a diagram illustrating an example of pixels used in strong filtering.

- FIG. 9A shows pixels (samples) used to horizontally filter a vertical edge between two horizontally adjacent blocks. Pixels in a region 610 surrounded by a broken line are pixels used for strong filtering.

- FIG. 9B is a diagram illustrating pixels to be filtered. Pixels in a region 620 surrounded by a broken line are pixels that are strongly filtered.

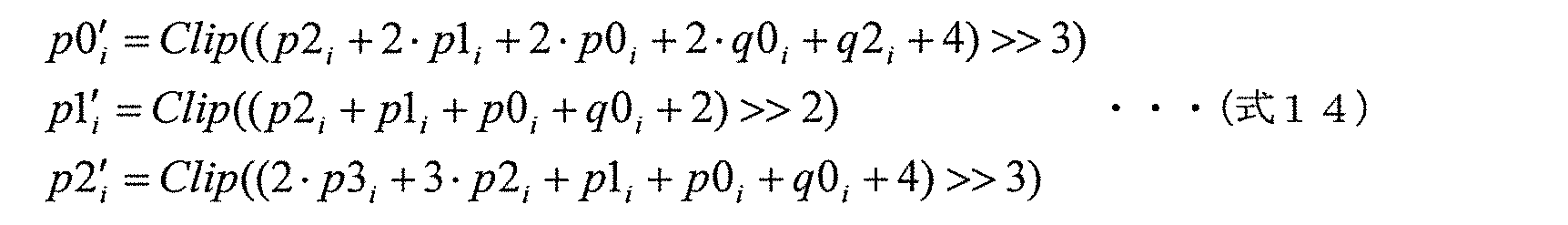

- the first deblocking filter 151 uses the four pixels adjacent to the left side of the boundary and filters the three pixels adjacent to the left side of the boundary according to the following Expression 14.

- the first deblocking filter 151 uses the four pixels adjacent to the right side of the boundary and filters the three pixels adjacent to the right side of the boundary according to the following Expression 15.

- the function Clip (x) is defined by the following expression 16.

- max_allowed_value is the maximum value that x of Clip (x) can have.

- max_allowed_value 255.

- max_allowed_value 1023.

- filtering is performed on a line-by-line basis.

- the second deblocking filter 152 When “weak filter” is selected, the second deblocking filter 152 performs weak filtering (S134). Specifically, the second deblocking filter 152 uses the pixels p2 i , p1 i , p0 i , q0 i , q1 i , q2 i according to the HEVC model, and the pixels p1 i , p0 i , q0 i , q1 i Filter.

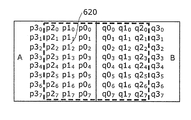

- FIG. 10A is a diagram illustrating an example of pixels used in weak filtering.

- FIG. 10A shows pixels (samples) used to horizontally filter a vertical edge between two horizontally adjacent blocks. Pixels in a region 630 surrounded by a broken line are pixels used for weak filtering.

- FIG. 10B is a diagram illustrating pixels to be filtered. Pixels in the region 640 surrounded by a broken line are weakly filtered pixels.

- the second deblocking filter 152 filters the pixel p0 i that is closest to the left side of the boundary and the pixel q0 i that is closest to the right side of the boundary according to the following Expression 17.

- q0 i ′ is a pixel value after filtering the pixel q0 i

- q0 i ′ is a pixel value after filtering the pixel q0 i .

- ⁇ 1 is obtained by the following equation (18).

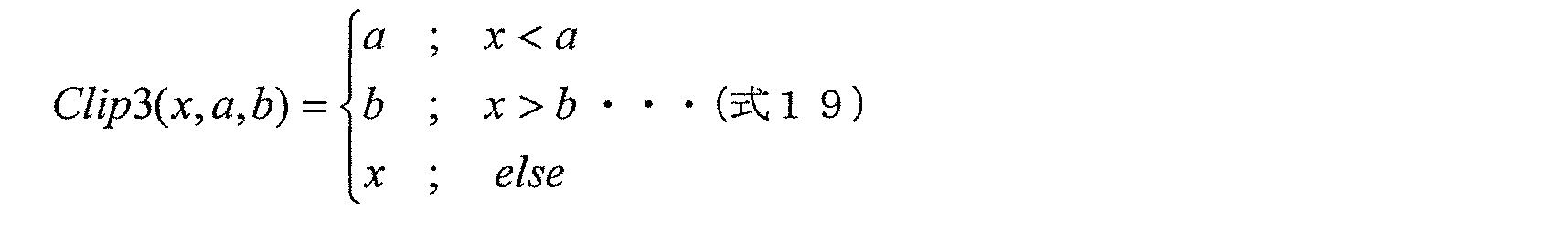

- the function Clip3 (x) is defined by the following Expression 19.

- the second deblocking filter 152 determines whether or not to filter each of the pixel p1i and the pixel q1i next closest to the boundary. Note that the determination for the pixel p1i and the determination for the pixel q1i are performed separately.

- the determination for the pixel p1i is performed using the evaluation value d p shown in Expression 7 described in the comparative example (1) determination process for determining whether or not to execute the filtering process. Specifically, when d p ⁇ ( ⁇ / 6) is satisfied, the second deblocking filter 152 filters the pixel p1 i according to Expression 20 below.

- p1 i ′ is a pixel value after filtering the pixel p1 i .

- ⁇ 2p is obtained by the following equation (21).

- the determination with respect to the pixel q1i is performed using the evaluation value d q shown in Expression 7 described in (1) the determination process on whether to execute the filtering process in the comparative example. Specifically, when d q ⁇ ( ⁇ / 6) is satisfied, the second deblocking filter 152 filters the pixel q1 i according to the following Expression 22.

- q1 i ′ is a pixel value after filtering the pixel q1 i .

- ⁇ 2q is obtained by the following equation (23).

- the present invention can also be applied to the case of performing vertical filtering on a horizontal edge by switching the horizontal direction and the vertical direction, and the row and the column, respectively. .

- the threshold t c of the loop filter is obtained by a function using a linear sum of the quantization parameter QP and the boundary strength BS.

- t c _offset is because it is determined based on the BS, it can be said that does not require the labor of calculation. For this reason, it is possible to reduce the use area of the memory and reduce the processing amount.

- t c _offset in the comparative example the common value for all the boundary strength BS or, but only take two values, t c _offset of the present embodiment, apart from different t c _offset setting boundary strength BS Is done. This makes it possible to deal with block noise more precisely.

- FIG. 11 is a diagram illustrating a processing procedure for setting the offset value t c _offset of the threshold value t c in the comparative example.

- the same processes as those in FIG. 8 are denoted by the same reference numerals.

- FIG. 12A is a diagram showing the coding efficiency of the comparative example and the present embodiment when the common test condition is used.

- the coding efficiency is indicated by a BD rate calculated using piecewise cubic interpolation.

- Modification 1 describes a case where the calculation procedure of the boundary strength BS (step S100 in FIG. 7A) is different from the above embodiment.

- FIG. 13 is a flowchart showing a processing procedure for calculating the boundary strength BS in the present modification.

- step S210 the filter control unit 153 (FIG. 6) determines whether at least one of the blocks BP and BQ is an intra-coded image, as in the first embodiment.

- the filter control unit 153 sets the value of the boundary strength BS to 3 (S218). Note that the value of the boundary strength BS in step S218 is not limited to 3, but may be a value larger than the value of the boundary strength BS set in another step.

- step S210 If it is determined in step S210 that both blocks BP and BQ are not intra-coded images (NO in S210), the processing is the same as in the first embodiment.

- FIG. 14 shows the coding efficiency of the first modification shown in FIG. 13 (right side of the figure) and the coding efficiency of the comparative example shown in FIG. 5 (left side of the figure) as shown in Non-Patent Document 2.

- FIG. 14 shows the coding efficiency of the first modification shown in FIG. 13 (right side of the figure) and the coding efficiency of the comparative example shown in FIG. 5 (left side of the figure) as shown in Non-Patent Document 2.

- the encoding efficiency is substantially the same as in the comparative example. However, as described above, it is possible to reduce the processing load and improve the processing efficiency.

- the threshold value t c is obtained using the following Expression 24 using the lookup table function Tctable.

- FIG. 15 is a diagram illustrating the value of the threshold value t c set in the present modification. As shown in FIG. 15, also in the first modification, different threshold values t c are assigned to different boundary strengths BS.

- the value of the boundary strength BS set in Modification 2 will be described with reference to FIG. In FIG. 16, the value of the boundary strength BS that is set is 1 smaller than the value of the boundary strength BS of the first modification.

- step S210 when it is determined in step S210 that at least one of the blocks BP and BQ is an intra-coded image (YES in step S210), the value of the boundary strength BS is set to 2 (S211). ).

- step S220 when it is determined that one of the flags cbf-P and cbf-Q is not 0 (YES in step S220), the value of the boundary strength BS is set to 1 (S224).

- step S230 If it is determined in step S230 that the reference picture index RefIdx-P and the reference picture index RefIdx-Q are different (YES in S230), the value of the boundary strength BS is set to 1 (S234).

- step S240 when one of the parameters AbsHor and AbsVer is larger than 3 (YES in S240), the value of the boundary strength BS is set to 0 (S246). On the other hand, when both the parameters AbsHor and AbsVer are 3 or less (NO in S240), the boundary strength BS is set to 0 (S248).

- a method for setting the value of the threshold value t c in Modification 2 will be described. Similar to the first modification, the second modification uses the lookup table function Ttable, but the index calculation method is different. In the second modification, the threshold value t c is obtained using the following Expression 25.

- Modification 2 like the modified example 1, a) CU edge whether no processing for confirmation of, b) for the calculation of the threshold t c without using the offset value t c _offset, the moving picture coding apparatus 100

- the processing load can be reduced.

- Modification 3 a case where the calculation procedure of the boundary strength BS (step S100 in FIG. 7A) is different from the above-described embodiment, Modification 1 and Modification 2 will be described.

- FIG. 17 is a flowchart showing a processing procedure for calculating the boundary strength BS in the present modification.

- step S210 the filter control unit 153 (FIG. 6) of the deblocking filter processing unit 150 (FIGS. 1 and 6) converts at least one of the blocks BP and BQ into an intra-coded image, as in the above embodiment. It is determined whether or not.

- the value of the boundary strength BS is set to 2 (step S211).

- step S210 If it is determined in step S210 that both the blocks BP and BQ are not intra-coded images (NO in S210), whether or not the value of either the flag cbf-P or the flag cbf-Q is not 0 Is determined (S220).

- step S220 (NO in S220) if one of the flag cbf-P or flag cbf-Q is determined not to be 0, the reference picture index RefIdx-P block B P, block B Q of the reference picture It is determined whether or not the indices RefIdx-Q are different from each other (S230).

- step S230 If it is determined in step S230 that the reference picture index RefIdx-P and the reference picture index RefIdx-Q are different (YES in S230), the value of the boundary strength BS is set to 0 (S236).

- step S230 if it is determined in step S230 that the reference picture index RefIdx-P and the reference picture index RefIdx-Q are the same (NO in S230), whether one of the parameters AbsHor and AbsVer is greater than 3 or not. Is determined (S240).

- step S240 when it is determined that one of the parameters AbsHor and AbsVer is larger than 3 (YES in S240), the value of the boundary strength BS is set to 0 (S246). On the other hand, if it is determined in step S240 that both parameters AbsHor and AbsVer are 3 or less (NO in S240), no deblocking is set (S248).

- step S220 (YES in S220) If both flags cbf-P and flag cbf-Q is determined to be 0, and the reference picture index RefIdx-P block B P, block B Q a reference picture index RefIdx It is determined whether or not ⁇ Q is different from each other (S250).

- step S250 If it is determined in step S250 that the reference picture index RefIdx-P and the reference picture index RefIdx-Q are the same (NO in S250), the value of the boundary strength BS is set to 1 (S252).

- step S250 If it is determined in step S250 that the reference picture index RefIdx-P and the reference picture index RefIdx-Q are different (YES in S250), it is determined whether one of the parameters AbsHor and AbsVer is greater than 3. (S260).

- step S260 when it is determined that one of the parameters AbsHor and AbsVer is larger than 3 (YES in S260), the value of the boundary strength BS is set to 2 (S264). On the other hand, when it is determined in step S260 that both parameters AbsHor and AbsVer are 3 or less (NO in S240), the value of the boundary strength BS is set to 1 (S262).

- Modification 4 describes a case where the processing procedure of the filtering process and the calculation procedure of the boundary strength BS are different from the above embodiment and Modifications 1 to 3.

- FIG. 18A is a flowchart showing the processing procedure of the filtering process of the fourth modification.

- step S300 the filter control unit 153 calculates the boundary strength BS as the first parameter (first parameter calculation step).

- FIG. 18B is a flowchart showing a procedure for setting the boundary strength BS.

- it is determined whether or not at least one of the blocks BP and BQ is an intra-coded image (S210).

- the value of the boundary strength BS is set to 2 (S211).

- the value of the boundary strength BS is set to 0 (S213). Note that the set value of the boundary strength BS may be another value.

- step S120 the filter control unit 153 calculates a threshold value t c that defines the output range of the deblocking filter (second parameter calculation step). Furthermore, in step S120, the filter control unit 153 calculates a threshold value ⁇ for selecting a deblocking filter to be used.

- step S330 the filter control unit 153 selects a deblocking filter based on the threshold value t c and the threshold value ⁇ (selection step).

- step S330 When a strong filter is selected in step S330, strong filtering is performed by the first deblocking filter 151 (S132). When a weak filter is selected in step S330, weak filtering is performed by the second deblocking filter 152 (S134).

- step S330 If no filtering process is selected in step S330, filtering using the deblocking filter is not performed (S136).

- the processing procedure of the filtering process and the calculation procedure of the boundary strength BS are simplified, so that it is possible to reduce the processing load of the moving picture encoding apparatus 100. Furthermore, it is possible to reduce the memory capacity used in the calculation procedure of the boundary strength BS. That is, since the values that the boundary strength BS can take are 0 to 3, the boundary strength BS can be represented by a 2-bit information amount. Thus, the advantage of this modification is that the same deblocking result as the current HM-4.0 can be obtained while processing with a smaller memory capacity.

- Embodiment 2 A moving picture decoding method and a moving picture decoding apparatus according to Embodiment 2 will be described with reference to FIG.

- FIG. 1 is a block diagram illustrating a configuration example of a moving picture decoding device based on H.264 / MPEG-4AVC or HEVC moving picture coding standard.

- the video decoding device 200 includes an entropy decoding unit 290, an inverse quantization / inverse conversion unit 230, an addition unit 240, a deblocking filter processing unit 250, a sample adaptive offset processing unit 260, and an adaptive loop filter process.

- the entropy decoding unit 290 decodes information necessary for decoding such as a prediction mode and a quantization coefficient by performing variable length decoding processing on the input encoded bitstream.

- the inverse quantization / inverse transform unit 230 performs an inverse quantization process on the quantization coefficient obtained by the variable length decoding process, and converts the quantized coefficient obtained by the inverse quantization process from the frequency domain to the image domain. To generate prediction error data e3.

- the addition unit 240 predicts prediction image data (prediction image signal s5) and prediction error data (prediction error signal) subjected to inverse quantization processing and inverse transformation processing by the inverse quantization / inverse transformation unit 230. By adding e3), reconstructed image data (reconstructed image signal s1) is generated.

- the deblocking filter processing unit 250 includes a plurality of deblocking filters having different strengths and a filter control unit that controls the plurality of deblocking filters.

- the deblocking filter processing unit 250 includes a plurality of deblocking filters corresponding to the types of deblocking filters included in the video encoding device 100.

- the deblocking filter processing unit 250 may include two types of deblocking filters, a narrow band and a wide band, as in the first embodiment. Note that the configuration of the deblocking filter processing unit 250 corresponds to the configuration of the deblocking filter processing unit 150 of the first embodiment.

- the sample adaptive offset processing unit 260 gives an offset value for approximating the original pixel value in units of pixels to the reconstructed image data (reconstructed image signal s2) filtered by the deblocking filter processing unit 250. I do.

- the adaptive loop filter processing unit 255 includes an adaptive loop filter such as a Wiener filter, and applies image distortion caused by compression to the reconstructed image data (reconstructed image signal s3) output from the sample adaptive offset processing unit 260. Perform compensation process.

- the output image signal s4 of the adaptive loop filter processing unit 255 is output as a decoded signal indicating a decoded image.

- reconstructed image data (reconstructed image signal s4) to which the adaptive loop filter is applied is stored in units of frames.

- the prediction unit 280 includes an intra prediction unit that generates a predicted image using spatial prediction (intra prediction) and an inter prediction unit that generates a predicted image using temporal prediction (inter prediction). ing.

- the prediction unit 280 can change the prediction type for each frame or block.

- Embodiment 3 A moving picture coding method and a moving picture coding apparatus according to Embodiment 3 will be described with reference to FIG.

- FIG. 20 is a block diagram illustrating a configuration example of a moving image encoding apparatus (hybrid video encoder) according to the present embodiment.

- the moving image encoding apparatus 300 includes a subtraction unit 105, a conversion unit 110, a quantization unit 120, an inverse quantization / inverse conversion unit 130, an addition unit 140, a horizontal deblocking filter processing unit 310, a vertical A deblocking filter processing unit 320, an adaptive loop filter processing unit 165, a sample adaptive offset processing unit 160, a prediction unit 180, and an entropy coding unit 190 are provided.

- the configuration of the encoding unit 190 includes the subtraction unit 105, the conversion unit 110, the quantization unit 120, the inverse quantization / inverse conversion unit 130, the addition unit 140, and the adaptive loop filter processing unit of the first embodiment (comparative example), respectively.

- 165, the configuration of the sample adaptive offset processing unit 155, the prediction unit 180, and the entropy encoding unit 190 is the same.

- the moving picture coding apparatus 300 according to the present embodiment is different from the moving picture coding apparatus 100 according to the first embodiment in that the deblocking filter processing unit 150 shown in FIG. 1 performs a horizontal filtering process on vertical edges.

- a deblocking filter processing unit 310 and a vertical deblocking filter processing unit 320 that performs filtering processing on horizontal edges are subdivided.

- the horizontal deblocking filter processing unit 310 performs a filtering process on the vertical edge on the reconstructed signal s1 output from the adder 140 to generate a reconstructed signal s6.

- the vertical deblocking filter processing unit 320 performs a filtering process on the horizontal edge on the reconstructed signal s6.

- FIG. 20 further shows that the quantization parameter QP is input to the entropy encoding unit 190, the horizontal deblocking filter processing unit 310, and the vertical deblocking filter processing unit 320.

- the storage medium may be any medium that can record a program, such as a magnetic disk, an optical disk, a magneto-optical disk, an IC card, and a semiconductor memory.

- the system has an image encoding / decoding device including an image encoding device using an image encoding method and an image decoding device using an image decoding method.

- image encoding / decoding device including an image encoding device using an image encoding method and an image decoding device using an image decoding method.

- Other configurations in the system can be appropriately changed according to circumstances.

- FIG. 21 is a diagram showing an overall configuration of a content supply system ex100 that realizes a content distribution service.

- a communication service providing area is divided into desired sizes, and base stations ex106, ex107, ex108, ex109, and ex110, which are fixed wireless stations, are installed in each cell.

- This content supply system ex100 includes a computer ex111, a PDA (Personal Digital Assistant) ex112, a camera ex113, a mobile phone ex114, a game machine ex115 via the Internet ex101, the Internet service provider ex102, the telephone network ex104, and the base stations ex106 to ex110. Etc. are connected.

- PDA Personal Digital Assistant

- each device may be directly connected to the telephone network ex104 without going from the base station ex106, which is a fixed wireless station, to ex110.

- the devices may be directly connected to each other via short-range wireless or the like.

- the camera ex113 is a device that can shoot moving images such as a digital video camera

- the camera ex116 is a device that can shoot still images and movies such as a digital camera.

- the mobile phone ex114 is a GSM (registered trademark) (Global System for Mobile Communications) system, a CDMA (Code Division Multiple Access) system, a W-CDMA (Wideband-Code Division Multiple Access) system, or an LTE (Long Terminal Term Evolution). It is possible to use any of the above-mentioned systems, HSPA (High Speed Packet Access) mobile phone, PHS (Personal Handyphone System), or the like.

- the camera ex113 and the like are connected to the streaming server ex103 through the base station ex109 and the telephone network ex104, thereby enabling live distribution and the like.

- live distribution content that is shot by a user using the camera ex113 (for example, music live video) is encoded as described in each of the above embodiments (that is, in one aspect of the present invention).

- the streaming server ex103 stream-distributes the content data transmitted to the requested client. Examples of the client include a computer ex111, a PDA ex112, a camera ex113, a mobile phone ex114, and a game machine ex115 that can decode the encoded data.

- Each device that receives the distributed data decodes the received data and reproduces it (that is, functions as an image decoding device according to one embodiment of the present invention).

- the captured data may be encoded by the camera ex113, the streaming server ex103 that performs data transmission processing, or may be shared with each other.

- the decryption processing of the distributed data may be performed by the client, the streaming server ex103, or may be performed in common with each other.

- still images and / or moving image data captured by the camera ex116 may be transmitted to the streaming server ex103 via the computer ex111.

- the encoding process in this case may be performed by any of the camera ex116, the computer ex111, and the streaming server ex103, or may be performed in a shared manner.

- these encoding / decoding processes are generally performed in the computer ex111 and the LSI ex500 included in each device.

- the LSI ex500 may be configured as a single chip or a plurality of chips.

- moving image encoding / decoding software is incorporated into some recording medium (CD-ROM, flexible disk, hard disk, etc.) that can be read by the computer ex111, etc., and encoding / decoding processing is performed using the software. May be.

- moving image data acquired by the camera may be transmitted.

- the moving image data at this time is data encoded by the LSI ex500 included in the mobile phone ex114.

- the streaming server ex103 may be a plurality of servers or a plurality of computers, and may process, record, and distribute data in a distributed manner.

- the encoded data can be received and reproduced by the client.

- the information transmitted by the user can be received, decrypted and reproduced by the client in real time, and personal broadcasting can be realized even for a user who does not have special rights or facilities.

- the digital broadcast system ex200 also includes at least the moving image encoding device (image encoding device) or the moving image decoding according to each of the above embodiments. Any of the devices (image decoding devices) can be incorporated.

- the broadcast station ex201 multiplexed data obtained by multiplexing music data and the like on video data is transmitted to a communication or satellite ex202 via radio waves.

- This video data is data encoded by the moving image encoding method described in each of the above embodiments (that is, data encoded by the image encoding apparatus according to one aspect of the present invention).

- the broadcasting satellite ex202 transmits a radio wave for broadcasting, and this radio wave is received by a home antenna ex204 capable of receiving satellite broadcasting.

- the received multiplexed data is decoded and reproduced by an apparatus such as the television (receiver) ex300 or the set top box (STB) ex217 (that is, functions as an image decoding apparatus according to one embodiment of the present invention).

- a reader / recorder ex218 that reads and decodes multiplexed data recorded on a recording medium ex215 such as a DVD or a BD, or encodes a video signal on the recording medium ex215 and, in some cases, multiplexes and writes it with a music signal. It is possible to mount the moving picture decoding apparatus or moving picture encoding apparatus described in the above embodiments. In this case, the reproduced video signal is displayed on the monitor ex219, and the video signal can be reproduced in another device or system using the recording medium ex215 on which the multiplexed data is recorded.

- a moving picture decoding apparatus may be mounted in a set-top box ex217 connected to a cable ex203 for cable television or an antenna ex204 for satellite / terrestrial broadcasting and displayed on the monitor ex219 of the television.

- the moving picture decoding apparatus may be incorporated in the television instead of the set top box.

- FIG. 23 is a diagram illustrating a television (receiver) ex300 that uses the video decoding method and the video encoding method described in each of the above embodiments.

- the television ex300 obtains or outputs multiplexed data in which audio data is multiplexed with video data via the antenna ex204 or the cable ex203 that receives the broadcast, and demodulates the received multiplexed data.

- the modulation / demodulation unit ex302 that modulates multiplexed data to be transmitted to the outside, and the demodulated multiplexed data is separated into video data and audio data, or the video data and audio data encoded by the signal processing unit ex306 Is provided with a multiplexing / demultiplexing unit ex303.

- the television ex300 also decodes the audio data and the video data, or encodes the information, the audio signal processing unit ex304, the video signal processing unit ex305 (the image encoding device or the image according to one embodiment of the present invention) A signal processing unit ex306 that functions as a decoding device), a speaker ex307 that outputs the decoded audio signal, and an output unit ex309 that includes a display unit ex308 such as a display that displays the decoded video signal. Furthermore, the television ex300 includes an interface unit ex317 including an operation input unit ex312 that receives an input of a user operation. Furthermore, the television ex300 includes a control unit ex310 that performs overall control of each unit, and a power supply circuit unit ex311 that supplies power to each unit.

- the interface unit ex317 includes a bridge unit ex313 connected to an external device such as a reader / recorder ex218, a recording unit ex216 such as an SD card, and an external recording unit such as a hard disk.

- a driver ex315 for connecting to a medium, a modem ex316 for connecting to a telephone network, and the like may be included.

- the recording medium ex216 is capable of electrically recording information by using a nonvolatile / volatile semiconductor memory element to be stored.

- Each part of the television ex300 is connected to each other via a synchronous bus.

- the television ex300 receives a user operation from the remote controller ex220 or the like, and demultiplexes the multiplexed data demodulated by the modulation / demodulation unit ex302 by the multiplexing / demultiplexing unit ex303 based on the control of the control unit ex310 having a CPU or the like. Furthermore, in the television ex300, the separated audio data is decoded by the audio signal processing unit ex304, and the separated video data is decoded by the video signal processing unit ex305 using the decoding method described in each of the above embodiments.