WO2011099080A1 - 画像符号化装置及び画像復号装置 - Google Patents

画像符号化装置及び画像復号装置 Download PDFInfo

- Publication number

- WO2011099080A1 WO2011099080A1 PCT/JP2010/000888 JP2010000888W WO2011099080A1 WO 2011099080 A1 WO2011099080 A1 WO 2011099080A1 JP 2010000888 W JP2010000888 W JP 2010000888W WO 2011099080 A1 WO2011099080 A1 WO 2011099080A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- effective coefficient

- coefficient

- information

- effective

- value

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/167—Position within a video image, e.g. region of interest [ROI]

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/105—Selection of the reference unit for prediction within a chosen coding or prediction mode, e.g. adaptive choice of position and number of pixels used for prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/13—Adaptive entropy coding, e.g. adaptive variable length coding [AVLC] or context adaptive binary arithmetic coding [CABAC]

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/182—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a pixel

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/593—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving spatial prediction techniques

Definitions

- the present invention relates to an image encoding device, method, program, and image decoding device, method, program using frequency transform such as orthogonal transform.

- high-efficiency encoding is performed when it is transmitted from a transmission device to a reception device or stored in a storage device.

- “high-efficiency encoding” refers to an encoding process for converting a data string into another data string and compressing the data amount.

- a predictive coding method as a method used in high-efficiency image coding such as moving images.

- the predictive coding method for each coding target block obtained by dividing the coding target image into a plurality of blocks, a difference from the coding target block predicted image generated based on the local decoding process is calculated, and the prediction error image is calculated. Generated. Then, the frequency coefficient obtained by performing orthogonal transform on the prediction error image is quantized, and the resulting quantized coefficient is encoded and sent to the decoding side.

- an image entropy coding method is widely used for the coefficient obtained by transforming an image into the frequency domain. ing.

- One aspect of the present invention is to encode an image with higher efficiency and to decode this encoded information.

- an encoded block predicted image that is a predicted value of the encoded block

- An encoded block prediction image generation unit that generates a prediction error image generation unit that generates a prediction error image that is a difference between the encoding block and the encoded block prediction image, and converts the prediction error image into a frequency coefficient

- a transform unit a quantization unit that quantizes the frequency coefficient to generate a quantization coefficient

- an inverse quantization unit that dequantizes the quantization coefficient to generate a reproduction frequency coefficient

- An inverse transform unit that performs inverse transform, a local decoded image generation unit that generates a local decoded image from the reproduction prediction error image and the encoded block predicted image, and an adjacent to the encoded block

- a boundary pixel prediction value generation unit that generates a boundary pixel prediction value that is a prediction value of a boundary pixel that is in contact with the encoded block in the encoding block from local decoded images of a plurality of encoded blocks;

- For the boundary pixel a boundary pixel prediction error estimation unit that generates boundary pixel prediction error estimation information from the boundary pixel prediction value and the encoded block prediction image; and a code from the quantization coefficient and boundary pixel prediction error estimation information

- a quantization coefficient encoding unit that generates encoded block entropy encoded data, and the quantization coefficient encoding unit extracts non-zero values from the quantization coefficients as effective coefficients, and Effective coefficient position information indicating the frequency position of the coefficient, effective coefficient absolute value information which is the absolute value of the effective coefficient,

- encoded block entropy encoded data encoded by a moving image encoding apparatus that performs encoding for each encoded block obtained by dividing an encoding target image into a plurality of blocks

- a coded block predicted image generation unit that generates a coded block predicted image that is a predicted value of the coded block, and a plurality of encoded blocks adjacent to the coded block

- a boundary pixel predicted value generation unit that generates a boundary pixel predicted value that is a predicted value of a boundary pixel that contacts the encoded block in the encoded block, and for the boundary pixel, the boundary pixel

- a boundary pixel prediction error estimator for generating boundary pixel prediction error estimation information from the boundary pixel prediction value and the encoded block prediction image

- a quantization coefficient decoding unit that generates a quantization coefficient from the encoded data and the boundary pixel prediction error estimation information, an inverse quantization unit that dequantize

- the effective coefficient position information decoding unit that decodes the effective coefficient position information that is the frequency position of the effective coefficient, and the effective coefficient absolute value information that is the absolute value of the effective coefficient of the encoded block from the encoded block entropy encoded data

- An effective coefficient sign information prediction unit that generates an effective coefficient sign information prediction value, the effective coefficient sign information prediction value, and the coding block entropy

- An effective coefficient sign information prediction decoding unit that decodes effective coefficient sign information that is sign information of the effective coefficient based on sign predicted value match information decoded from the encoded data, the effective coefficient absolute value information;

- a moving picture decoding apparatus is provided that generates a quantized coefficient of the coding block from the effective coefficient position information and the effective coefficient sign information.

- an appropriate entropy encoding is performed on sign information matching information including at least that the sign information and the predicted value thereof match, whereby one symbol of sign information per pixel is averaged by 1 bit. Therefore, it is possible to reduce the amount of sign information.

- FIG. 9 It is a figure which shows the structure of the quantization coefficient encoding part of FIG. 9 in 1st Embodiment. It is a figure which shows the decoding apparatus of 2nd Embodiment. It is a figure which shows the structure of the quantization coefficient decoding part of FIG. 11 in 2nd Embodiment. It is a figure which shows the effective coefficient sign information prediction part 1024 which is common in 1st Embodiment and 2nd Embodiment. , It is a figure which shows 3rd Embodiment which is another implementation

- FIG. 20 is a diagram for describing processing of a sign information reproducing unit 3302 in the fifth embodiment. It is a figure explaining the orthogonal basis vector which comprises 4-point Hadamard transformation of 6th Embodiment. It is a figure explaining the accumulation sum expression of 4 point

- FIG. 1 is an explanatory diagram of the ITU-T H.264 system that is an international video coding standard.

- a moving image is obtained by dividing an input frame 100 into a plurality of blocks and encoding in block units or a plurality of block units.

- FIG. 1 shows an example of block division in H.264.

- ITU-T H.264 which is an international video coding standard

- an image frame 100 is divided into macroblocks 103 each composed of 16 ⁇ 16 pixels.

- one of 4x4 and 8x8 is selected as orthogonal transform.

- the macro block 103 is further divided into 4 ⁇ 4 blocks (102) or 8 ⁇ 8 blocks (101), and encoding is performed using this block as an encoding unit.

- FIG. 2 shows an image encoding apparatus that divides an image into a plurality of blocks and encodes the blocks.

- the coding block is 4x4 or 8x8.

- an encoded block predicted image that is a predicted image having high correlation with the encoded block is generated.

- ITU-T H.264 there are an inter prediction image generation unit, an intra prediction image generation unit, and the like.

- the inter prediction image generation unit selects a region similar to the encoded block from the decoded images decoded in the past, and outputs the selected region as an encoded block predicted image.

- the intra-predicted image generation unit generates an image similar to the encoded block from the local decoded image of the peripheral block that has already been encoded of the current encoded image by extrapolation prediction, and outputs the image as an encoded block predicted image.

- both the inter prediction image generation unit and the intra prediction image generation unit are collectively referred to as an encoded block prediction image generation unit 200.

- the side information encoding unit 209 uses the entropy code for side information such as motion vector information indicating the relative positions of the encoding target block and the decoded image block and the intra prediction mode used in the inter prediction image generating unit. And superimposed on the bitstream.

- entropy coding is a technique for optimally compressing data using the appearance frequency of data.

- the prediction error image generation unit 201 calculates a difference between the encoded block and the encoded block predicted image to generate a prediction error image. Then, the transform unit 202 transforms the prediction error image into frequency coefficients using frequency transform such as discrete cosine transform and Hadamard transform.

- the quantization unit 203 quantizes the frequency coefficient to generate a quantized coefficient.

- quantization is realized by dividing a frequency coefficient by an appropriate quantizer and converting it into an integer and outputting the value as a quantization coefficient.

- the quantizer is switched for each frequency component position of the coefficient in MPEG-2 which is another international video coding standard and H.264 described above.

- the quantization coefficient is inversely quantized to generate a reproduction frequency coefficient.

- inverse quantization is realized by a quantizer used in the quantization unit 203 multiplying the quantization coefficient.

- the inverse transform unit 205 applies a reverse frequency transform corresponding to the frequency transform used in the transform unit to the playback prediction error image, thereby generating a playback prediction error image.

- the local decoded image generation unit 206 adds the encoded block prediction image and the reproduction prediction error image to generate a local decoded image.

- This local decoded image is stored in the decoded image storage unit 208, used for generating an inter predicted image in the subsequent frames, and also used for generating an intra predicted image of an encoding target frame. Then, the quantized coefficient is entropy encoded by the quantized coefficient encoding unit 207, and encoded block entropy encoded data is generated for each encoded block.

- FIG. 3 is an operation explanatory diagram of the conversion unit 202 of FIG.

- 301 shows the basis of Hadamard orthogonal transform. This conversion converts a four-point image into a four-point frequency.

- the values of the coefficients of the base pixels 0 to 3 having the frequency 0 are 0.5, 0.5, 0.5, and 0.5.

- the coefficient values of the base pixels 0 to 3 of frequency 1 are 0.5, 0.5, -0.5, and -0.5.

- the coefficient values of the pixels 0 to 3 are defined as 301.

- the frequency conversion of the prediction error image of 4x4 block can be realized by converting the vertical and horizontal directions by Hadamard orthogonal transform, for example.

- the frequency conversion in the vertical direction can be realized by expressing a 4 ⁇ 4 conversion target image in a matrix and multiplying this image by a Hadamard orthogonal transformation matrix from the left.

- the horizontal transformation can be realized by multiplying the result obtained by transposing a Hadamard orthogonal transformation matrix from the right.

- a frequency coefficient can be obtained for a prediction error image having a size of 4 ⁇ 4 blocks.

- FIG. 4 is an explanatory diagram of the processing operation of the encoding device shown in FIG. 2, and mainly shows changes in data values in the example of each pixel of the 4 ⁇ 4 block, taking the processing of 4 ⁇ 4 block conversion as an example.

- the Hadamard transform of FIG. 3 is used as the transform unit.

- the encoding target block 451 corresponds to one of the 16 blocks constituting the 4 ⁇ 4 block 102 in FIG. 1 and includes 16 pixels.

- the pixel value of the encoding target block prediction image block 450 with respect to the pixel value of the encoding target block (corresponding to the encoding block in FIG. 2) 451, for example, from the previous frame in time or from spatially adjacent images The difference between these pixel values is calculated by the prediction error image generation unit, and the pixel value of the prediction error image block 452 is generated.

- the pixel value is a value indicating the gradation of each pixel.

- the pixel value of the prediction error image block 452 of this 4 ⁇ 4 block is converted to a frequency by the Hadamard transform base of FIG. 3, and the value of the frequency coefficient block 453 is obtained.

- the frequency coefficient represents a horizontal frequency component in the horizontal direction, a vertical frequency component in the vertical direction, a low frequency of the horizontal / vertical component on the left and top, and a high frequency of the horizontal and vertical components on the right and bottom.

- the value of the frequency coefficient block 453 is quantized by the quantization unit.

- quantization is performed by dividing a frequency coefficient by a constant called a quantizer.

- the quantization method is calculated by the following equation, for example, where each coefficient is f, the quantizer is Q, and the quantization coefficient is C.

- sign (x) is a function that returns 1 if x is positive and -1 if negative.

- int (x) is a function that rounds off the decimal part of x to make it an integer

- abs (x) is a function that returns the absolute value of x.

- the quantizer is 3. Therefore, the value of the frequency coefficient block 453 of the DC component is ⁇ 7.25. And converted to a value of ⁇ 2 as a quantization coefficient. Other frequency coefficients are similarly quantized, and the value of the quantized coefficient block 454 is obtained.

- the quantized coefficient is converted into the value of the encoded block entropy encoded data block 458 by the quantized coefficient encoding unit.

- This quantization coefficient is further inversely quantized by the inverse quantization unit.

- the inverse quantization method is calculated, for example, by multiplying the inverse quantization coefficient by the inverse quantizer used in the quantization. That is, if the quantization coefficient is C, the quantizer is Q, and the reproduction frequency coefficient is f ′, It is represented by According to this equation, for example, the value of the DC component quantization coefficient block 454 is -2, so And converted to a value of -6 as a reproduction frequency coefficient. The other frequency coefficients are processed in the same manner, and the value of the reproduction frequency coefficient block 455 is obtained.

- the inverse conversion unit inversely transforms the reproduction frequency coefficient, and the pixel value of the reproduction prediction error image block 456 is generated.

- This reproduced prediction error image is added to the pixel value of the predicted image block 450 of the encoding target block by the local decoded image generation unit, and the pixel value of the local decoded image block 457 is generated.

- Each pixel value of the reproduction prediction error image block 456 is slightly different from each pixel value of the prediction error image block 452.

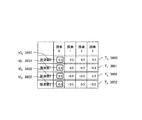

- FIG. 6 shows an example in which the value of the quantization coefficient block 454 of FIG. 4 is zigzag scanned and converted into non-zero effective coefficient information.

- Effective coefficient information which is a non-zero coefficient, is extracted, and position information in a zigzag scan, an absolute value of the effective coefficient, and sign information representing the sign of the effective coefficient are extracted from each effective coefficient.

- 0 is assigned as sign information when the quantization coefficient is positive, and 1 is assigned when it is negative.

- the first effective coefficient number in the zigzag scan order is 1

- the effective coefficient position information is 1

- the effective coefficient absolute value information is 2

- the effective coefficient sign information is 1.

- the effective coefficient of the second number has effective coefficient position information of 2, effective coefficient absolute value information of 3, and effective coefficient sign information of 0.

- the information in the table of FIG. 6 is obtained by sequentially converting in the same manner.

- FIG. 7 is a detailed configuration diagram of the quantized coefficient encoding unit 207 in FIG. 2 based on the above description.

- quantized coefficients are input to the quantized coefficient coding unit 207 in units of blocks.

- the quantized coefficient is decomposed by the effective coefficient information generation unit 720 into the effective coefficient position information, the effective coefficient absolute value information, and the effective coefficient sign information representing the positive / negative of the effective coefficient described with reference to FIG.

- an optimal entropy code is assigned by the effective coefficient position information encoding unit 721, and the effective coefficient position code is It is encoded efficiently.

- the effective coefficient absolute value information encoding unit 722 uses a bias that tends to generate a larger value as it is closer to the DC component and conversely tends to be smaller as it is closer to the high frequency.

- An optimal entropy code is assigned and is efficiently encoded as an effective coefficient absolute value code. For example, in the case of H.264 arithmetic coding (CABAC) mode, both the effective coefficient position information and the effective coefficient absolute value information reflect that a larger coefficient is more likely to appear at lower frequencies and a smaller coefficient at higher frequencies.

- CABAC H.264 arithmetic coding

- the optimal probability table is assigned to the arithmetic code in accordance with the position of the coefficient zigzag scan, thereby realizing highly efficient encoding.

- the effective coefficient sign information which is the sign of the coefficient

- positive and negative symbols are generated with the same probability of 0.5. Therefore, even if any entropy code is assigned, it cannot be efficiently encoded. For this reason, all the video coding standards such as ITU-T H.261 / H.263 / H.264, ISO / IEC MPEG-1, MPEG-2, MPEG-4 1-bit information is used and is output from the effective coefficient sign information encoding unit 723 as an effective coefficient sign code.

- the effective coefficient position code, the effective coefficient absolute value code, and the effective coefficient sign code are combined and output as encoded block entropy encoded data.

- FIG. 8 is a diagram showing the configuration of the image decoding apparatus corresponding to FIG.

- the quantized coefficient decoding unit 807 performs inverse entropy coding from the encoded block entropy coded data to decode the quantized coefficients, and then, similarly to the encoder, the inverse quantization unit 804 performs inverse quantization and inverse transform unit 805.

- a reverse prediction error image is generated by performing inverse transform in step (b).

- the encoded block predicted image generation unit 800 generates an encoded block predicted image

- the decoded image generation unit 806 adds the encoded block predicted image and the reproduction prediction error image to generate a decoded image. Then, this decoded image is stored in the decoded image storage unit 808 and simultaneously output for display.

- the local decoding unit of the encoding apparatus and a part of the decoding apparatus perform exactly the same operation. Therefore, the inverse quantization unit 804, the inverse transform unit 805, the encoded block predicted image generation unit 800, the decoded image generation unit 806, and the decoded image storage unit 808 in the decoding device in FIG.

- the same operations as those of the conversion unit 204, the inverse conversion unit 205, the encoded block predicted image generation unit 200, the decoded image generation unit 206, and the decoded image storage unit 208 are performed.

- sign information representing the sign of an effective quantization coefficient

- one bit is generally used for each coefficient. Since this sign information occupies 10% or more of the information amount of all target images, it is indispensable to reduce the sign information in order to further improve the compression rate.

- the pixel that is in contact with the boundary pixel of the block to be encoded and the pixel to be encoded are similar in the image included in the already decoded block.

- the sign information is efficiently encoded by generating a prediction value of the effective coefficient sign information and encoding whether or not the prediction value and the actual sign information coincide with each other.

- the presence of quantization coefficients means that there is a difference between the original image and the predicted image, that is, the accuracy of the predicted image is poor.

- pixels that are spatially in contact with each other have similar values. Therefore, it is expected that the boundary pixel in contact with the encoded block in the encoding target block has a value close to the pixel in contact with the encoding target block in the encoded block. Therefore, the value of the boundary pixel of the original image of the encoding target block can be estimated from the pixels in the encoding block that are in contact with the encoding target block.

- the difference between the original image and the predicted image at the boundary pixel of the encoded block can also be estimated from the pixel in contact with the encoding target block in the encoded block and the predicted image.

- an estimated value of the difference in the boundary pixel is set as a boundary pixel prediction error estimated value.

- the boundary pixel value in the reproduction prediction error obtained by dequantizing and inversely converting the quantization coefficient corresponding to the encoding target block is close to the boundary pixel prediction error estimated value.

- the absolute value and the position (frequency) of the quantized coefficients are known, the set of sign information of each coefficient for which the boundary pixel prediction error estimated value and the boundary pixel predicted error estimated value are close are obtained. It will be limited. Therefore, the sign information of each coefficient for which the boundary pixel of the reproduction prediction error and the estimated value of the boundary pixel prediction error are closest is a good prediction value of the actual sign information of each coefficient. If a good prediction value can be obtained, sign information can be efficiently encoded.

- each of the following embodiments first, from a locally decoded image of a coded block that has been coded before coding a coded block that contacts the coded block, and a coded block predicted image that is a predicted value of the coded block.

- the estimation value of the prediction error of the boundary pixel in contact with the encoded block among the encoded blocks is obtained.

- the sign that generates the reproduction prediction error that is closest to the estimated value of this prediction error is used as a sign information prediction value of an effective coefficient.

- Entropy encoding information on whether or not the sign information predicted value of the effective coefficient matches the sign information of the actual effective coefficient to be encoded (match information) is generated as ⁇ match '' or ⁇ not match '' information.

- FIG. 9 is a diagram illustrating an encoding apparatus based on the first embodiment.

- the first embodiment relates to a moving image encoding apparatus that divides an encoding target image into a plurality of block images and performs encoding for each encoding block.

- a quantized coefficient and a locally decoded image are generated from a prediction image and an encoding block that is an encoding target block. That is, first, the encoded block predicted image generation unit 900 generates an encoded block predicted image that is a predicted value of the encoded block by encoding. Next, a prediction error image generation unit 901 generates a prediction error image that is a difference between the encoded block and the encoded block prediction image. Subsequently, the conversion unit 902 converts the prediction error image into a frequency coefficient. Further, the quantization unit 903 quantizes the frequency coefficient to generate a quantization coefficient.

- the inverse quantization unit 904 inversely quantizes the quantization coefficient to generate a reproduction frequency coefficient.

- the inverse transformation unit 905 inversely transforms the reproduction frequency coefficient into a reproduction prediction error image.

- a local decoded image generation unit 906 generates a local decoded image from the reproduction prediction error image and the encoded block prediction image.

- boundary pixel predicted value generation unit 910 from the locally decoded images of a plurality of encoded blocks adjacent to the encoded block, the predicted value of the boundary pixel that contacts the encoded block in the encoded block A certain boundary pixel prediction value is generated.

- boundary pixel prediction error estimation unit 911 from the boundary pixel prediction value and the encoded block prediction image, the value of the boundary pixel and the boundary pixel prediction value of the encoded block prediction pixels with respect to the boundary pixel A boundary pixel prediction error estimated value is generated as the difference between the two.

- the quantized coefficient encoding unit 907 generates encoded block entropy encoded data by using the quantization coefficient and the boundary pixel prediction error estimated value (boundary pixel prediction error estimation information).

- FIG. 10 is a diagram illustrating a configuration of the quantized coefficient encoding unit 907 of FIG. 9 in the first embodiment.

- the effective coefficient information generating unit 1020 extracts a quantized coefficient whose value is not zero from the quantized coefficient as an effective coefficient, and effective coefficient position information indicating the frequency position of the effective coefficient.

- the effective coefficient absolute value information which is the absolute value of the effective coefficient, and the effective coefficient sign information representing the sign of the effective coefficient are generated. This operation is the same as that of the effective coefficient information generation unit 720 in FIG.

- the effective coefficient sign information prediction unit 1024 predicts sign information indicating whether the effective coefficient is positive or negative from the boundary pixel prediction error estimated value, the effective coefficient position information, and the effective coefficient absolute value information.

- An effective coefficient sign information prediction value that is a value is generated.

- the effective coefficients for generating the effective coefficient sign information prediction value may be all the effective coefficients of the coding block, or may be a part of the effective coefficients selected by a predetermined rule. .

- the configuration for generating the effective coefficient sign information prediction value for only some effective coefficients selected according to a predetermined rule will be described in detail in the fourth to sixth embodiments.

- the effective coefficient position information encoding unit 1021 generates the effective coefficient position code by entropy encoding the effective coefficient position information

- the effective coefficient absolute value encoding unit 1022 entropy encodes the effective coefficient absolute value information to Generate a value sign.

- the effective coefficient sign information prediction encoding unit 1023 entropy-encodes the sign prediction value match information indicating whether the effective coefficient sign information prediction value and the sign information of the effective coefficient match to generate an effective coefficient sign code. . Then, encoded block entropy encoded data is generated from the effective coefficient position code, the effective coefficient absolute value code, and the effective coefficient sign code.

- a highly accurate prediction value of effective coefficient sign information can be generated from effective coefficient position information, effective coefficient absolute value information, a predicted image, and a decoded image.

- the coincidence information as to whether or not the predicted value and the effective coefficient sign information coincide with each other will occupy a large number of “match” symbols.

- the information amount of the sign information is reduced. It is possible to reduce more.

- FIG. 11 is a diagram showing a decoding device based on the second embodiment.

- the moving picture decoding apparatus according to the second embodiment divides an encoding target picture into a plurality of block pictures, and performs coding performed by the moving picture coding apparatus in FIG. 9 that performs coding for each coding block.

- the block entropy encoded data is decoded for each block.

- a decoded image is generated from encoded block entropy encoded data, as in the decoding apparatus of FIG. That is, the encoded block prediction image generation unit 1100 generates an encoded block prediction image that is a prediction value of the encoding block. Further, the quantization coefficient decoding unit 1107 decodes the quantization coefficient from the bit stream and the boundary pixel prediction error estimated value. Then, the quantization coefficient is inversely quantized by the inverse quantization unit 1104 to generate a reproduction frequency coefficient, and the inverse transformation unit 1105 inversely converts the reproduction frequency coefficient into a reproduction prediction error image, and the decoded image generation unit 1106 performs reproduction prediction. A decoded image is generated from the error image and the encoded block prediction image.

- the boundary pixel predicted value generation unit 1110 from the decoded images of a plurality of encoded blocks adjacent to the encoded block, the predicted value of the boundary pixel that contacts the encoded block in the encoded block A certain boundary pixel prediction value is generated.

- the boundary pixel prediction error estimation unit 1111 generates a boundary pixel prediction error estimation value for the boundary pixel from the boundary pixel prediction value and the encoded block prediction image, and sends it to the quantization coefficient decoding unit 1107.

- the quantization coefficient decoding unit 1007 generates a quantization coefficient from the encoded block entropy encoded data and the boundary pixel prediction error estimation value.

- FIG. 12 is a diagram illustrating a configuration of the quantization coefficient decoding unit 1007 of FIG. 11 in the second embodiment.

- the effective coefficient position information decoding unit 1231 extracts an effective coefficient position code from the encoded block entropy encoded data, and decodes effective coefficient position information that is the frequency position of the effective coefficient of the encoded block.

- the effective coefficient absolute value information decoding unit 1232 extracts the effective coefficient absolute value code from the encoded block entropy encoded data, and decodes the effective coefficient absolute value information that is the absolute value of the effective coefficient of the encoded block.

- the effective coefficient sign information prediction unit 1024 predicts sign information indicating whether the effective coefficient is positive or negative from the boundary pixel prediction error estimated value, the effective coefficient position information, and the effective coefficient absolute value information. An effective coefficient sign information prediction value that is a value is generated.

- the effective coefficient sign information prediction unit 1024 in FIG. 12 is exactly the same as the effective coefficient sign information prediction unit 1024 in FIG. 10 of the encoding device in the first embodiment.

- the effective coefficient sign effective coefficient Effective coefficient sign information which is sign information is decoded and output.

- the sign prediction value match information is “match”

- the sign information of the effective coefficient sign information prediction value is “same”

- the sign information indicates a sign opposite to the sign of the effective coefficient sign information prediction value. Is output.

- block quantization coefficients are generated from the effective coefficient absolute value information, effective coefficient position information, and effective coefficient sign information. Then, this quantized coefficient is processed by the same method as that of the decoding apparatus in FIG. 8 to generate a decoded image.

- the second embodiment it is possible to decode the encoded block entropy encoded data encoded in the first embodiment and further reducing the information amount of the sign information.

- FIG. 13 is a diagram illustrating an effective coefficient sign information prediction unit 1024 that is common to the first embodiment and the second embodiment.

- the effective coefficient sign information prediction value is obtained as follows. First, in the effective coefficient sign information candidate generation unit 1340, the effective coefficient sign information for each effective coefficient is positive or negative with respect to the coefficient given by the effective coefficient position information and the effective coefficient absolute value information in the coding block. A combination of a plurality of pieces of signature information to which these are temporarily assigned is generated. This is a valid coefficient sign information candidate. Since there are two types of sign information indicating the sign of each effective coefficient, positive and negative, for example, when generating effective coefficient sign information candidates for N effective coefficients, as a combination, a maximum of 2 to the Nth power There are street combinations.

- the degree of coincidence calculation unit 1341 calculates the degree of coincidence between each effective coefficient sign information candidate, the effective coefficient position information, and the reproduction prediction error signal obtained from the effective coefficient absolute value information and the boundary pixel prediction error estimated value. To do. Then, the maximum likelihood coefficient sign information determination unit 1342 outputs the effective coefficient sign information candidate having the highest degree of matching as the effective coefficient sign information prediction value. This effective coefficient sign information prediction value coincides with the effective coefficient sign information with a high probability. Therefore, by encoding the difference between the effective coefficient sign information and its predicted value, the probability of the symbol “matching” between them increases, and by performing optimal entropy encoding, information on the effective coefficient sign information The amount can be reduced.

- FIG. 14 is a diagram illustrating a third embodiment, which is another implementation of the effective coefficient sign information prediction unit 1024 (FIGS. 10 and 12) in the first and second embodiments.

- the effective coefficient sign information prediction value is obtained as follows. First, in the Gray code (gray code) effective coefficient sign information candidate generation unit 1440, effective coefficient sign information for each effective coefficient is obtained for the coefficient given by the effective coefficient position information and effective coefficient absolute value information in the coding block. A combination of a plurality of pieces of sign information tentatively assigned either positive or negative is generated so as to correspond to 0/1 of each bit position of the Gray code.

- the technique described in Patent Document 1 is referred to as a Gray code in accordance with a widely used name.

- the effective coefficients having different signs are identified between the immediately preceding effective coefficient sign information candidate and the effective coefficient sign information candidate to be evaluated. To do.

- the influence of the degree of coincidence on the cost calculation process is obtained from the change of the sign of the effective coefficient.

- the difference between the coincidence cost of the previous effective coefficient sign information candidate and the coincidence cost of the effective coefficient sign information candidate to be evaluated Ask for. Further, by adding this difference to the cost of the matching degree of the previous effective coefficient sign information candidate, the cost of matching degree of the effective coefficient sign information candidate to be evaluated is obtained.

- the maximum likelihood coefficient sign information determination unit 1442 outputs the effective coefficient sign information candidate having the highest degree of matching as an effective coefficient sign information prediction value. According to the third embodiment described above, without calculating the cost of matching every time, only the cost difference of the matching score is obtained from the effective coefficient sign information whose sign has changed, and this value is used as the matching score of the previous candidate. Therefore, the amount of calculation can be further reduced.

- the effective coefficient sign information prediction unit uses the prediction value of the sign information of the effective coefficient and encodes whether the prediction and the actual value match. Is generated.

- sign information of an effective coefficient with high prediction accuracy is generated, and as a result, the probability that the sign information matches the predicted value is increased.

- entropy codes can be encoded more efficiently when the probability of symbol occurrence is biased. By performing appropriate entropy coding, this coincidence information can be coded with an average of less than 1 bit per symbol. For this reason, it is possible to further reduce the amount of information of sign information by performing appropriate entropy coding on the sign information matching information.

- FIG. 15 is a diagram illustrating an encoding apparatus based on the fourth embodiment.

- the fourth embodiment shown in FIG. 15 is based on the first embodiment shown in FIG. 9, and is based on a quantization coefficient encoding unit 1507, a boundary pixel prediction error estimation unit 1511, and a boundary pixel prediction value generation unit 1510. Is disclosed in more detail.

- the processing units 1507, 1511, and 1510 correspond to the processing units 907, 911, and 910 having the same names in FIG. In FIG. 15, each processing unit having the same name as in FIG. 9 executes the same process as in FIG.

- a block having the values of the encoding target block 451 and the encoding target block prediction image 450 shown in FIG. 4 is converted into a conversion unit, a quantization unit, an inverse quantization unit, and an inverse conversion equivalent to those in FIG.

- An example of encoding using a local decoding unit and a local decoding generation unit is shown. Since these arithmetic processes are equivalent to a general method, the quantization coefficient shown in FIG. 15 is also the same as the quantization coefficient 454 of FIG.

- the local decoded image in FIG. 15 is also the same as the local decoded image 457 in FIG.

- details of the boundary pixel prediction value generation unit 1510, the boundary pixel prediction error estimation unit 1511, and the quantization coefficient encoding unit 1507 will be described in the fourth embodiment.

- FIG. 16 is a diagram illustrating an example of a boundary pixel of an encoding target block 1661 (encoding block) having a size of 4 ⁇ 4 when the base size of orthogonal transformation such as H.264 is 4 ⁇ 4.

- encoding processing proceeds in units of blocks from the upper left to the lower right. For this reason, encoding of the left and upper blocks of the encoding block is completed before encoding of the encoding block.

- a block that has already been encoded at the time of encoding the encoded block is referred to as a coded block (1662).

- the pixels on the upper and left ends of the encoded block are in contact with the encoded block. Therefore, the upper and left end pixels in the encoding target block in FIG. 16 are defined as boundary pixels (1660).

- FIG. 17 is a diagram illustrating a processing example of the boundary pixel predicted value generation unit 1510 according to the fourth embodiment.

- the boundary pixel prediction value generation unit 1510 receives a local decoded image in the vicinity of the left, upper left, and upper boundaries of the encoded block, and generates a boundary pixel prediction value.

- the pixels of the encoded block of the locally decoded image in contact with the boundary pixel are the same as those in FIG. 16.

- the pixels that touch the left are L0 to L3

- the pixels that touch the top are U0 to U3

- the pixels that touch the top left are UL, with respect to the pixels of the input local decoded image.

- the boundary pixel prediction values at the boundary pixels of the coding block are assumed to be E0, E1, E2, E3, E4, E5, and E6 in order from the lower left to the upper right.

- the boundary pixel predicted values E0 to E6 are obtained from the pixels L0 to L3, U0 to L3, and UL of the locally decoded image of the encoded block near the boundary pixel by the following formula.

- E0 L3

- E1 L2

- E2 L1

- E3 (L0 + UL + U0)

- E4 U1

- these boundary pixel prediction values are output.

- the value of the nearest pixel is used as it is or averaged.

- the neighborhood of the prediction target pixel is also used. It is also possible to use a pixel prediction method or the like in general pixel adaptive DPCM encoding using a plurality of pixels for generating a boundary pixel prediction value.

- FIG. 18 is a diagram illustrating an implementation example of the boundary pixel prediction error estimation unit 1511 in the fourth embodiment.

- a boundary pixel prediction error estimation value is generated from the boundary pixel prediction value generated in FIG. 17 and the value of the encoding target block prediction image 450 in FIG.

- the boundary pixel prediction values E0 to E6 are boundary pixel prediction values of the boundary pixels of the encoded block corresponding to FIG.

- Pixels P0 to P6 are values of boundary pixels of the encoded block prediction image.

- Pixels D0 to D6 are boundary pixel prediction error estimation values.

- n is a number between 0 and 6

- Dn En-Pn

- the boundary pixel prediction error estimated value of each pixel is obtained. For example, since the value of the pixel E3 is 57 and the value of the pixel P3 is 55, the value of 2 is obtained by subtracting 55 from 57.

- FIG. 19 is a diagram illustrating an implementation example of the quantized coefficient coding unit 1507 in the fourth embodiment.

- this implementation example not all effective coefficients but coefficients that use the effective coefficient sign information prediction value are selected, a coefficient that is predictively encoded using the sign information prediction value, and a general 1-bit fixed-length code are used. An example of combining with existing coefficients will be described.

- the effective coefficient information generation unit 1920 extracts, as an effective coefficient, a quantization value whose value is not zero from the quantization coefficient, and effective coefficient position information representing the frequency position of the effective coefficient, Effective coefficient absolute value information, which is the absolute value of the effective coefficient, and effective coefficient sign information representing the sign of the effective coefficient are generated.

- Effective coefficient absolute value information which is the absolute value of the effective coefficient

- effective coefficient sign information representing the sign of the effective coefficient

- an effective coefficient for predictively encoding sign information using an effective coefficient sign information prediction value, and a fixed length An effective coefficient for encoding sign information is determined using encoding, and an index of an effective coefficient for encoding sign information using the latter fixed-length encoding (fixed-length encoded sign information index) is output.

- an effective coefficient sign information predicted value that is a predicted value of sign information indicating whether each coefficient is positive or negative is generated.

- the effective coefficient position information encoding unit 1921 generates effective coefficient position code by entropy encoding the effective coefficient position information, and the effective coefficient absolute value encoding unit 1922 performs entropy encoding on the effective coefficient absolute value information to Generate a value sign.

- the effective coefficient sign information prediction encoding unit 1923 encodes the effective coefficient sign information.

- the effective coefficient sign information indicated by the fixed-length encoded sign information index is encoded using fixed-length encoding.

- the effective coefficient sign information is generated by entropy-encoding the sign prediction value matching information indicating whether the effective coefficient sign information prediction value and the sign information of the effective coefficient match.

- the encoded block entropy encoded data is generated by combining the effective coefficient position code, the effective coefficient absolute value code, and the effective coefficient sign code.

- FIG. 20 is a diagram illustrating an implementation example of the effective coefficient sign information prediction unit 1924 according to the fourth embodiment.

- the effective coefficient sign information candidate generation unit 2040 the effective coefficient sign information for each effective coefficient is positive or negative with respect to the coefficient given by the effective coefficient position information and the effective coefficient absolute value information in the coding block. Generate multiple combinations that are assigned. This is a valid coefficient sign information candidate. Since sign information indicating the sign of each effective coefficient is two types, positive and negative, for example, when generating effective coefficient sign information candidates for N effective coefficients, a maximum of 2 to the Nth power is combined. There are street combinations.

- the matching degree calculation unit 2041 includes an effective coefficient rearranging unit 2070, a quantized coefficient provisional value generation unit 2071, a boundary pixel prediction error provisional value generation unit 2722, and a prediction error matching degree calculation unit 2073.

- the effective coefficient rearrangement unit 2070 rearranges the effective coefficients using the effective coefficient position information and the effective coefficient absolute value information of the encoded block. This rearrangement is performed from an effective coefficient expected to have a high accuracy of the generated effective coefficient sign information prediction value to a lower effective coefficient. When the number of effective coefficients is large, a coefficient to be encoded using a prediction value by an effective coefficient sign information prediction value is selected from those having high accuracy as necessary.

- the provisional value of the quantization coefficient is applied to the effective coefficient reordered by the effective coefficient rearranging unit 2070 and applied to each effective coefficient sign information candidate code in the quantization coefficient provisional value generation unit 2071. Is generated for each effective coefficient sign information candidate.

- the boundary pixel prediction miscalculation provisional value generation unit 2072 dequantizes and inversely transforms the generated quantized coefficient provisional value to select only the boundary pixel, so that the boundary pixel that is the provisional error prediction value of the boundary pixel A prediction error provisional value is generated for each effective coefficient sign information candidate.

- the prediction error coincidence calculation unit 2073 calculates the degree of coincidence between the field pixel prediction error provisional value generated for each valid coefficient sign information candidate and the boundary pixel prediction error estimated value.

- the maximum likelihood coefficient sign information determination unit 2042 outputs the effective coefficient sign information candidate having the highest degree of coincidence generated by the prediction error coincidence calculation unit as an effective coefficient sign information prediction value. Since the difference between the effective coefficient sign information prediction value and the effective coefficient sign information generated from the quantization coefficient of the frequency coefficient of the prediction error image of the encoding target block of the original image is small, as shown in FIG. By encoding the difference by the effective coefficient sign information predictive encoding unit 1923, an effective coefficient sign code optimally entropy-coded can be obtained.

- FIG. 21 is a diagram illustrating a processing example of the effective coefficient rearranging unit 2070 in the fourth embodiment.

- the input to the effective coefficient rearranging unit 2070 is the same as the effective coefficient position information and effective coefficient absolute value information of the coding block in FIG.

- the provisional value of the boundary pixel prediction error is obtained by multiplying the base of the orthogonal transform corresponding to the effective coefficient by a value obtained by multiplying the inverse quantized value for all the effective coefficients of the coding block, and accumulating this. Is required. Therefore, the larger the effective coefficient absolute value, the greater the influence on the boundary pixel prediction error provisional value.

- a different quantizer is used for each effective coefficient position corresponding to the effective coefficient in H.264 or the like, so that the effective coefficient absolute value is inverted instead of the effective coefficient absolute value. It is also possible to determine the priority based on the quantized value.

- the effective coefficients are rearranged in the rearrangement process 2110 according to the above rules, and rearranged effective coefficient position information and effective coefficient absolute value information 2101 are obtained.

- the fourth embodiment in the selection process 2111, the first six coefficients are selected from the rearranged coefficients, and the coefficients are encoded using the effective coefficient sign information prediction value. decide. For the remaining two coefficients having the effective coefficient position information of 5 and 4, the effective coefficient position information of “5” and “4” is output as the fixed-length encoded sign information index 2103.

- These coefficients are encoded using a general method, for example, a fixed length code of 1 bit per code.

- the six effective coefficients 2102 are output as the coefficients that are rearranged and use the effective coefficient sign information prediction value.

- FIG. 22 is a diagram illustrating a processing example of the effective coefficient sign information candidate generation unit 2040 in the fourth embodiment.

- This figure shows an example of generating effective coefficient sign information candidates for the selected six effective coefficients.

- the effective coefficient is described on the figure using the position information of each effective coefficient as an index. Since there are six coefficients, there are 64 combinations of positive and negative sign information for the six coefficients, which is 2 to the sixth power. Therefore, first, an index of effective coefficient sign information candidates is prepared as 0 to 63, and a binary notation of this index is defined as a sign information candidate for each effective coefficient.

- the sign information candidate of each effective coefficient is defined as positive if the value is 0 and negative if it is 1.

- the effective coefficient sign information candidate index 2200 associated with the generated 64 effective coefficient sign information candidates 2201 is output to the quantized coefficient provisional value generation unit 2071.

- the index of the effective coefficient sign information candidate indicating the correct code is 8.

- FIG. 23 is a diagram illustrating a processing example of the quantization coefficient provisional value generation unit 2071 according to the fourth embodiment.

- the effective coefficient absolute value information corresponding to each effective coefficient position information is quantized by setting each code of effective coefficient sign information candidate 2201 of FIG. 22 corresponding to effective coefficient sign information candidate index 2200 as a coefficient.

- a process for generating a coefficient provisional value is described. For example, for the effective coefficient sign information candidate index 0, a positive coefficient is generated as a provisional value of quantized coefficients. Further, when the candidate index is 13, the coefficients of the effective coefficient position information 2, 3, and 9 are set as positive, and when the effective coefficient position information is 1, 10, and 7, the negative sign is set.

- FIG. 24 is a diagram illustrating a processing example of the boundary pixel prediction error provisional value generation unit 2072, the prediction error coincidence calculation unit 2073, and the maximum likelihood coefficient sign information determination unit 2042 in the fourth embodiment.

- the boundary pixel prediction error provisional value generation unit 2072 performs inverse quantization equivalent to that used in normal encoding for the quantization coefficient provisional values 2400a to 2400n generated for each effective coefficient sign information candidate. Apply reverse transformation.

- coefficients having original codes are set for coefficients that do not use the effective coefficient sign information prediction values of the effective coefficient position information 5 and 4 shown in FIG.

- boundary pixels are selected from the inversely converted values, and boundary pixel prediction error provisional values 2401a to 2401n are generated.

- the reason why the calculation is not equivalent but equivalent is that this calculation does not necessarily require high accuracy, and an operation with reduced calculation accuracy may be substituted to reduce the amount of calculation.

- the boundary pixel prediction error provisional values 2401a to 2401n, the boundary pixel prediction error estimated value generated by the boundary pixel prediction error estimation unit 1511, and Differences 2402a to 2402n are generated, and the cost values 2403a to 2403n obtained by squaring and adding these values squared are used as the degree of coincidence.

- the maximum likelihood coefficient sign information determination unit 2042 totals the degree of coincidence (square error cost) 2403a to 2403n for each effective coefficient sign information candidate and determines the effective coefficient corresponding to the effective coefficient sign information candidate index that gives the minimum cost.

- Coefficient sign information is output as an effective coefficient sign information prediction value. That is, the absolute value of the effective coefficient is reduced from the effective coefficient (nonzero element in the quantized coefficient block) of the frequency coefficient corresponding to the difference (prediction error) between the encoding target block and the encoded block prediction image.

- an effective coefficient sign information candidate whose effective coefficient sign information candidate index is 13 is output as an effective coefficient sign information prediction value.

- FIG. 25 is a diagram illustrating the effective coefficient sign information prediction encoding unit 1923 according to the fourth embodiment.

- the effective coefficient sign information that does not use the effective coefficient sign information prediction value that is, encodes sign information with a fixed length

- the switch 2501 based on the fixed-length encoded sign information index.

- the effective coefficient sign information is encoded by the effective coefficient sign information fixed length encoding unit 2503 with a fixed length using information of 1 bit per coefficient. For example, a 1-bit code of “0” is assigned to positive sign information and a “1” is assigned to negative sign information. In the case of the coefficients shown in FIG.

- the sign predicted value match information generation unit 2500 uses the effective coefficient sign information predicted value and the effective coefficient sign. Generates match information indicating whether the information matches.

- the effective coefficient sign information entropy coding unit 2502 entropy codes the matching information.

- FIG. 26 is a diagram for explaining the processing of the sign predicted value match information generation unit 2500 in the fourth embodiment.

- the upper part represents the position information of the effective coefficient

- the lower part represents the effective coefficient sign information, the effective coefficient sign information prediction value, and the sign prediction value match information corresponding to the effective coefficient position information.

- each effective coefficient it is determined for each effective coefficient whether the effective coefficient sign information 2601 of the six effective coefficients selected matches the effective coefficient sign information prediction value 2600.

- “1” is output as sign predicted value match information 2602. Since the effective coefficients are arranged in descending order of the expected prediction accuracy of the effective coefficient sign information prediction value 2600, the first order coefficient matches both, and the latter order coefficient decreases. For this reason, it is expected that the probability of “match” symbols is higher in the first half.

- “match” is 0 and “mismatch” is 1.

- FIG. 27 is a diagram illustrating an effective coefficient sign information entropy encoding unit 2502 according to the fourth embodiment.

- the order is rearranged in absolute value order, and the sign information predicted value match information is encoded in the rearranged order in comparison with the encoding of the sign predicted value match information 2602 of the selected coefficient. That is, in the fourth embodiment, as shown in the sine predicted value match information in FIG. 26, 0, 0, 0, which is the sine predicted value match information of the coefficient positions 2, 3, 1, 10, 8, and 7.

- Encoding is performed in the order of 1, 0, 1, and a sine prediction value match information entropy code 2700 is generated.

- an arithmetic code 1 (2701) and an arithmetic code 2 (2702) are prepared.

- the arithmetic code 1 is an optimal code when the probability (match probability) of the matching symbol “0” is 0.8 and the probability of the non-matching symbol “1” is 0.2

- the arithmetic code 2 is the matching symbol “0”. Is the optimal arithmetic coding method when the probability (match probability) is 0.6 and the probability of the mismatch symbol “1” is 0.4.

- the arithmetic unit 1 switches between the arithmetic code 1 and the arithmetic code 2 in a determination unit 2703 that determines whether or not there is a non-matching symbol before encoding the sign prediction value match information.

- arithmetic code a general arithmetic code described in Non-Patent Document 2 can be used.

- an arithmetic coding method in which the probability table is updated every time a symbol is coded such as CABAC used in the moving picture coding international standard ITU-T H.264.

- the first effective coefficient 2 is encoded in order with arithmetic code 1. As long as the previous sign prediction value match information is “match”, that is, “0”, encoding is performed with arithmetic code 1. When the sign prediction value match information of the effective coefficient immediately before becomes “mismatch”, that is, “1”, all sign prediction value match information after the next is encoded using the arithmetic code 2. In the case of FIG. 28, the arithmetic code 1 is used for the first effective coefficient (the position of the effective coefficient is 2).

- the encoder uses the arithmetic code 1. Since the sign prediction value match information with the effective coefficient position of 10 encoded as the position of the effective coefficient immediately before the code of 8 is “mismatch” “1”, the sign information with the effective coefficient positions of 8 and 9 is used. The predicted value match information is encoded with the arithmetic code 2.

- the sine prediction value match information is “mismatch”, that is, “matches” with “1” after the prediction coefficient whose prediction is off. ", That is, based on the fact that the probability of occurrence of" 0 "tends to be equal.

- step S2903 it is checked whether the variable State is 1 or not.

- the i-th sign predicted value match information S [i] is encoded with the arithmetic code 1 in step S2904.

- step S2905 it is determined whether S [i] is “match” or “not match”. Only in the case of “mismatch”, the state variable State is set to 2 in step S2907.

- step S2903 If it is determined in step S2903 that the State is not 1, that is, 2, the i-th sign predicted value match information S [i] is encoded with the arithmetic code 2 in step S2906.

- step S2903 it is determined whether the counter i is larger than n. If the counter i is larger, the encoding is terminated. Otherwise, the process proceeds to step S2903.

- FIG. 30 is a diagram for explaining an embodiment in which encoded block entropy encoded data 3000 is generated by combining effective coefficient position code 3001, effective coefficient absolute value code 3002, and effective coefficient sign code 3005.

- the effective coefficient sign information prediction unit 1924 in FIG. 19 generates a fixed-length encoding index from effective coefficient position information and effective coefficient absolute value information, and then generates fixed-length encoding sign information, An effective coefficient sign information predicted value is generated from the effective coefficient position information, the effective coefficient absolute value information, and the boundary pixel prediction error estimated value. For this reason, in order to generate the fixed-length coding index and the effective coefficient sign information prediction value on the decoding device side as well, there is a restriction on the code order.

- the effective coefficient position code 3001 and the effective coefficient absolute value code 3002 exist before the effective coefficient sign code 3005 so that the fixed-length coding index and the effective coefficient sign information prediction value can be generated on the decoding device side. It only has to be.

- the encoded block entropy encoded data according to the fourth embodiment includes effective coefficient position information 3001 having effective coefficient position information and effective coefficient absolute value information values as shown in FIG. 30, effective coefficients. It consists of an absolute value code 3002, sign information “1” and “0” of effective coefficient positions 5 and 4 encoded with a fixed length code 3003, and a sign prediction value match information entropy code 3005. Further, the sine prediction value match information entropy code 3005 includes match information “0”, “0”, “0”, “1” of the effective coefficient positions 2, 3, 1, and 10 encoded by the arithmetic code 1. It consists of coincidence information “0”, “1” of effective coefficient positions 8 and 7 encoded with arithmetic code 2.

- FIG. 31 is a diagram showing a decoding device based on the fifth embodiment.

- the fifth embodiment shown in FIG. 31 includes a quantization coefficient decoding unit 3107, a boundary pixel prediction error estimation unit 3111, and a boundary pixel prediction value generation unit 3110 based on the second embodiment shown in FIG. Further details will be disclosed.

- the processing units 3107, 3111, and 3110 correspond to the processing units 1107, 1111, and 1110 having the same names in FIG. In FIG. 31, each processing unit having the same name as in FIG. 11 executes the same processing as in FIG.

- the decoding apparatus of the fifth embodiment decodes the encoded block entropy encoded data 3000 of FIG. 30 generated by the encoding apparatus of the fourth embodiment of FIG. This is equivalent to the block described in the fourth embodiment.

- the inverse quantization unit, the inverse transform unit, the decoded image generation unit, and the encoded block predicted image generation unit are respectively the inverse quantization unit and the inverse transform unit described in the fourth embodiment of FIG.

- the local decoded image generation unit, the encoded block prediction image generation unit, the boundary pixel prediction value generation unit, and the boundary pixel prediction error estimation unit are the same. Therefore, the example of operation

- movement of each part is also equivalent to 4th Embodiment.

- the locally decoded image described in the fourth embodiment is replaced with a decoded image in the fifth embodiment. This is because each part described above is called a so-called local decoder, and is the same in the encoding device and the decoding device.

- the configurations and operation examples of the boundary pixel prediction value generation unit 3110 and the boundary pixel prediction error estimation unit 3111 are the same as those in the fourth embodiment.

- a general decoding device in FIG. 11 and a quantized coefficient decoding unit 3107 different from the fourth embodiment in FIG. 15 will be described.

- FIG. 32 is a diagram illustrating a quantized coefficient decoding unit 3107 according to the fifth embodiment.

- the operation will be described through a process of decoding the encoded block entropy encoded data 3000 of FIG. 30 according to the fourth embodiment.

- effective coefficient position information decoding section 3231 takes out effective coefficient position code 3001 from encoded block entropy encoded data 3000 and decodes effective coefficient position information that is the frequency position of the effective coefficient of the encoded block. As a result, from FIG. 30, as the effective coefficient position, 1, 2, 3, 4, 5, 7, 9, 10 Get. At the same time, the number of effective coefficients (8) is also acquired.

- effective coefficient absolute value information decoding section 3232 extracts effective coefficient absolute value code 3002 from encoded block entropy encoded data 3000 and decodes effective coefficient absolute value information that is the absolute value of the effective coefficient of the encoded block. .

- effective coefficient absolute value information 2,3,2,1,1,1,1,1 Get.

- the effective coefficient sign information prediction unit 1924 first generates a fixed-length encoded sign information index.

- an effective coefficient sign information prediction unit 1924 that is exactly the same as in the fourth embodiment is used. This is because it is necessary to generate exactly the same effective coefficient sign information prediction value in the encoding device and the decoding device. Therefore, description of the operation of the effective coefficient sign information prediction unit 1924 is omitted.

- the effective coefficient sign information prediction unit 1924 receives the effective coefficient position information and the effective coefficient absolute value information, and has 5, as the fixed-length encoded sign information index. 4 Is output.

- FIG. 33 is a diagram illustrating the effective coefficient sign information prediction decoding unit 3233 according to the fifth embodiment.

- the effective coefficient sign information fixed length code 3003 is selected by the switch 3301 according to the fixed length code sign information index, and is decoded by the effective coefficient sign information fixed length decoding unit 3303.

- the sign predicted value match information entropy code 3004 is selected by the switch 3301 according to the fixed-length code sign information index. Then, in the sign prediction value match information entropy decoding unit 3300, the sign prediction value match information entropy code 3004 is decoded, and as the sign prediction value match information, 0, 0, 0, 1, 0, 1 Get.

- the sign information reproduction unit 3302 compares the effective coefficient sign information predicted value with the coincidence information to generate valid coefficient sign information “0, 0, 0, 1, 0, 1”. As a result, the effective coefficient sign information 3703 corresponding to FIG. 6 is decoded.

- the effective coefficient sign information prediction value 3701 “0, 0.1, 1, 0, 1” is generated by the effective coefficient sign information prediction unit 1924 shown in FIG.

- the effective coefficient sine information prediction unit 1924 obtains the first value from the fixed-length encoded sine information obtained by the effective coefficient sine information fixed-length decoding unit 3303 and the boundary pixel prediction error estimation value generated by the boundary pixel prediction error estimation unit 3111.

- the effective coefficient sign information prediction value is generated by the same method as described with reference to FIGS.

- the boundary pixel prediction error estimation value input to the effective coefficient sign information prediction unit is the same method as that described in the fourth embodiment with reference to FIGS. 16 to 18 in the boundary pixel prediction error estimation unit 3111. Is generated.

- FIG. 34 is a diagram showing a sine prediction value match information entropy decoding unit 3300 in the fifth embodiment, and corresponds to the sine prediction value match information entropy encoding unit 3502 in the fourth embodiment of FIG. .

- the sine prediction value match information entropy encoding unit includes arithmetic decoding 1 (3401) and arithmetic decoding 2 (3402) corresponding to arithmetic code 1 (2701) and arithmetic code 2 (2072), respectively.

- Arithmetic decoding 1 is designed to be most efficient when the probability of a “match” symbol is 0.8

- arithmetic decoding 2 is designed to be most efficient when the probability of a “match” symbol is 0.6. is there.

- the selection method of arithmetic decoding 1 and arithmetic decoding 2 is the same as that of the sign prediction value match information entropy encoding unit 2502 in the fourth embodiment. This operation will be described with reference to FIG.

- the first effective coefficient position is decoded in order from the arithmetic coefficient 1 to obtain sign prediction value match information.

- the sign prediction value match information decoded immediately before is “match”, that is, “0”

- decoding is performed by arithmetic decoding 1.

- the sign prediction value match information of the effective coefficient decoded immediately before becomes “mismatch”, that is, “1”, all the sign prediction value match information entropy codes after that use arithmetic decoding 2.