KR20200068258A - 차량용 센서퓨전 타겟 예측 장치 및 그의 센서 퓨전 타겟 예측 방법과 그를 포함하는 차량 - Google Patents

차량용 센서퓨전 타겟 예측 장치 및 그의 센서 퓨전 타겟 예측 방법과 그를 포함하는 차량 Download PDFInfo

- Publication number

- KR20200068258A KR20200068258A KR1020180155005A KR20180155005A KR20200068258A KR 20200068258 A KR20200068258 A KR 20200068258A KR 1020180155005 A KR1020180155005 A KR 1020180155005A KR 20180155005 A KR20180155005 A KR 20180155005A KR 20200068258 A KR20200068258 A KR 20200068258A

- Authority

- KR

- South Korea

- Prior art keywords

- information

- learning

- sensor fusion

- prediction

- fusion target

- Prior art date

Links

Images

Classifications

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W40/00—Estimation or calculation of non-directly measurable driving parameters for road vehicle drive control systems not related to the control of a particular sub unit, e.g. by using mathematical models

- B60W40/02—Estimation or calculation of non-directly measurable driving parameters for road vehicle drive control systems not related to the control of a particular sub unit, e.g. by using mathematical models related to ambient conditions

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W50/00—Details of control systems for road vehicle drive control not related to the control of a particular sub-unit, e.g. process diagnostic or vehicle driver interfaces

- B60W50/0097—Predicting future conditions

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R21/00—Arrangements or fittings on vehicles for protecting or preventing injuries to occupants or pedestrians in case of accidents or other traffic risks

- B60R21/01—Electrical circuits for triggering passive safety arrangements, e.g. airbags, safety belt tighteners, in case of vehicle accidents or impending vehicle accidents

- B60R21/013—Electrical circuits for triggering passive safety arrangements, e.g. airbags, safety belt tighteners, in case of vehicle accidents or impending vehicle accidents including means for detecting collisions, impending collisions or roll-over

- B60R21/0134—Electrical circuits for triggering passive safety arrangements, e.g. airbags, safety belt tighteners, in case of vehicle accidents or impending vehicle accidents including means for detecting collisions, impending collisions or roll-over responsive to imminent contact with an obstacle, e.g. using radar systems

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W30/00—Purposes of road vehicle drive control systems not related to the control of a particular sub-unit, e.g. of systems using conjoint control of vehicle sub-units, or advanced driver assistance systems for ensuring comfort, stability and safety or drive control systems for propelling or retarding the vehicle

- B60W30/08—Active safety systems predicting or avoiding probable or impending collision or attempting to minimise its consequences

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W40/00—Estimation or calculation of non-directly measurable driving parameters for road vehicle drive control systems not related to the control of a particular sub unit, e.g. by using mathematical models

- B60W40/02—Estimation or calculation of non-directly measurable driving parameters for road vehicle drive control systems not related to the control of a particular sub unit, e.g. by using mathematical models related to ambient conditions

- B60W40/06—Road conditions

- B60W40/072—Curvature of the road

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W40/00—Estimation or calculation of non-directly measurable driving parameters for road vehicle drive control systems not related to the control of a particular sub unit, e.g. by using mathematical models

- B60W40/10—Estimation or calculation of non-directly measurable driving parameters for road vehicle drive control systems not related to the control of a particular sub unit, e.g. by using mathematical models related to vehicle motion

- B60W40/105—Speed

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W40/00—Estimation or calculation of non-directly measurable driving parameters for road vehicle drive control systems not related to the control of a particular sub unit, e.g. by using mathematical models

- B60W40/10—Estimation or calculation of non-directly measurable driving parameters for road vehicle drive control systems not related to the control of a particular sub unit, e.g. by using mathematical models related to vehicle motion

- B60W40/114—Yaw movement

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B13/00—Adaptive control systems, i.e. systems automatically adjusting themselves to have a performance which is optimum according to some preassigned criterion

- G05B13/02—Adaptive control systems, i.e. systems automatically adjusting themselves to have a performance which is optimum according to some preassigned criterion electric

- G05B13/0265—Adaptive control systems, i.e. systems automatically adjusting themselves to have a performance which is optimum according to some preassigned criterion electric the criterion being a learning criterion

- G05B13/027—Adaptive control systems, i.e. systems automatically adjusting themselves to have a performance which is optimum according to some preassigned criterion electric the criterion being a learning criterion using neural networks only

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/25—Fusion techniques

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/044—Recurrent networks, e.g. Hopfield networks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/50—Context or environment of the image

- G06V20/56—Context or environment of the image exterior to a vehicle by using sensors mounted on the vehicle

- G06V20/588—Recognition of the road, e.g. of lane markings; Recognition of the vehicle driving pattern in relation to the road

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W2520/00—Input parameters relating to overall vehicle dynamics

- B60W2520/10—Longitudinal speed

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W2520/00—Input parameters relating to overall vehicle dynamics

- B60W2520/12—Lateral speed

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W2520/00—Input parameters relating to overall vehicle dynamics

- B60W2520/14—Yaw

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W2554/00—Input parameters relating to objects

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W2554/00—Input parameters relating to objects

- B60W2554/40—Dynamic objects, e.g. animals, windblown objects

- B60W2554/404—Characteristics

- B60W2554/4041—Position

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W2554/00—Input parameters relating to objects

- B60W2554/40—Dynamic objects, e.g. animals, windblown objects

- B60W2554/404—Characteristics

- B60W2554/4042—Longitudinal speed

Abstract

현재 측정값이 존재하지 않는 상황에서 예측값을 추정하여 센서퓨전 타겟의 위치 오차를 최소화할 수 있는 차량용 센서퓨전 타겟 예측 장치 및 그의 센서퓨전 타겟 예측 방법과 그를 포함하는 차량에 관한 것으로, 센서퓨전 타겟 정보를 수신하여 학습하는 학습부와, 현재 센서퓨전 타겟 정보가 수신되면 학습부로부터 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출하는 예측부와, 센서퓨전 타겟 정보의 수신 여부를 확인하고 센서퓨전 타겟 정보가 수신되지 않으면 예측부로부터 산출된 예측값으로 타겟을 추적하는 타겟 추적부를 포함할 수 있다.

Description

본 발명은 차량용 센서퓨전 타겟 예측 장치에 관한 것으로, 더욱 상세하게는 현재 측정값이 존재하지 않는 상황에서 예측값을 추정하여 센서퓨전 타겟의 위치 오차를 최소화할 수 있는 차량용 센서퓨전 타겟 예측 장치 및 그의 센서퓨전 타겟 예측 방법과 그를 포함하는 차량에 관한 것이다.

일반적으로, 차량에는 운전자 및 탑승자 보호와 운행 보조 및 승차감의 향상을 위한 다양한 시스템들이 탑재되고 있으며, 이러한 시스템들은 다양한 센서 및 정보통신기술을 활용하여 개량 발전되고 있다.

그 중에서도 카메라를 통한 영상 센서를 이용하여 차선을 인식하고 자동 조향을 수행하는 기술이 실용화되고 있다.

차량에 구비되는 영상 인식 처리장치는, 운행되는 도로 차선의 영상 정보와 후속 주행하는 차량에 관한 영상 정보 및 좌우 차선의 영상 정보를 검출한 후 표시수단을 통해 영상 정보를 디스플레이하여 운전자에게 편리한 차선의 인식과 운행되는 도로의 상황 및 주변 차량의 운행 정보를 제공할 수 있다.

또한, 최근에는 영상 센서 및 레이더를 통해 수집된 영상 정보 및 레이더 정보를 융합하여 필요한 정보를 추출해서 사용할 수 있는 센서 퓨전 시스템이 개발되고 있다.

이러한, 센서 퓨전 시스템은, 카메라를 이용하여 차선정보를 인식하고 차량의 자동 조향을 제어하는 자율주행시스템이나 차량의 스마트 크루즈 컨트롤 기능을 제공하기 위해 사용되고 있다.

하지만, 센서 퓨전 시스템은, 센서퓨전 타겟 추적 시에, 센서 이상 동작 또는 다른 센서퓨전 타겟에 가려져서 기존에 추적 중인 센서퓨전 타겟이 미감지될 경우에 위험한 상황에 처할 수 있다.

따라서, 센서 퓨전 시스템은, 센서 이상 동작 또는 다른 센서퓨전 타겟에 가려져서 기존에 추적 중인 센서퓨전 타겟이 미감지될 경우에도, 센서퓨전 타겟을 일정 시간 동안 유지시켜야 하는데, 이 때에는, 센서에서 측정되는 현재의 측정값이 없기 때문에 예측으로만 센서퓨전 타겟의 정보가 갱신될 수 있다.

센서 퓨전 시스템은, 필터를 이용한 센서퓨전 타겟을 예측할 수 있는데, 기본적으로 등속/등가속도 모델을 이용하여 센서퓨전 타겟의 다음 거동을 예측할 수 있다.

하지만, 센서 퓨전 시스템은, 센서에서 측정되는 측정값이 없을 시, 타겟 위치의 예측값에 오차가 발생할 수 있다.

특히, 도로가 회전 구간의 경우에, 도로가 회전 구간임을 알지 못하고 예측값을 산출하므로, 예측 위치에 도로의 회전 구간 정보가 반영되지 못하여 실제 도로에서 예측값의 위치 오차가 더 크게 발생할 수 있다.

따라서, 향후 타겟의 예측값에 대한 신뢰도를 향상시키고, 예측값의 오차를 최소화할 수 있는 차량용 센서퓨전 타겟 예측 장치의 개발이 요구되고 있다.

본 발명은 학습부로부터 학습된 파라미터를 기반으로 현재 센서퓨전 타겟에 대한 예측값을 산출함으로써, 예측값에 대한 신뢰도를 향상시키고 예측값에 대한 오차를 최소화할 수 있는 차량용 센서퓨전 타겟 예측 장치 및 그의 센서 퓨전 타겟 예측 방법과 그를 포함하는 차량을 제공하는데 있다.

본 발명에서 이루고자 하는 기술적 과제들은 이상에서 언급한 기술적 과제들로 제한되지 않으며, 언급하지 않은 또 다른 기술적 과제들은 아래의 기재로부터 본 발명이 속하는 기술분야에서 통상의 지식을 가진 자에게 명확하게 이해될 수 있을 것이다.

상기와 같은 기술적 과제를 해결하기 위하여, 본 발명의 일 실시예에 따른 차량용 센서퓨전 타겟 예측 장치는, 센서퓨전 타겟 정보를 수신하여 학습하는 학습부와, 현재 센서퓨전 타겟 정보가 수신되면 학습부로부터 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출하는 예측부와, 센서퓨전 타겟 정보의 수신 여부를 확인하고 센서퓨전 타겟 정보가 수신되지 않으면 예측부로부터 산출된 예측값으로 타겟을 추적하는 타겟 추적부를 포함할 수 있다.

또한, 본 발명 일 실시예에 따른 차량용 센서퓨전 타겟 예측 장치의 센서퓨전 타겟 예측 방법은, 센서퓨전 타겟 정보를 수신하는 단계와, 수신한 센서퓨전 타겟 정보를 학습하는 단계와, 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출하는 단계와, 센서퓨전 타겟의 수신 여부를 확인하는 단계와, 센서퓨전 타겟 정보가 수신되지 않으면 산출된 예측값으로 타겟을 추적하는 단계를 포함할 수 있다.

또한, 본 발명의 일 실시예에 따른 차량용 센서퓨전 타겟 예측 장치의 센서퓨전 타겟 예측 방법을 실행시키기 위한 프로그램을 기록한 컴퓨터로 읽을 수 있는 기록매체는, 상기 센서퓨전 타겟 예측 방법에서 제공된 과정을 수행할 수 있다.

한편, 본 발명의 일 실시예에 따른 차량은, 타겟의 거동을 센싱하는 센서 퓨전 장치와, 센서 퓨전 장치에 통신 연결되어 타겟의 거동을 예측하는 센서퓨전 타겟 예측 장치를 포함하고, 센서퓨전 타겟 예측 장치는, 센서퓨전 타겟 정보를 수신하여 학습하는 학습부와, 현재 센서퓨전 타겟 정보가 수신되면 학습부로부터 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출하는 예측부와, 센서퓨전 타겟 정보의 수신 여부를 확인하고, 센서퓨전 타겟 정보가 수신되지 않으면 예측부로부터 산출된 예측값으로 타겟을 추적하는 타겟 추적부를 포함할 수 있다.

상기와 같이 구성되는 본 발명의 적어도 하나의 실시예에 관련된 차량용 센서퓨전 타겟 예측 장치 및 그의 센서 퓨전 타겟 예측 방법과 그를 포함하는 차량은, 학습부로부터 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출함으로써, 예측값에 대한 신뢰도를 향상시키고 예측값에 대한 오차를 최소화할 수 있는 효과를 제공한다.

즉, 기존의 예측값 선정 방법은, 타겟의 이전 속도/가속도만을 이용했지만, 본 발명은, RNN(Recurrent Neural Network)을 통하여 정해진 일정한 과거 스텝의 추이를 확인하여 다음 스텝의 값을 예측함으로써, 이전 스텝만을 사용하는 것과는 다르게 과거 스텝의 추이 확인에 따라 예측값의 정확도를 향상시킬 수 있다.

이처럼, 본 발명은, RNN을 이용하여, 현재 측정값이 존재 하지 않을 때 예측값을 추정하고, 신뢰도를 판단하여 센서퓨전 타겟의 위치 오차를 실제 위치와 대비하여 최소로 줄일 수 있다.

본 발명에서 얻을 수 있는 효과는 이상에서 언급한 효과들로 제한되지 않으며, 언급하지 않은 또 다른 효과들은 아래의 기재로부터 본 발명이 속하는 기술분야에서 통상의 지식을 가진 자에게 명확하게 이해될 수 있을 것이다.

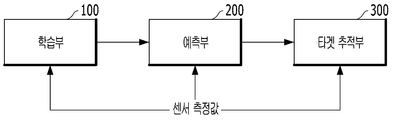

도 1은 본 발명의 일 실시예에 따른 차량용 센서퓨전 타겟 예측 장치를 설명하기 위한 블럭 구성도이다.

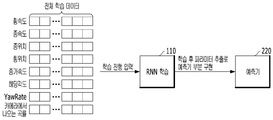

도 2는 도 1의 센서퓨전 타겟 예측 과정을 설명하기 위한 도면이다.

도 3은 도 2의 학습 과정을 설명하기 위한 도면이다.

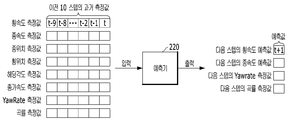

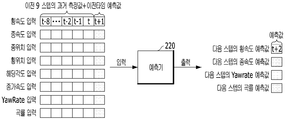

도 4 및 도 5는 도 2의 예측 과정을 설명하기 위한 도면이다.

도 6은 본 발명의 일 실시예에 따른 센서퓨전 타겟 예측 방법을 설명하기 위한 흐름도이다.

도 2는 도 1의 센서퓨전 타겟 예측 과정을 설명하기 위한 도면이다.

도 3은 도 2의 학습 과정을 설명하기 위한 도면이다.

도 4 및 도 5는 도 2의 예측 과정을 설명하기 위한 도면이다.

도 6은 본 발명의 일 실시예에 따른 센서퓨전 타겟 예측 방법을 설명하기 위한 흐름도이다.

아래에서는 첨부한 도면을 참고로 하여 본 발명의 실시 예에 대하여 본 발명이 속하는 기술 분야에서 통상의 지식을 가진 자가 용이하게 실시할 수 있도록 상세히 설명한다. 그러나 본 발명은 여러 가지 상이한 형태로 구현될 수 있으며 여기에서 설명하는 실시 예에 한정되지 않는다. 그리고 도면에서 본 발명을 명확하게 설명하기 위해서 설명과 관계없는 부분은 생략하였으며, 명세서 전체를 통하여 유사한 부분에 대해서는 유사한 도면 부호를 붙였다.

명세서 전체에서, 어떤 부분이 어떤 구성요소를 "포함"한다고 할 때, 이는 특별히 반대되는 기재가 없는 한 다른 구성요소를 제외하는 것이 아니라 다른 구성 요소를 더 포함할 수 있는 것을 의미한다. 또한, 명세서에 기재된 "…부", "…기", "모듈" 등의 용어는 적어도 하나의 기능이나 동작을 처리하는 단위를 의미하며, 이는 하드웨어나 소프트웨어 또는 하드웨어 및 소프트웨어의 결합으로 구현될 수 있다.

명세서 전체에서, 어떤 부분이 어떤 구성요소를 "포함"한다고 할 때, 이는 특별히 반대되는 기재가 없는 한 다른 구성요소를 제외하는 것이 아니라 다른 구성 요소를 더 포함할 수 있는 것을 의미한다. 또한, 명세서 전체에 걸쳐서 동일한 참조번호로 표시된 부분들은 동일한 구성요소들을 의미한다.

이하, 도 1 내지 도 6을 참조하여 본 발명의 실시예들에 적용될 수 있는 차량용 센서퓨전 타겟 예측 장치 및 그의 센서퓨전 타겟 예측 방법과 그를 포함하는 차량에 대해 상세히 설명한다.

도 1은 본 발명의 일 실시예에 따른 차량용 센서퓨전 타겟 예측 장치를 설명하기 위한 블럭 구성도이고,

도 1에 도시된 바와 같이, 본 발명의 차량용 센서퓨전 타겟 예측 장치는, 학습부(100), 예측부(200), 그리고 타겟 추적부(300)를 포함할 수 있다.

학습부(100)는, 센서퓨전 타겟 정보를 수신하여 학습할 수 있다.

그리고, 학습부(100)는, 센서퓨전 타겟 정보를 수신할 때, 타겟에 대한 횡 속도 정보, 종 속도 정보, 횡 위치 정보, 종 위치 정보, 헤딩 각도 정보, 종가속도 정보, 자차의 요레이트(yawrate) 정보, 도로 곡률 정보 중 적어도 어느 하나를 수신할 수 있다.

여기서, 학습부(100)는, 도로 곡률 정보를 수신할 때, 자차의 전방 카메라로부터 수신할 수 있다.

이어, 학습부(100)는, 센서퓨전 타겟 정보를 수신하면 수신한 센서퓨전 타겟 정보를 학습 항목별로 분류하고, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습할 수 있다.

여기서, 학습부(100)는, 수신한 센서퓨전 타겟 정보를 학습 항목별로 분류할 때, 횡 속도 정보를 학습하기 위한 제1 학습 항목, 종 속도 정보를 학습하기 위한 제2 학습 항목, 횡 위치 정보를 학습하기 위한 제3 학습 항목, 종 위치 정보를 학습하기 위한 제4 학습 항목, 헤딩 각도 정보를 학습하기 위한 제5 학습 항목, 종가속도 정보를 학습하기 위한 제6 학습 항목, 자차의 요레이트(yawrate) 정보를 학습하기 위한 제7 학습 항목, 도로 곡률 정보를 학습하기 위한 제8 학습 항목으로 분류할 수 있다.

또한, 학습부(100)는, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습할 때, 각 학습 항목에 상응하는 정보를 측정 시점마다 누적하여 연속적으로 학습할 수 있다.

여기서, 학습부(100)는, 각 학습 항목에 상응하는 정보를 측정 시점마다 누적하여 연속적으로 학습할 때, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-n (n은 자연수)까지 측정된 다수의 정보를 누적하여 학습할 수 있다.

일 예로, 학습부(100)는, 각 학습 항목에 상응하는 정보를 측정 시점마다 누적하여 연속적으로 학습할 때, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-9까지 측정된 10개 정보를 누적하여 학습할 수 있다.

그리고, 학습부(100)는, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습할 때, RNN(Recurrent Neural Network) 학습 방법을 토대로 학습을 수행할 수 있다.

다음, 예측부(200)는, 현재 센서퓨전 타겟 정보가 수신되면 학습부(100)로부터 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출할 수 있다.

예측부(200)는, 현재 센서퓨전 타겟 정보가 수신되면 수신한 현재 센서퓨전 타겟 정보를 예측 항목별로 분류하고, 각 예측 항목에 상응하는 학습 정보를 학습부로부터 수신하며, 수신한 학습 정보를 토대로 현재 측정 시점 t 이후의 다음 측정 시점 t+1에 대한 제1 예측값을 산출할 수 있다.

여기서, 예측부(200)는, 수신한 현재 센서퓨전 타겟 정보를 예측 항목별로 분류할 때, 횡 속도 정보를 예측하기 위한 제1 예측 항목, 종 속도 정보를 예측하기 위한 제2 예측 항목, 횡 위치 정보를 예측하기 위한 제3 예측 항목, 종 위치 정보를 예측하기 위한 제4 예측 항목, 헤딩 각도 정보를 예측하기 위한 제5 예측 항목, 종가속도 정보를 예측하기 위한 제6 예측 항목, 자차의 요레이트(yawrate) 정보를 예측하기 위한 제7 예측 항목, 도로 곡률 정보를 예측하기 위한 제8 예측 항목으로 분류할 수 있다.

이어, 예측부(200)는, 각 예측 항목에 상응하는 학습 정보를 학습부(100)로부터 수신할 때, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-n (n은 자연수)까지 측정된 다수의 정보들을 누적하여 학습한 학습 정보를 수신할 수 있다.

일 예로, 예측부(200)는, 각 예측 항목에 상응하는 학습 정보를 학습부(100)로부터 수신할 때, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-9까지 측정된 10개 정보를 누적하여 학습한 학습 정보를 수신할 수 있다.

그리고, 예측부(200)는, 제1 예측값을 산출할 때, 분류된 예측 항목에 상응하는 제1 예측값을 산출할 수 있다.

다음, 예측부(200)는, 현재 측정 시점 t 이후의 다음 측정 시점 t+1에 대한 제1 예측값을 산출하면 산출된 제1 예측값 및 제1 예측값에 상응하는 학습 정보를 토대로 다음 측정 시점 t+2에 대한 제2 예측값을 산출할 수 있다.

여기서, 제1 예측값에 상응하는 학습 정보는, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-n (n은 자연수)까지 측정된 정보를 포함하는 학습 정보일 수 있다.

일 예로, 제1 예측값에 상응하는 학습 정보는, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-8까지 측정된 9개 정보를 포함하는 학습 정보일 수 있다.

그리고, 예측부(200)는, 제2 예측값을 산출할 때, 제1 예측값이 산출된 이후에 현재 센서퓨전 타겟 정보가 수신되지 않으면 다음 측정 시점 t+2에 대한 제2 예측값을 산출할 수 있다.

여기서, 예측부(200)는, 제2 예측값을 산출할 때, 제1 예측값이 산출된 이후에 현재 센서퓨전 타겟 정보가 현재 측정 시점 t 이후의 다음 측정 시점 t+1 및 t+2에 연속적으로 수신되지 않으면 다음 측정 시점 t+2에 대한 제2 예측값을 산출할 수 있다.

다음, 타겟 추적부(300)는, 센서퓨전 타겟 정보의 수신 여부를 확인하고, 상기 센서퓨전 타겟 정보가 수신되지 않으면 예측부(200)로부터 산출된 예측값으로 타겟을 추적할 수 있다.

여기서, 타겟 추적부(300)는, 센서퓨전 타겟 정보의 수신 여부를 확인할 때, 센서퓨전 타겟 정보가 수신되면 수신한 센서퓨전 타겟 정보를 토대로 타겟을 추적할 수 있다.

이와 같이, 본 발명은, 학습부로부터 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출함으로써, 예측값에 대한 신뢰도를 향상시키고 예측값에 대한 오차를 최소화할 수 있다.

즉, 기존의 예측값 선정 방법은, 타겟의 이전 속도/가속도만을 이용했지만, 본 발명은, RNN(Recurrent Neural Network)을 통하여 정해진 일정한 과거 스텝의 추이를 확인하여 다음 스텝의 값을 예측함으로써, 이전 스텝만을 사용하는 것과는 다르게 과거 스텝의 추이 확인에 따라 예측값의 정확도를 향상시킬 수 있다.

이처럼, 본 발명은, RNN을 이용하여, 현재 측정값이 존재 하지 않을 때 예측값을 추정하고, 신뢰도를 판단하여 센서퓨전 타겟의 위치 오차를 실제 위치와 대비하여 최소로 줄일 수 있다.

도 2는 도 1의 센서퓨전 타겟 예측 과정을 설명하기 위한 도면이고, 도 3은 도 2의 학습 과정을 설명하기 위한 도면이며, 도 4 및 도 5는 도 2의 예측 과정을 설명하기 위한 도면이다.

도 2 및 도 3에 도시된 바와 같이, 본 발명의 학습부(100)는, 센서퓨전 타겟 정보를 수신하여 학습할 수 있다.

즉, 학습부(100)는, 과거 10스텝의 센서퓨전 타겟의 횡/종 위치 ,횡/종속도, 자차 요레이트(YawRate), 종가속도, 헤딩각도, 도로 곡률 정보를 RNN(Recurrent Neural Network)으로 학습할 수 있다(110).

그리고, 학습부(100)는, 타겟에 대한 횡 속도 정보, 종 속도 정보, 횡 위치 정보, 종 위치 정보, 헤딩 각도 정보, 종가속도 정보, 자차의 요레이트(yawrate) 정보, 도로 곡률 정보 중 적어도 어느 하나를 포함하는 센서퓨전 타겟 정보를 수신할 수 있다.

이때, 학습부(100)는, 자차의 전방 카메라로부터 도로 곡률 정보를 수신할 수 있다.

그리고, 학습부(100)는, 센서퓨전 타겟 정보를 수신하면 수신한 센서퓨전 타겟 정보를 학습 항목별로 분류하고, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습할 수 있다(110).

여기서, 학습부(100)는, 수신한 센서퓨전 타겟 정보를 학습 항목별로 분류할 때, 횡 속도 정보를 학습하기 위한 제1 학습 항목, 종 속도 정보를 학습하기 위한 제2 학습 항목, 횡 위치 정보를 학습하기 위한 제3 학습 항목, 종 위치 정보를 학습하기 위한 제4 학습 항목, 헤딩 각도 정보를 학습하기 위한 제5 학습 항목, 종가속도 정보를 학습하기 위한 제6 학습 항목, 자차의 요레이트(yawrate) 정보를 학습하기 위한 제7 학습 항목, 도로 곡률 정보를 학습하기 위한 제8 학습 항목으로 분류할 수 있다.

또한, 학습부(100)는, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습할 때, 각 학습 항목에 상응하는 정보를 측정 시점마다 누적하여 연속적으로 학습할 수 있다.

여기서, 학습부(100)는, 각 학습 항목에 상응하는 정보를 측정 시점마다 누적하여 연속적으로 학습할 때, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-n (n은 자연수)까지 측정된 다수의 정보를 누적하여 학습할 수 있다.

일 예로, 학습부(100)는, 각 학습 항목에 상응하는 정보를 측정 시점마다 누적하여 연속적으로 학습할 때, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-9까지 측정된 10개 정보를 누적하여 학습할 수 있다.

그리고, 학습부(100)는, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습할 때, RNN(Recurrent Neural Network) 학습 방법을 토대로 학습을 수행할 수 있다.

이처럼, 학습부(100)는, 센서퓨전 타겟의 횡/종 위치, 횡/종 속도, 종가속도, 헤딩각도, 자차의 요레이트(Yawrate), 전방 카메라 센서의 곡률(Curvature) 정보를 RNN으로 학습할 수 있으며, 학습 진행 시, RNN의 내부 파라미터 중에서, 센서퓨전 타겟의 과거 10스텝의 데이터를 기준으로 학습하는 파라미터를 세팅할 수 있다.

도 2, 도 4 및 도 5에 도시된 바와 같이, 본 발명의 예측부(200)는, 현재 센서퓨전 타겟 정보가 수신되면 학습부(100)로부터 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출할 수 있다.

즉, 예측부(200)는, 학습 부분에서 학습된 파라미터를 기반으로, 현재 센서퓨전 타겟의 횡/종 속도, 종가속도, 헤딩각도, 자차의 요레이트(Yawrate), 전방 카메라 센서의 곡률(Curvature) 입력으로 예측값을 출력할 수 있다.

예측부(200)는, 현재 자차의 요레이트, 타겟의 횡/종 위치, 횡/종속도, 종가속도, 헤딩각도, 도로의 곡률 정보를 포함하는 현재 센서퓨전 타겟 정보를 수신할 수 있다(210).

다음, 예측부(200)는, 현재 센서퓨전 타겟 정보가 수신되면 수신한 현재 센서퓨전 타겟 정보를 예측 항목별로 분류하고, 각 예측 항목에 상응하는 학습 정보를 학습부로부터 수신하며, 수신한 학습 정보를 토대로 현재 측정 시점 t 이후의 다음 측정 시점 t+1에 대한 제1 예측값을 산출할 수 있다(220, 230).

즉, 예측부(200)는, 과거 10 스텝의 측정값들을 예측기에 입력하여 다음 스텝의 예측값을 출력으로 얻을 수 있다.

여기서, 예측부(200)는, 수신한 현재 센서퓨전 타겟 정보를 예측 항목별로 분류할 때, 횡 속도 정보를 예측하기 위한 제1 예측 항목, 종 속도 정보를 예측하기 위한 제2 예측 항목, 횡 위치 정보를 예측하기 위한 제3 예측 항목, 종 위치 정보를 예측하기 위한 제4 예측 항목, 헤딩 각도 정보를 예측하기 위한 제5 예측 항목, 종가속도 정보를 예측하기 위한 제6 예측 항목, 자차의 요레이트(yawrate) 정보를 예측하기 위한 제7 예측 항목, 도로 곡률 정보를 예측하기 위한 제8 예측 항목으로 분류할 수 있다.

이어, 예측부(200)는, 각 예측 항목에 상응하는 학습 정보를 학습부(100)로부터 수신할 때, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-n (n은 자연수)까지 측정된 다수의 정보들을 누적하여 학습한 학습 정보를 수신할 수 있다.

일 예로, 예측부(200)는, 각 예측 항목에 상응하는 학습 정보를 학습부(100)로부터 수신할 때, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-9까지 측정된 10개 정보를 누적하여 학습한 학습 정보를 수신할 수 있다.

그리고, 예측부(200)는, 제1 예측값을 산출할 때, 분류된 예측 항목에 상응하는 제1 예측값을 산출할 수 있다.

다음, 예측부(200)는, 현재 측정 시점 t 이후의 다음 측정 시점 t+1에 대한 제1 예측값을 산출하면 산출된 제1 예측값 및 제1 예측값에 상응하는 학습 정보를 토대로 다음 측정 시점 t+2에 대한 제2 예측값을 산출할 수 있다.

즉, 예측부(200)는, 2 스텝(step) 이상의 센서에서 측정값이 없는 경우, 이전 타임에서 예측된 예측값과 그 이전의 9 스텝(step)의 데이터를 입력으로 다음 타임의 예측을 진행할 수 있다.

여기서, 제1 예측값에 상응하는 학습 정보는, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-n (n은 자연수)까지 측정된 정보를 포함하는 학습 정보일 수 있다.

일 예로, 제1 예측값에 상응하는 학습 정보는, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-8까지 측정된 9개 정보를 포함하는 학습 정보일 수 있다.

그리고, 예측부(200)는, 제2 예측값을 산출할 때, 제1 예측값이 산출된 이후에 현재 센서퓨전 타겟 정보가 수신되지 않으면 다음 측정 시점 t+2에 대한 제2 예측값을 산출할 수 있다.

여기서, 예측부(200)는, 제2 예측값을 산출할 때, 제1 예측값이 산출된 이후에 현재 센서퓨전 타겟 정보가 현재 측정 시점 t 이후의 다음 측정 시점 t+1 및 t+2에 연속적으로 수신되지 않으면 다음 측정 시점 t+2에 대한 제2 예측값을 산출할 수 있다.

도 6은 본 발명의 일 실시예에 따른 센서퓨전 타겟 예측 방법을 설명하기 위한 흐름도이다.

도 6에 도시된 바와 같이, 본 발명은, 센서퓨전 타겟 정보를 수신할 수 있다(S10).

여기서, 본 발명은, 타겟에 대한 횡 속도 정보, 종 속도 정보, 횡 위치 정보, 종 위치 정보, 헤딩 각도 정보, 종가속도 정보, 자차의 요레이트(yawrate) 정보, 도로 곡률 정보 중 적어도 어느 하나를 포함하는 센서퓨전 타겟을 수신할 수 있다.

그리고, 본 발명은, 수신한 센서퓨전 타겟 정보를 학습할 수 있다(S20).

본 발명에서, 수신한 센서퓨전 타겟 정보를 학습하는 단계는, 수신한 센서퓨전 타겟 정보를 학습 항목별로 분류하는 단계와, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습하는 단계를 포함할 수 있다.

여기서, 수신한 센서퓨전 타겟 정보를 학습 항목별로 분류하는 단계는, 횡 속도 정보를 학습하기 위한 제1 학습 항목, 종 속도 정보를 학습하기 위한 제2 학습 항목, 횡 위치 정보를 학습하기 위한 제3 학습 항목, 종 위치 정보를 학습하기 위한 제4 학습 항목, 헤딩 각도 정보를 학습하기 위한 제5 학습 항목, 종가속도 정보를 학습하기 위한 제6 학습 항목, 자차의 요레이트(yawrate) 정보를 학습하기 위한 제7 학습 항목, 도로 곡률 정보를 학습하기 위한 제8 학습 항목으로 분류할 수 있다.

그리고, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습하는 단계는, 각 학습 항목에 상응하는 정보를 측정 시점마다 누적하여 연속적으로 학습할 수 있다.

즉, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습하는 단계는, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-n (n은 자연수)까지 측정된 다수의 정보를 누적하여 학습할 수 있다.

일 예로, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습하는 단계는, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-9까지 측정된 10개 정보를 누적하여 학습할 수 있다.

일 예로, 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습하는 단계는, RNN(Recurrent Neural Network) 학습 방법을 토대로 학습을 수행할 수 있다.

이어, 본 발명은, 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출할 수 있다(S30).

본 발명에서, 현재 센서퓨전 타겟 정보에 대한 예측값을 산출하는 단계는, 현재 센서퓨전 타겟 정보를 수신하는 단계와, 수신한 현재 센서퓨전 타겟 정보를 예측 항목별로 분류하는 단계와, 각 예측 항목에 상응하는 학습 정보를 수신하는 단계와, 수신한 학습 정보를 토대로 현재 측정 시점 t 이후의 다음 측정 시점 t+1에 대한 제1 예측값을 산출하는 단계를 포함할 수 있다.

여기서, 수신한 현재 센서퓨전 타겟을 예측 항목별로 분류하는 단계는, 횡 속도 정보를 예측하기 위한 제1 예측 항목, 종 속도 정보를 예측하기 위한 제2 예측 항목, 횡 위치 정보를 예측하기 위한 제3 예측 항목, 종 위치 정보를 예측하기 위한 제4 예측 항목, 헤딩 각도 정보를 예측하기 위한 제5 예측 항목, 종가속도 정보를 예측하기 위한 제6 예측 항목, 자차의 요레이트(yawrate) 정보를 예측하기 위한 제7 예측 항목, 도로 곡률 정보를 예측하기 위한 제8 예측 항목으로 분류할 수 있다.

그리고, 각 예측 항목에 상응하는 학습 정보를 수신하는 단계는, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-n (n은 자연수)까지 측정된 다수의 정보들을 누적하여 학습한 학습 정보를 수신할 수 있다.

일 예로, 각 예측 항목에 상응하는 학습 정보를 수신하는 단계는, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-9까지 측정된 10개 정보를 누적하여 학습한 학습 정보를 수신할 수 있다.

이어, 제1 예측값을 산출하는 단계는, 분류된 예측 항목에 상응하는 제1 예측값을 산출할 수 있다.

또한, 제1 예측값을 산출하는 단계는, 현재 측정 시점 t 이후의 다음 측정 시점 t+1에 대한 제1 예측값이 산출되면 산출된 제1 예측값 및 제1 예측값에 상응하는 학습 정보를 토대로 다음 측정 시점 t+2에 대한 제2 예측값을 산출하는 단계를 더 포함할 수 있다.

여기서, 제1 예측값에 상응하는 학습 정보는, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-n (n은 자연수)까지 측정된 정보를 포함하는 학습 정보일 수 있다.

일 예로, 제1 예측값에 상응하는 학습 정보는, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-8까지 측정된 9개 정보를 포함하는 학습 정보일 수 있다.

그리고, 제2 예측값을 산출하는 단계는, 제1 예측값이 산출된 이후에 현재 센서퓨전 타겟 정보가 수신되지 않으면 다음 측정 시점 t+2에 대한 제2 예측값을 산출할 수 있다.

일 예로, 제2 예측값을 산출하는 단계는, 제1 예측값이 산출된 이후에 현재 센서퓨전 타겟 정보가 현재 측정 시점 t 이후의 다음 측정 시점 t+1 및 t+2에 연속적으로 수신되지 않으면 다음 측정 시점 t+2에 대한 제2 예측값을 산출할 수 있다.

다음, 본 발명은, 센서퓨전 타겟 정보의 수신 여부를 확인할 수 있다(S40).

그리고, 본 발명은, 센서퓨전 타겟 정보가 수신되지 않으면 산출된 예측값으로 타겟을 추적할 수 있다(S50).

또한, 본 발명은, 센서퓨전 타겟 정보의 수신 여부를 확인하는 단계에서, 센서퓨전 타겟 정보가 수신되면 수신된 센서퓨전 타겟 정보를 토대로 타겟을 추적할 수 있다(S60).

또한, 본 발명은, 차량용 센서퓨전 타겟 예측 장치의 센서퓨전 타겟 예측 방법을 실행시키기 위한 프로그램을 기록한 컴퓨터로 읽을 수 있는 기록매체로서, 본 발명의 실시예에 따른 센서퓨전 타겟 예측 방법에서 제공된 과정을 수행할 수 있다.

한편, 본 발명의 일 실시예에 따른 차량은, 타겟의 거동을 센싱하는 센서 퓨전 장치와, 센서 퓨전 장치에 통신 연결되어 타겟의 거동을 예측하는 센서퓨전 타겟 예측 장치를 포함하고, 센서퓨전 타겟 예측 장치는, 센서퓨전 타겟 정보를 수신하여 학습하는 학습부와, 현재 센서퓨전 타겟 정보가 수신되면 학습부로부터 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출하는 예측부와, 센서퓨전 타겟 정보의 수신 여부를 확인하고, 센서퓨전 타겟 정보가 수신되지 않으면 예측부로부터 산출된 예측값으로 타겟을 추적하는 타겟 추적부를 포함할 수 있다.

이와 같이, 본 발명은, 학습부로부터 학습된 파라미터를 기반으로 현재 센서퓨전 타겟 정보에 대한 예측값을 산출함으로써, 예측값에 대한 신뢰도를 향상시키고 예측값에 대한 오차를 최소화할 수 있다.

즉, 기존의 예측값 선정 방법은, 타겟의 이전 속도/가속도만을 이용했지만, 본 발명은, RNN(Recurrent Neural Network)을 통하여 정해진 일정한 과거 스텝의 추이를 확인하여 다음 스텝의 값을 예측함으로써, 이전 스텝만을 사용하는 것과는 다르게 과거 스텝의 추이 확인에 따라 예측값의 정확도를 향상시킬 수 있다.

이처럼, 본 발명은, RNN을 이용하여, 현재 측정값이 존재 하지 않을 때 예측값을 추정하고, 신뢰도를 판단하여 센서퓨전 타겟의 위치 오차를 실제 위치와 대비하여 최소로 줄일 수 있다.

전술한 본 발명은, 프로그램이 기록된 매체에 컴퓨터가 읽을 수 있는 코드로서 구현하는 것이 가능하다. 컴퓨터가 읽을 수 있는 매체는, 컴퓨터 시스템에 의하여 읽혀질 수 있는 데이터가 저장되는 모든 종류의 기록장치를 포함한다. 컴퓨터가 읽을 수 있는 매체의 예로는, HDD(Hard Disk Drive), SSD(Solid State Disk), SDD(Silicon Disk Drive), ROM, RAM, CD-ROM, 자기 테이프, 플로피 디스크, 광 데이터 저장 장치 등이 있으며, 또한 캐리어 웨이브(예를 들어, 인터넷을 통한 전송)의 형태로 구현되는 것도 포함한다.

따라서, 상기의 상세한 설명은 모든 면에서 제한적으로 해석되어서는 아니되고 예시적인 것으로 고려되어야 한다. 본 발명의 범위는 첨부된 청구항의 합리적 해석에 의해 결정되어야 하고, 본 발명의 등가적 범위 내에서의 모든 변경은 본 발명의 범위에 포함된다.

100: 학습부

200: 예측부

300: 타겟 추적부

200: 예측부

300: 타겟 추적부

Claims (32)

- 센서퓨전 타겟 정보를 수신하여 학습하는 학습부;

현재 센서퓨전 타겟 정보가 수신되면 상기 학습부로부터 학습된 파라미터를 기반으로 상기 현재 센서퓨전 타겟 정보에 대한 예측값을 산출하는 예측부; 그리고,

상기 센서퓨전 타겟 정보의 수신 여부를 확인하고, 상기 센서퓨전 타겟 정보가 수신되지 않으면 상기 예측부로부터 산출된 예측값으로 타겟을 추적하는 타겟 추적부를 포함하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제1 항에 있어서, 상기 학습부는,

상기 센서퓨전 타겟 정보를 수신할 때, 상기 타겟에 대한 횡 속도 정보, 종 속도 정보, 횡 위치 정보, 종 위치 정보, 헤딩 각도 정보, 종가속도 정보, 자차의 요레이트(yawrate) 정보, 도로 곡률 정보 중 적어도 어느 하나를 수신하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제1 항에 있어서, 상기 학습부는,

상기 센서퓨전 타겟 정보를 수신하면 상기 수신한 센서퓨전 타겟 정보를 학습 항목별로 분류하고, 상기 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제3 항에 있어서, 상기 학습부는,

상기 수신한 센서퓨전 타겟 정보를 학습 항목별로 분류할 때, 횡 속도 정보를 학습하기 위한 제1 학습 항목, 종 속도 정보를 학습하기 위한 제2 학습 항목, 횡 위치 정보를 학습하기 위한 제3 학습 항목, 종 위치 정보를 학습하기 위한 제4 학습 항목, 헤딩 각도 정보를 학습하기 위한 제5 학습 항목, 종가속도 정보를 학습하기 위한 제6 학습 항목, 자차의 요레이트(yawrate) 정보를 학습하기 위한 제7 학습 항목, 도로 곡률 정보를 학습하기 위한 제8 학습 항목으로 분류하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제3 항에 있어서, 상기 학습부는,

상기 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습할 때, 상기 각 학습 항목에 상응하는 정보를 측정 시점마다 누적하여 연속적으로 학습하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제5 항에 있어서, 상기 학습부는,

상기 각 학습 항목에 상응하는 정보를 측정 시점마다 누적하여 연속적으로 학습할 때, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-9까지 측정된 10개 정보를 누적하여 학습하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제1 항에 있어서, 상기 예측부는,

상기 현재 센서퓨전 타겟 정보가 수신되면 상기 수신한 현재 센서퓨전 타겟 정보를 예측 항목별로 분류하고, 상기 각 예측 항목에 상응하는 학습 정보를 상기 학습부로부터 수신하며, 상기 수신한 학습 정보를 토대로 현재 측정 시점 t 이후의 다음 측정 시점 t+1에 대한 제1 예측값을 산출하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제7 항에 있어서, 상기 예측부는,

상기 수신한 현재 센서퓨전 타겟 정보를 예측 항목별로 분류할 때, 횡 속도 정보를 예측하기 위한 제1 예측 항목, 종 속도 정보를 예측하기 위한 제2 예측 항목, 횡 위치 정보를 예측하기 위한 제3 예측 항목, 종 위치 정보를 예측하기 위한 제4 예측 항목, 헤딩 각도 정보를 예측하기 위한 제5 예측 항목, 종가속도 정보를 예측하기 위한 제6 예측 항목, 자차의 요레이트(yawrate) 정보를 예측하기 위한 제7 예측 항목, 도로 곡률 정보를 예측하기 위한 제8 예측 항목으로 분류하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제7 항에 있어서, 상기 예측부는,

상기 각 예측 항목에 상응하는 학습 정보를 상기 학습부로부터 수신할 때, 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-9까지 측정된 10개 정보를 누적하여 학습한 학습 정보를 수신하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제7 항에 있어서, 상기 예측부는,

상기 제1 예측값을 산출할 때, 상기 분류된 예측 항목에 상응하는 제1 예측값을 산출하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제7 항에 있어서, 상기 예측부는,

상기 현재 측정 시점 t 이후의 다음 측정 시점 t+1에 대한 제1 예측값을 산출하면 상기 산출된 제1 예측값 및 상기 제1 예측값에 상응하는 학습 정보를 토대로 다음 측정 시점 t+2에 대한 제2 예측값을 산출하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제11 항에 있어서, 상기 제1 예측값에 상응하는 학습 정보는,

상기 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-8까지 측정된 9개 정보를 포함하는 학습 정보인 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제11 항에 있어서, 상기 예측부는,

상기 제2 예측값을 산출할 때, 상기 제1 예측값이 산출된 이후에 상기 현재 센서퓨전 타겟 정보가 수신되지 않으면 상기 다음 측정 시점 t+2에 대한 제2 예측값을 산출하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제11 항에 있어서, 상기 예측부는,

상기 제2 예측값을 산출할 때, 상기 제1 예측값이 산출된 이후에 상기 현재 센서퓨전 타겟 정보가 상기 현재 측정 시점 t 이후의 다음 측정 시점 t+1 및 t+2에 연속적으로 수신되지 않으면 상기 다음 측정 시점 t+2에 대한 제2 예측값을 산출하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 제1 항에 있어서, 상기 타겟 추적부는,

상기 센서퓨전 타겟 정보의 수신 여부를 확인할 때, 상기 센서퓨전 타겟 정보가 수신되면 상기 수신한 센서퓨전 타겟 정보를 토대로 상기 타겟을 추적하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 장치. - 센서퓨전 타겟 정보를 수신하는 단계;

상기 수신한 센서퓨전 타겟 정보를 학습하는 단계;

상기 학습된 파라미터를 기반으로 상기 현재 센서퓨전 타겟 정보에 대한 예측값을 산출하는 단계;

상기 센서퓨전 타겟 정보의 수신 여부를 확인하는 단계; 그리고,

상기 센서퓨전 타겟 정보가 수신되지 않으면 상기 산출된 예측값으로 타겟을 추적하는 단계를 포함하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제16 항에 있어서, 상기 센서퓨전 타겟 정보를 수신하는 단계는,

상기 타겟에 대한 횡 속도 정보, 종 속도 정보, 횡 위치 정보, 종 위치 정보, 헤딩 각도 정보, 종가속도 정보, 자차의 요레이트(yawrate) 정보, 도로 곡률 정보 중 적어도 어느 하나를 수신하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제16 항에 있어서, 상기 수신한 센서퓨전 타겟 정보를 학습하는 단계는,

상기 수신한 센서퓨전 타겟 정보를 학습 항목별로 분류하는 단계; 그리고,

상기 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습하는 단계를 포함하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제18 항에 있어서, 상기 수신한 센서퓨전 타겟 정보를 학습 항목별로 분류하는 단계는,

횡 속도 정보를 학습하기 위한 제1 학습 항목, 종 속도 정보를 학습하기 위한 제2 학습 항목, 횡 위치 정보를 학습하기 위한 제3 학습 항목, 종 위치 정보를 학습하기 위한 제4 학습 항목, 헤딩 각도 정보를 학습하기 위한 제5 학습 항목, 종가속도 정보를 학습하기 위한 제6 학습 항목, 자차의 요레이트(yawrate) 정보를 학습하기 위한 제7 학습 항목, 도로 곡률 정보를 학습하기 위한 제8 학습 항목으로 분류하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제18 항에 있어서, 상기 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습하는 단계는,

상기 각 학습 항목에 상응하는 정보를 측정 시점마다 누적하여 연속적으로 학습하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제18 항에 있어서, 상기 각 학습 항목에 상응하는 정보를 측정 시점에 따라 연속적으로 학습하는 단계는,

현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-9까지 측정된 10개 정보를 누적하여 학습하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제16 항에 있어서, 상기 현재 센서퓨전 타겟 정보에 대한 예측값을 산출하는 단계는,

상기 현재 센서퓨전 타겟 정보를 수신하는 단계;

상기 수신한 현재 센서퓨전 타겟 정보를 예측 항목별로 분류하는 단계;

상기 각 예측 항목에 상응하는 학습 정보를 수신하는 단계; 그리고,

상기 수신한 학습 정보를 토대로 현재 측정 시점 t 이후의 다음 측정 시점 t+1에 대한 제1 예측값을 산출하는 단계를 포함하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제22 항에 있어서, 상기 수신한 현재 센서퓨전 타겟을 예측 항목별로 분류하는 단계는,

횡 속도 정보를 예측하기 위한 제1 예측 항목, 종 속도 정보를 예측하기 위한 제2 예측 항목, 횡 위치 정보를 예측하기 위한 제3 예측 항목, 종 위치 정보를 예측하기 위한 제4 예측 항목, 헤딩 각도 정보를 예측하기 위한 제5 예측 항목, 종가속도 정보를 예측하기 위한 제6 예측 항목, 자차의 요레이트(yawrate) 정보를 예측하기 위한 제7 예측 항목, 도로 곡률 정보를 예측하기 위한 제8 예측 항목으로 분류하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제22 항에 있어서, 상기 각 예측 항목에 상응하는 학습 정보를 수신하는 단계는,

현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-9까지 측정된 10개 정보를 누적하여 학습한 학습 정보를 수신하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제22 항에 있어서, 상기 제1 예측값을 산출하는 단계는,

상기 분류된 예측 항목에 상응하는 제1 예측값을 산출하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제22 항에 있어서, 상기 제1 예측값을 산출하는 단계는,

상기 현재 측정 시점 t 이후의 다음 측정 시점 t+1에 대한 제1 예측값이 산출되면 상기 산출된 제1 예측값 및 상기 제1 예측값에 상응하는 학습 정보를 토대로 다음 측정 시점 t+2에 대한 제2 예측값을 산출하는 단계를 더 포함하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제26 항에 있어서, 상기 제1 예측값에 상응하는 학습 정보는,

상기 현재 측정 시점 t로부터 과거 측정 시점 t-1 ~ t-8까지 측정된 9개 정보를 포함하는 학습 정보인 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제26 항에 있어서, 상기 제2 예측값을 산출하는 단계는,

상기 제1 예측값이 산출된 이후에 상기 현재 센서퓨전 타겟 정보가 수신되지 않으면 상기 다음 측정 시점 t+2에 대한 제2 예측값을 산출하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제26 항에 있어서, 상기 제2 예측값을 산출하는 단계는,

상기 제1 예측값이 산출된 이후에 상기 현재 센서퓨전 타겟 정보가 상기 현재 측정 시점 t 이후의 다음 측정 시점 t+1 및 t+2에 연속적으로 수신되지 않으면 상기 다음 측정 시점 t+2에 대한 제2 예측값을 산출하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제16 항에 있어서, 상기 센서퓨전 타겟 정보의 수신 여부를 확인하는 단계는,

상기 센서퓨전 타겟 정보가 수신되면 상기 수신된 센서퓨전 타겟 정보를 토대로 상기 타겟을 추적하는 것을 특징으로 하는 차량용 센서퓨전 타겟 예측 방법. - 제16 항 내지 제30 항 중 어느 한 항에 기재된 방법을 실행시키기 위한 프로그램을 기록한 컴퓨터로 읽을 수 있는 기록매체.

- 타겟의 거동을 센싱하는 센서 퓨전 장치; 그리고,

상기 센서 퓨전 장치에 통신 연결되어 상기 타겟의 거동을 예측하는 센서퓨전 타겟 예측 장치를 포함하고,

상기 센서퓨전 타겟 예측 장치는,

센서퓨전 타겟 정보를 수신하여 학습하는 학습부;

현재 센서퓨전 타겟 정보가 수신되면 상기 학습부로부터 학습된 파라미터를 기반으로 상기 현재 센서퓨전 타겟 정보에 대한 예측값을 산출하는 예측부; 그리고,

상기 센서퓨전 타겟 정보의 수신 여부를 확인하고, 상기 센서퓨전 타겟 정보가 수신되지 않으면 상기 예측부로부터 산출된 예측값으로 타겟을 추적하는 타겟 추적부를 포함하는 것을 특징으로 하는 차량.

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020180155005A KR102592830B1 (ko) | 2018-12-05 | 2018-12-05 | 차량용 센서퓨전 타겟 예측 장치 및 그의 센서 퓨전 타겟 예측 방법과 그를 포함하는 차량 |

| US16/525,973 US11748593B2 (en) | 2018-12-05 | 2019-07-30 | Sensor fusion target prediction device and method for vehicles and vehicle including the device |

| CN201910769834.1A CN111267860A (zh) | 2018-12-05 | 2019-08-20 | 用于车辆的传感器融合目标预测装置和方法、以及车辆 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020180155005A KR102592830B1 (ko) | 2018-12-05 | 2018-12-05 | 차량용 센서퓨전 타겟 예측 장치 및 그의 센서 퓨전 타겟 예측 방법과 그를 포함하는 차량 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| KR20200068258A true KR20200068258A (ko) | 2020-06-15 |

| KR102592830B1 KR102592830B1 (ko) | 2023-10-23 |

Family

ID=70972449

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020180155005A KR102592830B1 (ko) | 2018-12-05 | 2018-12-05 | 차량용 센서퓨전 타겟 예측 장치 및 그의 센서 퓨전 타겟 예측 방법과 그를 포함하는 차량 |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US11748593B2 (ko) |

| KR (1) | KR102592830B1 (ko) |

| CN (1) | CN111267860A (ko) |

Families Citing this family (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP4012603B1 (en) * | 2020-12-10 | 2023-12-06 | Aptiv Technologies Limited | Method for classifying a tracked object |

| KR20220131646A (ko) * | 2021-03-22 | 2022-09-29 | 현대자동차주식회사 | 객체 추적 방법과 장치 및 이 방법을 실행하기 위한 프로그램을 기록한 기록 매체 |

| CN114084129A (zh) * | 2021-10-13 | 2022-02-25 | 武汉光庭信息技术股份有限公司 | 一种基于融合的车辆自动驾驶控制方法及系统 |

| CN115588184A (zh) * | 2022-10-28 | 2023-01-10 | 摩尔线程智能科技(北京)有限责任公司 | 检测目标行驶装置的方法和装置 |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP5063851B2 (ja) * | 2000-08-16 | 2012-10-31 | ヴァレオ・レイダー・システムズ・インコーポレーテッド | 近接物体検出システム |

| KR20170114054A (ko) * | 2016-04-01 | 2017-10-13 | 주식회사 만도 | 충돌방지장치 및 충돌방지방법 |

| KR20170117723A (ko) * | 2016-04-14 | 2017-10-24 | 국방과학연구소 | 특징 기반 다중 센서 정보 융합 장치 및 방법 |

| JP2018173816A (ja) * | 2017-03-31 | 2018-11-08 | パナソニックIpマネジメント株式会社 | 運転支援方法およびそれを利用した運転支援装置、自動運転制御装置、車両、プログラム、運転支援システム |

Family Cites Families (16)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4510739B2 (ja) | 2005-09-29 | 2010-07-28 | 富士重工業株式会社 | 車両挙動推定予測装置および車両安定化制御システム |

| JP2011118755A (ja) * | 2009-12-04 | 2011-06-16 | Sony Corp | 学習装置、学習方法、およびプログラム |

| US9650043B2 (en) * | 2015-04-30 | 2017-05-16 | GM Global Technology Operations LLC | Real-time anticipatory speed control |

| US9711050B2 (en) * | 2015-06-05 | 2017-07-18 | Bao Tran | Smart vehicle |

| US9815462B2 (en) * | 2015-08-27 | 2017-11-14 | Toyota Motor Engineering & Manufacturing North America, Inc. | Path determination for automated vehicles |

| KR101813697B1 (ko) | 2015-12-22 | 2017-12-29 | 한국항공대학교산학협력단 | 딥 러닝을 이용한 무인기 비행 제어 시스템 및 방법 |

| US10410113B2 (en) | 2016-01-14 | 2019-09-10 | Preferred Networks, Inc. | Time series data adaptation and sensor fusion systems, methods, and apparatus |

| JP2017174244A (ja) | 2016-03-25 | 2017-09-28 | 株式会社日立製作所 | 情報提供装置 |

| US9760806B1 (en) * | 2016-05-11 | 2017-09-12 | TCL Research America Inc. | Method and system for vision-centric deep-learning-based road situation analysis |

| US11120353B2 (en) | 2016-08-16 | 2021-09-14 | Toyota Jidosha Kabushiki Kaisha | Efficient driver action prediction system based on temporal fusion of sensor data using deep (bidirectional) recurrent neural network |

| KR101864860B1 (ko) | 2016-09-13 | 2018-06-05 | 오토시맨틱스 주식회사 | 딥러닝을 통한 자동차 상태 진단 방법 |

| KR102072757B1 (ko) * | 2017-10-31 | 2020-02-03 | 국방과학연구소 | 딥 러닝을 이용한 이종 센서 정보 융합 장치 및 방법 |

| CN108573270B (zh) * | 2017-12-15 | 2020-04-28 | 上海蔚来汽车有限公司 | 使多传感器目标信息融合与多传感器感测同步的方法及装置、计算机设备和记录介质 |

| US20190050729A1 (en) * | 2018-03-26 | 2019-02-14 | Intel Corporation | Deep learning solutions for safe, legal, and/or efficient autonomous driving |

| US11592818B2 (en) * | 2018-06-20 | 2023-02-28 | Zoox, Inc. | Restricted multi-scale inference for machine learning |

| CN109829386B (zh) * | 2019-01-04 | 2020-12-11 | 清华大学 | 基于多源信息融合的智能车辆可通行区域检测方法 |

-

2018

- 2018-12-05 KR KR1020180155005A patent/KR102592830B1/ko active IP Right Grant

-

2019

- 2019-07-30 US US16/525,973 patent/US11748593B2/en active Active

- 2019-08-20 CN CN201910769834.1A patent/CN111267860A/zh active Pending

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP5063851B2 (ja) * | 2000-08-16 | 2012-10-31 | ヴァレオ・レイダー・システムズ・インコーポレーテッド | 近接物体検出システム |

| KR20170114054A (ko) * | 2016-04-01 | 2017-10-13 | 주식회사 만도 | 충돌방지장치 및 충돌방지방법 |

| KR20170117723A (ko) * | 2016-04-14 | 2017-10-24 | 국방과학연구소 | 특징 기반 다중 센서 정보 융합 장치 및 방법 |

| JP2018173816A (ja) * | 2017-03-31 | 2018-11-08 | パナソニックIpマネジメント株式会社 | 運転支援方法およびそれを利用した運転支援装置、自動運転制御装置、車両、プログラム、運転支援システム |

Also Published As

| Publication number | Publication date |

|---|---|

| US11748593B2 (en) | 2023-09-05 |

| KR102592830B1 (ko) | 2023-10-23 |

| CN111267860A (zh) | 2020-06-12 |

| US20200180646A1 (en) | 2020-06-11 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR102592830B1 (ko) | 차량용 센서퓨전 타겟 예측 장치 및 그의 센서 퓨전 타겟 예측 방법과 그를 포함하는 차량 | |

| US10809735B2 (en) | System and method for a framework of robust and safe reinforcement learning application in real world autonomous vehicle application | |

| US11782158B2 (en) | Multi-stage object heading estimation | |

| US10564640B2 (en) | System and method for sensing the driving environment of a motor vehicle | |

| JP6838241B2 (ja) | 移動体挙動予測装置 | |

| KR102151814B1 (ko) | 레이더 센서 및 카메라를 이용한 객체 인식 방법 및 그를 위한 장치 | |

| KR102456626B1 (ko) | 자율 주행 차량의 차선 인지 방법 및 장치 | |

| CN108960083B (zh) | 基于多传感器信息融合的自动驾驶目标分类方法及系统 | |

| KR102570338B1 (ko) | 자동차의 환경에서 타겟 자동차의 궤적을 예측하기 위한 방법 및 시스템 | |

| CN110834642A (zh) | 车辆跑偏识别方法、装置、车辆及存储介质 | |

| US11893496B2 (en) | Method for recognizing objects in an environment of a vehicle | |

| KR20200067506A (ko) | 전방위 센서퓨전 장치 및 그의 센서퓨전 방법과 그를 포함하는 차량 | |

| CN114750759A (zh) | 一种跟车目标确定方法、装置、设备及介质 | |

| CN111352414A (zh) | 用于车辆的假目标移除装置和方法及包括该装置的车辆 | |

| CN111971725B (zh) | 用于确定车辆的变道说明的方法、可读存储介质以及车辆 | |

| CN114207627A (zh) | 用于路径规划系统的极端情况检测和收集 | |

| US20220198921A1 (en) | Data collection and modeling systems and methods for autonomous vehicles | |

| US20220383736A1 (en) | Method for estimating coverage of the area of traffic scenarios | |

| CN114475656A (zh) | 行驶轨迹预测方法、装置、电子设备以及存储介质 | |

| CN110497906B (zh) | 车辆控制方法、装置、设备和介质 | |

| CN112526525A (zh) | 对静态对象和动态对象的分类 | |

| CN111527497A (zh) | 用于运行具有至少一个用于检测自主车辆环境的环境传感器的自主车辆的驾驶员辅助系统的方法、计算机可读介质、系统和车辆 | |

| JPWO2020170301A1 (ja) | 情報処理装置、プログラム及び情報処理方法 | |

| KR102261155B1 (ko) | 가상 센서 이중화를 통한 차량 제어 방법 및 그 장치 | |

| US11555913B2 (en) | Object recognition device and object recognition method |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination | ||

| E902 | Notification of reason for refusal | ||

| E902 | Notification of reason for refusal | ||

| E701 | Decision to grant or registration of patent right | ||

| GRNT | Written decision to grant |