KR20170053280A - 복수의 전자장치 사이에서 가상 객체를 표시하는 방법 및 이를 지원하는 전자 장치 - Google Patents

복수의 전자장치 사이에서 가상 객체를 표시하는 방법 및 이를 지원하는 전자 장치 Download PDFInfo

- Publication number

- KR20170053280A KR20170053280A KR1020150155577A KR20150155577A KR20170053280A KR 20170053280 A KR20170053280 A KR 20170053280A KR 1020150155577 A KR1020150155577 A KR 1020150155577A KR 20150155577 A KR20150155577 A KR 20150155577A KR 20170053280 A KR20170053280 A KR 20170053280A

- Authority

- KR

- South Korea

- Prior art keywords

- screen

- electronic device

- application

- external device

- virtual

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T19/00—Manipulating 3D models or images for computer graphics

- G06T19/006—Mixed reality

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G06F3/1454—Digital output to display device ; Cooperation and interconnection of the display device with other functional units involving copying of the display data of a local workstation or window to a remote workstation or window so that an actual copy of the data is displayed simultaneously on two or more displays, e.g. teledisplay

- G06F3/1462—Digital output to display device ; Cooperation and interconnection of the display device with other functional units involving copying of the display data of a local workstation or window to a remote workstation or window so that an actual copy of the data is displayed simultaneously on two or more displays, e.g. teledisplay with means for detecting differences between the image stored in the host and the images displayed on the remote displays

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/033—Pointing devices displaced or positioned by the user, e.g. mice, trackballs, pens or joysticks; Accessories therefor

- G06F3/0346—Pointing devices displaced or positioned by the user, e.g. mice, trackballs, pens or joysticks; Accessories therefor with detection of the device orientation or free movement in a 3D space, e.g. 3D mice, 6-DOF [six degrees of freedom] pointers using gyroscopes, accelerometers or tilt-sensors

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G06F3/1423—Digital output to display device ; Cooperation and interconnection of the display device with other functional units controlling a plurality of local displays, e.g. CRT and flat panel display

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G06F3/1423—Digital output to display device ; Cooperation and interconnection of the display device with other functional units controlling a plurality of local displays, e.g. CRT and flat panel display

- G06F3/1438—Digital output to display device ; Cooperation and interconnection of the display device with other functional units controlling a plurality of local displays, e.g. CRT and flat panel display using more than one graphics controller

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G06F3/1454—Digital output to display device ; Cooperation and interconnection of the display device with other functional units involving copying of the display data of a local workstation or window to a remote workstation or window so that an actual copy of the data is displayed simultaneously on two or more displays, e.g. teledisplay

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G06F3/147—Digital output to display device ; Cooperation and interconnection of the display device with other functional units using display panels

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G3/00—Control arrangements or circuits, of interest only in connection with visual indicators other than cathode-ray tubes

- G09G3/001—Control arrangements or circuits, of interest only in connection with visual indicators other than cathode-ray tubes using specific devices not provided for in groups G09G3/02 - G09G3/36, e.g. using an intermediate record carrier such as a film slide; Projection systems; Display of non-alphanumerical information, solely or in combination with alphanumerical information, e.g. digital display on projected diapositive as background

- G09G3/002—Control arrangements or circuits, of interest only in connection with visual indicators other than cathode-ray tubes using specific devices not provided for in groups G09G3/02 - G09G3/36, e.g. using an intermediate record carrier such as a film slide; Projection systems; Display of non-alphanumerical information, solely or in combination with alphanumerical information, e.g. digital display on projected diapositive as background to project the image of a two-dimensional display, such as an array of light emitting or modulating elements or a CRT

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G5/00—Control arrangements or circuits for visual indicators common to cathode-ray tube indicators and other visual indicators

- G09G5/12—Synchronisation between the display unit and other units, e.g. other display units, video-disc players

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2370/00—Aspects of data communication

- G09G2370/02—Networking aspects

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2370/00—Aspects of data communication

- G09G2370/02—Networking aspects

- G09G2370/022—Centralised management of display operation, e.g. in a server instead of locally

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2370/00—Aspects of data communication

- G09G2370/12—Use of DVI or HDMI protocol in interfaces along the display data pipeline

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2370/00—Aspects of data communication

- G09G2370/16—Use of wireless transmission of display information

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- General Engineering & Computer Science (AREA)

- Human Computer Interaction (AREA)

- Computer Hardware Design (AREA)

- Computer Graphics (AREA)

- Software Systems (AREA)

- Multimedia (AREA)

- User Interface Of Digital Computer (AREA)

Abstract

본 발명은 전자 장치에 있어서, 통신부 및 상기 통신부와 전기적으로 연결된 프로세서를 포함하고, 상기 프로세서는, 적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신하고, 상기 적어도 하나의 외부 장치의 어플리케이션을 표시하기 위한 기준이 되는 스크린의 외형을 인식하고, 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역에, 상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시하도록 설정된 전자 장치를 포함할 수 있다. 다만, 상기 실시예에 한정되지 않고 다른 실시예를 포함할 수 있다.

Description

본 발명은 복수의 전자 장치 사이에서 가상 객체를 표시하는 방법 및 이를 지원하는 전자 장치에 관한 것이다.

기술이 발전함에 따라, 전자 장치(예: 스마트 폰)와 근거리 무선 통신으로 연결 되는 착용 가능한 전자 장치(예: 스마트 시계, 스마트 밴드)가 시장에 선보이고 있다. 이러한 착용 가능한 전자 장치를 통해 각종 알림 서비스, 콜(call) 서비스, 이메일/SNS 확인 기능, 운동량 측정 서비스 등을 통해 사용자에게 새로운 경험을 제공해 주고 있다. 착용 가능한 전자장치의 형태에는 머리 장착 형 디스플레이(예: Head-mounted display), 스마트 안경 (smart glasses), 스마트 시계 또는 밴드(smart watch, wristband), 콘텍트 렌즈 형 장치, 반지 형 장치, 신발 형 장치, 의복 형 장치, 장갑형 장치 등 인체의 일부 또는 의복에 탈 부착 가능한 다양한 형태일 수 있다.

전자 장치 디스플레이의 해상도 증가와 연산속도의 증가, 그래픽 처리 장치의 성능 향상으로 인해, 과거 대형기기에서만 동작하던 가상현실 디스플레이 장치가 최근 소형화, 경량화 되고 있다. 예를 들면, 전자 장치의 사용자는 기존 3D TV에서만 보는 3D영상들도 소형화된 가상현실 디스플레이 장치를 통해 접할 수 있게 되었고, 과거 활용성이 낮았던 360도 파노라마 영상들도 가상현실 디스플레이 장치를 통해 접할 수 있게 되었다. 전자 장치의 사용자는 기존 PC의 모니터나 스마트폰 화면에서 느끼지 못했던 임장감을 HMD장비의 가속도 센서를 통해 머리의 움직임을 센싱함으로써 HMD장비에서는 임장감을 느낄 수 있게 되었다.

복수의 전자 장치를 사용하는 사용자는 각각의 전자 장치에 포함된 어플리케이션을 독립적으로 이용한다. 다만, 각 전자 장치의 어플리케이션의 호환성 또는 동기화가 떨어짐에 따라 일 전자 장치를 사용하고 있는 사용자는 다른 전자 장치에서 문자 메시지를 수신하거나 통화가 오는 등 새로운 이벤트가 발생하는 경우 해당 전자 장치에서만 이를 개별적으로 확인해야 하는 불편함이 존재한다.

또한, 복수의 전자 장치들의 스크린 크기는 개별적으로 상이함에도, 각각의 전자 장치를 구성하는 하드웨어적 구성(예: 스크린의 크기, 지원 해상도 등)에 기반하여 각 어플리케이션을 수행할 수 밖에 없는 한계점이 존재한다.

이에 후술할 실시예는 가상 객체를 표시하는 방법 및 이를 지원하는 전자 장치에 있다.

본 발명의 일 실시예에 따른 전자 장치에 있어서,

통신부 및 상기 통신부와 전기적으로 연결된 프로세서를 포함하고, 상기 프로세서는, 적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신하고, 상기 적어도 하나의 외부 장치의 어플리케이션을 표시하기 위한 기준이 되는 스크린의 외형을 인식하고, 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역에, 상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시하도록 설정된 전자 장치를 포함할 수 있다.

본 발명의 일 실시예에 따른 가상 객체를 표시하는 전자 장치의 어플리케이션 표시 방법에 있어서, 적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신하는 동작, 상기 적어도 하나의 외부 장치의 어플리케이션을 표시하기 위한 기준이 되는 스크린의 외형을 인식하는 동작, 및 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역에, 상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시하는 동작을 포함할 수 있다.

본 발명의 다양한 실시예에 따르면, 전자 장치가 일 외부 장치의 스크린으로부터 설정된 거리 이내의 가상영역에 또 다른 외부 장치의 어플리케이션 관련 가상 객체를 표시함으로써, 사용자는 확장된 가상 스크린에 표시된 어플리케이션을 통해 보다 편리한 작업을 수행할 수 있다.

본 발명의 다양한 실시예에 따르면, 전자 장치가 또 다른 외부 장치의 이벤트(예: 문자 메시지 수신 등) 갱신 시, 표시 중인 가상 객체를 변경함으로써 사용자가 보다 편리한 작업을 수행할 수 있다.

본 발명의 다양한 실시예에 따르면, 전자 장치에 의해 표시되는 가상 객체를 일 외부 장치의 입력 장치를 통해 편집함으로써, 사용자가 보다 용이하게 관련 기능을 수행할 수 있다.

도 1은 본 발명의 다양한 실시예에 따른 네트워크 환경을 도시하는 블럭도이다.

도 2는 본 발명의 다양한 실시예에 따른 전자 장치의 블럭도를 도시한다.

도 3은 본 발명의 다양한 실시예에 따른 프로그램 모듈의 블록도를 도시한다.

도 4는 본 발명의 다양한 실시예에 따른 전자 장치와 제1 외부 장치, 제2 외부장치 및 서버의 연결을 도시한다.

도 5는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체의 표시를 도시한다.

도 6a 및 6b는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체의 표시를 도시한다.

도 7a 및 도 7b는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 확장 스크린을 도시한다.

도 8a 및 도 8b는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체의 표시를 도시한다.

도 9는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체의 표시를 도시한다.

도 10은 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체를 표시하는 순서도를 도시한다.

도 11은 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체를 표시하는 순서도를 도시한다.

도 12는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체를 표시하는 순서도를 도시한다.

도 2는 본 발명의 다양한 실시예에 따른 전자 장치의 블럭도를 도시한다.

도 3은 본 발명의 다양한 실시예에 따른 프로그램 모듈의 블록도를 도시한다.

도 4는 본 발명의 다양한 실시예에 따른 전자 장치와 제1 외부 장치, 제2 외부장치 및 서버의 연결을 도시한다.

도 5는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체의 표시를 도시한다.

도 6a 및 6b는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체의 표시를 도시한다.

도 7a 및 도 7b는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 확장 스크린을 도시한다.

도 8a 및 도 8b는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체의 표시를 도시한다.

도 9는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체의 표시를 도시한다.

도 10은 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체를 표시하는 순서도를 도시한다.

도 11은 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체를 표시하는 순서도를 도시한다.

도 12는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체를 표시하는 순서도를 도시한다.

이하, 본 문서의 다양한 실시예들이 첨부된 도면을 참조하여 기재된다. 실시예 및 이에 사용된 용어들은 본 문서에 기재된 기술을 특정한 실시 형태에 대해 한정하려는 것이 아니며, 해당 실시예의 다양한 변경, 균등물, 및/또는 대체물을 포함하는 것으로 이해되어야 한다. 도면의 설명과 관련하여, 유사한 구성요소에 대해서는 유사한 참조 부호가 사용될 수 있다. 단수의 표현은 문맥상 명백하게 다르게 뜻하지 않는 한, 복수의 표현을 포함할 수 있다. 본 문서에서, "A 또는 B" 또는 "A 및/또는 B 중 적어도 하나" 등의 표현은 함께 나열된 항목들의 모든 가능한 조합을 포함할 수 있다. "제 1," "제 2," "첫째," 또는 "둘째,"등의 표현들은 해당 구성요소들을, 순서 또는 중요도에 상관없이 수식할 수 있고, 한 구성요소를 다른 구성요소와 구분하기 위해 사용될 뿐 해당 구성요소들을 한정하지 않는다. 어떤(예: 제 1) 구성요소가 다른(예: 제 2) 구성요소에 "(기능적으로 또는 통신적으로) 연결되어" 있다거나 "접속되어" 있다고 언급된 때에는, 상기 어떤 구성요소가 상기 다른 구성요소에 직접적으로 연결되거나, 다른 구성요소(예: 제 3 구성요소)를 통하여 연결될 수 있다.

본 문서에서, "~하도록 구성된(또는 설정된)(configured to)"은 상황에 따라, 예를 들면, 하드웨어적 또는 소프트웨어적으로 "~에 적합한," "~하는 능력을 가지는," "~하도록 변경된," "~하도록 만들어진," "~를 할 수 있는," 또는 또는 "~하도록 설계된"과 상호 호환적으로(interchangeably) 사용될 수 있다. 어떤 상황에서는, "~하도록 구성된 장치"라는 표현은, 그 장치가 다른 장치 또는 부품들과 함께 "~할 수 있는" 것을 의미할 수 있다. 예를 들면, 문구 "A, B, 및 C를 수행하도록 구성된(또는 설정된) 프로세서"는 해당 동작을 수행하기 위한 전용 프로세서(예: 임베디드 프로세서), 또는 메모리 장치에 저장된 하나 이상의 소프트웨어 프로그램들을 실행함으로써, 해당 동작들을 수행할 수 있는 범용 프로세서(예: CPU 또는 application processor)를 의미할 수 있다.

본 문서의 다양한 실시예들에 따른 전자 장치는, 예를 들면, 스마트폰, 태블릿 PC, 이동 전화기, 영상 전화기, 전자책 리더기, 데스크탑 PC, 랩탑 PC, 넷북 컴퓨터, 워크스테이션, 서버, PDA, PMP(portable multimedia player), MP3 플레이어, 의료기기, 카메라, 또는 웨어러블 장치 중 적어도 하나를 포함할 수 있다. 웨어러블 장치는 액세서리형(예: 시계, 반지, 팔찌, 발찌, 목걸이, 안경, 콘택트 렌즈, 또는 머리 착용형 장치(head-mounted-device(HMD)), 직물 또는 의류 일체형(예: 전자 의복), 신체 부착형(예: 스킨 패드 또는 문신), 또는 생체 이식형 회로 중 적어도 하나를 포함할 수 있다. 어떤 실시예들에서, 전자 장치는, 예를 들면, 텔레비전, DVD(digital video disk) 플레이어, 오디오, 냉장고, 에어컨, 청소기, 오븐, 전자레인지, 세탁기, 공기 청정기, 셋톱 박스, 홈 오토매이션 컨트롤 패널, 보안 컨트롤 패널, 미디어 박스(예: 삼성 HomeSyncTM, 애플TVTM, 또는 구글 TVTM), 게임 콘솔(예: XboxTM, PlayStationTM), 전자 사전, 전자 키, 캠코더, 또는 전자 액자 중 적어도 하나를 포함할 수 있다.

다른 실시예에서, 전자 장치는, 각종 의료기기(예: 각종 휴대용 의료측정기기(혈당 측정기, 심박 측정기, 혈압 측정기, 또는 체온 측정기 등), MRA(magnetic resonance angiography), MRI(magnetic resonance imaging), CT(computed tomography), 촬영기, 또는 초음파기 등), 네비게이션 장치, 위성 항법 시스템(GNSS(global navigation satellite system)), EDR(event data recorder), FDR(flight data recorder), 자동차 인포테인먼트 장치, 선박용 전자 장비(예: 선박용 항법 장치, 자이로 콤파스 등), 항공 전자기기(avionics), 보안 기기, 차량용 헤드 유닛(head unit), 산업용 또는 가정용 로봇, 드론(drone), 금융 기관의 ATM, 상점의 POS(point of sales), 또는 사물 인터넷 장치 (예: 전구, 각종 센서, 스프링클러 장치, 화재 경보기, 온도조절기, 가로등, 토스터, 운동기구, 온수탱크, 히터, 보일러 등) 중 적어도 하나를 포함할 수 있다. 어떤 실시예에 따르면, 전자 장치는 가구, 건물/구조물 또는 자동차의 일부, 전자 보드(electronic board), 전자 사인 수신 장치(electronic signature receiving device), 프로젝터, 또는 각종 계측 기기(예: 수도, 전기, 가스, 또는 전파 계측 기기 등) 중 적어도 하나를 포함할 수 있다. 다양한 실시예에서, 전자 장치는 플렉서블하거나, 또는 전술한 다양한 장치들 중 둘 이상의 조합일 수 있다. 본 문서의 실시예에 따른 전자 장치는 전술한 기기들에 한정되지 않는다. 본 문서에서, 사용자라는 용어는 전자 장치를 사용하는 사람 또는 전자 장치를 사용하는 장치(예: 인공지능 전자 장치)를 지칭할 수 있다.

도 1을 참조하여, 다양한 실시예에서의, 네트워크 환경(100) 내의 전자 장치(101)가 기재된다. 전자 장치(101)는 버스(110), 프로세서(120), 메모리(130), 입출력 인터페이스(150), 디스플레이(160), 및 통신 인터페이스(170)를 포함할 수 있다. 어떤 실시예에서는, 전자 장치(101)는, 구성요소들 중 적어도 하나를 생략하거나 다른 구성요소를 추가적으로 구비할 수 있다. 버스(110)는 구성요소들(110-170)을 서로 연결하고, 구성요소들 간의 통신(예: 제어 메시지 또는 데이터)을 전달하는 회로를 포함할 수 있다. 프로세서(120)는, 중앙처리장치, 어플리케이션 프로세서, 또는 커뮤니케이션 프로세서(communication processor(CP)) 중 하나 또는 그 이상을 포함할 수 있다. 프로세서(120)는, 예를 들면, 전자 장치(101)의 적어도 하나의 다른 구성요소들의 제어 및/또는 통신에 관한 연산이나 데이터 처리를 실행할 수 있다.

메모리(130)는, 휘발성 및/또는 비휘발성 메모리를 포함할 수 있다. 메모리(130)는, 예를 들면, 전자 장치(101)의 적어도 하나의 다른 구성요소에 관계된 명령 또는 데이터를 저장할 수 있다. 한 실시예에 따르면, 메모리(130)는 소프트웨어 및/또는 프로그램(140)을 저장할 수 있다. 프로그램(140)은, 예를 들면, 커널(141), 미들웨어(143), 어플리케이션 프로그래밍 인터페이스(API)(145), 및/또는 어플리케이션 프로그램(또는 "어플리케이션")(147) 등을 포함할 수 있다. 커널(141), 미들웨어(143), 또는 API(145)의 적어도 일부는, 운영 시스템으로 지칭될 수 있다. 커널(141)은, 예를 들면, 다른 프로그램들(예: 미들웨어(143), API(145), 또는 어플리케이션 프로그램(147))에 구현된 동작 또는 기능을 실행하는 데 사용되는 시스템 리소스들(예: 버스(110), 프로세서(120), 또는 메모리(130) 등)을 제어 또는 관리할 수 있다. 또한, 커널(141)은 미들웨어(143), API(145), 또는 어플리케이션 프로그램(147)에서 전자 장치(101)의 개별 구성요소에 접근함으로써, 시스템 리소스들을 제어 또는 관리할 수 있는 인터페이스를 제공할 수 있다.

미들웨어(143)는, 예를 들면, API(145) 또는 어플리케이션 프로그램(147)이 커널(141)과 통신하여 데이터를 주고받을 수 있도록 중개 역할을 수행할 수 있다. 또한, 미들웨어(143)는 어플리케이션 프로그램(147)으로부터 수신된 하나 이상의 작업 요청들을 우선 순위에 따라 처리할 수 있다. 예를 들면, 미들웨어(143)는 어플리케이션 프로그램(147) 중 적어도 하나에 전자 장치(101)의 시스템 리소스(예: 버스(110), 프로세서(120), 또는 메모리(130) 등)를 사용할 수 있는 우선 순위를 부여하고, 상기 하나 이상의 작업 요청들을 처리할 수 있다. API(145)는 어플리케이션(147)이 커널(141) 또는 미들웨어(143)에서 제공되는 기능을 제어하기 위한 인터페이스로, 예를 들면, 파일 제어, 창 제어, 영상 처리, 또는 문자 제어 등을 위한 적어도 하나의 인터페이스 또는 함수(예: 명령어)를 포함할 수 있다. 입출력 인터페이스(150)는, 예를 들면, 사용자 또는 다른 외부 기기로부터 입력된 명령 또는 데이터를 전자 장치(101)의 다른 구성요소(들)에 전달하거나, 또는 전자 장치(101)의 다른 구성요소(들)로부터 수신된 명령 또는 데이터를 사용자 또는 다른 외부 기기로 출력할 수 있다.

디스플레이(160)는, 예를 들면, 액정 디스플레이(LCD), 발광 다이오드(LED) 디스플레이, 유기 발광 다이오드(OLED) 디스플레이, 또는 마이크로 전자기계 시스템 (MEMS) 디스플레이, 또는 전자종이(electronic paper) 디스플레이를 포함할 수 있다. 디스플레이(160)는, 예를 들면, 사용자에게 각종 콘텐츠(예: 텍스트, 이미지, 비디오, 아이콘, 및/또는 심볼 등)을 표시할 수 있다. 디스플레이(160)는, 터치 스크린을 포함할 수 있으며, 예를 들면, 전자 펜 또는 사용자의 신체의 일부를 이용한 터치, 제스쳐, 근접, 또는 호버링 입력을 수신할 수 있다. 통신 인터페이스(170)는, 예를 들면, 전자 장치(101)와 외부 장치(예: 제 1 외부 전자 장치(102), 제 2 외부 전자 장치(104), 또는 서버(106)) 간의 통신을 설정할 수 있다. 예를 들면, 통신 인터페이스(170)는 무선 통신 또는 유선 통신을 통해서 네트워크(162)에 연결되어 외부 장치(예: 제 2 외부 전자 장치(104) 또는 서버(106))와 통신할 수 있다.

무선 통신은, 예를 들면, LTE, LTE-A(LTE Advance), CDMA(code division multiple access), WCDMA(wideband CDMA), UMTS(universal mobile telecommunications system), WiBro(Wireless Broadband), 또는 GSM(Global System for Mobile Communications) 등 중 적어도 하나를 사용하는 셀룰러 통신을 포함할 수 있다. 한 실시예에 따르면, 무선 통신은, 예를 들면, WiFi(wireless fidelity), 블루투스, 블루투스 저전력(BLE), 지그비(Zigbee), NFC(near field communication), 자력 시큐어 트랜스미션(Magnetic Secure Transmission), 라디오 프리퀀시(RF), 또는 보디 에어리어 네트워크(BAN) 중 적어도 하나를 포함할 수 있다. 한실시예에 따르면, 무선 통신은 GNSS를 포함할 수 있다. GNSS는, 예를 들면, GPS(Global Positioning System), Glonass(Global Navigation Satellite System), Beidou Navigation Satellite System(이하 “Beidou”) 또는 Galileo, the European global satellite-based navigation system일 수 있다. 이하, 본 문서에서는, “GPS”는 “GNSS”와 상호 호환적으로 사용될 수 있다. 유선 통신은, 예를 들면, USB(universal serial bus), HDMI(high definition multimedia interface), RS-232(recommended standard232), 전력선 통신, 또는 POTS(plain old telephone service) 등 중 적어도 하나를 포함할 수 있다. 네트워크(162)는 텔레커뮤니케이션 네트워크, 예를 들면, 컴퓨터 네트워크(예: LAN 또는 WAN), 인터넷, 또는 텔레폰 네트워크 중 적어도 하나를 포함할 수 있다.

제 1 및 제 2 외부 전자 장치(102, 104) 각각은 전자 장치(101)와 동일한 또는 다른 종류의 장치일 수 있다. 다양한 실시예에 따르면, 전자 장치(101)에서 실행되는 동작들의 전부 또는 일부는 다른 하나 또는 복수의 전자 장치(예: 전자 장치(102,104), 또는 서버(106)에서 실행될 수 있다. 한 실시예에 따르면, 전자 장치(101)가 어떤 기능이나 서비스를 자동으로 또는 요청에 의하여 수행해야 할 경우에, 전자 장치(101)는 기능 또는 서비스를 자체적으로 실행시키는 대신에 또는 추가적으로, 그와 연관된 적어도 일부 기능을 다른 장치(예: 전자 장치(102, 104), 또는 서버(106))에게 요청할 수 있다. 다른 전자 장치(예: 전자 장치(102, 104), 또는 서버(106))는 요청된 기능 또는 추가 기능을 실행하고, 그 결과를 전자 장치(101)로 전달할 수 있다. 전자 장치(101)는 수신된 결과를 그대로 또는 추가적으로 처리하여 요청된 기능이나 서비스를 제공할 수 있다. 이를 위하여, 예를 들면, 클라우드 컴퓨팅, 분산 컴퓨팅, 또는 클라이언트-서버 컴퓨팅 기술이 이용될 수 있다.

도 2는 다양한 실시예에 따른 전자 장치(201)의 블록도이다. 전자 장치(201)는, 예를 들면, 도 1에 도시된 전자 장치(101)의 전체 또는 일부를 포함할 수 있다. 전자 장치(201)는 하나 이상의 프로세서(예: AP)(210), 통신 모듈(220), (가입자 식별 모듈(224), 메모리(230), 센서 모듈(240), 입력 장치(250), 디스플레이(260), 인터페이스(270), 오디오 모듈(280), 카메라 모듈(291), 전력 관리 모듈(295), 배터리(296), 인디케이터(297), 및 모터(298) 를 포함할 수 있다. 프로세서(210)는, 예를 들면, 운영 체제 또는 응용 프로그램을 구동하여 프로세서(210)에 연결된 다수의 하드웨어 또는 소프트웨어 구성요소들을 제어할 수 있고, 각종 데이터 처리 및 연산을 수행할 수 있다.

프로세서(210)는, 예를 들면, SoC(system on chip) 로 구현될 수 있다. 한 실시예에 따르면, 프로세서(210)는 GPU(graphic processing unit) 및/또는 이미지 신호 프로세서를 더 포함할 수 있다. 프로세서(210)는 도 2에 도시된 구성요소들 중 적어도 일부(예: 셀룰러 모듈(221))를 포함할 수도 있다. 프로세서(210) 는 다른 구성요소들(예: 비휘발성 메모리) 중 적어도 하나로부터 수신된 명령 또는 데이터를 휘발성 메모리에 로드)하여 처리하고, 결과 데이터를 비휘발성 메모리에 저장할 수 있다.

통신 모듈(220)(예: 통신 인터페이스(170))와 동일 또는 유사한 구성을 가질 수 있다. 통신 모듈(220)은, 예를 들면, 셀룰러 모듈(221), WiFi 모듈(223), 블루투스 모듈(225), GNSS 모듈(227), NFC 모듈(228) 및 RF 모듈(229)를 포함할 수 있다. 셀룰러 모듈(221)은, 예를 들면, 통신망을 통해서 음성 통화, 영상 통화, 문자 서비스, 또는 인터넷 서비스 등을 제공할 수 있다. 한 실시예에 따르면, 셀룰러 모듈(221)은 가입자 식별 모듈(예: SIM 카드)(224)을 이용하여 통신 네트워크 내에서 전자 장치(201)의 구별 및 인증을 수행할 수 있다. 한 실시예에 따르면, 셀룰러 모듈(221)은 프로세서(210)가 제공할 수 있는 기능 중 적어도 일부 기능을 수행할 수 있다. 한 실시예에 따르면, 셀룰러 모듈(221)은 커뮤니케이션 프로세서(CP)를 포함할 수 있다. 어떤 실시예에 따르면, 셀룰러 모듈(221), WiFi 모듈(223), 블루투스 모듈(225), GNSS 모듈(227) 또는 NFC 모듈(228) 중 적어도 일부(예: 두 개 이상)는 하나의 integrated chip(IC) 또는 IC 패키지 내에 포함될 수 있다. RF 모듈(229)은, 예를 들면, 통신 신호(예: RF 신호)를 송수신할 수 있다. RF 모듈(229)은, 예를 들면, 트랜시버, PAM(power amp module), 주파수 필터, LNA(low noise amplifier), 또는 안테나 등을 포함할 수 있다. 다른 실시예에 따르면, 셀룰러 모듈(221), WiFi 모듈(223), 블루투스 모듈(225), GNSS 모듈(227) 또는 NFC 모듈(228) 중 적어도 하나는 별개의 RF 모듈을 통하여 RF 신호를 송수신할 수 있다. 가입자 식별 모듈(224)은, 예를 들면, 가입자 식별 모듈을 포함하는 카드 또는 임베디드 SIM을 포함할 수 있으며, 고유한 식별 정보(예: ICCID(integrated circuit card identifier)) 또는 가입자 정보(예: IMSI(international mobile subscriber identity))를 포함할 수 있다.

메모리(230)(예: 메모리(130))는, 예를 들면, 내장 메모리(232) 또는 외장 메모리(234)를 포함할 수 있다. 내장 메모리(232)는, 예를 들면, 휘발성 메모리(예: DRAM, SRAM, 또는 SDRAM 등), 비휘발성 메모리(예: OTPROM(one time programmable ROM), PROM, EPROM, EEPROM, mask ROM, flash ROM, 플래시 메모리, 하드 드라이브, 또는 솔리드 스테이트 드라이브 (SSD) 중 적어도 하나를 포함할 수 있다. 외장 메모리(234)는 플래시 드라이브(flash drive), 예를 들면, CF(compact flash), SD(secure digital), Micro-SD, Mini-SD, xD(extreme digital), MMC(multi-media card) 또는 메모리 스틱 등을 포함할 수 있다. 외장 메모리(234)는 다양한 인터페이스를 통하여 전자 장치(201)와 기능적으로 또는 물리적으로 연결될 수 있다.

센서 모듈(240)은, 예를 들면, 물리량을 계측하거나 전자 장치(201)의 작동 상태를 감지하여, 계측 또는 감지된 정보를 전기 신호로 변환할 수 있다. 센서 모듈(240)은, 예를 들면, 제스처 센서(240A), 자이로 센서(240B), 기압 센서(240C), 마그네틱 센서(240D), 가속도 센서(240E), 그립 센서(240F), 근접 센서(240G), 컬러(color) 센서(240H)(예: RGB(red, green, blue) 센서), 생체 센서(240I), 온/습도 센서(240J), 조도 센서(240K), 또는 UV(ultra violet) 센서(240M) 중의 적어도 하나를 포함할 수 있다. 추가적으로 또는 대체적으로, 센서 모듈(240)은, 예를 들면, 후각(e-nose) 센서, 일렉트로마이오그라피(EMG) 센서, 일렉트로엔씨팔로그램(EEG) 센서, 일렉트로카디오그램(ECG) 센서, IR(infrared) 센서, 홍채 센서 및/또는 지문 센서를 포함할 수 있다. 센서 모듈(240)은 그 안에 속한 적어도 하나 이상의 센서들을 제어하기 위한 제어 회로를 더 포함할 수 있다. 어떤 실시예에서는, 전자 장치(201)는 프로세서(210)의 일부로서 또는 별도로, 센서 모듈(240)을 제어하도록 구성된 프로세서를 더 포함하여, 프로세서(210)가 슬립(sleep) 상태에 있는 동안, 센서 모듈(240)을 제어할 수 있다.

입력 장치(250)는, 예를 들면, 터치 패널(252), (디지털) 펜 센서(254), 키(256), 또는 초음파 입력 장치(258)를 포함할 수 있다. 터치 패널(252)은, 예를 들면, 정전식, 감압식, 적외선 방식, 또는 초음파 방식 중 적어도 하나의 방식을 사용할 수 있다. 또한, 터치 패널(252)은 제어 회로를 더 포함할 수도 있다. 터치 패널(252)은 택타일 레이어(tactile layer)를 더 포함하여, 사용자에게 촉각 반응을 제공할 수 있다. (디지털) 펜 센서(254)는, 예를 들면, 터치 패널의 일부이거나, 별도의 인식용 쉬트를 포함할 수 있다. 키(256)는, 예를 들면, 물리적인 버튼, 광학식 키, 또는 키패드를 포함할 수 있다. 초음파 입력 장치(258)는 마이크(예: 마이크(288))를 통해, 입력 도구에서 발생된 초음파를 감지하여, 상기 감지된 초음파에 대응하는 데이터를 확인할 수 있다.

디스플레이(260)(예: 디스플레이(160))는 패널(262), 홀로그램 장치(264), 프로젝터(266), 및/또는 이들을 제어하기 위한 제어 회로를 포함할 수 있다. 패널(262)은, 예를 들면, 유연하게, 투명하게, 또는 착용할 수 있게 구현될 수 있다. 패널(262)은 터치 패널(252)과 하나 이상의 모듈로 구성될 수 있다. 홀로그램 장치(264)는 빛의 간섭을 이용하여 입체 영상을 허공에 보여줄 수 있다. 프로젝터(266)는 스크린에 빛을 투사하여 영상을 표시할 수 있다. 스크린은, 예를 들면, 전자 장치(201)의 내부 또는 외부에 위치할 수 있다. 인터페이스(270)는, 예를 들면, HDMI(272), USB(274), 광 인터페이스(optical interface)(276), 또는 D-sub(D-subminiature)(278)를 포함할 수 있다. 인터페이스(270)는, 예를 들면, 도 1에 도시된 통신 인터페이스(170)에 포함될 수 있다. 추가적으로 또는 대체적으로, 인터페이스(270)는, 예를 들면, MHL(mobile high-definition link) 인터페이스, SD카드/MMC(multi-media card) 인터페이스, 또는 IrDA(infrared data association) 규격 인터페이스를 포함할 수 있다.

오디오 모듈(280)은, 예를 들면, 소리와 전기 신호를 쌍방향으로 변환시킬 수 있다. 오디오 모듈(280)의 적어도 일부 구성요소는, 예를 들면, 도 1 에 도시된 입출력 인터페이스(145)에 포함될 수 있다. 오디오 모듈(280)은, 예를 들면, 스피커(282), 리시버(284), 이어폰(286), 또는 마이크(288) 등을 통해 입력 또는 출력되는 소리 정보를 처리할 수 있다. 카메라 모듈(291)은, 예를 들면, 정지 영상 및 동영상을 촬영할 수 있는 장치로서, 한 실시예에 따르면, 하나 이상의 이미지 센서(예: 전면 센서 또는 후면 센서), 렌즈, 이미지 시그널 프로세서(ISP), 또는 플래시(예: LED 또는 xenon lamp 등)를 포함할 수 있다. 전력 관리 모듈(295)은, 예를 들면, 전자 장치(201)의 전력을 관리할 수 있다. 한 실시예에 따르면, 전력 관리 모듈(295)은 PMIC(power management integrated circuit), 충전 IC, 또는 배터리 또는 연료 게이지를 포함할 수 있다. PMIC는, 유선 및/또는 무선 충전 방식을 가질 수 있다. 무선 충전 방식은, 예를 들면, 자기공명 방식, 자기유도 방식 또는 전자기파 방식 등을 포함하며, 무선 충전을 위한 부가적인 회로, 예를 들면, 코일 루프, 공진 회로, 또는 정류기 등을 더 포함할 수 있다. 배터리 게이지는, 예를 들면, 배터리(296)의 잔량, 충전 중 전압, 전류, 또는 온도를 측정할 수 있다. 배터리(296)는, 예를 들면, 충전식 전지 및/또는 태양 전지를 포함할 수 있다.

인디케이터(297)는 전자 장치(201) 또는 그 일부(예: 프로세서(210))의 특정 상태, 예를 들면, 부팅 상태, 메시지 상태 또는 충전 상태 등을 표시할 수 있다. 모터(298)는 전기적 신호를 기계적 진동으로 변환할 수 있고, 진동, 또는 햅틱 효과 등을 발생시킬 수 있다. 전자 장치(201)는, 예를 들면, DMB(digital multimedia broadcasting), DVB(digital video broadcasting), 또는 미디어플로(mediaFloTM) 등의 규격에 따른 미디어 데이터를 처리할 수 있는 모바일 TV 지원 장치(예: GPU)를 포함할 수 있다. 본 문서에서 기술된 구성요소들 각각은 하나 또는 그 이상의 부품(component)으로 구성될 수 있으며, 해당 구성요소의 명칭은 전자 장치의 종류에 따라서 달라질 수 있다. 다양한 실시예에서, 전자 장치(예: 전자 장치(201))는 일부 구성요소가 생략되거나, 추가적인 구성요소를 더 포함하거나, 또는, 구성요소들 중 일부가 결합되어 하나의 개체로 구성되되, 결합 이전의 해당 구성요소들의 기능을 동일하게 수행할 수 있다.

도 3은 다양한 실시예에 따른 프로그램 모듈의 블록도이다. 한 실시예에 따르면, 프로그램 모듈(310)(예: 프로그램(140))은 전자 장치(예: 전자 장치(101))에 관련된 자원을 제어하는 운영 체제 및/또는 운영 체제 상에서 구동되는 다양한 어플리케이션(예: 어플리케이션 프로그램(147))을 포함할 수 있다. 운영 체제는, 예를 들면, AndroidTM, iOSTM, WindowsTM, SymbianTM, TizenTM, 또는 BadaTM를 포함할 수 있다. 도 3을 참조하면, 프로그램 모듈(310)은 커널(320)(예: 커널(141)), 미들웨어(330)(예: 미들웨어(143)), (API(360)(예: API(145)), 및/또는 어플리케이션(370)(예: 어플리케이션 프로그램(147))을 포함할 수 있다. 프로그램 모듈(310)의 적어도 일부는 전자 장치 상에 프리로드 되거나, 외부 전자 장치(예: 전자 장치(102, 104), 서버(106) 등)로부터 다운로드 가능하다.

커널(320)은, 예를 들면, 시스템 리소스 매니저(321) 및/또는 디바이스 드라이버(323)를 포함할 수 있다. 시스템 리소스 매니저(321)는 시스템 리소스의 제어, 할당, 또는 회수를 수행할 수 있다. 한 실시예에 따르면, 시스템 리소스 매니저(321)는 프로세스 관리부, 메모리 관리부, 또는 파일 시스템 관리부를 포함할 수 있다. 디바이스 드라이버(323)는, 예를 들면, 디스플레이 드라이버, 카메라 드라이버, 블루투스 드라이버, 공유 메모리 드라이버, USB 드라이버, 키패드 드라이버, WiFi 드라이버, 오디오 드라이버, 또는 IPC(inter-process communication) 드라이버를 포함할 수 있다. 미들웨어(330)는, 예를 들면, 어플리케이션(370)이 공통적으로 필요로 하는 기능을 제공하거나, 어플리케이션(370)이 전자 장치 내부의 제한된 시스템 자원을 사용할 수 있도록 API(360)를 통해 다양한 기능들을 어플리케이션(370)으로 제공할 수 있다. 한 실시예에 따르면, 미들웨어(330) 는 런타임 라이브러리(335), 어플리케이션 매니저(341), 윈도우 매니저(342), 멀티미디어 매니저(343), 리소스 매니저(344), 파워 매니저(345), 데이터베이스 매니저(346), 패키지 매니저(347), 커넥티비티 매니저(348), 노티피케이션 매니저(349), 로케이션 매니저(350), 그래픽 매니저(351), 또는 시큐리티 매니저(352) 중 적어도 하나를 포함할 수 있다.

런타임 라이브러리(335)는, 예를 들면, 어플리케이션(370)이 실행되는 동안에 프로그래밍 언어를 통해 새로운 기능을 추가하기 위해 컴파일러가 사용하는 라이브러리 모듈을 포함할 수 있다. 런타임 라이브러리(335)는 입출력 관리, 메모리 관리, 또는 산술 함수 처리를 수행할 수 있다. 어플리케이션 매니저(341)는, 예를 들면, 어플리케이션(370)의 생명 주기를 관리할 수 있다. 윈도우 매니저(342)는 화면에서 사용되는 GUI 자원을 관리할 수 있다. 멀티미디어 매니저(343)는 미디어 파일들의 재생에 필요한 포맷을 파악하고, 해당 포맷에 맞는 코덱을 이용하여 미디어 파일의 인코딩 또는 디코딩을 수행할 수 있다. 리소스 매니저(344)는 어플리케이션(370)의 소스 코드 또는 메모리의 공간을 관리할 수 있다. 파워 매니저(345)는, 예를 들면, 배터리의 용량 또는 전원을 관리하고, 전자 장치의 동작에 필요한 전력 정보를 제공할 수 있다. 한 실시예에 따르면, 파워 매니저(345)는 바이오스(BIOS: basic input/output system)와 연동할 수 있다. 데이터베이스 매니저(346)는, 예를 들면, 어플리케이션(370)에서 사용될 데이터베이스를 생성, 검색, 또는 변경할 수 있다. 패키지 매니저(347)는 패키지 파일의 형태로 배포되는 어플리케이션의 설치 또는 갱신을 관리할 수 있다.

커넥티비티 매니저(348)는, 예를 들면, 무선 연결을 관리할 수 있다. 노티피케이션 매니저(349)는, 예를 들면, 도착 메시지, 약속, 근접성 알림 등의 이벤트를 사용자에게 제공할 수 있다. 로케이션 매니저(350)는, 예를 들면, 전자 장치의 위치 정보를 관리할 수 있다. 그래픽 매니저(351)는, 예를 들면, 사용자에게 제공될 그래픽 효과 또는 이와 관련된 사용자 인터페이스를 관리할 수 있다. 보안 매니저(352)는, 예를 들면, 시스템 보안 또는 사용자 인증을 제공할 수 있다. 한 실시예에 따르면, 미들웨어(330)는 전자 장치의 음성 또는 영상 통화 기능을 관리하기 위한 통화(telephony) 매니저 또는 전술된 구성요소들의 기능들의 조합을 형성할 수 있는 하는 미들웨어 모듈을 포함할 수 있다. 한 실시예에 따르면, 미들웨어(330)는 운영 체제의 종류 별로 특화된 모듈을 제공할 수 있다. 미들웨어(330)는 동적으로 기존의 구성요소를 일부 삭제하거나 새로운 구성요소들을 추가할 수 있다. API(360)는, 예를 들면, API 프로그래밍 함수들의 집합으로, 운영 체제에 따라 다른 구성으로 제공될 수 있다. 예를 들면, 안드로이드 또는 iOS의 경우, 플랫폼 별로 하나의 API 셋을 제공할 수 있으며, 타이젠의 경우, 플랫폼 별로 두 개 이상의 API 셋을 제공할 수 있다.

어플리케이션(370)은, 예를 들면, 홈(371), 다이얼러(372), SMS/MMS(373), IM(instant message)(374), 브라우저(375), 카메라(376), 알람(377), 컨택트(378), 음성 다이얼(379), 이메일(380), 달력(381), 미디어 플레이어(382), 앨범(383), 와치(384), 헬스 케어(예: 운동량 또는 혈당 등을 측정), 또는 환경 정보(예: 기압, 습도, 또는 온도 정보) 제공 어플리케이션을 포함할 수 있다. 한 실시예에 따르면, 어플리케이션(370)은 전자 장치와 외부 전자 장치 사이의 정보 교환을 지원할 수 있는 정보 교환 어플리케이션을 포함할 수 있다. 정보 교환 어플리케이션은, 예를 들면, 외부 전자 장치에 특정 정보를 전달하기 위한 노티피케이션 릴레이 어플리케이션, 또는 외부 전자 장치를 관리하기 위한 장치 관리 어플리케이션을 포함할 수 있다. 예를 들면, 알림 전달 어플리케이션은 전자 장치의 다른 어플리케이션에서 발생된 알림 정보를 외부 전자 장치로 전달하거나, 또는 외부 전자 장치로부터 알림 정보를 수신하여 사용자에게 제공할 수 있다. 장치 관리 어플리케이션은, 예를 들면, 전자 장치와 통신하는 외부 전자 장치의 기능(예: 외부 전자 장치 자체(또는, 일부 구성 부품)의 턴-온/턴-오프 또는 디스플레이의 밝기(또는, 해상도) 조절), 또는 외부 전자 장치에서 동작하는 어플리케이션을 설치, 삭제, 또는 갱신할 수 있다. 한 실시예에 따르면, 어플리케이션(370)은 외부 전자 장치의 속성에 따라 지정된 어플리케이션(예: 모바일 의료 기기의 건강 관리 어플리케이션)을 포함할 수 있다. 한 실시예에 따르면, 어플리케이션(370)은 외부 전자 장치로부터 수신된 어플리케이션을 포함할 수 있다. 프로그램 모듈(310)의 적어도 일부는 소프트웨어, 펌웨어, 하드웨어(예: 프로세서(210)), 또는 이들 중 적어도 둘 이상의 조합으로 구현(예: 실행)될 수 있으며, 하나 이상의 기능을 수행하기 위한 모듈, 프로그램, 루틴, 명령어 세트 또는 프로세스를 포함할 수 있다.

도 4는 본 발명의 다양한 실시예에 따른 전자 장치(400)와 서버(500), 제1 외부 장치(600) 및 제2 외부장치(700)의 연결을 도시한다. 여기서, 전자 장치(400), 제1 외부 장치(600) 및 제2 외부장치(700)는 도1에 도시된 전자 장치(101), 전자 장치(102), 전자 장치(104) 중 일 장치일 수 있다. 여기서, 서버(500)는 도 1에 도시된 서버(106)일 수 있으며 전자 장치(400)의 일부일 수도 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 프로세서(410), 사용자 입력 처리부(420), 영상 처리부(430), 통신부(440) 및 외부장치 정보 처리부(450)를 포함할 수 있다. 전자 장치(400)의 구성요소는 추가되거나 생략될 수 있다. 예를 들면, 전자 장치(400)는 센서 모듈(예: 가속도 센서, 자이로 센서, 지자계 센서, 근접 센서 등)을 더 포함할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 웨어러블 기기일 수 있다. 예를 들어, 웨어러블 기기는 웨어러블 장치는 액세서리형(예: 시계, 안경, 콘택트 렌즈, 또는 머리 착용형 장치(head-mounted-device(HMD)), 중 적어도 어느 하나일 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 사용자의 양안에 접안 또는 착용하여 영상을 표시하는 장치일 수 있다. 일 실시예에 따른 전자 장치(400)는 증강 현실(AR: Augmented reality)을 제공하는 씨 스루(See-through) 기능 또는 가상 현실(VR: Virtual reality)을 제공하는 씨 클로즈드(See-closed)기능 중 적어도 하나를 제공할 수 있다. 상기 씨 스루(See-through) 기능은 디스플레이를 통하여 실제 외부 영상들을 사용자의 안구에 전달하면서 실시간으로 부가적인 정보 또는 이미지를 하나의 영상으로 제공하는 기능을 의미할 수 있다. 상기 씨 클로즈드(See-closed)기능은 디스플레이를 통하여 제공되는 컨텐츠들만 영상으로 제공하는 기능을 의미할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 통신부(440)를 통해 서버(500), 제1 외부 장치(600) 및 제2 외부 장치(700)와 연결할 수 있다. 일 실시예에 따른 프로세서(410)는 가상 영역을 활성화하는 입력 신호를 외부 장치들(600, 700)로부터 수신할 수 있다. 예를 들면, 외부 장치들(600, 700)은 가상 영역을 활성화하는 사용자 입력 이벤트를 감지하거나 미리 설정된 기준(예: 외부 장치들(600, 700)이 전자 장치(400)와의 연결 수립 등)을 충족하는 경우 전자 장치(400)로 활성화 신호를 전달할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는, 적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신할 수 있다. 일 실시예에 따른 프로세서(410)는 통신부(440)를 통해 제1 외부 장치(600)로부터 어플리케이션 관련 정보를 수신할 수 있다.

일 실시예에 따른 상기 어플리케이션은 외부 장치들(600, 700)에서 현재 표시 중인 어플리케이션, 초기 화면, 현재 실행 중인 어플리케이션 리스트, 사용자에 의해 미리 지정된 어플리케이션, 특정 기능을 제공하는 어플리케이션 중 적어도 어느 하나일 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 외부장치 정보 처리부(450)를 통해 외부 장치들(600, 700)로부터 수신한 어플리케이션의 표시 특성을 결정할 수 있다. 여기서 표시 특성이란 어플리케이션을 기반으로 표시할 가상 객체의 위치 정보(예: 절대적 위치 정보, 상대적 위치 정보), 공간/물체에 대한 깊이(depth) 정보(이하에서는 깊이 정보라 칭할 수 있다) 등일 수 있다. 또는 표시 특성은, 수신한 어플리케이션의 표시를 결정하는 조건일 수 있다. 예를 들면, 전자 장치(400)는 알람 어플리케이션, SNS 어플리케이션, 사진 촬영 어플리케이션 등을 수신하는 경우, 해당 어플리케이션을 기반으로 가상 객체를 표시할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 외부 장치들(600. 700)로부터 수신한 어플리케이션 정보를 전자 장치(400)에서 실행하기 위한 정보(예: 고유 ID 정보, 사용자 계정 정보, 어플리케이션의 현재 상태 정보, 클라우드 정보 등)를 수신할 수 있다. 프로세서(410)는 수신한 정보를 기반으로 가상 객체를 표시하도록 제어할 수 있다.

일 실시예에 따른 프로세서(410)는 가상 객체를 표시하고 있음을 나타내는 정보를 외부 장치(600, 700)에게 전달할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)와 외부 장치들(600, 700)의 연동 방식은 어플리케이션, 사용자의 선호도, 외부 장치들(600, 700) 및 전자 장치(400)의 성능, 클라우드 공유에 관련된 정보에 따라 달라질 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 적어도 하나의 외부 장치의 어플리케이션을 표시하는 스크린 외형을 인식할 수 있다. 일 실시예에 따른 프로세서(410)는 영상 처리부(430)를 통해 제2 외부장치(700)의 스크린 외형을 인식할 수 있다. 예를 들면, 프로세서(410)는 영상 처리부(430)를 통해 제2 외부장치(700)의 프로그램 등이 표시되는 스크린의 하드웨어 경계면을 인식할 수 있다.

본 발명의 일 실시예에 따른 영상 처리부(430)는 적어도 하나의 카메라로부터 영상을 수신할 수 있다. 수신하는 영상은 2차원 영상이거나, 깊이(depth) 정보일 수 있다. 일 실시예에 따른 영상 처리부(430)는 고해상도 카메라, 스테레오 카메라, IR 카메라 등을 이용하여 제2 외부장치(700)의 스크린을 인식할 수 있다.

본 발명의 일 실시예에 따른 영상 처리부(430)는 수신한 영상에 포함된 영상 정보를 분석하여 영상 내 영상객체를 인식할 수 있다. 일 실시예에 따른 영상 처리부(430)는 카메라 모듈을 통해 영상객체의 종류, 속성 등을 인식 할 수 있다. 예를 들어, 영상 처리부(430)는 카메라를 통해 인식된 객체가 전자 장치, 인체의 손가락, 인체의 손목 등을 구별할 수 있다.

본 발명의 일 실시예에 따른 영상 처리부(430)는 카메라 모듈을 통해 영상객체의 경계, 인체의 골격 등을 인식할 수 있다. 예를 들면, 영상 처리부(430)는 카메라 모듈을 통해 인식된 외부 전자 장치 스크린의 외곽선 경계, 사용자 손가락의 관절 위치 등을 인식할 수 있다. 추가적인 예를 들면, 영상 처리부(430)는 전자 장치(400) 사용자의 시선 방향, 시선에 따른 관심 영역 등을 검출할 수 있다.

일 실시예에 따른 전자 장치(400)의 시선 검출은, 전자 장치(400)의 일측에 실장된 시선 추적부(Eye tracker, 미도시)는, 예를 들면, EOG 센서(Electircal oculography), Coil systems, Dual purkinje systems, Bright pupil systems, Dark pupil systems 중 적어도 하나의 방식을 이용하여 사용자의 시선을 추적할 수 있다. 또한, 상기 시선 추적부는 시선추적을 위한 마이크로 카메라를 더 포함할 수도 있다. 일 실시예에 따른 전자 장치(400)의 일측에 실장된 초점 조절부(Ajustable optics, 미도시)는 사용자가 자신의 시력에 적합한 영상을 감상할 수 있도록 사용자의 양안 사이 거리(IPD: Inter-Pupil Distance)를 측정하여 렌즈의 거리 및 디스플레이 위치를 조정할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 인식된 스크린의 외형에 기반하여 결정된 일 영역에, 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시할 수 있다. 일 실시예에 따른 프로세서(410)는 영상 처리부(430)를 통해 생성된 출력영상을 인식된 스크린 외형으로부터 설정된 거리 이내의 가상 영역에 가상 객체를 표시하도록 제어할 수 있다.

본 발명의 일 실시예에 따른 영상 처리부(430)는 3D 공간 정보와 사용자 움직임 정보에 기반하여 가상영상을 생성할 수 있다. 일 실시예에 따른 영상 처리부(430)는 복수의 영상들을 가상 영상과 합성하여 최종 출력 영상을 생성할 수 있다. 상기 3D 공간 정보는 외부 장치들(예: 제1 외부 장치(600), 제2 외부 장치(700))의 스크린 정보(예: 크기 정보, 해상도 정보 등)를 포함할 수 있다. 추가적인 일 실시예에 따른 영상 처리부(430)는 전자 장치(400)의 움직임 검출, 전자 장치(400) 사용자의 시선 검출, 영상 렌더링 기능 등을 수행할 수 있다. 일 실시예에 따른 영상 처리부(430)는 전자 장치(400)가 웨어러블 기기인 경우 사용자 양안에 표시하는 화면을 달리하여 표시할 수 있다.

일 실시예에 따른 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역은,적어도 하나의 외부 장치의 어플리케이션을 표시하는 스크린의 물리적 경계선 영역으로부터 설정된 거리 이내의 가상 영역일 수 있다. 예를 들면, 프로세서(410)는 영상 처리부(430)을 통해, 제2 외부 장치(700)의 스크린이 23인치(가로 495.36mm × 세로 309.60mm)인 경우 40인치(가로 906mm × 세로 609m)의 가상 확장 스크린을 표시하고, 가상 확장 스크린 중 일 영역에 어플리케이션 관련 가상 객체를 표시할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 영상 처리부(430)를 통해 인식된 스크린의 크기 정보 및 스크린의 화면 정보(예: 해상도 정보 등) 중 적어도 어느 하나의 정보를 기반으로 가상 객체를 표시할 수 있다. 일 실시예에 따른 프로세서(410)는 미리 저장된 조건, 제2 외부 장치(700)에서 현재 출력중인 컨텐츠 정보, 텍스트 정보 등을 기반으로 가상 객체를 표시할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 외부장치들(예: 600, 700)을 인식하고, 가상 확장 스크린 중 어느 일 영역에 배치할 것인지 여부를 결정할 수 있다. 일 실시예에 따른 프로세서(410)는 전자 장치(400) 사용자의 시선 정보, 움직임 정보를 기반으로 가상 객체가 표시될 영역, 해상도 정보, 색상 정보, 밝기 정보 등을 결정할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 사용자 입력을 수신하는 경우, 수신한 사용자 입력을 기반으로 어플리케이션을 수행할 수 있다. 일 실시예에 따른 프로세서(410)는 수행된 어플리케이션을 외부 장치들(예: 제1 외부 장치(600), 제2 외부 장치(700) 등)에 전달할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 외부 장치들(600, 700)로부터 수신한 제어신호를 기반으로, 표시중이거나 표시할 가상 객체의 그래픽 사용자 인터페이스를 변경할 수 있다. 예를 들면, 전자 장치(400)는 제1 외부 장치(600)로부터 제어 입력 신호(예: 터치 입력 이벤트 등)를 수신하는 경우, 가상 객체의 그래픽 사용자 인터페이스를 변경할 수 있다. 추가적인 예를 들면, 전자 장치(400)는 가상 객체 변경 시 관련 신호를 제2 외부 장치(700)에 전달할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 영상 처리부(430)를 통해 적어도 하나의 외부 장치의 백그라운드에서 실행중인 어플리케이션을 기반으로 가상 객체를 표시할 수 있다. 일 실시예에 따른 프로세서(410)는 영상 처리부(430)를 통해 제1 외부 장치(600)의 백그라운드에서 실행중인 어플리케이션을 기반으로 가상 객체를 표시할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 제1 외부 장치(600)에서 일 어플리케이션을 백그라운드에서 실행하더라도, 제1 외부 장치(600)로부터 해당 어플리케이션 정보를 수신할 수 있다. 일 실시예에 따른 프로세서(410)는 수신한 어플리케이션 정보를 기반으로 가상 객체를 표시할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 수신한 어플리케이션 정보를 기반으로 가상 객체를 표시하고 있는 중에, 외부 장치들(600, 700)에서 제2 어플리케이션을 표시하고자 하는 경우, 프로세서(410)는 외부 장치들(600, 700)로부터 제2 어플리케이션을 수신할 수 있다. 프로세서(410)는 어플리케이션 및 제2 어플리케이션을 모두 표시하거나, 하나의 어플리케이션만을 선택하여 표시할 수 있다.

본 발명의 일 실시예에 따른 외부 장치들(600, 700)은 상기 어플리케이션 및 제2 어플리케이션에 대해 멀티 태스킹을 수행할 수 있다. 예를 들면, 프로세서(400)가 수신한 어플리케이션을 기반으로 가상 객체를 표시하는 동안, 외부 장치들(600, 700)에서 어플리케이션이 종료되지 않도록 제어할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)의 외부 장치 정보 처리부(450)는 수신한 제2 어플리케이션의 표시 특성을 결정할 수 있다. 여기서 표시 특성이란 위치 정보(예: 절대적 위치 정보, 상대적 위치 정보, 크기 정보, 깊이(depth) 정보 등)일 수 있다. 추가적인 예를 들면, 프로세서(400)는 어플리케이션과 제2 어플리케이션을 기반으로 하는 가상 객체가, 같은 깊이(depth) 정보를 갖도록 가상 영역에서 나란히 표시되도록 제어할 수 있다. 또 다른 예를 들면, 프로세서(400)는 어플리케이션과 제2 어플리케이션을 기반으로 하는 가상 객체가, 다른 깊이 정보를 갖도록 가상 영역에서 계층적으로 표시되도록 제어할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 적어도 하나의 외부 장치로부터 어플리케이션 관련 정보가 변경됨에 따른 갱신 신호를 수신하는 경우, 수신한 변경 신호를 기반으로 상기 표시된 가상 객체를 갱신할 수 있다. 일 실시예에 따른 프로세서(410)는 제1 외부 장치(600)에 새로운 이벤트(예: 메시지 수신 등)가 발생하는 경우, 표시 중인 가상 객체의 그래픽 사용자 인터페이스를 갱신할 수 있다. 예를 들면, 전자 장치(400)는 가상 객체의 그래픽 사용자 인터페이스의 배치를 변경하거나, 제1 외부 장치(600)의 어플리케이션 변경에 따른 알림 아이템을 가상 영역에 표시할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 표시된 가상 객체를 상기 적어도 하나의 외부 장치의 입력 장치를 통해 갱신할 수 있다. 일 실시예에 따른 프로세서(410)는 표시 중인 가상 객체를 전자 장치(400) 사용자의 제스처 입력 또는 제2 외부 장치(700)의 입력 장치(예: 마우스 등)를 통해 갱신(예: 크기 확대, 크기 축소 등)할 수 있다. 일 실시예에 따른 프로세서(410)는 가상 객체를 제스처 입력 또는 외부 장치들(600, 700)의 입력 장치(예: 마우스, 터치 스크린)에 의한 이동 입력 이벤트(예: 드래그 앤 드롭, 터치 스와이프 등)를 통해 제2 외부 장치(700)의 스크린에 표시하도록 제어할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 영상 처리부(430)를 통해 제1 외부 장치(600)에 포함된 어플리케이션 정보를 기반으로 가상 객체를 표시할 수 있다. 일 실시예에 따른 프로세서(410)는 스크린을 포함하는 제2 외부 장치(700)의 입력장치를 통해 가상 객체에 포함된 이미지 아이템에 대한 입력 이벤트를 감지할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 감지된 입력 이벤트를 기반으로 제2 외부 장치(700)의 스크린 화면에 이미지 아이템에 대응하는 어플리케이션을 표시하도록 통신부(440)를 통해 제2 외부 장치(700)로 관련 신호를 전송할 수 있다. 일 실시예에 따른 프로세서(410)는 표시중인 가상 객체에 대한 입력 이벤트(예: 제2 외부 장치(의 입력장치(예: 마우스)에 의한 드래그 앤 드롭 입력 이벤트, 클릭 입력 이벤트 등)를 감지할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 제2 외부 장치(700)에서 실행 가능한 어플리케이션인지 여부를 판단할 수 있다. 일 실시예에 따른 프로세서(410)는 제2 외부 장치(700)에서 실행 가능한 어플리케이션인 것으로 판단되는 경우, 제1 외부 장치(600)에서 제2 외부 장치(700)로 해당 어플리케이션(예: 문서 파일, 첨부 파일 관련 어플리케이션 등)을 전송할 수 있다. 제2 외부 장치(700)는 수신한 어플리케이션을 기반으로 어플리케이션을 실행할 수 있다. 예를 들면, 프로세서(410)는 제2 외부 장치(700)가 해당 어플리케이션을 표시하는 경우, 3D로 표시 중인 가상 객체를 2D로 변환하여 제2 외부 장치(700)의 스크린에 표시되도록 제어할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 상기 입력 이벤트가 감지된 가상 객체에 대응하는 어플리케이션의 영상 정보를 통신부(440)를 통해 제1 외부 장치(600)로부터 수신할 수 있다. 일 실시예에 따른 프로세서(410)는 수신한 영상 정보를 가상 객체로 변환하여 표시할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 통신부(440)를 통해 제2 외부 장치(700)의 스크린 화면에 표시된 일 아이템을 가상 객체로 이동하는 입력 이벤트가 감지되는 경우, 제1 외부 장치(600)로 관련 신호를 전송할 수 있다. 예를 들면, 프로세서(410)는 제1 외부 장치(600)에서 e-mail을 수신하는 경우 첨부파일이 오피스 파일일 경우 제1 외부 장치(600)의 스크린 크기보다 큰 스크린을 갖는 제2 외부 장치(700)에서 작업을 바로 수행할 수 있도록 제1 외부 장치(600)로 관련 신호를 전송할 수 있다. 추가적인 예를 들면, 프로세서(410)는 제2 외부 장치(700)의 스크린을 통해 문서를 편집하고, 편집된 문서의 파일을 이동 입력 이벤트(예: 드래그 이벤트 등)를 이용하여 표시중인 가상 객체에 드롭하면 해당 파일이 첨부되어 전송되도록 제어할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 영상 처리부(430)를 통해 인식된 스크린의 크기 대비 확장된 크기를 갖는 가상 스크린을 가상 영역에 표시할 수 있다. 일 실시예에 따른 프로세서(410)는 영상 처리부(430)를 통해 제2 외부 장치(700) 스크린과 평행한 형태이면서 보다 큰 크기를 갖는 가상 확장 스크린을 표시할 수 있다. 가상 확장 스크린의 크기는 사용자에 의해 지정될 수 있고, 제2 외부 장치(700) 스크린이 표시할 수 있는 디스플레이 해상도, 물리적 크기 등을 기반으로 표시될 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 외부 장치들(600, 700)의 스크린을 제외한 일 영역에 가상 확장 스크린을 표시할 수 있다. 예를 들면, 서로 다른 깊이(depth) 정보를 갖는 복수의 계층 스크린을 표시할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 현실 객체(예: 실제 물체 등)를 기반으로 가상 확장 스크린을 배치할 수 있다. 예를 들면, 제2 외부 장치(700)의 스크린 근처에 실제 객체(예: 컵)가 존재하고, 가상 객체를 실제 객체의 주변에 배치할 수 있다. 이런 경우, 실제 객체(예: 컵)이 움직이면 해당 가상 객체도 상응하여 움직일 수 있다. 일 실시예에 따른 프로세서(410)는 실제 객체(예: 음료수병, 연필, 컵 등)의 위치를 가상 객체를 표시할 공간 좌표의 기준으로 사용하고, 표시된 이후에는 실제 객체와 독립적으로 이동되어 표시되도록 제어할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 가상 확장 스크린을 통해 홀로그램 이미지를 표시할 수 있다. 예를 들면, 프로세서(410)가 가상 확장 스크린에 가상 객체를 표시할 때 해당 객체가 3D 정보를 가지고 있는 경우 홀로그램 형태로 표시할 수 있다. 일 실시예에 따른 프로세서(410)는 특정 어플리케이션을 확장 스크린으로 이동하여 표시할 대 해당 어플리케이션이 3D 인터페이스를 가지고 있는 경우, 이를 이용하여 3D 모드로 표시하도록 제어할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 제2 외부 장치(700)의 스크린에 표시되고 있는 제2 외부 장치(700)의 입력 장치(예: 마우스)가 스크린의 물리적 경계를 초과하는 경우 가상 객체의 마우스 커서로 변환할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 제2 외부 장치(700)의 스크린으로부터 제2 외부 장치(700)의 입력 장치(예: 마우스)가 스크린의 물리적 경계를 넘어서는 입력이 수신될 때, 3차원 공간의 창이 존재하는 경우 3차원 공간의 컨트롤로 변환할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)가 가상 확장 스크린을 이용할 때, 전자 장치(410) 및 외부 장치들(600, 700)에 대한 사용자의 입력 또한 연동될 수 있다. 예를 들어 사용자가 PC에서 기존의 키보드나 마우스와 같은 컨트롤러를 사용하고 있을 때, 만약 마우스의 포인트가 커서가 PC의 스크린 밖에 위치한 가상 확장 스크린에 위치한 객체에 대한 입력이 가능할 수 있다.

추가적인 예를 들면, 마우스의 커서가 기존에 사용자가 제어하고 있던 일 스크린의 영상 표시 영역을 벗어난 경우 기존에 사용하던 입력 도구의 모드를 전환하여 가상 확장 스크린에 위치한 객체를 제어할 수 있다. 기존의 일 스크린을 벗어난 가상 확장 스크린의 경우 다차원의 가상 스크린이 가능하며, 이에 맞게 사용자 입력도구도 2D 에서 3D 제어로 그 동작 모드가 바뀔 수 있다.

본 발명의 일 실시예에 따른 모드의 전환은 사용자의 요청 혹은 가상 확장 스크린으로의 진입을 인지하는 경우를 통해 전환될 수 있다. 사용자는 기기 화면에 있는 아이콘이나 어플리케이션의 실행 등을 통해 입력도구의 모드를 전환할 수 있다. 일 실시예에 따른 가상 확장 스크린은 포인터나 커서가 기존의 화면을 벗어난 영역으로 움직이는 것을 전자 장치(400), 외부 장치들(600, 700)이 인지 할 때 모드가 전환 될 수 있다. 포인터나 커서의 인지는 전자 장치(400)의 시각적인 인지, 외부 카메라 등 외부에 위치한 센서기기에 의한 인지, 근거리 통신 등의 전파적인 기법을 통한 정보전달을 통한 인지 등의 방법을 통해 인지할 수 있다.

모드의 전환이 이루어지고 나면 전자 장치(400)의 사용자는 기존의 입력수단을 사용하여 확장 스크린 (3D 공간)을 제어 할 수 있다. 이는 마우스나 키보드 등에서 버튼이나 추가적인 입력 기기를 작동 가능하게 하는 등의 방법일 수 있다. 일 실시예에 따른 가상 확장 스크린에서의 동작은 제어 관련 기능 및 화면 업데이트를 위한 기능까지 두 기기 간에 교환이 가능할 수 있다.

예를 들어 2D 화면을 사용하는 PC 나 태블릿 PC에 가상 확장 스크린에 제어하고자 하는 객체가 위치하는 경우 헤드 마운트 디스플레이(HMD)에 있는 모션 컨트롤이나 음성 컨트롤을 이용하여 객체를 제어할 수 있다.

일 실시예에 따른 2D에서 3D 또는 3D에서 2D 모드의 전환은 사용자의 요청 또는 가상 확장 스크린으로의 진입을 인지하는 경우 등에 전환될 수 있다. 전자 장치(400)는 사용자에 의해 기기 화면에 있는 아이콘이나 어플리케이션의 실행 등을 통해 어떠한 기기의 입력도구를 이용할 것인지 여부를 선택하는 입력을 감지할 수 있다. 일 실시예에 따른 가상 확장 스크린은 포인터나 커서가 기존의 화면을 벗어난 영역으로 움직이는 것을 HMD 또는 모바일, PC 등의 기기가 인지 할 때 입력 도구가 전환 될 수 있다. 포인터나 커서의 인지는 HMD의 시각적인 인지, 외부 카메라 등 외부에 위치한 센서기기에 의한 인지, 근거리 통신 등의 전파적인 기법을 통한 정보전달을 통한 인지할 수 있다.

일 실시예에 따른 모드의 전환이 이루어진 후 전자 장치(400)의 사용자는 제 2 기기(예 외부 장치들(600, 700)의 입력수단을 사용하여 가상 객체를 제어 할 수 있다. 예를 들면 키보드와 마우스 등을 통해 제어를 하다가 제어권이 바뀐 후에는 전자 장치(예: 헤드 마운트 디스플레이(HMD), 400)의 음성입력이나 제스처 입력을 통해 입력할 수 있다. 이 때 제어 관련 및 화면 업데이트를 위한 정보는 두 기기 간에 교환이 가능하다.

본 발명의 일 실시예에 따른 전자 장치(400)는 인식된 사용자 제스처 정보를 제1 외부 장치(600)로 전달하여 실행되고 있는 하나 이상의 어플리케이션을 제어 할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 깊이(depth) 정보를 갖고 있는 두 개 이상의 어플리케이션이 표시되는 경우, 전자 장치(400)는 사용자 입력에 대한 깊이 정보를 판단하여 임의의 어플리케이션을 선택할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 깊이 정보를 갖고 있는 두 개 이상의 어플리케이션이 표시되는 경우, 전자 장치(400)에서 사용자 입력에 대한 깊이 정보를 판단하여 각 어플리케이션의 표시 깊이 정보를 변경할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 하나 이상의 어플리케이션이 표시되는 경우, 전자 장치(400)에서 인식된 사용자 제스처 정보를 사용하여 제2 외부 장치(700)의 어플리케이션의 수행을 제어할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 사용자 특정 제스처를 전자 장치(400)에서 인식한 경우 외부 장치들(600, 700)의 어플리케이션을 새로이 수행할 수 있다. 일 실시예에 따른 전자 장치(400)는 특정 제스쳐를 전자 장치(400)에서 인식한 경우 백그라운드에서 수행중인 어플리케이션을 포-그라운드로 변경할 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는 영상 처리부(430)를 통해 서로 다른 깊이(depth) 정보를 갖는 복수의 가상 영역들을 표시할 수 있다.

본 발명의 일 실시예에 따른 각각의 가상 영역이 포함되는 가상 객체는, 상기 표시될 가상 객체에 대응하는 어플리케이션의 종류 및 미리 설정된 가상 객체 배열 정보 중 적어도 어느 하나를 기반으로 표시될 수 있다.

본 발명의 일 실시예에 따른 사용자 입력 처리부(420)는 전자 장치(400) 사용자의 제스처를 인식 한 후 인식된 제스처에 대응하는 정보를 프로세서(410)에 전달할 수 있다. 일 실시예에 따른 사용자 입력 처리부(420)는 제스처를 인식하고, 사용자 시선 입력을 인식할 수 있다.

본 발명의 일 실시예에 따른 통신부(440)는 외부 장치들(600, 700)과 정보(예: 외부 장치들(600, 700)의 출력정보, 사용자 입력 관련 정보, 어플리케이션 정보 등)를 송수신할 수 있다.

일 실시예에 따른 전자 장치(400)는 증강 현실(AR: Augmented reality)을 제공하는 씨 스루(see-through) 기능을 지원하는 디스플레이를 포함할 수 있다. 일 실시예에 따른 전자 장치(400)는 공간 정보 및 객체 정보 중 적어도 어느 하나의 정보를 포함하는 영상 정보를 인식할 수 있는 카메라 모듈 및 센서 모듈 중 적어도 어느 하나의 모듈을 더 포함할 수 있다.

본 발명의 일 실시예에 따른 외부장치 정보 처리부(450)는 전자 장치(400)와 연결된 외부 장치들(600, 700)의 출력정보(예: 영상 정보, 음성 정보, 진동 피드백 정보 등)를 처리할 수 있다. 예를 들면, 외부 장치들(600, 700)로부터 소리 정보를 수신하는 경우, 수신한 소리 정보에 대응하는 오디오를 재생할 수 있다. 추가적인 예를 들면, 외부장치 정보 처리부(450)는 외부장치들(600, 700)의 출력 정보 중 영상 정보를 배치(예: 공간좌표, 방향 등의 속성 등)할 수 있다. 외부장치 정보 처리부(450)는 배치된 영상 정보에 기반하여 소리를 렌더링할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 제2 외부 장치(700)에서 실행중인 어플리케이션 또는 윈도우를 가상 영역에 표시할 수 있다. 일 실시예에 따른 전자 장치(400)는 제2 외부 장치(700)에서 실행중인 어플리케이션 또는 윈도우에 대한 제어를 전자 장치(400) 사용자의 제스처 입력을 통해 수행할 수 있다. 일 실시예에 따른 전자 장치(400)는 제2 외부 장치(700)에서 실행중인 어플리케이션 또는 윈도우에 대한 제어를 제2 외부 장치(700)로부터 I/O 정보(예: 마우스 커서의 위치 정보 등)을 공유 받아 마우스 포인터 또는 커서를 가상영역에 표시할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 제2 외부 장치(700)의 어플리케이션 또는 윈도우의 깊이(depth) 정보를 갖고 표시할 수 있다. 예를 들면, 전자 장치(400)는 가장 최근에 갱신한 어플리케이션 또는 또는 윈도우를 다른 어플리케이션들 대비 전자 장치(400)로부터 가장 가까운 거리의 가상영역에 표시할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 제2 외부장치(700)에서 실행 중인 문서를 마우스로 드래그하여 제2 외부장치(700)의 스크린 경계영역 밖으로 이동시키는 경우, 제2 외부장치(700)의 스크린 경계영역을 벗어나는 순간 해당 문서를 가상 객체로 변환하여 생성할 수 있다. 전자 장치(400)는 생성된 문서 가상 객체를 드롭하는 영역에 고정하여 표시할 수 있다.

본 발명의 일 실시예에 따른 서버(500)는 전자 장치(400)의 모듈 중 일부를 포함할 수 있다. 일 실시예에 따른 서버(500)는 전자 장치(400)를 포함한 장치와 데이터를 송수신할 수 있다.

본 발명의 일 실시예에 따른 제1 외부 장치(600)는 제어부(610), 사용자 입력 처리부(620) 및 통신부(630)를 포함할 수 있다. 일 실시예에 따른 제1 외부 장치(600)는 이동 단말기 등일 수 있다.

일 실시예에 따른 제1 외부 장치(600)의 사용자 입력 처리부(620)는 제1 외부 장치(600)에서 감지되는 사용자 입력(예: 터치 입력 등)이 감지되는 경우, 감지된 사용자 입력에 대응하는 신호를 제어부(610)에 전달할 수 있다.

일 실시예에 따른 제1 외부 장치(600)의 제어부(610)는 통신부(630)를 통해 전자 장치(400)와 제2 외부 장치(700)와의 연결을 수행할 수 있다.

본 발명의 일 실시예에 따른 제2 외부 장치(700)는 제어부(710), 사용자 입력 처리부(720) 및 통신부(730)를 포함할 수 있다. 제2 외부 장치(700)는 일정한 크기를 갖는 스크린을 포함하는 장치일 수 있다.

일 실시예에 따른 제2 외부 장치(700)의 사용자 입력 처리부(720)는 제2 외부 장치(700)에서 감지되는 사용자 입력(예: 키보드 입력, 마우스 입력 등)이 감지되는 경우, 감지된 사용자 입력에 대응하는 신호를 제어부(710)에 전달할 수 있다.

일 실시예에 따른 제2 외부 장치(700)의 제어부(710)는 통신부(730)를 통해 전자 장치(400)와 제2 외부 장치(700)와의 연결을 수행할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 가상 객체를 표시할 수 있다. 여기서 가상 객체는 전자 장치(400)에 의해 렌더링 되어 전자 장치(400) 사용자에게 보여지는 객체를 의미할 수 있다. 예를 들면, 전자 장치(400)가 가상의 스크린을 생성하고, 해당 스크린에 영화 컨텐츠를 상영하는 경우 생성된 스크린은 가상 객체일 수 있다. 가상 객체와 달리 현실 객체란 실제 현실에 존재하는 객체를 의미할 수 있다. 예를 들어, 방과 같은 환경을 생각해보면 책상, 의자, 책장 등의 가구나 텔레비전, 오디오 등의 가전 제품 등은 현실 객체일 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 현실의 객체와 가상의 객체를 혼합하여 보여줄 수 있다. 일 실시예에 따른 전자 장치(400)는 현실 객체에 오버랩 되어 가상 객체를 표시할 수 있다.

전자 장치(400)가 제공할 수 있는 증강 현실(AR: Augmented Reality) 기능 다양한 기능을 제공할 수 있다. 증강 현실 기능 수행 시 현실객체와 가상 객체는 다양한 상관관계를 가질 수 있다. 일 실시예에 따른 가상 객체는 현실 객체와 같은 공간에서 현실 객체와 동일한 물리법칙을 적용 받으며 하나의 현실 객체처럼 존재 할 수 있다. 예를 들면, 방에 쇼파와 그 앞에 배치된 가상의 테이블이 있으면, 전자 장치(400) 사용자의 위치에 따라 사용자가 보는 쇼파의 부분이 달라지듯이, 가상객체 테이블도 사용자의 위치에 따라 실제 테이블이 있는 것처럼 스케일 등을 렌더링할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 가상 객체와 현실 객체를 오버랩하여 표시할 수 있다. 예를 들면, 전자 장치(400)가 시스루(see-through) 안경인 경우, 가상 스크린을 우측 상단에 위치시킨 후 별도의 미디어 컨텐츠를 재생할 때 해당 가상 스크린은 실제 사물이 시야에 있더라도 상관없이 해당 객체를 오버랩하여 표시되도록 제어할 수 있다.

본 발명의 일 실시예에 따른 가상 객체와 현실 객체는 특정한 상관 관계를 갖을 수 있다. 예를 들면, 현실 객체인 테이블과 가상 객체인 테이블 관련 정보 창이 있을 때, 가상 객체인 테이블 관련 정보는 테이블의 가격과 브랜드 크기 등의 부가 정보를 표시할 수 있다. 추가적인 실시예에 따르면, 상기 테이블과 해당 정보창은 사용자의 시선에서 오버랩 되지 않도록 상호 위치를 고려하여 가상 객체를 표시할 수 있다.

예를 들어, 사용자는 전자 장치(400)를 장착하고 방에 들어갈 수 있다. 이 때, 현실 객체인 테이블 창문, 전등, 문 등이 표시되고, 가상 객체들이 현실 객체와 함께 표시될 수 있다. 예를 들면, 가상 객체는 전자 장치(400)와의 통신을 통해 연결된 또 다른 장치의 통화 상대방 얼굴일 수 있다.

본 발명의 일 실시예에 따른 가상 객체는 또 다른 전자장치로부터 수신한 사용자의 위치 정보 또는 시선 정보에 기반하여 상기 또 다른 전자 장치로 전달할 영상을 렌더링할 수 있다. 상기 렌더링의 전체 또는 일부는 상기 또 다른 전자 장치에서 수행될 수 있다.

본 발명의 일 실시예에 따른 가상 객체들의 일부는 전자 장치(400) 사용자의 위치 정보 또는 시선 정보에 기반하여 표시될 수 있다. 일 실시예에 따른 가상 객체들의 일부는 객체 위치, 크기, 회전각, 기울기, 색상 등의 속성을 포함할 수 있다. 예를 들면, 가상 영역에서 표시되는 책꽂이 위쪽에 표시된 인덱싱 정보 객체는 전자 장치(400) 사용자의 시선 정보에 기반하여 회전각 및 기울기 속성이 변경되어 사용자가 인덱싱 정보 객체를 바라보는 위치, 각도에 무관하여 같은 평면을 보도록 표시될 수 있다. 상기 인덱싱 정보 객체의 위치 정보는 사용자 위치 또는 시선 정보와 무관하게 가상 영역에서 일정한 값을 갖을 수 있다.

본 발명의 일 실시예에 따른 가상 객체들의 일부는 전자 장치(400) 사용자의 위치 정보 또는 시선 정보에 무관하게 표시될 수 있다. 상기 사용자의 위치 또는 시선 정보에 영향 받지 않는 가상 객체들은 가상 공간에 포함된 가상 객체이거나 현실 객체일 수 있다.

일 실시예에 따른 위치 또는 시선 정보에 영향 받지 않는 가상 객체는 또 다른 전자 장치(예: 클라이언트 단말, 외부 서버 등)에서 생성되어 사용자에게 제공되는 정보일 수 있다. 일 실시예에 따른 영상 객체는 가상 공간 서버에서 동작되는 3D렌더링부와 독립적으로 영상이 처리될 수 있다. 예를 들면, 3D 렌더링부에서 렌더링된 영상 정보를 클라이언트 단말에서 수신한 후 클라이언트 단말에서 생성된 영상 객체를 렌더링된 영상 정보에 혼합하여 표시될 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 전자 장치(400) 또는 전자 장치(400)와 연결된 또 다른 기기들을 이용하여 전자 장치(400) 사용자의 주변 환경을 인식할 수 있다. 여기서 환경 정보는 카메라(예: 깊이(depth) 카메라, 적외선(IR: Infrared) 카메라 등)을 통해 획득할 수 있는 비디오 정보, 객체들의 거리 정보 등을 포함할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 무선 통신 기술을 통해 사용자 주위의 전파 정보 등을 인식할 수 있다. 상기 전파 정보는 전자 장치(400) 근처에 있는 기기들 등의 위치 정보 역할 정보들을 포함할 수 있다. 예를 들면, GPS나 실내 측위 기술 등을 통해 위치 정보 등을 획득할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 센서나 타 기기와의 정보 교환 등으로 얻은 환경 정보를 기반으로 전자 장치(400) 사용자 주위의 객체들을 인식하고 분석할 수 있다. 일 실시예에 따른 전자 장치(400)의 분석은 전자 장치(400) 독립적으로도 가능하고 또 다른 전자 장치(예: 서버) 등과의 연산 혹은 데이터를 공유하여 진행할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 상기 분석을 통해 전자 장치(400) 사용자 주위의 현실 객체의 특징 정보, 예를 들면, 위치, 사용 용도, 모델명, 구성 물질, 모양, 색, 근거리 통신 모듈의 유무, 전파 세기 등의 물리적 전자적 추가 정보를 인식할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 현실 객체에 가상 객체 혹은 전자 장치(400)의 특정 기능 사이에 현실 객체의 특징 정보를 바탕으로 한 연관관계를 형성할 수 있다. 예를 들면, 책상 위에 있는 현실 객체인 연필에 가상 객체인 메모 어플리케이션 창을 매핑하게 되면, 전자 장치(400)는 연필의 특성(예: 색, 모양, 길이 등)을 파악하고 이를 통해 해당 연필에 메모 어플리케이션 창을 연결하여, 연필을 움직이면 가상 객체인 메모창이 연필의 움직임을 따라 같이 움직이는 등의 동작을 수행할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 현실 객체를 스캔하고 현실 객체의 용도를 파악할 수 있다. 일 실시예에 따른 전자 장치(400)는 현실 객체의 용도에 기반하여 가상 객체를 현실 객체의 표면이나 현실 객체의 근접한 위치에 배치할 수 있다. 예를 들어 일 실시예에 따른 가상 객체는 사용자 터치, 클릭, 또는 전자 장치(400) 사용자의 시선 인식에 의하여 사용자 입력을 인식할 수 있다. 전자 장치(400)는 인식된 사용자 입력을 통해 전자 장치(400)의 기능 수행, 또는 전자 장치(400)와 연결된 다른 기기의 기능을 제어할 수 있다. 이때, 가상 객체 아이콘의 배치는 사용자가 지정할 수 있고, 전자 장치(400) 기기에서 초기 위치를 지정할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 전자 장치(400) 사용자의 방을 스캔한 후 영상 정보를 통해 책장, TV, 오디오, 테이블 등이 전자 장치(400) 사용자 주변에 있음을 인식할 수 있다. 일 실시예에 따른 전자 장치(400)는 인식 후에 현실 객체 중 책장의 용도가 책 등의 보관에 쓰인다는 것을 인식하고, E-book과 관련된 인터페이스나 E-book 아이콘 등을 책장의 위 또는 책장의 근처에 표시할 수 있다. 추가적인 실시예에 따른 전자 장치(400)는 테이블 위에는 테이블 게임이나 게임 트로피와 같은 관련된 가상 객체를 배치하거나, 오디오의 옆에 볼륨 조절과 같은 미디어 관련 가상 객체를 배치 할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 주위 환경의 전파 신호(507)를 수신할 수 있다. 본 발명의 일 실시예에 따른 전자 장치(400)는 사용자 주위 환경을 시각적인 센서 외에 전파적인 신호를 인식하는 센서를 통해서 인식할 수 있다. 일 실시예에 따른 전자 장치(400)는 또 다른 전자 기기의 위치를, 전파적인 신호에 기반하여 인식할 수 있다. 전자 장치(400)는 인식된 또 다른 전자 기기와 관련성 있는 가상 객체를 해당 기기와 근접한 위치에 배치 할 수 있다.

예를 들어, 블루투스와 같은 근거리 통신모듈을 수행하는 네트워크 기기가 있을 경우, 해당 기기와 전자 장치(400)와의 통신을 통해 얻는 위치 정보와 컨텐츠 정보를 기반으로 가상 객체를 배치 할 수 있다. 전자 장치(400)는 근거리 통신(예: 블루투스(Blueetooth) 등) 연결을 통해 오디오 기기의 설정 정보와 위치 정보를 기반으로, 오디오 기기의 볼륨을 조절하는 기능을 제공하는 가상 객체를 해당 실제 오디오 기기의 위나 근접한 공간에 표시할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 가상 객체를 가상 영역에 표시할 수 있다. 본 발명의 일 실시예에 따른 전자 장치(400)의 센서를 이용해 획득한 정보를 기반으로 획득한 센싱 정보와 현실 객체를 연동하여 가상 객체를 배치할 수 있다. 예를 들면 전자 장치(400) 사용자의 시선 정보의 수집을 통해 특정 공간에서 가장 시선이 많이 머무르는 공간에 메모장이나 알람 기능을 하는 가상 객체를 배치 할 수 있다. 추가적인 예를 들면, 시간 정보나 장소 정보를 전자 장치(400)의 센서로 스캔 하여 해당 장소나 시간에 맞도록 가상 객체를 재배치하거나 보여지는 방법을 다르게 할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 전자 장치(400)의 센서로부터 획득된 센싱 정보와 현실 객체의 특성정보를 혼합하여 가상 객체를 배치할 수 있다. 예를 들면, 전자 장치(400)는 전자 장치(400) 사용자의 시선 정보의 수집을 통해 특정 공간에서 가장 시선이 많이 머무르는 공간을 파악할 수 있다. 추가적인 예를 들면, 전자 장치(400)는 가상 객체를 표시 하기 좋은 현실 객체를 물리적 특성 등에 기반하여 파악하고 이를 통해 가장 적합한 거실 벽과 같은 공간에 가상 스크린을 배치 할 수 있다. 추가적인 예를 들면, 전자 장치(400)는 해당 정보에 더하여 가상 객체나 어플리케이션의 종류와 특성에 관련된 추가적인 요소로 같이 고려하여 배치할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 지원 하는 기능을 현실객체의 특정 부분 또는 현실 객체 또는 전자 장치(400) 자체에 매핑할 수 있다. 예를 들어 실제 연필의 하단 연필 촉 부분에 스타일러스의 쓰기 기능을 매핑하고 연필의 다른 끝 부분에 스타일러스의 지우개 기능을 매핑 할 수 있다. 위와 같이 기능 매핑이 된 후에는 연필을 전자 장치(400)를 통해 스타일러스 도구로 사용할 수 있다.

일 실시예에 따른 물리적인 현실 객체인 연필의 기능을 가상 세계로 확장하여 가상 세계의 특정 기능을 담당할 수 있는 도구로 사용할 수 있다. 예를 들면, 빗자루를 가상 세계 테니스 게임 등에서 테니스 라켓으로 매핑 하여 사용할 수 있다. 일 실시예에 따른 전자 장치(400)는 빗자루를 인식하고 물리적, 전파적 특징을 통해 해당 현실 객체를 특정 지어 정의하고 해당 빗자루에 게임 컨트롤러의 기능을 부여할 수 있다. 상기 예에서 연필이나 빗자루는 스타일러스나 게임 컨트롤러 역할을 하기 위한 어떠한 전자적 장치를 가지고 있지 않지만 전자 장치(400)를 통해 특정 부위에 특정 기능을 부여 받아 사용 할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 가상 객체를 현실 객체와 결합한 형태로 표시할 수 있다.

예를 들어, 바퀴와 컨트롤러 등으로 구성된 BASE 형태의 로봇이 있으면 로봇의 팔과 얼굴 부분을 가상으로 생성하여 이를 BASE 형태의 로봇과 결합하여 하나의 객체처럼 사용 할 수 있다. 일 실시예에 따른 가상의 객체에 특정 기능을 매핑 하여 사용자의 컨트롤 용이성을 높일 수 있다. 예를 들면 나무 조각에 전자 장치(400)를 통해 리모콘 기능을 매핑 할 수 있다. 이때 전자 장치(400)는 가상객체로 버튼들을 나무 토막에 오버랩 시켜서 사용자가 해당 나무 조각을 리모콘을 사용할 때 실제 현실 객체에는 버튼이 없어도 현실 객체에 오버랩 된 버튼을 사용하여 리모콘 기능을 보다 원활하게 수행 할 수 있다.

본 발명의 일 실시예에 따른 가상 객체는 버튼뿐 아니라 근접 거리에 위치하여 아래 그림과 같이 사용자가 조정 가능한 컨트롤러 기능이나, 부가 정보 표시창 등의 전자 장치(400)와 연관된 부분을 수행 할 수 있게 해줄 수 있다. 이때 매핑된 정보는 전자 장치(400) 자체의 기능을 제어하는 것뿐 아니라 전자 장치(400)와 연결되어 제어가 가능한 외부기기들의 기능도 포함할 수 있다. 예를 들면 방의 온도나 습도를 조정하거나, 전자 장치(400)와 연결된 비디오 기기들의 볼륨을 조절하는 등이 있을 수 있다.

일 실시예에 따른 전자 장치(400)는 현실 사물이 아무 기능이 없는 기기가 아니라 특정 전자 장치를 가진 기계 혹은 제품일 경우에도 기능의 매핑을 수행할 수 있다. 이 경우에 기능의 매핑은 기존의 현실에 존재하는 기기가 가지고 있는 기능을 제어 하는 것에 더하여 전자 장치(400)와의 융합을 통해 기존 현실 기기의 기능을 확장하는 용도로 사용 가능할 수 있다. 예를 들면, 조도가 조정 가능한 무선 인터페이스를 가진 실내등이 있는 경우 사용자는 전자 장치(400)를 통해서 조도의 조정이 가능한 인터페이스를 현실의 실내등에 매핑 하고 실내등에 손을 댈 경우 단계적으로 조도가 변하도록 전자 장치(400)에 세팅 할 수 있다. 이때 전자 장치(400)는 사용자가 현실 사물을 터치하는 것을 인식하고 동시에 실내등과 연결되어 실제로 실내등이 조도의 변화를 줄 수 있도록 컨트롤 신호를 전송 할 수 있다. 실제 실내등의 작동이 특정한 색의 빛만 표현 할 수 있는 경우 전자 장치(400)는 랜더링을 통해 표현 실제 실내등이 표현 할 수 없는 빛으로까지 기능을 확장 할 수 있도록 가상 공간에 효과를 줄 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 통신부(440), 및 상기 통신부와 전기적으로 연결된 프로세서(410)를 포함하고, 상기 프로세서(410)는, 적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신하고, 상기 적어도 하나의 외부 장치의 어플리케이션을 표시하기 위한 기준이 되는 스크린의 외형을 인식하고, 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역에, 상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시하도록 설정될 수 있다.

본 발명의 일 실시예에 따른 프로세서(410)는, 상기 인식된 스크린의 크기 정보 및 상기 스크린의 화면 정보 중 적어도 어느 하나의 정보를 기반으로 상기 가상 객체를 표시하도록 설정될 수 있다. 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역은, 상기 적어도 하나의 외부 장치의 어플리케이션을 표시하는 스크린의 물리적 경계선 영역으로부터 설정된 거리 이내의 가상 영역일 수 있다.

본 발명의 일 실시예에 따른 상기 프로세서(410)는 상기 적어도 하나의 외부 장치의 백그라운드에서 실행중인 어플리케이션을 기반으로 가상 객체를 표시하도록 설정될 수 있다. 상기 프로세서(410)는, 상기 적어도 하나의 외부 장치로부터 상기 어플리케이션 관련 정보가 갱신됨에 따른 변경 신호를 수신하는 경우 상기 수신한 변경 신호를 기반으로 상기 표시된 가상 객체를 갱신하고, 상기 가상 객체에 대해 상기 적어도 하나의 외부 장치의 일 입력 장치를 통한 입력 이벤트가 감지되는 경우 상기 감지된 입력 이벤트에 대응하여 상기 가상 객체가 갱신되도록 설정될 수 있다.

본 발명의 일 실시예에 따른 상기 프로세서(410)는, 제1 외부 장치(600)에 포함된 어플리케이션 정보를 기반으로 가상 객체를 표시하고, 상기 스크린을 포함하는 제2 외부 장치(700)의 입력장치를 통해 상기 가상 객체에 포함된 이미지 아이템에 대한 입력 이벤트를 감지하고, 상기 감지된 입력 이벤트를 기반으로 상기 제2 외부 장치(700)의 스크린 화면에 상기 이미지 아이템에 대응하는 어플리케이션을 표시하도록 상기 제2 외부 장치(700)로 관련 신호를 전송하도록 설정될 수 있다.

본 발명의 일 실시예에 따른

상기 프로세서(410)는, 상기 제2 외부 장치(700)의 스크린 화면에 표시된 일 아이템을 상기 가상 객체로 이동하는 입력 이벤트가 감지되는 경우, 상기 제1 외부 장치(600)로 관련 신호를 전송하도록 설정될 수 있다.

본 발명의 일 실시예에 따른 상기 프로세서(410)는, 상기 인식된 스크린의 크기 대비 확장된 크기를 갖는 가상 확장 스크린을 가상 영역에 표시하도록 설정될 수 있다. 상기 프로세서(410)는, 서로 다른 깊이(depth) 정보를 갖는 복수의 가상 확장 스크린을 표시하도록 설정될 수 있다. 상기 각각의 가상 확장 스크린에 표시되는 가상 객체는, 어플리케이션의 종류 및 미리 설정된 가상 객체 배열 정보 중 적어도 어느 하나를 기반으로 표시될 수 있다.

도 5는 본 발명의 다양한 실시예에 따른 전자 장치(400)의 가상 객체의 표시를 도시한다.

도 5를 참조하면, 본 발명의 다양한 실시예에 따른 전자 장치(400)는 가상 객체를 표시할 수 있다.

본 발명의 다양한 실시예에 따른 전자 장치(400)는 안경 형태로 카메라(460, 예: 뎁스 카메라, IR 카메라, 고해상도 카메라 등)가 실장될 수 있다. 제1 외부 장치(600)는 휴대 단말일 수 있고, 제2 외부 장치(700)는 스크린을 갖는 퍼스널 컴퓨터(PC: Personal Computer)일 수 있다.

본 발명의 다양한 실시예에 따른 전자 장치(400)는 제1 외부 장치(600)에서 백그라운드에서 실행중인 어플리케이션(601)을 제2 외부 장치(700)의 스크린 외형으로부터 설정된 거리 이내인 가상 영역에 가상 객체(401)를 표시할 수 있다.

본 발명의 다양한 실시예에 따른 전자 장치(400)는 제1 외부 장치(600)에서 알림 메시지(예: push 메시지 등)가 수신되는 경우, 수신한 알림 메시지에 대응하는 가상 객체들(403)을 가상 영역에 표시할 수 있다.

본 발명의 일 실시예에 따른 가상 객체들(401, 403)은 제2 외부장치(700)의 스크린 크기, 스크린이 표시 중인 해상도 정보, 스크린이 표시중인 폰트 크기 등을 기반으로 표시될 수 있다.

도 6a 및 도 6b는 본 발명의 다양한 실시예에 따른 전자 장치(400)는 가상 객체를 표시할 수 있다.

도 6a를 참조하면, 제1 외부 장치(600)에서 새로운 이벤트(예: 문자 메시지 수신, SNS 업데이트, 커뮤니케이션 어플리케이션 업데이트 등)가 발생하는 경우, 전자 장치(400)는 현재 표시 중인 가상 객체를 변경할 수 있다. 예를 들어, 전자 장치(400)는 제1 외부 장치(600)에서 문자 어플리케이션의 갱신이 발생한 경우, 각 어플리케이션을 기반으로 표시중인 가상 객체들(401)의 순서를 변환하여, 최근에 갱신된 문자 어플리케이션의 가상 객체를 가장 앞쪽에 표시되도록 가상 객체들(401)의 배치를 변경할 수 있다.

도 6b를 참조하면, 전자 장치(400)에서 표시 중인 가상 객체들(401) 중 일 가상 객체(407)에 대한 입력 이벤트가 감지되는 경우, 제2 외부 장치(700)는 제2 외부 장치(700)의 스크린에 가상 객체(407)에 대응하는 어플리케이션을 화면에 표시할 수 있다. 일 가상 객체(407)에 대한 입력 이벤트가 감지되는 경우, 제1 외부 장치(600)은 제2 외부 장치(700)로 일 가상 객체(407)에 대응하는 어플리케이션 관련 정보를 제2 외부 장치(700)로 전달할 수 있다.

예를 들면, 제2 외부 장치(700)의 입력 장치(예: 마우스 등)를 이용하여 일 가상 객체(407)를 선택하고, 입력 이벤트(예: 드래그 앤 드롭 이벤트, 더블 클릭 등)가 감지되는 경우, 제2 외부 장치(700)는 스크린에 일 가상 객체(407)에 대응하는 어플리케이션을 표시할 수 있다. 추가적인 예를 들면, 전자 장치(400)의 사용자 제스처 정보(예: 움직임 정보, 터치 입력 정보, 터치 스와이프 입력 정보 등)등을 기반으로, 제2 외부 장치(700)는 스크린에 일 가상 객체(407)에 대응하는 어플리케이션을 표시할 수 있다.

도 7a 및 도 7b는 본 발명의 다양한 실시예에 따른 전자 장치(400)의 가상 확장 스크린을 도시한다.

도 7a를 참조하면, 전자 장치(400)는 제2 외부 장치(700)의 스크린 대비 보다 확장된 가상 확장 스크린(409)을 표시할 수 있다. 일 실시예에 따른 전자 장치(400)는 가상 확장 스크린(409)에 가상 객체(411)를 표시할 수 있다. 가상 확장 스크린의 크기는 제2 외부 장치(700)의 스크린 크기 가로 및 세로길이 대비 1.5배, 3배, 4배 등이 될 수 있으며, 사용자에 의해 지정되거나 변경될 수 있다. 일 실시예에 따른 상기 가상 확장 스크린(409)에 표시되는 가상 객체(411)는 제2 외부 장치(700)의 디스플레이 해상도, 표시되는 컨텐츠의 속성(예: 폰트, 크기, 종류 등)에 기반하여 표시될 수 있다.

도 7b를 참조하면, 전자 장치(400)는 제2 외부 장치(700)의 스크린 대비 보다 확장되고 서로 다른 깊이(depth) 정보를 갖는 복수의 가상 확장 스크린들(413, 415, 417)을 계층적으로 표시할 수 있다. 일 실시예에 따른 각각의 가상 확장 스크린들(413, 415, 417)은 가상 객체(411)을 표시할 수 있다.

본 발명의 일 실시예에 따른 각각의 가상 확장 스크린들(413, 415, 417)에 표시되는 가상 객체는 어플리케이션의 종류 및 미리 설정된 가상 객체 배열 정보를 기반으로 서로 달리 표시될 수 있다.

예를 들면, 제1 가상 확장 스크린(413)에는 커뮤니케이션 관련 가상 객체들(예: SNS 어플리케이션, 문자 어플리케이션 등)을 표시하고, 제2 가상 확장 스크린(415)에는 일 관련 가상 객체들(예: 문서 관련 어플리케이션 등)을 표시하고, 제3 가상 확장 스크린(417)에는 사용자 관심 관련 가상 객체들(예: 쇼핑 어플리케이션, 맛집 어플리케이션 등)을 표시할 수 있다. 추가적인 예를 들면, 어플리케이션이 요구하는 프로세서 속도값 또는 해상도 요구값(예: 3D 게임 어플리케이션 대비 메모 어플리케이션 등)에 의해서도 각각의 가상 확장 스크린들(413, 415, 417)이 표시하는 가상 객체들이 구분되어 표시될 수 있다.

도 8a 및 도 8b는 본 발명의 다양한 실시예에 따른 전자 장치(400)의 가상 객체의 표시를 도시한다.

도 8a를 참조하면, 전자 장치(400)는 가상 메신저 객체(419)를 가상 영역에 표시할 수 있다. 일 실시예에 따른 전자 장치(400)는 가상 메신저 객체(419)를 실제 머그컵(421)의 위치를 기반으로 표시할 수 있다. 예를 들어, 전자 장치(400)는 가상 메신저 객체(419)를 실제 머그컵(421)의 주변에 표시할 수 있다. 추가적인 예를 들면, 전자 장치(400)는 실제 머그컵(421)이 움직이는 경우, 가상 메신저 객체(419)도 이에 상응하게 이동하여 표시할 수 있다. 추가적인 예를 들면, 전자 장치(400)는 가상 메신저 객체(419) 표시 시 실제 머그컵(421)의 위치는 초기 공간 좌표 값으로만 활용하고, 그 이후에는 실제 머그컵(421)과 독립적으로 가상 메신저 객체(419)를 이동하여 표시할 수 있다.

도 8b를 참조하면, 전자 장치(400)는 홀로그램 가상 객체(423)를 표시할 수 있다. 일 실시예에 따른 전자 장치(400)는 일 객체(예: 자동차 이미지, 물체 이미지 등)가 3D 정보를 갖고 있는 경우 홀로그램 형태로 가상영역에 표시할 수 있다. 일 실시예에 따른 전자 장치(400)는 제2 외부 장치(700)의 스크린에 표시중인 객체를 이동 입력 이벤트에 따라 가상 영역에 표시하는 경우, 상기 객체를 홀로그램으로 표시할 수 있다.

도 9는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체의 표시를 도시한다.

도 9를 참조하면, 전자 장치(400)는 가상 객체를 표시할 가상 영역을 설정하고, 설정된 가상 영역에 가상 객체를 표시할 수 있다.

901을 참조하면, 전자 장치(400)의 깊이 카메라(460)를 통해 공간 정보를 획득할 수 있다. 일 실시예에 따른 깊이 카메라(460)는 제2 외부 장치(700)의 스크린 외형을 인식할 수 있다.

903 및 905를 참조하면, 전자 장치(400)는 제1 외부 장치(600)의 어플리케이션을 기반으로 하는 가상 객체를 표시할 가상 영역을 설정할 수 있다. 전자 장치(400)는 제2 외부 장치(700)의 스크린의 물리적 경계면으로부터 설정된 거리 이내의 가상 영역을 가상 객체를 표시할 영역으로 결정할 수 있다. 전자 장치(400)는 결정된 가상 영역에 어플리케이션을 기반으로 하는 가상 객체(423)을 제2 외부 장치(700)의 스크린 옆에 표시할 수 있다.

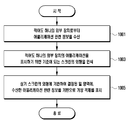

도 10은 본 발명의 다양한 실시예에 따른 전자 장치(400)의 가상 객체를 표시하는 순서도를 도시한다.

1001을 참조하면, 전자 장치(400)는 적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신할 수 있다. 일 실시예에 따른 전자 장치(400)는 인식된 상기 스크린의 크기 정보 및 상기 스크린의 화면 정보 중 적어도 어느 하나의 정보를 기반으로 상기 가상 객체를 표시할 수 있다.

1003을 참조하면, 전자 장치(400)는 적어도 하나의 외부 장치의 어플리케이션을 표시하기 위한 기준이 되는 스크린의 외형을 인식할 수 있다.

1005를 참조하면, 전자 장치(400)는 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역에, 상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시할 수 있다. 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역은, 상기 적어도 하나의 외부 장치의 어플리케이션을 표시하는 스크린의 물리적 경계선 영역으로부터 설정된 거리 이내의 가상 영역일 수 있다.

일 실시예에 따른 전자 장치(400)는 상기 적어도 하나의 외부 장치의 백그라운드에서 실행중인 어플리케이션을 기반으로 가상 객체를 표시할 수 있다.

도 11은 본 발명의 다양한 실시예에 따른 전자 장치(400)의 가상 객체를 표시하는 순서도를 도시한다.

1101을 참조하면, 전자 장치(400)는 적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신할 수 있다. 일 실시예에 따른 전자 장치(400)는 인식된 상기 스크린의 크기 정보 및 상기 스크린의 화면 정보 중 적어도 어느 하나의 정보를 기반으로 상기 가상 객체를 표시할 수 있다.

1103을 참조하면, 전자 장치(400)는 적어도 하나의 외부 장치의 어플리케이션을 표시하기 위한 기준이 되는 스크린의 외형을 인식할 수 있다.

1105를 참조하면, 전자 장치(400)는 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역에, 상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시할 수 있다. 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역은, 상기 적어도 하나의 외부 장치의 어플리케이션을 표시하는 스크린의 물리적 경계선 영역으로부터 설정된 거리 이내의 가상 영역일 수 있다.

1107을 참조하면, 전자 장치(400)는 적어도 하나의 외부 장치로부터, 어플리케이션 관련 정보가 갱신됨에 따른 변경 신호를 수신하는 경우, 수신한 변경 신호를 기반으로 표시된 가상 객체를 갱신할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 가상 객체에 대해 상기 적어도 하나의 외부 장치의 일 입력 장치를 통한 입력 이벤트가 감지되는 경우 상기 감지된 입력 이벤트에 대응하여 상기 가상 객체가 갱신되도록 제어할 수 있다.

도 12는 본 발명의 다양한 실시예에 따른 전자 장치의 가상 객체를 표시하는 순서도를 도시한다.

1201을 참조하면, 전자 장치(400)는 적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신할 수 있다. 일 실시예에 따른 전자 장치(400)는 인식된 상기 스크린의 크기 정보 및 상기 스크린의 화면 정보 중 적어도 어느 하나의 정보를 기반으로 상기 가상 객체를 표시할 수 있다. 상기 적어도 하나의 외부 장치는 제1 외부 장치(600)일 수 있다.

1203을 참조하면, 전자 장치(400)는 적어도 하나의 외부 장치의 어플리케이션을 표시하기 위한 기준이 되는 스크린의 외형을 인식할 수 있다. 상기 적어도 하나의 외부 장치는 제2 외부 장치(700)일 수 있다.

1205를 참조하면, 전자 장치(400)는 제1 외부 장치(600)에 포함된 어플리케이션 정보를 기반으로 가상 객체를 표시할 수 있다.

1207을 참조하면, 전자 장치(400)는 상기 스크린을 포함하는 제2 외부 장치(700)의 입력 장치를 통해 가상 객체에 포함된 이미지 아이템에 대한 입력 이벤트를 감지할 수 있다.

1209를 참조하면, 전자 장치(400)는 감지된 입력 이벤트를 기반으로 제2 외부 장치(700)의 스크린 화면에 이미지 아이템에 대응하는 어플리케이션을 표시하도록 제2 외부 장치(700)로 관련 신호를 전송할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 인식된 스크린의 크기 대비 확장된 크기를 갖는 가상 확장 스크린을 가상 영역에 표시할 수 있다. 일 실시예에 따른 전자 장치(400)는 서로 다른 깊이(depth) 정보를 갖는 복수의 가상 확장 스크린을 표시할 수 있다. 각각의 가상 확장 스크린에 표시되는 가상 객체는, 어플리케이션의 종류 및 미리 설정된 가상 객체 배열 정보 중 적어도 어느 하나를 기반으로 표시될 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신하는 동작, 상기 적어도 하나의 외부 장치의 어플리케이션을 표시하기 위한 기준이 되는 스크린의 외형을 인식하는 동작, 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역에, 상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시하는 동작, 상기 전자 장치를 통해, 인식된 상기 스크린의 크기 정보 및 상기 스크린의 화면 정보 중 적어도 어느 하나의 정보를 기반으로 상기 가상 객체를 표시하는 동작 중 적어도 어느 하나의 동작을 수행할 수 있다. 일 실시예에 따른 상기 인식된 스크린의 외형에 기반하여 결정된 일 영역은,

상기 적어도 하나의 외부 장치의 어플리케이션을 표시하는 스크린의 물리적 경계선 영역으로부터 설정된 거리 이내의 가상 영역일 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 상기 적어도 하나의 외부 장치의 백그라운드에서 실행중인 어플리케이션을 기반으로 가상 객체를 표시하는 동작, 상기 적어도 하나의 외부 장치로부터 상기 어플리케이션 관련 정보가 갱신됨에 따른 변경 신호를 수신하는 경우 상기 수신한 변경 신호를 기반으로 상기 표시된 가상 객체를 갱신하는 동작, 상기 가상 객체에 대해 상기 적어도 하나의 외부 장치의 일 입력 장치를 통한 입력 이벤트가 감지되는 경우 상기 감지된 입력 이벤트에 대응하여 상기 가상 객체가 갱신되도록 제어하는 동작 중 어느 하나의 동작을 수행할 수 있다.

본 발명의 일 실시예에 따른 전자 장치(400)는 제1 외부 장치에 포함된 어플리케이션 정보를 기반으로 가상 객체를 표시하는 동작, 상기 스크린을 포함하는 제2 외부 장치의 입력장치를 통해 상기 가상 객체에 포함된 이미지 아이템에 대한 입력 이벤트를 감지하는 동작, 상기 감지된 입력 이벤트를 기반으로 상기 제2 외부 장치의 스크린 화면에 상기 이미지 아이템에 대응하는 어플리케이션을 표시하도록 상기 제2 외부 장치로 관련 신호를 전송하는 동작, 상기 제2 외부 장치의 스크린 화면에 표시된 일 아이템을 상기 가상 객체로 이동하는 입력 이벤트가 감지되는 경우, 상기 제1 외부 장치로 관련 신호를 전송하는 동작, 상기 인식된 스크린의 크기 대비 확장된 크기를 갖는 가상 확장 스크린을 가상 영역에 표시하는 동작 중 적어도 어느 하나의 동작을 수행할 수 있다.

일 실시예에 따른 상기 각각의 가상 확장 스크린에 표시되는 가상 객체는, 어플리케이션의 종류 및 미리 설정된 가상 객체 배열 정보 중 적어도 어느 하나를 기반으로 표시될 수 있다. 본 발명의 일 실시예에 따른 전자 장치(400)는 서로 다른 깊이(depth) 정보를 갖는 복수의 가상 확장 스크린을 표시하는 동작을 수행할 수 있다.

본 문서에서 사용된 용어 "모듈"은 하드웨어, 소프트웨어 또는 펌웨어로 구성된 유닛을 포함하며, 예를 들면, 로직, 논리 블록, 부품, 또는 회로 등의 용어와 상호 호환적으로 사용될 수 있다. "모듈"은, 일체로 구성된 부품 또는 하나 또는 그 이상의 기능을 수행하는 최소 단위 또는 그 일부가 될 수 있다. "모듈"은 기계적으로 또는 전자적으로 구현될 수 있으며, 예를 들면, 어떤 동작들을 수행하는, 알려졌거나 앞으로 개발될, ASIC(application-specific integrated circuit) 칩, FPGAs(field-programmable gate arrays), 또는 프로그램 가능 논리 장치를 포함할 수 있다. 다양한 실시예에 따른 장치(예: 모듈들 또는 그 기능들) 또는 방법(예: 동작들)의 적어도 일부는 프로그램 모듈의 형태로 컴퓨터로 판독 가능한 저장 매체(예:메모리(130))에 저장된 명령어로 구현될 수 있다. 상기 명령어가 프로세서(예: 프로세서(120))에 의해 실행될 경우, 프로세서가 상기 명령어에 해당하는 기능을 수행할 수 있다. 컴퓨터로 판독 가능한 기록 매체는, 하드디스크, 플로피디스크, 마그네틱 매체(예: 자기테이프), 광기록 매체(예: CD-ROM, DVD, 자기-광 매체 (예: 플롭티컬 디스크), 내장 메모리 등을 포함할 수 있다. 명령어는 컴파일러에 의해 만들어지는 코드 또는 인터프리터에 의해 실행될 수 있는 코드를 포함할 수 있다. 다양한 실시예에 따른 모듈 또는 프로그램 모듈은 전술한 구성요소들 중 적어도 하나 이상을 포함하거나, 일부가 생략되거나, 또는 다른 구성요소를 더 포함할 수 있다. 다양한 실시예에 따른, 모듈, 프로그램 모듈 또는 다른 구성요소에 의해 수행되는 동작들은 순차적, 병렬적, 반복적 또는 휴리스틱하게 실행되거나, 적어도 일부 동작이 다른 순서로 실행되거나, 생략되거나, 또는 다른 동작이 추가될 수 있다.

101: 전자 장치

110: 버스

120: 프로세서 130: 메모리

150: 입출력 인터페이스 160: 디스플레이

170: 통신 인터페이스

120: 프로세서 130: 메모리

150: 입출력 인터페이스 160: 디스플레이

170: 통신 인터페이스

Claims (20)

- 전자 장치에 있어서,

통신부; 및

상기 통신부와 전기적으로 연결된 프로세서를 포함하고,

상기 프로세서는,

적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신하고,

상기 적어도 하나의 외부 장치의 어플리케이션을 표시하기 위한 기준이 되는 스크린의 외형을 인식하고,

상기 인식된 스크린의 외형에 기반하여 결정된 일 영역에, 상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시하도록 설정된 전자 장치. - 제1항에 있어서,

상기 프로세서는,

상기 인식된 스크린의 크기 정보 및 상기 스크린의 화면 정보 중 적어도 어느 하나의 정보를 기반으로 상기 가상 객체를 표시하도록 설정된 전자 장치. - 제1항에 있어서,

상기 인식된 스크린의 외형에 기반하여 결정된 일 영역은,

상기 적어도 하나의 외부 장치의 어플리케이션을 표시하는 스크린의 물리적 경계선 영역으로부터 일 거리 이내의 가상 영역인 것을 특징으로 하는 전자 장치. - 제1항에 있어서,

상기 프로세서는

상기 적어도 하나의 외부 장치의 백그라운드에서 실행중인 어플리케이션을 기반으로 가상 객체를 표시하도록 설정된 전자 장치. - 제1항에 있어서,

상기 프로세서는,

상기 적어도 하나의 외부 장치로부터 상기 어플리케이션 관련 정보가 갱신됨에 따른 변경 신호를 수신하는 경우 상기 수신한 변경 신호를 기반으로 상기 표시된 가상 객체를 갱신하고, 상기 가상 객체에 대해 상기 적어도 하나의 외부 장치의 일 입력 장치를 통한 입력 이벤트가 감지되는 경우 상기 감지된 입력 이벤트에 대응하여 상기 가상 객체가 갱신되도록 설정된 전자 장치. - 제1항에 있어서,

상기 프로세서는,

제1 외부 장치에 포함된 어플리케이션 정보를 기반으로 가상 객체를 표시하고,

상기 스크린을 포함하는 제2 외부 장치의 입력장치를 통해 상기 가상 객체에 포함된 이미지 아이템에 대한 입력 이벤트를 감지하고,

상기 감지된 입력 이벤트를 기반으로 상기 제2 외부 장치의 스크린 화면에 상기 이미지 아이템에 대응하는 어플리케이션을 표시 또는 실행하도록 상기 제2 외부 장치로 관련 신호를 전송 하도록 설정된 전자 장치. - 제6항에 있어서,

상기 프로세서는,

상기 제2 외부 장치의 스크린 화면에 표시된 일 아이템을 상기 가상 객체로 이동하는 입력 이벤트가 감지되는 경우, 상기 제1 외부 장치로 관련 신호를 전송하도록 설정된 전자 장치. - 제1항에 있어서,

상기 프로세서는,

상기 인식된 스크린의 크기 대비 확장된 크기를 갖는 가상 확장 스크린을 가상 영역에 표시하도록 설정된 전자 장치. - 제8항에 있어서,

상기 프로세서가,

서로 다른 깊이(depth) 정보를 갖는 복수의 가상 확장 스크린을 표시하도록 설정된 전자 장치. - 제9항에 있어서,

상기 각각의 가상 확장 스크린에 표시되는 가상 객체는,

어플리케이션의 종류 및 미리 설정된 가상 객체 배열 정보 중 적어도 어느 하나를 기반으로 표시되는 것을 특징으로 하는 전자 장치. - 제1항에 있어서,

상기 전자 장치는,

증강 현실(AR: Augmented reality)을 제공하는 씨 스루(see-through) 기능을 지원하는 디스플레이; 및

공간 정보 및 객체 정보 중 적어도 어느 하나의 정보를 포함하는 영상 정보를 인식할 수 있는 카메라 모듈 및 센서 모듈 중 적어도 어느 하나의 모듈을 더 포함하는 전자 장치. - 가상 객체를 표시하는 전자 장치의 어플리케이션 표시 방법에 있어서,

적어도 하나의 외부 장치로부터 어플리케이션 관련 정보를 수신하는 동작;

상기 적어도 하나의 외부 장치의 어플리케이션을 표시하기 위한 기준이 되는 스크린의 외형을 인식하는 동작; 및

상기 인식된 스크린의 외형에 기반하여 결정된 일 영역에, 상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시하는 동작을 포함하는 어플리케이션 표시 방법. - 제12항에 있어서,

상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시하는 동작은,

상기 전자 장치를 통해, 인식된 상기 스크린의 크기 정보 및 상기 스크린의 화면 정보 중 적어도 어느 하나의 정보를 기반으로 상기 가상 객체를 표시하는 동작을 포함하는 방법. - 제12항에 있어서,

상기 인식된 스크린의 외형에 기반하여 결정된 일 영역은,

상기 적어도 하나의 외부 장치의 어플리케이션을 표시하는 스크린의 물리적 경계선 영역으로부터 일 거리 이내의 가상 영역인 것을 특징으로 하는 방법. - 제12항에 있어서,

상기 수신한 어플리케이션 관련 정보를 기반으로 가상 객체를 표시하는 동작은,

상기 적어도 하나의 외부 장치의 백그라운드에서 실행중인 어플리케이션을 기반으로 가상 객체를 표시하는 동작을 포함하는 방법. - 제12항에 있어서,

상기 적어도 하나의 외부 장치로부터 상기 어플리케이션 관련 정보가 갱신됨에 따른 변경 신호를 수신하는 경우 상기 수신한 변경 신호를 기반으로 상기 표시된 가상 객체를 갱신하는 동작; 및

상기 가상 객체에 대해 상기 적어도 하나의 외부 장치의 일 입력 장치를 통한 입력 이벤트가 감지되는 경우 상기 감지된 입력 이벤트에 대응하여 상기 가상 객체가 갱신되도록 제어하는 동작을 더 포함하는 표시 방법. - 제12항에 있어서,

상기 가상 객체를 표시하는 동작은,

제1 외부 장치에 포함된 어플리케이션 정보를 기반으로 가상 객체를 표시하는 동작을 포함하고,

상기 스크린을 포함하는 제2 외부 장치의 입력장치를 통해 상기 가상 객체에 포함된 이미지 아이템에 대한 입력 이벤트를 감지하는 동작; 및

상기 감지된 입력 이벤트를 기반으로 상기 제2 외부 장치의 스크린 화면에 상기 이미지 아이템에 대응하는 어플리케이션을 표시 또는 실행하도록 상기 제2 외부 장치로 관련 신호를 전송하는 동작을 더 포함하는 방법. - 제17항에 있어서,

상기 제2 외부 장치의 스크린 화면에 표시된 일 아이템을 상기 가상 객체로 이동하는 입력 이벤트가 감지되는 경우, 상기 제1 외부 장치로 관련 신호를 전송하는 동작을 더 포함하는 표시 방법. - 제12항에 있어서,

상기 인식된 스크린의 크기 대비 확장된 크기를 갖는 가상 확장 스크린을 가상 영역에 표시하는 동작을 더 포함하는 방법. - 제19항에 있어서,

상기 가상 영역을 표시하는 동작은,

서로 다른 깊이(depth) 정보를 갖는 복수의 가상 확장 스크린을 표시하는 동작을 포함하는 방법.

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020150155577A KR102471977B1 (ko) | 2015-11-06 | 2015-11-06 | 복수의 전자장치 사이에서 가상 객체를 표시하는 방법 및 이를 지원하는 전자 장치 |

| US15/343,351 US10289376B2 (en) | 2015-11-06 | 2016-11-04 | Method for displaying virtual object in plural electronic devices and electronic device supporting the method |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020150155577A KR102471977B1 (ko) | 2015-11-06 | 2015-11-06 | 복수의 전자장치 사이에서 가상 객체를 표시하는 방법 및 이를 지원하는 전자 장치 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| KR20170053280A true KR20170053280A (ko) | 2017-05-16 |

| KR102471977B1 KR102471977B1 (ko) | 2022-11-30 |

Family

ID=58664228

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020150155577A KR102471977B1 (ko) | 2015-11-06 | 2015-11-06 | 복수의 전자장치 사이에서 가상 객체를 표시하는 방법 및 이를 지원하는 전자 장치 |

Country Status (2)

| Country | Link |

|---|---|

| US (1) | US10289376B2 (ko) |

| KR (1) | KR102471977B1 (ko) |

Cited By (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR102154684B1 (ko) * | 2019-09-24 | 2020-09-10 | (주)코드쓰리 | 다중 프로젝터 출력 시스템 및 그 방법 |

| CN111708504A (zh) * | 2020-06-16 | 2020-09-25 | 成都忆光年文化传播有限公司 | 一种扩展屏幕的显示方法 |

| WO2023106895A1 (ko) * | 2021-12-10 | 2023-06-15 | 삼성전자 주식회사 | 가상 입력 장치를 이용하기 위한 전자 장치 및 그 전자 장치에서의 동작 방법 |

| WO2024096244A1 (ko) * | 2022-10-31 | 2024-05-10 | 삼성전자주식회사 | 가상 공간의 정보를 제공하기 위한 전자 장치 및 그 방법 |

| WO2024101950A1 (ko) * | 2022-11-11 | 2024-05-16 | 삼성전자 주식회사 | 가상 오브젝트를 표시하는 전자 장치 및 이의 제어 방법 |

Families Citing this family (40)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US10650591B1 (en) | 2016-05-24 | 2020-05-12 | Out of Sight Vision Systems LLC | Collision avoidance system for head mounted display utilized in room scale virtual reality system |

| US10261595B1 (en) * | 2017-05-19 | 2019-04-16 | Facebook Technologies, Llc | High resolution tracking and response to hand gestures through three dimensions |

| WO2019013409A1 (en) | 2017-07-10 | 2019-01-17 | Samsung Electronics Co., Ltd. | INCREASED REALITY VISIOCASTIC DEVICE FOR DISPLAYING TELEPHONE CONTENT AND HEALTH MONITORING |

| US11048325B2 (en) | 2017-07-10 | 2021-06-29 | Samsung Electronics Co., Ltd. | Wearable augmented reality head mounted display device for phone content display and health monitoring |

| US10242390B2 (en) | 2017-07-31 | 2019-03-26 | Bank Of America Corporation | Digital data processing system for controlling automated exchange zone systems |

| EP3707581A1 (en) * | 2017-11-07 | 2020-09-16 | Koninklijke Philips N.V. | Augmented reality drag and drop of objects |

| CN108154864B (zh) * | 2017-12-22 | 2020-02-21 | 联想(北京)有限公司 | 显示屏处理方法、第一电子设备以及第二电子设备 |

| KR102338901B1 (ko) | 2018-04-03 | 2021-12-13 | 삼성전자주식회사 | 전자 장치 및 그 동작 방법 |

| US10970937B2 (en) * | 2018-05-04 | 2021-04-06 | Intel Corporation | Technologies for virtual attribute assignment referencing real objects |

| US10818093B2 (en) | 2018-05-25 | 2020-10-27 | Tiff's Treats Holdings, Inc. | Apparatus, method, and system for presentation of multimedia content including augmented reality content |

| US10984600B2 (en) | 2018-05-25 | 2021-04-20 | Tiff's Treats Holdings, Inc. | Apparatus, method, and system for presentation of multimedia content including augmented reality content |

| US10635895B2 (en) | 2018-06-27 | 2020-04-28 | Facebook Technologies, Llc | Gesture-based casting and manipulation of virtual content in artificial-reality environments |

| KR20200076449A (ko) * | 2018-12-19 | 2020-06-29 | 삼성전자주식회사 | 증강 장치를 제어하는 방법 및 이를 수행하는 전자 장치 |

| CN111399631B (zh) * | 2019-01-03 | 2021-11-05 | 广东虚拟现实科技有限公司 | 虚拟内容显示方法、装置、终端设备及存储介质 |

| US11238656B1 (en) * | 2019-02-22 | 2022-02-01 | Consumerinfo.Com, Inc. | System and method for an augmented reality experience via an artificial intelligence bot |

| US11366564B2 (en) * | 2019-03-13 | 2022-06-21 | Samsung Electronics Co., Ltd. | Electronic device and method for multi-view browsing in an augmented reality environment |

| WO2020237194A1 (en) * | 2019-05-22 | 2020-11-26 | Pcms Holdings, Inc. | Method for rendering of augmented reality content in combination with external display |

| CN110248026B (zh) * | 2019-06-18 | 2021-10-22 | 北京字节跳动网络技术有限公司 | 一种移动终端、显示系统及其显示控制方法、记录介质 |

| US11775130B2 (en) * | 2019-07-03 | 2023-10-03 | Apple Inc. | Guided retail experience |

| US11816800B2 (en) | 2019-07-03 | 2023-11-14 | Apple Inc. | Guided consumer experience |

| CN110377764B (zh) * | 2019-07-19 | 2022-10-11 | 芋头科技(杭州)有限公司 | 信息显示方法 |

| US11379033B2 (en) * | 2019-09-26 | 2022-07-05 | Apple Inc. | Augmented devices |

| US11823343B1 (en) * | 2020-03-26 | 2023-11-21 | Apple Inc. | Method and device for modifying content according to various simulation characteristics |

| US11589124B1 (en) | 2020-04-14 | 2023-02-21 | Worldpay Limited | Methods and systems for seamlessly transporting objects between connected devices for electronic transactions |

| US11250642B1 (en) * | 2020-04-14 | 2022-02-15 | Worldpay Limited | Methods and systems for displaying virtual objects from an augmented reality environment on a multimedia device |

| TWI757824B (zh) | 2020-08-10 | 2022-03-11 | 宏碁股份有限公司 | 擴增實境螢幕系統及擴增實境螢幕顯示方法 |

| US11175791B1 (en) * | 2020-09-29 | 2021-11-16 | International Business Machines Corporation | Augmented reality system for control boundary modification |

| CN112269614A (zh) * | 2020-10-26 | 2021-01-26 | 维沃移动通信有限公司 | 一种消息处理方法、装置和电子设备 |

| CN116438503A (zh) * | 2020-12-17 | 2023-07-14 | 三星电子株式会社 | 电子装置和电子装置的操作方法 |

| JP2024506630A (ja) | 2021-02-08 | 2024-02-14 | サイトフル コンピューターズ リミテッド | 生産性のためのエクステンデッド・リアリティ |

| EP4288950A1 (en) | 2021-02-08 | 2023-12-13 | Sightful Computers Ltd | User interactions in extended reality |

| JP2024507749A (ja) | 2021-02-08 | 2024-02-21 | サイトフル コンピューターズ リミテッド | エクステンデッドリアリティにおけるコンテンツ共有 |

| TWI775397B (zh) * | 2021-04-21 | 2022-08-21 | 宏碁股份有限公司 | 3d顯示系統與3d顯示方法 |

| WO2023009580A2 (en) | 2021-07-28 | 2023-02-02 | Multinarity Ltd | Using an extended reality appliance for productivity |

| US20230147561A1 (en) * | 2021-11-08 | 2023-05-11 | Niantic, Inc. | Metaverse Content Modality Mapping |

| CN114327723A (zh) * | 2021-12-28 | 2022-04-12 | 阿波罗智联(北京)科技有限公司 | 基于虚拟屏幕的应用处理方法、装置、设备及存储介质 |

| US20230334795A1 (en) | 2022-01-25 | 2023-10-19 | Multinarity Ltd | Dual mode presentation of user interface elements |

| US11948263B1 (en) | 2023-03-14 | 2024-04-02 | Sightful Computers Ltd | Recording the complete physical and extended reality environments of a user |

| US20230376161A1 (en) * | 2022-05-19 | 2023-11-23 | Microsoft Technology Licensing, Llc | Mouse cursor and content migration between 3d space and physical flat displays |

| CN117555446A (zh) * | 2022-08-03 | 2024-02-13 | 华为技术有限公司 | 一种设备控制方法及设备 |

Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20120042036A1 (en) * | 2010-08-10 | 2012-02-16 | Microsoft Corporation | Location and contextual-based mobile application promotion and delivery |

| US8576276B2 (en) * | 2010-11-18 | 2013-11-05 | Microsoft Corporation | Head-mounted display device which provides surround video |

| KR20140027034A (ko) * | 2012-08-23 | 2014-03-06 | 삼성전자주식회사 | 정보 전송 방법 및 시스템, 디바이스와 그 기록 매체 |

| KR20140033677A (ko) * | 2012-09-10 | 2014-03-19 | 삼성전자주식회사 | 애플리케이션 실행 방법 및 기기 |

| KR20140128197A (ko) * | 2013-04-27 | 2014-11-05 | 엘지전자 주식회사 | 이동 단말기 및 그 제어방법 |

| KR20140139883A (ko) * | 2013-05-28 | 2014-12-08 | 엘지전자 주식회사 | 디스플레이 장치 |

| JP2015049498A (ja) * | 2013-09-05 | 2015-03-16 | セイコーエプソン株式会社 | 頭部装着型表示装置、頭部装着型表示装置を制御する方法、画像表示システム、情報処理装置 |

| KR20150074345A (ko) * | 2013-12-24 | 2015-07-02 | 현대자동차주식회사 | 로컬 기기에서의 리모트 앱 실행 방법 |

Family Cites Families (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8276069B2 (en) * | 2007-03-28 | 2012-09-25 | Honeywell International Inc. | Method and system for automatically generating an adaptive user interface for a physical environment |

| US10019962B2 (en) * | 2011-08-17 | 2018-07-10 | Microsoft Technology Licensing, Llc | Context adaptive user interface for augmented reality display |

| US9292085B2 (en) * | 2012-06-29 | 2016-03-22 | Microsoft Technology Licensing, Llc | Configuring an interaction zone within an augmented reality environment |

| US10042655B2 (en) * | 2015-01-21 | 2018-08-07 | Microsoft Technology Licensing, Llc. | Adaptable user interface display |

| JP6585929B2 (ja) * | 2015-06-02 | 2019-10-02 | キヤノン株式会社 | システム、システムの制御方法 |

-

2015

- 2015-11-06 KR KR1020150155577A patent/KR102471977B1/ko active IP Right Grant

-

2016

- 2016-11-04 US US15/343,351 patent/US10289376B2/en active Active

Patent Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20120042036A1 (en) * | 2010-08-10 | 2012-02-16 | Microsoft Corporation | Location and contextual-based mobile application promotion and delivery |

| US8576276B2 (en) * | 2010-11-18 | 2013-11-05 | Microsoft Corporation | Head-mounted display device which provides surround video |

| KR20140027034A (ko) * | 2012-08-23 | 2014-03-06 | 삼성전자주식회사 | 정보 전송 방법 및 시스템, 디바이스와 그 기록 매체 |

| KR20140033677A (ko) * | 2012-09-10 | 2014-03-19 | 삼성전자주식회사 | 애플리케이션 실행 방법 및 기기 |

| KR20140128197A (ko) * | 2013-04-27 | 2014-11-05 | 엘지전자 주식회사 | 이동 단말기 및 그 제어방법 |

| KR20140139883A (ko) * | 2013-05-28 | 2014-12-08 | 엘지전자 주식회사 | 디스플레이 장치 |

| JP2015049498A (ja) * | 2013-09-05 | 2015-03-16 | セイコーエプソン株式会社 | 頭部装着型表示装置、頭部装着型表示装置を制御する方法、画像表示システム、情報処理装置 |

| KR20150074345A (ko) * | 2013-12-24 | 2015-07-02 | 현대자동차주식회사 | 로컬 기기에서의 리모트 앱 실행 방법 |

Cited By (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR102154684B1 (ko) * | 2019-09-24 | 2020-09-10 | (주)코드쓰리 | 다중 프로젝터 출력 시스템 및 그 방법 |

| CN111708504A (zh) * | 2020-06-16 | 2020-09-25 | 成都忆光年文化传播有限公司 | 一种扩展屏幕的显示方法 |

| WO2023106895A1 (ko) * | 2021-12-10 | 2023-06-15 | 삼성전자 주식회사 | 가상 입력 장치를 이용하기 위한 전자 장치 및 그 전자 장치에서의 동작 방법 |

| WO2024096244A1 (ko) * | 2022-10-31 | 2024-05-10 | 삼성전자주식회사 | 가상 공간의 정보를 제공하기 위한 전자 장치 및 그 방법 |

| WO2024101950A1 (ko) * | 2022-11-11 | 2024-05-16 | 삼성전자 주식회사 | 가상 오브젝트를 표시하는 전자 장치 및 이의 제어 방법 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20170131964A1 (en) | 2017-05-11 |

| US10289376B2 (en) | 2019-05-14 |

| KR102471977B1 (ko) | 2022-11-30 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR102471977B1 (ko) | 복수의 전자장치 사이에서 가상 객체를 표시하는 방법 및 이를 지원하는 전자 장치 | |

| US11221695B2 (en) | Electronic device | |

| KR102423447B1 (ko) | 벤디드 디스플레이를 구비한 전자 장치 및 그 제어 방법 | |

| US9952711B2 (en) | Electronic device and method of processing screen area of electronic device | |

| EP3586316B1 (en) | Method and apparatus for providing augmented reality function in electronic device | |

| KR102559625B1 (ko) | 증강 현실 출력 방법 및 이를 지원하는 전자 장치 | |

| KR102265086B1 (ko) | 정보를 공유하기 위한 가상 환경 | |

| KR102183212B1 (ko) | 화면 제어 방법 및 그 방법을 처리하는 전자 장치 | |

| US10929005B2 (en) | Electronic device, wearable device, and method of controlling displayed object in electronic device | |

| KR102481632B1 (ko) | 전자 장치 및 전자 장치의 디스플레이를 이용한 적응적 터치 입력 방법 | |

| KR20180095409A (ko) | 전자 장치 및 전자 장치의 화면 표시 방법 | |

| KR20170005602A (ko) | 증강현실 및 가상현실의 통합적 제공 방법 및 이를 사용하는 전자 장치 | |

| KR102398503B1 (ko) | 입력의 압력을 감지하는 전자 장치 및 그 동작 방법 | |

| KR20160063812A (ko) | 화면 구성 방법, 전자 장치 및 저장 매체 | |

| KR102528389B1 (ko) | 전자 장치 및 전자 장치에서의 노티피케이션 처리 방법 | |

| US20170046123A1 (en) | Device for providing sound user interface and method thereof | |

| KR20170013623A (ko) | 디스플레이를 제어하는 전자 장치 및 방법 | |

| KR20170052368A (ko) | 전자 장치, 웨어러블 장치 및 전자 장치에서 디스플레이되는 객체를 제어하는 방법 | |

| EP3336675B1 (en) | Electronic devices and input method of electronic device | |

| KR20160051411A (ko) | 외부의 물체를 제어하는 전자 장치 및 그 방법 | |

| KR102654621B1 (ko) | 객체를 디스플레이하기 위한 방법 및 그 전자 장치 | |

| KR102328102B1 (ko) | 전자 장치 및 전자 장치의 화면 표시방법 | |

| KR20170040706A (ko) | 한 손 조작 ui를 제공하는 전자 장치 및 방법 | |

| EP3327551A1 (en) | Electronic device for displaying image and method for controlling the same | |

| KR20180041905A (ko) | Emi 센서를 포함하는 전자 장치 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|