KR20170000722A - 전자기기 및 그의 음성 인식 방법 - Google Patents

전자기기 및 그의 음성 인식 방법 Download PDFInfo

- Publication number

- KR20170000722A KR20170000722A KR1020150090058A KR20150090058A KR20170000722A KR 20170000722 A KR20170000722 A KR 20170000722A KR 1020150090058 A KR1020150090058 A KR 1020150090058A KR 20150090058 A KR20150090058 A KR 20150090058A KR 20170000722 A KR20170000722 A KR 20170000722A

- Authority

- KR

- South Korea

- Prior art keywords

- user

- voice

- language

- phoneme

- information

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/005—Language recognition

Abstract

전자기기의 음성 인식 방법이 개시된다. 본 발명의 실시 예에 따른 전자 기기의 음성 인식 방법은, 사용자의 음성을 수신하는 단계, 상기 수신된 음성으로부터 하나 이상의 음소 정보를 획득하는 단계, 및, 상기 획득된 하나 이상의 음소 정보를 이용하여 상기 사용자의 사용 언어를 판단하는 단계를 포함한다.

Description

본 발명은, 사용자가 사용하는 언어를 자동으로 탐지하여 자동으로 음성 인식 언어를 설정하는 전자기기 및 그의 음성 인식 방법에 관한 것이다.

최근 음성 인식 기술이 널리 활용되고 있다. 음성 인식 기술이란, 자동적 수단에 의하여 음성으로부터 언어적 의미 내용을 식별하는 것, 구체적으로는 음성파형을 입력하여 단어나 단어열을 식별하고 의미를 추출하는 처리과정이다.

음성 인식을 위해서는 음성 분석 단계, 단어 인식 단계를 거치는데, 여기서 단어 인식 단계에서는 분석된 음성을 데이터베이스에 저장된 단어와 비교 함으로써 음성의 의미를 인식할 수 있었다.

한편, 기존에는 사용자가 음성 인식 대상 언어를 설정하고, 설정된 언어를 말하면, 설정된 언어에 포함되는 단어들의 집합과 사용자가 말한 언어를 비교함으로써 음성 인식을 수행하였다. 예를 들어, 사용자가 “한국어”로써 음성 인식 대상을 설정하고, “한국어”로 말하면, 음성 인식 장치는 “한국어”에서 사용하는 단어들이 저장된 데이터베이스의 자료들과 사용자가 사용한 언어를 비교함으로써 음성 인식을 수행하였다.

다만, 종래에는 음성 인식을 위하여 사용자가 음성 인식 대상 언어를 직접 설정해야만 하는 불편함이 있었다. 또한, 종래에는 사용자가 복수개의 언어를 섞어서 말하는 경우 음성 인식 대상으로 설정되어 있지 않은 언어에 포함되는 단어는 인식이 불가능한 문제점이 있었다.

본 발명은 상술한 문제점을 해결하기 위한 것으로, 본 발명의 목적은, 사용자가 사용하는 언어를 자동으로 탐지하여 자동으로 음성 인식 언어를 설정하는 전자기기 및 그의 음성 인식 방법에 관한 것이다.

본 발명의 일 실시 예에 따른 전자기기의 음성 인식 방법은, 사용자의 음성을 수신하는 단계, 상기 수신된 음성으로부터 하나 이상의 음소 정보를 획득하는 단계, 및, 상기 획득된 하나 이상의 음소 정보를 이용하여 상기 사용자의 사용 언어를 판단하는 단계를 포함한다.

한편, 본 발명의 실시 예에 따른 음성 인식 가능한 전자기기는, 사용자의 음성을 수신하는 입력부, 상기 수신된 음성으로부터 하나 이상의 음소 정보를 획득하고, 상기 획득된 하나 이상의 음소 정보를 이용하여 상기 사용자의 사용 언어를 판단하는 제어부를 포함한다.

도 1은 본 발명의 일 실시 예에 따른 디스플레이 장치의 구성을 블록도로 도시한 것이다.

도 2는 본 발명의 일 실시예에 따른 이동 단말기를 설명하기 위한 블록도 이다.

도 3은, 본 발명의 실시 예에 따른, 전자기기의 음성 인식 방법을 설명하기 위한 순서도이다.

도 4는, 본 발명의 실시 예에 따른 각각의 언어의 음소를 설명하기 위한 도면이다.

도 5는 본 발명의 실시 예에 따른, 사용자의 음성을 음소 단위로 분할한 음성 스펙트럼을 도시한 도면이다.

도 6은 본 발명의 실시 예에 따른, 하나 이상의 언어 각각의 음소가 데이터베이스화 있는 상태를 도시한 도면이다.

도 7은, 본 발명의 또 다른 실시 예에 따른, 전자기기의 음성 인식 방법을 설명하기 위한 순서도이다.

도 8은 딥 러닝 알고리즘을 이용하여 음소를 학습하는 방법 및 학습된 음소 정보를 이용하여 사용자의 언어를 판단하는 방법을 설명하기 위한 도면이다.

도 9는 본 발명을 이용한 다양한 실시 예들을 도시한 도면이다.

도 10은, 음성 인식이 두개 이상의 서버에서 수행되는 실시 예를 설명하기 위한 도면이다.

도 11은, 음성 인식이 단일 서버에서 수행되는 실시 예를 설명하기 위한 도면이다.

도 12는 본 발명의 실시 예에 따른 전자기기의 음성 인식 방법을 설명하기 위한 도면이다.

도 2는 본 발명의 일 실시예에 따른 이동 단말기를 설명하기 위한 블록도 이다.

도 3은, 본 발명의 실시 예에 따른, 전자기기의 음성 인식 방법을 설명하기 위한 순서도이다.

도 4는, 본 발명의 실시 예에 따른 각각의 언어의 음소를 설명하기 위한 도면이다.

도 5는 본 발명의 실시 예에 따른, 사용자의 음성을 음소 단위로 분할한 음성 스펙트럼을 도시한 도면이다.

도 6은 본 발명의 실시 예에 따른, 하나 이상의 언어 각각의 음소가 데이터베이스화 있는 상태를 도시한 도면이다.

도 7은, 본 발명의 또 다른 실시 예에 따른, 전자기기의 음성 인식 방법을 설명하기 위한 순서도이다.

도 8은 딥 러닝 알고리즘을 이용하여 음소를 학습하는 방법 및 학습된 음소 정보를 이용하여 사용자의 언어를 판단하는 방법을 설명하기 위한 도면이다.

도 9는 본 발명을 이용한 다양한 실시 예들을 도시한 도면이다.

도 10은, 음성 인식이 두개 이상의 서버에서 수행되는 실시 예를 설명하기 위한 도면이다.

도 11은, 음성 인식이 단일 서버에서 수행되는 실시 예를 설명하기 위한 도면이다.

도 12는 본 발명의 실시 예에 따른 전자기기의 음성 인식 방법을 설명하기 위한 도면이다.

이하, 첨부된 도면을 참조하여 본 명세서에 개시된 실시 예를 상세히 설명하되, 도면 부호에 관계없이 동일하거나 유사한 구성요소는 동일한 참조 번호를 부여하고 이에 대한 중복되는 설명은 생략하기로 한다. 이하의 설명에서 사용되는 구성요소에 대한 접미사 "모듈" 및 "부"는 명세서 작성의 용이함만이 고려되어 부여되거나 혼용되는 것으로서, 그 자체로 서로 구별되는 의미 또는 역할을 갖는 것은 아니다. 또한, 본 명세서에 개시된 실시 예를 설명함에 있어서 관련된 공지 기술에 대한 구체적인 설명이 본 명세서에 개시된 실시 예의 요지를 흐릴 수 있다고 판단되는 경우 그 상세한 설명을 생략한다. 또한, 첨부된 도면은 본 명세서에 개시된 실시 예를 쉽게 이해할 수 있도록 하기 위한 것일 뿐, 첨부된 도면에 의해 본 명세서에 개시된 기술적 사상이 제한되지 않으며, 본 발명의 사상 및 기술 범위에 포함되는 모든 변경, 균등물 내지 대체물을 포함하는 것으로 이해되어야 한다.

본 발명의 실시 예에 따른 전자기기는, 디스플레이 장치일 수 있다. 예를 들어, 본 발명의 실시 예에 따른 전자기기는, 방송 수신 기능에 컴퓨터 지원 기능을 추가한 지능형 디스플레이 장치로서, 방송 수신 기능에 충실하면서도 인터넷 기능 등이 추가되어, 수기 방식의 입력 장치, 터치 스크린 또는 공간 리모콘 등 보다 사용에 편리한 인터페이스를 갖출 수 있다. 그리고, 유선 또는 무선 인터넷 기능의 지원으로 인터넷 및 컴퓨터에 접속되어, 이메일, 웹브라우징, 뱅킹 또는 게임 등의 기능도 수행가능하다. 이러한 다양한 기능을 위해 표준화된 범용 OS가 사용될 수 있다.

따라서, 본 발명에서 기술되는 디스플레이 장치는, 예를 들어 범용의 OS 커널 상에, 다양한 애플리케이션이 자유롭게 추가되거나 삭제 가능하므로, 사용자 친화적인 다양한 기능이 수행될 수 있다. 상기 디스플레이 장치는, 보다 구체적으로 예를 들면, 네트워크 TV, HBBTV, 스마트 TV, LED TV, OLED TV 등이 될 수 있다.

도 1은 본 발명의 일 실시 예에 따른 디스플레이 장치의 구성을 블록도로 도시한 것이다.

도 1을 참조하면, 디스플레이 장치(100)는 방송 수신부(130), 외부 장치 인터페이스부(135), 저장부(140), 입력부(150), 영상 획득부(160), 제어부(170), 디스플레이부(180), 오디오 출력부(185), 전원공급부(190), GUI 생성부(195)를 포함할 수 있다.

방송 수신부(130)는 튜너(131), 복조부(132) 및 네트워크 인터페이스부(133)를 포함할 수 있다.

튜너(131)는 채널 선국 명령에 따라 특정 방송 채널을 선국할 수 있다. 튜너(131)는 선국된 특정 방송 채널에 대한 방송 신호를 수신할 수 있다.

복조부(132)는 수신한 방송 신호를 비디오 신호, 오디오 신호, 방송 프로그램과 관련된 데이터 신호로 분리할 수 있고, 분리된 비디오 신호, 오디오 신호 및 데이터 신호를 출력이 가능한 형태로 복원할 수 있다.

외부장치 인터페이스부(135)는 인접하는 외부 장치 내의 애플리케이션 또는 애플리케이션 목록을 수신하여, 제어부(170) 또는 저장부(140)로 전달할 수 있다.

외부 장치 인터페이스부(135)는 외부 장치와 연결하기 위한 단자(terminal)를 포함할 수 있어서, 외부 장치의 커넥터(connecter)와 연결될 수 있다.

외부 장치 인터페이스부(135)는 전원 공급부(190)로부터 공급받은 전원을 연결된 외부 장치에 구동 전원으로 공급할 수 있다.

또한, 외부 장치 인터페이스부(135)는 외부 장치가 송신한 동작 신호를 제어부(170)에 전달할 수 있다.

한편, 외부 장치 인터페이스부(135)는 외부 장치의 연결을 감지할 수 있는 센서가 포함될 수 있어서, 외부 장치의 연결을 인식할 수 있다.

네트워크 인터페이스부(133)는 디스플레이 장치(100)를 인터넷망을 포함하는 유/무선 네트워크와 연결하기 위한 인터페이스를 제공할 수 있다. 네트워크 인터페이스부(133)는 접속된 네트워크 또는 접속된 네트워크에 링크된 다른 네트워크를 통해, 다른 사용자 또는 다른 전자 기기와 데이터를 송신 또는 수신할 수 있다.

또한, 디스플레이 장치(100)에 미리 등록된 다른 사용자 또는 다른 전자 기기 중 선택된 사용자 또는 선택된 전자기기에, 디스플레이 장치(100)에 저장된 일부의 컨텐츠 데이터를 송신할 수 있다.

네트워크 인터페이스부(133)는 접속된 네트워크 또는 접속된 네트워크에 링크된 다른 네트워크를 통해, 소정 웹 페이지에 접속할 수 있다. 즉, 네트워크를 통해 소정 웹 페이지에 접속하여, 해당 서버와 데이터를 송신 또는 수신할 수 있다.

그리고, 네트워크 인터페이스부(133)는 컨텐츠 제공자 또는 네트워크 운영자가 제공하는 컨텐츠 또는 데이터들을 수신할 수 있다. 즉, 네트워크 인터페이스부(133)는 네트워크를 통하여 컨텐츠 제공자 또는 네트워크 제공자로부터 제공되는 영화, 광고, 게임, VOD, 방송 신호 등의 컨텐츠 및 그와 관련된 정보를 수신할 수 있다.

또한, 네트워크 인터페이스부(133)는 네트워크 운영자가 제공하는 펌웨어의 업데이트 정보 및 업데이트 파일을 수신할 수 있으며, 인터넷 또는 컨텐츠 제공자 또는 네트워크 운영자에게 데이터들을 송신할 수 있다.

네트워크 인터페이스부(133)는 네트워크를 통해, 공중에 공개(open)된 애플리케이션들 중 원하는 애플리케이션을 선택하여 수신할 수 있다.

저장부(140)는 제어부(170) 내의 각 신호 처리 및 제어를 위한 프로그램이 저장하고, 신호 처리된 영상, 음성 또는 데이터신호를 저장할 수 있다.

또한, 저장부(140)는 외부장치 인터페이스부(135) 또는 네트워크 인터페이스부(133)로부터 입력되는 영상, 음성, 또는 데이터 신호의 임시 저장을 위한 기능을 수행할 수도 있으며, 채널 기억 기능을 통하여 소정 이미지에 관한 정보를 저장할 수도 있다.

저장부(140)는 외부장치 인터페이스부(135) 또는 네트워크 인터페이스부(133)로부터 입력되는 애플리케이션 또는 애플리케이션 목록을 저장할 수 있다.

디스플레이 장치(100)는 저장부(140) 내에 저장되어 있는 컨텐츠 파일(동영상 파일, 정지영상 파일, 음악 파일, 문서 파일, 애플리케이션 파일 등)을 재생하여 사용자에게 제공할 수 있다.

입력부(150)는 사용자가 입력한 신호를 제어부(170)로 전달하거나, 제어부(170)로부터의 신호를 사용자에게 전달할 수 있다. 예를 들어, 사용자입력 인터페이스부(150)는 블루투스(Bluetooth), WB(Ultra Wideband), 지그비(ZigBee) 방식, RF(Radio Frequency) 통신 방식 또는 적외선(IR) 통신 방식 등 다양한 통신 방식에 따라, 원격제어장치(200)로부터 전원 온/오프, 채널 선택, 화면 설정 등의 제어 신호를 수신하여 처리하거나, 제어부(170)로부터의 제어 신호를 원격제어장치(200)로 송신하도록 처리할 수 있다.

또한, 입력부(150)는, 전원키, 채널키, 볼륨키, 설정치 등의 로컬키(미도시)에서 입력되는 제어 신호를 제어부(170)에 전달할 수 있다.

또한, 입력부(150)는 오디오를 수신할 수 있다. 예를 들어, 입력부(150)는 사용자의 음성을 포함하는 오디오를 수신할 수 있다. 그리고, 입력부(150)는 수신한 사용자의 음성을 음성 신호로써 제어부(170)에 전달할 수 있다.

그리고 영상 획득부(160)는 디스플레이 장치(100)에 대한 시청 가능 영역을 촬영하여 획득한 영상을 제어부(170)에 전달할 수 있다.

제어부(170)에서 영상 처리된 영상 신호는 디스플레이부(180)로 입력되어 해당 영상 신호에 대응하는 영상으로 표시될 수 있다. 또한, 제어부(170)에서 영상 처리된 영상 신호는 외부장치 인터페이스부(135)를 통하여 외부 출력장치로 입력될 수 있다.

제어부(170)에서 처리된 음성 신호는 오디오 출력부(185)로 오디오 출력될 수 있다. 또한, 제어부(170)에서 처리된 음성 신호는 외부장치 인터페이스부(135)를 통하여 외부 출력장치로 입력될 수 있다.

그 외, 제어부(170)는, 디스플레이 장치(100) 내의 전반적인 동작을 제어할 수 있다.

또한, 제어부(170)는 사용자입력 인터페이스부(150)를 통하여 입력된 사용자 명령 또는 내부 프로그램에 의하여 디스플레이 장치(100)를 제어할 수 있으며, 네트워크에 접속하여 사용자가 원하는 애플리케이션 또는 애플리케이션 목록을 디스플레이 장치(100) 내로 다운받을 수 있도록 할 수 있다.

제어부(170)는 사용자가 선택한 채널 정보 등이 처리한 영상 또는 음성신호와 함께 디스플레이부(180) 또는 오디오 출력부(185)를 통하여 출력될 수 있도록 한다.

또한, 제어부(170)는 사용자입력 인터페이스부(150)를 통하여 수신한 외부장치 영상 재생 명령에 따라, 외부장치 인터페이스부(135)를 통하여 입력되는 외부 장치, 예를 들어, 카메라 또는 캠코더로부터의, 영상 신호 또는 음성 신호가 디스플레이부(180) 또는 오디오 출력부(185)를 통해 출력될 수 있도록 한다.

한편, 제어부(170)는 영상을 표시하도록 디스플레이부(180)를 제어할 수 있으며, 예를 들어 튜너(131)를 통해 입력되는 방송 영상, 또는 외부장치 인터페이스부(135)를 통해 입력되는 외부 입력 영상, 또는 네트워크 인터페이스부를 통해 입력되는 영상, 또는 저장부(140)에 저장된 영상이 디스플레이부(180)에서 표시되도록 제어할 수 있다. 이 경우, 디스플레이부(180)에 표시되는 영상은 정지 영상 또는 동영상일 수 있으며, 2D 영상 또는 3D 영상일 수 있다.

또한, 제어부(170)는 디스플레이 장치(100) 내에 저장된 컨텐츠, 또는 수신된 방송 컨텐츠, 외부로 부터 입력되는 외부 입력 컨텐츠가 재생되도록 제어할 수 있으며, 상기 컨텐츠는 방송 영상, 외부 입력 영상, 오디오 파일, 정지 영상, 접속된 웹 화면, 및 문서 파일 등 다양한 형태일 수 있다.

한편, 통신부(173)는 외부 기기와 통신할 수 있다. 구체적으로, 통신부(173)는 WiFi direct, WiDi, 기타 유무선 네트워크를 통하여 스마트 폰, 노트 북, PC 등의 외부 기기와 통신할 수 있다.

디스플레이부(180)는 제어부(170)에서 처리된 영상 신호, 데이터 신호, OSD 신호 또는 외부장치 인터페이스부(135)에서 수신되는 영상 신호, 데이터 신호 등을 각각 R,G,B 신호로 변환하여 구동 신호를 생성할 수 있다.

GUI 생성부(195)는 디스플레이 장치(100)에 표시되는 UI 오브젝트 영상을 생성할 수 있다. 예를 들어, GUI 생성부(195)는 포인터 리모콘의 동작에 대응되는 포인터, 외부 기기와의 연동 정보에 대한 팝업 창, 예약 녹화 또는 예약 시청 알림 정보에 대한 팝업창, TV에 설치된 APP에 대한 업데이트 정보에 대한 팝업창 등 사용자가 TV를 조작하는데 필요하거나 사용자에게 정보를 전달하는데 필요한 다양한 UI 오브젝트 영상을 생성할 수 있다.

제어부(170)는 GUI 생성부에서 생성된 UI 오브젝트 영상을 디스플레이부(180)에 표시할 수 있다. 또한, 제어부(170)는 GUI 생성부(195)에서 생성된 UI 오브젝트 영상을 저장부(140)에 저장하고, 저장된 UI 오브젝트 영상을 독출하여 디스플레이부(180)에 표시할 수 있다.

한편, 도 1에 도시된 디스플레이 장치(100)는 본 발명의 일실시 예에 불과하므로. 도시된 구성요소들 중 일부는 실제 구현되는 디스플레이 장치(100)의 사양에 따라 통합, 추가, 또는 생략될 수 있다.

즉, 필요에 따라 2 이상의 구성요소가 하나의 구성요소로 합쳐지거나, 혹은 하나의 구성요소가 2 이상의 구성요소로 세분되어 구성될 수 있다. 또한, 각 블록에서 수행하는 기능은 본 발명의 실시예를 설명하기 위한 것이며, 그 구체적인 동작이나 장치는 본 발명의 권리범위를 제한하지 아니한다.

본 발명의 또 다른 실시예에 따르면, 디스플레이 장치(100)는 도 1에 도시된 바와 달리, 튜너(131)와 복조부(132)를 구비하지 않고 네트워크 인터페이스부(133) 또는 외부장치 인터페이스부(135)를 통해서 영상을 수신하여 재생할 수도 있다.

예를 들어, 디스플레이 장치(100)는 방송 신호 또는 다양한 네트워크 서비스에 따른 컨텐츠들을 수신하기 위한 등과 같은 셋탑 박스 등과 같은 영상 처리 장치와 상기 영상 처리 장치로부터 입력되는 컨텐츠를 재생하는 컨텐츠 재생 장치로 분리되어 구현될 수 있다.

이 경우, 이하에서 설명할 본 발명의 실시예에 따른 디스플레이 장치의 동작 방법은 도 1을 참조하여 설명한 바와 같은 디스플레이 장치(100)뿐 아니라, 상기 분리된 셋탑 박스 등과 같은 영상 처리 장치 또는 디스플레이부(180) 및 오디오출력부(185)를 구비하는 컨텐츠 재생 장치 중 어느 하나에 의해 수행될 수도 있다.

한편, 본 발명의 실시 예에 따른 전자기기는, 이동 단말기일 수 있다. 그리고, 본 명세서에서 설명되는 이동 단말기에는 휴대폰, 스마트 폰(smart phone), 노트북 컴퓨터(laptop computer), 디지털방송용 단말기, PDA(personal digital assistants), PMP(portable multimedia player), 네비게이션, 슬레이트 PC(slate PC), 태블릿 PC(tablet PC), 울트라북(ultrabook), 웨어러블 디바이스(wearable device, 예를 들어, 워치형 단말기 (smartwatch), 글래스형 단말기 (smart glass), HMD(head mounted display)) 등이 포함될 수 있다.

그러나, 본 명세서에 기재된 실시 예에 따른 구성은 이동 단말기에만 적용 가능한 경우를 제외하면, 디지털 TV, 데스크탑 컴퓨터, 디지털 사이니지 등과 같은 고정 단말기에도 적용될 수도 있음을 본 기술분야의 당업자라면 쉽게 알 수 있을 것이다.

도 2는 본 발명의 일 실시예에 따른 이동 단말기를 설명하기 위한 블록도 이다.

상기 이동 단말기(200)는 통신부(210), 입력부(220), 센싱부(240), 출력부(250), 인터페이스부(260), 저장부(270), 제어부(280) 및 전원 공급부(290) 등을 포함할 수 있다. 도 2에 도시된 구성요소들은 이동 단말기를 구현하는데 있어서 필수적인 것은 아니어서, 본 명세서 상에서 설명되는 이동 단말기는 위에서 열거된 구성요소들 보다 많거나, 또는 적은 구성요소들을 가질 수 있다.

보다 구체적으로, 상기 구성요소들 중 통신부(210)는, 이동 단말기(200)와 무선 통신 시스템 사이, 이동 단말기(200)와 다른 이동 단말기(200) 사이, 또는 이동 단말기(200)와 외부서버 사이의 무선 통신을 가능하게 하는 하나 이상의 모듈을 포함할 수 있다. 또한, 상기 통신부(210)는, 이동 단말기(200)를 하나 이상의 네트워크에 연결하는 하나 이상의 모듈을 포함할 수 있다.

이러한 통신부(210)는, 방송 수신 모듈(211), 이동통신 모듈(212), 무선 인터넷 모듈(213), 근거리 통신 모듈(214), 위치정보 모듈(215) 중 적어도 하나를 포함할 수 있다.

입력부(220)는, 영상 신호 입력을 위한 카메라(221) 또는 영상 입력부, 오디오 신호 입력을 위한 마이크로폰(microphone, 222), 또는 오디오 입력부, 사용자로부터 정보를 입력 받기 위한 사용자 입력부(223, 예를 들어, 터치키(touch key), 푸시키(mechanical key) 등)를 포함할 수 있다. 입력부(220)에서 수집한 음성 데이터나 이미지 데이터는 분석되어 사용자의 제어명령으로 처리될 수 있다.

센싱부(240)는 이동 단말기 내 정보, 이동 단말기를 둘러싼 주변 환경 정보 및 사용자 정보 중 적어도 하나를 센싱 하기 위한 하나 이상의 센서를 포함할 수 있다. 예를 들어, 센싱부(240)는 근접센서(241, proximity sensor), 조도 센서(242, illumination sensor), 터치 센서(touch sensor), 가속도 센서(acceleration sensor), 자기 센서(magnetic sensor), 중력 센서(G-sensor), 자이로스코프 센서(gyroscope sensor), 모션 센서(motion sensor), RGB 센서, 적외선 센서(IR 센서: infrared sensor), 지문인식 센서(finger scan sensor), 초음파 센서(ultrasonic sensor), 광 센서(optical sensor, 예를 들어, 카메라(121 참조)), 마이크로폰(microphone, 222 참조), 배터리 게이지(battery gauge), 환경 센서(예를 들어, 기압계, 습도계, 온도계, 방사능 감지 센서, 열 감지 센서, 가스 감지 센서 등), 화학 센서(예를 들어, 전자 코, 헬스케어 센서, 생체 인식 센서 등) 중 적어도 하나를 포함할 수 있다. 한편, 본 명세서에 개시된 이동 단말기는, 이러한 센서들 중 적어도 둘 이상의 센서에서 센싱 되는 정보들을 조합하여 활용할 수 있다.

출력부(250)는 시각, 청각 또는 촉각 등과 관련된 출력을 발생시키기 위한 것으로, 디스플레이부(251), 음향 출력부(252), 햅팁 모듈(253), 광 출력부(254) 중 적어도 하나를 포함할 수 있다. 디스플레이부(251)는 터치 센서와 상호 레이어 구조를 이루거나 일체형으로 형성됨으로써, 터치 스크린을 구현할 수 있다. 이러한 터치 스크린은, 이동 단말기(200)와 사용자 사이의 입력 인터페이스를 제공하는 사용자 입력부(223)로써 기능함과 동시에, 이동 단말기(200)와 사용자 사이의 출력 인터페이스를 제공할 수 있다.

인터페이스부(260)는 이동 단말기(200)에 연결되는 다양한 종류의 외부 기기와의 통로 역할을 수행한다. 이러한 인터페이스부(260)는, 유/무선 헤드셋 포트(port), 외부 충전기 포트(port), 유/무선 데이터 포트(port), 메모리 카드(memory card) 포트, 식별 모듈이 구비된 장치를 연결하는 포트(port), 오디오 I/O(Input/Output) 포트(port), 비디오 I/O(Input/Output) 포트(port), 이어폰 포트(port) 중 적어도 하나를 포함할 수 있다. 이동 단말기(100)에서는, 상기 인터페이스부(260)에 외부 기기가 연결되는 것에 대응하여, 연결된 외부 기기와 관련된 적절할 제어를 수행할 수 있다.

또한, 저장부(270)는 이동 단말기(200)의 다양한 기능을 지원하는 데이터를 저장한다. 저장부 (270)는 이동 단말기(100)에서 구동되는 다수의 응용 프로그램(application program 또는 애플리케이션(application)), 이동 단말기(200)의 동작을 위한 데이터들, 명령어들을 저장할 수 있다. 이러한 응용 프로그램 중 적어도 일부는, 무선 통신을 통해 외부 서버로부터 다운로드 될 수 있다. 또한 이러한 응용 프로그램 중 적어도 일부는, 이동 단말기(200)의 기본적인 기능(예를 들어, 전화 착신, 발신 기능, 메시지 수신, 발신 기능)을 위하여 출고 당시부터 이동 단말기(200)상에 존재할 수 있다. 한편, 응용 프로그램은, 저장부(270)에 저장되고, 이동 단말기(200) 상에 설치되어, 제어부(280)에 의하여 상기 이동 단말기의 동작(또는 기능)을 수행하도록 구동될 수 있다.

제어부(280)는 상기 응용 프로그램과 관련된 동작 외에도, 통상적으로 이동 단말기(200)의 전반적인 동작을 제어한다. 제어부(280)는 위에서 살펴본 구성요소들을 통해 입력 또는 출력되는 신호, 데이터, 정보 등을 처리하거나 저장부(270)에 저장된 응용 프로그램을 구동함으로써, 사용자에게 적절한 정보 또는 기능을 제공 또는 처리할 수 있다.

또한, 제어부(180)는 저장부(270)에 저장된 응용 프로그램을 구동하기 위하여, 도 2와 함께 살펴본 구성요소들 중 적어도 일부를 제어할 수 있다. 나아가, 제어부(280)는 상기 응용 프로그램의 구동을 위하여, 이동 단말기(200)에 포함된 구성요소들 중 적어도 둘 이상을 서로 조합하여 동작시킬 수 있다.

전원공급부(290)는 제어부(280)의 제어 하에서, 외부의 전원, 내부의 전원을 인가 받아 이동 단말기(200)에 포함된 각 구성요소들에 전원을 공급한다. 이러한 전원공급부(290)는 배터리를 포함하며, 상기 배터리는 내장형 배터리 또는 교체 가능한 형태의 배터리가 될 수 있다.

상기 각 구성요소들 중 적어도 일부는, 이하에서 설명되는 다양한 실시 예들에 따른 이동 단말기의 동작, 제어, 또는 제어방법을 구현하기 위하여 서로 협력하여 동작할 수 있다. 또한, 상기 이동 단말기의 동작, 제어, 또는 제어방법은 상기 저장부(270)에 저장된 적어도 하나의 응용 프로그램의 구동에 의하여 이동 단말기 상에서 구현될 수 있다.

이하에서는, 위에서 살펴본 이동 단말기(200)를 통하여 구현되는 다양한 실시 예들을 살펴보기에 앞서, 위에서 열거된 구성요소들에 대하여 도 2를 참조하여 보다 구체적으로 살펴본다.

먼저, 통신부(210)에 대하여 살펴보면, 통신부(210)의 방송 수신 모듈(211)은 방송 채널을 통하여 외부의 방송 관리 서버로부터 방송 신호 및/또는 방송 관련된 정보를 수신한다. 상기 방송 채널은 위성 채널, 지상파 채널을 포함할 수 있다. 적어도 두 개의 방송 채널들에 대한 동시 방송 수신 또는 방송 채널 스위칭을 위해 둘 이상의 상기 방송 수신 모듈이 상기 이동단말기(200)에 제공될 수 있다.

이동통신 모듈(212)은, 이동통신을 위한 기술표준들 또는 통신방식(예를 들어, GSM(Global System for Mobile communication), CDMA(Code Division Multi Access), CDMA2000(Code Division Multi Access 2000), EV-DO(Enhanced Voice-Data Optimized or Enhanced Voice-Data Only), WCDMA(Wideband CDMA), HSDPA(High Speed Downlink Packet Access), HSUPA(High Speed Uplink Packet Access), LTE(Long Term Evolution), LTE-A(Long Term Evolution-Advanced) 등)에 따라 구축된 이동 통신망 상에서 기지국, 외부의 단말, 서버 중 적어도 하나와 무선 신호를 송수신한다.

상기 무선 신호는, 음성 호 신호, 화상 통화 호 신호 또는 문자/멀티미디어 메시지 송수신에 따른 다양한 형태의 데이터를 포함할 수 있다.

무선 인터넷 모듈(213)은 무선 인터넷 접속을 위한 모듈을 말하는 것으로, 이동 단말기(200)에 내장되거나 외장될 수 있다. 무선 인터넷 모듈(213)은 무선 인터넷 기술들에 따른 통신망에서 무선 신호를 송수신하도록 이루어진다.

무선 인터넷 기술로는, 예를 들어 WLAN(Wireless LAN), Wi-Fi(Wireless-Fidelity), Wi-Fi(Wireless Fidelity) Direct, DLNA(Digital Living Network Alliance), WiBro(Wireless Broadband), WiMAX(World Interoperability for Microwave Access), HSDPA(High Speed Downlink Packet Access), HSUPA(High Speed Uplink Packet Access), LTE(Long Term Evolution), LTE-A(Long Term Evolution-Advanced) 등이 있으며, 상기 무선 인터넷 모듈(213)은 상기에서 나열되지 않은 인터넷 기술까지 포함한 범위에서 적어도 하나의 무선 인터넷 기술에 따라 데이터를 송수신하게 된다.

WiBro, HSDPA, HSUPA, GSM, CDMA, WCDMA, LTE, LTE-A 등에 의한 무선인터넷 접속은 이동통신망을 통해 이루어진다는 관점에서 본다면, 상기 이동통신망을 통해 무선인터넷 접속을 수행하는 상기 무선 인터넷 모듈(213)은 상기 이동통신 모듈(212)의 일종으로 이해될 수도 있다.

근거리 통신 모듈(214)은 근거리 통신(Short range communication)을 위한 것으로서, 블루투스(Bluetooth™), RFID(Radio Frequency Identification), 적외선 통신(Infrared Data Association; IrDA), UWB(Ultra Wideband), ZigBee, NFC(Near Field Communication), Wi-Fi(Wireless-Fidelity), Wi-Fi Direct, Wireless USB(Wireless Universal Serial Bus) 기술 중 적어도 하나를 이용하여, 근거리 통신을 지원할 수 있다. 이러한, 근거리 통신 모듈(214)은, 근거리 무선 통신망(Wireless Area Networks)을 통해 이동 단말기(200)와 무선 통신 시스템 사이, 이동 단말기(200)와 다른 이동 단말기(200) 사이, 또는 이동 단말기(200)와 다른 이동 단말기(200, 또는 외부서버)가 위치한 네트워크 사이의 무선 통신을 지원할 수 있다. 상기 근거리 무선 통신망은 근거리 무선 개인 통신망(Wireless Personal Area Networks)일 수 있다.

여기에서, 다른 이동 단말기(200)는 본 발명에 따른 이동 단말기(200)와 데이터를 상호 교환하는 것이 가능한(또는 연동 가능한) 웨어러블 디바이스(wearable device, 예를 들어, 스마트워치(smartwatch), 스마트 글래스(smart glass), HMD(head mounted display))가 될 수 있다. 근거리 통신 모듈(214)은, 이동 단말기(200) 주변에, 상기 이동 단말기(100)와 통신 가능한 웨어러블 디바이스를 감지(또는 인식)할 수 있다. 나아가, 제어부(280)는 상기 감지된 웨어러블 디바이스가 본 발명에 따른 이동 단말기(100)와 통신하도록 인증된 디바이스인 경우, 이동 단말기(200)에서 처리되는 데이터의 적어도 일부를, 상기 근거리 통신 모듈(214)을 통해 웨어러블 디바이스로 송신할 수 있다. 따라서, 웨어러블 디바이스의 사용자는, 이동 단말기(200)에서 처리되는 데이터를, 웨어러블 디바이스를 통해 이용할 수 있다. 예를 들어, 이에 따르면 사용자는, 이동 단말기(200)에 전화가 수신된 경우, 웨어러블 디바이스를 통해 전화 통화를 수행하거나, 이동 단말기(200)에 메시지가 수신된 경우, 웨어러블 디바이스를 통해 상기 수신된 메시지를 확인하는 것이 가능하다.

위치정보 모듈(215)은 이동 단말기의 위치(또는 현재 위치)를 획득하기 위한 모듈로서, 그의 대표적인 예로는 GPS(Global Positioning System) 모듈 또는 WiFi(Wireless Fidelity) 모듈이 있다. 예를 들어, 이동 단말기는 GPS모듈을 활용하면, GPS 위성에서 보내는 신호를 이용하여 이동 단말기의 위치를 획득할 수 있다. 다른 예로서, 이동 단말기는 Wi-Fi모듈을 활용하면, Wi-Fi모듈과 무선신호를 송신 또는 수신하는 무선 AP(Wireless Access Point)의 정보에 기반하여, 이동 단말기의 위치를 획득할 수 있다. 필요에 따라서, 위치정보모듈(215)은 치환 또는 부가적으로 이동 단말기의 위치에 관한 데이터를 얻기 위해 무선 통신부(110)의 다른 모듈 중 어느 기능을 수행할 수 있다. 위치정보모듈(215)은 이동 단말기의 위치(또는 현재 위치)를 획득하기 위해 이용되는 모듈로, 이동 단말기의 위치를 직접적으로 계산하거나 획득하는 모듈로 한정되지는 않는다.

다음으로, 입력부(220)는 영상 정보(또는 신호), 오디오 정보(또는 신호), 데이터, 또는 사용자로부터 입력되는 정보의 입력을 위한 것으로서, 영상 정보의 입력을 위하여, 이동 단말기(200) 는 하나 또는 복수의 카메라(221)를 구비할 수 있다. 카메라(221)는 화상 통화모드 또는 촬영 모드에서 이미지 센서에 의해 얻어지는 정지영상 또는 동영상 등의 화상 프레임을 처리한다. 처리된 화상 프레임은 디스플레이부(251)에 표시되거나 저장부(270)에 저장될 수 있다. 한편, 이동 단말기(200)에 구비되는 복수의 카메라(221)는 매트릭스 구조를 이루도록 배치될 수 있으며, 이와 같이 매트릭스 구조를 이루는 카메라(221)를 통하여, 이동 단말기(200)에는 다양한 각도 또는 초점을 갖는 복수의 영상정보가 입력될 수 있다. 또한, 복수의 카메라(221)는 입체영상을 구현하기 위한 좌 영상 및 우 영상을 획득하도록, 스트레오 구조로 배치될 수 있다.

마이크로폰(222)은 외부의 음향 신호를 전기적인 음성 데이터로 처리한다. 처리된 음성 데이터는 이동 단말기(200)에서 수행 중인 기능(또는 실행 중인 응용 프로그램)에 따라 다양하게 활용될 수 있다. 한편, 마이크로폰(222)에는 외부의 음향 신호를 입력 받는 과정에서 발생되는 잡음(noise)을 제거하기 위한 다양한 잡음 제거 알고리즘이 구현될 수 있다.

사용자 입력부(223)는 사용자로부터 정보를 입력 받기 위한 것으로서, 사용자 입력부(223)를 통해 정보가 입력되면, 제어부(280)는 입력된 정보에 대응되도록 이동 단말기(200)의 동작을 제어할 수 있다. 이러한, 사용자 입력부(223)는 기계식 (mechanical) 입력수단(또는, 메커니컬 키, 예를 들어, 이동 단말기(200)의 전·후면 또는 측면에 위치하는 버튼, 돔 스위치 (dome switch), 조그 휠, 조그 스위치 등) 및 터치식 입력수단을 포함할 수 있다. 일 예로서, 터치식 입력수단은, 소프트웨어적인 처리를 통해 터치스크린에 표시되는 가상 키(virtual key), 소프트 키(soft key) 또는 비주얼 키(visual key)로 이루어지거나, 상기 터치스크린 이외의 부분에 배치되는 터치 키(touch key)로 이루어질 수 있다. 한편, 상기 가상키 또는 비주얼 키는, 다양한 형태를 가지면서 터치스크린 상에 표시되는 것이 가능하며, 예를 들어, 그래픽(graphic), 텍스트(text), 아이콘(icon), 비디오(video) 또는 이들의 조합으로 이루어질 수 있다.

한편, 센싱부(240)는 이동 단말기 내 정보, 이동 단말기를 둘러싼 주변 환경 정보 및 사용자 정보 중 적어도 하나를 센싱 하고, 이에 대응하는 센싱 신호를 발생시킨다. 제어부(280)는 이러한 센싱 신호에 기초하여, 이동 단말기(200)의 구동 또는 동작을 제어하거나, 이동 단말기(200)에 설치된 응용 프로그램과 관련된 데이터 처리, 기능 또는 동작을 수행 할 수 있다. 센싱부(240)에 포함될 수 있는 다양한 센서 중 대표적인 센서들의 대하여, 보다 구체적으로 살펴본다.

먼저, 근접 센서(241)는 소정의 검출면에 접근하는 물체, 혹은 근방에 존재하는 물체의 유무를 전자계의 힘 또는 적외선 등을 이용하여 기계적 접촉이 없이 검출하는 센서를 말한다. 이러한 근접 센서(241)는 위에서 살펴본 터치 스크린에 의해 감싸지는 이동 단말기의 내부 영역 또는 상기 터치 스크린의 근처에 근접 센서(241)가 배치될 수 있다.

근접 센서(241)의 예로는 투과형 광전 센서, 직접 반사형 광전 센서, 미러 반사형 광전 센서, 고주파 발진형 근접 센서, 정전 용량형 근접 센서, 자기형 근접 센서, 적외선 근접 센서 등이 있다. 터치 스크린이 정전식인 경우에, 근접 센서(241)는 전도성을 갖는 물체의 근접에 따른 전계의 변화로 상기 물체의 근접을 검출하도록 구성될 수 있다. 이 경우 터치 스크린(또는 터치 센서) 자체가 근접 센서로 분류될 수 있다.

한편, 설명의 편의를 위해, 터치 스크린 상에 물체가 접촉되지 않으면서 근접되어 상기 물체가 상기 터치 스크린 상에 위치함이 인식되도록 하는 행위를 "근접 터치(proximity touch)"라고 명명하고, 상기 터치 스크린 상에 물체가 실제로 접촉되는 행위를 "접촉 터치(contact touch)"라고 명명한다. 상기 터치 스크린 상에서 물체가 근접 터치 되는 위치라 함은, 상기 물체가 근접 터치될 때 상기 물체가 상기 터치 스크린에 대해 수직으로 대응되는 위치를 의미한다. 상기 근접 센서(241)는, 근접 터치와, 근접 터치 패턴(예를 들어, 근접 터치 거리, 근접 터치 방향, 근접 터치 속도, 근접 터치 시간, 근접 터치 위치, 근접 터치 이동 상태 등)을 감지할 수 있다. 한편, 제어부(180)는 위와 같이, 근접 센서(241)를 통해 감지된 근접 터치 동작 및 근접 터치 패턴에 상응하는 데이터(또는 정보)를 처리하며, 나아가, 처리된 데이터에 대응하는 시각적인 정보를 터치 스크린상에 출력시킬 수 있다. 나아가, 제어부(280)는, 터치 스크린 상의 동일한 지점에 대한 터치가, 근접 터치인지 또는 접촉 터치인지에 따라, 서로 다른 동작 또는 데이터(또는 정보)가 처리되도록 이동 단말기(200)를 제어할 수 있다.

터치 센서는 저항막 방식, 정전용량 방식, 적외선 방식, 초음파 방식, 자기장 방식 등 여러 가지 터치방식 중 적어도 하나를 이용하여 터치 스크린(또는 디스플레이부(151))에 가해지는 터치(또는 터치입력)을 감지한다.

일 예로서, 터치 센서는, 터치 스크린의 특정 부위에 가해진 압력 또는 특정 부위에 발생하는 정전 용량 등의 변화를 전기적인 입력신호로 변환하도록 구성될 수 있다. 터치 센서는, 터치 스크린 상에 터치를 가하는 터치 대상체가 터치 센서 상에 터치 되는 위치, 면적, 터치 시의 압력, 터치 시의 정전 용량 등을 검출할 수 있도록 구성될 수 있다. 여기에서, 터치 대상체는 상기 터치 센서에 터치를 인가하는 물체로서, 예를 들어, 손가락, 터치펜 또는 스타일러스 펜(Stylus pen), 포인터 등이 될 수 있다.

이와 같이, 터치 센서에 대한 터치 입력이 있는 경우, 그에 대응하는 신호(들)는 터치 제어기로 보내진다. 터치 제어기는 그 신호(들)를 처리한 다음 대응하는 데이터를 제어부(180)로 송신한다. 이로써, 제어부(280)는 디스플레이부(251)의 어느 영역이 터치 되었는지 여부 등을 알 수 있게 된다. 여기에서, 터치 제어기는, 제어부(280)와 별도의 구성요소일 수 있고, 제어부(280) 자체일 수 있다.

한편, 제어부(280)는, 터치 스크린(또는 터치 스크린 이외에 구비된 터치키)을 터치하는, 터치 대상체의 종류에 따라 서로 다른 제어를 수행하거나, 동일한 제어를 수행할 수 있다. 터치 대상체의 종류에 따라 서로 다른 제어를 수행할지 또는 동일한 제어를 수행할 지는, 현재 이동 단말기(200)의 동작상태 또는 실행 중인 응용 프로그램에 따라 결정될 수 있다.

한편, 위에서 살펴본 터치 센서 및 근접 센서는 독립적으로 또는 조합되어, 터치 스크린에 대한 숏(또는 탭) 터치(short touch), 롱 터치(long touch), 멀티 터치(multi touch), 드래그 터치(drag touch), 플리크 터치(flick touch), 핀치-인 터치(pinch-in touch), 핀치-아웃 터치(pinch-out 터치), 스와이프(swype) 터치, 호버링(hovering) 터치 등과 같은, 다양한 방식의 터치를 센싱할 수 있다.

초음파 센서는 초음파를 이용하여, 감지대상의 위치정보를 인식할 수 있다. 한편 제어부(280)는 광 센서와 복수의 초음파 센서로부터 감지되는 정보를 통해, 파동 발생원의 위치를 산출하는 것이 가능하다. 파동 발생원의 위치는, 광이 초음파보다 매우 빠른 성질, 즉, 광이 광 센서에 도달하는 시간이 초음파가 초음파 센서에 도달하는 시간보다 매우 빠름을 이용하여, 산출될 수 있다. 보다 구체적으로 광을 기준 신호로 초음파가 도달하는 시간과의 시간차를 이용하여 파동 발생원의 위치가 산출될 수 있다.

한편, 입력부(220)의 구성으로 살펴본, 카메라(221)는 카메라 센서(예를 들어, CCD, CMOS 등), 포토 센서(또는 이미지 센서) 및 레이저 센서 중 적어도 하나를 포함한다.

카메라(221)와 레이저 센서는 서로 조합되어, 3차원 입체영상에 대한 감지대상의 터치를 감지할 수 있다. 포토 센서는 디스플레이 소자에 적층될 수 있는데, 이러한 포토 센서는 터치 스크린에 근접한 감지대상의 움직임을 스캐닝 하도록 이루어진다. 보다 구체적으로, 포토 센서는 행/열에 Photo Diode와 TR(Transistor)를 실장하여 Photo Diode에 인가되는 빛의 양에 따라 변화되는 전기적 신호를 이용하여 포토 센서 위에 올려지는 내용물을 스캔 한다. 즉, 포토 센서는 빛의 변화량에 따른 감지대상의 좌표 계산을 수행하며, 이를 통하여 감지대상의 위치정보가 획득될 수 있다.

디스플레이부(251)는 이동 단말기(200)에서 처리되는 정보를 표시(출력)한다. 예를 들어, 디스플레이부(251)는 이동 단말기(200)에서 구동되는 응용 프로그램의 실행화면 정보, 또는 이러한 실행화면 정보에 따른 UI(User Interface), GUI(Graphic User Interface) 정보를 표시할 수 있다.

또한, 상기 디스플레이부(251)는 입체영상을 표시하는 입체 디스플레이부로서 구성될 수 있다.

상기 입체 디스플레이부에는 스테레오스코픽 방식(안경 방식), 오토 스테레오스코픽 방식(무안경 방식), 프로젝션 방식(홀로그래픽 방식) 등의 3차원 디스플레이 방식이 적용될 수 있다.

음향 출력부(252)는 호신호 수신, 통화모드 또는 녹음 모드, 음성인식 모드, 방송수신 모드 등에서 무선 통신부(210)로부터 수신되거나 저장부(270)에 저장된 오디오 데이터를 출력할 수 있다. 음향 출력부(152)는 이동 단말기(200)에서 수행되는 기능(예를 들어, 호신호 수신음, 메시지 수신음 등)과 관련된 음향 신호를 출력하기도 한다. 이러한 음향 출력부(252)에는 리시버(receiver), 스피커(speaker), 버저(buzzer) 등이 포함될 수 있다.

햅틱 모듈(haptic module)(253)은 사용자가 느낄 수 있는 다양한 촉각 효과를 발생시킨다. 햅틱 모듈(253)이 발생시키는 촉각 효과의 대표적인 예로는 진동이 될 수 있다. 햅틱 모듈(253)에서 발생하는 진동의 세기와 패턴 등은 사용자의 선택 또는 제어부의 설정에 의해 제어될 수 있다. 예를 들어, 상기 햅틱 모듈(253)은 서로 다른 진동을 합성하여 출력하거나 순차적으로 출력할 수도 있다.

햅틱 모듈(253)은, 진동 외에도, 접촉 피부면에 대해 수직 운동하는 핀 배열, 분사구나 흡입구를 통한 공기의 분사력이나 흡입력, 피부 표면에 대한 스침, 전극(electrode)의 접촉, 정전기력 등의 자극에 의한 효과와, 흡열이나 발열 가능한 소자를 이용한 냉온감 재현에 의한 효과 등 다양한 촉각 효과를 발생시킬 수 있다.

햅틱 모듈(253)은 직접적인 접촉을 통해 촉각 효과를 전달할 수 있을 뿐만 아니라, 사용자가 손가락이나 팔 등의 근 감각을 통해 촉각 효과를 느낄 수 있도록 구현할 수도 있다. 햅틱 모듈(253)은 이동 단말기(200)의 구성 태양에 따라 2개 이상이 구비될 수 있다.

광출력부(254)는 이동 단말기(200)의 광원의 빛을 이용하여 이벤트 발생을 알리기 위한 신호를 출력한다. 이동 단말기(200)에서 발생 되는 이벤트의 예로는 메시지 수신, 호 신호 수신, 부재중 전화, 알람, 일정 알림, 이메일 수신, 애플리케이션을 통한 정보 수신 등이 될 수 있다.

광출력부(254)가 출력하는 신호는 이동 단말기가 전면이나 후면으로 단색이나 복수색의 빛을 발광함에 따라 구현된다. 상기 신호 출력은 이동 단말기가 사용자의 이벤트 확인을 감지함에 의하여 종료될 수 있다.

인터페이스부(260)는 이동 단말기(200)에 연결되는 모든 외부 기기와의 통로 역할을 한다. 인터페이스부(260)는 외부 기기로부터 데이터를 송신 받거나, 전원을 공급받아 이동 단말기(200) 내부의 각 구성요소에 전달하거나, 이동 단말기(200) 내부의 데이터가 외부 기기로 송신되도록 한다. 예를 들어, 유/무선 헤드셋 포트(port), 외부 충전기 포트(port), 유/무선 데이터 포트(port), 메모리 카드(memory card) 포트(port), 식별 모듈이 구비된 장치를 연결하는 포트(port), 오디오 I/O(Input/Output) 포트(port), 비디오 I/O(Input/Output) 포트(port), 이어폰 포트(port) 등이 인터페이스부(160)에 포함될 수 있다.

한편, 식별 모듈은 이동 단말기(200)의 사용 권한을 인증하기 위한 각종 정보를 저장한 칩으로서, 사용자 인증 모듈(user identify module; UIM), 가입자 인증 모듈(subscriber identity module; SIM), 범용 사용자 인증 모듈(universal subscriber identity module; USIM) 등을 포함할 수 있다. 식별 모듈이 구비된 장치(이하 '식별 장치')는, 스마트 카드(smart card) 형식으로 제작될 수 있다. 따라서 식별 장치는 상기 인터페이스부(260)를 통하여 단말기(200)와 연결될 수 있다.

또한, 상기 인터페이스부(260)는 이동 단말기(200)가 외부 크래들(cradle)과 연결될 때 상기 크래들로부터의 전원이 상기 이동 단말기(200)에 공급되는 통로가 되거나, 사용자에 의해 상기 크래들에서 입력되는 각종 명령 신호가 상기 이동 단말기(200)로 전달되는 통로가 될 수 있다. 상기 크래들로부터 입력되는 각종 명령 신호 또는 상기 전원은 상기 이동 단말기(200)가 상기 크래들에 정확히 장착되었음을 인지하기 위한 신호로 동작될 수 있다.

저장부(270)는 제어부(280)의 동작을 위한 프로그램을 저장할 수 있고, 입/출력되는 데이터들(예를 들어, 폰북, 메시지, 정지영상, 동영상 등)을 임시 저장할 수도 있다. 상기 저장부(270)는 상기 터치 스크린 상의 터치 입력시 출력되는 다양한 패턴의 진동 및 음향에 관한 데이터를 저장할 수 있다.

저장부(270)는 플래시 메모리 타입(flash memory type), 하드디스크 타입(hard disk type), SSD 타입(Solid State Disk type), SDD 타입(Silicon Disk Drive type), 멀티미디어 카드 마이크로 타입(multimedia card micro type), 카드 타입의 메모리(예를 들어 SD 또는 XD 메모리 등), 램(random access memory; RAM), SRAM(static random access memory), 롬(read-only memory; ROM), EEPROM(electrically erasable programmable read-only memory), PROM(programmable read-only memory), 자기 메모리, 자기 디스크 및 광디스크 중 적어도 하나의 타입의 저장매체를 포함할 수 있다. 이동 단말기(200)는 인터넷(internet)상에서 상기 저장부(270)의 저장 기능을 수행하는 웹 스토리지(web storage)와 관련되어 동작될 수도 있다.

한편, 앞서 살펴본 것과 같이, 제어부(280)는 응용 프로그램과 관련된 동작과, 통상적으로 이동 단말기(200)의 전반적인 동작을 제어한다. 예를 들어, 제어부(280)는 상기 이동 단말기의 상태가 설정된 조건을 만족하면, 애플리케이션들에 대한 사용자의 제어 명령의 입력을 제한하는 잠금 상태를 실행하거나, 해제할 수 있다.

또한, 제어부(280)는 음성 통화, 데이터 통신, 화상 통화 등과 관련된 제어 및 처리를 수행하거나, 터치 스크린 상에서 행해지는 필기 입력 또는 그림 그리기 입력을 각각 문자 및 이미지로 인식할 수 있는 패턴 인식 처리를 행할 수 있다. 나아가 제어부(280)는 이하에서 설명되는 다양한 실시 예들을 본 발명에 따른 이동 단말기(200) 상에서 구현하기 위하여, 위에서 살펴본 구성요소들을 중 어느 하나 또는 복수를 조합하여 제어할 수 있다.

전원 공급부(290)는 제어부(280)의 제어에 의해 외부의 전원, 내부의 전원을 인가 받아 각 구성요소들의 동작에 필요한 전원을 공급한다. 전원공급부(290)는 배터리를 포함하며, 배터리는 충전 가능하도록 이루어지는 내장형 배터리가 될 수 있으며, 충전 등을 위하여 단말기 바디에 착탈 가능하게 결합될 수 있다.

또한, 전원공급부(290)는 연결포트를 구비할 수 있으며, 연결포트는 배터리의 충전을 위하여 전원을 공급하는 외부 충전기가 전기적으로 연결되는 인터페이스(260)의 일 예로서 구성될 수 있다.

다른 예로서, 전원공급부(290)는 상기 연결포트를 이용하지 않고 무선방식으로 배터리를 충전하도록 이루어질 수 있다. 이 경우에, 전원공급부(290)는 외부의 무선 전력 송신장치로부터 자기 유도 현상에 기초한 유도 결합(Inductive Coupling) 방식이나 전자기적 공진 현상에 기초한 공진 결합(Magnetic Resonance Coupling) 방식 중 하나 이상을 이용하여 전력을 전달받을 수 있다.

한편, 이하에서 다양한 실시 예는 예를 들어, 소프트웨어, 하드웨어 또는 이들의 조합된 것을 이용하여 컴퓨터 또는 이와 유사한 장치로 읽을 수 있는 기록매체 내에서 구현될 수 있다.

다음으로, 본 발명에 따른 이동 단말기(200)를 통해 실시 가능한 통신 시스템에 대하여 살펴본다.

먼저, 통신 시스템은, 서로 다른 무선 인터페이스 및/또는 물리 계층을 이용할 수도 있다. 예를 들어, 통신 시스템에 의해 이용 가능한 무선 인터페이스에는, 주파수 분할 다중 접속(Frequency Division Multiple Access, FDMA), 시분할 다중 접속(Time Division Multiple Access, TDMA), 코드 분할 다중 접속(Code Division Multiple Access, CDMA), 범용 이동통신 시스템(Universal Mobile Telecommunications Systems, UMTS)(특히, LTE(Long Term Evolution), LTE-A(Long Term Evolution-Advanced)), 이동통신 글로벌 시스템(Global System for Mobile Communications, GSM) 등이 포함될 수 있다.

이하에서는, 설명의 편의를 위하여, CDMA에 한정하여 설명하도록 한다. 그러나, 본 발명은, CDMA 무선 통신 시스템뿐만 아니라 OFDM(Orthogonal Frequency Division Multiplexing) 무선 통신 시스템을 포함한 모든 통신 시스템 적용될 수 있음은 자명하다.

CDMA 무선 통신 시스템은, 적어도 하나의 단말기(200), 적어도 하나의 기지국(Base Station, BS (Node B 혹은 Evolved Node B로 명칭 될 수도 있다.)), 적어도 하나의 기지국 제어부(Base Station Controllers, BSCs), 이동 스위칭 센터(Mobile Switching Center, MSC)를 포함할 수 있다. MSC는, 일반 전화 교환망(Public Switched Telephone Network, PSTN) 및 BSCs와 연결되도록 구성된다. BSCs는, 백홀 라인(backhaul line)을 통하여, BS와 짝을 이루어 연결될 수 있다. 백홀 라인은, E1/T1, ATM, IP, PPP, Frame Relay, HDSL, ADSL 또는 xDSL 중 적어도 하나에 따라서 구비될 수 있다. 따라서, 복수의 BSCs가 CDMA 무선 통신 시스템에 포함될 수 있다.

복수의 BS 각각은 적어도 하나의 섹터를 포함할 수 있고, 각각의 섹터는, 전방향성 안테나 또는 BS로부`터 방사상의 특정 방향을 가리키는 안테나를 포함할 수 있다. 또한, 각각의 섹터는, 다양한 형태의 안테나를 두 개 이상 포함할 수도 있다. 각각의 BS는, 복수의 주파수 할당을 지원하도록 구성될 수 있고, 복수의 주파수 할당은 각각 특정 스펙트럼(예를 들어, 1.25MHz, 5MHz 등)을 가질 수 있다.

섹터와 주파수 할당의 교차는, CDMA 채널이라고 불릴 수 있다. BS는, 기지국 송수신 하부 시스템(Base Station Transceiver Subsystem, BTSs)이라고 불릴 수 있다. 이러한 경우, 하나의 BSC 및 적어도 하나의 BS를 합하여 “기지국”이라고 칭할 수 있다. 기지국은, 또한 "셀 사이트"을 나타낼 수도 있다. 또는, 특정 BS에 대한 복수의 섹터들 각각은, 복수의 셀 사이트로 불릴 수도 있다.

방송 송신부(Broadcasting Transmitter, BT) 는, 시스템 내에서 동작하는 단말기들(200)에게 방송 신호를 송신한다. 도 2 도시된 방송 수신 모듈(211)은, BT에 의해 송신되는 방송 신호를 수신하기 위해 단말기(100) 내에 구비된다.

뿐만 아니라, CDMA 무선 통신 시스템에는 이동 단말기(200)의 위치를 확인하기 위한, 위성 위치 확인 시스템(Global Positioning System, GPS)이 연계될 수 있다. 상기 위성(300)은, 이동 단말기(100)의 위치를 파악하는 것을 돕는다. 유용한 위치 정보는, 두 개 이하 또는 이상의 위성들에 의해 획득될 수도 있다. 여기에서는, GPS 추적 기술뿐만 아니라 위치를 추적할 수 있는 모든 기술들을 이용하여 이동 단말기(200)의 위치가 추적될 수 있다. 또한, GPS 위성 중 적어도 하나는, 선택적으로 또는 추가로 위성 DMB 송신을 담당할 수도 있다.

이동 단말기에 구비된 위치정보 모듈(215)은 이동 단말기의 위치를 탐지, 연산 또는 식별하기 위한 것으로, 대표적인 예로는 GPS(Global Position System) 모듈 및 WiFi(Wireless Fidelity) 모듈을 포함할 수 있다. 필요에 따라서, 위치정보모듈(115)은 치환 또는 부가적으로 이동 단말기의 위치에 관한 데이터를 얻기 위해 무선 통신부(210)의 다른 모듈 중 어느 기능을 수행할 수 있다.

한편, 이하에서 다양한 실시 예는 예를 들어, 소프트웨어, 하드웨어 또는 이들의 조합된 것을 이용하여 컴퓨터 또는 이와 유사한 장치로 읽을 수 있는 기록매체 내에서 구현될 수 있다.

한편, 본 실시 예에서는 음성 인식 가능한 전자기기의 예로써, TV의 예를 들어 설명한다. 다만, 이에 한정되지 않으며, 본 발명은 디스플레이 장치, 이동 단말기, 기타 음성 인식을 수행할 수 있는 모든 장치에 적용될 수 있다.

도 3은, 본 발명의 실시 예에 따른, 전자기기의 음성 인식 방법을 설명하기 위한 순서도이다.

도 3에 따르면, 본 발명의 실시 예에 따른, 전자기기의 음성 인식 방법은, 사용자의 음성을 수신하는 단계(S310), 상기 수신된 음성으로부터 하나 이상의 음소 정보를 획득하는 단계(S330), 상기 획득된 하나 이상의 음소 정보를 이용하여 상기 사용자의 사용 언어를 판단하는 단계(S350), 상기 사용자의 사용 언어를 기초로 상기 사용자의 음성을 인식하는 단계(S370)를 포함할 수 있다.

사용자의 음성을 수신하는 단계(S310)와 관련하여, 입력부(150)는 사용자의 음성을 수신할 수 있다. 구체적으로, 입력부(150)는 외부로부터 오디오를 수신할 수 있으며, 오디오에는 사용자의 음성이 포함될 수 있다.

여기서, 사용자의 음성은 복수의 언어 중 하나로 이루어진 음성일 수 있다. 예를 들어, 사용자는 “책상”, “시계” 등의 한국어를 말할 수 있으며, 이러한 경우 입력부(150)는 한국어로 이루어진 사용자의 음성을 수신할 수 있다. 또 다른 예로써, 사용자는 “school”, “boy” 등의 영어를 말할 수 있으며, 이러한 경우 입력부(150)는 영어로 이루어진 사용자의 음성을 수신할 수 있다.

또한, 사용자 음성은 복수의 언어 중 두 개 이상의 언어로 이루어진 음성일 수 있다. 예를 들어, 사용자는 “Meteo 번역해줘.”라는 프랑스어와 한국어로 이루어진 음성을 말할 수 있으며, 입력부(150)는 프랑스어 및 한국어로 이루어진 사용자의 음성을 수신할 수 있다.

그리고, 입력부(150)는 수신한 사용자의 음성을 음성 신호로써 제어부(170)에 전달할 수 있다.

수신된 음성으로부터 하나 이상의 음소 정보를 획득하는 단계(S330)와 관련하여, 도 4 및 도 5를 참고하여 구체적으로 설명한다.

도 4는, 본 발명의 실시 예에 따른 각각의 언어의 음소를 설명하기 위한 도면이다.

여기서, 음소는 더 이상 작은 단위로 나눌 수 없는 음운의 최소 단위일 수 있다. 또한, 음소는 한 언어의 음성체계에서 단어의 의미를 구별 짓는 최소의 소리 단위일 수 있다.

예를 들어, 한국어의‘살’과 ‘쌀’에서의 ‘ㅅ’과 ‘ㅆ’, ‘손’과 ‘산’에서 ‘ㅗ’와 ‘ㅏ’는 두 낱말의 의미를 구별시켜 주는 변별적 기능을 가진 음소일 수 있다.

한편, 한국어의 ‘살’과 ‘쌀’에서의 ㅅ(s) 와 ㅆ(s’)는 두 낱말의 의미를 구별시켜 주므로, 한국어에서는 ㅅ(s)와 ㅆ(s’)이 각각 서로 다른 음소로 인식될 수 있다. 다만, 영어 화자들은 s’를 단순히 s의 변이음으로 인식하는 바, 영어에서는 s와 s’가 하나의 음소로 인식될 수 있다.

한편, 영어에서의 'light’와 'right'에서 l과 r은 '가벼운'과 '옳은'과 같이 그 뜻을 구별시켜 주므로, l에 해당하는 발음기호 [l]과 r에 해당하는 발음기호 [r]은 별개의 음소를 이루고 있다. 다만, 한국어에서 [l]과 [r]은 의미 변별력이 없기 때문에 하나의 음소를 이루고 있다.

즉, 음소는 언어마다 차이가 있을 수 있다. 곧, 한 언어에서는 음소이지만 다른 언어에서는 음소가 아닌 소리가 있을 수 있으며, 그 반대로 한 언어에서는 음소가 아니지만 다른 언어에서는 음소인 소리가 있을 수 있다. 또한 한 언어에는 전혀 없는 소리가 다른 언어에 있을 수도 있다.

이와 같이, 각각의 언어는 서로 다른 음소를 각각 포함하고 있는 바, 제어부(170)는 사용자의 음성으로부터 획득한 음소를 복수의 언어 각각의 음소와 비교함으로써 사용자가 사용중인 언어가 무엇인지를 판단할 수 있다.

도 4a는 한국어에 포함될 수 있는 음소를 나열한 것이다. 한국어에 포함되는 음소로는 자음으로 “ㄱ, ㄴ, ㄷ, ㄹ, ㅁ, ㅂ, ㅅ, ㅇ, ㅈ, ㅊ, ㅋ, ㅌ, ㅍ, ㅎ, ㄲ, ㄸ, ㅃ, 쓰, ㅉ”가 있을 수 있으며, 모음으로는 “ㅏ, ㅓ, ㅗ, ㅜ, ㅡ, ㅣ, ㅐ, ㅔ, ㅑ, ㅕ, ㅛ, ㅠ, ㅒ, ㅖ, ㅘ, ㅙ, ㅝ, ㅞ, ㅚ, ㅟ, ㅢ”가 있을 수 있다.

한편, 도 4b는 미국식 영어에 포함될 수 있는 음소를 나열한 것이고, 도 4c는 영국식 영어에 포함될 수 있는 음소를 나열한 것이다.

미국식 영어와 영국식 영어는 모두 같은 문자(알파벳)를 사용한다. 다만, 미국식 영어와 영국식 영어는 발음에서 서로 차이가 있기 때문에, 미국식 영어와 영국식 영어에 각각 포함되는 음소는 서로 상이할 수 있다.

이러한 현상은 한 언어 안의 방언들에도 적용될 수 있다. 즉, 음소의 수와 종류는 하나의 언어의 개별방언에 따라 각각 달라질 수 있다. 예를 들어, 하나의 한국어라도 표준어와 전라도 사투리 및 경상도 사투리의 음소는 서로 상이할 수 있다.

따라서, 제어부(170)는 사용자의 음성으로부터 획득한 음소를 복수의 언어 및 개별 방언 각각의 음소와 비교함으로써 사용자가 사용중인 언어 및 사용자가 사용중인 방언이 무엇인지를 판단할 수 있다.

한편, 본 실시 예에서 도시한 음소는, 각 언어의 음소의 일 예에 불과하다. 구체적으로, 각 언어의 음소는 해석 기준에 따라 다소 상이해질 수 있기 때문에, 도 4에서 설명한 한국어, 미국식 영어, 영국식 영어의 음소는 일 예에 불과하고, 다른 해석 기준에 따른 음소를 적용하여 본 발명을 구현할 수도 있다.

다시 도 3으로 돌아가서, 제어부(170)는 수신한 음성으로부터 하나 이상의 음소 정보를 획득할 수 있다.(S330) 구체적으로, 제어부(170)는 입력부(150)로부터 오디오 신호를 수신하면, 수신한 오디오 신호에 음성 신호가 포함되어 있는지 판단할 수 있다. 그리고, 수신한 오디오 신호에 음성 신호가 포함되어 있으면(즉, 입력부(150)가 수신한 오디오에 사용자의 음성이 포함되어 있으면) 음성 스펙트럼으로부터 음성의 특징을 추출할 수 있다.

한편, 입력부(150)에서 수신한 오디오에 음성이 포함되어 있지 않은 경우, 제어부(170)는 음성을 인식할 수 없다는 내용의 알림을 출력할 수 있고, 음성 인식을 위해 음성을 다시 입력해 달라는 내용의 알림을 출력할 수 있다. 이 경우, 제어부(170)는 알림을 디스플레이부(180)를 통하여 영상으로 출력하거나, 오디오 출력부(185)를 통하여 음성으로써 출력할 수 있다.

한편, 제어부(170)는 수신한 오디오 신호에 음성 신호가 포함되어 있으면 음성 스펙트럼으로부터 음성의 특징을 추출한 후, 추출된 음성의 특징을 이용하여 사용자의 음성을 음소 단위로 분할할 수 있다.

예를 들어, 사용자가 “세바퀴”라는 단어를 말하고, “세바퀴”의 음성을 입력부(150)가 수신한 경우, 제어부(170)는 “세바퀴”에 대응되는 음성 신호를 입력부(150)로부터 수신하고, 음성의 특징을 추출할 수 있다. 그리고, 제어부(170)는 추출된 음성의 특징 및 음성 인식 알고리즘을 통하여 “세바퀴”라는 단어를 음소 단위로 분할하여 하나 이상의 음소 정보를 획득할 수 있다. 즉, 제어부(170)는 사용자가 입력한 “세바퀴”라는 단어를 “ㅅ”, “ㅔ”, “ㅂ”, “ㅏ”, “ㅋ”, “ㅟ”의 음소 단위로 분할한 음소 정보를 획득할 수 있다.

다른 예로써, 사용자가 “book”이라는 단어를 말한 경우, 제어부(170)는 사용자가 입력한 “book”이라는 단어를 “b”, “?”, “k”의 음소 단위로 분할한 음소 정보를 획득할 수 있다.

도 5는 사용자의 음성을 음소 단위로 분할한 음성 스펙트럼을 도시한 도면이다.

도 5를 참고하면, 음성 스펙트럼에는 “세바퀴”라는 단어의 음성이 음소 단위로 분할되어 나타나 있는 것을 알 수 있다. 그리고, 각각의 음소는 자신만의 특정 주파수를 가지고 있기 때문에, 제어부(170)는 분할된 음소를 데이터베이스화 된 각각의 언어의 음소와 비교하여 사용자의 사용 언어를 판단할 수 있다.

도 3으로 돌아가서, 본 발명의 실시 예에 따른, 전자기기의 음성 인식 방법은, 획득된 하나 이상의 음소 정보를 이용하여 사용자의 사용 언어를 판단하는 단계(S350)를 포함할 수 있다. 구체적으로, 제어부(170)는 사용자의 음성을 음소 단위로 분할한 음소 정보를 이용하여 사용자의 사용 언어를 판단할 수 있다.

이와 관련해서는, 도 6을 참고하여 구체적으로 설명한다.

도 6은, 하나 이상의 언어 각각의 음소가 데이터베이스화 있는 상태를 도시한 도면이다. 도 6a는 한국어 음소 데이터베이스(610), 도 6b는 미국식 영어 음소 데이터 베이스(620), 도6c는 영국식 영어 음소 데이터 베이스(630)를 도시하고 있다.

한편, 본 실시 예에서는 한글 음소, 미국식 영어 음소, 영국식 영어 음소를 예로써 설명하나 이에 한정되지 않고, 전 세계에 존재하는 모든 언어나 모든 언어의 방언이 포함될 수 있다.

하나 이상의 언어 각각의 음소 데이터베이스는 저장부(140)에 저장되어 있을 수 있다. 구체적으로, 하나 이상의 언어 각각의 음소 데이터베이스가 저장부(140)에 기 저장된 상태로 제품이 출시될 수 있으며, 서버로부터 수신하여 저장부(140)에 저장될 수 있다. 또한, 제어부(170)는 서버로부터 새로운 음소 데이터베이스를 수신하여 저장부(140)에 저장함으로써 하나 이상의 언어 각각의 음소 데이터 베이스를 지속적으로 업데이트 할 수 있다.

제어부(170)는 저장부(140)에 저장된 하나 이상의 언어 각각의 음소 정보와 사용자의 음성으로부터 획득한 하나 이상의 음소 정보를 비교하여 사용자의 사용 언어를 판단할 수 있다.

예를 들어, 사용자의 음성으로부터 제1 음소인 ?(621, 631)과 제2 음소인 ?(632)를 획득한 경우, 획득한 제1 음소 및 제2 음소 중 적어도 하나를 한국어 음소 데이터 베이스(610), 미국식 영어 데이터베이스(620), 영국식 영어 데이터베이스(630)과 각각 비교하여 사용자의 사용 언어를 판단할 수 있다. 이 경우, 제1 음소인 ?(621, 631)과 제2 음소인 ?(632)는 모두 영국식 영어 데이터베이스(630)에 포함되기 때문에, 제어부(170)는 사용자의 사용 언어를 영국식 영어로 판단할 수 있다.

한편, 본 실시 예에서는, 제1 음소 및 제2 음소를 음소 데이터베이스(610, 620, 630)과 비교한다고 설명하였으나, 이에 한정되지 않는다. 예를 들어, 사용자의 음성에 제1 음소, 제2 음소, 제3 음소, 제4 음소, 제5 음소, 제6 음소, 제7 음소가 포함되어 있는 경우, 제어부(170)는 제1 음소, 제2 음소, 제3 음소, 제4 음소, 제5 음소, 제6 음소, 제7 음소를 음소 데이터베이스(610, 620, 630)와 비교하여 사용자의 사용 언어를 판단할 수 있다.

또한, 제어부(170)는 사용자의 음성으로부터 획득한 복수의 음소 중 일부 음소만을 음소 데이터베이스(610, 620, 630)와 비교하여 사용자의 사용 언어를 판단할 수 있다.

또한, 제어부(170)는 사용자의 음성으로부터 획득한 복수의 음소가 특정 언어의 음소에 모두 일치하지는 않아도, 사용자의 음성으로부터 획득한 복수의 음소와 특정 언어의 음소의 유사도를 이용하여 사용자의 사용 언어를 판단할 수 있다. 예를 들어, 사용자의 음성으로부터 획득한 복수의 음소가 제1 음소, 제2 음소, 제3 음소, 제4 음소, 제5 음소, 제6 음소, 제7 음소이고, 사용자의 음성으로부터 획득한 복수의 음소와 특정 언어의 음소의 유사도가 80프로 이상이면 특정 언어를 사용자의 사용 언어로써 판단하는 것으로 설정한 경우, 사용자의 음성으로부터 획득한 복수의 음소 중 제2 음소, 제3 음소, 제4 음소, 제5 음소, 제6 음소, 제7 음소만이 특정 언어의 음소와 동일하더라도 특정 언어를 사용자의 사용 언어로써 판단할 수 있다.

한편, 언어학 적으로 단어에 포함되는 음소와 제어부(170)에서 획득하는 음소와는 차이가 있을 수 있다. 예를 들어, 단어 “세바퀴”는 언어학 적으로는 제1 음소(ㅅ), 제2 음소(ㅔ), 제3 음소(ㅂ), 제4 음소(ㅏ), 제5 음소(ㅋ), 제6 음소(ㅟ)를 포함하나, 제어부(170)에서 음성의 일부 음소를 분할하는데 실패하는 경우, 제어부(170)에서 획득한 음소에는 제3 음소(ㅂ), 제4 음소(ㅏ), 제5 음소(ㅋ), 제6 음소(ㅟ)만이 포함될 수 있다. 이러한 경우 제어부(170)는 사용자의 음성으로부터 획득한 음소만을 이용하여 사용자의 사용 언어를 판단할 수 있다. 예를 들어, 제어부(170)는 제3 음소(ㅂ), 제4 음소(ㅏ), 제5 음소(ㅋ), 제6 음소(ㅟ)을 음소 데이터 베이스(610, 620, 630)과 비교함으로써, 사용자의 사용 언어를 판단할 수 있다.

한편, 제어부(170)가 사용자의 음성으로부터 획득한 음소 정보는, 제1 음소 정보 및 제1 음소 정보 다음으로 획득한 제2 음소 정보를 포함할 수 있다. 그리고, 제어부(170)는 제1 음소 정보를 하나 이상의 언어 각각의 음소 정보와 비교하여, 하나 이상의 언어 중 제1 음소 정보를 포함하는 하나 이상의 언어를 획득할 수 있다. 또한, 제어부(170)는 제2 음소 정보를 제1 음소 정보를 포함하는 하나 이상의 언어의 음소 정보와 비교하여 제2 음소 정보를 포함하는 언어를 획득할 수 있다.

예를 들어, 제어부(170)가 사용자의 음성으로부터 먼저 제1 음소 정보(?)를 획득한 경우, 제어부(170)는 먼저 제1 음소 정보(?)를 한국어 음소 데이터 베이스(610), 미국식 영어 음소 데이터 베이스(620), 영국식 영어 음소 데이터베이스(520)와 비교할 수 있다. 그리고, 제어부(170)는 제1 음소 정보(?(621, 631))를 포함하고 있는 언어(미국식 영어와 영국식 영어)를 획득할 수 있다.

이후, 제2 음소 정보(?(632))를 획득한 경우, 제어부(170)는 제2 음소 정보(?(632))를 미국식 영어 음소 데이터 베이스(620), 영국식 영어 음소 데이터베이스(520)와 비교할 수 있다. 그리고, 제어부(170)는 제2 음소 정보(?(632))를 포함하고 있는 언어(영국식 영어)를 획득할 수 있다. 따라서, 제어부(170)는 사용자가 영국식 영어를 사용하는 것으로 판단할 수 있다.

한편, 제어부(170)는 사용자의 사용 언어를 판단할 수 없는 경우, 사용자의 음성으로부터 획득한 음소 정보와 유사도가 높은 하나 이상의 언어들을 표시하는 팝업 창을 디스플레이할 수 있다. 그리고, 표시된 하나 이상의 언어들 중 하나를 선택하는 사용자 입력을 수신하면, 제어부(170)는 사용자에 의해 선택된 언어를 음성 인식 언어로 설정할 수 있다.

한편, 사용자가 사용 언어를 수동으로 설정한 경우, 사용자의 음성이 수신되면, 제어부(170)는 사용자의 음성으로부터 획득한 음소 정보를 사용자가 수동으로 설정한 사용자의 사용 언어와 매칭시켜 저장부(140)에 저장할 수 있다. 그리고 이후의 음성 인식 과정에서 사용자의 사용 언어와 매칭시켜 저장한 음소 정보를 이용함으로써, 개인별 특성을 반영하여 보정된 데이터베이스를 이용하여 사용자의 사용 언어를 판단할 수 있다.

다시 도 3으로 돌아가, 본 발명의 실시 예에 따른 전자기기의 음성 인식 방법은, 사용자의 사용 언어를 기초로 사용자의 음성을 인식하는 단계(S370)를 더 포함할 수 있다.

구체적으로, 저장부(140)에는 복수의 언어의 단어들을 각각 포함하는 복수의 언어 각각의 데이터베이스가 저장될 수 있다. 이 경우, 제어부(170)는 수신한 음성을 사용자의 사용 언어에 대응하는 데이터베이스와 매칭하여, 사용자의 음성을 인식할 수 있다. 더욱 구체적으로, 제어부(170)는 수신한 음성으로부터 추출한 단어를 사용자의 사용 언어에 대응하는 데이터베이스에 포함된 단어들과 매칭하여, 사용자의 음성을 인식할 수 있다.

한편, 제어부(170)는 사용자의 음성을 인식하면, 사용자의 음성에 대응되는 동작을 수행할 수 있다.

이와 같이, 본 발명에 따른 전자기기의 음성 인식 방법은, 자동으로 사용자의 사용 언어를 인식함으로써, 사용자가 음성 인식 언어를 별도로 설정해야 하는 불편함을 해소할 수 있다.

한편, 사용자의 사용 언어를 판단하기 위하여 딥 러닝 알고리즘이 사용될 수 있다. 여기서 딥 러닝(deep learning) 알고리즘이란, 여러 비선형 변환기법의 조합을 통해 높은 수준의 추상화(abstractions, 다량의 데이터나 복잡한 자료들 속에서 핵심적인 내용 또는 기능을 요약하는 작업)를 시도하는 기계학습(machine learning) 알고리즘의 집합으로 정의 되며, 큰틀에서 사람의 사고방식을 컴퓨터에게 가르치는 기계학습의 한 분야일 수 있다.

이와 관련해서는, 도 7을 참고하여 구체적으로 설명한다.

도 7은, 본 발명의 또 다른 실시 예에 따른, 전자기기의 음성 인식 방법을 설명하기 위한 순서도이다.

도 7을 참고하면, 본 전자기기의 음성 인식 방법은, 사용자의 음성을 수신하는 단계(S710), 수신된 음성으로부터 하나 이상의 음소 정보를 획득하는 단계(S720), 획득한 음소 정보를 딥 러닝 알고리즘을 이용하여 학습하는 단계(S730), 사용자의 제2 음성을 수신하는 단계(S740), 제2 음성으로부터 음소 정보를 획득하는 단계(S750), 각 언어별 음소 정보 데이터베이스와 사용자의 제2 음성으로부터 획득한 음소 정보를 비교하여 사용자의 사용 언어를 판단하는 단계(S760) 및 딥 러닝 알고리즘을 이용하여 학습한 음소 정보와 제2 음성으로부터 획득한 하나 이상의 음소 정보를 비교하여 사용자의 사용 언어를 판단하는 단계(S770)를 포함할 수 있다.

S710 및 S720은 도 3에서의 S310, S330이 그대로 적용될 수 있는바 구체적인 설명은 생략한다.

본 전자기기의 음성 인식 방법은, 획득한 하나 이상의 음소 정보를 딥 러닝 알고리즘을 이용하여 학습하는 단계(S730)를 포함할 수 있다.

도 3에서 설명한 바와 같이, 제어부(170)는 수신된 음성으로부터 음소 정보를 획득할 수 있다. 또한, 복수의 음성이 입력부(150)를 통하여 수신되는 경우, 제어부(170)는 수신된 복수의 음성 각각으로부터 복수의 음소 정보를 획득할 수 있다.

이 경우, 제어부(170)는 수신된 음성으로부터 획득한 음소 정보를 딥 러닝 알고리즘을 이용하여 학습할 수 있다. 여기서 딥 러닝 알고리즘은 심층 신경망(Deep Neural Network, DNN) 알고리즘일 수 있다.

이와 관련해서는, 도 8을 이용하여 더욱 구체적으로 설명한다.

도 8은 딥 러닝 알고리즘을 이용하여 음소를 학습하는 방법을 설명하기 위한 도면이다.

제어부(170)는 복수의 음성 각각에 포함된 특정 음소를 딥 러닝 알고리즘을 이용하여 학습할 수 있다. 예를 들어, 제어부(170)가 복수의 음성으로부터 각각 제1 음소, 제2 음소, 제3 음소, 제4 음소를 획득하였고, 제1 음소, 제2 음소, 제3 음소를 이용하여 수신한 복수의 음성 각각이 한국어인 것으로 판단한 경우, 복수의 음성 각각에 포함된 제4 음소가 한국어 음소인 것으로 학습할 수 있다. 더욱 구체적으로, 도 8a에서 도시된 바와 같이, 한국어 음소 데이터베이스(810)에는 “ㅈ” (811) 이 한국어 음소로써 저장되어 있으나, 복수의 음성으로부터 각각 획득한 제4 음소가 “ㅈ”이 아니라 “g”를 포함하고 있는 경우(이러한 경우는, 특정 사용자의 발음이 특이하여 “ㅈ”를 “g”로 발음하는 경우, 특정 지역이나 특정 집단의 사용자들이 “ㅈ”를 “g”로 발음하는 경우, 또는 시대의 흐름에 따라 대다수의 사용자 들의 일반적인 발음이 변경되어 “ㅈ”를 “g”로 발음하는 경우 등이 있을 수 있다.), 제어부(170)는 딥 러닝 알고리즘을 통한 학습 결과를 이용하여 “ㅈ”(811) 대신 “g”(812)가 한국어에 포함되는 음소인 것으로 판단할 수 있다. 또한, 제어부(170)는 딥 러닝 알고리즘을 통하여 “ㅈ”(811)가 더 이상 한국어에 포함되는 음소가 아닌 것으로 학습한 경우에는, “ㅈ”(811)를 삭제하고 “g”(812)”를 추가 시킨 새로운 한국어 음소 데이터 베이스(815)를 생성할 수 있다.

다른 예로써, 제어부(170)가 동일한 단어를 말하는 복수의 음성으로부터 제1 음소, 제2 음소, 제3 음소를 동일하게 획득하나, 동일한 단어를 말하는 복수의 음성 중 일부는 제4 음소를 포함하고, 복수의 음성 중 다른 일부는 제5음소를 포함하는 경우, 제어부(170)는 제5 음소가 한국어 음소인 것으로 판단할 수 있다. 더욱 구체적으로, 도 8b에서 도시된 바와 같이, 한국어 음소 데이터베이스(820)에는 “ㅈ” (821) 이 한국어 음소로써 저장되어 있고, 동일한 단어를 말하는 복수의 음성 중 일부로부터는 제4 음소 “ㅈ”를 획득하였으나, 동일한 단어를 말하는 복수의 음성 중 다른 일부로부터는 제5 음소”g”를 획득한 경우(이러한 경우는, 동일 사용자의 발음이 특이하여 “ㅈ”를 “ㅈ”나 “g”로 발음하는 경우, 특정 집단에 속한 사용자들은 “ㅈ”를 “ㅈ”로 발음하나 다른 특정 집단에 속한 사용자들은 “ㅈ”를 “g”로 발음하는 경우 등이 있을 수 있다.), 제어부(170)는 딥 러닝 알고리즘을 통하여 “ㅈ”(821)와 함께 “g”(822)도 한국어에 포함되는 음소인 것으로 판단할 수 있다. 또한, 제어부(170)는 딥 러닝 알고리즘을 통하여 “ㅈ”(821) 뿐만 아니라 “g”(822)도 한국어에 포함되는 음소인 것으로 학습한 경우에는, “ㅈ”(821)와 함께 “g”(822)”를 추가 시킨 새로운 한국어 음소 데이터 베이스(825)를 생성할 수 있다.

또한, 도시하지는 않았으나, 복수의 음성으로부터 각각 획득한 음소 정보를 딥 러닝 알고리즘을 이용하여 학습함으로써 특정 음소가 더 이상 사용되지 않는 것으로 학습한 경우, 제어부(170)는 더 이상 사용되지 않는 특정 음소를 제외한 음소 데이터 베이스를 생성할 수 있다.

다시 도 7로 돌아가서, 본 발명의 실시 예에 따른 전자기기의 음성 인식 방법은, 사용자의 제2 음성을 수신하는 단계(S740), 제2 음성으로부터 음소 정보를 획득하는 단계(S750)를 포함할 수 있다. 한편, S740, S750은 S710, S720과 각각 동일한 방법으로 수행되는 바, 구체적인 설명은 생략한다.

한편, 본 발명의 실시 예에 따른 전자기기의 음성 인식 방법은, 각 언어별 음소 정보 데이터베이스와 사용자의 제2 음성으로부터 획득한 음소 정보를 비교하여 사용자의 사용 언어를 판단하는 단계(S760) 및 딥 러닝 알고리즘을 이용하여 학습한 음소 정보와 제2 음성으로부터 획득한 하나 이상의 음소 정보를 비교하여 사용자의 사용 언어를 판단하는 단계(S770)를 포함할 수 있다.

이와 관련해서는, 도 8을 참조하여 더욱 구체적으로 설명한다.

도 8은 딥 러닝 알고리즘을 이용하여 음소를 학습하는 방법 및 학습된 음소 정보를 이용하여 사용자의 언어를 판단하는 방법을 설명하기 위한 도면이다.

제어부(170)는 먼저, 각 언어별 음소 정보 데이터베이스와 사용자의 제2 음성으로부터 획득한 음소 정보를 비교하여 사용자의 사용 언어를 판단할 수 있다. 도 8a에서의 예를 들어 설명하면, 제어부(170)는 한국어 음소 정보 데이터 베이스(810)와 제2 음성으로부터 획득한 음소 정보를 비교하여 사용자의 사용 언어를 판단할 수 있다.

한편, 각 언어별 음소 정보 데이터베이스와 사용자의 제2 음성으로부터 획득한 음소 정보를 비교하여 사용자의 사용 언어를 판단할 수 없는 경우, 제어부(170)는 딥 러닝 알고리즘을 이용하여 학습한 음소 정보와 제2 음성으로부터 획득한 음소 정보를 비교함으로써 사용자의 사용 언어를 판단할 수 있다. 도 8a에서의 예를 들어 설명하면, 제어부(170)는 한국어 음소 정보 데이터 베이스(810)와 제2 음성으로부터 획득한 음소 정보를 비교하여 사용자의 사용 언어를 판단할 수 없는 경우, 딥 러닝 알고리즘을 이용한 학습 결과를 반영한 데이터 베이스(815)와 제2 음성으로부터 획득한 음소 정보를 비교하여 사용자의 사용 언어를 판단할 수 있다.

한편, 본 실시 예에서는 각 언어별 음소 정보 데이터 베이스를 사용자의 제2 음성으로부터 획득한 음소 정보와 우선적으로 비교하고, 사용자의 사용 언어를 판단할 수 없는 경우 딥 러닝 알고리즘을 이용한 학습 결과를 반영한 데이터 베이스와 제2 음성으로부터 획득한 음소 정보를 비교한다고 설명하였으나 이에 한정되지 않는다. 구체적으로, 제어부(170)는 각 언어별 음소 정보 데이터 베이스와 각 언어별 딥 러닝 알고리즘을 이용한 학습 결과를 반영한 데이터 베이스를 제2 음성으로부터 획득한 음소 정보와 동시에 비교할 수 도 있고, 제2 음성으로부터 획득한 음소 정보를 각 언어별 딥 러닝 알고리즘을 이용한 학습 결과를 반영한 데이터 베이스와 먼저 비교하는 방식으로도 구현할 수 있다.

한편, 복수의 음성 각각에 포함되는 음소 정보를 딥 러닝 알고리즘을 이용하여 학습함으로써 생성되는 음소 정보 데이터 베이스는, 복수의 음성을 입력한 사용자에 따라 분류되어 생성될 수 있다. 예를 들어, 복수의 음성이 특정 사용자에 의해 입력된 경우, 제어부(170)는 음소 정보를 딥 러닝 알고리즘을 이용하여 학습함으로써 생성하는 음소 정보 데이터 베이스를 특정 사용자에 대응되는 음소 정보 데이터 베이스로써 분류하여 생성할 수 있다. 또 다른 예로써, 복수의 음성이 특정 지역 사용자에 의해 입력된 경우, 제어부(170)는 음소 정보를 딥 러닝 알고리즘을 이용하여 학습함으로써 생성하는 음소 정보 데이터 베이스를 특정 지역 사용자에 대응되는 음소 정보 데이터 베이스로써 분류하여 생성할 수 있다.

그리고, 제어부(170)는 제2 음성이 수신된 경우, 제2 음성으로 획득한 하나 이상의 음소 정보를 제2 음성을 입력한 사용자에 대응되는 음소 정보 데이터 베이스와 비교하여 사용자의 사용 언어를 판단할 수 있다. 예를 들어, 제어부(170)는 특정 사용자가 제2 음성을 입력한 경우, 제2 음성으로부터 획득한 음소 정보와 특정 사용자에 대응되는 음소 정보 데이터 베이스를 비교함으로써, 특정 사용자의 사용 언어를 판단할 수 있다. 또 다른 예로써, 특정 지역의 사용자가 제2 음성을 입력한 경우, 제2 음성으로부터 획득한 음소 정보와 특정 지역에 대응되는 음소 정보 데이터 베이스를 비교함으로써, 특정 지역의 사용자의 사용 언어를 판단할 수 있다.

이와 같이, 본 전자기기의 음성 인식 방법은, 딥 러닝 알고리즘을 이용하여 사용자의 음성에 포함된 음소를 학습함으로써, 특정 사용자 및 특정 집단의 언어 특성을 반영하여 사용자의 언어를 판단할 수 있다. 또한, 세월의 흐름에 따라 사람들의 언어 습관이 달라져서 사용자의 사용 음소 역시 달라지더라도, 변경된 언어 습관을 반영하여 사용자의 언어를 판단할 수 있다.

도 9는 본 발명을 이용한 다양한 실시 예들을 도시한 도면이다.

제어부(170)는 디스플레이 장치(100)의 설정 언어에 관계 없이 사용자의 사용 언어를 판단하고, 사용자의 사용 언어에 기초하여 사용자의 음성을 인식하고, 사용자의 음성에 대응되는 동작을 수행할 수 있다.

예를 들어, 디스플레이 장치(100)의 설정 언어가 “영어”인 경우, 사용자가 “한국어”로 “텔레비전 꺼”라고 말하더라도, 디스플레이 장치의 제어부(170)는 한국어에 기초하여 사용자의 음성을 인식하고, 사용자의 음성에 대응되는 동작, 즉, 텔레비전을 끄는 동작을 수행할 수 있다.

또 다른 예로써, 도 9a의 디스플레이 장치가 주변 레스토랑 검색 기능을 제공하는 경우, 도 9a에서 도시하는 바와 같이, 주변 레스토랑 검색 메뉴(110)는 한글로써 표시될 수 있다. 그리고, 사용자가 러시아 한글을 모르는 외국인으로 주변 레스토랑 검색 메뉴(110)를 읽지 못하더라도, “Показать рестораны поблизости?(근처 레스토랑을 알려줘)”라는 말을 러시아어로 할 수 있다”그리고, 디스플레이 장치(100)의 제어부(170)는 사용자의 사용 언어가 러시아 인 것으로 판단하고, 러시아어에 대응되는 DB의 단어들과 사용자의 음성에 포함된 단어들을 비교함으로써 사용자의 음성의 의미를 판단한 후, 그에 대응되는 동작, 즉, 주변 레스토랑 검색 결과를 출력할 수 있다.

한편, 도 9a에서는 사용자의 음성에 따른 동작, 즉, 주변 레스토랑 검색 결과를 디스플레이 장치의 설정 언어인 한국어로 출력하는 것으로 설명하였으나 이에 한정되지 않는다. 구체적으로, 디스플레이 장치(100)의 제어부(170)는 사용자의 사용 언어에 대응되는 언어로써 사용자의 음성에 따른 동작을 수행할 수 있다. 예를 들어, 사용자가 러시아어로 말한 경우, 제어부(170)는 러시아어로써 주변 레스토랑 검색 결과를 출력할 수 있다.

또한, 제어부(170)는 사용자의 언어에 대응되는 콘텐츠를 출력할 수 있다. 예를 들어, 사용자의 사용 언어가 러시아어인 경우, 사용자는 주변 러시아 레스토랑에 대한 검색 결과를 출력할 수 있다. 이와 관련해서는 도 9c에서 구체적으로 후술한다.

한편, 제어부(170)는 사용자의 사용 언어에 대응되는 언어로써 답변을 출력하는 경우, 디스플레이부(180)를 통하여 사용자의 사용 언어에 대응되는 글자를 출력하거나, 오디오 출력부(185)를 통하여 사용자의 사용 언어에 대응되는 언어의 음성으로 답변을 출력할 수 있다. 예를 들어, 제어부(170)는 사용자가 영어로 말한 경우, 사용자의 질문에 대한 답변을 알파벳으로 표시되도록 디스플레이부(180)를 통하여 출력하거나, 영어에 해당하는 음성으로 오디오 출력부(185)를 통하여 출력할 수 있다.

도 9b는 사용자의 음성에 복수의 언어가 포함된 경우의 디스플레이 장치(100)의 동작을 설명하는 도면이다.

도 9b에 따르면, 입력부(150)를 통하여 수신된 음성에는 제1 언어에 대응되는 제1 단어 및 제2 언어에 대응되는 제2 단어가 포함될 수 있다. 예를 들어, 도 9b에서 도시한 바와 같이 사용자의 음성에는 프랑스어에 대응되는 “Meteo”와 한국어에 대응되는 “번역해줘”가 포함될 수 있다.

제어부(170)는 제1 단어의 음소 정보를 하나 이상의 언어 각각의 음소 정보와 비교하여 제1 단어의 언어를 판단할 수 있다. 예를 들어, 제어부(170)는 “Meteo”를 복수의 음소로 분할하고, 분할된 음소 정보를 하나 이상의 언어 각각의 음소 정보와 비교함으로써, 제1 단어가 프랑스어라는 것을 판단할 수 있다. 또한, 제어부(170)는 “번역해줘”를 복수의 음소로 분할하고, 분할된 음소 정보를 하나 이상의 언어 각각의 음소 정보와 비교함으로써, 제2 단어가 한국어라는 것을 판단할 수 있다.

그리고, 제어부(170)는 상기 판단된 단어의 언어를 기초로 단어의 의미를 인식할 수 있다. 구체적으로, 제어부(170)는 단어의 언어에 대응되는 데이터 베이스의 단어들과 사용자의 음성에 포함된 단어를 비교함으로써 사용자의 음성을 인식할 수 있다. 예를 들어, 제어부(170)는 “Meteo”라는 사용자의 음성을 프랑스어 데이터베이스와 비교하여 사용자의 음성의 의미가 “Meteo”인 것으로 인식할 수 있다. 또한, 제어부(170)는 “번역해줘”라는 사용자의 음성을 한국어 데이터베이스와 비교하여 사용자의 음성의 의미가 “번역해줘”인 것으로 인식할 수 있다.

한편, 제어부(170)는 인식된 제1 단어 및 제2 단어를 조합한 의미에 대응되는 동작을 수행할 수 있다. 예를 들어, 제어부(170)는 “Meteo”와 “번역해줘”를 조합한 의미에 대응되는 동작을 수행할 수 있다. 구체적으로, 제어부(170)는 “번역해줘”의 의미에 따라 “Meteo”라는 단어를 번역할 수 있고, “번역해줘”라는 단어가 한국어인 바, “Meteo”라는 단어를 한국어로 번역할 수 있다. 따라서, 제어부(170)는 “프랑스어로 날씨입니다”라는 알림을 출력할 수 있다.

도 9c는 사용자의 사용 언어에 대응되는 콘텐츠를 검색하는 실시 예를 나타낸 도면이다.

제어부(170)는 사용자의 사용 언어에 대응되는 콘텐츠를 검색할 수 있다. 구체적으로, 콘텐츠를 검색하기 위한 사용자 입력이 수신되면, 제어부(170)는 도 4 내지 도 6 과정에서 설명한 방법에 의해 사용자의 사용 언어를 판단하고, 사용자의 사용 언어에 대응되는 콘텐츠를 검색하여 제공할 수 있다.

예를 들어, 도 9c에서 도시한 바와 같이 “볼만한 거 보여줘”라는 한국어 음성이 수신되면, 제어부(170)는 사용자의 사용 언어가 한국어인 것으로 판단하고, 사용자의 음성을 인식한 결과 사용자가 볼만한 콘텐츠의 검색을 운하는 바, 사용자의 사용 언어인 한국어에 대응되는 콘텐츠인 한국 영화를 검색하여 사용자에게 제공할 수 있다.

다른 예로써, “Anything to watch?”의 미국식 영어 음성이 수신되면, 제어부(170)는 미국 영화를 검색하여 사용자에게 제공할 수 있고, “Anything to watch?”의 영국식 영어 음성이 수신되면, 제어부(170)는 영국 영화를 검색하여 사용자에게 제공할 수 있다.

한편, 본 실시 예에 따른 디스플레이 장치(100)는 사용자의 언어에 대응되는 지역의 정보를 사용자에게 제공할 수 있다. 구체적으로, 제어부(170)는 도 4 내지 도 6 과정에서 설명한 방법에 의해 사용자의 사용 언어를 판단하고, 사용자의 음성을 인식한 결과가 특정 정보를 요청하는 것이면, 사용자의 사용 언어에 대응되는 지역의 정보를 특정 제공할 수 있다.

예를 들어, 도 9d에서 도시한 바와 같이 “날씨가 어때?”라는 한국어 음성이 수신되면, 제어부(170)는 사용자의 사용 언어가 한국어인 것으로 판단하고, 사용자의 음성을 인식한 결과가 날씨 정보를 요청 하는 것인 바, 사용자의 사용 언어에 대응되는 지역인 대한민국의 날씨 정보에 대한 알림을 출력할 수 있다.

도 10은, 음성 인식이 두개 이상의 서버에서 수행되는 실시 예를 설명하기 위한 도면이다.

도 3에서는, 사용자의 음성과 저장부(140) 내의 데이터베이스를 비교하여 사용자의 음성을 인식한다고 설명하였으나, 사용자의 음성을 인식하는 과정은 서버(300, 400) 측에서 수행될 수 있다.

구체적으로, 디스플레이 장치의 통신부(173)는 제1 서버(300)의 통신부(310) 및 제2 서버(400)의 통신부(410)와 통신할 수 있다. 그리고, 제어부(170)는 사용자의 사용 언어를 인식하는 음성 인식 서버로 사용자의 음성을 전송할 수 있다. 예를 들어, 제1 서버(300)는 한국어 음성 인식 서버이고, 제2 서버(400)는 영국식 영어 인식 서버라고 가정하면, 제어부(170)는 도 4 내지 도 6의 과정에 따라 사용자의 음성을 한국어인 것으로 판단하면, 사용자의 음성을 제1 서버(300)로 전송할 수 있다. 다른 예로써, 제어부(170)는 사용자의 음성을 영국식 영어인 것으로 판단하면, 사용자의 음성을 제2 서버(400)로 전송할 수 있다.

사용자의 음성을 수신한 제1 서버(300)의 제어부(330)는 저장부(320) 내 한국어 데이터베이스와 사용자의 음성을 비교함으로써, 사용자의 음성을 인식할 수 있다.

또한, 제2 서버(400) 역시 제어부(430)는 저장부(420) 내 영국식 영어 데이터베이스와 사용자의 음성을 비교함으로써, 사용자의 음성을 인식할 수 있다.

그리고, 제1 서버(300) 및 제2 서버(400) 중 적어도 하나는 음성 인식 결과를 디스플레이 장치(100)로 전송할 수 있다.

한편, 디스플레이 장치(100)의 제어부(170)는 음성 인식 서버로부터 사용자의 음성을 이용한 음성 인식 결과를 통신부(173)를 통하여 수신할 수 있다. 그리고, 제어부(170)는 음성 인식 결과에 기초하여 사용자의 음성의 의미에 대응되는 동작을 수행할 수 있다.

한편, 제어부(170)는 도 4 내지 도6에서 설명한 과정을 통하여 사용자의 사용 언어를 판단할 수 있고, 따라서, 사용자의 사용 언어가 변경되는 것을 판단할 수 있다. 예를 들어, 사용자가 “Meteo 번역해줘”라는 문장을 얘기한 경우, 제어부(170)는 사용자의 사용 언어가 프랑스어에서 한국어로 변경되는 것으로 판단할 수 있다.

이러한 경우, 제어부(170)는 변경된 서버로 사용자의 음성을 전송할 수 있다. 구체적으로, 제어부(170)는 사용자의 사용 언어가 제1 언어로써 제1 언어에 대응되는 서버로 음성을 전송하던 중, 사용자의 사용 언어가 제2 언어로 변경되면, 제2 언어에 대응되는 서버로 음성을 전송할 수 있다. 예를 들어, 사용자가 “Meteo 번역해줘”라는 문장을 얘기한 경우, 제어부(170)는 “Meteo”에 해당하는 음성은 프랑스어 음성 인식 서버로, “번역해줘”에 해당하는 음성은 한국어 음성 인식 서버로 전송할 수 있다.

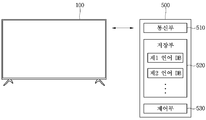

도 11은, 음성 인식이 단일 서버에서 수행되는 실시 예를 설명하기 위한 도면이다.

도 10에서는, 음성 인식이 사용자의 언어에 대응되는 음성 인식 서버에서 수행되는 것으로 설명하였으나, 음성 인식은 단일 서버인 제3 서버(500)에서 수행될 수 있다.

구체적으로, 디스플레이 장치의 통신부(173)는 제3 서버(500)의 통신부(510)와 통신할 수 있다. 그리고, 제어부(170)는 제3 서버(500)로 사용자의 사용 언어에 대한 정보 및 사용자의 음성을 전송할 수 있다.

사용자의 음성을 수신한 제3 서버(500)의 제어부(530)는 사용자의 사용 언어에 대한 정보를 이용하여 사용자의 언어에 대응되는 데이터베이스와 사용자의 음성을 비교할 수 있다. 예를 들어, 사용자의 사용 언어가 한국어인 경우, 서버(500)는 디스플레이 장치(100)로부터 사용자의 사용 언어가 한국어라는 정보와 사용자의 음성을 수신하고, 수신한 사용자의 음성을 한국어 데이터베이스와 비교함으로써 사용자의 음성을 인식할 수 있다.

그리고, 제3 서버(500)는 음성 인식 결과를 디스플레이 장치(100)로 전송할 수 있다.

한편, 디스플레이 장치(100)의 제어부(170)는 음성 인식 서버로부터 사용자의 음성을 이용한 음성 인식 결과를 통신부(173)를 통하여 수신할 수 있다. 그리고, 제어부(170)는 음성 인식 결과에 기초하여 사용자의 음성의 의미에 대응되는 동작을 수행할 수 있다.

한편, 디스플레이 장치(170)는 사용자의 음성을 분할하여 획득한 하나 이상의 음소 정보를 서버(500)로 전송할 수 있다. 그리고, 서버(500)는 복수의 디스플레이 장치로부터 수신되는 음소 정보를 딥 러닝 알고리즘을 이용하여 학습하고, 학습 결과를 반영한 음소 정보 데이터베이스를 생성할 수 있다. 그리고, 서버(500)는 학습 결과를 반영하여 생성한 음소 정보 데이터베이스를 복수의 디스플레이 장치로 제공할 수 있고, 디스플레이 장치(170)는 수신한 음소 정보 데이터베이스를 이용하여 기존의 음소 정보 데이터베이스를 업데이트할 수 있다.

한편, 본 실시 예에서는 사용자의 사용 언어 판단 과정이 디스플레이 장치(100)에서 수행되는 것으로 설명하였으나, 이에 한정되지 않는다. 예를 들어, 디스플레이 장치(100)에서는 사용자의 음성을 수신하여 서버(500)로 전송하면, 서버(500)의 제어부(530)는 수신된 음성으로부터 하나 이상의 음소 정보를 획득하고, 획득된 하나 이상의 음소 정보를 이용하여 사용자의 사용 언어를 판단하고, 사용자의 사용 언어에 기초하여 사용자의 음성을 인식하고, 사용자의 음성을 인식한 인식 결과를 디스플레이 장치(100)로 전송할 수 있다. 그리고, 디스플레이 장치(100)는 수신한 인식 결과를 기초로 사용자의 음성에 대응되는 동작을 수행할 수 있다.

도 12는 본 발명의 실시 예에 따른 전자기기의 음성 인식 방법을 설명하기 위한 도면이다.

도 12를 참고하면, 제어부(170)는 수신된 오디오에 사용자의 음성이 포함되어 있는지 판단할 수 있다(S1210). 그리고, 사용자의 음성이 포함되어 있지 않은 것으로 판단되면, 제어부(170)는 사용자의 음성을 인식할 수 없으니 음성 입력을 재시도 하라는 팝업창을 출력할 수 있다.

한편, 수신된 오디오에 사용자의 음성이 포함되어 있으면, 제어부(170)는 사용자의 음성의 특징을 추출할 수 있다.(S1220)

한편, 제어부(170)는 사용자의 음성의 특징을 이용하여 사용자의 음성을 분할한 하나 이상의 음소 정보를 획득하고, 획득한 음소 정보를 기 저장된 음소 스펙트럼 데이터베이스와 비교할 수 있다.(S1230)

그리고, 제어부(170)는 S1230에서의 비교 결과에 따라 사용자의 사용 언어를 판단할 수 있다.(S1240)

한편, 사용자의 사용 언어를 판단하는데 실패한 경우, 제어부(170)는 사용자의 음성과 유사도가 높은 언어들을 표시하는 팝업창을 디스플레이할 수 있다. 그리고, 디스플레이 된 언어들 중 하나를 선택하는 사용자 입력이 수신되면 사용자에 의해 선택된 언어를 음성 인식 언어로 설정할 수 있다.(S1250)

한편, 사용자가 수동으로 언어를 설정한 경우, 사용자에 의해 설정된 언어 및 사용자의 음성으로부터 획득된 음소를 딥 러닝 알고리즘을 이용하여 학습하고, 학습 결과를 음소 스펙트럼 데이터 베이스에 추가할 수 있다.

한편, 사용자의 사용 언어가 판단된 경우, 제어부(170)는 사용자의 사용 언어로 음성 인식 언어를 설정할 수 있다.(S1260)

그리고, 제어부(170)는 음성 인식 서버를 연결하고(S1270), 통신부(173)를 통하여 사용자의 음성 및 사용자의 사용 언어에 대한 정보를 서버로 전송함으로써 사용자의 음성에 포함된 단어별로 스트리밍 음성 인식을 수행할 수 있다.(S1280)

한편, 제어부(180)는 일반적으로 장치의 제어를 담당하는 구성으로, 중앙처리장치, 마이크로 프로세서, 프로세서 등의 용어와 혼용될 수 있다.

전술한 본 발명은, 프로그램이 기록된 매체에 컴퓨터가 읽을 수 있는 코드로서 구현하는 것이 가능하다. 컴퓨터가 읽을 수 있는 매체는, 컴퓨터 시스템에 의하여 읽혀질 수 있는 데이터가 저장되는 모든 종류의 기록장치를 포함한다. 컴퓨터가 읽을 수 있는 매체의 예로는, HDD(Hard Disk Drive), SSD(Solid State Disk), SDD(Silicon Disk Drive), ROM, RAM, CD-ROM, 자기 테이프, 플로피 디스크, 광 데이터 저장 장치 등이 있으며, 또한 캐리어 웨이브(예를 들어, 인터넷을 통한 송신)의 형태로 구현되는 것도 포함한다. 또한, 상기 컴퓨터는 단말기의 제어부(180)를 포함할 수도 있다. 따라서, 상기의 상세한 설명은 모든 면에서 제한적으로 해석되어서는 아니 되고 예시적인 것으로 고려되어야 한다. 본 발명의 범위는 첨부된 청구항의 합리적 해석에 의해 결정되어야 하고, 본 발명의 등가적 범위 내에서의 모든 변경은 본 발명의 범위에 포함된다.

150: 입력부

170: 제어부

Claims (10)

- 사용자의 음성을 수신하는 단계;

상기 수신된 음성으로부터 하나 이상의 음소 정보를 획득하는 단계; 및

상기 획득된 하나 이상의 음소 정보를 이용하여 상기 사용자의 사용 언어를 판단하는 단계를 포함하는

전자기기의 음성 인식 방법. - 제 1항에 있어서,

상기 사용자의 사용 언어를 판단하는 단계는,

기 저장된 하나 이상의 언어 각각의 음소 정보와 상기 획득된 하나 이상의 음소 정보를 비교하여 상기 사용자의 사용 언어를 판단하는

전자기기의 음성 인식 방법. - 제 2항에 있어서,

상기 획득된 음소 정보는,

제1 음소 정보 및 상기 제1 음소 정보 다음으로 획득된 제2 음소 정보를 포함하고,

상기 사용자의 사용 언어를 판단하는 단계는,

상기 제1 음소 정보를 상기 하나 이상의 언어 각각의 음소 정보와 비교하여, 상기 하나 이상의 언어 중 상기 제1 음소 정보를 포함하는 하나 이상의 언어를 획득하는 단계; 및

상기 제2 음소 정보를 상기 획득된 하나 이상의 언어 각각의 음소 정보와 비교하여, 상기 획득된 하나 이상의 언어 중 상기 제2 음소 정보를 포함하는 언어를 획득하는 단계를 포함하는

전자기기의 음성 인식 방법. - 제 1항에 있어서,

상기 획득한 하나 이상의 음소 정보를 딥 러닝 알고리즘을 이용하여 학습하는 단계;

사용자의 제2 음성을 수신하는 단계;

상기 수신된 제2 음성으로부터 하나 이상의 음소 정보를 획득하는 단계; 및

기 저장된 하나 이상의 언어 각각의 음소 정보 및 상기 학습된 음소 정보 중 적어도 하나와 상기 제2 음성으로부터 획득한 하나 이상의 음소 정보를 비교하여 상기 사용자의 사용 언어를 판단하는 단계를 더 포함하는

전자기기의 음성 인식 방법. - 제 1항에 있어서,

상기 사용자의 사용 언어를 기초로 상기 사용자의 음성을 인식하는 단계를 더 포함하는

전자기기의 음성 인식 방법. - 제 5항에 있어서,

상기 수신된 음성은,

제1 언어에 대응되는 제1 단어 및 제2 언어에 대응되는 제2 단어를 포함하고,

상기 사용자의 사용 언어를 판단하는 단계는,

상기 제1 단어의 음소 정보를 기 저장된 하나 이상의 언어 각각의 음소 정보와 비교하여 상기 제1 단어의 언어를 판단하는 단계; 및

상기 제2 단어의 음소 정보를 기 저장된 하나 이상의 언어 각각의 음소 정보와 비교하여 상기 제2 단어의 언어를 판단하는 단계를 포함하고,

상기 사용자의 음성을 인식하는 단계는,

상기 판단된 제1 단어의 언어를 기초로 상기 제1 단어를 인식하는 단계;

상기 판단된 제2 단어의 언어를 기초로 상기 제2 단어를 인식하는 단계; 및

상기 인식된 제1 단어 및 제2 단어를 조합한 의미에 대응되는 동작을 수행하는 단계를 포함하는

전자기기의 음성 인식 방법. - 제 1항에 있어서,

콘텐츠를 검색하기 위한 사용자 입력이 수신되면, 상기 판단된 사용자의 사용 언어에 대응되는 콘텐츠를 검색하는 단계를 더 포함하는

전자 기기의 음성 인식 방법. - 제 1항에 있어서,

상기 사용자의 사용 언어를 인식하는 음성 인식 서버로 상기 사용자의 음성을 전송하는 단계; 및

상기 음성 인식 서버로부터 상기 사용자의 음성을 이용한 음성 인식 결과를 수신하는 단계를 포함하는

전자기기의 음성 인식 방법. - 음성 인식 가능한 전자기기에 있어서,

사용자의 음성을 수신하는 입력부;

상기 수신된 음성으로부터 하나 이상의 음소 정보를 획득하고, 상기 획득된 하나 이상의 음소 정보를 이용하여 상기 사용자의 사용 언어를 판단하는 제어부를 포함하는

전자기기. - 제 9항에 있어서,

하나 이상의 언어 각각의 음소 정보를 저장하는 저장부를 더 포함하고,

상기 제어부는,

상기 저장된 하나 이상의 언어 각각의 음소 정보와 상기 획득된 하나 이상의 음소 정보를 비교하여 상기 사용자의 사용 언어를 판단하는

전자기기.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020150090058A KR20170000722A (ko) | 2015-06-24 | 2015-06-24 | 전자기기 및 그의 음성 인식 방법 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020150090058A KR20170000722A (ko) | 2015-06-24 | 2015-06-24 | 전자기기 및 그의 음성 인식 방법 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20170000722A true KR20170000722A (ko) | 2017-01-03 |

Family

ID=57797254

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020150090058A KR20170000722A (ko) | 2015-06-24 | 2015-06-24 | 전자기기 및 그의 음성 인식 방법 |

Country Status (1)

| Country | Link |

|---|---|

| KR (1) | KR20170000722A (ko) |

Cited By (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE102017110582A1 (de) | 2016-02-03 | 2018-07-05 | Samsung Electronics Co., Ltd. | Halbleitervorrichtung, Halbleitersystem und Verfahren zum Betreiben der Halbleitervorrichtung |

| CN108461082A (zh) * | 2017-02-20 | 2018-08-28 | Lg 电子株式会社 | 控制执行多语音处理的人工智能系统的方法 |

| KR20190007175A (ko) * | 2017-07-12 | 2019-01-22 | 최갑천 | 유해 콘텐츠 탐지 장치 |

| WO2019045455A3 (ko) * | 2017-08-31 | 2019-04-18 | 삼성전자주식회사 | 가전 기기의 음성 인식을 위한 시스템과 서버, 방법 |

| KR20190109868A (ko) * | 2018-03-19 | 2019-09-27 | 삼성전자주식회사 | 사운드 데이터를 처리하는 시스템 및 시스템의 제어 방법 |

| KR20200038843A (ko) * | 2018-10-04 | 2020-04-14 | 장우용 | 자극 발생 시스템 |

| CN113272893A (zh) * | 2019-01-09 | 2021-08-17 | 三星电子株式会社 | 用于多口语检测的系统和方法 |

| WO2022177063A1 (ko) * | 2021-02-18 | 2022-08-25 | 삼성전자주식회사 | 전자 장치 및 이의 제어 방법 |

-

2015

- 2015-06-24 KR KR1020150090058A patent/KR20170000722A/ko unknown

Cited By (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE102017110582A1 (de) | 2016-02-03 | 2018-07-05 | Samsung Electronics Co., Ltd. | Halbleitervorrichtung, Halbleitersystem und Verfahren zum Betreiben der Halbleitervorrichtung |

| CN108461082A (zh) * | 2017-02-20 | 2018-08-28 | Lg 电子株式会社 | 控制执行多语音处理的人工智能系统的方法 |

| KR20180096183A (ko) * | 2017-02-20 | 2018-08-29 | 엘지전자 주식회사 | 다국어 처리를 수행하는 인공 지능 시스템의 제어 방법 |

| EP3373292A3 (en) * | 2017-02-20 | 2018-12-05 | LG Electronics Inc. | Method for controlling artificial intelligence system that performs multilingual processing |

| US10580400B2 (en) | 2017-02-20 | 2020-03-03 | Lg Electronics Inc. | Method for controlling artificial intelligence system that performs multilingual processing |

| KR20190007175A (ko) * | 2017-07-12 | 2019-01-22 | 최갑천 | 유해 콘텐츠 탐지 장치 |

| US11501770B2 (en) | 2017-08-31 | 2022-11-15 | Samsung Electronics Co., Ltd. | System, server, and method for speech recognition of home appliance |

| WO2019045455A3 (ko) * | 2017-08-31 | 2019-04-18 | 삼성전자주식회사 | 가전 기기의 음성 인식을 위한 시스템과 서버, 방법 |

| KR20190109868A (ko) * | 2018-03-19 | 2019-09-27 | 삼성전자주식회사 | 사운드 데이터를 처리하는 시스템 및 시스템의 제어 방법 |

| KR20200038843A (ko) * | 2018-10-04 | 2020-04-14 | 장우용 | 자극 발생 시스템 |

| CN113272893A (zh) * | 2019-01-09 | 2021-08-17 | 三星电子株式会社 | 用于多口语检测的系统和方法 |

| US11967315B2 (en) | 2019-01-09 | 2024-04-23 | Samsung Electronics Co., Ltd. | System and method for multi-spoken language detection |

| WO2022177063A1 (ko) * | 2021-02-18 | 2022-08-25 | 삼성전자주식회사 | 전자 장치 및 이의 제어 방법 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US10580400B2 (en) | Method for controlling artificial intelligence system that performs multilingual processing | |

| US9881603B2 (en) | Emotional-speech synthesizing device, method of operating the same and mobile terminal including the same | |

| US10957315B2 (en) | Mobile terminal and method for controlling mobile terminal using machine learning | |

| US9705828B2 (en) | Mobile terminal and controlling method thereof | |

| KR20170000722A (ko) | 전자기기 및 그의 음성 인식 방법 | |

| US10042551B2 (en) | Mobile terminal having a screen with a circular form and method for controlling the same | |

| US11011170B2 (en) | Speech processing method and device | |

| US11164581B2 (en) | Artificial intelligence device | |

| EP3193328A1 (en) | Method and device for performing voice recognition using grammar model | |

| US10255278B2 (en) | Mobile terminal and controlling method thereof | |

| US10007425B2 (en) | Mobile terminal and modified keypad using method thereof | |

| US20120239673A1 (en) | Electronic device and method of controlling the same | |

| US20230199102A1 (en) | Mobile terminal and control method therefor | |

| KR102446694B1 (ko) | 전자 기기 및 그 제어방법 | |

| US10860288B2 (en) | Display device and control method thereof | |

| KR102542766B1 (ko) | 디스플레이 장치 및 그의 동작 방법 | |

| US20190163436A1 (en) | Electronic device and method for controlling the same | |

| CN112437956B (zh) | 语音识别系统 | |

| EP3171579A2 (en) | Mobile device and method of controlling therefor | |

| KR102254891B1 (ko) | 이동 단말기 및 그 제어 방법 | |

| KR102113236B1 (ko) | 개인 검색 패턴 가이드 제공 장치 및 방법 | |

| KR102527585B1 (ko) | 이동 단말기 및 그 제어방법 | |

| KR20170107774A (ko) | 전자 기기 및 그의 음성 인식 방법 | |

| KR20170056846A (ko) | 이동 단말기 및 그 제어 방법 | |

| KR20160010289A (ko) | 디스플레이 디바이스 및 그 제어 방법 |