JP7599136B2 - 測位装置及び移動体 - Google Patents

測位装置及び移動体 Download PDFInfo

- Publication number

- JP7599136B2 JP7599136B2 JP2021575605A JP2021575605A JP7599136B2 JP 7599136 B2 JP7599136 B2 JP 7599136B2 JP 2021575605 A JP2021575605 A JP 2021575605A JP 2021575605 A JP2021575605 A JP 2021575605A JP 7599136 B2 JP7599136 B2 JP 7599136B2

- Authority

- JP

- Japan

- Prior art keywords

- attitude

- reliability

- vehicle

- relative

- marker

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01G—WEIGHING

- G01G19/00—Weighing apparatus or methods adapted for special purposes not provided for in the preceding groups

- G01G19/08—Weighing apparatus or methods adapted for special purposes not provided for in the preceding groups for incorporation in vehicles

- G01G19/083—Weighing apparatus or methods adapted for special purposes not provided for in the preceding groups for incorporation in vehicles lift truck scale

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01C—MEASURING DISTANCES, LEVELS OR BEARINGS; SURVEYING; NAVIGATION; GYROSCOPIC INSTRUMENTS; PHOTOGRAMMETRY OR VIDEOGRAMMETRY

- G01C15/00—Surveying instruments or accessories not provided for in groups G01C1/00 - G01C13/00

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01G—WEIGHING

- G01G19/00—Weighing apparatus or methods adapted for special purposes not provided for in the preceding groups

- G01G19/08—Weighing apparatus or methods adapted for special purposes not provided for in the preceding groups for incorporation in vehicles

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05D—SYSTEMS FOR CONTROLLING OR REGULATING NON-ELECTRIC VARIABLES

- G05D1/00—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots

- G05D1/02—Control of position or course in two dimensions

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/20—Analysis of motion

- G06T7/246—Analysis of motion using feature-based methods, e.g. the tracking of corners or segments

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/20—Image preprocessing

- G06V10/22—Image preprocessing by selection of a specific region containing or referencing a pattern; Locating or processing of specific regions to guide the detection or recognition

- G06V10/225—Image preprocessing by selection of a specific region containing or referencing a pattern; Locating or processing of specific regions to guide the detection or recognition based on a marking or identifier characterising the area

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/40—Extraction of image or video features

- G06V10/62—Extraction of image or video features relating to a temporal dimension, e.g. time-based feature extraction; Pattern tracking

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/50—Context or environment of the image

- G06V20/56—Context or environment of the image exterior to a vehicle by using sensors mounted on the vehicle

- G06V20/58—Recognition of moving objects or obstacles, e.g. vehicles or pedestrians; Recognition of traffic objects, e.g. traffic signs, traffic lights or roads

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30196—Human being; Person

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30204—Marker

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30248—Vehicle exterior or interior

- G06T2207/30252—Vehicle exterior; Vicinity of vehicle

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V2201/00—Indexing scheme relating to image or video recognition or understanding

- G06V2201/06—Recognition of objects for industrial automation

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V2201/00—Indexing scheme relating to image or video recognition or understanding

- G06V2201/08—Detecting or categorising vehicles

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Multimedia (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Radar, Positioning & Navigation (AREA)

- Remote Sensing (AREA)

- Aviation & Aerospace Engineering (AREA)

- Automation & Control Theory (AREA)

- Length Measuring Devices By Optical Means (AREA)

Description

本開示は、車両などの移動体の位置を測定する測位装置と、そのような測位装置を備えた移動体とに関する。

荷物運搬用の車両を用いて予め決められた領域内又は予め決められた地点間で荷物を移動させるとき、車両の位置を測定して追跡することが求められる場合がある。例えば、特許文献1は、GPS、無線LAN測位、赤外線測位などの測位技術を用いて車両の位置を測位する荷物所在管理装置を開示している。

屋外で移動する車両を測位する場合、一般的には、GPSを用いた測位方法が使用される。一方、倉庫又は工場などの屋内では、GPS衛星からの電波を受信できないので、GPSを用いた測位方法は使用できない。屋内の測位方法として、例えば、UWB(ultra wide band)、Wi-Fi、又はBLE(Bluetooth(登録商標) Low Energy)などの無線信号を用いたものがある。しかしながら、無線信号を用いた測位方法は、無線信号を送信するための多数の無線送信機を車両の移動範囲に設置する必要があるので、初期導入コストが高い。また、屋内の測位方法として、PDR(Pedestrian Dead Reckoning:歩行者自律航法)と呼ばれるものがある。しかしながら、PDRは位置を高精度に測定することが困難である。

無線信号を送信するための多数の無線送信機を必要とすることなく、車両などの移動体の位置を高精度に測定して追跡するために、例えば、非特許文献1に開示されるように、Visual-SLAM(Visual Simultaneous Localization and Mapping)と呼ばれる技術がある。Visual-SLAMによれば、撮影装置を備えた移動体がその周囲を撮影しながら移動し、撮影された複数の画像における特徴点の移動量に基づいて移動体の移動量が計算される。これにより、移動体の現在の位置を推定したり、移動体の軌跡に基づいて地図を生成したりすることができる。

R. Mur-Artal, et al., "ORB-SLAM2: an Open-Source SLAM System for Monocular, Stereo and RGB-D Cameras", IEEE Transactions on Robotics, Volume: 33, Issue: 5, Oct. 2017

工場及び倉庫等など、日々背景が変化するシーンにおいては、事前に作成した地図を用いて現在の位置を特定することは困難である。この場合、Visual-SLAMによって得られる移動体の位置は、ある基準位置(例えば、移動体が移動を開始した位置)に対する相対位置として計算されるので、時間の経過に従って誤差が累積的に増大する。従って、撮影装置を用いて、従来よりも小さな誤差で移動体の位置を測定することができる測位装置が求められる。

本開示の目的は、撮影装置を用いて移動体の位置を測定する測位装置であって、従来よりも小さな誤差で移動体の位置を測定することができる測位装置を提供することにある。

本開示の一態様によれば、

移動体に搭載された撮影装置によって撮影された複数の画像に基づいて、所定の基準位置及び基準姿勢に対する前記移動体の相対位置及び相対姿勢を示す前記移動体の第1の位置及び第1の姿勢を計算する第1の計算器と、

予め決められた位置に配置されて視覚的に識別可能な複数のマーカーの識別子、位置、及び姿勢の情報と、前記移動体のための通路を含むマップの情報とを格納する記憶装置と、

前記撮影装置によって撮影された画像から前記複数のマーカーのうちの1つを抽出し、抽出された前記1つのマーカーの位置及び姿勢に基づいて、前記マップにおける前記移動体の位置及び姿勢を示す前記移動体の第2の位置及び第2の姿勢を計算する第2の計算器と、

前記第1の計算器によって計算された前記第1の位置及び前記第1の姿勢の信頼度を示す第1の信頼度と、前記第2の計算器によって計算された前記第2の位置及び前記第2の姿勢の信頼度を示す第2の信頼度とを計算する信頼度計算器と、

前記第1の信頼度が前記第2の信頼度以上であるとき、前記第1の位置及び前記第1の姿勢を前記移動体の位置及び姿勢として決定し、前記第1の信頼度が前記第2の信頼度より小さいとき、前記第2の位置及び前記第2の姿勢を前記移動体の位置及び姿勢として決定する位置及び姿勢決定器とを備える。

移動体に搭載された撮影装置によって撮影された複数の画像に基づいて、所定の基準位置及び基準姿勢に対する前記移動体の相対位置及び相対姿勢を示す前記移動体の第1の位置及び第1の姿勢を計算する第1の計算器と、

予め決められた位置に配置されて視覚的に識別可能な複数のマーカーの識別子、位置、及び姿勢の情報と、前記移動体のための通路を含むマップの情報とを格納する記憶装置と、

前記撮影装置によって撮影された画像から前記複数のマーカーのうちの1つを抽出し、抽出された前記1つのマーカーの位置及び姿勢に基づいて、前記マップにおける前記移動体の位置及び姿勢を示す前記移動体の第2の位置及び第2の姿勢を計算する第2の計算器と、

前記第1の計算器によって計算された前記第1の位置及び前記第1の姿勢の信頼度を示す第1の信頼度と、前記第2の計算器によって計算された前記第2の位置及び前記第2の姿勢の信頼度を示す第2の信頼度とを計算する信頼度計算器と、

前記第1の信頼度が前記第2の信頼度以上であるとき、前記第1の位置及び前記第1の姿勢を前記移動体の位置及び姿勢として決定し、前記第1の信頼度が前記第2の信頼度より小さいとき、前記第2の位置及び前記第2の姿勢を前記移動体の位置及び姿勢として決定する位置及び姿勢決定器とを備える。

これらの概括的かつ特定の態様は、システム、方法、コンピュータプログラム並びにシステム、方法及びコンピュータプログラムの任意の組み合わせにより実現してもよい。

本開示の一態様によれば、第1の計算器によって計算された相対位置及び相対姿勢の信頼度と、第2の計算器によって計算された絶対位置及び絶対姿勢の信頼度とを計算し、信頼度が高いほうを移動体の位置及び姿勢として決定することにより、移動体の位置及び姿勢を高精度に測定することができる。

以下、本開示に係る実施形態について図面を参照して説明する。なお、以下の各実施形態において、同様の構成要素については同一の符号を付している。

[第1の実施形態]

以下、第1の実施形態に係る測位装置及びそれを備えた移動体について説明する。

以下、第1の実施形態に係る測位装置及びそれを備えた移動体について説明する。

[第1の実施形態の構成]

[全体構成]

図1は、第1の実施形態に係る車両1の構成を示す概略図である。車両1は、例えばフォークリフトであってもよい。また、車両1は、荷物3を搭載する荷台1aを備える。車両1は、荷物3を荷台1aに積み卸しするための昇降機構1bをさらに備えてもよい。また、車両1は、前進、後進、操舵、及び停止などのユーザ操作を受けるコンソール1cを備える。また、車両1の車体には、車両1に対して予め決められた向き(前方、後方、側方、上方、及び/又は下方)を撮影するように、撮影装置11が設置されている。

[全体構成]

図1は、第1の実施形態に係る車両1の構成を示す概略図である。車両1は、例えばフォークリフトであってもよい。また、車両1は、荷物3を搭載する荷台1aを備える。車両1は、荷物3を荷台1aに積み卸しするための昇降機構1bをさらに備えてもよい。また、車両1は、前進、後進、操舵、及び停止などのユーザ操作を受けるコンソール1cを備える。また、車両1の車体には、車両1に対して予め決められた向き(前方、後方、側方、上方、及び/又は下方)を撮影するように、撮影装置11が設置されている。

図2は、図1の車両1を含む測位システムの構成を示すブロック図である。図2の測位システムは、少なくとも1つの車両1と、サーバ装置2とを含む。各車両1は、撮影装置11によって撮影された画像に基づいて、その位置を測定する測位装置12を備える。サーバ装置2は、各車両1からそれらの位置を取得し、各車両1の位置を記録する。

[車両1の構成]

車両1は、撮影装置11、測位装置12、通信装置13、表示装置14、及び駆動機構15をさらに備える。

車両1は、撮影装置11、測位装置12、通信装置13、表示装置14、及び駆動機構15をさらに備える。

撮影装置11は、車両1の移動中に、所定時間ごとに、車両1に対して予め決められた向きにおける被写体の画像を生成する。撮影装置11は、例えば、少なくとも1つのカメラを含む。撮影装置11は、所定時間ごとに静止画像を撮影してもよく、動画像の一連のフレームから所定時間ごとにフレームを抽出してもよい。撮影装置11は、撮影した画像を測位装置12に送る。撮影装置11は、各画像に、当該画像を撮影した時刻のタイムスタンプを付与する。

測位装置12は、撮影装置11によって撮影された画像に基づいて、車両1の位置及び姿勢を計算する。測位装置12は、撮影装置11によって撮影された複数の画像から特徴点を抽出し、抽出された特徴点を画像間で対応付けし、画像間の特徴点の変化量に基づいて、所定の基準位置及び基準姿勢に対する車両1の相対位置及び相対姿勢を計算する。また、測位装置12は、撮影装置11によって撮影された画像から、予め決められた位置に配置されて視覚的に識別可能な複数のマーカーのうちの1つを抽出し、抽出された1つのマーカーに基づいて、予め与えられたマップにおける車両1の絶対位置及び絶対姿勢を計算する。測位装置12はさらに、相対位置及び相対姿勢の信頼度と、絶対位置及び絶対姿勢の信頼度とを計算し、信頼度が高いほうを車両1の位置及び姿勢として決定する。信頼度は、例えば、予め実験的に決定された理論誤差(すなわち、位置及び姿勢の真値からの統計的な誤差)のモデルを参照し、撮影装置11によって撮影された画像に基づいて計算された推定誤差によって表される。信頼度は推定誤差が小さいほど大きくなる。

本明細書において、車両1の「姿勢」は、例えば、所定の座標系(後述する「世界座標系」又は「マーカー座標系」)の座標軸に対する車両1の進行方向の角度を示す。

通信装置13は、Wi-Fi又はBluetoothなどのモジュール及びその制御プログラムを備え、サーバ装置2と無線で通信する。通信装置13は、測位装置12によって計算された車両1の位置及び姿勢をサーバ装置2に送信する。

表示装置14は、車両1の位置をマップの上に表示してもよい。また、表示装置14は、車両1の動作に関する警報などを表示してもよい。

駆動機構15は、車両1のエンジン又はモータ、操舵装置、制動装置、及びそれらの制御装置などを含む。駆動機構15は、例えば、コンソール1cを介してユーザによって制御される。

[サーバ装置2の構成]

図2のサーバ装置2は、処理装置21、通信装置22、入力装置23、記憶装置24、及び表示装置25を備える。処理装置21は、例えば、プロセッサ及びメモリなどを含む汎用のコンピュータである。通信装置22は、車両1の通信装置13と通信可能に接続される。入力装置23は、キーボード及びポインティングデバイスなどを含む。記憶装置24は、車両1から受信した車両1の位置及び姿勢を記録する。表示装置25は、車両1から受信した車両1の位置及び姿勢を表示する。処理装置21は、通信装置22を介して各車両1からそれらの位置を取得し、各車両1の位置を記憶装置24に記録し、また、各車両1の位置を表示装置25に表示する。

図2のサーバ装置2は、処理装置21、通信装置22、入力装置23、記憶装置24、及び表示装置25を備える。処理装置21は、例えば、プロセッサ及びメモリなどを含む汎用のコンピュータである。通信装置22は、車両1の通信装置13と通信可能に接続される。入力装置23は、キーボード及びポインティングデバイスなどを含む。記憶装置24は、車両1から受信した車両1の位置及び姿勢を記録する。表示装置25は、車両1から受信した車両1の位置及び姿勢を表示する。処理装置21は、通信装置22を介して各車両1からそれらの位置を取得し、各車両1の位置を記憶装置24に記録し、また、各車両1の位置を表示装置25に表示する。

表示装置25は、車両1の測位装置12によって計算された車両1の位置及び姿勢を表示する。処理装置21は、車両1の移動範囲(倉庫又は工場など)のマップを予め取得し、測位装置12によって計算された車両1の位置及び姿勢をこのマップ上に重畳して表示装置25に表示してもよい。それに代わって、処理装置21は、車両1の移動経路に基づいて処理装置21自体によりマップを生成し、このマップを表示装置25に表示してもよい。

[測位装置12の構成]

図3は、図2の測位装置12の構成を示すブロック図である。測位装置12は、画像処理器31、相対位置計算器32、画像認識器33、絶対位置計算器34、記憶装置35、信頼度計算器36、ならびに位置及び姿勢決定器37を備える。

図3は、図2の測位装置12の構成を示すブロック図である。測位装置12は、画像処理器31、相対位置計算器32、画像認識器33、絶対位置計算器34、記憶装置35、信頼度計算器36、ならびに位置及び姿勢決定器37を備える。

記憶装置35は、予め決められた位置に配置されて視覚的に識別可能な複数のマーカー4の識別子、位置、及び姿勢の情報と、車両1のための通路を含むマップ(例えば、図4を参照して説明する倉庫100のマップ)の情報とを格納する。マーカー4の位置は、所定の基準位置に対する相対位置として表されてもよく、及び/又は、マップに関連付けて表されてもよい。

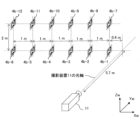

図4は、図1の車両1が移動する通路101を含む倉庫100のマップである。倉庫100は、複数の通路101及び複数の棚102などの構造物を含む。倉庫100における予め決められた複数の位置に、複数のマーカー4が予め配置される。図1の車両1は、通路101を移動して、ある棚102から他の棚102に荷物3を搬送する。車両1及び各マーカー4の位置は、倉庫100の全体に対して決められた世界座標系(Xw,Yw,Zw)によって表される。

図5は、図4のマーカー4の例を示す図であって、図5(a)はマーカー4の正面図を示し、図5(b)はマーカー4の上面図を示す。図5の例では、マーカー4は正方形の平板として形成される。マーカー4は、その1つの面において、マーカー4自体の識別子を符号化した視覚的に識別可能なパターンを有する。図5の例では、マーカー4は、縦横に7×7個の白又は黒の正方形のセルからなるパターンを有する。マーカー4のパターンはさらに、例えば拡張現実の分野で使用されるマーカー(「ARマーカー」ともいう)のように、マーカー4を撮影した画像からマーカー4自体の姿勢を検出可能であるように形成される。各マーカー4は、その任意の点(例えば、中心、又は1つの頂点)を原点とするマーカー座標系(Xm,Ym,Zm)を有する。図5の下段及び他の図面では、Xm-Ym面に沿った面の中央における矢印によってマーカー4の正面(Zm軸の正の向き)を示す。

図6は、図3の記憶装置35に格納されたマーカー情報の例を示すテーブルである。図6の例では、図4に示す2つのマーカー4の情報を示す。各マーカー4は、識別子001、002を有する。この識別子は、マーカー4のパターンに符号化されている。また、各マーカー4は、世界座標系(Xw,Yw,Zw)において所定の座標を有する。また、各マーカー4は、その正面(Zm軸の正の向き)がXw-Yw面内においてXw軸を基準として角度θ(すなわち方位角)を有するような姿勢で配置される。各マーカー4の姿勢は、方位角及び仰角によって表されてもよい。また、各マーカー4は、正方形形状のパターンを有し、また、実際のサイズ30cm×30cmを有する。マーカー4のサイズは、そのパターンの領域のサイズを示し、パターンの周囲のマージンなど(図5には図示せず)を含まない。

記憶装置35は、すべてのマーカー4について、例えば、図6に示すような項目を含むマーカー情報を格納する。また、記憶装置35は、すべての通路101について、その向き、寸法、及び配置を含むマップ情報を格納する。

図7は、図1の撮影装置11によって撮影された画像40の例を示す図である。画像40は複数の特徴点41を含む。特徴点41は、輝度値あるいは色が周囲の画素と区別でき、その位置を正確に決定することができる点である。特徴点41は、例えば、車両1が移動する通路101又は棚102などの構造物の頂点又はエッジ、床、壁、又は天井の模様から検出される。また、車両1がマーカー4の近傍を通過するとき、画像40はマーカー4を含む。画像40における特徴点41及びマーカー4の位置は、例えば、画像40の任意の点(例えば、左上のコーナー)を原点とする画像座標系(Xi,Yi)によって表される。

再び図3を参照すると、画像処理器31は、所定時間だけ離れた複数の時刻において撮影装置11によってそれぞれ撮影された複数の画像から、対応する特徴点の座標を抽出(トラッキング)する。相対位置計算器32は、時間的に隣接した2つの画像における特徴点の移動量に基づいて、車両1の移動量を計算する。これにより、相対位置計算器32は、複数の画像の特徴点の座標に基づいて、所定の基準位置及び基準姿勢(例えば、車両1が移動を開始したときの位置及び姿勢)に対する車両1の相対位置及び相対姿勢を計算する。相対位置計算器32は、例えば、Visual-SLAM又はVisual-Odometryなど、公知の画像処理及び測位の技術を用いて、車両1の相対位置及び相対姿勢を計算してもよい。基準位置及び基準姿勢は、記憶装置35に格納されたマップの情報に関連付けられる。また、相対位置計算器32は、相対位置及び相対姿勢に、それらの計算に関連付けられた画像(時間的に隣接した2つの画像のうちの後者)のタイムスタンプを付与する。

相対位置計算器32は、計算した車両1の位置を、例えば、直交座標(XYZ座標)により表してもよい。相対位置計算器32は、計算した車両1の位置及び時刻に基づいて、車両1の速度及び/又は加速度を計算してもよい。相対位置計算器32は、計算した車両1の姿勢を、ロール(左右の傾き)、ピッチ(前後の傾き)、及びヨー(床面に垂直な軸(すなわち、図4のZw軸)の周りの回転)により表してもよい。これにより、地面に平行な水平面内における車両1の向きだけでなく、車両1の車体の傾斜を表したり、車両1の高さ方向の移動を表したりすることができる。

本明細書では、画像処理器31及び相対位置計算器32を合わせて、「第1の計算器」ともいう。また、本明細書では、相対位置及び相対姿勢を「第1の位置」及び「第1の姿勢」ともいう。

画像認識器33は、撮影装置11によって撮影された画像から、予め決められた位置に配置されて視覚的に識別可能な複数のマーカー4のうちの1つを抽出する。絶対位置計算器34は、抽出された1つのマーカー4の位置及び姿勢に基づいて、記憶装置35に格納されたマーカー4の情報及びマップの情報を参照することにより、マップ(すなわち世界座標系)における車両1の位置及び姿勢を示す車両1の絶対位置及び絶対姿勢を計算する。また、絶対位置計算器34は、絶対位置及び絶対姿勢に、それらの計算に関連付けられた画像のタイムスタンプを付与する。

本明細書では、画像認識器33及び絶対位置計算器34を合わせて、「第2の計算器」ともいう。また、本明細書では、絶対位置及び絶対姿勢を「第2の位置」及び「第2の姿勢」ともいう。

信頼度計算器36は、相対位置計算器32によって計算された相対位置及び相対姿勢の信頼度と、絶対位置計算器34によって計算された絶対位置及び絶対姿勢の信頼度とを計算する。信頼度計算器36は、例えば、車両1の基準位置及び基準姿勢からの移動距離及び回転角度が小さくなるほど信頼度が増大するように、また、移動距離及び回転角度が大きくなるほど信頼度が低下するように、相対位置及び相対姿勢の信頼度を計算する。例えば、後述するように位置及び姿勢決定器37が絶対位置及び絶対姿勢を車両1の位置及び姿勢として決定したとき、車両1の基準位置及び基準姿勢はリセットされる。言いかえると、絶対位置及び絶対姿勢の信頼度が相対位置及び相対姿勢の信頼度を越えたときの絶対位置及び絶対姿勢が、車両1の基準位置及び基準姿勢として設定される。また、信頼度計算器36は、例えば、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズが大きくなるほど信頼度が増大するように、また、画像におけるマーカー4の見かけのサイズが小さくなるほど信頼度が低下するように、絶対位置及び絶対姿勢の信頼度を計算する。

位置及び姿勢決定器37は、相対位置及び相対姿勢の信頼度が絶対位置及び絶対姿勢の信頼度以上であるとき、相対位置及び相対姿勢を車両1の位置及び姿勢として決定する。また、位置及び姿勢決定器37は、相対位置及び相対姿勢の信頼度が絶対位置及び絶対姿勢の信頼度より小さいとき、絶対位置及び絶対姿勢を車両1の位置及び姿勢として決定する。位置及び姿勢決定器37は、相対位置及び相対姿勢のタイムスタンプと、絶対位置及び絶対姿勢のタイムスタンプとに基づいて、絶対位置及び絶対姿勢を相対位置及び相対姿勢と同期させる。位置及び姿勢決定器37は、例えば、予め決められた閾値より小さい時間差を有し、最も近接したタイムスタンプを有する相対位置及び相対姿勢と絶対位置及び絶対姿勢とを、同じ画像から計算されたものとみなしてもよい。

測位装置12の各構成要素31~37のうちの少なくとも一部が一体化されてもよい。例えば、画像処理器31及び画像認識器33を一体化してもよい。また、測位装置12の各構成要素31~37は、専用回路として実装されてもよく、汎用のプロセッサによって実行されるプログラムとして実装されてもよい。

[第1の実施形態の動作]

測位装置12によれば、Visual-SLAMを用いて計算された相対位置及び相対姿勢の誤差が増大したとき、マーカー4に基づいて計算された絶対位置及び絶対姿勢により、車両1の位置及び姿勢を補正することができる。

測位装置12によれば、Visual-SLAMを用いて計算された相対位置及び相対姿勢の誤差が増大したとき、マーカー4に基づいて計算された絶対位置及び絶対姿勢により、車両1の位置及び姿勢を補正することができる。

しかしながら、Visual-SLAMを用いて車両1の相対位置及び相対姿勢を計算する場合、車両1の基準位置及び基準姿勢からの移動距離及び回転角度が増大するほど、相対位置及び相対姿勢の誤差が増大する。また、マーカー4に基づいて車両1の絶対位置及び絶対姿勢を計算する場合、撮影装置11によってマーカー4を撮影する条件に応じて、絶対位置及び絶対姿勢の誤差が増大する。例えば、撮影装置11からマーカー4までの距離が増大するほど、絶対位置及び絶対姿勢の誤差が増大する。また、撮影装置11の光軸に対するマーカー4の面の角度が0度に近いとき、絶対位置及び絶対姿勢の誤差が増大する。また、撮影された画像の端部にマーカー4が位置しているとき、絶対位置及び絶対姿勢の誤差が増大することがある。

絶対位置及び絶対姿勢の誤差が大きい場合には、絶対位置及び絶対姿勢を車両1の位置及び姿勢として使用しないことが望ましい。一方、相対位置及び相対姿勢の誤差が蓄積しすぎた場合には、ある程度、絶対位置及び絶対姿勢の誤差が大きくても、絶対位置及び絶対姿勢を車両1の位置及び姿勢として決定することが望ましい。この場合、相対位置及び相対姿勢の誤差の大きさと、絶対位置及び絶対姿勢の誤差の大きさとを評価する必要がある。

従って、実施形態に係る測位装置12は、相対位置及び相対姿勢の信頼度と、絶対位置及び絶対姿勢の信頼度とを計算し、信頼度が高いほうを車両1の位置及び姿勢として決定する。

以下、測位装置12の動作について詳細に説明する。

[測位処理の全体]

図8は、図2の測位装置12によって実行される測位処理を示すフローチャートである。

図8は、図2の測位装置12によって実行される測位処理を示すフローチャートである。

ステップS1において、測位装置12は、撮影装置11によって撮影された画像を取得する。

ステップS2において、画像処理器31及び相対位置計算器32は、相対位置計算処理を実行し、車両1の相対位置及び相対姿勢を計算する。ステップS3において、信頼度計算器36は、車両1の相対位置及び相対姿勢の信頼度Q1を計算する。

ステップS4において、画像認識器33及び絶対位置計算器34は、絶対位置計算処理を実行し、車両1の絶対位置及び絶対姿勢を計算する。ステップS5において、信頼度計算器36は、車両1の絶対位置及び絶対姿勢の信頼度Q2を計算する。

ステップS2~S5は、図8に示すように並列に実行されてもよく、逐次に実行されてもよい。

ステップS6において、信頼度計算器36は、「絶対位置の信頼度>相対位置の信頼度」と、「絶対姿勢の信頼度>相対姿勢の信頼度」とのうちの少なくとも一方が成り立つか否かを判断し、YESのときはステップS7に進み、NOのときはステップS9に進む。信頼度計算器36に代わって位置及び姿勢決定器37がステップS6を実行してもよい。

ステップS7において、位置及び姿勢決定器37は、車両1の絶対位置及び絶対姿勢を、車両1の位置及び姿勢として決定する。位置及び姿勢決定器37は、決定された車両1の位置及び姿勢を、通信装置13及び表示装置14に出力する。ステップS8において、位置及び姿勢決定器37は、車両1の相対位置及び相対姿勢の基準をリセットする。

ステップS9において、位置及び姿勢決定器37は、車両1の相対位置及び装置姿勢を、車両1の位置及び姿勢として決定する。位置及び姿勢決定器37は、決定された車両1の位置及び姿勢を、通信装置13及び表示装置14に出力する。

ステップS8,S9の後でステップS1に戻り、処理を繰り返す。

[相対位置計算処理]

図9は、図8のステップS2(相対位置計算処理)のサブルーチンを示すフローチャートである。

図9は、図8のステップS2(相対位置計算処理)のサブルーチンを示すフローチャートである。

ステップS11において、画像処理器31は、所定時間だけ離れた第1及び第2の時刻にそれぞれ撮影された(例えば、時間的に隣接したフレームの)第1及び第2の画像を取得する。

ステップS12において、画像処理器31は、第1の画像から特徴点を検出する。画像から特徴点を検出するために、例えば、FAST(Features from Accelerated Segment Test)のような画像処理技術を使用してもよい。

ステップS13において、画像処理器31は、第2の画像から、第1の画像の特徴点に対応する特徴点を検出する。画像間で対応する特徴点を検出するために、例えば、KLT(Kanade-Lucas-Tomasi)トラッカーのような公知の画像処理技術を使用してもよい。

図10は、図3の画像処理器31によって抽出される特徴点を示す図である。図10(a)は時刻nにおける画像40(n)から抽出される特徴点F1,F2を示す。図10(b)は時刻n’における画像40(n’)から抽出される特徴点F1’,F2’を示す。図10(a)の画像40(n)の画像座標系において、特徴点F1は座標(xi1,yi1)を有し、特徴点F2は座標(xi2,yi2)を有する。図10(b)の画像40(n’)の画像座標系において、特徴点F1’は座標(xi1’,yi1’)を有し、特徴点F2’は座標(xi2’,yi2’)を有する。図10(b)の特徴点F1’,F2’は、図10(a)の特徴点F1,F2にそれぞれ対応する。

図9のステップS14において、画像処理器31は、第1及び第2の画像における対応する特徴点の座標の組を取得する。画像処理器31は、例えば、特徴点F1,F1’の座標の組(xi1,yi1,xi1’,yi1’)を取得し、特徴点F2,F2’の座標の組(xi2,yi2,xi2’,yi2’)を取得する。

ステップS15において、相対位置計算器32は、ステップS14において取得された特徴点の座標に基づいて、例えば5点アルゴリズムを用いて、3×3個の要素からなる基礎行列Eを計算する。

ステップS16において、相対位置計算器32は、基礎行列Eに対して特異値分解を行うことにより、第1及び第2の画像を撮影した時刻の間における車両1の移動を表す回転行列R及び並進ベクトルtを計算する。回転行列Rは、第1及び第2の画像を撮影した時刻の間における車両1の姿勢の変化を示す。並進ベクトルtは、第1及び第2の画像を撮影した時刻の間における車両1の位置の変化を示す。

回転行列R及び並進ベクトルtの計算は、例えば、以下のように定式化される。

基礎行列Eは、特異値分解を行うことにより、E=UΣVTとして表される。ここで、Σは、3×3個の要素からなる対角行列Σであり、U,Vは、3×3個の要素からなる直交行列である。

回転行列Rは、3×3個の要素からなる次式の行列Wを用いて、R=UW-1VTにより計算される。

また、並進ベクトルtを計算するために、3×3個の要素からなる行列T=VWΣVTが計算される。行列Tは、E=TRを満たし、次式で表される。

並進ベクトルtは、行列Tの成分により、t=(tx,ty,tz)Tとして表される。

ステップS17において、相対位置計算器32は、車両1の相対位置及び相対姿勢を計算する。直前の時刻n-1において車両1が相対位置t(n-1)及び相対姿勢R(n-1)を有するとき、現在の時刻nにおいて、車両1の相対位置t(n)は、ステップS16において計算された並進ベクトルtを用いて、t(n)=t(n-1)+tR(n-1)により表される。また、現在の時刻nにおいて、車両1の相対姿勢R(n)は、ステップS16において計算された回転行列Rを用いて、R(n)=RR(n-1)で表される。このように、相対位置計算器32は、複数の並進ベクトルを累積的に加算し、複数の回転行列を累積的に乗算することにより、所定の基準位置及び基準姿勢に対する車両1の相対位置及び相対姿勢を計算する。相対位置計算器32は、計算した車両1の相対位置及び相対姿勢を位置及び姿勢決定器37に送る。

[相対位置及び相対姿勢の信頼度]

図11は、図3の相対位置計算器32によって計算される相対位置及び相対姿勢の信頼度の計算を説明する図である。

図11は、図3の相対位置計算器32によって計算される相対位置及び相対姿勢の信頼度の計算を説明する図である。

信頼度計算器36は、例えば、車両1の基準位置及び基準姿勢からの移動距離及び回転角度が小さくなるほど信頼度が増大するように、また、移動距離及び回転角度が大きくなるほど信頼度が低下するように、相対位置及び相対姿勢の信頼度を計算する。相対位置及び相対姿勢の信頼度は、例えば、予め実験的に決定された理論誤差(すなわち、位置及び姿勢の真値からの統計的な誤差)のモデルを参照し、撮影装置11によって撮影された画像に基づいて計算された推定誤差によって表される。信頼度は推定誤差が小さいほど大きくなる。

事前実験として、さまざまな条件で車両1を実際に走行させ、実際の経路における車両1の位置及び姿勢と、Visual-SLAMを用いて推定された経路における車両1の位置及び姿勢との差を計算する。これにより、Visual-SLAMの理論誤差、すなわち、車両1の移動距離の理論誤差Eraと、車両1の移動中の回転角度の理論誤差Erbとを取得する。ここで、移動距離の理論誤差Eraは、例えば、さまざまな条件で計算して平均された、実際の移動距離に対する、Visual-SLAMを用いて推定される移動距離の誤差の比を示す。回転角度の理論誤差Erbは、例えば、さまざまな条件で計算して平均された、実際の回転角度に対する、Visual-SLAMを用いて推定される回転角度の誤差の比Erbを示す。

図11の例では、車両1は、点P0から点P1に至る経路を実際に走行する。実際の経路P0→P1は、例えば、長さd1=50mを有し、90度のコーナーを2つ含む。従って、車両1は、経路P0→P1を進む間に、A1=|90度|×2=180度にわたって回転する。また、車両1が点P1に到着したとき、Visual-SLAMを用いて推定された車両1の位置は点P2にある。点P1,P2は、車両1の進行方向に沿った位置の誤差E1aa=3.85mと、車両1の進行方向に直交する方向に沿った位置の誤差E1ab=1.6mとを有する。従って、Visual-SLAMを用いて推定された経路P0→P2は、長さd2=((d1-E1aa)2+E1ab2)1/2=((50m-3.85m)2+1.62)1/2=46.2mを有する。また、経路P0→P1及び経路P0→P2は、角度の誤差E1b=arcsin(E1ab/d2)=arcsin(1.6/46.2)=2度を有する。この場合、Visual-SLAMの理論誤差、すなわち、移動距離の理論誤差Era及び回転角度の理論誤差Erbは、以下のように計算される。

Era=E1aa/d1=3.85/50=0.077

Erb=E1b/A1=2/180=0.011

Erb=E1b/A1=2/180=0.011

ここで、移動距離の理論誤差Eraは、車両1の進行方向に沿った移動距離の成分に基づいて計算される。

このように予め実験的に決定された理論誤差のモデルが与えられ、車両1が任意の経路に沿って移動するとき、車両1の相対位置及び相対姿勢の推定誤差は以下のように計算される。

Visual-SLAMの理論誤差として、Era=0.077及びErb=0.011が与えられ、車両1が、長さd1=50mを有し、90度のコーナーを2つ含む経路P0→P1を走行する場合を考える。実際の経路P0→P1の長さd1=50m及び回転角度A1=180度は未知である。一方、Visual-SLAMを用いて推定された経路P0→P2は、例えば、長さd2=46.2m及び回転角度A2=182度を有することがわかる。従って、相対位置の推定誤差E1aは以下のように計算される。

E1b=A2×Erb=182度×0.011=2度

E1ab=d2×sin(E1b)=46.2m×sin(2度)=1.6m

E1aa=d2×cos(E1b)×Era/(1±Era)=46.2m×cos(2度)×0.077/(1±0.077)=3.3m,3.85m

E1a=(E1aa2+E1ab2)1/2=(3.852+1.62)1/2=4.2m

E1ab=d2×sin(E1b)=46.2m×sin(2度)=1.6m

E1aa=d2×cos(E1b)×Era/(1±Era)=46.2m×cos(2度)×0.077/(1±0.077)=3.3m,3.85m

E1a=(E1aa2+E1ab2)1/2=(3.852+1.62)1/2=4.2m

一方、相対姿勢の推定誤差は、経路P0→P1及び経路P0→P2の間の角度の推定誤差E1bに等しい。

車両1の基準位置及び基準姿勢からの移動距離及び回転角度が大きくなるほど、相対位置及び相対姿勢の推定誤差は増大する(すなわち、相対位置及び相対姿勢の信頼度が低下する)。また、移動距離及び回転角度が小さくなるほど、相対位置及び相対姿勢の推定誤差は低下する(すなわち、相対位置及び相対姿勢の信頼度が増大する)。従って、相対位置及び相対姿勢の推定誤差を用いて、相対位置及び相対姿勢の信頼度を表すことができる。

[絶対位置計算処理]

図12は、図8のステップS4(絶対位置計算処理)のサブルーチンを示すフローチャートである。

図12は、図8のステップS4(絶対位置計算処理)のサブルーチンを示すフローチャートである。

ステップS21において、画像認識器33は、画像からマーカー4を検出する。ここで、画像認識器33は、画像座標系において四角形のマーカー4の4つの頂点(コーナー)の座標を検出し、また、マーカー4のパターンを復号してマーカー4の識別子を取得する。なお、画像認識器33は、マーカー4の4つの頂点に代えて、予め決められたいくつかの点の座標を検出してもよい。

図13は、マーカー座標系におけるマーカー4の頂点の座標を示す図である。マーカー座標系(Xm,Ym,Zm)において、マーカー4の4つの頂点は、座標(xm0,ym0,zm0)、(xm1,ym1,zm1)、(xm2,ym2,zm2)、及び(xm3,ym3,zm3)をそれぞれ有する。マーカー4の寸法は既知であるので、マーカー座標系におけるマーカー4の4つの頂点の座標もまた既知である。例えば、図13のマーカー4の左上の頂点がマーカー座標系(Xm,Ym,Zm)の原点であり、かつ、マーカー4が実際のサイズ30cm×30cmを有する場合、マーカー4の頂点は、例えば、座標(xm0,ym0,zm0)=(0,0,0)、(xm1,ym1,zm1)=(0.3,0,0)、(xm2,ym2,zm2)=(0,0.3,0)、及び(xm3,ym3,zm3)=(0.3,0.3,0)を有する。

図14は、図1の撮影装置11によって撮影された画像40におけるマーカー4の頂点の座標を示す図である。画像座標系(Xi,Yi)において、マーカー4の4つの頂点は、座標(xi0,yi0)、(xi1,yi1)、(xi2,yi2)、及び(xi3,yi3)をそれぞれ有する。

図12のステップS22において、絶対位置計算器34は、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズを取得する。世界座標系において車両1が主に水平面内(すなわち、Xw-Yw面内)において移動する場合、画像におけるマーカー4の見かけのサイズは、例えば、マーカー4の縦方向(すなわちYi方向)の長さ(画素数)によって表されてもよい。それに代わって、画像におけるマーカー4の見かけのサイズは、マーカー4の縦方向の長さ及び横方向の長さの組み合わせによって表されてもよい。画像におけるマーカー4の見かけのサイズは、撮影装置11からマーカー4までの距離に対応する。なお、マーカー4の横方向(すなわちXi方向)の長さは、距離に依存するだけでなく、撮影装置11によりマーカー4を撮影する角度にも依存して変化する。

ステップS23において、絶対位置計算器34は、ステップS21において検出されたマーカー4の座標に基づいて、撮影装置11を原点とする3次元座標系(カメラ座標系)におけるマーカー4の位置及び姿勢(すなわち、撮影装置11から見たマーカー4の位置及び姿勢)を計算する。例えば、絶対位置計算器34は、2次元の画像座標系におけるマーカー4の4つの頂点の座標と、3次元のマーカー座標系におけるマーカー4の4つの頂点の座標とに基づいて、PnP(perspective n point)問題を解くことにより、撮影装置11から見たマーカー4の位置及び姿勢を計算する。

ステップS24において、絶対位置計算器34は、マーカー座標系における撮影装置11の位置及び姿勢(すなわち、マーカー4から見た撮影装置11の位置及び姿勢)を計算する。ここで、撮影装置11から見たマーカー4の位置を並進ベクトルtにより示し、撮影装置11から見たマーカー4の姿勢を回転行列Rにより示す。この場合、マーカー4から見た撮影装置11の姿勢は、R-1により表され、マーカー4から見た撮影装置11の位置は、-R-1tにより表される。

ステップS25において、絶対位置計算器34は、ステップS21において検出されたマーカー4の識別子に基づいて、記憶装置35から、世界座標系におけるマーカー4の位置及び姿勢(すなわち、マーカー4の絶対位置及び絶対姿勢)を読み出す。

ステップS26において、絶対位置計算器34は、ステップS24において計算されたマーカー座標系における撮影装置11の位置及び姿勢と、ステップS25において読み出された世界座標系におけるマーカー4の位置及び姿勢とに基づいて、世界座標系における車両1の位置及び姿勢(すなわち、車両1の絶対位置及び絶対姿勢)を計算する。マーカー座標系における撮影装置11の位置及び姿勢に対して、世界座標系におけるマーカー4の位置及び姿勢をオフセット値として加算することにより、世界座標系における車両1の位置及び姿勢が得られる。絶対位置計算器34は、計算した車両1の絶対位置及び絶対姿勢を位置及び姿勢決定器37に送る。

[絶対位置及び絶対姿勢の信頼度]

図15は、図3の絶対位置計算器34によって計算される絶対位置及び絶対姿勢の信頼度の計算を説明する図である。

図15は、図3の絶対位置計算器34によって計算される絶対位置及び絶対姿勢の信頼度の計算を説明する図である。

信頼度計算器36は、例えば、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズが大きくなるほど信頼度が増大するように、また、画像におけるマーカー4の見かけのサイズが小さくなるほど信頼度が低下するように、絶対位置及び絶対姿勢の信頼度を計算する。絶対位置及び絶対姿勢の信頼度は、例えば、予め実験的に決定された理論誤差(すなわち、位置及び姿勢の真値からの統計的な誤差)のモデルを参照し、撮影装置11によって撮影された画像に基づいて計算された推定誤差によって表される。信頼度は推定誤差が小さいほど大きくなる。

事前実験として、さまざまな条件で撮影装置11によってマーカー4を撮影し、車両1の実際の位置及び姿勢と、マーカー4に基づいて計算された車両1の絶対位置及び絶対姿勢との誤差を計算する。このとき、マーカー4に対してさまざまな距離及び角度に位置した予め決められた複数の観測点から、撮影装置11によりマーカー4を撮影する。観測点は、例えば、予め決められた間隔を有する格子点であってもよい。撮影装置11の向きを変化させながらマーカー4を撮影してもよい。

図15の例では、マーカー4に対して相対的に近接した撮影装置11-1と、マーカー4に対して相対的に遠隔した撮影装置11-2とを示す。撮影装置11-1を備える車両1は、絶対位置の誤差E2a-1と、絶対姿勢の誤差E2b-1とを有する。また、撮影装置11-2を備える車両1は、絶対位置の誤差E2a-1より大きい絶対位置の誤差E2a-2と、絶対姿勢の誤差E2b-1より大きい絶対姿勢の誤差E2b-2とを有する。従って、図15によれば、絶対位置及び絶対姿勢の誤差は、撮影装置11からマーカー4までの距離に依存すると考えられる。

図15の例では、絶対姿勢の誤差E2b-1,E2b-2をマーカー座標系に関連付けて示すが、図12のステップS26において説明したように、マーカー座標系における姿勢は世界座標系における姿勢に換算される。

図16は、絶対位置の誤差が、図1の撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズに依存することを説明するグラフである。図17は、絶対姿勢の誤差が、図1の撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズに依存することを説明するグラフである。図16及び図17にプロットした各点は、前述の事前実験の結果を示す。ここで、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズは、撮影装置11からマーカー4までの距離に応じて変化する。図16及び図17によれば、マーカー4の縦方向の長さと絶対位置及び絶対姿勢の誤差との間には相関があると考えられる。従って、図16及び図17のグラフに曲線をあてはめ、あてはめた曲線に基づいて、絶対位置の理論誤差E2a及び絶対姿勢の理論誤差E2bを例えば以下のように表す。

E2a=40/縦方向の長さ(画素数)

E2b=400/縦方向の長さ(画素数)

E2b=400/縦方向の長さ(画素数)

このように予め実験的に決定された理論誤差のモデルが与えられ、車両1が任意の経路に沿って移動するとき、絶対位置の理論誤差E2a及び絶対姿勢の理論誤差E2bを、絶対位置及び絶対姿勢の推定誤差として計算することができる。

撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズが小さくなるほど、絶対位置及び絶対姿勢の推定誤差は増大する(すなわち、絶対位置及び絶対姿勢の信頼度が低下する)。また、画像におけるマーカー4の見かけのサイズが大きくなるほど、絶対位置及び絶対姿勢の推定誤差は低下する(すなわち、絶対位置及び絶対姿勢の信頼度が増大する)。従って、絶対位置及び絶対姿勢の推定誤差を用いて、絶対位置及び絶対姿勢の信頼度を表すことができる。

第1の実施形態によれば、相対位置及び相対姿勢の信頼度と、絶対位置及び絶対姿勢の信頼度とを計算し、信頼度が高いほうを車両1の位置及び姿勢として決定することにより、車両1の位置及び姿勢を高精度に測定することができる。第1の実施形態によれば、例えば、相対位置及び相対姿勢の信頼度としてそれらの推定誤差を計算し、絶対位置及び絶対姿勢の信頼度としてそれらの推定誤差を計算し、推定誤差が小さいほうを、車両1の位置及び姿勢として決定することができる。

第1の実施形態によれば、撮影装置11を用いることにより、倉庫又は工場など、GPS衛星からの電波を受信できない屋内であっても、車両1の位置を安価に測定することができる。無線信号を送信するための多数の無線送信機を設置する必要がないので、初期導入コストを低減できる。

第1の実施形態によれば、測位結果から得られる車両1の移動経路に基づいて、業務改善を行うことができる。

第1の実施形態によれば、車両1の移動距離に基づいて、保守の要否、リース契約の更改の要否、などを判断するために活用することができる。

第1の実施形態によれば、車両1の移動のヒートマップに基づいて、倉庫又は工場における通路又は棚などの配置を最適化することができる。

第1の実施形態によれば、各車両1の軌跡の違いに基づいて、各車両1が移動中に互いにすれ違う場所を可視化することができ、経路及び通路幅を見直して安全性を向上させることができる。

[第1の実施形態の第1の変形例]

図18は、第1の実施形態の第1の変形例に係る測位処理における相対位置及び相対姿勢の信頼度の計算を説明する図である。信頼度計算器36は、図11を参照して説明したように、車両1の移動距離及び回転角度に基づいて相対位置及び相対姿勢の信頼度を計算することに代えて、相対位置及び相対姿勢の信頼度を以下のように計算してもよい。

図18は、第1の実施形態の第1の変形例に係る測位処理における相対位置及び相対姿勢の信頼度の計算を説明する図である。信頼度計算器36は、図11を参照して説明したように、車両1の移動距離及び回転角度に基づいて相対位置及び相対姿勢の信頼度を計算することに代えて、相対位置及び相対姿勢の信頼度を以下のように計算してもよい。

信頼度計算器36は、絶対位置及び絶対姿勢に対する相対位置及び相対姿勢の差が小さくなるほど信頼度が増大するように、また、絶対位置及び絶対姿勢に対する相対位置及び相対姿勢の差が大きくなるほど信頼度が低下するように、相対位置及び相対姿勢の信頼度を計算する。この場合、相対位置及び相対姿勢の信頼度は、絶対位置及び絶対姿勢に対する相対位置及び相対姿勢の差(「相対位置及び相対姿勢の推定誤差」ともいう)によって表される。

図18において、車両1は、マーカー4に基づいて計算された絶対位置P10及び絶対姿勢A10を有する。また、車両1は、Visual-SLAMを用いて計算された、相対位置P11及び相対姿勢A11(図18では「車両1’」として示す)、又は、相対位置P12及び相対姿勢A12(図18では「車両1”」として示す)を有する。車両1は、絶対位置の推定誤差E2a及び絶対姿勢の推定誤差E2bを有する。

信頼度計算器36は、車両1の相対位置及び絶対位置の間の距離を、車両1の相対位置の推定誤差として計算する。位置及び姿勢決定器37は、車両1の相対位置及び絶対位置の間の距離が絶対位置の推定誤差E2aより大きいとき、絶対位置を車両1の位置として決定する。また、位置及び姿勢決定器37は、車両1の相対位置及び絶対位置の間の距離が絶対位置の推定誤差E2a以下であるとき、相対位置を車両1の位置として決定する。従って、図18の例では、車両1が相対位置P11を有する場合、車両1の相対位置P11は推定誤差d11<E2aを有し、位置及び姿勢決定器37は、相対位置P11を車両1の位置として決定する。一方、車両1が相対位置P12を有する場合、車両1の相対位置P12は推定誤差d12>E2aを有し、位置及び姿勢決定器37は、絶対位置P10を車両1の位置として決定する。

信頼度計算器36は、車両1の相対姿勢及び絶対姿勢の間の角度差を、車両1の相対姿勢の推定誤差として計算する。位置及び姿勢決定器37は、車両1の相対姿勢及び絶対姿勢の間の角度差が絶対姿勢の推定誤差E2bより大きいとき、絶対姿勢を車両1の姿勢として決定する。また、位置及び姿勢決定器37は、車両1の相対姿勢及び絶対姿勢の間の角度差が絶対姿勢の推定誤差E2b以下であるとき、相対姿勢を車両1の姿勢として決定する。従って、図18の例では、車両1が相対姿勢A11を有する場合、車両1の相対姿勢A11は推定誤差θ1<E2bを有し、位置及び姿勢決定器37は、相対姿勢A11を車両1の姿勢として決定する。一方、車両1が相対姿勢A12を有する場合、車両1の相対姿勢A12は推定誤差θ2>E2bを有し、位置及び姿勢決定器37は、絶対姿勢A10を車両1の姿勢として決定する。

絶対位置及び絶対姿勢に対する相対位置及び相対姿勢の差が大きくなるほど、相対位置及び相対姿勢の推定誤差は増大する(すなわち、相対位置及び相対姿勢の信頼度が低下する)。また、絶対位置及び絶対姿勢に対する相対位置及び相対姿勢の差が小さくなるほど、相対位置及び相対姿勢の推定誤差は低下する(すなわち、相対位置及び相対姿勢の信頼度が増大する)。従って、相対位置及び相対姿勢の推定誤差を用いて、相対位置及び相対姿勢の信頼度を表すことができる。

図18の例では、絶対位置及び絶対姿勢の推定誤差は、図15~図17を参照して説明した場合と同様に計算される。

第1の実施形態の第1の変形例によれば、相対位置及び相対姿勢の推定誤差と、絶対位置及び絶対姿勢の推定誤差とを計算し、推定誤差が小さいほう(すなわち、信頼度が高いほう)を、車両1の位置及び姿勢として決定することにより、車両1の位置及び姿勢を高精度に測定することができる。

[第1の実施形態の第2の変形例]

図19は、第1の実施形態の第2の変形例に係る測位処理における相対位置及び相対姿勢の信頼度の計算を説明する図である。信頼度計算器36は、図11又は図18を参照して説明したように相対位置及び相対姿勢の推定誤差を計算する際に、トラッキングの信頼度を考慮してもよい。

図19は、第1の実施形態の第2の変形例に係る測位処理における相対位置及び相対姿勢の信頼度の計算を説明する図である。信頼度計算器36は、図11又は図18を参照して説明したように相対位置及び相対姿勢の推定誤差を計算する際に、トラッキングの信頼度を考慮してもよい。

相対位置計算器32は、時間的に隣接した複数の画像においてトラッキングされた特徴点に基づいて相対位置及び相対姿勢を計算する。信頼度計算器36は、時間的に隣接した複数の画像においてトラッキングに成功した特徴点の個数に基づいてトラッキングの信頼度を計算し、トラッキングの信頼度が高くなるほど相対位置及び相対姿勢の信頼度が増大するように相対位置及び相対姿勢の信頼度を計算する。この場合、相対位置及び相対姿勢の信頼度は、例えば、図11又は図18を参照して説明した場合と同様に計算された相対位置及び相対姿勢の推定誤差に対して、トラッキングの信頼度を示す係数を乗算した値によって表される。

図19(a)を参照すると、画像40(n)において特徴点F1~F4が検出されている。図19(b)を参照すると、画像40(n’)において、図19(a)の特徴点F2に対応する特徴点F2’と、図19(a)の特徴点F4に対応する特徴点F4’とが検出されているが、図19(a)の特徴点F1,F3に対応する特徴点の検出に失敗している。

トラッキングを考慮した相対位置の推定誤差E1a’及び相対姿勢の推定誤差E1b’は、次式によって計算される。

E1a’=λ×(1/Tf)×E1a

E1b’=λ×(1/Tf)×E1b

E1b’=λ×(1/Tf)×E1b

λは予め決められた定数である。Tfはトラッキングの信頼度を示し、次式によって計算される。

Tf=トラッキングに成功した特徴点の総数/車両1の移動距離(m)

例えば、車両1が移動距離10mにわたって移動し、時間的に隣接した2つの画像において40000個の特徴点のトラッキングに成功し、λ=3000の場合、相対位置及び相対姿勢の推定誤差は以下のように計算される。

Tf=40000/10=4000

E1a’=3000×(1/4000)×E1a

E1b’=3000×(1/4000)×E1b

E1a’=3000×(1/4000)×E1a

E1b’=3000×(1/4000)×E1b

相対位置の推定誤差E1a及び相対姿勢の推定誤差E1bは、図11又は図18を参照して説明した場合と同様に計算される。

トラッキングの信頼度が低くなるほど、相対位置及び相対姿勢の推定誤差は増大する(すなわち、相対位置及び相対姿勢の信頼度が低下する)。また、トラッキングの信頼度が高くなるほど、相対位置及び相対姿勢の推定誤差は低下する(すなわち、相対位置及び相対姿勢の信頼度が増大する)。従って、トラッキングの信頼度を考慮した相対位置及び相対姿勢の推定誤差を用いて、相対位置及び相対姿勢の信頼度を表すことができる。

絶対位置及び絶対姿勢の信頼度は、図15~図17を参照して説明した場合と同様に計算される。

第1の実施形態の第2の変形例によれば、トラッキングの信頼度を考慮することにより、車両1の位置及び姿勢をより高精度に測定することができる。

[第1の実施形態の第3の変形例]

信頼度計算器36は、相対位置及び相対姿勢の信頼度として、図11、図18、又は図19を参照して説明した場合と同様に相対位置及び相対姿勢の推定誤差を計算することに代えて、相対位置及び相対姿勢の変化量の分散を計算してもよい。

信頼度計算器36は、相対位置及び相対姿勢の信頼度として、図11、図18、又は図19を参照して説明した場合と同様に相対位置及び相対姿勢の推定誤差を計算することに代えて、相対位置及び相対姿勢の変化量の分散を計算してもよい。

信頼度計算器36は、相対位置又は相対姿勢の変化量の分散が小さくなるほど信頼度が増大するように、また、相対位置又は相対姿勢の変化量の分散が大きくなるほど信頼度が低下するように、相対位置及び相対姿勢の信頼度を計算する。この場合、相対位置及び相対姿勢の信頼度は、相対位置又は相対姿勢の変化量の分散によって表される。

図20は、第1の実施形態の第3の変形例に係る測位処理における相対位置及び相対姿勢の信頼度の計算を説明する図であって、車両1の第1の軌跡を示す図である。図21は、図20の車両1の相対位置又は相対姿勢の変化量を概略的に示すグラフである。図20に示すように、時刻n-2~n+2において、車両1は相対位置P(n-2)~P(n+2)及び相対姿勢A(n-2)~A(n+2)を有する。この場合、相対位置及び相対姿勢の変化量は小さく、その分散も小さい。

図22は、第1の実施形態の第3の変形例に係る測位処理における相対位置及び相対姿勢の信頼度の計算を説明する図であって、車両1の第2の軌跡を示す図である。図23は、図22の車両1の相対位置又は相対姿勢の変化量を概略的に示すグラフである。図22に示すように、時刻n-2~n+2において、車両1は相対位置P(n-2)~P(n+2)及び相対姿勢A(n-2)~A(n+2)を有する。この場合、相対位置及び相対姿勢の変化量は図20の場合よりもフレームごとに大きく変動し、その分散も図20の場合より大きくなる。

相対位置及び相対姿勢の変化量がフレームごとに大きく変動するとき、相対位置及び相対姿勢を高精度に計算することは困難であると考えられる。相対位置又は相対姿勢の変化量の分散が大きくなるほど、相対位置及び相対姿勢の信頼度が低下する。また、相対位置又は相対姿勢の変化量の分散が小さくなるほど、相対位置及び相対姿勢の信頼度が増大する。従って、相対位置及び相対姿勢の変化量の分散を用いて、相対位置及び相対姿勢の信頼度を表すことができる。

絶対位置及び絶対姿勢の信頼度は、図15~図17を参照して説明した場合と同様に計算される。

第1の実施形態の第3の変形例によれば、相対位置及び相対姿勢の信頼度としてそれらの分散の変化量を計算し、絶対位置及び絶対姿勢の信頼度としてそれらの推定誤差を計算し、信頼度が高いほうを車両1の位置及び姿勢として決定することができる。

[第1の実施形態の第4の変形例]

図24は、第1の実施形態の第4の変形例に係る測位処理における絶対位置及び絶対姿勢の信頼度の計算を説明する図である。信頼度計算器36は、図15~図17を参照して説明したように絶対位置及び絶対姿勢の推定誤差を計算する際に、撮影装置11によって撮影された画像におけるマーカー4の位置を考慮してもよい。

図24は、第1の実施形態の第4の変形例に係る測位処理における絶対位置及び絶対姿勢の信頼度の計算を説明する図である。信頼度計算器36は、図15~図17を参照して説明したように絶対位置及び絶対姿勢の推定誤差を計算する際に、撮影装置11によって撮影された画像におけるマーカー4の位置を考慮してもよい。

図24を参照すると、撮影装置11によって撮影された画像40において、マーカー4は、画像40の中心P21から距離d21の位置にある。信頼度計算器36は、撮影装置11によって撮影された画像40において、画像40の中心P21からマーカー4までの距離d21が小さくなるほど信頼度が増大するように、また、距離d21が大きくなるほど信頼度が低下するように、絶対位置及び絶対姿勢の信頼度を計算する。この場合、絶対位置及び絶対姿勢の信頼度は、例えば、図15~図17を参照して説明した場合と同様に計算された絶対位置及び絶対姿勢の推定誤差に対して、画像40の中心P21からマーカー4までの距離d21を含む係数を乗算した値によって表される。

画像におけるマーカー4の位置を考慮した絶対位置の推定誤差E2a’及び絶対姿勢の推定誤差E2b’は、次式によって表される。

E2a’=λ×d21×E2a

E2b’=λ×d21×E2b

E2b’=λ×d21×E2b

λは予め決められた定数である。絶対位置の推定誤差E2a及び絶対姿勢の推定誤差E2bは、図15~図17を参照して説明した場合と同様に計算される。

相対位置及び相対姿勢の信頼度は、図11、図18~図23を参照して説明した場合と同様に計算される。

撮影装置11によって撮影された画像におけるマーカー4の位置によっては、撮影装置11の光軸に対して異なる角度の面を有するマーカー4が区別しにくくなることがある。例えば、撮影装置11によって撮影された画像の端部では、撮影装置11の光軸に対して垂直な面を有するマーカー4と、平行な面を有するマーカー4とが区別しにくくなる。

図25は、図1の撮影装置11によって撮影されるマーカー4a-1~4a-12の例示的な配置を示す図である。各マーカー4a-1~4a-12は、0.6m×0.6mの正方形形状を有する。また、各マーカー4a-1~4a-12は、それらの面が撮影装置11の光軸に対して垂直に、すなわち、Xw-Zw平面に対して平行に配置される。図26は、図25のマーカー4a-1~4a-12を撮影装置11によって撮影した画像40の例を示す図である。

図27は、図1の撮影装置11によって撮影されるマーカー4b-1~4b-12の例示的な配置を示す図である。各マーカー4b-1~4b-12は、0.6m×0.6mの正方形形状を有する。また、各マーカー4b-1~4b-12は、それらの面が撮影装置11の光軸に対して平行に、すなわち、Yw-Zw平面に対して平行になるように配置される。図28は、図27のマーカー4b-1~4b-12を撮影装置11によって撮影した画像40の例を示す図である。図28を図26と比較すると、図28のマーカー4b-6は、面の向きが90度異なるにもかかわらず、図26のマーカー4a-1~4a-12のそれぞれとほとんど同じサイズ及び形状に見えることがわかる。

図29は、図1の撮影装置11の光軸に対するマーカー4の面の角度を誤検出したことに起因する、マーカー座標系における撮影装置11の位置の変動を説明する図である。前述のように、図26のマーカー4a-1~4a-12及び図28のマーカー4b-6は、見かけ上、互いに区別することができない。従って、撮影装置11は、図29のマーカー座標系において、「11a」の位置及び姿勢を有するべきところ、「11b」の位置及び姿勢を有すると誤って判断されることがあり、また、その逆の場合もある。撮影装置11の光軸がマーカー4の面の実質的に中心を通りかつマーカー4の面に実質的に直交する場合、当該マーカー4を原点とするマーカー座標系における撮影装置11の位置を決定することは困難であり、当該マーカー4は車両1の絶対位置及び絶対姿勢の計算に不適である。従って、撮影装置11の光軸に対して垂直な面を有するマーカー4(図25のマーカー4-1~4a-12)と、撮影装置11の光軸に対して垂直な面を有するように見えるマーカー4(図27のマーカー4b-6)との信頼性が低いと考えられる。信頼度計算器36は、このようなマーカー4の絶対位置及び絶対姿勢の推定誤差を増大させる。

画像40の中心P21からマーカー4までの距離d21が大きくなるほど(すなわち、画像40においてマーカー4が端部に近づくほど)、絶対位置及び絶対姿勢の推定誤差は増大する(すなわち、絶対位置及び絶対姿勢の信頼度が低下する)。また、距離d21が小さくなるほど(すなわち、画像40においてマーカー4が中心P21に近づくほど)、絶対位置及び絶対姿勢の推定誤差は低下する(すなわち、絶対位置及び絶対姿勢の信頼度が増大する)。従って、画像におけるマーカー4の位置を考慮した絶対位置及び絶対姿勢の推定誤差を用いて、絶対位置及び絶対姿勢の信頼度を表すことができる。

図24の変形例によれば、撮影装置11によって撮影された画像におけるマーカー4の位置を考慮することにより、車両1の位置及び姿勢をより高精度に測定することができる。

[第1の実施形態の第5の変形例]

図30は、第1の実施形態の第5の変形例に係る測位処理における絶対位置及び絶対姿勢の信頼度の計算を説明する図である。信頼度計算器36は、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズを考慮してもよい。

図30は、第1の実施形態の第5の変形例に係る測位処理における絶対位置及び絶対姿勢の信頼度の計算を説明する図である。信頼度計算器36は、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズを考慮してもよい。

信頼度計算器36は、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズが大きくなるほど信頼度が増大するように、また、画像におけるマーカー4の見かけのサイズが小さくなるほど信頼度が低下するように、絶対位置及び絶対姿勢の信頼度を計算してもよい。この場合、絶対位置及び絶対姿勢の信頼度は、例えば、図15~図17、図24~図29を参照して説明した場合と同様に計算された絶対位置及び絶対姿勢の推定誤差に対して、画像におけるマーカー4の見かけのサイズを示す係数を乗算した値によって表される。

図30を参照すると、撮影装置11によって撮影された画像40において、マーカー4aは見かけのサイズd31を有し、マーカー4bは見かけのサイズd32を有する。画像におけるマーカー4a,4bの見かけのサイズは、例えば、縦方向の長さ(画素数)によって表される。画像におけるマーカー4の見かけのサイズは、撮影装置11からマーカー4までの距離に対応する。

絶対位置の推定誤差E2a及び絶対姿勢の推定誤差E2bは、図15~図17、図24~図29を参照して説明した場合と同様に計算される。

相対位置及び相対姿勢の信頼度は、図11、図18~図23を参照して説明した場合と同様に計算される。

画像におけるマーカー4の見かけのサイズが小さくなるほど(すなわち、撮影装置11からマーカー4までの距離が大きくなるほど)、絶対位置及び絶対姿勢の推定誤差は増大する(すなわち、絶対位置及び絶対姿勢の信頼度が低下する)。また、画像におけるマーカー4の見かけのサイズが大きくなるほど(すなわち、撮影装置11からマーカー4までの距離が小さくなるほど)、絶対位置及び絶対姿勢の推定誤差は低下する(すなわち、絶対位置及び絶対姿勢の信頼度が増大する)。従って、画像におけるマーカー4の見かけのサイズを考慮した絶対位置及び絶対姿勢の推定誤差を用いて、絶対位置及び絶対姿勢の信頼度を表すことができる。

追加又は代替として、位置及び姿勢決定器37は、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズが予め決められた閾値よりも小さいとき、常に、相対位置及び相対姿勢を車両1の位置及び姿勢として決定してもよい。言いかえると、画像におけるマーカー4の見かけのサイズが閾値よりも小さいとき、絶対位置及び絶対姿勢の信頼度が最低値になる。画像におけるマーカー4の見かけのサイズの閾値は、例えば、縦方向において7画素に設定される。

図30の変形例によれば、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズを考慮することにより、車両1の位置及び姿勢をより高精度に測定することができる。

[第1の実施形態の他の変形例]

撮影装置11は、被写体の画像を生成するとともに、撮影装置11から被写体の各点までの距離を検出するように構成されてもよい。撮影装置11は、被写体までの距離を検出するため、例えば、RGB-Dカメラなどのデプスセンサ、又はToF(Time of Flight)センサを含んでもよい。それに代わって、撮影装置11は、被写体までの距離を検出するため、所定距離だけ互いに離れた配置された2つのカメラを含むステレオカメラであってもよい。

撮影装置11は、被写体の画像を生成するとともに、撮影装置11から被写体の各点までの距離を検出するように構成されてもよい。撮影装置11は、被写体までの距離を検出するため、例えば、RGB-Dカメラなどのデプスセンサ、又はToF(Time of Flight)センサを含んでもよい。それに代わって、撮影装置11は、被写体までの距離を検出するため、所定距離だけ互いに離れた配置された2つのカメラを含むステレオカメラであってもよい。

撮影装置11が距離を検出する場合、相対位置計算器32は、公知のICP(iterative closest point)アルゴリズムなどを用いて、車両1の相対位置及び相対姿勢を計算してもよい。

図9の相対位置計算処理では、FAST及びKLTトラッカーを用いる例を説明したが、他の方法を用いてもよい。例えば、画像処理で一般的であるSIFT(Scale Invariant Feature Transform)又はORB(Oriented FAST and Rotated BRIEF)を用いた特徴点検出処理及び特徴点マッチング処理などを用いてもよい。

マーカー4が通路101の直線区間の中間に配置されている場合、絶対位置及び絶対姿勢を高精度に計算できると期待される。一方、マーカー4が通路101の交差点又は出入口の付近に配置されている場合、車両1はマーカー4の近傍を直進するとは限らず、計算された絶対位置及び絶対姿勢の誤差が大きくなる可能性がある。従って、複数のマーカー4のうちの一部は、絶対位置及び絶対姿勢を計算するために(すなわち、位置及び姿勢を補正するために)使用されない補助マーカーであってもよい。補助マーカーは、例えば、車両1の出発地、目的地、又は他のチェックポイントとなりうる何らかの構造物(倉庫100の出入口、通路101の交差点、特定の棚102、など)の近傍に配置される。補助マーカーは、車両1から撮影可能であるならば、通路101に沿って配置されなくてもよい。測位装置12は、補助マーカーを検出することにより、車両1が特定のチェックポイントに到達したことを認識することができる。この場合、記憶装置35に格納されたマーカー情報のテーブルは、各マーカー4が補助マーカーであるか否かを示す項目をさらに含む。また、この場合、マーカー情報のテーブルは、補助マーカーについては、その位置及び姿勢の情報をもたなくてもよい。また、マーカー情報のテーブルは、各マーカー4が補助マーカーであるか否かを示す項目に代えて、当該マーカー4に基づいて計算される絶対位置及び絶対姿勢の信頼度を示す項目を含んでもよい。

車両1及びサーバ装置2は、通信装置13、22に代えて、SDカードなど、着脱可能な記憶媒体を用いてもよい。車両において計算した当該車両の位置及び姿勢を記憶媒体に書き込み、サーバ装置2において、この記憶媒体から車両の位置及び姿勢を読み出してもよい。

車両1は、フォークリフトに代えて、例えばトラック又は牽引車など、有人の乗物であってもよい。また、車両1は、例えば無人搬送車(AGV)又はパレット搬送ロボットなど、無人の荷物運搬装置であってもよい。この場合、車両1は、サーバ装置2の制御下で駆動機構15を制御して移動する。また、車両1は、手押し台車など、駆動機構を持たない人力の車両であってもよい。

測位装置12は、車両1に代えて、サーバ装置2に設けられてもよい。この場合、撮影装置11によって撮影された画像は、通信装置13(又は着脱可能な記憶媒体)によって車両1からサーバ装置2に送られる。サーバ装置2の測位装置12は、車両1から取得された画像に基づいて、図2の測位装置12と同様に、車両1の位置及び姿勢を計算する。

[第1の実施形態の効果等]

第1の実施形態によれば、測位装置12は、相対位置計算器32と、記憶装置35と、絶対位置計算器34と、信頼度計算器36と、位置及び姿勢決定器37とを備える。相対位置計算器32は、車両1に搭載された撮影装置11によって撮影された複数の画像に基づいて、所定の基準位置及び基準姿勢に対する車両1の相対位置及び相対姿勢を示す車両1の相対位置及び相対姿勢を計算する。記憶装置35は、予め決められた位置に配置されて視覚的に識別可能な複数のマーカー4の識別子、位置、及び姿勢の情報と、車両1のための通路を含むマップの情報とを格納する。絶対位置計算器34は、撮影装置11によって撮影された画像から複数のマーカー4のうちの1つを抽出し、抽出された1つのマーカー4の位置及び姿勢に基づいて、マップにおける車両1の位置及び姿勢を示す車両1の絶対位置及び絶対姿勢を計算する。信頼度計算器36は、相対位置計算器32によって計算された相対位置及び相対姿勢の信頼度と、絶対位置計算器34によって計算された絶対位置及び絶対姿勢の信頼度とを計算する。位置及び姿勢決定器37は、相対位置及び相対姿勢の信頼度が絶対位置及び絶対姿勢の信頼度以上であるとき、相対位置及び相対姿勢を車両1の位置及び姿勢として決定し、相対位置及び相対姿勢の信頼度が絶対位置及び絶対姿勢の信頼度より小さいとき、絶対位置及び絶対姿勢を車両1の位置及び姿勢として決定する。

第1の実施形態によれば、測位装置12は、相対位置計算器32と、記憶装置35と、絶対位置計算器34と、信頼度計算器36と、位置及び姿勢決定器37とを備える。相対位置計算器32は、車両1に搭載された撮影装置11によって撮影された複数の画像に基づいて、所定の基準位置及び基準姿勢に対する車両1の相対位置及び相対姿勢を示す車両1の相対位置及び相対姿勢を計算する。記憶装置35は、予め決められた位置に配置されて視覚的に識別可能な複数のマーカー4の識別子、位置、及び姿勢の情報と、車両1のための通路を含むマップの情報とを格納する。絶対位置計算器34は、撮影装置11によって撮影された画像から複数のマーカー4のうちの1つを抽出し、抽出された1つのマーカー4の位置及び姿勢に基づいて、マップにおける車両1の位置及び姿勢を示す車両1の絶対位置及び絶対姿勢を計算する。信頼度計算器36は、相対位置計算器32によって計算された相対位置及び相対姿勢の信頼度と、絶対位置計算器34によって計算された絶対位置及び絶対姿勢の信頼度とを計算する。位置及び姿勢決定器37は、相対位置及び相対姿勢の信頼度が絶対位置及び絶対姿勢の信頼度以上であるとき、相対位置及び相対姿勢を車両1の位置及び姿勢として決定し、相対位置及び相対姿勢の信頼度が絶対位置及び絶対姿勢の信頼度より小さいとき、絶対位置及び絶対姿勢を車両1の位置及び姿勢として決定する。

これにより、相対位置及び相対姿勢の信頼度と、絶対位置及び絶対姿勢の信頼度とを計算し、信頼度が高いほうを車両1の位置及び姿勢として決定することにより、車両1の位置及び姿勢を高精度に測定することができる。

第1の実施形態によれば、信頼度計算器36は、車両1の基準位置及び基準姿勢からの移動距離及び回転角度が小さくなるほど信頼度が増大するように相対位置及び相対姿勢の信頼度を計算してもよい。位置及び姿勢決定器37が絶対位置及び絶対姿勢を車両1の位置及び姿勢として決定したとき、信頼度計算器36は基準位置及び基準姿勢をリセットする。

これにより、車両1の移動距離及び回転角度に基づいて、相対位置及び相対姿勢の誤差を計算することができる。

第1の実施形態によれば、信頼度計算器36は、絶対位置及び絶対姿勢に対する相対位置及び相対姿勢の差が小さくなるほど信頼度が増大するように相対位置及び相対姿勢の信頼度を計算してもよい。

これにより、絶対位置及び絶対姿勢に対する相対位置及び相対姿勢の差に基づいて、相対位置及び相対姿勢の誤差を計算することができる。

第1の実施形態によれば、相対位置計算器32は、時間的に隣接した複数の画像においてトラッキングされた特徴点に基づいて相対位置及び相対姿勢を計算してもよい。信頼度計算器36は、時間的に隣接した複数の画像においてトラッキングに成功した特徴点の個数に基づいてトラッキングの信頼度を計算し、トラッキングの信頼度が高くなるほど相対位置及び相対姿勢の信頼度が増大するように相対位置及び相対姿勢の信頼度を計算してもよい。

これにより、トラッキングの信頼度に基づいて、相対位置及び相対姿勢の誤差を計算することができる。

第1の実施形態によれば、信頼度計算器36は、相対位置又は相対姿勢の変化量の分散が小さくなるほど信頼度が増大するように相対位置及び相対姿勢の信頼度を計算してもよい。

これにより、相対位置又は相対姿勢の変化量の分散に基づいて、相対位置及び相対姿勢の誤差を計算することができる。

第1の実施形態によれば、信頼度計算器36は、撮影装置11によって撮影された画像において、画像の中心からマーカー4までの距離が小さくなるほど信頼度が増大するように絶対位置及び絶対姿勢の信頼度を計算してもよい。

これにより、撮影装置11によって撮影された画像におけるマーカー4の位置を考慮して、絶対位置及び絶対姿勢の誤差を計算することができる。

第1の実施形態によれば、信頼度計算器36は、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズが大きくなるほど信頼度が増大するように絶対位置及び絶対姿勢の信頼度を計算してもよい。

これにより、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズに基づいて、絶対位置及び絶対姿勢の誤差を計算することができる。

第1の実施形態によれば、位置及び姿勢決定器37は、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズが予め決められた閾値よりも小さいとき、相対位置及び相対姿勢を車両1の位置及び姿勢として決定してもよい。

これにより、撮影装置11によって撮影された画像におけるマーカー4の見かけのサイズを考慮して、絶対位置及び絶対姿勢の誤差を計算することができる。

[第2の実施形態]

図31を参照して、第2の実施形態に係る測位装置及びそれを備えた移動体について説明する。

図31を参照して、第2の実施形態に係る測位装置及びそれを備えた移動体について説明する。

[第2の実施形態の構成]

図31は、第2の実施形態に係る測位装置12Bの構成を示すブロック図である。第1の実施形態に係る車両1は、図3の測位装置12に代えて、測位装置12Bを備えてもよい。測位装置12Bは、図3の測位装置12の各構成要素に加えて、画像認識器38及びデータ合成器39を備える。

図31は、第2の実施形態に係る測位装置12Bの構成を示すブロック図である。第1の実施形態に係る車両1は、図3の測位装置12に代えて、測位装置12Bを備えてもよい。測位装置12Bは、図3の測位装置12の各構成要素に加えて、画像認識器38及びデータ合成器39を備える。

画像認識器38は、撮影装置11によって撮影された画像から予め決められた対象物を認識する。画像認識器38は人物(例えば、車両1の運転手、車両1の周りの人物)を認識してもよい。画像認識器38は、予め学習された特定の荷物3を認識してもよい。画像処理器31、画像認識器33、及び画像認識器38は、同一の撮影装置11から画像を取得してもよい。それに代わって、画像認識器38は、画像処理器31及び画像認識器33に供給される画像(すなわち、車両1の位置及び姿勢を測定するための画像)を撮影する撮影装置11とは異なる撮影装置を用いて、人物及び/又は荷物3を含む画像を撮影してもよい。この場合、撮影装置11は、例えば、車両1の前方の通路101を撮影するように設けられ、他の撮影装置は、例えば、車両1の運転席手又は荷台を撮影するように設けられてもよい。撮影装置11と他の撮影装置とは、予め互いに同期される。

データ合成器39は、位置及び姿勢決定器37から、位置及び姿勢決定器37によって決定された車両1の位置及び姿勢のデータを、当該位置及び姿勢に対応する画像を撮影装置11により撮影した時刻(又は、当該位置及び姿勢を計算した時刻)のタイムスタンプとともに取得する。データ合成器39は、画像認識器38によって認識された対象物の画像認識データを、車両1の位置及び姿勢のデータに合成する。また、データ合成器39は、車両1に搭載された1つ又は複数のセンサを含むセンサ群16Bによって生成されたセンサデータを取得し、センサデータを、車両1の位置及び姿勢のデータに合成する。データ合成器39は、車両1の加速度及び角速度の少なくとも一方を含むセンサデータを取得してもよい。また、データ合成器39は、車両1によって搬送される荷物3の重さを含むセンサデータを取得してもよい。センサ群16Bの各センサは、センサデータに、当該センサデータを取得した時刻のタイムスタンプを付与する。データ合成器39は、車両1の位置及び姿勢のデータのタイムスタンプと、画像認識データのタイムスタンプと、センサデータのタイムスタンプとに基づいて、これらのデータを互いに同期させて合成する。

データ合成器39は、これらのデータのタイムスタンプが互いに不一致しているとき、画像認識データ又はセンサデータを、それに最も近接したタイムスタンプを有する車両1の位置及び姿勢のデータに関連付けてもよい。また、データ合成器39は、これらのデータのタイムスタンプが互いに不一致しているとき、線形補間又は内分などを用いて車両1の位置及び姿勢のデータを補間し、画像認識データ又はセンサデータを、それに対応するタイムスタンプを有する補間された車両1の位置及び姿勢のデータに関連付けてもよい。

データ合成器39を備えたことにより、車両1の作業に関連するさまざまなデータを、車両1の位置及び軌跡に関連付けて記録することができる。例えば、画像認識された人物を記録することにより、車両1の作業に関連する人物を追跡することができる。画像認識された荷物3を記録することにより、車両1によって搬送される荷物3を追跡することができる。車両1の加速度及び角速度を記録することにより、倉庫の路面の凹凸などを検出することができる。荷物3の重さを記録することにより、車両1の仕事量をモニタリングすることができる。

[第2の実施形態の効果等]

第2の実施形態によれば、車両1に搭載された1つ又は複数のセンサによって生成されたセンサデータを取得し、センサデータを、位置及び姿勢決定器37によって決定された車両1の位置及び姿勢のデータに合成するデータ合成器39をさらに備えてもよい。

第2の実施形態によれば、車両1に搭載された1つ又は複数のセンサによって生成されたセンサデータを取得し、センサデータを、位置及び姿勢決定器37によって決定された車両1の位置及び姿勢のデータに合成するデータ合成器39をさらに備えてもよい。

第2の実施形態によれば、データ合成器39は、車両1の加速度及び角速度の少なくとも一方を含むセンサデータを取得してもよい。

第2の実施形態によれば、データ合成器39は、車両1によって搬送される荷物3の重さを含むセンサデータを取得してもよい。

第2の実施形態によれば、測位装置12Bは、撮影装置11によって撮影された画像から予め決められた対象物を認識する画像認識器38をさらに備えてもよい。この場合、データ合成器39は、画像認識器38によって認識された対象物の情報を、位置及び姿勢決定器37によって決定された車両1の位置及び姿勢のデータに合成する。

第2の実施形態によれば、画像認識器38は人物を認識してもよい。

第2の実施形態によれば、画像認識器38は、予め学習された特定の荷物3を認識してもよい。

第2の実施形態によれば、車両1の作業に関連するさまざまなデータを、車両1の位置及び軌跡に関連付けて記録することができる。

第2の実施形態によれば、車両1は、車両1の位置及び姿勢を測定するための画像を撮影する撮影装置11と、他の対象物を撮影する他の撮影装置とを備えてもよい。この場合、データ合成器39は、撮影装置11によって撮影された画像に基づいて生成された車両1の位置及び姿勢のデータと、他の撮影装置によって撮影された画像に基づいて生成された画像認識データとを、互いに関連付けることができる。車両1の位置及び姿勢のデータと、車両1の移動中に撮影された他の対象物の画像認識データとが関連付けられていると、マップにおける車両1の位置及び軌跡に基づいて業務分析を行う際に非常に有用である。例えば、ある人物の不審な行動を目視等で検出したとき、その人物の位置をマップにおいて参照することで、その位置の近傍において、及び/又は、その人物に関連して、過去に撮影された画像又は映像を検索して読み出すことができる。

[他の実施形態]

なお、各実施形態において、測位装置は、フォークリフト又はトラックなどの四輪の車両に設けられてもよく、1~3輪、5輪以上の車両に設けられてもよい。また、各実施形態において、測位装置は、車輪の個数及び/又は車輪の有無と関係なく、飛行機、ヘリコプタ、ドローン、ホバークラフトなど、車輪のない移動体に設けられてもよい。本実施形態に係る測位装置は、車輪の回転数から移動体の位置を推定するのでなく、撮影装置によって撮影された画像に基づいて移動体の位置を推定することができる。

なお、各実施形態において、測位装置は、フォークリフト又はトラックなどの四輪の車両に設けられてもよく、1~3輪、5輪以上の車両に設けられてもよい。また、各実施形態において、測位装置は、車輪の個数及び/又は車輪の有無と関係なく、飛行機、ヘリコプタ、ドローン、ホバークラフトなど、車輪のない移動体に設けられてもよい。本実施形態に係る測位装置は、車輪の回転数から移動体の位置を推定するのでなく、撮影装置によって撮影された画像に基づいて移動体の位置を推定することができる。

本開示の各態様に係る測位装置によれば、倉庫又は工場などにおいて移動体の位置を測定することができる。これにより、移動体の軌跡(動線)を追跡すること、移動体をルーティングすること、倉庫又は工場における荷物などの配置を最適化すること、稼働率をモニタリングすること、作業効率を改善すること、などが可能である。

1 車両

1a 荷台

1b 昇降機構

1c コンソール

2 サーバ装置

3 荷物

4 マーカー

11 撮影装置

12,12B 測位装置

13 通信装置

14 表示装置

15 駆動機構

16B センサ群

21 処理装置

22 通信装置

23 入力装置

24 記憶装置

25 表示装置

31 画像処理器(特徴点)

32 相対位置計算器

33 画像認識器(マーカー)

34 絶対位置計算器

35 記憶装置

36 信頼度計算器

37 位置及び姿勢決定器

38 画像認識器(人物荷物)

39 データ合成器

40 画像

41 特徴点

100 倉庫

101 通路

102 棚

1a 荷台

1b 昇降機構

1c コンソール

2 サーバ装置

3 荷物

4 マーカー

11 撮影装置

12,12B 測位装置

13 通信装置

14 表示装置

15 駆動機構

16B センサ群

21 処理装置

22 通信装置

23 入力装置

24 記憶装置

25 表示装置

31 画像処理器(特徴点)

32 相対位置計算器

33 画像認識器(マーカー)

34 絶対位置計算器

35 記憶装置

36 信頼度計算器

37 位置及び姿勢決定器

38 画像認識器(人物荷物)

39 データ合成器

40 画像

41 特徴点

100 倉庫

101 通路

102 棚

Claims (15)

- 移動体に搭載された撮影装置によって撮影された複数の画像に基づいて、所定の基準位置及び基準姿勢に対する前記移動体の相対位置及び相対姿勢を示す前記移動体の第1の位置及び第1の姿勢を計算する第1の計算器と、

予め決められた位置に配置されて視覚的に識別可能な複数のマーカーの識別子、位置、及び姿勢の情報と、前記移動体のための通路を含むマップの情報とを格納する記憶装置と、

前記撮影装置によって撮影された画像から前記複数のマーカーのうちの1つを抽出し、抽出された前記1つのマーカーの位置及び姿勢に基づいて、前記マップにおける前記移動体の位置及び姿勢を示す前記移動体の第2の位置及び第2の姿勢を計算する第2の計算器と、

前記第1の計算器によって計算された前記第1の位置及び前記第1の姿勢の信頼度を示す第1の信頼度と、前記第2の計算器によって計算された前記第2の位置及び前記第2の姿勢の信頼度を示す第2の信頼度とを計算する信頼度計算器と、

前記第1の信頼度が前記第2の信頼度以上であるとき、前記第1の位置及び前記第1の姿勢を前記移動体の位置及び姿勢として決定し、前記第1の信頼度が前記第2の信頼度より小さいとき、前記第2の位置及び前記第2の姿勢を前記移動体の位置及び姿勢として決定する位置及び姿勢決定器とを備えた、

測位装置。 - 前記信頼度計算器は、前記移動体の基準位置及び基準姿勢からの移動距離及び回転角度が小さくなるほど前記第1の信頼度が増大するように前記第1の信頼度を計算し、

前記位置及び姿勢決定器が前記第2の位置及び前記第2の姿勢を前記移動体の位置及び姿勢として決定したとき、前記信頼度計算器は前記基準位置及び前記基準姿勢をリセットする、

請求項1記載の測位装置。 - 前記信頼度計算器は、前記第2の位置及び前記第2の姿勢に対する前記第1の位置及び前記第1の姿勢の差が小さくなるほど前記第1の信頼度が増大するように前記第1の信頼度を計算する、

請求項1記載の測位装置。 - 前記第1の計算器は、時間的に隣接した複数の画像においてトラッキングされた特徴点に基づいて前記第1の位置及び前記第1の姿勢を計算し、

前記信頼度計算器は、時間的に隣接した複数の画像においてトラッキングに成功した特徴点の個数に基づいてトラッキングの信頼度を計算し、前記トラッキングの信頼度が高くなるほど前記第1の信頼度が増大するように前記第1の信頼度を計算する、

請求項2又は3記載の測位装置。 - 前記信頼度計算器は、前記第1の位置又は前記第1の姿勢の変化量の分散が小さくなるほど前記第1の信頼度が増大するように前記第1の信頼度を計算する、

請求項1記載の測位装置。 - 前記信頼度計算器は、前記撮影装置によって撮影された画像において、前記画像の中心から前記マーカーまでの距離が小さくなるほど前記第2の信頼度が増大するように前記第2の信頼度を計算する、

請求項1~5のうちの1つに記載の測位装置。 - 前記信頼度計算器は、前記撮影装置によって撮影された画像における前記マーカーの見かけのサイズが大きくなるほど前記第2の信頼度が増大するように前記第2の信頼度を計算する、

請求項1~6のうちの1つに記載の測位装置。 - 前記位置及び姿勢決定器は、前記撮影装置によって撮影された画像における前記マーカーの見かけのサイズが予め決められた閾値よりも小さいとき、前記第1の位置及び前記第1の姿勢を前記移動体の位置及び姿勢として決定する、

請求項1~7のうちの1つに記載の測位装置。 - 前記移動体に搭載された1つ又は複数のセンサによって生成されたセンサデータを取得し、前記センサデータを、前記位置及び姿勢決定器によって決定された前記移動体の位置及び姿勢のデータに合成するデータ合成器をさらに備えた、

請求項1~8のうちの1つに記載の測位装置。 - 前記データ合成器は、前記移動体の加速度及び角速度の少なくとも一方を含むセンサデータを取得する、

請求項9記載の測位装置。 - 前記データ合成器は、前記移動体によって搬送される荷物の重さを含むセンサデータを取得する、

請求項9又は10記載の測位装置。 - 前記測位装置は、前記撮影装置によって撮影された画像から予め決められた対象物を認識する画像認識器をさらに備え、

前記データ合成器は、前記画像認識器によって認識された対象物の情報を、前記位置及び姿勢決定器によって決定された前記移動体の位置及び姿勢のデータに合成する、

請求項9~11のうちの1つに記載の測位装置。 - 前記画像認識器は人物を認識する、

請求項12記載の測位装置。 - 前記画像認識器は、予め学習された特定の荷物を認識する、

請求項12記載の測位装置。 - 撮影装置と、

請求項1~14のうちの1つに記載の測位装置とを備えた、

移動体。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2020019935 | 2020-02-07 | ||

| JP2020019935 | 2020-02-07 | ||

| PCT/JP2020/036114 WO2021157123A1 (ja) | 2020-02-07 | 2020-09-24 | 測位装置及び移動体 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JPWO2021157123A1 JPWO2021157123A1 (ja) | 2021-08-12 |

| JP7599136B2 true JP7599136B2 (ja) | 2024-12-13 |

Family

ID=77199822

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2021575605A Active JP7599136B2 (ja) | 2020-02-07 | 2020-09-24 | 測位装置及び移動体 |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US12475593B2 (ja) |

| JP (1) | JP7599136B2 (ja) |

| WO (1) | WO2021157123A1 (ja) |

Families Citing this family (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2022012173A (ja) * | 2020-07-01 | 2022-01-17 | ソニーグループ株式会社 | 情報処理装置、情報処理システム、および情報処理方法、並びにプログラム |

| JP2023042704A (ja) * | 2021-09-15 | 2023-03-28 | ユーピーアール株式会社 | 飛行体制御システム |

| CN114964445B (zh) * | 2022-05-23 | 2023-05-02 | 西安交通大学 | 基于车辆识别的多模块动态称重方法 |

| US12311956B2 (en) * | 2022-05-27 | 2025-05-27 | Curtis Instruments, Inc. | Grade severity detection |

| CN116611763B (zh) * | 2023-04-25 | 2023-12-15 | 亳州神农谷中药控股有限公司 | 一种仓库货物定位查找系统 |

| WO2025004188A1 (ja) * | 2023-06-27 | 2025-01-02 | 日本電気株式会社 | 移動体制御装置、移動体制御方法、及び非一時的なコンピュータ可読媒体 |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2019130931A1 (ja) | 2017-12-26 | 2019-07-04 | パナソニックIpマネジメント株式会社 | 測位装置及び車両 |

| WO2019138836A1 (ja) | 2018-01-12 | 2019-07-18 | キヤノン株式会社 | 情報処理装置、情報処理システム、情報処理方法およびプログラム |

| WO2020137312A1 (ja) | 2018-12-28 | 2020-07-02 | パナソニックIpマネジメント株式会社 | 測位装置及び移動体 |

Family Cites Families (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US7386372B2 (en) * | 1995-06-07 | 2008-06-10 | Automotive Technologies International, Inc. | Apparatus and method for determining presence of objects in a vehicle |

| JPH1069219A (ja) * | 1996-08-28 | 1998-03-10 | Honda Motor Co Ltd | 自動走行路および自動走行システム |

| JP2011219229A (ja) | 2010-04-12 | 2011-11-04 | Hitachi Ltd | 荷物所在管理装置 |

| WO2015049717A1 (ja) * | 2013-10-01 | 2015-04-09 | 株式会社日立製作所 | 移動体位置推定装置および移動体位置推定方法 |

| JP2017207942A (ja) | 2016-05-19 | 2017-11-24 | 株式会社リコー | 画像処理装置、自己位置推定方法、及び、プログラム |

| CN107481284A (zh) * | 2017-08-25 | 2017-12-15 | 京东方科技集团股份有限公司 | 目标物跟踪轨迹精度测量的方法、装置、终端及系统 |

| EP3534333B1 (en) * | 2018-02-28 | 2025-12-17 | Aptiv Technologies AG | Method for calibrating the position and orientation of a camera relative to a calibration pattern |

| US20210405654A1 (en) * | 2018-03-22 | 2021-12-30 | Infinium Robotics Pte Ltd | Autonomous taking off, positioning and landing of unmanned aerial vehicles (uav) on a mobile platform |

-

2020

- 2020-09-24 WO PCT/JP2020/036114 patent/WO2021157123A1/ja not_active Ceased

- 2020-09-24 JP JP2021575605A patent/JP7599136B2/ja active Active

-

2022

- 2022-07-29 US US17/877,008 patent/US12475593B2/en active Active

Patent Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2019130931A1 (ja) | 2017-12-26 | 2019-07-04 | パナソニックIpマネジメント株式会社 | 測位装置及び車両 |

| WO2019138836A1 (ja) | 2018-01-12 | 2019-07-18 | キヤノン株式会社 | 情報処理装置、情報処理システム、情報処理方法およびプログラム |

| WO2020137312A1 (ja) | 2018-12-28 | 2020-07-02 | パナソニックIpマネジメント株式会社 | 測位装置及び移動体 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20220366599A1 (en) | 2022-11-17 |

| US12475593B2 (en) | 2025-11-18 |

| WO2021157123A1 (ja) | 2021-08-12 |

| JPWO2021157123A1 (ja) | 2021-08-12 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP7599136B2 (ja) | 測位装置及び移動体 | |

| US12203757B2 (en) | Positioning apparatus capable of measuring position of moving body using image capturing apparatus | |

| JP7482453B2 (ja) | 測位装置及び移動体 | |

| JP7689308B2 (ja) | 測位システム | |

| US12475592B2 (en) | Positioning apparatus capable of measuring position of moving body using image capturing apparatus | |

| US8744169B2 (en) | Voting strategy for visual ego-motion from stereo | |

| Nair et al. | Moving obstacle detection from a navigating robot | |

| WO2021004483A1 (zh) | 一种导航方法、移动载体及导航系统 | |

| CN112740274A (zh) | 在机器人设备上使用光流传感器进行vslam比例估计的系统和方法 | |

| JP7486095B2 (ja) | 車両監視方法、車両監視装置、車両、及び車両監視システム | |

| WO2019130931A1 (ja) | 測位装置及び車両 | |

| US11715229B2 (en) | Moving body and system | |

| Fiala et al. | Visual odometry using 3-dimensional video input | |

| Tsukiyama | Global navigation system with RFID tags | |

| JP7657689B2 (ja) | 処理システム、制御システム、移動体、撮影位置決定方法及び撮影位置決定プログラム | |

| Bonin-Font et al. | Concurrent visual navigation and localisation using inverse perspective transformation | |

| Drulea et al. | An omnidirectional stereo system for logistic plants. Part 1: calibration and multi-channel rectification |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20230804 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20241029 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20241121 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7599136 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |