JP7173317B2 - 動作規則決定装置、動作規則決定方法およびプログラム - Google Patents

動作規則決定装置、動作規則決定方法およびプログラム Download PDFInfo

- Publication number

- JP7173317B2 JP7173317B2 JP2021519989A JP2021519989A JP7173317B2 JP 7173317 B2 JP7173317 B2 JP 7173317B2 JP 2021519989 A JP2021519989 A JP 2021519989A JP 2021519989 A JP2021519989 A JP 2021519989A JP 7173317 B2 JP7173317 B2 JP 7173317B2

- Authority

- JP

- Japan

- Prior art keywords

- degree

- state

- risk

- rule determination

- controlled object

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B13/00—Adaptive control systems, i.e. systems automatically adjusting themselves to have a performance which is optimum according to some preassigned criterion

- G05B13/02—Adaptive control systems, i.e. systems automatically adjusting themselves to have a performance which is optimum according to some preassigned criterion electric

- G05B13/0265—Adaptive control systems, i.e. systems automatically adjusting themselves to have a performance which is optimum according to some preassigned criterion electric the criterion being a learning criterion

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B15/00—Systems controlled by a computer

- G05B15/02—Systems controlled by a computer electric

-

- G—PHYSICS

- G08—SIGNALLING

- G08B—SIGNALLING OR CALLING SYSTEMS; ORDER TELEGRAPHS; ALARM SYSTEMS

- G08B31/00—Predictive alarm systems characterised by extrapolation or other computation using updated historic data

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/16—Anti-collision systems

Description

図1は、第1実施形態に係る動作規則決定装置の機能構成の例を示す概略ブロック図である。図1に示す構成で、動作規則決定装置100は、通信部110と、記憶部180と、制御部190とを備える。記憶部180は、プランナーパラメータ記憶部181と、相互作用履歴記憶部182と、環境パラメータセット記憶部183とを備える。制御部190は、プランナー部191と、プランナーパラメータ設定部192と、リスク考慮型履歴生成部193と、パラメトリック環境実行部194と、環境パラメータ選択部195とを備える。

環境または制御対象から取得可能な情報を状態と称する。ここでいう状態は、強化学習でいうところの状態である。状態の例として、センサによる測定値、および、制御対象の位置を挙げることができるが、これらに限定されない。

状態を動作規則に適用して求まる動作を動作プランまたは単にプランとも称する。また、動作を求める処理をプランニングと称する。プランニングを行う主体をプランナーと称する。

動作規則決定装置100がシミュレーションに用いるモデルは、状態以外のパラメータを含む。このパラメータを環境パラメータと称する。環境パラメータの値は、制御対象に影響を及ぼし得る。

動作規則決定装置100は、環境パラメータセットが示す確率に従って、環境パラメータセットが示す環境パラメータの値をサンプリングし、サンプリングした値をシミュレーションのモデルの環境パラメータに設定し、設定した環境パラメータに従い制御対象の動作等のシミュレーションを行う。動作規則決定装置100は、該シミュレーションによって、たとえば、動作後の制御対象の状態を取得する。

初期状態から所定の終了条件が成立するまでのターンの繰り返しを1エピソードと称する。すなわち、エピソードは、制御対象に対する一連の動作を表しているということもできる。

なお、動作規則決定装置100が、報酬に代えてペナルティを用いて強化学習を行うようにしてもよい。報酬は、たとえば、制御対象の状態が所望状態である場合(または、所望状態に近付いている場合)に、正の値によって表現されていてもよい。また、ペナルティは、制御対象の状態が所望状態でない場合(または、所望状態から遠ざかっている場合)に、負の値によって表現されていてもよい。この場合に、報酬、および、ペナルティは、それぞれ、正、および、負の値を用いて表すことができる。以降の説明では、報酬と、ペナルティとを総称して「報酬」と表現することもある。

動作規則決定装置100の実運用とは、強化学習の終了後に、強化学習で得られた動作規則に基づいて、制御対象の動作を算出することである。動作規則決定装置100が、制御対象の動作を直接制御するようにしてもよい。あるいはプラントの運転員など制御対象を制御する担当者がいる場合、動作規則決定装置100が、算出した動作を制御の担当者に提案するようにしてもよい。または、プラントが自動制御されている場合に、動作規則決定装置100は、プラントを制御している制御装置に対して、制御対象の動作を指示してもよい。

プランナーパラメータ記憶部181は、プランナーパラメータを記憶する。

相互作用履歴記憶部182は、相互作用履歴情報を記憶する。

環境パラメータセット記憶部183は、環境パラメータセットを記憶する。

プランナー部191は、プランニングを行う。すなわち、プランナー部191は、制御対象の動作を状態に応じて決定するための動作規則に状態を適用して動作を決定する。

プランナーパラメータ設定部192は、リスク考慮型履歴情報に基づいてプランナーパラメータの値を決定する。

パラメトリック環境実行部194は、上述したシミュレーションを実行する。

環境パラメータ選択部195は、環境パラメータセットから、環境パラメータセットに示される確率に従って、環境パラメータの値をサンプリングする。

パラメトリック環境実行部194は、環境実行部の例に該当する。

図2の例で、環境パラメータセット記憶部183は、環境パラメータセットPを記憶している。環境パラメータセットPは、環境パラメータpが取り得る値の確率分布を示す。すなわち、環境パラメータセットPは、環境パラメータpが取り得る値と、環境パラメータpがその値をとり得る確率とを示す。

環境パラメータセットPは、例えば動作規則決定装置100のユーザによって与えられるなどにより、予め環境パラメータセット記憶部183が記憶しておく。

パラメトリック環境実行部194は、環境のシミュレーションを行う。パラメトリック環境実行部194は、環境パラメータ選択部195がサンプリングした環境パラメータpの値をシミュレーションモデルに適用して、制御対象の動作等についてのシミュレーションを行う。環境パラメータ選択部195は、シミュレーションにて、プランナー部191が出力する動作at,mに対する状態st,mと、これら動作at,mおよび状態st,mに基づく報酬rt,mとを算出する。mは、1つのエピソードを表す識別子である。tは、1つのタイミングを表す識別子である。また、「t,m」は、第mエピソードの第tタイミングを表す識別子である。

リスク考慮型履歴生成部193は、たとえば、相互作用履歴記憶部182から1つのエピソードにおける状態の望ましさの程度を読み取り、読み取った程度を累積した程度を表す累積程度を算出する。リスク考慮型履歴生成部193は、累積程度が条件を満たした場合に、その程度情報における一連の動作後における状態に関連付けされた程度を減じる。リスク考慮型履歴生成部193は、累積程度が条件を満たした場合に、一連の動作後を表す相互作用履歴情報における状態の望ましさの程度(報酬)を減じる。このような処理によって、リスク考慮型履歴生成部193は、読み出した相互作用履歴情報にリスクを反映する。

リスク考慮型履歴生成部193は、生成したリスク考慮型履歴情報をプランナーパラメータ設定部192へ出力する。

図3は、動作規則決定装置100がプランを決定する処理手順の例を示すフローチャートである。

図3の処理で、環境パラメータ選択部195は、環境パラメータセット記憶部183が記憶する環境パラメータセットから確率的に環境パラメータをサンプリングする(ステップS11)。環境パラメータ選択部195は、サンプリングした環境パラメータをパラメトリック環境実行部194へ送信する。

具体的には、プランナー部191が制御対象の動作を決定し、パラメトリック環境実行部194は、環境パラメータに応じた環境での動作に対する状態を算出する。パラメトリック環境実行部194は、たとえば、パラメータ値に従い制御対象の動作をシミュレーションすることによって、動作後における制御対象の状態を算出してもよい。また、パラメトリック環境実行部194は、得られた状態に基づいて報酬を算出する。

プランナー部191は、動作と状態と報酬との組み合わせの履歴を相互作用履歴情報として相互作用履歴記憶部182に格納する。

そして、動作規則決定装置100は、所定の終了条件が成立しているかを判定する(ステップS14)。ここでの終了条件は、得られたプランを採用して強化学習を終了するか決定可能なものであればよく、特定のものに限定されない。例えば、ここでの終了条件として、パラメータが収束しているか、プランへのリスクの反映が所定の条件を満たすか、または、プランナー部191とパラメトリック環境実行部194との相互作用の実行が所定の繰り返し回数に達しているか、あるいはこれらの組み合わせを用いることができるが、これらに限定されない。

終了条件が成立していないと動作規則決定装置100が判定した場合(ステップS14:NO)、処理がステップS11へ戻る。一方、終了条件が成立していると判定した場合(ステップS14:YES)、動作規則決定装置100は、図3の処理を終了する。

動作規則決定装置100によれば、リスクが反映されたリスク考慮型相互作用履歴情報を用いて動作規則を決定することで、リスクを考慮した動作規則を得られる。これにより、状態に応じた動作を決定するプランナーが、リスクを考慮した動作を決定することができる。

これにより、リスクを考慮した動作規則を得られる。これにより、動作規則決定装置100では、上記のように、状態に応じた動作を決定するプランナーが、リスクを考慮した動作を決定することができる。

プランナーパラメータ設定部192は、リスク考慮型履歴生成部193が決定した条件に基づいてプランナーパラメータの値を設定することで、リスクを考慮した動作規則を得られる。

これにより、プランナー部191は、制御対象に対してリスクを考慮した制御を行うことができる。

これにより、パラメトリック環境実行部194は、制御対象に対するリスクを考慮した制御の結果を算出することができる。

これにより、リスク考慮型履歴生成部193は、リスクを反映させた相互作用履歴情報を生成することができる。プランナーパラメータ設定部192が、リスクを反映させた相互作用履歴情報を用いてプランナーパラメータの値を設定することで、リスクを考慮した動作規則を得られる。

動作規則決定装置100によれば、環境パラメータの値によって挙動が異なる環境におけるリスクを、動作規則に反映させることができる。

このように、リスク考慮型履歴生成部193が、報酬の値が所定の値より小さいことで示されるリスクを報酬に反映させることで、報酬に基づいて動作規則を学習し得る。

また、リスク考慮型履歴生成部193は、複数のエピソードについて、累積程度の頻度を求め、求めた頻度を用いて、所定の値を決定してもよい。リスク考慮型履歴生成部193は、頻度分布の分位点(たとえば、1%位、5%位、10%位)にて所定の値を決定してもよい。

第2実施形態では、第1実施形態にかかる動作規則決定装置100の、より具体的な適用例について説明する。第1実施形態の説明は、第2実施形態にも当てはまる。特に、第2実施形態における動作規則決定装置100の構成および動作は、図1から図3を参照して説明した構成および動作と同様である。

第2実施形態では、動作規則決定装置100が、Hopperと呼ばれるロボットの制御のプランニングを行う例について説明する。この例では、動作規則決定装置100は、Hopperを転倒させずに素早く前進させるためのHopperにかける一連のトルクの数値をプランニングする。

第2実施形態では、図3のステップS11で、環境パラメータ選択部195が、環境パラメータセット記憶部183から環境パラメータセットとして、{Prob(Hopperと地面との摩擦係数=2.0)=0.9,Prob(Hopperと地面との摩擦係数=0.1)=0.1}との情報を取得する。Hopperと地面との摩擦係数を、単に摩擦係数とも称する。

環境パラメータ選択部195は、得られた環境パラメータセットに示される確率に応じて環境パラメータ値を選択する。

第2実施形態の例では、最大ターン数が3回に設定され、プランナー部191とパラメトリック環境実行部194とが、エピソード毎に、ターン数が最大ターン数に達するか、あるいは、Hopperが転倒するまで相互作用を繰り返すものとする。

図5は、第1エピソードの第2ターンの例を示す図である。図5の例では、図4に示される第1ターンの場合よりも、Hopper801が目標位置802に近付いている。

図8は、第2エピソードの第2ターンの例を示す図である。図8の例では、Hopper801が転倒している。このため、プランナー部191とパラメトリック環境実行部194とは相互作用を終了する。そして、プランナー部191は、第2エピソードにおける第1ターンから第2ターンまでの、2次元座標におけるHopper801の位置情報と、Hopper801の動作を制御するトルクの数値と、報酬との組み合わせの履歴を、相互作用履歴情報として相互作用履歴記憶部182に格納する。

図9で、mは、エピソードの識別番号を示す。tは、ターンの識別番号を示す。動作at,mは、第mエピソードの第tターンにおける、Hopper801の動作を制御するトルクの数値を示す。状態st,mは、第mエピソードの第tターンにおける、Hopper801の座標(位置情報)を示す。

報酬rt,mは、第mエピソードの第tターンにおける、報酬を示す。

第1エピソードの第1ターンおよび第2エピソードの第1ターンでは、いずれもエピソードにおける初期状態のため、報酬は0となっている。第1エピソードの第2ターンおよび第3ターンでは、いずれも、Hopper801が目標位置802に向かって進んだ進み具合に応じて報酬が与えられている。一方、第2エピソードの第2ターンでは、Hopper801が転倒したため、-10の報酬が与えられている。

図10は、リスク考慮型相互作用履歴情報の例を示す図である。図10の例で、リスク考慮型履歴生成部193は、図9の相互作用履歴情報の状態st,mがリスク考慮型状態情報s’t,mに置き換えられ、報酬rt,mがリスク考慮型報酬r’t,mに置き換えられたリスク考慮型相互作用履歴情報を生成している。

ただし、xt,mは、第mエピソードの第tターンにおけるHopper801の位置のx座標を示す。yt,mは、第mエピソードの第tターンにおけるHopper801の位置のy座標を示す。すなわち、ベクトル(xt,m,yt,m)は、第mエピソードの第tターンにおける、2次元座標におけるHopper801の位置情報の例に該当する。

「Σt=0 Tm-1-rt,m」は、第mエピソードにおけるタイミング「0」からタイミング「Tm-1」までの間の報酬の合計値に、「-1」を掛け算した値を表す。すなわち、「Σt=0 Tm-1-rt,m」は、第mエピソードにおけるタイミング「0」からタイミング「Tm-1」までの間のペナルティの合計値であるということもできる。

式(2)で、報酬rt,mに「-」が付されていることから、第mエピソードにおける報酬rt,mの合計が小さいほど、Σt=0 Tm-rt,mの値は大きくなる。Σt=0 Tm-rt,mの値が-v以下である場合、式(2)のmax関数で0が選択され、ペナルティ(1/ε)max(0,v+Σt=0 Tm-rt,m)は0になる。一方、Σt=0 Tm-rt,mの値が-vより大きい場合、式(2)のmax関数でv+Σt=0 Tm-rt,mが選ばれ、リスク考慮型履歴生成部193は、ペナルティを(1/ε)(v+Σt=0 Tm-rt,m)と算出する。リスク考慮型履歴生成部193は、このペナルティを報酬rt,mから減算した値を、リスク考慮型報酬r’t,mとして算出する。

例えば、プランナーパラメータ設定部192が、式(3)を用いて方策勾配法によってプランナーパラメータの値を更新するようにしてもよい。

π(at,m|s’t,m,θ)は、状態s’t,mおよびプランナーパラメータθのもとで動作at,mが選ばれる確率を示す。∇θlogπ(at,m|s’t,m,θ)は、θによるlogπ(at,m|s’t,m,θ)の微分を示す。∇θlogπ(at,m|s’t,m,θ)が示す傾きの方向にプランナーパラメータθの値が変化することで、状態s’t,mおよびプランナーパラメータθのもとで動作at,mが選ばれる確率が上昇する。

第3実施形態では、第1実施形態にかかる動作規則決定装置100の、より具体的なもう1つの適用例について説明する。第1実施形態の説明は、第3実施形態にも当てはまる。特に、第3実施形態における動作規則決定装置100の構成および動作は、図1から図3を参照して説明した構成および動作と同様である。

第3実施形態の例では、パラメトリック環境実行部194は、制御対象のプラントのシミュレータを含んで構成される。第3実施形態の例における環境は、このシミュレータによって提供される。

また、プランナー部191は、例えば所定の流量調節弁の開度指令値など、プラントに対する制御指令値を動作として算出する。プランナー部191が、プラントに対する制御指令値をPID(Proportional Integral Differential)制御値で算出するようにしてもよいが、これに限定されない。

また、プランナー部191は、例えば、エチレンの量またはガソリンの量など、パラメトリック環境実行部194によるプラントのシミュレーションで算出される成果物の量に応じて報酬を算出する。

パラメトリック環境実行部194は、環境パラメータ選択部195が選択した外気温=28℃、10℃のそれぞれについてエピソードを実行する。

これにより、実際のプラントに外気温のセンサが設けられておらず外気温を測定できない状況に、動作規則決定装置100は、外気温の不確定性に起因するリスクを考慮したプラントの制御プランを、プラントの運転者に提示できる。

あるいは、動作規則決定装置100が、想定し得る自然災害を環境パラメータとして動作規則を決定するようにしてもよい。これにより、動作規則決定装置100は、自然災害が生じた場合の不利益が比較的小さくて済むようなプラント制御を、プラントの運転者に提示できる。

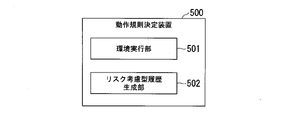

図12は、第4実施形態に係る動作規則決定装置の構成の例を示す図である。図12に示す構成で、動作規則決定装置500は、環境実行部501と、リスク考慮型履歴生成部502とを備える。

図13は、第5実施形態に係る動作規則決定方法における処理の手順の例を示す図である。図13に示す動作規則決定方法は、ステップS51からステップS52の工程を含む。ステップS51では、コンピュータが、制御対象の状態と、その状態の望ましさの程度とが関連付けされた程度情報を用いて、制御対象に対する一連の動作について、各動作後の状態と、その状態に関連付けされた程度とを求める。ステップS52では、コンピュータが、求められた程度を一連の動作について累積した累積程度を算出し、累積程度が条件を満たしている場合に、程度情報における一連の動作後の状態に関連付けされた程度を減じる。ステップS53では、パラメータ設定部が決定したプランナーパラメータの値が設定された動作規則を用いて制御対象に行わせる動作を決定する。

この動作規則決定方法によれば、リスクが反映されたリスク考慮型相互作用履歴情報を用いて動作規則を決定することで、リスクを考慮した動作規則を得られる。これにより、状態に応じた動作を決定するプランナーが、リスクを考慮した動作を決定することができる。

図14に示す構成で、コンピュータ700は、CPU710と、主記憶装置720と、補助記憶装置730と、インタフェース740とを備える。

上記の動作規則決定装置100、または、動作規則決定装置500のうち何れか1つ以上が、コンピュータ700に実装されてもよい。その場合、上述した各処理部の動作は、プログラムの形式で補助記憶装置730に記憶されている。CPU710は、プログラムを補助記憶装置730から読み出して主記憶装置720に展開し、当該プログラムに従って上記処理を実行する。また、CPU710は、プログラムに従って、上述した各記憶部に対応する記憶領域を主記憶装置720に確保する。各装置と他の装置との通信は、インタフェース740が通信機能を有し、CPU710の制御に従って通信を行うことで実行される。

また、CPU710は、プログラムに従って、記憶部180に対応する記憶領域を主記憶装置720に確保する。通信部110が行う通信は、インタフェース740が通信機能を有し、CPU710の制御に従って通信を行うことで実行される。

「コンピュータ読み取り可能な記録媒体」とは、フレキシブルディスク、光磁気ディスク、ROM(Read Only Memory)、CD-ROM(Compact Disc Read Only Memory)等の可搬媒体、コンピュータシステムに内蔵されるハードディスク等の記憶装置のことをいう。また上記プログラムは、前述した機能の一部を実現するためのものであっても良く、さらに前述した機能をコンピュータシステムにすでに記録されているプログラムとの組み合わせで実現できるものであっても良い。

110 通信部

180 記憶部

181 プランナーパラメータ記憶部

182 相互作用履歴記憶部

183 環境パラメータセット記憶部

190 制御部

191 プランナー部

192 プランナーパラメータ設定部

193、502 リスク考慮型履歴生成部

194 パラメトリック環境実行部

195 環境パラメータ選択部

501 環境実行部

Claims (8)

- 制御対象の状態と、その状態の望ましさの程度とが関連付けされた程度情報を用いて、前記制御対象に対する一連の動作について、各動作後の状態と、その状態に関連付けされた程度とを求める環境実行部と、

求められた程度を前記一連の動作について累積した累積程度を算出し、累積程度が条件を満たしている場合に、前記程度情報における一連の動作後の状態に関連付けされた前記程度を減じるリスク考慮型履歴生成部と

を備える動作規則決定装置。 - 前記制御対象の前記動作を示すパラメータ値を、前記累積程度が増大するよう更新するプランナーパラメータ設定部

をさらに備える請求項1に記載の動作規則決定装置。 - 前記リスク考慮型履歴生成部は、前記累積程度を、複数の前記一連の動作について算出し、算出した前記累積程度の頻度を求め、求めた頻度を用いて前記条件を決定する、

請求項1または請求項2に記載の動作規則決定装置。 - 前記パラメータ値に応じて前記制御対象を制御するプランナー部

をさらに備える請求項2に記載の動作規則決定装置。 - 前記環境実行部は、前記パラメータ値に基づき前記制御対象の動作をシミュレーションする、

請求項2に記載の動作規則決定装置。 - 前記リスク考慮型履歴生成部は、前記程度情報における前記程度から、前記累積程度に応じた量を減じる、

請求項1から5の何れか一項に記載の動作規則決定装置。 - コンピュータが、制御対象の状態と、その状態の望ましさの程度とが関連付けされた程度情報を用いて、前記制御対象に対する一連の動作について、各動作後の状態と、その状態に関連付けされた程度とを求める工程と、

前記コンピュータが、求められた程度を前記一連の動作について累積した累積程度を算出し、累積程度が条件を満たしている場合に、前記程度情報における一連の動作後の状態に関連付けされた前記程度を減じる工程と

を含む動作規則決定方法。 - コンピュータに、

制御対象の状態と、その状態の望ましさの程度とが関連付けされた程度情報を用いて、前記制御対象に対する一連の動作について、各動作後の状態と、その状態に関連付けされた程度とを求める工程と、

求められた程度を前記一連の動作について累積した累積程度を算出し、累積程度が条件を満たしている場合に、前記程度情報における一連の動作後の状態に関連付けされた前記程度を減じる工程と

を実行させるためのプログラム。

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/JP2019/020324 WO2020235061A1 (ja) | 2019-05-22 | 2019-05-22 | 動作規則決定装置、動作規則決定方法および記録媒体 |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JPWO2020235061A1 JPWO2020235061A1 (ja) | 2020-11-26 |

| JPWO2020235061A5 JPWO2020235061A5 (ja) | 2022-01-14 |

| JP7173317B2 true JP7173317B2 (ja) | 2022-11-16 |

Family

ID=73458170

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2021519989A Active JP7173317B2 (ja) | 2019-05-22 | 2019-05-22 | 動作規則決定装置、動作規則決定方法およびプログラム |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US20220197230A1 (ja) |

| JP (1) | JP7173317B2 (ja) |

| WO (1) | WO2020235061A1 (ja) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11645498B2 (en) * | 2019-09-25 | 2023-05-09 | International Business Machines Corporation | Semi-supervised reinforcement learning |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2013225192A (ja) | 2012-04-20 | 2013-10-31 | Nippon Telegr & Teleph Corp <Ntt> | 報酬関数推定装置、報酬関数推定方法、およびプログラム |

| WO2018181020A1 (ja) | 2017-03-29 | 2018-10-04 | 三菱重工業株式会社 | 予兆検知システム及び予兆検知方法 |

| JP2018165693A (ja) | 2017-03-28 | 2018-10-25 | パナソニックIpマネジメント株式会社 | 運転支援方法およびそれを利用した運転支援装置、自動運転制御装置、車両、プログラム、提示システム |

Family Cites Families (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP5572339B2 (ja) * | 2009-07-03 | 2014-08-13 | 富士重工業株式会社 | オンラインリスク認識システム |

| JP5750657B2 (ja) * | 2011-03-30 | 2015-07-22 | 株式会社国際電気通信基礎技術研究所 | 強化学習装置、制御装置、および強化学習方法 |

| CN106101379B (zh) * | 2016-05-26 | 2019-08-06 | Oppo广东移动通信有限公司 | 一种移动终端的防沉迷方法、装置及移动终端 |

| JP6453922B2 (ja) * | 2017-02-06 | 2019-01-16 | ファナック株式会社 | ワークの取り出し動作を改善するワーク取り出し装置およびワーク取り出し方法 |

| KR20180096113A (ko) * | 2017-02-20 | 2018-08-29 | 엘지전자 주식회사 | 설비 기기 제어 시스템 |

| JP6895334B2 (ja) * | 2017-07-11 | 2021-06-30 | 株式会社東芝 | 運用ルール抽出装置、運用ルール抽出システムおよび運用ルール抽出方法 |

| JP6939162B2 (ja) * | 2017-07-13 | 2021-09-22 | 横河電機株式会社 | プラント制御支援装置、プラント制御支援方法、プラント制御支援プログラム及び記録媒体 |

| JP7379833B2 (ja) * | 2019-03-04 | 2023-11-15 | 富士通株式会社 | 強化学習方法、強化学習プログラム、および強化学習システム |

-

2019

- 2019-05-22 JP JP2021519989A patent/JP7173317B2/ja active Active

- 2019-05-22 WO PCT/JP2019/020324 patent/WO2020235061A1/ja active Application Filing

- 2019-05-22 US US17/611,694 patent/US20220197230A1/en active Pending

Patent Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2013225192A (ja) | 2012-04-20 | 2013-10-31 | Nippon Telegr & Teleph Corp <Ntt> | 報酬関数推定装置、報酬関数推定方法、およびプログラム |

| JP2018165693A (ja) | 2017-03-28 | 2018-10-25 | パナソニックIpマネジメント株式会社 | 運転支援方法およびそれを利用した運転支援装置、自動運転制御装置、車両、プログラム、提示システム |

| WO2018181020A1 (ja) | 2017-03-29 | 2018-10-04 | 三菱重工業株式会社 | 予兆検知システム及び予兆検知方法 |

Also Published As

| Publication number | Publication date |

|---|---|

| JPWO2020235061A1 (ja) | 2020-11-26 |

| WO2020235061A1 (ja) | 2020-11-26 |

| US20220197230A1 (en) | 2022-06-23 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| Phan et al. | Neural simplex architecture | |

| US20220040852A1 (en) | Method for controlling a robot device and robot device controller | |

| JP6840363B2 (ja) | ネットワーク学習装置、行動決定装置、ネットワーク学習方法、及びプログラム | |

| JP2021501433A (ja) | ターゲットシステム用制御システムの生成 | |

| JP6457382B2 (ja) | キャッシュロックを学習する機械学習器,産業機械システム,製造システム,機械学習方法および機械学習プログラム | |

| CN112135717A (zh) | 基于像素的模型预测控制的系统和方法 | |

| JP7398373B2 (ja) | 制御装置、システム、制御方法、及びプログラム | |

| US11790042B1 (en) | Mitigating reality gap through modification of simulated state data of robotic simulator | |

| JP7173317B2 (ja) | 動作規則決定装置、動作規則決定方法およびプログラム | |

| JP6940831B2 (ja) | 決定装置、決定方法、及び、決定プログラム | |

| CN116324818A (zh) | 使用增强时间差异学习训练强化学习智能体 | |

| JP2008512750A (ja) | 規則に基づいた逐次アプローチを利用した人間の姿勢を予測するためのシステムおよび方法 | |

| Gutzeit et al. | The besman learning platform for automated robot skill learning | |

| JP7180696B2 (ja) | 制御装置、制御方法およびプログラム | |

| CN111984000A (zh) | 用于自动影响执行器的方法和设备 | |

| Abdi et al. | Muscle excitation estimation in biomechanical simulation using NAF reinforcement learning | |

| JPWO2019142728A1 (ja) | 制御装置、制御方法およびプログラム | |

| WO2023026342A1 (ja) | 動作規則決定装置、動作規則決定方法および記録媒体 | |

| JP2022100227A (ja) | リスク尺度を示すパラメータに基づいて訓練されたモデルを使用して、与えられた状況に対するデバイスの行動を決定する方法およびシステム | |

| WO2021140698A1 (ja) | 情報処理装置、方法及びプログラム | |

| CN110147891B (zh) | 应用于强化学习训练过程的方法、装置及电子设备 | |

| GB2601110A (en) | Latency mitigation system and method | |

| Schmidt-Rohr et al. | Bridging the gap of abstraction for probabilistic decision making on a multi-modal service robot | |

| WO2023248426A1 (ja) | 学習装置、表示装置、学習方法、表示方法および記録媒体 | |

| CN112292239A (zh) | 用于计算机辅助地确定用于适宜操作技术系统的调节参数的方法和设备 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20211008 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20211008 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20221004 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20221017 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 7173317 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |