JP6971585B2 - 画像処理装置および画像処理方法 - Google Patents

画像処理装置および画像処理方法 Download PDFInfo

- Publication number

- JP6971585B2 JP6971585B2 JP2017030152A JP2017030152A JP6971585B2 JP 6971585 B2 JP6971585 B2 JP 6971585B2 JP 2017030152 A JP2017030152 A JP 2017030152A JP 2017030152 A JP2017030152 A JP 2017030152A JP 6971585 B2 JP6971585 B2 JP 6971585B2

- Authority

- JP

- Japan

- Prior art keywords

- normal

- light

- image processing

- calculating

- depth

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000012545 processing Methods 0.000 title claims description 90

- 238000003672 processing method Methods 0.000 title claims description 4

- 239000013598 vector Substances 0.000 claims description 65

- 238000005286 illumination Methods 0.000 claims description 31

- 238000000034 method Methods 0.000 claims description 19

- 238000003384 imaging method Methods 0.000 claims description 17

- 238000012937 correction Methods 0.000 claims description 14

- 230000003287 optical effect Effects 0.000 claims description 5

- 238000012804 iterative process Methods 0.000 description 9

- 238000010586 diagram Methods 0.000 description 7

- 238000000605 extraction Methods 0.000 description 4

- 230000006870 function Effects 0.000 description 4

- 239000000284 extract Substances 0.000 description 3

- 230000000694 effects Effects 0.000 description 2

- 238000004891 communication Methods 0.000 description 1

- 238000007796 conventional method Methods 0.000 description 1

- 230000001678 irradiating effect Effects 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 230000003252 repetitive effect Effects 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/2224—Studio circuitry; Studio devices; Studio equipment related to virtual studio applications

- H04N5/2226—Determination of depth image, e.g. for foreground/background separation

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01B—MEASURING LENGTH, THICKNESS OR SIMILAR LINEAR DIMENSIONS; MEASURING ANGLES; MEASURING AREAS; MEASURING IRREGULARITIES OF SURFACES OR CONTOURS

- G01B11/00—Measuring arrangements characterised by the use of optical techniques

- G01B11/24—Measuring arrangements characterised by the use of optical techniques for measuring contours or curvatures

- G01B11/25—Measuring arrangements characterised by the use of optical techniques for measuring contours or curvatures by projecting a pattern, e.g. one or more lines, moiré fringes on the object

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/06—Digital input from, or digital output to, record carriers, e.g. RAID, emulated record carriers or networked record carriers

- G06F3/0601—Interfaces specially adapted for storage systems

- G06F3/0602—Interfaces specially adapted for storage systems specifically adapted to achieve a particular effect

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/20—Image signal generators

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/20—Image signal generators

- H04N13/271—Image signal generators wherein the generated image signals comprise depth maps or disparity maps

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/67—Focus control based on electronic image sensor signals

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N25/00—Circuitry of solid-state image sensors [SSIS]; Control thereof

- H04N25/60—Noise processing, e.g. detecting, correcting, reducing or removing noise

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/20—Image signal generators

- H04N13/204—Image signal generators using stereoscopic image cameras

- H04N13/254—Image signal generators using stereoscopic image cameras in combination with electromagnetic radiation sources for illuminating objects

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N2013/0074—Stereoscopic image analysis

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Human Computer Interaction (AREA)

- General Engineering & Computer Science (AREA)

- Length Measuring Devices By Optical Means (AREA)

- Image Generation (AREA)

Description

本発明は、上記した課題を解決すべく、法線算出対象物体の大きさにかかわらず、当該物体の法線をより高い精度で算出することを目的とする。

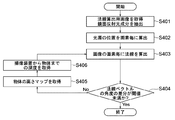

本実施形態においては、従来の方法により算出した法線から深度を取得し、当該深度を用いて再度法線を算出するという処理を繰り返し行うことにより、高精度に法線を算出する。すなわち、繰り返し処理により取得した深度から、法線算出対象物体の法線取得位置を算出し、法線算出の際に視線ベクトルと光源ベクトルを補正することで法線算出精度を向上させる。深度とは、撮像装置から法線算出対象物体までの距離である。

図1は、本発明に係る画像処理装置100の構成の一例を示す図である。画像処理装置100は、CPU101、RAM102、ROM103、二次記憶装置104、入力インターフェース105、出力インターフェース106、およびシステムバス107を有する。画像処理装置100には、入力装置108と外部蓄積装置109と表示装置110が接続されている。より詳しくは、入力装置108は画像処理装置100の入力インターフェース105に接続され、外部蓄積装置109は画像処理装置100の入力インターフェース105と出力インターフェース106に接続されている。また、表示装置110は画像処理装置100の出力インターフェース106に接続されている。

CPU101は、RAM102をワークメモリとして、ROM103に格納されたプログラムを実行し、システムバス107を介して画像処理装置100の各部を統括的に制御する処理回路である。CPU101がプログラムを実行することにより、後述する様々な処理が実行される。

入力インターフェース105は、例えばUSBやIEEE1394等のシリアルバスインターフェースである。画像処理装置100は、入力インターフェース105を介して、入力装置108や外部蓄積装置109などからデータなどを取得することができる。

出力インターフェース106は、例えばDVIやHDMI(登録商標)等の映像出力端子である。画像処理装置100は、出力インターフェース106を介して、表示装置110に、処理された画像などを表示することができる。出力インターフェース106は、例えば、USBやIEEE1394等のシリアルバスインターフェースである。画像処理装置100は、出力インターフェース106を介して、外部蓄積手段109へのデータの蓄積を行うことができる。

外部蓄積装置109は、例えば、ハードディスク、メモリーカード、CFカード、SDカード、USBメモリである。CFはCompact Flashの略である。

表示装置110は、液晶ディスプレイなどの出力デバイスである。なお、表示装置110は音声出力部を備えてもよい。

画像処理装置100の構成要素は上記以外にも存在し得る(例えば、外部の機器と通信を行う通信部)が、法線の算出に関連がない構成要素の説明は本明細書において省略する。

図2(A)は、法線算出システム200の概略構成を示している。図2(A)に示されているように、法線算出システム200は、画像処理装置100と、撮像装置201と、光源装置202と、撮影ステージ204とを有する。法線算出システム200は、法線算出対象物体(以下、「物体」と称する)203の法線を算出するシステムである。物体203は、例えば、球体である。画像処理装置100は、撮像装置201と光源装置202に接続されている。法線算出システム200は、画像処理装置100を含む画像処理システムである。

撮像装置201は、物体203の画像を撮像する装置である。撮像装置201は、例えば、カメラである。

光源装置202は、複数の点光源からなる照明装置である。点光源の配置等については、図2(B)を用いて後述する。

撮影ステージ204は、物体203を置くステージ(載置台)である。撮影ステージ204は、伸長収縮できるように構成されるか、移動可能に構成され、物体203を光源装置202の中心Oに配置することができる。

図2(B)は、光源装置202が物体203に光を照射する様子を示している。図2(B)に示されるように、光源装置202は複数の照明(点光源)205を有している。点光源205は離散的に且つ球面状に配置されている。光源装置202は、点光源205を異なる輝度で発光させることができる。つまり、光源装置202は、点光源205の輝度を連続して(徐々に、滑らかに、段階的に)変化させることができる(勾配照明)。勾配照明はgradient illuminationと称される。また、光源装置202は、点光源205を同一の輝度で発光させることもできる(均一照明)。図2(B)には、光源装置202が物体203に向けて、点光源205から異なる輝度で光を照射する様子を描いてある。

物体203から点光源205へ向かうベクトルL”が光線ベクトルであり、物体203から撮像装置201へ向かうベクトルC”が視線ベクトルである。符号Nは法線ベクトルを示す。物体203上の点206は、法線取得位置(法線Nの起点になる位置)を示す。なお、撮像装置201の位置は、図示の都合上、図2(A)とは異なるように描かれている。

図3に示されているように、機能ブロックで描くと、画像処理装置100は、画像取得部301、制御部302、光源位置算出部303、法線算出部304、繰り返し処理判定部305、高さマップ算出部306および深度算出部307から成る。

画像取得部301は、光源装置202によって照射された物体203を撮像した撮像装置201から画像を取得する。また、画像取得部301は、物体203の画像から鏡面反射光成分を抽出する。

制御部302は、所定の規則(例えば、3種類の勾配照明パターンと、1種類の均一照明パターン)に従って、光源装置202の点光源205を点灯させる。制御部302は、光源装置202からの照射光により物体203を照射し、撮像装置201が物体203を撮像できるようにしている。

法線算出部304は、物体203の深度(法線取得位置)と、撮像装置201の位置と、点光源の位置とから、法線を算出する。撮像装置201の位置は、事前に、入力装置108から画像処理装置100に入力されていてもよいし、撮像中に取得してもよい。撮像装置201の位置の情報は、例えば、入力装置108からRAM102に入力・記憶され、必要なときに、法線算出部304がRAM102から取得する。

高さマップ算出部306は、法線から画像の画素の高さマップを作成(算出)する。

深度算出部307は、高さマップを深度マップに変換する。物体203の深度は、深度算出部307から法線算出部304に入力される。物体203の深度は法線取得位置206として用いることができるので、深度算出部307は、算出された法線を用いて、法線取得位置を補正していると言える。

S401では、画像取得部301が、処理対象である物体203の画像を撮像装置201から取得する。つまり、画像取得部301は、法線算出用画像を撮像装置201から取得する。そして、画像取得部301は、法線算出用画像を光源位置算出部303に出力する。

S401で取得される画像(法線算出用画像)は、制御部302によって所定の規則(所定の照明パターン)に従って点灯された光源装置202によって照らされた物体203を撮像して得た画像群である。ここで、所定の規則とは、例えば、特許文献1に示すような鏡面反射光を用いて法線を算出するための照明パターンのことである。特許文献1では光源装置202のように離散的に配置された連続的に輝度を変化させられる多灯照明(複数の点光源205)を、互いに直交するx、y、zの各々の軸方向に滑らかに輝度を変化させて3種類の勾配照明パターンで照明を行う。すなわち、x軸方向に滑らかに輝度を変化させて1種類のパターンを作り、y軸方向に滑らかに輝度を変化させて1種類のパターンを作り、z軸方向に滑らかに輝度を変化させて1種類のパターンを作り、物体203に光を照射する。

Li(θi)=cωi(θi) (1)

Lc=c (2)

このとき、1つの偏光板を点光源205に配置し、別の偏光板を撮像装置201に配置しておく。そして、点光源205に配置した偏光板と撮像装置201に配置した偏光板の主軸の方向を、直交させた場合と平行にした場合の二通りで撮像を行う。画像取得部301は、それらの画像の差分をとることで鏡面反射光成分(以下、「鏡面反射光」と称する)を抽出する。撮像された画像群はRAM102や二次記憶装置104に記憶しておく。なお、鏡面反射光の抽出はこの方法のみに限定されない。例えば、二色性反射モデルを用いた方法等を利用して鏡面反射光の抽出を行うこともできる。画像取得部301は、鏡面反射光を光源位置算出部303に出力する。

Ii(θi,x’,y’)=ρ(x’,y’)cωi(θi) (3)

Ic=ρ(x’,y’)c (4)

式(3)を式(4)で除算することで式(5)を得る。

S403では、法線算出部304が、深度算出部307が出力した物体203の深度と撮像装置201の位置と光源位置とから、画像の画素毎に法線を算出する。物体203の深度は法線取得位置206として用いることができる。撮像装置201で撮像した画像における画素(x’,y’)に対応する深度V’ (x’,y’)は、撮像装置201から物体203の各点(法線取得位置)に対する奥行き方向の距離を表している。従って、深度の最大値をV’max、画像の幅をw、高さをh、中心画素を(xo’,yo’)とすると、画素(x’,y’)における法線取得位置ベクトルPは水平画角φH、垂直画角φVを用いて式(6)で表される。法線取得位置ベクトルPは、撮像装置201の座標の原点から出るベクトルである。水平画角φH及び垂直画角φVは、撮像装置(カメラ)201の画角である。

C”(x’,y’)=C’(x’,y’)−P(x’,y’) (7)

L”(x’,y’)=L’(x’,y’)−P(x’,y’) (8)

視線ベクトルC’’と入射光線ベクトルL’’を用いて、式(9)で法線ベクトルNを算出する。

なお、一度目の繰り返し処理(ループ処理)では、物体203の深度は未知であるため、法線取得位置206は光源装置202の中心Oであるとする。二度目以降のループ処理では深度算出部307が出力した物体203の深度を用いる。ループ処理とは、S403−S404−S405−S406−S403のループで行われる処理のことである。

S404では、例えば、法線ベクトルの値を各画素に格納した法線マップを用いる。S404における繰り返し処理の必要性の判定条件は式(10)のように表わすことができる。

S405では、高さマップ算出部306が、繰り返し処理判定部305が出力した法線から高さマップを算出することにより、物体203の高さマップを取得する。高さマップ算出部306は、取得した高さマップを深度算出部407へ出力する。各画素(i,j)における法線ベクトルをN(i,j)とすると、各画素の高さV(i,j)は式(11)で表される。

S406では、深度算出部307が、高さマップ算出部306が出力した高さマップを撮像装置201から物体203までの深度マップへ変換することにより、深度を取得(算出)する。高さマップは基準面からの高さをモノクロ画像に格納したものであるため、撮像装置201から基準面までの距離dを決定することで、撮影装置201から物体203までの深度を決定できる。そこで、物体203が球面状に配置した点光源205の中心O付近にあるとして、距離dを撮像装置201から点光源205の中心Oまでの距離の近傍で変化させた際の法線Nd(i,j)の変化率を計算し、変化率を最も小さくする距離dを採用する。例えば、高さマップに格納されている高さの値の範囲が0からaまでであるとする。そして、深度V’(i,j)に対する深度マップの輝度値がI’ (i,j)であるとき、画素(i,j)における撮像装置201から物体203までの深度V’ (i,j)は式(12)で表される。なお、高さの値の範囲については被写体(物体203)の大きさに合わせて、ユーザが入力装置108を用いて指定するものとする。

dを算出する場合には、撮像装置201から高さマップの基準面までの距離をΔdだけ変化させて法線ベクトルを算出し、法線ベクトルの変化率を最小とするdを算出する。すなわち、高さマップの画像の幅をwとし、高さをhとし、式(13)を満たすようなdを採用する。

特許文献1では、法線取得位置がある一点であると仮定して法線ベクトルを算出していたために、法線取得位置がその一点からずれた際に、法線取得位置と撮像装置の位置と光源位置から算出される光源ベクトルと視線ベクトルにずれが生じる。そのため、それらのベクトルにより算出される法線の精度が低下する。しかし、本実施形態では法線算出(S403)と深度算出(S406)を繰り返し行うことで、法線と深度を徐々に高精度なものにして行く。そして、法線の精度が所定以上のものなったとき(S404:Yes)、繰り返し処理を終了して、当該法線を画像処理装置100から出力する。つまり、本実施形態では、法線を算出した後、すでに算出した法線(または、予め用意してある法線)とのなす角度が閾値以上の場合、直前に算出した法線を用いて、深度(法線取得位置)を補正する処理を行う。そして、補正された法線取得位置と、すでに取得している光源の位置と、すでに取得している撮像装置の位置とを用いて、法線を再度算出している。

本実施形態の効果を実証するため、立方体モデルのCG画像に対して、上記した繰り返し処理を適用した際の法線の角度誤差を算出した。図6は、その算出結果を示している。図6は、横軸に繰り返し回数をとり、縦軸に法線に発生する角度誤差をとった際の法線算出誤差を示したグラフである。図6から、繰り返し処理によって法線の算出精度が向上していることが分かる。

なお、上記した実施形態では、画像処理装置100に二次記憶装置104が含まれるとしたが、二次記憶装置104は画像処理装置100の外に設けてもよい。また、入力装置108および表示装置110が画像処理装置100の外に設けられるとしたが、入力装置108および表示装置110は、画像処理装置100に含まれてもよい。

上記した実施形態では、撮影ステージ204に球状の被写体(物体203)が置かれたが、被写体は人物でもよい。例えば、椅子に座った人物の頭部(顔部)が法線算出対象物体となった場合でも、本発明を適用することができる。また、撮影ステージ204は法線算出システム200に含まれるとしたが、法線算出システム200に含まれなくてもよい。

画像処理装置100は、例えば、PC(パーソナルコンピュータ)で構成することができる。なお、画像処理装置100は、PC以外の装置(例えば、タブレットコンピュータ、ウエアラブルコンピュータ)で構成することもできる。

上記した実施形態では、画像処理装置100を説明したが、本発明はその他の形態でも具現化(実現)することができる。たとえば、上記した実施形態の1以上の機能を実現するプログラムを、ネットワーク又は記憶媒体を介してシステム又は装置に供給し、そのシステム又は装置のコンピュータにおける1つ以上のプロセッサーがプログラムを読出し実行する処理でも実現可能である。また、1以上の機能を実現する回路(例えば、ASIC)によっても実現可能である。

Claims (17)

- 物体に光を照射する複数の光源の位置を表す第1位置情報と、前記物体において法線を算出する位置を表す第2位置情報と、前記物体を撮像する撮像装置の位置を表す第3位置情報と、に基づいて、前記法線を算出する位置における法線を算出する算出手段と、

所定の条件に応じて、前記算出された法線を用いて、前記法線を算出する位置の深度を補正する補正手段と、を有し、

前記算出手段は、前記補正手段が前記深度を補正した場合に、前記補正された深度の位置における法線を算出し、

前記第1位置情報は、前記複数の光源においてある方向に向かって明るさを変化させる照明パターンにより光が照射された前記物体を撮像して得られる輝度から、前記複数の光源を同じ明るさで発光させる照明パターンにより光が照射された前記物体を撮像して得られる輝度を除算することにより得られることを特徴とする画像処理装置。 - 前記補正手段が前記深度を補正すべきか否かを判定する判定手段をさらに有し、

前記補正手段は、前記判定手段が前記深度を補正すべきと判定した場合に、前記深度を補正することを特徴とする請求項1に記載の画像処理装置。 - 前記判定手段は、前記撮像装置の光軸方向に平行な法線と、前記算出手段が算出した法線と、がなす角度が所定の閾値以上である場合、前記深度を補正すべきと判定することを特徴とする請求項2に記載の画像処理装置。

- 前記補正手段は、前記撮像装置の光軸方向に平行な法線と、前記算出手段が算出した法線と、がなす角度が所定の閾値以上である場合、前記深度を補正することを特徴とする請求項1に記載の画像処理装置。

- 前記第1位置情報は、前記物体における鏡面反射光の強度に基づいて取得されることを特徴とする請求項1乃至請求項4のいずれか一項に記載の画像処理装置。

- 前記算出手段は、前記光源の位置と前記法線を算出する位置とに基づいて前記物体から前記光源への方向を表す光源ベクトルを算出し、前記撮像装置の位置と前記法線を算出する位置とに基づいて前記物体から前記撮像装置への方向を表す視線ベクトルを算出し、前記光源ベクトルと前記視線ベクトルとの和を算出することによって、前記法線を算出することを特徴とする請求項1乃至請求項5のいずれか一項に記載の画像処理装置。

- 前記第2位置情報は、前記撮像装置から前記物体までの距離に基づいて取得されることを特徴とする請求項1乃至請求項6のいずれか一項に記載の画像処理装置。

- 前記撮像装置は前記複数の光源からの光が照射された前記物体を撮像し、

前記第1位置情報として、前記物体を撮像して得られる画像における前記物体に対応する各画素について、前記複数の光源の中から、前記物体の表面において鏡面反射する光を発する光源の位置情報が取得され、

前記算出手段は、前記各画素について、前記法線を算出することを特徴とする請求項1乃至請求項7のいずれか一項に記載の画像処理装置。 - 前記光源は複数の照明パターンによって前記物体に光を照射し、

前記撮像装置は前記照明パターンごとに前記物体を撮像することを特徴とする請求項8に記載の画像処理装置。 - 前記複数の照明パターンは、前記複数の光源を互いに異なる明るさで発光させた場合の照明パターンと、前記複数の光源を同じ明るさで発光させた場合の照明パターンとを含むことを特徴とする請求項9に記載の画像処理装置。

- 前記補正手段は、前記算出された法線を用いて前記物体の表面における高さ分布を算出し、前記高さ分布に基づいて、前記深度を補正することを特徴とする請求項1乃至請求項10のいずれか一項に記載の画像処理装置。

- 前記補正手段は、前記高さ分布に基づいて前記撮像装置から前記物体までの距離を算出し、前記撮像装置から前記物体までの距離に基づいて前記深度を補正することを特徴とする請求項11に記載の画像処理装置。

- 前記第2位置情報は、前記撮像装置から前記物体までの距離を表す深度データまたは前記物体の形状を表す形状データに基づいて取得されることを特徴とする請求項1乃至請求項12のいずれか一項に記載の画像処理装置。

- 物体に光を照射する複数の光源の位置を表す第1位置情報と、前記物体において法線を算出する位置を表す第2位置情報と、前記物体を撮像する撮像装置の位置を表す第3位置情報と、に基づいて、前記法線を算出する位置における法線を算出する算出手段と、

前記法線を算出する位置の補正と、前記補正された法線を算出する位置における法線の算出と、を含む処理が行われるか否かを判定する判定手段と、を有し、

前記算出手段は、前記判定手段が前記処理が行われないと判定するまで、前記処理を繰り返し行い、

前記第1位置情報は、前記複数の光源においてある方向に向かって明るさを変化させる照明パターンにより光が照射された前記物体を撮像して得られる輝度から、前記複数の光源を同じ明るさで発光させる照明パターンにより光が照射された前記物体を撮像して得られる輝度を除算することにより得られることを特徴とする画像処理装置。 - 物体に光を照射する複数の光源の位置を表す第1位置情報と、前記物体において法線を算出する位置を表す第2位置情報と、前記物体を撮像する撮像装置の位置を表す第3位置情報と、に基づいて、前記法線を算出する位置における法線を算出する算出ステップと、

所定の条件に応じて、前記算出された法線を用いて、前記法線を算出する位置の深度を補正する補正ステップと、を有し、

前記補正ステップにおいて前記深度が補正された場合に、前記算出ステップにおいて、前記補正された深度の位置における法線を算出し、

前記第1位置情報は、前記複数の光源においてある方向に向かって明るさを変化させる照明パターンにより光が照射された前記物体を撮像して得られる輝度から、前記複数の光源を同じ明るさで発光させる照明パターンにより光が照射された前記物体を撮像して得られる輝度を除算することにより得られることを特徴とする画像処理方法。 - 物体に光を照射する複数の光源の位置を表す第1位置情報と、前記物体において法線を算出する位置を表す第2位置情報と、前記物体を撮像する撮像装置の位置を表す第3位置情報と、に基づいて、前記法線を算出する位置における法線を算出する算出ステップと、

前記法線を算出する位置の補正と、前記補正された法線を算出する位置における法線の算出と、を含む処理が行われるか否かを判定する判定ステップと、を有し、

前記判定ステップにおいて前記処理が行われないと判定されるまで、前記算出ステップにおいて前記処理を繰り返し行い、

前記第1位置情報は、前記複数の光源においてある方向に向かって明るさを変化させる照明パターンにより光が照射された前記物体を撮像して得られる輝度から、前記複数の光源を同じ明るさで発光させる照明パターンにより光が照射された前記物体を撮像して得られる輝度を除算することにより得られることを特徴とする画像処理方法。 - コンピュータを、請求項1乃至請求項14のいずれか一項に記載の画像処理装置の各手段として機能させるためのプログラム。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017030152A JP6971585B2 (ja) | 2017-02-21 | 2017-02-21 | 画像処理装置および画像処理方法 |

| US15/897,042 US10652436B2 (en) | 2017-02-21 | 2018-02-14 | Image processing apparatus, image processing method, and storage medium |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017030152A JP6971585B2 (ja) | 2017-02-21 | 2017-02-21 | 画像処理装置および画像処理方法 |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2018136693A JP2018136693A (ja) | 2018-08-30 |

| JP2018136693A5 JP2018136693A5 (ja) | 2020-02-06 |

| JP6971585B2 true JP6971585B2 (ja) | 2021-11-24 |

Family

ID=63166252

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2017030152A Active JP6971585B2 (ja) | 2017-02-21 | 2017-02-21 | 画像処理装置および画像処理方法 |

Country Status (2)

| Country | Link |

|---|---|

| US (1) | US10652436B2 (ja) |

| JP (1) | JP6971585B2 (ja) |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN114331823A (zh) * | 2021-12-29 | 2022-04-12 | 北京字跳网络技术有限公司 | 图像处理方法、装置、电子设备及存储介质 |

| KR102440840B1 (ko) * | 2022-03-03 | 2022-09-06 | (주)이브이알스튜디오 | 노멀 맵을 하이트 맵으로 변환하는 전자 장치의 제어 방법 |

| US20240163563A1 (en) * | 2022-11-14 | 2024-05-16 | Sony Group Corporation | Lighting control for multi-view image capture |

Family Cites Families (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US10469831B2 (en) * | 2002-06-07 | 2019-11-05 | University Of Southern California | Near-instant capture of high-resolution facial geometry and reflectance |

| US9123116B2 (en) * | 2011-04-19 | 2015-09-01 | University Of Southern California | Multiview face capture using polarized spherical gradient illumination |

| US8134555B2 (en) * | 2007-04-17 | 2012-03-13 | University Of Southern California | Acquisition of surface normal maps from spherical gradient illumination |

| WO2010151643A2 (en) * | 2009-06-24 | 2010-12-29 | University Of Southern California | Estimating spectral distribution of reflections from object surface based on low frequency illumination |

| JP5170154B2 (ja) * | 2010-04-26 | 2013-03-27 | オムロン株式会社 | 形状計測装置およびキャリブレーション方法 |

| US9562857B2 (en) * | 2013-03-14 | 2017-02-07 | University Of Southern California | Specular object scanner for measuring reflectance properties of objects |

| JP6519265B2 (ja) * | 2015-03-27 | 2019-05-29 | 株式会社Ihi | 画像処理方法 |

| WO2018017897A1 (en) * | 2016-07-20 | 2018-01-25 | Mura Inc. | Systems and methods for 3d surface measurements |

-

2017

- 2017-02-21 JP JP2017030152A patent/JP6971585B2/ja active Active

-

2018

- 2018-02-14 US US15/897,042 patent/US10652436B2/en active Active

Also Published As

| Publication number | Publication date |

|---|---|

| US20180241914A1 (en) | 2018-08-23 |

| US10652436B2 (en) | 2020-05-12 |

| JP2018136693A (ja) | 2018-08-30 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US11315281B2 (en) | Pupil positioning method and apparatus, VR/AR apparatus and computer readable medium | |

| TWI668997B (zh) | 產生全景深度影像的影像裝置及相關影像裝置 | |

| US10475237B2 (en) | Image processing apparatus and control method thereof | |

| US11210839B2 (en) | Photometric image processing | |

| CN108363995B (zh) | 用于生成数据的方法和装置 | |

| CN110312111B (zh) | 用于图像装置的自动校准的装置、系统和方法 | |

| CN111028205B (zh) | 一种基于双目测距的眼睛瞳孔定位方法及装置 | |

| US10403001B2 (en) | Producing three-dimensional representation based on images of an object | |

| US9740914B2 (en) | Face location detection | |

| CN105180836B (zh) | 控制装置、机器人、以及控制方法 | |

| US10169891B2 (en) | Producing three-dimensional representation based on images of a person | |

| WO2018027530A1 (zh) | 红外光源的亮度调节方法与装置、光学动捕摄像机 | |

| US10672116B2 (en) | Substrate inspection method and system | |

| JP6971585B2 (ja) | 画像処理装置および画像処理方法 | |

| US11022861B2 (en) | Lighting assembly for producing realistic photo images | |

| WO2020075252A1 (ja) | 情報処理装置、プログラム及び情報処理方法 | |

| JP2016024052A (ja) | 3次元計測システム、3次元計測方法及びプログラム | |

| US10281265B2 (en) | Method and system for scene scanning | |

| CN106803284B (zh) | 构建脸部的三维图像的方法及装置 | |

| JP6776004B2 (ja) | 画像処理装置、画像処理方法およびプログラム | |

| US11143499B2 (en) | Three-dimensional information generating device and method capable of self-calibration | |

| CN108256477B (zh) | 一种用于检测人脸的方法和装置 | |

| CN111696146A (zh) | 人脸模型重建方法、系统、图像处理系统及存储介质 | |

| WO2023032312A1 (ja) | 撮像システムおよびその制御方法 | |

| JP2019016843A (ja) | 原稿読取装置、原稿読取装置の制御方法、及びプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20191217 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20191217 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20210128 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20210309 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20210427 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20211005 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20211102 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 6971585 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |

|

| RD03 | Notification of appointment of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: R3D03 |