JP6866484B2 - 向上した深度感知のためのシステムおよび方法 - Google Patents

向上した深度感知のためのシステムおよび方法 Download PDFInfo

- Publication number

- JP6866484B2 JP6866484B2 JP2019531636A JP2019531636A JP6866484B2 JP 6866484 B2 JP6866484 B2 JP 6866484B2 JP 2019531636 A JP2019531636 A JP 2019531636A JP 2019531636 A JP2019531636 A JP 2019531636A JP 6866484 B2 JP6866484 B2 JP 6866484B2

- Authority

- JP

- Japan

- Prior art keywords

- depth

- light pattern

- structured light

- field

- image

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000000034 method Methods 0.000 title claims description 66

- 238000003384 imaging method Methods 0.000 claims description 133

- 230000003287 optical effect Effects 0.000 claims description 42

- 238000003860 storage Methods 0.000 claims description 37

- 230000008569 process Effects 0.000 claims description 8

- 238000013461 design Methods 0.000 description 25

- 230000006870 function Effects 0.000 description 11

- 230000000875 corresponding effect Effects 0.000 description 6

- 230000009471 action Effects 0.000 description 5

- 238000005516 engineering process Methods 0.000 description 5

- 238000005286 illumination Methods 0.000 description 5

- 230000008901 benefit Effects 0.000 description 4

- 238000004590 computer program Methods 0.000 description 4

- 238000010586 diagram Methods 0.000 description 2

- 230000000694 effects Effects 0.000 description 2

- 239000000835 fiber Substances 0.000 description 2

- 230000006872 improvement Effects 0.000 description 2

- 238000012545 processing Methods 0.000 description 2

- 230000009467 reduction Effects 0.000 description 2

- 238000012546 transfer Methods 0.000 description 2

- 230000002776 aggregation Effects 0.000 description 1

- 238000004220 aggregation Methods 0.000 description 1

- 230000005540 biological transmission Effects 0.000 description 1

- 230000015556 catabolic process Effects 0.000 description 1

- 238000004891 communication Methods 0.000 description 1

- 230000000295 complement effect Effects 0.000 description 1

- 238000012790 confirmation Methods 0.000 description 1

- 230000002596 correlated effect Effects 0.000 description 1

- 230000008878 coupling Effects 0.000 description 1

- 238000010168 coupling process Methods 0.000 description 1

- 238000005859 coupling reaction Methods 0.000 description 1

- 238000006731 degradation reaction Methods 0.000 description 1

- 238000001514 detection method Methods 0.000 description 1

- 239000004744 fabric Substances 0.000 description 1

- 238000004519 manufacturing process Methods 0.000 description 1

- 239000011159 matrix material Substances 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 239000005022 packaging material Substances 0.000 description 1

- 238000012856 packing Methods 0.000 description 1

- 230000005855 radiation Effects 0.000 description 1

- 230000008707 rearrangement Effects 0.000 description 1

- 230000011218 segmentation Effects 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/50—Depth or shape recovery

- G06T7/521—Depth or shape recovery from laser ranging, e.g. using interferometry; from the projection of structured light

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/20—Image signal generators

- H04N13/204—Image signal generators using stereoscopic image cameras

- H04N13/254—Image signal generators using stereoscopic image cameras in combination with electromagnetic radiation sources for illuminating objects

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/20—Image signal generators

- H04N13/271—Image signal generators wherein the generated image signals comprise depth maps or disparity maps

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/20—Image signal generators

- H04N13/296—Synchronisation thereof; Control thereof

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/76—Television signal recording

- H04N5/907—Television signal recording using static stores, e.g. storage tubes or semiconductor memories

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10028—Range image; Depth image; 3D point clouds

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Physics & Mathematics (AREA)

- Optics & Photonics (AREA)

- Computer Vision & Pattern Recognition (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Electromagnetism (AREA)

- Length Measuring Devices By Optical Means (AREA)

- Studio Devices (AREA)

- Measurement Of Optical Distance (AREA)

Description

本技術は、アクティブな深度感知に関連し、より具体的には、シーンの深度マップを発生させて、画像捕捉パラメータの改善と後捕捉画像処理とを促進することに関連する。

構造化された光アクティブ感知システムである画像化デバイスは、空間コード(または「コードワード」)に対応するパターンを送信および受信して、画像化デバイスからのシーン中の1つ以上のオブジェクトの距離を示す深度マップを発生させるように構成されている、送信機と受信機とを含んでいる。送出するコードワードと反射されて到来するコードワードの伝搬パスがより平行であることから、シーン中のオブジェクトが送信機と受信機から遠く離れるほど、オブジェクトから反射され、受信されるコードワードは、(送信されるコードワードと比較して)そのオリジナルのポジションから近くなる。逆に、オブジェクトが送信機と受信機に近くなるほど、受信されるコードワードは、送信されるコードワード中のそのオリジナルのポジションから遠くなる。したがって、受信されるコードワードのポジションと対応する送信されるコードワードのポジションとの間の差を、シーン中のオブジェクトの深度を決定するために使用してもよい。構造化された光アクティブ感知システムは、これらの決定した深度を使用して、シーンの3次元表現であってもよい、シーンの深度マップを発生させてもよい。多くのアプリケーションは、画像品質向上およびコンピュータビジョン技術を含む、シーンの深度マップを決定することから利益を得ることができる。

いくつかの態様では、深度マップを発生させることは、コードワードを検出することを含んでいてもよい。いくつかの態様では、コードワードは、シンボルのアレイを含んでいてもよい。デコーディングフィルタは、コードワードとシンボルとに対する空間境界を識別してもよく、これらの強度値に基づいて、例えば、「0」または「1」のようにシンボルを分類してもよい。デコーディングフィルタは、到来基底関数を分類するために、可能性あるコードワードのセットを規定するために使用される調和基底関数のセットに対応する、マッチドフィルタを使用してもよい。したがって、深度マップ精度は、シンボル、コードワード、および/または、基底関数を正確に受信することに依存する。

パターンを投影するために使用される光源(例えば、レーザー)が薄暗すぎる場合、より明るいシンボルに対応するスポットは、より暗いシンボルから区分するのには暗すぎるかもしれない。したがって、デジタル画像化アプリケーションのための深度マップ発生を向上させるための方法とシステムに対する必要性がある。

本発明のシステム、方法、およびデバイスはそれぞれ、いくつかの態様を有し、これらのうちのいずれも、その望ましい属性を単独で担うものではない。以下の特許請求の範囲によって表される本発明の範囲を限定することなく、いくつかの特徴を簡単に議論する。この議論を考慮した後、特に「詳細な説明」と題されたセクションを読んだ後、当業者は、向上した深度マップ発生を含む利点を本発明の特徴がどのように提供するかを理解するだろう。

開示している1つの実施形態は、画像化デバイスである。画像化デバイスは、第1の解像度で第1の被写界深度を有する構造化された光パターンと第1の解像度で第2の被写界深度を有する第2の構造化された光パターンとを発生させるように構成されている第1の送信機を含む複数の送信機と、第1の被写界深度内に焦点を合わせて、第1の構造化された光パターンを受け取り、第1の構造化された光パターンを表す第1の画像を捕捉するように、および、第2の被写界深度内に焦点を合わせて、第2の構造化された光パターンを受け取り、第2の構造化された光パターンを表す第2の画像を捕捉するように構成されている受信機と、第1の画像と第2の画像とに基づいて、シーンの深度マップを発生させるように構成されている電子ハードウェアプロセッサとを含み、第2の被写界深度は、第1の被写界深度よりも広い。

いくつかの態様では、電子ハードウェアプロセッサは、発生させた深度マップに基づいて、第3の画像の画像捕捉パラメータを調節し、画像捕捉パラメータを使用して、第3の画像を捕捉するようにさらに構成されている。いくつかの態様では、電子ハードウェアプロセッサは、深度マップに基づいて、第3の画像の、開口、シャッタースピード、または、照度パラメータのうちの1つ以上を調節するように構成されている。いくつかの態様では、電子ハードウェアプロセッサは、深度マップと第3の画像とのうちの1つ以上を安定記憶装置に記憶させるようにさらに構成されている。いくつかの態様では、第1の送信機は、画像化デバイスから第1の距離で第1の最大解像度を有する、第1の構造化された光パターンを発生させるように構成され、第2の送信機は、画像化デバイスから第2の距離で第1の構造化された光パターンよりも低い第2の最大解像度を有する、第2の構造化された光パターンを発生させるように構成されている。いくつかの態様では、第1の距離と第2の距離は、等しい。いくつかの態様では、第1の距離は、第2の距離とは異なる。いくつかの態様では、第1の送信機は、第2の被写界深度とオーバーラップする、第1の被写界深度を発生させるように構成されている。いくつかの態様では、第1の送信機は、第2の被写界深度内に含まれる第1の被写界深度を発生させるように構成されている。

開示している別の態様は、画像化デバイスにより画像を捕捉する方法である。方法は、第1の発光体を使用して、第1の解像度で第1の被写界深度を有する第1の構造化された光パターンをシーン上に発生させることと、電子ハードウェアプロセッサを介して、第1の被写界深度内に画像化センサの焦点を合わせて、第1の構造化された光パターンによって照光されたシーンを表す第1の画像を捕捉することと、第2の発光体を使用して、第1の解像度で第2の被写界深度を有する第2の構造化された光パターンを発生させることと、第2の被写界深度内に画像化センサの焦点を合わせて、第2の構造化された光パターンによって照光されたシーンを表す第2の画像を捕捉することと、電子ハードウェアプロセッサを使用して、第1の画像と第2の画像とに基づいて、シーンの深度マップを発生させることと、深度マップに基づいて、画像捕捉パラメータを決定することと、画像化センサを使用して、画像捕捉パラメータに基づいて、シーンの第3の画像を捕捉することと、第3の画像を安定記憶装置に記憶させることとを含み、第2の被写界深度は、第1の被写界深度よりも広い。いくつかの態様では、深度マップに基づいて、第3の画像の、開口、シャッタースピード、または、照度パラメータのうちの1つ以上を調節することを含む。いくつかの態様では、方法は、深度マップを安定記憶装置に記憶させることを含む。いくつかの態様では、方法は、画像化デバイスから第1の距離で第1の最大解像度を有する、第1の構造化された光パターンを発生させることを含み、第2の送信機は、画像化デバイスから第2の距離で第1の構造化された光パターンよりも低い第2の最大解像度を有する、第2の構造化された光パターンを発生させるように構成されている。いくつかの態様では、第1の距離と第2の距離は、等しい。いくつかの態様では、第1の距離は、第2の距離とは異なる。いくつかの態様では、方法は、第2の被写界深度とオーバーラップする、第1の被写界深度を発生させることを含む。いくつかの態様では、方法は、第2の被写界深度内に含まれる第1の被写界深度を発生させることを含む。

開示している別の態様は、命令を含む非一時的コンピュータ読取可能記憶媒体であり、命令は、実行されるとき、プロセッサに、画像化デバイスにより画像を捕捉する方法を実行させる。方法は、第1の発光体を使用して、第1の解像度で第1の被写界深度を有する第1の構造化された光パターンをシーン上に発生させることと、電子ハードウェアプロセッサを介して、第1の被写界深度内に画像化センサの焦点を合わせて、第1の構造化された光パターンによって照光されたシーンを表す第1の画像を捕捉することと、第2の発光体を使用して、第1の解像度で第2の被写界深度を有する第2の構造化された光パターンを発生させることと、第2の被写界深度内に画像化センサの焦点を合わせて、第2の構造化された光パターンによって照光されたシーンを表す第2の画像を捕捉することと、電子ハードウェアプロセッサを使用して、第1の画像と第2の画像とに基づいて、シーンの深度マップを発生させることと、深度マップに基づいて、画像捕捉パラメータを決定することと、画像化センサを使用して、画像捕捉パラメータに基づいて、シーンの第3の画像を捕捉することと、第3の画像を安定記憶装置に記憶させることとを含み、第2の被写界深度は、第1の被写界深度よりも広い。

いくつかの態様では、非一時的コンピュータ読取可能記憶媒体の方法は、画像化デバイスから第1の距離で第1の最大解像度を有する、第1の構造化された光パターンを発生させることを含み、第2の送信機は、画像化デバイスから第2の距離で第1の構造化された光パターンよりも低い第2の最大解像度を有する、第2の構造化された光パターンを発生させるように構成されている。いくつかの態様では、第1の距離と第2の距離は、等しい。

図面に図示したさまざまな特徴は、スケーリングして描かれていないかもしれない。したがって、さまざまな特徴の寸法は、明確化のために任意に拡大または縮小されているかもしれない。さらに、点線または破線およびオブジェクトは、オプション的特徴を示しているかもしれず、あるいは、コンポーネントの構成を示すために使用されているかもしれない。さらに、図面のうちのいくつかは、所定のシステム、方法、または、デバイスのコンポーネントのすべてを描いていないかもしれない。最後に、明細書および図の全体を通して、同様の参照番号は、同様の特徴を示すために使用している。

新規のシステム、装置、および方法の多様な態様を、添付の図面を参照して以下でより十分に説明する。しかしながら、本開示の教示は、多くの異なる形態で具現化することができ、本開示の全体に渡って提示される任意の特定の構造または機能に限定されると解釈すべきではない。むしろ、本開示が、徹底的および完全になり、本開示の範囲を当業者に完全に伝えるように、これらの態様を提供している。本開示の他の何らかの態様から独立して実現するかまたは本開示の他の何らかの態様と組み合わせて実現するかにかかわらず、本開示の範囲が、ここで開示する新規なシステム、装置、および方法の任意の態様をカバーするように意図していることを、ここでの教示に基づいて、当業者は認識すべきである。例えば、ここで述べる任意の数の態様を使用して、装置を実現してもよく、または、方法を実施してもよい。さらに、ここで述べる本開示のさまざまな態様に加えて、または、ここで述べる開示のさまざまな態様以外の、他の構造、機能性、または、構造および機能性を使用して実施するこのような装置または方法をカバーすることを、本開示の範囲は意図している。ここで開示する任意の態様は、請求項の1つ以上の要素によって具現化してもよいことを理解すべきである。

さらに、特定の態様をここで説明するが、これらの態様の多くのバリエーションおよび並べ替えが本開示の範囲内に入る。さらに、本開示の範囲は、ここで開示する特定の利益、使用、または、目的に限定するように意図されていない。むしろ、本開示の態様は、異なるワイヤードおよびワイヤレステクノロジー、システムコンフィギュレーション、ネットワーク、ならびに、送信プロトコルに広く適用可能であるように意図されており、それらのうちのいくつかを、図面中で、および、好ましい態様の以下の説明中で例として示している。詳細な説明および図面は、限定よりむしろ、本開示の例示に過ぎず、本開示の範囲は、添付した特許請求の範囲およびそれらの均等物によって規定される。

図1は、構造化された光送信機102と受信機104を示している。アクティブ感知は、送信機102からの一意的なパターン(またはコード)をシーンに投影してもよく、受信機104においてこれらのパターンの反射を受信する。送信機102によって投影されるパターンまたはコードのサイズは、最も小さい検出可能なオブジェクトに影響を与える。さらに、送信機102と受信機104の両方は、ある深度平面において「帯域調整」され、シ−ンにおける深度はその平面から離れて移動するにつれて帯域制限される。

いくつかの態様では、送信機は、特定の深度に、例えば、106a〜bによって表した深度のいずれかに焦点が合っている構造化された光パターン105を送信するように構成されていてもよい。送信機は、さまざまな深度106a〜bにおける視野108を有している構造化された光パターンを生成させてもよい。

受信機は、さまざまな深度106a〜bのうちの1つ以上において、構造化された光パターン105を受信するように調整されていてもよい。受信機104によって受信される深度に依存して、構造化された光パターン105においてエンコードされる情報は、ポジション110aおよび110bによって示すように、画像化センサ108上のさまざまなポジションで受信機中の画像化センサ108によって受信されてもよい。

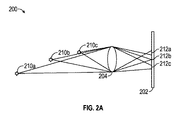

図2Aは、レンズと画像化センサとを含む受信機を示している。オブジェクト210a〜cとして示すように、画像化センサ202が異なる深度で複数のオブジェクトから反射される光情報を、レンズ204を介して受信できることを、図2Aは明らかにしている。オブジェクト210a〜cの深度に依存して、画像化センサにおける、反射された光の品質は変化する。例えば、オブジェクト210bから反射される光は、ポイント212bとして画像化センサ202の表面に焦点が合ってはっきりと示されている。対照的に、212aとしてオブジェクト210aから反射された光は、画像化センサ202の幾分前方に焦点が合っているかもしれず、212cとして示されるオブジェクト210cから反射された光は、画像化センサ202の背後に焦点が合っている。これは、結果として、オブジェクト210bと比較して、オブジェクト210aと210cを感知するために利用可能な光の帯域幅を低減させるかもしれない。

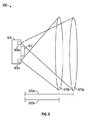

図2Bは、オブジェクトによって反射され、受信機によって受信される光の帯域幅が、オブジェクトの距離によってどのように影響されるかを明らかにするグラフ250を示している。これは、結果として、カメラの焦点面から離れて位置付けられている小さなオブジェクトを、画像化デバイスのカメラのような受信機が感知することを困難にするかもしれない。

図3Aは、回折光学素子を利用する送信機を示している。図3Aは、送信面の複数のロケーション304a〜cから放射される光を示している。光が回折光学素子302を通過すると、ポイント306bによって示される焦点面に焦点が合う。しかしながら、送信機は、深度306aと306cによって示すような、シーン内の異なる深度で、同じ焦点が合った光を提供することができない。

図3Bは、図3Aに関して上記で説明した効果により、送信機の帯域幅が距離によってどのように変化するかを明らかにするグラフ350である。

図4Aは、構造化された光パターンのカバレッジのより広い範囲を提供するために、2つの発光体が単一のデバイスにどのように組み合わせられるかを示している。図4Aは、発光体402aと402bを示しており、これらは、単一の画像化デバイス中に含められていてもよい。2つの発光体402a〜bは、それぞれ回折光学素子404a〜bを含んでいる。2つの発光体402a〜bは、406a〜bでそれぞれ示すように、異なる焦点距離に調整される。このようなコンフィギュレーションの結果は、以下で議論するように図4Bで示している。

図4Bは、図4Aの2つの発光体402a〜bを装備した画像化デバイスの受信範囲を示している。示しているように、受信範囲450は、発光体402aによって提供される第1の深度感知ゾーン452aと、発光体402bによって提供される第2の深度感知ゾーン452bとを含んでいる。

図5Aは、受信機と3つの送信機または発光体の例示的なコンフィギュレーションを示している。図5Aの例示的なコンフィギュレーションにおいて、3つの送信機504a〜cは、すべて受信機502と同じ水平側に位置付けられているが、各送信機504a〜cは、受信機502から異なる距離にある。このように、送信機504a〜cは、506a〜cによって示す組み合わせた構造化された光パターンを発生させる。各構造化された光パターン506a〜cのシーン中のオブジェクトからの反射は、3つの送信機405a〜cの異なるポジションに基づいて、異なるレベルの妨げを有していてもよい。3つの構造化された光パターン506a〜cによって提供されるオーバーラップするカバレッジは、他の送信機のコンフィギュレーションを利用するデバイスと比較するとき、向上した深度感知を提供する。

図5Bは、受信機と2つの送信機または発光体の別の例示的なコンフィギュレーションを示している。図5Bの例示的なコンフィギュレーションにおいて、2つの送信機は、異なる焦点深度である構造化された光パターンを提供するように設計されている。構造化された光パターン546a〜bによって示すように、送信機544aは、結果として、構造化された光パターン546aに対してより広い視野となる、より長い焦点深度を提供するように設計されている。対照的に、送信機544bは、結果として、構造化された光パターン546bに対して、より高い解像度とより狭い視野となる、より短い焦点深度を提供するように設計されている。2つの構造化された光パターン546a〜bによって提供される相補的なカバレッジは、他の送信機コンフィギュレーションを利用するデバイスと比較するとき、向上した深度感知を提供する。

図5Cは、受信機と2つの送信機の別の例示的なコンフィギュレーションを示している。コンフィギュレーション560において、送信機544a〜bは、受信機562の両方の側に位置付けられている。したがって、2つの送信機544a〜bによって放射される構造化された光パターンは、妨げから最小限の劣化を受ける深度情報から発生させる深度マップを提供する。例えば、オブジェクトの特定の側が送信機544aから妨げられる範囲まで、送信機544bは、オブジェクトのその側を照光するポジションにあってもよく、深度情報を受信機562に提供してもよい。

図6は、シーン中の1つ以上のオブジェクトに対して深度がどのように感知されるかの例を図示している。図6に関しての説明は、構造化された光を利用する画像シーンの1つ以上の深度を決定するために、開示した実施形態のうちのいずれかによって使用してもよい。図6は、送信機102と受信機104とを含むデバイス600を示している。デバイスは、コードワード投影610として送信機102から放射される構造化された光で、2つのオブジェクト606と608を照光している。コードワード投影610は、オブジェクト606および/または608から反射し、反射されたコードワード611としてセンサ平面607上で受信機104によって受信される。

図示した態様において、送信機102は、受信機104と同じ基準平面(例えば、レンズ平面605)上にある。送信機102は、開口613を通して、コードワード投影610をオブジェクト606と608に投影する。

コードワード投影610は、オブジェクト606を、投影されるセグメント612’として照光し、オブジェクト608を、照光されるセグメント612’’として照光する。投影されるセグメント612’と612’’とが、受信機開口615を通して受信機104によって受信されるとき、反射されたコードワード111は、第1の距離d1における、オブジェクト608から発生された反射と、第2の距離d2における、オブジェクト606から発生された放射とを示している。

図6によって示すように、オブジェクト606は、送信機102のより近く(例えば、送信機デバイスから第1の距離)に位置付けられていることから、投影されるセグメント612’は、その最初のロケーションから距離d2で現れる。対照的に、オブジェクト608は、さらに離れて(例えば、送信機102から第2の距離)位置付けられていることから、投影されるセグメント612’’は、その最初のロケーションから距離d1で現れる(ここで、d1<d2である)。すなわち、オブジェクトが送信機/受信機から離れるほど、投影され受信されるセグメント/部分/ウィンドウは、受信機104におけるそのオリジナルポジションからより近くなる(例えば、送出投影と到来投影がより平行である)。逆に、オブジェクトが送信機/受信機から近くなるほど、投影され受信されるセグメント/部分/ウィンドウは、受信機104におけるそのオリジナルポジションからより遠くなる。したがって、受信されおよび送信されるコードワードポジション間の差は、オブジェクトの深度のインジケータとして使用してもよい。1つの例では、このような深度(例えば、相対深度)は、画像中の各ピクセルまたはグループ化したピクセル(例えば、2つ以上のピクセルの領域)によって描かれるオブジェクトに対する深度値を提供してもよい。

さまざまなタイプの変調およびコーディングスキームを使用して、コードワード投影またはコードマスクを発生させてもよい。これらの変調およびコーディングスキームは、時間コーディング、空間コーディング、および、直接コード化を含む。

時間コーディングにおいて、パターンは、測定する表面に連続して(例えば、経時的に)投影される。この技術は、高い精度と解像度を有しているが、動的シーンに対してはあまり適していない。

空間コーディングにおいて、情報は、形状とパターンとに基づいて、局所近傍中にエンコードされる。擬似ランダムコードは、コードブックを規定するド・ブラウンまたはMアレイ(例えば、m−ary強度またはカラー変調)に基づいていてもよい。パターンセグメンテーションは、例えば、形状およびパターンが歪んでいる場合、容易に達成できないかもしれない。

直接コード化において、水平および垂直ピクセルの両方の座標がエンコードされる。変調は、単調位相または強度波形によるものであってもよい。しかしながら、このスキームは、他の方法に対して利用されるコードブックよりも大きいコードブックを利用するかもしれない。多くの方法において、受信されるコードワードは、(例えば、コードブック中の)可能性あるコードワードの規定したセットに対して相関されるかもしれない。したがって、コードワードの小さなセット(例えば、小さなコードブック)の使用は、より大きなコードブックよりも、よりよい性能を提供するかもしれない。また、より大きなコードブックは、結果としてコードワード間のより小さな距離になることから、より大きなコードブックを使用するインプリメンテーションによって、追加のエラーを経験するかもしれない。

[0053]

コードマスクを通してライトを光らせることにより、構造化された光パターンをシーン上に投影してもよい。コードマスクを通して投影されるライトは、1つ以上のモザイク状のコードマスクプリミティブを含んでいてもよい。各コードマスクプリミティブは、空間コードのアレイを含んでいてもよい。コードブックまたはデータ構造は、コードのセットを含んでいてもよい。空間コード、コードマスク、および、コードマスクプリミティブは、基底関数を使用して発生させてもよい。基底関数の周期性は、(ゴースト画像をなくし、製造を単純化するための)エルミート対称性の集約パターンと、(コードワード毎の最小電力を確実にするための)最小デューティサイクルと、(最適な輪郭解像度と高い解像度に対するコードパッキングのための)完全なウィンドウ特性と、(オブジェクト境界上の向上した検出のための)ランダムシフトとに対する要件を満たすように選んでもよい。受信されたパターン中のエラーを復調し、デコードし、補正するとき、受信機は、制約に準拠するように意図されている設計の、コードブックおよび/または属性を使用してもよい。

空間コードのサイズおよび対応する解像度は、コードマスク上の空間コードの物理的空間範囲に対応する。サイズは、各コードワードを表す行列の行と列の数に対応していてもよい。コードワードが小さいほど、検出できるオブジェクトはより小さくなる。例えば、シャツ上のボタンとシャツの布との間の深度差を検出して決定するために、コードワードは、ボタンのサイズほどの大きさであるべきである。実施形態において、各空間コードは、4つの行と4つの列を占有していてもよい。実施形態において、コードは、例えば、3×3、4×4、4×5、5×5、6×4、または、10×10の行と列を占有するために、より多くのまたはより少ない行と列(行×列)、を占有してもよい。

空間コードの空間表現は、各コードワード要素がコードマスク上にどのようにパターン化され、その後、シーンに投影されるかに対応する。例えば、各コードワード要素は、1つ以上のドット、1つ以上の線セグメント、1つ以上のグリッド、他の何らかの形状、または、これらのいくつかの組み合わせを使用して表されていてもよい。

空間コードの「デューティサイクル」は、コードワード中の、非アサートビットまたは部分(例えば、「0」)の数に対する、アサートビットまたは部分(例えば、「1」)の数の比に対応する。コードワードを含むコード化された光パターンがシーンに投影されるとき、「1」の値を有する各ビットまたは部分は、エネルギー(例えば、「光エネルギー」)を有しているかもしれないが、「0」の値を有する各ビットは、エネルギーを持っていないかもしれない。コードワードを容易に検出可能にするために、コードワードは、十分なエネルギーを有するべきである。低いエネルギーのコードワードは、検出することがより難しいかもしれず、ノイズをより受けやすいかもしれない。例えば、コードワード中のビットのうちの8つ以上が「1」である場合、4×4コードワードは、50%以上のデューティサイクルを有している。個々のコードワードに対する最小(または最大)デューティサイクル制約、すなわち、デューティサイクル制約、例えば、コードブック中のコードのセットに対する平均デューティサイクルがあってもよい。

コードの「輪郭解像度」または「完全なウィンドウ」特性は、量、例えば、1ビットの回転、だけコードワードがシフトされるときに、結果として生じるデータが、別のコードワードを表すことを示す。コードワードがシフトされる量は、シフト量と呼ばれることがある。高輪郭解像度を有するコードは、構造化された光深度感知システムが、比較的小さなオブジェクトの境界を認識し、異なるオブジェクトに対する認識の連続性を提供することを可能にするかもしれない。行次元における1と列次元における2のシフト量は、行次元に沿って右に1ビットのポジションだけ、そして、列次元に沿って下に2ビットのポジションだけシフトすることに対応していてもよい。コードワードの高輪郭解像度のセットは、一度に、受信された画像上のウィンドウを1行または1列移動させることを可能にし、各ウィンドウポジションにおける深度を決定する。これは、受信された画像の3行目と3列目に中心を置いた開始点で5×5ウィンドウを使用して、5×5ウィンドウを3行目から最後から3行目へ、3列目から最後から3列目へと、各行、列ロケーションに移動させて、深度の決定を可能にする。コードワードがオーバーラップするとき、決定されるオブジェクト(例えば、シャツ上のボタン)の深度の解像度に基づいて、ウィンドウをサイズ変更してもよい。

コードの対称性は、コードマスクまたはコードブックプリミティブがエルミート対称性を有していることを示してもよく、エルミート対称性は、非エルミート対称性コードブックプリミティブまたはパターンを使用することと比較して、いくつかの利点を提供できる。エルミート対称性を有するパターンは、XとY(行と列)軸の両方に沿って、「反転している」または対称である。

コードマスクまたはコードマスクプリミティブのエイリアシング特性は、同じである2つのコードワード間の距離に対応する。光学パターンがモザイク状のコードブックプリミティブを含むとき、そして、プリミティブ中の各コードブックが一意的であるとき、エイリアシング距離は、コードブックプリミティブのサイズに基づいていてもよい。したがって、エイリアシング距離は、コードブックプリミティブの各コードワードがコードブックプリミティブの他のそれぞれのコードワードと異なり、コードブックプリミティブが全体として一意的であることを示す、一意性の基準を表していてもよい。エイリアシング距離は、1つ以上の受信機デバイスに知られていてもよく、コードワード復調の間のエイリアシングを回避するために使用してもよい。コードマスクの濃度は、コードブックプリミティブ中の一意的なコードの数に対応する。

図7は、回折光学素子の代替設計に対する画像化性能を示すグラフである。グラフ740は、回折光学素子の4つの仮定的な設計の光学性能を表す4つのグラフ742a〜dを示している。第1の設計は、約70cmの距離で最良の解像度744aを提供する。第2の設計は、約100cmの距離で最良の解像度の744bを提供する。第3の設計は、約150cmの距離で最良の解像度744cを提供する。第4の設計は、約200cmの距離で最良の解像度744dを提供する。

図1B中に示されている設計のそれぞれの光学性能はまた、例えば、0.7の基準解像度746において比較できる。基準解像度は、次のように説明できる;いくつかの態様では、最良の焦点が特定の設計によって達成されるときに、画像化されているシーンの空間中のポイントは、設計のレンズ上に円を生成させるだろう。この円は、回折限界に少なくとも部分的に基づいている。基準(最大)解像度は、1/円_直径であり;ポイントが最適な焦点から外れると、焦点がぼけることにより、円はより大きくなり、したがって、解像度を低下させる。任意の選択された低減、例えば0.7では、画像はもはや焦点が合っていない。

グラフ742aで表される第1の設計の光学性能は、基準解像度において第1の深度の被写界深度748aを提供する。グラフ742bによって表される第2の設計の光学性能は、基準解像度において第2の深度の被写界深度748bを提供し、これは、第1の被写界深度748aよりも大きい。第2の設計の被写界深度748bはまた、第1の設計の被写界深度748aと比べて画像化デバイスから異なる距離であることに留意すべきである。グラフ742cによって表される第3の設計の光学性能は、基準解像度において第3の深度の被写界深度748cを提供し、これは、第1および第2の被写界深度748a〜bの両方よりも大きい。第3の被写界深度748cはまた、画像化デバイスから異なる距離で提供される。第3の被写界深度748cは、第2の被写界深度748bといくらかオーバーラップすることに留意すべきである。グラフ742dによって表される第4の設計の光学性能は、基準解像度において第4の深度の被写界深度748dを提供し、これは、第1、第2、または、第3の被写界深度748a〜cのいずれよりも大きい。第4の被写界深度748dは、第3の被写界深度748cとオーバーラップするが、第4の被写界深度はまた、第1、第2、または、第3の被写界深度748a〜cと比べて画像化デバイスから異なる距離で提供される。

図8は、回折光学素子の代替設計に対する画像化性能を示すグラフである。図7中に示した設計は、画像化デバイスから異なる距離で、等しい解像度を達成する一方で、図8中に示した2つの設計の両方は、画像化デバイスから同じ距離(150cm)でこれらの最良の解像度を達成する。しかしながら、グラフ862aによって示される第1の設計は、グラフ862bによって示される第2の設計よりも、実質的により高い解像度を達成する。

しかしながら、グラフ862bによって示される光学性能を有する第2の設計は、被写界深度868aを有する第1の設計の光学性能862aよりも、基準解像度866において、より大きな被写界深度868bを提供する。

図9は、複数の構造化された光送信機を含む画像化デバイスの実例である。図9は、画像化デバイス905と2つの構造化された光送信機908a〜bを示している。構造化された光送信機908a〜bのそれぞれは、構造化された光パターン910a〜bをそれぞれ送信する。構造化された光パターン910a〜bのそれぞれは、異なる距離920a〜bでそれぞれ焦点が合っている。

受信機912は、構造化された光パターン910a〜bのそれぞれからパターン情報を受信してもよい。いくつかの態様では、受信機912は、可変焦点距離を有するレンズを含んでいてもよい。いくつかの態様では、受信機912が焦点距離920aに調節されるとき、画像化デバイス905は、第1の構造化された光パターン910aを放射するように構成されていてもよい。受信機は、その後、第1の構造化された光パターン910aによるシーンの照光に基づいて、第1の画像を捕捉するように構成されていてもよい。受信機912が異なる焦点距離920bに調節された後、画像化デバイス905は、第2の構造化された光パターン910bを発生させるように構成されていてもよい。受信機は、その後、シーンが第2の構造化された光画像によって照光されている間、第2の画像を捕捉するように構成されていてもよい。

画像化デバイス905は、第1の画像と第2の画像から深度情報を発生させるように構成されていてもよい。第1の構造化された光画像910aと第2の構造化された光画像910bのそれぞれは、画像化デバイスから異なる距離920a〜bで焦点が合っていることから、発生させた深度情報は、構造化された光パターン910a〜bのうちのいずれかのような、1つだけの構造化された光パターンから深度情報を発生させる場合よりも、より完全および/または正確であるかもしれない。

図10は、複数の放射体を含む、画像化デバイスの第2の実例である。図10の画像化デバイス1055は、発光体1058a〜bを含んでいる。発光体1058aは、画像化デバイス1055から1070aの中間距離で、構造化された光パターン1060aを発生させるように構成されている。第1の構造化された光パターン1060aは、発光体1058aによって発生され、1072aとして示される被写界深度を有する。第2の発光体1058bは、構造化された光パターン1060bを発生させるように構成されている。構造化された光パターン1060bは、1072bの被写界深度を有している。構造化された光パターン1060bの被写界深度1072bは、実質的に、発光体1058aによって発生された第1の構造化された光パターン1060aの被写界深度1072a内にある。

いくつかの態様では、構造化された光パターン1060aは、第1の解像度において発生させてもよく、第2の構造化された光パターン1060bは、第1の解像度よりも高い第2の解像度において発生させてもよい。

受信機1062は、構造化された光パターン1060a〜bのそれぞれから情報を受信してもよい。いくつかの態様では、受信機1062は、可変焦点距離を有するレンズを含んでいてもよい。いくつかの態様では、受信機1062が焦点距離1070aに調節されるとき、画像化デバイス1055は、第1の構造化された光パターン1058aを放射するように構成されていてもよい。受信機は、その後、第1の構造化された光パターン1060aによるシーンの照光に基づいて、第1の画像を捕捉するように構成されていてもよい。受信機1062が異なる焦点距離1070bに調節された後、画像化デバイス1055は、その後、第2の構造化された光パターン1060bを発生させるように構成されていてもよい。受信機は、その後、シーンが第2の構造化された光画像によって照光されている間、第2の画像を捕捉するように構成されていてもよい。

図11は、複数の放射体を含む画像化デバイスの第3の実例である。図11の画像化デバイス1105は、発光体1108a〜bを含んでいる。発光体1108aは、画像化デバイス1105から1120aの中間距離で構造化された光パターン1110aを発生させるように構成されている。第1の構造化された光パターン1110aは、発光体1108aによって発生され、1122aとして示される被写界深度を有する。第2の発光体1108bは、構造化された光パターン1110bを発生させるように構成されている。構造化された光パターン1110bは、1122bの被写界深度を有している。構造化された光パターン1110bの被写界深度1122bは、発光体1108aによって発生させた第1の構造化された光パターン1110aの被写界深度1122aよりも狭い。さらに、図10の被写界深度1022a〜bとは異なり、図11中の2つの構造化された光パターン1110a〜bの被写界深度は、実質的にオーバーラップしない。

いくつかの態様では、構造化された光パターン1110aは、第1の解像度において発生させてもよく、第2の構造化された光パターン1110bは、第1の解像度よりも高い第2の解像度において発生させてもよい。

受信機1112は、構造化された光パターン1110a〜bのそれぞれからのパターン情報を受信してもよい。いくつかの態様では、受信機1112は、可変焦点距離を有するレンズを含んでいてもよい。いくつかの態様では、受信機1112が焦点距離1120aに調節されるとき、画像化デバイス1105は、第1の構造化された光パターン1110aを放射するように構成されていてもよい。受信機は、第1の構造化された光パターン1110aによるシーンの照光に基づいて、第1の画像を捕捉するように構成されていてもよい。受信機1112が異なる焦点距離1120bに調節された後、画像化デバイス1105は、その後、第2の構造化された光パターン1110bを発生させるように構成されていてもよい。受信機は、その後、シーンが第2の構造化された光画像によって照光されている間、第2の画像を捕捉するように構成されていてもよい。

いくつかの態様では、デバイス1105は、3つ以上の放射体を含んでいてもよい。例えば、いくつかの態様では、第1の発光体は、画像化デバイス1105から50センチメートルから4メートルの被写界深度を有する構造化された光パターンを発生させてもよい。第2の発光体は、画像化デバイス1105から30cmから50cmの被写界深度を有する第2の構造化された光パターンを発生させるように構成されていてもよい。第3の発光体は、画像化デバイス1105から20cmから30cmの被写界深度を有する第3の構造化された光パターンを発生させるように構成されていてもよい。

図12は、複数の放射体を含む画像化デバイスの第4の実例である。図12の画像化デバイス1205は、発光体1208a〜cを含んでいる。図9〜11それぞれで示した発光体908a〜b、1008a〜b、1108a〜bとは異なり、発光体1208a〜cは、受信機1214の同じ側ではあるが異なる距離に位置付けられている。

発光体1208aは、画像化デバイス1205から1220aの中間焦点距離で、構造化された光パターン1210aを発生させるように構成されている。第2の発光体308は、中間焦点距離1220aで、構造化された光パターン1210bを発生させるように構成されている。発光体1208cは、中間焦点距離1220aで、構造化された光パターン1210cを発生させるように構成されている。いくつかの態様では、受信機1212から異なる距離である発光体1208a〜cから構造化された光パターン1210a〜cを発生させることにより、シーン1201中のオブジェクトは、構造化された光パターン1210a〜cのそれぞれに対して、異なるレベルの妨げを有していてもよい。このようなことから、例えば、シーン1201を照光するためにより少ない発光体を使用する画像化デバイスと比較するとき、画像化デバイス1205は、シーン1201に対する向上した深度情報を導出することが可能であるかもしれない。

受信機1212は、構造化された光パターン1210a〜cのそれぞれからパターン情報を受信してもよい。いくつかの態様では、画像化デバイス1205は、第1の構造化された光パターン1208aを放射するように構成されていてもよい。受信機1212は、その後、第1の構造化された光パターン1210aによるシーンの照光に基づいて、第1の画像を捕捉するように構成されていてもよい。画像化デバイス1205は、その後、第2の構造化された光パターン1210bを発生させるように構成されていてもよい。シーンが第2の構造化された光パターン1210bによって照光されている間、受信機1212は、第2の画像を捕捉するように構成されていてもよい。画像化デバイス1205は、その後、第3の構造化された光パターン1210cを発生させるように構成されていてもよい。シーンが第3の構造化された光パターン1210cによって照光されている間、受信機1212は、第3の画像を捕捉するように構成されていてよい。

画像化デバイス1205は、第1、第2、および、第3の画像からの情報を組み合わせて、深度マップを発生させるように構成されていてもよい。深度マップは、シーン1201に対するより完全な深度情報および/またはより正確な深度情報を含んでいてもよい。

図13は、開示した実施形態を実現する例示的なデバイスのブロックダイヤグラムである。デバイス1300は、図10〜12に関して上記で示したデバイス1005、1055、1105、または、1205のうちのいずれかの実施形態であってもよい。デバイス1300は、少なくとも2つの発光体1308a〜bと画像化センサ1312を含んでいる。2つの発光体1308a〜bは、図10〜12に関して上記で議論した発光体208a〜b、1058a〜b、308a〜b、408a〜bのうちのいずれかを表していてもよい。画像化センサ1312は、上記で議論した画像化センサ912、1062、1112、1312、または、1212のうちのいずれかを表していてもよい。

デバイス1300はまた、電子ハードウェアプロセッサ1340と、プロセッサ1340に動作可能に結合されている電子ハードウェアメモリ1345と、プロセッサ1340に動作可能に結合されている電子ディスプレイ1350と、プロセッサ1340に動作可能に結合されている記憶装置1360も含んでいる。メモリ1345は、ここで議論する1つ以上の機能を実行するようにプロセッサを構成する命令を記憶する。いくつかの態様では、命令は、これらの機能性の議論を促進するために、モジュールで編成されていてもよい。例えば、図13のデバイス1300の命令は、構造化された光モジュール1346a、深度マップモジュール1346b、および、画像捕捉モジュール1346cで編成される。

図14は、深度マップを発生させる例示的な方法のフローチャートである。いくつかの態様では、プロセス1400は、図13に関して上記で議論したデバイス1300によって実行してもよい。代替的に、プロセス1400は、図1、4A〜C、5A〜C、または、9〜12中に示した、画像化デバイスのうちのいずれかによって、および/または、画像化コンフィギュレーションのうちのいずれかを使用して、実行してもよい。

プロセス1400は、向上した深度感知を提供してもよい。上記で議論したように、アクティブ感知のための既存の設計は、一意的なパターンまたはコードを投影することまたは検出することに依存しているかもしれない。パターンのサイズは、最も小さい検出可能なオブジェクトを決定するかもしれない。構造化された光送信機と受信機の両方は、ある深度面に帯域同調されてもよく、画像化されているシーン中のオブジェクトが入る深度面からさらに遠くに帯域制限されてもよい。これらの状況下で、発光デバイスは、オブジェクトがある焦点面からさらに遠くに、構造化された光コードを投影するように要求されるかもしれない。

プロセス1400のいくつかの態様は、構造化された光受信機としてオートフォーカスカメラを利用し、画像化されているシーンに基づいて、焦点範囲をシフトさせてもよい。異なる深度に焦点が合っている複数の構造化された光送信機を利用してもよい。送信機のサブセットは、シーン特性に、おそらくは他の考慮に依存して選択してもよい。

ブロック1405において、第1の構造化された光パターンをシーン上に発生させる。いくつかの態様では、第1の構造化された光パターンは、例えば、発光体1308a〜bのうちの1つによって発生される。いくつかの態様では、第1の構造化された光パターンは、上記で説明したような、回折光学素子を通して投影されるレーザーによって発生させてもよい。これらの態様において、第1の構造化された光パターンを発生させるために使用される回折光学素子は、第1の被写界深度を有する第1の構造化された光パターンを提供するように構成されている。いくつかの態様では、第1の構造化された光パターンを発生させる発光体は、第1の構造化された光パターンを捕捉するように構成されている受信機または画像化センサから第1の距離である。

ブロック1410において、レンズを調節して、第1の被写界深度内に焦点を合わせる。例えば、いくつかの態様では、レンズは、デバイス1300に関して上記で議論した画像化センサ1312のような、画像化センサの一部であってもよい。

ブロック1415において、第1の被写界深度内に焦点を合わせながら、第1の画像をレンズで捕捉する。したがって、第1の画像は、シーン上に投影される第1の構造化された光パターンを表す。いくつかの態様では、第1の画像は、例示的なデバイス1300に関して上記で議論した画像化センサを使用して捕捉される。

ブロック1420において、第2の構造化された光パターンをシーン上に発生させる。いくつかの態様では、第2の構造化された光パターンは、第1の構造化された光パターンを発生させるために使用されたものとは異なる発光体を使用して発生させてもよい。いくつかの態様において、第2の構造化された光パターンは、発光体308〜bのうちの1つによって発生させてもよい。第2の構造化された光パターンは、レーザー光源を照光することと、上記で議論したような第2の回折光学素子(DOE)を通して、光源を投影することによって発生させてもよい。これらの態様において、第2のDOEは、第1の構造化された光パターンの第1の被写界深度とは異なる第2の被写界深度を有するように、第2の構造化された光パターンを発生させるように構成されていてもよい。いくつかの態様において、被写界深度が画像化センサからまたは構造化された光パターンを捕捉するところから異なる距離に存在するという点で、被写界深度は、異なっていてもよい。いくつかの態様では、被写界深度が異なる幅のものであるという点で、被写界深度は、異なっていてもよい。言い換えると、1つの被写界深度は、例えば、20cmの深度であってもよい一方で、第2の被写界深度は、50cmの深度であってもよい。上記で議論したように、いくつかの態様では、2つの被写界深度は、実施形態のコンフィギュレーションに依存して、完全にまたは部分的にオーバーラップしていてもよく、あるいは、オーバーラップしていなくてもよい。

いくつかの態様では、第2の発光体は、画像化センサ1312または第1および第2の構造化された光パターンを捕捉するように構成されている受信機とは異なる第2の距離であってもよい。いくつかの態様では、第2の発光体は、第1および第2の構造化された光パターンを捕捉する画像化センサの等しい水平側にあってもよく、または、画像化センサの反対の水平側にあってもよい。いくつかの態様では、第1のDOEは、第1の最大解像度を使用して、第1の構造化された光パターンを発生させるように構成されていてもよい一方で、第2のDOEは、第1の解像度とは異なる(より高いまたはより低い)第2の最大解像度を有する、第2の構造化された光パターンを発生させるように構成されている。いくつかの態様では、第1および第2の構造化された光パターンは、構造化された光パターンを捕捉する受信機または画像化センサとは異なる(または等しい)距離でこれらの最大解像度を提供するように構成されていてもよい。

ブロック1425では、レンズを調節して、第2の被写界深度内に焦点を合わせる。ブロック1430では、第2の被写界深度内に焦点を合わせながら、第2の画像をレンズで捕捉する。したがって、第2の画像は、シーン上に投影された第2の構造化された光パターンを表す。いくつかの態様では、第2の画像は、画像化センサ1312によって捕捉されてもよい。

ブロック1435では、第1および/または第2の画像に基づいて、深度マップを発生させる。例えば、第1の被写界深度内の深度におけるシーン中に含まれるオブジェクトは、第1の画像に基づいて、深度マップ中に表されてもよい一方で、第2の被写界深度内の深度におけるシーン内のオブジェクトは、第2の画像から導出されたデータに基づいて、深度マップ中に表されてもよい。

いくつかの態様では、深度マップを発生させるために、第1および第2の画像のみを利用してもよい。例えば、いくつかの態様では、画像化されているシーンの特徴に基づいて、第1および第2の画像を利用してもよい。いくつかの態様では、画像中で提供される深度情報の品質レベルは、深度マップを発生させるために使用される最高品質の深度情報を含む画像により評価してもよい。品質レベルは、深度情報の量、あるいは、破損または欠落した深度情報の量に基づいていてもよい。いくつかの態様では、例えば、深度マップを発生させるために、最少量の欠落した深度情報を有する画像を利用してもよい。

プロセス1400は、発生させた深度マップを安定記憶装置(または記憶媒体)に書き込むことも含んでいてもよい。いくつかの態様では、深度マップに基づいて、第3の画像の1つ以上の画像捕捉パラメータを調節してもよい。例えば、いくつかの態様では、深度マップに基づいて、露光時間または(フラッシュ強度および/またはフラッシュが使用されるか否かのような)フラッシュ照光設定を修正してもよい。その後、1つ以上の画像捕捉パラメータを使用して、第3の画像を捕捉してもよい。捕捉の後、安定記憶装置または他のI/Oデバイスに第3の画像を書き込んでもよい。

以下の表1は、深度マップを発生させるときに、さまざまな利点を提供するように組み合わせてもよい回折光学素子のさまざまなコンフィギュレーションを示している。さまざまな実施形態において、プロセス1400は、深度マップを発生させるために、以下に示した例示的なコンフィギュレーションのうちのいずれかを利用してもよい。プロセス1400はまた、図4A〜C、5A〜C、および、7〜12のうちのいずれか1つにおいて、上記で示した例示的なコンフィギュレーションのうちのいずれかを利用してもよい。

表1において、第1および第2の構造化された光パターンに対する対応するブランクセルは、単一のコンフィギュレーションに渡って等しくてもよい。

用語「決定すること」は、ここで使用されるように、幅広い動作を含む。例えば、「決定すること」は、算出すること、計算すること、処理すること、導出すること、調査すること、ルックアップすること(例えば、表、データベースまたは別のデータ構造においてルックアップすること)、確認すること、および、これらに類するものを含んでいてもよい。また、「決定すること」は、受信すること(例えば、情報を受信すること)、アクセスすること(例えば、メモリ中のデータにアクセスすること)、および、これらに類するものを含んでいてもよい。また、「決定すること」は、解決すること、選択すること、選ぶこと、確立すること、および、これらに類するものを含んでいてもよい。さらに、ここで使用されるような「チャネル帯域」は、ある態様において、帯域幅を含んでもよく、または、帯域幅と呼ばれることもある。

ここで使用されるように、項目のリスト「のうちの少なくとも1つ」を指すフレーズは、単一のメンバ−を含む、それらの項目の任意の組み合わせを指す。例として、「a、b、またはc、のうちの少なくとも1つ」は、a、b、c、a−b、a−c、b−c、およびa−b−cをカバーするように意図されている。

上記に説明した方法のさまざまな動作は、さまざまなハードウェアおよび/またはソフトウェアのコンポーネント、回路、および/またはモジュールのような、動作を実行することができる任意の適切な手段によって実行してもよい。一般的に、図面中に図示した任意の動作は、動作を実行することが可能な対応する機能手段によって実行できる。

本開示に関連して説明した、さまざまな例示的な論理ブロック、モジュール、および、回路は、汎用プロセッサ、デジタル信号プロセッサ(DSP)、特定用途向け集積回路(ASIC)、フィールドプログラマブルゲートアレイ信号(FPGA)または他のプログラマブル論理デバイス(PLD)、ディスクリートゲートまたはトランジスタ論理、ディスクリートハードウェアコンポーネント、あるいは、ここで説明した機能を実行するように設計されたこれらの任意の組み合わせを用いて実現または実行してもよい。汎用プロセッサはマイクロプロセッサであってもよいが、代替実施形態では、プロセッサは、何らかの商業的に入手可能なプロセッサ、制御装置、マイクロ制御装置、または、状態機械であってもよい。プロセッサはまた、例えば、DSPとマイクロプロセッサとの組み合わせ、複数のマイクロプロセッサ、DSPコアに関連する1つ以上のマイクロプロセッサ、または、他の何らかのこのようなコンフィギュレーションのような、コンピューティングデバイスの組み合わせとして実現してもよい。

1つ以上の態様において、説明した機能は、ハードウェア、ソフトウェア、ファームウェア、または、これらの任意の組み合わせで実現してもよい。ソフトウェアで実現する場合、機能は、1つ以上の命令またはコードとしてコンピュータ読取可能媒体上に記憶されていてもよく、あるいは、1つ以上の命令またはコードとしてコンピュータ読取可能媒体上で送信されてもよい。コンピュータ読取可能媒体は、1つの場所から別の場所へのコンピュータプログラムの転送を促進する任意の媒体を含む、コンピュータ記憶媒体および通信媒体の両方を含んでいる。記憶媒体は、コンピュータによってアクセスできる何らかの利用可能な媒体であるかもしれない。限定ではなく例として、このようなコンピュータ読取可能媒体は、RAM、ROM、EEPROM(登録商標)、CD−ROMまたは他の光ディスク記憶装置、磁気ディスク記憶装置または他の磁気記憶デバイス、あるいは、コンピュータによってアクセスできる命令またはデータ構造の形態で所望のプログラムコードを運ぶまたは記憶するために使用できる他の何らかの媒体を含むことができる。また、任意の接続は、コンピュータ読取可能媒体と適切に呼ばれる。例えば、ソフトウェアが、ウェブサイト、サーバ、または、同軸ケーブル、光ファイバーケーブル、ツイストペア、デジタル加入者線(DSL)、あるいは、赤外線、無線、および、マイクロ波のようなワイヤレステクノロジーを使用する他の遠隔ソースから送信される場合、同軸ケーブル、光ファイバーケーブル、ツイストペア、DSL、または、赤外線、無線、および、マイクロ波のようなワイヤレステクノロジーは、媒体の定義に含まれる。ここで使用したようなディスク(diskおよびdisc)は、コンパクトディスク(CD)、レーザーディスク(登録商標)、光ディスク、デジタル汎用ディスク(DVD)、フロッピー(登録商標)ディスク、およびブルーレイ(登録商標)ディスクを含むが、通常、ディスク(disk)はデータを磁気的に再生する一方で、ディスク(disc)はデータをレーザーにより光学的に再生する。したがって、いくつかの態様では、コンピュータ読取可能媒体は、非一時的コンピュータ読取可能媒体(例えば、有形の媒体)を含んでいる。さらに、いくつかの態様では、コンピュータ読取可能媒体は、一時的コンピュータ読取可能媒体(例えば、

信号)を含んでいてもよい。先のものを組み合わせたものもまた、コンピュータ読取可能媒体の範囲内に含められるべきである。

ここで開示した方法は、説明した方法を達成するための1つ以上のステップまたは動作を備えている。方法のステップおよび/またはアクションは、特許請求の範囲から逸脱することなく、互いに交換可能であってもよい。言い換えると、ステップまたはアクションの特定の順序が指定されていない限り、特定のステップおよび/またはアクションの順序および/または使用を、特許請求の範囲から逸脱することなく修正してもよい。

説明した機能は、ハードウェア、ソフトウェア、ファームウェア、または、これらの任意の組み合わせで実現してもよい。ソフトウェアにおいて実現する場合、機能は、コンピュータ読取可能媒体上の1つ以上の命令として記憶されてもよい。記憶媒体は、コンピュータによってアクセスできる任意の利用可能な媒体であってもよい。限定ではなく例として、このようなコンピュータ読取可能媒体は、RAM、ROM、EEPROM、CD−ROM、または、他の光ディスク記憶装置、磁気ディスク記憶装置または他の磁気記憶デバイス、あるいは、コンピュータによってアクセスできる命令またはデータ構造の形態で所望のプログラムコードを運ぶまたは記憶するために使用できる他の何らかの媒体を含むことができる。ここで使用したような、ディスク(diskおよびdisc)は、コンパクトディスク(CD)、レーザーディスク、光ディスク、デジタル汎用ディスク(DVD)、フロッピーディスク、およびブルーレイディスクを含むが、一般的に、ディスク(disk)は、データを磁気的に再生する一方で、ディスク(disc)はデータをレーザーにより光学的に再生する。

したがって、ある態様は、ここで提示した動作を実行するためのコンピュータプログラム製品を備えていてもよい。例えば、このようなコンピュータプログラム製品は、その上に記憶されている(および/またはエンコードされている)命令を有するコンピュータ読取可能媒体を含んでいてもよく、命令は、ここで説明した動作を実行するために、1つ以上のプロセッサにより実行可能である。ある態様では、コンピュータプログラム製品は、パッケージングマテリアルを含んでいてもよい。

さらに、ここで説明した方法および技術を実行するためのモジュールおよび/または他の適切な手段をダウンロードでき、および/または、そうでなければ、ユーザ端末および/または基地局によって、適宜、得ることができることが理解されるべきである。例えば、このようなデバイスは、ここで説明した方法を実行する手段の転送を促進するように、サーバに結合することができる。代替的に、ここで説明したさまざまな方法は、記憶手段をデバイスに結合または提供する際に、ユーザ端末および/または基地局がさまざまな方法を取得することができるように、記憶手段(例えば、RAM、ROM、コンパクトディスク(CD)またはフロッピーディスクのような物理記憶媒体等)を介して提供することができる。さらに、ここで説明した方法および技術を提供するための、他の何らかの適切な技術が利用できる。

特許請求の範囲が、上記に例示されたまさにそのコンフィギュレーションおよびコンポーネントに限定されないことを理解すべきである。さまざまな修正、変更、および、バリエーションが、上記で説明した方法ならびに装置の構成、動作、および、詳細において、特許請求の範囲から逸脱することなく行われてもよい。

前述の内容は、本開示の態様に向けられているが、本開示の他の態様およびさらなる態様が、その基本的な範囲から逸脱することなく考案することができ、その範囲は、以下に続く特許請求の範囲によって決定される。

以下に、本願出願の当初の特許請求の範囲に記載された発明を付記する。

[1] 画像化デバイスにおいて、

第1の解像度で第1の被写界深度を有する構造化された光パターンと前記第1の解像度で第2の被写界深度を有する第2の構造化された光パターンとを発生させるように構成されている第1の送信機を含む複数の送信機と、

前記第1の被写界深度内に焦点を合わせて、前記第1の構造化された光パターンを受け取り、前記第1の構造化された光パターンを表す第1の画像を捕捉するように、および、前記第2の被写界深度内に焦点を合わせて、前記第2の構造化された光パターンを受け取り、前記第2の構造化された光パターンを表す第2の画像を捕捉するように構成されている受信機と、

前記第1の画像と前記第2の画像とに基づいて、シーンの深度マップを発生させるように構成されている電子ハードウェアプロセッサとを具備し、

前記第2の被写界深度は、前記第1の被写界深度よりも広い画像化デバイス。

[2] 前記電子ハードウェアプロセッサは、前記発生させた深度マップに基づいて、第3の画像の画像捕捉パラメータを調節し、前記画像捕捉パラメータを使用して、前記第3の画像を捕捉するようにさらに構成されている[1]記載の画像化デバイス。

[3] 前記電子ハードウェアプロセッサは、前記深度マップに基づいて、前記第3の画像の、開口、シャッタースピード、または、照度パラメータのうちの1つ以上を調節するように構成されている[2]記載の画像化デバイス。

[4] 前記電子ハードウェアプロセッサは、前記深度マップと前記第3の画像とのうちの1つ以上を安定記憶装置に記憶させるようにさらに構成されている[2]記載の画像化デバイス。

[5] 前記第1の送信機は、前記画像化デバイスから第1の距離で第1の最大解像度を有する、前記第1の構造化された光パターンを発生させるように構成され、

第2の送信機は、前記画像化デバイスから第2の距離で前記第1の構造化された光パターンよりも低い第2の最大解像度を有する、前記第2の構造化された光パターンを発生させるように構成されている[1]記載の画像化デバイス。

[6] 前記第1の距離と前記第2の距離は、等しい[5]記載の画像化デバイス。

[7] 前記第1の距離は、前記第2の距離とは異なる[5]記載の画像化デバイス。

[8] 前記第1の送信機は、前記第2の被写界深度とオーバーラップする、前記第1の被写界深度を発生させるように構成されている[1]記載の画像化デバイス。

[9] 前記第1の送信機は、前記第2の被写界深度内に含まれる前記第1の被写界深度を発生させるように構成されている[8]記載の画像化デバイス。

[10] 画像化デバイスにより画像を捕捉する方法おいて、

第1の発光体を使用して、第1の解像度で第1の被写界深度を有する第1の構造化された光パターンをシーン上に発生させることと、

電子ハードウェアプロセッサを介して、前記第1の被写界深度内に画像化センサの焦点を合わせて、前記第1の構造化された光パターンによって照光されたシーンを表す第1の画像を捕捉することと、

第2の発光体を使用して、前記第1の解像度で第2の被写界深度を有する第2の構造化された光パターンを発生させることと、

前記第2の被写界深度内に前記画像化センサの焦点を合わせて、前記第2の構造化された光パターンによって照光されたシーンを表す第2の画像を捕捉することと、

前記電子ハードウェアプロセッサを使用して、前記第1の画像と前記第2の画像とに基づいて、前記シーンの深度マップを発生させることと、

前記深度マップに基づいて、画像捕捉パラメータを決定することと、

前記画像化センサを使用して、前記画像捕捉パラメータに基づいて、前記シーンの第3の画像を捕捉することと、

前記第3の画像を安定記憶装置に記憶させることとを含み、

前記第2の被写界深度は、前記第1の被写界深度よりも広い方法。

[11] 前記深度マップに基づいて、前記第3の画像の、開口、シャッタースピード、または、照度パラメータのうちの1つ以上を調節することをさらに含む[10]記載の方法。

[12] 前記深度マップを前記安定記憶装置に記憶させることをさらに含む[10]記載の方法。

[13] 前記画像化デバイスから第1の距離で第1の最大解像度を有する、前記第1の構造化された光パターンを発生させることをさらに含み、

第2の送信機は、前記画像化デバイスから第2の距離で前記第1の構造化された光パターンよりも低い第2の最大解像度を有する、前記第2の構造化された光パターンを発生させるように構成されている[10]記載の方法。

[14] 前記第1の距離と前記第2の距離は、等しい[13]記載の方法。

[15] 前記第1の距離は、前記第2の距離とは異なる[13]記載の方法。

[16] 前記第2の被写界深度とオーバーラップする、前記第1の被写界深度を発生させることをさらに含む[13]記載の方法。

[17] 前記第2の被写界深度内に含まれる前記第1の被写界深度を発生させることをさらに含む[16]記載の方法。

[18] 命令を含む非一時的コンピュータ読取可能記憶媒体において、

前記命令は、実行されるとき、プロセッサに、画像化デバイスにより画像を捕捉する方法を実行させ、

前記方法は、

第1の発光体を使用して、第1の解像度で第1の被写界深度を有する第1の構造化された光パターンをシーン上に発生させることと、

電子ハードウェアプロセッサを介して、前記第1の被写界深度内に画像化センサの焦点を合わせて、前記第1の構造化された光パターンによって照光されたシーンを表す第1の画像を捕捉することと、

第2の発光体を使用して、前記第1の解像度で第2の被写界深度を有する第2の構造化された光パターンを発生させることと、

前記第2の被写界深度内に前記画像化センサの焦点を合わせて、前記第2の構造化された光パターンによって照光されたシーンを表す第2の画像を捕捉することと、

前記電子ハードウェアプロセッサを使用して、前記第1の画像と前記第2の画像とに基づいて、前記シーンの深度マップを発生させることと、

前記深度マップに基づいて、画像捕捉パラメータを決定することと、

前記画像化センサを使用して、前記画像捕捉パラメータに基づいて、前記シーンの第3の画像を捕捉することと、

前記第3の画像を安定記憶装置に記憶させることとを含み、

前記第2の被写界深度は、前記第1の被写界深度よりも広い非一時的コンピュータ読取可能記憶媒体。

[19] 前記方法は、

前記画像化デバイスから第1の距離で第1の最大解像度を有する、前記第1の構造化された光パターンを発生させることをさらに含み、

第2の送信機は、前記画像化デバイスから第2の距離で前記第1の構造化された光パターンよりも低い第2の最大解像度を有する、前記第2の構造化された光パターンを発生させるように構成されている[18]記載の非一時的コンピュータ読取可能記憶媒体。

[20] 前記第1の距離と前記第2の距離は、等しい[19]記載の非一時的コンピュータ読取可能記憶媒体。

Claims (18)

- 画像化デバイスにおいて、

第1の距離で焦点が合わせられ、第1の被写界深度を有する第1の構造化された光パターンを送信するように構成されている第1の送信機と、

第2の距離で焦点が合わせられ、第2の被写界深度を有する第2の構造化された光パターンを送信するように構成されている第2の送信機とを含む複数の送信機と、

前記第1の距離で前記第1の被写界深度内に焦点を合わせて、シーンの前記第1の構造化された光パターンを表す第1の画像を捕捉するようにと、前記第2の距離で前記第2の被写界深度内に焦点を合わせて、前記シーンの前記第2の構造化された光パターンを表す第2の画像を捕捉するように構成されている受信機と、

前記第1の画像と前記第2の画像とに基づいて、前記シーンの深度マップを発生させるように構成されている電子ハードウェアプロセッサとを具備し、

前記第2の被写界深度は、前記第1の被写界深度よりも広く、前記第2の距離は、前記第1の距離とは異なり、前記第1の構造化された光パターンを送信した後に前記第2の構造化された光パターンを送信する画像化デバイス。 - 前記電子ハードウェアプロセッサは、前記発生させた深度マップに基づいて、第3の画像の画像捕捉パラメータを調節し、前記画像捕捉パラメータを使用して、前記第3の画像を捕捉するようにさらに構成されている請求項1記載の画像化デバイス。

- 前記電子ハードウェアプロセッサは、前記深度マップに基づいて、前記第3の画像の、開口、シャッタースピード、または、照度パラメータのうちの1つ以上を調節するように構成されている請求項2記載の画像化デバイス。

- 前記電子ハードウェアプロセッサは、前記深度マップと前記第3の画像とのうちの1つ以上を安定記憶装置に記憶させるようにさらに構成されている請求項2記載の画像化デバイス。

- 前記第1の送信機は、前記画像化デバイスから第1の距離で第1の最大解像度を有する、前記第1の構造化された光パターンを発生させるように構成され、

前記第2の送信機は、前記画像化デバイスから前記第2の距離で前記第1の構造化された光パターンよりも低い第2の最大解像度を有する、前記第2の構造化された光パターンを発生させるように構成されている請求項1記載の画像化デバイス。 - 前記第1の被写界深度は、前記第2の被写界深度とオーバーラップする請求項1記載の画像化デバイス。

- 前記第1の被写界深度は、前記第2の被写界深度内に含まれる請求項6記載の画像化デバイス。

- 前記受信機上での基準ポジションと前記捕捉された第1の構造化された光パターンのポジションとの第1の差と、前記受信機上での前記基準ポジションと前記捕捉された第2の構造化された光パターンのポジションとの第2の差は、それぞれ、前記シーン中のオブジェクトに対する深度のインジケータとして使用される請求項1記載の画像化デバイス。

- 画像化デバイスにより画像を捕捉する方法おいて、

第1の発光体を使用して、第1の距離で焦点が合わせられ、第1の被写界深度を有する第1の構造化された光パターンをシーン上に発生させることと、

電子ハードウェアプロセッサを介して、前記第1の距離で前記第1の被写界深度内に画像化センサの焦点を合わせて、前記第1の構造化された光パターンによって照光された前記シーンを表す第1の画像を捕捉することと、

第2の発光体を使用して、第2の距離で焦点が合わせられ、第2の被写界深度を有する第2の構造化された光パターンを発生させることと、

前記第2の距離で前記第2の被写界深度内に前記画像化センサの焦点を合わせて、前記第2の構造化された光パターンによって照光された前記シーンを表す第2の画像を捕捉することと、

前記電子ハードウェアプロセッサを使用して、前記第1の画像と前記第2の画像とに基づいて、前記シーンの深度マップを発生させることとを含み、

前記第2の被写界深度は、前記第1の被写界深度よりも広く、前記第2の距離は、前記第1の距離とは異なり、前記第1の構造化された光パターンを発生させた後に前記第2の構造化された光パターンを発生させる方法。 - 前記深度マップに基づいて、画像捕捉パラメータを決定することと、

前記深度マップに基づいて、第3の画像の、開口、シャッタースピード、または、照度パラメータのうちの1つ以上を調節することと、

前記画像化センサを使用して、前記画像捕捉パラメータに基づいて、前記シーンの前記第3の画像を捕捉することと、

前記第3の画像を安定記憶装置に記憶させることとをさらに含む請求項9記載の方法。 - 前記深度マップを安定記憶装置に記憶させることをさらに含む請求項9記載の方法。

- 前記画像化デバイスから前記第1の距離で第1の最大解像度を有する、前記第1の構造化された光パターンを発生させることをさらに含み、

前記第2の発光体は、前記画像化デバイスから前記第2の距離で前記第1の構造化された光パターンよりも低い第2の最大解像度を有する、前記第2の構造化された光パターンを発生させるように構成されている請求項9記載の方法。 - 前記第2の被写界深度とオーバーラップする、前記第1の被写界深度を発生させることをさらに含む請求項9記載の方法。

- 前記第2の被写界深度内に含まれる前記第1の被写界深度を発生させることをさらに含む請求項13記載の方法。

- 前記受信機上での基準ポジションと前記捕捉された第1の構造化された光パターンのポジションとの第1の差と、前記受信機上での前記基準ポジションと前記捕捉された第2の構造化された光パターンのポジションとの第2の差は、それぞれ、前記シーン中のオブジェクトに対する深度のインジケータとして使用される請求項9記載の方法。

- 命令を含む非一時的コンピュータ読取可能記憶媒体において、

前記命令は、実行されるとき、プロセッサに、画像化デバイスにより画像を捕捉する方法を実行させ、

前記方法は、

第1の発光体を使用して、第1の距離で焦点が合わせられ、第1の被写界深度を有する第1の構造化された光パターンをシーン上に発生させることと、

電子ハードウェアプロセッサを介して、前記第1の距離で前記第1の被写界深度内に画像化センサの焦点を合わせて、前記第1の構造化された光パターンによって照光された前記シーンを表す第1の画像を捕捉することと、

第2の発光体を使用して、第2の距離で焦点が合わせられ、第2の被写界深度を有する第2の構造化された光パターンを発生させることと、

前記第2の距離で前記第2の被写界深度内に前記画像化センサの焦点を合わせて、前記第2の構造化された光パターンによって照光された前記シーンを表す第2の画像を捕捉することと、

前記電子ハードウェアプロセッサを使用して、前記第1の画像と前記第2の画像とに基づいて、前記シーンの深度マップを発生させることとを含み、

前記第2の被写界深度は、前記第1の被写界深度よりも広く、前記第2の距離は、前記第1の距離とは異なり、前記第1の構造化された光パターンを発生させた後に前記第2の構造化された光パターンを発生させる非一時的コンピュータ読取可能記憶媒体。 - 前記方法は、

前記画像化デバイスから前記第1の距離で第1の最大解像度を有する、前記第1の構造化された光パターンを発生させることをさらに含み、

前記第2の発光体は、前記画像化デバイスから前記第2の距離で前記第1の構造化された光パターンよりも低い第2の最大解像度を有する、前記第2の構造化された光パターンを発生させるように構成されている請求項16記載の非一時的コンピュータ読取可能記憶媒体。 - 前記受信機上での基準ポジションと前記捕捉された第1の構造化された光パターンのポジションとの第1の差と、前記受信機上での前記基準ポジションと前記捕捉された第2の構造化された光パターンのポジションとの第2の差は、それぞれ、前記シーン中のオブジェクトに対する深度のインジケータとして使用される請求項16記載の非一時的コンピュータ読取可能記憶媒体。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US15/380,745 | 2016-12-15 | ||

| US15/380,745 US10771768B2 (en) | 2016-12-15 | 2016-12-15 | Systems and methods for improved depth sensing |

| PCT/US2017/058982 WO2018111423A1 (en) | 2016-12-15 | 2017-10-30 | Systems and methods for improved depth sensing |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2020502506A JP2020502506A (ja) | 2020-01-23 |

| JP2020502506A5 JP2020502506A5 (ja) | 2020-11-12 |

| JP6866484B2 true JP6866484B2 (ja) | 2021-04-28 |

Family

ID=60480378

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2019531636A Active JP6866484B2 (ja) | 2016-12-15 | 2017-10-30 | 向上した深度感知のためのシステムおよび方法 |

Country Status (7)

| Country | Link |

|---|---|

| US (1) | US10771768B2 (ja) |

| EP (1) | EP3555855B1 (ja) |

| JP (1) | JP6866484B2 (ja) |

| KR (1) | KR20190096992A (ja) |

| CN (1) | CN109983506A (ja) |

| BR (1) | BR112019011021A2 (ja) |

| WO (1) | WO2018111423A1 (ja) |

Families Citing this family (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| TWI672677B (zh) | 2017-03-31 | 2019-09-21 | 鈺立微電子股份有限公司 | 用以融合多深度圖的深度圖產生裝置 |

| US10735711B2 (en) * | 2017-05-05 | 2020-08-04 | Motorola Mobility Llc | Creating a three-dimensional image via a wide-angle camera sensor |

| US10595007B2 (en) * | 2018-03-21 | 2020-03-17 | Himax Imaging Limited | Structured-light method and system of dynamically generating a depth map |

| WO2019243046A1 (en) | 2018-06-18 | 2019-12-26 | Lumileds Holding B.V. | Lighting device comprising led and grating |

| WO2020057365A1 (en) * | 2018-09-18 | 2020-03-26 | Guangdong Oppo Mobile Telecommunications Corp., Ltd. | Method, system, and computer-readable medium for generating spoofed structured light illuminated face |

| CN109974611B (zh) * | 2019-03-23 | 2023-07-21 | 柳州阜民科技有限公司 | 深度检测系统及其支架和电子装置 |

| US11150088B2 (en) * | 2019-05-13 | 2021-10-19 | Lumileds Llc | Depth sensing using line pattern generators |

| CN114543749B (zh) * | 2022-03-17 | 2022-07-29 | 苏州英示测量科技有限公司 | 测量多目标景深的光学系统及方法 |

Family Cites Families (18)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH0382909A (ja) * | 1989-08-25 | 1991-04-08 | Honda Motor Co Ltd | 光学式反射体検出装置 |

| US6850872B1 (en) | 2000-08-30 | 2005-02-01 | Microsoft Corporation | Facial image processing methods and systems |

| JP3778085B2 (ja) * | 2001-12-28 | 2006-05-24 | 松下電工株式会社 | 反射型光電センサ |

| GB0921461D0 (en) * | 2009-12-08 | 2010-01-20 | Qinetiq Ltd | Range based sensing |

| US9696427B2 (en) * | 2012-08-14 | 2017-07-04 | Microsoft Technology Licensing, Llc | Wide angle depth detection |

| US11509880B2 (en) * | 2012-11-14 | 2022-11-22 | Qualcomm Incorporated | Dynamic adjustment of light source power in structured light active depth sensing systems |

| US20140267701A1 (en) * | 2013-03-12 | 2014-09-18 | Ziv Aviv | Apparatus and techniques for determining object depth in images |

| KR101762525B1 (ko) | 2013-03-15 | 2017-07-27 | 애플 인크. | 다수의 이미터들을 이용한 깊이 주사를 위한 장치 및 방법 |

| US8872818B2 (en) | 2013-03-15 | 2014-10-28 | State Farm Mutual Automobile Insurance Company | Methods and systems for capturing the condition of a physical structure |

| US10401498B2 (en) | 2013-06-06 | 2019-09-03 | Ams Sensors Singapore Pte. Ltd. | Sensor system with active illumination |

| US9774833B2 (en) * | 2013-07-16 | 2017-09-26 | Texas Instruments Incorporated | Projector auto-focus correction with the aid of a camera |

| JP6075644B2 (ja) * | 2014-01-14 | 2017-02-08 | ソニー株式会社 | 情報処理装置および方法 |

| US9589359B2 (en) | 2014-04-24 | 2017-03-07 | Intel Corporation | Structured stereo |

| US9696424B2 (en) * | 2014-05-19 | 2017-07-04 | Rockwell Automation Technologies, Inc. | Optical area monitoring with spot matrix illumination |

| US10068338B2 (en) | 2015-03-12 | 2018-09-04 | Qualcomm Incorporated | Active sensing spatial resolution improvement through multiple receivers and code reuse |

| US10785393B2 (en) * | 2015-05-22 | 2020-09-22 | Facebook, Inc. | Methods and devices for selective flash illumination |

| IL239919A (en) * | 2015-07-14 | 2016-11-30 | Brightway Vision Ltd | Branded template lighting |

| JP6805904B2 (ja) * | 2017-03-08 | 2020-12-23 | 株式会社リコー | 計測装置、計測方法およびロボット |

-

2016

- 2016-12-15 US US15/380,745 patent/US10771768B2/en active Active

-

2017

- 2017-10-30 WO PCT/US2017/058982 patent/WO2018111423A1/en active Search and Examination

- 2017-10-30 CN CN201780071795.7A patent/CN109983506A/zh active Pending

- 2017-10-30 EP EP17804996.1A patent/EP3555855B1/en active Active

- 2017-10-30 JP JP2019531636A patent/JP6866484B2/ja active Active

- 2017-10-30 KR KR1020197016374A patent/KR20190096992A/ko active IP Right Grant

- 2017-10-30 BR BR112019011021A patent/BR112019011021A2/pt not_active IP Right Cessation

Also Published As

| Publication number | Publication date |

|---|---|

| US20180176542A1 (en) | 2018-06-21 |

| US10771768B2 (en) | 2020-09-08 |

| CN109983506A (zh) | 2019-07-05 |

| WO2018111423A1 (en) | 2018-06-21 |

| EP3555855A1 (en) | 2019-10-23 |

| BR112019011021A2 (pt) | 2019-10-08 |

| EP3555855B1 (en) | 2023-12-20 |

| KR20190096992A (ko) | 2019-08-20 |

| JP2020502506A (ja) | 2020-01-23 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6866484B2 (ja) | 向上した深度感知のためのシステムおよび方法 | |

| EP2856078B1 (en) | Design of code in affine-invariant spatial mask | |

| JP6513887B2 (ja) | 構造化光深度マップのアウトライアの検出および補正のための方法および装置 | |

| US9530215B2 (en) | Systems and methods for enhanced depth map retrieval for moving objects using active sensing technology | |

| EP3344949B1 (en) | Code domain power control for structured light | |

| EP3513552B1 (en) | Systems and methods for improved depth sensing | |

| CN104769387A (zh) | 组合多个图像以补偿反射率和/或吸收的差别的结构光主动深度感测系统 | |

| US10068338B2 (en) | Active sensing spatial resolution improvement through multiple receivers and code reuse |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20200925 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20200925 |

|

| A871 | Explanation of circumstances concerning accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A871 Effective date: 20200925 |

|

| A975 | Report on accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A971005 Effective date: 20201113 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20201124 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20210210 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20210309 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20210407 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6866484 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |