JP6849331B2 - デバイス及びコンピュータプログラム - Google Patents

デバイス及びコンピュータプログラム Download PDFInfo

- Publication number

- JP6849331B2 JP6849331B2 JP2016136533A JP2016136533A JP6849331B2 JP 6849331 B2 JP6849331 B2 JP 6849331B2 JP 2016136533 A JP2016136533 A JP 2016136533A JP 2016136533 A JP2016136533 A JP 2016136533A JP 6849331 B2 JP6849331 B2 JP 6849331B2

- Authority

- JP

- Japan

- Prior art keywords

- projection

- map

- map information

- information

- projecting

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Landscapes

- Navigation (AREA)

- Projection Apparatus (AREA)

- User Interface Of Digital Computer (AREA)

- Traffic Control Systems (AREA)

- Instructional Devices (AREA)

Description

第1実施形態では、図1(b)に示すようにオブジェクトと自分の位置の把握を容易にする地図108を投影する投射型デバイス102の構成例を説明する。

図2は、投射型デバイス102のハードウェア構成図である。投射型デバイス102は、CPU201、RAM202、ROM203をシステムバス208に接続したコンピュータを備える。CPU(Central Processing Unit)201は、本発明のコンピュータプログラムを実行することにより、コンピュータを投射型デバイス102として動作させる。

RAM(Random Access Memory)202はCPU201のワークエリアとして機能する。また、図示しない外部装置などから供給されるプログラムやデータを一時記憶する。さらに、CPU201と協働して、表示対象となる地図情報を取得する地図情報取得手段として機能する。地図情報は、対象物が存在する位置を表す全体地図のほか、その一部である部分地図を含む。RAM202は、さらに、CPU201と協働して、対象となる実オブジェクトである物体(以下、「対象物」という)に関連付けられた情報(以下、「関連情報」という)を取得する関連情報取得手段として機能する。さらに、各種判定に用いる所定条件などを保持する保持手段としても機能する。ROM(Read Only Memory)203は変更を必要としないプログラムや各種パラメータを格納する。なお、図示しないハードディスクドライブ装置などのストレージを備え、本発明のコンピュータプログラムをこのストレージにインストールするようにしてもよい。システムバス208には、入力装置204、出力装置205、ネットワーク・インタフェース206も接続されている。ネットワーク・インタフェース206には、ネットワーク207が接続される。

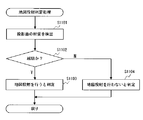

地図投射判定部304は、検出した投射方向が所定の角度、例えば20度以内の場合(S602:Y)、投射型デバイス102が「下向き」とみなし、投影面の傾きを検出する(S603)。投影面の傾きは投影面の法線ベクトルとして取得される。なお、投影面の傾きは撮像装置で取得した画像から推定してもよいし、焦点の深度を直接取得可能な撮像装置を用いて投影面までの距離を計測し、その情報を基に推定してもよい。

地図投射判定部304は、その後、投影面が水平かどうかを判定する(S604)。具体的には、上記の法線ベクトルと重力加速度方向の逆ベクトルとの間の角度を求め、それらの間の角度が一定の範囲内(例えば5度以内)であれば水平、そうでなければ水平でないと判定する。水平であった場合は(S604:Y)地図投射を行うと判定し(S605)、処理を終える。一方、水平でなかった場合は(S604:N)、地図投射を行わないと判定し(S606)、処理を終える。S602において投射型デバイス102が「下向き」でないと判定した場合(S602:N)も地図投射を行わないと判定する(S606)。

図7(a)〜(e)は、図4で示した美術館の全体を表す全体地図の中でシフトする部分地図700の例を表す。図の矢印は投射型デバイス102が向いている方角(投射方向)を表している。図7(a)は投射型デバイス102を北向きでかつ真下に向けたときに投射される地図情報の例である。図7(b)〜(e)は、それぞれ図7(a)と同じ位置で、投射型デバイス102を北、西、東、南の方向に鉛直方向から20度傾けて投射した時に投射される地図情報の例である。各図の白い丸は各展示室に置かれている展示品を表す。マーク701は投射型デバイス102の位置、つまりユーザの(足の)現在位置を表す。

その後、投射部305は、出力装置205の一例となるプロジェクタから図7(a)〜(e)に例示される部分地図700を投射する。投射する部分地図700には、美術館における展示品の位置と投射型デバイス102の現在位置(マーク701)とが表示される。このとき、美術館の全体地図における部分地図700の相対位置を表す情報と共に表示されるようにしてもよい。投射される部分地図700の向きや表示位置は、投射型デバイス102の水平方向の向きと、鉛直方向からの角度によって決定される。部分地図700の向きは、投射型デバイス102が向いている方位が上になるように表示される。また、部分地図700の表示位置は、図8に例示した制御テーブルに基づいて決定されるシフト量の分だけ、移動した方位と同じ方向に移動される。そのため、図7(a)のように投射型デバイス102を北向きでかつ真下に向けた場合は、投射型デバイス102の位置が中心に来る。その一方、そこから約20度傾けた場合は、図7(b)のように、現在位置を基準として、投影面の高さの1/3の分、先の地図を見ている状態になる。同様に、図7の(c)、(d)、(e)の部分地図700は、それぞれ投射型デバイス102を西、東、南に向けて、鉛直方向から約20度傾けている。そのため、図4に示した地図400の左、右、下方向がそれぞれ上になっていて、かつ表示位置が投射型デバイス102の位置から方位の方向にシフトした位置になっている。

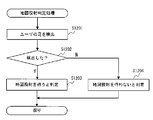

上述した実施形態では、投射型デバイス102を「下向き」にしたときに、ユーザの現在位置を含む部分地図700を投射する例について説明したが、本発明の適用範囲は、そのような例に限定されない。例えば、投影面が地面又は床に対して水平な場合のみ、つまり、投影面が壁でない場合にのみ地図表示を行うようにしてもよい。この場合の投射型デバイス102における処理手順は図5と同様であり、地図投射判定部304が行うS505の地図投射判定処理の内容が異なるものとなる。

第2変形例では、投射型デバイス102からの投射により形成される投影面が床で(つまり第1変形例と同様、傾きが水平で)、その床の材質が所定の材質の場合にだけ地図表示を行う場合の例を説明する。この場合の投射型デバイス102の制御手順は図5と同様であり、S505で行う地図投射判定処理の内容だけが異なる。第2変形例において地図投射判定部304が実行する地図投射判定処理を図11を参照して説明する。

もちろん床の材質は場所に合わせて絨毯以外のものを用いてもよいし、複数の材質に対応するようにしてもよい。また、認識しやすいように特定の柄などを持つ素材を床に設置し、それを認識してもよい。いずれにせよ、床にある素材の材質を認識できればいずれの方法であってもよい。

第3変形例では、投射型デバイス102による投射先、すなわち投影面にユーザの身体の一部、例えばユーザの足が存在することを検出した場合に地図投射を行うと判定する場合の例を説明する。この場合の投射型デバイス102の制御手順は図5と同様であり、S505で行う地図投射判定処理の内容が異なる。第3変形例において地図投射判定部304が行う地図投射判定処理を図12を参照して説明する。

投射部305は、投射している位置、つまり投影面の中心の位置と認識された足との距離を計算する(S1401)。次いで、計算された距離に応じて地図情報の表示形態を選択可能にする(S1402)。ここでは、その距離に応じて、投射する地図情報の視点の角度を傾けて、かつ拡大表示されるように投射するものとする。但し、この例に限定されない。また、ユーザの足の位置を示す画像を地図上の現在位置にマッピングさせる(S1403)。

このようにすることで図13(a)に示すように、投射型デバイス102を真下に向けているときは二次元画像に見えた部分地図が投射型デバイス102の投影面を足から徐々に遠ざけていくに従って図13(b)のように立体的な表示となって見える。さらに、特定の拡大率を超えたときに、展示物の表示を実際のものと同じ見え方で表示する。このような立体表示にすることで、今自分がいる部屋のどの方向にどのような展示品があるかを直感的に把握できるようになる。

第1実施形態では、投射型デバイス102を美術館などの屋内で使用する地図表示の例を説明したが、第2実施形態では、投射型デバイス102を屋外で使う場合の例を説明する。投射型デバイス102のハードウェア構成及び機能構成は、第1実施形態の場合と同じである。図15は、屋外美術館の地図情報の例示図である。屋外美術館は、散策可能なエリアを有している。図15に示された地図情報1500は上方向の方位を北とする。投射型デバイス102のユーザであるユーザは、グレーで示されたエリアを歩いて所々に設置された展示品を鑑賞することを想定する。

投射型デバイス102は、まず、現在位置から最近情報を取得した展示物までのルートを取得する(S1701)。ルート計算は投射型デバイス102上で処理してもよいし、ネットワーク・インタフェース206を介して外部装置で計算させ、結果を取得してもよい。

屋外美術館の地図情報と取得したルートがあればそれを合わせて上記のプロジェクタから投射する(S1702)。投射型デバイス102を持ったユーザが投射型デバイス102を下向きにすると図16(a)に示される地図が表示される。

また、ユーザが投射型デバイス102を野外展示品1602の方向に向けて美術品に関する関連情報を見たり聞いたりした後で下に向けると、図16(b)に示すように、地図情報と共にその美術品までのルートが表示される。このように展示品までに距離があり、そこへどのように向かえばよいかわからない屋外美術館のようなケースにおいても、第2実施形態によれば、展示品の正確な場所と共にルートも把握できるようになる。

また、本発明は、1以上の機能を実現するプログラムを、ネットワークまたは記憶媒体を介してシステムまたは装置に供給し、そのシステムまたは装置のコンピュータにおける1つ以上のプロセッサがプログラムを読出し実行する態様でも実現可能である。また、1以上の機能を実現する回路(例えば、ASIC)によっても実現可能である。

Claims (13)

- 物体に関連付けられた関連情報を投射する投射手段と、

前記物体の位置を表す地図情報を取得する地図情報取得手段と、

前記投射手段による投射環境を検出する検出手段と、

前記検出手段の検出結果が所定条件を満たす場合に、前記関連情報に代えて前記地図情報を前記投射手段に投射させる制御手段と、

を有し、

前記投射手段は、前記地図情報を二次元画像として投射した後、投射位置と同じ位置及び同じ方位で、所定角度以上傾いたことが前記検出手段で検出された場合に、傾いた後の前記地図情報を三次元画像に変換することを特徴とする投射型デバイス。 - 物体に関連付けられた関連情報を投射する投射手段と、

前記物体の位置を表す地図情報を取得する地図情報取得手段と、

前記投射手段による投射環境を検出する検出手段と、

現在位置を取得する取得手段と、

前記検出手段の検出結果が所定条件を満たす場合に前記関連情報に代えて投射する前記地図情報又は前記関連情報を投射する際に、前記取得手段で取得した現在位置を表す画像をマッピングさせるように前記投射手段に投射させる制御手段と、を有することを特徴とする投射型デバイス。 - 前記制御手段は、前記検出手段による検出結果に応じて前記地図情報をシフトさせることを特徴とする、

請求項2に記載の投射型デバイス。 - 前記シフトさせる地図情報は、前記物体を含む複数の物体が存在する領域の全体地図の一部となる部分地図であることを特徴とする、

請求項3に記載の投射型デバイス。 - 音を出力する音出力手段をさらに備えており、

前記制御手段は、前記関連情報を、前記投射手段に代えて又は前記投射手段と共に、前記音出力手段から出力させることを特徴とする、

請求項1に記載の投射型デバイス。 - 前記投射環境は、前記投射手段による投射の方向及び投射先に形成される投影面の状態の少なくとも一方を検出することを特徴とする、

請求項1、3乃至5のいずれか一項に記載の投射型デバイス。 - 前記投影面の状態は、所定の基準面に対する前記投影面の角度又は当該投影面が形成される部位の材質であることを特徴とする、

請求項6に記載の投射型デバイス。 - 前記検出手段は、前記投影面の角度を検出するものであり、

前記制御手段は、検出された角度が水平でない場合は前記地図情報の投射を制限することを特徴とする、

請求項7に記載の投射型デバイス。 - 前記投影面の状態は、前記投影面における前記物体又はユーザの人体の一部の存在の有無であることを特徴とする、

請求項6に記載の投射型デバイス。 - 前記検出手段が前記投影面に前記物体又は前記人体の一部が存在することを検出した場合、前記制御手段は、前記投影面への前記地図情報の投射を制限することを特徴とする、

請求項9に記載の投射型デバイス。 - 前記検出手段が前記投影面に前記人体の一部が存在することを検出した場合、

前記制御手段は、前記投影面の位置と前記人体の一部との距離に応じて、投影する地図情報の表示形態を選択可能にすることを特徴とする、

請求項9に記載の投射型デバイス。 - コンピュータを、物体に関連付けられた関連情報を投射する投射手段、

前記物体の位置を表す地図情報を取得する地図情報取得手段、

前記投射手段による投射環境を検出する検出手段、

前記検出手段の検出結果が所定条件を満たす場合に、前記関連情報に代えて前記地図情報を前記投射手段に投射させる制御手段、として機能させるためのコンピュータプログラムであって、

前記投射手段は、前記地図情報を二次元画像として投射した後、投射位置と同じ位置及び同じ方位で、所定角度以上傾いたことが前記検出手段で検出された場合に、傾いた後の地図情報を三次元画像に変換することを特徴とするコンピュータプログラム。 - コンピュータを、物体に関連付けられた関連情報を投射する投射手段、

前記物体の位置を表す地図情報を取得する地図情報取得手段、

前記投射手段による投射環境を検出する検出手段、

現在位置を取得する取得手段、

前記検出手段の検出結果が所定条件を満たす場合に前記関連情報に代えて投射する前記地図情報又は前記関連情報を投射する際に、前記取得手段で取得した現在位置を表す画像をマッピングさせるように前記投射手段に投射させる制御手段、

として機能させるためのコンピュータプログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016136533A JP6849331B2 (ja) | 2016-07-11 | 2016-07-11 | デバイス及びコンピュータプログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016136533A JP6849331B2 (ja) | 2016-07-11 | 2016-07-11 | デバイス及びコンピュータプログラム |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2018010025A JP2018010025A (ja) | 2018-01-18 |

| JP2018010025A5 JP2018010025A5 (ja) | 2019-08-15 |

| JP6849331B2 true JP6849331B2 (ja) | 2021-03-24 |

Family

ID=60995500

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2016136533A Active JP6849331B2 (ja) | 2016-07-11 | 2016-07-11 | デバイス及びコンピュータプログラム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP6849331B2 (ja) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN110660238B (zh) * | 2019-09-28 | 2021-08-27 | 徐州奥拉可电子科技有限公司 | 一种基于无人机投影的高危地段交通指挥台及其指挥方法 |

Family Cites Families (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP5612929B2 (ja) * | 2010-07-05 | 2014-10-22 | 大日本印刷株式会社 | 案内情報提供システム、制御装置、案内情報提供方法、及びプログラム |

| JP2015011360A (ja) * | 2013-06-26 | 2015-01-19 | 株式会社デジタル・スタンダード | 情報処理装置およびプログラム |

-

2016

- 2016-07-11 JP JP2016136533A patent/JP6849331B2/ja active Active

Also Published As

| Publication number | Publication date |

|---|---|

| JP2018010025A (ja) | 2018-01-18 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US12039644B2 (en) | Method and sytem for presenting a digital information related to a real object | |

| US10217288B2 (en) | Method for representing points of interest in a view of a real environment on a mobile device and mobile device therefor | |

| KR102414587B1 (ko) | 증강 현실 데이터 제시 방법, 장치, 기기 및 저장 매체 | |

| CN111065891B (zh) | 基于增强现实的室内导航系统 | |

| JP6050518B2 (ja) | 実環境に仮想情報を表現する方法 | |

| KR101295712B1 (ko) | 증강 현실 사용자 인터페이스 제공 장치 및 방법 | |

| US9672588B1 (en) | Approaches for customizing map views | |

| JP6674192B2 (ja) | 画像処理装置と画像処理方法 | |

| KR20120017293A (ko) | 증강 현실 제공 장치 및 방법 | |

| JPWO2019069575A1 (ja) | 情報処理装置、情報処理方法及びプログラム | |

| JP5890359B2 (ja) | 端末装置、表示方法、プログラム、および表示システム | |

| KR101155761B1 (ko) | 증강 현실에서 위치 정보를 표시하는 방법 및 장치 | |

| JP6849331B2 (ja) | デバイス及びコンピュータプログラム | |

| JP2009020906A (ja) | 地図表示装置、地図上の位置を特定する方法、および、コンピュータプログラム | |

| KR101404976B1 (ko) | 3차원 매칭을 이용한 영상 기반의 보행 경로 poi표출 시스템 | |

| KR20120014976A (ko) | 위치 정보를 이용한 증강 현실 장치 | |

| CN119604741A (zh) | 使用单手的沉浸式数字地图导航 | |

| JP2011113127A (ja) | オブジェクト位置決め装置及びオブジェクト位置決め方法 | |

| KR20180038698A (ko) | 프로젝터 자세에 연동하는 콘텐츠 디스플레이 시스템 및 방법 | |

| KR20190056694A (ko) | 디지털 소묘 요소가 태깅된 2.5차원 오브젝트를 활용한 가상 전시 공간 제공 방법 | |

| KR101318324B1 (ko) | 영상 기반의 보행 경로 poi표출 시스템 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20190627 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20190627 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20200721 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20200909 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20210202 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20210304 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 6849331 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |