JP5993897B2 - Specific apparatus, specific method, and specific program - Google Patents

Specific apparatus, specific method, and specific program Download PDFInfo

- Publication number

- JP5993897B2 JP5993897B2 JP2014126554A JP2014126554A JP5993897B2 JP 5993897 B2 JP5993897 B2 JP 5993897B2 JP 2014126554 A JP2014126554 A JP 2014126554A JP 2014126554 A JP2014126554 A JP 2014126554A JP 5993897 B2 JP5993897 B2 JP 5993897B2

- Authority

- JP

- Japan

- Prior art keywords

- classification

- input data

- output

- input

- specifying

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000000034 method Methods 0.000 title claims description 45

- 238000004364 calculation method Methods 0.000 claims description 35

- 230000008569 process Effects 0.000 claims description 18

- 230000008878 coupling Effects 0.000 claims description 15

- 238000010168 coupling process Methods 0.000 claims description 15

- 238000005859 coupling reaction Methods 0.000 claims description 15

- 238000003860 storage Methods 0.000 description 16

- 238000012545 processing Methods 0.000 description 12

- 238000010586 diagram Methods 0.000 description 10

- 238000004891 communication Methods 0.000 description 9

- 239000013256 coordination polymer Substances 0.000 description 7

- 230000004048 modification Effects 0.000 description 6

- 238000012986 modification Methods 0.000 description 6

- 230000006870 function Effects 0.000 description 5

- 230000008520 organization Effects 0.000 description 4

- 238000002372 labelling Methods 0.000 description 3

- 230000003287 optical effect Effects 0.000 description 3

- 238000004458 analytical method Methods 0.000 description 2

- 230000006399 behavior Effects 0.000 description 2

- 238000007405 data analysis Methods 0.000 description 2

- 230000000694 effects Effects 0.000 description 2

- 230000010365 information processing Effects 0.000 description 2

- 238000004519 manufacturing process Methods 0.000 description 2

- 238000012552 review Methods 0.000 description 2

- 239000004065 semiconductor Substances 0.000 description 2

- 238000013528 artificial neural network Methods 0.000 description 1

- 230000008859 change Effects 0.000 description 1

- 238000009826 distribution Methods 0.000 description 1

- 230000010354 integration Effects 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 210000002569 neuron Anatomy 0.000 description 1

Images

Landscapes

- Information Retrieval, Db Structures And Fs Structures Therefor (AREA)

- Image Analysis (AREA)

Description

本発明は、特定装置、特定方法及び特定プログラムに関する。 The present invention relates to a specific device, a specific method, and a specific program.

従来、各種のデータに対してデータのカテゴリを示すラベル付けが行われている。例えば、インターネットオークションに商品を出品する場合に、出品者は、商品のカテゴリ検索や絞込み検索を行えるようにするため、予め用意されたカテゴリの中から出品する商品が属するカテゴリを手動で選択することで商品に対してラベル付けを行う。 Conventionally, various types of data are labeled to indicate the data category. For example, when a product is listed in an Internet auction, the seller must manually select a category to which the product to be listed belongs from among categories prepared in advance so that the category search or refined search of the product can be performed. Label products with.

しかしながら、上記の方法では、適切なラベルを付けることができるとは限らなかった。例えば、上記の方法では、出品者は、商品が属するカテゴリのラベルを恣意的に判断し、商品のラベルを決定する。このため、上記の方法では、商品に対して不適切なラベルが付けられる場合がある。このようなことから、上記の方法では、適切なラベルを付けることができるとは限らなかった。 However, the above method cannot always provide an appropriate label. For example, in the above method, the exhibitor arbitrarily determines the label of the category to which the product belongs and determines the label of the product. For this reason, in the above method, an inappropriate label may be attached to the product. For this reason, the above method cannot always provide an appropriate label.

本願は、上記に鑑みてなされたものであって、適切なラベルを付けることができる特定装置、特定方法及び特定プログラムを提供することを目的とする。 The present application has been made in view of the above, and an object thereof is to provide a specifying device, a specifying method, and a specifying program capable of attaching an appropriate label.

本願に係る特定装置は、入力データを受け付ける受付部と、所定の分類の特徴情報を再現する学習器に対して、前記受付部によって受け付けられた入力データを入力した場合に出力する出力データの前記入力データに対する再現誤差を算出する算出部と、前記算出部によって算出された再現誤差に基づいて前記入力データが属する分類を特定する特定部とを備えたことを特徴とする。 The specific device according to the present application includes: a receiving unit that receives input data; and a learning device that reproduces feature information of a predetermined classification, and the output data that is output when the input data received by the receiving unit is input. A calculation unit that calculates a reproduction error with respect to input data, and a specifying unit that specifies a classification to which the input data belongs based on the reproduction error calculated by the calculation unit.

実施形態の一態様によれば、適切なラベルを付けることができるという効果を奏する。 According to one aspect of the embodiment, there is an effect that an appropriate label can be attached.

以下に、本願に係る特定装置、特定方法及び特定プログラムを実施するための形態(以下、「実施形態」と呼ぶ)について図面を参照しつつ詳細に説明する。なお、この実施形態により本願に係る特定装置、特定方法及び特定プログラムが限定されるものではない。また、以下の実施形態において同一の部位には同一の符号を付し、重複する説明は省略される。 Hereinafter, a specific apparatus, a specific method, and a specific program (hereinafter referred to as “embodiment”) according to the present application will be described in detail with reference to the drawings. Note that the specific device, the specific method, and the specific program according to the present application are not limited by this embodiment. Moreover, in the following embodiment, the same code | symbol is attached | subjected to the same site | part and the overlapping description is abbreviate | omitted.

〔1.特定処理〕

まず、図1を用いて、実施形態に係る特定処理の一例について説明する。図1は、実施形態に係る特定装置による特定処理の一例を示す説明図である。図1の例では、特定装置100によって製品と共起する人物を特定する特定処理が行われる例を示す。

[1. Specific processing)

First, an example of the specifying process according to the embodiment will be described with reference to FIG. FIG. 1 is an explanatory diagram illustrating an example of the specifying process performed by the specifying apparatus according to the embodiment. In the example of FIG. 1, an example in which a specifying process for specifying a person who co-occurs with a product is performed by the

特定装置100は、所定の分類の特徴情報を再現する学習器(例えば、オートエンコーダ)によって入力データの属する分類を特定するサーバ装置である。この点について図1を用いて詳細に説明する。学習器Le1〜Lenは、所定の分類の特徴を学習したオートエンコーダである。具体的には、学習器Le1〜Lenは、入力データに対する演算結果を出力する複数のノード(例えば、ニューロン)を接続したDNN(Deep Neural Network)であって被写体が描出された画像を入力データとして入力した場合に入力データを再現する出力データ(例えば、再現データ)を出力するオートエンコーダである。この点について、図2を用いて説明する。図2は、オートエンコーダの一例を示す説明図である。学習器Le2は、ノートパソコンの特徴を学習したオートエンコーダである。学習器Le2は、ノートパソコンが描出された画像NPを入力データとして入力した場合に、ノートパソコンを再現する出力データREを出力する。

The

例えば、学習器Le2は、画像NPの各画素の画素値(例えば、グレースケールの8ビット値)を対応する入力ノードに入力し、各出力ノードが出力した値を取得する。また、学習器Le2は、各出力ノードが出力した値を、各出力ノードと対応する位置の画素の画素値として画像を構成することで、出力データとなる画像を得る。ここで、オートエンコーダにおいては、入力ノードの数よりも中心部分のノードの数が少ないため、入力ノードに含まれる特徴のうち再現されない特徴が生じる。このため、オートエンコーダにある物体が描出された画像を入力した際に、かかる物体がうまく再現された場合(例えば、ノイズが入っていない画像が出力された場合等)は、かかる物体の特徴を良く学習していると判断できる。一方、学習器Le3は、ノートパソコンの特徴を学習していないエンコーダであるため、図2に示すように、ノートパソコンが描出された画像NPが入力データとして入力された場合は、画像をうまく再現することができずに、ビット欠け等のノイズが生じた画像を出力する恐れがある。 For example, the learning unit Le 2, the pixel value of each pixel of the image NP (e.g., 8-bit values of the gray scale) is input to the corresponding input node, and acquires a value each output node is output. Further, the learning device Le 2 constructs an image using the values output from the output nodes as pixel values of pixels at positions corresponding to the output nodes, thereby obtaining an image serving as output data. Here, in the auto encoder, since the number of nodes in the central portion is smaller than the number of input nodes, features that are not reproduced among the features included in the input nodes occur. For this reason, when an image in which an object in the auto encoder is drawn is input, if the object is reproduced well (for example, an image without noise is output), the characteristics of the object are displayed. You can judge that you are learning well. On the other hand, the learning unit Le 3 are the encoder does not learn the features of a notebook personal computer, as shown in FIG. 2, when the image NP which laptop is depicted is input as input data, well image There is a risk of outputting an image in which noise such as missing bits cannot be reproduced.

なお、図1の例では、学習器Le1は、テレビの特徴を学習したオートエンコーダである。学習器Le2は、ノートパソコンの特徴を学習したオートエンコーダである。学習器Lenは、スマートフォンの特徴を学習したオートエンコーダである。 In the example of FIG. 1, the learning device Le 1 is an auto encoder that learns the characteristics of the television. Learner Le 2 is a Autoencoder learned features of laptop. Learner Le n is a Autoencoder learned characteristics of the smartphone.

また、図1の例では、学習器Le1〜Lenは、入力層と、多段のノード群によって形成される中間層と、出力層とから構成される。ここで、中間層は、図1に示すように、次元数が最も少ない層を中心に含む。 In the example of FIG. 1, the learning devices Le 1 to Le n are configured by an input layer, an intermediate layer formed by a multi-stage node group, and an output layer. Here, as shown in FIG. 1, the intermediate layer mainly includes a layer having the smallest number of dimensions.

特定装置100は、まず、入力データを受け付ける(ステップS1)。ここで、入力データは、例えば、特定装置100によって分類を特定する特定対象の未知データである。図1の例では、入力データP1は、ノートパソコンが描出された画像である。なお、画像には、被写体に加えて背景などが描出されてもよい。

First, the

続いて、特定装置100は、学習器Le1〜Lenを用いて入力データP1に描出された被写体が属する分類を特定する。具体的には、特定装置100は、まず、入力データP1を学習器Le1〜Lenに入力する(ステップS2)。なお、図1では、説明を簡単にするため、3つの学習器Le1、Le2およびLenに入力データP1を入力する例を示すが実際には各種の異なる分類の特徴を学習した学習器であって予め用意された各学習器に入力データP1を入力する。これにより、図1の例では、学習器Le1は、出力データOD1を出力する。学習器Le2は、出力データOD2を出力する。学習器Lenは、出力データODnを出力する。

Subsequently, the

そして、特定装置100は、学習器Le1〜Lenに対して、入力データP1を入力した場合に出力する出力データOD1〜ODnの入力データP1に対する再現誤差を算出する(ステップS3)。ここで、再現誤差は、入力データに対する出力データの再現度を示す指標である。例えば、特定装置100は、入力データである画像に含まれる各画素のグレースケールの値を対応する入力ノードに入力し、各出力ノードが出力した値を各画素のグレースケールの値とする。また、特定装置100は、各画素に対応する入力ノードに入力した値と出力ノードが出力した値との差分の累乗値をそれぞれ算出する。そして、特定装置100は、各画素について算出した累乗値の総和を平均誤差の値とする。

The

すなわち、再現誤差は、出力データが入力データを正確に再現しているほど低くなる。図1の例では、特定装置100は、出力データOD1の再現誤差を「50」と算出する。また、特定装置100は、出力データOD2の再現誤差を「0」と算出する。また、特定装置100は、出力データODnの再現誤差を「90」と算出する。

That is, the reproduction error becomes lower as the output data accurately reproduces the input data. In the example of FIG. 1, the identifying

その後、特定装置100は、算出された再現誤差に基づいて入力データP1が属する分類を特定する(ステップS4)。例えば、特定装置100は、算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を入力データが属する分類として特定する。図1の例では、算出された再現誤差のうち最も低い再現誤差「0」となる出力データOD2を出力する学習器Le2に対応する分類である「ノートパソコン」を入力データP1が属する分類として特定する。

Thereafter, the

このように、実施形態に係る特定装置100は、入力データを受け付ける。また、特定装置100は、所定の分類の特徴情報を再現する学習器に対して、受け付けられた入力データを入力した場合に出力する出力データの再現誤差を算出する。また、特定装置100は、算出された再現誤差に基づいて入力データが属する分類を特定する。

As described above, the specifying

これにより、特定装置100は、入力データが属する適切な分類を特定することができるので、適切なラベルを付けることができる。例えば、特定装置100は、被写体が描出された画像が入力された場合に画像に描出された被写体が属する分類を特定することができる。このため、特定装置100は、例えば、インターネットオークションにおいて出品者が新規に出品する商品が描出された画像を受け付けた場合に商品が属するカテゴリを特定することができる。

As a result, the identifying

また、特定装置100は、例えば、インターネットオークションで出品する商品に対して適切なラベルを付けることができるので、不適切なラベルが付いた商品を減らすことができる。このため、特定装置100は、出品者やオークションの利用者の利便性を向上させることができる。

Moreover, since the

また、特定装置100は、商品の画像を学習器に入力するだけで商品に対して適切なラベルを付けることができるので、出品者がラベルを検討する手間を減らすことができる。このため、特定装置100は、出品者の出品作業における利便性を向上させることができる。

Moreover, since the

〔2.出品システムの構成〕

図3を用いて、実施形態に係る出品システムの構成について説明する。図3は、実施形態に係る出品システムによる出品処理の一例を示す説明図である。図3に示すように、出品システム1には、端末装置10と、サーバ装置50と、特定装置100とが含まれる。端末装置10、サーバ装置50および特定装置100は、ネットワークを介して、有線又は無線により通信可能に接続される。なお、図3に示した出品システム1には、複数台の端末装置10や、複数台のサーバ装置50や、複数台の特定装置100が含まれてもよい。

[2. Configuration of the exhibition system

The configuration of the exhibition system according to the embodiment will be described with reference to FIG. FIG. 3 is an explanatory diagram illustrating an example of an exhibition process performed by the exhibition system according to the embodiment. As shown in FIG. 3, the exhibition system 1 includes a

端末装置10は、例えば、デスクトップ型PCや、ノート型PCや、タブレット型端末や、スマートフォンや、携帯電話機や、PDA(Personal Digital Assistant)等の情報処理装置である。例えば、端末装置10は、オークションに商品を出品する利用者(例えば、販売者)によって利用される。端末装置10は、利用者によって用意された画像をサーバ装置50に送信する。例えば、端末装置10は、表示部に表示中のウェブページである出品画面に対して所定の操作(例えば、クリック操作)を受け付けた場合に、利用者が出品する商品が描出された画像CPをサーバ装置50に送信する。

The

サーバ装置50は、各種ウェブページを端末装置10に提供するサーバ装置である。具体的には、サーバ装置50は、ネットオークションに関するウェブページを提供する。例えば、サーバ装置50は、消費者が閲覧するネットオークションサイトや商品を出品する利用者が閲覧する管理画面(例えば、出品画面)を提供する。なお、サーバ装置50は、ネットオークションサイトのウェブページに限らず、技術解説サイト、検索エンジンサイト、ショッピングサイト、ニュースサイト、ファイナンスサイト(株価サイト)等といった各種のウェブページを提供してもよい。

The

特定装置100は、学習器Leを用いて商品が属する分類を特定するサーバ装置である。具体的には、特定装置100は、まず、入力データとして商品が描出された画像を学習器Leに入力する。続いて、特定装置100は、入力データに対する出力データの再現誤差を算出する。そして、特定装置100は、算出した再現誤差に基づいて商品が属する分類を特定する。

The

次に、図3を用いて、出品システム1による出品処理について説明する。まず、端末装置10は、例えば、サーバ装置50から提供される出品画面を介して、利用者がオークションサイトに出品する商品C1が描出された画像CPをサーバ装置50に送信する(ステップS21)。

Next, the exhibition process by the exhibition system 1 will be described with reference to FIG. First, for example, the

続いて、サーバ装置50は、端末装置10から送信された画像CPを特定装置100に送信する(ステップS22)。これにより、特定装置100は、商品C1が描出された画像CPを受け付ける。

Subsequently, the

そして、特定装置100は、画像CPに描出された商品C1が属する分類を特定する(ステップS23)。具体的には、特定装置100は、入力データとして画像CPを学習器Leに入力し、入力データに対する出力データの再現誤差に基づいて商品C1が属する分類を特定する。

Then, the specifying

その後、特定装置100は、特定した商品C1が属する分類をサーバ装置50に通知する(ステップS24)。例えば、特定装置100は、画像CPに描出された商品C1が属する分類を「ノートパソコン」と特定した場合には、「ノートパソコン」という分類に関する情報をサーバ装置50に通知する。

Thereafter, the specifying

そして、サーバ装置50は、特定装置100から通知された分類に基づいて商品C1のラベル付けを実行する(ステップS25)。例えば、サーバ装置50は、「ノートパソコン」という分類が通知された場合には、商品C1のカテゴリを「ノートパソコン」に設定する。これにより、サーバ装置50は、商品C1のラベルを適切に設定してオークションに出品することができる。

Then, the

〔3.特定装置の構成〕

次に、図4を用いて、実施形態に係る特定装置100の構成について説明する。図4は、実施形態に係る特定装置100の構成例を示す図である。図4に示すように、特定装置100は、通信部110と、記憶部120と、制御部130とを有する。なお、特定装置100は、特定装置100を利用する管理者等から各種操作を受け付ける入力部(例えば、キーボードやマウス等)や、各種情報を表示するための表示部(例えば、液晶ディスプレイ等)を有してもよい。

[3. (Specific device configuration)

Next, the configuration of the specifying

(通信部110について)

通信部110は、例えば、NIC等によって実現される。通信部110は、ネットワークと有線又は無線で接続され、ネットワークを介して、各種のサーバ装置や端末装置との間で情報の送受信を行う。

(About the communication unit 110)

The communication unit 110 is realized by a NIC or the like, for example. The communication unit 110 is connected to a network by wire or wirelessly, and transmits / receives information to / from various server devices and terminal devices via the network.

(記憶部120について)

記憶部120は、例えば、RAM(Random Access Memory)、フラッシュメモリ(Flash Memory)等の半導体メモリ素子、または、ハードディスク、光ディスク等の記憶装置によって実現される。記憶部120は、学習器情報記憶部121を有する。

(About the storage unit 120)

The storage unit 120 is realized by, for example, a semiconductor memory device such as a RAM (Random Access Memory) or a flash memory, or a storage device such as a hard disk or an optical disk. The storage unit 120 includes a learning device information storage unit 121.

(学習器情報記憶部121について)

学習器情報記憶部121は、学習器(例えば、DNN)に関する情報を記憶する。具体的には、学習器情報記憶部121は、DNN(例えば、オートエンコーダ)に含まれる入力層、中間層および出力層のノードや、ノード間の結合係数に関する情報を記憶する。例えば、学習器情報記憶部121は、図1に示す学習器Leを記憶する。

(About the learning device information storage unit 121)

The learning device information storage unit 121 stores information related to the learning device (for example, DNN). Specifically, the learning device information storage unit 121 stores information on nodes of input layers, intermediate layers, and output layers included in a DNN (for example, an auto encoder) and coupling coefficients between the nodes. For example, the learning device information storage unit 121 stores the learning device Le illustrated in FIG.

(制御部130について)

制御部130は、例えば、CPU(Central Processing Unit)やMPU(Micro Processing Unit)等によって、特定装置100内部の記憶装置に記憶されている各種プログラム(特定プログラムの一例に相当)がRAMを作業領域として実行されることにより実現される。また、制御部130は、例えば、ASIC(Application Specific Integrated Circuit)やFPGA(Field Programmable Gate Array)等の集積回路により実現される。

(About the control unit 130)

The control unit 130 is configured such that, for example, a CPU (Central Processing Unit), an MPU (Micro Processing Unit), or the like stores various programs (corresponding to an example of the specific program) stored in a storage device inside the

制御部130は、図4に示すように、受付部131と、生成部132と、算出部133と、特定部134とを有し、以下に説明する情報処理の機能や作用を実現または実行する。なお、制御部130の内部構成は、図4に示した構成に限られず、後述する生成処理を行う構成であれば他の構成であってもよい。また、制御部130が有する各処理部の接続関係は、図4に示した接続関係に限られず、他の接続関係であってもよい。

As illustrated in FIG. 4, the control unit 130 includes a reception unit 131, a generation unit 132, a calculation unit 133, and a

(受付部131について)

受付部131は、入力データを受け付ける。具体的には、受付部131は、被写体が描出された画像を受け付ける。例えば、受付部131は、販売者がオークションサイトに商品を出品する際に、出品する商品が描出された画像を端末装置10から受け付ける。また、受付部131は、学習器の学習を行う際には、所定の分類の被写体が描出された画像を受け付ける。なお、この場合、受付部131は、所定の分類の特徴を学習するのに十分な数の画像を受け付ける。

(About the reception unit 131)

The accepting unit 131 accepts input data. Specifically, the accepting unit 131 accepts an image depicting a subject. For example, when the seller places a product on the auction site, the accepting unit 131 accepts an image depicting the product to be exhibited from the

(生成部132について)

生成部132は、学習器(例えば、DNN)を生成する。具体的には、生成部132は、入力データを入力した場合に出力する出力データが所定の分類の特徴情報を再現するノード間の結合係数を算出し、算出した結合係数をノード間に設定することでオートエンコーダを生成する。一例としては、生成部132は、バックプロパゲーション法や教師あり学習によりDNNに含まれるノード間の結合係数を算出する。

(About the generator 132)

The generation unit 132 generates a learning device (for example, DNN). Specifically, the generation unit 132 calculates a coupling coefficient between nodes in which output data output when input data is input reproduces feature information of a predetermined classification, and sets the calculated coupling coefficient between the nodes. The auto encoder is generated. As an example, the generation unit 132 calculates a coupling coefficient between nodes included in the DNN by a back-propagation method or supervised learning.

例えば、生成部132は、受付部131によって「ノートパソコン」が描出された画像を入力した場合に出力する出力データが「ノートパソコン」の分類の特徴情報を再現するノード間の結合係数を算出する。そして、生成部132は、算出した結合係数をノード間に設定することでオートエンコーダを生成する。これにより、生成部132は、所定の分類に属する被写体が描出された画像が受け付けられた場合に、被写体を再現する出力データを出力する学習器を生成することができる。例えば、生成部132は、ノートパソコンが描出された画像を入力した場合に、ノートパソコンを再現した画像である出力データを出力する学習器を生成する。なお、生成部132は、例えば、ネットオークションで用いられる商品の各種の分類に対応する学習器をそれぞれ生成する。そして、生成部132は、生成した各学習器を学習器情報記憶部121に格納する。 For example, the generation unit 132 calculates a coupling coefficient between nodes in which output data that is output when the image in which the “notebook computer” is rendered by the reception unit 131 is input reproduces the feature information of the classification of the “notebook computer”. . Then, the generation unit 132 generates an auto encoder by setting the calculated coupling coefficient between nodes. Accordingly, the generation unit 132 can generate a learning device that outputs output data for reproducing a subject when an image depicting a subject belonging to a predetermined category is received. For example, the generation unit 132 generates a learning device that outputs output data, which is an image reproducing a notebook computer, when an image drawn by the notebook computer is input. In addition, the production | generation part 132 produces | generates the learning device corresponding to the various classification | category of the goods used by an online auction, for example. Then, the generation unit 132 stores each generated learning device in the learning device information storage unit 121.

(算出部133について)

算出部133は、出力データの再現誤差を算出する。具体的には、算出部133は、所定の分類の特徴情報を再現する学習器に対して、受付部131によって受け付けられた入力データを入力した場合に出力する出力データの再現誤差を算出する。

(About the calculation unit 133)

The calculation unit 133 calculates a reproduction error of the output data. Specifically, the calculation unit 133 calculates a reproduction error of output data output when the input data received by the reception unit 131 is input to a learning device that reproduces feature information of a predetermined classification.

例えば、算出部133は、まず、学習器情報記憶部121に記憶された学習器であって各種の分類の特徴を学習した各学習器に入力データを入力する。続いて、算出部133は、各学習器から出力された出力データの再現誤差をそれぞれ算出する。ここで、算出部133は、例えば、入力データと出力データとの間の誤差が小さいほど再現誤差を低く算出する。すなわち、算出部133は、出力データが入力データを正確に再現しているほど再現誤差を低く算出する。なお、算出部133は、生成部132によって生成された学習器に限らず、他から取得した学習器を用いて算出処理を行ってもよい。 For example, the calculation unit 133 first inputs input data to each learning device that has been stored in the learning device information storage unit 121 and has learned characteristics of various classifications. Subsequently, the calculation unit 133 calculates the reproduction error of the output data output from each learning device. Here, for example, the calculation unit 133 calculates the reproduction error lower as the error between the input data and the output data is smaller. That is, the calculation unit 133 calculates the reproduction error as the output data accurately reproduces the input data. Note that the calculation unit 133 is not limited to the learning device generated by the generation unit 132, and the calculation processing may be performed using a learning device acquired from another.

(特定部134について)

特定部134は、受付部131によって受け付けられた入力データが属する分類を特定する。具体的には、特定部134は、算出部133によって算出された再現誤差に基づいて入力データが属する分類を特定する。例えば、特定部134は、算出部133によって算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を入力データが属する分類として特定する。特徴が類似するオートエンコーダほど入力データを最も高い精度で再現する出力データを出力すると考えられるからである。

(About the specific part 134)

The specifying

そして、特定部134は、例えば、入力データが属する分類として特定した分類をサーバ装置50に通知する。これにより、サーバ装置50は、サーバ装置50から通知された分類を用いて、例えば、販売者がオークションサイトに出品する商品のラベル付けを適切に行うことができる。

For example, the specifying

〔4.生成処理手順〕

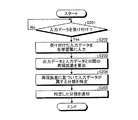

次に、図5を用いて、実施形態に係る特定装置100による生成処理の手順について説明する。図5は、実施形態に係る特定装置100による生成処理手順を示すフローチャートである。

[4. Generation process procedure)

Next, with reference to FIG. 5, a generation process procedure performed by the

図5に示すように、特定装置100は、入力データを受け付ける(ステップS101)。例えば、特定装置100は、入力データとして所定の分類に属する商品が描出された画像を、商品が属する分類の特徴を学習するのに十分な枚数受け付ける。そして、特定装置100は、入力データを受け付けていない場合には(ステップS101;No)、入力データを受け付けるまで待機する。例えば、特定装置100は、商品が属する分類の特徴を学習するのに十分な枚数が集まるまで画像を受け付ける。

As illustrated in FIG. 5, the identifying

一方、特定装置100は、入力データを受け付けた場合(ステップS101;Yes)、受け付けた入力データを学習器に入力する(ステップS102)。例えば、特定装置100は、入力データとして所定の分類に属する商品が描出された画像を学習器に入力する。

On the other hand, when receiving the input data (step S101; Yes), the

その後、特定装置100は、受け付けられた入力データに基づいて、入力データを入力した場合に入力データを再現する出力データを出力する学習器を生成する。具体的には、特定装置100は、入力データを入力した場合に出力する出力データが所定の分類の特徴情報を再現するノード間の結合係数を算出する(ステップS103)。例えば、特定装置100は、バックプロパゲーション法により結合係数を算出する。一例としては、特定装置100は、出力データの誤差が最小となる結合係数を算出する。

After that, the identifying

そして、特定装置100は、所定の分類の特徴を学習した学習器を生成する(ステップS104)。例えば、特定装置100は、算出した結合係数をノード間に設定することで、所定の分類の特徴を学習した学習器を生成する。そして、特定装置100は、生成した学習器を格納する(ステップS105)。なお、特定装置100は、例えば、ネットオークションで用いられる商品の各種の分類において上記のステップS101〜S105の処理を実行し、各種の分類に対応する学習器をそれぞれ生成する。

Then, the identifying

〔5.特定処理手順〕

次に、図6を用いて、実施形態に係る特定装置100による特定処理の手順について説明する。図6は、実施形態に係る特定装置100による特定処理手順を示すフローチャートである。

[5. Specific processing procedure)

Next, the procedure of the specifying process by the specifying

図6に示すように、特定装置100は、入力データを受け付ける(ステップS201)。例えば、特定装置100は、入力データとして販売者がネットオークションに出品する商品が描出された画像を受け付ける。そして、特定装置100は、入力データを受け付けていない場合には(ステップS201;No)、入力データを受け付けるまで待機する。

As illustrated in FIG. 6, the identifying

一方、特定装置100は、入力データを受け付けた場合(ステップS201;Yes)、受け付けた入力データを各学習器に入力する(ステップS202)。例えば、特定装置100は、各種の分類の特徴を学習した学習器を学習器情報記憶部121から取得する。そして、特定装置100は、取得した各学習器に販売者がオークションに出品する商品が描出された画像をそれぞれ入力する。

On the other hand, when receiving the input data (step S201; Yes), the

その後、特定装置100は、出力データの再現誤差を算出する(ステップS203)。具体的には、特定装置100は、各学習器が出力した出力データの再現誤差をそれぞれ算出する。

Thereafter, the identifying

そして、特定装置100は、算出した再現誤差に基づいて入力データが属する分類を特定する(ステップS204)。例えば、特定装置100は、算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を入力データが属する分類として特定する。

Then, the specifying

そして、特定装置100は、特定した分類をサーバ装置50に通知する(ステップS205)。その後、サーバ装置50は、特定装置100から通知された分類に基づいて入力データのラベル付けを実行する。これにより、サーバ装置50は、例えば、オークションサイトに出品する商品に適切なラベルを付けることができる。

Then, the specifying

〔6.変形例〕

上述した実施形態に係る特定装置100は、上記実施形態以外にも種々の異なる形態にて実施されてよい。そこで、以下では、上記の特定装置100の他の実施形態について説明する。

[6. (Modification)

The

〔6−1.人の分類を特定〕

上記実施形態では、特定装置100は、商品の分類の特徴情報を再現する学習器を用いて、入力データである画像に描出された商品が属する分類を特定する例を示した。ここで、特定装置100は、各種の特徴を学習した学習器を用いて、各種の分類を特定してもよい。

[6-1. (Identify people's classification)

In the above-described embodiment, the

具体的には、特定装置100は、人が属する分類の特徴情報を再現する学習器に対して、人の動きを入力した場合に出力する出力データの人の動きに対する再現誤差を算出し、算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を人が属する分類として特定する。

Specifically, the identifying

初めに、特定装置100によって所定の人が属する分類の特徴情報を再現する学習器を生成する処理について説明する。例えば、特定装置100は、まず、歩数計やスマートフォンなどを人に持たせることで各時刻における人の動きに関する情報を人が所属する組織の業種ごとに取得する。すなわち、特定装置100は、人の動きを時系列なデータとして取得する。

First, a process of generating a learning device that reproduces characteristic information of a classification to which a predetermined person belongs by the

そして、特定装置100は、取得した人の動きに関する情報を用いて、人の動きの特徴を学習する学習器(例えば、オートエンコーダ)を生成する。すなわち、人の行動パターンを学習した学習器を生成する。例えば、特定装置100は、人の動きの特徴を学習する学習器を人が所属する組織の業種ごとに生成する。一例としては、特定装置100は、飲食業、製造業、漁業といった各種の業種ごとに人の動きの特徴を学習した学習器を生成する。なお、特定装置100は、人が所属する組織の業種ごとに限らず、性別や役職などといった各種のユーザ属性ごとに学習器を生成してもよい。

Then, the specifying

次に、特定装置100が学習器を用いて人が属する分類を特定する特定処理について説明する。特定装置100は、まず、入力データとして特定対象の人の動きを受け付ける。そして、特定装置100は、生成した学習器を用いて、人が所属する組織の業種を特定する。例えば、特定装置100は、まず、入力データを各学習器に入力する。一例としては、特定装置100は、入力データとして「午前10時〜午前11時までのAさんの動き」を示すベクトルを各学習器に入力する。

Next, a description will be given of a specifying process in which the specifying

そして、特定装置100は、人が属する分類の特徴情報を再現する各学習器に対して、受け付けられた人の動きを入力した場合に出力する出力データの入力データに対する再現誤差を算出する。例えば、特定装置100は、出力データが表すベクトルと入力データが表すベクトルとの間の誤差に基づいて再現誤差を算出する。

Then, the identifying

そして、特定装置100は、算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を人が属する分類として特定する。例えば、特定装置100は、最も低い再現誤差となる出力データを出力する学習器が飲食業に対応する場合、人の分類を「飲食業」として特定する。なお、特定装置100は、利用者の行動、思考、属性などから利用者のラベル付けを行ってもよい。

Then, the identifying

このように、特定装置100は、入力データとして人の動きを受け付ける。また、特定装置100は、所定の人が属する分類の特徴情報を再現する学習器に対して、受付部131によって受け付けられた人の動きを入力した場合に出力する出力データの入力データに対する再現誤差を算出する。また、特定装置100は、算出部133によって算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を人が属する分類として特定する。

In this way, the

これにより、特定装置100は、入力データに対して入力データが属する適切な分類を特定することができるので、人に適切なラベルを付けることができる。例えば、特定装置100は、業種や役職ごとに分類したラベルを人に対して適切に付けることができるので、マーケティングなどにおけるデータ分析に活用することができる。一例としては、特定装置100は、ビッグデータのサンプルとして活用することができるので、分析の精度を高めることができる。

Thereby, since the identifying

なお、特定装置100は、利用者の友人関係の特徴の共通性を特定してもよい。この場合、特定装置100は、友人関係の特徴を学習した学習器を生成する。例えば、特定装置100は、友人が属するユーザ属性ごとに特徴を学習した学習器を生成する。その後、特定装置100は、入力データとして利用者の友人に関する情報を学習器に入力する。続いて、特定装置100は、入力データに対して学習器が出力する出力データに基づいて利用者の友人関係の特徴を特定する。

The specifying

〔6−2.分類を提案〕

上記実施形態では、特定装置100は、算出部133によって算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を入力データが属する分類として特定し、特定した分類を商品のラベルとして付ける例を示した。

[6-2. (Proposed classification)

In the above embodiment, the identifying

ここで、特定装置100は、再現誤差に応じて入力データが属する分類を提案してもよい。例えば、特定装置100は、ネットオークションに商品を出品する販売者に対して、算出部133によって算出された再現誤差が所定の閾値より低い分類を商品が属するカテゴリとして提案する。続いて、販売者は、提案されたカテゴリのうち商品に最も適したカテゴリを選択する。そして、サーバ装置50は、販売者によって選択されたカテゴリを商品のラベルとして付けてネットオークションに出品する。

Here, the identifying

このように、特定装置100は、再現誤差に応じて入力データが属する分類を提案する。これにより、特定装置100は、機械的に特定された分類の候補から販売者が商品のカテゴリを選択することができるので、販売者の希望を反映したカテゴリを商品に付けることができる。このため、特定装置100は、販売者のラベル付けにかかる手間を軽減することができるとともに、販売者の利便性を高めることができる。

As described above, the specifying

〔6−3.オートエンコーダ〕

上記実施形態では、特定装置100は、所定の分類の特徴情報を再現する学習器に対して、受付部131によって受け付けられた入力データを入力した場合に出力する出力データの入力データに対する再現誤差を算出する例を示した。

[6-3. (Auto encoder)

In the above-described embodiment, the identifying

ここで、特定装置100は、特徴情報の次元数を削減した後に特徴情報を再現する学習器に対して、受付部131によって受け付けられた入力データを入力した場合に出力する出力データの再現誤差を算出してもよい。例えば、特定装置100は、まず、中間層に含まれるノード群の層のうち中心の層が最も少ないノード数となるオートエンコーダを生成する。すなわち、特定装置100は、入力された入力データの情報の次元数を中間層の中心まで序所に削減し、その後に次元数を元に戻すオートエンコーダを生成する。具体的には、特定装置100は、出力データが入力データを高い精度で再現するようにノード間の結合係数を補正することでオートエンコーダを生成する。ここで、特定装置100は、例えば、入力データの画像自体を再現するのではなく、画像に描出された被写体を再現するオートエンコーダを生成する。一例としては、特定装置100は、画像に描出された被写体を再現するオートエンコーダを生成する。

Here, the identifying

そして、特定装置100は、生成したオートエンコーダに対して、受付部131によって受け付けられた入力データを入力した場合に出力する出力データの入力データに対する再現誤差を算出する。

Then, the identifying

このように、特定装置100は、特徴情報の次元数を削減した後に特徴情報を再現する学習器に対して、受付部131によって受け付けられた入力データを入力した場合に出力する出力データの入力データに対する再現誤差を算出する。

As described above, the specifying

これにより、特定装置100は、画像に描出された被写体を再現するオートエンコーダを生成することができるので、出力データの再現精度を高めることができる。このため、特定装置100は、入力データの分類を特定する精度を高めることができる。

As a result, the identifying

〔6−4.DNN〕

上記実施形態では、特定装置100は、入力層、中間層および出力層によって構成される学習器を生成する例を示した。ここで、特定装置100は、各種の層に任意の数のノード群を含む学習器を生成してもよい。例えば、特定装置100は、中間層に複数のノード群が含まれる多段の学習器を生成する。また、学習器に含まれるノード群は、任意の数のノードによって構成されてもよい。

[6-4. DNN]

In the above-described embodiment, the

〔6−5.適用対象〕

上記実施形態では、特定装置100は、ネットオークションに出品する商品の分類を特定する画像認識の適用例を示した。ここで、特定装置100は、商品の分類に限らず、各種の認識に適用してもよい。例えば、特定装置100は、音声を対象とする音声認識に適用する。一例としては、特定装置100は、入力データとして音声データを入力することで話者の分類を学習する学習器を生成する。これにより、特定装置100は、音声データに含まれる音声を発した話者の性別や年齢、国籍などといった分類を特定することができる。

[6-5. (Applicable)

In the above-described embodiment, the

〔6−6.装置構成〕

上記実施形態では、特定装置100は、サーバ装置50と一体となって構成されてもよい。この場合、特定装置100は、学習器を用いて特定した分類に基づいて商品のラベル付けを行う。また、特定装置100は、学習器を生成する生成処理は行わず、算出部133と、特定部134とによる特定処理のみを行う特定装置であってもよい。この場合、特定装置は、少なくとも生成部132を有しない。そして、特定装置は、生成部132を有する生成装置によって生成された学習器を用いて分類を特定し、特定した分類をサーバ装置50等に通知する。

[6-6. Device configuration〕

In the above embodiment, the specifying

〔6−7.その他〕

上記実施形態において説明した各処理のうち、自動的に行われるものとして説明した処理の全部または一部を手動的に行うこともでき、あるいは、手動的に行われるものとして説明した処理の全部または一部を公知の方法で自動的に行うこともできる。この他、上記文書中や図面中で示した処理手順、具体的名称、各種のデータやパラメータを含む情報については、特記する場合を除いて任意に変更することができる。例えば、各図に示した各種情報は、図示した情報に限られない。

[6-7. Others]

Of the processes described in the above embodiment, all or part of the processes described as being automatically performed can be performed manually, or all of the processes described as being performed manually or A part can be automatically performed by a known method. In addition, the processing procedures, specific names, and information including various data and parameters shown in the document and drawings can be arbitrarily changed unless otherwise specified. For example, the various types of information illustrated in each drawing is not limited to the illustrated information.

また、図示した各装置の各構成要素は機能概念的なものであり、必ずしも物理的に図示の如く構成されていることを要しない。すなわち、各装置の分散・統合の具体的形態は図示のものに限られず、その全部または一部を、各種の負荷や使用状況などに応じて、任意の単位で機能的または物理的に分散・統合して構成することができる。例えば、図4に示した受付部131および生成部132は統合されてもよい。 Further, each component of each illustrated apparatus is functionally conceptual, and does not necessarily need to be physically configured as illustrated. In other words, the specific form of distribution / integration of each device is not limited to that shown in the figure, and all or a part thereof may be functionally or physically distributed or arbitrarily distributed in arbitrary units according to various loads or usage conditions. Can be integrated and configured. For example, the reception unit 131 and the generation unit 132 illustrated in FIG. 4 may be integrated.

〔6−8.ハードウェア構成〕

また、上述してきた実施形態に係る特定装置100は、例えば図7に示すような構成のコンピュータ1000によって実現される。以下、特定装置100を例に挙げて説明する。図7は、特定装置100の機能を実現するコンピュータ1000の一例を示すハードウェア構成図である。コンピュータ1000は、CPU1100、RAM1200、ROM1300、HDD1400、通信インターフェイス(I/F)1500、入出力インターフェイス(I/F)1600、およびメディアインターフェイス(I/F)1700を有する。

[6-8. Hardware configuration)

In addition, the specifying

CPU1100は、ROM1300またはHDD1400に格納されたプログラムに基づいて動作し、各部の制御を行う。ROM1300は、コンピュータ1000の起動時にCPU1100によって実行されるブートプログラムや、コンピュータ1000のハードウェアに依存するプログラム等を格納する。

The

HDD1400は、CPU1100によって実行されるプログラム、および、かかるプログラムによって使用されるデータ等を格納する。通信インターフェイス1500は、通信網500を介して他の機器からデータを受信してCPU1100へ送り、CPU1100が生成したデータを通信網500を介して他の機器へ送信する。

The

CPU1100は、入出力インターフェイス1600を介して、ディスプレイやプリンタ等の出力装置、および、キーボードやマウス等の入力装置を制御する。CPU1100は、入出力インターフェイス1600を介して、入力装置からデータを取得する。また、CPU1100は、生成したデータを入出力インターフェイス1600を介して出力装置へ出力する。

The

メディアインターフェイス1700は、記録媒体1800に格納されたプログラムまたはデータを読み取り、RAM1200を介してCPU1100に提供する。CPU1100は、かかるプログラムを、メディアインターフェイス1700を介して記録媒体1800からRAM1200上にロードし、ロードしたプログラムを実行する。記録媒体1800は、例えばDVD(Digital Versatile Disc)、PD(Phase change rewritable Disk)等の光学記録媒体、MO(Magneto Optical disk)等の光磁気記録媒体、テープ媒体、磁気記録媒体、または半導体メモリ等である。

The

例えば、コンピュータ1000が実施形態に係る特定装置100として機能する場合、コンピュータ1000のCPU1100は、RAM1200上にロードされたプログラムを実行することにより、制御部130の機能を実現する。また、HDD1400には、記憶部120内のデータが格納される。コンピュータ1000のCPU1100は、これらのプログラムを記録媒体1800から読み取って実行するが、他の例として、他の装置から通信網500を介してこれらのプログラムを取得してもよい。

For example, when the

〔7.効果〕

上述してきたように、実施形態に係る特定装置100は、受付部131と、算出部133と、特定部134とを有する。受付部131は、入力データを受け付ける。算出部133は、所定の分類の特徴情報を再現する学習器に対して、受付部131によって受け付けられた入力データを入力した場合に出力する出力データの再現誤差を算出する。特定部134は、算出部133によって算出された再現誤差に基づいて入力データが属する分類を特定する。

[7. effect〕

As described above, the specifying

また、実施形態に係る特定装置100において、特定部134は、算出部133によって算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を前記入力データが属する分類として特定する。

In the specifying

また、実施形態に係る特定装置100において、受付部131は、入力データとして商品が描出された画像を受け付ける。算出部133は、所定の商品が属する分類の特徴情報を再現する学習器に対して、受付部131によって受け付けられた画像を入力した場合に出力する出力データの再現誤差を算出する。特定部134は、算出部133によって算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を商品が属する分類として特定する。

In the specifying

また、実施形態に係る特定装置100において、生成部132は、入力データを入力した場合に出力する出力データが所定の分類の特徴情報を再現するノード間の結合係数を算出し、算出した結合係数をノード間に設定することで学習器を生成する。

In the specifying

これにより、実施形態に係る特定装置100は、入力データが属する適切な分類を特定することができるので、適切なラベルを付けることができる。例えば、特定装置100は、被写体が描出された画像が入力された場合に画像に描出された被写体が属する分類を特定することができる。このため、特定装置100は、例えば、インターネットオークションにおいて出品者が新規に出品する商品が描出された画像を受け付けた場合に商品が属するカテゴリを特定することができる。

Thereby, since the

また、特定装置100は、例えば、インターネットオークションで出品する商品に対して適切なラベルを付けることができるので、不適切なラベルが付いた商品を減らすことができる。このため、特定装置100は、出品者やオークションの利用者の利便性を向上させることができる。

Moreover, since the

また、特定装置100は、商品の画像を学習器に入力するだけで商品に対して適切なラベルを付けることができるので、出品者がラベルを検討する手間を減らすことができる。このため、特定装置100は、出品者の出品作業における利便性を向上させることができる。

Moreover, since the

また、変形例に係る特定装置100において、受付部131は、入力データとして人の動きを受け付ける。算出部133は、所定の人が属する分類の特徴情報を再現する学習器に対して、受付部131によって受け付けられた人の動きを入力した場合に出力する出力データの入力データに対する再現誤差を算出する。特定部134は、算出部133によって算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を人が属する分類として特定する。

In the specifying

これにより、変形例に係る特定装置100は、入力データが属する適切な分類を特定することができるので、人に適切なラベルを付けることができる。例えば、特定装置100は、業種や役職ごとに分類したラベルを人に対して適切に付けることができるので、マーケティングなどにおけるデータ分析に活用することができる。一例としては、特定装置100は、ビッグデータのサンプルとして活用することができるので、分析の精度を高めることができる。

Thereby, since the

また、変形例に係る特定装置100において、算出部133は、特徴情報の次元数を削減した後に特徴情報を再現する学習器に対して、受付部131によって受け付けられた入力データを入力した場合に出力する出力データの入力データに対する再現誤差を算出する。

Further, in the specifying

これにより、変形例に係る特定装置100は、画像に描出された被写体を再現するオートエンコーダを生成することができるので、出力データの再現精度を高めることができる。このため、特定装置100は、入力データの分類を特定する精度を高めることができる。

As a result, the

以上、本願の実施形態のいくつかを図面に基づいて詳細に説明したが、これらは例示であり、発明の開示の欄に記載の態様を始めとして、当業者の知識に基づいて種々の変形、改良を施した他の形態で本発明を実施することが可能である。 As described above, some of the embodiments of the present application have been described in detail with reference to the drawings. However, these are merely examples, and various modifications, including the aspects described in the disclosure section of the invention, based on the knowledge of those skilled in the art, It is possible to implement the present invention in other forms with improvements.

1 出品システム

10 端末装置

50 サーバ装置

100 特定装置

121 学習器情報記憶部

131 受付部

132 生成部

133 算出部

134 特定部

DESCRIPTION OF SYMBOLS 1

Claims (8)

所定の分類の特徴情報を再現する学習器に対して、前記受付部によって受け付けられた入力データを入力した場合に出力する出力データの前記入力データに対する再現誤差を算出する算出部と、

前記算出部によって算出された再現誤差に基づいて前記入力データが属する分類を特定する特定部と

を備えたことを特徴とする特定装置。 A reception unit for receiving input data;

For a learning device that reproduces feature information of a predetermined classification, a calculation unit that calculates a reproduction error of the output data output when the input data received by the receiving unit is input;

And a specifying unit that specifies a classification to which the input data belongs based on a reproduction error calculated by the calculating unit.

前記算出部によって算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を前記入力データが属する分類として特定する

ことを特徴とする請求項1に記載の特定装置。 The specific part is:

2. The specification according to claim 1, wherein a classification corresponding to a learning device that outputs output data having the lowest reproduction error among the reproduction errors calculated by the calculation unit is specified as a classification to which the input data belongs. apparatus.

前記入力データとして商品が描出された画像を受け付け、

前記算出部は、

所定の商品が属する分類の特徴情報を再現する学習器に対して、前記受付部によって受け付けられた画像を入力した場合に出力する出力データと前記画像との間の再現誤差を算出し、

前記特定部は、

前記算出部によって算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を前記商品が属する分類として特定する

ことを特徴とする請求項1または2に記載の特定装置。 The reception unit

Accept an image depicting a product as the input data,

The calculation unit includes:

For a learning device that reproduces characteristic information of a classification to which a predetermined product belongs, a reproduction error between the output data output when the image received by the receiving unit is input and the image is calculated,

The specific part is:

The classification corresponding to the learning device that outputs the output data having the lowest reproduction error among the reproduction errors calculated by the calculation unit is specified as a classification to which the product belongs. Specific device.

前記入力データとして人の動きを受け付け、

前記算出部は、

所定の人が属する分類の特徴情報を再現する学習器に対して、前記受付部によって受け付けられた人の動きを入力した場合に出力する出力データの前記人の動きに対する再現誤差を算出し、

前記特定部は、

前記算出部によって算出された再現誤差のうち最も低い再現誤差となる出力データを出力する学習器に対応する分類を前記人が属する分類として特定する

ことを特徴とする請求項1〜3のいずれか一つに記載の特定装置。 The reception unit

Accepting human movement as the input data,

The calculation unit includes:

For a learning device that reproduces feature information of a classification to which a predetermined person belongs, calculating a reproduction error for the movement of the person in the output data that is output when the movement of the person accepted by the reception unit is input,

The specific part is:

The classification corresponding to the learning device that outputs the output data having the lowest reproduction error among the reproduction errors calculated by the calculation unit is specified as the classification to which the person belongs. The specific device according to one.

をさらに備えることを特徴とする請求項1〜4のいずれか一つに記載の特定装置。 Generating that generates the learning device by calculating a coupling coefficient between nodes in which output data output when the input data is input reproduces characteristic information of a predetermined classification, and setting the calculated coupling coefficient between the nodes The specifying device according to claim 1, further comprising: a unit.

前記特徴情報の次元数を削減した後に当該特徴情報を再現する学習器に対して、前記受付部によって受け付けられた入力データを入力した場合に出力する出力データの前記入力データに対する再現誤差を算出する

ことを特徴とする請求項1〜5のいずれか一つに記載の特定装置。 The calculation unit includes:

The reproduction error of the output data output when the input data received by the receiving unit is input to the learning device that reproduces the feature information after reducing the number of dimensions of the feature information is calculated. The specific device according to claim 1, wherein

入力データを受け付ける受付工程と、

所定の分類の特徴情報を再現する学習器に対して、前記受付工程によって受け付けられた入力データを入力した場合に出力する出力データの前記入力データに対する再現誤差を算出する算出工程と、

前記算出工程によって算出された再現誤差に基づいて前記入力データが属する分類を特定する特定工程と

を含んだことを特徴とする特定方法。 A specific method performed by a specific device,

A reception process for receiving input data;

A calculation step for calculating a reproduction error for the input data of the output data to be output when the input data received by the reception step is input to a learning device that reproduces feature information of a predetermined classification;

A specifying step of specifying a classification to which the input data belongs based on the reproduction error calculated by the calculating step.

所定の分類の特徴情報を再現する学習器に対して、前記受付手順によって受け付けられた入力データを入力した場合に出力する出力データの前記入力データに対する再現誤差を算出する算出手順と、

前記算出手順によって算出された再現誤差に基づいて前記入力データが属する分類を特定する特定手順と

をコンピュータに実行させることを特徴とする特定プログラム。 Acceptance procedure to accept input data,

A calculation procedure for calculating a reproduction error with respect to the input data of the output data output when the input data received by the reception procedure is input to a learning device that reproduces feature information of a predetermined classification;

A specifying program for causing a computer to execute a specifying procedure for specifying a classification to which the input data belongs based on a reproduction error calculated by the calculating procedure.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2014126554A JP5993897B2 (en) | 2014-06-19 | 2014-06-19 | Specific apparatus, specific method, and specific program |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2014126554A JP5993897B2 (en) | 2014-06-19 | 2014-06-19 | Specific apparatus, specific method, and specific program |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2016004549A JP2016004549A (en) | 2016-01-12 |

| JP5993897B2 true JP5993897B2 (en) | 2016-09-14 |

Family

ID=55223746

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2014126554A Active JP5993897B2 (en) | 2014-06-19 | 2014-06-19 | Specific apparatus, specific method, and specific program |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP5993897B2 (en) |

Families Citing this family (15)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9805306B1 (en) * | 2016-11-23 | 2017-10-31 | Accenture Global Solutions Limited | Cognitive robotics analyzer |

| JP6545728B2 (en) | 2017-01-11 | 2019-07-17 | 株式会社東芝 | ABNORMALITY DETECTING APPARATUS, ABNORMALITY DETECTING METHOD, AND ABNORMALITY DETECTING PROGRAM |

| TWI748035B (en) * | 2017-01-20 | 2021-12-01 | 日商半導體能源硏究所股份有限公司 | Display system and electronic device |

| WO2018138603A1 (en) | 2017-01-26 | 2018-08-02 | Semiconductor Energy Laboratory Co., Ltd. | Semiconductor device and electronic device including the semiconductor device |

| JP7075358B2 (en) * | 2017-01-26 | 2022-05-25 | 株式会社半導体エネルギー研究所 | Semiconductor devices and electronic devices |

| JP7208889B2 (en) * | 2017-03-09 | 2023-01-19 | 株式会社半導体エネルギー研究所 | broadcasting system |

| JP6981760B2 (en) * | 2017-03-10 | 2021-12-17 | 株式会社半導体エネルギー研究所 | Semiconductor device |

| WO2018179338A1 (en) * | 2017-03-31 | 2018-10-04 | 三菱電機株式会社 | Machine learning device and image recognition device |

| US11556583B2 (en) | 2017-09-04 | 2023-01-17 | Nec Corporation | Information processing system, information processing method, and storage medium |

| US10726525B2 (en) * | 2017-09-26 | 2020-07-28 | Samsung Electronics Co., Ltd. | Image denoising neural network architecture and method of training the same |

| JP6962123B2 (en) * | 2017-10-04 | 2021-11-05 | 株式会社豊田中央研究所 | Label estimation device and label estimation program |

| US20210073615A1 (en) * | 2018-04-12 | 2021-03-11 | Nippon Telegraph And Telephone Corporation | Neural network system, neural network method, and program |

| JP7056406B2 (en) * | 2018-06-22 | 2022-04-19 | 日本電信電話株式会社 | Devices, sensor networks, communication methods and programs that function as sensor nodes and data centers |

| JP6757378B2 (en) | 2018-08-28 | 2020-09-16 | 株式会社モルフォ | Image identification device, image identification method and image identification program |

| JP7322411B2 (en) * | 2019-01-24 | 2023-08-08 | カシオ計算機株式会社 | Image classification device, image classification method and program |

Family Cites Families (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2005267604A (en) * | 2004-02-18 | 2005-09-29 | Fuji Xerox Co Ltd | Operation classification support device and operation classifying device |

-

2014

- 2014-06-19 JP JP2014126554A patent/JP5993897B2/en active Active

Also Published As

| Publication number | Publication date |

|---|---|

| JP2016004549A (en) | 2016-01-12 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5993897B2 (en) | Specific apparatus, specific method, and specific program | |

| US20220092635A1 (en) | Adaptive real time modeling and scoring | |

| US10354184B1 (en) | Joint modeling of user behavior | |

| JP6523498B1 (en) | Learning device, learning method and learning program | |

| CN109740018B (en) | Method and device for generating video label model | |

| WO2019133862A1 (en) | Computer vision for unsuccessful queries and iterative search | |

| JP6344995B2 (en) | Specific apparatus, specific method, and specific program | |

| US20210383259A1 (en) | Dynamic workflow optimization using machine learning techniques | |

| US20210390365A1 (en) | Aspect Pre-selection using Machine Learning | |

| US20190214005A1 (en) | Artificial Assistant System Notifications | |

| JP2019139521A (en) | Prediction device, prediction method, and prediction program | |

| JP2019020980A (en) | Estimation device, estimation method, estimation program, and model | |

| JP6050284B2 (en) | Extraction apparatus, extraction method, and extraction program | |

| JP2021119526A (en) | Generation device, generation method, data generation program | |

| WO2020142124A1 (en) | Dynamic link preview generation | |

| JP7231322B2 (en) | LEARNING DEVICE, LEARNING METHOD, LEARNING PROGRAM AND PROGRAM | |

| JP6043755B2 (en) | Generating device, generating method, and generating program | |

| JP6955392B2 (en) | Decision device, decision method, and decision program | |

| JP2019036087A (en) | Generation device, method for generation, generation program, learning data, and model | |

| JP6092160B2 (en) | Display control apparatus, display control method, and display control program | |

| JP7208286B2 (en) | Information processing device, information processing method and information processing program | |

| JP2020035072A (en) | Device, method, and program for processing information | |

| JP7198900B2 (en) | Generation device, generation method, and generation program | |

| JP2019125146A (en) | Information processing device, information processing method, and information processing program | |

| US20220156799A1 (en) | Audience generation using psychographic data |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20160726 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20160822 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 5993897 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| S531 | Written request for registration of change of domicile |

Free format text: JAPANESE INTERMEDIATE CODE: R313531 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| S533 | Written request for registration of change of name |

Free format text: JAPANESE INTERMEDIATE CODE: R313533 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| S111 | Request for change of ownership or part of ownership |

Free format text: JAPANESE INTERMEDIATE CODE: R313111 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| S111 | Request for change of ownership or part of ownership |

Free format text: JAPANESE INTERMEDIATE CODE: R313111 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |