JP5924978B2 - 画像処理装置および画像処理方法 - Google Patents

画像処理装置および画像処理方法 Download PDFInfo

- Publication number

- JP5924978B2 JP5924978B2 JP2012041144A JP2012041144A JP5924978B2 JP 5924978 B2 JP5924978 B2 JP 5924978B2 JP 2012041144 A JP2012041144 A JP 2012041144A JP 2012041144 A JP2012041144 A JP 2012041144A JP 5924978 B2 JP5924978 B2 JP 5924978B2

- Authority

- JP

- Japan

- Prior art keywords

- images

- imaging

- image data

- arrangement

- captured

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/63—Control of cameras or camera modules by using electronic viewfinders

- H04N23/631—Graphical user interfaces [GUI] specially adapted for controlling image capture or setting capture parameters

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

- H04N5/268—Signal distribution or switching

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/90—Arrangement of cameras or camera modules, e.g. multiple cameras in TV studios or sports stadiums

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Human Computer Interaction (AREA)

- Studio Devices (AREA)

- Stereoscopic And Panoramic Photography (AREA)

Description

以下、本発明の好適な実施形態について詳細に説明する。なお、以下の実施形態において示す構成は一例に過ぎず、本発明は図示された構成に限定されるものではない。

ステップ401で取得される撮像画像データについては、上述したとおりである。ステップ401では、同時に、当該撮像画像データの撮像に用いた多眼カメラの撮像部の配置に関する情報(以下、「撮像部配置情報」と呼ぶ。)を取得する。この撮像部配置情報は、多眼カメラの筺体に対する各撮像部の相対位置関係を示す情報であり、撮像時にRAM202等に記憶しておいたものが読み出される。なお、本実施例では、撮像画像データはすべて上述の多眼カメラ100で撮像されることを前提としているため、予めRAM等に記憶しておいた撮像部配置情報を別途取得する構成としている。しかし、例えば、外部メモリに格納された多くの撮像画像データを表示するような場合には、撮像部の数など仕様の異なる多眼カメラで撮像された撮像画像データが混在していることも考えられる。このような場合には、撮像画像データ自体に当該撮像に用いた多眼カメラの撮像部配置情報を関連付けておき、撮像画像データと一緒に取得するようにしてもよい。

ステップ402の表示角度設定処理では、取得した撮像画像データを表示部206に表示する際の角度を設定する。詳細には、操作部204を介してユーザが指定した角度(例えば、0°、+90°、−90°、180°など)を表示角度θとして取得し、RAM202に記憶する。

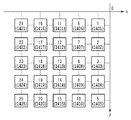

ステップ403の画像出力処理では、取得した撮像部配置情報と設定された表示角度θに基づき撮像画像データ中の各画像を回転させ、さらに回転後の各画像の配置が撮像時における各撮像部の配置と一致するようにその配置を決定して、撮像画像データを表示する。以下、詳しく説明する。

実施例1では、1回の撮像に係る9個の画像ファイルからなる撮像画像データを表示する場合について説明した。次に、複数回の撮像に係る撮像画像データであって、その中に撮像部が単一である一般的なデジタルカメラで撮像した撮像画像データも混在している場合の表示について、実施例2として説明する。なお、実施例1と共通する部分については説明を簡略化ないしは省略し、ここでは差異点を中心に説明することとする。

次に、多眼カメラから得られる複数の撮像画像のうち、ユーザが選択した撮像画像のみを表示する態様について実施例3として説明する。なお、実施例1及び2と共通する部分については説明を簡略化ないしは省略し、ここでは差異点を中心に説明することとする。

次に、多眼カメラにおける撮像部の配置がN×Nの正方形以外の場合について、実施例4として説明する。なお、実施例1〜3と共通する部分については説明を簡略化ないしは省略し、ここでは差異点を中心に説明することとする。

また、本発明の目的は、以下の処理を実行することによっても達成される。即ち、上述した実施形態の機能を実現するソフトウェアのプログラムコードを記録した記憶媒体を、システム或いは装置に供給し、そのシステム或いは装置のコンピュータ(またはCPUやMPU等)が記憶媒体に格納されたプログラムコードを読み出す処理である。この場合、記憶媒体から読み出されたプログラムコード自体が前述した実施の形態の機能を実現することになり、そのプログラムコード及び該プログラムコードを記憶した記憶媒体は本発明を構成することになる。

Claims (17)

- 互いに異なる視点に対応する複数の画像を撮像するための複数の撮像部を有する撮像装置で撮像して得られた撮像画像データを取得する第一の取得手段と、

前記撮像画像データが示す複数の画像を表示する際の前記複数の画像の回転度合い、又は前記複数の画像を撮像した際の前記撮像装置の傾き度合いを示す回転情報を取得する第二の取得手段と、

前記撮像画像データが示す複数の画像を、並べて表示する表示手段と、

前記表示手段により前記複数の画像を並べて表示する際の各画像の向きと配置とを、前記回転情報に基づいて決定する決定手段と、

を有し、

前記決定手段で決定される各画像の配置は、前記撮像画像データの撮像時における前記複数の撮像部の配置と一致するように決定される

ことを特徴とする画像処理装置。 - 前記複数の撮像部は、垂直及び水平方向にそれぞれ複数であることを特徴とする請求項1に記載の画像処理装置。

- 前記第二の取得手段は、ユーザによって入力された、前記複数の画像を表示する際の前記複数の画像の回転度合いを含む前記複数の画像の回転指示を取得し、

前記決定手段は、前記回転指示に基づいて前記複数の画像の向きと配置とを決定する

ことを特徴とする請求項1又は2に記載の画像処理装置。 - 前記第二の取得手段は、前記複数の画像撮像時の前記撮像装置の傾き度合いを取得し、

前記決定手段は、前記傾き度合いに基づいて前記複数の画像の向きと配置とを決定する

ことを特徴とする請求項1又は2に記載の画像処理装置。 - 前記決定手段は、所定の間隔で設定された複数の角度のうち、前記傾き度合いが示す角度に最も近い角度を選択し、該選択した角度に基づいて前記複数の画像の向きと配置とを決定することを特徴とする請求項4に記載の画像処理装置。

- 前記撮像装置は加速度センサを備え、前記第二の取得手段は、前記加速度センサからの出力に基づいて前記撮像装置の傾き度合いを取得することを特徴とする請求項4又は5に記載の画像処理装置。

- 前記第二の取得手段は、前記複数の画像に対応する複数の視点の間の位置関係を示す位置関係情報を更に取得し、

前記決定手段は、前記位置関係情報に更に基づいて前記複数の画像の向きと配置とを決定する

ことを特徴とする請求項1乃至6のいずれか一項に記載の画像処理装置。 - 前記決定手段により決定された向きと配置で並べて表示された前記複数の画像に対して入力された、前記複数の画像のうちの一部を選択するユーザ指示を取得する第三の取得手段と、

前記第三の取得手段により取得された前記ユーザ指示で特定される選択された画像を合成することで合成画像を生成する合成手段と

を有することを特徴とする請求項1乃至7のいずれか一項に記載の画像処理装置。 - 前記複数の画像のうち、前記ユーザ指示で特定される選択された画像を示す画像と、前記合成画像とを表示する表示画像を生成する生成手段を更に有することを特徴とする請求項8に記載の画像処理装置。

- 互いに異なる視点に対応する複数の画像を撮像するための複数の撮像部を有する撮像装置で撮像して得られた撮像画像データを取得する第一の取得手段と、

前記撮像画像データが示す複数の画像の回転度合いを含む、ユーザによって入力された前記複数の画像の回転指示、又は前記複数の画像を撮像した際の前記撮像装置の傾き度合いを示す回転情報を取得する第二の取得手段と、

前記撮像画像データが示す複数の画像を、並べて表示する表示手段と、

前記表示手段により前記複数の画像を並べて表示する場合の前記複数の画像の向きと配置とを示す情報を、前記回転情報に基づいて決定する決定手段と

を有し、

前記決定手段で決定される情報における各画像の配置は、前記撮像画像データの撮像時における前記複数の撮像部の配置と一致するように決定される

ことを特徴とする画像処理装置。 - 互いに異なる視点に対応する複数の画像を撮像するための複数の撮像部を有する撮像装置で撮像して得られた撮像画像データを取得する第一の取得手段と、

前記撮像画像データが示す複数の画像の回転度合いを含む、ユーザによって入力された前記複数の画像の回転指示、又は前記複数の画像を撮像した際の前記撮像装置の傾き度合いを示す回転情報を取得する第二の取得手段と、

前記撮像画像データが示す複数の画像を並べて表示する表示手段と、

を有し、

前記表示手段により前記複数の画像を表示する際の前記複数の画像の回転度合い、又は前記複数の画像を撮像した際の前記撮像装置の傾き度合いが変更された場合に、前記表示において、前記複数の画像の向きと配置との両方が連動して、かつ、各画像の配置が前記撮像画像データの撮像時における前記複数の撮像部の配置と一致するように変化する

ことを特徴とする画像処理装置。 - 前記撮像装置は、複数の撮像部を備えた多眼方式の撮像装置であることを特徴とする請求項1乃至11のいずれか一項に記載の画像処理装置。

- 請求項1乃至12のいずれか一項に記載の画像処理装置を有する、互いに異なる視点に対応する複数の画像を撮像する撮像装置。

- 互いに異なる視点に対応する複数の画像を撮像するための複数の撮像部を有する撮像装置で撮像して得られた撮像画像データを取得するステップと、

前記撮像画像データが示す複数の画像を表示する際の前記複数の画像の回転度合い、又は前記複数の画像を撮像した際の前記撮像装置の傾き度合いを示す回転情報を取得するステップと、

前記複数の画像を並べて表示する際の各画像の向きと配置とを、前記回転情報に基づいて決定するステップと、

前記決定するステップで決定された向きと配置に従って、前記複数の画像を、並べて表示するステップと、

を有し、

前記決定するステップでは、各画像の配置が、前記撮像画像データの撮像時における前記複数の撮像部の配置と一致するように決定される

ことを特徴とする画像処理方法。 - 互いに異なる視点に対応する複数の画像を撮像するための複数の撮像部を有する撮像装置で撮像して得られた撮像画像データを取得するステップと、

前記撮像画像データが示す複数の画像の回転度合いを含む、ユーザによって入力された前記複数の画像の回転指示、又は前記複数の画像を撮像した際の前記撮像装置の傾き度合いを示す回転情報を取得するステップと、

前記複数の画像を並べて表示する場合の前記複数の画像の向きと配置とを示す情報を、前記回転情報に基づいて決定するステップと、

前記決定するステップで決定された向きと配置に従って、前記複数の画像を、並べて表示するステップと、

を有し、

前記決定するステップで決定される情報における各画像の配置は、前記撮像画像データの撮像時における前記複数の撮像部の配置と一致するように決定される

ことを特徴とする画像処理方法。 - 互いに異なる視点に対応する複数の画像を撮像するための複数の撮像部を有する撮像装置で撮像して得られた撮像画像データを取得するステップと、

前記撮像画像データが示す複数の画像の回転度合いを含む、ユーザによって入力された前記複数の画像の回転指示、又は前記複数の画像を撮像した際の前記撮像装置の傾き度合いを示す回転情報を取得するステップと、

前記撮像画像データが示す複数の画像を並べて表示するステップと

を有し、

前記複数の画像を表示する際の前記複数の画像の回転度合い、又は前記複数の画像を撮像した際の前記撮像装置の傾き度合いが変更された場合に、前記表示において、前記複数の画像の向きと配置との両方が連動して、かつ、各画像の配置が前記撮像画像データの撮像時における前記複数の撮像部の配置と一致するように変化する

ことを特徴とする画像処理方法。 - コンピュータを、請求項1乃至12のいずれか1項に記載の画像処理装置として機能さ

せるためのプログラム。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2012041144A JP5924978B2 (ja) | 2012-02-28 | 2012-02-28 | 画像処理装置および画像処理方法 |

| US13/768,317 US9307150B2 (en) | 2012-02-28 | 2013-02-15 | Image processing device, image processing method, and program for display angle determination |

| CN201310064423.5A CN103297685B (zh) | 2012-02-28 | 2013-02-28 | 图像处理装置和图像处理方法 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2012041144A JP5924978B2 (ja) | 2012-02-28 | 2012-02-28 | 画像処理装置および画像処理方法 |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2013179397A JP2013179397A (ja) | 2013-09-09 |

| JP2013179397A5 JP2013179397A5 (ja) | 2015-07-09 |

| JP5924978B2 true JP5924978B2 (ja) | 2016-05-25 |

Family

ID=49002487

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2012041144A Active JP5924978B2 (ja) | 2012-02-28 | 2012-02-28 | 画像処理装置および画像処理方法 |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US9307150B2 (ja) |

| JP (1) | JP5924978B2 (ja) |

| CN (1) | CN103297685B (ja) |

Families Citing this family (72)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US10298834B2 (en) | 2006-12-01 | 2019-05-21 | Google Llc | Video refocusing |

| US11792538B2 (en) | 2008-05-20 | 2023-10-17 | Adeia Imaging Llc | Capturing and processing of images including occlusions focused on an image sensor by a lens stack array |

| US8866920B2 (en) * | 2008-05-20 | 2014-10-21 | Pelican Imaging Corporation | Capturing and processing of images using monolithic camera array with heterogeneous imagers |

| EP2502115A4 (en) | 2009-11-20 | 2013-11-06 | Pelican Imaging Corp | RECORDING AND PROCESSING IMAGES THROUGH A MONOLITHIC CAMERA ARRAY WITH HETEROGENIC IMAGE CONVERTER |

| US8878950B2 (en) | 2010-12-14 | 2014-11-04 | Pelican Imaging Corporation | Systems and methods for synthesizing high resolution images using super-resolution processes |

| WO2013043761A1 (en) | 2011-09-19 | 2013-03-28 | Pelican Imaging Corporation | Determining depth from multiple views of a scene that include aliasing using hypothesized fusion |

| WO2013049699A1 (en) | 2011-09-28 | 2013-04-04 | Pelican Imaging Corporation | Systems and methods for encoding and decoding light field image files |

| EP2817955B1 (en) | 2012-02-21 | 2018-04-11 | FotoNation Cayman Limited | Systems and methods for the manipulation of captured light field image data |

| JP5924978B2 (ja) * | 2012-02-28 | 2016-05-25 | キヤノン株式会社 | 画像処理装置および画像処理方法 |

| US9723205B2 (en) * | 2012-06-20 | 2017-08-01 | Nokia Technologies Oy | Display camera operation |

| US9858649B2 (en) | 2015-09-30 | 2018-01-02 | Lytro, Inc. | Depth-based image blurring |

| EP2873028A4 (en) | 2012-06-28 | 2016-05-25 | Pelican Imaging Corp | SYSTEMS AND METHOD FOR DETECTING DEFECTIVE CAMERA ARRAYS, OPTICAL ARRAYS AND SENSORS |

| US20140002674A1 (en) | 2012-06-30 | 2014-01-02 | Pelican Imaging Corporation | Systems and Methods for Manufacturing Camera Modules Using Active Alignment of Lens Stack Arrays and Sensors |

| FI4296963T3 (fi) | 2012-08-21 | 2025-03-31 | Adeia Imaging Llc | Menetelmä syvyyden tunnistamiseksi kameraryhmällä otetuista kuvista |

| CN104685513B (zh) | 2012-08-23 | 2018-04-27 | 派力肯影像公司 | 根据使用阵列源捕捉的低分辨率图像的基于特征的高分辨率运动估计 |

| WO2014052974A2 (en) | 2012-09-28 | 2014-04-03 | Pelican Imaging Corporation | Generating images from light fields utilizing virtual viewpoints |

| JP6003578B2 (ja) * | 2012-11-26 | 2016-10-05 | 株式会社ニコン | 画像生成方法及び装置 |

| US9001226B1 (en) * | 2012-12-04 | 2015-04-07 | Lytro, Inc. | Capturing and relighting images using multiple devices |

| US8866912B2 (en) | 2013-03-10 | 2014-10-21 | Pelican Imaging Corporation | System and methods for calibration of an array camera using a single captured image |

| US9578259B2 (en) | 2013-03-14 | 2017-02-21 | Fotonation Cayman Limited | Systems and methods for reducing motion blur in images or video in ultra low light with array cameras |

| JP2016524125A (ja) | 2013-03-15 | 2016-08-12 | ペリカン イメージング コーポレイション | カメラアレイを用いた立体撮像のためのシステムおよび方法 |

| US10122993B2 (en) | 2013-03-15 | 2018-11-06 | Fotonation Limited | Autofocus system for a conventional camera that uses depth information from an array camera |

| US9497429B2 (en) | 2013-03-15 | 2016-11-15 | Pelican Imaging Corporation | Extended color processing on pelican array cameras |

| US10334151B2 (en) | 2013-04-22 | 2019-06-25 | Google Llc | Phase detection autofocus using subaperture images |

| WO2015048694A2 (en) | 2013-09-27 | 2015-04-02 | Pelican Imaging Corporation | Systems and methods for depth-assisted perspective distortion correction |

| WO2015074078A1 (en) | 2013-11-18 | 2015-05-21 | Pelican Imaging Corporation | Estimating depth from projected texture using camera arrays |

| US9426361B2 (en) | 2013-11-26 | 2016-08-23 | Pelican Imaging Corporation | Array camera configurations incorporating multiple constituent array cameras |

| US9319576B2 (en) | 2014-01-29 | 2016-04-19 | Google Technology Holdings LLC | Multi-processor support for array imagers |

| US10089740B2 (en) | 2014-03-07 | 2018-10-02 | Fotonation Limited | System and methods for depth regularization and semiautomatic interactive matting using RGB-D images |

| JP2017531976A (ja) | 2014-09-29 | 2017-10-26 | フォトネイション ケイマン リミテッド | アレイカメラを動的に較正するためのシステム及び方法 |

| US10567464B2 (en) | 2015-04-15 | 2020-02-18 | Google Llc | Video compression with adaptive view-dependent lighting removal |

| US10412373B2 (en) | 2015-04-15 | 2019-09-10 | Google Llc | Image capture for virtual reality displays |

| US10444931B2 (en) | 2017-05-09 | 2019-10-15 | Google Llc | Vantage generation and interactive playback |

| US10341632B2 (en) | 2015-04-15 | 2019-07-02 | Google Llc. | Spatial random access enabled video system with a three-dimensional viewing volume |

| US10440407B2 (en) | 2017-05-09 | 2019-10-08 | Google Llc | Adaptive control for immersive experience delivery |

| US10469873B2 (en) | 2015-04-15 | 2019-11-05 | Google Llc | Encoding and decoding virtual reality video |

| US10275898B1 (en) | 2015-04-15 | 2019-04-30 | Google Llc | Wedge-based light-field video capture |

| US10419737B2 (en) | 2015-04-15 | 2019-09-17 | Google Llc | Data structures and delivery methods for expediting virtual reality playback |

| US10565734B2 (en) | 2015-04-15 | 2020-02-18 | Google Llc | Video capture, processing, calibration, computational fiber artifact removal, and light-field pipeline |

| US10546424B2 (en) | 2015-04-15 | 2020-01-28 | Google Llc | Layered content delivery for virtual and augmented reality experiences |

| US11328446B2 (en) | 2015-04-15 | 2022-05-10 | Google Llc | Combining light-field data with active depth data for depth map generation |

| US10540818B2 (en) | 2015-04-15 | 2020-01-21 | Google Llc | Stereo image generation and interactive playback |

| US9979909B2 (en) | 2015-07-24 | 2018-05-22 | Lytro, Inc. | Automatic lens flare detection and correction for light-field images |

| CN106612387B (zh) * | 2015-10-15 | 2019-05-21 | 杭州海康威视数字技术股份有限公司 | 一种组合深度图获得方法及深度相机 |

| US11721061B2 (en) * | 2016-03-02 | 2023-08-08 | Nutilt Imaging, Llc | Method and apparatus for displaying a collectible |

| US10275892B2 (en) | 2016-06-09 | 2019-04-30 | Google Llc | Multi-view scene segmentation and propagation |

| US10679361B2 (en) | 2016-12-05 | 2020-06-09 | Google Llc | Multi-view rotoscope contour propagation |

| US10594945B2 (en) | 2017-04-03 | 2020-03-17 | Google Llc | Generating dolly zoom effect using light field image data |

| US10474227B2 (en) | 2017-05-09 | 2019-11-12 | Google Llc | Generation of virtual reality with 6 degrees of freedom from limited viewer data |

| US10354399B2 (en) | 2017-05-25 | 2019-07-16 | Google Llc | Multi-view back-projection to a light-field |

| US10545215B2 (en) | 2017-09-13 | 2020-01-28 | Google Llc | 4D camera tracking and optical stabilization |

| US10965862B2 (en) | 2018-01-18 | 2021-03-30 | Google Llc | Multi-camera navigation interface |

| JPWO2019142892A1 (ja) * | 2018-01-22 | 2021-01-28 | 株式会社小糸製作所 | 電子ミラー用の撮像装置、電子ミラーシステム、自動車 |

| CN114041110B (zh) * | 2019-07-22 | 2023-11-10 | 株式会社富士 | 图像显示装置及图像显示方法 |

| CN114600165B (zh) | 2019-09-17 | 2025-08-15 | 波士顿偏振测定公司 | 用于使用偏振提示表面建模的系统和方法 |

| DE112020004810B4 (de) | 2019-10-07 | 2023-10-26 | Boston Polarimetrics, Inc. | Systeme und Verfahren zur Erfassung von Oberflächennormalen mit Polarisation |

| MX2022005289A (es) | 2019-11-30 | 2022-08-08 | Boston Polarimetrics Inc | Sistemas y metodos para segmentacion de objetos transparentes usando se?ales de polarizacion. |

| WO2021154386A1 (en) | 2020-01-29 | 2021-08-05 | Boston Polarimetrics, Inc. | Systems and methods for characterizing object pose detection and measurement systems |

| JP7542070B2 (ja) | 2020-01-30 | 2024-08-29 | イントリンジック イノベーション エルエルシー | 偏光画像を含む異なる撮像モダリティで統計モデルを訓練するためのデータを合成するためのシステムおよび方法 |

| US11953700B2 (en) | 2020-05-27 | 2024-04-09 | Intrinsic Innovation Llc | Multi-aperture polarization optical systems using beam splitters |

| US12069227B2 (en) | 2021-03-10 | 2024-08-20 | Intrinsic Innovation Llc | Multi-modal and multi-spectral stereo camera arrays |

| US12020455B2 (en) | 2021-03-10 | 2024-06-25 | Intrinsic Innovation Llc | Systems and methods for high dynamic range image reconstruction |

| US11954886B2 (en) | 2021-04-15 | 2024-04-09 | Intrinsic Innovation Llc | Systems and methods for six-degree of freedom pose estimation of deformable objects |

| US11290658B1 (en) | 2021-04-15 | 2022-03-29 | Boston Polarimetrics, Inc. | Systems and methods for camera exposure control |

| US12067746B2 (en) | 2021-05-07 | 2024-08-20 | Intrinsic Innovation Llc | Systems and methods for using computer vision to pick up small objects |

| US12175741B2 (en) | 2021-06-22 | 2024-12-24 | Intrinsic Innovation Llc | Systems and methods for a vision guided end effector |

| US12340538B2 (en) | 2021-06-25 | 2025-06-24 | Intrinsic Innovation Llc | Systems and methods for generating and using visual datasets for training computer vision models |

| US12172310B2 (en) | 2021-06-29 | 2024-12-24 | Intrinsic Innovation Llc | Systems and methods for picking objects using 3-D geometry and segmentation |

| US11689813B2 (en) | 2021-07-01 | 2023-06-27 | Intrinsic Innovation Llc | Systems and methods for high dynamic range imaging using crossed polarizers |

| US12293535B2 (en) | 2021-08-03 | 2025-05-06 | Intrinsic Innovation Llc | Systems and methods for training pose estimators in computer vision |

| KR102712618B1 (ko) * | 2022-04-12 | 2024-10-02 | 한국광기술원 | 다분광 카메라의 영상보정 방법 및 이에 적용되는 다분광 카메라의 영상보정 장치 |

| JP2024159105A (ja) * | 2023-04-28 | 2024-11-08 | キヤノン株式会社 | 画像処理システム、画像処理装置 |

Family Cites Families (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH1188912A (ja) | 1997-09-10 | 1999-03-30 | Canon Inc | 複眼カメラ及び複眼カメラにおける表示制御方法 |

| JP2005229280A (ja) * | 2004-02-12 | 2005-08-25 | Fuji Photo Film Co Ltd | 画像処理装置および方法並びにプログラム |

| CN101674413B (zh) | 2005-09-09 | 2011-12-21 | 佳能株式会社 | 摄像设备 |

| US7825958B2 (en) * | 2007-01-25 | 2010-11-02 | Research In Motion Limited | Method and apparatus for controlling a camera module to compensate for the light level of a white LED |

| CN101577783A (zh) | 2008-05-09 | 2009-11-11 | 宏达国际电子股份有限公司 | 图像画面的处理方法及其电子装置 |

| JP5259457B2 (ja) * | 2009-03-03 | 2013-08-07 | オリンパスメディカルシステムズ株式会社 | 電子画像観察装置 |

| JP5383356B2 (ja) * | 2009-07-08 | 2014-01-08 | キヤノン株式会社 | 撮像装置、情報処理装置、撮像装置の制御方法、情報処理装置の制御方法、及びコンピュータプログラム |

| JP5924978B2 (ja) * | 2012-02-28 | 2016-05-25 | キヤノン株式会社 | 画像処理装置および画像処理方法 |

-

2012

- 2012-02-28 JP JP2012041144A patent/JP5924978B2/ja active Active

-

2013

- 2013-02-15 US US13/768,317 patent/US9307150B2/en active Active

- 2013-02-28 CN CN201310064423.5A patent/CN103297685B/zh active Active

Also Published As

| Publication number | Publication date |

|---|---|

| CN103297685B (zh) | 2016-08-03 |

| US20130222656A1 (en) | 2013-08-29 |

| JP2013179397A (ja) | 2013-09-09 |

| CN103297685A (zh) | 2013-09-11 |

| US9307150B2 (en) | 2016-04-05 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5924978B2 (ja) | 画像処理装置および画像処理方法 | |

| JP6721065B2 (ja) | 撮像装置、画像処理装置および方法 | |

| CN105659287B (zh) | 图像处理装置、图像处理方法和成像系统 | |

| JP6263623B2 (ja) | 画像生成方法及びデュアルレンズ装置 | |

| JP6029380B2 (ja) | 画像処理装置、画像処理装置を具備する撮像装置、画像処理方法、及びプログラム | |

| CN107197137B (zh) | 图像处理装置、图像处理方法以及记录介质 | |

| JP5766077B2 (ja) | ノイズ低減のための画像処理装置及び画像処理方法 | |

| CN114073069B (zh) | 成像系统、图像处理设备、成像装置和记录介质 | |

| JP2013027021A (ja) | 全方位撮像装置及び全方位撮像方法 | |

| US11825213B2 (en) | Removal of image capture device from omnidirectional image created by stitching partial images | |

| JP2010199971A (ja) | 撮像装置、撮像方法、及びプログラム | |

| JP4403172B2 (ja) | ファイル生成方法および装置並びに立体画像の表示制御方法および装置 | |

| KR20150003576A (ko) | 삼차원 영상 생성 또는 재생을 위한 장치 및 방법 | |

| US20210133937A1 (en) | Method and system for creating, storing, sharing, and displaying multiple perspectives of an image | |

| JP6012396B2 (ja) | 画像処理装置、画像処理方法およびプログラム。 | |

| JP4403173B2 (ja) | 立体表示用ファイルの生成方法および装置並びに表示制御方法および装置 | |

| JP5744642B2 (ja) | 画像処理装置および画像処理方法、プログラム。 | |

| JP2005130312A (ja) | 立体視画像処理装置,コンピュータプログラム,および視差補正方法 | |

| JP6833772B2 (ja) | 画像処理装置、撮像装置、画像処理方法およびプログラム | |

| JP2025011441A (ja) | 電子機器、電子機器の制御方法、プログラム、および記憶媒体 | |

| JP2014003715A (ja) | 撮像装置、撮像方法、及びプログラム | |

| JP2013078038A (ja) | 撮像装置、画像処理方法、およびプログラム | |

| JP2012120016A (ja) | 端末装置及びその処理方法とプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20150227 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20150227 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20150521 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20151124 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20151208 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20160208 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20160322 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20160419 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 5924978 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |