JP5091908B2 - 物体数計測方法、物体数計測装置、物体数計測プログラム及びこのプログラムを記録した記録媒体 - Google Patents

物体数計測方法、物体数計測装置、物体数計測プログラム及びこのプログラムを記録した記録媒体 Download PDFInfo

- Publication number

- JP5091908B2 JP5091908B2 JP2009111376A JP2009111376A JP5091908B2 JP 5091908 B2 JP5091908 B2 JP 5091908B2 JP 2009111376 A JP2009111376 A JP 2009111376A JP 2009111376 A JP2009111376 A JP 2009111376A JP 5091908 B2 JP5091908 B2 JP 5091908B2

- Authority

- JP

- Japan

- Prior art keywords

- image

- load value

- pixel

- coordinates

- camera

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Landscapes

- Studio Devices (AREA)

- Image Analysis (AREA)

Description

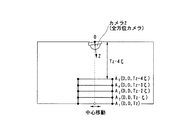

本実施形態に係る物体数計測装置1は図1に示されたように画像蓄積部3と対象物抽出処理部4と有効領域判定部5とカメラ情報入力部6と荷重値テーブル生成部7と人数計測部8と計測値出力部9とを備える。

実施形態1に係る物体数計測装置1,10は、カメラ2の光軸が床面または地面に対して垂直の姿勢であることを前提に荷重値w(x,y)を計算しているが、実施形態2に係る物体数計測装置は、実施形態1と同じ構成要素を有しているが、荷重値テーブル作成部7が荷重値テーブルの生成においてカメラ2の姿勢情報を考慮した荷重値算出を行う点で、実施形態1とは異なる。

図9の事例のように光軸が傾くようにカメラ2が取り付けられているとき、実施形態2では光軸の傾き角ψ,ωを既知であるとした。本実施形態では、カメラ2が天井面において任意に傾いて取り付けられていても、カメラ2によって得られた既知の参照物体の撮影画像に基づきカメラ2の回転角を算出している。そして、この算出された値に基づき有効な画像領域を構成する各画素を補正し、この補正した各画素を前記荷重値の算出に供している。

2…カメラ(撮像装置)

3…画像蓄積部

4…対象物抽出処理部(対象物抽出処理手段)

5…有効領域判定部(有効領域判定手段)

6…カメラ情報入力部

7…荷重値テーブル生成部(荷重値テーブル生成手段)

8…人数計測部(計測手段)

11…背景情報構築部

21…カメラ情報獲得部(撮像装置情報獲得手段)

Claims (8)

- 全方位画像に基づき当該画像に含まれる物体の数を計測する物体数計測方法であって、

物体抽出処理手段が全方位画像から物体を含んだ画像領域を抽出するステップと、

有効領域判定手段が前記抽出された画像領域に含まれる物体の数の計測に有効な画像領域を撮像装置の視野特性に基づき判定するステップと、

荷重値テーブル生成手段が、前記判定された有効な画像領域を構成する各画素に投影される視体積のうち前記物体の体積に寄与する体積を算出し、この体積に基づき前記各画素が物体の数にどれだけ寄与するかを示す荷重値を算出し、この算出した各画素の荷重値を格納させた荷重値テーブルを生成するステップと、

計測手段が前記抽出された画像領域における各画素が前記判定によって有効領域と判定された場合のみ、前記荷重値テーブルに格納された当該各画素の荷重値を積算することにより前記物体の数を計測するステップと、

を有すること

を特徴とする物体数計測方法。 - 前記荷重値テーブルを生成するステップは、前記撮像装置の姿勢情報に基づき前記有効な画像領域を構成する各画素を補正し、この補正した各画素を前記荷重値の算出に供するステップをさらに有すること

を特徴とする請求項1に記載の物体数計測方法。 - 撮像装置情報獲得手段が、既知の参照物体の中心座標と前記参照物体を撮影する撮像装置の姿勢情報に基づく画像座標との差分が許容誤差以下になるまで前記中心座標を調整しこの調整した中心座標に基づく前記撮像装置の姿勢情報の算出を反復的に行うことにより更新した姿勢情報を前記有効な画像領域を構成する各画素の補正に供するステップをさらに有すること

を特徴とする請求項2に記載の物体数計測方法。 - 全方位画像に基づき当該画像に含まれる物体の数を計測する物体数計測装置であって、

全方位画像から物体を含んだ画像領域を抽出する物体抽出処理手段と、

前記抽出された画像領域に含まれる物体の数の計測に有効な画像領域を撮像装置の視野特性に基づき判定する有効領域判定手段と、

前記判定された有効な画像領域を構成する各画素に投影される視体積のうち前記物体の体積に寄与する体積を算出し、この体積に基づき前記各画素が物体の数にどれだけ寄与するかを示す荷重値を算出し、この算出した各画素の荷重値を格納させた荷重値テーブルを生成する荷重値テーブル生成手段と、

前記抽出された画像領域における各画素が前記判定によって有効領域と判定された場合のみ、前記荷重値テーブルに格納された当該各画素の荷重値を積算することにより前記物体の数を計測する計測手段と

を備えること

を特徴とする物体数計測装置。 - 前記荷重値テーブル生成手段は、前記撮像装置の姿勢情報に基づき前記有効な画像領域を構成する各画素を補正し、この補正した各画素を前記荷重値の算出に供すること

を特徴とする請求項4に記載の物体数計測装置。 - 既知の参照物体の中心座標と前記参照物体を撮影する撮像装置の姿勢情報に基づく画像座標との差分が許容誤差以下になるまで前記中心座標を調整しこの調整した中心座標に基づく前記撮像装置の姿勢情報の算出を反復的に行うことにより更新した姿勢情報を前記荷重値テーブル生成手段に供する撮像装置情報獲得手段を

さらに備えたこと

を特徴とする請求項5に記載の物体数計測装置。 - 請求項4から6のいずれか1項に記載の物体数計測装置を構成する各手段としてコンピュータを機能させることを特徴とする物体数計測プログラム。

- 請求項7に記載の物体数計測プログラムを記録したコンピュータ読み取り可能な記録媒体。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2009111376A JP5091908B2 (ja) | 2009-04-30 | 2009-04-30 | 物体数計測方法、物体数計測装置、物体数計測プログラム及びこのプログラムを記録した記録媒体 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2009111376A JP5091908B2 (ja) | 2009-04-30 | 2009-04-30 | 物体数計測方法、物体数計測装置、物体数計測プログラム及びこのプログラムを記録した記録媒体 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2010262397A JP2010262397A (ja) | 2010-11-18 |

| JP5091908B2 true JP5091908B2 (ja) | 2012-12-05 |

Family

ID=43360420

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2009111376A Expired - Fee Related JP5091908B2 (ja) | 2009-04-30 | 2009-04-30 | 物体数計測方法、物体数計測装置、物体数計測プログラム及びこのプログラムを記録した記録媒体 |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP5091908B2 (ja) |

Families Citing this family (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN103473554B (zh) * | 2013-08-19 | 2016-12-28 | 上海汇纳信息科技股份有限公司 | 人流统计系统及方法 |

| WO2017135310A1 (ja) * | 2016-02-04 | 2017-08-10 | シャープ株式会社 | 通過数カウント装置、通過数カウント方法、プログラムおよび記憶媒体 |

| JP7696880B2 (ja) * | 2022-11-29 | 2025-06-23 | キヤノン株式会社 | 画像処理装置、制御装置、画像処理方法、及びプログラム |

| CN118642417B (zh) * | 2024-08-14 | 2024-11-08 | 山东鲁检科技有限公司 | 一种基于物品识别的消毒设备控制方法及系统 |

Family Cites Families (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPS6288080A (ja) * | 1985-10-15 | 1987-04-22 | A S T Soken:Kk | 運動する物体の概数測定装置 |

| JP4825350B2 (ja) * | 2000-12-07 | 2011-11-30 | 住友大阪セメント株式会社 | 通過物体計数装置及び計数方法 |

| JP5046285B2 (ja) * | 2007-08-29 | 2012-10-10 | 一般財団法人電力中央研究所 | バブルカウントシステム |

| JP4914870B2 (ja) * | 2008-06-03 | 2012-04-11 | 日本電信電話株式会社 | 混雑度計測装置、混雑度計測方法、混雑度計測プログラムおよびそのプログラムを記録した記録媒体 |

-

2009

- 2009-04-30 JP JP2009111376A patent/JP5091908B2/ja not_active Expired - Fee Related

Also Published As

| Publication number | Publication date |

|---|---|

| JP2010262397A (ja) | 2010-11-18 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US11200734B2 (en) | Method for reconstructing three-dimensional space scene based on photographing | |

| JP5580164B2 (ja) | 光学情報処理装置、光学情報処理方法、光学情報処理システム、光学情報処理プログラム | |

| CN107836012B (zh) | 投影图像生成方法及其装置、图像像素与深度值之间的映射方法 | |

| TWI555379B (zh) | 一種全景魚眼相機影像校正、合成與景深重建方法與其系統 | |

| US9965870B2 (en) | Camera calibration method using a calibration target | |

| CN103198524B (zh) | 一种大规模室外场景三维重建方法 | |

| JP5593177B2 (ja) | 点群位置データ処理装置、点群位置データ処理方法、点群位置データ処理システム、および点群位置データ処理プログラム | |

| CN104463880B (zh) | 一种rgb‑d图像获取方法 | |

| CN110807809A (zh) | 基于点线特征和深度滤波器的轻量级单目视觉定位方法 | |

| CN103813150B (zh) | 图像处理设备和方法、图像处理系统 | |

| WO2018068678A1 (zh) | 一种立体摄像机外部参数的确定方法及装置 | |

| KR20130138247A (ko) | 신속 3d 모델링 | |

| KR101759798B1 (ko) | 실내 2d 평면도의 생성 방법, 장치 및 시스템 | |

| TW200937348A (en) | Calibration method for image capturing device | |

| US20170289516A1 (en) | Depth map based perspective correction in digital photos | |

| KR20130121290A (ko) | 회전식 라인 카메라로 획득한 실내 전방위 영상의 지오레퍼런싱 방법 | |

| JP5091908B2 (ja) | 物体数計測方法、物体数計測装置、物体数計測プログラム及びこのプログラムを記録した記録媒体 | |

| CN106264537A (zh) | 图像中人体姿态高度的测量系统及方法 | |

| JP2008249431A (ja) | 3次元画像補正方法及びその装置 | |

| CN104732557A (zh) | 一种地面激光扫描仪彩色点云生成方法 | |

| JP2018044942A (ja) | カメラパラメータ算出装置、カメラパラメータ算出方法、プログラム、及び記録媒体 | |

| CN111742352A (zh) | 3d对象建模方法以及相关设备和计算机程序产品 | |

| JP5714960B2 (ja) | 監視範囲検知装置 | |

| JP4914870B2 (ja) | 混雑度計測装置、混雑度計測方法、混雑度計測プログラムおよびそのプログラムを記録した記録媒体 | |

| JP5727969B2 (ja) | 位置推定装置、方法、及びプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20110926 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20120911 |

|

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20120914 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20150921 Year of fee payment: 3 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 5091908 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| S531 | Written request for registration of change of domicile |

Free format text: JAPANESE INTERMEDIATE CODE: R313531 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| LAPS | Cancellation because of no payment of annual fees |