JP2017011746A - 画像復号化方法および画像復号化装置 - Google Patents

画像復号化方法および画像復号化装置 Download PDFInfo

- Publication number

- JP2017011746A JP2017011746A JP2016172315A JP2016172315A JP2017011746A JP 2017011746 A JP2017011746 A JP 2017011746A JP 2016172315 A JP2016172315 A JP 2016172315A JP 2016172315 A JP2016172315 A JP 2016172315A JP 2017011746 A JP2017011746 A JP 2017011746A

- Authority

- JP

- Japan

- Prior art keywords

- motion vector

- reference picture

- adjacent

- prediction

- decoding

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/107—Selection of coding mode or of prediction mode between spatial and temporal predictive coding, e.g. picture refresh

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/90—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using coding techniques not provided for in groups H04N19/10-H04N19/85, e.g. fractals

- H04N19/94—Vector quantisation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/105—Selection of the reference unit for prediction within a chosen coding or prediction mode, e.g. adaptive choice of position and number of pixels used for prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/124—Quantisation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/137—Motion inside a coding unit, e.g. average field, frame or block difference

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/137—Motion inside a coding unit, e.g. average field, frame or block difference

- H04N19/139—Analysis of motion vectors, e.g. their magnitude, direction, variance or reliability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/172—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a picture, frame or field

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/46—Embedding additional information in the video signal during the compression process

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/513—Processing of motion vectors

- H04N19/517—Processing of motion vectors by encoding

- H04N19/52—Processing of motion vectors by encoding by predictive encoding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/56—Motion estimation with initialisation of the vector search, e.g. estimating a good candidate to initiate a search

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/567—Motion estimation based on rate distortion criteria

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/573—Motion compensation with multiple frame prediction using two or more reference frames in a given prediction direction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/577—Motion compensation with bidirectional frame interpolation, i.e. using B-pictures

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/58—Motion compensation with long-term prediction, i.e. the reference frame for a current frame not being the temporally closest one

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/60—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding

- H04N19/61—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding in combination with predictive coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

Abstract

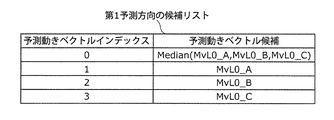

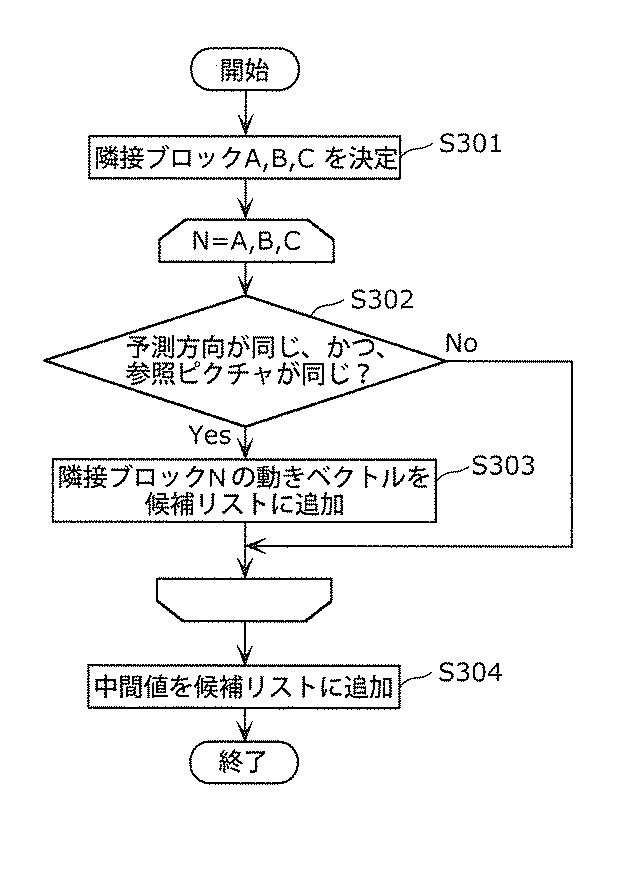

【解決手段】画像復号化方法は、復号化対象ブロックの第1参照ピクチャリスト内の第1参照ピクチャと、隣接ブロックの第1参照ピクチャリスト内の第1隣接参照ピクチャとが同一であるか否かを判断し、第1参照ピクチャと、第1隣接参照ピクチャとが同一である場合に、第1隣接動きベクトルを候補リストに追加し、第1参照ピクチャと、第1隣接参照ピクチャとが同一でない場合にのみ、第1参照ピクチャと、隣接ブロックの第2参照ピクチャリスト内の第2隣接参照ピクチャとが同一であるか否かを判断し、第1参照ピクチャと、第2隣接参照ピクチャとが同一である場合に、第2隣接動きベクトルを候補リストに追加し、候補リストから、予測動きベクトルを選択し、選択された予測動きベクトルを用いて、動きベクトルを復号化する。

【選択図】図12B

Description

図1は、本実施の形態に係る画像符号化装置の構成を示すブロック図である。

図9は、本実施の形態に係る画像復号装置の構成を示すブロック図である。

本実施の形態は、実施の形態1の画像符号化装置100の特徴的な構成要素を備える画像符号化装置を補足的に示す。

本実施の形態は、実施の形態2の画像復号装置200の特徴的な構成要素を備える画像復号装置を補足的に示す。

本実施の形態は、実施の形態1の画像符号化装置100、および、実施の形態2の画像復号装置200の特徴的な構成要素を備える画像符号化復号装置を補足的に示す。

上記各実施の形態で示した動画像符号化方法(画像符号化方法)または動画像復号化方法(画像復号方法)の構成を実現するためのプログラムを記憶メディアに記録することにより、上記各実施の形態で示した処理を独立したコンピュータシステムにおいて簡単に実施することが可能となる。記憶メディアは、磁気ディスク、光ディスク、光磁気ディスク、ICカード、半導体メモリ等、プログラムを記録できるものであればよい。

上記各実施の形態で示した動画像符号化方法または装置と、MPEG−2、MPEG4−AVC、VC−1など異なる規格に準拠した動画像符号化方法または装置とを、必要に応じて適宜切替えることにより、映像データを生成することも可能である。

上記各実施の形態で示した動画像符号化方法および装置、動画像復号化方法および装置は、典型的には集積回路であるLSIで実現される。一例として、図28に1チップ化されたLSIex500の構成を示す。LSIex500は、以下に説明する要素ex501、ex502、ex503、ex504、ex505、ex506、ex507、ex508、ex509を備え、各要素はバスex510を介して接続している。電源回路部ex505は電源がオン状態の場合に各部に対して電力を供給することで動作可能な状態に起動する。

上記各実施の形態で示した動画像符号化方法または装置によって生成された映像データを復号する場合、従来のMPEG−2、MPEG4−AVC、VC−1などの規格に準拠する映像データを復号する場合に比べ、処理量が増加することが考えられる。そのため、LSIex500において、従来の規格に準拠する映像データを復号する際のCPUex502の駆動周波数よりも高い駆動周波数に設定する必要がある。しかし、駆動周波数を高くすると、消費電力が高くなるという課題が生じる。

テレビや、携帯電話など、上述した機器・システムには、異なる規格に準拠する複数の映像データが入力される場合がある。このように、異なる規格に準拠する複数の映像データが入力された場合にも復号できるようにするために、LSIex500の信号処理部ex507が複数の規格に対応している必要がある。しかし、それぞれの規格に対応する信号処理部ex507を個別に用いると、LSIex500の回路規模が大きくなり、また、コストが増加するという課題が生じる。

101 減算部

102 直交変換部

103 量子化部

104 可変長符号化部

105、205 逆量子化部

106、206 逆直交変換部

107、207 加算部

108、208 ブロックメモリ

109、209 フレームメモリ

110、210 イントラ予測部

111、211 インター予測部

112、212 スイッチ部

113 ピクチャタイプ決定部

114、214 インター予測制御部

115、215 参照ピクチャリスト管理部

116、216 追加判定部

200、400 画像復号装置

204 可変長復号部

301、401、501 追加部

302、402、502 選択部

303、503 符号化部

403、504 復号部

500 画像符号化復号装置

Claims (2)

- 復号化対象ピクチャをブロック毎に復号化する画像復号化方法であって、

復号化対象ブロックが参照する、復号化対象ブロックの第1参照ピクチャリスト内の第1参照ピクチャと、前記復号化対象ブロックに隣接する隣接ブロックが参照する、前記隣接ブロックの第1参照ピクチャリスト内の第1隣接参照ピクチャとが同一であるか否かを判断し、

前記第1参照ピクチャと、前記第1隣接参照ピクチャとが同一である場合に、前記第1隣接参照ピクチャ内の位置を指し示す第1隣接動きベクトルを、前記第1参照ピクチャ内の位置を指し示す動きベクトルの復号化に用いられる予測動きベクトルの候補リストに追加し、

前記第1参照ピクチャと、前記第1隣接参照ピクチャとが同一でない場合にのみ、前記第1参照ピクチャと、前記隣接ブロックが参照する、前記隣接ブロックの第2参照ピクチャリスト内の第2隣接参照ピクチャとが同一であるか否かを判断し、前記第1参照ピクチャと、前記第2隣接参照ピクチャとが同一である場合に、前記第2隣接参照ピクチャ内の位置を指し示す第2隣接動きベクトルを、前記候補リストに追加し、

前記候補リストから、前記動きベクトルの復号化に用いられる前記予測動きベクトルを選択し、

選択された前記予測動きベクトルを用いて、前記動きベクトルを復号化する、

画像復号化方法。 - 復号化対象ピクチャをブロック毎に復号化する画像復号化装置であって、

復号化対象ブロックが参照する、復号化対象ブロックの第1参照ピクチャリスト内の第1参照ピクチャと、前記復号化対象ブロックに隣接する隣接ブロックが参照する、前記隣接ブロックの第1参照ピクチャリスト内の第1隣接参照ピクチャとが同一であるか否かを判断し、

前記第1参照ピクチャと、前記第1隣接参照ピクチャとが同一である場合に、前記第1隣接参照ピクチャ内の位置を指し示す第1隣接動きベクトルを、前記第1参照ピクチャ内の位置を指し示す動きベクトルの復号化に用いられる予測動きベクトルの候補リストに追加し、

前記第1参照ピクチャと、前記第1隣接参照ピクチャとが同一でない場合にのみ、前記第1参照ピクチャと、前記隣接ブロックが参照する、前記隣接ブロックの第2参照ピクチャリスト内の第2隣接参照ピクチャとが同一であるか否かを判断し、前記第1参照ピクチャと、前記第2隣接参照ピクチャとが同一である場合に、前記第2隣接参照ピクチャ内の位置を指し示す第2隣接動きベクトルを、前記候補リストに追加することにより前記候補リストを生成する候補リスト生成部と、

前記候補リストから、前記動きベクトルの復号化に用いられる前記予測動きベクトルを選択する選択部と、

選択された前記予測動きベクトルを用いて、前記動きベクトルを復号化する復号化部とを備える、

画像復号化装置。

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US201061427587P | 2010-12-28 | 2010-12-28 | |

| US61/427,587 | 2010-12-28 |

Related Parent Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2012550732A Division JP6008291B2 (ja) | 2010-12-28 | 2011-12-27 | 画像符号化方法および画像符号化装置 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2017011746A true JP2017011746A (ja) | 2017-01-12 |

| JP6167409B2 JP6167409B2 (ja) | 2017-07-26 |

Family

ID=46316778

Family Applications (2)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2012550732A Active JP6008291B2 (ja) | 2010-12-28 | 2011-12-27 | 画像符号化方法および画像符号化装置 |

| JP2016172315A Active JP6167409B2 (ja) | 2010-12-28 | 2016-09-02 | 画像復号化方法および画像復号化装置 |

Family Applications Before (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2012550732A Active JP6008291B2 (ja) | 2010-12-28 | 2011-12-27 | 画像符号化方法および画像符号化装置 |

Country Status (13)

| Country | Link |

|---|---|

| US (10) | US9049455B2 (ja) |

| EP (2) | EP2661087B1 (ja) |

| JP (2) | JP6008291B2 (ja) |

| KR (1) | KR101790378B1 (ja) |

| CN (2) | CN103004205B (ja) |

| AU (2) | AU2011353405B2 (ja) |

| BR (1) | BR112013002448B1 (ja) |

| CA (1) | CA2805663C (ja) |

| ES (2) | ES2704960T3 (ja) |

| MX (1) | MX2013000995A (ja) |

| PL (2) | PL2661087T3 (ja) |

| SG (1) | SG187185A1 (ja) |

| WO (1) | WO2012090491A1 (ja) |

Families Citing this family (49)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20130128983A1 (en) * | 2010-12-27 | 2013-05-23 | Toshiyasu Sugio | Image coding method and image decoding method |

| US9049455B2 (en) | 2010-12-28 | 2015-06-02 | Panasonic Intellectual Property Corporation Of America | Image coding method of coding a current picture with prediction using one or both of a first reference picture list including a first current reference picture for a current block and a second reference picture list including a second current reference picture for the current block |

| US9635382B2 (en) * | 2011-01-07 | 2017-04-25 | Texas Instruments Incorporated | Method, system and computer program product for determining a motion vector |

| US20130322535A1 (en) * | 2011-02-21 | 2013-12-05 | Electronics And Telecommunications Research Institute | Method for encoding and decoding images using plurality of reference images and device using method |

| WO2012140821A1 (ja) | 2011-04-12 | 2012-10-18 | パナソニック株式会社 | 動画像符号化方法、動画像符号化装置、動画像復号化方法、動画像復号化装置、および動画像符号化復号化装置 |

| TWI526056B (zh) | 2011-04-27 | 2016-03-11 | Jvc Kenwood Corp | A moving picture coding apparatus, a motion picture coding method, a motion picture coding program, a transmission apparatus, a transmission method, a transmission program, a video decoding apparatus, a video decoding method, a video decoding program, a reception device, a reception method, Receiving program |

| WO2012147344A1 (ja) | 2011-04-27 | 2012-11-01 | 株式会社Jvcケンウッド | 動画像復号装置、動画像復号方法、及び動画像復号プログラム |

| US9485518B2 (en) | 2011-05-27 | 2016-11-01 | Sun Patent Trust | Decoding method and apparatus with candidate motion vectors |

| EP3614665B1 (en) | 2011-05-27 | 2022-03-23 | Sun Patent Trust | Apparatus, method and program for decoding moving pictures |

| TW201304552A (zh) | 2011-05-31 | 2013-01-16 | Panasonic Corp | 動態圖像編碼方法、動態圖像編碼裝置、動態圖像解碼方法、動態圖像解碼裝置、及動態圖像編碼解碼裝置 |

| GB2491589B (en) * | 2011-06-06 | 2015-12-16 | Canon Kk | Method and device for encoding a sequence of images and method and device for decoding a sequence of image |

| PL3481066T3 (pl) | 2011-06-28 | 2021-11-22 | Lg Electronics Inc. | Sposób wyprowadzania predyktora wektora ruchu |

| CN106851269B (zh) | 2011-06-30 | 2019-11-15 | 太阳专利托管公司 | 图像解码方法及装置、图像编码方法及装置、编解码装置 |

| IN2014CN00729A (ja) | 2011-08-03 | 2015-04-03 | Panasonic Corp | |

| CN108881903B (zh) | 2011-10-19 | 2022-01-04 | 太阳专利托管公司 | 图像编码方法及装置、图像解码方法及装置、编解码装置 |

| JP2013098933A (ja) * | 2011-11-04 | 2013-05-20 | Sony Corp | 画像処理装置および方法 |

| US10003810B2 (en) * | 2012-03-22 | 2018-06-19 | Mediatek Inc. | Method and apparatus of scalable video coding |

| RU2624578C2 (ru) * | 2012-07-02 | 2017-07-04 | Самсунг Электроникс Ко., Лтд. | Способ и устройство для прогнозирования вектора движения для кодирования видео или декодирования видео |

| US9325990B2 (en) * | 2012-07-09 | 2016-04-26 | Qualcomm Incorporated | Temporal motion vector prediction in video coding extensions |

| US9699450B2 (en) | 2012-10-04 | 2017-07-04 | Qualcomm Incorporated | Inter-view predicted motion vector for 3D video |

| CN102883163B (zh) | 2012-10-08 | 2014-05-28 | 华为技术有限公司 | 用于运动矢量预测的运动矢量列表建立的方法、装置 |

| CN102946536B (zh) * | 2012-10-09 | 2015-09-30 | 华为技术有限公司 | 候选矢量列表构建的方法及装置 |

| US9826239B2 (en) * | 2013-01-07 | 2017-11-21 | Lg Electronics Inc. | Video signal processing method and device |

| US9628795B2 (en) * | 2013-07-17 | 2017-04-18 | Qualcomm Incorporated | Block identification using disparity vector in video coding |

| CN104079944B (zh) | 2014-06-30 | 2017-12-01 | 华为技术有限公司 | 视频编码的运动矢量列表构建方法和系统 |

| EP3410717A1 (en) * | 2017-05-31 | 2018-12-05 | Thomson Licensing | Methods and apparatus for candidate list pruning |

| US11394992B2 (en) * | 2018-03-14 | 2022-07-19 | Hfi Innovation Inc. | Methods and apparatuses of generating average candidates in video coding systems |

| CN110365987B (zh) * | 2018-04-09 | 2022-03-25 | 杭州海康威视数字技术股份有限公司 | 一种运动矢量确定方法、装置及其设备 |

| TWI744661B (zh) | 2018-06-29 | 2021-11-01 | 大陸商北京字節跳動網絡技術有限公司 | 要根據模式檢查的查找表中的運動候選的數量 |

| CN114845108A (zh) | 2018-06-29 | 2022-08-02 | 抖音视界(北京)有限公司 | 查找表的更新:fifo、约束的fifo |

| CN110662056B (zh) | 2018-06-29 | 2022-06-07 | 北京字节跳动网络技术有限公司 | 哪个查找表需要更新或不更新 |

| CN114885173A (zh) | 2018-06-29 | 2022-08-09 | 抖音视界(北京)有限公司 | Lut中的运动候选的检查顺序 |

| BR112020024142A2 (pt) | 2018-06-29 | 2021-03-02 | Beijing Bytedance Network Technology Co., Ltd. | método para processamento de vídeo, aparelho para codificação de dados de vídeo, meio de armazenamento e meio de gravação legíveis por computador não transitório |

| KR20210025537A (ko) | 2018-06-29 | 2021-03-09 | 베이징 바이트댄스 네트워크 테크놀로지 컴퍼니, 리미티드 | 하나 또는 다수의 룩업 테이블들을 사용하여 이전에 코딩된 모션 정보를 순서대로 저장하고 이를 사용하여 후속 블록들을 코딩하는 개념 |

| CN110662052B (zh) | 2018-06-29 | 2022-07-08 | 北京字节跳动网络技术有限公司 | 更新查找表(lut)的条件 |

| KR20240005239A (ko) | 2018-06-29 | 2024-01-11 | 베이징 바이트댄스 네트워크 테크놀로지 컴퍼니, 리미티드 | Lut와 amvp 사이의 상호작용 |

| CN113163211B (zh) * | 2018-06-30 | 2023-01-03 | Oppo广东移动通信有限公司 | 基于合并模式的帧间预测方法及装置 |

| KR102606146B1 (ko) | 2018-07-02 | 2023-11-23 | 후아웨이 테크놀러지 컴퍼니 리미티드 | 모션 벡터 예측 방법 및 관련 장치 |

| TWI731364B (zh) | 2018-07-02 | 2021-06-21 | 大陸商北京字節跳動網絡技術有限公司 | Hmvp+非相鄰運動 |

| CN116647696A (zh) | 2018-09-06 | 2023-08-25 | Lg电子株式会社 | 图像解码方法、图像编码方法、存储介质和发送方法 |

| KR102585975B1 (ko) * | 2018-09-12 | 2023-10-05 | 후아웨이 테크놀러지 컴퍼니 리미티드 | 참조 화상 리스트 구조를 위한 인덱스 시그널링 |

| GB2590310B (en) | 2018-09-12 | 2023-03-22 | Beijing Bytedance Network Tech Co Ltd | Conditions for starting checking HMVP candidates depend on total number minus K |

| WO2020133518A1 (zh) | 2018-12-29 | 2020-07-02 | 深圳市大疆创新科技有限公司 | 视频处理方法和设备 |

| KR20240010576A (ko) | 2019-01-10 | 2024-01-23 | 베이징 바이트댄스 네트워크 테크놀로지 컴퍼니, 리미티드 | Lut 업데이트의 호출 |

| WO2020143824A1 (en) | 2019-01-13 | 2020-07-16 | Beijing Bytedance Network Technology Co., Ltd. | Interaction between lut and shared merge list |

| WO2020147773A1 (en) | 2019-01-16 | 2020-07-23 | Beijing Bytedance Network Technology Co., Ltd. | Inserting order of motion candidates in lut |

| CN113615193A (zh) | 2019-03-22 | 2021-11-05 | 北京字节跳动网络技术有限公司 | Merge列表构建和其他工具之间的交互 |

| JP2022539657A (ja) * | 2019-06-24 | 2022-09-13 | アリババ グループ ホウルディング リミテッド | 映像処理における適応解像度変更 |

| US11934554B2 (en) | 2021-05-17 | 2024-03-19 | Bank Of America Corporation | Information security by preventing unauthorized data access |

Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2004056756A (ja) * | 2002-07-18 | 2004-02-19 | Lg Electronics Inc | 予測動きベクトル演算方法 |

| JP2004208258A (ja) * | 2002-04-19 | 2004-07-22 | Matsushita Electric Ind Co Ltd | 動きベクトル計算方法 |

| US20050117646A1 (en) * | 2003-11-28 | 2005-06-02 | Anthony Joch | Low-complexity motion vector prediction for video codec with two lists of reference pictures |

| WO2010035730A1 (ja) * | 2008-09-24 | 2010-04-01 | ソニー株式会社 | 画像処理装置および方法 |

| WO2011041321A1 (en) * | 2009-10-01 | 2011-04-07 | Ntt Docomo, Inc. | Motion vector prediction in video coding |

| WO2012006889A1 (en) * | 2010-07-12 | 2012-01-19 | Mediatek Inc. | Method and apparatus of temporal motion vector prediction |

Family Cites Families (22)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US6625211B1 (en) * | 1999-02-25 | 2003-09-23 | Matsushita Electric Industrial Co., Ltd. | Method and apparatus for transforming moving picture coding system |

| EP1830577A1 (en) | 2002-01-18 | 2007-09-05 | Kabushiki Kaisha Toshiba | Video decoding method and apparatus |

| US7321626B2 (en) * | 2002-03-08 | 2008-01-22 | Sharp Laboratories Of America, Inc. | System and method for predictive motion estimation using a global motion predictor |

| EP3525467B1 (en) | 2002-04-19 | 2021-02-24 | Panasonic Intellectual Property Corporation of America | Bitstream decoding method and apparatus |

| PT3525465T (pt) | 2002-04-19 | 2021-05-10 | Panasonic Ip Corp America | Método e aparelho de descodificação de imagens |

| JP2004023458A (ja) | 2002-06-17 | 2004-01-22 | Toshiba Corp | 動画像符号化/復号化方法及び装置 |

| EP1562385B1 (en) * | 2002-11-01 | 2014-07-02 | Panasonic Corporation | Motion picture encoding method and motion picture decoding method |

| KR100631768B1 (ko) | 2004-04-14 | 2006-10-09 | 삼성전자주식회사 | 비디오 코딩에서 프레임간 예측방법 및 비디오 인코더와,비디오 디코딩방법 및 비디오 디코더 |

| JP4702943B2 (ja) | 2005-10-19 | 2011-06-15 | キヤノン株式会社 | 画像処理装置及びその方法 |

| CN101317463B (zh) | 2006-03-16 | 2012-10-17 | 华为技术有限公司 | 在编解码中的实现量化的方法和装置 |

| JP4822940B2 (ja) | 2006-06-02 | 2011-11-24 | キヤノン株式会社 | 画像処理装置及び画像処理方法 |

| JP4884290B2 (ja) | 2007-05-07 | 2012-02-29 | パナソニック株式会社 | 動画像復号化集積回路、動画像復号化方法、動画像復号化装置及び動画像復号化プログラム |

| JP4650461B2 (ja) * | 2007-07-13 | 2011-03-16 | ソニー株式会社 | 符号化装置、符号化方法、プログラム、及び記録媒体 |

| US9042455B2 (en) * | 2008-08-19 | 2015-05-26 | Thomson Licensing | Propagation map |

| US20100166073A1 (en) | 2008-12-31 | 2010-07-01 | Advanced Micro Devices, Inc. | Multiple-Candidate Motion Estimation With Advanced Spatial Filtering of Differential Motion Vectors |

| JP5169978B2 (ja) * | 2009-04-24 | 2013-03-27 | ソニー株式会社 | 画像処理装置および方法 |

| KR102004836B1 (ko) | 2010-05-26 | 2019-07-29 | 엘지전자 주식회사 | 비디오 신호의 처리 방법 및 장치 |

| US9300970B2 (en) * | 2010-07-09 | 2016-03-29 | Samsung Electronics Co., Ltd. | Methods and apparatuses for encoding and decoding motion vector |

| US9357229B2 (en) * | 2010-07-28 | 2016-05-31 | Qualcomm Incorporated | Coding motion vectors in video coding |

| US8824558B2 (en) | 2010-11-23 | 2014-09-02 | Mediatek Inc. | Method and apparatus of spatial motion vector prediction |

| US20130128983A1 (en) * | 2010-12-27 | 2013-05-23 | Toshiyasu Sugio | Image coding method and image decoding method |

| US9049455B2 (en) | 2010-12-28 | 2015-06-02 | Panasonic Intellectual Property Corporation Of America | Image coding method of coding a current picture with prediction using one or both of a first reference picture list including a first current reference picture for a current block and a second reference picture list including a second current reference picture for the current block |

-

2011

- 2011-12-23 US US13/336,353 patent/US9049455B2/en active Active

- 2011-12-27 KR KR1020137001284A patent/KR101790378B1/ko active IP Right Grant

- 2011-12-27 MX MX2013000995A patent/MX2013000995A/es active IP Right Grant

- 2011-12-27 SG SG2013005574A patent/SG187185A1/en unknown

- 2011-12-27 PL PL11854143T patent/PL2661087T3/pl unknown

- 2011-12-27 JP JP2012550732A patent/JP6008291B2/ja active Active

- 2011-12-27 WO PCT/JP2011/007309 patent/WO2012090491A1/ja active Application Filing

- 2011-12-27 ES ES17157139T patent/ES2704960T3/es active Active

- 2011-12-27 ES ES11854143.2T patent/ES2637615T3/es active Active

- 2011-12-27 CN CN201180035081.3A patent/CN103004205B/zh active Active

- 2011-12-27 CN CN201710014608.3A patent/CN106878749B/zh active Active

- 2011-12-27 PL PL17157139T patent/PL3200463T3/pl unknown

- 2011-12-27 AU AU2011353405A patent/AU2011353405B2/en active Active

- 2011-12-27 EP EP11854143.2A patent/EP2661087B1/en active Active

- 2011-12-27 EP EP17157139.1A patent/EP3200463B1/en active Active

- 2011-12-27 CA CA2805663A patent/CA2805663C/en active Active

- 2011-12-27 BR BR112013002448-8A patent/BR112013002448B1/pt active IP Right Grant

-

2015

- 2015-04-24 US US14/695,246 patent/US9264726B2/en active Active

- 2015-12-21 US US14/976,238 patent/US9445105B2/en active Active

-

2016

- 2016-04-27 AU AU2016202666A patent/AU2016202666B2/en active Active

- 2016-08-12 US US15/235,337 patent/US9729877B2/en active Active

- 2016-09-02 JP JP2016172315A patent/JP6167409B2/ja active Active

-

2017

- 2017-06-01 US US15/611,002 patent/US9998736B2/en active Active

-

2018

- 2018-05-14 US US15/978,697 patent/US10638128B2/en active Active

- 2018-12-26 US US16/232,305 patent/US10574983B2/en active Active

-

2020

- 2020-01-15 US US16/743,042 patent/US10880545B2/en active Active

- 2020-11-23 US US17/101,022 patent/US11310493B2/en active Active

-

2022

- 2022-03-15 US US17/694,979 patent/US20220201291A1/en active Pending

Patent Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2004208258A (ja) * | 2002-04-19 | 2004-07-22 | Matsushita Electric Ind Co Ltd | 動きベクトル計算方法 |

| JP2004056756A (ja) * | 2002-07-18 | 2004-02-19 | Lg Electronics Inc | 予測動きベクトル演算方法 |

| US20050117646A1 (en) * | 2003-11-28 | 2005-06-02 | Anthony Joch | Low-complexity motion vector prediction for video codec with two lists of reference pictures |

| WO2010035730A1 (ja) * | 2008-09-24 | 2010-04-01 | ソニー株式会社 | 画像処理装置および方法 |

| WO2011041321A1 (en) * | 2009-10-01 | 2011-04-07 | Ntt Docomo, Inc. | Motion vector prediction in video coding |

| WO2012006889A1 (en) * | 2010-07-12 | 2012-01-19 | Mediatek Inc. | Method and apparatus of temporal motion vector prediction |

Non-Patent Citations (2)

| Title |

|---|

| JIAN-LIANG LIN ET AL.: "Improved Advanced Motion Vector Prediction", JOINT COLLABORATIVE TEAM ON VIDEO CODING (JCT-VC) OF ITU-T SG16 WP3 AND ISO/IEC JTC1/SC29/WG11, vol. JCTVC-D125_r2, JPN6017018574, January 2011 (2011-01-01), pages 1 - 8 * |

| TOSHIYASU SUGIO AND TAKAHIRO NISHI: "Modified derivation process of temporal motion vector predictor", JOINT COLLABORATIVE TEAM ON VIDEO CODING (JCT-VC) OF ITU-T SG16 WP3 AND ISO/IEC JTC1/SC29/WG11, vol. JCTVC-D273, JPN6017018575, January 2011 (2011-01-01), pages 1 - 4 * |

Also Published As

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6167409B2 (ja) | 画像復号化方法および画像復号化装置 | |

| JP6478133B2 (ja) | 動画像復号方法、動画像復号装置、動画像符号化方法、および動画像符号化装置 | |

| JP5414942B1 (ja) | カメラデバイスおよび送信方法 | |

| JP5347082B1 (ja) | 復号方法および復号装置 | |

| JP6004271B2 (ja) | 画像符号化方法、画像復号方法、画像符号化装置および画像復号装置 | |

| JP6422011B2 (ja) | 動画像符号化方法、動画像復号化方法、動画像符号化装置および動画像復号化装置 | |

| WO2013057877A1 (ja) | 画像符号化方法、画像符号化装置、画像復号方法、および、画像復号装置 | |

| JP2016174392A (ja) | 画像符号化方法及び画像符号化装置 | |

| JP5893570B2 (ja) | 画像符号化方法および画像復号化方法 | |

| WO2012117728A1 (ja) | 動画像符号化方法、動画像復号方法、動画像符号化装置、動画像復号装置、及び動画像符号化復号装置 | |

| JP6108309B2 (ja) | 動画像符号化方法、動画像符号化装置、動画像復号方法、および、動画像復号装置 | |

| JP5883431B2 (ja) | 画像符号化方法および画像復号化方法 | |

| JP6551894B2 (ja) | 動画像復号化方法および動画像復号化装置 | |

| WO2012090495A1 (ja) | 画像符号化方法および画像復号方法 | |

| JPWO2012081246A1 (ja) | 画像符号化方法および画像復号化方法 | |

| WO2012073481A1 (ja) | 動画像符号化方法および動画像復号化方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20170516 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20170530 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20170606 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6167409 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |