JP2013150086A - 行動情報認識システム、情報処理装置および行動情報認識方法 - Google Patents

行動情報認識システム、情報処理装置および行動情報認識方法 Download PDFInfo

- Publication number

- JP2013150086A JP2013150086A JP2012007641A JP2012007641A JP2013150086A JP 2013150086 A JP2013150086 A JP 2013150086A JP 2012007641 A JP2012007641 A JP 2012007641A JP 2012007641 A JP2012007641 A JP 2012007641A JP 2013150086 A JP2013150086 A JP 2013150086A

- Authority

- JP

- Japan

- Prior art keywords

- information

- behavior

- viewer

- content

- user

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Landscapes

- Testing, Inspecting, Measuring Of Stereoscopic Televisions And Televisions (AREA)

- Two-Way Televisions, Distribution Of Moving Picture Or The Like (AREA)

Abstract

【解決手段】ユーザに行ってもらう行動を認識するための行動認識制御情報を生成する行動認識制御情報生成サーバと、行動認識制御情報を用いてユーザの行動を認識する1以上の情報処理端末と、を備え、各情報処理端末は、該情報処理端末のユーザによる行動を認識し、行動認識制御情報生成サーバから送信される行動認識制御情報と、認識の結果とからユーザ行動情報を生成するユーザ行動認識部と、ユーザ行動認識部が生成したユーザ行動情報を外部に送信するユーザ行動情報送信部と、1以上の情報処理端末から送信されたユーザ行動情報の集計結果を受信するユーザ行動情報受信部と、を含む、行動情報認識システムが提供される。

【選択図】図1

Description

<1.第1の実施形態>

[システムの構成例]

[視聴者構成測定部の構成例]

[視聴者構成測定部の動作例]

[視聴情報集計サーバの動作例]

[コンテンツ提供サーバの動作例]

[視聴者構成情報の例]

<2.第2の実施形態>

[システムの構成例]

[システムの動作例]

<3.まとめ>

[システムの構成例]

まず、本開示の第1の実施形態にかかるコンテンツ提供システムの構成例について説明する。図1は、本開示の第1の実施形態にかかるコンテンツ提供システム1の構成例を示す説明図である。以下、図1を用いて本開示の第1の実施形態にかかるコンテンツ提供システム1の構成例について説明する。

図2は、本開示の第1の実施形態にかかるコンテンツ再生端末200に含まれる、視聴者構成測定部230の構成例を示す説明図である。なお、図2には視聴者構成測定部230の他にコンテンツ受信部210も併せて図示している。以下、図2を用いて、本開示の第1の実施形態にかかるコンテンツ再生端末200に含まれる、視聴者構成測定部230の構成について説明する。

図3は、本開示の第1の実施形態にかかるコンテンツ再生端末200に含まれる、視聴者構成測定部230の動作を示す流れ図である。以下、図3を用いて、本開示の第1の実施形態にかかるコンテンツ再生端末200に含まれる、視聴者構成測定部230の動作について説明する。

図4は、本開示の第1の実施形態にかかる視聴情報集計サーバ300の動作を示す流れ図であり、各コンテンツ再生端末200から送信される視聴者構成情報を集計する際の動作について示したものである。以下、図4を用いて本開示の第1の実施形態にかかる視聴情報集計サーバ300の動作について説明する。

図5は、本開示の第1の実施形態にかかるコンテンツ提供サーバ100の動作例を示す説明図であり、視聴情報集計サーバ300から全視聴者構成情報の提供を受けた際にコンテンツを決定する処理を示したものである。以下、図5を用いて本開示の第1の実施形態にかかるコンテンツ提供サーバ100の動作について説明する。

図6は、本開示の第1の実施形態にかかるコンテンツ再生端末200で生成される視聴者構成情報の例を示す説明図である。以下、図6を用いて、本開示の第1の実施形態にかかるコンテンツ再生端末200で生成される視聴者構成情報について説明する。

図7は、本開示の第1の実施形態にかかる視聴情報集計サーバ300で集計される全視聴者構成情報の例を示す説明図である。以下、図7を用いて本開示の第1の実施形態にかかる視聴情報集計サーバ300で集計される全視聴者構成情報の例について説明する。

(1)リアルタイムに制作し放送するコンテンツの場合

コンテンツを提供する側では、コンテンツ提供サーバ100が視聴情報集計サーバ300から全視聴者構成情報を受信すると、コンテンツ内(番組内)の構成や出演者の行動が、全視聴者構成情報を参照して変化する。

「報道番組」「情報バラエティ番組」「料理番組」「音楽番組」「スポーツ番組」「映画」「ドラマ」「アニメ」等によって構成される一般的な放送チャンネルにおいて、コンテンツを提供する側は、番組毎に想定する視聴者層を設定しておき、コンテンツ提供サーバ100が視聴情報集計サーバ300から受信した全視聴者構成情報内のその時の主要構成に合わせて、予定されている番組の順番の変更や、予定外の番組の挿入や、それによる予定番組の削除を行うようにしてもよい。

[システムの構成例]

まず、本開示の第2の実施形態にかかるコンテンツ提供システムの構成例について説明する。図8は、本開示の第2の実施形態にかかるコンテンツ提供システム1’の構成例を示す説明図である。なお、図8に示したコンテンツ提供システム1’は、本開示の行動情報認識システムの一例である。以下、図8を用いて本開示の第2の実施形態にかかるコンテンツ提供システム1’の構成例について説明する。

図9は、本開示の第2の実施形態にかかるコンテンツ再生端末200に含まれる、視聴者行動認識部231の構成例を示す説明図である。なお、図9には視聴者行動認識部231の他に行動認識制御情報受信部211も併せて図示している。以下、図9を用いて、本開示の第2の実施形態にかかるコンテンツ再生端末200に含まれる、視聴者行動認識部231の構成について説明する。

図10は、本開示の第2の実施形態にかかるコンテンツ再生端末200に含まれる、視聴者行動認識部231の動作を示す流れ図である。図10に示した流れ図は、視聴者行動認識部231による視聴者行動認識処理を示したものである。以下、図10を用いて、本開示の第2の実施形態にかかるコンテンツ再生端末200に含まれる、視聴者行動認識部231の動作について説明する。

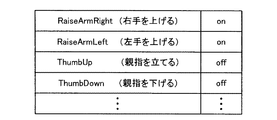

図11は、本開示の第2の実施形態にかかるコンテンツ提供システム1’で用いられる行動認識制御情報の例を示す説明図である。以下、図11を用いて、本開示の第2の実施形態にかかるコンテンツ提供システム1’で用いられる行動認識制御情報の例について説明する。

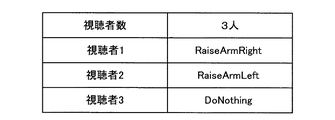

図12は、本開示の第2の実施形態にかかるコンテンツ再生端末200で生成される、視聴者行動情報の例を示す説明図である。以下、図12を用いて、本開示の第2の実施形態にかかるコンテンツ再生端末200で生成される、視聴者行動情報の例について説明する。

図13は、本開示の第2の実施形態にかかる視聴情報集計サーバ300で生成される、全視聴者行動情報の例を示す説明図である。以下、図13を用いて、本開示の第2の実施形態にかかる視聴情報集計サーバ300で生成される、全視聴者行動情報の例について説明する。

以上説明したように本開示の各実施形態によれば、コンテンツの制作者側は、広範囲で詳細な視聴実態に関する情報を入手可能となる。そしてコンテンツの制作者側は、主要な視聴者群に合わせて提供コンテンツの内容をリアルタイムに変更することによって、多くの視聴者によりマッチしたコンテンツの提供が可能となる。またコンテンツの制作者側は、コンテンツの内容に関して、視聴者の応答を把握しながら、その結果に応じてコンテンツの内容を動的に変更することが可能となる。これによって、コンテンツの制作者側は多くの視聴者によりマッチしたコンテンツの提供が可能となる。

(1)

ユーザに行ってもらう行動を認識するための行動認識制御情報を生成する行動認識制御情報生成サーバと、

前記行動認識制御情報生成サーバから前記行動認識制御情報を受信し、該行動認識制御情報を用いてユーザの行動を認識する1以上の情報処理端末と、

を備え、

各前記情報処理端末は、

該情報処理端末のユーザによる行動を認識し、前記行動認識制御情報生成サーバから送信される行動認識制御情報と、前記認識の結果とからユーザ行動情報を生成するユーザ行動認識部と、

前記ユーザ行動認識部が生成したユーザ行動情報を外部に送信するユーザ行動情報送信部と、

1以上の前記情報処理端末から送信されたユーザ行動情報の集計結果を受信するユーザ行動情報受信部と、

を含む、行動情報認識システム。

(2)

前記行動認識制御情報生成サーバは、ユーザによる所定の動作の内容を認識して行動認識制御情報を生成するユーザ行動認識部をさらに含む、前記(1)に記載の行動情報認識システム。

(3)

前記行動認識制御情報生成サーバは、前記ユーザ行動認識部が生成した行動認識制御情報を前記1以上の情報処理端末に送信する、前記(2)に記載の行動情報認識システム。

(4)

前記行動認識制御情報生成サーバは、前記1以上の情報処理端末にコンテンツを配信し、

前記ユーザ行動認識部は、

該情報処理端末が再生するコンテンツの視聴者の構成を推定する人物推定部を含む、前記(1)〜(3)のいずれかに記載の行動情報認識システム。

(5)

前記ユーザ行動認識部は、

前記人物推定部が推定した視聴者の構成と、前記行動認識制御情報生成サーバから送信される行動認識制御情報とを用いて、視聴者ごとの行動の情報である視聴者行動情報を生成する視聴者行動情報生成部をさらに含む、前記(4)に記載の行動情報認識システム。

(6)

前記行動認識制御情報生成サーバは、前記1以上の情報処理端末に同一のコンテンツを同時に配信し、

前記情報処理端末は、前記行動認識制御情報生成サーバから提供されるコンテンツを視聴している視聴者の構成を測定する視聴者構成測定部をさらに含む、前記(1)〜(5)のいずれかに記載の行動情報認識システム。

(7)

前記ユーザ行動情報受信部は、前記視聴者構成測定部で測定された各前記情報処理端末における視聴者の構成を集計して生成される全視聴者構成情報を受信する、前記(6)に記載の行動情報認識システム。

(8)

前記行動認識制御情報生成サーバは、前記視聴者構成測定部で測定された各前記情報処理端末における視聴者の構成を集計して生成される全視聴者構成情報を用いて、提供するコンテンツを決定するコンテンツ決定部をさらに含む、前記(6)または(7)に記載の行動情報認識システム。

(9)

ユーザに実行してもらう行動を認識するための行動認識制御情報を送信する行動認識制御情報送信部と、

前記行動認識制御情報に基づいて得られる、前記ユーザによる行動情報を集計して全ユーザ行動情報を生成するユーザ行動情報集計部と、

を備える、情報処理装置。

(10)

ユーザに行ってもらう行動を認識するための行動認識制御情報をサーバ装置で生成し、ユーザの行動を認識する1以上の端末に送信する行動認識制御情報生成ステップと、

ユーザによる行動を認識し、前記行動認識制御情報生成ステップで生成された前記行動認識制御情報と、前記認識の結果とからユーザ行動情報を生成するユーザ行動認識ステップと、

前記ユーザ行動認識ステップが生成したユーザ行動情報を外部に送信するユーザ行動情報送信ステップと、

1以上の前記端末から送信されたユーザ行動情報の集計結果を1以上の前記端末で受信するユーザ行動情報受信ステップと、

を含む、行動情報認識システム。

100 コンテンツ提供サーバ

110 コンテンツ送信部

111 行動認識制御情報送信部

120 全視聴者構成情報受信部

121 全視聴者行動情報受信部

130 コンテンツ決定部

131 出演者行動認識部

140 コンテンツデータベース

200 コンテンツ再生端末

210 コンテンツ受信部

211 行動認識制御情報受信部

220 表示部

230 視聴者構成測定部

231 視聴者行動認識部

240 視聴者構成情報送信部

241 視聴者行動情報送信部

250 全視聴者構成情報受信部

251 全視聴者行動情報受信部

261 画像入力部

262 画像認識部

263 音声入力部

264 音声認識部

265 人物推定部

266 視聴者構成情報生成部

267 視聴者行動情報生成部

300 視聴情報集計サーバ

310 視聴者構成情報受信部

311 視聴者行動情報受信部

320 視聴者構成情報集計部

321 視聴者行動情報集計部

330 全視聴者構成情報送信部

331 全視聴者行動情報送信部

Claims (10)

- ユーザに行ってもらう行動を認識するための行動認識制御情報を生成する行動認識制御情報生成サーバと、

前記行動認識制御情報生成サーバから前記行動認識制御情報を受信し、該行動認識制御情報を用いてユーザの行動を認識する1以上の情報処理端末と、

を備え、

各前記情報処理端末は、

該情報処理端末のユーザによる行動を認識し、前記行動認識制御情報生成サーバから送信される行動認識制御情報と、前記認識の結果とからユーザ行動情報を生成するユーザ行動認識部と、

前記ユーザ行動認識部が生成したユーザ行動情報を外部に送信するユーザ行動情報送信部と、

1以上の前記情報処理端末から送信されたユーザ行動情報の集計結果を受信するユーザ行動情報受信部と、

を含む、行動情報認識システム。 - 前記行動認識制御情報生成サーバは、ユーザによる所定の動作の内容を認識して行動認識制御情報を生成するユーザ行動認識部をさらに含む、請求項1に記載の行動情報認識システム。

- 前記行動認識制御情報生成サーバは、前記ユーザ行動認識部が生成した行動認識制御情報を前記1以上の情報処理端末に送信する、請求項2に記載の行動情報認識システム。

- 前記行動認識制御情報生成サーバは、前記1以上の情報処理端末にコンテンツを配信し、

前記ユーザ行動認識部は、

該情報処理端末が再生するコンテンツの視聴者の構成を推定する人物推定部を含む、請求項1に記載の行動情報認識システム。 - 前記ユーザ行動認識部は、

前記人物推定部が推定した視聴者の構成と、前記行動認識制御情報生成サーバから送信される行動認識制御情報とを用いて、視聴者ごとの行動の情報である視聴者行動情報を生成する視聴者行動情報生成部をさらに含む、請求項4に記載の行動情報認識システム。 - 前記行動認識制御情報生成サーバは、前記1以上の情報処理端末に同一のコンテンツを同時に配信し、

前記情報処理端末は、前記行動認識制御情報生成サーバから提供されるコンテンツを視聴している視聴者の構成を測定する視聴者構成測定部をさらに含む、請求項1に記載の行動情報認識システム。 - 前記ユーザ行動情報受信部は、前記視聴者構成測定部で測定された各前記情報処理端末における視聴者の構成を集計して生成される全視聴者構成情報を受信する、請求項6に記載の行動情報認識システム。

- 前記行動認識制御情報生成サーバは、前記視聴者構成測定部で測定された各前記情報処理端末における視聴者の構成を集計して生成される全視聴者構成情報を用いて、提供するコンテンツを決定するコンテンツ決定部をさらに含む、請求項6に記載の行動情報認識システム。

- ユーザに実行してもらう行動を認識するための行動認識制御情報を送信する行動認識制御情報送信部と、

前記行動認識制御情報に基づいて得られる、前記ユーザによる行動情報を集計して全ユーザ行動情報を生成するユーザ行動情報集計部と、

を備える、情報処理装置。 - ユーザに行ってもらう行動を認識するための行動認識制御情報をサーバ装置で生成し、ユーザの行動を認識する1以上の端末に送信する行動認識制御情報生成ステップと、

ユーザによる行動を認識し、前記行動認識制御情報生成ステップで生成された前記行動認識制御情報と、前記認識の結果とからユーザ行動情報を生成するユーザ行動認識ステップと、

前記ユーザ行動認識ステップが生成したユーザ行動情報を外部に送信するユーザ行動情報送信ステップと、

1以上の前記端末から送信されたユーザ行動情報の集計結果を1以上の前記端末で受信するユーザ行動情報受信ステップと、

を含む、行動情報認識システム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2012007641A JP2013150086A (ja) | 2012-01-18 | 2012-01-18 | 行動情報認識システム、情報処理装置および行動情報認識方法 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2012007641A JP2013150086A (ja) | 2012-01-18 | 2012-01-18 | 行動情報認識システム、情報処理装置および行動情報認識方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2013150086A true JP2013150086A (ja) | 2013-08-01 |

| JP2013150086A5 JP2013150086A5 (ja) | 2015-02-26 |

Family

ID=49047201

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2012007641A Pending JP2013150086A (ja) | 2012-01-18 | 2012-01-18 | 行動情報認識システム、情報処理装置および行動情報認識方法 |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2013150086A (ja) |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2020077924A (ja) * | 2018-11-05 | 2020-05-21 | 株式会社ビデオリサーチ | テレビ番組評価システム |

| JP2020167639A (ja) * | 2019-03-29 | 2020-10-08 | 株式会社ビデオリサーチ | テレビ番組評価システム |

| JP2020166786A (ja) * | 2019-03-29 | 2020-10-08 | 株式会社ビデオリサーチ | テレビ番組評価システム |

| JP2021064945A (ja) * | 2020-12-10 | 2021-04-22 | 株式会社ビデオリサーチ | テレビ番組評価システム |

Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2003061065A (ja) * | 2001-08-10 | 2003-02-28 | Nippon Telegraph & Telephone East Corp | 視聴者参加型ストリーミング配信方法ならびにアンケート管理サーバおよび視聴者端末装置 |

| JP2003284008A (ja) * | 2002-01-15 | 2003-10-03 | Sony Broadband Solution Corp | 情報提供システム、情報提供装置、情報提供方法、情報提供プログラム、情報提供プログラムが記憶された記憶媒体、情報利用装置、情報利用方法、情報利用プログラム、及び情報利用プログラムが記憶された記憶媒体 |

| JP2005333389A (ja) * | 2004-05-19 | 2005-12-02 | Dowango:Kk | 番組連動システム番組連動方法、サーバ装置、および、プログラム |

| JP2009140051A (ja) * | 2007-12-04 | 2009-06-25 | Sony Corp | 情報処理装置、情報処理システム、推薦装置、情報処理方法および記憶媒体 |

| JP2009140010A (ja) * | 2007-12-03 | 2009-06-25 | Sony Corp | 情報処理装置、情報処理端末、情報処理方法、およびプログラム |

| JP2011517357A (ja) * | 2008-03-04 | 2011-06-02 | ジェスチャー テック,インコーポレイテッド | 改良されたジェスチャに基づく画像操作 |

| JP2011123657A (ja) * | 2009-12-10 | 2011-06-23 | Ntt Comware Corp | 情報収集システム及び方法 |

| JP2011239029A (ja) * | 2010-05-06 | 2011-11-24 | Hitachi Consumer Electronics Co Ltd | 映像表示装置、省電力制御装置、及び省電力方法 |

| JP2011244419A (ja) * | 2010-04-19 | 2011-12-01 | Business Breakthrough Inc | 視聴覚端末、視聴覚認証システム及び制御プログラム |

-

2012

- 2012-01-18 JP JP2012007641A patent/JP2013150086A/ja active Pending

Patent Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2003061065A (ja) * | 2001-08-10 | 2003-02-28 | Nippon Telegraph & Telephone East Corp | 視聴者参加型ストリーミング配信方法ならびにアンケート管理サーバおよび視聴者端末装置 |

| JP2003284008A (ja) * | 2002-01-15 | 2003-10-03 | Sony Broadband Solution Corp | 情報提供システム、情報提供装置、情報提供方法、情報提供プログラム、情報提供プログラムが記憶された記憶媒体、情報利用装置、情報利用方法、情報利用プログラム、及び情報利用プログラムが記憶された記憶媒体 |

| JP2005333389A (ja) * | 2004-05-19 | 2005-12-02 | Dowango:Kk | 番組連動システム番組連動方法、サーバ装置、および、プログラム |

| JP2009140010A (ja) * | 2007-12-03 | 2009-06-25 | Sony Corp | 情報処理装置、情報処理端末、情報処理方法、およびプログラム |

| JP2009140051A (ja) * | 2007-12-04 | 2009-06-25 | Sony Corp | 情報処理装置、情報処理システム、推薦装置、情報処理方法および記憶媒体 |

| JP2011517357A (ja) * | 2008-03-04 | 2011-06-02 | ジェスチャー テック,インコーポレイテッド | 改良されたジェスチャに基づく画像操作 |

| JP2011123657A (ja) * | 2009-12-10 | 2011-06-23 | Ntt Comware Corp | 情報収集システム及び方法 |

| JP2011244419A (ja) * | 2010-04-19 | 2011-12-01 | Business Breakthrough Inc | 視聴覚端末、視聴覚認証システム及び制御プログラム |

| JP2011239029A (ja) * | 2010-05-06 | 2011-11-24 | Hitachi Consumer Electronics Co Ltd | 映像表示装置、省電力制御装置、及び省電力方法 |

Cited By (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2020077924A (ja) * | 2018-11-05 | 2020-05-21 | 株式会社ビデオリサーチ | テレビ番組評価システム |

| JP2020167639A (ja) * | 2019-03-29 | 2020-10-08 | 株式会社ビデオリサーチ | テレビ番組評価システム |

| JP2020166786A (ja) * | 2019-03-29 | 2020-10-08 | 株式会社ビデオリサーチ | テレビ番組評価システム |

| JP7116401B2 (ja) | 2019-03-29 | 2022-08-10 | 株式会社ビデオリサーチ | テレビ番組評価システム |

| JP7232466B2 (ja) | 2019-03-29 | 2023-03-03 | 株式会社ビデオリサーチ | テレビ番組評価システム |

| JP2021064945A (ja) * | 2020-12-10 | 2021-04-22 | 株式会社ビデオリサーチ | テレビ番組評価システム |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US11860915B2 (en) | Systems and methods for automatic program recommendations based on user interactions | |

| US10070192B2 (en) | Application for determining and responding to user sentiments during viewed media content | |

| US11947587B2 (en) | Methods, systems, and media for generating sentimental information associated with media content | |

| US8578415B2 (en) | Information providing method, content display terminal, portable terminal, server device, information providing system and program | |

| US9854315B1 (en) | Systems and methods for broadcast audience interaction and participation | |

| US9706235B2 (en) | Time varying evaluation of multimedia content | |

| US9003457B2 (en) | Media engagement factors | |

| US9143830B2 (en) | Information processing apparatus, information processing method, computer program, and information sharing system | |

| US10587921B2 (en) | Viewer rating calculation server, method for calculating viewer rating, and viewer rating calculation remote apparatus | |

| US9756387B2 (en) | Systems and methods for using a remote control for presence detection | |

| US8359610B2 (en) | Audience measurement apparatus, system and method for producing audience information of a media presentation | |

| US9306989B1 (en) | Linking social media and broadcast media | |

| US10142691B2 (en) | Display system, display apparatus, display method, and program | |

| US20100319043A1 (en) | Interactive television architecture | |

| Fink et al. | Social-and interactive-television applications based on real-time ambient-audio identification | |

| CN103686235A (zh) | 将音频和/或图像与脸部特征和表情相关的系统和方法 | |

| US10219018B2 (en) | Method of controlling display device for providing content and display device performing the same | |

| JP2013150086A (ja) | 行動情報認識システム、情報処理装置および行動情報認識方法 | |

| US20150026744A1 (en) | Display system, display apparatus, display method, and program | |

| TW201308995A (zh) | 廣告及多媒體影片互動系統及其方法 | |

| US10560207B2 (en) | System and method for providing targeted secondary content delivery | |

| US11627373B2 (en) | Systems and methods for providing survey data from a mobile device | |

| JP2017092664A (ja) | 番組分析装置及び番組分析方法 | |

| Colaç̦o | Back talk: an auditory environment for co-presence in television viewing | |

| Colaco et al. | Back talk: Engagement sensing for enhancing video viewing |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20150109 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20150109 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20151020 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20151117 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20160322 |