JP2012212340A - 情報処理装置、画像表示装置、および情報処理方法 - Google Patents

情報処理装置、画像表示装置、および情報処理方法 Download PDFInfo

- Publication number

- JP2012212340A JP2012212340A JP2011077985A JP2011077985A JP2012212340A JP 2012212340 A JP2012212340 A JP 2012212340A JP 2011077985 A JP2011077985 A JP 2011077985A JP 2011077985 A JP2011077985 A JP 2011077985A JP 2012212340 A JP2012212340 A JP 2012212340A

- Authority

- JP

- Japan

- Prior art keywords

- display

- information

- observer

- processing apparatus

- switching

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Abandoned

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/017—Gesture based interaction, e.g. based on a set of recognized hand gestures

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0481—Interaction techniques based on graphical user interfaces [GUI] based on specific properties of the displayed interaction object or a metaphor-based environment, e.g. interaction with desktop elements like windows or icons, or assisted by a cursor's changing behaviour or appearance

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T3/00—Geometric image transformation in the plane of the image

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G5/00—Control arrangements or circuits for visual indicators common to cathode-ray tube indicators and other visual indicators

- G09G5/34—Control arrangements or circuits for visual indicators common to cathode-ray tube indicators and other visual indicators for rolling or scrolling

- G09G5/346—Control arrangements or circuits for visual indicators common to cathode-ray tube indicators and other visual indicators for rolling or scrolling for systems having a bit-mapped display memory

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/10—Processing, recording or transmission of stereoscopic or multi-view image signals

- H04N13/106—Processing image signals

- H04N13/111—Transformation of image signals corresponding to virtual viewpoints, e.g. spatial image interpolation

- H04N13/117—Transformation of image signals corresponding to virtual viewpoints, e.g. spatial image interpolation the virtual viewpoint locations being selected by the viewers or determined by viewer tracking

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/20—Image signal generators

- H04N13/275—Image signal generators from 3D object models, e.g. computer-generated stereoscopic image signals

- H04N13/279—Image signal generators from 3D object models, e.g. computer-generated stereoscopic image signals the virtual viewpoint locations being selected by the viewers or determined by tracking

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/30—Image reproducers

- H04N13/366—Image reproducers using viewer tracking

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/30—Image reproducers

- H04N13/366—Image reproducers using viewer tracking

- H04N13/376—Image reproducers using viewer tracking for tracking left-right translational head movements, i.e. lateral movements

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F2203/00—Indexing scheme relating to G06F3/00 - G06F3/048

- G06F2203/048—Indexing scheme relating to G06F3/048

- G06F2203/04802—3D-info-object: information is displayed on the internal or external surface of a three dimensional manipulable object, e.g. on the faces of a cube that can be rotated by the user

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2200/00—Indexing scheme for image data processing or generation, in general

- G06T2200/16—Indexing scheme for image data processing or generation, in general involving adaptation to the client's capabilities

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2354/00—Aspects of interface with display user

Abstract

【課題】ユーザにとって処理効率の向上を図る情報処理装置を提供する。

【解決手段】情報処理装置1は、表示装置10に表示する表示内容を生成し、両眼視差により観察者9が観視可能な立体画像を表示する立体画像表示装置である表示装置10に出力する。情報処理装置1は、位置情報入力部2により観察者9の位置情報を入力し、変化検出部3により位置情報の変化を検出する。切替部4は、観察者9の位置情報の変化の検出にもとづいて、付属情報表示の表示状態を、第1の表示状態から第1の表示状態に比較して観察者が観察容易な第2の表示状態に切り替える。表示出力部5は、主表示6、および主表示6に関する付属情報を表示する付属情報表示7、8を表示装置10に出力する。

【選択図】図1

【解決手段】情報処理装置1は、表示装置10に表示する表示内容を生成し、両眼視差により観察者9が観視可能な立体画像を表示する立体画像表示装置である表示装置10に出力する。情報処理装置1は、位置情報入力部2により観察者9の位置情報を入力し、変化検出部3により位置情報の変化を検出する。切替部4は、観察者9の位置情報の変化の検出にもとづいて、付属情報表示の表示状態を、第1の表示状態から第1の表示状態に比較して観察者が観察容易な第2の表示状態に切り替える。表示出力部5は、主表示6、および主表示6に関する付属情報を表示する付属情報表示7、8を表示装置10に出力する。

【選択図】図1

Description

本技術は、情報処理装置、画像表示装置、および情報処理方法に関する。

従来、PC(Personal Computer)などのデスクトップ環境において、ユーザの視覚効果を高めるために、ディスプレイに表示するウインドウ等に影を付けて、立体的な視覚効果を演出することがおこなわれている。

また、近年のディスプレイ技術は、たとえば、立体画像表示装置のように、両眼視差により立体感を演出することが可能になってきている。こうしたディスプレイ技術を背景にして、ディスプレイ表示領域外に仮想オブジェクトを配置して、ユーザに対する視覚効果だけでなく、処理効率の向上を図る情報処理装置の提案がある(たとえば、特許文献1参照)。

しかしながら、提案の情報処理装置は、ユーザにとって処理効率の向上を図るのに十分な操作性を提供しているとは言い難く、より一層の操作性の改善が望まれている。

本技術は、このような点に鑑みてなされたものであり、ユーザにとって処理効率の向上を図ることができる情報処理装置、画像表示装置、および情報処理方法の提供を目的とする。

上記課題を解決するために、情報処理装置は、表示出力部と、位置情報入力部と、変化検出部と、切替部を備える。表示出力部は、主表示、および主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像表示装置に出力する。位置情報入力部は、立体画像表示装置を観察する観察者の位置情報を入力する。変化検出部は、位置情報の変化を検出する。切替部は、変化の検出にもとづいて、付属情報表示の表示状態を、第1の表示状態から第1の表示状態に比較して観察者が観察容易な第2の表示状態に切り替える。

また、上記課題を解決するために、画像表示装置は、立体画像表示部と、位置検出部と、変化検出部と、切替部を備える。立体画像表示部は、主表示、および主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像により表示する。位置検出部は、立体画像表示部を観察する観察者の位置を検出する。変化検出部は、位置の変化を検出する。切替部は、変化の検出にもとづいて、付属情報表示の表示状態を、第1の表示状態から第1の表示状態に比較して観察者が観察容易な第2の表示状態に切り替える。

また、上記課題を解決するために、情報処理装置において実行する情報処理方法は、主表示、および主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像表示装置に出力するステップと、立体画像表示装置を観察する観察者の位置情報を入力するステップと、位置情報の変化を検出するステップと、変化の検出にもとづいて、付属情報表示の表示状態を、第1の表示状態から第1の表示状態に比較して観察者が観察容易な第2の表示状態に切り替えるステップと、を有する。

上記の情報処理装置、画像表示装置、および情報処理方法によれば、ユーザにとって処理効率の向上を図ることができる。

以下、本技術の実施の形態を図面を参照して詳細に説明する。

[第1の実施形態]

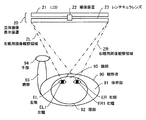

まず、第1の実施形態の情報処理装置の構成について図1を用いて説明する。図1は、第1の実施形態の情報処理装置の構成例を示す図である。

[第1の実施形態]

まず、第1の実施形態の情報処理装置の構成について図1を用いて説明する。図1は、第1の実施形態の情報処理装置の構成例を示す図である。

情報処理装置1は、表示装置10に表示する表示内容を生成し、両眼視差により観察者が観視可能な立体画像を表示する立体画像表示装置である表示装置10に出力する。情報処理装置1は、撮像装置11が観察者9を撮影した画像から観察者9の位置を検出する。情報処理装置1は、観察者9の位置に応じて表示装置10に表示する表示内容を更新する。

情報処理装置1は、位置情報入力部2と、変化検出部3と、切替部4と、表示出力部5を備える。

表示出力部5は、主表示6、および主表示6に関する付属情報を表示する付属情報表示7、8を表示装置10に出力する。主表示6は、観察者9に主として提示される表示である。より、具体的に表すと、主表示6は、仮想空間(仮想三次元空間)に配置される表示オブジェクトを用いて、観察者9に主として提示される表示である。付属情報表示7、8は、主表示6に関する付属情報として、すなわち、主表示6に従属して観察者9に提示される表示である。付属情報表示7、8は、仮想空間に配置される表示オブジェクトを用いて、主表示6に従属して観察者9に提示される表示である。

付属情報表示7は、第1の表示状態の付属情報表示であり、付属情報表示8は、第1の表示状態に比較して観察者が観察容易な第2の表示状態の付属情報表示である。付属情報表示8は、付属情報表示7に比較して、表示面積の拡大、表示方向の変更、明るさの変更などのいずれか、または組み合わせによって、観察容易な表示状態となる。なお、付属情報表示7の表示状態は、非表示状態を含むものとする。

位置情報入力部2は、表示装置10を観察する観察者9の位置情報を入力する。位置情報は、撮像装置11が撮影する画像にもとづいて観察者9の位置を特定可能な情報である。撮像装置11は、たとえば、CCDイメージセンサ(Charge Coupled Device Image Sensor)や、CMOSイメージセンサ(Complementary Metal Oxide Semiconductor Image Sensor)である。

変化検出部3は、位置情報の変化を検出する。たとえば、変化検出部3は、第1の位置にいる観察者9aの位置情報と、第2の位置にいる観察者9bの位置情報とを比較して、観察者9の位置情報に変化があったことを検出する。

切替部4は、観察者9の位置情報の変化の検出にもとづいて、付属情報表示の表示状態を、第1の表示状態から第1の表示状態に比較して観察者が観察容易な第2の表示状態に切り替える。

たとえば、情報処理装置1は、直方体からなるウインドウ表示の正面に主表示6a、側面に付属情報表示7を、観察者9aに対して表示する出力を表示装置10におこなう。ここで、位置情報入力部2が観察者9bの位置情報を入力し、変化検出部3が観察者9aから観察者9bの位置変化を検出すると、切替部4は、表示出力部5が出力する付属情報表示7を付属情報表示8に切り替える。すなわち、情報処理装置1は、直方体からなるウインドウ表示の正面に付属情報表示8、側面に主表示6bを、観察者9bに対して表示する出力を表示装置10におこなう。

このように、情報処理装置1は、観察者9の位置変化を検出して、付属情報表示7を付属情報表示8に切り替えることができる。これにより、表示装置10を観察する観察者9は、観察者9自身の位置変化により容易に表示内容の切り替えをおこなうことができ、観察者(ユーザ)9にとって処理効率の向上を図ることができる。

また、情報処理装置1は、観察者9の位置変化を検出して、立体画像表示装置である表示装置10の表示内容を切り替えるため、観察者9にとって自然に受け入れ可能な操作を提供できる。

[第2の実施形態]

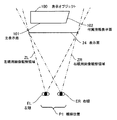

次に、第2の実施形態を用いてより具体的に説明する。図2は、第2の実施形態の立体画像表示装置と観察者の関係を示す図である。

次に、第2の実施形態を用いてより具体的に説明する。図2は、第2の実施形態の立体画像表示装置と観察者の関係を示す図である。

立体画像表示装置20は、両眼視差により観察者90が観視可能な立体画像を表示する。立体画像表示装置20は、LCD(Liquid Crystal Display:液晶ディスプレイ)21と、レンチキュラレンズ23を備える。LCD21は、左眼用画像と右眼用画像を表示する。レンチキュラレンズ23は、LCD21からの入射光を屈折させて、LCD21が表示する左眼用画像を左眼用画像観察領域ZLに、LCD21が表示する右眼用画像を右眼用画像観察領域ZRに出射する。これにより、立体画像表示装置20は、立体画像表示装置20の表示面から所定距離にいる観察者90のおよそ65mm離れた左眼ELと右眼ERに、それぞれ左眼用画像と右眼用画像を観視させる。左眼用画像と右眼用画像は、視差が設定された画像であり、観察者90は、立体画像表示装置20に表示された画像を立体画像として認識可能になる。

立体画像表示装置20は、表示面の額縁部、または周縁部に、撮像装置22を備える。撮像装置22は、観察者90を撮影する。撮像装置22が撮影した画像は、観察者90の位置を特定し、位置変化を検出するために用いられる。また、撮像装置22が撮影した画像は、位置変化の検出に限らず、ジェスチャ入力に用いることができる。

なお、撮像装置22の撮影対象は、観察者90の全部、または体の一部の部位であってもよく、また複数の部位であってもよい。たとえば、観察者90の体幹部91は、ボディトラッキングをおこなう場合の撮影対象になる。また、観察者90の頭部92は、ヘッドトラッキングをおこなう場合の撮影対象になる。また、観察者90の腕部93や手部94は、アームトラッキングやハンドトラッキングをおこなう場合の撮影対象になる。また、観察者90の顔部95は、フェイストラッキングをおこなう場合の撮影対象になる。また、観察者90の左眼EL、左瞳EL1、右眼ER、右瞳ER1は、アイトラッキング(視線検出を含む)をおこなう場合の撮影対象になる。

なお、立体画像表示装置としてレンチキュラ方式を説明したが、これに限らず、バリア方式などの空間分割方式、シャッタ眼鏡を用いた時間分割方式など、既知の立体画像表示方式を用いることができる。

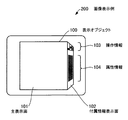

次に、立体画像表示装置が表示する表示オブジェクトについて、図3から図7を用いて表示面正対時と表示面非正対時の画像表示例を示しながら説明する。図3は、第2の実施形態の表示面正対時の表示オブジェクトと観察者の関係を示す図である。図4は、第2の実施形態の表示面正対時の画像表示例を示す図である。図5は、第2の実施形態の表示面非正対時の表示オブジェクトと観察者の関係を示す図である。図6、図7は、第2の実施形態の表示面非正対時の画像表示例を示す図である。

立体画像表示装置20の表示面24に右眼用画像および左眼用画像が表示されることにもとづいて、表示面24の奥側および手前側に形成された仮想空間内に出現する(観察者90が立体画像として観視し得る)画像を表示オブジェクトと表現する。観察者90の左眼ELと右眼ERが観察位置P1にあるとき、すなわち、左眼ELが左眼用画像観察領域ZLにあり、右眼ERが右眼用画像観察領域ZRにあるとき、観察者90は、表示オブジェクト100を立体画像として観視し得る。

表示オブジェクト100は、主表示面101と付属情報表示面102を備える多面体として設定される。表示オブジェクト100は、所定の情報の表示単位であり、たとえば、ウインドウやアイコンなどである。

表示オブジェクト100の主表示面101は、表示オブジェクト100の主となる表示面であり、付属情報表示面102は主となる表示に付属する付属情報を表示する従となる表示面である。図3に示す主表示面101は、付属情報表示面102と比較して観察位置P1の観察者90から観察容易な位置にある。主表示面101は、観察位置P1の観察者90と正対する位置にある。主表示面101は、アプリケーションの実行中の画面を表示する。たとえば、主表示面101は、ワードプロセッサやテキストエディタ、グラフィックエディタの編集画面であり、ブラウザのブラウジング画面である。

画像表示例200は、仮想空間に配置された表示オブジェクト100を観察位置P1から観察した画像である。画像表示例200に示す表示オブジェクト100は、アプリケーションのウインドウであり、主表示面101を正面に正対するように表示し、側面の1つに付属情報表示面102を表示する。表示オブジェクト100は、仮想空間内で俯瞰したときに台形形状であり、観察位置P1の観察者90は、付属情報表示面102を確認可能にしている。このように主表示面101とともに観察可能な付属情報表示面102は、観察位置P1にいる観察者90に観察位置変更の動機付けを与える。

付属情報表示面102は、操作情報103と属性情報104を表示する。操作情報103は、アプリケーションの操作に関する情報である。たとえば、操作情報103は、ウインドウに対する「最小化」、「最大化」、「閉じる」の各操作メニューや、ファイルに対する「保存」、「印刷」などの各操作メニューがある。属性情報104は、アプリケーションの属性に関する情報である。たとえば、属性情報104は、作業中ファイルの「作成日時」、「更新日時」、「サイズ」、「作成者」、「更新者」などがある。

また、表示オブジェクト100がアイコンである場合も、アプリケーションのウインドウと同様に、付属情報表示面102は、操作情報103や属性情報104の表示をおこなうことができる。

図5に示す観察位置P2は、観察位置P1より右方向に位置する。主表示面101は、観察位置P2の観察者90と正対する位置からずれた位置にある。立体画像表示装置20は、観察者90の観察位置P1から観察位置P2への位置変化の検出にもとづいて、図6に示す画像表示例201のように表示面24に表示する画像を切り替える。また、観察位置P2においても、レンチキュラレンズ23は、LCD21からの入射光を屈折させて、LCD21が表示する左眼用画像を左眼用画像観察領域ZLに、LCD21が表示する右眼用画像を右眼用画像観察領域ZRに出射する。

画像表示例201は、仮想空間に配置された表示オブジェクト100を観察位置P2から観察した画像である。画像表示例201に示す表示オブジェクト100の付属情報表示面102は、画像表示例200に示す付属情報表示面102よりも表示面積が大きくなっている。これにより、観察者90は、付属情報表示面102に表示される情報(操作情報103、属性情報104)の観察が容易になっている。付属情報表示面102の表示面積の拡大は、表示オブジェクト100を観察する仮想視点を観察位置P1から観察位置P2に切り替えることによって実現することができる。

図7に示す画像表示例202は、仮想空間に配置された表示オブジェクト100を観察位置P2から観察した画像である。画像表示例202に示す表示オブジェクト100の付属情報表示面102は、画像表示例201に示す付属情報表示面102よりも、さらに表示面積が大きくなっている。これにより、観察者90は、付属情報表示面102に表示される情報(操作情報103、属性情報104)の観察が一層容易になっている。

なお、付属情報表示面102の表示面積の拡大は、表示オブジェクト100を観察する仮想視点の切り替えによって実現することができるほか、表示オブジェクト100の向き、サイズ、形状の切り替え、またはこれらの組み合わせによっても実現することができる。

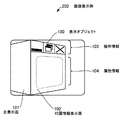

次に、画像表示装置のハードウェア構成について説明する。図8は、第2の実施形態の画像表示装置のハードウェア構成例を示す図である。画像表示装置50は、画像処理を含む所要の情報処理をおこなう情報処理装置30と、情報処理装置30が生成する画像を立体画像として表示出力可能な立体画像表示装置20を含んで構成される。

情報処理装置30は、CPU(Central Processing Unit)31によって装置全体が制御されている。CPU31には、バス37を介してRAM(Random Access Memory)32、HDD(Hard Disk Drive:ハードディスクドライブ)33、通信インタフェース34、グラフィック処理装置35、および入出力インタフェース36が接続されている。

RAM32には、CPU31に実行させるOS(Operating System)のプログラムやサーバを実行するためのアプリケーションプログラムの少なくとも一部が一時的に格納される。また、RAM32には、CPU31による処理に必要な各種データが格納される。HDD33には、OSやアプリケーションプログラムが格納される。

グラフィック処理装置35には、立体画像表示装置20が接続されている。立体画像表示装置20は、情報処理作業をおこなうための所定のGUI(Graphical User Interface)を表示する。グラフィック処理装置35は、CPU31からの命令に従って、画像を立体画像表示装置20に表示させる。

入出力インタフェース36には、キーボード38、マウス39、撮像装置22が接続されている。また、入出力インタフェース36は、可搬型記録媒体41への情報の書込み、および可搬型記録媒体41からの情報の読み出しが可能な可搬型記録媒体インタフェースと接続可能になっている。入出力インタフェース36は、キーボード38、マウス39、撮像装置22、可搬型記録媒体インタフェースから送られてくる信号を、バス37を介してCPU31に送信する。

情報処理装置30は、撮像装置22からの入力にもとづいて、観察者90のトラッキングとジェスチャ入力をおこなう。なお、画像表示装置50は、観察者90のトラッキングをおこなう入力装置と、ジェスチャ入力をおこなう入力装置をそれぞれ設けるようにしてもよい。

通信インタフェース34は、図示しないネットワークに接続されている。通信インタフェース34は、ネットワークを介して他のコンピュータとの間でデータの送受信をおこなう。

以上のようなハードウェア構成によって、本実施の形態の処理機能を実現することができる。

なお、情報処理装置30は、それぞれFPGA(Field Programmable Gate Array)やDSP(Digital Signal Processer)などからなるモジュールを含んで構成することもでき、CPU31を有しない構成とすることもできる。その場合、情報処理装置30は、それぞれ不揮発性メモリ(たとえば、EEPROM(Electrically Erasable and Programmable Read Only Memory)、フラッシュメモリ、フラッシュメモリ型メモリカードなど)を備え、モジュールのファームウェアを記憶する。不揮発性メモリは、可搬型記録媒体41、あるいは通信インタフェース34を介してファームウェアを書き込むことができる。このように情報処理装置30は、不揮発性メモリに記憶されているファームウェアを書き換えることにより、ファームウェアの更新をすることもできる。

次に、情報処理装置30が実行する切替トリガ検出処理について図9、図10を用いて説明する。図9は、第2の実施形態の切替トリガ検出処理のフローチャートである。図10は、第2の実施形態の切替情報の一例を示す図である。情報処理装置30は、所要のアプリケーションの実行に並行して、切替トリガ検出処理を実行する。切替トリガ検出処理は、観察者90のトラッキングをおこない、表示の切替タイミングの決定および切替内容の設定をおこなう処理である。

[ステップS11]情報処理装置30は、撮像装置22からの入力にもとづいて、観察者90の位置検出をおこなう。

[ステップS12]情報処理装置30は、観察者90の位置について所定の変化を検出する。

[ステップS13]情報処理装置30は、観察者90の位置について所定の変化を検出した場合にステップS14にすすみ、所定の変化を検出しない場合にステップS11にすすむ。

[ステップS14]情報処理装置30は、表示の切替対象となる表示オブジェクトを特定する。なお、表示の切替対象となる表示オブジェクトは、複数であってもよい。また、表示の切替対象となる表示オブジェクトは、アクティブなウインドウなど所定条件を満たすものに限ってもよい。

[ステップS15]情報処理装置30は、表示の切替対象として特定した表示オブジェクト毎に切替情報を設定する。切替情報300は、情報処理装置30が設定する切替情報の一例である。切替情報300は、表示オブジェクトをどのような表示態様に切り替えるかを特定するための情報である。切替情報300は、表示オブジェクトを一意に識別する識別情報(たとえば、「001」)を含む。また、切替情報300は、表示オブジェクトの形状を特定可能な情報(たとえば、「幅厚ウインドウ」)を含む。また、切替情報300は、表示オブジェクトのサイズを特定可能な情報(たとえば、「中」)を含む。また、切替情報300は、表示オブジェクトの位置を特定可能な情報(たとえば、「x1、y1、z1」)を含む。また、切替情報300は、表示オブジェクトの向きを特定可能な情報(たとえば、「dx1、dy1、dz1」)を含む。なお、各情報は、具体的な値を定義した情報であってもよいし、あらかじめ定義してある情報を参照するためのインデックスなどであってもよい。

また、切替情報300は、表示オブジェクトに設定された領域毎の表示内容を含む。たとえば、識別情報「001」で特定される表示オブジェクトは、領域aから領域nまでの表示領域を有し、領域aには「主表示」、領域bには「属性表示」、領域cには「操作表示」が設定される。なお、表示オブジェクトに設定された領域は、多面体からなる表示オブジェクトの各面毎に設定されたものであってもよいし、一の面を複数領域に分割して設定されたものであってもよいし、これらの組み合わせであってもよい。

[ステップS16]情報処理装置30は、トラッキング情報を設定する。トラッキング情報は、観察者90の観察位置に関する情報である。

[ステップS17]情報処理装置30は、表示の切替トリガとなる表示切替フラグをセットして切替トリガ検出処理を終了する。

なお、ステップS12で検出する所定の変化は、観察者90のトラッキング部位(たとえば、頭部92、左眼ELおよび右眼ERなど)の所定方向への所定の移動量(たとえば、右方向に65mm(左右眼の距離)など)がある。

また、ステップS12で検出する所定の変化は、頭部92(顔部95、左眼ELおよび右眼ERを含む)の所定の傾き量などであってもよい。また、ステップS12で検出する所定の変化は、頭部92(顔部95、左眼ELおよび右眼ERを含む)の所定の回転量などであってもよい。また、ステップS12で検出する所定の変化は、左眼ELおよび左瞳EL1、右眼ERおよび右瞳ER1から検出する視線方向などであってもよい。これらによれば、体幹部91の大きな移動を伴わなくとも表示切り替えが可能であり、ユーザにとって一層の処理効率の向上を図ることができる。

次に、情報処理装置30が実行する表示切替処理について図11、図12を用いて説明する。図11は、第2の実施形態の表示切替処理のフローチャートである。図12は、第2の実施形態の仮想視点、光源の更新の様子を示す図である。情報処理装置30は、所要のアプリケーションの実行に並行して、表示切替処理を実行する。表示切替処理は、切替トリガ検出処理がセットする表示切替フラグを監視し、表示切替フラグのセットを検出して表示切替をおこなう処理である。

[ステップS21]情報処理装置30は、表示切替フラグを監視し、表示切替フラグがセットされていればステップS22にすすみ、表示切替フラグがセットされていなければ表示切替処理を終了する。

[ステップS22]情報処理装置30は、切替情報を取得する。

[ステップS23]情報処理装置30は、切替情報にもとづいて表示オブジェクトを更新する。たとえば、情報処理装置30は、切替情報300にもとづいて、識別情報「001」で特定される表示オブジェクトの形状を「幅厚ウインドウ」、サイズを「中」、位置を「x1、y1、z1」、向きを「dx1、dy1、dz1」に設定する。

[ステップS24]情報処理装置30は、トラッキング情報を取得する。

[ステップS25]情報処理装置30は、トラッキング情報にもとづいて仮想空間に設定する仮想視点を更新する。

[ステップS26]情報処理装置30は、トラッキング情報にもとづいて仮想空間に設定する光源を更新する。

[ステップS27]情報処理装置30は、表示用画像を生成する画像生成処理を実行した後に表示切替処理を終了する。画像生成処理は、仮想空間に配置した表示オブジェクトを設定した光源と仮想視点とにもとづいてレンダリング処理をおこない表示用画像を生成する処理である。情報処理装置30は、左眼用画像と右眼用画像とを生成した後に合成して、表示用画像を生成する。

このような、表示切替処理の実行前後の表示オブジェクト、光源、仮想視点の更新例が仮想視点更新例203である。仮想視点更新例203は、表示切替前後の表示オブジェクト100a、100b、光源106、108、仮想視点105L、105R、107L、107Rの位置関係を示す。なお、仮想視点105L、107Lは、左眼用画像を生成するための仮想視点であり、仮想視点105R、107Rは、右眼用画像を生成するための仮想視点である。

表示切替前の表示オブジェクト100aは、切替情報にもとづいて表示オブジェクトの形状、サイズ、位置、向きが更新された表示オブジェクト100bに切り替えられる。また、表示切替前の光源106は、トラッキング情報にもとづいて位置、照射範囲、明るさ、色などが更新された光源108に切り替えられる。また、表示切替前の仮想視点105L、105Rは、トラッキング情報にもとづいて位置、向きなどが更新された仮想視点107L、107Rに切り替えられる。

このように、画像表示装置50は、表示切替前後で表示オブジェクトの表示態様の更新と、表示オブジェクト、光源、仮想視点の配置の更新とをおこなうので、付属情報表示面102aに比較して付属情報表示面102bは、観察者90にとって観察容易となる。

なお、画像表示装置50は、表示切替前後で表示オブジェクトの表示態様の更新と、表示オブジェクト、光源、仮想視点の配置の更新のうち、いずれか一方をおこなうものであってもよい。

なお、仮想視点107L、107Rへの切り替えは、トラッキング情報にもとづいて位置、向きなどが更新する際に、所定の係数をかけるなどして、検出した観察者90の動きより大きな変化で表示内容を切り替えるようにしてもよい。このようにすれば、画像表示装置50は、観察者90に大きな動きを強いることなく、付属情報表示面102の視認性を向上させることができる。

次に、表示オブジェクトの仮想空間配置例および画像表示例について図13から図16を用いて説明する。図13から図16は、第2の実施形態の表示オブジェクトの画像表示および仮想空間配置の一例を示す図である。

仮想空間配置例205(図13参照)は、観察者90が表示面24に正対しているとき(表示切替前)の表示オブジェクト110の様子を示す。表示オブジェクト110は、薄板状であって表示面24より奥手方向に位置する。表示オブジェクト110は、主表示面111を表示面24に向けて、付属情報表示面112を側方に向けている。

このような表示オブジェクト110は、観察者90に画像表示例204(図13参照)のように観察される。表示オブジェクト110の主表示面111は、観察者90に観察容易な状態にあり、付属情報表示面112は観察できない状態にある。

仮想空間配置例207(図14参照)は、観察者90が表示面24に正対しているとき(表示切替前)の表示オブジェクト113の様子を示す。表示オブジェクト113は、断面が台形の薄板状であって表示面24より奥手方向に位置する。表示オブジェクト113は、主表示面114を表示面24に向けて、付属情報表示面115を斜めにして前方に向けている。

このような表示オブジェクト113は、観察者90に画像表示例206(図14参照)のように観察される。表示オブジェクト113の主表示面114は、観察者90に観察容易な状態にあり、付属情報表示面115は観察容易でないものの、付属情報表示面115の存在を確認可能な状態にある。このような付属情報表示面115は、観察者90に対して付属情報表示面115を観察するための位置変更をおこなう動機付けを与える。

仮想空間配置例209(図15参照)は、観察者90が表示面24に正対していないとき(表示切替後)の表示オブジェクト116の様子を示す。表示オブジェクト116は、立方体状であって表示面24より奥手方向に位置する。表示オブジェクト116は、主表示面117および付属情報表示面118を斜めにして前方に向けている。

このような表示オブジェクト116は、観察者90に画像表示例208(図15参照)のように観察される。表示切替後の表示オブジェクト116は、変形、向きの変更により表示態様を更新し、付属情報表示面118を観察者90にとって観察容易な表示状態としている。

なお、表示切替前の表示オブジェクトが表示オブジェクト110であれば、表示オブジェクト116の付属情報表示面118は、付属情報表示面112の非表示状態から観察者90が観察容易な表示状態になったといえる。また、表示切替前の表示オブジェクトが表示オブジェクト113であれば、表示オブジェクト116の付属情報表示面118は、付属情報表示面115の表示状態よりも観察者90が観察容易な表示状態になったといえる。

仮想空間配置例211(図16参照)は、観察者90が表示面24に正対していないとき(表示切替後)の表示オブジェクト119の様子を示す。表示オブジェクト119は、立方体状であって、表示面24を挟んで一部が手前方向に、その余が奥手方向に位置する。表示オブジェクト119は、主表示面120および付属情報表示面121を斜めにして前方に向けている。

このような表示オブジェクト119は、観察者90に画像表示例210(図16参照)のように観察される。表示切替後の表示オブジェクト119は、変形、向きの変更、位置の変更により表示態様を更新し、付属情報表示面121を観察者90にとって観察容易な表示状態としている。

なお、表示切替前の表示オブジェクトが表示オブジェクト110であれば、表示オブジェクト119の付属情報表示面121は、付属情報表示面112の非表示状態から観察者90が観察容易な表示状態になったといえる。また、表示切替前の表示オブジェクトが表示オブジェクト113であれば、表示オブジェクト119の付属情報表示面121は、付属情報表示面115の表示状態よりも観察者90が観察容易な表示状態になったといえる。

このように、画像表示装置50は、ユーザ(観察者90)の動きにしたがい付属情報表示面の観察容易性を変更することができる。このようなGUIの改善は、ユーザの操作性の改善や、表示領域の有効利用により、ユーザの処理効率の向上を図ることができる。

次に、情報処理装置30が実行する操作入力特定処理について図17を用いて説明する。図17は、第2の実施形態の操作入力特定処理のフローチャートである。情報処理装置30は、所要のアプリケーションの実行に並行して、操作入力特定処理を実行する。操作入力特定処理は、観察者90の手、指を検出し、手、指によるジェスチャを検出し、アプリケーションの操作入力の特定をおこなう処理である。

[ステップS31]情報処理装置30は、選択可能操作情報を取得する。選択可能操作情報は、実行中のアプリケーションの操作入力として有効なジェスチャパタンを定義した情報である。

[ステップS32]情報処理装置30は、観察者90の手部94を検出する。情報処理装置30は、観察者90の手部94の位置、向き、形状などを特定する。観察者90の手部94の検出は、撮像装置22が撮影する画像にもとづいておこなう。

[ステップS33]情報処理装置30は、観察者90の手部94の時系列的な変化を検出する。

[ステップS34]情報処理装置30は、選択可能操作情報が定義するジェスチャパタンと、観察者90の手部94の時系列的な変化パタンのマッチングをおこなう。

[ステップS35]情報処理装置30は、ジェスチャパタンと、観察者90の手部94の時系列的な変化パタンとが一致した場合にステップS36にすすみ、一致しない場合にステップS31にすすむ。

[ステップS36]情報処理装置30は、選択可能操作情報から一致したジェスチャパタンに対応する操作入力を特定して操作入力特定処理を終了する。

次に、ジェスチャ入力の具体例を図18から図20を用いて説明する。図18から図20は、第2の実施形態のジェスチャ入力の一例を示す図である。

ジェスチャ入力例212は、観察者90の手部94aが手部94bの位置まで移動したことを検出したジェスチャ入力例を示す。情報処理装置30は、手部94aを検出した後、手部94bを検出することで、所定時間内の手部94の変化量が、所定方向に所定距離(たとえば、左方向に20cm移動)だけあったことを検出する。情報処理装置30は、検出した変化パタンがあらかじめ定義したジェスチャパタンと一致することで、所定の操作入力を受け付ける。

ジェスチャ入力例213は、観察者90の手部94cが手部94dの向きまで回転したことを検出したジェスチャ入力例を示す。情報処理装置30は、手部94cを指の位置関係まで含めて検出した後、手部94dの指の位置関係を比較して回転を検出することで、所定時間内の手部94の変化量が、所定方向に所定角度(たとえば、反時計回りに30度回転)だけあったことを検出する。情報処理装置30は、検出した変化パタンがあらかじめ定義したジェスチャパタンと一致することで、所定の操作入力を受け付ける。

ジェスチャ入力例214は、観察者90の手部94eが手部94fの位置まで接近したことを検出したジェスチャ入力例を示す。情報処理装置30は、手部94eを検出した後、手部94fを検出することで、所定時間内の手部94の変化量が、所定方向に所定距離(たとえば、接近方向に10cm移動)だけあったことを検出する。情報処理装置30は、検出した変化パタンがあらかじめ定義したジェスチャパタンと一致することで、所定の操作入力を受け付ける。

なお、ジェスチャ入力は、上記に例示した以外にも、傾きの変化(たとえば、手のひらの向きの変化)や形状の変化(たとえば、手を握ったり、開いたりなど)を検出するものであってもよい。

なお、手部94によるジェスチャ入力について説明したが、ジェスチャ入力をおこなう部位は、手部94に限らず観察者90のその他の部位(たとえば、頭部92、顔部95など)であってもよい。また、ジェスチャ入力は、左瞳EL1や右瞳ER1の動きを検出した視線入力などを含むものである。また、ジェスチャにより特定する操作入力は、マウス操作や、タッチパネルタッチ操作などと同様の操作入力を対象とすることができる。

なお、ジェスチャ入力は、観察者90の変化を検出して、表示切替を行った後に有効な入力として受け付けるものであってもよい。また、ジェスチャ入力は、付属情報表示面を対象とするものに限ってもよい。このようにすれば、画像表示装置50は、ユーザにとってジェスチャ入力の有効な状態、あるいはジェスチャ入力の有効な対象の把握が容易になる。また、画像表示装置50は、マウス39を用いて右クリック操作していた操作内容を、右クリック入力に代えて観察者90の移動による表示切替、マウス39のポインティングや選択、決定操作入力に代えてジェスチャ入力とすることができる。これにより、画像表示装置50は、ユーザの操作性を改善し、ユーザの処理効率の向上を図ることができる。

次に、表示オブジェクトの画像表示および仮想空間配置の変形例を、図21から図29を用いて説明する。図21から図29は、第2の実施形態の表示オブジェクトの画像表示および仮想空間配置の変形例を示す図である。

まず、表示領域外にある付属情報表示面を表示切替により、立体画像表示装置20の表示領域内に付属情報表示面を表示する表示例について、図21、図22を用いて説明する。

仮想空間配置例216(図21参照)は、観察者90が表示面24に正対しているとき(表示切替前)の表示オブジェクト122の様子を示す。表示オブジェクト122は、薄板状であって表示面24より奥手方向に位置する。表示オブジェクト122は、主表示面123と付属情報表示面124を同一面に並べて備え、表示面24に向けている。主表示面123は、表示面24に正対している観察者90によって観察できる表示領域内にあり、付属情報表示面124は、観察者90によって観察できない表示領域外にある(画像表示例215参照)。

仮想空間配置例218(図22参照)は、観察者90が表示面24に正対していないとき(表示切替後)の表示オブジェクト125の様子を示す。表示オブジェクト125は、薄板状であって表示面24より奥手方向に位置する。表示オブジェクト125は、主表示面126および付属情報表示面127を斜めにして前方に向けている。表示オブジェクト125は、表示オブジェクト122(図21参照)の位置、向きを変更した表示オブジェクトである。表示オブジェクト125は、表示面24に対して付属情報表示面127を表示面24に近接させる位置および向きで仮想空間内に配置される。

このような表示オブジェクト125は、観察者90に画像表示例217(図22参照)のように観察される。表示切替後の表示オブジェクト125は、向きの変更、位置の変更により表示態様を更新し、付属情報表示面127を観察者90にとって観察容易な表示状態としている。このような付属情報表示面127の表示状態は、表示切替前の表示オブジェクト122の付属情報表示面124の非表示状態から観察者90が観察容易な表示状態になったといえる。

次に、複数ある表示オブジェクトの再配置をともなう表示切替により、立体画像表示装置20の表示領域内に付属情報表示面を表示する表示例について、図23、図24を用いて説明する。たとえば、再配置をおこなう表示オブジェクトは、重畳配置されたウインドウやアイコンなどがある。

仮想空間配置例220(図23参照)は、観察者90が表示面24に正対しているとき(表示切替前)の表示オブジェクト128、129、130の様子を示す。表示オブジェクト128、129、130は、それぞれ薄板状であって表示面24より奥手方向に整列して位置する。表示オブジェクト128は、主表示面131を表示面24に向けて、付属情報表示面132を側方に向けている。このような表示オブジェクト128は、観察者90に画像表示例219(図23参照)のように観察される。表示オブジェクト128の主表示面131は、観察者90に観察容易な状態にあり、付属情報表示面132は観察できない状態にある。また、表示オブジェクト129、130は、表示オブジェクト128の背面側に位置し、観察者90から確認できない。

仮想空間配置例222(図24参照)は、観察者90が表示面24に正対していないとき(表示切替後)の表示オブジェクト133、134、135の様子を示す。なお、表示オブジェクト133、134、135は、それぞれ表示切替前の表示オブジェクト128、129、130に対応する。

表示オブジェクト133は、直方体状であって表示面24より奥手方向に位置する。表示オブジェクト133は、主表示面136および付属情報表示面137を斜めにして前方に向けている。このような表示オブジェクト133は、観察者90に画像表示例221(図24参照)のように観察される。表示切替後の表示オブジェクト133は、変形、位置の変更、向きの変更により表示態様を更新し、付属情報表示面137を観察者90にとって観察容易な表示状態としている。このような付属情報表示面137の表示状態は、表示切替前の表示オブジェクト128の付属情報表示面132の非表示状態から観察者90が観察容易な表示状態になったといえる。

また、表示オブジェクト134、135は、それぞれ表示オブジェクト133との整列状態から、位置の変更、向きの変更により表示態様を更新する。これにより、表示オブジェクト134、135は、表示切替前には、表示されていなかった付属情報表示面138、139を観察者90が観察容易な表示状態となる。なお、表示オブジェクト134、135は、観察容易な表示状態となる付属情報表示面138、139に代えて、あるいは含めて主表示面を観察容易な表示状態としてもよい。

次に、一の表示オブジェクト上に配置された複数の表示オブジェクトの再配置をともなう表示切替により、立体画像表示装置20の表示領域内に付属情報表示面を表示する表示例について、図25から図27を用いて説明する。たとえば、再配置をおこなう表示オブジェクトは、ウインドウ上に配置されたアイコンなどがある。

仮想空間配置例224(図25参照)は、観察者90が表示面24に正対しているとき(表示切替前)の表示オブジェクト140、141の様子を示す。複数の表示オブジェクト141は、薄板状であって、同じく薄板状の表示オブジェクト140の前面側に配置されている。表示オブジェクト140、141は、それぞれ、表示面24より奥手方向に位置する。表示オブジェクト141は、主表示面142を表示面24に向けて、付属情報表示面143を側方に向けている。このような表示オブジェクト141は、観察者90に画像表示例223(図25参照)のように観察される。表示オブジェクト141の主表示面142は、観察者90に観察容易な状態にあり、付属情報表示面143は観察できない状態にある。

仮想空間配置例226(図26参照)は、観察者90が表示面24に正対していないとき(表示切替後)の表示オブジェクト144、145の様子を示す。なお、表示オブジェクト144、145は、それぞれ表示切替前の表示オブジェクト140、141に対応する。

表示オブジェクト144、145は、それぞれ直方体状であって表示面24より奥手方向に位置する。表示オブジェクト145は、主表示面146および付属情報表示面147を斜めにして前方に向けている。このような表示オブジェクト145は、観察者90に画像表示例225(図26参照)のように観察される。表示切替後の表示オブジェクト145は、位置の変更、向きの変更により表示態様を更新し、付属情報表示面147を観察者90にとって観察容易な表示状態としている。このような付属情報表示面147の表示状態は、表示切替前の表示オブジェクト141の付属情報表示面143の非表示状態から観察者90が観察容易な表示状態になったといえる。

このように、表示オブジェクト145は、背景となる表示オブジェクト144と独立して、表示態様の変更をおこなう。言い換えれば、仮想空間内の複数の表示オブジェクト145は、相対的位置関係を変更して表示態様の変更をおこなう。これにより、表示オブジェクト145が表示オブジェクト144に関連付けされていても、表示オブジェクト144の観察状態と独立して付属情報表示面147の観察状態を容易なものとすることができる。

仮想空間配置例228(図27参照)は、観察者90が表示面24に正対していないとき(表示切替後)の表示オブジェクト148、149の様子を示す。なお、表示オブジェクト148、149は、それぞれ表示切替前の表示オブジェクト140、141に対応する。

表示オブジェクト148、149は、それぞれ立方体状であって表示面24より奥手方向に位置する。表示オブジェクト149は、主表示面150および付属情報表示面151を斜めにして前方に向けている。このような表示オブジェクト149は、観察者90に画像表示例227(図27参照)のように観察される。表示切替後の表示オブジェクト149は、変形、位置の変更、向きの変更により表示態様を更新し、付属情報表示面151を観察者90にとって観察容易な表示状態としている。このような付属情報表示面151の表示状態は、表示切替前の表示オブジェクト141の付属情報表示面143の非表示状態から観察者90が観察容易な表示状態になったといえる。

このように、表示オブジェクト149は、背景となる表示オブジェクト148と独立して、表示態様の変更をおこなう。これにより、表示オブジェクト149が表示オブジェクト148に関連付けされていても、表示オブジェクト148の観察状態と独立して付属情報表示面151の観察状態を容易なものとすることができる。

次に、表示領域外にある付属情報表示面を表示切替により、立体画像表示装置20の表示領域内に付属情報表示面を表示する表示例について、図28、図29を用いて説明する。主表示面と付属情報表示面が異なる表示オブジェクトに表示される点で、図21、図22を用いて説明した変形例と異なる。

仮想空間配置例230(図28参照)は、観察者90が表示面24に正対しているとき(表示切替前)の表示オブジェクト152、154の様子を示す。表示オブジェクト152は、前面に主表示面153を備え、表示オブジェクト154は、前面に付属情報表示面155を備える。表示オブジェクト152、154は、薄板状であって表示面24より奥手方向に位置する。表示オブジェクト152、154は、それぞれ主表示面153、付属情報表示面155を表示面24に向けている。主表示面153は、表示面24に正対している観察者90によって観察できる表示領域内にあり、付属情報表示面155は、観察者90によって観察できない表示領域外にある(画像表示例229参照)。

仮想空間配置例232(図29参照)は、観察者90が表示面24に正対していないとき(表示切替後)の表示オブジェクト156、158の様子を示す。表示オブジェクト156、158、薄板状であって表示面24より奥手方向に位置する。表示オブジェクト156、158は、仮想空間内の相対的位置関係を保持したまま、仮想空間内の位置関係を変更する。位置関係変更後の主表示面157は、付属情報表示面159に正対している観察者90によって観察できる表示領域内にあり、表示面24は、観察者90によって観察できない表示領域外にある(画像表示例231参照)。

表示切替後の表示オブジェクト156、158は、位置の変更により表示態様を更新し、付属情報表示面159を観察者90にとって観察容易な表示状態としている。このような付属情報表示面159の表示状態は、表示切替前の表示オブジェクト154の付属情報表示面155の非表示状態から観察者90が観察容易な表示状態になったといえる。

[第3の実施形態]

次に、第3の実施形態の表示切替処理について図30を用いて説明する。図30は、第3の実施形態の表示切替処理のフローチャートである。第3の実施形態の表示切替処理は、切替情報にもとづいて表示用画像を生成するものではなく、あらかじめ用意してある表示用画像に切り替える点で第2の実施形態の表示切替処理と異なる。また、観察者90の位置検出を含めて表示切替をおこなうため、第2の実施形態の切替トリガ検出処理は、第3の実施形態においておこなわない。情報処理装置30は、所要のアプリケーションの実行に並行して、表示切替処理を実行する点は、第2の実施形態と同様である。

次に、第3の実施形態の表示切替処理について図30を用いて説明する。図30は、第3の実施形態の表示切替処理のフローチャートである。第3の実施形態の表示切替処理は、切替情報にもとづいて表示用画像を生成するものではなく、あらかじめ用意してある表示用画像に切り替える点で第2の実施形態の表示切替処理と異なる。また、観察者90の位置検出を含めて表示切替をおこなうため、第2の実施形態の切替トリガ検出処理は、第3の実施形態においておこなわない。情報処理装置30は、所要のアプリケーションの実行に並行して、表示切替処理を実行する点は、第2の実施形態と同様である。

[ステップS41]情報処理装置30は、撮像装置22からの入力にもとづいて、観察者90の位置検出をおこなう。

[ステップS42]情報処理装置30は、観察者90の位置について所定の変化を検出する。

[ステップS43]情報処理装置30は、観察者90の位置について所定の変化を検出した場合にステップS44にすすみ、所定の変化を検出しない場合にステップS41にすすむ。

[ステップS44]情報処理装置30は、付属情報表示面を観察容易とした表示用画像への切替をおこない、表示切替処理を終了する。

情報処理装置30は、あらかじめ第1の表示用画像と、第1の表示用画像と比較して付属情報表示面を観察容易な第2の表示用画像を用意することで、付属情報表示面を観察容易とした表示用画像への切替を容易におこなうことができる。

なお、画像表示装置50は、2視点の画像(右眼用画像および左眼用画像)を表示する立体画像表示装置20を備えたが、多視点の立体画像表示装置を備えるようにしてもよい。この場合、画像表示装置50は、立体画像表示装置20で表示する切替前後の画像を異なる視点に対応して多視点の立体画像表示装置に表示する。

なお、上記の処理機能は、コンピュータによって実現することができる。その場合、各装置が有すべき機能の処理内容を記述したプログラムが提供される。そのプログラムをコンピュータで実行することにより、上記処理機能がコンピュータ上で実現される。処理内容を記述したプログラムは、コンピュータで読み取り可能な記録媒体に記録しておくことができる。

プログラムを流通させる場合には、たとえば、そのプログラムが記録されたDVD(Digital Versatile Disc)、CD−ROM(Compact Disc Read Only Memory)などの可搬型記録媒体が販売される。また、プログラムをサーバコンピュータの記憶装置に格納しておき、ネットワークを介して、サーバコンピュータから他のコンピュータにそのプログラムを転送することもできる。

プログラムを実行するコンピュータは、たとえば、可搬型記録媒体に記録されたプログラムもしくはサーバコンピュータから転送されたプログラムを、自己の記憶装置に格納する。そして、コンピュータは、自己の記憶装置からプログラムを読み取り、プログラムにしたがった処理を実行する。

なお、本技術は以下のような構成も採ることができる。

(1)主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像表示装置に出力する表示出力部と、

前記立体画像表示装置を観察する前記観察者の位置情報を入力する位置情報入力部と、

前記位置情報の変化を検出する変化検出部と、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替える切替部と、

を備える情報処理装置。

(2)前記付属情報は、前記主表示の操作に関する操作情報である(1)記載の情報処理装置。

(3)前記第2の表示状態において、前記観察者のジェスチャから、前記操作情報に関する選択操作を検出するジェスチャ検出部を備える(2)記載の情報処理装置。

(4)前記付属情報は、前記主表示の属性に関する属性情報である(1)記載の情報処理装置。

(5)前記付属情報は、前記第1の表示状態において非表示である(1)乃至(4)記載の情報処理装置。

(6)前記主表示および前記付属情報表示は、多面体からなる表示オブジェクトのそれぞれ異なる面に表示される(1)乃至(5)記載の情報処理装置。

(7)前記主表示および前記付属情報表示は、表示オブジェクトの同一面に領域を区分して表示される(1)乃至(5)記載の情報処理装置。

(8)前記主表示は、第1の表示オブジェクトに表示され、前記付属情報表示は、第2の表示オブジェクトに表示される(1)乃至(5)記載の情報処理装置。

(9)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの仮想視点を第1の仮想視点から第2の仮想視点に切り替える(1)乃至(8)記載の情報処理装置。

(10)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの大きさを変更する(1)乃至(9)記載の情報処理装置。

(11)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの向きを変更する(1)乃至(10)記載の情報処理装置。

(12)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの形状を変更する(1)乃至(11)記載の情報処理装置。

(13)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの光源を変更する(1)乃至(12)記載の情報処理装置。

(14)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、複数の前記表示オブジェクトの相対的位置関係を変更する(1)乃至(13)記載の情報処理装置。

(15)主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像により表示する立体画像表示部と、

前記立体画像表示部を観察する前記観察者の位置を検出する位置検出部と、

前記位置の変化を検出する変化検出部と、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替える切替部と、

を備える画像表示装置。

(16)情報処理装置において実行する情報処理方法であって、

主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像表示装置に出力するステップと、

前記立体画像表示装置を観察する前記観察者の位置情報を入力するステップと、

前記位置情報の変化を検出するステップと、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替えるステップと、

を有する情報処理方法。

(17)画像表示装置において実行する画像表示方法であって、

主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像を立体画像表示部に表示するステップと、

前記立体画像表示部を観察する前記観察者の位置を検出するステップと、

前記位置の変化を検出するステップと、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替えるステップと、

を有する画像表示方法。

(1)主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像表示装置に出力する表示出力部と、

前記立体画像表示装置を観察する前記観察者の位置情報を入力する位置情報入力部と、

前記位置情報の変化を検出する変化検出部と、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替える切替部と、

を備える情報処理装置。

(2)前記付属情報は、前記主表示の操作に関する操作情報である(1)記載の情報処理装置。

(3)前記第2の表示状態において、前記観察者のジェスチャから、前記操作情報に関する選択操作を検出するジェスチャ検出部を備える(2)記載の情報処理装置。

(4)前記付属情報は、前記主表示の属性に関する属性情報である(1)記載の情報処理装置。

(5)前記付属情報は、前記第1の表示状態において非表示である(1)乃至(4)記載の情報処理装置。

(6)前記主表示および前記付属情報表示は、多面体からなる表示オブジェクトのそれぞれ異なる面に表示される(1)乃至(5)記載の情報処理装置。

(7)前記主表示および前記付属情報表示は、表示オブジェクトの同一面に領域を区分して表示される(1)乃至(5)記載の情報処理装置。

(8)前記主表示は、第1の表示オブジェクトに表示され、前記付属情報表示は、第2の表示オブジェクトに表示される(1)乃至(5)記載の情報処理装置。

(9)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの仮想視点を第1の仮想視点から第2の仮想視点に切り替える(1)乃至(8)記載の情報処理装置。

(10)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの大きさを変更する(1)乃至(9)記載の情報処理装置。

(11)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの向きを変更する(1)乃至(10)記載の情報処理装置。

(12)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの形状を変更する(1)乃至(11)記載の情報処理装置。

(13)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの光源を変更する(1)乃至(12)記載の情報処理装置。

(14)前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、複数の前記表示オブジェクトの相対的位置関係を変更する(1)乃至(13)記載の情報処理装置。

(15)主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像により表示する立体画像表示部と、

前記立体画像表示部を観察する前記観察者の位置を検出する位置検出部と、

前記位置の変化を検出する変化検出部と、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替える切替部と、

を備える画像表示装置。

(16)情報処理装置において実行する情報処理方法であって、

主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像表示装置に出力するステップと、

前記立体画像表示装置を観察する前記観察者の位置情報を入力するステップと、

前記位置情報の変化を検出するステップと、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替えるステップと、

を有する情報処理方法。

(17)画像表示装置において実行する画像表示方法であって、

主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像を立体画像表示部に表示するステップと、

前記立体画像表示部を観察する前記観察者の位置を検出するステップと、

前記位置の変化を検出するステップと、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替えるステップと、

を有する画像表示方法。

なお、上述の実施の形態は、実施の形態の要旨を逸脱しない範囲内において種々の変更を加えることができる。

さらに、上述の実施の形態は、多数の変形、変更が当業者にとって可能であり、説明した正確な構成および応用例に限定されるものではない。

1,30……情報処理装置、2……位置情報入力部、3……変化検出部、4……切替部、5……表示出力部、6,6a,6b……主表示、7……付属情報表示(第1の表示状態)、8……付属情報表示(第2の表示状態)、9,9a,9b,90……観察者、10……表示装置、11,22……撮像装置、20……立体画像表示装置、21……LCD、23……レンチキュラレンズ、24……表示面、31……CPU、32……RAM、33……HDD、34……通信インタフェース、35……グラフィック処理装置、36……入出力インタフェース、37……バス、38……キーボード、39……マウス、41……可搬型記録媒体、50……画像表示装置、91……体幹部、92……頭部、93……腕部、94,94a,94b,94c,94d,94e,94f……手部、95……顔部、100,100a,100b,110,113,116,119,122,125,128,129,130,133,134,135,140,141,144,145,148,149,152,154,156,158……表示オブジェクト、101,111,114,117,120,123,126,131,136,142,146,150,153,157……主表示面、102,102a,102b,112,115,118,121,124,127,132,137,138,139,143,147,151,155,159……付属情報表示面、103……操作情報、104……属性情報、105L,105R,107L,107R……仮想視点、106,108……光源、EL……左眼、EL1……左瞳、ER……右眼、ER1……右瞳、P1,P2……観察位置、ZL……左眼用画像観察領域、ZR……右眼用画像観察領域

Claims (16)

- 主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像表示装置に出力する表示出力部と、

前記立体画像表示装置を観察する前記観察者の位置情報を入力する位置情報入力部と、

前記位置情報の変化を検出する変化検出部と、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替える切替部と、

を備える情報処理装置。 - 前記付属情報は、前記主表示の操作に関する操作情報である請求項1記載の情報処理装置。

- 前記第2の表示状態において、前記観察者のジェスチャから、前記操作情報に関する選択操作を検出するジェスチャ検出部を備える請求項2記載の情報処理装置。

- 前記付属情報は、前記主表示の属性に関する属性情報である請求項1記載の情報処理装置。

- 前記付属情報は、前記第1の表示状態において非表示である請求項1記載の情報処理装置。

- 前記主表示および前記付属情報表示は、多面体からなる表示オブジェクトのそれぞれ異なる面に表示される請求項1記載の情報処理装置。

- 前記主表示および前記付属情報表示は、表示オブジェクトの同一面に領域を区分して表示される請求項1記載の情報処理装置。

- 前記主表示は、第1の表示オブジェクトに表示され、前記付属情報表示は、第2の表示オブジェクトに表示される請求項1記載の情報処理装置。

- 前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの仮想視点を第1の仮想視点から第2の仮想視点に切り替える請求項1記載の情報処理装置。

- 前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの大きさを変更する請求項1記載の情報処理装置。

- 前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの向きを変更する請求項1記載の情報処理装置。

- 前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの形状を変更する請求項1記載の情報処理装置。

- 前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、前記表示オブジェクトの光源を変更する請求項1記載の情報処理装置。

- 前記切替部は、前記第1の表示状態から前記第2の表示状態に切り替える際に、複数の前記表示オブジェクトの相対的位置関係を変更する請求項1記載の情報処理装置。

- 主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像により表示する立体画像表示部と、

前記立体画像表示部を観察する前記観察者の位置を検出する位置検出部と、

前記位置の変化を検出する変化検出部と、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替える切替部と、

を備える画像表示装置。 - 情報処理装置において実行する情報処理方法であって、

主表示、および前記主表示に関する付属情報を表示する付属情報表示を、両眼視差により観察者が観視可能な立体画像表示装置に出力するステップと、

前記立体画像表示装置を観察する前記観察者の位置情報を入力するステップと、

前記位置情報の変化を検出するステップと、

前記変化の検出にもとづいて、前記付属情報表示の表示状態を、第1の表示状態から前記第1の表示状態に比較して前記観察者が観察容易な第2の表示状態に切り替えるステップと、

を有する情報処理方法。

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2011077985A JP2012212340A (ja) | 2011-03-31 | 2011-03-31 | 情報処理装置、画像表示装置、および情報処理方法 |

| CN201280016794XA CN103477313A (zh) | 2011-03-31 | 2012-02-17 | 信息处理装置、图像显示装置以及信息处理方法 |

| PCT/JP2012/001076 WO2012132201A1 (en) | 2011-03-31 | 2012-02-17 | Information processing apparatus, image display apparatus, and information processing method |

| US14/006,870 US9182827B2 (en) | 2011-03-31 | 2012-02-17 | Information processing apparatus, image display apparatus, and information processing method |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2011077985A JP2012212340A (ja) | 2011-03-31 | 2011-03-31 | 情報処理装置、画像表示装置、および情報処理方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2012212340A true JP2012212340A (ja) | 2012-11-01 |

| JP2012212340A5 JP2012212340A5 (ja) | 2014-05-01 |

Family

ID=46929997

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2011077985A Abandoned JP2012212340A (ja) | 2011-03-31 | 2011-03-31 | 情報処理装置、画像表示装置、および情報処理方法 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US9182827B2 (ja) |

| JP (1) | JP2012212340A (ja) |

| CN (1) | CN103477313A (ja) |

| WO (1) | WO2012132201A1 (ja) |

Cited By (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE102013110341A1 (de) | 2012-09-26 | 2014-03-27 | Denso Corporation | Drahtlose Leistungsübertragungsvorrichtung und Direktantriebssystem mit der Vorrichtung |

| JP2014098778A (ja) * | 2012-11-14 | 2014-05-29 | Casio Comput Co Ltd | 画像処理装置、投影装置、画像選択方法及びプログラム |

| WO2014175455A1 (ja) * | 2013-04-26 | 2014-10-30 | 京セラ株式会社 | 電子機器 |

| JP2020135291A (ja) * | 2019-02-18 | 2020-08-31 | キヤノン株式会社 | 情報処理装置、情報処理方法及びプログラム |

| JP2020177482A (ja) * | 2019-04-19 | 2020-10-29 | キヤノンメディカルシステムズ株式会社 | 医用情報処理装置及び医用情報処理方法 |

| WO2022209258A1 (ja) * | 2021-03-29 | 2022-10-06 | ソニーグループ株式会社 | 情報処理装置、情報処理方法及び記録媒体 |

Families Citing this family (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| TWI637348B (zh) * | 2013-04-11 | 2018-10-01 | 緯創資通股份有限公司 | 影像顯示裝置和影像顯示方法 |

| US9591295B2 (en) * | 2013-09-24 | 2017-03-07 | Amazon Technologies, Inc. | Approaches for simulating three-dimensional views |

| KR102099178B1 (ko) * | 2013-11-29 | 2020-04-09 | 엘지전자 주식회사 | 웨어러블 디바이스 및 웨어러블 디바이스 디스플레이 제어 방법 |

| KR20150101915A (ko) * | 2014-02-27 | 2015-09-04 | 삼성전자주식회사 | 3차원 gui 화면의 표시 방법 및 이를 수행하기 위한 디바이스 |

| DE102014103621A1 (de) * | 2014-03-17 | 2015-09-17 | Christian Nasca | Bildstabilisierungsverfahren |

| WO2015145203A1 (en) * | 2014-03-25 | 2015-10-01 | Sony Corporation | 3d graphical authentication by revelation of hidden objects |

| US20170140215A1 (en) * | 2015-11-18 | 2017-05-18 | Le Holdings (Beijing) Co., Ltd. | Gesture recognition method and virtual reality display output device |

| US20170185142A1 (en) * | 2015-12-25 | 2017-06-29 | Le Holdings (Beijing) Co., Ltd. | Method, system and smart glove for obtaining immersion in virtual reality system |

| US10372289B2 (en) | 2015-12-31 | 2019-08-06 | Beijing Pico Technology Co., Ltd. | Wraparound interface layout method, content switching method under three-dimensional immersive environment, and list switching method |

| CN105653034A (zh) * | 2015-12-31 | 2016-06-08 | 北京小鸟看看科技有限公司 | 一种三维沉浸式环境下内容切换方法和装置 |

| KR20210107631A (ko) * | 2018-12-25 | 2021-09-01 | 소니그룹주식회사 | 영상 재생 장치, 재생 방법 및 프로그램 |

| US11221683B2 (en) * | 2019-05-09 | 2022-01-11 | Dell Products, L.P. | Graphical user interface (GUI) manipulation using hand gestures over a hovering keyboard |

| US11151770B2 (en) | 2019-09-23 | 2021-10-19 | Facebook Technologies, Llc | Rendering images using declarative graphics server |

Family Cites Families (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP1098498A1 (fr) * | 1999-11-04 | 2001-05-09 | Koninklijke Philips Electronics N.V. | Appareil comportant un écran pour des images stéréoscopiques |

| JP2004199142A (ja) * | 2002-12-16 | 2004-07-15 | Matsushita Electric Ind Co Ltd | 携帯端末機器及び画像表示方法 |

| KR101602363B1 (ko) * | 2008-09-11 | 2016-03-10 | 엘지전자 주식회사 | 3차원 사용자 인터페이스의 제어방법과 이를 이용한 이동 단말기 |

| JP4819114B2 (ja) * | 2008-12-08 | 2011-11-24 | シャープ株式会社 | 立体画像表示装置 |

| JP5263049B2 (ja) | 2009-07-21 | 2013-08-14 | ソニー株式会社 | 情報処理装置、および情報処理方法、並びにプログラム |

| KR101657168B1 (ko) * | 2009-12-01 | 2016-09-19 | 삼성전자주식회사 | 사용자 위치 기반의 디스플레이 방법 및 장치 |

| KR101726790B1 (ko) * | 2010-07-16 | 2017-04-26 | 엘지전자 주식회사 | 이동 단말기 및 이동 단말기의 제어 방법 |

-

2011

- 2011-03-31 JP JP2011077985A patent/JP2012212340A/ja not_active Abandoned

-

2012

- 2012-02-17 US US14/006,870 patent/US9182827B2/en not_active Expired - Fee Related

- 2012-02-17 WO PCT/JP2012/001076 patent/WO2012132201A1/en active Application Filing

- 2012-02-17 CN CN201280016794XA patent/CN103477313A/zh active Pending

Cited By (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE102013110341A1 (de) | 2012-09-26 | 2014-03-27 | Denso Corporation | Drahtlose Leistungsübertragungsvorrichtung und Direktantriebssystem mit der Vorrichtung |

| DE102013110341B4 (de) | 2012-09-26 | 2021-10-21 | Denso Corporation | Drahtlose Leistungsübertragungsvorrichtung und Direktantriebssystem mit der Vorrichtung |

| JP2014098778A (ja) * | 2012-11-14 | 2014-05-29 | Casio Comput Co Ltd | 画像処理装置、投影装置、画像選択方法及びプログラム |

| WO2014175455A1 (ja) * | 2013-04-26 | 2014-10-30 | 京セラ株式会社 | 電子機器 |

| JP2020135291A (ja) * | 2019-02-18 | 2020-08-31 | キヤノン株式会社 | 情報処理装置、情報処理方法及びプログラム |

| JP7282541B2 (ja) | 2019-02-18 | 2023-05-29 | キヤノン株式会社 | 情報処理装置、情報処理方法及びプログラム |

| JP2020177482A (ja) * | 2019-04-19 | 2020-10-29 | キヤノンメディカルシステムズ株式会社 | 医用情報処理装置及び医用情報処理方法 |

| JP7346066B2 (ja) | 2019-04-19 | 2023-09-19 | キヤノンメディカルシステムズ株式会社 | 医用情報処理装置及び医用情報処理方法 |

| WO2022209258A1 (ja) * | 2021-03-29 | 2022-10-06 | ソニーグループ株式会社 | 情報処理装置、情報処理方法及び記録媒体 |

Also Published As

| Publication number | Publication date |

|---|---|

| CN103477313A (zh) | 2013-12-25 |

| US9182827B2 (en) | 2015-11-10 |

| US20140055348A1 (en) | 2014-02-27 |

| WO2012132201A1 (en) | 2012-10-04 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2012212340A (ja) | 情報処理装置、画像表示装置、および情報処理方法 | |

| US9766793B2 (en) | Information processing device, information processing method and program | |

| EP2240843B1 (en) | Method and apparatus for two-handed computer user interface with gesture recognition | |

| US9215439B2 (en) | Apparatus and method for arranging emails in depth positions for display | |

| JP6123365B2 (ja) | 画像表示システム及び頭部装着型表示装置 | |

| US8316319B1 (en) | Efficient selection of characters and commands based on movement-inputs at a user-inerface | |

| JP6569496B2 (ja) | 入力装置、入力方法、及びプログラム | |

| US11284061B2 (en) | User input device camera | |

| US20180150997A1 (en) | Interaction between a touch-sensitive device and a mixed-reality device | |

| WO2012082971A1 (en) | Systems and methods for a gaze and gesture interface | |

| US20130169594A1 (en) | Apparatus and method for controlling 3d image | |

| US9432652B2 (en) | Information processing apparatus, stereoscopic display method, and program | |

| TW201342135A (zh) | 行動裝置的全三維互動 | |

| US20180114349A1 (en) | Augmented reality system and method | |

| CN106462222B (zh) | 透明白板显示器 | |

| JP6176013B2 (ja) | 座標入力装置及び画像処理装置 | |

| US10754524B2 (en) | Resizing of images with respect to a single point of convergence or divergence during zooming operations in a user interface | |

| EP3054380B1 (en) | Document presentation method and user terminal | |

| WO2014061310A1 (ja) | 表示物制御システム、表示物制御方法及びプログラム | |

| JP7240858B2 (ja) | 対面式カウンター、及び、対面式コミュニケーション支援システム | |

| JP2012252386A (ja) | 表示装置 | |

| JP2012048656A (ja) | 画像処理装置、画像処理方法 | |

| CN104378621A (zh) | 立体场景处理方法及装置 | |

| Lubos et al. | The interactive spatial surface-blended interaction on a stereoscopic multi-touch surface | |

| KR20170095595A (ko) | 투명 디스플레이 장치 및 그것의 양면 디스플레이 방법 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20140314 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20140314 |

|

| A762 | Written abandonment of application |

Free format text: JAPANESE INTERMEDIATE CODE: A762 Effective date: 20150401 |