CN108831501B - 用于带宽扩展的高频编码/高频解码方法和设备 - Google Patents

用于带宽扩展的高频编码/高频解码方法和设备 Download PDFInfo

- Publication number

- CN108831501B CN108831501B CN201811081766.1A CN201811081766A CN108831501B CN 108831501 B CN108831501 B CN 108831501B CN 201811081766 A CN201811081766 A CN 201811081766A CN 108831501 B CN108831501 B CN 108831501B

- Authority

- CN

- China

- Prior art keywords

- signal

- unit

- encoding

- current frame

- excitation

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/04—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using predictive techniques

- G10L19/16—Vocoder architecture

- G10L19/18—Vocoders using multiple modes

- G10L19/20—Vocoders using multiple modes using sound class specific coding, hybrid encoders or object based coding

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/02—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using spectral analysis, e.g. transform vocoders or subband vocoders

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/04—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using predictive techniques

- G10L19/06—Determination or coding of the spectral characteristics, e.g. of the short-term prediction coefficients

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/008—Multichannel audio signal coding or decoding using interchannel correlation to reduce redundancy, e.g. joint-stereo, intensity-coding or matrixing

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/04—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using predictive techniques

- G10L19/16—Vocoder architecture

- G10L19/18—Vocoders using multiple modes

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L21/00—Processing of the speech or voice signal to produce another audible or non-audible signal, e.g. visual or tactile, in order to modify its quality or its intelligibility

- G10L21/02—Speech enhancement, e.g. noise reduction or echo cancellation

- G10L21/038—Speech enhancement, e.g. noise reduction or echo cancellation using band spreading techniques

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L21/00—Processing of the speech or voice signal to produce another audible or non-audible signal, e.g. visual or tactile, in order to modify its quality or its intelligibility

- G10L21/02—Speech enhancement, e.g. noise reduction or echo cancellation

- G10L21/038—Speech enhancement, e.g. noise reduction or echo cancellation using band spreading techniques

- G10L21/0388—Details of processing therefor

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/04—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using predictive techniques

- G10L19/08—Determination or coding of the excitation function; Determination or coding of the long-term prediction parameters

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/04—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using predictive techniques

- G10L19/16—Vocoder architecture

- G10L19/18—Vocoders using multiple modes

- G10L19/22—Mode decision, i.e. based on audio signal content versus external parameters

Abstract

公开了一种用于带宽扩展的对高频进行编码和解码的方法和设备。所述方法包括:估计权值;通过在随机噪声和解码的低频频谱之间应用所述权值来产生高频激励信号。

Description

本申请是向中国知识产权局提交的申请日为2013年3月21日、标题为“用于带宽扩展的高频编码/高频解码方法和设备”且申请号为“201380026924.2”的申请的分案申请。

技术领域

示例性实施例涉及音频编码和音频解码,更具体地讲,涉及一种用于带宽扩展的对高频进行编码和解码的方法和设备。

背景技术

G.719中的编码方案被开发和标准化用于电话会议的目的,并通过执行修正离散余弦变换(MDCT)来执行频域变换,以针对稳态帧直接对MDCT频谱进行编码,并针对非稳态帧改变时域混叠顺序以便考虑时间特性。可通过执行交织以按照与稳态帧相同的框架构建编解码器,来以与稳态帧类似的形式构建针对非稳态帧获得的频谱。获得构建的频谱的能量并对所述能量归一化和量化。一般来说,能量被表示为均方根(RMS)值,通过基于能量的比特分配从归一化的频谱计算每个频带所需的比特的数量,并通过基于关于针对每个频带的比特分配的信息进行量化和无损编码来产生比特流。

根据G.719中的解码方案,作为编码方案的逆处理,通过对来自比特流的能量进行反量化,基于反量化的能量产生比特分配信息并对频谱进行反量化来产生归一化的反量化的频谱。当比特不足时,在特定频带中可能不存在反量化的频谱。为了产生针对特定频带的噪声,应用噪声填充方法,其中,该噪声填充方法通过基于反量化的低频频谱产生噪声码本来根据发送的噪声等级产生噪声。对于特定频率或更高频率的频带,应用通过折叠低频信号来产生高频信号的带宽扩展方案。

发明内容

技术问题

示例性实施例提供一种可提高重构的信号的质量的用于带宽扩展的对高频进行编码和解码的方法和设备、以及采用所述方法和设备的多媒体装置。

解决方案

根据示例性实施例的一方面,提供了一种用于带宽扩展的对高频进行编码的方法,所述方法包括:针对每个帧产生激励类型信息,其中,激励类型信息用于在解码端估计应用于产生高频激励信号的权值;并针对每个帧产生包括激励类型信息的比特流。

根据示例性实施例的一方面,提供了一种用于带宽扩展的对高频进行解码的方法,所述方法包括:估计权值;通过在随机噪声和解码的低频频谱之间应用所述权值来产生高频激励信号。

有益效果

根据示例性实施例,在不增加任何复杂度的情况下,重构的信号的质量可被提高。

附图说明

图1示出根据示例性实施例的低频信号的频带和被构建的高频信号的频带;

图2a至图2c示出根据示例性实施例的根据选择的编码方案分别将区域R0分类为R4和R5,将区域R1分类为R2和R3;

图3是根据示例性实施例的音频编码设备的框图;

图4是示出根据示例性实施例的在BWE区域R1中确定R2和R3的方法的流程图;

图5是示出根据示例性实施例的确定BWE参数的方法的流程图;

图6是根据另一示例性实施例的音频编码设备的框图;

图7是根据示例性实施例的BWE参数编码单元的框图;

图8是根据示例性实施例的音频解码设备的框图;

图9是根据示例性实施例的激励信号产生单元的框图;

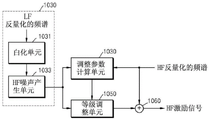

图10是根据另一示例性实施例的激励信号产生单元的框图;

图11是根据另一示例性实施例的激励信号产生单元的框图;

图12是用于描述在频带边缘对权值进行平滑的曲线图;

图13是用于描述根据示例性实施例的作为用于重构重叠区域中存在的频谱的贡献的权值的曲线图;

图14是根据示例性实施例的切换结构的音频编码设备的框图;

图15是根据另一示例性实施例的切换结构的音频编码设备的框图;

图16是根据示例性实施例的切换结构的音频解码设备的框图;

图17是根据另一示例性实施例的切换结构的音频解码设备的框图;

图18是根据示例性实施例的包括编码模块的多媒体装置的框图;

图19是根据示例性实施例的包括解码模块的多媒体装置的框图;

图20是根据示例性实施例的包括编码模块和解码模块的多媒体装置的框图。

具体实施方式

本发明构思可允许各种类型的改变或修改和各种形式上的改变,并且将在附图中示出特定示例性实施例并且在说明书中对其进行详细的描述。然而,应理解特定示例性实施例没有将本发明构思限制于特定公开形式而包括在本发明构思的精神和技术范围内的每个修改的、等同的或替代的形式。在以下描述中,由于公知的功能或构造在不必要的细节上使本发明不清楚,因此不详细描述公知的功能或构造。

虽然诸如“第一”和“第二”的术语可用于描述各种元件,但元件不被术语限制。术语可用于将特定元件与另一元件分类开。

在本申请中使用的术语仅用于描述特定示例性实施例,并不意图限制本发明构思。虽然在考虑本发明构思中的功能的同时尽可能地将当前广泛使用的通用术语选作在本发明构思中使用的术语,但它们可根据本领域普通技术人员的意图、先例或新技术的出现而改变。另外,在特定情况下,会使用由申请人有意地选择的术语,在这种情况下,将在本发明的相应描述中公开该术语的含义。因此,在本发明构思中使用的术语不应仅由术语的名称来限定而是由术语的含义和本发明构思的内容来限定。

除非在上下文中单数表达和复数表达明显彼此不同,否则单数表达包括复数表达。在本申请中,应理解诸如“包括”和“具有”的术语用于指示存在实施的特征、数量、步骤、操作、元件、部件或它们的组合,而不预先排除可能存在或添加一个或更多个其他特征、数量、步骤、操作、元件、部件或它们的组合。

现将参照附图详细描述本发明的示例性实施例。附图中的相同的标号表示相同的元件,因此将省略它们的重复的描述。

图1示出根据示例性实施例的低频信号的频带和被构建的高频信号的频带。根据示例性实施例,采样率是32KHz,可按照22个频带(详细地,针对低频信号的17个频带和针对高频信号的5个频带)形成640个离散余弦变换(MDCT)频谱系数。高频信号的起始频率是第241个频谱系数,第0个频谱系数至第240个频谱可被定为将按照低频编码方案被编码的区域R0。另外,第241个频谱系数至第639个频谱系数可被定义为执行了带宽扩展(BWE)的区域R1。在区域R1中,也可存在将按照低频编码方案被编码的频带。

图2a至图2c示出根据示例性实施例的根据选择的编码方案分别将区域R0分类为R4和R5,将区域R1分类为R2和R3。作为BWE区域的区域R1可被分类为R2和R3,作为低频编码区域的区域R0可被分类为区域R4和R5。R2指示包含将按照低频编码方案(例如,频域编码方案)被量化和无损编码的信号的频带,R3指示不存在将按照低频编码方案被编码的信号的频带。然而,即使定义了R2以便分配用于按照低频编码方案被编码的比特,也可由于缺少比特而以与频带R3相同的方式产生频带R2。R5指示按照低频编码方案使用分配的比特执行编码的频带,R4指示由于没有剩余比特而即使对低频信号也无法执行编码或者由于较少的分配比特而应添加噪声的频带。因此,可通过确定是否添加了噪声来识别R4和R5,其中,可按照低频编码频带中的频谱的数量的百分数来执行该确定,或者当使用阶乘脉冲编码(FPC)时可基于带内脉冲分配信息执行该确定。由于在解码处理中当噪声被添加到频带R4和频带R5时频带R4和频带R5可被识别,因此在编码处理中可不用清楚地标识频带R4和频带R5。频带R2至频带R5可具有彼此不同的将被编码的信息,不同的解码方案也可被应用于频带R2至频带R5。

在图2a中示出的图示中,低频编码区域R0中的包含第170个频谱系数至第240个频谱系数的两个频带是添加了噪声的R4,BWE区域R1中的包含第241个频谱系数至第350个频谱系数的两个频带和包含第427个频谱系数至第639个频谱系数的两个频带是将按照低频编码方案被编码的R2。在图2b中示出的图示中,低频编码区域R0中的包含第202个频谱系数至第240个频谱系数的一个频带是添加了噪声的R4,BWE区域R1中的包含第241个频谱系数至第639个频谱系数的全部五个频带是将按照低频编码方案被编码的R2。在图2c中示出的图示中,低频编码区域R0中的包含第144个频谱系数至第240个频谱系数的三个频带是添加了噪声的R4,并且在BWE区域R1中不存在R2。一般来说,低频编码区域R0中的R4可分布在高频频带中,BWE区域R1中的R2可不限于特定频带。

图3是根据示例性实施例的音频编码设备的框图。

图3中示出的音频编码设备可包括瞬态检测单元310、变换单元320、能量提取单元330、能量编码单元340、音调计算单元350、编码频带选择单元360、频谱编码单元370、BWE参数编码单元380和复用单元390。可将这些组件集成到至少一个模块中并通过至少一个处理器(未示出)来实现。在图3中,输入信号可指示音乐、语音或音乐和语音的混合信号,并可主要地被划分为语音信号和另一普通信号。以下,为了便于描述,输入信号被称为音频信号。

参照图3,瞬态检测单元310可检测在时域的音频信号中是否存在瞬态信号或尖锐上升(attack)信号。为此,可应用各种公知的方法,例如,可使用时域的音频信号中的能量改变。如果从当前帧检测到瞬态信号或尖锐上升信号,则可将当前帧定义为瞬态帧,如果从当前帧没有检测到瞬态信号或尖锐上升信号,则可将当前帧定义为非瞬态帧(例如,稳态帧)。

变换单元320可基于瞬态检测单元310的检测结果将时域的音频信号变换为频域的频谱。可将MDCT应用为变换方案的示例,但示例性实施例不限于此。另外,可以以与G.719中的方式相同的方式执行对瞬态帧和稳态帧的变换处理和交织处理,但示例性实施例不限于此。

能量提取单元330可提取从变换单元320提供的频域的频谱的能量。可以以频带为单位形成频域的频谱,频带的长度可以是均匀的或非均匀的。能量可指示每个频带的平均能量、平均功率、包络或范数。可将针对每个频带提取的能量提供给能量编码单元340和频谱编码单元370。

能量编码单元340可对从能量提取单元330提供的每个频带的能量进行量化和无损编码。可使用各种方案(诸如,均匀标量量化器、非均匀标量量化器、矢量量化器等)来执行能量量化。可使用各种方案(诸如,算术编码、霍夫曼编码等)执行能量无损编码。

音调计算单元350可计算从变换单元320提供的频域的频谱的音调。通过计算每个频带的音调,可确定当前频带是否具有类似音调的特性或类似噪声的特性。可基于频谱平坦度测量(spectral flatness measurement,SFM)计算音调,或者如等式1可通过峰值与平均振幅的比来定义音调。

等式1

在等式1中,T(b)表示频带b的音调,N表示频带b的长度,S(k)表示频带b中的频谱系数。T(b)可通过被改变为dB值来被使用。

可通过先前帧中的对应频带的音调与当前帧中的对应频带的音调的加权和来计算音调。在这种情况下,频带b的音调T(b)可通过等式2来定义。

等式2

T(b)=aO*F(b,n-1)+(l-a0)*T(b,n) (2)

在等式2中,T(b,n)表示帧n中的频带b的音调,a0表示权值,并且可通过实验或仿真预先将a0设置为最优值。

可针对构成高频信号的频带(例如,图1中的区域R1中的频带)计算音调。然而,根据情况,也可针对构成低频信号的频带(例如,图1中的区域R0中的频带)计算音调。当频带中的频谱长度过长时,由于在计算音调时会出现差错,因此,可通过划分频带来计算音调,并可将计算出的音调的均值或最大值设置为表示频带的音调。

编码频带选择单元360可基于每个频带的音调选择编码频带。根据示例性实施例,可针对图1中的BWE区域R1确定R2和R3。另外,可通过考虑可允许的比特来确定图1中的低频编码区域R0中的R4和R5。

详细地,现将描述在低频编码区域R0中选择编码频带的处理。

可按照频域编码方案通过将比特分配给R5来对R5进行编码。根据示例性实施例,对于按照频域编码方案进行的编码,可应用FPC方案,其中,按照FPC方案,基于根据关于每个频带的比特分配信息分配的比特对脉冲进行编码。能量可用于比特分配信息,大量的比特可被设计为被分配给具有高能量的频带而少量的比特被分配给具有低能量的频带。根据目标比特率对可允许的比特进行限制,由于在受限的条件下分配比特,因此当目标比特率低时,R4和R5之间的频带区分会更有意义。然而,对于瞬态帧,可以以与用于稳态帧的方法不同的方法分配比特。根据示例性实施例,对于瞬态帧,可将比特设置为非强制性地分配给高频信号的频带。也就是说,通过不将比特分配给瞬态帧中的特定频率之后的频带来良好地表达低频信号,可在低目标比特率下提高声音质量。可不将比特分配给稳态帧中的特定频率之后的频带。另外,可将比特分配给稳态帧中的高频信号的频带之中的具有超过预定阈值的能量的频带。基于能量和频率信息执行比特分配,由于在编码单元和解码单元中应用相同的方案,因此不必将附加信息包括在比特流中。根据示例性实施例,可通过使用被量化并随后被反量化的能量来执行比特分配。

图4是示出根据示例性实施例的在BWE区域R1中确定R2和R3的方法的流程图。在参照图4描述的方法中,R2指示包含按照频域编码方案编码的信号的频带,R3指示不包含按照频域编码方案编码的信号的频带。当在BWE区域R1中选择与R2对应的所有频带时,残余频带与R3对应。由于R2指示具有类似音调的特性的频带,因此R2具有大的音调值。相反,与音调不同,R2具有小的噪度(noiseness)值。

参照图4,在操作410,针对每个频带b计算音调T(b),并在操作420,将计算出的音调T(b)与预定阈值Tth0进行比较。

在操作430,将计算出的音调T(b)大于预定阈值Tth0(作为在操作420的比较结果)的频带b分配为R2,并将f_flag(b)设置为1。

在操作440,将计算出的音调T(b)不大于预定阈值Tth0(作为在操作420的比较结果)的频带b分配为R3,并将f_flag(b)设置为0。

可将针对包含在BWE区域R1中的每个频带b设置的f_flag(b)定义为编码频带选择信息,并将f_flag(b)包括在比特流中。可不将编码频带选择信息包括在比特流中。

返回参照图3,频谱编码单元370可基于由编码频带选择单元360产生的编码频带选择信息,对低频信号的频带的频谱系数和f_flag(b)被设置为1的频带的频谱系数进行频域编码。频域编码可包括量化和无损编码,根据示例性实施例,可使用FPC方案。FPC方案将编码的频谱系数的位置、大小和符号信息表示为脉冲。

频谱编码单元370可基于从能量提取单元330提供的每个频带的能量产生比特分配信息,基于分配给每个频带的比特计算用于FPC的脉冲的数量,并对脉冲的数量进行编码。此时,当由于缺少比特而不对低频信号的一些频带进行编码或使用太过少量的比特对低频信号的一些频带进行编码时,可能存在需要在解码端添加噪声的频带。可将低频信号的这些频带定义为R4。对于使用足够数量的比特执行编码的频带,在解码端不必添加噪声,可将低频信号的这些频带定义为R5。由于在编码端在低频信号的R4和R5之间进行区分是没有意义的,因此,不必产生单独的编码频带选择信息。可基于所有比特之中的分配给每个频带的比特来仅计算脉冲的数量,并可对脉冲的数量进行编码。

BWE参数编码单元380可通过包括信息If_att_flag来产生高频带宽扩展所需的BWE参数,其中,信息If_att_flag指示低频信号的频带中的频带R4是需要添加噪声的频带。可通过适当地对低频信号和随机噪声进行加权来在解码端产生高频带宽扩展所需的BWE参数。根据另一示例性实施例,可通过适当地对通过白化低频信号而获得的信号与随机噪声进行加权来产生高频带宽扩展所需的BWE参数。

BWE参数可包括信息all_noise和信息all_If,其中,信息all_noise指示应添加更多的随机噪声以用于产生当前帧的整个高频信号,信息all_If指示应更多地增强低频信号。对于每个帧可发送一次信息If_att_flag、信息all_noise和信息all_If,并可将一个比特分配给信息If_att_flag、信息all_noise和信息all_If中的每个并进行发送。根据情况,可针对每个频带将信息If_att_flag、信息all_noise和信息all_If进行分离并发送信息If_att_flag、信息all_noise和信息all_If。

图5是示出根据示例性实施例的确定BWE参数的方法的流程图。在图5中,可将图2的图示中的包含第241个频谱系数至第290个频谱系数的频带和包含第521个频谱系数至第639个频谱系数的频带(即,BWE区域R1中的第一个频带和最后一个频带)分别定义为Pb和Eb。

参照图5,在操作510,计算BWE区域R1中的平均音调Ta0,并在操作520,将平均音调Ta0与阈值Tth1进行比较。

在操作525,如果作为在操作520的比较结果,平均音调Ta0小于阈值Tth1,则将all_noise设置为1,并且将all_If和If_att_flag两者设置为0并不发送all_If和If_att_flag。

在操作530,如果作为在操作520的比较结果,平均音调Ta0大于或等于阈值Tth1,则将all_noise设置为0,并且如下所述地设置all_If和If_att_flag并发送all_If和If_att_flag。

在操作540,将平均音调Ta0与阈值Tth2进行比较。阈值Tth2优选地小于阈值Tth1。

在操作545,如果作为在操作540的比较的结果,平均音调Ta0大于阈值Tth2,则将all_If设置为1,并将If_att_flag设置为0并不发送If_att_flag。

在操作550,如果作为在操作540的比较的结果,平均音调Ta0小于或等于阈值Tth2,则将all_If设置为0,并且如下所述地设置If_att_flag并发送If_att_flag。

在操作560,计算在Pb之前的频带的平均音调Ta1。根据示例性实施例,可考虑一个或五个先前频带。

在操作570,不论先前帧如何,将平均音调Ta1与阈值Tth3进行比较,或者在考虑先前帧的If_att_flag(即,p_If_att_flag)时,将平均音调Ta1与阈值Tth4进行比较。

在操作580,如果作为在操作570的比较结果,平均音调Ta1大于阈值Tth3,则将If_att_flag设置为1。在操作590,如果作为在操作570的比较结果,平均音调Ta1小于或等于阈值Tth3,则将If_att_flag设置为0。

当p_If_att_flag被设置为1时,如果平均音调Ta1大于阈值Tth4,则在操作580将If_att_flag设置为1。此时,如果先前帧是瞬态帧,则p_if_att_flag被设置为0。当将p_if_att_flag设置为1时,如果平均音调Ta1小于或等于阈值Tth4,则在操作590将If_att_flag设置为0。阈值Tth3优选地大于阈值Tth4。

当在高频信号的频带中存在flag(b)被设置为1的至少一个频带时,因为被设置为1的flag(b)指示在高频信号中存在具有类似音调的特性的频带因此all_noise不能被设置为1,从而将all_noise设置为0。在这种情况下,将all_noise作为0被发送,并通过执行操作540至操作590来产生关于all_If和If_att_flag的信息。

下面的表1示出通过图5的方法产生的BWE参数的发送关系。在表1中,每个数字指示发送对应BWE参数所需的比特的数量,X指示不发送对应BWE参数。BWE参数(即,all_noise、all_If和If_att_flag)可与作为由编码频带选择单元360产生的编码频带选择信息的f_flag(b)具有相关性。例如,当如表1中所示all_noise被设置为1时,f_flag、all_If和If_att_flag不必被发送。当all_noise被设置为0时,f_flag(b)应被发送,与BWE区域R1中的频带的数量对应的信息应被发送。

当all_If被设置为0时,If_att_flag被设置为0并不被发送。当all_If被设置为1时,If_att_flag需要被发送。发送可依赖于上述相关性,为了简化编解码器的结构,在没有依赖的相关性的情况下也可进行发送。作为结果,频谱编码单元370通过使用通过从所有可允许的比特之中排除将被用于BWE参数和编码频带选择信息的比特而剩余的残余比特,来针对每个频带执行比特分配和编码。

表1

返回参照图3,复用单元390可产生包括以下项的比特流并可将比特流存储在预定存储介质中或将比特流发送到解码端:从能量编码单元340提供的每个频带的能量,从编码频带选择单元360提供的BWE区域R1的编码频带选择信息、从频谱编码单元370提供的低频编码区域R0和BWE区域R1中的频带R2的频域编码结果、以及从BWE参数编码单元380提供的BWE参数。

图6是根据另一示例性实施例的音频编码设备的框图。基本上,图6的音频编码设备可包括用于针对每个频带产生激励类型信息的元件以及用于产生包括针对每个频带的激励类型信息的比特流的元件,其中,所述激励类型信息用于在解码端估计应用于产生高频激励信号的权值。可将一些元件选择性地包括在音频编码设备中。

图6中示出的音频编码设备可包括瞬态检测单元610、变换单元620、能量提取单元630、能量编码单元640、频谱编码单元650、音调计算单元660、BWE参数编码单元670和复用单元680。这些组件可被集成到至少一个模块中,并通过至少一个处理器(未示出)来实现。在图6中,不重复对与图3的音频编码设备中的组件相同的组件的描述。

参照图6,频谱编码单元650可针对从变换单元620提供的低频信号的频带执行频谱系数的频域编码。其他操作与频谱编码单元370的操作相同。

音调计算单元660可以以帧为单位计算BWE区域R1的音调。

BWE参数编码单元670可通过使用从音调计算单元660提供的BWE区域R1的音调产生BWE激励类型信息或激励分类信息并对BWE激励类型信息或激励分类信息进行编码。根据示例性实施例,可通过首先考虑输入信号的模式信息来确定BWE激励类型信息。可针对每个帧发送BWE激励类型信息。例如,当使用两个比特形成BWE激励类型信息时,BWE激励类型信息可具有值0、1、2或3。BWE激励类型信息可以以如下方式被分配:随着BWE激励类型信息接近0,将被添加到随机噪声的权值增大,并随着BWE激励类型信息接近3,将被添加到随机噪声的权值减小。根据示例性实施例,随着音调上升,可将BWE激励类型信息设置为接近于3的值,随着音调下降,可将BWE激励类型信息设置为接近于0的值。

图7是根据示例性实施例的BWE参数编码单元的框图。图7中示出的BWE参数编码单元可包括信号分类单元710和激励类型确定单元730。

频域的BWE方案可通过与时域编码部分结合来应用。码激励线性预测(CELP)方案可主要用于时域编码,BWE参数编码单元可被实现为按照CELP方案对低频频带进行编码并与和频域的BWE方案不同的时域的BWE方案结合。在这种情况下,可基于在时域编码和频域编码之间的自适应编码方案确定来将编码方案选择性地应用于整个编码。为了选择适当的编码方案,需要信号分类,根据示例性实施例,可通过额外使用信号分类的结果来将权值分配给每个频带。

参照图7,信号分类单元710可以通过以帧为单位分析输入信号的特性来对当前帧是否为语音信号进行分类,并响应于分类的结果确定BWE激励类型。可使用各种公知方法(例如,短期特性和/或长期特性)来处理信号分类。当当前帧主要被分类为语音信号(对于语音信号,时域编码是适当的编码方案)时,与基于高频信号的特性的方法相比,添加固定类型的权值的方法可能对于提高声音质量更加有益。以下将描述的通常用于图14和图15中的切换结构的音频编码设备的信号分类单元1410和1510可通过将多个先前帧的结果和当前帧的结果结合来对当前帧的信号进行分类。因此,尽管最终应用频域编码,但当通过仅将当前帧的信号分类结果用作中间结果,输出对于当前帧时域编码是适当的编码方案时,可设置固定的权值以执行编码。例如,如上所述,当当前帧被分类为适合于时域编码的语音信号时,可将BWE激励类型设置为例如2。

当作为信号分类单元710的分类结果,当前帧没有被分类为语音信号时,可使用多个阈值来确定BWE激励类型。

激励类型确定单元730可通过使用三个设置的阈值划分为四个平均音调区域,来产生未被分类为语音信号的当前帧的四个BWE激励类型。示例性实施例不限于四个BWE激励类型,根据情况可使用三个或两个BWE激励类型,其中,还可根据BWE激励类型的数量调整将被使用的阈值的数量和值。可根据BWE激励类型信息分配用于每个帧的权值。根据另一示例性实施例,当可将更多的比特分配给用于每个帧的权值时,可提取和发送每个频带的权值信息。

图8是根据示例性实施例的音频解码设备的框图。

图8的音频解码设备可包括用于估计权值的元件以及用于通过在随机噪声和解码的低频频谱之间应用权值来产生高频激励信号的元件。可将一些元件选择性地包括在音频解码设备中。

图8中示出的音频解码设备可包括解复用单元810、能量解码单元820、BWE参数解码单元830、频谱解码单元840、第一逆归一化单元850、噪声添加单元860、激励信号产生单元870、第二逆归一化单元880、逆变换单元890。这些组件可被集成到至少一个模块中并通过至少一个处理器(未示出)来实现。

参照图8,解复用单元810可通过对比特流进行解析来提取用于每个频带的编码的能量、低频编码区域R0和BWE区域R1中的频带R2的频域编码结果以及BWE参数。此时,根据编码频带选择信息和BWE参数之间的相关性,可由解复用单元810或BWE参数解码单元830对编码频带选择信息进行解析。

能量解码单元820可通过对从解复用单元810提供的用于每个频带的编码的能量进行解码,来产生用于每个频带的反量化的能量。可将用于每个频带的反量化的能量提供给第一逆归一化单元850和第二逆归一化单元880。另外,与编码端类似,可将用于每个频带的反量化的能量提供给频谱解码单元840以用于比特分配。

BWE参数解码单元830可对从解复用单元810提供的BWE参数进行解码。此时,当作为编码频带选择信息的f_flag(b)与BWE参数(例如,all_noise)具有相关性时,BWE参数解码单元830可对编码频带选择信息连同BWE参数进行解码。根据示例性实施例,当如表1中所示,信息all_noise、信息f_flag、信息all_If和信息If_att_flag具有相关性时,可依次执行解码。相关性可以以另一方式被改变,在被改变的情况下,可按照适合于被改变的情况的方案依次执行解码。作为表1的示例,首先对all_noise进行解析以检查all_noise是1还是0。如果all_noise是1,则将信息f_flag、信息all_If和信息If_att_flag设置为0。如果all_noise是0,则将信息f_flag解析为多达BWE区域R1中的频带的数量,随后对信息all_If进行解析。如果all_If是0,则将If_att_flag设置为0,如果all_If是1,则对If_att_flag进行解析。

当作为编码频带信息的f_flag(b)与BWE参数不具有相关性时,编码频带选择信息可被解复用单元810解析为比特流,并与低频编码区域R0和BWE区域R1中的频带R2的频域编码结果一起被提供给频谱解码单元840。

频谱解码单元840可对低频编码区域R0的频域编码结果进行解码,并可根据编码频带选择信息对BWE区域R1中的频带R2的频域编码结果进行解码。为此,频谱解码单元840可使用从能量解码单元820提供的用于每个频带的反量化的能量,并通过使用通过从所有可允许的比特之中排除用于解析的BWE参数和编码频带选择信息的比特而剩余的残余比特,来将比特分配给每个频带。对于频谱解码,可执行无损解码和反量化,并且根据示例性实施例,可使用FPC。也就是说,可通过使用与在编码端进行频谱编码所使用的方案相同的方案,执行频谱解码。

BWE区域R1中的由于f_flag(b)被设置为1而被分配了比特并因此被分配了实际脉冲的频带被分类为频带R2,BWE区域R1中的由于f_flag(b)被设置为0而未被分配比特的频带被分类为R3。然而,在BWE区域R1中可能存在这样的频带:即使由于f_flag(b)被设置为1而应针对该频带执行频谱解码,但由于无法将比特分配给该频带,所以按照FPC方案编码的脉冲的数量为0。即使被设置为执行频域编码的频带R2也无法执行编码的频带可被分类为频带R3而不是频带R2,并以与f_flag(b)被设置为0的情况相同的方式被处理。

第一逆归一化单元850可通过使用从能量解码单元820提供的每个频带的反量化的能量对从频谱解码单元840提供的频域编码结果进行逆归一化。逆归一化可与将解码的频谱能量与每个频带的能量进行匹配的处理对应。根据示例性实施例,可对低频编码区域R0和BWE区域R1中的频带R2执行逆归一化。

噪声添加单元860可检查低频编码区域R0中的解码的频谱的每个频带,并将频带分离为频带R4和R5之一。此时,可不将噪声添加到被分离为R5的频带,可将噪声添加到被分离为R4的频带。根据示例性实施例,可基于频带中存在的脉冲的密度确定在添加噪声时将使用的噪声等级。也就是说,可基于编码的脉冲能量确定噪声等级,可使用该噪声等级产生随机能量。根据另一示例性实施例,可从编码端发送噪声等级。可基于信息If_att_flag调整噪声等级。根据示例性实施例,如果如下所述地满足预定条件,则可按照Att_factor更新噪声等级NI。

其中,ni_gain表示将应用于最终噪声的增益,ni_coef表示随机种子,Att_factor表示调整常数。

激励信号产生单元870可根据关于BWE区域R1中的每个频带的编码频带选择信息,通过使用从噪声添加单元860提供的解码的低频频谱来产生高频激励信号。

第二逆归一化单元880可通过使用从能量解码单元820提供的每个频带的反量化的能量对从激励信号产生单元870提供的高频激励信号进行逆归一化,以产生高频频谱。逆归一化可与将BWE区域R1中的能量与每个频带的能量进行匹配的处理对应。

逆变换单元890可通过对从第二逆归一化单元880提供的高频频谱进行逆变换来产生时域的解码信号。

图9是根据示例性实施例的激励信号产生单元的框图,其中,激励信号产生单元可产生用于BWE区域R1中的频带R3(即,未被分配比特的频带)的激励信号。

图9中示出的激励信号产生单元可包括权值分配单元910、噪声信号产生单元930和计算单元950。这些组件可被集成到至少一个模块中,并通过至少一个处理器(未示出)来实现。

参照图9,权值分配单元910可将对每个频带分配权值。权值指示基于解码的低频信号和随机噪声产生的高频(HF)噪声信号与所述随机噪声的混合比例。详细地,可通过等式3来表示HF激励信号He(f,k)。

等式3

He(f,k)=(1-Ws(f,k))*Hn(f,k)+Ws(f,k)*Rn(f,k) (3)

在等式3中,Ws(f,k)表示权值,f表示频率索引,k表示频带索引,Hn表示HF噪声信号,Rn表示随机噪声。

尽管权值Ws(f,k)在一个频带中具有相同的值,但权值Ws(f,k)可被处理为根据频带边界处的邻近频带的权值而被平滑。

权值分配单元910可通过使用BWE参数和编码频带选择信息(例如,信息all_noise、信息all_If、信息If_att_flag和信息f_flag)对每个频带分配权值。详细地,当all_noise=1时,将权值分配为Ws(k)=w0(对于所有k)。当all_noise=0时,对于频带R2将权值分配为Ws(k)=w4。另外,对于频带R3,当all_noise=0,all_If=1并且If_att_flag=1时,将权值分配为Ws(k)=w3,当all_noise=0,all_If=1并且If_att_flag=0时,将权值分配为Ws(k)=w2,并且在其他情况下,将权值分配为Ws(k)=w1。根据示例性实施例,可分配为w0=1,w1=0.65,w2=0.55,w3=0.4,w4=0。可优选地设置为从w0到w4逐渐减小。

权值分配单元910可通过考虑邻近频带的权值Ws(k-1)和Ws(k+1)来对分配给每个频带的权值Ws(k)进行平滑。作为平滑的结果,频带k的权值Ws(f,k)可根据频率f而具有不同的值。

图12是用于描述对频带边界处的权值进行平滑的曲线图。参照图12,由于第(K+2)个频带的权值和第(K+1)个频带的权值彼此不同,所以在频带边界处平滑是必要的。在图12的示例中,因为第(K+1)个频带的权值Ws(K+1)是0,所以不对第(K+1)个频带执行平滑并且仅对第(K+2)个频带执行平滑,当对第(K+1)个频带执行平滑时,第(K+1)个频带的权值Ws(K+1)不是零,并且在这种情况下,也应考虑第(K+1)个频带中的随机噪声。也就是说,权值0指示在HF激励信号被产生时不考虑对应频带中的随机噪声。权值0与极端音调信号对应,并且不考虑随机噪声,以防止由于随机噪声而由插入到谐波信号的波谷时间段的噪声产生噪声声音。

由权值分配单元910确定的权值Ws(f,k)可被提供给计算单元950并可被应用于HF噪声信号Hn和随机噪声Rn。

噪声信号产生单元930可产生HF噪声信号,并可包括白化单元931和HF噪声产生单元933。

白化单元931可对反量化的低频频谱执行白化。各种公知的方法可应用于白化。例如,可使用这样的方法:将反量化的低频频谱划分为多个均匀的块,获得用于每个块的频谱系数的绝对值的平均值并将每个块中的频谱系数除以该平均值。

HF噪声产生单元933可通过将从白化单元931提供的低频频谱复制到高频频带(即,BWE区域R1)来产生HF噪声信号,并将等级匹配为随机噪声。到高频频带的复制处理可通过在编码端和解码端的预设规则下进行修改(patching)、折叠或复制来执行,并可根据比特率而可变地应用。等级匹配指示将随机噪声的平均值与通过针对BWE区域R1中的所有频带将经白化处理的信号复制到高频频带而获得的信号的平均值进行匹配。根据示例性实施例,因为由于随机噪声是随机信号因此可认为随机噪声具有平坦特性,所以通过将经白化处理的信号复制到高频频带而获得的信号的平均值可被设置为稍大于随机噪声的平均值,并且由于尽管幅度的平均值被匹配,但低频(LF)信号可具有相对宽的动态范围,因此可产生小的能量。

计算单元950可通过将权值应用于随机噪声和HF噪声信号来产生用于每个频带的HF激励信号。计算单元950可包括第一乘法器951和第二乘法器953以及加法器955。可以以各种公知的方法(例如,使用随机种子)来产生随机噪声。

第一乘法器951将随机噪声乘以第一权值Ws(k),第二乘法器953将HF噪声信号乘以第二权值1-Ws(k),并且加法器将第一乘法器951的相乘结果和第二乘法器953的相乘结果相加以产生用于每个频带的HF激励信号。

图10是根据另一示例性实施例的激励信号产生单元的框图,其中,激励信号产生单元可产生用于BWE区域R1中的频带R2(即,分配有比特的频带)的激励信号。

图10中示出的激励信号产生单元可包括调整参数计算单元1010、噪声信号产生单元1030、等级调整单元1050和计算单元1060。这些组件可被集成到至少一个模块中,并通过至少一个处理器(未示出)来实现。

参照图10,由于频带R2具有按照FPC编码的脉冲,因此还可将等级调整添加到使用权值的HF激励信号的产生。随机噪声没有被添加到已执行了频域编码的频带R2。图10示出权值Ws(k)为0的情况,并且当权值Ws(k)不是零时,以与在图9的噪声信号产生单元930中的方式相同的方式产生HF噪声信号,并将产生的HF噪声信号映射为图10的噪声信号产生单元1030的输出。也就是说,图10的噪声信号产生单元1030的输出与图9的噪声信号产生单元930的输出相同。

调整参数计算单元1010计算将用于等级调整的参数。当将频带R2的反量化的FPC信号定义为C(k)时,从C(k)选择绝对值的最大值,将选择的值定义为Ap,并将作为FPC的结果的非零值的位置定义为CPs。在除CPs以外的位置处获得信号N(k)(噪声信号产生单元1030的输出)的能量,并将信号N(k)的能量定义为En。可基于En、Ap和用于在编码时设置f_flag(b)的Tth0使用等式4获得调整参数γ。

等式4

在等式4中,Att_factor表示调整常数。

计算单元1060可通过将调整参数γ乘以从噪声信号产生单元1030提供的噪声信号N(k)来产生HF激励信号。

图11是根据另一示例性实施例的激励信号产生单元的框图,其中,激励信号产生单元可产生用于BWE区域R1中的所有频带的激励信号。

图11中示出的激励信号产生单元可包括权值分配单元1110、噪声信号产生单元1130和计算单元1150。这些组件可被集成到至少一个模块中,并通过至少一个处理器(未示出)来实现。由于噪声信号产生单元1130和计算单元1150与图9的噪声信号产生单元930和计算单元950相同,因此不重复其描述。

参照图11,权值分配单元1110可将针对每个帧分配权值。权值指示基于解码的LF信号和随机噪声产生的HF噪声信号与该随机噪声的混合比例。

权值分配单元1110接收从比特流解析的BWE激励类型信息。权值分配单元1110在BWE激励类型是0时设置Ws(k)=w00(对于所有k),在BWE激励类型是1时设置Ws(k)=w01(对于所有k),在BWE激励类型是2时设置Ws(k)=w02(对于所有k),在BWE激励类型是3时设置Ws(k)=w03(对于所有k)。根据本发明的实施例,可分配为w00=0.8,w01=0.5,w02=0.25,和w03=0.05。可设置为从w00到w03逐渐减小。同样可针对被分配的权值执行平滑。

不论BWE激励类型信息如何,都可将预设的相同的权值应用于在BWE区域R1中的在特定频率之后的频带。根据示例性实施例,可总是将相同的权值用于BWE区域R1中的在特定频率之后的包括最后一个频带的多个频带,并基于BWE激励类型信息针对在特定频率之前的频带产生权值。例如,针对12KHz或12KHz以上的频率所属的频带,w02可被分配给所有Ws(k)的值。作为结果,由于在编码端获得了用于确定BWE激励类型的音调平均值的频带的区域即使在BWE区域R1中也可限于特定频率或更低的频率,所以计算的复杂度可被减小。根据示例性实施例,对于特定频率或更低的频率(即BWE区域R1中的低频部分),可通过音调的平均值确定激励类型,并也可将确定的激励类型应用于特定频率或更高的频率(即,BWE区域R1中的高频部分)。也就是说,由于以帧为单位仅发送一条激励分类信息,因此当用于估计激励分类信息的区域窄时,可增加了多达窄区域的精确度,从而提高恢复的声音质量。对于BWE区域R1中的高频频带,即使应用相同的激励分类,声音质量退化的可能性也会小。另外,当针对每个频带发送BWE激励类型信息时,用于指示BWE激励类型信息的比特可被减少。

当将除了低频的能量发送方案以外的例如矢量量化(VQ)方案的方案应用于高频的能量时,可在标量量化之后使用无损编码发送低频的能量,可按照另一方案在量化之后发送高频的能量。在这种情况下,低频编码区域R0中的最后的频带与BWE区域R1中的第一频带可彼此重叠。另外,可以以另一方案配置BWE区域R1中的频带以具有相对稠密的频带分配结构。

例如,可配置为低频编码区域R0中的最后的频带在8.2KHz处结束并且BWE区域R1中的第一频带从8KHz开始。在这种情况下,在低频编码区域R0和BWE区域R1之间存在重叠的区域。作为结果,在重叠区域中会产生两个解码的频谱。一个是通过应用针对低频的解码方案而产生的频谱,另一个是通过应用针对高频的解码方案而产生的频谱。可应用重叠并相加方案,从而两个频谱(即,低频的解码的频谱和高频的解码的频谱)之间的过渡更加平滑。也就是说,通过同时使用两个频谱来重新配置重叠区域,其中,对于接近重叠区域中的低频的频谱,按照低频方案产生的频谱的贡献被增加,对于接近重叠区域中的高频的频谱,按照高频方案产生的频谱的贡献被增加。

例如,当低频编码区域R0中的最后的频带在8.2KHz处结束并且BWE区域R1中的第一频带从8KHz开始时,如果以32KHz的采样率构建640个采样的频谱,则八个频谱(即,第320个频谱至第327个频谱)重叠,并且可使用等式5产生这八个频谱。

等式5

图13是用于描述根据示例性实施例的将用于在解码端在BWE处理之后产生重叠区域中存在的频谱的贡献的曲线图。

参照图13,可将wo0(k)和wo1(k)选择性地应用于wo(k),其中,wo0(k)指示将相同的权值应用于LF解码方案和HF解码方案,wo1(k)指示将更大权值应用于HF解码方案。用于wo(k)的选择标准是在低频的重叠频带中是否已选择使用FPC的脉冲。当低频的重叠频带中的脉冲已被选择和编码时,wo0(k)用于使用于在低频处产生的频谱的贡献有效直到L1的附近,并且高频的贡献被减小。基本上,与通过BWE产生的信号的频谱相比,按照实际编码方案产生的频谱可与原始信号具有更高的接近度。通过使用该方案,在重叠频带中,可应用用于增加更接近原始信号的频谱的贡献的方案,因此可预期平滑效果和声音质量的提高。

图14是根据示例性实施例的切换结构的音频编码设备的框图。

图14中示出的音频编码设备可包括信号分类单元1410、时域(TD)编码单元1420、TD扩展编码单元1430、频域(FD)编码单元1440和FD扩展编码单元1450。

信号分类单元1410可通过参考输入信号的特性来确定输入信号的编码模式。信号分类单元1410可通过考虑输入信号的TD特性和FD特性来确定输入信号的编码模式。另外,信号分类单元1410可确定在输入信号的特性与语音信号对应时执行输入信号的TD编码,在输入信号的特性与除了语音信号之外的音频信号对应时执行输入信号的FD编码。

输入到信号分类单元1410的输入信号可以是由下采样单元(未示出)下采样的信号。根据示例性实施例,输入信号可以是通过对采样率为32KHz或48KHz的信号进行重新采样而获得的采样率为12.8KHz或16KHz的信号。在这种情况下,采样率为32KHz的信号可以是可作为全频带(FB)信号的超宽带(SWB)信号。另外,采样率为16KHz的信号可以是宽带(WB)信号。

因此,信号分类单元1410可通过参考LF信号的特性,来将输入信号的LF区域中存在的LF信号的编码模式确定为TD模式和FD模式中的任意一个。

当输入信号的编码模式被确定为TD模式时,TD编码单元1420可对输入信号执行CELP编码。TD编码单元1420可从输入信号提取激励信号,并通过考虑与音高信息对应的自适应的码本贡献和固定的码本贡献来对提取的激励信号进行量化。

根据另一示例性实施例,TD编码单元1420还可包括从输入信号提取线性预测系数(LPC),对提取的LPC进行量化,并通过使用量化的LPC提取激励信号。

另外,TD编码单元1420可根据输入信号的特性以各种编码模式执行CELP编码。例如,TD编码单元1420可以以池音编码(voiced coding)模式、清音编码(unvoiced coding)模式、过渡模式和通用编码模式中的任何一个模式对输入信号执行CELP编码。

当对输入信号中的LF信号执行CELP编码时,TD扩展编码单元1430可对输入信号中的HF信号执行扩展编码。例如,TD扩展编码单元1430可对与输入信号的HF区域对应的HF信号的LPC进行量化。此时,TD扩展编码单元1430可提取输入信号中的HF信号的LPC,并对提取的LPC进行量化。根据示例性实施例,TD扩展编码单元1430可通过使用输入信号中的LF信号的激励信号来产生输入信号中的HF信号的LPC。

当输入信号的编码模式被确定为FD模式时,FD编码单元1440可对输入信号执行FD编码。为此,FD编码单元1440可通过使用MDCT等将输入信号变换为频域的频谱,并对变换后的频谱进行量化和无损编码。根据示例性实施例,可将FPC应用于此。

FD扩展编码单元1450可对输入信号中的HF信号执行扩展编码。根据示例性实施例,FD扩展编码单元1450可通过使用LF频谱执行FD扩展。

图15是根据另一示例性实施例的切换结构的音频编码设备的框图。

图15中示出的音频编码设备可包括信号分类单元1510、LPC编码单元1520、TD编码单元1530、TD扩展编码单元1540、音频编码单元1550和FD扩展编码单元1560。

参照图15,信号分类单元1510可通过参考输入信号的特性来确定输入信号的编码模式。信号分类单元1510可通过考虑输入信号的TD特性和FD特性来确定输入信号的编码模式。信号分类单元1510可确定在输入信号的特性与语音信号对应时执行输入信号的TD编码,在输入信号的特性与除了语音信号之外的音频信号对应时执行输入信号的音频编码。

LPC编码单元1520可从输入信号提取LPC并对提取的LPC进行量化。根据示例性实施例,LPC编码单元1520可通过使用网格编码量化(TCQ)方案、多级矢量量化(MSVQ)方案、格矢量量化(LVQ)方案等来对LPC进行量化,但不限于此。

详细地,LPC编码单元1520可从通过对采样率为32KHz或48KHz的输入信号进行重新采样而具有12.8KHz或16KHz的采样率的输入信号中的LF信号提取LPC。LPC编码单元1520还可包括通过使用量化的LPC提取LPC激励信号。

当输入信号的编码模式被确定为TD模式时,TD编码单元1530可对使用LPC提取的LPC激励信号执行CELP编码。例如,TD编码单元1530可通过考虑与音高信息对应的自适应的码本贡献和固定的码本贡献来对LPC激励信号进行量化。可通过LPC编码单元1520和TD编码单元1530中的至少一个来产生LPC激励信号。

当对输入信号中的LF信号的LPC激励信号执行CELP编码时,TD扩展编码单元1540可对输入信号中的HF信号执行扩展编码。例如,TD扩展编码单元1540可对输入信号中的HF信号的LPC进行量化。根据本发明的实施例,TD扩展编码单元1540可通过使用输入信号中的LF信号的LPC激励信号来提取输入信号中的HF信号的LPC。

当输入信号的编码模式被确定为音频模式时,音频编码单元1550可对使用LPC提取的LPC激励信号执行音频编码。例如,音频编码单元1550可将使用LPC提取的LPC激励信号变换为频域的LPC激励频谱,并对变换后的LPC激励频谱进行量化。按照FPC方案或LVQ方案,音频编码单元1550可对在频域中已被变换的LPC激励频谱进行量化。

另外,当在LPC激励频谱的量化中存在剩余比特时,音频编码单元1550可通过进一步考虑TD编码信息(诸如,自适应的码本贡献和固定的码本贡献)来对LPC激励频谱进行量化。

当对输入信号中的LF信号的LPC激励信号执行音频编码时,FD扩展编码单元1560可对输入信号中的HF信号执行扩展编码。也就是说,FD扩展编码单元1560可通过使用LF频谱执行HF扩展编码。

FD扩展编码单元1450和1560可通过图3或图6的音频编码设备来实现。

图16是根据示例性实施例的切换结构的音频解码设备的框图。

参照图16,音频解码设备可包括模式信息检查单元1610、TD解码单元1620、TD扩展解码单元1630、FD解码单元1640和FD扩展解码单元1650。

模式信息检查单元1610可检查包括在比特流中的每个帧的模式信息。模式信息检查单元1610可从比特流解析模式信息,并根据来自解析结果的当前帧的编码模式切换到TD解码模式和FD解码模式中的任意一个。

详细地,模式信息检查单元1610可针对包括在比特流中的每个帧进行切换以对在TD模式下编码的帧执行CELP解码,对在FD模式下编码的帧执行FD解码。

TD解码单元1620可根据检查结果对CELP编码的帧执行CELP解码。例如,TD解码单元1620可通过对包括在比特流中的LPC进行解码,对自适应的码本贡献和固定的码本贡献进行解码并对解码结果进行合成,来产生作为低频的解码信号的LF信号。

TD扩展解码单元1630可通过使用LF信号的CELP解码结果和激励信号中的至少一个来产生高频的解码信号。LF信号的激励信号可包括在比特流中。另外,TD扩展解码单元1630可使用包括在比特流中的关于HF信号的LPC信息,以产生作为高频的解码信号的HF信号。

根据示例性实施例,TD扩展解码单元1630可通过将产生的HF信号和由TD解码单元1620产生的LF信号合成来产生解码信号。此时,TD扩展解码单元1630还可将LF信号和HF信号的采样率转换为相同以产生解码信号。

FD解码单元1640可根据检查结果对FD编码的帧执行FD解码。根据示例性实施例,FD解码单元1640可通过参考包括在比特流中的先前帧的模式信息来执行无损解码和反量化。此时,可应用FPC解码,并作为FPC解码的结果可将噪声添加到预定频带。

FD扩展解码单元1650可通过使用FD解码单元1640中的FPC解码和/或噪声填充的结果来执行HF扩展解码。FD扩展解码单元1650可通过以下操作来产生解码的HF信号:对LF频带的解码的频谱的能量进行反量化,根据各种HF BWE模式中的任意一个模式通过使用LF信号来产生HF信号的激励信号,并应用增益使得产生的激励信号的能量与反量化的能量对称。例如,HF BWE模式可以是普通模式、谐波模式和噪声模式中的任意一个模式。

图17是根据另一示例性实施例的切换结构的音频解码设备的框图

参照图17,音频解码设备可包括模式信息检查单元1710、LPC解码单元1720、TD解码单元1730、TD扩展解码单元1740、音频解码单元1750和FD扩展解码单元1760。

模式信息检查单元1710可检查包括在比特流中的每个帧的模式信息。例如,模式信息检查单元1710可从编码的比特流解析模式信息,并根据来自解析结果的当前帧的编码模式切换到TD解码模式和音频解码模式中的任意一个。

详细地,模式信息检查单元1710可针对比特流中包括的每个帧进行切换以对在TD模式下编码的帧执行CELP解码,对在音频模式下编码的帧执行音频解码。

LPC解码单元1720可对包括在比特流中的帧进行LPC解码。

TD解码单元1730可根据检查结果对CELP编码的帧执行CELP解码。例如,TD解码单元1730可通过对自适应的码本贡献和固定的码本贡献进行解码并对解码结果进行合成,来产生作为低频的解码信号的LF信号。

TD扩展解码单元1740可通过使用LF信号的CELP解码结果和激励信号中的至少一个产生高频的解码信号。LF信号的激励信号可包括在比特流中。另外,TD扩展解码单元1740可使用由LPC解码单元1720解码的LPC信息来产生作为高频的解码信号的HF信号。

根据示例性实施例,TD扩展解码单元1740可通过将产生的HF信号和由TD解码单元1730产生的LF信号合成来产生解码信号。此时,TD扩展解码单元1740还可将LF信号和HF信号的采样率转换为相同以产生解码信号。

音频解码单元1750可根据检查结果对音频编码的帧执行音频解码。例如,当存在TD贡献时,音频解码单元1750可通过考虑TD贡献和FD贡献来执行解码,当不存在TD贡献时,音频解码单元1750可通过考虑FD贡献来执行解码。

另外,音频解码单元1750可通过将按照FPC或LVQ方案量化的信号变换到时域来产生解码的LF激励信号,并将产生的激励信号与反量化的LPC系数合成,来产生解码的LF信号。

FD扩展解码单元1760可通过使用音频解码结果来执行扩展解码。例如,FD扩展解码单元1760可将解码的LF信号的采样率转换为适合HF扩展解码的采样率,并通过使用MDCT等来执行转换后的信号的频率变换。FD扩展解码单元1760可通过以下操作来产生解码的HF信号:对变换后的LF频谱的能量进行反量化,根据各种HF BWE模式中的任意一种通过使用LF信号来产生HF信号的激励信号,并应用增益使得产生的激励信号的能量与反量化的能量对称。例如,HF BWE模式可以是普通模式、瞬态模式、谐波模式和噪声模式中的任意一种。

另外,FD扩展解码单元1760可通过使用逆MDCT来将解码的HF信号变换为时域的信号,执行转换以将变换为时域的信号的采样率与由音频解码单元1750产生的LF信号的采样率匹配,并对LF信号和转换后的信号进行合成。

图16和图17中示出的FD扩展解码单元1650和1760可通过图8的音频解码设备来实现。

图18是根据示例性实施例的包括编码模块的多媒体装置的框图。

参照图18,多媒体装置1800可包括通信单元1810和编码模块1830。另外,多媒体装置1800还可包括用于存储音频比特流的存储单元1850,其中,所述音频比特流作为根据音频比特流的使用进行编码的结果而获得。另外,多媒体装置1800还可包括麦克风1870。也就是说,可选择性地包括存储单元1850和麦克风1870。多媒体装置1800还可包括任意解码模块(未示出),例如,用于执行普通解码功能的解码模块或根据示例性实施例的解码模块。编码模块1830可通过与包括在多媒体装置1800中的其他组件(未示出)集成为一体通过至少一个处理器(例如,中央处理器(未示出))来实现。

通信单元1810可接收从外部提供的音频信号或编码的比特流中的至少一个,或者发送恢复的音频信号和作为由编码模块1830编码的结果而获得的编码的比特流中的至少一个。

通信单元1810被配置为通过无线网络(诸如,无线互联网、无线内联网、无线电话网络、无线局域网(LAN)、Wi-Fi、Wi-Fi直连(WFD)、第三代(3G)、第四代(4G)、蓝牙、红外数据协会(IrDA)、射频识别(RFID)、超宽带(UWB)、Zigbee或近场通信(NFC))或有线网络(诸如,有线电话网络或有线互联网),将数据发送到外部多媒体装置,从外部多媒体装置接收数据。

根据示例性实施例,编码模块1830可通过使用图14或图15的编码设备对通过通信单元1810或麦克风1870提供的时域的音频信号进行编码。另外,可通过使用图3或图6的编码设备来执行FD扩展编码。

存储单元1850可存储由编码模块1830产生的编码的比特流。另外,存储单元1850可存储操作多媒体装置1800所需的各种程序。

麦克风1870可将来自用户或外部的音频信号提供给编码模块1830。

图19是根据示例性实施例的包括解码模块的多媒体装置的框图。

图19的多媒体装置1900可包括通信单元1910和解码模块1930。另外,根据作为解码结果被获得的恢复的音频信号的使用,图19的多媒体装置1900还可包括用于存储恢复的音频信号的存储单元1950。另外,图19的多媒体装置1900还可包括扬声器1970。也就是说,存储单元1950和扬声器1970是可选择的。图19的多媒体装置1900还可包括编码模块(未示出),例如,用于执行普通编码功能的编码模块或根据示例性实施例的编码模块。解码模块1930可与包括在多媒体装置1900中的其他组件(未示出)集成,并通过至少一个处理器(例如,中央处理器(CPU))来实现。

参照图19,通信单元1910可接收从外部提供的音频信号或编码的比特流中的至少一个,或可发送作为解码模块1930的解码的结果被获得的恢复的音频信号和作为编码的结果被获得的音频比特流中的至少一个。通信单元1910可大体上与图18的通信单元1810类似地被实现。

根据示例性实施例,解码模块1930可接收通过通信单元1910提供的比特流,并通过使用图16或图17的解码设备来对比特流进行解码。另外,可通过使用图8的解码设备(详细地,图9至图11的激励信号产生单元)来执行FD扩展解码。

存储单元1950可存储由解码模块1930产生的恢复的音频信号。另外,存储单元1950可存储操作多媒体装置1900所需的各种程序。

扬声器1970可将由解码模块1930产生的恢复的音频信号输出到外部。

图20是根据示例性实施例的包括编码模块和解码模块的多媒体装置的框图。

图20中示出的多媒体装置2000可包括通信单元2010、编码模块2020和解码模块2030。另外,多媒体装置2000还可包括:存储单元2040,用于根据作为编码的结果而获得的音频比特流或作为解码的结果而获得的恢复的音频信号的使用,存储所述音频比特流或所述恢复的音频信号。另外,多媒体装置2000还可包括麦克风2050和/或扬声器2060。编码模块2020和解码模块2030可通过与包括在多媒体装置2000中的其他组件(未示出)集成为一体通过至少一个处理器(例如,中央处理器(CPU)(未示出))来实现。

由于图20中示出的多媒体装置2000的组件与图18中示出的多媒体装置1800的组件或图19中示出的多媒体装置1900的组件对应,因此省略其详细描述。

图18、图19和图20中示出的多媒体装置1800、1900和2000中的每个可包括仅语音通信的终端(诸如,电话或移动电话)、仅广播或音乐的装置(诸如,TV或MP3播放器)或仅语音通信的终端和仅广播或音乐的装置的混合终端装置,但不限于此。另外,多媒体装置1800、1900和2000中的每个可用作客户机、服务器或布置在客户机和服务器之间的换能器。

当多媒体装置1800、1900或2000是例如移动电话(尽管未示出)时,多媒体装置1800、1900或2000还可包括用户输入单元(诸如,键区)、用于显示由用户界面或移动电话处理的信息的显示单元和用于控制移动电话的功能的处理器。另外,移动电话还可包括具有图像拾取功能的相机单元和用于执行移动电话所需的功能的至少一个组件。

当多媒体装置1800、1900或2000是例如TV(尽管未示出)时,多媒体装置1800、1900或2000还可包括用户输入单元(诸如,键区)、用于显示接收到的广播信息的显示单元和用于控制TV的所有功能的处理器。另外,TV还可包括用于执行TV的功能的至少一个组件。

根据实施例的方法可被编写为计算机可执行程序,并可在通过使用非暂时性计算机可读记录介质执行程序的通用数字计算机中被实现。另外,可在实施例中使用的数据结构、程序指令或数据文件可以以各种方式被记录在非暂时性计算机可读记录介质上。非暂时性计算机可读记录介质是可存储随后可由计算机系统读取的数据的任意数据存储装置。非暂时性计算机可读记录介质的示例包括磁存储介质(诸如,硬盘、软盘和磁带)、光学记录介质(诸如,CD-ROM、DVD)、磁光介质(诸如,光盘)和专门被配置为存储和执行程序指令的硬件装置(诸如,ROM、RAM和闪存)。另外,非暂时性计算机可读记录介质可以是用于发送指定程序指令、数据结构等的信号的传输介质。程序指令的示例可不仅包括由编译器创建的机器语言代码,还包括可由计算机使用解释器等执行的高级语言代码。

尽管已具体示出和描述了示例性实施例,但本领域的普通技术人员将理解,在不脱离由权利要求限定的本发明构思的精神和范围的情况下,可在形式和细节上进行各种改变。

Claims (5)

1.一种产生高频激励频谱的方法,所述方法包括:

接收比特流,其中,所述比特流包括第一激励分类信息和第二激励分类信息之一作为当前帧的激励分类;

从所述比特流对当前帧的低频频谱进行解码;

基于当前帧的激励分类,从解码的低频频谱获得当前帧的高频激励频谱;

其中,针对当前帧的第一激励分类信息指示如果当前帧具有语音特性,则当前帧的激励分类与语音分类对应,

其中,针对当前帧的第二激励分类信息指示如果当前帧不具有语音特性,则基于当前帧的音调特性,当前帧的激励分类是与第一非语音分类对应还是与第二非语音分类对应。

2.如权利要求1所述的方法,其中,针对当前帧的第二激励分类信息是在当前帧不具有语音特性时,通过将所述音调特性与阈值进行比较,基于当前帧是与噪声信号对应还是与音调信号对应而被确定的。

3.如权利要求1所述的方法,还包括:从当前帧的解码的频谱以及当前帧的高频激励频谱产生当前帧的带宽扩展频谱。

4.一种用于产生激励分类的设备,所述设备包括:

至少一个处理器,被配置为:

基于信号分类的结果,确定音频信号的当前帧是否与语音信号对应;

响应于当前帧与语音信号对应,产生针对当前帧的第一激励分类信息;

当音频信号的当前帧不与语音信号对应时,获得当前帧的音调特性;

通过将所述音调特性与阈值进行比较来产生针对当前帧的第二激励分类信息;

产生包括第一激励分类信息或第二激励分类信息的比特流,

其中,第一激励分类信息指示当前帧的分类是语音分类;

其中,第二激励分类信息指示当前帧的分类是第一非语音分类还是第二非语音分类。

5.如权利要求4所述的设备,其中,所述至少一个处理器被配置为:当音频信号的当前帧不与语音信号对应时,通过将所述音调特性与所述阈值进行比较,基于当前帧是与噪声信号对应还是与音调信号对应来确定针对当前帧的第二激励分类信息。

Applications Claiming Priority (6)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US201261613610P | 2012-03-21 | 2012-03-21 | |

| US61/613,610 | 2012-03-21 | ||

| US201261719799P | 2012-10-29 | 2012-10-29 | |

| US61/719,799 | 2012-10-29 | ||

| PCT/KR2013/002372 WO2013141638A1 (ko) | 2012-03-21 | 2013-03-21 | 대역폭 확장을 위한 고주파수 부호화/복호화 방법 및 장치 |

| CN201380026924.2A CN104321815B (zh) | 2012-03-21 | 2013-03-21 | 用于带宽扩展的高频编码/高频解码方法和设备 |

Related Parent Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201380026924.2A Division CN104321815B (zh) | 2012-03-21 | 2013-03-21 | 用于带宽扩展的高频编码/高频解码方法和设备 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| CN108831501A CN108831501A (zh) | 2018-11-16 |

| CN108831501B true CN108831501B (zh) | 2023-01-10 |

Family

ID=49223006

Family Applications (2)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201811081766.1A Active CN108831501B (zh) | 2012-03-21 | 2013-03-21 | 用于带宽扩展的高频编码/高频解码方法和设备 |

| CN201380026924.2A Active CN104321815B (zh) | 2012-03-21 | 2013-03-21 | 用于带宽扩展的高频编码/高频解码方法和设备 |

Family Applications After (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201380026924.2A Active CN104321815B (zh) | 2012-03-21 | 2013-03-21 | 用于带宽扩展的高频编码/高频解码方法和设备 |

Country Status (8)

| Country | Link |

|---|---|

| US (3) | US9378746B2 (zh) |

| EP (2) | EP2830062B1 (zh) |

| JP (2) | JP6306565B2 (zh) |

| KR (3) | KR102070432B1 (zh) |

| CN (2) | CN108831501B (zh) |

| ES (1) | ES2762325T3 (zh) |

| TW (2) | TWI591620B (zh) |

| WO (1) | WO2013141638A1 (zh) |

Families Citing this family (32)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CA2997882C (en) * | 2013-04-05 | 2020-06-30 | Dolby International Ab | Audio encoder and decoder |

| US8982976B2 (en) * | 2013-07-22 | 2015-03-17 | Futurewei Technologies, Inc. | Systems and methods for trellis coded quantization based channel feedback |

| KR102315920B1 (ko) * | 2013-09-16 | 2021-10-21 | 삼성전자주식회사 | 신호 부호화방법 및 장치와 신호 복호화방법 및 장치 |

| JP6243540B2 (ja) | 2013-09-16 | 2017-12-06 | サムスン エレクトロニクス カンパニー リミテッド | スペクトル符号化方法及びスペクトル復号化方法 |

| WO2015081699A1 (zh) * | 2013-12-02 | 2015-06-11 | 华为技术有限公司 | 一种编码方法及装置 |

| FR3017484A1 (fr) * | 2014-02-07 | 2015-08-14 | Orange | Extension amelioree de bande de frequence dans un decodeur de signaux audiofrequences |

| WO2015122752A1 (ko) | 2014-02-17 | 2015-08-20 | 삼성전자 주식회사 | 신호 부호화방법 및 장치와 신호 복호화방법 및 장치 |

| CN106233112B (zh) * | 2014-02-17 | 2019-06-28 | 三星电子株式会社 | 信号编码方法和设备以及信号解码方法和设备 |

| KR102185478B1 (ko) * | 2014-02-28 | 2020-12-02 | 프라운호퍼-게젤샤프트 추르 푀르데룽 데어 안제반텐 포르슝 에 파우 | 복호 장치, 부호화 장치, 복호 방법, 및 부호화 방법 |

| US10410645B2 (en) | 2014-03-03 | 2019-09-10 | Samsung Electronics Co., Ltd. | Method and apparatus for high frequency decoding for bandwidth extension |

| WO2015133795A1 (ko) * | 2014-03-03 | 2015-09-11 | 삼성전자 주식회사 | 대역폭 확장을 위한 고주파 복호화 방법 및 장치 |

| TR201907596T4 (tr) | 2014-03-14 | 2019-06-21 | Ericsson Telefon Ab L M | Ses kodlama usulü ve aygıtı. |

| CN104934034B (zh) * | 2014-03-19 | 2016-11-16 | 华为技术有限公司 | 用于信号处理的方法和装置 |

| KR102400016B1 (ko) * | 2014-03-24 | 2022-05-19 | 삼성전자주식회사 | 고대역 부호화방법 및 장치와 고대역 복호화 방법 및 장치 |

| EP2980792A1 (en) | 2014-07-28 | 2016-02-03 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Apparatus and method for generating an enhanced signal using independent noise-filling |

| EP4293666A3 (en) | 2014-07-28 | 2024-03-06 | Samsung Electronics Co., Ltd. | Signal encoding method and apparatus and signal decoding method and apparatus |

| FR3024581A1 (fr) * | 2014-07-29 | 2016-02-05 | Orange | Determination d'un budget de codage d'une trame de transition lpd/fd |

| JP2016038435A (ja) | 2014-08-06 | 2016-03-22 | ソニー株式会社 | 符号化装置および方法、復号装置および方法、並びにプログラム |

| WO2016024853A1 (ko) * | 2014-08-15 | 2016-02-18 | 삼성전자 주식회사 | 음질 향상 방법 및 장치, 음성 복호화방법 및 장치와 이를 채용한 멀티미디어 기기 |

| US9837089B2 (en) * | 2015-06-18 | 2017-12-05 | Qualcomm Incorporated | High-band signal generation |

| US10847170B2 (en) | 2015-06-18 | 2020-11-24 | Qualcomm Incorporated | Device and method for generating a high-band signal from non-linearly processed sub-ranges |

| US9978392B2 (en) * | 2016-09-09 | 2018-05-22 | Tata Consultancy Services Limited | Noisy signal identification from non-stationary audio signals |

| CN108630212B (zh) * | 2018-04-03 | 2021-05-07 | 湖南商学院 | 非盲带宽扩展中高频激励信号的感知重建方法与装置 |

| US11133891B2 (en) | 2018-06-29 | 2021-09-28 | Khalifa University of Science and Technology | Systems and methods for self-synchronized communications |

| US10951596B2 (en) * | 2018-07-27 | 2021-03-16 | Khalifa University of Science and Technology | Method for secure device-to-device communication using multilayered cyphers |

| WO2020157888A1 (ja) * | 2019-01-31 | 2020-08-06 | 三菱電機株式会社 | 周波数帯域拡張装置、周波数帯域拡張方法、及び周波数帯域拡張プログラム |

| EP3751567B1 (en) * | 2019-06-10 | 2022-01-26 | Axis AB | A method, a computer program, an encoder and a monitoring device |

| CN113539281A (zh) * | 2020-04-21 | 2021-10-22 | 华为技术有限公司 | 音频信号编码方法和装置 |

| CN113808597A (zh) * | 2020-05-30 | 2021-12-17 | 华为技术有限公司 | 一种音频编码方法和音频编码装置 |

| CN113808596A (zh) * | 2020-05-30 | 2021-12-17 | 华为技术有限公司 | 一种音频编码方法和音频编码装置 |

| CN113963703A (zh) * | 2020-07-03 | 2022-01-21 | 华为技术有限公司 | 一种音频编码的方法和编解码设备 |

| CN113270105B (zh) * | 2021-05-20 | 2022-05-10 | 东南大学 | 一种基于混合调制的类语音数据传输方法 |

Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN1338096A (zh) * | 1998-12-30 | 2002-02-27 | 诺基亚移动电话有限公司 | 用于分析-合成celp型语音编码的自适应窗 |

| CN101083076A (zh) * | 2006-06-03 | 2007-12-05 | 三星电子株式会社 | 使用带宽扩展技术对信号编码和解码的方法和设备 |

| CN101089951A (zh) * | 2006-06-16 | 2007-12-19 | 徐光锁 | 频带扩展编码方法及装置和解码方法及装置 |

| CN101568959A (zh) * | 2006-11-17 | 2009-10-28 | 三星电子株式会社 | 用带宽扩展进行编码和/或解码的方法、介质和设备 |

| EP2273493A1 (en) * | 2009-06-29 | 2011-01-12 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Bandwidth extension encoder, bandwidth extension decoder and phase vocoder |

| CN101965612A (zh) * | 2008-03-03 | 2011-02-02 | Lg电子株式会社 | 用于处理音频信号的方法和装置 |

Family Cites Families (72)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US524323A (en) * | 1894-08-14 | Benfabriken | ||

| GB1218015A (en) * | 1967-03-13 | 1971-01-06 | Nat Res Dev | Improvements in or relating to systems for transmitting television signals |

| US4890328A (en) * | 1985-08-28 | 1989-12-26 | American Telephone And Telegraph Company | Voice synthesis utilizing multi-level filter excitation |

| US4771465A (en) * | 1986-09-11 | 1988-09-13 | American Telephone And Telegraph Company, At&T Bell Laboratories | Digital speech sinusoidal vocoder with transmission of only subset of harmonics |

| KR940004026Y1 (ko) | 1991-05-13 | 1994-06-17 | 금성일렉트론 주식회사 | 바이어스의 스타트업회로 |

| WO1992022891A1 (en) * | 1991-06-11 | 1992-12-23 | Qualcomm Incorporated | Variable rate vocoder |

| US5721788A (en) | 1992-07-31 | 1998-02-24 | Corbis Corporation | Method and system for digital image signatures |

| US5455888A (en) * | 1992-12-04 | 1995-10-03 | Northern Telecom Limited | Speech bandwidth extension method and apparatus |

| US6614914B1 (en) * | 1995-05-08 | 2003-09-02 | Digimarc Corporation | Watermark embedder and reader |

| US6983051B1 (en) * | 1993-11-18 | 2006-01-03 | Digimarc Corporation | Methods for audio watermarking and decoding |

| US5602961A (en) * | 1994-05-31 | 1997-02-11 | Alaris, Inc. | Method and apparatus for speech compression using multi-mode code excited linear predictive coding |

| US5732389A (en) * | 1995-06-07 | 1998-03-24 | Lucent Technologies Inc. | Voiced/unvoiced classification of speech for excitation codebook selection in celp speech decoding during frame erasures |

| US5664055A (en) * | 1995-06-07 | 1997-09-02 | Lucent Technologies Inc. | CS-ACELP speech compression system with adaptive pitch prediction filter gain based on a measure of periodicity |

| CA2188369C (en) * | 1995-10-19 | 2005-01-11 | Joachim Stegmann | Method and an arrangement for classifying speech signals |

| US6570991B1 (en) * | 1996-12-18 | 2003-05-27 | Interval Research Corporation | Multi-feature speech/music discrimination system |

| US7024355B2 (en) * | 1997-01-27 | 2006-04-04 | Nec Corporation | Speech coder/decoder |

| US6819863B2 (en) * | 1998-01-13 | 2004-11-16 | Koninklijke Philips Electronics N.V. | System and method for locating program boundaries and commercial boundaries using audio categories |

| ES2247741T3 (es) * | 1998-01-22 | 2006-03-01 | Deutsche Telekom Ag | Metodo para conmutacion controlada por señales entre esquemas de codificacion de audio. |

| US6104992A (en) * | 1998-08-24 | 2000-08-15 | Conexant Systems, Inc. | Adaptive gain reduction to produce fixed codebook target signal |

| US6456964B2 (en) * | 1998-12-21 | 2002-09-24 | Qualcomm, Incorporated | Encoding of periodic speech using prototype waveforms |

| SE9903553D0 (sv) | 1999-01-27 | 1999-10-01 | Lars Liljeryd | Enhancing percepptual performance of SBR and related coding methods by adaptive noise addition (ANA) and noise substitution limiting (NSL) |

| US6298322B1 (en) * | 1999-05-06 | 2001-10-02 | Eric Lindemann | Encoding and synthesis of tonal audio signals using dominant sinusoids and a vector-quantized residual tonal signal |

| JP4438127B2 (ja) * | 1999-06-18 | 2010-03-24 | ソニー株式会社 | 音声符号化装置及び方法、音声復号装置及び方法、並びに記録媒体 |

| JP4792613B2 (ja) * | 1999-09-29 | 2011-10-12 | ソニー株式会社 | 情報処理装置および方法、並びに記録媒体 |

| FR2813722B1 (fr) * | 2000-09-05 | 2003-01-24 | France Telecom | Procede et dispositif de dissimulation d'erreurs et systeme de transmission comportant un tel dispositif |

| SE0004187D0 (sv) * | 2000-11-15 | 2000-11-15 | Coding Technologies Sweden Ab | Enhancing the performance of coding systems that use high frequency reconstruction methods |

| US20020128839A1 (en) * | 2001-01-12 | 2002-09-12 | Ulf Lindgren | Speech bandwidth extension |

| US6694293B2 (en) * | 2001-02-13 | 2004-02-17 | Mindspeed Technologies, Inc. | Speech coding system with a music classifier |

| DE10134471C2 (de) * | 2001-02-28 | 2003-05-22 | Fraunhofer Ges Forschung | Verfahren und Vorrichtung zum Charakterisieren eines Signals und Verfahren und Vorrichtung zum Erzeugen eines indexierten Signals |

| SE522553C2 (sv) * | 2001-04-23 | 2004-02-17 | Ericsson Telefon Ab L M | Bandbreddsutsträckning av akustiska signaler |

| US6658383B2 (en) * | 2001-06-26 | 2003-12-02 | Microsoft Corporation | Method for coding speech and music signals |

| US7092877B2 (en) * | 2001-07-31 | 2006-08-15 | Turk & Turk Electric Gmbh | Method for suppressing noise as well as a method for recognizing voice signals |

| US7158931B2 (en) * | 2002-01-28 | 2007-01-02 | Phonak Ag | Method for identifying a momentary acoustic scene, use of the method and hearing device |

| JP3900000B2 (ja) * | 2002-05-07 | 2007-03-28 | ソニー株式会社 | 符号化方法及び装置、復号方法及び装置、並びにプログラム |

| KR100503415B1 (ko) | 2002-12-09 | 2005-07-22 | 한국전자통신연구원 | 대역폭 확장을 이용한 celp 방식 코덱간의 상호부호화 장치 및 그 방법 |

| US8243093B2 (en) | 2003-08-22 | 2012-08-14 | Sharp Laboratories Of America, Inc. | Systems and methods for dither structure creation and application for reducing the visibility of contouring artifacts in still and video images |

| KR100571831B1 (ko) | 2004-02-10 | 2006-04-17 | 삼성전자주식회사 | 음성 식별 장치 및 방법 |

| FI118834B (fi) | 2004-02-23 | 2008-03-31 | Nokia Corp | Audiosignaalien luokittelu |

| FI119533B (fi) * | 2004-04-15 | 2008-12-15 | Nokia Corp | Audiosignaalien koodaus |

| GB0408856D0 (en) * | 2004-04-21 | 2004-05-26 | Nokia Corp | Signal encoding |

| CN1947174B (zh) * | 2004-04-27 | 2012-03-14 | 松下电器产业株式会社 | 可扩展编码装置、可扩展解码装置、可扩展编码方法以及可扩展解码方法 |

| US7457747B2 (en) * | 2004-08-23 | 2008-11-25 | Nokia Corporation | Noise detection for audio encoding by mean and variance energy ratio |

| CN101010730B (zh) * | 2004-09-06 | 2011-07-27 | 松下电器产业株式会社 | 可扩展解码装置以及信号丢失补偿方法 |

| KR20070085982A (ko) * | 2004-12-10 | 2007-08-27 | 마츠시타 덴끼 산교 가부시키가이샤 | 광대역 부호화 장치, 광대역 lsp 예측 장치, 대역스케일러블 부호화 장치 및 광대역 부호화 방법 |

| JP4793539B2 (ja) * | 2005-03-29 | 2011-10-12 | 日本電気株式会社 | 符号変換方法及び装置とプログラム並びにその記憶媒体 |

| BRPI0608269B8 (pt) * | 2005-04-01 | 2019-09-03 | Qualcomm Inc | método e aparelho para quantização vetorial de uma representação de envelope espectral |

| US7734462B2 (en) * | 2005-09-02 | 2010-06-08 | Nortel Networks Limited | Method and apparatus for extending the bandwidth of a speech signal |

| US20090222261A1 (en) * | 2006-01-18 | 2009-09-03 | Lg Electronics, Inc. | Apparatus and Method for Encoding and Decoding Signal |

| EP1979901B1 (de) * | 2006-01-31 | 2015-10-14 | Unify GmbH & Co. KG | Verfahren und anordnungen zur audiosignalkodierung |

| DE102006008298B4 (de) * | 2006-02-22 | 2010-01-14 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Vorrichtung und Verfahren zum Erzeugen eines Notensignals |

| US9454974B2 (en) * | 2006-07-31 | 2016-09-27 | Qualcomm Incorporated | Systems, methods, and apparatus for gain factor limiting |

| US8532984B2 (en) * | 2006-07-31 | 2013-09-10 | Qualcomm Incorporated | Systems, methods, and apparatus for wideband encoding and decoding of active frames |

| CN101145345B (zh) * | 2006-09-13 | 2011-02-09 | 华为技术有限公司 | 音频分类方法 |

| US8639500B2 (en) | 2006-11-17 | 2014-01-28 | Samsung Electronics Co., Ltd. | Method, medium, and apparatus with bandwidth extension encoding and/or decoding |

| ES2533358T3 (es) * | 2007-06-22 | 2015-04-09 | Voiceage Corporation | Procedimiento y dispositivo para estimar la tonalidad de una señal de sonido |

| CN101393741A (zh) * | 2007-09-19 | 2009-03-25 | 中兴通讯股份有限公司 | 一种宽带音频编解码器中的音频信号分类装置及分类方法 |

| KR101441896B1 (ko) | 2008-01-29 | 2014-09-23 | 삼성전자주식회사 | 적응적 lpc 계수 보간을 이용한 오디오 신호의 부호화,복호화 방법 및 장치 |

| CN101515454B (zh) * | 2008-02-22 | 2011-05-25 | 杨夙 | 用于语音、音乐、噪音自动分类的信号特征提取方法 |

| CN101751926B (zh) * | 2008-12-10 | 2012-07-04 | 华为技术有限公司 | 信号编码、解码方法及装置、编解码系统 |

| CN101751920A (zh) * | 2008-12-19 | 2010-06-23 | 数维科技(北京)有限公司 | 基于再次分类的音频分类装置及其实现方法 |

| EP2211339B1 (en) * | 2009-01-23 | 2017-05-31 | Oticon A/s | Listening system |

| CN101847412B (zh) | 2009-03-27 | 2012-02-15 | 华为技术有限公司 | 音频信号的分类方法及装置 |

| EP2328363B1 (en) * | 2009-09-11 | 2016-05-18 | Starkey Laboratories, Inc. | Sound classification system for hearing aids |

| US8447617B2 (en) * | 2009-12-21 | 2013-05-21 | Mindspeed Technologies, Inc. | Method and system for speech bandwidth extension |

| CN102237085B (zh) * | 2010-04-26 | 2013-08-14 | 华为技术有限公司 | 音频信号的分类方法及装置 |

| WO2012008891A1 (en) * | 2010-07-16 | 2012-01-19 | Telefonaktiebolaget L M Ericsson (Publ) | Audio encoder and decoder and methods for encoding and decoding an audio signal |

| US9117459B2 (en) * | 2010-07-19 | 2015-08-25 | Dolby International Ab | Processing of audio signals during high frequency reconstruction |

| JP5749462B2 (ja) * | 2010-08-13 | 2015-07-15 | 株式会社Nttドコモ | オーディオ復号装置、オーディオ復号方法、オーディオ復号プログラム、オーディオ符号化装置、オーディオ符号化方法、及び、オーディオ符号化プログラム |

| US8729374B2 (en) * | 2011-07-22 | 2014-05-20 | Howling Technology | Method and apparatus for converting a spoken voice to a singing voice sung in the manner of a target singer |

| CN103035248B (zh) * | 2011-10-08 | 2015-01-21 | 华为技术有限公司 | 音频信号编码方法和装置 |

| WO2013096875A2 (en) * | 2011-12-21 | 2013-06-27 | Huawei Technologies Co., Ltd. | Adaptively encoding pitch lag for voiced speech |

| US9082398B2 (en) * | 2012-02-28 | 2015-07-14 | Huawei Technologies Co., Ltd. | System and method for post excitation enhancement for low bit rate speech coding |

-

2013

- 2013-03-21 US US13/848,177 patent/US9378746B2/en active Active

- 2013-03-21 KR KR1020130030587A patent/KR102070432B1/ko active IP Right Grant

- 2013-03-21 CN CN201811081766.1A patent/CN108831501B/zh active Active

- 2013-03-21 EP EP13763979.5A patent/EP2830062B1/en active Active

- 2013-03-21 TW TW102110397A patent/TWI591620B/zh active

- 2013-03-21 WO PCT/KR2013/002372 patent/WO2013141638A1/ko active Application Filing

- 2013-03-21 CN CN201380026924.2A patent/CN104321815B/zh active Active

- 2013-03-21 ES ES13763979T patent/ES2762325T3/es active Active

- 2013-03-21 JP JP2015501583A patent/JP6306565B2/ja active Active

- 2013-03-21 TW TW106118001A patent/TWI626645B/zh active

- 2013-03-21 EP EP19200892.8A patent/EP3611728A1/en not_active Ceased

-

2016

- 2016-04-25 US US15/137,030 patent/US9761238B2/en active Active

-

2017

- 2017-09-11 US US15/700,737 patent/US10339948B2/en active Active

-

2018

- 2018-03-08 JP JP2018042308A patent/JP6673957B2/ja active Active

-

2020

- 2020-01-20 KR KR1020200007392A patent/KR102194559B1/ko active IP Right Grant

- 2020-12-17 KR KR1020200177443A patent/KR102248252B1/ko active IP Right Grant

Patent Citations (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN1338096A (zh) * | 1998-12-30 | 2002-02-27 | 诺基亚移动电话有限公司 | 用于分析-合成celp型语音编码的自适应窗 |

| CN101083076A (zh) * | 2006-06-03 | 2007-12-05 | 三星电子株式会社 | 使用带宽扩展技术对信号编码和解码的方法和设备 |

| CN101089951A (zh) * | 2006-06-16 | 2007-12-19 | 徐光锁 | 频带扩展编码方法及装置和解码方法及装置 |

| CN101568959A (zh) * | 2006-11-17 | 2009-10-28 | 三星电子株式会社 | 用带宽扩展进行编码和/或解码的方法、介质和设备 |

| CN101965612A (zh) * | 2008-03-03 | 2011-02-02 | Lg电子株式会社 | 用于处理音频信号的方法和装置 |

| EP2273493A1 (en) * | 2009-06-29 | 2011-01-12 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Bandwidth extension encoder, bandwidth extension decoder and phase vocoder |

| CN102473414A (zh) * | 2009-06-29 | 2012-05-23 | 弗兰霍菲尔运输应用研究公司 | 带宽扩展编码器、带宽扩展解码器和相位声码器 |

Also Published As

| Publication number | Publication date |

|---|---|

| KR102194559B1 (ko) | 2020-12-23 |

| US20130290003A1 (en) | 2013-10-31 |

| TWI591620B (zh) | 2017-07-11 |

| KR20200144086A (ko) | 2020-12-28 |

| US9378746B2 (en) | 2016-06-28 |

| TW201729181A (zh) | 2017-08-16 |

| US10339948B2 (en) | 2019-07-02 |

| US9761238B2 (en) | 2017-09-12 |

| ES2762325T3 (es) | 2020-05-22 |

| CN108831501A (zh) | 2018-11-16 |

| EP3611728A1 (en) | 2020-02-19 |

| JP6306565B2 (ja) | 2018-04-04 |

| US20160240207A1 (en) | 2016-08-18 |

| EP2830062B1 (en) | 2019-11-20 |

| CN104321815A (zh) | 2015-01-28 |

| WO2013141638A1 (ko) | 2013-09-26 |

| CN104321815B (zh) | 2018-10-16 |

| KR102248252B1 (ko) | 2021-05-04 |

| US20170372718A1 (en) | 2017-12-28 |

| JP2018116297A (ja) | 2018-07-26 |

| KR102070432B1 (ko) | 2020-03-02 |

| TWI626645B (zh) | 2018-06-11 |

| TW201401267A (zh) | 2014-01-01 |

| EP2830062A1 (en) | 2015-01-28 |

| KR20130107257A (ko) | 2013-10-01 |

| EP2830062A4 (en) | 2015-10-14 |

| JP2015512528A (ja) | 2015-04-27 |

| JP6673957B2 (ja) | 2020-04-01 |

| KR20200010540A (ko) | 2020-01-30 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR102248252B1 (ko) | 대역폭 확장을 위한 고주파수 부호화/복호화 방법 및 장치 | |

| JP6980871B2 (ja) | 信号符号化方法及びその装置、並びに信号復号方法及びその装置 | |

| US11676614B2 (en) | Method and apparatus for high frequency decoding for bandwidth extension | |

| CN105745703B (zh) | 信号编码方法和装置以及信号解码方法和装置 | |

| KR20150032220A (ko) | 신호 부호화방법 및 장치와 신호 복호화방법 및 장치 | |

| KR20220051317A (ko) | 대역폭 확장을 위한 고주파 복호화 방법 및 장치 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| GR01 | Patent grant | ||

| GR01 | Patent grant |