JP6483922B2 - Validating audio calibration using multidimensional motion check - Google Patents

Validating audio calibration using multidimensional motion check Download PDFInfo

- Publication number

- JP6483922B2 JP6483922B2 JP2018514418A JP2018514418A JP6483922B2 JP 6483922 B2 JP6483922 B2 JP 6483922B2 JP 2018514418 A JP2018514418 A JP 2018514418A JP 2018514418 A JP2018514418 A JP 2018514418A JP 6483922 B2 JP6483922 B2 JP 6483922B2

- Authority

- JP

- Japan

- Prior art keywords

- calibration

- playback

- movement

- data

- motion

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 230000033001 locomotion Effects 0.000 title claims description 518

- 238000000034 method Methods 0.000 claims description 114

- 230000001133 acceleration Effects 0.000 claims description 52

- 230000005484 gravity Effects 0.000 claims description 20

- 230000004044 response Effects 0.000 claims description 10

- 230000010354 integration Effects 0.000 claims description 4

- 239000013589 supplement Substances 0.000 claims description 4

- 238000004590 computer program Methods 0.000 claims 1

- 230000001934 delay Effects 0.000 claims 1

- 238000012545 processing Methods 0.000 description 61

- 230000005236 sound signal Effects 0.000 description 45

- 230000008569 process Effects 0.000 description 31

- 238000005259 measurement Methods 0.000 description 29

- 230000006870 function Effects 0.000 description 20

- 230000000875 corresponding effect Effects 0.000 description 19

- 238000010586 diagram Methods 0.000 description 16

- 238000001514 detection method Methods 0.000 description 15

- 230000002596 correlated effect Effects 0.000 description 10

- 230000008859 change Effects 0.000 description 9

- 230000000694 effects Effects 0.000 description 9

- 238000004891 communication Methods 0.000 description 8

- 230000000737 periodic effect Effects 0.000 description 7

- 239000000047 product Substances 0.000 description 7

- 230000002411 adverse Effects 0.000 description 5

- 238000013500 data storage Methods 0.000 description 5

- 230000000670 limiting effect Effects 0.000 description 4

- 230000009471 action Effects 0.000 description 3

- 238000005516 engineering process Methods 0.000 description 3

- 230000007613 environmental effect Effects 0.000 description 3

- 230000005540 biological transmission Effects 0.000 description 2

- 230000001276 controlling effect Effects 0.000 description 2

- 238000006073 displacement reaction Methods 0.000 description 2

- 230000003993 interaction Effects 0.000 description 2

- 230000003287 optical effect Effects 0.000 description 2

- 230000002829 reductive effect Effects 0.000 description 2

- 230000001360 synchronised effect Effects 0.000 description 2

- 230000007704 transition Effects 0.000 description 2

- 238000004458 analytical method Methods 0.000 description 1

- 230000002238 attenuated effect Effects 0.000 description 1

- 238000004364 calculation method Methods 0.000 description 1

- 230000001413 cellular effect Effects 0.000 description 1

- 238000006243 chemical reaction Methods 0.000 description 1

- 239000012141 concentrate Substances 0.000 description 1

- 238000012937 correction Methods 0.000 description 1

- 230000026058 directional locomotion Effects 0.000 description 1

- 230000002452 interceptive effect Effects 0.000 description 1

- 238000007726 management method Methods 0.000 description 1

- 235000012054 meals Nutrition 0.000 description 1

- 238000003032 molecular docking Methods 0.000 description 1

- 230000000644 propagated effect Effects 0.000 description 1

- 230000001681 protective effect Effects 0.000 description 1

- 238000009877 rendering Methods 0.000 description 1

- 239000011435 rock Substances 0.000 description 1

- 238000004904 shortening Methods 0.000 description 1

- 238000012360 testing method Methods 0.000 description 1

- 238000010200 validation analysis Methods 0.000 description 1

- 238000012795 verification Methods 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R29/00—Monitoring arrangements; Testing arrangements

- H04R29/007—Monitoring arrangements; Testing arrangements for public address systems

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/16—Sound input; Sound output

- G06F3/165—Management of the audio stream, e.g. setting of volume, audio stream path

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L25/00—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00

- G10L25/03—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 characterised by the type of extracted parameters

- G10L25/06—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 characterised by the type of extracted parameters the extracted parameters being correlation coefficients

-

- H—ELECTRICITY

- H03—ELECTRONIC CIRCUITRY

- H03G—CONTROL OF AMPLIFICATION

- H03G5/00—Tone control or bandwidth control in amplifiers

- H03G5/16—Automatic control

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R1/00—Details of transducers, loudspeakers or microphones

- H04R1/20—Arrangements for obtaining desired frequency or directional characteristics

- H04R1/32—Arrangements for obtaining desired frequency or directional characteristics for obtaining desired directional characteristic only

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R29/00—Monitoring arrangements; Testing arrangements

- H04R29/008—Visual indication of individual signal levels

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R3/00—Circuits for transducers, loudspeakers or microphones

- H04R3/04—Circuits for transducers, loudspeakers or microphones for correcting frequency response

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S7/00—Indicating arrangements; Control arrangements, e.g. balance control

- H04S7/30—Control circuits for electronic adaptation of the sound field

- H04S7/302—Electronic adaptation of stereophonic sound system to listener position or orientation

- H04S7/303—Tracking of listener position or orientation

-

- H—ELECTRICITY

- H03—ELECTRONIC CIRCUITRY

- H03G—CONTROL OF AMPLIFICATION

- H03G5/00—Tone control or bandwidth control in amplifiers

- H03G5/16—Automatic control

- H03G5/165—Equalizers; Volume or gain control in limited frequency bands

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R2227/00—Details of public address [PA] systems covered by H04R27/00 but not provided for in any of its subgroups

- H04R2227/003—Digital PA systems using, e.g. LAN or internet

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R2227/00—Details of public address [PA] systems covered by H04R27/00 but not provided for in any of its subgroups

- H04R2227/005—Audio distribution systems for home, i.e. multi-room use

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R2460/00—Details of hearing devices, i.e. of ear- or headphones covered by H04R1/10 or H04R5/033 but not provided for in any of their subgroups, or of hearing aids covered by H04R25/00 but not provided for in any of its subgroups

- H04R2460/07—Use of position data from wide-area or local-area positioning systems in hearing devices, e.g. program or information selection

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R27/00—Public address systems

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R29/00—Monitoring arrangements; Testing arrangements

- H04R29/001—Monitoring arrangements; Testing arrangements for loudspeakers

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S7/00—Indicating arrangements; Control arrangements, e.g. balance control

- H04S7/30—Control circuits for electronic adaptation of the sound field

- H04S7/301—Automatic calibration of stereophonic sound system, e.g. with test microphone

Description

本願は、2015年9月24日に出願された米国特許出願第14/864,506号及び2015年9月17日に出願された米国仮特許出願第62/220,176号の優先権を主張しており、その全体が参照されることにより本明細書に組み込まれる。 This application claims priority to US patent application Ser. No. 14 / 864,506 filed Sep. 24, 2015 and US Provisional Patent Application No. 62 / 220,176 filed Sep. 17, 2015. And are hereby incorporated by reference in their entirety.

本願は、コンシューマ製品に関するものであり、特に、メディア再生に向けられた方法、システム、製品、機能、サービス、および他の要素に関するものや、それらのいくつかの態様に関する。 This application relates to consumer products, and in particular, to methods, systems, products, features, services, and other elements directed to media playback and some aspects thereof.

2003年に、ソノズ・インコーポレイテッドが最初の特許出願のうちの1つである「複数のネットワークデバイス間のオーディオ再生を同期する方法」と題する特許出願をし、2005年にメディア再生システムの販売を開始するまで、アウトラウド設定におけるデジタルオーディオへのアクセスおよび試聴のオプションは制限されていた。人々は、ソノズ無線HiFiシステムによって、1つ又は複数のネットワーク再生デバイスを介して多数のソースから音楽を体験できるようになっている。スマートフォン、タブレット、又はコンピュータにインストールされたソフトウェアコントロールアプリケーションを通じて、ネットワーク再生デバイスを備えたいずれの部屋においても、人々は自分が望む音楽を再生することができる。また、例えばコントローラを用いて、再生デバイスを備えた各部屋に異なる歌をストリーミングすることもできるし、同期再生のために複数の部屋をグループ化することもできるし、全ての部屋において同期して同じ歌を聞くこともできる。 In 2003, Sonos Incorporated filed a patent application entitled “Method of Synchronizing Audio Playback Between Multiple Network Devices”, one of the first patent applications, and in 2005, marketed a media playback system. Until it started, the options for accessing and listening to digital audio in the outloud setting were limited. People can experience music from multiple sources via one or more network playback devices with the Sonos Wireless HiFi system. Through a software control application installed on a smartphone, tablet, or computer, people can play the music they want in any room with a network playback device. Also, for example, a controller can be used to stream different songs to each room equipped with a playback device, or multiple rooms can be grouped for synchronized playback, or synchronized in all rooms. You can listen to the same song.

これまでのデジタルメディアに対する関心の高まりを考えると、試聴体験を更に向上させることができるコンシューマアクセス可能な技術を更に開発することにニーズがある。 Given the growing interest in digital media, there is a need to further develop consumer accessible technologies that can further improve the listening experience.

本明細書で開示されている技術の特徴、態様、および利点は、以下の記載、添付の特許請求の範囲、および添付の図面を参照するとより理解しやすい。 The features, aspects, and advantages of the techniques disclosed herein may be better understood with reference to the following description, appended claims, and accompanying drawings.

図面は、いくつかの例示的な実施形態を説明することを目的としているが、本発明が、図面に示した配置および手段に限定されるものではないことは理解される。 Although the drawings are intended to illustrate some exemplary embodiments, it is understood that the invention is not limited to the arrangements and instrumentality shown in the drawings.

I.概要

本明細書に記述する実施形態は、とりわけ、メディア再生システムの1つまたは複数の再生デバイスをキャリブレーションする際に生じる場合もある1つまたは複数のエラー状態を検出することを含む。キャリブレーションが環境の音響特性に対処できるため、再生デバイスのキャリブレーションは、所定の環境における再生デバイスのパフォーマンスを改善できる。音響効果は、環境によって変わる可能性があり、一部の環境は、再生デバイスの周波数応答にわたって所定の周波数をブーストまたはカットすることにより、音響透過に悪影響を与えることがある。例えば、シンフォニーホールでは、音響効果が完璧に近く、音響の伝播に実質的な影響はないが、多くの家庭またはオフィスでは、音響透過にとってそうした理想的な条件は提供されない。

I. Overview Embodiments described herein include, among other things, detecting one or more error conditions that may occur when calibrating one or more playback devices of a media playback system. Because calibration can address the acoustic characteristics of the environment, calibration of the playback device can improve the performance of the playback device in a given environment. Sound effects can vary from environment to environment, and some environments can adversely affect sound transmission by boosting or cutting a predetermined frequency over the frequency response of the playback device. For example, in a symphony hall, the acoustic effect is nearly perfect and has no substantial effect on the propagation of sound, but many homes or offices do not provide such ideal conditions for sound transmission.

本明細書において企図する幾つかのキャリブレーション手順は、所定のリスニング環境において1つまたは複数の再生デバイスにより放出される音波(例えば、1つまたは複数のキャリブレーション音)を検出しかつ分析する録音デバイスを含む。リスニング環境内において伝播した音波を分析することによって、メディア再生システムは、リスニング環境が再生デバイスにより放出される音にどのように影響しているか、およびおそらくは、再生デバイスに与えるリスニング環境の影響を補う方法をも決定できる。例えば、メディア再生システムは、環境の音響効果を補うように再生デバイスの周波数応答を調整するキャリブレーションプロファイルを決定してもよい。 Some calibration procedures contemplated herein include recordings that detect and analyze sound waves (eg, one or more calibration sounds) emitted by one or more playback devices in a given listening environment. Includes devices. By analyzing the sound waves propagated within the listening environment, the media playback system compensates for how the listening environment affects the sound emitted by the playback device, and possibly the effect of the listening environment on the playback device. The method can also be determined. For example, the media playback system may determine a calibration profile that adjusts the frequency response of the playback device to compensate for environmental acoustic effects.

キャリブレーション中に生じる場合もあるエラー状態の可能性としては、1つまたは複数の再生デバイスがキャリブレーション音を放出する間の、リスニング環境内における録音デバイスの動きが不十分であることが含まれる。音響効果は、リスニング環境内の物理的場所毎に変わる可能性があることから、本明細書において企図する例示的なキャリブレーション手順は、1つまたは複数の再生デバイスがキャリブレーション音を放出する間に、リスニング環境内において録音デバイスを動かすことを提案できる。幾つかの例において、キャリブレーション音は、キャリブレーショントーンの周期的反復を含んでもよい。これは、個々の場所における環境の音響効果を表す「サンプル」を生成してもよい。移動するマイクロホンにより生成されるこのようなデータは、固定式のマイクロホンによるものよりも完全な環境音響効果の表現を提供してもよい。他のエラー状態の例としては、他の可能性の中でもとりわけ、バックグラウンドノイズのレベル、マイクロホンにより検出されるオーディオ信号の品質、1つまたは複数の再生デバイスと録音デバイスとの距離または録音デバイスの速度が挙げられる。 Possible error conditions that may occur during calibration include insufficient movement of the recording device within the listening environment while one or more playback devices emit calibration sounds. . Since acoustic effects can vary from physical location to physical location within the listening environment, the exemplary calibration procedure contemplated herein is performed while one or more playback devices emit calibration sounds. In addition, it can be proposed to move the recording device within the listening environment. In some examples, the calibration sound may include a periodic repetition of calibration tones. This may generate “samples” that represent the acoustic effects of the environment at individual locations. Such data generated by a moving microphone may provide a more complete representation of environmental acoustic effects than by a stationary microphone. Examples of other error conditions include, among other possibilities, the level of background noise, the quality of the audio signal detected by the microphone, the distance between one or more playback devices and the recording device, or the recording device's Speed.

キャリブレーションの間、録音デバイスは、1つまたは複数の(例えば、(再生デバイスに対して)垂直、水平および/または半径方向の)次元で、十分な移動が生じたかどうかを決定してもよい。(おそらくは、他のエラー状態が存在しないものとすると)録音デバイスがこのような次元で十分に移動されたキャリブレーションは、有効とされうる。逆に、これらの次元のうちの1つ以上における十分な移動の不在は、無効とされうる。1つまたは複数のエラー状態が検出される状況では、メディア再生システムは、エラー状態の種類に依存して、キャリブレーションを繰り返すように促しても、キャリブレーションの修正を試行してもよい。 During calibration, the recording device may determine whether sufficient movement has occurred in one or more (eg, vertical, horizontal and / or radial (relative to the playback device) dimensions. . A calibration where the recording device has been moved sufficiently in this dimension (perhaps assuming no other error conditions exist) may be valid. Conversely, the absence of sufficient movement in one or more of these dimensions can be invalidated. In situations where one or more error conditions are detected, the media playback system may prompt the calibration to repeat or attempt to correct the calibration, depending on the type of error condition.

録音デバイスの(または、マイクロホンが録音デバイスから分離されている実施形態では、マイクロホン自体の)動きを示すデータは、異なるソースから生成されうる。幾つかの実施形態において、録音デバイス上の(またはマイクロホン上にあって録音デバイスへ結合される)センサは、録音デバイスの加速を示すデータを生成してもよい。録音デバイスまたは再生デバイス上のカメラまたは他の種類のビジョンベース・システムは、環境内における録音デバイスの移動を示す映像データを生成してもよい。別の例として、音響データは、(例えば、再生デバイスから録音デバイスへの、またはその逆のオーディオ伝搬遅延を示すことによって)録音デバイスから再生デバイスへの半径方向距離を示してもよい。 Data indicating the movement of the recording device (or in the embodiment where the microphone is separate from the microphone itself) may be generated from different sources. In some embodiments, a sensor on the recording device (or on the microphone and coupled to the recording device) may generate data indicative of the acceleration of the recording device. A camera or other type of vision-based system on the recording or playback device may generate video data that indicates the movement of the recording device within the environment. As another example, the acoustic data may indicate a radial distance from the recording device to the playback device (eg, by indicating an audio propagation delay from the playback device to the recording device or vice versa).

幾つかの場合において、2つの次元における録音デバイスの移動を示す動きデータは、第3の次元における録音デバイスの動きを決定するために使用されることが可能である。例えば、センサは、(おそらくは、重力関連のデータを生成する加速度計から)録音デバイスの垂直方向の移動を示す動きデータを生成してもよく、かつ音響データは、録音デバイスの再生デバイスからの半径方向移動を示してもよい。このようなデータを相互相関することにより、メディア再生システムは、録音デバイスの第3の次元における動き(即ち、水平方向の動き)を表す水平動きパラメータを決定してもよい。この水平動きパラメータが相関閾値(最初の2つの次元における動きが十分に相関されないことを示す閾値)を超える場合、メディア再生システムは、キャリブレーション周期中に環境にわたって十分な水平移動が生じたものと推測することができる。 In some cases, motion data indicating movement of the recording device in the two dimensions can be used to determine the movement of the recording device in the third dimension. For example, the sensor may generate motion data indicating the vertical movement of the recording device (possibly from an accelerometer that generates gravity-related data), and the acoustic data is a radius from the playback device of the recording device. Directional movement may be indicated. By cross-correlating such data, the media playback system may determine a horizontal motion parameter that represents motion in the third dimension of the recording device (ie, horizontal motion). If this horizontal motion parameter exceeds a correlation threshold (threshold indicating that the motion in the first two dimensions is not fully correlated), the media playback system will assume that sufficient horizontal movement has occurred across the environment during the calibration period. Can be guessed.

エラー状態が識別されると、キャリブレーションプロセスは中断されてもよく、かつメディア再生システムは、キャリブレーションプロセスが中断されたことを示すメッセージを表示してもよい。幾つかの場合において、メディア再生システムは、キャリブレーションプロセスの中断を引き起こした識別されたエラー状態を示してもよい。メディア再生システムは、さらに、識別されたエラー状態をどのように修正するかについての提案を示してもよい。例えば、メッセージは、不十分な垂直移動が生じたこと、および、このエラー状態を、より多い量の録音デバイスを動かす、または録音デバイスをキャリブレーション周期のより長い部分にわたって動かすことにより回避できること、を示してもよい。メディア再生システムは、さらに、キャリブレーションプロセスを再開するため、またはキャリブレーションプロセスをキャンセルするための選択可能なオプションを表示してもよい。例としては、これら以外のものも可能である。 If an error condition is identified, the calibration process may be interrupted and the media playback system may display a message indicating that the calibration process has been interrupted. In some cases, the media playback system may indicate the identified error condition that caused the calibration process to be interrupted. The media playback system may further provide suggestions on how to correct the identified error condition. For example, the message may indicate that insufficient vertical movement has occurred and that this error condition can be avoided by moving a larger amount of recording device or moving the recording device over a longer portion of the calibration period. May be shown. The media playback system may also display selectable options for restarting the calibration process or canceling the calibration process. Other examples are possible as examples.

先に示したように、本開示は、1つまたは複数の再生デバイスをキャリブレーションする間に1つまたは複数のエラー状態を識別することを含む。ある態様では、録音デバイスが提供される。録音デバイスは、マイクロホンと、1つまたは複数のプロセッサと、1つまたは複数のプロセッサにより実行可能な命令であって、録音デバイスに動作を実行させる前記命令を内部に記憶している有形データ記憶装置とを含む。動作には、キャリブレーション周期中に所定の環境において再生デバイスがキャリブレーション音を放出しているという指示を受信することが含まれる。動作には、マイクロホンを介して、放出されるキャリブレーション音を含む音データを録音すること、および、キャリブレーション音放出中の録音デバイスの移動を示す動きデータを受信すること、も含まれる。動作には、キャリブレーション周期中に録音デバイスの十分な垂直移動が生じたと決定することがさらに含まれる。動作には、キャリブレーション周期中に録音デバイスの十分な水平移動が生じたと決定することと、キャリブレーション周期中に垂直方向および水平方向に録音デバイスの十分な移動が生じたという決定に基づいて、検出されたキャリブレーション音を基礎とするキャリブレーションを再生デバイスのオーディオステージに適用すること、が含まれる。 As indicated above, the present disclosure includes identifying one or more error conditions while calibrating one or more playback devices. In an aspect, a recording device is provided. A recording device includes a microphone, one or more processors, and an instruction executable by the one or more processors, the tangible data storage device storing therein the instructions for causing the recording device to perform an operation Including. The operation includes receiving an indication that the playback device is emitting a calibration sound in a predetermined environment during the calibration period. Operation also includes recording sound data including the emitted calibration sound via the microphone and receiving motion data indicating movement of the recording device during the emission of the calibration sound. The operation further includes determining that sufficient vertical movement of the recording device has occurred during the calibration period. The operation is based on determining that sufficient horizontal movement of the recording device has occurred during the calibration period and that sufficient movement of the recording device has occurred in the vertical and horizontal directions during the calibration period. Applying a calibration based on the detected calibration sound to the audio stage of the playback device.

別の態様では、方法を提供する。本方法は、キャリブレーション周期中に所定の環境において1つまたは複数の再生デバイスがキャリブレーション音を放出しているという指示を受信するステップを含む。本方法は、放出されたキャリブレーション音を録音するステップと、キャリブレーション音放出中の制御デバイスの移動を示す動きデータを受信するステップ、も含む。本方法は、さらに、制御デバイスの垂直方向の移動を示す、動きデータの第1の成分と、制御デバイスの1つまたは複数の再生デバイスからの各半径方向の移動を示す、動きデータの1つまたは複数の第2の成分とを識別するステップを含む。また、本方法は、制御デバイスの垂直方向の移動を示す動きデータの第1の成分と、制御デバイスの1つまたは複数の再生デバイスからの各半径方向の移動を示す動きデータの1つまたは複数の第2の成分とを相互相関することによって、環境内における制御デバイスの水平方向の動きを表す1つまたは複数の水平動きパラメータを決定するステップも含む。本方法は、環境内における水平方向の動きを表す水平動きパラメータの少なくとも1つが相関閾値を超えていると決定することによって、キャリブレーション周期中に制御デバイスの十分な水平移動が生じたことを決定するステップを含む。本方法は、キャリブレーション周期中に制御デバイスの十分な移動が生じたことを示すメッセージを送信するステップも含む。 In another aspect, a method is provided. The method includes receiving an indication that one or more playback devices are emitting a calibration sound in a predetermined environment during a calibration cycle. The method also includes recording the emitted calibration sound and receiving motion data indicating movement of the control device during the calibration sound emission. The method further includes a first component of motion data indicative of vertical movement of the control device and one of the motion data indicative of each radial movement of the control device from one or more playback devices. Or identifying a plurality of second components. The method also includes a first component of motion data indicative of vertical movement of the control device and one or more of motion data indicative of each radial movement of the control device from one or more playback devices. And determining one or more horizontal motion parameters representative of the horizontal movement of the control device within the environment by cross-correlating the second component of The method determines that sufficient horizontal movement of the control device has occurred during the calibration period by determining that at least one of the horizontal motion parameters representing horizontal motion in the environment exceeds a correlation threshold. Including the steps of: The method also includes sending a message indicating that sufficient movement of the control device has occurred during the calibration period.

別の態様では、非一時的コンピュータ読み取り可能媒体を提供する。非一時的コンピュータ読み取り可能媒体は、動作を実行するためにコンピュータ装置により実行可能な命令を記憶している。動作には、キャリブレーション周期中に所定の環境において再生デバイスがキャリブレーション音を放出しているという指示を受信することが含まれる。動作には、マイクロホンを介して、放出されるキャリブレーション音を含む音データを録音すること、および、キャリブレーション音放出中の録音デバイスの移動を示す動きデータを受信すること、も含まれる。動作には、キャリブレーション周期中に録音デバイスの十分な垂直移動が生じたと決定することがさらに含まれる。動作には、キャリブレーション周期中に録音デバイスの十分な水平移動が生じたと決定することと、キャリブレーション周期中に垂直方向および水平方向に録音デバイスの十分な移動が生じたという決定に基づいて、検出されたキャリブレーション音を基礎とするキャリブレーションを再生デバイスのオーディオステージに適用すること、が含まれる。 In another aspect, a non-transitory computer readable medium is provided. A non-transitory computer readable medium stores instructions executable by a computer device to perform an operation. The operation includes receiving an indication that the playback device is emitting a calibration sound in a predetermined environment during the calibration period. Operation also includes recording sound data including the emitted calibration sound via the microphone and receiving motion data indicating movement of the recording device during the emission of the calibration sound. The operation further includes determining that sufficient vertical movement of the recording device has occurred during the calibration period. The operation is based on determining that sufficient horizontal movement of the recording device has occurred during the calibration period and that sufficient movement of the recording device has occurred in the vertical and horizontal directions during the calibration period. Applying a calibration based on the detected calibration sound to the audio stage of the playback device.

さらに別の態様では、制御デバイスを提供する。制御デバイスは、1つまたは複数のプロセッサと、1つまたは複数のプロセッサにより実行可能な命令であって、録音デバイスに動作を実行させる前記命令を内部に記憶している有形データ記憶装置とを含む。動作には、キャリブレーション周期中に所定の環境において録音デバイスが1つまたは複数の再生デバイスにより放出されるキャリブレーション音を録音している間の、録音デバイスの移動を示す動きデータを受信することが含まれる。動作には、キャリブレーション周期中に録音デバイスの十分な垂直移動が生じたこと、およびキャリブレーション周期中に録音デバイスの十分な水平移動が生じたこと、を決定することも含まれる。動作には、キャリブレーション周期中、垂直方向および水平方向に録音デバイスの十分な移動が生じたことを示すメッセージを送信することがさらに含まれる。 In yet another aspect, a control device is provided. The control device includes one or more processors and a tangible data storage device having instructions stored therein that are executable by the one or more processors and that cause the recording device to perform an operation. . In operation, receiving motion data indicating movement of the recording device while the recording device is recording a calibration sound emitted by one or more playback devices in a given environment during the calibration period. Is included. The operation also includes determining that a sufficient vertical movement of the recording device has occurred during the calibration period and that a sufficient horizontal movement of the recording device has occurred during the calibration period. The operation further includes sending a message indicating that sufficient movement of the recording device has occurred in the vertical and horizontal directions during the calibration period.

ある態様では、方法を提供する。本方法は、キャリブレーション周期中に所定の環境において録音デバイスが1つまたは複数の再生デバイスにより放出されるキャリブレーション音を録音している間の、録音デバイスの移動を示す動きデータを受信するステップを含む。本方法は、キャリブレーション周期中に録音デバイスの十分な垂直移動が生じたこと、およびキャリブレーション周期中に録音デバイスの十分な水平移動が生じたこと、を決定するステップも含む。本方法は、さらに、キャリブレーション周期中、垂直方向および水平方向に録音デバイスの十分な移動が生じたことを示すメッセージを送信するステップを含む。 In certain aspects, a method is provided. The method receives motion data indicative of movement of a recording device while the recording device is recording a calibration sound emitted by one or more playback devices in a predetermined environment during a calibration period. including. The method also includes determining that a sufficient vertical movement of the recording device has occurred during the calibration period and that a sufficient horizontal movement of the recording device has occurred during the calibration period. The method further includes transmitting a message indicating that sufficient movement of the recording device has occurred in the vertical and horizontal directions during the calibration period.

別の態様では、非一時的コンピュータ読み取り可能媒体を提供する。非一時的コンピュータ読み取り可能媒体は、動作を実行するためにコンピュータ装置により実行可能な命令を記憶している。動作には、キャリブレーション周期中に所定の環境において録音デバイスが1つまたは複数の再生デバイスにより放出されるキャリブレーション音を録音している間の、録音デバイスの移動を示す動きデータを受信することが含まれる。動作には、キャリブレーション周期中に録音デバイスの十分な垂直移動が生じたこと、およびキャリブレーション周期中に録音デバイスの十分な水平移動が生じたこと、を決定することも含まれる。動作には、キャリブレーション周期中、垂直方向および水平方向に録音デバイスの十分な移動が生じたことを示すメッセージを送信することがさらに含まれる。 In another aspect, a non-transitory computer readable medium is provided. A non-transitory computer readable medium stores instructions executable by a computer device to perform an operation. In operation, receiving motion data indicating movement of the recording device while the recording device is recording a calibration sound emitted by one or more playback devices in a given environment during the calibration period. Is included. The operation also includes determining that a sufficient vertical movement of the recording device has occurred during the calibration period and that a sufficient horizontal movement of the recording device has occurred during the calibration period. The operation further includes sending a message indicating that sufficient movement of the recording device has occurred in the vertical and horizontal directions during the calibration period.

本明細書に記載の幾つかの例は、「ユーザ」及び/又は他の実体のような任意の主体によって行われる機能について言及するが、このことは単に例示目的であると理解されるべきである。特許請求の範囲は、特許請求の範囲自体の記載によって明示的に要請されない限り、そのような例示の主体の動作であることを要請するものと解釈されてはならない。当業者にとって、本開示には他の複数の実施形態が含まれることは理解されるであろう。 Although some examples described herein refer to functions performed by any entity, such as a “user” and / or other entity, this should be understood to be for illustrative purposes only. is there. The claims should not be construed as requiring the operation of such exemplary subject matter unless explicitly required by the recitation of the claims themselves. Those skilled in the art will appreciate that the present disclosure includes other embodiments.

II.動作環境の例

図1は、本明細書で開示されている1つ又は複数の実施形態で実施可能又は実装可能なメディア再生システム100の例示的な構成を示す。図示されるように、メディア再生システム100は、複数の部屋および空間、例えば、主寝室、オフィス、ダイニングルーム、およびリビングルームを有する例示的なホーム環境と関連付けられている。図1の例に示されるように、メディア再生システム100は、再生デバイス102−124、制御デバイス126および128、有線又は無線のネットワークルータ130を含む。

II. Exemplary Operating Environment FIG. 1 illustrates an exemplary configuration of a

更に、例示的なメディア再生システム100の異なる構成要素、および異なる構成要素がどのように作用してユーザにメディア体験を提供するかに関しての説明は、以下のセクションで述べられている。本明細書における説明は、概してメディア再生システム100を参照しているが、本明細書で述べられている技術は、図1に示されるホーム環境の用途に限定されるものではない。例えば、本明細書で述べられている技術は、マルチゾーンオーディオが望まれる環境、例えば、レストラン、モール、又は空港のような商業的環境、スポーツ用多目的車(SUV)、バス又は車のような車両、船、若しくはボード、飛行機などの環境において有益である。

In addition, descriptions of the different components of the exemplary

a.例示的な再生デバイス

図2は、図1のメディア再生システム100の再生デバイス102−124の1つ又は複数を構成する例示的な再生デバイス200の機能ブロック図を示す。再生デバイス200は、プロセッサ202、ソフトウェアコンポーネント204、メモリ206、オーディオ処理コンポーネント208、オーディオアンプ210、スピーカー212、マイクロホン220、およびネットワークインタフェース214を含んでもよい。ネットワークインタフェース214は、無線インタフェース216および有線インタフェース218を含む。ある場合では、再生デバイス200は、スピーカー212を含まないが、再生デバイス200を外部スピーカーに接続するためのスピーカーインタフェースを含んでいてもよい。別の場合では、再生デバイス200は、スピーカー212もオーディオアンプ210も含まないが、再生デバイス200を外部オーディオアンプ又はオーディオビジュアルレシーバーに接続するためのオーディオインタフェースを含んでもよい。

a. Exemplary Playback Device FIG. 2 shows a functional block diagram of an exemplary playback device 200 that constitutes one or more of the playback devices 102-124 of the

ある例では、プロセッサ202は、メモリ206に記憶された命令に基づいて、入力データを処理するように構成されたクロック駆動コンピュータコンポーネントであってもよい。メモリ206は、プロセッサ202によって実行可能な命令を記憶するように構成された非一時的なコンピュータ読み取り可能記録媒体であってもよい。例えば、メモリ206は、ある機能を実行するためにプロセッサ202によって実行可能なソフトウェアコンポーネント204の1つ又は複数をロードすることができるデータストレージであってもよい。ある例では、機能は、再生デバイス200がオーディオソース又は別の再生デバイスからオーディオデータを読み出すステップを含んでもよい。別の例では、機能は、再生デバイス200がネットワーク上の別のデバイス又は再生デバイスにオーディオデータを送信するステップを含んでもよい。更に別の例では、機能は、マルチチャンネルオーディオ環境を作るために、再生デバイス200と1つ又は複数の再生デバイスとをペアリングするステップを含んでもよい。

In one example, the processor 202 may be a clocked computer component configured to process input data based on instructions stored in the

ある機能は、再生デバイス200が、1つ又は複数の他の再生デバイスと、オーディオコンテンツの再生を同期するステップを含む。再生を同期している間、再生デバイス200によるオーディオコンテンツの再生と1つ又は複数の他の再生デバイスによる再生との間の遅延を、リスナーが気づかないことが好ましい。「複数の独立クロックデジタルデータ処理デバイス間の動作を同期するシステムおよび方法」と題する米国特許第8,234,395号が本明細書に参照として援用されており、それは再生デバイス間のオーディオ再生を同期することが述べられたより詳細な例を提供している。 One feature includes the playback device 200 synchronizing the playback of audio content with one or more other playback devices. While synchronizing playback, it is preferred that the listener is unaware of the delay between playback of audio content by playback device 200 and playback by one or more other playback devices. US Pat. No. 8,234,395, entitled “System and Method for Synchronizing Operation Between Multiple Independent Clock Digital Data Processing Devices”, is incorporated herein by reference, which provides audio playback between playback devices. It provides a more detailed example where synchronization is stated.

更に、メモリ206は、データを記憶するように構成されていてもよい。データは、例えば、1つ又は複数のゾーンおよび/又はゾーングループに一部として含まれる再生デバイス200などの再生デバイス200、再生デバイス200によりアクセス可能なオーディオソース、又は再生デバイス200(又は他の再生デバイス)と関連付け可能な再生キュー、に関連付けられている。データは、定期的に更新され、再生デバイス200の状態を示す1つ又は複数の状態変数として記憶されてもよい。また、メモリ206は、メディアシステムの他のデバイスの状態と関連付けられたデータを含んでもよく、デバイス間で随時共有することによって、1つ又は複数のデバイスが、システムと関連するほぼ直近のデータを有してもよい。他の実施形態も可能である。

Further, the

オーディオ処理コンポーネント208は、とりわけ、1つ又は複数のデジタル−アナログ変換器(DAC)、アナログ−デジタル変換器(ADC)、オーディオ処理コンポーネント、オーディオ強化コンポーネント、及びデジタルシグナルプロセッサ(DSP)を含んでいてもよい。ある実施形態では、1つ又は複数のオーディオ処理コンポーネント208は、プロセッサ202のサブコンポーネントであってもよい。ある実施形態では、オーディオコンテンツが、オーディオ処理コンポーネント208によって処理および/又は意図的に変更されることによって、オーディオ信号を生成してもよい。生成されたオーディオ信号は、オーディオアンプ210に送信され、増幅され、スピーカー212を通じて再生される。特に、オーディオアンプ210は、1つ又は複数のスピーカー212を駆動できるレベルまでオーディオ信号を増幅するように構成されたデバイスを含んでもよい。スピーカー212は、独立した変換器(例えば、「ドライバ」)又は1つ又は複数のドライバを内包する筐体を含む完全なスピーカーシステムを備えてもよい。スピーカー212に備えられたあるドライバは、例えば、サブウーファー(例えば、低周波用)、ミドルレンジドライバ(例えば、中間周波用)、および/又はツイーター(高周波用)を含んでもよい。ある場合では、1つ又は複数のスピーカー212のそれぞれの変換器は、オーディオアンプ210の対応する個々のオーディオアンプによって駆動されてもよい。再生デバイス200で再生するアナログ信号を生成することに加えて、オーディオ処理コンポーネント208は、オーディオコンテンツを処理し、そのオーディオコンテンツを1つ又は複数の他の再生デバイスに再生させるために送信する。 Audio processing component 208 includes, among other things, one or more digital-to-analog converters (DACs), analog-to-digital converters (ADCs), audio processing components, audio enhancement components, and digital signal processors (DSPs). Also good. In some embodiments, one or more audio processing components 208 may be a subcomponent of processor 202. In some embodiments, audio content may be processed and / or deliberately modified by the audio processing component 208 to generate an audio signal. The generated audio signal is transmitted to the audio amplifier 210, amplified, and reproduced through the speaker 212. In particular, the audio amplifier 210 may include a device configured to amplify the audio signal to a level that can drive one or more speakers 212. The speaker 212 may comprise a complete speaker system including an independent transducer (eg, a “driver”) or a housing that contains one or more drivers. Some drivers provided in the speaker 212 may include, for example, a subwoofer (eg, for low frequency), a middle range driver (eg, for intermediate frequency), and / or a tweeter (for high frequency). In some cases, each transducer of one or more speakers 212 may be driven by a corresponding individual audio amplifier of audio amplifier 210. In addition to generating analog signals for playback on playback device 200, audio processing component 208 processes the audio content and transmits the audio content for playback by one or more other playback devices.

再生デバイス200によって処理および/又は再生されるオーディオコンテンツは、外部ソース、例えば、オーディオライン−イン入力接続(例えば、オートディテクティング3.5mmオーディオラインイン接続)又はネットワークインタフェース214を介して、受信されてもよい。 Audio content that is processed and / or played by the playback device 200 is received via an external source, eg, an audio line-in input connection (eg, an auto-detecting 3.5 mm audio line-in connection) or the network interface 214. May be.

マイクロホン220は、検出されたサウンドを電気信号に変換するように構成されたオーディオセンサを含んでもよい。電気信号は、オーディオ処理コンポーネント208及び/又はプロセッサ202によって処理されうる。マイクロホン220は、再生デバイス200における1つ又は複数の位置において1つ又は複数の向きに配置されうる。マイクロホン220は、1つ又は複数の周波数レンジ内のサウンドを検出するように構成されうる。ある場合では、1つ又は複数のマイクロホン220は、再生デバイス200が可能であるか又はレンダリングしているオーディオの周波数レンジ内のサウンドを検出するように構成されうる。別の場合では、1つ又は複数のマイクロホン220は、人間の可聴周波数レンジ内のサウンドを検出するように構成されてもよい。他の例もまた可能である。 The microphone 220 may include an audio sensor configured to convert the detected sound into an electrical signal. The electrical signal may be processed by audio processing component 208 and / or processor 202. The microphone 220 can be arranged in one or more orientations at one or more positions in the playback device 200. Microphone 220 may be configured to detect sound within one or more frequency ranges. In some cases, the one or more microphones 220 may be configured to detect sound within the frequency range of audio that the playback device 200 is capable of or rendering. In another case, the one or more microphones 220 may be configured to detect sound within the human audible frequency range. Other examples are also possible.

ネットワークインタフェース214は、データネットワーク上で再生デバイス200と1つ又は複数の他のデバイスとの間のデータフローを可能にするように構成されてもよい。このように、再生デバイス200は、再生デバイスと通信する1つ又は複数の他の再生デバイス、ローカルエリアネットワーク内のネットワークデバイス、又は例えば、インターネット等のワイドエリアネットワーク上のオーディオコンテンツソースから、データネットワークを介してオーディオコンテンツを受信するように構成されていてもよい。ある例では、再生デバイス200によって送信および受信されたオーディオコンテンツおよび他の信号は、インターネットプロトコル(IP)に基づくソースアドレスおよびIPに基づく宛先アドレスを含むデジタルパケットの形で送信されてもよい。そのような場合、ネットワークインタフェース214は、デジタルパケットデータを解析することによって、再生デバイス200宛てのデータを、再生デバイス200によって適切に受信して処理することができる。 The network interface 214 may be configured to allow data flow between the playback device 200 and one or more other devices over a data network. In this way, the playback device 200 can receive data from one or more other playback devices that communicate with the playback device, a network device in a local area network, or an audio content source on a wide area network such as, for example, the Internet. May be configured to receive audio content over the network. In one example, audio content and other signals transmitted and received by playback device 200 may be transmitted in the form of a digital packet that includes a source address based on Internet Protocol (IP) and a destination address based on IP. In such a case, the network interface 214 can appropriately receive and process data addressed to the playback device 200 by analyzing the digital packet data.

図示されるように、ネットワークインタフェース214は、無線インタフェース216と有線インタフェース218とを含んでもよい。無線インタフェース216は、再生デバイス200用のネットワークインタフェース機能を提供し、通信プロトコル(例えば、無線規格IEEE802.11a、802.11b、802.11g、802.11n、802.11ac、802.15、4Gモバイル通信基準などを含む無線基準(規格)のいずれか)に基づいて、他のデバイス(例えば、再生デバイス200に関連付けられたデータネットワーク内の他の再生デバイス、スピーカー、レシーバー、ネットワークデバイス、制御デバイス)と無線通信してもよい。有線インタフェース218は、再生デバイス200用のネットワークインタフェース機能を提供し、通信プロトコル(例えば、IEEE802.3)に基づいて他のデバイスとの有線接続を介して通信してもよい。図2に示されるネットワークインタフェース214は、無線インタフェース216と有線インタフェース218との両方を含んでいるが、ネットワークインタフェース214は、ある実施形態において、無線インタフェースのみか、又は有線インタフェースのみを含んでいてもよい。 As shown, the network interface 214 may include a wireless interface 216 and a wired interface 218. The wireless interface 216 provides a network interface function for the playback device 200 and a communication protocol (eg, wireless standards IEEE 802.11a, 802.11b, 802.11g, 802.11n, 802.11ac, 802.15, 4G mobile Other devices (eg, other playback devices, speakers, receivers, network devices, control devices in the data network associated with playback device 200) based on any of the wireless standards (standards) including communication standards, etc. And wireless communication. The wired interface 218 may provide a network interface function for the playback device 200 and may communicate with other devices via a wired connection based on a communication protocol (eg, IEEE 802.3). Although the network interface 214 shown in FIG. 2 includes both a wireless interface 216 and a wired interface 218, the network interface 214 may include only a wireless interface or only a wired interface in some embodiments. Good.

ある例では、再生デバイス200と他の再生デバイスとは、ペアにされて、オーディオコンテンツの2つの別々のオーディオコンポーネントを再生してもよい。例えば、再生デバイス200は、左チャンネルオーディオコンポーネントを再生するように構成される一方、他の再生デバイスは、右チャンネルオーディオコンポーネントを再生するように構成されてもよい。これにより、オーディオコンテンツのステレオ効果を生成するか、又は強化することができる。ペアにされた再生デバイス(「結合再生デバイス」とも言う)は、更に、他の再生デバイスと同期してオーディオコンテンツを再生してもよい。 In one example, playback device 200 and another playback device may be paired to play two separate audio components of audio content. For example, playback device 200 may be configured to play a left channel audio component while other playback devices may be configured to play a right channel audio component. This can generate or enhance the stereo effect of the audio content. Paired playback devices (also referred to as “combined playback devices”) may further play audio content in synchronization with other playback devices.

別の例では、再生デバイス200は、1つ又は複数の他の再生デバイスと音響的に統合され、単一の統合された再生デバイス(統合再生デバイス)を形成してもよい。統合再生デバイスは、統合されていない再生デバイス又はペアにされた再生デバイスと比べて、サウンドの処理や再現を異なるように構成することができる。なぜならば、統合再生デバイスは、オーディオコンテンツを再生するスピーカー追加することができるからである。例えば、再生デバイス200が、低周波レンジのオーディオコンテンツを再生するように設計されている場合(例えば、サブウーファー)、再生デバイス200は、全周波数レンジのオーディオコンテンツを再生するように設計された再生デバイスと統合されてもよい。この場合、全周波数レンジの再生デバイスは、低周波の再生デバイス200と統合されたとき、オーディオコンテンツの中高周波コンポーネントのみを再生するように構成されてもよい。一方で低周波レンジの再生デバイス200は、オーディオコンテンツの低周波コンポーネントを再生する。更に、統合再生デバイスは、単一の再生デバイス、又は更に他の統合再生デバイスとペアにされてもよい。 In another example, playback device 200 may be acoustically integrated with one or more other playback devices to form a single integrated playback device (integrated playback device). The integrated playback device can be configured to differ in sound processing and reproduction compared to non-integrated playback devices or paired playback devices. This is because the integrated playback device can add a speaker for playing back audio content. For example, if the playback device 200 is designed to play audio content in the low frequency range (eg, a subwoofer), the playback device 200 will play back designed to play audio content in the full frequency range. It may be integrated with the device. In this case, the playback device for the entire frequency range may be configured to play back only the medium and high frequency components of the audio content when integrated with the low frequency playback device 200. On the other hand, the low frequency range playback device 200 plays back the low frequency component of the audio content. Further, the integrated playback device may be paired with a single playback device or yet another integrated playback device.

例として、現在、ソノズ・インコーポレイテッドは、「PLAY:1」、「PLAY:3」、「PLAY:5」、「PLAYBAR」、「CONNECT:AMP」、「CONNECT」、および「SUB」を含む再生デバイスを販売提供している。他の過去、現在、および/又は将来のいずれの再生デバイスにおいても、追加的に又は代替的に本明細書で開示された実施例の再生デバイスに実装して使用することができる。更に、再生デバイスは、図2に示された特定の例又は提供されるソノズ製品に限定されないことは理解される。例えば、再生デバイスは、有線又は無線のヘッドホンを含んでもよい。別の例では、再生デバイスは、パーソナルモバイルメディア再生デバイス用のドッキングステーションを含むか、又は、それらと対話してもよい。更に別の例では、再生デバイスは、別のデバイス又はコンポーネント、例えば、テレビ、照明器具、又は屋内又は屋外で使用するためのいくつかの他のデバイスと一体化されてもよい。 As an example, currently Sonos Incorporated includes “PLAY: 1”, “PLAY: 3”, “PLAY: 5”, “PLAYBAR”, “CONNECT: AMP”, “CONNECT”, and “SUB”. I sell devices. In any other past, present, and / or future playback devices, the playback devices of the embodiments disclosed herein may be additionally or alternatively implemented and used. Further, it is understood that the playback device is not limited to the specific example shown in FIG. 2 or the provided Sonoz product. For example, the playback device may include wired or wireless headphones. In another example, the playback device may include or interact with a docking station for a personal mobile media playback device. In yet another example, the playback device may be integrated with another device or component, such as a television, luminaire, or some other device for indoor or outdoor use.

b.例示的な再生ゾーン構成

図1のメディア再生システム100に戻って、環境は、1つ又は複数の再生ゾーンを有しており、それぞれの再生ゾーンは1つ又は複数の再生デバイスを含んでいる。メディア再生システム100は、1つ又は複数の再生ゾーンで形成されており、後で1つ又は複数のゾーンが追加又は削除して、図1に示す例示的な構成としてもよい。それぞれのゾーンは、異なる部屋又は空間、例えば、オフィス、浴室、主寝室、寝室、キッチン、ダイニングルーム、リビングルーム、および/又はバルコニーに基づく名前が与えられてもよい。ある場合では、単一の再生ゾーンは複数の部屋又は空間を含んでいてもよい。別の場合では、単一の部屋又は空間は、複数の再生ゾーンを含んでいてもよい。

b. Exemplary Playback Zone Configuration Returning to the

図1に示されるように、バルコニー、ダイニングルーム、キッチン、浴室、オフィス、および寝室のゾーンのそれぞれは、1つの再生デバイスを有する一方、リビングルームおよび主寝室のゾーンのそれぞれは、複数の再生デバイスを有する。リビングルームゾーンは、再生デバイス104、106、108、および110が、別々の再生デバイスとしてか、1つ又は複数の結合再生デバイスとしてか、1つ又は複数の統合再生デバイスとしてか、又はこれらのいずれかの組み合わせで、オーディオコンテンツを同期して再生するように構成されてもよい。同様に、主寝室の場合では、再生デバイス122および124が、別々の再生デバイスとしてか、結合再生デバイスとしてか、又は統合再生デバイスとして、オーディオコンテンツを同期して再生するように構成されてもよい。

As shown in FIG. 1, each of the balcony, dining room, kitchen, bathroom, office, and bedroom zones has one playback device, while each of the living room and master bedroom zones has multiple playback devices. Have The living room zone is where the

ある例では、図1の環境における1つ又は複数の再生ゾーンは、それぞれ異なるオーディオコンテンツを再生している。例えば、ユーザは、バルコニーゾーンでグリルしながら、再生デバイス102によって再生されるヒップホップ音楽を聞くことができる。一方、別のユーザは、キッチンゾーンで食事を準備しながら、再生デバイス114によって再生されるクラシック音楽を聞くことができる。別の例では、再生ゾーンは、同じオーディオコンテンツを別の再生ゾーンと同期して再生してもよい。例えば、ユーザがオフィスゾーンにいる場合、オフィスゾーンの再生デバイス118が、バルコニーの再生デバイス102で再生されている音楽と同じ音楽を再生してもよい。そのような場合、再生デバイス102および118は、ロック音楽を同期して再生しているため、ユーザは、異なる再生ゾーン間を移動してもアウト−ラウドで再生されるオーディオコンテンツをシームレス(又は少なくともほぼシームレス)に楽しむことができる。再生ゾーン間の同期は、前述の米国特許第8,234,395号で述べられているような再生デバイス間の同期と同様の方法で行ってもよい。

In one example, one or more playback zones in the environment of FIG. 1 are playing different audio content. For example, a user can listen to hip-hop music played by the

上述したように、メディア再生システム100のゾーン構成は、動的に変更してもよく、ある実施形態では、メディア再生システム100は、複数の構成をサポートする。例えば、ユーザが1つ又は複数の再生デバイスを、物理的にゾーンに移動させるか、又はゾーンから移動させる場合、メディア再生システム100は変更に対応するように再構成されてもよい。例えば、ユーザが再生デバイス102をバルコニーゾーンからオフィスゾーンに物理的に移動させる場合、オフィスゾーンは、再生デバイス118と再生デバイス102との両方を含んでもよい。必要に応じて、制御デバイス、例えば制御デバイス126と128とを介して、再生デバイス102が、ペアにされるか、又はオフィスゾーンにグループ化されるか、および/又はリネームされてもよい。一方、1つ又は複数の再生デバイスが、再生ゾーンを未だ設定していないホーム環境において、ある領域に移動させられた場合、新しい再生ゾーンがその領域に形成されてもよい。

As described above, the zone configuration of the

更に、メディア再生システム100の異なる再生ゾーンは、動的にゾーングループに組み合わされてもよいし、又は別々の再生ゾーンに分割されてもよい。例えば、ダイニングルームゾーンとキッチンゾーン114とがディナーパーティ用のゾーングループに組み合わされることによって、再生デバイス112と114とがオーディオコンテンツを同期して再生することができる。一方、あるユーザがテレビを見たい一方、他のユーザがリビングルーム空間の音楽を聞きたい場合、リビングルームゾーンが、再生デバイス104を含むテレビゾーンと、再生デバイス106、108および110を含むリスニングゾーンと、に分けられてもよい。

Furthermore, the different playback zones of the

c.例示的な制御デバイス

図3は、メディア再生システム100の制御デバイス126と128とうちの一方又は両方を構成する例示的な制御デバイス300の機能ブロック図を示す。図示されるように、制御デバイス300は、プロセッサ302、メモリ304、ネットワークインタフェース306、ユーザインタフェース308、及びマイクロホン310を含んでもよい。ある例では、制御デバイス300は、メディア再生システム100専用の制御デバイスであってもよい。別の例では、制御デバイス300は、メディア再生システムコントローラアプリケーションソフトウェアをインストールされたネットワークデバイス、例えば、iPhone(登録商標)、iPad(登録商標)、又は任意の他のスマートフォン、タブレットあるいはネットワークデバイス(例えば、PC又はMac(登録商標)などのネットワークコンピュータ)であってもよい。

c. Exemplary Control Device FIG. 3 shows a functional block diagram of an exemplary control device 300 that constitutes one or both of the

プロセッサ302は、メディア再生システム100のユーザアクセス、コントロール、および構成を可能にすることに関する機能を実行するように構成されてもよい。メモリ304は、プロセッサ302によって実行可能な命令を記憶し、それらの機能を実行するように構成されていてもよい。また、メモリ304は、メディア再生システムコントローラアプリケーションソフトウェアと、メディア再生システム100とユーザとに関連付けられた他のデータを記憶するように構成されていてもよい。

The processor 302 may be configured to perform functions relating to enabling user access, control, and configuration of the

マイクロホン310は、検出されたサウンドを電気信号に変換するように構成されたオーディオセンサを含んでもよい。電気信号は、プロセッサ302によって処理されうる。ある場合では、制御デバイス300が音声通信又は音声録音のための手段として使用されることもできるデバイスである場合、1つ又は複数のマイクロホン310は、それらの機能を容易にするマイクロホンであってもよい。例えば、1つ又は複数のマイクロホン310は、人間が生成可能な周波数レンジ及び/又は人間の可聴周波数レンジ内のサウンドを検出するように構成されうる。他の例もまた可能である。 Microphone 310 may include an audio sensor configured to convert the detected sound into an electrical signal. The electrical signal can be processed by the processor 302. In some cases, where the control device 300 is a device that can also be used as a means for voice communication or voice recording, the one or more microphones 310 may be microphones that facilitate their functions. Good. For example, the one or more microphones 310 may be configured to detect sound within a human-generated frequency range and / or a human audible frequency range. Other examples are also possible.

ある例では、ネットワークインタフェース306は、工業規格(例えば、赤外線、無線、IEEE802.3などの有線規格、IEEE802.11a、802.11b、802.11g、802.11n、802.11ac、802.15などの無線規格、4G通信規格など)に基づいてもよい。ネットワークインタフェース306においては、制御デバイス300がメディア再生システム100内の他のデバイスと通信するための手段を提供してもよい。ある例では、データおよび情報(例えば、状態変数)は、ネットワークインタフェース306を介して制御デバイス300と他のデバイスとの間で通信されてもよい。例えば、メディア再生システム100における再生ゾーンおよびゾーングループの構成は、制御デバイス300によって、再生デバイス又は別のネットワークデバイスから受信されてもよいし、あるいは制御デバイス300によって、ネットワークインタフェース306を介して別の再生デバイス又はネットワークデバイスに送信されてもよい。ある場合では、他のネットワークデバイスは、別の制御デバイスであってもよい。

In one example, the network interface 306 may be an industry standard (eg, infrared, wireless, wired standards such as IEEE 802.3, IEEE 802.11a, 802.11b, 802.11g, 802.11n, 802.11ac, 802.15, etc. Wireless standards, 4G communication standards, etc.). In network interface 306, control device 300 may provide a means for communicating with other devices in

ボリュームコントロールおよびオーディオ再生コントロールなどの再生デバイス制御コマンドは、ネットワークインタフェース306を介して制御デバイス300から再生デバイスに通信されてもよい。上述したように、メディア再生システム100の構成の変更は、ユーザにより制御デバイス300を用いて行うことができる。構成の変更は、1つ又は複数の再生デバイスをゾーンに追加すること、1つ又は複数の再生デバイスをゾーンから取り除くこと、1つ又は複数のゾーンをゾーングループに追加すること、1つ又は複数のゾーンをゾーングループから取り除くこと、結合プレーヤー又は統合プレーヤーを形成すること、結合プレーヤー又は統合プレーヤーから1つ又は複数の再生デバイスに分けることなどを含んでもよい。このように、制御デバイス300は、コントローラと呼ばれてもよく、制御デバイス300は、メディア再生システムコントローラアプリケーションソフトウェアをインストールした専用のコントローラか、又はネットワークデバイスであってもよい。

Playback device control commands such as volume control and audio playback control may be communicated from the control device 300 to the playback device via the network interface 306. As described above, the configuration of the

制御デバイス300のユーザインタフェース308は、図4に示されるコントローラインタフェース400などのようなコントローラインタフェースを提供することによって、メディア再生システム100のユーザアクセスおよび制御を可能にするように構成されていてもよい。コントローラインタフェース400は、再生制御領域410、再生ゾーン領域420、再生ステータス領域430、再生キュー領域440、およびオーディオコンテンツソース領域450を含む。図示されるユーザインタフェース400は、図3の制御デバイス300などのようなネットワークデバイス(および/又は図1の制御デバイス126および128)を設けられたユーザインタフェースの単なる一例であって、ユーザによってメディア再生システム100などのようなメディア再生システムを制御するためにアクセスされるものである。あるいは、様々なフォーマット、スタイル、および対話型シーケンスを他のユーザのインタフェースを1つ又は複数のネットワークデバイスに実装し、メディア再生システムへ類似の制御アクセスを提供してもよい。

The user interface 308 of the control device 300 may be configured to allow user access and control of the

再生制御領域410は、(例えば、タッチ又はカーソルを用いることで)選択可能なアイコンを含んでもよい。このアイコンによって、選択された再生ゾーン又はゾーングループ内の再生デバイスが、再生又は停止、早送り、巻き戻し、次にスキップ、前にスキップ、シャッフルモードのオン/オフ、リピートモードのオン/オフ、クロスフェードモードのオン/オフを行う。再生制御領域410は、別の選択可能なアイコンを含んでもよい。別の選択可能なアイコンは、イコライゼーション設定、再生ボリュームなど他の設定などを変更してもよい。

The

再生ゾーン領域420は、メディア再生システム100内の再生ゾーンの表示を含んでもよい。ある実施形態では、再生ゾーンのグラフィック表示が選択可能であってもよい。追加の選択可能なアイコンを移動させることによって、メディア再生システム内の再生ゾーンを管理又は構成することができる。例えば、結合ゾーンの作成、ゾーングループの作成、ゾーングループの分割、およびゾーングループのリネームなど他の管理又は構成を行うことができる。

The

例えば、図示されるように、「グループ」アイコンは、再生ゾーンのグラフィック表示のそれぞれに設けられてもよい。あるゾーンのグラフィック表示内の「グループ」アイコンは、メディア再生システム内の1つ又は複数のゾーンを選択して、あるゾーンとグループ化するオプションを出せるように選択可能であってもよい。一度グループ化すると、あるゾーンとグループ化されたゾーン内の再生デバイスは、あるゾーン内の再生デバイスと同期してオーディオコンテンツを再生するように構成される。同様に、「グループ」アイコンは、ゾーングループのグラフィック表示内に設けられてもよい。この場合、「グループ」アイコンは、ゾーングループ内の1つ又は複数のゾーンをゾーングループから取り除くために、ゾーングループ内の1つ又は複数のゾーンを選択から外すというオプションを出すように選択可能であってもよい。ユーザインタフェース400等のユーザインタフェースを介してゾーンをグループ化およびグループ解除するための他の対話をすることも可能であるし、実施することも可能である。再生ゾーン領域420内の再生ゾーンの表示は、再生ゾーン又はゾーングループ構成が変更されると、動的に更新されてもよい。

For example, as shown, a “group” icon may be provided for each graphic display of the playback zone. A “group” icon in a graphical representation of a zone may be selectable to allow selection of one or more zones in the media playback system and the option to group with a zone. Once grouped, a playback device in a zone grouped with a zone is configured to play audio content in synchronization with the playback device in the zone. Similarly, a “group” icon may be provided in the graphic display of the zone group. In this case, the “Group” icon can be selected to give the option to deselect one or more zones in the zone group to remove one or more zones in the zone group from the zone group. There may be. Other interactions for grouping and ungrouping zones may be possible and implemented via a user interface, such as

再生ステータス領域430は、現在再生されているオーディオコンテンツ、前に再生されたオーディオコンテンツ、又は選択された再生ゾーン又はゾーングループ内で次に再生するように予定されているオーディオコンテンツ、のグラフィック表示を含んでもよい。選択可能な再生ゾーン又は再生グループは、ユーザインタフェース上で、例えば、再生ゾーン領域420および/又は再生ステータス領域430内で視覚的に区別されてもよい。グラフィック表示は、トラックタイトル、アーティスト名、アルバム名、アルバム年、トラックの長さ、およびメディア再生システムを、ユーザインタフェース400を介して制御するときに、ユーザにとって有益な他の関連情報を含んでいてもよい。

The

再生キュー領域440は、選択された再生ゾーン又はゾーングループと関連付けられた再生キュー内のオーディオコンテンツのグラフィック表示を含んでもよい。ある実施形態では、それぞれの再生ゾーン又はゾーングループは、再生ゾーン又は再生グループによって再生される0以上のオーディオアイテムに対応する情報を含む再生キューと関連付けられていてもよい。例えば、再生キュー内のそれぞれのオーディオアイテムは、ユー・アール・アイ(URI)、ユー・アール・エル(URL)、又は再生ゾーン又はゾーングループ内の再生デバイスによって使用可能な他の識別子を含んでいてもよい。これらによって、ローカルオーディオコンテンツソース又はネットワークオーディオコンテンツソース、からオーディオアイテムを見つけ、および/又は取り出し、再生デバイスによって再生することができる。

The

ある例では、プレイリストが再生キューに追加されてもよい。この場合、プレイリスト内のそれぞれのオーディオアイテムに対応する情報が再生キューに追加されてもよい。別の例では、再生キュー内のオーディオアイテムは、プレイリストとして保存されてもよい。更に別の例では、再生デバイスがストリーミングオーディオコンテンツ、例えば、再生時間を有することで連続して再生されないオーディオアイテムよりも、停止しない限り連続して再生されるインターネットラジオを再生し続けているとき、再生キューは、空であってもよいし、又は「未使用」であるが埋められていてもよい。別の実施形態では、再生キューは、インターネットラジオおよび/又は他のストリーミングオーディオコンテンツアイテムを含むことができ、且つ再生ゾーン又はゾーングループがそれらのアイテムを再生しているとき「使用中」とすることができる。他の例も可能である。 In one example, a playlist may be added to the playback queue. In this case, information corresponding to each audio item in the playlist may be added to the reproduction queue. In another example, audio items in the play queue may be saved as a playlist. In yet another example, when the playback device continues to play streaming audio content, e.g., an audio item that does not play continuously due to having a playback time, it continues to play continuously unless it stops. The play queue may be empty, or may be “unused” but filled. In another embodiment, the playback queue can include Internet radio and / or other streaming audio content items and is “in use” when a playback zone or zone group is playing those items. Can do. Other examples are possible.

再生ゾーン又はゾーングループが「グループ化される」か、又は「グループ解除」されるとき、影響を受ける再生ゾーン又はゾーングループに関連付けられた再生キューは、クリアされてもよいし、又は再び関連付けられてもよい。例えば、第1再生キューを含む第1再生ゾーンが、第2再生キューを含む第2再生ゾーンとグループ化された場合、形成されたゾーングループは、関連付けられた再生キューを有していてもよい。関連付けられた再生キューは、最初は空であるか、(例えば、第2再生ゾーンが第1再生ゾーンに追加された場合、)第1再生キューのオーディオアイテムを含むか、(例えば、第1再生ゾーンが第2再生ゾーンに追加された場合、)第2再生キューのオーディオアイテムを含むか、又は第1再生キューと第2再生キューとの両方のオーディオアイテムを組み合わせられる。その後、形成されたゾーングループがグループ解除された場合、グループ解除された第1再生ゾーンは、前の第1再生キューと再び関連付けられてもよいし、空の新しい再生キューと関連付けられてもよいし、あるいはゾーングループがグループ解除される前にゾーングループと関連付けられていた再生キューのオーディオアイテムを含む新しい再生キューと関連付けられてもよい。同様に、グループ解除された第2再生ゾーンは、前の第2再生キューと再び関連付けられてもよいし、空の新しい再生キューと関連付けられてもよいし、あるいはゾーングループがグループ解除される前にゾーングループと関連付けられていた再生キューのオーディオアイテムを含む新しい再生キューと関連付けられてもよい。他の例も可能である。 When a playback zone or zone group is “grouped” or “ungrouped”, the playback queue associated with the affected playback zone or zone group may be cleared or reassociated. May be. For example, if a first playback zone that includes a first playback queue is grouped with a second playback zone that includes a second playback queue, the formed zone group may have an associated playback queue. . The associated play queue is initially empty, or contains audio items from the first play queue (eg, when the second play zone is added to the first play zone), or (eg, the first play queue). When a zone is added to the second playback zone, it can include the audio items of the second playback queue, or combine the audio items of both the first and second playback queues. Thereafter, when the formed zone group is ungrouped, the ungrouped first playback zone may be re-associated with the previous first playback queue or may be associated with an empty new playback queue. Alternatively, it may be associated with a new play queue that includes the audio items of the play queue that were associated with the zone group before the zone group was ungrouped. Similarly, the ungrouped second playback zone may be re-associated with the previous second playback queue, may be associated with an empty new playback queue, or before the zone group is ungrouped. May be associated with a new play queue that includes an audio item of the play queue that was associated with the zone group. Other examples are possible.

図4のユーザインタフェース400に戻って、再生キュー領域440内のオーディオコンテンツのグラフィック表示は、トラックタイトル、アーティスト名、トラックの長さ、および再生キュー内のオーディオコンテンツと関連付けられた他の関連情報を含んでいてもよい。ある例では、オーディオコンテンツのグラフィック表示は、追加の選択可能なアイコンを選択して移動させることができる。これにより、再生キューおよび/又は再生キューに表示されたオーディオコンテンツを管理および/又は操作することができる。例えば、表示されたオーディオコンテンツは、再生キューから取り除いてもよいし、再生キュー内の異なる位置に移動させてもよいし、すぐに再生させるか若しくは現在再生しているオーディオコンテンツの後に再生するように選択されてもよいし、あるいは他の動作を実行してもよい。再生ゾーン又はゾーングループに関連付けられた再生キューは、再生ゾーン又はゾーングループ内の1つ又は複数の再生デバイスのメモリ、再生ゾーン又はゾーングループに入っていない再生デバイスのメモリ、および/又は他の指定のデバイスのメモリに記憶されていてもよい。

Returning to the

オーディオコンテンツソース領域450は、選択可能なオーディオコンテンツソースのグラフィック表示を含んでいてもよい。このオーディオコンテンツソースにおいては、オーディオコンテンツが選択された再生ゾーン又はゾーングループによって取り出され、再生されてもよい。オーディオコンテンツソースに関する説明は、以降のセクションを参照することができる。

Audio

d.例示的なオーディオコンテンツソース

前回図示したように、ゾーン又はゾーングループ内の1つ又は複数の再生デバイスは、再生するオーディオコンテンツを、(例えば、オーディオコンテンツの対応するURI又はURLに基づいて、)複数の入手可能なオーディオコンテンツソースから取り出すように構成されていてもよい。ある例では、オーディオコンテンツは、再生デバイスによって、対応するオーディオコンテンツソース(例えば、ライン−イン接続)から直接取り出されてもよい。別の例では、オーディオコンテンツは、1つ又は複数の他の再生デバイス若しくはネットワークデバイスを介してネットワーク上の再生デバイスに提供されてもよい。

d. Exemplary Audio Content Source As previously illustrated, one or more playback devices in a zone or zone group may select multiple audio content to play (eg, based on the corresponding URI or URL of the audio content). May be configured to be retrieved from available audio content sources. In one example, audio content may be retrieved directly from a corresponding audio content source (eg, a line-in connection) by a playback device. In another example, audio content may be provided to a playback device on a network via one or more other playback devices or network devices.

例示的なオーディオコンテンツソースは、メディア再生システム内の1つ又は複数の再生デバイスのメモリを含んでもよい。メディア再生システムとしては、例えば、図1のメディア再生システム100、1つ又は複数のネットワークデバイス上のローカルミュージックライブラリ(例えば、制御デバイス、ネットワーク対応のパーソナルコンピュータ、又はネットワーク接続ストレージ(NAS)など)、インターネット(例えば、クラウド)を介してオーディオコンテンツを提供するストリーミングオーディオサービス、あるいは再生デバイス又はネットワークデバイスのライン−イン入力接続を介してメディア再生システムに接続されるオーディオソース、他の可能なシステムであってもよい。

Exemplary audio content sources may include the memory of one or more playback devices in the media playback system. As the media playback system, for example, the

ある実施形態では、オーディオコンテンツソースは、図1のメディア再生システム100などのようなメディア再生システムに定期的に追加されてもよいし、定期的に取り除かれてもよい。ある例では、1つ又は複数のオーディオコンテンツソースが追加される、取り除かれる、又は更新される度に、オーディオアイテムのインデックス付けが行われてもよい。オーディオアイテムのインデックス付けは、ネットワーク上で共有される全てのフォルダ/ディレクトリ内の識別可能なオーディオアイテムをスキャンすることを含んでもよい。ここで、ネットワークは、メディア再生システム内の再生デバイスによってアクセス可能である。また、オーディオアイテムのインデックス付けは、メタデータ(例えば、タイトル、アーティスト、アルバム、トラックの長さなど)と他の関連情報とを含むオーディオコンテンツデータベースを作成すること、又は更新すること、を含んでもよい。他の関連情報とは、例えば、それぞれの識別可能なオーディオアイテムを見つけるためのURI又はURLを含んでもよい。オーディオコンテンツソースを管理し、且つ維持するための他の例も可能である。

In some embodiments, the audio content source may be periodically added to or removed from a media playback system, such as the

再生デバイス、制御デバイス、再生ゾーン構成、およびメディアアイテムソースに関しての上述した説明は、以降で述べられている機能および方法を実施可能ないくつかの例示的な動作環境のみを提供している。本発明は、本明細書で明示的に述べられていないメディア再生システム、再生デバイス、およびネットワークデバイスの他の動作環境および構成であっても適用可能であり、その機能および方法を実施するのに適している。 The above description of playback devices, control devices, playback zone configurations, and media item sources provides only some exemplary operating environments in which the functions and methods described below can be implemented. The present invention is applicable to other operating environments and configurations of media playback systems, playback devices, and network devices not explicitly mentioned herein, and to implement the functions and methods. Is suitable.

III.再生デバイスキャリブレーションの例

先に論じたように、図1の再生デバイス102〜124のうちの1つまたはそれ以上等の1つまたは複数の再生デバイスは、特定のオーディオ体験を提供するように構成されてもよく、かつ、そのオーディオ体験を、再生環境内の1つまたは複数の再生デバイスの位置に関わらず提供するようにキャリブレーションされてもよい。先に述べたように、本明細書において企図する例示的なキャリブレーション手順は、キャリブレーション中の再生デバイスにより放出される音波(例えば、1つまたは複数のキャリブレーション音)を検出しかつ分析する録音デバイスのマイクロホンを含んでもよい。

III. Playback Device Calibration Example As discussed above, one or more playback devices, such as one or more of the playback devices 102-124 of FIG. 1, are configured to provide a particular audio experience. And may be calibrated to provide the audio experience regardless of the location of one or more playback devices within the playback environment. As previously mentioned, the exemplary calibration procedure contemplated herein detects and analyzes sound waves (eg, one or more calibration sounds) emitted by the playback device being calibrated. A microphone of the recording device may be included.

キャリブレーションプロセスによってユーザを誘導するためのキャリブレーションインタフェースは、ネットワークデバイス上に設けられてもよい。例示的なインタフェースは、2015年4月24日に出願された「Speaker Calibration」と題する米国非仮特許出願第14/696,014号明細書に記載されており、その全体が本明細書に参考として組み込まれる。さらなる例示的なインタフェースは、2015年8月14日に出願された「Speaker Calibration User Interface」と題する米国非仮特許出願第14/826,873号明細書に記載されており、その全体が本明細書に同じく参考として組み込まれる。あるいは、キャリブレーションは、ネットワークデバイスと再生デバイスとの間で自動的に実行されてもよく、かつネットワークデバイスのユーザによる相互作用によって、または相互作用なしに実行されてもよい。ネットワークデバイスは、ユーザが1つまたは複数の再生デバイスを制御するために使用できるデバイスであってもよい。例えば、ネットワークデバイスは、図1の制御デバイス126および128ならびに図3の制御デバイス300に類似していてもよい。キャリブレーションインタフェースは、1つまたは複数の再生デバイスを制御するためにネットワークデバイス上へ設けられる図4のコントローラインタフェース400等のコントローラインタフェースのコンポーネントであってもよい。

A calibration interface for guiding the user through the calibration process may be provided on the network device. An exemplary interface is described in US Non-Provisional Application No. 14 / 696,014, filed Apr. 24, 2015, entitled “Speaker Calibration”, which is hereby incorporated by reference in its entirety. Incorporated as. A further exemplary interface is described in US Non-Provisional Application No. 14 / 826,873, filed Aug. 14, 2015, entitled “Speaker Calibration User Interface”, which is incorporated herein in its entirety. Also incorporated into the book as a reference. Alternatively, the calibration may be performed automatically between the network device and the playback device, and may be performed with or without interaction by the user of the network device. A network device may be a device that a user can use to control one or more playback devices. For example, the network device may be similar to the

1つまたは複数の再生デバイスを再生環境内に配置すれば、キャリブレーションインタフェースにより、1つまたは複数の再生デバイスにキャリブレーショントーンを再正させることが可能になる。特定のキャリブレーショントーンは、本明細書において企図する例示的なキャリブレーション手順を容易にできる。例示的なキャリブレーショントーンは、2015年7月21日に出願された「Hybrid Test Tone for Space−Averaged Room Audio Calibration Using A Moving Microphone」と題する米国非仮特許出願第14/805,140号明細書に記載されており、その全体が本明細書に参考として組み込まれる。 If one or more playback devices are placed in the playback environment, the calibration interface allows one or more playback devices to recalibrate the calibration tone. Certain calibration tones can facilitate the exemplary calibration procedure contemplated herein. An exemplary calibration tone is described in U.S. Non-Provisional Patent Application No. 14 / 805,140, filed July 21, 2015, entitled “Hybrid Test Tone for Space-Available Room Audio Calibration Using A Moving Microphone”. Which is incorporated herein by reference in its entirety.

ネットワークデバイスは、1つまたは複数の再生デバイスによるキャリブレーショントーンの再生に関連するオーディオデータを受信するように配置されてもよい。ある例において、インタフェースは、キャリブレーショントーンが再生されている間に再生環境内でネットワークデバイスを動かすようにユーザに対して促してもよい。例えば、あるより具体的な場合において、インタフェースは、再生環境内の、1つまたは複数の再生デバイスによるオーディオ再生の楽しさが典型的に起こりうるエリアを横切るようにユーザに指示してもよい。別の例において、インタフェースは、ネットワークデバイスを可能な限り部屋の壁等の再生環境の反対側の境界領域へ近づけて動かすようにユーザに指示してもよい。ある場合において、キャリブレーションインタフェースは、ユーザがどのようにして再生環境を横切るかを説明する映像を提供してもよい。映像は、キャリブレーショントーンが再生される前、またはキャリブレーショントーンが再生されている間に、インタフェースを介してユーザに示されてもよい。キャリブレーション中に動くマイクロホンの例は、2014年9月9日に出願された「Playback Device Calibration」と題する米国非仮特許出願第14/481,511号明細書に記載されており、その全体が本明細書に参考として組み込まれる。 The network device may be arranged to receive audio data related to the playback of the calibration tone by one or more playback devices. In one example, the interface may prompt the user to move the network device within the playback environment while the calibration tone is being played. For example, in certain more specific cases, the interface may instruct the user to traverse an area in the playback environment where audio playback enjoyment by one or more playback devices may typically occur. In another example, the interface may instruct the user to move the network device as close as possible to the border area opposite the playback environment, such as a room wall. In some cases, the calibration interface may provide a video describing how the user crosses the playback environment. The video may be shown to the user via the interface before the calibration tone is played or while the calibration tone is being played. Examples of microphones that move during calibration are described in US Non-Provisional Patent Application No. 14 / 481,511, filed September 9, 2014, entitled “Playback Device Calibration”. Incorporated herein by reference.

幾つかの例において、複数の再生デバイスが同時にキャリブレーションされてもよい。さらに、幾つかの再生デバイスは、複数の再生チャネル(例えば、ツイータおよびウーファ、またはチャネルとして作用するように構成される複数のスピーカ)を含んでもよく、これらは、同時にキャリブレーションされてもよい。複数の再生チャネルのキャリブレーションを容易にするための技術の例は、2015年7月21日に出願された「Concurrent Multi−Loudspeaker Calibration with a Single Measurement」と題する米国非仮特許出願第14/805,340号明細書に記載されており、その全体が本明細書に参考として組み込まれる。 In some examples, multiple playback devices may be calibrated simultaneously. In addition, some playback devices may include multiple playback channels (eg, tweeters and woofers, or multiple speakers configured to act as channels), which may be calibrated simultaneously. An example of a technique for facilitating calibration of multiple playback channels is U.S. Non-Provisional Patent Application No. 14/805 entitled “Concurrent Multi-Loudspeaker Calibration with a Single Measurement” filed on July 21, 2015. No. 340, which is incorporated herein by reference in its entirety.

ある例において、キャリブレーショントーンは、予め決められた持続時間にわたって再生されてもよく、ユーザには、再生環境におけるエリアを横切るための予め決められた持続時間が割り当てられてもよい。別の例において、キャリブレーショントーンが再生される時間量は、ネットワークデバイスにより検出される、ネットワークデバイスの動きまたは経路に関する情報に基づいて変更されてもよい。例えば、ネットワークデバイスが、前記ネットワークデバイスが先に横断された経路を逆戻りすることを開始したと決定すれば、ネットワークデバイスは、キャリブレーショントーンの追加の測定が不要であると決定してもよく、かつ1つまたは複数の再生デバイスによるキャリブレーショントーンの再正を終了させてもよい。 In one example, the calibration tone may be played for a predetermined duration, and the user may be assigned a predetermined duration for crossing an area in the playback environment. In another example, the amount of time that the calibration tone is played may be changed based on information about network device movement or path detected by the network device. For example, if a network device determines that the network device has started reversing a previously traversed path, the network device may determine that no additional measurement of calibration tones is required, And the calibration tone re-correction by one or more playback devices may be terminated.

さらなる例において、キャリブレーショントーンが再生される時間量は、検出されるオーディオ信号に基づいて変更されてもよい。例えば、ネットワークデバイスは、再生環境において検出されたオーディオ信号の追加のサンプルが再生環境の特性の決定を改善するものではないと決定すれば、キャリブレーショントーンの追加の測定が不要であると決定してもよく、かつ1つまたは複数の再生デバイスによるキャリブレーショントーンの再正を終了させてもよい。例としては、これら以外のものも可能である。 In a further example, the amount of time that the calibration tone is played may be changed based on the detected audio signal. For example, if the network device determines that the additional samples of the audio signal detected in the playback environment do not improve the determination of the characteristics of the playback environment, the network device determines that no additional measurement of calibration tones is required. And calibration tone recalibration by one or more playback devices may be terminated. Other examples are possible as examples.

予め決められる持続時間は、再生環境の種類および/またはサイズに依存して変わってもよい。例えば、1つまたは複数の再生デバイスにキャリブレーショントーンを再生させる前に、キャリブレーションインタフェースは、再生環境の種類および/またはサイズを指示するようにユーザに対して促してもよい。ユーザによる入力に基づいて、インタフェースは、指示された再生環境の種類および/またはサイズをもとに、キャリブレーショントーンを再生するための適切な予め決められる持続時間を特定してもよい。ある場合において、提供されるデモンストレーション映像も、指示された再生環境の種類および/またはサイズに基づいて変わってもよい。別の例において、ユーザは、再生環境の対向する境界エリア間で動くように指示されてもよい。再生環境のおおよそのサイズは、ネットワークデバイスの検出される動きおよび/または経路に基づいて決定されてもよく、よって、キャリブレーショントーンの再生時間は、検出されるユーザの動きおよび/または検出されるユーザの動きの経路に基づいて調整(延長または短縮)されてもよい。例えば、ユーザが依然としてネットワークデバイスを動かしていることが検出されれば、キャリブレーショントーンの再生は、延長されてもよい。別の例において、ユーザがデバイスを、再生環境が先の想定より大きいことを示す方向に動かしていて、かつユーザが再生環境全体またはそのかなりの部分をカバーすべくデバイスを適切に動かすにはさらなる時間を必要とすることが検出されれば、再生時間が延長されてもよい。 The predetermined duration may vary depending on the type and / or size of the playback environment. For example, prior to playing a calibration tone on one or more playback devices, the calibration interface may prompt the user to indicate the type and / or size of the playback environment. Based on input by the user, the interface may identify an appropriate predetermined duration for playing the calibration tone based on the type and / or size of the indicated playback environment. In some cases, the provided demonstration video may also vary based on the type and / or size of the indicated playback environment. In another example, the user may be instructed to move between opposing boundary areas of the playback environment. The approximate size of the playback environment may be determined based on the detected movement and / or path of the network device, so the playback time of the calibration tone is detected and / or detected. Adjustment (extension or shortening) may be made based on the path of movement of the user. For example, if it is detected that the user is still moving the network device, the playback of the calibration tone may be extended. In another example, if the user is moving the device in a direction that indicates that the playback environment is larger than previously assumed, and the user moves the device appropriately to cover the entire playback environment or a substantial portion thereof, further If it is detected that time is required, the playback time may be extended.

1つまたは複数の再生デバイスがキャリブレーショントーンを再生している間、制御デバイス300のマイクロホン310等のネットワークデバイスのマイクロホンは、オーディオ信号を検出できる。制御デバイス300のプロセッサ302等のネットワークデバイスのプロセッサは、オーディオ信号が検出されるにつれて、マイクロホンからオーディオデータストリームを受信してもよい。次いで、プロセッサは、受信されたオーディオデータを処理して、再生環境のオーディオ特性を決定してもよい。例えば、オーディオデータを基礎として、再生環境に関連づけられる線形周波数応答が決定されてもよい。 While one or more playback devices are playing calibration tones, a microphone of a network device, such as microphone 310 of control device 300, can detect the audio signal. A network device processor, such as processor 302 of control device 300, may receive an audio data stream from a microphone as an audio signal is detected. The processor may then process the received audio data to determine the audio characteristics of the playback environment. For example, based on audio data, a linear frequency response associated with the playback environment may be determined.

次には、オーディオ特性に基づいて、信号処理アルゴリズムが決定されてもよい。例えば、等価パラメータは、オーディオコンテンツの再生に際して1つまたは複数の再生デバイスにより等化パラメータが適用される場合に、特定のオーディオ体験が生成されるように決定されてもよい。言い替えれば、環境の音響特性を補うために、キャリブレーションプロファイルが再生デバイスに適用されてもよい。 Next, a signal processing algorithm may be determined based on the audio characteristics. For example, the equivalent parameter may be determined such that a specific audio experience is generated when the equalization parameter is applied by one or more playback devices during playback of the audio content. In other words, a calibration profile may be applied to the playback device to supplement the acoustic properties of the environment.

IV.再生デバイス−キャリブレーションエラー状態を識別する技術の例

先に指摘したように、1つまたは複数のエラー状態は、1つまたは複数の再生デバイスのキャリブレーションの有効性に悪影響を及ぼすことがある。ある例において、1つまたは複数のエラー状態は、1つまたは複数の再生デバイスによるキャリブレーショントーンの再生中およびネットワークデバイスのマイクロホンによるオーディオ信号の検出中に識別されてもよい。ある場合において、1つまたは複数の再生デバイスのキャリブレーションは、予め決められた持続時間にわたるキャリブレーショントーンの再生およびオーディオ信号の検出が完了した後ではなく、エラー状態が識別されるとすぐに、中断されかつ/または終了されてもよい。

IV. Example Reproducing Device-Calibration Error Condition Identification Technique As pointed out above, one or more error conditions may adversely affect the calibration effectiveness of one or more reproduction devices. In one example, one or more error conditions may be identified during calibration tone playback by one or more playback devices and during detection of an audio signal by a microphone of a network device. In some cases, calibration of one or more playback devices may occur as soon as an error condition is identified, rather than after calibration tone playback and audio signal detection over a predetermined duration is complete. It may be interrupted and / or terminated.

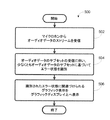

図5は、再生デバイス−キャリブレーションエラー状態を識別するための実装500の例を示すフロー図である。実装500は、例えば図1のメディア再生システム100と、図2の再生デバイス200のうちの1つ以上と、制御デバイス300のうちの1つ以上とを含む動作環境内で実施されることが可能な技術の例を提示する。ある例において、実装500は、全体的または部分的に、メディア再生システムと通信するコンピュータ装置によって実行されてもよい。例えば、実装500は、図1の制御デバイス126および128のうちの一方またはそれ以上によって実行されてもよい。このような場合において、制御デバイス126および128のうちの一方またはそれ以上は、各制御デバイスに実装500の機能を実行させるように各制御デバイスのプロセッサにより実行可能な命令を含むソフトウェアアプリケーションをインストールしていてもよい。

FIG. 5 is a flow diagram illustrating an

実装500は、ブロック502−506の1つ又は複数によって構成されるように、1つ又は複数の操作、機能、又は動作を含んでもよい。各ブロックはそれぞれ順番に示されているが、これらのブロックは並行して行われてもよいし、および/又は、本明細書で述べられている順番と異なる順番で行われてもよい。また、所望の実施内容に応じて、ブロックを少なくしてもよいし、増やして分割してもよいし、および/又は取り除いてもよい。さらに、フローチャートは、実装500並びに本明細書で開示されている他の処理および方法に関して、本実施形態の単に幾つかの可能な実装の機能および動作の例を示している。これに関して、各ブロックは、プロセッサによって実行されるとプロセスにおける特定のロジカル機能又はステップを実行させる1つ又は複数の命令を記憶した、モジュール、セグメント、あるいはプログラムコードの一部を示していてもよい。プログラムコードは例えば、ディスク又はハードドライブを含む記憶デバイスなど、任意のタイプのコンピュータ読み取り可能記録媒体に記憶されてもよい。

コンピュータ読み取り可能記録媒体は、非一時的なコンピュータ読み取り可能記録媒体、例えば、レジスタメモリ、プロセッサキャッシュ、およびランダム・アクセス・メモリ(RAM)などのように短時間データを記憶するコンピュータ読み取り可能媒体を含んでもよい。コンピュータ読み取り可能媒体は、非一時的なメディア、例えば、リード・オンリ・メモリ(ROM)、光ディスク、磁気ディスク、コンパクトディスク・リード・オンリ・メモリ(CD−ROM)等の長期間の記憶が可能な二次記憶装置又は永続記憶装置を含んでもよい。コンピュータ読み取り可能媒体は、その他の任意の揮発性記憶システム又は不揮発性記憶システムであってもよい。コンピュータ読み取り可能媒体は例えば、コンピュータ読み取り可能記録媒体、即ち、有形の記憶デバイスとみなされてもよい。また、実装500並びに本明細書に開示されたその他の処理および方法において、各ブロックは回路を示していてもよく、その回路は処理において、ある論理機能を実行するために有線接続されている。

Computer-readable recording media include non-transitory computer-readable recording media, such as computer-readable media that store data for a short time, such as register memory, processor cache, and random access memory (RAM). But you can. Computer readable media can be stored for long periods of time such as non-transitory media such as read only memory (ROM), optical disk, magnetic disk, compact disk read only memory (CD-ROM), etc. Secondary storage or permanent storage may be included. The computer readable medium may be any other volatile storage system or non-volatile storage system. A computer readable medium may be considered, for example, a computer readable recording medium, ie, a tangible storage device. Also, in

図5に示すように、実装500は、ブロック502において、マイクロホンからオーディオデータストリームを受信し、ブロック504において、オーディオデータのサブセットが受信されるにつれて、少なくともオーディオデータのサブセットをもとにエラー状態を識別し、かつブロック506において、識別されたエラー状態に関連づけられるグラフィック表示をグラフィックディスプレイ上に表示することを含む。

As shown in FIG. 5, the

a.マイクロホンからのオーディオデータストリームの受信

先に指摘したように、ブロック502は、マイクロホンからオーディオデータストリームを受信するステップを含む。ある例において、マイクロホンは、1つまたは複数の再生デバイスをキャリブレーションするプロセスによってユーザを誘導するためのキャリブレーションインタフェースを提供するネットワークデバイスの一部であってもよい。別の例において、マイクロホンは、ネットワークデバイスの外部にあってネットワークデバイスへ通信可能に結合されるマイクロホンであってもよい。本明細書における説明において、ネットワークデバイスの物理的移動は、マイクロホンの同時的な物理的移動を含んでもよい。

a. Receiving an Audio Data Stream from a Microphone As noted above, block 502 includes receiving an audio data stream from a microphone. In one example, the microphone may be part of a network device that provides a calibration interface to guide the user through the process of calibrating one or more playback devices. In another example, the microphone may be a microphone that is external to the network device and communicatively coupled to the network device. In the description herein, physical movement of network devices may include simultaneous physical movement of microphones.

ある例において、ネットワークデバイスは、マイクロホンがオーディオデータストリームを受信する前に、1つまたは複数の再生デバイスのうちの少なくとも1つへ、前記少なくとも1つの再生デバイスにキャリブレーショントーンを再生させるメッセージを送信してもよい。ある場合において、キャリブレーションインタフェースは、再生環境内でユーザがネットワークデバイスの移動を開始する準備ができた時にそれを指示するようにユーザに対して促してもよい。例えば、キャリブレーションインタフェースは、ネットワークデバイスのグラフィックディスプレイ上に、ユーザが選択できる選択可能アイコン(即ち、「キャリブレーション開始」アイコン)を提供して、ユーザが準備完了であることを示してもよい。 In one example, the network device sends a message that causes the at least one playback device to play a calibration tone to at least one of the one or more playback devices before the microphone receives the audio data stream. May be. In some cases, the calibration interface may prompt the user to indicate when the user is ready to begin moving the network device within the playback environment. For example, the calibration interface may provide a selectable icon (ie, a “start calibration” icon) that the user can select on the graphic display of the network device to indicate that the user is ready.

ネットワークデバイスは、再生環境内でユーザがネットワークデバイスの移動を開始する準備ができていることを示す入力を受信したことに応答して、適宜、1つまたは複数の再生デバイスのうちの少なくとも1つへメッセージを送信してもよい。ある場合において、次に、1つまたは複数の再生デバイスのうちの少なくとも1つは、1つまたは複数の再生デバイスの各々によるキャリブレーショントーンの再生を調整してもよい。 In response to receiving input indicating that the user is ready to begin moving the network device in the playback environment, the network device, as appropriate, at least one of the one or more playback devices. You may send a message to In some cases, at least one of the one or more playback devices may then coordinate the playback of the calibration tone by each of the one or more playback devices.

キャリブレーショントーンが1つまたは複数の再生デバイスによって再生されるにつれて、マイクロホンは、再生中であるキャリブレーショントーンの少なくとも一部を含むオーディオ信号、および再生環境内に存在するあらゆる周囲ノイズを検出できる。次に、マイクロホンは、オーディオ信号が検出されるにつれて、検出されるオーディオ信号をサンプリングし、かつ結果として生じるオーディオデータをネットワークデバイスのプロセッサに流してもよい。 As the calibration tone is played by one or more playback devices, the microphone can detect an audio signal that includes at least a portion of the calibration tone being played, and any ambient noise present in the playback environment. The microphone may then sample the detected audio signal and stream the resulting audio data to the network device processor as the audio signal is detected.