WO2023095475A1 - 可動部の位置を制御する情報処理装置 - Google Patents

可動部の位置を制御する情報処理装置 Download PDFInfo

- Publication number

- WO2023095475A1 WO2023095475A1 PCT/JP2022/038009 JP2022038009W WO2023095475A1 WO 2023095475 A1 WO2023095475 A1 WO 2023095475A1 JP 2022038009 W JP2022038009 W JP 2022038009W WO 2023095475 A1 WO2023095475 A1 WO 2023095475A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- controller

- movable

- movable part

- information processing

- virtual object

- Prior art date

Links

Images

Classifications

-

- A—HUMAN NECESSITIES

- A63—SPORTS; GAMES; AMUSEMENTS

- A63F—CARD, BOARD, OR ROULETTE GAMES; INDOOR GAMES USING SMALL MOVING PLAYING BODIES; VIDEO GAMES; GAMES NOT OTHERWISE PROVIDED FOR

- A63F13/00—Video games, i.e. games using an electronically generated display having two or more dimensions

- A63F13/25—Output arrangements for video game devices

- A63F13/28—Output arrangements for video game devices responding to control signals received from the game device for affecting ambient conditions, e.g. for vibrating players' seats, activating scent dispensers or affecting temperature or light

- A63F13/285—Generating tactile feedback signals via the game input device, e.g. force feedback

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

Definitions

- the present disclosure relates to an information processing device, an information processing method, and a program.

- a first member provided with a first movable portion, a second member connected to the first member, and controlling the position of the first movable portion

- An information processing apparatus comprising: a signal acquisition section that acquires a first control signal for the control; and a position control section that controls the position of the first movable section according to the first control signal.

- the computer acquires a first control signal for controlling the position of a first movable portion provided on a first member connected to a second member. and a position control section for controlling the position of the first movable section according to the first control signal.

- FIG. 1 is a diagram illustrating a configuration example of an information processing system according to a first embodiment of the present disclosure

- FIG. It is a figure which shows the functional structural example of a microcomputer.

- Fig. 2 schematically shows the structure of the controller;

- FIG. 10 is a diagram for explaining an example of controlling the position of a movable part according to a virtual object corresponding to a controller;

- FIG. 10 is a diagram showing an example of haptic presentation to the user based on the contact of another virtual object with respect to the virtual object corresponding to the controller;

- FIG. 10 is a diagram showing another example of haptic presentation to the user based on the contact of another virtual object with respect to the virtual object corresponding to the controller;

- FIG. 10 is a diagram showing another example of haptic presentation to the user based on the contact of another virtual object with respect to the virtual object corresponding to the controller;

- FIG. 10 is a diagram showing an example of haptic presentation to a user;

- FIG. 10 is a diagram showing another example of haptic presentation to the user;

- FIG. 10 is a diagram showing another example of haptic presentation to the user;

- FIG. 10 is a diagram showing an example of the relationship between the position command value of the movable part and the weight of the virtual object corresponding to the controller;

- FIG. 5 is a diagram showing an example of a relationship between a position command value and the position of a movable part;

- FIG. 10 is a diagram showing an example of addition of effect signals;

- FIG. 10 is a diagram for explaining an example of pseudo haptic presentation using a nonlinear waveform; It is a figure for demonstrating the modification of the movable range of a movable part.

- FIG. 10 is a diagram showing an example of using controllers when the angle between the controllers is 90 degrees;

- FIG. 5 is a diagram showing an example of a relationship between a position command value and positions of two movable parts;

- FIG. 10 is a diagram for explaining an example of controlling the positions of two movable parts according to a virtual object corresponding to a combination of two controllers;

- FIG. 10 is a diagram showing an example of using controllers when the angle between the controllers is 0 degree;

- FIG. 5 is a diagram showing an example of a relationship between a position command value and positions of two movable parts

- FIG. 10 is a diagram for explaining an example of controlling the positions of two movable parts according to a virtual object corresponding to a combination of two controllers; It is a figure which shows a mode that the cap was removed from the controller.

- FIG. 4 is a diagram showing an example of connection between two controllers via a joint;

- FIG. 10 is a diagram showing an example of direct connection between controllers forming an angle of 0 degrees;

- FIG. 10 is a diagram showing an example of direct connection between controllers forming an angle of 90 degrees;

- FIG. 10 is a diagram showing a display example of guidance prompting connection between controllers;

- FIG. 10 is a diagram showing the state of two controllers before and after connection according to guidance;

- FIG. 4 is a diagram showing four controllers connected to each other; It is a figure which shows the control example of the movable part provided in each of four controllers.

- FIG. 10 is a diagram showing an example in which a controller and an attached member are connected;

- FIG. 10 is a diagram showing another example of connection between the controller and the attached member;

- FIG. 10 illustrates an example in which two controllers are each connected to an attachment;

- FIG. 10 is a diagram showing an example of control of movable parts provided in two controllers connected to an attached member;

- FIG. 10 illustrates an example in which two controllers are each connected to an attachment;

- FIG. 10 illustrates an example in which two controllers are each connected to an attachment;

- FIG. 5 is a diagram showing an example of a relationship between a position command value and the position of a movable part

- FIG. 10 is a diagram showing an example in which attachment members are connected to two types of controllers; It is a figure for demonstrating the 1st modification regarding a movement of a movable part. It is a figure for demonstrating the 2nd modification regarding the movement of a movable part. It is a figure for demonstrating the 3rd modification regarding a movement of a movable part. It is a figure for demonstrating the 4th modification regarding the movement of a movable part. It is a figure for demonstrating the 1st structural example of a movable part.

- FIG. 10 is a diagram showing an example in which attachment members are connected to two types of controllers; It is a figure for demonstrating the 1st modification regarding a movement of a movable part. It is a figure for demonstrating the 2nd modification regarding the movement of a movable part. It is a figure for demonstrating

- FIG. 4 is a diagram for explaining the details of the first configuration example of the movable portion;

- FIG. 10 is a diagram for explaining a second configuration example of the movable portion;

- FIG. 11 is a diagram for explaining details of a second configuration example of the movable portion;

- FIG. 11 is a diagram for explaining a third configuration example of the movable portion;

- a plurality of components having substantially the same or similar functional configurations may be distinguished by attaching different numerals after the same reference numerals.

- attaching different numerals after the same reference numerals.

- similar components in different embodiments may be distinguished by attaching different alphabets after the same reference numerals.

- attaching different alphabets after the same reference numerals.

- only the same reference numerals are used.

- haptic presentation device is an exoskeleton type haptic presentation device.

- a user can be presented with a sensation of grasping something with a hand in a VR (Virtual Reality) space.

- VR Virtual Reality

- a haptic presentation device is a tool-type haptic presentation device (for example, a pen-shaped haptic presentation device or a gun-shaped haptic presentation device).

- a tool-type haptic presentation device is generally made to imitate the shape of a specific tool, and presents a user with a haptic that matches the specific tool. Therefore, it is difficult for such a tool-type haptic presentation device to present a user with haptic sensations corresponding to each of a plurality of types of tools.

- this specification mainly proposes a tool-type, more general-purpose haptic presentation device. Furthermore, this specification also proposes a technique of presenting a haptic sensation to a user by combining a plurality of devices. It is expected that the combination of multiple devices will further improve the types of haptic sensations presented to the user, and that haptic sensations corresponding to more types of tools will be presented to the user.

- FIG. 1 is a diagram showing a configuration example of an information processing system according to the first embodiment of the present disclosure.

- an information processing system 1 includes a controller 10 (first member), a control device 81, a camera 82, and a VR device 83 (display device). and

- the control device 81 is connected to each of the controller 10, camera 82 and VR device 83 by wire or wirelessly.

- the control device 81 is implemented by a computer. As shown in FIG. 1, the control device 81 holds an App (application) 812 in a storage unit (not shown), and a processor (not shown) executes the App 812 to realize a processing unit.

- App 812 may be a game application.

- the type of App 812 is not limited to game applications.

- App 812 may be an application other than a game application.

- the App 812 proceeds based on information transmitted from the controller 10, information transmitted from the VR device 83, or images captured by the camera 82. App 812 then controls the output by VR device 83 based on its progress.

- output by the VR device 83 may include screen display by a display device or audio output by a speaker.

- the information transmitted from the controller 10 can correspond to operation information for controlling the execution of the App 812.

- the information transmitted from the controller 10 may include information indicating that a button provided on the controller 10 has been pressed, or may include information detected by a sensor provided on the controller 10.

- the information transmitted from the VR device 83 may include information indicating that a button provided on the VR device 83 has been pressed, or information detected by a sensor provided on the VR device 83. It's okay.

- the App 812 constructs the VR space.

- An avatar corresponding to the user exists in the VR space.

- the App 812 controls the movement of the avatar within the VR space based on information transmitted from the controller 10, information transmitted from the VR device 83, or images captured by the camera .

- an image of the VR space is provided from the App 812 to the VR device 83 and displayed by the VR device 83 so that the user can visually recognize the VR space.

- the App 812 transmits various control signals to the controller 10 .

- the control device 81 holds an SDK (Software Development Kit) 814 in a storage unit (not shown).

- the SDK 814 is a component required for executing App 812 .

- control device 81 can be assumed to be a game machine.

- control device 81 is not limited to a game machine.

- control device 81 may be a PC (Personal Computer) or the like.

- the camera 82 has an image sensor, and obtains an image by capturing an imaging range with the image sensor. More specifically, the camera 82 obtains a plurality of frames (that is, moving images) by continuously capturing images of the imaging range in chronological order with the image sensor.

- the controller 10 and the VR device 83 may exist within the imaging range of the camera 82 .

- the camera 82 is installed independently of other devices (for example, the controller 10, the control device 81, the VR device 83, etc.). However, camera 82 may be integrated with other devices. For example, the camera 82 may be provided in the VR device 83 or may be provided in the control device 81 .

- the VR device 83 outputs according to control by the App 812 .

- the VR device 83 includes a display device, and performs screen display using the display device under control of the App 812 .

- the VR device 83 includes a speaker, and outputs audio through the speaker under control of the App 812 .

- the VR device 83 can be used by being worn on the user's head. However, the VR device 83 does not necessarily have to be worn on the user's head.

- the VR device 83 is connected to the control device 81 .

- the form of the VR device 83 is not limited.

- the form of the VR device 83 may be a form in which a smart phone is set in goggles and used.

- the form of the VR device 83 may be a form in which the headset operates alone.

- the controller 10 includes a microcomputer 120 (control section), a movable section 130 (first movable section) as an example of a haptic presentation device, a battery 140, an Amp 151, and a VCM as another example of a haptic presentation device. (Voice Coil Motor) 152 .

- the microcomputer 120 corresponds to an MCU (Micro-Control Unit) and can be configured by an integrated circuit on which a processor, memory (recording medium), input/output circuits, and the like are mounted.

- the functions of the microcomputer 120 can be realized by executing programs stored in the memory by the processor. A functional configuration example of the microcomputer 120 will be described with reference to FIG.

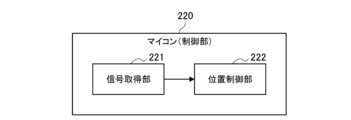

- FIG. 2 is a diagram showing an example of the functional configuration of the microcomputer 120. As shown in FIG. As shown in FIG. 2 , the microcomputer 120 has a signal acquisition section 121 and a position control section 122 . Functions of the signal acquisition unit 121 and the position control unit 122 will be described later in detail. Returning to FIG. 1, the description continues.

- microcomputer 120 may be incorporated in the microcomputer outside the controller 10.

- the movable part 130 includes an origin search switch 131 , a motor driver 132 , a motor 133 and an encoder 134 .

- the movable part 130 has a substrate (not shown) on which these components are arranged.

- the origin switch 131 is a switch used to determine the reference position of the movable part 130 .

- the motor 133 has a function of converting electrical energy into mechanical energy for moving the movable part 130 .

- the motor driver 132 is a driver that controls the motor 133 according to commands output from the microcomputer 120 .

- the encoder 134 has a function of detecting the rotational speed and position of the motor 133 and outputting the detection result to the microcomputer 120 .

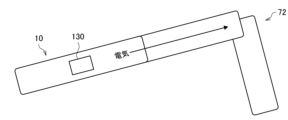

- FIG. 3 is a diagram schematically showing the structure of the controller 10.

- the controller 10 includes a housing E1.

- Various buttons 161 and a trigger button 162 are provided on the outside of the housing E1.

- the various buttons 161 are arranged at positions that are likely to be depressed mainly by the thumb, and the trigger button 162 is arranged at a position that is likely to be depressed mainly by the index finger.

- a drive member 163 is provided inside the housing E1.

- the driving member 163 is connected to the movable section 130 and the housing E1, and uses the mechanical energy generated by the motor 133 to move the movable section 130 in the vertical direction of the controller 10.

- a switch 131 for setting the origin is provided at the lower end of the movable part 130 . Therefore, when the movable part 130 moves downward and comes into contact with the housing E1, the origin search switch 131 is pressed, and the position of the movable part 130 when the origin search switch 131 is pressed is the position of the movable part 130. is used to determine the reference position of

- the position where the switch 131 for setting the origin is provided is not limited.

- the switch 131 for returning to the origin may be provided at the upper end of the movable portion 130 .

- the origin search switch 131 is pressed, and the position of the movable portion 130 when the origin search switch 131 is pressed corresponds to the position of the movable portion 130. It is used to determine the reference position of 130.

- the direction in which the thumb is located with respect to the center of the portion of the controller 10 that is gripped by the user's hand is also referred to as the "upward direction of the controller" for convenience.

- the direction in which the little finger is located with respect to the center of the portion of the controller 10 gripped by the user's hand is also referred to as the “downward direction of the controller.”

- how the user holds the controller 10 is not limited. Returning to FIG. 1, the description continues.

- a battery 140 supplies power to each part of the controller 10 .

- the battery 140 supplies power to the microcomputer 120, Amp 151, motor driver 132 and encoder 134, respectively.

- the battery 140 is provided outside the movable portion 130, but the battery 140 may be included in the movable portion 130 as described later.

- Amp 151 outputs current to VCM 152 based on a current command output from microcomputer 120 .

- VCM152 VCM 152 has a coil and a magnet. A magnetic field is generated by the magnet, and when the current output from the Amp 151 flows through the coil, a force corresponding to the magnetic field and the current is generated in the coil. This causes the VCM 152 to move in a predetermined direction. Furthermore, when the direction of the current flowing through the coil is reversed, the VCM 152 also moves in the direction opposite to the predetermined direction. Therefore, the VCM 152 vibrates due to repeated changes in the direction of the current flowing through the coil.

- a virtual object (first virtual object) corresponding to the controller 10 exists in the VR space constructed by the App 812 of the control device 81 .

- virtual objects representing various tools for example, tennis rackets, swords, etc.

- FIG. 4 is a diagram for explaining an example of controlling the position of the movable part 130 according to the virtual object corresponding to the controller 10.

- FIG. 4 an example in which the VR device 83 displays a VR space image 65A is shown. In this example, no virtual object corresponding to the controller 10 exists in the VR space.

- FIG. 4 an example in which the VR device 83 displays an image 65B in the VR space is shown.

- a virtual object 51B representing a tennis racket exists in the VR space as an example of a virtual object corresponding to the controller 10.

- FIG. an example in which the VR device 83 displays an image 65C in the VR space is shown.

- a virtual object 51C representing a sword exists in the VR space.

- the App 812 may control the position of the movable section 130 based on predetermined parameters of the virtual object corresponding to the controller 10.

- the predetermined parameters may include the weight of the virtual object corresponding to the controller 10.

- FIG. the weight of the virtual object is preset in the App812.

- the App 812 may then control the position of the movable section 130 based on the weight of the virtual object corresponding to the controller 10 .

- the App 812 may control the position of the movable section 130 so that the greater the weight of the virtual object corresponding to the controller 10 is, the farther away from the position the user grips the controller 10 .

- the App 812 may control the position of the movable section 130 such that the greater the weight of the virtual object corresponding to the controller 10, the higher the position of the controller 10 away from the grip position of the controller 10 by the user.

- the App 812 may control the position of the movable part 130A corresponding to the controller 10A to stop at the position where the user grips the controller 10A when the weight of the virtual object corresponding to the controller 10A is zero.

- the App 812 may perform control such that the position of the movable portion 130B corresponding to the controller 10B is further away from the position where the user grips the controller 10B in the upward direction of the controller 10B.

- the App 812 may perform control such that the position of the movable portion 130C corresponding to the controller 10C is further away from the position of the movable portion 130B in the upward direction of the controller 10C.

- the predetermined parameter of the virtual object corresponding to the controller 10 may include the size of the virtual object corresponding to the controller 10.

- FIG. The App 812 may then control the position of the movable section 130 based on the size of the virtual object corresponding to the controller 10 .

- the App 812 may control the position of the movable section 130 so that the larger the virtual object corresponding to the controller 10 is, the farther away from the position the user grips the controller 10 .

- the App 812 may control the position of the movable section 130 such that the larger the virtual object corresponding to the controller 10 is, the more the controller 10 is held upward by the user.

- control example of the position of the movable part 130 is not limited to this example.

- the control example of the position of the movable part 130 may be set in advance along with the progress of the App812. At this time, the App 812 may control the position of the movable section 130 based on its own progress.

- a virtual object existing in the VR space is controlled according to the progress of App 812 .

- a virtual object (second virtual object) different from the virtual object corresponding to the controller 10 may exist in the VR space. At this time, if another virtual object touches the virtual object corresponding to the controller 10, it is desirable that the contact is fed back to the user.

- FIG. 5 is a diagram showing an example of haptic presentation to the user based on the contact of another virtual object with the virtual object corresponding to the controller 10.

- FIG. 5 an example in which the VR device 83 displays a VR space image 65B is shown.

- a virtual object 51B representing a tennis racket exists in the VR space as an example of a virtual object corresponding to the controller 10B.

- a virtual object 51BX representing a ball exists in the VR space as another example of the virtual object.

- the App 812 may change the position of the movable section 130 based on the contact between the virtual object 51B corresponding to the controller 10B and the virtual object 51BX. Thereby, the contact of the virtual object 51BX with the virtual object 51B corresponding to the controller 10B can be fed back to the user. As an example, as shown in FIG. 5, the position of the movable portion 130B may be momentarily moved downward in the controller 10B (eg, to the position of the movable portion 130BX).

- FIG. 6 is a diagram showing another example of haptic presentation to the user based on the contact of another virtual object with the virtual object corresponding to the controller 10.

- FIG. 6 an example is shown in which the VR device 83 displays a VR space image 65C.

- a virtual object 51C representing a sword exists in the VR space as an example of a virtual object corresponding to the controller 10C.

- a virtual object 51CX representing a bamboo exists in the VR space as an example of another virtual object.

- the App 812 may change the position of the movable section 130 based on the contact between the virtual object 51C corresponding to the controller 10C and the virtual object 51CX. Thereby, the contact of the virtual object 51CX with the virtual object 51C corresponding to the controller 10C can be fed back to the user. As an example, as shown in FIG. 6, the position of the movable portion 130C may be momentarily moved downwards in the controller 10C (eg, to the position of the movable portion 130CX).

- FIG. 7 is a diagram showing an example of haptic presentation to the user.

- the VR device 83 displays a VR space image 65D.

- a virtual object 51D representing a gun exists in the VR space as an example of a virtual object corresponding to the controller 10D.

- the App 812 changes the position of the movable portion 130D and causes the VCM 152 to vibrate based on the detection of a predetermined user operation on the controller 10 (for example, an operation of pressing the trigger button 162). can be controlled to This can present the user's hand with a force sensation similar to the impact given to the user's hand when the trigger of a gun is pulled.

- a predetermined user operation on the controller 10 for example, an operation of pressing the trigger button 162.

- FIG. 8 is a diagram showing another example of haptic presentation to the user.

- the VR device 83 displays a VR space image 65E

- a virtual object 51E representing a fork exists in the VR space as an example of a virtual object corresponding to the controller 10E.

- a virtual object 51EX representing a pudding exists in the VR space as an example of another virtual object.

- the App 812 may change the position of the movable part 130E and control the VCM 152 to vibrate based on the contact between the virtual object 51E corresponding to the controller 10E and the virtual object 51EX. This can present the user's hand with a tactile sensation similar to the soft feel given to the user's hand when the fork contacts the pudding.

- FIG. 9 is a diagram showing another example of haptic presentation to the user. Referring to FIG. 9, an example in which the VR device 83 displays an image 65F of the VR space is shown. In this example, a virtual object 51F representing waves exists in the VR space.

- the App 812 may change the position of the movable portion 130F and control the VCM 152 to vibrate. This can present a user's hand with a force sensation similar to the vibrations that waves give to the user's hand.

- FIG. 10 is a diagram showing an example of the relationship between the position command value of the movable part 130 and the weight of the virtual object corresponding to the controller 10.

- the position command value of the movable portion 130 corresponding to the lowest position is indicated as X1

- the position command value of the movable portion 130 corresponding to the highest position is indicated as X2.

- the lower limit is the weight corresponding to the lowest

- the upper limit is the weight corresponding to the highest.

- Such lower and upper limits can be arbitrarily set by the user.

- the App 812 controls so that a control signal (first control signal) for controlling the position of the movable section 130 is transmitted to the controller 10 at the timing of controlling the position of the movable section 130.

- the control signal includes a command value for the position of the movable portion 130 (hereinafter also referred to as a “position command value”).

- the timing for controlling the position of the movable portion 130 is as described above.

- the signal acquisition section 121 acquires the control signal transmitted from the control device 81, and the position control section 122 controls the position of the movable section 130 according to the control signal acquired by the signal acquisition section 121. do. More specifically, position control section 122 controls the position of movable section 130 based on the position command value included in the control signal acquired by signal acquisition section 121 .

- FIG. 11 is a diagram showing an example of the relationship between the position command value and the position of the movable part 130.

- FIG. below, it is assumed that the upward direction of the controller 10 is the positive direction of the position of the movable portion 130 .

- the position of the movable portion 130 changes (in the order of movable portion 130A, movable portion 130B, and movable portion 130C).

- the position of the movable part 130 may change linearly with respect to the position command value.

- the position control unit 122 may control the position of the movable unit 130 by notifying the motor driver 132 of an instruction to rotate the motor 133 according to the position command value. More specifically, the position control unit 122 considers the rotation speed and position of the motor 133 output from the encoder 134, and notifies the motor driver 132 of the rotation instruction of the motor 133 according to the position command value, thereby controlling the moving unit. The position of 130 may be controlled.

- FIG. 12 is a diagram showing an example of addition of effect signals.

- FIG. 12 similar to FIG. 11, an example of the relationship between the position command value and the position of the movable portion 130 is shown.

- a position 60 corresponds to the target position of the movable part 130 .

- an effect signal whose addition value changes with time.

- the position control section 122 may obtain an addition signal by adding the position command value and the effect signal. Then, the position control section 122 may control the position of the movable section 130 based on the addition signal.

- FIG. 13 is a diagram for explaining an example of pseudo haptic presentation using a nonlinear waveform.

- the position control unit 122 moves the movable part 130 in one vertical direction of the controller 10 and then moves the movable part 130 in the one direction opposite to the one direction of the controller 10 . It repeats moving slower than the moving speed of In this way, by creating a difference in the acceleration generated in the vertical direction, it is possible to present the user with a pseudo force sensation as if being pulled in the one direction.

- the movable part 130 is always housed in the housing E1 of the controller 10 .

- the movable part 130 may not be housed in the housing E1 of the controller 10 in some cases.

- the movable section 130 may be configured to be movable outside the housing E1 of the controller 10 .

- FIG. 14 is a diagram for explaining a modification of the movable range of the movable part 130.

- controller 11 is shown as a modified example of controller 10 .

- the controller 11 has a movable section 130 .

- the movable part 130 may be configured to be movable to the outside of the housing E1 of the controller 11 (here, the outside of the controller 11 in the downward direction).

- FIG. 15 is a diagram for explaining another modification of the movable range of the movable portion 130.

- controller 12 is shown as a modified example of controller 10 .

- the controller 12 has a movable section 130 .

- the movable part 130 may be configured to be movable to the outside of the housing E1 of the controller 12 (here, the outside of the controller 12 in the upward direction).

- the single controller 10 is held by the user's hand.

- a member (second member) other than the controller 10 may be connected to the controller 10 .

- the type of member connected to the controller 10 is not limited.

- the member connected to the controller 10 is the controller 20 (FIG. 16).

- FIG. 16 is a diagram showing a configuration example of an information processing system according to the second embodiment of the present disclosure.

- an information processing system 2 according to the second embodiment of the present disclosure includes a controller 10 and a control device 81, similar to the information processing system 1 according to the first embodiment of the present disclosure. , a camera 82 and a VR device 83 .

- the information processing system 2 according to the second embodiment of the present disclosure includes a controller 20 connected to the controller 10 .

- controller 10 The functions of the controller 10, the control device 81, the camera 82, and the VR device 83 are the same in the second embodiment of the present disclosure and the first embodiment of the present disclosure. Therefore, in the second embodiment of the present disclosure, detailed descriptions of the functions of the controller 10, control device 81, camera 82, and VR device 83 are omitted.

- the controller 20 includes a microcomputer 220 (control section), a movable section 230 (second movable section) as an example of a haptic device, a battery 240, an Amp 251, and a VCM 252 as another example of a haptic device. and

- the movable part 230 includes an origin search switch 231 , a motor driver 232 , a motor 233 and an encoder 234 .

- the movable part 230 has a substrate (not shown) on which these components are arranged.

- the functions of the movable section 230, the battery 240, the Amp 251 and the VCM 252 are the same as the functions of the movable section 130, the battery 140, the Amp 151 and the VCM 152 according to the first embodiment of the present disclosure. Therefore, detailed descriptions of the functions of battery 240, Amp 251 and VCM 252 are omitted.

- a functional configuration example of the microcomputer 220 will be described with reference to FIG.

- FIG. 17 is a diagram showing a functional configuration example of the microcomputer 220. As shown in FIG. As shown in FIG. 17 , the microcomputer 220 has a signal acquisition section 221 and a position control section 222 . Functions of the signal acquisition unit 221 and the position control unit 222 will be described later in detail. Returning to FIG. 16, the description continues.

- microcomputer 220 may be incorporated in the microcomputer 120 included in the controller 10. At this time, the controller 20 is also electrically connected to the controller 10 . Alternatively, if a microcomputer exists outside controller 10 and controller 20 , the functions of microcomputer 220 may be incorporated in the microcomputer outside controller 10 and controller 20 .

- the control device 81 is connected to each of the controller 10, camera 82 and VR device 83 by wire or wirelessly. In addition, the control device 81 is connected to the controller 20 by wire or wirelessly.

- the connection relationship between the controller 10 and the controller 20 may be one. However, in the embodiment of the present disclosure, it is mainly assumed that there are multiple connection relationships between the controller 10 and the controller 20 .

- the connection relationship between controller 10 and controller 20 may be the angle between controller 10 and controller 20 . More specifically, it is mainly assumed that the angle between the controllers 10 and 20 is 90 degrees and that the angle between the controllers 10 and 20 is 0 degrees.

- FIG. 18 is a diagram showing an example of using controllers when the angle between the controllers is 90 degrees.

- controller 10 and controller 20 are connected so that the angle between controller 10 and controller 20 is 90 degrees.

- a movable part 130 exists inside the housing E1 of the controller 10 .

- a movable part 230 exists inside the housing E2 of the controller 20 .

- the controller 20 is held by the user's hand.

- the direction away from the user's hand is also referred to as the "upward direction of the controller” for convenience.

- the direction in which the controller 10 approaches the user's hand is also referred to as the “downward direction of the controller” for convenience. Note that the user can also hold the controller 10 by hand.

- the App 812 transmits a control signal (first control signal) for controlling the position of the movable portion 130 to the controller 10 at the timing of controlling the position of the movable portion 130 and the position of the movable portion 230. and control so that the control signal (first control signal) is transmitted to the controller 20 .

- the control signal includes a position command value.

- the signal acquisition section 121 acquires the control signal transmitted from the control device 81, and the position control section 122 controls the position of the movable section 130 according to the control signal acquired by the signal acquisition section 121. do. More specifically, position control section 122 controls the position of movable section 130 based on the position command value included in the control signal acquired by signal acquisition section 121 .

- the signal acquisition section 221 acquires the control signal transmitted from the control device 81, and the position control section 222 controls the position of the movable section 230 according to the control signal acquired by the signal acquisition section 221. do. More specifically, the position control section 222 controls the position of the movable section 230 based on the position command value included in the control signal acquired by the signal acquisition section 221 .

- FIG. 19 is a diagram showing an example of the relationship between the position command value and the positions of the movable portion 130 and the movable portion 230.

- FIG. Here, it is assumed that the downward direction of the controller 10 is the positive direction of the position of the movable portion 130 and the downward direction of the controller 20 is the positive direction of the movable portion 230 .

- the position of the movable portion 130 changes (in the order of movable portion 130A, movable portion 130B, and movable portion 130C).

- the controllers 10A-10C For example, the position of the movable part 130 may change linearly with respect to the position command value.

- the position of the movable portion 230 changes (in the order of the movable portion 230A, the movable portion 230B, and the movable portion 230C). It may change down the controllers 20A-20C. For example, the position of the movable part 230 may change linearly with respect to the position command value.

- the movable part 130 and the movable part 230 move simultaneously with respect to one position command value.

- the center-of-gravity positions (60A, 60B, 60C) of the movable part 130 and the movable part 230 change so as to draw a trajectory close to a straight line, and the user may feel an unnatural change in the center-of-gravity position. can be reduced.

- the position control unit 122 may control the position of the movable unit 130 by notifying the motor driver 132 of an instruction to rotate the motor 133 according to the position command value.

- the position control section 222 may control the position of the movable section 230 by notifying the motor driver 232 of an instruction to rotate the motor 233 according to the position command value.

- FIG. 20 is a diagram for explaining an example of controlling the position of the movable section 130 and the position of the movable section 230 according to the virtual object corresponding to the combination of the controllers 10 and 20.

- FIG. 20 a virtual object 52A representing a gun exists in the VR space as an example of a virtual object corresponding to the combination of the controller 10 and the controller 20.

- FIG. 20

- a virtual object 52B representing a gun exists in the VR space as an example of a virtual object corresponding to the combination of the controller 10 and the controller 20. Also, referring to FIG. 20, as an example of a virtual object corresponding to the combination of the controller 10 and the controller 20, a virtual object 52C representing a gun exists in the VR space.

- the App 812 may control the position of the movable section 130 and the position of the movable section 230 based on predetermined parameters of the virtual object corresponding to the combination of the controller 10 and the controller 20.

- the predetermined parameter may include the weight of the virtual object.

- the weight of the virtual object is preset in the App812.

- the App 812 may then control the positions of the movable section 130 and the movable section 230 based on the weight of the virtual object.

- the App 812 may control the positions of the movable section 130 and the movable section 230 such that the greater the weight of the virtual object, the farther away from the gripping position of the controller 20 by the user.

- the App 812 may move the movable part 130 upwards of the controller 10 and the movable part 230 upwards of the controller 20 more greatly as the weight of the virtual object increases.

- the weight of the virtual object 52A is the largest

- the weight of the virtual object 52B is the second largest

- the weight of the virtual object 52C is the smallest.

- the App 812 moves the movable portion 130B and the movable portion 230B corresponding to the virtual object 52B downward from the movable portion 130A and the movable portion 230A corresponding to the virtual object 52A. and the movable portion 130C and the movable portion 230C corresponding to the virtual object 52C may be moved downward from the movable portion 230B.

- FIG. 21 is a diagram showing an example of using the controllers when the angle between the controllers is 0 degrees.

- controller 10 and controller 20 are connected so that the angle between controller 10 and controller 20 is 0 degrees.

- a movable part 130 exists inside the housing E1 of the controller 10 .

- a movable part 230 exists inside the housing E2 of the controller 20 .

- the controller 20 is held by the user's hand.

- the user can also hold the controller 10 by hand.

- the App 812 controls so that a control signal (first control signal) for controlling the position of the movable section 130 is transmitted to the controller 10 at the timing of controlling the position of the movable section 130.

- the control signal includes a position command value.

- the App 812 controls so that a control signal (second control signal) for controlling the position of the movable section 230 is transmitted to the controller 20 at the timing of controlling the position of the movable section 230 .

- the control signal includes a position command value.

- control signal for controlling the position of movable part 130 and the control signal for controlling the position of movable part 230 are different control signals.

- An example of timing for controlling the position of the movable portion 130 and the position of the movable portion 230 will be described later with reference to FIG. 23 .

- the signal acquisition section 121 acquires the control signal (first control signal) transmitted from the control device 81, and the position control section 122 follows the control signal acquired by the signal acquisition section 121. It controls the position of the movable part 130 . More specifically, position control section 122 controls the position of movable section 130 based on the position command value included in the control signal acquired by signal acquisition section 121 .

- the signal acquisition section 221 acquires the control signal (second control signal) transmitted from the control device 81, and the position control section 222 follows the control signal acquired by the signal acquisition section 221. It controls the position of the movable part 230 . More specifically, the position control section 222 controls the position of the movable section 230 based on the position command value included in the control signal acquired by the signal acquisition section 221 .

- FIG. 22 is a diagram showing an example of the relationship between the position command value and the position of the movable part 130 and the position of the movable part 230.

- FIG. it is assumed that the downward direction of the controller 10 is the positive direction of the position of the movable portion 130 and the downward direction of the controller 20 is the positive direction of the movable portion 230 .

- the position of the movable portion 130 changes (in the order of the movable portion 130A and the movable portion 130B) of the controllers 10A to 10B. May change downwards.

- the position of the movable part 130 may change linearly with respect to the position command value.

- the position of the movable section 230 moves (in the order of the movable section 230B and the movable section 230C) to the position below the controllers 20B to 20C. direction may change.

- the position of the movable part 230 may change linearly with respect to the position command value.

- the movable part 130 and the movable part 230 move continuously with respect to different position command values.

- the center-of-gravity positions (60A, 60B, 60C) of the movable part 130 and the movable part 230 gradually change so as to draw a trajectory close to a straight line. .

- FIG. 23 is a diagram for explaining an example of controlling the position of the movable section 130 and the position of the movable section 230 according to the virtual object corresponding to the combination of the controller 10 and the controller 20.

- FIG. 23 a virtual object 53A representing a sword exists in the VR space as an example of a virtual object corresponding to the combination of the controller 10 and the controller 20.

- FIG. 23

- a virtual object 53B representing a sword exists in the VR space as an example of a virtual object corresponding to the combination of the controller 10 and the controller 20.

- a virtual object 53C representing a sword exists in the VR space as an example of a virtual object corresponding to the combination of the controller 10 and the controller 20.

- the App 812 may move the movable section 130 in the upward direction of the controller 10 by a greater amount as the weight of the virtual object increases. Also, the App 812 may move the movable section 230 in the upward direction of the controller 20 by a greater amount as the weight of the virtual object increases.

- the weight of the virtual object 53A is the largest

- the weight of the virtual object 53B is the second largest

- the weight of the virtual object 53C is the smallest.

- the App 812 may move the movable part 130B corresponding to the virtual object 53B downward more than the movable part 130A corresponding to the virtual object 53A. Also, the App 812 may move the movable portion 230C corresponding to the virtual object 53C downward more than the movable portion 230B corresponding to the virtual object 53B.

- the size of the virtual object is preset in the App 812 . Therefore, the predetermined parameter of the virtual object corresponding to the combination of controller 10 and controller 20 may include the size of the virtual object corresponding to the combination of controller 10 and controller 20 . The App 812 may then control the positions of the movable section 130 and the movable section 230 based on the size of the virtual object.

- the App 812 may move the positions of the movable section 130 and the movable section 230 upward as the virtual object becomes larger.

- the App 812 may move the positions of the movable section 130 and the movable section 230 upward as the virtual object becomes larger.

- control example of the position of the movable part 130 and the position of the movable part 230 is not limited to such an example.

- control examples of the position of the movable part 130 and the position of the movable part 230 may be set in advance along with the progress of the App 812 .

- the App 812 may control the position of the movable section 130 and the position of the movable section 230 based on its own progress.

- the App 812 may vary the combination of control of the position of the movable section 130 and the position of the movable section 230 according to the connection relationship between the controller 10 and the controller 20.

- App 812 may determine a combination of control of the position of movable section 130 and the position of movable section 230 according to the angle between controller 10 and controller 20 .

- the angle between the controller 10 and the controller 20 when the angle between the controller 10 and the controller 20 is 0 degrees, the positions of the movable part 130 and the position of the movable part 230 are controlled based on separate control signals.

- the example in which control is performed based on the same control signal when the angle between and is 90 degrees has been described.

- the angle between controller 10 and controller 20 may be other than 0 degrees and 90 degrees.

- the App 812 controls the positions of the movable section 130 and the movable section 230 based on separate control signals when the angle between the controller 10 and the controller 20 is equal to or less than a predetermined angle (eg, 0 degree).

- a predetermined angle eg, 0 degree

- the App 812 controls the positions of the movable section 130 and the movable section 230 based on the same control signal. You may

- connection relationship between the controller 10 and the controller 20 may be selectable by the user.

- the connection relationship between the controller 10 and the controller 20 changes according to the shape of the joint selected by the user.

- the controller 10 and the controller 20 each exist alone, the controller 10 and the controller 20 may each be fitted with a removable cap.

- FIG. 24 is a diagram showing how the cap is removed from the controller 10.

- a cap 76A is fitted to the controller 10, and the cap 76A may be manually removable from the controller 10 by the user. Also, as shown in FIG. 24, the recess of the controller 10 may be exposed after the cap 76A is removed.

- FIG. 25 is a diagram showing an example of connection between the controller 10 and the controller 20 via joints.

- the cap 76B is also fitted to the controller 20, and the cap 76B may be manually removable from the controller 20 by the user. Also, the recess of the controller 20 may be exposed after the cap 76B is removed.

- the user may be able to fit the joint 77 into the recess of the controller 10 and the recess of the controller 20 .

- the controller 10 and the controller 20 are connected at a predetermined angle (here, 90 degrees).

- connection relationship between the controller 10 and the controller 20 may be recognized in any way.

- App 812 may recognize the connection relationship between controller 10 and controller 20 based on sensor data obtained from a predetermined sensor.

- the type of sensor is not limited.

- the controller 10 and the controller 20 are each provided with an acceleration sensor.

- the sensor data may include acceleration measured by the acceleration sensor. That is, the App 812 recognizes the direction of gravity based on the orientation of each of the controller 10 and the controller 20 based on the acceleration measured by these acceleration sensors, and based on the recognized direction of gravity, the controller 10 and the controller 20 connection relationship may be recognized.

- the sensor data may include images captured by the camera 82 . That is, the App 812 may recognize the shape of the joint 77 based on the image captured by the camera 82 and recognize the connection relationship between the controller 10 and the controller 20 based on the recognized shape of the joint 77 .

- the App 812 recognizes the color of the joint 77 based on the image captured by the camera 82, and determines the connection relationship between the controller 10 and the controller 20 based on the shape corresponding to the recognized color of the joint 77. may be recognized.

- the App 812 may attempt to recognize the joint 77 based on the image captured by the camera 82. Then, the App 812 may recognize the connection relationship between the controller 10 and the controller 20 appearing in the image captured by the camera 82 using recognition of the joint 77 as a trigger.

- Controller 10 and controller 20 may be directly connected without any other member.

- connecting portions are provided at a plurality of different locations on the controller 20, and by changing the connecting portion of the controller 20 with which the connecting portions of the controller 10 are brought into contact, the connection relationship between the controller 10 and the controller 20 can be changed.

- the microcomputer 120 and the microcomputer 220 may recognize which connection parts are in contact by receiving an electrical signal from the contact parts caused by the contact between the connection parts.

- the combination of the connecting portion of the controller 10 and the connecting portion of the controller 20 may be configured by combining a magnet and a terminal.

- FIG. 26 is a diagram showing an example of direct connection between controllers forming an angle of 0 degrees.

- connection portions 78A to 78C are provided on the bottom surface of the controller 10.

- connecting portions 79A to 79C are provided on the upper surface of the controller 20.

- the connecting portions 78A to 78C are formed by convex portions

- the connecting portions 79A to 79C are formed by concave portions

- the connecting portions 78A to 78C are fitted to the connecting portions 79A to 79C, whereby the controller 10 and the controller 20 are connected. are connected at an angle of 0 degrees.

- the connecting portions 78A to 78C may be configured by concave portions

- the connecting portions 79A to 79C may be configured by convex portions.

- connection portions 78A to 78C and the connection portions 79A to 79C may be attracted to each other by magnetic force.

- connecting portions 79D to 79F are provided on the side surface of the controller 20, connecting portions 79D to 79F are provided.

- the connection portions 79D to 79F are used for direct connection between controllers forming an angle of 90 degrees. An example of this is described below with reference to FIG.

- FIG. 27 is a diagram showing an example of direct connection between controllers forming an angle of 90 degrees.

- the connecting portions 78A to 78C are formed by convex portions

- the connecting portions 79D to 79F are formed by concave portions

- the connecting portions 78A to 78C are fitted to the connecting portions 79D to 79F

- Controller 10 and controller 20 are connected at an angle of 90 degrees.

- the connecting portions 78A to 78C may be configured by concave portions

- the connecting portions 79D to 79F may be configured by convex portions.

- connection portions 78A to 78C and the connection portions 79D to 79F may be attracted to each other by magnetic force.

- the connecting portions of the controller 20 are provided at a plurality of different locations (upper surface and side surface) has been described.

- the connecting portions of the controller 10 may be provided at different locations.

- the connection relationship between the controller 10 and the controller 20 may be changed by changing the connection portion of the controller 10 with which the connection portion of the controller 20 is brought into contact.

- FIG. 28 is a diagram showing a display example of guidance prompting connection between controllers.

- guidance is displayed on the VR device 83 prompting connection between the controllers.

- the guidance includes a message prompting the connection of the controllers (here, the message "Put the left-hand controller on top of the right-hand controller so that it forms a sword shape") and an image of the two controllers after connection. and are included.

- FIG. 29 is a diagram showing the state of the two controllers before and after connection according to the guidance. Referring to the left half of FIG. 29, the user holds controller 10 in his left hand and controller 20 in his right hand. When the user follows the guidance and puts the left-hand controller 10 on top of the right-hand controller 20, the controller 10 is connected on top of the controller 20 as shown in the right half of FIG.

- the first embodiment of the present disclosure has mainly described the case of one controller, and the second embodiment of the present disclosure has mainly described the case of two controllers. However, more than two controllers may be connected together. Even in such a case, connection at arbitrary points among the three or more controllers may be made in the same manner as the connection between controllers described in the second embodiment of the present disclosure.

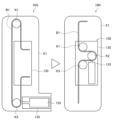

- FIG. 30 is a diagram showing a state in which four controllers are connected to each other.

- controller 10 and controller 20 are connected, controller 20 and controller 30 are connected, controller 30 and controller 40 are connected, and controller 40 and controller 10 are connected.

- the controller 30 has a movable portion 330 and the controller 40 has a movable portion 430 .

- the functions of the controllers 30 and 40 may be the same as the functions of the controller 10 . Therefore, detailed description of the functions of each of the controllers 30 and 40 is omitted. As a specific application example, it is assumed that the user is presented with a force sensation similar to the force sensation given to the user's hand when the weight moves on the plate inside the controllers 10 to 40. be done.

- FIG. 31 is a diagram showing a control example of movable parts provided in each of the four controllers. Referring to FIG. 31, three combinations of the positions of the movable parts 130 to 430 (that is, the movable parts 130A to 430A provided in the controllers 10A to 40A, the movable parts 130B to 430B provided in the controllers 10B to 40B, Movable parts 130C-430C) provided in controllers 10C-40C are shown.

- the position command value X controls the positions of the movable parts 230 and 430

- the position command value Y controls the positions of the movable parts 130 and 330 . That is, the App 812 may provide two or more dimensional position command values to three or more controllers when three or more controllers are connected to each other. This allows finer control over the haptic presented to the user.

- a member (second member) connected to one controller may be a member other than the controller (hereinafter also referred to as an "attachment member").

- the attached member can also be referred to as an "attachment.”

- FIG. 32 is a diagram showing an example in which the controller and attached members are connected. Referring to FIG. 32, controller 10 and attachment member 71 are connected.

- the attachment member 71 is formed to imitate the shape of the grip portion of a sword, and the lower surface of the controller 10 and the attachment member 71 are connected.

- the member held by the user's hand is the attached member 71, and by moving the controller 10 away from the holding position, it is possible to increase the moment of the movable portion 130 with a slight change in the position of the movable portion 130. It becomes possible.

- the controller 10 may be moved away from the gripping position by connecting the controller 10 upward to the attachment member 71 .

- the attached member 71 does not have a function as a controller and does not have a battery. Therefore, normally, the attached member 71 receives an operation of pressing a button from the user or presents vibration to the user by means of a VCM. It is considered difficult to

- the controller 10 has a battery 140.

- the controller 10 may then provide the power of the battery 140 to the accessory member 71 . This allows the attachment member 71 to operate using power provided by the controller 10 .

- the attached member 71 can use the power provided from the controller 10 to accept an operation of pressing a button from the user, or to present vibration to the user through VCM.

- the connecting portions of the controller 10 and the attached member 71 are preferably made of a material that conducts electricity.

- FIG. 33 is a diagram showing another example in which the controller and attached members are connected. Referring to FIG. 33, controller 10 and attachment member 72 are connected.

- the attachment member 72 is formed to imitate the shape of the grip portion of a gun, and the lower surface of the controller 10 and the attachment member 72 are connected.

- the member held by the user's hand is the attached member 72, and by moving the controller 10 away from the holding position, it is possible to increase the moment of the movable portion 130 with a slight change in the position of the movable portion 130. It becomes possible.

- the controller 10 may be moved away from the gripping position by connecting the controller 10 upwardly of the attachment member 72 .

- the controller 10 may provide the power of the battery 140 to the attachment member 72 . This allows attachment member 72 to operate using power provided by controller 10 . At this time, since the controller 10 and the attached member 72 must be electrically connected, the connecting portions of the controller 10 and the attached member 72 are preferably made of a material that conducts electricity.

- the attached member 71 shown in FIG. 32 and the attached member 72 shown in FIG. 33 have different shapes. These attachment member 71 and attachment member 72 may be separately prepared in advance. Alternatively, it may be possible for the user to arbitrarily create either the attached member 71 or the attached member 72 by rearranging the shape of one attached member.

- FIG. 34 is a diagram showing an example in which two controllers are each connected to an attached member. As shown in FIG. 34 , not only the controller 10 and the attached member 73 are connected, but also the controller 20 may be connected to the attached member 73 .

- controller 10 and the controller 20 may be fitted into the two grooves.

- controller 10 and controller 20 may be connectable in parallel to attachment member 73 . Controller 10 and controller 20 may thereby correspond to the grip portion of a handle formed by controller 10 , attachment 73 and controller 20 .

- the position of the movable part 130 and the position of the movable part 230 may be controlled according to one position command value.

- 35A and 35B are diagrams showing control examples of the movable parts provided in each of the two controllers connected to the attached member 73.

- FIG. 35 three combinations of the positions of the movable parts 130 and the movable parts 230 (that is, the movable parts 130A and 230A provided in the controllers 10A and 20A, the movable parts 130B provided in the controllers 10B and 20B, 230B, movable parts 130C, 230C provided in the controllers 10C, 20C) are shown.

- the position of the movable part 130 and the position of the movable part 230 are controlled by one position command value. Then, according to the change in the position command value, the position of movable portion 130 and the position of movable portion 230 change in opposite directions. This can present the user with a force sensation in the direction in which the handle rotates.

- FIG. 36 is a diagram showing an example in which two controllers are connected to attached members. As shown in FIG. 36 , not only the controller 10 and the attached member 74 are connected, but also the controller 20 may be further connectable to the attached member 74 .

- a groove may be formed in the attachment member 74, and the controller 20 may be fitted into the groove.

- controller 20 may be connectable in an orientation orthogonal to the orientation of attachment member 74 . Accordingly, the controller 20 can correspond to the sword guard portion of the sword formed by the controller 10 , the attachment member 74 and the controller 20 .

- movable portion 230 may be controlled by App 812 to vibrate. This may present the user's hand with a haptic similar to the haptic experienced by the user's hand when the sword is impacted.

- FIG. 37 is a diagram showing an example of the relationship between the position command value and the position of the movable part 130.

- FIG. Here, it is assumed that the upward direction of the controller 10 is the positive direction of the position of the movable portion 130 .

- the position of the movable portion 130 changes (in the order of movable portion 130A, movable portion 130B, and movable portion 130C).

- the position of the movable part 130 may vary upwards of the controllers 10A-10C.

- the position of the movable part 130 may change linearly with respect to the position command value.

- the position of movable part 230 does not have to change based on the position command value.

- FIG. 38 is a diagram showing an example in which the attached member 71 is connected to two types of controllers. Referring to FIG. 38, not only the controller 10 and the attached member 71 are connected, but also the attached member 71 and the controller 21 are connected.

- the controller 21 is a general controller with no moving parts according to embodiments of the present disclosure.

- tools of various shapes for example, swords, guns, etc. can be created by changing the shape of the attached member 71.

- the part that is held by the user's hand is not the attached member 71 but the controller 21 and has a battery. Therefore, it becomes possible for the controller 21 to receive an operation of pressing a button from the user, and to present vibration to the user through the VCM. Along with this, the controller 10 does not need to be provided with a battery and buttons, so that a moving space for the movable part 130 can be easily secured.

- the controller 21 may provide battery power to the controller 10 via the accessory member 71 . This allows controller 10 to operate using power provided from controller 21 . More specifically, the controller 10 can move the movable part 130 using the electric power provided from the controller 21 .

- the connecting portions of the controller 10 and the attached member 71 are preferably made of a material that conducts electricity.

- the connecting portions of the controller 21 and the attached member 71 are preferably made of a material that conducts electricity.

- FIG. 39 is a diagram for explaining a first modification regarding movement of the movable section 130.

- a movable section 130 is provided inside a housing E11 of the controller 10.

- the position control section 122 may change the position of the movable section 130 so as to draw a curved line based on the position command value.

- the housing E11 may have a grip portion E12 that is gripped by the user's hand.

- FIG. 40 is a diagram for explaining a second modification regarding the movement of the movable section 130.

- a movable section 130 is provided inside a housing E13 of the controller 10. As shown in FIG. Further, the housing E13 is connected to a housing E14 held by the user via a rotating shaft E15.

- the position control section 122 may change the position of the movable section 130 so as to draw a curve by rotating the housing E13 about the rotation axis E15 based on the position command value.

- FIG. 41 is a diagram for explaining a third modification regarding the movement of the movable section 130.

- a movable part 130 is provided inside an elongated housing E16. Further, the housing E16 is connected to a housing E14 held by the user via a rotating shaft E15.

- the position control section 122 may change the position of the movable section 130 so as to draw a curve by rotating the housing E16 with respect to the rotation axis E15 based on the position command value.

- FIG. 42 is a diagram for explaining a fourth modification regarding the movement of the movable section 130.

- FIG. 42 the controller 10 according to the second modification shown in FIG. 40 is shown.

- FIG. 42 also shows a controller 20 according to the second embodiment of the present disclosure, in which a housing E13 of the controller 10 and the controller 20 are connected.

- the position control unit 122 may change the position of the movable unit 130 so as to draw a curve by rotating the housing E13 with respect to the rotation axis E15 based on the position command value.

- the position of the movable portion 230 provided in the controller 20 also changes so as to draw a curved line.

- a gun-shaped tool is created.

- the position control unit 122 can create a sword-shaped tool by rotating the housing E13 so that the housing E14 and the housing E13 are aligned in a straight line.

- FIG. 43 is a diagram for explaining a first configuration example of the movable section 130.

- a controller 10G as an example of the controller 10 is shown.

- a movable part 130 and a substrate 135 are provided in the controller 10G.

- a motor 133 is arranged on the substrate 135 . That is, the motor 133 exists outside the movable portion 130 .

- the controller 10G is provided with a pulley K1, a pulley K2 and a belt B1.

- a movable portion 130 is connected to both ends of the belt B1. Further, the pulley K1 and the pulley K2 are in contact with the same side of the belt B1 and fixed to the housing E1. In this state, when the motor 133 applies a rotational driving force to the pulley K2, the belt B1 moves in contact with the pulley K1 and the pulley K2 as the pulley K2 rotates, and the movable portion 130 connected to the belt B1 moves. moves up and down.

- the motor 133 which is the main heavy object, exists outside the movable part 130. Therefore, the weight ratio of the movable part 130 relative to the overall weight of the controller 10G is not very high, and it is difficult to improve the quality of the force sensation presented to the user.

- a controller 10H as an example of the controller 10 is also shown.

- a substrate 135 is provided in the controller 10H, and a motor 133 is provided in the movable section 130.

- a battery may also be located on substrate 135 . At this time, the battery is also included in the movable part 130 .

- the controller 10H is provided with pulleys K1 to K3 and a belt B1. Both ends of the belt B1 are connected to the housing E1.

- the pulleys K1, K3, and K2 are in contact with the opposite side of the belt B1, and the pulleys K1 to K3 are connected to the movable portion .

- the motor 133 and the battery are inside the movable part 130. Therefore, since the weight ratio of the movable part 130 with respect to the overall weight of the controller 10H is increased, the quality of the haptic sensation presented to the user is improved.

- FIG. 44 is a diagram for explaining the details of the first configuration example of the movable section 130.

- rails R1 and R2 are fixed to housing E1, and movable section 130 is configured to be movable on these rails R1 and R2.

- the substrate 135 is one layer in the example shown in FIG. 44, the substrate 135 may be divided into a plurality of layers. The multiple layers may then be configured to overlap each other.

- FIG. 45 is a diagram for explaining a second configuration example of the movable section 130.

- a controller 10J as an example of the controller 10 is shown.

- the controller 10J is provided with a board 135 on which a motor 133 is arranged.

- Board 135 and motor 133 are included in movable portion 130 .

- a battery may also be located on substrate 135 . At this time, the battery is also included in the movable part 130 .

- the controller 10J is provided with pulleys K1 and K2 and a belt B1. Both ends of the belt B1 are connected to the housing E1. Also, the pulley K1 and the pulley K2 are in contact with the opposite side of the belt B1, and the pulley K1 and the pulley K2 are connected to the movable portion 130 .

- the motor 133 and the battery exist inside the movable part 130 . Therefore, the weight ratio of the movable part 130 relative to the overall weight of the controller 10J is increased, so the quality of the force sensation presented to the user is improved.

- FIG. 46 is a diagram for explaining the details of the second configuration example of the movable section 130.

- rails R1 and R2 are fixed to housing E1, and movable section 130 is configured to be movable on these rails R1 and R2.

- the substrate 135 is one layer in the example shown in FIG. 46, the substrate 135 may be divided into a plurality of layers. The multiple layers may then be configured to overlap each other.

- FIG. 47 is a diagram for explaining a third configuration example of the movable section 130.

- a controller 10L as an example of the controller 10 is shown.

- a board 135 is provided in the controller 10L, and a motor 133 is arranged on the board 135 .

- Board 135 and motor 133 are included in movable portion 130 .

- a battery may also be located on substrate 135 . At this time, the battery is also included in the movable part 130 .

- the controller 10L is provided with a pulley K1, a belt B2 and a belt B3.

- One end of the belt B2 is connected to the housing E1, and the other end is connected to the pulley K1.

- One end of the belt B3 is connected to the housing E1, and the other end is connected to the pulley K1.

- the belts B2 and B3 are wound around the pulley K1 in opposite directions.

- the motor 133 applies a rotational driving force (for example, a counterclockwise rotational driving force when viewed from above the paper surface) to the pulley K1

- a rotational driving force for example, a counterclockwise rotational driving force when viewed from above the paper surface

- the belt B2 is applied to the pulley K1 as the pulley K1 rotates.

- the amount of winding increases, the amount of winding of the belt B3 around the pulley K1 decreases, the pulley K1 rises, and the movable portion 130 connected to the pulley K1 moves upward.

- the controller 10M is the controller after the movable part 130 has moved upward.

- the motor 133 gives a rotational driving force (for example, a clockwise rotational driving force when viewed from above the paper surface) to the pulley K1

- a rotational driving force for example, a clockwise rotational driving force when viewed from above the paper surface

- the winding amount of the belt B2 around the pulley K1 decreases as the pulley K1 rotates.

- the amount of winding of the belt B3 around the pulley K1 increases, the pulley K1 descends, and the movable part 130 connected to the pulley K1 moves downward.

- the motor 133 and the battery exist inside the movable part 130 . Therefore, since the weight ratio of the movable part 130 with respect to the overall weight of the controller 10L is increased, the quality of the haptic sensation presented to the user is improved.

- a first member provided with a first movable portion, a second member connected to the first member, and controlling the position of the first movable portion

- An information processing apparatus comprising: a signal acquisition section that acquires a first control signal for the control; and a position control section that controls the position of the first movable section according to the first control signal.

- a first member provided with a first movable portion; a second member connected to the first member; a signal acquisition unit that acquires a first control signal for controlling the position of the first movable unit; a position control section that controls the position of the first movable section according to the first control signal; An information processing device.

- the second member is provided with a second movable portion, The position control section controls the position of the second movable section according to the first control signal or a second control signal different from the first control signal.

- the combination of position control of the first movable part and the second movable part differs depending on the connection relationship between the first member and the second member, The information processing device according to (2) above.

- the connection relationship includes an angle between the first member and the second member; the combination is determined based on the angle; The information processing device according to (3) above.

- the angle between the first member and the second member is equal to or less than a predetermined angle, the position of the first movable portion is controlled based on the first control signal, and the second The position of the second movable part is controlled based on the control signal of The information processing device according to (4) above.