WO2022045210A1 - 画像処理装置、画像処理方法、学習装置、学習方法、及びプログラム - Google Patents

画像処理装置、画像処理方法、学習装置、学習方法、及びプログラム Download PDFInfo

- Publication number

- WO2022045210A1 WO2022045210A1 PCT/JP2021/031218 JP2021031218W WO2022045210A1 WO 2022045210 A1 WO2022045210 A1 WO 2022045210A1 JP 2021031218 W JP2021031218 W JP 2021031218W WO 2022045210 A1 WO2022045210 A1 WO 2022045210A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- image

- noise

- radiation

- radiographic

- radiation image

- Prior art date

Links

- 238000012545 processing Methods 0.000 title claims abstract description 296

- 238000000034 method Methods 0.000 title claims description 133

- 238000003672 processing method Methods 0.000 title claims description 8

- 238000012549 training Methods 0.000 claims abstract description 67

- 230000005855 radiation Effects 0.000 claims description 293

- 230000008569 process Effects 0.000 claims description 98

- 238000006243 chemical reaction Methods 0.000 claims description 91

- 238000010801 machine learning Methods 0.000 claims description 50

- 230000006870 function Effects 0.000 claims description 40

- OAICVXFJPJFONN-UHFFFAOYSA-N Phosphorus Chemical compound [P] OAICVXFJPJFONN-UHFFFAOYSA-N 0.000 claims description 31

- 230000002238 attenuated effect Effects 0.000 claims description 19

- 239000006185 dispersion Substances 0.000 claims description 15

- 238000013528 artificial neural network Methods 0.000 claims description 12

- 230000015572 biosynthetic process Effects 0.000 claims description 12

- 238000003786 synthesis reaction Methods 0.000 claims description 11

- 238000012546 transfer Methods 0.000 claims description 7

- 230000002194 synthesizing effect Effects 0.000 claims description 6

- 239000002131 composite material Substances 0.000 claims description 3

- 230000009467 reduction Effects 0.000 description 53

- 238000002601 radiography Methods 0.000 description 21

- 238000013527 convolutional neural network Methods 0.000 description 20

- 230000000875 corresponding effect Effects 0.000 description 19

- 230000004048 modification Effects 0.000 description 11

- 238000012986 modification Methods 0.000 description 11

- 230000000694 effects Effects 0.000 description 8

- 238000004364 calculation method Methods 0.000 description 6

- 238000007781 pre-processing Methods 0.000 description 6

- 238000013526 transfer learning Methods 0.000 description 6

- 238000003384 imaging method Methods 0.000 description 5

- 238000003062 neural network model Methods 0.000 description 5

- 230000009466 transformation Effects 0.000 description 5

- 239000000654 additive Substances 0.000 description 4

- 230000000996 additive effect Effects 0.000 description 4

- 238000007689 inspection Methods 0.000 description 4

- 238000012805 post-processing Methods 0.000 description 4

- 230000008859 change Effects 0.000 description 3

- 230000001066 destructive effect Effects 0.000 description 3

- 238000010586 diagram Methods 0.000 description 3

- 238000010606 normalization Methods 0.000 description 3

- 238000011946 reduction process Methods 0.000 description 3

- 239000004065 semiconductor Substances 0.000 description 3

- 238000012935 Averaging Methods 0.000 description 2

- 241001465754 Metazoa Species 0.000 description 2

- 239000002775 capsule Substances 0.000 description 2

- 238000013135 deep learning Methods 0.000 description 2

- 238000003745 diagnosis Methods 0.000 description 2

- 238000005516 engineering process Methods 0.000 description 2

- 210000002569 neuron Anatomy 0.000 description 2

- 239000002245 particle Substances 0.000 description 2

- 210000001015 abdomen Anatomy 0.000 description 1

- 230000004913 activation Effects 0.000 description 1

- 229910021417 amorphous silicon Inorganic materials 0.000 description 1

- JJWKPURADFRFRB-UHFFFAOYSA-N carbonyl sulfide Chemical compound O=C=S JJWKPURADFRFRB-UHFFFAOYSA-N 0.000 description 1

- 230000001276 controlling effect Effects 0.000 description 1

- 230000002596 correlated effect Effects 0.000 description 1

- 238000010168 coupling process Methods 0.000 description 1

- 229910021419 crystalline silicon Inorganic materials 0.000 description 1

- 238000003066 decision tree Methods 0.000 description 1

- 230000003247 decreasing effect Effects 0.000 description 1

- 230000010339 dilation Effects 0.000 description 1

- 230000014509 gene expression Effects 0.000 description 1

- 238000009499 grossing Methods 0.000 description 1

- 238000010191 image analysis Methods 0.000 description 1

- 230000000415 inactivating effect Effects 0.000 description 1

- 238000009434 installation Methods 0.000 description 1

- 239000000463 material Substances 0.000 description 1

- 238000005259 measurement Methods 0.000 description 1

- 239000000203 mixture Substances 0.000 description 1

- 230000001537 neural effect Effects 0.000 description 1

- 230000003287 optical effect Effects 0.000 description 1

- 230000002093 peripheral effect Effects 0.000 description 1

- 230000000717 retained effect Effects 0.000 description 1

- 238000001228 spectrum Methods 0.000 description 1

- 230000000087 stabilizing effect Effects 0.000 description 1

- 238000012706 support-vector machine Methods 0.000 description 1

- 230000008685 targeting Effects 0.000 description 1

- 238000013519 translation Methods 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T5/00—Image enhancement or restoration

- G06T5/70—Denoising; Smoothing

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus or devices for radiation diagnosis; Apparatus or devices for radiation diagnosis combined with radiation therapy equipment

- A61B6/52—Devices using data or image processing specially adapted for radiation diagnosis

- A61B6/5258—Devices using data or image processing specially adapted for radiation diagnosis involving detection or reduction of artifacts or noise

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus or devices for radiation diagnosis; Apparatus or devices for radiation diagnosis combined with radiation therapy equipment

- A61B6/42—Arrangements for detecting radiation specially adapted for radiation diagnosis

- A61B6/4208—Arrangements for detecting radiation specially adapted for radiation diagnosis characterised by using a particular type of detector

- A61B6/4225—Arrangements for detecting radiation specially adapted for radiation diagnosis characterised by using a particular type of detector using image intensifiers

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus or devices for radiation diagnosis; Apparatus or devices for radiation diagnosis combined with radiation therapy equipment

- A61B6/42—Arrangements for detecting radiation specially adapted for radiation diagnosis

- A61B6/4208—Arrangements for detecting radiation specially adapted for radiation diagnosis characterised by using a particular type of detector

- A61B6/4233—Arrangements for detecting radiation specially adapted for radiation diagnosis characterised by using a particular type of detector using matrix detectors

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus or devices for radiation diagnosis; Apparatus or devices for radiation diagnosis combined with radiation therapy equipment

- A61B6/52—Devices using data or image processing specially adapted for radiation diagnosis

- A61B6/5205—Devices using data or image processing specially adapted for radiation diagnosis involving processing of raw data to produce diagnostic data

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T5/00—Image enhancement or restoration

- G06T5/50—Image enhancement or restoration using two or more images, e.g. averaging or subtraction

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T5/00—Image enhancement or restoration

- G06T5/60—Image enhancement or restoration using machine learning, e.g. neural networks

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B6/00—Apparatus or devices for radiation diagnosis; Apparatus or devices for radiation diagnosis combined with radiation therapy equipment

- A61B6/58—Testing, adjusting or calibrating thereof

- A61B6/582—Calibration

- A61B6/585—Calibration of detector units

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10116—X-ray image

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20081—Training; Learning

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20084—Artificial neural networks [ANN]

Definitions

- This disclosure relates to an image processing device, an image processing method, a learning device, a learning method, and a program.

- Patent Document 1 discloses a rule-based noise reduction processing technique for creating a rule based on the noise characteristics of a digital radiography apparatus and switching the characteristics of a smoothing filter.

- the digital radiation photographing apparatus detects the radiation transmitted through the subject as an electric signal

- the radiation is converted into visible light by a phosphor such as CsI or GOS (Gd 2 O 2 S) and then detected by the semiconductor sensor.

- a phosphor such as CsI or GOS (Gd 2 O 2 S)

- the semiconductor sensor It is common to adopt a configuration that does. Since the converted visible light is diffused by passing through the phosphor and reaching the semiconductor sensor, the noise caused by the fluctuation of the radiation quantum (hereinafter referred to as quantum noise) is smoothed and the high frequency is attenuated. It becomes.

- noise generated from the detector, circuit, etc. hereinafter referred to as system noise

- system noise Since the noise in digital radiography equipment is mainly the sum of system noise and quantum noise, the content ratio of both changes depending on the input signal, and the frequency characteristics differ depending on the signal strength. It has characteristics.

- Non-Patent Document 1 proposes a technique capable of realizing suitable noise reduction processing for more subjects by increasing the number of images used for learning.

- this technology when considering the application of this technology to digital radiography equipment, it is difficult to learn a neural network that realizes suitable noise reduction because the above-mentioned characteristics of the digital radiography equipment that have noise cannot be taken into consideration. There was a case.

- the present disclosure has been made in view of the above problems, and includes an image processing device, an image processing method, a learning device, a learning method, and a program capable of performing suitable noise reduction processing in a digital radiography apparatus.

- One of the purposes is to provide.

- the image processing apparatus learns using a learning unit including an acquisition unit that acquires a first radiation image of an object to be inspected and a radiation image obtained by adding noise with attenuated high-frequency components.

- a generation unit that generates a second radiation image with less noise than the first radiation image.

- a schematic configuration of the radiography system according to the first embodiment is shown.

- a schematic configuration of the radiation detector according to the first embodiment is shown.

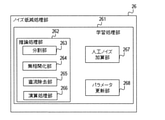

- a schematic configuration of the control unit according to the first embodiment is shown.

- a schematic configuration of the noise reduction processing unit according to the first embodiment is shown.

- An example of the schematic configuration of the trained model according to the first embodiment is shown.

- An example of the schematic configuration of the trained model according to the first embodiment is shown. It is a figure for demonstrating the operation example of the learning process which concerns on Example 1.

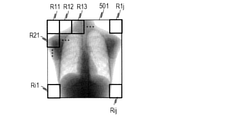

- FIG. It is a figure for demonstrating the area division processing which concerns on Example 1.

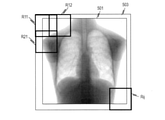

- FIG. It is a figure for demonstrating the area division processing which concerns on Example 1.

- FIG. It is a figure for demonstrating the area division processing which concerns on Example 1.

- FIG. It is a figure which shows the spatial frequency characteristic of noise which differs depending on a dose.

- FIG. It is a flowchart of the inference processing which concerns on Example 1.

- An example of the image before and after the image processing according to the first embodiment is shown.

- It is a flowchart of the learning process which concerns on Example 2.

- An example of the relationship between the spatial frequency and the MTF in a radiation detector is shown.

- the radiation includes ⁇ -rays, ⁇ -rays, ⁇ -rays, which are beams produced by particles (including photons) emitted by radiation decay, and more than the same degree. It also includes beams having energy, such as X-rays, particle rays, and cosmic rays. Further, in the following, dark current, electrical noise, and the like that do not depend on the signal magnitude of the radiographic image are referred to as system noise.

- the machine learning model refers to a learning model based on a machine learning algorithm.

- Specific algorithms for machine learning include the nearest neighbor method, the naive Bayes method, the decision tree, and the support vector machine. Further, a neural network or deep learning may be used. As appropriate, any of the above algorithms that can be used can be applied to the following examples and modifications.

- the training data refers to a data set used for training a machine learning model, and is composed of a pair of input data input to the machine learning model and correct data that is the correct answer of the output result of the machine learning model. ..

- the trained model is a model in which a machine learning model according to an arbitrary machine learning algorithm such as deep learning is trained using appropriate learning data in advance.

- the trained model is obtained by learning using appropriate learning data in advance, it is not that no further learning is performed, and additional learning can be performed. Additional learning can be done even after the device has been installed at the site of use.

- FIG. 1A shows a schematic configuration of the radiography system 1 according to the present embodiment.

- the inspected object O will be described as a human body, but the inspected object O photographed by the radiography system according to the present disclosure is not limited to the human body, but is used for other animals, plants, and non-destructive inspection. It may be an object or the like.

- the radiography system 1 is provided with a radiation detector 10, a control unit 20, a radiation generator 30, an input unit 40, and a display unit 50.

- the radiography system 1 may include an external storage device 70 such as a server connected to the control unit 20 via a network 60 such as the Internet or an intranet.

- the radiation generator 30 includes a radiation source such as an X-ray tube and can emit radiation.

- the radiation detector 10 can detect the radiation emitted from the radiation generator 30 and generate a radiation image corresponding to the detected radiation. Therefore, the radiation detector 10 can generate a radiation image of the inspected object O by detecting the radiation emitted from the radiation generator 30 and passing through the inspected object O.

- FIG. 1B shows a schematic configuration of the radiation detector 10 according to this embodiment.

- the radiation detector 10 is provided with a phosphor 11 and a photographing sensor 12.

- the phosphor 11 converts the radiation incident on the radiation detector 10 into light having a wavelength that can be detected by the photographing sensor 12.

- the phosphor 11 may contain, for example, CsI, GOS (Gd 2 O 2 S), or the like.

- the photographing sensor 12 includes, for example, a photoelectric conversion element composed of a-Si or crystalline Si, can detect light corresponding to the radiation converted by the phosphor 11, and output a signal corresponding to the detected light. can.

- the radiation detector 10 can generate a radiation image by performing A / D conversion or the like on the signal output by the photographing sensor 12.

- the radiation detector 10 may include a calculation unit, an A / D conversion unit, and the like.

- the control unit 20 is connected to the radiation detector 10, the radiation generator 30, the input unit 40, and the display unit 50.

- the control unit 20 can acquire a radiation image output from the radiation detector 10 and perform image processing on the radiation image, or control the drive of the radiation detector 10 and the radiation generator 30. Therefore, the control unit 20 can function as an example of the image processing device.

- the control unit 20 may be connected to the external storage device 70 via an arbitrary network 60 such as the Internet or an intranet, or may acquire a radiographic image or the like from the external storage device 70. Further, the control unit 20 may be connected to another radiation detector, a radiation generator, or the like via the network 60.

- the control unit 20 may be connected to the external storage device 70 or the like by wire or wirelessly.

- the input unit 40 is provided with input devices such as a mouse, keyboard, trackball, and touch panel, and can be operated by an operator to input instructions to the control unit 20.

- the display unit 50 includes, for example, an arbitrary monitor, and can display information and images output from the control unit 20, information input by the input unit 40, and the like.

- control unit 20 the input unit 40, the display unit 50, and the like are configured by separate devices in the present embodiment, they may be integrally configured.

- the input unit 40 and the display unit 50 may be configured by a touch panel display.

- the image processing device is configured by the control unit 20, but the image processing device only needs to be able to acquire a radiation image and perform image processing on the radiation image, and the radiation detector 10 and the radiation generator 30 are sufficient. It is not necessary to control the drive of.

- control unit 20, the radiation detector 10, the radiation generator 30, and the like may be connected by wire or wirelessly.

- the external storage device 70 may configure an image system such as a PACS in the hospital, or may be a server or the like outside the hospital.

- FIG. 2A shows a schematic configuration of the control unit 20 according to this embodiment.

- FIG. 2B shows a schematic configuration of the noise reduction processing unit 26 included in the control unit 20.

- the control unit 20 is provided with an acquisition unit 21, an image processing unit 22, a display control unit 23, a drive control unit 24, and a storage unit 25.

- the acquisition unit 21 can acquire a radiation image output by the radiation detector 10, various information input by the input unit 40, and the like. In addition, the acquisition unit 21 can also acquire radiographic images, patient information, and the like from the external storage device 70 and the like.

- the image processing unit 22 is provided with a noise reduction processing unit 26 and a diagnostic image processing unit 27, and can perform image processing according to the present disclosure on the radiographic image acquired by the acquisition unit 21.

- the noise reduction processing unit 26 is provided with a learning processing unit 261 and an inference processing unit 262.

- the inference processing unit 262 is provided with a division unit 263, an uncorrelated unit 264, a DC removal unit 265, and an arithmetic processing unit 266.

- the learning processing unit 261 is further provided with an artificial noise addition unit 267 and a parameter update unit 268. With this configuration, the noise reduction processing unit 26 can learn a machine learning model for performing the noise reduction processing, and can apply the noise reduction processing suitable for the radiographic image by using the machine learning model.

- the diagnostic image processing unit 27 can perform diagnostic image processing for converting the noise-reduced image in the noise reduction processing unit 26 into an image suitable for diagnosis.

- the diagnostic image processing includes, for example, gradation processing, enhancement processing, grid fringe reduction processing, and the like.

- the inference processing unit 262 can apply the trained model to the input of an arbitrary radiographic image and perform inference processing to output the result.

- the dividing unit 263 can divide the radiographic image into images of a plurality of regions. Further, the division unit 263 can also combine images in a plurality of regions to generate a single image.

- the uncorrelated unit 264 performs a process of eliminating (uncorrelated) the correlation between the magnitude of the quantum noise caused by the fluctuation of the radiation contained in the radiation image and the magnitude of the signal corresponding to the detected radiation. ..

- the dispersion (hereinafter referred to as the magnitude of noise) of quantum noise is proportional to the amount of radiation. Therefore, the magnitude of the quantum noise is proportional to the signal amount (hereinafter referred to as a pixel value) related to each pixel of the radiation image corresponding to the detected radiation dose.

- the uncorrelated unit 264 according to the present embodiment performs the uncorrelated processing on the radiographic image so that the magnitude of the quantum noise is substantially constant regardless of the magnitude of the pixel value of each pixel in the radiographic image. Can be done. A specific method of uncorrelated processing will be described later.

- the uncorrelated unit 264 applies the inverse conversion process of the conversion process related to the uncorrelated process to the radiographic image to which the uncorrelated process is performed, so that the magnitude of the quantum noise and the pixel value are correlated. It can be undone. It should be noted that a separate component that performs each of the noise uncorrelated processing and the inverse conversion of the uncorrelated processing may be provided. In this case, the functional block including each component is provided as the uncorrelated unit 264. Can be.

- the DC removing unit 265 performs a process of subtracting the DC component of the image and leveling the average signal level of the image. Specifically, the DC component of the radiation image is removed by subtracting the average pixel value of the image from each pixel value of the radiation image so that the average pixel value of the radiation image becomes 0. Further, the DC removal unit 265 returns the average signal level of the radiographic image to the one before conversion by adding the subtracted average pixel value to each pixel value for the image subjected to the DC removal processing. Can be done. It should be noted that a separate component for performing the DC removal process and the DC addition process may be provided, and in this case, the functional block including each component can be the DC removal unit 265. Further, the removal of the DC component may be performed on each of the images divided by the dividing unit 263, or may be performed on the entire radiation image before being divided by the dividing unit 263.

- the arithmetic processing unit 266 takes an image to which the processing by the division unit 263, the uncorrelated unit 264, and the DC removal unit 265 is applied as an input, performs processing using a trained model described later, and performs noise included in the input image. It is possible to generate an image with reduced noise.

- the noise reduced in this embodiment includes system noise such as dark current and electrical noise generated by the photographing sensor 12 and quantum noise caused by radiation fluctuation.

- the learning processing unit 261 performs learning processing applied when learning a machine learning model.

- the learning processing unit 261 also has an artificial noise addition unit 267 and parameter update. A portion 268 is provided.

- Learning data is required when performing learning processing.

- processing by the division unit 263, the uncorrelated unit 264, and the DC removal unit 265 is applied to both the input data and the correct answer data.

- the artificial noise addition unit 267 performs a process of adding artificial noise created by simulating the characteristics of a radiation image to the learning data.

- the addition of artificial noise is performed on the input data only or the input data and the correct answer data among the training data.

- the artificial noise adding unit 267 inputs the input data so that the amount of noise added to the input data is larger than the amount of noise added to the correct answer data. And add noise to the correct answer data.

- the method of adding artificial noise to the input data and the correct answer data is not limited to the above, and the artificial noise may be added so as to cause a difference between the input data and the correct answer data.

- the timing of adding the artificial noise may be any timing between the processes performed by the inference processing unit 262.

- the artificial noise is added to the radiation image input to the inference processing unit 262, or no artificial noise is added. It can be performed at any timing, such as adding artificial noise after the correlation processing.

- the image after adding artificial noise is input to the arithmetic processing unit 266 after being appropriately processed.

- the details of the artificial noise to be added will be described later.

- the parameter update unit 268 performs a process of updating the parameters of the machine learning model possessed by the arithmetic processing unit 266 based on the arithmetic result of the arithmetic processing unit 266 and the correct answer data. The details of the operation of the parameter update unit 268 will be described later.

- the learning processing unit 261 does not necessarily have to be included in the radiography system 1.

- a learning processing unit 261 is configured on hardware different from the radiography system, and learning is performed in advance using appropriate learning data to create a trained model. In the radiography system, inference is made. Only the processing by the processing unit 262 may be performed. Alternatively, by including the learning processing unit 261 in the radiography system 1, additional learning may be performed using the learning data acquired after the installation.

- the display control unit 23 can control the display of the display unit 50, and can display the radiographic image, patient information, and the like before and after image processing by the image processing unit 22 on the display unit 50.

- the drive control unit 24 can control the drive of the radiation detector 10, the radiation generator 30, and the like. Therefore, the control unit 20 can control the photographing of the radiation image by controlling the driveability of the radiation detector 10 and the radiation generator 30 by the drive control unit 24.

- the storage unit 25 can store a program for realizing various application software including an operating system (OS), a device driver of a peripheral device, and a program for performing processing described later. Further, the storage unit 25 can also store the information acquired by the acquisition unit 21, the radiographic image processed by the image processing unit 22, and the like. For example, the storage unit 25 can store a radiation image acquired by the acquisition unit 21 or store a radiation image that has undergone noise reduction processing, which will be described later.

- OS operating system

- a device driver of a peripheral device a program for performing processing described later.

- the storage unit 25 can also store the information acquired by the acquisition unit 21, the radiographic image processed by the image processing unit 22, and the like.

- the storage unit 25 can store a radiation image acquired by the acquisition unit 21 or store a radiation image that has undergone noise reduction processing, which will be described later.

- the control unit 20 can be configured by using a general computer including a processor, a memory, and the like, but may be configured as a dedicated computer of the radiography system 1.

- the control unit 20 functions as an example of the image processing device according to the present embodiment, and the image processing device according to the present embodiment is a separate (external) computer communicably connected to the control unit 20. It may be.

- the control unit 20 and the image processing device may be, for example, a personal computer, or a desktop PC, a notebook PC, or a tablet PC (portable information terminal) may be used.

- the processor may be a CPU (Central Processing Unit). Further, the processor may be, for example, an MPU (Micro Processing Unit), a GPU (Graphical Processing Unit), an FPGA (Field-Programmable Gate Array), or the like.

- MPU Micro Processing Unit

- GPU Graphics Processing Unit

- FPGA Field-Programmable Gate Array

- Each function of the control unit 20 may be realized by executing a software module stored in the storage unit 25 by a processor such as a CPU or MPU. Further, each function may be configured by a circuit or the like that performs a specific function such as an ASIC.

- the image processing unit 22 may be realized by using dedicated hardware such as an ASIC, or the display control unit 23 may be realized by using a dedicated processor such as a GPU different from the CPU.

- the storage unit 25 may be composed of, for example, an optical disk such as a hard disk or an arbitrary storage medium such as a memory.

- An example of the machine learning model used by the arithmetic processing unit 266 according to this embodiment is a multi-layer neural network.

- FIG. 3A shows a schematic configuration example of the neural network model according to this embodiment.

- the neural network model 33 shown in FIG. 3A is designed to output inference data 32 with reduced noise according to a tendency learned in advance with respect to the input data 31.

- the output noise-reduced radiation image is based on the learning content in the machine learning process, and the neural network according to this embodiment has features for separating the signal and noise contained in the radiation image. I'm learning.

- a convolutional neural network (hereinafter referred to as CNN: Convolutional Neural Network) can be used.

- a technique related to an autoencoder self-encoder may be used for at least a part of the multi-layer neural network.

- FIG. 3B shows an example of a schematic configuration of a CNN constituting the neural network model 33 according to this embodiment.

- the inference data 32 with reduced noise can be output.

- the CNN shown in FIG. 3B is composed of a plurality of layers responsible for processing and outputting an input value group.

- the types of layers included in the CNN configuration include a convolution layer, a Downsampling layer, an Upsampling layer, and a Merge layer.

- the convolution layer is a layer that performs convolution processing on the input value group according to parameters such as the kernel size of the set filter, the number of filters, the stride value, and the dilation value.

- the number of dimensions of the kernel size of the filter may be changed according to the number of dimensions of the input image.

- the downsampling layer is a layer that performs processing to reduce the number of output value groups to less than the number of input value groups by thinning out or synthesizing input value groups. Specifically, as such a process, for example, there is a Max Polling process.

- the upsampling layer is a layer that performs processing to increase the number of output value groups to be larger than the number of input value groups by duplicating the input value group or adding the interpolated value from the input value group. Specifically, as such a process, for example, there is an upsampling process by deconvolution.

- the composite layer is a layer in which a value group such as an output value group of a certain layer or a pixel value group constituting an image is input from a plurality of sources, and the processing is performed by concatenating or adding them.

- the neural network may have an addition layer 34 that adds the input data to the data output from the first convolution layer on the decoder side.

- the input data is added before the output. It is good to configure a shortcut to do.

- the CNN can adopt a configuration for learning the difference between the input data and the correct answer data, and can preferably handle a system targeting noise.

- the degree of reproducibility of the tendency trained from the training data may differ at the time of inference. That is, in many cases, the appropriate parameters differ depending on the embodiment, and therefore, the values can be changed to preferable values as needed.

- the CNN can obtain better characteristics by changing the configuration of the CNN.

- Better characteristics include, for example, a more accurate output of a noise-reduced radiographic image, shorter processing time, shorter training time for a machine learning model, and the like.

- the configuration of the CNN used in this embodiment is a U-net having a function of an encoder composed of a plurality of layers including a plurality of downsampling layers and a function of a decoder composed of a plurality of layers including a plurality of upsampling layers. It is a type machine learning model. That is, the configuration of the CNN includes a U-shaped structure having an encoder function and a decoder function. In the U-net type machine learning model, position information (spatial information) that is ambiguous in a plurality of layers configured as an encoder is displayed in the same-dimensional layer (layers corresponding to each other) in a plurality of layers configured as a decoder. ) (For example, using a skip connection).

- an activation function for example, ReLu: Rectifier Liner Unit

- batch normalization Batch Normalization

- noise features can be extracted from the input radiographic image.

- the learning processing unit 261 includes a parameter updating unit 268.

- the parameter update unit 268 calculates the loss function from the inference data 32 in which the neural network model 33 of the arithmetic processing unit 266 is applied to the input data 31 in the training data and the correct answer data 35 in the training data. Perform processing. Further, the parameter update unit 268 performs a process of updating the parameters of the neural network model 33 based on the calculated loss function.

- the loss function indicates an error between the inference data 32 and the correct answer data 35.

- the parameter update unit 268 uses, for example, an error backpropagation method to reduce the error between the inference data 32 represented by the loss function and the correct answer data 35, such as the filter coefficient of the convolution layer.

- the error back propagation method is a method of adjusting parameters and the like between each node of a neural network so that the above error becomes small.

- a method (dropout) of randomly inactivating the units (each neuron or each node) constituting the CNN may be used.

- the trained model used by the arithmetic processing unit 266 may be one generated by using transfer learning.

- transfer learning may be performed on a machine learning model learned from a radiographic image of an object O of a different type or the like to generate a trained model used for noise reduction processing.

- transfer learning it is possible to efficiently generate a trained model even for the inspected object O for which it is difficult to obtain a large amount of training data.

- the inspected object O having a different type and the like here may be, for example, an animal, a plant, an object for non-destructive inspection, or the like.

- the GPU can perform efficient operations by processing more data in parallel. Therefore, when learning is performed a plurality of times using the learning model using CNN as described above, it is effective to perform processing on the GPU. Therefore, a GPU is used in addition to the CPU for the learning processing unit 261 according to this embodiment. Specifically, when a learning program including a learning model is executed, learning is performed by the CPU and the GPU collaborating to perform calculations. In the learning process, the calculation may be performed only by the CPU or GPU. Further, each process of the inference processing unit 262 may be realized by using the GPU in the same manner as the learning processing unit 261.

- the configuration of the machine learning model has been explained above, but it is not limited to the model using CNN as shown so far.

- the learning of the machine learning model may be similar to machine learning using a model that can extract (express) the features of learning data such as images by learning.

- the processing flow of the learning processing unit 261 according to this embodiment will be described.

- the training data used by the learning processing unit 261 it is ideally desirable to use a set of a radiation image containing noise as input data and a radiation image containing substantially no noise as correct answer data.

- the same inspected object may be photographed multiple times to create an average image, and a method of canceling a noise component that does not correlate with the signal can be mentioned.

- it is not realistic to perform the above means using an actual human body in view of the invasiveness of radiography, and the radiographic image containing noise as training data and noise are not included in the abbreviated form. It is difficult to prepare a set of radiographic images.

- the radiation image obtained by photographing the human body for medical purposes is used as the correct answer data of the training data

- the image obtained by adding the artificial noise corresponding to the noise generated in the radiation image to the radiation image is used as the input data of the training data.

- the noise to be added is not limited to artificial noise.

- a difference processing is performed using a radiation image obtained by photographing the inspected object and an average image obtained by photographing the same inspected object multiple times.

- the noise component to be added to the radiographic image may be acquired.

- the present inventor has suitably reduced the noise even when the actual radiation image is input when the artificial noise is given in a form simulating the noise characteristics of the actual radiation image in a manner as described later.

- FIG. 4 is a flowchart showing a processing flow of the learning processing unit 261 according to the present embodiment.

- the artificial noise addition processing is performed before the preprocessing including the noise uncorrelated processing and the DC removal processing.

- step S401 learning data is input to the learning processing unit 261.

- the acquisition of the input learning data is performed by the acquisition unit 21, and in this embodiment, an appropriate radiographic image is acquired as the learning data.

- the acquisition unit 21 may acquire a radiation image stored in the storage unit 25, or may acquire a radiation image from an external storage device 70 or the like. Further, the acquisition unit 21 may acquire a radiation image output by the radiation detector 10.

- the learning data in this embodiment is the radiation image as input data and correct answer data. After the same data is input to the learning processing unit 261, an appropriate artificial noise is added to the input data or the input data and the correct answer data inside the learning processing unit, so that a difference occurs between the input data and the correct answer data. It becomes a state.

- step S402 the region division processing is performed on the radiographic image input by the division unit 263.

- 5A to 5C are images for explaining the area division process according to the present embodiment.

- the division unit 263 divides the area of the radiation image 501 and creates an appropriate divided image 502.

- the learning data input to the learning processing unit 261 is composed of input data and correct answer data, and the division unit 263 operates so as to divide both images into regions at the same position.

- the number of pixels of the divided image 502 is within the range of pixels that can be processed at one time in the arithmetic unit in which the arithmetic processing unit 266 operates, and the feature amount related to noise in the image can be extracted. Any number can be set as long as it is.

- the radiation detector 10 is often of high definition, and the radiation image 501 may have pixels exceeding, for example, 2688 pix ⁇ 2688 pix, and the arithmetic unit in which the arithmetic processing unit 266 operates calculates.

- the number of possible pixels may be exceeded.

- the number of pixels of the divided image 502 can be about 256 pix ⁇ 256 pix.

- steps S401 to S407 are repeatedly processed, but in the area division processing in step S402, the area image is included so as to include a portion overlapping with the area image created during the loop. You may set the range. In this case, more training data can be generated from one radiographic image.

- various types of data expansion may be performed. For example, rotation / reduction / enlargement / skew, change in signal amount, addition of offset, and the like can be mentioned.

- the learning data may be expanded by using a hostile generation network (GAN: Generative Adversarial Networks).

- GAN Generative Adversarial Networks

- step S403 artificial noise is added to the divided image 502 by the artificial noise adding unit 267.

- the artificial noise can be close to the noise actually generated in the radiographic image.

- an example of artificial noise to be added in this embodiment will be described.

- the noise contained in the radiation image is roughly classified into the quantum noise generated by the fluctuation of the radiation quantum and the system noise generated from the detector, the circuit, and the like.

- the radiation detector 10 adopts a configuration in which radiation is converted into visible light by the phosphor 11, high-frequency attenuation occurs in the radiation signal according to the modulation transfer function (MTF: Modulation Transfer Function) of the phosphor 11.

- MTF Modulation Transfer Function

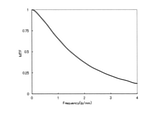

- FIG. 12 shows an example of the relationship between the spatial frequency and the MTF in the radiation detector 10 having a pixel size of 125 ⁇ m.

- the MTF is monotonically decreasing towards the Nyquist frequency.

- the MTF at a Nyquist frequency of 4 lp / mm is, for example, about 0.2, and the high frequency signal is attenuated.

- Quantum noise generated by fluctuations in radiation quantum also undergoes high-frequency attenuation due to the same modulation transfer function.

- the system noise generated from the detector, the circuit and the like is not affected by the phosphor.

- the noise contained in the radiographic image is the sum of the system noise that does not depend on the dose at the time of imaging and the quantum noise that changes depending on the dose at the time of imaging. From this, the noise in the digital radiography apparatus has a feature that the frequency characteristics (NPS: Noise Power Spectrum) differ depending on the intensity of the input radiation.

- NPS Noise Power Spectrum

- Graph 601 shows an example of the spatial frequency characteristic of system noise only.

- Graph 604 shows an example of the spatial frequency characteristics of quantum noise according to the MTF of the phosphor 11.

- Graphs 602 and 603 show examples of the spatial frequency characteristics of the synthesized system noise and the spatial frequency characteristics of the quantum noise, respectively.

- the noise When there is no input signal, the noise has an NPS with white noise-like characteristics derived from system noise, as shown in Graph 601.

- the noise becomes an NPS with less high frequency attenuation as shown in Graph 602, and when the input signal is larger than Graph 602, it has an NPS with higher high frequency attenuation as shown in Graph 603.

- the noise has an NPS according to the MTF of the phosphor 11 as shown in the graph 604.

- the noise obtained by synthesizing the white noise corresponding to the system noise of the radiation detector 10 and the quantum noise affected by the MTF of the phosphor 11 is treated as artificial noise.

- the characteristics of the radiation detector 10 can be simulated by using, for example, the following relational expressions (Equation 1) to (Equation 4).

- the standard deviation of the quantum noise is ⁇ q

- the standard deviation of the system noise by the radiation detector 10 is ⁇ s

- the signal of the input image is I sig

- the standard deviation ⁇ q of the quantum noise is proportional to the signal I sig , so the coefficient q of the quantum noise is used.

- the artificial noise can be obtained as follows.

- the artificial system noise sNoise simulating the system noise is referred to as additive white Gaussian noise (AWGN: Additive White Gaussian Noise) having a standard deviation of ⁇ s .

- the artificial quantum noise qNoise simulating the quantum noise is defined as noise having an NPS according to the Poisson distribution of the variance ⁇ q 2 and according to the MTF of the phosphor 11. For example, when fMTF is an approximation of the MTF of the phosphor 11 with a two-dimensional filter, it can be created by convolving the fMTF into a noise image that follows a Poisson distribution.

- the coefficients q and s indicate the performance of the radiation detector 10, and can be obtained by measuring in advance. For example, it is preferable to plot the measured values taken a plurality of times by changing the dose, approximate the series of measured values to (Equation 1), and obtain the quantum noise coefficient q and the system noise coefficient s. As a result, the standard deviation ⁇ q of the quantum noise and the standard deviation ⁇ s of the system noise can be obtained at any signal I sig .

- the method for acquiring the standard deviation ⁇ q of the quantum noise and the standard deviation ⁇ s of the system noise is not limited to this, and any known method may be used.

- the standard deviation ⁇ q of the quantum noise and the standard deviation ⁇ s of the system noise may be stored in advance in the storage unit 25 for each radiation detector 10 used for acquiring the radiation image, or may be performed prior to photographing. May be obtained by measurement.

- the radiation detector 10 a method called an indirect conversion method for converting radiation into visible light by a phosphor 11 is shown, but in the radiation detector 10, radiation is directly converted into an electric signal. There is also what is called a direct conversion method. Even in that case, the quantum noise is equivalent in that it has an NPS affected by the MTF, and it is possible to perform suitable learning by adding the artificial noise represented by the above (Equation 4).

- step S404 the uncorrelated unit 264 performs noise uncorrelated processing on the divided image to which artificial noise is added.

- the noise uncorrelated processing will be described with reference to FIGS. 7A and 7B.

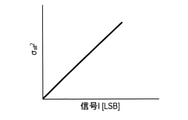

- FIG. 7A shows the relationship between the noise dispersion in the radiographic image and the input signal of the image.

- FIG. 7B is a diagram showing the relationship between the noise after the noise uncorrelated processing and the signal value after the conversion.

- Noise uncorrelated processing refers to processing that eliminates the correlation between noise dispersion and signals.

- the radiographic image contains quantum noise proportional to the magnitude of the signal and system noise not proportional to the magnitude of the signal, and includes (Equation 1) to (Equation 3) and FIG. 7A.

- the noise dispersion ⁇ all 2 in the radiographic image has a characteristic that it is proportional to the signal I.

- the noise is converted into a format in which the noise is substantially constant regardless of the signal. It is desirable to handle additive noise. Since quantum noise follows a Poisson distribution, it can be made substantially constant regardless of the intensity of input radiation by performing square root transformation, logarithmic transformation, or the like.

- the system noise component I 0 is obtained from the above (Equation 1) to (Equation 3).

- the input image is Im

- the input image Im is transformed into a square root so as to obtain the noise-uncorrelated image Im'.

- the uncorrelated unit 264 sets the standard deviation of the converted noise to 1.

- the uncorrelated processing according to the above may be performed. By these processes, the magnitude of the noise and the magnitude of the signal can be uncorrelated with respect to the noise contained in the radiographic image.

- the DC removal unit 265 performs DC removal processing on the uncorrelated divided image to remove the DC component (average signal level of the image) for each divided image.

- the DC component is removed from the pixel value of the region image by the DC removing unit 265.

- the DC component for each divided image is removed by subtracting the average pixel value of the image from each pixel value of the divided image so that the average pixel value of the divided image becomes 0.

- step S406 the arithmetic processing unit 266 performs inference processing using the machine learning model possessed by the arithmetic processing unit 266.

- the inference process using the machine learning model such as CNN described above is performed by inputting the images created up to step S405.

- the input data 31 for example, the signal obtained by removing the direct current in step S405 can be used, and the inference data 32 can be output.

- the input data may have a plurality of channels (here, an example of two channels is shown), and the inference data may have a plurality of channels.

- the noise dispersion (which can be said to be the magnitude) becomes substantially constant regardless of the signal value by the noise uncorrelated processing in step S404. There is.

- the NPS of the noise is still in a state of having a correlation with the input signal amount. Therefore, it is desirable that the signal amount information is input as the information used for learning, but on the other hand, the signal amount information is lost due to the DC removal processing performed in step S405 for stabilizing the learning. It has become.

- the image to which the direct current is removed is used as the input data 36 of the first channel, and in addition, the image including the signal amount information is input as the input data 37 of the second channel.

- the image that has been normalized in a state where the signal amount information is stored for the image that has been noise-uncorrelated in step S404 it is possible to use an image that has been normalized in a state where the signal amount information is stored for the image that has been noise-uncorrelated in step S404.

- the square root transformation of (Equation 6) or (Equation 7) is divided by the value performed by the maximum value max (Im) (for example, 65535) assumed in Im. , Normalized so that the maximum value is 0 to 1 can be used.

- the inference data includes inference data 38 in which the noise of the input data 36 of the first channel from which DC has been removed is reduced, and inference data 39 in which the noise of the input data 37 of the second channel including signal amount information is reduced. It will be a configuration to have.

- the input data may have a plurality of channels (here, an example of two channels is shown), and the inference data may have one channel.

- the inference data may have the inference data 43 in which the noise of the input data 36 of the first channel from which the direct current has been removed is reduced.

- the parameter update unit 268 compares the inference data and the correct answer data, and calculates a loss function that quantifies the error between the two.

- the parameters of the machine learning model for example, the filter coefficient of the convolutional layer in CNN

- the loss function include mean absolute error (L1loss) and mean square error (L2loss).

- L1loss mean absolute error

- L2loss mean square error

- FIG. 3C when the inference data is data of a single channel, the pair of inference data 32 and the correct answer data 35 (the same applies to the example shown in FIG. 3E, the pair of the inference data 43 and the correct answer data 44). Compare with. As shown in FIG.

- the inference data is data of a plurality of channels

- comparison is performed in the corresponding sets.

- the loss function with the corresponding normalized correct answer data 42 is calculated.

- the distribution of the noise generated in the radiographic image and the artificial noise added in step S403 can be approximated to the normal distribution in which the mean value and the median value are 0.

- the loss function is set to the mean absolute error (L1loss) or the mean square error (L2loss) as described above, the noise-derived component is approximately canceled by the averaging process in the loss function calculation. Therefore, the main factor that affects the loss function is the error of the noise-free signal component contained in the data. That is, the machine learning model possessed by the arithmetic processing unit 266 can adopt a configuration in which learning proceeds so as to reproduce a signal containing no noise from the input data containing noise.

- step S408 the end of learning is determined, and if it is determined to be the end, the flow is terminated. If not, the process returns to step S401, and the flow of steps S401 to S407 is repeated using another data.

- the criterion for the end determination it is possible to use an appropriate criterion generally used in general machine learning. For example, whether or not a specific number of loops has been executed, whether or not the loss function is below a certain level, whether or not overfitting has been performed, or PSNR, which is an index indicating the noise reduction performance in the inference data, The SSIM may be evaluated to determine if the performance has reached a sufficient level.

- the learning processing unit 261 in the present embodiment is a machine learning model capable of outputting a radiation image with appropriately reduced noise by adding artificial noise simulating the noise characteristics of an actual radiation image. Can be generated.

- FIG. 9 is a flowchart showing a series of image processing of the inference processing unit 262 according to the present embodiment.

- the radiation image to be processed is subjected to region division and preprocessing, and is input to the trained model.

- the output from the trained model is subjected to post-processing corresponding to the pre-processing, and finally the divided image is combined to obtain a noise-reduced radiation image corresponding to the original radiation image.

- the image processing performed on the image before being input to the inference processing is referred to as pre-processing

- the image processing performed on the image after being output by the inference processing is referred to as post-processing.

- the pre-processing includes noise uncorrelated processing and DC removal processing

- the post-processing includes DC addition processing corresponding to DC removal processing and inverse conversion processing corresponding to noise uncorrelated processing.

- the acquisition unit 21 acquires a radiographic image in step S901.

- the acquisition unit 21 may acquire a radiation image generated by the radiation detector 10, or may acquire a radiation image from a storage unit 25, an external storage device 70, or the like.

- step S902 the division unit 263 performs region division processing on the acquired radiation image and generates a plurality of division images (a plurality of radiation images) in the same manner as in step S402.

- step S902 the division unit 263 divides the radiation image 501 into a plurality of divided images R11 to Rij, as shown in FIG. 5B.

- the number of pixels of the divided image is within the number of pixels that can be processed at one time by the machine learning model used by the arithmetic processing unit 266 (for example, 256 pix ⁇ 256 pix), and the feature amount related to noise in the image can be extracted. Any number may be set as long as it is a degree.

- the division unit 263 can set the division area so that the areas do not overlap. Further, as shown in FIG. 5C, the division unit 263 sets the division area so that a part of the adjacent areas overlaps so that the overlapping areas can be combined when the divided images are combined. good. In this case, in the combined radiographic image, when a slight difference in the calculation result occurs at the boundary of each combined region, the influence can be alleviated. Further, in the inference processing, the convolution operation is performed, and for the edge processing of the image at that time, as shown in FIG. 5C, an appropriate padding area 503 is provided in the radiation image 501, and the divided area is also appropriately used. Subsequent processing may be performed after providing a padding area.

- step S903 the uncorrelated unit 264 performs noise uncorrelated processing on the divided image generated in step S902 in the same manner as in step S404.

- the uncorrelated processing is performed with the same parameters as the uncorrelated processing performed in the learning process. For example, when the standard deviation of the converted noise is set to 1 as in (Equation 7) in the learning process, it is preferable to perform the uncorrelated processing according to (Equation 7) in the same manner.

- the effect of the noise reduction processing in the inference processing of step S905 by adopting a configuration in which the magnitude of the standard deviation of the noise after conversion is changed.

- the standard deviation of the noise after conversion is 1.2

- the noise is larger than that of the uncorrelated processing in the learning process. Since the trained model operates so as to reduce noise by assuming noise having a standard deviation of 1 of noise, it is possible to obtain an effect of alleviating the noise reduction effect as a result.

- the magnitude of the noise reduction effect can be determined according to the request of the diagnostician who diagnoses the image subjected to the noise reduction process. Can be adjusted.

- step S904 the DC removal unit 265 performs the same DC removal processing as in step S405 for each divided image that has undergone noise uncorrelated processing in step S903.

- step S905 the arithmetic processing unit 266 uses the trained model described above to perform inference processing based on the divided image subjected to the DC removal processing in step S904 to reduce noise. Generate.

- the trained model may be a machine learning model that has been trained in advance, and it is not necessary to train each time the series of image processing is performed. As shown in step S406 and FIGS. 3C to 3E, the arithmetic processing unit 266 is given an input matching the learning model.

- the trained model is configured to be provided in the control unit 20, but the trained model may be provided in the external storage device 70 or the like connected to the control unit 20.

- the noise-reduced divided image generation process by the arithmetic processing unit 266 was generated based on the divided image transmitted from the control unit 20 by using a trained model in, for example, an external storage device 70 or the like. It may include acquiring a radiographic image with reduced noise.

- the system as shown in FIG. 3E is dealt with.

- the image to which the direct current removal processing is performed is input to the first channel, and the divided image having the uncorrelated processed image normalized so that the maximum value is 0 to 1 is input to the second channel. ..

- an image obtained by performing noise reduction on the image subjected to the direct current removal process (noise reduction image of the first channel) is output.

- FIG. 8 is a schematic diagram showing an example of the noise reduction processing effect adjusting means.

- an image 84 in which the input image 81 and the output image 83 of the inference processing by the machine learning model 82 using the trained model are blended with a specific coefficient ⁇ is used.

- the size of ⁇ ( ⁇ : a real number from 0 to 1) may be changed according to the user's preference.

- the adjustment process may be performed by, for example, an inference processing unit 262, an arithmetic processing unit 266, or the like.

- step S906 the DC component of the divided image removed in step S904 is added to the divided image in which the noise generated in step S905 is reduced by the DC removing unit 265.

- step S907 the uncorrelated unit 264 performs the inverse conversion processing of the noise uncorrelated processing in step S903 for the divided image to which the DC addition processing was performed in step S906. Specifically, in step S903, when the square root conversion is performed according to (Equation 6), the uncorrelated unit 264 determines that the divided image is Im 2 . Perform the inverse transformation so that Further, in step S903, when the square root conversion is performed according to (Equation 7), the uncorrelated unit 264 determines that the divided image is Im 2 . Perform the inverse transformation so that By these processes, each pixel value in each divided image can be returned to the pixel value corresponding to the pixel value of each divided image before the noise uncorrelated processing. However, since the noise reduction processing is performed on the divided image in step S905, each pixel value is a pixel value in which noise is reduced.

- step S908 the end determination is performed, and if the post-processing is completed for all the divided images, the process proceeds to step S909. If not, the flow of steps S903 to S907 is repeated.

- step S909 the division unit 263 arranges each of the divided images subjected to the inverse conversion process in step S907 at the positions where the radiation images are divided during the area division process in step S902, and performs a combination process. Combine the split images to generate the entire radiographic image.

- step S902 when the divided images are divided so that a part of the adjacent regions overlaps, the overlapping portion is subjected to addition averaging processing in which the weight of the distance from each original image is used. May be performed to synthesize an image so that a step in the pixel value is not created in the overlapping portion.

- FIG. 10 shows an example of a series of pre-processed radiographic images 1001 and post-processed radiographic images 1002 according to this embodiment. Comparing the radiation image 1001 and the radiation image 1002, in the radiation image 1002 subjected to a series of image processing according to the present embodiment, the noise contained in the radiation image 1001 is reduced, and the inspected object O included in the radiation image is clear. It can be seen that it is shown in.

- the uncorrelated unit 264 is configured to perform square root conversion as noise uncorrelated processing.

- the noise uncorrelated processing is not limited to this, and other processing may be used as long as it can stabilize the dispersion of the Poisson distribution.

- the uncorrelated unit 264 may perform noise uncorrelated processing by logarithmically converting a radiographic image. Specifically, when the radiographic image (input image) is Im, The radiographic image is logarithmically converted so as to be. In this case, in the inverse conversion process in step S907, the uncorrelated unit 264 determines that the radiographic image is Im 2 . Inverse conversion is performed on the radiation image so as to be. Even in such a case, the correlation between the noise contained in the radiographic image and the signal magnitude can be eliminated, and learning by a machine learning model using learning data based on such an image can be simplified. Can be done.

- the inference processing unit 262 is processed by using the trained model created by the learning processing unit 261 to reduce noise suitable for the digital radiography apparatus. Radiation images can be generated.

- the control unit 20 includes an acquisition unit 21 and an arithmetic processing unit 266.

- the acquisition unit 21 acquires the first radiographic image of the object O to be inspected.

- the arithmetic processing unit 266 inputs the first radiation image acquired by the acquisition unit 21 into the trained model obtained by training using the training data including the radiation image obtained by adding the noise with the attenuated high frequency component.

- the noise includes noise in which the high frequency component is attenuated.

- it includes noise according to the modulation transfer function (MTF) of the phosphor 11 included in the radiation detector 10.

- MTF modulation transfer function

- the artificial noise is, for example, noise imitating the system noise of the radiation detector 10 such as additive white noise, and quantum noise (high frequency component attenuated) in consideration of the influence of MTF on the noise following the Poisson distribution. Noise) and combined noise are included.

- the artificial noise may include noise imitating the system noise of the radiation detector 10 and noise in which high frequency components are attenuated and synthesized at a predetermined synthesis ratio.

- the artificial noise includes noise imitating the system noise of the radiation detector 10 and noise attenuated by high frequency components, and disperses the entire noise included in the radiation image of the object O to be inspected used for training data.

- the artificial noise includes noise obtained by synthesizing noise imitating the system noise of the radiation detector 10 and noise attenuated by high frequency components at the first synthesis ratio, and a second synthesis ratio different from the first synthesis ratio. It may include the noise synthesized in. Further, the artificial noise may include random noise and noise different from random noise.

- control unit 20 uses the trained model to reduce noise including noise caused by blurring due to the phosphor (noise in which high frequency components are attenuated) from the radiation image. It is possible to generate a radiofrequency image. By using such a radiographic image, it is possible to support more appropriate image analysis and support an appropriate image diagnosis by a doctor.

- control unit 20 further includes an uncorrelated unit 264.

- the uncorrelated unit 264 performs a conversion process on the radiographic image of the inspected object O so as to stabilize (make it substantially constant) the dispersion of noise according to the Poisson distribution contained in the radiographic image of the inspected object O. It functions as an example of the conversion unit to be performed.

- the uncorrelated unit 264 performs a conversion process on the first radiation image, and the arithmetic processing unit 266 generates a second radiation image based on the first radiation image on which the conversion process has been performed. Further, the uncorrelated unit 264 performs an inverse conversion process of the conversion process on the second radiographic image.

- the uncorrelated unit 264 performs a square root conversion process on the first radiographic image and an inverse conversion process of the square root conversion process on the second radiographic image.

- learning by a machine learning model can be further simplified, and the accuracy of noise reduction processing using the trained model can be improved.

- control unit 20 further includes a DC removal unit 265.

- the DC removing unit 265 functions as an example of an adjusting unit that adjusts the average value of the pixel values included in the radiographic image of the object O to be inspected.

- the DC removing unit 265 subtracts the average value of the pixel values from each pixel value included in the first radiation image subjected to the conversion process by the uncorrelated unit 264.

- the arithmetic processing unit 266 generates a second radiographic image based on the first radiographic image from which the average value has been subtracted.

- the DC removing unit 265 adds the subtracted average value to each pixel value included in the second radiation image.

- the uncorrelated unit 264 performs an inverse conversion process on the second radiographic image to which the average value is added.

- the variation in brightness for each input image can be suppressed, and the machine learning model can easily learn the characteristics of the shape (distribution) of noise in the image, and the trained model can be learned. It is possible to improve the accuracy of the noise reduction processing using.

- the learning data can include a radiation image obtained by performing a conversion process related to noise uncorrelated processing on the radiation image of the object O to be inspected. Further, the training data can include a radiation image obtained by subtracting the average value of the pixel values from each pixel value included in the radiation image subjected to the conversion process. Further, the training data can include a radiation image subjected to square root conversion so that the standard deviation of noise is larger than the standard deviation of noise in the square root conversion performed on the first radiation image.

- the learning data can include data in which the radiation image obtained by adding artificial noise to the radiation image of the object O to be inspected is used as input data and the radiation image of the object O to be inspected is used as correct answer data.

- the training data includes data in which the radiation image obtained by adding artificial noise to the radiation image subjected to the conversion processing related to the noise uncorrelated processing is used as input data and the radiation image subjected to the conversion processing is used as the correct answer data. Can be done.

- the training data includes data in which the radiation image obtained by adding artificial noise to the radiation image obtained by subtracting the average value of the pixel values is used as the input data and the radiation image obtained by subtracting the average value of the pixel values is used as the correct answer data. Can be done.

- control unit 20 further includes a division unit 263.

- the dividing unit 263 functions as an example of a dividing unit that divides a radiographic image into a plurality of radiographic images.

- the dividing unit 263 divides the radiographic image of the object O to be inspected into a plurality of first radiographic images.

- the arithmetic processing unit 266 generates a plurality of second radiation images based on the plurality of first radiation images.

- the dividing unit 263 combines a plurality of second radiographic images to generate a third radiographic image with reduced noise.

- the radiation image used for the training data can include a plurality of radiation images obtained by dividing the radiation image of the object O to be inspected. With such a configuration, even if the number of pixels of the radiation image exceeds the number of pixels that can be processed at one time by the trained model, it is possible to generate the radiation image subjected to noise reduction processing. can.

- step S402 and step S902 the dividing unit 263 divided the acquired radiographic image into a plurality of divided images.

- the processes after step S402 and step S902 may be performed on the entire acquired radiographic image.

- the DC removal processing in steps S405 and S904 and the DC addition processing in step S906 can be performed. In this case, it is possible to suppress the variation in brightness for each radiation image and suppress the variation in brightness for each image output from the trained model to be emphasized.

- the uncorrelated unit 264 is configured to perform square root conversion as noise uncorrelated processing.

- the noise uncorrelated processing is not limited to this, and other processing may be used as long as it can stabilize the dispersion of the Poisson distribution.

- the uncorrelated unit 264 may perform noise uncorrelated processing by logarithmically converting a radiographic image. Specifically, when the radiographic image (input image) is Im, The radiographic image is logarithmically converted so as to be. In this case, in the inverse conversion process in step S907, the uncorrelated unit 264 determines that the radiographic image is Im 2 . Inverse conversion is performed on the radiation image so as to be. Even in such a case, the correlation between the noise contained in the radiographic image and the signal magnitude can be eliminated, and learning by a machine learning model using learning data based on such an image can be simplified. Can be done.

- the learning device for learning the machine learning model and generating the learning data may be provided separately from the control unit 20, and the learning device functions as an example of the acquisition unit 21 and the learning unit. It suffices to have a configuration corresponding to the unit 22.

- the trained model may be any machine learning model that has been trained in advance, and it is not necessary to perform training every time image processing including noise reduction processing using the trained model is performed.

- the trained model may be provided in an external storage device 70 or the like connected to the control unit 20, for example, a cloud server, a fog server, or an edge server connected to the control unit 20 via a network 60 such as the Internet. Etc. may be provided.

- the timing of addition of artificial noise may be any timing between each processing performed in the inference processing unit.

- the artificial noise addition processing is performed after the preprocessing including the noise uncorrelated processing and the DC removal processing. Since the learning processing unit that generates the learning data has the same configuration as that described in the first embodiment, the description will be omitted by using the reference code for the learning processing unit 261 according to the first embodiment.

- Steps S1101 and S1102, and steps S1103 and S1104 are the same as steps S401 and S402, and steps S404 and S405 relating to the method for generating learning data according to the first embodiment.