WO2020218029A1 - 電子内視鏡システム及びデータ処理装置 - Google Patents

電子内視鏡システム及びデータ処理装置 Download PDFInfo

- Publication number

- WO2020218029A1 WO2020218029A1 PCT/JP2020/016068 JP2020016068W WO2020218029A1 WO 2020218029 A1 WO2020218029 A1 WO 2020218029A1 JP 2020016068 W JP2020016068 W JP 2020016068W WO 2020218029 A1 WO2020218029 A1 WO 2020218029A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- lesion

- degree

- image

- section

- value

- Prior art date

Links

Images

Classifications

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/00002—Operational features of endoscopes

- A61B1/00043—Operational features of endoscopes provided with output arrangements

- A61B1/00045—Display arrangement

- A61B1/0005—Display arrangement combining images e.g. side-by-side, superimposed or tiled

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/00002—Operational features of endoscopes

- A61B1/00004—Operational features of endoscopes characterised by electronic signal processing

- A61B1/00009—Operational features of endoscopes characterised by electronic signal processing of image signals during a use of endoscope

- A61B1/000094—Operational features of endoscopes characterised by electronic signal processing of image signals during a use of endoscope extracting biological structures

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T1/00—General purpose image data processing

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/04—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor combined with photographic or television appliances

- A61B1/05—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor combined with photographic or television appliances characterised by the image sensor, e.g. camera, being in the distal end portion

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/06—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor with illuminating arrangements

- A61B1/0661—Endoscope light sources

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/06—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor with illuminating arrangements

- A61B1/0661—Endoscope light sources

- A61B1/0669—Endoscope light sources at proximal end of an endoscope

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/06—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor with illuminating arrangements

- A61B1/0661—Endoscope light sources

- A61B1/0684—Endoscope light sources using light emitting diodes [LED]

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/06—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor with illuminating arrangements

- A61B1/07—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor with illuminating arrangements using light-conductive means, e.g. optical fibres

Definitions

- the present invention relates to an electronic endoscopy system and a data processing device that process images of living tissues in an organ.

- ulcerative colitis ulcerative colitis

- the ulcerated part of an ulcerative colitis (UC) lesion becomes white with white moss and purulent mucus, and the inflamed part becomes reddish with edema and easy bleeding.

- UC ulcerative colitis

- the endoscopic system provides an evaluation result in which the degree of lesion in the lesion is objectively quantified.

- an endoscope system that can suppress fluctuations in the evaluation value of the inflamed area due to the brightness of the image, perform stable evaluation value calculation, and reduce the processing load of the evaluation value calculation is known. (Patent Document 1).

- a light source device that irradiates the subject with illumination light and an image acquisition unit that captures the reflected light from the subject with an image pickup element and acquires a color image containing at least three or more color components.

- an image acquisition unit that captures the reflected light from the subject with an image pickup element and acquires a color image containing at least three or more color components.

- a predetermined reference point set in the color plane and a color image acquired by the image acquisition unit are configured.

- a line segment connecting pixel corresponding points in the color plane of each pixel, a reference axis having a correlation with the target disease, and an evaluation unit for obtaining an evaluation result regarding the target disease of each pixel based on an angle formed by the reference axis are provided.

- the reference axis is set so as to pass through a predetermined reference point.

- the reference axis is at least one of an axis having a correlation with a target disease having an inflammation degree of a predetermined value or less and an axis having a correlation with a target disease having an inflammation degree of a predetermined value or more in the color plane. According to such a configuration, it is possible to suppress the fluctuation of the inflammation evaluation value due to the brightness of the image, perform stable calculation of the inflammation evaluation value, and suppress the processing load of the calculation of the inflammation evaluation value.

- the brightness of the image changes depending on the imaging conditions such as the distance between the subject and the endoscope, and even if an image of a living tissue having the same intensity of inflammation is imaged, the inflammation evaluation value varies.

- the inflammation evaluation value fluctuates and varies even when the degree of lesion changes along the depth direction in the organ.

- the method of treating the lesion may also differ.

- an object of the present invention is to obtain an index appropriately indicating the degree of lesion in a predetermined region in an organ in an electronic endoscopy system and a data processing device that process an image of a living tissue inside an organ. ..

- One aspect of the present invention is an electronic endoscope comprising an endoscope configured to image a living tissue in an organ extending in the depth direction and a processor configured to process the image of the captured living tissue. It is a mirror system.

- the electronic endoscopy system An evaluation value calculation unit configured to obtain an evaluation value indicating the degree of lesion in a living tissue of each of a plurality of images taken in a predetermined section along the depth direction of the region in the organ.

- a determination unit configured to determine whether or not the degree of lesion has changed within the section based on the degree of variation in the evaluation values.

- a representative value determination configured to determine a representative value of the section representing the evaluation value by a different method depending on whether the degree of lesion is determined to have changed or not. It is characterized by having a part and.

- the determination unit makes the determination using an index indicating the degree of variation obtained from the evaluation value, and when the degree of variation indicated by the index is equal to or greater than a predetermined value, the lesion is found in the section. It is preferably configured to determine that the degree has changed.

- the index is preferably the difference between the maximum value and the minimum value of the evaluation values.

- the index is preferably the standard deviation or variance of the evaluation value.

- the index is preferably an index indicating the degree of fit of the regression line obtained by regressing the evaluation value in the order of the images in which the image was taken.

- the electronic endoscope system further includes a position information processing unit configured to associate information on an imaging position in the organ in which each of the images is imaged with each of the images. It is preferable that the determination unit further uses the information on the imaging position to identify a region within the section where the degree of the lesion has changed.

- the evaluation value obtained by the evaluation value calculation unit is an evaluation value indicating the degree of lesions in the biological tissue of each of the plurality of images taken in each of the plurality of sections in which the region in the organ including the section is divided in the depth direction.

- the electronic endoscope system further includes a section specifying unit configured to specify in which section of the plurality of sections the image is captured by utilizing the information of the imaging position. ..

- the determination unit is configured to make the determination for each of the sections. It is preferable that the representative value determining unit is configured to determine the representative value for each of the sections.

- a position information processing unit configured to associate the information of the imaging position in the organ in which each of the images is imaged with each of the images.

- the determination unit makes the determination using the slope of the regression line obtained by returning the evaluation value to the imaging position, and when the slope is greater than or equal to a predetermined value, the degree of the lesion within the section. Is preferably configured to determine that is changing.

- the determination unit makes the determination by further using an index indicating the degree of fit of the regression line, and when the degree of fit indicated by the index exceeds a predetermined value, the inclination of the regression line is used. It is preferably configured to make a determination.

- the determination unit is configured to specify the degree of change of the lesion in the section according to the magnitude of the inclination of the regression line.

- the determination unit is configured to perform the determination based on the variation of some of the evaluation values.

- the representative value determining unit determines that the degree of the lesion has changed within the section, the maximum of the evaluation values of at least a part of the images captured in the section among the evaluation values. It is preferable that the value is configured to be the representative value of the section.

- the representative value determining unit averages at least a part of the evaluation values of the image captured in the section. It is preferable that any one of the value, the mode value, and the median value is set as the representative value of the section.

- the electronic endoscopy system uses information on the determination result of whether or not the degree of the lesion has changed, when it is determined that the degree of the lesion has changed and when it is determined that the degree of the lesion has not changed. It is preferable to further include a monitor configured to display the screen in a display mode different from that of the above.

- Another aspect of the present invention is a data processing device that processes an image of a living tissue in an organ that extends in the depth direction.

- the data processing device An evaluation value calculation unit configured to obtain an evaluation value indicating the degree of lesion in a living tissue of each of a plurality of images taken in a predetermined section along the depth direction of the region in the organ.

- a determination unit configured to determine whether or not the degree of lesion has changed within the section based on the degree of variation in the evaluation values.

- a representative value determination configured to determine a representative value of the section representing the evaluation value by a different method depending on whether the degree of lesion is determined to have changed or not. It is characterized by having a part and.

- FIG. 1 It is a block diagram which shows the structure of the endoscope system of one Embodiment. It is a figure explaining the structure of the part which evaluates the spread of the lesion in the depth direction of an organ of the image processing unit shown in FIG. It is a figure explaining the example of the reference axis in the color space used in one Embodiment. It is a figure explaining the method of calculating the deviation angle for calculating the degree of redness of a living tissue used in one Embodiment.

- (A) and (b) are graphs showing the relationship between the number of times of imaging and the image evaluation value of the captured image.

- (A) and (b) are graphs showing the relationship between the number of times of imaging and the image evaluation value of the captured image.

- (A) and (b) are graphs showing the relationship between the number of times of imaging and the image evaluation value of the captured image.

- (A) and (b) are graphs showing the relationship between the number of times of imaging and the image evaluation value of the captured image. It is a figure which shows an example of the flow from image acquisition to obtaining the representative evaluation value for each section performed by the evaluation unit of one embodiment. It is a figure which shows another example of the flow from image acquisition to obtaining the representative evaluation value for each section performed by the evaluation unit of one embodiment. It is a figure explaining the large intestine which is an example of the organ to be measured by the endoscope system of one Embodiment. It is a figure which shows an example of the evaluation result by the lesion evaluation part of one Embodiment.

- the processor of the electronic endoscopy system of the embodiment described below processes the image of the living tissue inside the organ taken by the electronic endoscope to evaluate the degree of lesion.

- the extent of the lesion includes at least the strength of the lesion and, according to one embodiment, further includes the extent of the lesion.

- the depth direction includes both a direction from the opening end to the deepest side and a direction from the deepest side to the opening end side.

- the images of the living tissue may be moving images continuously taken at regular time intervals, or may be a plurality of still images taken intermittently while moving the electronic endoscope in the organ. ..

- the speed of the electronic endoscope does not necessarily have to be constant, and the image is taken by returning to the place where the electronic endoscope has passed, that is, the moving direction is partially reversed. You can also do it.

- the electronic endoscope is imaged while moving at substantially the same speed and in substantially the same direction.

- the processor calculates an image evaluation value (evaluation value) indicating the intensity of the lesion in each of the plurality of images of the living tissue illuminated by the illumination light of white light.

- This image evaluation value is not particularly limited, but for example, when the lesion is inflamed, the degree of inflammation of the lesion (inflamed part) is evaluated based on the information of the color component of the lesion (for example, red).

- the evaluation value can be given.

- the organ to be evaluated is not particularly limited, and examples thereof include gastrointestinal tracts such as pharynx to esophagus, stomach, duodenum, small intestine, and large intestine.

- a living tissue is illuminated and imaged using special light including a laser beam having a wavelength of 405 nm, a laser beam having a wavelength of 445 nm, and a fluorescence having a phosphor emitted by a laser beam having a wavelength of 445 nm and having a fluorescence of 445 to 700 nm.

- the evaluation value for evaluating the mucous membrane or the like in atrophic gastric inflammation can be used as the above-mentioned image evaluation value.

- the evaluation value for each image created by using the image for example, the evaluation value for evaluating the state of blood vessels in the deep mucosa can be used as the above image evaluation value.

- the cells of the mucosa of the gastrointestinal tract which are illuminated with light and have been pretreated by staining or the like, are magnified and imaged, and the characteristics of the cell nuclei (length, diameter, perimeter, roundness, etc.)

- the average value of information can be used as an image evaluation value for evaluating the degree of lesions such as non-tumor, adenoma, and cancer.

- the image evaluation value may be an evaluation value such as a Mayo score obtained for each image.

- the evaluation value calculated by using the evaluation device machine-learned from the captured image may be used as the image evaluation value.

- the image evaluation value may be a numerical value of the histopathological evaluation for each image.

- the processor calculates a representative evaluation value (representative value) of the image evaluation value from the image evaluation values of a plurality of images of the living tissue imaged in a predetermined section along the depth direction of the region in the imaged organ, and this representative evaluation.

- the value is used to assess the extent of lesions within a given interval.

- the section to be evaluated may be one section in the organ, but according to one embodiment, it is preferable that the section in the organ is divided into a plurality of sections in the depth direction. In this case, when each image is imaged, the information of the imaging position inside the captured organ is associated with each image. Further, according to one embodiment, it is preferable to include a lesion evaluation unit configured to evaluate the degree of lesion using a representative evaluation value.

- the processor uses the acquired imaging position information to use the representative evaluation values calculated for each of the plurality of sections in which the imaged organ region is divided in the depth direction. Evaluate the extent and strength of lesions that are continuously spreading in the depth direction of the organ.

- the section is a section divided by a distance equal to or longer than the sampling interval of the imaging position.

- this section is a section delimited at predetermined intervals.

- the predetermined interval may be a constant interval or may not be constant. Further, the predetermined interval may be changed at any time during the calculation of the representative evaluation value.

- the pre-divided sections may be changed to larger sections, for example, segments that are distinguishable from other parts within the organ.

- the degree of lesion is evaluated by obtaining a representative evaluation value of an image evaluation value corresponding to this section for each of a plurality of sections and displaying the distribution of the representative evaluation value in the depth direction. It includes providing the total value of the representative evaluation values corresponding to the section including the lesion portion determined by using the image evaluation value. Thereby, the degree of the lesion in which the extent and the strength of the lesion are evaluated at the same time can be evaluated by dividing it into levels.

- the representative evaluation value of the image evaluation value is calculated from the image evaluation value for each of a plurality of sections in which the region inside the imaged organ is divided by using the information of the imaging position inside the organ in which each image is imaged. Therefore, the extent of the lesion can be evaluated accurately.

- the representative evaluation value is an index of the strength of the lesion in the section. Therefore, it is possible to accurately evaluate not only the local lesion strength of living tissue for each of a plurality of captured images, but also the comprehensive evaluation including the lesion spread and the lesion strength in the depth direction of the organ. it can.

- the spread of the lesion indicates that the lesion is continuously spread in the depth direction. For this reason, it is difficult to evaluate the extent of a lesion even if the image is discretely imaged at several positions in the organ and the image evaluation value is calculated.

- FIG. 1 is a block diagram showing a configuration of an electronic endoscope system 1 according to an embodiment of the present invention.

- the electronic endoscope system 1 includes an electronic scope 100, an electronic endoscope processor 200, a monitor 300, and a printer 400.

- the electronic endoscope processor 200 includes a system controller 202 and a timing controller 206.

- the system controller 202 executes various programs stored in the memory 204 and controls the entire electronic endoscopy system 1 in an integrated manner. Further, the system controller 202 changes various settings of the electronic endoscopy system 1 according to an instruction by a user (operator or assistant) input to the operation panel 208. On the operation panel 208, for example, input for setting a statistic to be used as a representative value can be performed, and at that time, different statistic can be set according to a determination result described later.

- the timing controller 206 outputs a clock pulse for adjusting the operation timing of each part to each circuit in the electronic endoscope system 1.

- the electronic endoscope processor 200 includes a light source unit 230 that supplies illumination light to the electronic scope 100.

- the light source unit 230 includes, for example, a high-intensity lamp that emits white illumination light by receiving drive power from a lamp power source, for example, a xenon lamp, a metal halide lamp, a mercury lamp, or a halogen lamp.

- the illumination light emitted from the high-intensity lamp is focused by a condensing lens (not shown) and then incident on the incident end of the LCB (Light Carrying Bundle) 102 of the electron scope 100 via a dimmer (not shown).

- the light source unit 230 is configured.

- the light source unit 230 includes a plurality of light emitting diodes that emit light in a wavelength band of a predetermined color.

- the light emitted from the light emitting diode is synthesized by using an optical element such as a dichroic mirror, and the synthesized light is collected as illumination light by a condensing lens (not shown), and then the LCB (Light Carrying Bundle) 102 of the electron scope 100.

- the light source unit 230 is configured so as to be incident on the incident end of.

- a laser diode may be used instead of the light emitting diode.

- the light emitting diode and the laser diode have features such as low power consumption and low heat generation amount as compared with other light sources, they have an advantage that a bright image can be acquired while suppressing power consumption and heat generation amount. By acquiring a bright image, it is possible to improve the accuracy of the evaluation value regarding inflammation described later.

- the light source unit 230 is built in the electronic endoscope processor 200, but is provided in the electronic endoscope system 1 as a device separate from the electronic endoscope processor 200. It may be provided. Further, the light source unit 230 may be provided at the tip end portion of the electronic scope 100 described later. In this case, the LCB 102 that guides the illumination light is unnecessary.

- the illumination light incident on the LCB 102 from the incident end propagates in the LCB 102 and is emitted from the end of the LCB 102 arranged in the tip of the electron scope 100, and is emitted from the end of the LCB 102 via the light distribution lens 104, and the biological tissue inside the organ which is the subject. Is irradiated to.

- the reflected light from the living tissue forms an optical image on the light receiving surface of the solid-state image sensor 108 via the objective lens 106.

- the solid-state image sensor 108 is, for example, a single-plate color CCD (Charge-Coupled Device) image sensor in which various filters of an IR (Infrared) cut filter 108a and a Bayer array color filter 108b are arranged on a light receiving surface. Each primary color signal of R (Red), G (Green), and B (Blue) corresponding to the imaged optical image is generated.

- a single-plate color CMOS (Complementary Metal Oxide Semiconductor) image sensor can also be used instead of the single-plate color CCD image sensor.

- CMOS image sensors generally tend to have an overall darker image than CCD image sensors.

- the electron scope 100 uses the solid-state image sensor 108 to image the biological tissue inside the organ and generate a moving image.

- a driver signal processing circuit 112 is provided inside the connection portion of the electronic scope 100 with the processor 200.

- the driver signal processing circuit 112 generates an image signal (brightness signal Y, color difference signal Cb, Cr) by performing predetermined signal processing such as color interpolation and matrix calculation on the primary color signal input from the solid-state image sensor 108. , The generated image signal is output to the image processing unit 220 of the electronic endoscope processor 200. Further, the driver signal processing circuit 112 accesses the memory 114 and reads out the unique information of the electronic scope 100.

- the unique information of the electronic scope 100 recorded in the memory 114 includes, for example, the number of pixels and sensitivity of the solid-state image sensor 108, the operable frame rate, the model number, and the like.

- the driver signal processing circuit 112 outputs the unique information read from the memory 114 to the system controller 202.

- the system controller 202 performs various calculations based on the unique information of the electronic scope 100 and generates a control signal.

- the system controller 202 uses the generated control signal to operate each circuit in the electronic endoscope processor 200 so that processing suitable for the electronic scope 100 connected to the electronic endoscope processor 200 is performed. And control the timing.

- the timing controller 206 supplies clock pulses to the driver signal processing circuit 112, the image processing unit 220, and the light source unit 230 according to the timing control by the system controller 202.

- the driver signal processing circuit 112 drives and controls the solid-state image sensor 108 at a timing synchronized with the frame rate of the image processed by the electronic endoscope processor 200 according to the clock pulse supplied from the timing controller 206.

- the image processing unit 220 is a portion capable of performing image processing according to an operator's instruction or according to preset processing contents. Under the control of the system controller 202, the image processing unit 220 generates a video signal for displaying an endoscopic image or the like on a monitor based on the image signal of the captured image input from the driver signal processing circuit 112, and the monitor 300. Output to. Further, as a part of image processing, the image processing unit 220 processes a plurality of images of the imaged biological tissue to evaluate the degree of lesions in the organ, and generates a video signal for displaying the evaluation result on a monitor. Then, it is output to the monitor 300.

- the image processing unit 220 calculates an image evaluation value described later, which indicates the degree of lesions in the living tissue in each of the images, from a plurality of images of the living tissue obtained by the electron scope 100.

- the electronic scope 100 is set to the biological tissue inside the organ while moving substantially continuously along the depth direction inside the organ (including the case where the imaging position in the depth direction is partially displaced in the opposite direction). Image at a frame rate. Therefore, the image processing unit 220 takes an image by utilizing the image evaluation value of the images captured substantially continuously along the substantially depth direction and the information of the imaging position inside the organ in which each of the plurality of images is imaged.

- a representative evaluation value of the image evaluation value is calculated for each of a plurality of sections in which the region inside the organ is divided at predetermined intervals, and the representative evaluation value is used to continuously spread the lesion in the depth direction inside the organ. Evaluate the degree.

- the representative evaluation value is an evaluation value that represents the image evaluation value of a plurality of images captured in the section.

- the image processing unit 220 generates a color map image in which the color of each pixel in the image is replaced according to the pixel evaluation value described later.

- the image processing unit 220 generates information on the evaluation result of the degree of lesion in the organ and a video signal for displaying the color map image on the monitor, and outputs the video signal to the monitor 300.

- the image processing unit 220 outputs a color map image and information on the evaluation result of the degree of lesion in the organ to the printer 400 as needed.

- the electronic endoscope processor 200 is connected to the server 600 via the NIC (Network Interface Card) 210 and the network 500.

- the processor 200 for electronic endoscopy can download information related to endoscopy (for example, electronic medical record information of a patient, information of an operator, evaluation result of the degree of lesion in the same organ in the past) from a server 600. ..

- the downloaded information is displayed, for example, on the display screen of the monitor 300 or the operation panel 208.

- the electronic endoscope processor 200 uploads the endoscopic examination results (endoscopic image data, examination conditions, evaluation results of the degree of organ lesions, operator's findings, etc.) to the server 600, thereby causing the server. It can be stored in 600.

- FIG. 2 is a diagram illustrating a configuration of a portion of the image processing unit 220 for evaluating the degree of lesion in the section.

- the image processing unit 220 is a portion configured to process a plurality of images of living tissue captured by the electron scope 100 and evaluate the degree of lesions.

- the image processing unit 220 includes a preprocessing unit 220a, an image evaluation value calculation unit 220b, an image pickup position information processing unit 220c, a determination unit 220d, a lesion evaluation unit 220e, a lesion site calculation unit 220f, and an evaluation result integration unit 220g.

- the preprocessing unit 220a, the image evaluation value calculation unit 220b, the imaging position information processing unit 220c, the lesion evaluation unit 20d, the lesion site calculation unit 220f, and the evaluation result integration unit 220g activate the software stored in the memory 204. It may be a software module formed by the above, or it may be composed of hardware.

- the electronic endoscope system 1 includes a position measurement system 250 described later, and the image processing unit 220 includes an image pickup position information processing unit 220c.

- the electronic endoscope system 1 does not include a position measuring system 250 and an imaging position information processing unit 220c.

- the image processing unit 220 includes a lesion site calculation unit 220f, but in another embodiment, the image processing unit 220 does not include a lesion site calculation unit 220f.

- the image evaluation value calculation unit 220b evaluates the degree of inflammation, which is an example of a lesion, for each image.

- inflammation generated by ulcerative colitis or the like will be described as an example of a lesion.

- the image evaluation value calculation unit 220b uses the degree of redness of the living tissue, which is obtained by quantifying the degree of redness of the living tissue for each pixel, as the pixel evaluation value, and integrates the pixel evaluation values of the entire image into one numerical value. Is calculated as an image evaluation value. That is, the intensity of inflammation of the living tissue is evaluated by using the degree of redness of the living tissue.

- a form for calculating the redness of living tissue which indicates the degree of inflammation, will be described as an example.

- the pretreatment unit 220a is a portion for pretreating an image for evaluating the degree of redness exhibited by a living tissue. As shown as an example, the preprocessing unit 220a performs RGB conversion, color space conversion, reference axis setting, and color correction processing. The preprocessing unit 220a converts the image signal (luminance signal Y, color difference signal Cb, Cr) input from the driver signal processing circuit 112 into image color components (R, G, B) using predetermined matrix coefficients. The preprocessing unit 220a further performs color conversion to project the image data converted into the image color component on the RG plane.

- the image color component of each pixel in the RGB color space defined by the RGB3 primary colors is converted into the image color component of RG.

- the points of the image color components of each pixel in the RGB color space and the points of the image color components plotted in the RG color space are referred to as “pixel correspondence points”.

- the RGB image color components of the RGB color space are, for example, color components having a wavelength of 620 to 750 nm, a wavelength of 495 to 570 nm, and a wavelength of 450 to 495 nm, respectively.

- the color component constitutes a color space (including a color plane). Hue and saturation are excluded from the "color components”.

- the pretreatment unit 220a sets a reference axis in the RG plane necessary for evaluating the redness of the living tissue.

- the R component of the image color components is dominant over the other components (G component and B component) due to the influence of the hemoglobin pigment and the like.

- the degree of lesion in the lesion is low and the lesion is inflamed, the stronger the inflammation, the stronger the red color (R component) with respect to other colors (G component and B component).

- the color of the captured image in the organ changes depending on the imaging conditions that affect the brightness (for example, the degree of illumination light and the distance between the subject and the endoscope).

- the shaded area that the illumination light does not reach is black (achromatic color, for example, the values of the image color components of R, G, and B are zero or close to zero), and the illumination light is strongly applied to the positive.

- the reflecting portion is white (achromatic color, for example, when the values of the image color components of R, G, and B are 8-bit gradation, the values are close to 255 or 255). That is, even when the same inflamed area where inflammation is occurring is imaged, the pixel value of the inflamed area increases as the illumination light hits the image. Therefore, depending on how the illumination light hits, the value of the color component of the image may take a value that does not correlate with the intensity of inflammation. Similarly, depending on the distance between the subject and the endoscope, the value of the color component of the image may take a value that does not correlate with the intensity of inflammation.

- the healthy part inside the non-inflamed organ is covered with sufficient mucous membrane.

- the inflamed area inside the inflamed organ is not sufficiently covered with mucous membrane.

- the mucous membrane becomes relatively thin and the color of the blood becomes easily visible.

- the mucous membrane is basically white, but the color is slightly yellowish, and the color (yellow) that appears on the image changes depending on the shade (thickness of the mucous membrane). Therefore, the shading of the mucous membrane is also considered to be one of the indexes for evaluating the degree of inflammation.

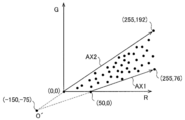

- FIG. 3 is a diagram illustrating an example of a reference axis in the color space used in one embodiment.

- the plot shown in FIG. 3 was obtained as a result of analyzing a large number of reference images inside the organ.

- the reference images used in the analysis include an example of an inflammation image with the highest degree of inflammation (an example of an inflammation image with the most severe level) and an example of an inflammation image with the lowest degree of inflammation (substantially considered to be a healthy part). Image examples) and other inflammation image examples of each stage are included.

- FIG. 3 only a part of the plot obtained as a result of the analysis is shown for convenience of clarifying the drawing.

- the number of plots actually obtained as a result of the analysis is much larger than the number of plots shown in FIG.

- the axis on the boundary line passing through 76) is set as the axis having the highest degree of inflammation, that is, the axis having a high correlation with the part having the highest degree of inflammation.

- This axis is the hemoglobin change axis AX1.

- the hemoglobin change axis AX1 is the axis on which the pixel correspondence points plotted as the degree of inflammation of the living tissue increases.

- the axis on the boundary line passing through 192) is set as the axis with the lowest degree of inflammation, that is, the part with the lowest degree of inflammation, which is highly correlated with what is considered to be a substantially healthy part. To. This axis is the mucosal change axis AX2.

- the mucosal change axis AX2 is superposed with plots corresponding to the lowest degree of inflammation imaged under various imaging conditions, for example, under various illumination conditions, that is, what is considered to be a substantially normal part. .. Therefore, the mucosal change axis AX2 is the axis on which the pixel correspondence points plotted as the degree of inflammation decreases (closer to the healthy part) converge.

- the highest degree of lesion in the lesion is accompanied by bleeding.

- the part with the lowest degree of lesion is a substantially normal healthy part, and is therefore covered with sufficient mucosa. Therefore, the plot in the RG color space shown in FIG. 3 can be regarded as being distributed in the region sandwiched between the axis having the highest correlation with blood (hemoglobin pigment) and the axis having the highest correlation with mucosal color. .. Therefore, of the boundary lines between the areas where the plot is distributed and the areas where the plot is not distributed, the boundary line closer to the R axis (stronger R component) is the axis indicating the inflamed area with the highest degree of inflammation (hemoglobin change axis AX1).

- the boundary line closer to the G axis corresponds to the axis indicating the inflamed part with the lowest degree of inflammation (mucosal change axis AX2).

- a process of calculating the redness of the living tissue which indicates the degree of redness, which will be described later, is performed on the color component of the normally projected image.

- color correction is performed on the normally projected pixel data.

- the reference axis shown in FIG. 3 is an example, and the reference axis varies depending on the type of disease.

- the pretreatment unit 220a performs color correction on the color components of the image represented in the RG color space before calculating the inflammation evaluation value.

- the correction matrix coefficient is stored in the memory 204. Pretreatment unit so that the inflammation evaluation values described later do not vary (in other words, to suppress inter-individual errors of the electronic scope) when images are taken with different electron endoscopy systems despite the same inflammation area.

- the 220a corrects the pixel data (R, G), which is the pixel corresponding point in the RG color space of each pixel, as shown in the following equation using the correction matrix coefficient.

- Rnew Corrected pixel data (R component)

- Gnew Corrected pixel data (G component)

- M 00 to M 11 Correction matrix coefficient

- R Pixel data before correction (R component)

- G Pixel data before correction (G component)

- the image evaluation value calculation unit 220b selects one pixel of interest from the pixels, and calculates the deviation angle for calculating the degree of inflammation of the selected pixel of interest based on the information of the color component of the pixel of interest. That is, a quantification process is performed to quantify the degree of redness of the living tissue based on the information of the color component of the pixel.

- FIG. 4 is a diagram illustrating a method of calculating a deviation angle for calculating the redness of living tissue used in one embodiment. Specifically, as shown in FIG.

- the image evaluation value calculation unit 220b sets the intersection of the hemoglobin change axis AX1 and the mucosa change axis AX2 as the reference point O', and sets the reference point O'and the pixel corresponding point of the pixel of interest.

- the deviation angle ⁇ at which the direction of the line segment L connecting P deviates from the reference axis AX1 is calculated.

- the reference point O' is located at the coordinates (-150, -75).

- the example in which the reference point O'is set to the coordinates (-150, -75) is given, but the present invention is not limited to this.

- the reference point O' can be changed as appropriate, and may be, for example, an intersection of the R axis and the G axis in the RG color space.

- a suitable coordinate position as the reference point O'is for example, a position where an error in the evaluation result due to fluctuations in brightness can be reduced.

- the reference point O' is determined in advance to minimize the error between the evaluation result in the dark part (brightness is less than the predetermined value) and the evaluation result in the non-dark part (brightness is more than the predetermined value). It is preferable to set it.

- the coordinates (-150, -75) and the like are compared with the case where the reference point O'is set. Therefore, the amount of change in the angle ⁇ when the pixel correspondence point changes becomes large, so that the resolution is improved. As a result, a highly accurate evaluation result can be obtained.

- the evaluation result indicating the degree of inflammation is not easily affected by noise.

- the color of the image is generally affected by individual differences, the location of the image, the state of inflammation, etc., but in the RG color space. In the most severely inflamed area, it changes along the hemoglobin change axis AX1, and in the inflamed area with the lowest degree of inflammation, it changes along the mucosal change axis AX2. In addition, it is presumed that the color of the image of the inflamed area where the degree of inflammation is intermediate changes with the same tendency.

- the pixel corresponding point corresponding to the inflamed portion changes depending on how the illumination light hits, the pixel corresponding point shifts in the azimuth direction starting from the reference point O'.

- the deviation angle ⁇ with respect to the mucosal change axis AX2 moves while being constant, and the distance from the reference point O'changes. This means that the shift angle ⁇ is a parameter that is substantially unaffected by changes in the brightness of the image.

- the image evaluation value calculation unit 220b normalizes the angle ⁇ so that the value becomes 255 when the deviation angle ⁇ is zero and the value becomes zero when the deviation angle ⁇ is ⁇ MAX .

- ⁇ MAX is equal to the angle formed by the hemoglobin change axis AX1 and the mucosal change axis AX2.

- the image evaluation value calculation unit 220b sets a value in the range of 0 to 255 obtained by normalizing the deviation angle ⁇ calculated based on the information of the color component of each attention pixel for each attention pixel, as the biological tissue redness (pixel). It is calculated as an evaluation value).

- the pixel of interest is selected one by one for all the pixels of the image.

- the RG color space is used as the color space, but the RB color space can be used instead of the RG color space.

- the image evaluation value calculation unit 220b calculates the redness of the living tissue, which is a value obtained by normalizing the deviation angle ⁇ , as the pixel evaluation value. In some cases, the whiteness of the living tissue indicating the degree of the characteristic of the ulcer of the living tissue is calculated. It can also be calculated as a pixel evaluation value.

- a gain adjustment that gives a linear gain (gain) to the pixel value of each color component of each pixel of an image of a living tissue is performed to substantially widen the dynamic range in the vicinity of the color gamut peculiar to a lesion, and color

- tone enhancement treatment that enhances the effective resolution of expression, for example, inflammation showing white ulcers including white moss and purulent mucus of ulcerative colitis and red color including edema and easy bleeding. It can be distinguished by the color component from the normal part showing a part or yellow or green.

- the whiteness of biological tissue is a color used as the coordinate axis of two color components (R component, G component, and B component) or three color components (R component, G component, and B component) as shown in FIG. It can be calculated by using the deviation angle with respect to the reference axis different from the reference axis AX represented in space.

- the tone enhancement process is performed by the preprocessing unit 220a.

- the image evaluation value calculation unit 220b calculates one image evaluation value using the pixel evaluation value of each pixel. For example, the pixels representing the image of the living tissue to be evaluated are selected from the captured images, and the integrated value or the average value of the pixel evaluation values of the selected pixels is calculated as one image evaluation value. Alternatively, for example, among the RGB color components or pixel brightness components for each pixel, the pixels to be evaluated are extracted based on the color components or brightness components in a predetermined range, and the average value of the pixel evaluation values of the extracted pixels is extracted. The image evaluation value calculation unit 220b calculates one image evaluation value by obtaining a weighted average value using a predetermined weighting coefficient, or by performing an integration process.

- the pixel portion to be evaluated in the image is a portion having a value of a color component within a predetermined range assumed in a living tissue in order to evaluate the degree of inflammation of an organ with high accuracy, and is illuminated by illumination light. It is preferable that the portion of the pixel has an illuminated brightness component of a predetermined value or more.

- the image evaluation value calculated by the image evaluation value calculation unit 220b is sent to the determination unit 220d and the lesion evaluation unit 220e.

- the image evaluation value calculation unit 220b further creates a color map image in which the image of the living tissue is mosaicked with a display color that changes according to the redness of the living tissue.

- a table in which the pixel evaluation value and the predetermined display color are associated with each other is stored in the storage area of the memory 204.

- different display colors are associated with each value in increments of 5.

- blue is associated with a pixel evaluation value in the range of 0 to 5

- different display colors are associated with each increase of the pixel evaluation value by 5 according to the order of colors in the color wheel.

- Red is associated with the pixel evaluation value in the range of 250 to 255.

- the display color is a color that approaches a warm color from a cold color, for example, from blue to yellow to red as the degree of redness of the living tissue increases.

- the image evaluation value calculation unit 220b determines the display color of the selected pixel of interest on the color map image based on the above table according to the redness of the biological tissue of the pixel of interest. In this way, the image evaluation value calculation unit 220b creates a color map image in which colors are added according to the degree of redness of the living tissue.

- the image pickup position information processing unit 220c acquires position information regarding the image pickup position sent from the position measurement system 250 provided in the electronic endoscope system 1, and associates the acquired position information with the image taken.

- the position measurement system 250 uses a sensor to acquire, for example, the position of the solid-state image sensor 108 located at the tip of the electronic scope 100 inserted into the organ, and the position of each of the subsequent flexible tubes.

- the system the system for acquiring the insertion length of the electronic scope 100 inserted from the open end of the organ, or the captured image is displayed on the monitor 300, and the operator who sees this image can see the inside of the inserted organ.

- This is a system for acquiring a specific partial passage signal indicating that the tip portion of the electronic scope 100 has passed through the characteristic portion of the above.

- the acquired information of the imaging position is sequentially sent to the determination unit 220d and the lesion evaluation unit 220e.

- a position near the solid-state image sensor 108 at the tip of the electronic scope 100 and a flexible tube following the tip to the processor 200 side A plurality of magnetic sensors are provided at predetermined intervals, and an electron scope 100 applies a magnetic field having different strength depending on the position from the outside of the human body inserted into the organ, and the magnetic sensor measures the strength of the magnetic field.

- the position of the magnetic sensor provided at the tip portion can be known, and further, the curved shape in the organ of the flexible tube can be known from the positions of the plurality of magnetic sensors.

- the position of the tip of the solid-state image sensor 108 can be known, and the shape of the electron scope 100 in the organ and the insertion length of the electron scope 100 from the open end can be known.

- the optical flow shows how much the biological tissue has moved between adjacent images in the captured moving image.

- Information on the insertion length of the current electronic scope 100 can be acquired by acquiring using the process and integrating the acquisition results to calculate the moving distance. Further, for example, information on the current insertion length of the electron scope 100 can be obtained by measuring the length of the flexible tube extending from the tip of the inserted electron scope 100 toward the inside of the organ. can do.

- the operator sees the image displayed on the monitor 300, and when the identifiable specific part inside the organ appears in the image and passes through, the button that the operator has at hand. By pressing, a specific partial passage signal is generated, and the imaging position information processing unit 220c can acquire this specific partial passage signal.

- the positions of specific parts inside the organ are, for example, when the organ is the large intestine, the position where the ascending colon begins, the position where the ascending colon ends and the large intestine bends and the transverse colon begins, and the position where the transverse colon ends and the large intestine bends and descends.

- the position where the descending colon ends, the large intestine bends and the sigmoid colon begins, the position where the sigmoid colon ends and the rectum begins, and the position where the rectum ends and reaches the anus.

- the determination unit 220d is configured to determine whether or not the degree of lesion changes in the section based on the degree of variation in the image evaluation values of the plurality of images captured in the section. By making such a determination, an index (representative evaluation value) indicating the degree of lesion in the section can be obtained more appropriately, and the degree of lesion can be evaluated accurately.

- the variation in the evaluation value may be the variation in the image evaluation value of all the images captured in the section, or may be the variation in the image evaluation value of some images as described later.

- a section in which the degree of lesion changes a section in which a plurality of lesion degrees exist and a section in which both a lesion and a normal part exist are included.

- Examples of the degree of the plurality of lesions include a plurality of ranks or a plurality of levels, which will be described later, which are different from each other.

- the determination unit 220d makes a determination using an index indicating the degree of variation obtained from the image evaluation value, and the degree of variation indicated by this index is equal to or higher than a predetermined threshold value (predetermined value). In some cases, it is preferably configured to determine that the extent of the lesion has changed within the section. Examples of such indicators include the following indicators 1 to 4. Index 1: Difference between the maximum and minimum values of the image evaluation values (the size of the range of image evaluation values) Index 2: Standard deviation (or variance) of the image evaluation value Index 3: An index showing the degree of fit of the regression line obtained by regressing the image evaluation value in the order of the images taken. Index 4: Slope of the regression line obtained by regressing the image evaluation value to the imaging position.

- FIGS. 5 to 8 show graphs showing the relationship between the number of measurements (number of images taken) in each section and the image evaluation value of the captured image for a certain two sections

- FIG. 8A shows the image evaluation value of the image evaluation value.

- a graph in a section with a small variation is shown

- (b) shows a graph in a section with a large variation in the image evaluation value.

- the number of measurements (number of imagings) on the horizontal axis indicates that the plot located on the right side is the one that was imaged later, and the number of measurements is from left to right in the order of imaging. Lined up in the direction.

- the horizontal axis indicates the imaging position along the depth direction in the organ, and the plot located on the right side indicates that the image was taken on the side of the open end of the organ.

- a threshold value for distinguishing the degree of variation in the image evaluation value between FIGS. 5 (a) and 5 (b) regarding the difference between the maximum value and the minimum value of the image evaluation value is set.

- the strength of the lesion changes within the section when the difference between the maximum value and the minimum value is equal to or greater than the threshold value as shown in FIG. 5 (b). ..

- the difference between the maximum value and the minimum value is less than the threshold value as shown in FIG. 5A, it can be determined that the lesion strength has not changed within the interval.

- a threshold value for distinguishing the degree of variation in the image evaluation value between FIGS. 6 (a) and 6 (b) should be set in advance with respect to the standard deviation (or variance). Therefore, when the standard deviation (or variance) is equal to or greater than the threshold value as shown in FIG. 6B, it can be determined that the strength of the lesion changes within the interval. Further, when the standard deviation (or variance) is less than the threshold value as shown in FIG. 6A, it can be determined that the lesion strength has not changed within the interval. Note that FIGS. 6A and 6B show the average value of the image evaluation values used in the calculation of the standard deviation (or variance).

- the degree of variation in the image evaluation value caused by the change in the brightness of the image is less than the threshold value, and the image caused by the change in the degree of lesion within the section.

- the degree of variation in the evaluation value is set to be equal to or higher than the threshold value.

- a threshold value for distinguishing the degree of variation of the image evaluation value with respect to the regression line between FIGS. 7 (a) and 7 (b) is set in advance with respect to the degree of fit of the regression line.

- y i captured image evaluation value y 'i of the image: the image evaluation value Y on the regression line: Mean value n of the image evaluation value of captured image: Number of captured images

- the coefficient of determination is indicated by a value from 0 to 1, and the closer it is to 1, the better the fit of the regression line.

- the threshold is set to a value between 0 and 1. As a result, when the coefficient of determination exceeds a predetermined threshold value, it is determined that the strength of the lesion changes within the section. If the coefficient of determination is less than or equal to the threshold value, it is determined that the lesion strength has not changed within the interval.

- the electronic endoscope system 1 does not have to have the position measurement system 250 and the imaging position information processing unit 220c.

- the graphs shown in FIGS. 5 to 7 there is no correlation between the image evaluation value and the imaging position, but whether or not the degree of lesion changes within the section using the above indicators 1 to 3. Can be determined.

- the variation of the image evaluation value may be large as shown in FIG. 8 (b). In this case, since it should be determined that the degree of lesion has changed within the section, it is preferable to make the determination using the index 4 described above.

- the determination unit 220d makes a determination using the inclination of the regression line obtained by regressing the image evaluation values in the order of the imaging positions along the depth direction, and the inclination is greater than or equal to a predetermined value. In some cases, it is preferably configured to determine that the extent of the lesion has changed within the section. In this case, it is preferable that the determination unit 220d is configured to perform a determination using the slope of such a regression line when the index indicating the degree of fit exceeds the threshold value.

- the slope of the regression line is not only when the index indicating the degree of fit of the regression line exceeds the threshold value, but also when the index indicating the degree of fit of the regression line is below the threshold value (when the fit is good). If is large, it can be determined that the degree of lesion has changed. On the other hand, when the index indicating the degree of fit of the regression line is equal to or less than the threshold value, it can be determined that the degree of lesion has not changed when the slope of the regression line is small.

- the determination using such an index 4 can be performed when the electronic endoscope system 1 includes the imaging position information processing unit 220c and the position measurement system 250.

- a threshold value for distinguishing the degree of variation in the image evaluation value between FIGS. 8 (a) and 8 (b) is set in advance with respect to the slope of the regression line.

- FIG. 8B when the slope of the regression line is equal to or greater than the threshold value, it can be determined that the strength of the lesion changes within the interval.

- FIG. 8A when the slope of the regression line is less than the threshold value, it can be determined that the strength of the lesion has not changed within the section.

- the determination is made using the index 4 it is possible to know how the strength of the lesion changes and the degree of the change. For example, it can be seen whether the strength of the lesion changes suddenly or slowly.

- the determination unit 220d further utilizes the imaging position information to determine the degree of lesion. It is preferable to identify the region within the section where is changing. By identifying the region where the strength of the lesion has changed, the region where the degree of lesion has changed exists, for example, in a spot shape or continuously so as to be connected to the lesion portion in the adjacent section. You can see if it is.

- the spot-like regions may exist in various depth directions depending on the length of the section. For example, there are cases where one or a plurality of spot-like regions exist in one section, and there are cases where they continuously exist over two or three or more sections.

- a region in which the degree of lesion has changed a region within one lesion that continuously spreads in the depth direction and a section including a boundary between the lesion and a normal portion (start position or end position described later). There is an area.

- the determination unit 220d further specifies the degree of change in the intensity of the lesion with respect to the region in the section where the degree of the lesion is changing by using the information of the imaging position. It is also preferable. For example, depending on whether the degree of change (inclination) of the lesion strength is greater than or equal to a predetermined threshold value or less than the threshold value, it can be determined whether the change in lesion strength is rapid or gradual. Further, depending on the direction of change in the strength of the lesion along one direction in the depth direction, it can be seen whether the strength of the lesion is stronger or weaker in the one direction. That is, according to one embodiment, it is preferable that the determination unit 220d is configured to specify the degree of change in the lesion in the section according to the magnitude of the inclination of the regression line.

- the lesion site calculation unit 220f may be configured to perform these identifications performed by the determination unit 220d.

- the determination unit 220d is configured to perform determination based on the variation of some image evaluation values among the image evaluation values. For example, when water for cleaning, blood, stool, etc. adheres to the part of the living tissue to be imaged or the tip of the endoscope, the image greatly deviates from the average value of the image evaluation values of all the images captured. The evaluation value may be calculated. If it is determined whether or not the degree of the lesion has changed within the section based on the variation in the image evaluation value including such outliers, the accuracy of the determination is lowered. In this embodiment, the strength of the lesion changes within the section by making a judgment based on the variation of the remaining image evaluation values excluding the outliers as some of the image evaluation values.

- the degree of lesion can be evaluated with high accuracy.

- outliers for example, from the maximum value, the minimum value, or both of the image evaluation values of all the images captured in the section, the range of variation of the image evaluation values (maximum value and minimum value).

- the image evaluation value within a predetermined ratio for example, several%) of the difference

- the inflammation evaluation value outside the range of the predetermined inflammation evaluation value may be excluded.

- outliers detected by the test are excluded from the image evaluation values of all the images captured in the section, and the test is performed again to detect another outlier. And repeat the exclusion.

- the outliers are preferably excluded from the image evaluation values obtained when all the images are imaged in the region in the organ to be imaged or in a predetermined segment. According to one embodiment, the image can be excluded while being reproduced.

- the lesion evaluation unit 220e uses the information regarding the imaging position sent from the imaging position information processing unit 220c to divide the region inside the imaged organ into a plurality of sections at predetermined intervals, and the living body of each of the plurality of sections.

- a representative evaluation value of the image evaluation value is calculated from the image evaluation values of a plurality of images obtained by imaging the tissue.

- the lesion evaluation unit 220e evaluates the spread of the lesion continuously spreading in the depth direction inside the organ by using the representative evaluation value. For example, in the case of ulcerative colitis in the large intestine, it can be evaluated that the lesion has spread from the rectum to the descending colon. In such an evaluation, the extent of the lesion can be evaluated assuming that the region where the representative evaluation value exceeds a preset threshold value is the lesion portion.

- the section may be predetermined by the operator, or the section may be divided by a specific partial passage signal.

- a section is defined by a specific partial passage signal, the section is called a segment.

- This segment is a part of one organ that can be distinguished from the other, for example, if the organ is the large intestine, the ascending colon segment, the transverse colon segment, the descending colon segment, the S-shape. Includes colon segment, rectal segment, etc.

- Such segments are separated by specific partial passage signals.

- the lesion evaluation unit 220e has a representative value determination unit 220h.

- the representative value determining unit 220h differs in the representative evaluation value depending on whether the determination unit 220d determines that the lesion intensity has changed within the section or has not changed. It is configured to be determined by the method.

- the brightness of the image changes depending on the shooting conditions such as the distance between the subject and the endoscope. Therefore, even if a site of a living tissue having the same inflammation intensity is imaged, the image evaluation value fluctuates and varies. On the other hand, the image evaluation value also fluctuates when the degree of the lesion changes along the depth direction in the organ, and the variation occurs.

- the image evaluation is performed not only when the image evaluation value varies due to the brightness of the image but also when the intensity of inflammation changes. Even if the values vary, it becomes a representative evaluation value indicating the average intensity of inflammation. As a result, it becomes difficult to understand that there is a lesion portion showing a stronger inflammation intensity than the representative evaluation value indicates in the section, and it is not possible to appropriately judge the inflammation intensity. Knowing the strength of a lesion is important in considering a treatment method for the lesion. Therefore, as described above, the representative value determining unit 220h determines the representative evaluation value by a different method depending on whether the lesion strength is determined to be changed or not. Determine. As a result, an index that appropriately indicates the degree of lesion in the section can be obtained, and the degree of lesion can be evaluated accurately.

- the method is preferably a statistical method.

- the representative value determining unit 220h determines at least a part of the images captured in the section when it is determined that the intensity of the lesion changes in the section. It is preferable that the maximum value among the evaluation values of the image of is set as the representative value of the section. This makes it possible to optimally indicate the degree of lesion in the section where the degree of lesion is changing. Further, according to one embodiment, when it is determined that the degree of lesion does not change in the section, the representative value determining unit 220h determines at least a part of the images captured in the section.

- any one of the average value, the mode value, and the median value of the evaluation values is set as the representative value of the section. Since it is considered that the variation in the evaluation value in the section where the degree of lesion has not changed is due to the imaging conditions, the strength of the lesion in the section can be appropriately determined by using these statistics as representative values. Can be shown.

- the maximum value, or any one of the average value, the mode value, and the median value is preferably determined based on the evaluation values of all the images captured in the interval, but as described above. In the case of excluding outliers from the image evaluation values as described above, it is preferable that the values are obtained based on the remaining image evaluation values.

- the lesion evaluation unit 220e may include the section identification unit 220i according to one embodiment. preferable.

- the section specifying unit 220i is configured to use the information of the imaging position to specify the section in which section the image associated with the acquired information is the image captured in the plurality of sections. ..

- the lesion evaluation unit 220e is configured to evaluate the degree of lesion by dividing it into a plurality of ranks related to the strength of the lesion, and the lesion evaluation unit 220e is based on a representative evaluation value. It is preferable to determine one of a plurality of ranks and evaluate the degree of lesion for each section. This makes it possible for the operator to accurately inform the operator of the extent and strength of the lesion that continuously spreads in the depth direction inside the organ. Further, according to one embodiment, it is preferable that the lesion evaluation unit 220e determines the presence or absence of a lesion portion in which the lesion is continuously spread in the depth direction of the organ for each section based on the representative evaluation value.

- the region of the lesion is a region in which the representative evaluation value is larger than the preset threshold value.

- the lesion evaluation unit 220e can also determine the presence or absence of a lesion portion in which the lesion is continuously spread in the depth direction of the organ based on the image evaluation value.

- the region of the lesion is a region where the image evaluation value is larger than the preset threshold value. Since the image evaluation value is an evaluation value for each image, it may include a noise component. In this case, it is preferable to use the representative evaluation value for each section instead of the image evaluation value.

- the lesion site calculation unit 220f obtains the start position and the end position of the lesion area by obtaining the section in which the lesion is located among the above sections based on the position information of the captured image. Identify the location of the lesion. In order to accurately determine the start position and end position of the lesion, it is also preferable to determine the position where the image evaluation value crosses a predetermined threshold value by using the image evaluation value and the position information obtained by capturing the image. .. In this case, the lesion evaluation unit 220e compares each image evaluation value with the threshold value to determine whether or not the image evaluation value crosses the threshold value. This determination result is sent to the lesion site calculation unit 220f.

- the lesion evaluation unit 220e preferably calculates the length of the lesion portion from the information on the start position and the end position of the lesion portion obtained by the lesion site calculation unit 220f. Therefore, according to one embodiment, it is preferable that the monitor 300 displays at least one of the start position, the end position, and the length of the lesion on the screen. This makes it easier for the operator to recognize the extent of the lesion organ in the depth direction. Further, the lesion evaluation unit 220e obtains the total value of the representative evaluation values corresponding to the sections included between the start position and the end position of the lesion part among the plurality of sections, and evaluates the degree of the lesion by the total value. It is preferable to do.

- the total value can be divided into a plurality of levels and the degree of lesion can be evaluated according to the level.

- the lesion evaluation unit 220e When many sections are set by shortening the length of the predetermined section, the lesion evaluation unit 220e provides position information along the depth direction of each section (for example, the distance from the deepest part of the electronic scope to the opening end).

- the curve created by the representative evaluation value for each section may be uneven in the adjacent section.

- the representative evaluation shown in the above graph is performed by performing a moving average process or a curve fitting process using a function indicating a predetermined curve by using the position information of the section and the representative evaluation value. It is preferable to process the value curve smoothly.

- FIG. 9 is a diagram showing an example of a flow performed by the evaluation unit 221 from image acquisition to obtaining a representative evaluation value for each section.

- the maximum value among the image evaluation values corresponding to the section is used as the representative evaluation value.

- the average value of the image evaluation values corresponding to the section is used as the representative evaluation value, but the median value or the mode value may be used. Good.

- the preprocessing unit 220a acquires an image (step S10) and performs the above-described processing.