WO2017169079A1 - 画像処理装置、画像処理方法および撮像素子 - Google Patents

画像処理装置、画像処理方法および撮像素子 Download PDFInfo

- Publication number

- WO2017169079A1 WO2017169079A1 PCT/JP2017/003582 JP2017003582W WO2017169079A1 WO 2017169079 A1 WO2017169079 A1 WO 2017169079A1 JP 2017003582 W JP2017003582 W JP 2017003582W WO 2017169079 A1 WO2017169079 A1 WO 2017169079A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- correction

- image

- correction coefficient

- axis

- unit

- Prior art date

Links

- 238000012545 processing Methods 0.000 title claims abstract description 170

- 238000003672 processing method Methods 0.000 title claims description 25

- 238000012937 correction Methods 0.000 claims abstract description 390

- 238000000034 method Methods 0.000 claims description 89

- 230000008569 process Effects 0.000 claims description 81

- 238000003384 imaging method Methods 0.000 claims description 57

- 238000004364 calculation method Methods 0.000 claims description 40

- 238000003702 image correction Methods 0.000 claims description 18

- 230000004075 alteration Effects 0.000 description 31

- 239000000203 mixture Substances 0.000 description 30

- 238000001514 detection method Methods 0.000 description 23

- 238000010586 diagram Methods 0.000 description 16

- 238000002156 mixing Methods 0.000 description 14

- 230000006870 function Effects 0.000 description 12

- 238000012986 modification Methods 0.000 description 12

- 230000004048 modification Effects 0.000 description 12

- 230000003287 optical effect Effects 0.000 description 11

- 238000004519 manufacturing process Methods 0.000 description 10

- 230000000694 effects Effects 0.000 description 8

- 238000003708 edge detection Methods 0.000 description 7

- 230000006866 deterioration Effects 0.000 description 5

- 230000015556 catabolic process Effects 0.000 description 4

- 238000006731 degradation reaction Methods 0.000 description 4

- 230000007246 mechanism Effects 0.000 description 4

- 230000008859 change Effects 0.000 description 3

- 238000005516 engineering process Methods 0.000 description 3

- 238000006243 chemical reaction Methods 0.000 description 2

- 238000009434 installation Methods 0.000 description 2

- 239000011159 matrix material Substances 0.000 description 2

- 230000001151 other effect Effects 0.000 description 2

- 239000000758 substrate Substances 0.000 description 2

- 238000012360 testing method Methods 0.000 description 2

- 230000001133 acceleration Effects 0.000 description 1

- 230000009471 action Effects 0.000 description 1

- 230000032683 aging Effects 0.000 description 1

- 230000005540 biological transmission Effects 0.000 description 1

- 238000002485 combustion reaction Methods 0.000 description 1

- 238000004891 communication Methods 0.000 description 1

- 230000000295 complement effect Effects 0.000 description 1

- 238000013461 design Methods 0.000 description 1

- 238000012423 maintenance Methods 0.000 description 1

- 238000005259 measurement Methods 0.000 description 1

- 229910044991 metal oxide Inorganic materials 0.000 description 1

- 150000004706 metal oxides Chemical class 0.000 description 1

- 230000000116 mitigating effect Effects 0.000 description 1

- 230000004044 response Effects 0.000 description 1

- 230000000717 retained effect Effects 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

- 230000003595 spectral effect Effects 0.000 description 1

- 238000001228 spectrum Methods 0.000 description 1

- 230000002123 temporal effect Effects 0.000 description 1

- 238000012546 transfer Methods 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T5/00—Image enhancement or restoration

- G06T5/20—Image enhancement or restoration using local operators

-

- H—ELECTRICITY

- H10—SEMICONDUCTOR DEVICES; ELECTRIC SOLID-STATE DEVICES NOT OTHERWISE PROVIDED FOR

- H10F—INORGANIC SEMICONDUCTOR DEVICES SENSITIVE TO INFRARED RADIATION, LIGHT, ELECTROMAGNETIC RADIATION OF SHORTER WAVELENGTH OR CORPUSCULAR RADIATION

- H10F99/00—Subject matter not provided for in other groups of this subclass

Definitions

- the present disclosure relates to an image processing device that performs image correction, an image processing method, and an imaging device.

- Patent Documents 1 and 2 In the field of imaging devices such as digital cameras, techniques for correcting an image (correcting image blur) according to the image height dependency of the lens and MTF characteristics have been proposed (for example, Patent Documents 1 and 2).

- Patent Document 2 discloses a technique in which a user performs correction using a parameter set prepared in advance using software. However, even in this technique, the above-described variation in resolution occurs. In some cases, sufficient correction cannot be performed. This leads to image quality degradation.

- An image processing apparatus includes two or more correction coefficients corresponding to the position coordinates of a correction target pixel among a plurality of correction coefficients associated with each of a first axis and a second axis that intersect each other.

- An acquisition unit that acquires a correction coefficient and a correction unit that performs an image correction process using the correction coefficient acquired by the acquisition unit are provided.

- two or more correction coefficients corresponding to each of the first axis and the second axis intersecting each other are selected according to the position coordinates of the correction target pixel.

- a correction coefficient is acquired, and an image correction process is performed using the acquired correction coefficient.

- An image sensor includes a pixel unit including a plurality of pixels and a signal processing unit that performs signal processing on an image obtained from the pixel unit.

- a signal processing unit that acquires two or more correction coefficients according to the position coordinates of the correction target pixel from a plurality of correction coefficients associated with the first axis and the second axis that intersect with each other;

- a correction unit that performs an image correction process using the correction coefficient acquired by the acquisition unit.

- the position of the correction target pixel from among a plurality of correction coefficients associated with the first axis and the second axis that intersect each other. Two or more correction coefficients are acquired according to the coordinates, and image correction processing is performed using the acquired correction coefficients. Thus, correction can be performed using a correction coefficient optimized according to the position coordinates of the pixel.

- the position of the correction target pixel from among a plurality of correction coefficients associated with the first axis and the second axis that intersect each other. Two or more correction coefficients are acquired according to the coordinates, and image correction processing is performed using the acquired correction coefficients. As a result, a sufficient correction effect can be obtained even when resolution variations occur due to lens manufacturing errors or the like using the optimized correction coefficient. Therefore, even when the lens resolution varies, the image quality deterioration can be suppressed.

- FIG. 4B is a schematic diagram illustrating an example of a correction coefficient of the correction target pixel illustrated in FIG. 4A. It is a schematic diagram showing an example of a correction target pixel (B pixel).

- FIG. 4B is a schematic diagram illustrating an example of a correction coefficient of the correction target pixel illustrated in FIG. 4A. It is a schematic diagram showing an example of a correction target pixel (B pixel).

- 5B is a schematic diagram illustrating an example of a correction coefficient of the correction target pixel illustrated in FIG. 5A. It is a schematic diagram showing a correspondence with a correction coefficient, an image height, and an effective pixel area. It is a characteristic view showing MTF data for explaining setting of an image height position. It is a schematic diagram for demonstrating the MTF data shown in FIG. It is a schematic diagram for demonstrating an example of a correction coefficient blend process (interpolation process). It is a figure showing the example of functional composition in the case of performing friend processing after pixel value amendment. It is a schematic diagram showing the correspondence between the correction coefficient according to Modification 1 and the image height and effective pixel area.

- FIG. 1 illustrates a functional configuration of an imaging device (imaging device 1) according to an embodiment of the present disclosure together with a lens (lens 30).

- the imaging device 1 is an image sensor such as a charge coupled device image sensor (CCD) or a complementary metal oxide semiconductor (CMOS) image sensor, and is applied to, for example, a still camera or a video camera.

- the image sensor 1 is a signal that performs various signal processing including image correction processing on the pixel unit 10 that receives the passing light L of the lens 30 and the image signal (imaging signal D0) output from the pixel unit 10, for example.

- a processing unit 20 includes a control unit that drives and controls each unit of the pixel unit and the signal processing unit, and a memory.

- the pixel unit 10 includes, for example, a plurality of pixels, for example, R (red), G (green), and B (blue) pixels (sub-pixels) arranged two-dimensionally in the effective pixel region.

- Each of the R, G, and B pixels has an RGB array 10a made of, for example, a Bayer array.

- the pixel unit 10 is provided with a color filter having an RGB array 10a.

- the present disclosure is configured to have an array other than RGB, for example, an RGBW array including R, G, B, and W (white). It can also be applied to.

- the pixel unit 10 may have, for example, an array of Y (yellow), C (cyan), M (magenta), and the like. The present disclosure can be applied to color arrangements other than the arrangements exemplified here.

- any of the RGB color lights is received in units of pixels via the lens 30, and an electrical signal corresponding to the received light signal intensity is generated by photoelectric conversion.

- a mosaic image composed of three types of RGB spectra is obtained by the pixel unit 10.

- the pixel unit 10 and the signal processing unit 20 are stacked, for example, as schematically shown in FIG.

- the imaging element 1 has a structure (so-called stacked type element) in which a substrate 1A on which a pixel unit 10 is formed and a substrate 2A on which a signal processing unit 20 is stacked (bonded) one above the other. Structure).

- the “signal processing unit 20” in the present embodiment corresponds to a specific example of the “image processing apparatus” in the present disclosure.

- the “image processing method” of the present disclosure is embodied by the configuration and operation of the image processing apparatus (signal processing unit 20), and thus description thereof is omitted.

- the configuration in which the signal processing unit 20 is provided in the image sensor 1 will be described as an example.

- the image processing apparatus of the present disclosure is applied to such an image sensor 1.

- the apparatus is not limited to the lens 30 and the pixel unit 10, and may be a personal computer (PC) or the like.

- the configuration in addition to the configuration of the signal processing unit 20 illustrated in FIG. 1, the configuration further includes an interface unit to which imaging data is input and a memory in which the input imaging data is stored.

- the signal processing unit 20 includes, for example, a position coordinate calculation unit 21 (a distance calculation unit 21A and an angle calculation unit 21B), a correction coefficient acquisition unit 22, an image height coefficient calculation unit 23A, a quadrant coefficient calculation unit 23B, and a correction A coefficient blend processing unit 24, a lens aberration correction processing unit 25, a line memory 26, an edge detection unit 27, an edge / flat part blend processing unit 28, and an RGB signal processing unit 29 are provided.

- the correction coefficient acquisition unit 22 of the present embodiment corresponds to a specific example of the “acquisition unit” of the present disclosure

- the correction coefficient blend processing unit 24 and the lens aberration correction processing unit 25 correspond to the “correction unit of the present disclosure.

- the correction coefficient blend processing unit 24 corresponds to a specific example of the “correction coefficient calculation unit” of the present disclosure

- the lens aberration correction processing unit 25 corresponds to a specific example of the “correction processing unit” of the present disclosure.

- the position coordinate calculation unit 21 includes, for example, a distance calculation unit 21A and an angle calculation unit 21B. Based on the xy address indicating the coordinate position of each pixel associated with the pixel value of each pixel of the pixel unit 10, The position coordinates of the correction target pixel (hereinafter referred to as pixel Pt) are detected.

- the distance calculation unit 21A calculates the distance of the pixel Pt (the distance r from the optical center, the distance corresponding to the image height). Information on the calculated distance r is supplied to the correction coefficient acquisition unit 22 and the image height coefficient calculation unit 23A, respectively.

- the angle calculation unit 21B calculates a quadrant position (angle d) in the image area of the pixel Pt. Information about the calculated angle d is supplied to the correction coefficient acquisition unit 22 and the quadrant coefficient calculation unit 23B, respectively.

- the correction coefficient acquisition unit 22 selects two or more correction coefficients (Fr, Fg, Fb) from among a plurality of correction coefficients (Fr, Fg, Fb) according to the position coordinates (distance r, angle d) of the pixel Pt calculated by the position coordinate calculation unit 21.

- a correction coefficient (correction coefficient group Fgrp) is selected (acquired).

- Each of the correction coefficients Fr, Fg, and Fb is composed of, for example, a plurality of filter coefficients.

- Information on the acquired correction coefficient group Fgrp is supplied to the correction coefficient blend processing unit 24.

- correction coefficients Fr, Fg, and Fb are set for each color of R, G, and B, respectively, and may be held in the imaging device 1 in advance or may be input from the outside. Details of these correction coefficients Fr, Fg, and Fb will be described later.

- the image height coefficient calculation unit 23A calculates a coefficient (Ar) used in blending processing (interpolation processing) between image heights based on the distance r calculated by the distance calculation unit 21A. Information regarding the calculated coefficient Ar is supplied to the correction coefficient blend processing unit 24.

- the quadrant coefficient calculation unit 23B calculates a coefficient (Ad) used in the blending process (interpolation process) between quadrants based on the angle d calculated by the angle calculation unit 21B.

- Information about the calculated coefficient Ad is supplied to the correction coefficient blend processing unit 24.

- the correction coefficient blend processing unit 24 performs a process of generating a correction coefficient (correction coefficient F1) for the pixel Pt using the correction coefficient group Fgrp acquired by the correction coefficient acquisition unit 22.

- the processing unit generates the correction coefficient F1 for the pixel Pt at the position (image point) where the correction coefficients Fr, Fg, and Fb are not associated with each other by interpolation.

- an interpolation process using each correction coefficient constituting the correction coefficient group Fgrp, the coefficient Ar calculated by the inter-image height coefficient calculation unit 23A, and the coefficient Ad calculated by the inter-quadrant coefficient calculation unit 23B.

- the correction coefficient F1 of the pixel Pt is calculated by (blending processing).

- the correction coefficient F1 is calculated for each RGB color. Information about the calculated correction coefficient F1 is supplied to the lens aberration correction processing unit 25.

- the lens aberration correction processing unit 25 uses correction coefficients F1 (specifically, correction coefficients F1r, F1g, and F1b for each color) for each color signal (Rin, Gin, Bin) input from the line memory 26. Correction processing is performed, and the corrected image signal D1 (Rd, Gd, Bd) is calculated. The calculated image signal D1 is supplied to the edge / flat portion blend processing unit.

- the lens aberration correction processing unit 25 can perform, for example, a process for correcting image blur, particularly a correction process in consideration of aberration variations depending on the position coordinates (image height and quadrant position) of the pixel Pt.

- the line memory 26 temporarily holds the pixel signal output from the pixel unit 10.

- the line memory 26 is configured to store pixel values for seven horizontal lines of the pixel unit 10 and sequentially output seven horizontal line data in parallel.

- the output destinations are the lens aberration correction processing unit 25, the edge detection unit 27, and the edge / flat portion blend processing unit. Imaging data having the RGB array 10a is output in units of 7 lines to each of these processing units.

- the line memory 26 is described as outputting in units of 7 lines, but this is not particularly limited, but a correction coefficient (filter) described later corresponds to, for example, 7 ⁇ 7 pixels. This is an example of a case. For this reason, when the correction coefficient corresponds to the number of pixels other than 7 ⁇ 7 pixels, the line memory 26 can store and output in units of lines corresponding to the number of pixels of the correction coefficient. It is good to be done.

- the edge detection unit 27 Based on the output signal from the line memory 26, the edge detection unit 27 generates information related to edges in the image (including, for example, the edge direction and the edge strength) and outputs the information to the edge / flat part blend processing unit 28. Specifically, for example, the flatness (Weightflat) calculated from the pixel information of 7 ⁇ 7 pixels is calculated based on the processing target pixel (the center pixel of the 7 ⁇ 7 pixels), and the edge / flat portion blending process is performed. To the unit 28. As the flatness calculation process, for example, a process similar to the process described in JP 2011-55038 A can be used.

- the edge / flat portion blend processing unit 28 includes RGB signals (Rin, Gin, Bin) in the input signal from the line memory 26, edge information output from the edge detection unit 27, and output from the lens aberration correction processing unit 25.

- RGB signals Rosin, Gin, Bin

- the image signal D1 (Rd, Gd, Bd) to be generated, the image signal D2 after the correction process considering the edge information is generated and output to the RGB signal processing unit 29.

- the edge / flat portion blend processing unit 28 is configured to perform lens aberration correction processing according to the edge information calculated by the edge detection unit 27 (for example, flatness calculated from pixel information of 7 ⁇ 7 pixels).

- the weighted average processing of the corrected image signal D1 (Rd, Gd, Bd) output from 25 is executed to calculate the RGB pixel values of the RGB array 10a.

- RGB pixel values are determined according to the following three equations.

- the R, G, and B color signals obtained as the calculation result of this expression are output to the RGB signal processing unit 29.

- the RGB signal processing unit 29 performs signal processing on the signals of the RGB array 11a output from the edge / flat portion blend processing unit 28 as signal processing on the signals of the RGB array (Bayer array) 11a to generate a color image.

- the RGB signal processing unit 29 performs, for example, white balance adjustment processing, demosaic processing, shading processing, RGB color matrix processing, gamma correction processing, and the like to generate a color image.

- the image signal Dout for the color image generated by the RGB signal processing unit 29 is output to the outside or recorded in a memory inside the apparatus.

- a control unit executes control of a series of processes in each of the above processing units.

- a program for executing a series of processes is stored in a memory (not shown), and the control unit executes the program read from the memory and controls the series of processes.

- the memory can be composed of various recording media such as a magnetic disk, an optical disk, and a flash memory.

- the correction coefficients Fr, Fg, and Fb are either stored in advance as lens aberration correction filter coefficients or input from the outside. These correction coefficients Fr, Fg, and Fb can be calculated using, for example, a Wiener filter.

- the winner filter will be briefly described. In the following, three images, an ideal image without blur (original image A1), a blurred photographed image (captured image A2), and a restored image (restored image A3) restored by filter correction processing for the photographed image are represented. Assuming this will be explained.

- the filter that minimizes the square error of the two images of the original image A1 and the restored image A3 is called a least square filter or a Wiener filter.

- the original image A1 is f (x, y)

- the photographed image A2 is g (x, y)

- the degradation function due to lens aberration or camera shake is h (x, y)

- the noise component is n (x, y).

- (x, y) is the pixel position of each image

- f (x, y) to n (x, y) may indicate the pixel value of the coordinate position (x, y) of each image.

- the deterioration function h (x, y) due to lens aberration and camera shake is a fixed value.

- FIGS. 3A and 3B An example of the Wiener filter corresponding to the above equation (5) is shown in FIGS. 3A and 3B.

- FIG. 3A shows 7 ⁇ 7 pixels centered on the G pixel in the photographed image

- FIG. 3B shows an example of a Wiener filter in which the G pixel at the center of the pixel region in FIG. 3A is the correction target pixel Pt (pixel Pgt). It is shown.

- the photographed image is a RAW image composed of RGB pixels.

- the correction target pixel Pgt is the center G pixel of the 7 ⁇ 7 pixels shown in FIG. 3A.

- the Wiener filter shown in FIG. 3B shows a multiplication coefficient for each of a plurality of G pixels included in a 7 ⁇ 7 pixel.

- a correction pixel value of the central G pixel is calculated by executing a convolution operation that multiplies each coefficient by the pixel value of the G pixel included in the 7 ⁇ 7 pixels and adds the result.

- the pixel value of the G pixel can be corrected by the following formula (6).

- FIG. 4A shows a 7 ⁇ 7 pixel area centered on the R pixel in the captured image

- FIG. 4B shows the R pixel at the center of the pixel area in FIG. 4A as the correction target pixel Pt (pixel Prt).

- An example of the Wiener filter is shown.

- FIG. 5A shows a 7 ⁇ 7 pixel area centered on the B pixel in the captured image

- FIG. 5B shows a Wiener filter in which the B pixel at the center of the pixel area in FIG. 5A is the correction target pixel Pt (pixel Pbt).

- the correction value is calculated for each of the R pixel and the B pixel in the same manner as in the case of the G pixel.

- lens PSF Point Spread Function

- MTF Modulation Transfer Function

- correction coefficient (Detailed configuration example of correction coefficient)

- a plurality of correction coefficients Fr, Fg, and Fb are associated (set) with each of the first axis and the second axis that intersect each other.

- the following description will be made using the correction coefficient Fg for correcting the G pixel as a representative.

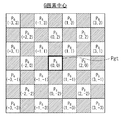

- a plurality of correction coefficients Fg are set for one lens 30. An example is shown in FIG. FIG. 6 shows a correction filter corresponding to 7 ⁇ 7 pixels as an example of the correction coefficient.

- a plurality of correction coefficients Fg are associated with each of the X axis and the Y axis that are orthogonal to each other, for example.

- four correction coefficients f11 to f14 (coefficient sequence q1) are set in the positive direction on the X axis, and for example, four correction coefficients f31 to f34 (coefficient sequence q3) are set in the negative direction on the X axis.

- four correction coefficients f21 to f24 coefficient sequence q2 are set in the positive direction on the Y axis, and for example, four correction coefficients f41 to f44 (coefficient sequence q4) are set in the negative direction on the Y axis. Is set.

- a correction coefficient f0 is set at the optical center (point where the image height is 0).

- the correction coefficient f11 is set to, for example, the image height ih1 (image point at the position of the image height ih1) closest to the optical axis (close to the optical axis) in the coefficient sequence q1.

- the correction coefficient f12 is set to the image height ih2 next to (one outside) the image height ih1 in the coefficient sequence q1.

- the correction coefficient f13 is set to the image height ih3 next to (one outside) the image height ih2 in the coefficient sequence q1.

- the correction coefficient f14 is set to the image height ih4 next to (one outside) the image height ih3 in the coefficient sequence q1.

- the correction coefficient f21 is set to the image height ih1 in the coefficient sequence q2.

- the correction coefficient f22 is set to the image height ih2 in the coefficient sequence q2.

- the correction coefficient f23 is set to the image height ih3 in the coefficient sequence q2.

- the correction coefficient f24 is set to the image height ih4 in the coefficient sequence q2.

- the correction coefficient f31 is set to the image height ih1 in the coefficient sequence q3.

- the correction coefficient f32 is set to the image height ih2 in the coefficient sequence q3.

- the correction coefficient f33 is set to the image height ih3 in the coefficient sequence q3.

- the correction coefficient f34 is set to the image height ih4 in the coefficient sequence q3.

- the correction coefficient f41 is set to the image height ih1 in the coefficient sequence q4.

- the correction coefficient f42 is set to the image height ih2 in the coefficient sequence q4.

- the correction coefficient f43 is set to the image height ih3 in the coefficient sequence q4.

- the correction coefficient f44 is set to the image height ih4 in the coefficient sequence q4.

- a plurality of correction coefficients Fg are set for each of a plurality of image heights and a plurality of angles (rows on the X axis and the Y axis).

- a plurality of correction coefficients Fg (specifically, correction coefficients f11 to f14, f21 to f24, f31 to 34) are obtained at the position coordinates of the four image heights and the four angular directions. , F41 to f44) are set.

- These correction coefficients Fg can be calculated by a method using a Wiener filter as described above.

- two or more correction coefficients are acquired according to the position coordinates of the pixel Pt from the plurality of correction coefficients Fg associated on two axes in this way. It has become.

- correction coefficients Fr and Fb and a plurality of correction coefficients Fr and Fb are associated with each other on two axes (first axis and second axis).

- a plurality of correction coefficients need only be associated with two intersecting axes, and these two axes do not necessarily have to be orthogonal (may be oblique).

- two axes may be arranged along the diagonal line of the effective pixel region 301.

- the correction coefficients Fr, Fg, and Fb are calculated, for example, in the manufacturing process of the lens 30 or the manufacturing process of the camera module, and are held in association with the lens 30.

- the housing portion of the lens 30 has a holding function such as a memory, and correction coefficient information is held by the holding function.

- the correction coefficients Fr, Fg, and Fb are supplied from the lens 30 side outside the signal processing unit 20.

- the correction coefficients Fr, Fg, and Fb may be held in the signal processing unit 20 in advance.

- the correction coefficient is calculated for each lens 30 and is stored in the signal processing unit 20 in advance or input from the outside.

- the set image height intervals can be equal intervals, and the intervals may be constant regardless of lens characteristics.

- a characteristic image height image height 0 to 4

- FIGS. 7 and 8 are diagrams showing MTF data with respect to image height.

- FIG. 8 also shows the image circle 303 and the effective pixel region 301.

- the MTF data changes depending on the image height. Therefore, an image height at an image point with a relatively large degree of change is selected, and a correction coefficient is calculated at the selected image height.

- the image height 0 is selected as the center position of the lens.

- the image height 2 is selected because it is the image height at the point where the MTF data falls. Since the distance between the image height 0 and the image height 2 is separated, the image height 1 is selected as the image height at the approximate center.

- Image height 3 is selected because it is a turning point where the MTF data once lowered at image height 2 rises again and falls again.

- Image height 4 is selected as the end of the lens.

- MTF data or PSF data may be acquired from a plurality of positions on the lens 30 corresponding to these image heights 0 to 4, and the correction coefficient may be calculated by the processing as described above.

- the image height at which the correction coefficient is calculated may be the image height at the image point that is the inflection point in the MTF data.

- the image height at the position may be selected.

- the image height may be added so as to be an appropriate interval.

- MTF data for image height may vary from lens to lens. Therefore, it is desirable that data is acquired for each lens, an image height is selected, and a lens aberration correction filter coefficient is calculated. Lens aberration correction filter coefficients corresponding to different characteristics for each lens can be calculated, and correction processing can be performed with higher accuracy.

- the light beam that has passed through the lens 30 enters the pixel unit 10, whereby a pixel signal is obtained for each pixel by photoelectric conversion.

- the pixel unit 10 acquires R, G, B color RAW data corresponding to the RGB array 10a as the imaging signal D0.

- the obtained imaging signal D0 is output to the signal processing unit 20.

- the signal processing unit 20 performs image correction processing based on the input imaging signal D0. Specifically, first, the position coordinate calculation unit 21 calculates the position coordinate of the pixel Pt to be corrected based on the xy address indicating the coordinate position of each pixel associated with the pixel value of each pixel of the pixel unit 10. To detect. Specifically, the distance calculation unit 21A calculates the distance r of the pixel Pt. Information on the calculated distance r is output to each of the correction coefficient acquisition unit 22 and the image height coefficient calculation unit 23A. Further, the angle calculation unit 21B calculates the quadrant position (angle d) in the image area of the pixel Pt. Information about the calculated angle d is output to the correction coefficient acquisition unit 22 and the quadrant coefficient calculation unit 23B, respectively.

- the correction coefficient acquisition unit 22 selects two or more correction coefficients from a plurality of correction coefficients (here, the correction coefficient Fg is taken as an example) according to the input position coordinates (distance r, angle d) of the pixel Pt. (Correction coefficient group Fgrp) is selected (obtained). Information on the acquired correction coefficient group Fgrp is supplied to the correction coefficient blend processing unit 24.

- the inter-image height coefficient calculation unit 23A calculates a coefficient Ar used in the blending process (interpolation process) between the image heights based on the input distance r. Information about the calculated coefficient Ar is output to the correction coefficient blend processing unit 24.

- the quadrant coefficient calculation unit 23B calculates a coefficient Ad used in the blend process (interpolation process) between quadrants based on the input angle d. Information about the calculated coefficient Ad is output to the correction coefficient blend processing unit 24.

- the correction coefficient blend processing unit 24 generates the correction coefficient F1 of the pixel Pt by interpolation processing using the input correction coefficient group Fgrp. Specifically, the correction coefficient F1 (first correction coefficient) of the pixel Pt is calculated by interpolation processing (blend processing) using the correction coefficients constituting the correction coefficient group Fgrp and the coefficients Ar and Ad.

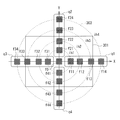

- FIG. 9 shows an example of correction coefficient blending processing.

- interpolation processing is performed between angles (between quadrants and axes) and between image heights in the XY plane.

- the correction coefficient F1 of the center pixel Pt of 7 ⁇ 7 pixels is calculated by interpolation processing using a correction coefficient group Fgrp including two or more correction coefficients Fg and the coefficients Ar and Ad.

- the image height ih n corresponds to any one of the image heights ih1 to ih4 (image height position) shown in FIG. 6, for example, and the image height ih n + 1 is 1 of the image height ih n . It corresponds to the outer image height.

- the pixel Pt will be described as a G pixel located in the first quadrant in the XY plane.

- the correction coefficient acquisition unit 22 uses a plurality of correction coefficients Fg (correction coefficients f11 to f14, f21 to f24, f31 to 34, and f41 to f44 shown in FIG.

- Two or more appropriate correction coefficients Fg are selected (acquired) according to the distance r and the angle d).

- the correction coefficient group Fgrp includes, for example, two correction coefficients F0 n and F0 n + 1 (any two correction coefficients in the coefficient sequence q1 illustrated in FIG.

- the correction coefficient blend process is performed from the following equation (6) by linear calculation. Thereby, the blending process between quadrants (between axes) is performed on the image height ih n , and the correction coefficient F2 (second correction coefficient) is calculated.

- linearity is calculated using correction coefficients F0 n + 1 and F90 n + 1 associated with the image height ih n + 1 and a coefficient Ad (0 ⁇ Ad ⁇ 1) calculated based on the angle d.

- the correction coefficient blending process is performed from the following equation (7) by calculation. Thereby, a blending process between quadrants (between axes) is performed on the image height ih n + 1 , and a correction coefficient F3 (third correction coefficient) is calculated.

- F3 (1-Ad) ⁇ F0 n + 1 + Ad ⁇ F90 n + 1 (7)

- these correction coefficients F2 and F3 are obtained from the following equation (8) by linear calculation using a coefficient Ar (0 ⁇ Ar ⁇ 1) calculated based on the distance r (distance from the optical center).

- the correction coefficient blending process is performed. Thereby, the blending process between the image heights is performed, and the correction coefficient F1 of the pixel Pt at the position of distance r and angle d is calculated. That is, the correction coefficient of the pixel Pt is optimized.

- F1 (1-Ar) ⁇ F2 + Ad ⁇ F3 (8)

- the lens aberration correction processing unit 25 corrects the pixel value in the pixel Pt using the correction coefficient F1 (as an example) for each color signal (Rin, Gin, Bin) input from the line memory 26.

- Lens aberration correction processing Specifically, when the correction coefficient F1 corresponds to 7 ⁇ 7 pixels, a calculation process of multiplying and adding the 7 ⁇ 7 pixels is performed, and the pixel of the center pixel Pt is executed. Correct the value. Assuming that the pixel value of the pixel Pt at the distance r is Pr, the pixel value Pr1 after lens aberration correction is calculated by the following equation (9).

- the correction processing is performed on the pixel values after blending (interpolating) correction coefficients between quadrants and between image heights.

- the blend processing (interpolation processing) It may be performed after the correction.

- FIG. 10 shows a functional block configuration in that case.

- the lens aberration correction processing unit 25a corrects the pixel value of the pixel Pt to be corrected using a plurality of correction coefficients associated on two axes.

- the blend processing unit 26a may perform interpolation processing between quadrants and between image heights based on the corrected pixel values. Further, the order in which the blending process and the correction process are performed may be determined according to the data amount of the correction coefficient.

- the image signal D1 (Rd, Gd, Bd) after the correction processing by the lens aberration correction processing unit 25 is output to the edge / flat portion blend processing unit.

- the edge / flat portion blend processing unit 28 receives RGB signals (Rin, Gin, Bin) input from the line memory 26, edge information input from the edge detection unit 27, and lens aberration correction processing unit 25. Using the image signal D1 (Rd, Gd, Bd), an image signal D2 after correction processing in consideration of edge information is generated. Specifically, the edge / flat portion blend processing unit 28 is configured to perform lens aberration correction processing according to the edge information calculated by the edge detection unit 27 (for example, flatness calculated from pixel information of 7 ⁇ 7 pixels). The weighted average processing of the corrected image signal D1 (Rd, Gd, Bd) output from 25 is executed to calculate the RGB pixel values in the RGB array 10a. Specifically, RGB pixel values are determined according to the following three equations.

- the R, G, and B color signals obtained as the calculation result of this expression are output to the RGB signal processing unit 29.

- the generated image signal D2 is output to the RGB signal processing unit 29.

- the RGB signal processing unit 29 performs signal processing on the input RGB array (Bayer array) signal, for example, white balance adjustment processing, demosaic processing, shading processing, RGB color matrix processing, gamma correction processing, and the like to generate a color image. Generate. An image signal Dout for the generated color image is output to the outside or recorded in a memory inside the apparatus.

- the position coordinates of the pixel Pt to be corrected are selected from among a plurality of correction coefficients associated with the first axis and the second axis (X axis, Y axis) that intersect each other. Two or more correction coefficients are acquired according to (distance r, angle d), and image correction processing is performed using the acquired correction coefficients. Thereby, the correction coefficient can be optimized according to the position coordinates of the pixel Pt.

- the generated blur differs depending on the characteristics of the lens 30 and the like. For example, as the image height (distance from the optical center) increases, the blur of the image due to lens aberration increases. Further, due to a manufacturing error of the lens and the like, not only the image height of the lens but also a variation in aberration occurs in each region (quadrant) in the XY plane orthogonal to the optical axis, resulting in a variation in resolution.

- the degree of blurring of the lens 30 is different and is often not isotropic. This is caused by, for example, a lens manufacturing error. If the resolution of the lens 30 varies, even if correction processing is performed, a location where correction is insufficient or an overcorrected location occurs depending on the pixel position, leading to image quality degradation.

- a pixel to be corrected is selected from a plurality of correction coefficients associated with the first axis and the second axis (X axis and Y axis) that intersect each other.

- Two or more correction coefficients are acquired according to the position coordinates (distance r, angle d) of Pt, and image correction processing is performed using the acquired correction coefficients.

- the correction coefficient can be optimized, and a sufficient correction effect can be obtained even when the resolution varies due to a lens manufacturing error or the like. Therefore, even when the lens resolution varies, the image quality deterioration can be suppressed.

- FIG. 11 is a schematic diagram illustrating a correspondence between a correction coefficient (any one of Fg, Fr, and Fb) according to the first modification, an image height, and an effective pixel area.

- a correction coefficient any one of Fg, Fr, and Fb

- FIG. 6 the configuration in which the coefficient sequences q1 to q4 are arranged along the X axis and the Y axis has been exemplified.

- the coefficient sequences q1 to q4 are arranged.

- q4 may be associated with two axes rotated 45 ° counterclockwise from the X axis and the Y axis, respectively. In this case, it is effective when the lens blur occurs along an oblique direction.

- the rotation angle of the shaft is not limited to 45 °, and can be set in a range from 0 ° to 90 ° depending on a region where a lens blur occurs.

- FIG. 12 shows a flow of correction coefficient calculation and signal processing according to the second modification.

- the correction coefficients Fr, Fg, and Fb are calculated in the manufacturing process of the lens 30 or the manufacturing process of the camera module, and are stored in the circuit in advance as calibration information, or are externally (lens 30 ).

- the signal processing (image processing) of the present disclosure can also be applied when there is no calibration information regarding such a lens 30 (for example, when the lens 30 is an old lens).

- the correction coefficient may be input by the user. Specifically, as shown in FIG. 12, after the lens 30 is attached to the camera body (step S21), a test chart (test pattern) is photographed by the image sensor 1 (step S22). Subsequently, lens aberration characteristics (for example, PSF data or MTF data) are acquired from the captured image (step S23). A correction coefficient may be calculated based on the acquired lens aberration characteristic (step S24), and the lens aberration may be corrected using this correction coefficient.

- lens aberration characteristics for example, PSF data or MTF data

- the correction coefficient may be calculated not when the lens 30 is manufactured but when the camera is used. In this case, an old lens having no calibration information can be used as the lens 30. In addition, it is possible to appropriately update the correction coefficient in response to a change in the usage environment or aging of the lens 30. Further, when the lens 30 is replaceable with respect to the camera body, it is possible to cope with the case where the lens 30 is replaced with another lens.

- the technology according to the present disclosure can be applied to various products.

- the technology according to the present disclosure is realized as a device that is mounted on any type of mobile body such as an automobile, an electric vehicle, a hybrid electric vehicle, a motorcycle, a bicycle, personal mobility, an airplane, a drone, a ship, and a robot. May be.

- FIG. 13 is a block diagram illustrating a schematic configuration example of a vehicle control system that is an example of a mobile control system to which the technology according to the present disclosure can be applied.

- the vehicle control system 12000 includes a plurality of electronic control units connected via a communication network 12001.

- the vehicle control system 12000 includes a drive system control unit 12010, a body system control unit 12020, a vehicle exterior information detection unit 12030, a vehicle interior information detection unit 12040, and an integrated control unit 12050.

- a microcomputer 12051, a sound image output unit 12052, and an in-vehicle network I / F (Interface) 12053 are illustrated as a functional configuration of the integrated control unit 12050.

- the drive system control unit 12010 controls the operation of the device related to the drive system of the vehicle according to various programs.

- the drive system control unit 12010 includes a driving force generator for generating a driving force of a vehicle such as an internal combustion engine or a driving motor, a driving force transmission mechanism for transmitting the driving force to wheels, and a steering angle of the vehicle. It functions as a control device such as a steering mechanism that adjusts and a braking device that generates a braking force of the vehicle.

- the body system control unit 12020 controls the operation of various devices mounted on the vehicle body according to various programs.

- the body system control unit 12020 functions as a keyless entry system, a smart key system, a power window device, or a control device for various lamps such as a headlamp, a back lamp, a brake lamp, a blinker, or a fog lamp.

- the body control unit 12020 can be input with radio waves transmitted from a portable device that substitutes for a key or signals from various switches.

- the body system control unit 12020 receives input of these radio waves or signals, and controls a door lock device, a power window device, a lamp, and the like of the vehicle.

- the vehicle outside information detection unit 12030 detects information outside the vehicle on which the vehicle control system 12000 is mounted.

- the imaging unit 12031 is connected to the vehicle exterior information detection unit 12030.

- the vehicle exterior information detection unit 12030 causes the imaging unit 12031 to capture an image outside the vehicle and receives the captured image.

- the vehicle outside information detection unit 12030 may perform an object detection process or a distance detection process such as a person, a car, an obstacle, a sign, or a character on a road surface based on the received image.

- the imaging unit 12031 is an optical sensor that receives light and outputs an electrical signal corresponding to the amount of received light.

- the imaging unit 12031 can output an electrical signal as an image, or can output it as distance measurement information. Further, the light received by the imaging unit 12031 may be visible light or invisible light such as infrared rays.

- the vehicle interior information detection unit 12040 detects vehicle interior information.

- a driver state detection unit 12041 that detects a driver's state is connected to the in-vehicle information detection unit 12040.

- the driver state detection unit 12041 includes, for example, a camera that images the driver, and the vehicle interior information detection unit 12040 determines the degree of fatigue or concentration of the driver based on the detection information input from the driver state detection unit 12041. It may be calculated or it may be determined whether the driver is asleep.

- the microcomputer 12051 calculates a control target value of the driving force generator, the steering mechanism, or the braking device based on the information inside / outside the vehicle acquired by the vehicle outside information detection unit 12030 or the vehicle interior information detection unit 12040, and the drive system control unit A control command can be output to 12010.

- the microcomputer 12051 realizes ADAS (Advanced Driver Assistance System) functions including vehicle collision avoidance or impact mitigation, following traveling based on inter-vehicle distance, vehicle speed maintenance traveling, vehicle collision warning, or vehicle lane departure warning. It is possible to perform cooperative control for the purpose.

- ADAS Advanced Driver Assistance System

- the microcomputer 12051 controls the driving force generator, the steering mechanism, the braking device, and the like based on the information around the vehicle acquired by the vehicle exterior information detection unit 12030 or the vehicle interior information detection unit 12040. It is possible to perform cooperative control for the purpose of automatic driving that autonomously travels without depending on the operation.

- the microcomputer 12051 can output a control command to the body system control unit 12030 based on information outside the vehicle acquired by the vehicle outside information detection unit 12030.

- the microcomputer 12051 controls the headlamp according to the position of the preceding vehicle or the oncoming vehicle detected by the outside information detection unit 12030, and performs cooperative control for the purpose of anti-glare, such as switching from a high beam to a low beam. It can be carried out.

- the sound image output unit 12052 transmits an output signal of at least one of sound and image to an output device capable of visually or audibly notifying information to a vehicle occupant or the outside of the vehicle.

- an audio speaker 12061, a display unit 12062, and an instrument panel 12063 are illustrated as output devices.

- the display unit 12062 may include at least one of an on-board display and a head-up display, for example.

- FIG. 14 is a diagram illustrating an example of an installation position of the imaging unit 12031.

- the imaging unit 12031 includes imaging units 12101, 12102, 12103, 12104, and 12105.

- the imaging units 12101, 12102, 12103, 12104, and 12105 are provided, for example, at positions such as a front nose, a side mirror, a rear bumper, a back door, and an upper part of a windshield in the vehicle interior of the vehicle 12100.

- the imaging unit 12101 provided in the front nose and the imaging unit 12105 provided in the upper part of the windshield in the vehicle interior mainly acquire an image in front of the vehicle 12100.

- the imaging units 12102 and 12103 provided in the side mirror mainly acquire an image of the side of the vehicle 12100.

- the imaging unit 12104 provided in the rear bumper or the back door mainly acquires an image behind the vehicle 12100.

- the imaging unit 12105 provided on the upper part of the windshield in the passenger compartment is mainly used for detecting a preceding vehicle or a pedestrian, an obstacle, a traffic light, a traffic sign, a lane, or the like.

- FIG. 14 shows an example of the shooting range of the imaging units 12101 to 12104.

- the imaging range 12111 indicates the imaging range of the imaging unit 12101 provided in the front nose

- the imaging ranges 12112 and 12113 indicate the imaging ranges of the imaging units 12102 and 12103 provided in the side mirrors, respectively

- the imaging range 12114 The imaging range of the imaging part 12104 provided in the rear bumper or the back door is shown. For example, by superimposing the image data captured by the imaging units 12101 to 12104, an overhead image when the vehicle 12100 is viewed from above is obtained.

- At least one of the imaging units 12101 to 12104 may have a function of acquiring distance information.

- at least one of the imaging units 12101 to 12104 may be a stereo camera including a plurality of imaging elements, or may be an imaging element having pixels for phase difference detection.

- the microcomputer 12051 based on the distance information obtained from the imaging units 12101 to 12104, the distance to each three-dimensional object in the imaging range 12111 to 12114 and the temporal change in this distance (relative speed with respect to the vehicle 12100).

- a predetermined speed for example, 0 km / h or more

- the microcomputer 12051 can set an inter-vehicle distance to be secured in advance before the preceding vehicle, and can perform automatic brake control (including follow-up stop control), automatic acceleration control (including follow-up start control), and the like.

- automatic brake control including follow-up stop control

- automatic acceleration control including follow-up start control

- cooperative control for the purpose of autonomous driving or the like autonomously traveling without depending on the operation of the driver can be performed.

- the microcomputer 12051 converts the three-dimensional object data related to the three-dimensional object to other three-dimensional objects such as a two-wheeled vehicle, a normal vehicle, a large vehicle, a pedestrian, and a utility pole based on the distance information obtained from the imaging units 12101 to 12104. It can be classified and extracted and used for automatic avoidance of obstacles.

- the microcomputer 12051 identifies obstacles around the vehicle 12100 as obstacles that are visible to the driver of the vehicle 12100 and obstacles that are difficult to see.

- the microcomputer 12051 determines the collision risk indicating the risk of collision with each obstacle, and when the collision risk is equal to or higher than the set value and there is a possibility of collision, the microcomputer 12051 is connected via the audio speaker 12061 or the display unit 12062. By outputting an alarm to the driver and performing forced deceleration or avoidance steering via the drive system control unit 12010, driving assistance for collision avoidance can be performed.

- At least one of the imaging units 12101 to 12104 may be an infrared camera that detects infrared rays.

- the microcomputer 12051 can recognize a pedestrian by determining whether a pedestrian is present in the captured images of the imaging units 12101 to 12104. Such pedestrian recognition is, for example, whether or not the user is a pedestrian by performing a pattern matching process on a sequence of feature points indicating the outline of an object and a procedure for extracting feature points in the captured images of the imaging units 12101 to 12104 as infrared cameras. It is carried out by the procedure for determining.

- the audio image output unit 12052 When the microcomputer 12051 determines that there is a pedestrian in the captured images of the imaging units 12101 to 12104 and recognizes the pedestrian, the audio image output unit 12052 has a rectangular contour line for emphasizing the recognized pedestrian.

- the display unit 12062 is controlled so as to be superimposed and displayed.

- voice image output part 12052 may control the display part 12062 so that the icon etc. which show a pedestrian may be displayed on a desired position.

- the present disclosure has been described with reference to the embodiment and its modifications. However, the present disclosure is not limited to the above-described embodiment and the like, and various modifications are possible.

- the series of signal processing described above can be executed by hardware or can be executed by software.

- a series of processing is executed by software

- a program constituting the software is installed in the computer.

- the computer includes, for example, a general-purpose personal computer capable of executing various functions by installing various programs by installing a computer incorporated in dedicated hardware.

- this indication can also take the following structures.

- An acquisition unit that acquires two or more correction coefficients according to the position coordinates of the correction target pixel from among a plurality of correction coefficients associated with each of the first axis and the second axis that intersect each other;

- An image processing apparatus comprising: a correction unit that performs an image correction process using the correction coefficient acquired by the acquisition unit.

- the correction unit is A correction coefficient calculation unit that calculates a first correction coefficient at the position coordinates by an interpolation process using the correction coefficient acquired by the acquisition unit;

- the image processing apparatus according to (1) further including: a correction processing unit that corrects a pixel value corresponding to the position coordinates using the first correction coefficient calculated by the correction coefficient calculation unit.

- the image processing apparatus according to (4), wherein the third correction coefficient is calculated by performing interpolation according to the above.

- (6) In the second interpolation process, after the first interpolation process, The image processing apparatus according to (5), wherein the first correction coefficient is calculated by interpolating the second correction coefficient and the third correction coefficient in accordance with an image height of the position coordinates.

- the correction unit is Correct the pixel value using the correction coefficient acquired by the acquisition unit; The image processing apparatus according to (1), wherein the image is corrected by an interpolation process based on the corrected pixel value.

- the acquisition unit acquires a plurality of correction coefficients associated with the first axis and the second axis for each color, The image processing apparatus according to any one of (1) to (7), wherein the correction unit performs an image correction process using the acquired correction coefficient for each color.

- the image processing apparatus according to any one of (1) to (7), wherein the correction unit performs an image correction process using the acquired correction coefficient for each color.

- the 9 From the plurality of correction coefficients associated with each of the first axis and the second axis intersecting each other, two or more correction coefficients are acquired according to the position coordinates of the correction target pixel, An image processing method for correcting an image using an acquired correction coefficient.

- a first correction coefficient at the position coordinates is calculated by an interpolation process using the acquired correction coefficient, The image processing method according to (9), wherein the pixel value corresponding to the position coordinate is corrected using the calculated first correction coefficient.

- the second interpolation processing is performed based on the image height of the position coordinates before or after the first interpolation processing.

- a pixel portion including a plurality of pixels; A signal processing unit that performs signal processing on an image obtained from the pixel unit, The signal processing unit An acquisition unit that acquires two or more correction coefficients according to the position coordinates of the correction target pixel from among a plurality of correction coefficients associated with each of the first axis and the second axis that intersect each other; An image pickup device comprising: a correction unit that performs correction processing of the image using the correction coefficient acquired by the acquisition unit.

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Studio Devices (AREA)

- Solid State Image Pick-Up Elements (AREA)

- Transforming Light Signals Into Electric Signals (AREA)

- Image Processing (AREA)

Abstract

この画像処理装置は、互いに交差する第1軸および第2軸のそれぞれに対応づけられた複数の補正係数の中から、補正対象画素の位置座標に応じて2以上の補正係数を取得する取得部と、取得部により取得された補正係数を用いて画像の補正処理を行う補正部とを備える。

Description

本開示は、画像補正を行う画像処理装置、画像処理方法、および撮像素子に関する。

デジタルカメラ等の撮像装置の分野では、レンズの像高依存およびMTF特性等に応じて画像を補正する(画像のぼけを補正する)技術が提案されている(例えば、特許文献1,2)。

ところが、上記の特許文献1の手法では、同一の像高にある画素値に対しては同一の補正係数(フィルタ係数)を使用して補正処理が行われる。このため、レンズの製造誤差等に起因して解像度にばらつきが生じた場合、十分な補正効果を得ることが困難である。また、特許文献2には、ユーザがソフトウエアを用いて、事前に用意されたパラメータセットを用いて補正を行う手法が示されているが、この手法においても、上記のような解像度のばらつきに対して十分な補正を行うことができない場合がある。これは画質劣化につながる。

レンズの解像度にばらつきが生じた場合にも、画質劣化を抑制することが可能な画像処理装置、画像処理方法および撮像素子を実現することが望まれている。

本開示の一実施の形態の画像処理装置は、互いに交差する第1軸および第2軸のそれぞれに対応づけられた複数の補正係数の中から、補正対象画素の位置座標に応じて2以上の補正係数を取得する取得部と、取得部により取得された補正係数を用いて画像の補正処理を行う補正部とを備えたものである。

本開示の一実施の形態の画像処理方法は、互いに交差する第1軸および第2軸のそれぞれに対応づけられた複数の補正係数の中から、補正対象画素の位置座標に応じて2以上の補正係数を取得し、取得された補正係数を用いて画像の補正処理を行うものである。

本開示の一実施の形態の撮像素子は、複数の画素を含む画素部と、画素部から得られた画像に対して信号処理を施す信号処理部とを備えたものである。信号処理部は、互いに交差する第1軸および第2軸のそれぞれに対応づけられた複数の補正係数の中から、補正対象画素の位置座標に応じて2以上の補正係数を取得する取得部と、取得部により取得された補正係数を用いて画像の補正処理を行う補正部とを備える。

本開示の一実施の形態の画像処理装置、画像処理方法および撮像素子では、互いに交差する第1軸および第2軸のそれぞれに対応づけられた複数の補正係数の中から、補正対象画素の位置座標に応じて2以上の補正係数が取得され、取得された補正係数を用いて画像の補正処理が行われる。これにより、画素の位置座標に応じて最適化された補正係数を用いて補正を行うことができる。

本開示の一実施の形態の画像処理装置、画像処理方法および撮像素子では、互いに交差する第1軸および第2軸のそれぞれに対応づけられた複数の補正係数の中から、補正対象画素の位置座標に応じて2以上の補正係数が取得され、取得された補正係数を用いて画像の補正処理が行われる。これにより、最適化された補正係数を用いて、レンズの製造誤差等に起因して解像度のばらつきが生じた場合にも、十分な補正効果を得ることができる。よって、レンズの解像度にばらつきが生じた場合にも、画質劣化を抑制することが可能となる。

尚、上記内容は本開示の一例である。本開示の効果は、上述したものに限らず、他の異なる効果であってもよいし、更に他の効果を含んでいてもよい。

以下、本開示を実施するための形態について、図面を参照して詳細に説明する。なお、説明は以下の順序で行う。

1.実施の形態

・構成:撮像素子の構成、信号処理部(画像処理装置)の構成、補正係数について

・作用、効果

2.変形例1,2

3.応用例(移動体制御システムの例)

1.実施の形態

・構成:撮像素子の構成、信号処理部(画像処理装置)の構成、補正係数について

・作用、効果

2.変形例1,2

3.応用例(移動体制御システムの例)

<実施の形態>

[構成]

図1は、本開示の一実施の形態に係る撮像素子(撮像素子1)の機能構成をレンズ(レンズ30)と共に表したものである。この撮像素子1は、例えばCCD(Charge Coupled Device Image Sensor)またはCMOS(Complementary Metal Oxide Semiconductor)イメージセンサ等のイメージセンサであり、例えばスチルカメラまたはビデオカメラ等に適用されるものである。撮像素子1は、例えばレンズ30の通過光線Lを受光する画素部10と、画素部10から出力された画像信号(撮像信号D0)に対して画像の補正処理を含む各種の信号処理を行う信号処理部20とを備える。尚、撮像素子1は、この他にも、図示はしないが、画素部および信号処理部の各部を駆動制御する制御部とメモリーとを備えている。

[構成]

図1は、本開示の一実施の形態に係る撮像素子(撮像素子1)の機能構成をレンズ(レンズ30)と共に表したものである。この撮像素子1は、例えばCCD(Charge Coupled Device Image Sensor)またはCMOS(Complementary Metal Oxide Semiconductor)イメージセンサ等のイメージセンサであり、例えばスチルカメラまたはビデオカメラ等に適用されるものである。撮像素子1は、例えばレンズ30の通過光線Lを受光する画素部10と、画素部10から出力された画像信号(撮像信号D0)に対して画像の補正処理を含む各種の信号処理を行う信号処理部20とを備える。尚、撮像素子1は、この他にも、図示はしないが、画素部および信号処理部の各部を駆動制御する制御部とメモリーとを備えている。

画素部10は、例えば有効画素領域に2次元配置された、複数の画素、例えばR(赤),G(緑),B(青)の3原色の画素(サブ画素)を含むものである。R,G,Bの各画素は、例えばベイヤー配列等からなるRGB配列10aを有している。具体的には、画素部10には、RGB配列10aを有するカラーフィルタが設けられている。尚、本実施の形態では、画素部10がRGB配列10aを有する場合について説明するが、本開示は、RGB以外の配列、例えばR,G,B,W(白)からなるRGBW配列を有する構成に対しても適用できる。あるいは、画素部10は、例えば、Y(イエロー)、C(シアン)、M(マゼンタ)等の配列を有していてもよい。ここで例示した配列以外の他の色配列に対しても本開示を適用することができる。

上記構成により、画素部10では、レンズ30を介してRGBいずれかの色光が画素単位で受光され、光電変換により受光信号強度に対応する電気信号が生成される。これにより、画素部10によってRGB3種類の分光から成るモザイク画像が得られる。

この画素部10と信号処理部20とは、例えば図2に模式的に示したように、積層されている。具体的には、撮像素子1は、画素部10が形成された基板1Aと、信号処理部20が形成された基板2Aとが上下に積層された(貼り合わされた)構造(いわゆる積層型の素子構造)を有している。尚、本実施の形態の「信号処理部20」が、本開示の「画像処理装置」の一具体例に相当する。また、本開示の「画像処理方法」は、画像処理装置(信号処理部20)の構成および動作により具現化されるものであるので、その説明を省略する。

なお、本実施の形態では、信号処理部20が撮像素子1内に具備された構成を例に挙げて説明するが、本開示の画像処理装置は、このような撮像素子1に適用される場合に限らず、レンズ30や画素部10を持たない装置、例えばパーソナルコンピュータ(PC)などであってもよい。この場合、図1に示した信号処理部20の構成に加え、撮像データが入力されるインターフェース部と、入力された撮像データが記憶されるメモリーとを更に有する構成となる。

(信号処理部20の構成)

信号処理部20は、例えば位置座標算出部21(距離算出部21Aおよび角度算出部21B)と、補正係数取得部22と、像高間係数算出部23Aと、象限間係数算出部23Bと、補正係数ブレンド処理部24と、レンズ収差補正処理部25と、ラインメモリ26と、エッジ検出部27と、エッジ・平坦部ブレンド処理部28と、RGB信号処理部29とを備える。尚、本実施の形態の補正係数取得部22は、本開示の「取得部」の一具体例に相当し、補正係数ブレンド処理部24およびレンズ収差補正処理部25が、本開示の「補正部」の一具体例に相当する。また、補正係数ブレンド処理部24が本開示の「補正係数算出部」の一具体例、レンズ収差補正処理部25が本開示の「補正処理部」の一具体例にそれぞれ相当する。

信号処理部20は、例えば位置座標算出部21(距離算出部21Aおよび角度算出部21B)と、補正係数取得部22と、像高間係数算出部23Aと、象限間係数算出部23Bと、補正係数ブレンド処理部24と、レンズ収差補正処理部25と、ラインメモリ26と、エッジ検出部27と、エッジ・平坦部ブレンド処理部28と、RGB信号処理部29とを備える。尚、本実施の形態の補正係数取得部22は、本開示の「取得部」の一具体例に相当し、補正係数ブレンド処理部24およびレンズ収差補正処理部25が、本開示の「補正部」の一具体例に相当する。また、補正係数ブレンド処理部24が本開示の「補正係数算出部」の一具体例、レンズ収差補正処理部25が本開示の「補正処理部」の一具体例にそれぞれ相当する。

位置座標算出部21は、例えば距離算出部21Aおよび角度算出部21Bを含んで構成され、画素部10の各画素の画素値に対応付けられた各画素の座標位置を示すxyアドレスに基づいて、補正対象画素(以下、画素Ptと称する)の位置座標を検出するものである。距離算出部21Aは、画素Ptの距離(光学中心からの距離r、像高に対応する距離)を算出するものである。算出された距離rに関する情報は、補正係数取得部22と像高間係数算出部23Aとにそれぞれ供給される。角度算出部21Bは、画素Ptの画像領域内での象限位置(角度d)を算出するものである。算出された角度dに関する情報は、補正係数取得部22と象限間係数算出部23Bとにそれぞれ供給される。

補正係数取得部22は、位置座標算出部21により算出された画素Ptの位置座標(距離r,角度d)に応じて、複数の補正係数(Fr,Fg,Fb)の中から、2以上の補正係数(補正係数群Fgrp)を選択(取得)するものである。補正係数Fr,Fg,Fbはそれぞれ、例えば複数のフィルタ係数から構成されている。取得された補正係数群Fgrpに関する情報は、補正係数ブレンド処理部24に供給される。補正係数Fr,Fg,Fbは、それぞれR,G,Bの色毎に設定されたものであり、予め撮像素子1内に保持されていてもよいし、または外部から入力されてもよい。これらの補正係数Fr,Fg,Fbの詳細については後述する。

像高間係数算出部23Aは、距離算出部21Aにより算出された距離rに基づいて、像高間のブレンド処理(補間処理)で使用する係数(Ar)を算出するものである。算出された係数Arに関する情報は、補正係数ブレンド処理部24に供給される。

象限間係数算出部23Bは、角度算出部21Bにより算出された角度dに基づいて、象限間のブレンド処理(補間処理)で使用する係数(Ad)を算出するものである。算出された係数Adに関する情報は、補正係数ブレンド処理部24に供給される。

補正係数ブレンド処理部24は、補正係数取得部22により取得された補正係数群Fgrpを用いて、画素Ptの補正係数(補正係数F1)を生成する処理を行うものである。換言すると、補正係数Fr,Fg,Fbの対応づけられていない位置(像点)の画素Ptに対する補正係数F1を補間によって生成する処理部である。具体的には、補正係数群Fgrpを構成する各補正係数と、像高間係数算出部23Aにより算出された係数Arと、象限間係数算出部23Bにより算出された係数Adとを用いた補間処理(ブレンド処理)により、画素Ptの補正係数F1を算出する。補正係数F1は、RGBの色毎に算出される。算出された補正係数F1に関する情報は、レンズ収差補正処理部25に供給される。

レンズ収差補正処理部25は、ラインメモリ26から入力された各色の信号(Rin,Gin,Bin)に対して補正係数F1(詳細には、色毎の補正係数F1r,F1g,F1b)を用いた補正処理を行い、補正処理後の画像信号D1(Rd,Gd,Bd)を算出するものである。算出された画像信号D1は、エッジ・平坦部ブレンド処理部28に供給される。このレンズ収差補正処理部25は、例えば画像のぼけを補正する処理、特に画素Ptの位置座標(像高および象限位置)に依存する収差ばらつきを考慮した補正処理を行うことが可能である。

ラインメモリ26は、画素部10から出力された画素信号を一時的に保持するものである。このラインメモリ26は、例えば、画素部10の水平7ライン分の画素値を記憶し、7つの水平ラインデータを並列に順次出力するように構成されている。出力先は、レンズ収差補正処理部25、エッジ検出部27、およびエッジ・平坦部ブレンド処理部28である。これらの各処理部に対して、RGB配列10aを有する撮像データが7ライン単位で出力される。

尚、ラインメモリ26は、ここでは、7ライン単位で出力するものとして説明するが、これは、特に限定されないが、後述する補正係数(フィルタ)が、例えば7×7の画素に対応したものである場合の一例である。このため、補正係数が7×7画素以外の画素数に対応するものである場合には、ラインメモリ26は、その補正係数の画素数に応じたライン数単位で記憶および出力が可能な構成とされるとよい。

エッジ検出部27は、ラインメモリ26からの出力信号に基づいて、画像におけるエッジに関する情報(例えばエッジ方向とエッジ強度とを含む)を生成してエッジ・平坦部ブレンド処理部28に出力する。具体的には、例えば、処理対象画素(7×7画素のうちの中心画素)を基準として7×7画素の画素情報から算出される平坦度(Weightflat)を算出してエッジ・平坦部ブレンド処理部28に出力する。なお、この平坦度算出処理としては、例えば、特開2011-55038号公報に記載された処理と同様の処理を用いることができる。

エッジ・平坦部ブレンド処理部28は、ラインメモリ26からの入力信号中のRGB信号(Rin,Gin,Bin)と、エッジ検出部27から出力されるエッジ情報と、レンズ収差補正処理部25から出力される画像信号D1(Rd,Gd,Bd)とを用いて、エッジ情報を考慮した補正処理後の画像信号D2を生成してRGB信号処理部29に出力する。具体的には、エッジ・平坦部ブレンド処理部28は、エッジ検出部27により算出されたエッジ情報(例えば7×7画素の画素情報から算出される平坦度)に応じて、レンズ収差補正処理部25から出力される補正処理後の画像信号D1(Rd,Gd,Bd)の加重平均処理を実行して、RGB配列10aのRGB各画素値を算出する。具体的には、以下の3式に従ってRGB画素値を決定する。

R=(Weightflat)×(Rd)+(1-Weightflat)×Rin

G=(Weightflat)×(Gd)+(1-Weightflat)×Gin

B=(Weightflat)×(Bd)+(1-Weightflat)×Bin

G=(Weightflat)×(Gd)+(1-Weightflat)×Gin

B=(Weightflat)×(Bd)+(1-Weightflat)×Bin

この式の算出結果として得られるR、G、Bの各色信号がRGB信号処理部29に出力される。RGB信号処理部29は、RGB配列(ベイヤー配列)11aの信号に対する信号処理として、エッジ・平坦部ブレンド処理部28から出力されるRGB配列11aの信号に対する信号処理を実行してカラー画像を生成する。RGB信号処理部29は、例えば、ホワイトバランス調整処理、デモザイク処理、シェーディング処理、RGBカラーマトリクス処理およびガンマ補正処理などを実行してカラー画像を生成する。

RGB信号処理部29により生成されたカラー画像についての画像信号Doutは、外部へ出力されるか、装置内部のメモリーに記録される。

図示しない制御部は、上記の各処理部における一連の処理の制御を実行するものである。例えば、一連の処理を実行させるプログラムが図示しないメモリーに格納されており、制御部は、そのメモリーから読み出したプログラムを実行して一連の処理を制御する。なお、メモリーは、例えば磁気ディスク、光ディスク、フラッシュメモリ等の各種記録媒体によって構成可能である。

(補正係数について)

補正係数Fr,Fg,Fbは、レンズ収差補正フィルタ係数として、予め保持されているか、外部から入力されるものである。これらの補正係数Fr,Fg,Fbは、例えば、ウィナー(Wiener)フィルタを用いて算出することができる。このウィナーフィルタについて簡単に説明する。以下では、ぼけのない理想画像(原画像A1)と、ぼけのある撮影画像(撮影画像A2)と、撮影画像に対するフィルタ補正処理によって復元される復元画像(復元画像A3)との3つの画像を想定して、説明する。

補正係数Fr,Fg,Fbは、レンズ収差補正フィルタ係数として、予め保持されているか、外部から入力されるものである。これらの補正係数Fr,Fg,Fbは、例えば、ウィナー(Wiener)フィルタを用いて算出することができる。このウィナーフィルタについて簡単に説明する。以下では、ぼけのない理想画像(原画像A1)と、ぼけのある撮影画像(撮影画像A2)と、撮影画像に対するフィルタ補正処理によって復元される復元画像(復元画像A3)との3つの画像を想定して、説明する。

上記3つの画像のうち、原画像A1および復元画像A3の2つの画像の二乗誤差を最小とするフィルタが、最小二乗フィルタ、またはウィナーフィルタと呼ばれる。ここで、原画像A1をf(x,y)、撮影画像A2をg(x,y)、レンズ収差や手ぶれによる劣化関数をh(x,y)、ノイズ成分を、n(x,y)とすると、以下の式(1)が成り立つ。尚、(x,y)は各画像の画素位置であり、f(x,y)~n(x,y)は各画像の座標位置(x,y)の画素値を示す場合もある。また、レンズ収差や手ぶれによる劣化関数h(x,y)は、固定値であると仮定する。

上記の式(1)の両辺をフーリエ変換すると、以下の式(2)が得られる。但し、G(u,v),H(u,v),F(u,v),N(u,v)はそれぞれ、g(x,y),h(x,y),f(x,y),n(x,y)のフーリエ変換を表す。

G(u,v)=H(u,v)×F(u,v)+N(u,v) ………(2)

レンズ収差や手ぶれによる劣化関数に零点がなく、ノイズ成分が既知であるとすると、上記の式(2)からF(u,v)は、以下の式(3)のように表すことができる。

しかしながら、一般にノイズ成分は未知であるため、上記式(3)を厳密に解くことはできない。そこで、原画像A1および復元画像A3の誤差を最小とする以下の式(4)のウィナーフィルタK(u,v)を用いて補正が行われる。尚、(Sn(u,v)/Sf(u,v))は、原画像A1と、ノイズ成分とのパワースペクトル密度に対応するものである。

この式(4)で表されるウィナーフィルタを逆フーリエ変換したもの(k(x,y))と、撮影画像A2とを実空間で畳み込むことで、以下の式(5)に示したように、補正がなされた復元画像A3のf'(x,y)を得ることができる。

上記の式(5)に対応するウィナーフィルタの一例を、図3Aおよび図3Bに示す。図3Aは、撮影画像におけるG画素を中心とする7×7画素について示し、図3Bは、図3Aの画素領域の中心のG画素を補正対象画素Pt(画素Pgt)とするウィナーフィルタの一例を示したものである。

ここで、撮影画像は、RGB画素からなるRAW画像である。補正対象画素Pgtは、図3Aに示した7×7画素の中心のG画素である。図3Bに示したウィナーフィルタは、7×7画素に含まれる複数のG画素の各々に対する乗算係数を示したものである。7×7画素に含まれるG画素の画素値に各係数を乗算して加算する畳み込み演算を実行することで、中心のG画素の補正画素値が算出される。具体的には、以下の式(6)によりG画素の画素値を補正することができる。

同様に、図4Aは、撮影画像におけるR画素を中心とする7×7の画素領域について示し、図4Bは、図4Aの画素領域の中心のR画素を補正対象画素Pt(画素Prt)とするウィナーフィルタの一例を示したものである。図5Aは、撮影画像におけるB画素を中心とする7×7の画素領域について示し、図5Bは、図5Aの画素領域の中心のB画素を補正対象画素Pt(画素Pbt)とするウィナーフィルタの一例を示したものである。上記のG画素の場合と同様にしてR画素およびB画素のそれぞれにおいて補正値が算出される。

この補正係数を算出する際は、レンズPSF(Point Spread Function:点拡がり関数)データあるいはMTF(Modulation Transfer Function)データが用いられる。レンズ30の特性に応じて算出された補正係数が、補正係数Fr,Fg,Fbとして予め保持されているか、または外部より入力される。

(補正係数の詳細構成例)

本実施の形態では、補正係数Fr,Fg,Fbのそれぞれが、互いに交差する第1軸および第2軸のそれぞれに、複数対応づけられている(設定されている)。以下では、代表してG画素補正用の補正係数Fgを用いて説明する。補正係数Fgは、1つのレンズ30に対して複数設定されている。図6にその一例を示す。尚、図6には、補正係数の一例として、7×7画素に対応する補正フィルタを図示している。

本実施の形態では、補正係数Fr,Fg,Fbのそれぞれが、互いに交差する第1軸および第2軸のそれぞれに、複数対応づけられている(設定されている)。以下では、代表してG画素補正用の補正係数Fgを用いて説明する。補正係数Fgは、1つのレンズ30に対して複数設定されている。図6にその一例を示す。尚、図6には、補正係数の一例として、7×7画素に対応する補正フィルタを図示している。

補正係数Fgは、例えば互いに直交するX軸およびY軸のそれぞれに複数対応づけられている。X軸上の正の方向には、例えば4つの補正係数f11~f14(係数列q1)が設定され、X軸上の負の方向には、例えば4つの補正係数f31~f34(係数列q3)が設定されている。Y軸上の正の方向には、例えば4つの補正係数f21~f24(係数列q2)が設定され、Y軸上の負の方向には、例えば4つの補正係数f41~f44(係数列q4)が設定されている。尚、X軸(第1軸)およびY軸(第2軸)は、光軸(光学中心)において交差(ここでは直交)する。この光学中心(像高が0である点)には、補正係数f0が設定されている。

補正係数f11は、係数列q1のうち、例えば最も光軸寄りの(光軸に近い)像高ih1(像高ih1の位置にある像点)に設定されている。補正係数f12は、係数列q1のうち、像高ih1の隣の(1つ外側の)像高ih2に設定されている。補正係数f13は、係数列q1のうち、像高ih2の隣の(1つ外側の)像高ih3に設定されている。補正係数f14は、係数列q1のうち、像高ih3の隣の(1つ外側の)像高ih4に設定されている。

同様に、補正係数f21は、係数列q2のうち像高ih1に設定されている。補正係数f22は、係数列q2のうち像高ih2に設定されている。補正係数f23は、係数列q2のうち像高ih3に設定されている。補正係数f24は、係数列q2のうち像高ih4に設定されている。また、補正係数f31は、係数列q3のうち像高ih1に設定されている。補正係数f32は、係数列q3のうち像高ih2に設定されている。補正係数f33は、係数列q3のうち像高ih3に設定されている。補正係数f34は、係数列q3のうち像高ih4に設定されている。また、補正係数f41は、係数列q4のうち像高ih1に設定されている。補正係数f42は、係数列q4のうち像高ih2に設定されている。補正係数f43は、係数列q4のうち像高ih3に設定されている。補正係数f44は、係数列q4のうち像高ih4に設定されている。

尚、ここでは、一例として、像高ih4が、レンズ30のイメージサークル(最外端)に相当する場合を例に挙げて説明する。

このように本実施の形態では、補正係数Fgが、複数の像高毎および複数の角度(X軸およびY軸上の列)毎に、複数設定されている。図6に示した例では、4つの像高と、4つの角度方向とのそれぞれの位置座標において、複数の補正係数Fg(具体的には、補正係数f11~f14,f21~f24,f31~34,f41~f44)が設定されている。これらの補正係数Fgは、上述したようなウィナーフィルタを用いた手法により算出することができる。本実施の形態では、このように2軸上に対応づけられた複数の補正係数Fgの中から2以上の補正係数(補正係数群Fgrp)が、画素Ptの位置座標に応じて取得されるようになっている。

補正係数Fr,Fbについても同様で、2軸(第1軸,第2軸)上のそれぞれに複数対応づけられている。尚、R,G,B毎に、交差する2軸上に複数の補正係数が対応づけられていればよく、これら2つの軸は必ずしも直交していなくともよい(斜交していてもよい)。例えば、有効画素領域301の対角線に沿って2軸が配置されていてもよい。

尚、これらの補正係数Fr,Fg,Fbは、例えば、レンズ30の製造過程もしくはカメラモジュールの製造過程において算出され、レンズ30と関連付けられて保持される。例えば、レンズ30がカメラの本体に対して着脱可能である場合、レンズ30の筐体部分にメモリーなどの保持機能が備えられており、その保持機能により補正係数の情報が保持される。この場合には、補正係数Fr,Fg,Fbは、信号処理部20の外部のレンズ30側から供給される。あるいは、レンズ30がカメラと一体型の場合には、信号処理部20に予め補正係数Fr,Fg,Fbが保持されていてもよい。このように、補正係数は、レンズ30毎に算出され、信号処理部20に予め保持されるか、または外部より入力される。

(像高の設定)

上述のように、1つのレンズ30に対して、選択的な数の像高(図6では4つの像高ih1~ih4)において補正係数が算出されるが、この像高の数を増やす、換言すれば、像高の間隔を狭めることで、補正係数を用いた補正精度は向上する。しかしながら、保持すべき補正係数が多くなり、メモリー容量が大きくなる。このため、像高の数は、補正精度とメモリー容量との兼ね合いから設定されることが望ましい。像高間の領域は、後述するように補間によって算出することが可能である。

上述のように、1つのレンズ30に対して、選択的な数の像高(図6では4つの像高ih1~ih4)において補正係数が算出されるが、この像高の数を増やす、換言すれば、像高の間隔を狭めることで、補正係数を用いた補正精度は向上する。しかしながら、保持すべき補正係数が多くなり、メモリー容量が大きくなる。このため、像高の数は、補正精度とメモリー容量との兼ね合いから設定されることが望ましい。像高間の領域は、後述するように補間によって算出することが可能である。

設定される像高の間隔は、等間隔とすることが可能であり、また、その間隔は、レンズ特性によらず一定としても良い。あるいは、等間隔とせずに、図7および図8に示したように、特徴がある像高(像高0~4)を検出してもよい。これにより、効果的に補正係数の数を削減することができる。尚、図7および図8は、像高に対するMTFデータを示す図である。図8には、イメージサークル303と、有効画素領域301とについても示している。このように、MTFデータは、像高により変化する。そこで、変化の度合いが相対的に大きい像点における像高を選択し、選択した像高において補正係数を算出する。

詳細には、像高0は、レンズの中心位置として選択される。像高2は、MTFデータが落ち込む点における像高であるため、選択される。像高1は、像高0と像高2の間隔が離れているため、その略中央の像高として選択される。像高3は、像高2で一旦下がったMTFデータが再度上がり、そして再度下がる転換点なので、選択される。像高4は、レンズの端部として選択される。例えば、これらの像高0~4に相当するレンズ30上の複数箇所から、MTFデータもしくはPSFデータが取得され、上記したような処理により補正係数を算出するとよい。

このように、補正係数が算出される像高は、MTFデータにおいて変曲点となる像点における像高が選択されるとよい。また、レンズ中心や端なども、レンズ内では特徴的な位置であるため、その位置の像高も選択されるとよい。更に、特徴点となる像高の数が少ない場合や、選択された像高の間隔が広い場合等には、適切な間隔になるように像高を追加してもよい。

像高に対するMTFデータは、レンズにより異なる可能性がある。よって、レンズ毎に、データが取得され、像高が選択され、レンズ収差補正フィルタ係数が算出されることが望ましい。レンズ毎に異なる特性に対応したレンズ収差補正フィルタ係数を算出できるようになり、補正処理をより精度良く行えるようになる。

[作用、効果]

上記の撮像素子1では、レンズ30を通過した光線が画素部10に入射することで、光電変換によって画素毎に画素信号が得られる。このとき、画素部10では、撮像信号D0として、RGB配列10aに対応したR,G,BのカラーのRAWデータが取得される。得られた撮像信号D0は、信号処理部20へ出力される。

上記の撮像素子1では、レンズ30を通過した光線が画素部10に入射することで、光電変換によって画素毎に画素信号が得られる。このとき、画素部10では、撮像信号D0として、RGB配列10aに対応したR,G,BのカラーのRAWデータが取得される。得られた撮像信号D0は、信号処理部20へ出力される。

信号処理部20は、入力された撮像信号D0に基づいて、画像の補正処理を行う。具体的には、まず、位置座標算出部21が、画素部10の各画素の画素値に対応付けられた各画素の座標位置を示すxyアドレスに基づいて、補正対象の画素Ptの位置座標を検出する。詳細には、距離算出部21Aが、画素Ptの距離rを算出する。算出された距離rに関する情報は、補正係数取得部22と像高間係数算出部23Aとのそれぞれに出力される。また、角度算出部21Bが、画素Ptの画像領域内での象限位置(角度d)を算出する。算出された角度dに関する情報は、補正係数取得部22と象限間係数算出部23Bとにそれぞれ出力される。

補正係数取得部22は、入力された画素Ptの位置座標(距離r,角度d)に応じて、複数の補正係数(ここでは補正係数Fgを例に挙げる)の中から、2以上の補正係数(補正係数群Fgrp)を選択(取得)する。取得された補正係数群Fgrpに関する情報は、補正係数ブレンド処理部24に供給される。

像高間係数算出部23Aは、入力された距離rに基づいて、像高間のブレンド処理(補間処理)で使用する係数Arを算出する。算出された係数Arに関する情報は、補正係数ブレンド処理部24に出力される。象限間係数算出部23Bは、入力された角度dに基づいて、象限間のブレンド処理(補間処理)で使用する係数Adを算出する。算出された係数Adに関する情報は、補正係数ブレンド処理部24に出力される。

補正係数ブレンド処理部24は、入力された補正係数群Fgrpを用いて、画素Ptの補正係数F1を補間処理により生成する。具体的には、補正係数群Fgrpを構成する各補正係数と、係数Ar,Adとを用いた補間処理(ブレンド処理)により、画素Ptの補正係数F1(第1の補正係数)を算出する。

図9に、補正係数のブレンド処理の一例を示す。このようにXY面内において、角度間(象限間,軸間)、および像高間のそれぞれにおいて補間処理を行う。具体的には、2以上の補正係数Fgを含む補正係数群Fgrpと係数Ar,Adとを用いた補間処理により、7×7画素の中心の画素Ptの補正係数F1を算出する。尚、像高ihnは、例えば図6に示した像高ih1~ih4のうちのいずれかの像高(像高位置)に対応し、像高ihn+1は、像高ihnの1つ外側の像高に対応している。また、ここでは、画素Ptは、XY面内における第1象限に位置するG画素として説明する。

この例では、補正係数取得部22により、複数の補正係数Fg(図6に示した補正係数f11~f14,f21~f24,f31~34,f41~f44)の中から、画素Ptの位置座標(距離r,角度d)に応じて、適当な2以上の補正係数Fg(補正係数群Fgrp)が選択(取得)される。補正係数群Fgrpは、例えばX軸上の正方向に設定された2つの補正係数F0n,F0n+1(図6に示した係数列q1のうちのいずれか2つの補正係数)と、例えばY軸上の正方向に設定された2つの補正係数F90n,F90n+1(図6に示した係数列q2のうちのいずれか2つの補正係数)とを含んでいる。

これらの補正係数F0n,F0n+1,F90n,F90n+1のうち、例えば像高ihn上に対応づけられた補正係数F0n,F90nと、角度dに基づいて算出された係数Ad(0≦Ad<1)を用いて、線形演算により以下の式(6)から、補正係数のブレンド処理を行う。これにより、像高ihn上において象限間(軸間)のブレンド処理がなされ、補正係数F2(第2の補正係数)が算出される。

F2=(1-Ad)×F0n+Ad×F90n ………(6)

同様に、像高ihn+1上に対応づけられた補正係数F0n+1,F90n+1と、角度dに基づいて算出された係数Ad(0≦Ad<1)を用いて、線形演算により以下の式(7)から補正係数のブレンド処理を行う。これにより、像高ihn+1上において象限間(軸間)のブレンド処理がなされ、補正係数F3(第3の補正係数)が算出される。

F3=(1-Ad)・F0n+1+Ad×F90n+1 ………(7)

F3=(1-Ad)・F0n+1+Ad×F90n+1 ………(7)

続いて、これらの補正係数F2,F3を、距離r(光学中心からの距離)に基づいて算出された係数Ar(0≦Ar<1)を用いて、線形演算により以下の式(8)から、補正係数のブレンド処理を行う。これにより、像高間のブレンド処理がなされ、距離r,角度dの位置の画素Ptの補正係数F1が算出される。即ち、画素Ptの補正係数が最適化される。

F1=(1-Ar)×F2+Ad×F3 ………(8)

F1=(1-Ar)×F2+Ad×F3 ………(8)

上記のような補間処理(ブレンド処理)によって算出された補正係数F1についての情報は、レンズ収差補正処理部25に出力される。

レンズ収差補正処理部25は、ラインメモリ26から入力された各色の信号(Rin,Gin,Bin)に対して、上記の補正係数F1を用いて画素Ptにおける画素値に対して補正処理(一例として、レンズ収差補正処理)を施す。具体的には、補正係数F1が7×7画素に対応するものである場合、それらの7×7画素に対して乗算して加算をする演算処理を実行して、その中心の画素Ptの画素値を補正する。距離rの位置の画素Ptの画素値をPrとすると、レンズ収差補正後の画素値Pr1は、以下の式(9)で算出される。

このようにして、画素Ptの画素値を補正する。同様にして、R画素およびB画素に対しても、象限間および像高間で補正係数のブレンド処理を行って補正係数F1を算出した後、その補正係数F1を用いた補正処理(レンズ収差補正処理)を行う。

尚、本実施の形態では、象限間および像高間の補正係数をブレンド処理した(補間した)後、画素値に対して補正処理を行っているが、ブレンド処理(補間処理)は、画素値の補正後に行ってもよい。その場合の機能ブロック構成を図10に示す。即ち、レンズ収差補正処理部25aが、2軸上に対応づけられた複数の補正係数を用いて補正対象である画素Ptの画素値を補正する。この後、ブレンド処理部26aが、補正後の画素値に基づいて、象限間および像高間での補間処理を行ってもよい。また、ブレンド処理と補正処理との各処理を行う順番を、補正係数のデータ量に応じて決定するようにしてもよい。

これにより、画像の補正処理、特に画素Ptの位置座標(像高および象限位置)に依存する収差ばらつきを考慮した補正処理を行うことが可能である。レンズ収差補正処理部25による補正処理後の画像信号D1(Rd,Gd,Bd)は、エッジ・平坦部ブレンド処理部28に出力される。

エッジ・平坦部ブレンド処理部28は、ラインメモリ26から入力されたRGB信号(Rin,Gin,Bin)と、エッジ検出部27から入力されたエッジ情報と、レンズ収差補正処理部25から入力された画像信号D1(Rd,Gd,Bd)とを用いて、エッジ情報を考慮した補正処理後の画像信号D2を生成する。具体的には、エッジ・平坦部ブレンド処理部28は、エッジ検出部27により算出されたエッジ情報(例えば7×7画素の画素情報から算出される平坦度)に応じて、レンズ収差補正処理部25から出力される補正処理後の画像信号D1(Rd,Gd,Bd)の加重平均処理を実行して、RGB配列10aにおけるRGBの各画素値を算出する。具体的には、以下の3式に従ってRGB画素値を決定する。

R=(Weightflat)×(Rd)+(1-Weightflat)×Rin

G=(Weightflat)×(Gd)+(1-Weightflat)×Gin

B=(Weightflat)×(Bd)+(1-Weightflat)×Bin

G=(Weightflat)×(Gd)+(1-Weightflat)×Gin

B=(Weightflat)×(Bd)+(1-Weightflat)×Bin

この式の算出結果として得られるR、G、Bの各色信号がRGB信号処理部29に出力される。生成された画像信号D2は、RGB信号処理部29に出力される。

RGB信号処理部29は、入力されたRGB配列(ベイヤー配列)信号に対する信号処理、例えば、ホワイトバランス調整処理、デモザイク処理、シェーディング処理、RGBカラーマトリクス処理およびガンマ補正処理などを実行してカラー画像を生成する。生成されたカラー画像についての画像信号Doutは、外部へ出力されるか、装置内部のメモリーに記録される。

上記のように本実施の形態では、互いに交差する第1軸および第2軸(X軸,Y軸)のそれぞれに対応づけられた複数の補正係数の中から、補正対象の画素Ptの位置座標(距離r,角度d)に応じて2以上の補正係数が取得され、取得された補正係数を用いて画像の補正処理が行われる。これにより、画素Ptの位置座標に応じて補正係数を最適化することができる。