WO2016170965A1 - オブジェクト検出方法及び画像検索システム - Google Patents

オブジェクト検出方法及び画像検索システム Download PDFInfo

- Publication number

- WO2016170965A1 WO2016170965A1 PCT/JP2016/061104 JP2016061104W WO2016170965A1 WO 2016170965 A1 WO2016170965 A1 WO 2016170965A1 JP 2016061104 W JP2016061104 W JP 2016061104W WO 2016170965 A1 WO2016170965 A1 WO 2016170965A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- image

- feature amount

- symmetry

- detection method

- object detection

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

- G06F16/50—Information retrieval; Database structures therefor; File system structures therefor of still image data

- G06F16/58—Retrieval characterised by using metadata, e.g. metadata not derived from the content or metadata generated manually

- G06F16/583—Retrieval characterised by using metadata, e.g. metadata not derived from the content or metadata generated manually using metadata automatically derived from the content

- G06F16/5854—Retrieval characterised by using metadata, e.g. metadata not derived from the content or metadata generated manually using metadata automatically derived from the content using shape and object relationship

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

- G06F16/50—Information retrieval; Database structures therefor; File system structures therefor of still image data

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/60—Analysis of geometric attributes

- G06T7/68—Analysis of geometric attributes of symmetry

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/40—Extraction of image or video features

- G06V10/42—Global feature extraction by analysis of the whole pattern, e.g. using frequency domain transformations or autocorrelation

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/74—Image or video pattern matching; Proximity measures in feature spaces

- G06V10/75—Organisation of the matching processes, e.g. simultaneous or sequential comparisons of image or video features; Coarse-fine approaches, e.g. multi-scale approaches; using context analysis; Selection of dictionaries

- G06V10/758—Involving statistics of pixels or of feature values, e.g. histogram matching

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/168—Feature extraction; Face representation

- G06V40/169—Holistic features and representations, i.e. based on the facial image taken as a whole

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/168—Feature extraction; Face representation

- G06V40/171—Local features and components; Facial parts ; Occluding parts, e.g. glasses; Geometrical relationships

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/172—Classification, e.g. identification

Abstract

プロセッサ及びメモリを有する計算機によって構成される画像解析装置が実行するオブジェクト検出方法であって、前記プロセッサが、画像の入力を受け、前記メモリに格納する第1ステップと、前記プロセッサが、前記入力された画像から、その一部である部分領域を抽出して、前記メモリに格納する第2ステップと、前記プロセッサが、前記部分領域から抽出した特徴量と、前記特徴量を鏡映変換した後の鏡映特徴量とを用いて、前記部分領域の対称性を評価する第3ステップと、前記プロセッサが、所定の閾値より前記対称性が高いと評価された部分領域を、検出対象が写っているオブジェクト領域であると判定する第4ステップと、を有する。

Description

本出願は、平成27年(2015年)4月20日に出願された日本出願である特願2015-85964の優先権を主張し、その内容を参照することにより、本出願に取り込む。

本発明は、画像から所定のオブジェクトを検出する技術に関する。

近年、ネットワークのブロードバンド化、各種記憶装置の大容量化により、大規模に画像や映像を蓄積し、それらを配信するサービスが可能となっている。

大規模にコンテンツを扱うシステムでは検索技術が重要である。一般的な検索技術として、画像や映像コンテンツと関連付けられたテキスト情報を検索する技術である。文書情報の検索技術では、一つ又は複数個のキーワードをクエリとして入力し、入力されたキーワードが含まれるテキスト情報と関連付けられた画像や映像を検索結果として返す。また、画像自体から情報を抽出し、検索する技術も提案されている。特開2000-123173号公報及び特開2007-334402号公報等に記載されているように、類似画像検索では、検索対象となる登録画像の特徴を数値化した画像特徴量をデータベースに登録することによって高速な検索を実現している。

類似画像検索における画像特徴量の抽出は、検索対象となる事物が含まれる画像中の部分領域を検出する処理が重要となる場合が多い。例えば、類似画像検索を用いた顔検索では、顔領域を検出し、検出された顔領域から画像特徴量を抽出する。同様に、車両の類似検索では、画像中の車両が存在する領域を検出する。

画像中から特定の物体が存在する領域を検出する方法として、学習データを用いる方法が提案されている。例えば、検出対象となる物体が撮像された画像の集合を学習データとして用いたAdaブースト法による学習によって、局所的な特徴の一致に基づく弱識別器をカスケード上に並べて識別器を構成する。この方法は、特に、人物の顔領域検出の分野で、高い有効性を示す。

また、この方法では、検出する対象物のカテゴリーごとに識別器の学習を行う必要がある。この場合のカテゴリーは、単なる意味的なカテゴリー分けでは不十分である。各カテゴリー内では、画像の見えが、ある程度均質である必要がある。例えば、顔検出では、正面顔と横顔は、別々の識別器として学習する。また、各学習では、大量の学習用データが必要である。

これに対して、部分画像が登録された辞書パターンを用いる方法が提案されている。例えば、検出したい対象物が含まれる部分画像をデータベースに辞書パターンとして登録し、画像中から辞書パターンと類似した部分領域を効率的に抽出することによって部分領域の検出を実現している。この方法では、見え方が異なる多様な対象物を一括して検出することができる。

前述した従来技術において、検索したい画像が画像中の部分領域である場合、前述した検出処理が必要である。前述した検出処理を行うためには、いずれの方法においても、検索対象として想定される事物の画像を事前に収集する必要がある。例えば、収集した画像に基づき識別器の学習を実施したり、収集した画像を辞書パターンに登録する。いずれの方法でも、着目する事物を事前に決定して検出処理を行い、データベースを構築する。従って、着目する事物が事前に不明である場合、いずれの方法も適切ではない。

検索システムを使用するユーザが、どのような事物に着目して検索するかを事前に網羅的に想定することは、一般的には困難である。また、検索したい事物を想定できても、手掛かりとなる情報、すなわち、検索クエリとなる情報が、隠蔽等により事物の部分のみしか知り得ない場合もある。このような場合、事前に検索対象となる画像を検出処理によってデータベース化することはできない。

本願において開示される発明の代表的な一例を示せば以下の通りである。すなわち、プロセッサ及びメモリを有する計算機によって構成される画像解析装置が実行するオブジェクト検出方法であって、前記プロセッサが、画像の入力を受け、前記メモリに格納する第1ステップと、前記プロセッサが、前記入力された画像から、その一部である部分領域を抽出して、前記メモリに格納する第2ステップと、前記プロセッサが、前記部分領域から抽出した特徴量と、前記特徴量を鏡映変換した後の鏡映特徴量とを用いて、前記部分領域の対称性を評価する第3ステップと、前記プロセッサが、所定の閾値より前記対称性が高いと評価された部分領域を、検出対象が写っているオブジェクト領域であると判定する第4ステップと、を有する。

本発明によって、着目すべき部分領域を的確に検出することができる。前述した以外の課題、構成及び効果は、以下の実施例の説明により明らかにされる。

次に、本発明の実施例について、図面を参照して説明する。

<実施例1>

図1は、第1実施例の検索方法において、局所的な対称性を評価するための画像特徴量の抽出を説明する図である。

図1は、第1実施例の検索方法において、局所的な対称性を評価するための画像特徴量の抽出を説明する図である。

画像101の中の任意の矩形部分領域102を、さらに、所定数(図示する例では3×3)のブロックに分割し、各ブロックの領域の画像特徴量ベクトル103を抽出する。この9個の画像特徴量ベクトルの各々をf00、f10、f20、f01、f11、f21、f02、f12、f22で示す。画像特徴量ベクトルを示す符号の1番目の添え字は各ブロックのx方向の位置を表し、2番目の添え字はy方向の位置を表す。

次に、図2に示すように、各ブロックの領域の画像特徴量ベクトルに対して、4つの軸を中心とした鏡映変換を考える。ここで、各軸を中心とした鏡映変換を画像特徴量ベクトルに対して適用するための行列を、T0、T1、T3、T4で表す。すなわち、T0は、左右に鏡映変換するための行列であり、T1は、右上45度の軸を中心に鏡映変換するための行列であり、T3は、上下に鏡映変換するための行列であり、T4は、右下45度の軸を中心に鏡映変換するための行列である。なお、図2は、各行列によって行われる鏡映変換の中心となる軸を示す。

各ブロックの領域で抽出された画像特徴量ベクトルに、前述した変換行列を適用することによって、矩形部分の領域内の対称性を評価する。例えば、左右対称性を評価するためには、y軸を中心として対称な位置に存在するf00とf20について、f20を左右に鏡映変換したベクトル、すなわち、f20にT0を乗じたベクトルがf00と近ければ、対称性が高いと考えられる。同様に、f01とf21については、f21にT0を乗じたベクトル、f02とf22については、f22にT0を乗じたベクトルがそれぞれ近ければ、対称性が高いと考えられる。このようにして、左右対称性は、数式(1)に示すような特徴量ベクトル間の三つの二乗距離から構成されるベクトルD0として表すことができる。

同様に、右上45度の軸を中心とする対称性は、数式(2)のD1として表すことができる。

同様に、上下対称性は、数式(3)のD2として表すことができる。

同様に、右下45度の軸を中心とする対称性は、数式(4)のD3として表すことができる。

一方、本実施例の方法では、特徴量ベクトルの変換によって、変換前より対称性が増大する場合に、対称性が高いと評価する。例えば、D0の算出で用いられるf00とf02が、元々、左右の鏡映変換を行っても対称性の変化が小さい場合、左右対称性が大きいとは考えない。このような性質を定量的に表現する補正項として、数式(5)に示すような、鏡映変換を適用しない場合に対応するブロックの領域の特徴量ベクトル間の二乗距離から構成されるベクトルE0を定義する。

同様に、D1に対する補正項E1は、数式(6)で表される。

同様に、D2に対する補正項E2は、数式(7)で表される。

同様に、D3に対する補正項E3は、数式(8)で表される。

D0、D1、D2、D3、および、E0、E1、E2、E3を用いて、矩形部分領域の対称性を評価する。具体的な評価関数としては、以下の四つを定義する。

数式(9)に示す評価関数は、D0、D1、D2、D3の各要素の総和と、E0、E1、E2、E3の各要素の総和との比を用いて対称性を評価する。

数式(10)に示す評価関数は、4方向の対称性を評価した後、その平均値を用いて総合的な対称性を評価する。

数式(11)に示す評価関数は、対応する各ブロック間で対称性を評価した後、その平均値を用いて総合的な対称性を評価する。

数式(12)に示す評価関数は、4方向ごとの対称性を評価した後、その最大値を用いて総合的な対称性を評価する。

これらの評価関数は、本発明が適用される具体的な事案に最も適切なものを採用するとよい。

次に、本実施例で用いる画像特徴量について説明する。

本実施例で用いる画像特徴量は、ブロックに分割された領域の中から所定次元のベクトルとして抽出可能なアルゴリズムによって抽出されるものでなければならない。さらに、鏡映変換に関して不変な特徴量は採用できない。例えば、ブロック内の色平均特徴量、すなわち、画像を構成するRGB値の平均から構成される特徴量は、鏡映変換に関して不変であるので、本実施例では用いることができない。

鏡映変換に関して不変ではない特徴量の抽出については、複数の公知技術がある。例えば、ブロックの領域内を更に小ブロックに分割して、小ブロックごとに色平均を算出した特徴量や、小ブロックごとの色分布をヒストグラム化した特徴量は、鏡映変換に関して不変ではない。また、白黒濃淡画像の場合、局所的な輝度変化のパターンの性質を抽出するエッジパターン特徴量も、鏡映変換に関して不変ではない。以下の説明では、本実施例の方法を分かりやすく説明するために、輝度勾配ベクトルの強度分布を特徴量としてを用いた例について詳細に説明する。

輝度勾配ベクトルは、白黒濃淡画像に二次元の数値微分を適用することによって算出できる。図3は、数値微分を行うためのフィルタの例である。微分フィルタによって求められた画素位置(x,y)上の輝度勾配ベクトル(gx,gy)から、数式(13)のように、ベクトルの方向θとベクトルの二乗ノルムpを算出することができる。

ベクトルの方向θは、0度から360度の範囲に分布する。これを適切なレベルで等間隔に量子化し、二乗ノルムpを矩形領域内で集計することによって、輝度勾配ベクトル方向の強度分布をヒストグラム状のデータとして表現することができる。

図4は、この処理を説明する図である。

まず、画素の輝度の勾配を示す輝度勾配ベクトル401を画像から抽出し、抽出した輝度勾配ベクトルを集計して、ヒストグラム状のデータ402を算出する。なお、本実施例の方法における4方向の鏡映変換を適用するために、量子化のレベル数は8、又は8の倍数とする。また、量子化の最初の値域の中心をx軸方向に一致させるとよい。

本特徴量において量子化のレベル数を8とすれば、各ブロックの領域から8次元の画像特徴量ベクトルが抽出される。このとき、左右の対称性を評価するための鏡映変換行列T0は数式(14)で表される。

同様に、右上45度方向の軸を中心とする対称性を評価するための鏡映変換行列T1は数式(15)で表される。

同様に、上下対称性を評価するための鏡映変換行列T2は数式(16)で表される。

同様に、右下45度方向の軸を中心とする対称性を評価するための鏡映変換行列T3は数式(17)で表される。

輝度勾配ベクトルに基づく特徴量では、明るい画素から暗い画素に向かう輝度勾配と、暗い画素から明るい画素に向かう輝度勾配との明暗反転を無視し、ベクトルの方向θを0度から180度の範囲に分布させて処理してもよい。この場合、本実施例の方法における4方向の鏡映変換を適用するために、量子化のレベル数は4、又は4の倍数とするとよい。

図5を用いて、輝度勾配ベクトルの方向を説明する。

図5(A)に示すような、2値画像(例えば、白黒2値による線画)では、反対方向の輝度勾配ベクトルが近接して現れる。このため、一方の輝度勾配ベクトルのみを使用して輝度勾配ベクトルの方向の分布を求めれば十分であり、0°~180°の範囲に輝度勾配ベクトルを分布させればよい。一方、図5(B)に示すような、多値画像(例えば、多値のグレースケース画像や、カラー画像)では、様々な方向に輝度勾配ベクトルが現れる。このため、0°~360°の範囲に輝度勾配ベクトルを分布させる必要がある。特に、図5(C)に示すように背景の輝度が変わる場合、0°~180°の範囲では、輝度勾配ベクトルの分布を正確に求めることができない。このように、入力された画像の種類に応じて輝度勾配ベクトルの分布の範囲を変えるとよい。

輝度勾配ベクトルの分布の範囲の切替は、入力画像に性質に応じてオペレータが設定してもよい。また、計算機が入力された画像を判定し、入力された画像が2値画像である場合、輝度勾配ベクトルの方向を0度から180度の範囲に分布させ、それ以外の場合、輝度勾配ベクトルの方向を0度から360度の範囲に分布させるように処理してもよい。

本特徴量において量子化のレベル数を4とすれば、各ブロックの領域から4次元の画像特徴量ベクトルが抽出される。このとき、左右対称性を評価するための鏡映変換行列T0は数式(18)で表される。

同様に、右上45度方向の軸を中心とする対称性を評価するための鏡映変換行列T1は数式(19)で表される。

また、この場合、上下対称性を評価するための鏡映変換行列T2は、T0と同一であり、右下45度方向の軸を中心とする対称性を評価するための鏡映変換行列T3は、T1と同一である。

なお、輝度勾配ベクトルに基づく特徴量を用いた場合、数式(9)から数式(12)で定義される評価関数は、全て、特徴量ベクトルのノルムに対して不変である。これは、画像の絶対的なコントラスト等に対して不変に対称性を評価できる利点がある。一方で、輝度勾配がほとんど存在しない領域、すなわち、各特徴量ベクトルがゼロベクトルに近い領域では、評価関数が不安定となる。このような事態に対応するため、領域内の輝度勾配強度の平均又は和が一定の閾値以下である矩形領域は、評価対象から排除するとよい。さらに、領域内の輝度勾配強度の平均又は和が小さいと評価関数の値が増大する補正項を加えることによって、より適切な着目部分領域を推定してもよい。

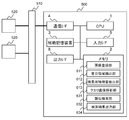

図6は、第1実施例の画像評価システムの物理的な構成を示すブロック図である。

本実施形態の画像評価システムは、プロセッサ(CPU)1、メモリ2、補助記憶装置3、通信インターフェース4、入力インターフェース5及び出力インターフェース8を有する計算機によって構成される。

プロセッサ1は、メモリ2に格納されたプログラムを実行する。メモリ2は、不揮発性の記憶素子であるROM及び揮発性の記憶素子であるRAMを含む。ROMは、不変のプログラム(例えば、BIOS)などを格納する。RAMは、DRAM(Dynamic Random Access Memory)のような高速かつ揮発性の記憶素子であり、プロセッサ1が実行するプログラム及びプログラムの実行時に使用されるデータを一時的に格納する。

補助記憶装置3は、例えば、磁気記憶装置(HDD)、フラッシュメモリ(SSD)等の大容量かつ不揮発性の記憶装置である。また、補助記憶装置3は、プロセッサ1が実行するプログラムを格納する。すなわち、プログラムは、補助記憶装置3から読み出されて、メモリ2にロードされて、プロセッサ1によって実行される。

通信インターフェース4は、所定のプロトコルに従って、他の装置(ファイルサーバやゲートウェイなど)との通信を制御するネットワークインターフェース装置である。

入力インターフェース5は、キーボード6やマウス7などが接続され、オペレータからの入力を受けるインターフェースである。出力インターフェース8は、ディスプレイ装置9やプリンタなどが接続され、プログラムの実行結果をオペレータが視認可能な形式で出力するインターフェースである。

プロセッサ1が実行するプログラムは、リムーバブルメディア(CD-ROM、フラッシュメモリなど)又はネットワークを介して画像評価システムに提供され、非一時的記憶媒体である不揮発性の補助記憶装置3に格納される。このため、画像評価システムは、リムーバブルメディアからデータを読み込むインターフェースを有するとよい。

画像評価システムは、物理的に一つの計算機上で、又は、論理的又は物理的に構成された複数の計算機上で構成される計算機システムであり、同一の計算機上で別個のスレッドで動作してもよく、複数の物理的計算機資源上に構築された仮想計算機上で動作してもよい。

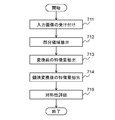

図7は、第1実施例の対称性評価処理のフローチャートである。

まず、プロセッサ1は、評価される画像の入力を受領する(711)。例えば、入力画像は、通信インターフェース4から入力されたり、図示を省略するデータ入出力ポート(例えば、USBポート)から、オペレータの指示に従って入力されるとよい。

その後、入力された画像から部分領域を抽出し(712)、抽出した部分領域の変換前の特徴量を抽出する(713)。その後、抽出した部分領域を鏡像変換し、鏡映変換後の特徴量を抽出する(714)。

その後、鏡像変換前の特徴量と、鏡映変換後の特徴量とを比較し、対称性を評価する(715)。

以上に説明したように、本発明の第1実施例によると、対象となる事物を事前に想定することなく、着目するべき部分領域を検出することができる。

<実施例2>

次に、第2実施例として、第1実施例の方法を画像検索サービスに適用したシステムについて説明する。

次に、第2実施例として、第1実施例の方法を画像検索サービスに適用したシステムについて説明する。

図8は、第2実施例の画像検索システムの構成を示す図である。

計算機システム500は、検索サービスを提供する。検索サービスが提供する各種機能は、ネットワークシステム510を経由して、端末計算機520を用いるユーザに提供される。

計算機システム500は、プロセッサ、メモリ及び通信インターフェースを有する一般的なサーバ装置によって構成することができる。計算機システム500の物理的な構成は、図6に示す計算機と同じでよい。

計算機システム500のメモリ2には、後述する画像登録部611、着目領域抽出部612、検索用特徴量抽出部613、クエリ画像解析部631、類似検索部632及び検索結果出力部634を実現するためのプログラムが格納される。

端末計算機520は、プロセッサ、メモリ及び通信インターフェースを有する一般的なパーソナルコンピュータやタブレット端末によって構成することができる。端末計算機520の物理的な構成は、図6に示す計算機と同じでよい。端末計算機520がユーザに提供する機能は、webブラウザで構成しても、専用アプリケーションで構成してもよい。

図9は、第2実施例の画像検索システムの論理的な構成を示す図である。

画像登録部611は、検索対象となる登録画像610を受領すると、画像データの保存先、表示用サムネール画像、及び画像に付随する各種書誌情報などをデータベース620に保存する。次に、着目領域抽出部612は、第1実施例の方法を適用して、登録画像から着目すべき矩形部分領域の集合を抽出する。その後、検索用特徴量抽出部613は、抽出された各矩形部分領域の画像特徴量を抽出する。抽出された画像特徴量は、登録画像と対応付けられてデータベース620に保存される。

検索時には、クエリ画像解析部631は、クエリ画像630が与えられると、検索用の画像特徴量を抽出する。その後、類似検索部632は、クエリ画像から抽出された画像特徴量と、データベース620に保存された矩形部分領域の画像特徴量との間で、ベクトル間距離に基づく類似検索処理を行い、クエリ画像と類似した矩形部分領域を検索結果として取得する。最後に、検索結果出力部634は、類似検索の結果、及びデータベース620に格納された各種情報を用いて、検索要求元に返信すべき情報を生成し、検索結果640として検索要求元に送信する。

検索用特徴量抽出部613及びクエリ画像解析部631が用いる画像特徴量は、色分布、輝度勾配ベクトルの分布などに基づいて算出する。具体的な画像特徴量は公知のものを用いることができる。また、これらの特徴量を用いた類似検索処理も公知のものを用いることができる。

次に、本実施例の方法が直接的に適用されている着目領域抽出部612の処理の詳細について説明する。

本発明の実施例のシステムの実装例として、図8及び図9に示す画像検索システムの他、例えば、画像登録部611、着目領域抽出部612及び検索用特徴量抽出部613を含み、オブジェクトを検出する画像解析装置650がある。

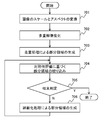

図10は、着目領域抽出部612による処理のフローチャートである。

まず、登録画像610から、適切なスケールおよびアスペクトに変換した複数個の画像を生成する(701)。このアスペクト(画像の縦横比)は、ユーザが設定すればよい。また、探したい画像のアスペクトによって、アスペクト比を自動的に設定してもよい。さらに、探したい画像の種類によって、アスペクト比を自動的に設定してもよい。例えば、人の画像を探したい場合、縦長の画像を用いるとよい。

さらに、生成した複数個の画像を多重解像度化する(702)。その後、後述する走査処理によって、多重解像度化した複数個の画像から着目部分領域の候補となる矩形部分領域を生成し、生成された各部分領域の対称性を算出する(703)。このステップ703の処理は、前述した第1実施例の対称性評価処理(図7)である。

その後、走査処理によって生成される多数個の部分領域を、対称性の評価値に基づいてソートし、上位の一定の件数の部分領域を、着目すべき部分領域の候補として保持する(704)。次に、収束判定処理(705)によって着目すべく部分領域の絞り込みが完了したと判定する。具体的には、着目領域が変動しない場合、又は、繰り返し回数が所定回数を越えた場合に収束したと判定する。

その後、着目すべく部分領域の絞り込みが完了したと判定された後、後述する詳細化処理によって、その時点の着目領域候補から新たに部分領域を生成し、各部分領域の対称性を算出して、着目領域候補を追加する(706)。そして、ステップ704に戻り、再び対称性を評価することによって、詳細化処理によって生成された着目領域候補を絞り込む。

図11は、着目領域抽出部処理(図10)のステップ701~703を説明する図である。

着目領域の抽出では、応用分野に応じて、画像中の部分領域の大きさを適切に見積もる必要がある。特に、必要以上に小さな領域を部分領域に設定すると、不必要な部分領域の抽出、すなわち、誤検出及び処理時間が増大し、運用上の問題の原因となる。例えば、本方式の対称性評価における1ブロックの大きさを8×8画素とすれば、部分領域の大きさは24×24画素となる。仮に、着目するべき部分領域が、画像の大きさの10%程度までで十分とすれば、画像の大きさは、240×240画素程度で十分となる。

また、着目部分領域の形状は、必ずしも、正方形ではなく、横長又は縦長の矩形領域の抽出が必要な場合も多い。本実施例では、横長の矩形を抽出する必要がある場合は、元画像のアスペクトを縦長に変形して、正方格子状のブロック分割により対称性を評価する。このような処理によって生成された矩形領域を元の画像の座標系に戻せば、横長の矩形となる。同様に、縦長の矩形を抽出する必要がある場合は、元画像のアスペクトを横長に変形して処理を行う。

前述の二つの観点から行われる処理が図11の登録画像801から画像802への変換である。

登録画像801から、適切なスケールに変換して、幅を半分に縮小した画像、アスペクト比を保持した画像、及び高さを半分に縮小した画像の、三つの画像802を生成する。さらに、多重解像度処理で、各画像を1/2ずつ2段階まで縮小した画像803を生成する。このようにして生成された九つの画像803に対して走査処理を行う(810)。走査処理810では、各画像内の窓を一定画素数ずつ平行に移動することによって、矩形領域を粗く生成する。

図12は、着目領域抽出部処理(図10)の詳細化処理(ステップ706)を説明する図である。

ある着目部分領域の候補に対して、微小に縦横に平行移動した矩形領域910、微小に拡大縮小を行った矩形領域920、及び、拡大縮小された矩形領域を更に縦横に平行移動した矩形領域を、新たな着目部分領域の候補として生成する。平行移動によって生成される矩形領域の数は、上下、左右及び斜めの移動で8パターンある。拡大縮小で生成される矩形領域は2パターンで、拡大及び縮小の矩形領域の平行移動で、拡大及び縮小のそれぞれについて8パターンの矩形領域が生成される。合わせて、一つの種となる矩形領域に対して、最大で26パターンの新たな矩形領域が生成され、その対称性が評価される。

前述したように、詳細化処理706は繰り返し実行される。各繰り返し処理における各微小変動量は、次式によって定義することができる。

数式(20)において、qは詳細化処理の繰り返しの回数、sx及びsyは走査処理703において平行移動を行った際の横方向及び縦方向それぞれのステップ幅、dx及びdyはq回目の詳細化処理における横方向及び縦方向それぞれの変動量である。一方、dzはq回目の詳細化処理での拡大率であり、縮小する場合の縮小率は1/dzである。数式(20)から明らかなように、変動の大きさは、本処理の繰り返しの回数に応じて小さくなる。対象となる画像は離散的なデジタル画像であるから、本処理を十分に多い回数繰り返せば、微小変動によって新たな領域候補が生成されなくなる。少なくとも、新たな領域候補が生成されなくなれば、詳細化処理706は終了してもよい。

以上に説明したように、本発明の実施例によると、対象物によらず着目すべき部分領域を的確に検出することができる。

また、部分領域から抽出した特徴量と、特徴量を鏡映変換した後の鏡映特徴量と、特徴量の平均強度とを用いて部分領域の対称性を評価するので、部分領域を高精度で検出することができる。

また、部分領域を所定の大きさの矩形のブロックに分割し、各ブロックから特徴量を抽出して、各ブロックの特徴量を鏡映変換するので、簡単な演算で鏡映特徴量を計算することができる。

また、部分領域の位置及び大きさの少なくとも一方を変更した領域を生成し、部分領域の特徴量及び前記生成された領域の特徴量の対称性を評価するので、着目すべき部分が見切れることがない適切な部分領域を抽出することができる。このため、例えば、人の顔が見切れることがなく、部分領域の中心に顔があった方がよい顔認証への応用が容易になる。

また、入力された画像の種類によって特徴量として抽出される輝度勾配ベクトルの方向を分布させる範囲を変えるので、的確に特徴量を計算できる。

また、入力された画像を所定の縦横比に変換し、縦横比を変換された画像から部分領域を抽出するので、抽出される特徴量(輝度勾配ベクトル)の異方性がなくなり、正確に特徴量を計算できる。すなわち、長方形の部分領域を用いると輝度ベクトルのヒストグラムの偏りが生じることがあり、対称性を評価するためには部分領域は正方形が望ましい。

なお、本発明は前述した実施例に限定されるものではなく、添付した特許請求の範囲の趣旨内における様々な変形例及び同等の構成が含まれる。例えば、前述した実施例は本発明を分かりやすく説明するために詳細に説明したものであり、必ずしも説明した全ての構成を備えるものに本発明は限定されない。また、ある実施例の構成の一部を他の実施例の構成に置き換えてもよい。また、ある実施例の構成に他の実施例の構成を加えてもよい。また、各実施例の構成の一部について、他の構成の追加・削除・置換をしてもよい。

また、前述した各構成、機能、処理部、処理手段等は、それらの一部又は全部を、例えば集積回路で設計する等により、ハードウェアで実現してもよく、プロセッサがそれぞれの機能を実現するプログラムを解釈し実行することにより、ソフトウェアで実現してもよい。

各機能を実現するプログラム、テーブル、ファイル等の情報は、メモリ、ハードディスク、SSD(Solid State Drive)等の記憶装置、又は、ICカード、SDカード、DVD等の記録媒体に格納することができる。

また、制御線や情報線は説明上必要と考えられるものを示しており、実装上必要な全ての制御線や情報線を示しているとは限らない。実際には、ほとんど全ての構成が相互に接続されていると考えてよい。

Claims (7)

- プロセッサ及びメモリを有する計算機によって構成される画像解析装置が実行するオブジェクト検出方法であって、

前記プロセッサが、画像の入力を受け、前記メモリに格納する第1ステップと、

前記プロセッサが、前記入力された画像から、その一部である部分領域を抽出して、前記メモリに格納する第2ステップと、

前記プロセッサが、前記部分領域から抽出した特徴量と、前記特徴量を鏡映変換した後の鏡映特徴量とを用いて、前記部分領域の対称性を評価する第3ステップと、

前記プロセッサが、所定の閾値より前記対称性が高いと評価された部分領域を、検出対象が写っているオブジェクト領域であると判定する第4ステップと、を有するオブジェクト検出方法。 - 請求項1に記載のオブジェクト検出方法であって、

前記第3ステップでは、前記部分領域から抽出した特徴量と、前記特徴量を鏡映変換した後の鏡映特徴量と、前記特徴量の平均強度とを用いて前記部分領域の対称性を評価するオブジェクト検出方法。 - 請求項1に記載のオブジェクト検出方法であって、

前記第3ステップでは、前記部分領域を所定の大きさの矩形のブロックに分割し、前記各ブロックから特徴量を抽出するオブジェクト検出方法。 - 請求項1に記載のオブジェクト検出方法であって、

前記第3ステップでは、前記部分領域の位置及び大きさの少なくとも一方を変更した領域を生成し、前記部分領域の特徴量の対称性及び前記生成された領域の特徴量の対称性を評価し、所定の閾値より前記対称性が高いと評価された領域を、検出対象が写っているオブジェクト領域であると判定するオブジェクト検出方法。 - 請求項1に記載のオブジェクト検出方法であって、

前記第3ステップでは、

前記入力された画像が2値画像である場合、前記特徴量として抽出される輝度勾配ベクトルの方向を0度から180度の範囲に分布させて処理し、

それ以外の場合、前記特徴量として抽出される輝度勾配ベクトルの方向を0度から360度の範囲に分布させて処理するオブジェクト検出方法。 - 請求項1に記載のオブジェクト検出方法であって、

前記第2ステップでは、前記入力された画像を所定の縦横比に変換し、前記縦横比を変換された画像から部分領域を抽出するオブジェクト検出方法。 - 登録画像を検索する画像検索システムであって、

入力された登録画像について請求項1から6のいずれか一つに記載の方法によって判定されたオブジェクト領域の特徴量をデータベースに格納し、

入力されたクエリ画像から抽出された特徴量と、前記登録画像の特徴量とを比較することによって、前記クエリ画像と類似する登録画像を検索する画像検索システム。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US15/552,823 US10373014B2 (en) | 2015-04-20 | 2016-04-05 | Object detection method and image search system |

| SG11201707973UA SG11201707973UA (en) | 2015-04-20 | 2016-04-05 | Object detection method and image search system |

| CN201680009223.1A CN107209942B (zh) | 2015-04-20 | 2016-04-05 | 对象检测方法和图像检索系统 |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015-085964 | 2015-04-20 | ||

| JP2015085964A JP6393230B2 (ja) | 2015-04-20 | 2015-04-20 | オブジェクト検出方法及び画像検索システム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2016170965A1 true WO2016170965A1 (ja) | 2016-10-27 |

Family

ID=57143686

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2016/061104 WO2016170965A1 (ja) | 2015-04-20 | 2016-04-05 | オブジェクト検出方法及び画像検索システム |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US10373014B2 (ja) |

| JP (1) | JP6393230B2 (ja) |

| CN (1) | CN107209942B (ja) |

| SG (1) | SG11201707973UA (ja) |

| WO (1) | WO2016170965A1 (ja) |

Families Citing this family (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20170017572A (ko) * | 2015-08-07 | 2017-02-15 | 삼성전자주식회사 | 사용자 단말 장치 및 이의 제어 방법 |

| JP6924413B2 (ja) * | 2017-12-25 | 2021-08-25 | オムロン株式会社 | データ生成装置、データ生成方法及びデータ生成プログラム |

| CN109308325B (zh) * | 2018-08-21 | 2022-07-01 | 董志忠 | 图像搜索方法及系统 |

| KR102528453B1 (ko) | 2018-10-18 | 2023-05-02 | 삼성전자주식회사 | 영상 내의 특징 추출 방법, 이를 이용하는 영상 매칭 방법 및 영상 처리 방법 |

| JP6755346B2 (ja) * | 2019-02-05 | 2020-09-16 | 株式会社日立製作所 | 分析システム |

| CN112767723B (zh) * | 2019-11-05 | 2022-04-22 | 深圳市大富科技股份有限公司 | 路况检测方法、计算机存储设备、车载终端和车辆 |

| CN117616447A (zh) | 2021-07-09 | 2024-02-27 | 三星电子株式会社 | 电子装置和电子装置的操作方法 |

| KR20230009713A (ko) * | 2021-07-09 | 2023-01-17 | 삼성전자주식회사 | 전자 장치 및 전자 장치의 동작 방법 |

| CN113763211A (zh) * | 2021-09-23 | 2021-12-07 | 支付宝(杭州)信息技术有限公司 | 基于区块链的侵权检测方法及装置和电子设备 |

Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2010272092A (ja) * | 2009-05-25 | 2010-12-02 | Canon Inc | 画像検索装置およびその方法 |

| JP2012203691A (ja) * | 2011-03-25 | 2012-10-22 | Toshiba Corp | 画像識別装置及び画像識別方法 |

| JP2012243155A (ja) * | 2011-05-20 | 2012-12-10 | Toyota Central R&D Labs Inc | 画像識別装置及びプログラム |

| JP2013186902A (ja) * | 2012-03-07 | 2013-09-19 | Ricoh Co Ltd | 車輌検知方法及び装置 |

| JP2013228901A (ja) * | 2012-04-26 | 2013-11-07 | Mega Chips Corp | 物体検出装置およびプログラム |

| JP2013250868A (ja) * | 2012-06-01 | 2013-12-12 | Honda Elesys Co Ltd | 画像認識装置、画像認識方法および画像認識プログラム |

Family Cites Families (16)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP3718967B2 (ja) * | 1997-08-22 | 2005-11-24 | コニカミノルタビジネステクノロジーズ株式会社 | 画像特徴量抽出装置および方法並びに画像特徴量抽出プログラムを記録した記録媒体 |

| JP2000123173A (ja) | 1998-10-14 | 2000-04-28 | Ntt Data Corp | 画像特徴抽出方法及び類似画像検索システム、記録媒体 |

| US6539099B1 (en) * | 1999-08-30 | 2003-03-25 | Electric Planet | System and method for visual chat |

| GB0125774D0 (en) * | 2001-10-26 | 2001-12-19 | Cableform Ltd | Method and apparatus for image matching |

| US6735745B2 (en) * | 2002-02-07 | 2004-05-11 | Applied Materials, Inc. | Method and system for detecting defects |

| JP2004361987A (ja) * | 2003-05-30 | 2004-12-24 | Seiko Epson Corp | 画像検索システム、画像分類システム、画像検索プログラム及び画像分類プログラム、並びに画像検索方法及び画像分類方法 |

| JP2007013514A (ja) * | 2005-06-30 | 2007-01-18 | Taiji Kajikawa | 720°全方位矩形画像モニタリングシステム |

| US7580563B1 (en) * | 2005-09-02 | 2009-08-25 | Adobe Systems Incorporated | Detection of objects in an image using color analysis |

| JP5137339B2 (ja) | 2006-06-12 | 2013-02-06 | 株式会社日立製作所 | クラスタリングされたベクトルデータを検索するサーバ、システム及び方法 |

| JP4362538B2 (ja) * | 2007-06-06 | 2009-11-11 | シャープ株式会社 | 画像処理装置、画像形成装置、画像送信装置、画像読取装置、画像処理システム、画像処理方法、画像処理プログラムおよびその記録媒体 |

| JP4510069B2 (ja) * | 2007-12-10 | 2010-07-21 | シャープ株式会社 | 画像処理装置、画像表示装置、画像形成装置、画像処理方法、コンピュータプログラム及び記憶媒体 |

| KR100896065B1 (ko) * | 2007-12-17 | 2009-05-07 | 한국전자통신연구원 | 3차원 얼굴 표정 애니메이션 생성 방법 |

| US8170341B2 (en) * | 2009-01-23 | 2012-05-01 | Nec Corporation | Image signature extraction device |

| JP4976578B1 (ja) * | 2011-09-16 | 2012-07-18 | 楽天株式会社 | 画像検索装置およびプログラム |

| JP6008367B2 (ja) * | 2012-03-28 | 2016-10-19 | 株式会社メガチップス | 物体検出装置およびプログラム |

| EP2827298A1 (en) * | 2013-07-16 | 2015-01-21 | Universitätsklinikum Jena | Method and computer program for filtering and particularly segmenting and/or analyzing anatomic structures in a digital image |

-

2015

- 2015-04-20 JP JP2015085964A patent/JP6393230B2/ja active Active

-

2016

- 2016-04-05 WO PCT/JP2016/061104 patent/WO2016170965A1/ja active Application Filing

- 2016-04-05 CN CN201680009223.1A patent/CN107209942B/zh active Active

- 2016-04-05 US US15/552,823 patent/US10373014B2/en active Active

- 2016-04-05 SG SG11201707973UA patent/SG11201707973UA/en unknown

Patent Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2010272092A (ja) * | 2009-05-25 | 2010-12-02 | Canon Inc | 画像検索装置およびその方法 |

| JP2012203691A (ja) * | 2011-03-25 | 2012-10-22 | Toshiba Corp | 画像識別装置及び画像識別方法 |

| JP2012243155A (ja) * | 2011-05-20 | 2012-12-10 | Toyota Central R&D Labs Inc | 画像識別装置及びプログラム |

| JP2013186902A (ja) * | 2012-03-07 | 2013-09-19 | Ricoh Co Ltd | 車輌検知方法及び装置 |

| JP2013228901A (ja) * | 2012-04-26 | 2013-11-07 | Mega Chips Corp | 物体検出装置およびプログラム |

| JP2013250868A (ja) * | 2012-06-01 | 2013-12-12 | Honda Elesys Co Ltd | 画像認識装置、画像認識方法および画像認識プログラム |

Non-Patent Citations (2)

| Title |

|---|

| AKIHIKO SAWADA ET AL.: "Detection of Faces Features by using Symmetry Transform", IEICE TECHNICAL REPORT, vol. 98, no. 576, 3 February 1999 (1999-02-03), pages 31 - 36 * |

| YUSUKE SANO ET AL.: "An Expansionist SIFT and Application to Symmetrical Plane Object Detection", THE TRANSACTIONS OF THE INSTITUTE OF ELECTRONICS, INFORMATION AND COMMUNICATION ENGINEERS, vol. J92-D, no. 8, 1 August 2009 (2009-08-01), pages 1176 - 1185 * |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2016206837A (ja) | 2016-12-08 |

| US20180032837A1 (en) | 2018-02-01 |

| SG11201707973UA (en) | 2017-11-29 |

| CN107209942A (zh) | 2017-09-26 |

| US10373014B2 (en) | 2019-08-06 |

| CN107209942B (zh) | 2020-11-24 |

| JP6393230B2 (ja) | 2018-09-19 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6393230B2 (ja) | オブジェクト検出方法及び画像検索システム | |

| Seeland et al. | Plant species classification using flower images—A comparative study of local feature representations | |

| Jaberi et al. | Accurate and robust localization of duplicated region in copy–move image forgery | |

| Tokuda et al. | Computer generated images vs. digital photographs: A synergetic feature and classifier combination approach | |

| US7653244B2 (en) | Intelligent importation of information from foreign applications user interface | |

| US8406535B2 (en) | Invariant visual scene and object recognition | |

| US8687886B2 (en) | Method and apparatus for document image indexing and retrieval using multi-level document image structure and local features | |

| Cristin et al. | Illumination‐based texture descriptor and fruitfly support vector neural network for image forgery detection in face images | |

| Kishorjit Singh et al. | Image classification using SLIC superpixel and FAAGKFCM image segmentation | |

| Carvalho et al. | Analysis of object description methods in a video object tracking environment | |

| Jiang et al. | Flexible sliding windows with adaptive pixel strides | |

| Ghandour et al. | Building shadow detection based on multi-thresholding segmentation | |

| Chae et al. | An efficient face detection based on color-filtering and its application to smart devices | |

| Chennupati | A structured approach to JPEG tampering detection using enhanced fusion algorithm | |

| Evangelou et al. | PU learning-based recognition of structural elements in architectural floor plans | |

| JP6336827B2 (ja) | 画像検索装置、画像検索方法および検索システム | |

| CN111832626B (zh) | 图像识别分类方法、装置及计算机可读存储介质 | |

| CN113298087B (zh) | 图片分类模型冷启动的方法、系统、装置及介质 | |

| Zhang et al. | From pixels to region: a salient region detection algorithm for location-quantification image | |

| Khryashchev et al. | Improving audience analysis system using face image quality assessment | |

| ur Rhhman et al. | Comparative Analysis of Various Image Splicing Algorithms | |

| Goswami et al. | Hybrid region and edge based unsupervised color-texture segmentation for natural images | |

| Zhang et al. | Real-time quadrilateral object corner detection algorithm based on deep learning | |

| Khryashchev et al. | Development of Face Image Quality Assessment Algorithms for Biometric Identification Tasks | |

| Archana et al. | Image forgery detection in forensic science using optimization based deep learning models |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| 121 | Ep: the epo has been informed by wipo that ep was designated in this application |

Ref document number: 16782986 Country of ref document: EP Kind code of ref document: A1 |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 11201707973U Country of ref document: SG |

|

| NENP | Non-entry into the national phase |

Ref country code: DE |

|

| 122 | Ep: pct application non-entry in european phase |

Ref document number: 16782986 Country of ref document: EP Kind code of ref document: A1 |