WO2010101064A1 - 画像処理装置および方法 - Google Patents

画像処理装置および方法 Download PDFInfo

- Publication number

- WO2010101064A1 WO2010101064A1 PCT/JP2010/052925 JP2010052925W WO2010101064A1 WO 2010101064 A1 WO2010101064 A1 WO 2010101064A1 JP 2010052925 W JP2010052925 W JP 2010052925W WO 2010101064 A1 WO2010101064 A1 WO 2010101064A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- motion vector

- accuracy

- vector information

- unit

- image

- Prior art date

Links

- 238000000034 method Methods 0.000 title abstract description 116

- 230000033001 locomotion Effects 0.000 claims abstract description 681

- 239000013598 vector Substances 0.000 claims abstract description 530

- 238000003672 processing method Methods 0.000 claims description 4

- 238000007906 compression Methods 0.000 abstract description 18

- 230000006835 compression Effects 0.000 abstract description 17

- 230000006872 improvement Effects 0.000 abstract description 3

- 230000002441 reversible effect Effects 0.000 abstract 1

- 230000008569 process Effects 0.000 description 70

- 238000006243 chemical reaction Methods 0.000 description 44

- 230000006870 function Effects 0.000 description 42

- 239000000872 buffer Substances 0.000 description 40

- 238000004364 calculation method Methods 0.000 description 33

- 238000013139 quantization Methods 0.000 description 28

- 238000009825 accumulation Methods 0.000 description 22

- 230000001413 cellular effect Effects 0.000 description 22

- 230000008707 rearrangement Effects 0.000 description 21

- 230000005540 biological transmission Effects 0.000 description 19

- 230000000875 corresponding effect Effects 0.000 description 19

- 238000010586 diagram Methods 0.000 description 19

- 238000004891 communication Methods 0.000 description 17

- 230000005236 sound signal Effects 0.000 description 15

- 230000015572 biosynthetic process Effects 0.000 description 9

- 239000012536 storage buffer Substances 0.000 description 9

- 238000003786 synthesis reaction Methods 0.000 description 9

- 238000005192 partition Methods 0.000 description 8

- 230000009466 transformation Effects 0.000 description 8

- 230000003321 amplification Effects 0.000 description 7

- 239000004973 liquid crystal related substance Substances 0.000 description 7

- 238000003199 nucleic acid amplification method Methods 0.000 description 7

- 230000003287 optical effect Effects 0.000 description 7

- 230000002123 temporal effect Effects 0.000 description 7

- 238000001228 spectrum Methods 0.000 description 6

- 239000004065 semiconductor Substances 0.000 description 4

- 238000003384 imaging method Methods 0.000 description 3

- 230000002194 synthesizing effect Effects 0.000 description 3

- 230000002596 correlated effect Effects 0.000 description 2

- 239000000284 extract Substances 0.000 description 2

- 238000004519 manufacturing process Methods 0.000 description 2

- 230000004044 response Effects 0.000 description 2

- 229930091051 Arenine Natural products 0.000 description 1

- 101000969688 Homo sapiens Macrophage-expressed gene 1 protein Proteins 0.000 description 1

- 102100021285 Macrophage-expressed gene 1 protein Human genes 0.000 description 1

- 230000000295 complement effect Effects 0.000 description 1

- 238000004590 computer program Methods 0.000 description 1

- 238000006073 displacement reaction Methods 0.000 description 1

- 230000000694 effects Effects 0.000 description 1

- 229910044991 metal oxide Inorganic materials 0.000 description 1

- 150000004706 metal oxides Chemical class 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 230000000750 progressive effect Effects 0.000 description 1

- 239000007787 solid Substances 0.000 description 1

- 230000001360 synchronised effect Effects 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/567—Motion estimation based on rate distortion criteria

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/107—Selection of coding mode or of prediction mode between spatial and temporal predictive coding, e.g. picture refresh

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/46—Embedding additional information in the video signal during the compression process

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/513—Processing of motion vectors

- H04N19/517—Processing of motion vectors by encoding

- H04N19/52—Processing of motion vectors by encoding by predictive encoding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/523—Motion estimation or motion compensation with sub-pixel accuracy

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/60—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding

- H04N19/61—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding in combination with predictive coding

Definitions

- the present invention relates to an image processing apparatus and method, and more particularly, to an image processing apparatus and method that suppresses an increase in compression information and improves prediction accuracy.

- MPEG2 (ISO / IEC 13818-2) is defined as a general-purpose image encoding system, and is a standard that covers both interlaced scanning images and progressive scanning images, as well as standard resolution images and high-definition images.

- MPEG2 is currently widely used in a wide range of applications for professional and consumer applications.

- a code amount (bit rate) of 4 to 8 Mbps is assigned to an interlaced scanned image having a standard resolution of 720 ⁇ 480 pixels.

- a high resolution interlaced scanned image having 1920 ⁇ 1088 pixels is assigned a code amount (bit rate) of 18 to 22 Mbps.

- bit rate code amount

- MPEG2 was mainly intended for high-quality encoding suitable for broadcasting, but it did not support encoding methods with a lower code amount (bit rate) than MPEG1, that is, a higher compression rate. With the widespread use of mobile terminals, the need for such an encoding system is expected to increase in the future, and the MPEG4 encoding system has been standardized accordingly. Regarding the image coding system, the standard was approved as an international standard in December 1998 as ISO / IEC 14496-2.

- H. The standardization of 26L (ITU-T Q6 / 16 ⁇ VCEG) is in progress.

- H. 26L is known to achieve higher encoding efficiency than the conventional encoding schemes such as MPEG2 and MPEG4, although a large amount of calculation is required for encoding and decoding.

- this H. Based on 26L, H. Standardization to achieve higher coding efficiency by incorporating functions that are not supported by 26L is performed as JointJModel of Enhanced-Compression Video Coding.

- H. H.264 and MPEG-4 Part 10 Advanced Video Coding, hereinafter referred to as H.264 / AVC).

- motion prediction / compensation processing is performed in units of 16 ⁇ 16 pixels.

- motion prediction / compensation processing is performed for each of the first field and the second field in units of 16 ⁇ 8 pixels.

- H. In the H.264 / AVC format motion prediction / compensation can be performed by changing the block size. That is, H. In the H.264 / AVC format, one macro block composed of 16 ⁇ 16 pixels is divided into any of 16 ⁇ 16, 16 ⁇ 8, 8 ⁇ 16, or 8 ⁇ 8 partitions, which are independent of each other. It is possible to have motion vector information.

- An 8 ⁇ 8 partition can be divided into 8 ⁇ 8, 8 ⁇ 4, 4 ⁇ 8, or 4 ⁇ 4 subpartitions and have independent motion vector information.

- Non-Patent Document 1 proposes motion prediction with 1/8 pixel accuracy.

- Non-Patent Document 1 the interpolation process with 1/2 pixel accuracy is performed by the filter [ ⁇ 3,12, ⁇ 39,158,158, ⁇ 39,12, ⁇ 3] / 256.

- the interpolation processing with 1/4 pixel accuracy is performed by the filter [-3,12, -37,229,71, -21,6, -1] / 256, and the interpolation processing with 1/8 pixel accuracy is performed by linear interpolation. Is called.

- motion vector information in the compressed image information transmitted to the decoding side In integer pixel accuracy, motion vector information with a value of “1” has a processing value of “4” in the compressed image information when motion prediction with 1/4 pixel accuracy is performed. When performing accurate motion prediction, the processing value in the compressed image information is “8”.

- the present invention has been made in view of such a situation, and suppresses an increase in compression information and improves prediction accuracy.

- the image processing apparatus includes an accuracy flag indicating whether the accuracy of motion vector information of a target block is the same as or different from the accuracy of motion vector information of an adjacent block adjacent to the target block.

- the motion vector information of the adjacent block Predictive motion vector generation means for performing median prediction by converting accuracy into the precision of motion vector information of the target block and generating predicted motion vector information, and the encoding means includes motion vector information of the target block As described above, the difference between the motion vector information of the target block and the predicted motion vector information can be encoded.

- the accuracy flag generating means and the predicted motion vector generating means can use a block adjacent to the left part of the target block as the adjacent block.

- the accuracy flag generating unit and the predicted motion vector generating unit can use, as the adjacent block, a block that is adjacent to the target block and has been subjected to encoding processing immediately before.

- the accuracy flag generating means and the predicted motion vector generating means can use, as the adjacent blocks, blocks adjacent to the target block and giving motion vector information selected by median prediction.

- the image processing apparatus is configured such that the accuracy of motion vector information of a target block is the same as or different from the accuracy of motion vector information of an adjacent block adjacent to the target block. And a step of encoding the motion vector information of the target block and the generated accuracy flag.

- the image processing apparatus provides encoded motion vector information of a target block, accuracy of motion vector information of the target block, and accuracy of motion vector information of an adjacent block adjacent to the target block. And reconstructing motion vector information of the target block decoded by the decoding means, using a decoding means for decoding the accuracy flag indicating whether or not are the same or different, and the accuracy flag decoded by the decoding means A motion vector reconstructing unit that performs prediction using the motion vector information of the target block reconstructed by the motion vector reconstructing unit.

- the accuracy of the motion vector information of the adjacent block is , Further comprising predicted motion vector generation means for performing median prediction in terms of the accuracy of motion vector information of the target block and generating predicted motion vector information, wherein the motion vector reconstructing means is decoded by the decoding means

- the motion vector information of the target block decoded by the decoding unit can be reconstructed using the accuracy flag and the predicted motion vector information generated by the predicted motion vector generation unit.

- the motion vector reconstruction unit and the predicted motion vector generation unit may use a block adjacent to the left part of the target block as the adjacent block.

- the motion vector reconstruction unit and the predicted motion vector generation unit may use a block that is adjacent to the target block and has been subjected to encoding processing immediately before as the adjacent block.

- the motion vector reconstruction unit and the predicted motion vector generation unit may use a block that is adjacent to the target block and that provides motion vector information selected by median prediction as the adjacent block.

- the image processing apparatus is configured such that the encoded motion vector information of the target block, the accuracy of the motion vector information of the target block, and the adjacent block adjacent to the target block.

- the accuracy flag indicating whether the accuracy of the motion vector information is the same or different is decoded, and using the decoded accuracy flag, the motion vector information of the decoded target block is reconstructed and reconstructed Generating a predicted image of the target block using the motion vector information of the target block.

- an accuracy flag indicating whether the accuracy of the motion vector information of the target block is the same as or different from the accuracy of the motion vector information of the adjacent block adjacent to the target block is generated,

- the generated accuracy flag is encoded together with the motion vector information of the target block.

- the accuracy of the motion vector information of the encoded target block and the motion vector information of the target block is the same as the accuracy of the motion vector information of the adjacent block adjacent to the target block.

- the accuracy flag indicating whether or not is different is decoded. Then, the motion vector information of the decoded target block is reconstructed using the decoded accuracy flag, and a predicted image of the target block is generated using the reconstructed motion vector information of the target block Is done.

- each of the above-described image processing apparatuses may be an independent apparatus, or may be an internal block constituting one image encoding apparatus or image decoding apparatus.

- an image can be encoded. Moreover, according to the 1st side surface of this invention, while suppressing the increase in compression information, prediction accuracy can be improved.

- an image can be decoded. Moreover, according to the 2nd side surface of this invention, while suppressing the increase in compression information, prediction accuracy can be improved.

- FIG. 2 is a block diagram illustrating a configuration example of a motion prediction / compensation unit and a motion vector accuracy determination unit in FIG. 1. It is a flowchart explaining the encoding process of the image coding apparatus of FIG. It is a flowchart explaining the prediction process of step S21 of FIG.

- FIG. 14 is a block diagram illustrating a configuration example of a motion prediction / compensation unit and a motion vector accuracy determination unit in FIG. 13. It is a flowchart explaining the decoding process of the image decoding apparatus of FIG. It is a flowchart explaining the prediction process of step S138 of FIG. It is a figure which shows the example of the expanded block size.

- FIG. 1 shows a configuration of an embodiment of an image encoding apparatus as an image processing apparatus to which the present invention is applied.

- This image encoding device 51 is, for example, H.264. 264 and MPEG-4 Part10 (Advanced Video Coding) (hereinafter referred to as H.264 / AVC) format is used for compression coding.

- H.264 / AVC Advanced Video Coding

- the image encoding device 51 includes an A / D conversion unit 61, a screen rearrangement buffer 62, a calculation unit 63, an orthogonal transformation unit 64, a quantization unit 65, a lossless encoding unit 66, an accumulation buffer 67, Inverse quantization unit 68, inverse orthogonal transform unit 69, operation unit 70, deblock filter 71, frame memory 72, switch 73, intra prediction unit 74, motion prediction / compensation unit 75, motion vector accuracy determination unit 76, prediction image selection

- the unit 77 and the rate control unit 78 are configured.

- the A / D converter 61 A / D converts the input image, outputs it to the screen rearrangement buffer 62, and stores it.

- the screen rearrangement buffer 62 rearranges the stored frames in the display order in the order of frames for encoding in accordance with GOP (Group of Picture).

- the calculation unit 63 subtracts the prediction image from the intra prediction unit 74 selected by the prediction image selection unit 77 or the prediction image from the motion prediction / compensation unit 75 from the image read from the screen rearrangement buffer 62, The difference information is output to the orthogonal transform unit 64.

- the orthogonal transform unit 64 subjects the difference information from the calculation unit 63 to orthogonal transform such as discrete cosine transform and Karhunen-Loeve transform, and outputs the transform coefficient.

- the quantization unit 65 quantizes the transform coefficient output from the orthogonal transform unit 64.

- the quantized transform coefficient that is the output of the quantization unit 65 is input to the lossless encoding unit 66, where lossless encoding such as variable length encoding and arithmetic encoding is performed and compressed.

- the lossless encoding unit 66 acquires information indicating intra prediction from the intra prediction unit 74 and acquires information indicating inter prediction mode from the motion prediction / compensation unit 75. Note that the information indicating intra prediction and the information indicating inter prediction are also referred to as intra prediction mode information and inter prediction mode information, respectively.

- the lossless encoding unit 66 encodes the quantized transform coefficient, encodes information indicating intra prediction, information indicating inter prediction mode, and the like, and uses it as a part of header information in the compressed image.

- the lossless encoding unit 66 supplies the encoded data to the accumulation buffer 67 for accumulation.

- lossless encoding processing such as variable length encoding or arithmetic encoding is performed.

- variable length coding include H.264.

- CAVLC Context-Adaptive Variable Length Coding

- arithmetic coding include CABAC (Context-Adaptive Binary Arithmetic Coding).

- the accumulation buffer 67 converts the data supplied from the lossless encoding unit 66 to H.264. As a compressed image encoded by the H.264 / AVC format, for example, it is output to a recording device or a transmission path (not shown) in the subsequent stage.

- the quantized transform coefficient output from the quantization unit 65 is also input to the inverse quantization unit 68, and after inverse quantization, the inverse orthogonal transform unit 69 further performs inverse orthogonal transform.

- the output subjected to the inverse orthogonal transform is added to the predicted image supplied from the predicted image selection unit 77 by the calculation unit 70, and becomes a locally decoded image.

- the deblocking filter 71 removes block distortion from the decoded image, and then supplies the deblocking filter 71 to the frame memory 72 for accumulation.

- the image before the deblocking filter processing by the deblocking filter 71 is also supplied to the frame memory 72 and accumulated.

- the switch 73 outputs the reference image stored in the frame memory 72 to the motion prediction / compensation unit 75 or the intra prediction unit 74.

- an I picture, a B picture, and a P picture from the screen rearrangement buffer 62 are supplied to the intra prediction unit 74 as images to be intra predicted (also referred to as intra processing). Further, the B picture and the P picture read from the screen rearrangement buffer 62 are supplied to the motion prediction / compensation unit 75 as an image to be inter-predicted (also referred to as inter-processing).

- the intra prediction unit 74 performs intra prediction processing of all candidate intra prediction modes based on the image to be intra predicted read from the screen rearrangement buffer 62 and the reference image supplied from the frame memory 72, and performs prediction. Generate an image.

- the intra prediction unit 74 calculates cost function values for all candidate intra prediction modes, and selects an intra prediction mode in which the calculated cost function value gives the minimum value as the optimal intra prediction mode.

- the intra prediction unit 74 supplies the predicted image generated in the optimal intra prediction mode and its cost function value to the predicted image selection unit 77.

- the intra prediction unit 74 supplies information indicating the optimal intra prediction mode to the lossless encoding unit 66.

- the lossless encoding unit 66 encodes this information and uses it as a part of header information in the compressed image.

- the motion prediction / compensation unit 75 performs motion prediction / compensation processing for all candidate inter prediction modes.

- the inter prediction image read from the screen rearrangement buffer 62 and the reference image from the frame memory 72 are supplied to the motion prediction / compensation unit 75 via the switch 73.

- the motion prediction / compensation unit 75 detects motion vectors of all candidate inter prediction modes based on the inter-processed image and the reference image, performs compensation processing on the reference image based on the motion vector, and converts the predicted image into a predicted image. Generate.

- the motion prediction / compensation unit 75 is described later with reference to FIG.

- the motion prediction compensation processing with 1/8 pixel accuracy described in Non-Patent Document 1 is performed instead of the motion prediction compensation processing with 1/4 pixel accuracy defined in the H.264 / AVC format.

- the motion vector information of the target block obtained by the motion prediction / compensation unit 75 and the motion vector information of the adjacent block adjacent to the target block are supplied to the motion vector accuracy determination unit 76.

- the motion prediction / compensation unit 75 indicates from the motion vector accuracy determination unit 76 whether the accuracy of the motion vector information of the target block and the accuracy of the motion vector information of the adjacent block are the same or different. An accuracy flag is supplied.

- the motion prediction / compensation unit 75 calculates the predicted motion vector information of the target block using the motion vector information of the adjacent block, and obtains the obtained motion vector information and the generated predicted motion vector information, Is the motion vector information to be sent to the decoding side.

- the motion prediction / compensation unit 75 calculates cost function values for all candidate inter prediction modes.

- the motion prediction / compensation unit 75 determines a prediction mode that gives the minimum value among the calculated cost function values as the optimal inter prediction mode.

- the motion prediction / compensation unit 75 supplies the prediction image generated in the optimal inter prediction mode and its cost function value to the prediction image selection unit 77.

- the motion prediction / compensation unit 75 sends information indicating the optimal inter prediction mode (inter prediction mode information) to the lossless encoding unit 66. Output.

- the lossless encoding unit 66 performs lossless encoding processing such as variable length encoding and arithmetic encoding on the information from the motion prediction / compensation unit 75 and inserts the information into the header portion of the compressed image.

- the motion vector accuracy determination unit 76 is supplied with the motion vector information of the target block and the motion vector information of the adjacent block from the motion prediction / compensation unit 75.

- the motion vector accuracy determination unit 76 generates an accuracy flag indicating whether the accuracy of the motion vector information of the target block is the same as or different from the accuracy of the motion vector information of the adjacent block, and the generated accuracy flag is used as the motion prediction. Supply to the compensation unit 75.

- the predicted image selection unit 77 determines the optimal prediction mode from the optimal intra prediction mode and the optimal inter prediction mode based on each cost function value output from the intra prediction unit 74 or the motion prediction / compensation unit 75. Then, the predicted image selection unit 77 selects a predicted image in the determined optimal prediction mode and supplies the selected predicted image to the calculation units 63 and 70. At this time, the predicted image selection unit 77 supplies the selection information of the predicted image to the intra prediction unit 74 or the motion prediction / compensation unit 75.

- the rate control unit 78 controls the quantization operation rate of the quantization unit 65 based on the compressed image stored in the storage buffer 67 so that overflow or underflow does not occur.

- FIG. 3 is a diagram illustrating an example of a block size for motion prediction / compensation in the H.264 / AVC format.

- macroblocks composed of 16 ⁇ 16 pixels divided into 16 ⁇ 16 pixels, 16 ⁇ 8 pixels, 8 ⁇ 16 pixels, and 8 ⁇ 8 pixel partitions are sequentially shown from the left. ing.

- an 8 ⁇ 8 pixel partition divided into 8 ⁇ 8 pixel, 8 ⁇ 4 pixel, 4 ⁇ 8 pixel, and 4 ⁇ 4 pixel subpartitions is sequentially shown from the left. Yes.

- one macroblock is divided into any partition of 16 ⁇ 16 pixels, 16 ⁇ 8 pixels, 8 ⁇ 16 pixels, or 8 ⁇ 8 pixels, and independent motion vector information is obtained. It is possible to have.

- an 8 ⁇ 8 pixel partition is divided into 8 ⁇ 8 pixel, 8 ⁇ 4 pixel, 4 ⁇ 8 pixel, or 4 ⁇ 4 pixel subpartitions and has independent motion vector information. Is possible.

- Figure 3 shows H. It is a figure explaining the prediction and compensation process of the 1/4 pixel precision in a H.264 / AVC system.

- FIR Finite Impulse Response Filter

- the position A indicates the position of the integer precision pixel

- the positions b, c, and d indicate the positions of the 1/2 pixel precision

- the positions e1, e2, and e3 indicate the positions of the 1/4 pixel precision.

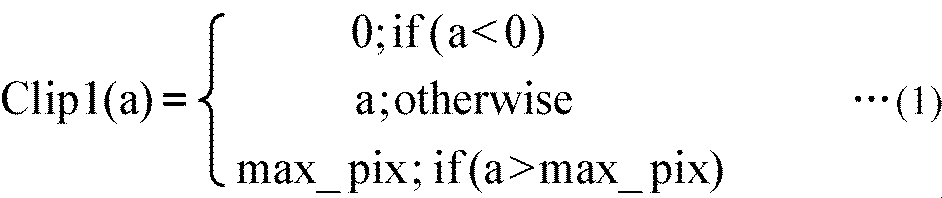

- max_pix When the input image has 8-bit precision, the value of max_pix is 255.

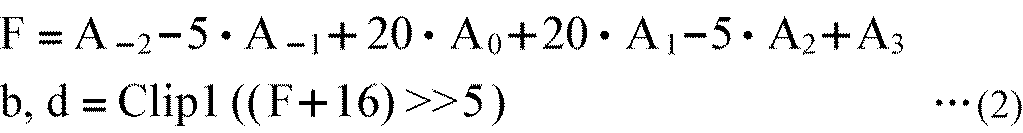

- the pixel values at the positions b and d are generated by the following equation (2) using a 6-tap FIR filter.

- the pixel value at the position c is generated as in the following Expression (3) by applying a 6-tap FIR filter in the horizontal direction and the vertical direction.

- the clip process is executed only once at the end after performing both the horizontal and vertical product-sum processes.

- the positions e1 to e3 are generated by linear interpolation as in the following equation (4).

- the interpolation process with 1/2 pixel accuracy is performed using the filter [-3, 12, -39, 158, 158, -39, 12, -3] / 256.

- 1/4 pixel precision interpolation processing is performed using the filter [-3,12, -37,229,71, -21,6, -1] / 256, and 1/8 pixel accuracy interpolation processing is linear interpolation. Is done.

- FIG. 6 is a diagram for describing prediction / compensation processing of a multi-reference frame in the H.264 / AVC format.

- a target frame Fn to be encoded and encoded frames Fn-5,..., Fn-1 are shown.

- the frame Fn-1 is a frame immediately before the target frame Fn on the time axis

- the frame Fn-2 is a frame two before the target frame Fn

- the frame Fn-3 is the frame of the target frame Fn. This is the previous three frames.

- the frame Fn-4 is a frame four times before the target frame Fn

- the frame Fn-5 is a frame five times before the target frame Fn.

- a smaller reference picture number (ref_id) is added to a frame closer to the time axis than the target frame Fn. That is, frame Fn-1 has the smallest reference picture number, and thereafter, the reference picture numbers are smallest in the order of Fn-2,..., Fn-5.

- a block A1 and a block A2 are shown in the target frame Fn.

- the block A1 is considered to be correlated with the block A1 'of the previous frame Fn-2, and the motion vector V1 is searched.

- the block A2 is considered to be correlated with the block A1 'of the previous frame Fn-4, and the motion vector V2 is searched.

- the block indicates any of the 16 ⁇ 16 pixel, 16 ⁇ 8 pixel, 8 ⁇ 16 pixel, and 8 ⁇ 8 pixel partitions described above with reference to FIG.

- the reference frames within the 8x8 sub-block must be the same.

- FIG. It is a figure explaining the production

- a target block E to be encoded (for example, 16 ⁇ 16 pixels) and blocks A to D that have already been encoded and are adjacent to the target block E are shown.

- the block D is adjacent to the upper left of the target block E

- the block B is adjacent to the upper side of the target block E

- the block C is adjacent to the upper right of the target block E

- the block A is , Adjacent to the left of the target block E.

- the blocks A to D are not divided represent blocks having any one of the 16 ⁇ 16 pixels to 4 ⁇ 4 pixels described above with reference to FIG.

- the predicted motion vector information for the current block E pmv E is block A, B, by using the motion vector information on C, is generated as in the following equation by median prediction (5).

- the motion vector information related to the block C may be unavailable (unavailable) because it is at the edge of the image frame or is not yet encoded. In this case, the motion vector information regarding the block C is substituted with the motion vector information regarding the block D.

- the data mvd E added to the header portion of the compressed image as motion vector information for the target block E is generated as in the following equation (6) using pmv E.

- mvd E mv E -pmv E (6)

- processing is performed independently for each of the horizontal and vertical components of the motion vector information.

- this data mvd E is also referred to as differential motion vector information as appropriate in order to distinguish it from motion vector information obtained by motion prediction.

- the motion vector information of the target block is extracted from the motion vector information around the target block or the motion vector information of the co-located block whose coordinates are the same as the target block in the reference picture. . Therefore, there is no need to send motion vector information to the decoding side.

- the spatial direct mode is a mode that mainly uses the correlation of motion information in the spatial direction (horizontal and vertical two-dimensional space in the picture), and is generally an image including similar motion, and the motion speed is Effective with changing images.

- the temporal direct mode is a mode that mainly uses the correlation of motion information in the time direction, and is generally effective for images containing different motions and having a constant motion speed.

- the spatial direct mode using the H.264 / AVC format will be described.

- the target block E to be encoded for example, 16 ⁇ 16 pixels

- the blocks A to D that have already been encoded and are adjacent to the target block E are shown.

- Predicted motion vector information pmv E for the target block E is a block A, B, by using the motion vector information on C, is generated as described above wherein the median prediction (5).

- the motion vector information mv E for the target block E in the spatial direct mode is expressed by the following equation (7).

- mv E pmv E (7)

- predicted motion vector information generated by median prediction is used as motion vector information of the target block. That is, the motion vector information of the target block is generated with the motion vector information of the encoded block. Therefore, since the motion vector in the spatial direct mode can be generated also on the decoding side, it is not necessary to send motion vector information.

- the time axis t represents the passage of time

- the L0 (List0) reference picture, the current picture to be encoded from now, and the L1 (List1) reference picture are shown in order from the left.

- the arrangement of the L0 reference picture, the target picture, and the L1 reference picture is H.264.

- the H.264 / AVC format is not limited to this order.

- the target block of the target picture is included in a B slice, for example. Therefore, for the target block of the target picture, L0 motion vector information mv L0 and L1 motion vector information mv L1 based on the temporal direct mode are calculated for the L0 reference picture and the L1 reference picture.

- the motion vector information mv col in the co-located block which is a block at the same address (coordinates) as the current block to be encoded, is based on the L0 reference picture and the L1 reference picture. Is calculated.

- the L0 motion vector information mv L0 in the target picture and the L1 motion vector information mv L1 in the target picture can be calculated by the following equation (8).

- the encoded data related to the motion vector is 0 (in the case of the H.264 / AVC format, when the above equation (7) holds) and when the DCT coefficients are all 0, the target block is in skip mode.

- the target block is in the skip mode.

- the direct mode is used and the DCT coefficient is 0, the target block is in the skip mode.

- FIG. 7 is a block diagram illustrating a detailed configuration example of the motion prediction / compensation unit and the motion vector accuracy determination unit. Details will be described using the above-described target block E and adjacent blocks A to D in FIG. 5 as appropriate.

- the motion prediction / compensation unit 75 includes an integer pixel accuracy motion prediction / compensation unit 81, a decimal pixel accuracy motion prediction / compensation unit 82, a motion vector information accumulation buffer 83, a predicted motion vector calculation unit 84, a motion A vector information encoding unit 85 and a mode determination unit 86 are included.

- the motion vector accuracy determination unit 76 includes a target motion vector accuracy determination unit 91, an adjacent motion vector accuracy determination unit 92, and an accuracy flag generation unit 93.

- the integer pixel precision motion prediction / compensation unit 81 is supplied with the original image to be inter-processed read from the screen rearrangement buffer 62 and the reference image from the frame memory 72 via the switch 73.

- the integer pixel accuracy motion prediction / compensation unit 81 performs integer pixel accuracy motion prediction / compensation processing of the target block E for all candidate inter prediction modes.

- the obtained motion vector information of integer pixel accuracy of the target block E is supplied to the decimal pixel accuracy motion prediction / compensation unit 82 together with the intervening image and the reference image.

- the fractional pixel precision motion prediction / compensation unit 82 performs the fractional pixel precision motion prediction / compensation processing of the target block E based on the motion vector information with integer pixel precision using the intervening image and the reference image.

- motion prediction / compensation processing with 1/8 pixel accuracy is performed.

- the obtained motion vector information mv E is stored in the motion vector information storage buffer 83 and is also supplied to the motion vector information encoding unit 85 and the target motion vector accuracy determination unit 91.

- the predicted image obtained by the compensation processing with decimal pixel accuracy is supplied to the mode determination unit 86 together with the original image and the reference frame information.

- the predicted motion vector calculation unit 84 reads motion vector information mv A , mv B , and mv C of adjacent blocks adjacent to the target block from the motion vector information accumulation buffer 83.

- the predicted motion vector calculation unit 84 calculates the predicted motion vector information pmv E of the target block E by the median prediction of Expression (5) described above using the read motion vector information.

- the accuracy flags horizontal_mv_precision_change_flag, vertical_mv_precision_change_flag

- the predicted motion vector calculation unit 84 converts (according to) the accuracy of the motion vector information of the adjacent block to the accuracy of the motion vector information of the target block E, and predicts the motion vector information pmv of the target block E. E is calculated.

- the predicted motion vector information pmv E of the target block E generated by the predicted motion vector calculation unit 84 is supplied to the motion vector information encoding unit 85.

- the motion vector information encoding unit 85 is supplied with the motion vector information mv E of the target block E from the decimal pixel precision motion prediction / compensation unit 82, and the predicted motion vector information pmv E of the target block E from the predicted motion vector calculation unit 84. Is supplied. Further, the accuracy flag is supplied from the accuracy flag generation unit 93 to the motion vector information encoding unit 85.

- the motion vector information encoding unit 85 uses the motion vector information mv E of the target block E and the predicted motion vector information pmv E of the target block E to add to the header portion of the compressed image according to the above equation (6). Difference motion vector information mvd E of the target block E is obtained. The motion vector information encoding unit 85 supplies the obtained difference motion vector information mvd E of the target block E to the mode determination unit 86 together with the accuracy flag.

- the mode determination unit 86 includes a predicted image from the decimal pixel accuracy motion prediction / compensation unit 82, an original image, and reference frame information, and difference motion vector information mvd E and an accuracy flag from the motion vector information encoding unit 85. Supplied.

- the mode determination unit 86 calculates cost function values for all candidate inter prediction modes using the supplied information as appropriate.

- the mode determination unit 86 determines the prediction mode in which the cost function value gives the minimum value as the optimal inter prediction mode, and supplies the prediction image generated in the optimal inter prediction mode and its cost function value to the prediction image selection unit 77. To do.

- the mode determination unit 86 reversibly receives information indicating the optimal inter prediction mode, difference motion vector information mvd E , accuracy flag, reference frame information, and the like.

- the data is output to the encoding unit 66.

- the target motion vector accuracy determination unit 91 determines the accuracy of the motion vector information mv E of the target block from the decimal pixel accuracy motion prediction / compensation unit 82. Then, the target motion vector accuracy determination unit 91 determines accuracy parameters (curr_horizontal_mv_precision_param, curr_vertical_mv_precision_param) regarding the horizontal component and the vertical component for the motion vector information of the target block. The accuracy parameter of the motion vector information of the determined target block is supplied to the accuracy flag generator 93.

- the motion vector information mv E of the target block E has only information up to 1 ⁇ 4 pixel accuracy

- the values of the horizontal component accuracy parameter and the vertical component accuracy parameter of the target block E are set to zero.

- the motion vector information mv E of the target block E has information up to 1/8 pixel accuracy

- the value of the accuracy parameter of the horizontal component and the accuracy parameter of the vertical component of the target block E is 1.

- the adjacent motion vector accuracy determining unit 92 reads the motion vector information of the adjacent block in the motion vector information accumulation buffer 83 and determines the accuracy of the motion vector information of the adjacent block. Then, the adjacent motion vector accuracy determination unit 92 determines accuracy parameters (pred_horizontal_mv_precision_param, pred_vertical_mv_precision_param) regarding the horizontal component and the vertical component for the motion vector information of the adjacent block. The accuracy parameter of the motion vector information of the determined adjacent block is supplied to the accuracy flag generator 93.

- the value of the accuracy parameter of the horizontal component and the accuracy parameter of the vertical component of the adjacent block is set to 0.

- the value of the accuracy parameter of the horizontal component and the accuracy parameter of the vertical component of the adjacent block is set to 1.

- the adjacent block is a block that may give a predicted value (predicted motion vector information) pmv E to the motion vector information mv E of the target block E.

- the blocks A and B in FIG. , C, or D are defined by one of the following methods.

- the first method is a method in which the block A adjacent to the left part of the target block E is used as an adjacent block.

- the second method is a method in which a block that has been subjected to a decoding process immediately before is used as an adjacent block.

- the third method is a method in which a block that gives a prediction value selected by the median prediction of Expression (5) described above is used as an adjacent block. That is, in this case, the accuracy of the motion vector determined as the predicted value by the median prediction is used.

- the process is performed with the value of the motion vector information set to 0.

- H Processing based on median prediction defined in the H.264 / AVC format is performed.

- the accuracy flag generation unit 93 is supplied with the accuracy parameter of the motion vector information of the target block E from the target motion vector accuracy determination unit 91 and the accuracy parameter of the motion vector information of the adjacent block from the adjacent motion vector accuracy determination unit 92. .

- the accuracy flag generator 93 compares the accuracy parameters of both, and generates an accuracy flag indicating whether the accuracy of the motion vector information of the target block E and the accuracy of the motion vector information of the adjacent block are the same or different.

- the value of the accuracy flag (horizontal_mv_precision_change_flag) of the horizontal component of the target block E is set to 0. If the accuracy parameter of the horizontal component of the target block E is different from the accuracy parameter of the horizontal component of the adjacent block, the value of the accuracy flag (horizontal_mv_precision_change_flag) of the horizontal component of the target block E is set to 1.

- the value of the accuracy flag (vertical_mv_precision_change_flag) of the vertical component of the target block E is set to 0. If the accuracy parameter of the vertical component of the target block E is different from the accuracy parameter of the vertical component of the adjacent block, the value of the accuracy flag (vertical_mv_precision_change_flag) of the vertical component of the target block E is set to 1.

- the accuracy flag indicating whether the accuracy of the motion vector information of the target block E is the same as or different from the accuracy of the motion vector information of the adjacent block indicates that the accuracy of the motion vector information of the target block E is the motion vector of the adjacent block. It indicates whether or not the accuracy of the information has changed.

- the generated accuracy flag of the horizontal component and the vertical component of the target block is supplied to the predicted motion vector calculation unit 84 and the motion vector information encoding unit 85.

- step S11 the A / D converter 61 performs A / D conversion on the input image.

- step S12 the screen rearrangement buffer 62 stores the image supplied from the A / D conversion unit 61, and rearranges the picture from the display order to the encoding order.

- step S13 the calculation unit 63 calculates the difference between the image rearranged in step S12 and the predicted image.

- the prediction image is supplied from the motion prediction / compensation unit 75 in the case of inter prediction, and from the intra prediction unit 74 in the case of intra prediction, to the calculation unit 63 via the prediction image selection unit 77.

- ⁇ Difference data has a smaller data volume than the original image data. Therefore, the data amount can be compressed as compared with the case where the image is encoded as it is.

- step S14 the orthogonal transformation unit 64 orthogonally transforms the difference information supplied from the calculation unit 63. Specifically, orthogonal transformation such as discrete cosine transformation and Karhunen-Loeve transformation is performed, and transformation coefficients are output.

- step S15 the quantization unit 65 quantizes the transform coefficient. At the time of this quantization, the rate is controlled as described in the process of step S25 described later.

- step S ⁇ b> 16 the inverse quantization unit 68 inversely quantizes the transform coefficient quantized by the quantization unit 65 with characteristics corresponding to the characteristics of the quantization unit 65.

- step S ⁇ b> 17 the inverse orthogonal transform unit 69 performs inverse orthogonal transform on the transform coefficient inversely quantized by the inverse quantization unit 68 with characteristics corresponding to the characteristics of the orthogonal transform unit 64.

- step S18 the calculation unit 70 adds the predicted image input via the predicted image selection unit 77 to the locally decoded difference information, and outputs the locally decoded image (for input to the calculation unit 63). Corresponding image).

- step S ⁇ b> 19 the deblock filter 71 filters the image output from the calculation unit 70. Thereby, block distortion is removed.

- step S20 the frame memory 72 stores the filtered image. Note that an image that has not been filtered by the deblocking filter 71 is also supplied to the frame memory 72 from the computing unit 70 and stored therein.

- step S21 the intra prediction unit 74 and the motion prediction / compensation unit 75 each perform image prediction processing. That is, in step S21, the intra prediction unit 74 performs an intra prediction process in the intra prediction mode.

- the motion prediction / compensation unit 75 performs motion prediction / compensation processing in the inter prediction mode with 1/8 pixel accuracy.

- the motion vector accuracy determination unit 76 determines whether the accuracy of the motion vector information of the target block obtained by the motion prediction / compensation unit 75 is the same as the accuracy of the motion vector information of the adjacent block adjacent to the target block. Generates an accuracy flag indicating whether they are different. Based on the accuracy flag, the motion prediction / compensation unit 75 calculates the predicted motion vector information of the target block using the motion vector information of the adjacent block, and calculates the calculated motion vector information and the calculated predicted motion vector information. The difference is set as difference motion vector information to be sent to the decoding side.

- the accuracy flag and the difference motion vector information are supplied to the lossless encoding unit 66 together with information indicating the optimal inter prediction mode and reference frame information when a prediction image in the optimal inter prediction mode is selected in step S22. .

- step S21 The details of the prediction processing in step S21 will be described later with reference to FIG. 9, but by this processing, prediction processing in all the candidate intra prediction modes is performed, and in all the candidate intra prediction modes. Cost function values are respectively calculated. Then, based on the calculated cost function value, the optimal intra prediction mode is selected, and the predicted image generated by the intra prediction in the optimal intra prediction mode and its cost function value are supplied to the predicted image selection unit 77.

- prediction processing in all candidate inter prediction modes is performed, and cost function values in all candidate inter prediction modes are calculated.

- the optimal inter prediction mode is determined from the inter prediction modes, and the predicted image generated in the optimal inter prediction mode and its cost function value are supplied to the predicted image selection unit 77.

- step S ⁇ b> 22 the predicted image selection unit 77 optimizes one of the optimal intra prediction mode and the optimal inter prediction mode based on the cost function values output from the intra prediction unit 74 and the motion prediction / compensation unit 75. Determine the prediction mode. Then, the predicted image selection unit 77 selects the predicted image of the determined optimal prediction mode and supplies it to the calculation units 63 and 70. As described above, this predicted image is used for the calculations in steps S13 and S18.

- the prediction image selection information is supplied to the intra prediction unit 74 or the motion prediction / compensation unit 75.

- the intra prediction unit 74 supplies information indicating the optimal intra prediction mode (that is, intra prediction mode information) to the lossless encoding unit 66.

- the motion prediction / compensation unit 75 sends information indicating the optimal inter prediction mode and, if necessary, information corresponding to the optimal inter prediction mode to the lossless encoding unit 66. Output.

- information corresponding to the optimal inter prediction mode include differential motion vector information, accuracy flags, reference frame information, and the like.

- step S23 the lossless encoding unit 66 encodes the quantized transform coefficient output from the quantization unit 65. That is, the difference image is subjected to lossless encoding such as variable length encoding and arithmetic encoding, and is compressed.

- the intra prediction mode information from the intra prediction unit 74 or the information corresponding to the optimal inter prediction mode from the motion prediction / compensation unit 75, which is input to the lossless encoding unit 66 in step S22 described above, is also encoded. And added to the header information.

- step S24 the accumulation buffer 67 accumulates the difference image as a compressed image.

- the compressed image stored in the storage buffer 67 is appropriately read and transmitted to the decoding side via the transmission path.

- step S25 the rate control unit 78 controls the rate of the quantization operation of the quantization unit 65 based on the compressed image stored in the storage buffer 67 so that overflow or underflow does not occur.

- the decoded image to be referred to is read from the frame memory 72, and the intra prediction unit 74 via the switch 73. To be supplied. Based on these images, in step S31, the intra prediction unit 74 performs intra prediction on the pixels of the block to be processed in all candidate intra prediction modes. Note that pixels that have not been deblocked filtered by the deblocking filter 71 are used as decoded pixels that are referred to.

- intra prediction is performed in all candidate intra prediction modes, and for all candidate intra prediction modes.

- a cost function value is calculated.

- the optimal intra prediction mode is selected, and the predicted image generated by the intra prediction in the optimal intra prediction mode and its cost function value are supplied to the predicted image selection unit 77.

- the processing target image supplied from the screen rearrangement buffer 62 is an image to be inter-processed

- the referenced image is read from the frame memory 72 and supplied to the motion prediction / compensation unit 75 via the switch 73.

- the motion prediction / compensation unit 75 performs an inter motion prediction process. That is, the motion prediction / compensation unit 75 refers to the image supplied from the frame memory 72 and performs motion prediction processing in all candidate inter prediction modes.

- the motion vector accuracy determination unit 76 has the same accuracy of the motion vector information of the target block obtained by the motion prediction / compensation unit 75 and the accuracy of the motion vector information of the adjacent block adjacent to the target block. Generates an accuracy flag indicating whether it exists or not. Based on the accuracy flag, the motion prediction / compensation unit 75 generates predicted motion vector information of the target block using the motion vector information of the adjacent block, and calculates the calculated motion vector information and the generated predicted motion vector information. The difference is set as difference motion vector information to be sent to the decoding side.

- the accuracy flag and the difference motion vector information are stored in the lossless encoding unit 66 together with information indicating the optimal inter prediction mode and reference frame information when a prediction image in the optimal inter prediction mode is selected in step S22 of FIG. Supplied.

- step S32 Details of the inter motion prediction process in step S32 will be described later with reference to FIG. 11. With this process, the motion prediction process is performed in all candidate inter prediction modes, and all candidate inter prediction modes are set. On the other hand, a cost function value is calculated.

- step S34 the mode determination unit 86 of the motion prediction / compensation unit 75 compares the cost function value for the inter prediction mode calculated in step S32.

- the mode determination unit 86 determines the prediction mode that gives the minimum value as the optimal inter prediction mode, and supplies the prediction image generated in the optimal inter prediction mode and its cost function value to the prediction image selection unit 77.

- step S41 the intra prediction unit 74 performs intra prediction for each of the 4 ⁇ 4 pixel, 8 ⁇ 8 pixel, and 16 ⁇ 16 pixel intra prediction modes.

- the luminance signal intra prediction modes include nine types of 4 ⁇ 4 pixel and 8 ⁇ 8 pixel block units, and four types of 16 ⁇ 16 pixel macroblock unit prediction modes. There are four types of prediction modes in units of 8 ⁇ 8 pixel blocks.

- the color difference signal intra prediction mode can be set independently of the luminance signal intra prediction mode.

- the 4 ⁇ 4 pixel and 8 ⁇ 8 pixel intra prediction modes of the luminance signal one intra prediction mode is defined for each block of the luminance signal of 4 ⁇ 4 pixels and 8 ⁇ 8 pixels.

- the 16 ⁇ 16 pixel intra prediction mode for luminance signals and the intra prediction mode for color difference signals one prediction mode is defined for one macroblock.

- the intra prediction unit 74 refers to a decoded image read from the frame memory 72 and supplied via the switch 73, and performs intra prediction on the pixel of the processing target block. By performing this intra prediction process in each intra prediction mode, a prediction image in each intra prediction mode is generated. Note that pixels that have not been deblocked filtered by the deblocking filter 71 are used as decoded pixels that are referred to.

- the intra prediction unit 74 calculates a cost function value for each intra prediction mode of 4 ⁇ 4 pixels, 8 ⁇ 8 pixels, and 16 ⁇ 16 pixels.

- the cost function value is determined based on a method of either High Complexity mode or Low Complexity mode. These modes are H.264. It is defined by JM (Joint Model) which is reference software in the H.264 / AVC format.

- the encoding process is temporarily performed for all candidate prediction modes as the process in step S41. Then, the cost function value represented by the following equation (9) is calculated for each prediction mode, and the prediction mode that gives the minimum value is selected as the optimal prediction mode.

- D a difference (distortion) between the original image and the decoded image

- R a generated code amount including up to the orthogonal transform coefficient

- ⁇ a Lagrange multiplier given as a function of the quantization parameter QP.

- step S41 generation of predicted images and header bits such as motion vector information, prediction mode information, and flag information are calculated for all candidate prediction modes. The Then, the cost function value represented by the following equation (10) is calculated for each prediction mode, and the prediction mode that gives the minimum value is selected as the optimal prediction mode.

- Cost (Mode) D + QPtoQuant (QP) ⁇ Header_Bit (10)

- D is a difference (distortion) between the original image and the decoded image

- Header_Bit is a header bit for the prediction mode

- QPtoQuant is a function given as a function of the quantization parameter QP.

- the intra prediction unit 74 determines an optimum mode for each of the 4 ⁇ 4 pixel, 8 ⁇ 8 pixel, and 16 ⁇ 16 pixel intra prediction modes. That is, as described above, in the case of the intra 4 ⁇ 4 prediction mode and the intra 8 ⁇ 8 prediction mode, there are nine types of prediction modes, and in the case of the intra 16 ⁇ 16 prediction mode, there are types of prediction modes. There are four types. Therefore, the intra prediction unit 74 selects the optimal intra 4 ⁇ 4 prediction mode, the optimal intra 8 ⁇ 8 prediction mode, and the optimal intra 16 ⁇ 16 prediction mode from among the cost function values calculated in step S42. decide.

- the intra prediction unit 74 calculates the cost calculated in step S42 from among the optimum modes determined for the 4 ⁇ 4 pixel, 8 ⁇ 8 pixel, and 16 ⁇ 16 pixel intra prediction modes in step S44.

- the optimal intra prediction mode is selected based on the function value. That is, the mode having the minimum cost function value is selected as the optimal intra prediction mode from among the optimal modes determined for 4 ⁇ 4 pixels, 8 ⁇ 8 pixels, and 16 ⁇ 16 pixels.

- the intra prediction unit 74 supplies the predicted image generated in the optimal intra prediction mode and its cost function value to the predicted image selection unit 77.

- step S51 the motion prediction / compensation unit 75 determines a motion vector and a reference image for each of the eight types of inter prediction modes including 16 ⁇ 16 pixels to 4 ⁇ 4 pixels described above with reference to FIG. . That is, a motion vector and a reference image are determined for each block to be processed in each inter prediction mode.

- step S52 the motion prediction / compensation unit 75 performs motion prediction on the reference image based on the motion vector determined in step S51 for each of the eight types of inter prediction modes including 16 ⁇ 16 pixels to 4 ⁇ 4 pixels. Perform compensation processing. By this motion prediction and compensation processing, a prediction image in each inter prediction mode is generated.

- steps S51 and S52 described above is performed with integer pixel accuracy by the integer pixel accuracy motion prediction / compensation unit 81 on the target block in each inter prediction mode, and decimal pixel accuracy motion prediction /

- the compensation unit 82 performs the operation with 1/8 pixel accuracy.

- the integer pixel accuracy motion prediction / compensation unit 81 performs integer pixel accuracy motion prediction / compensation processing of the target block for all candidate inter prediction modes.

- the obtained motion vector information of integer pixel accuracy of the target block is supplied to the decimal pixel accuracy motion prediction / compensation unit 82 together with the intervening image and the reference image.

- the decimal pixel accuracy motion prediction / compensation unit 82 uses the intervening image and the reference image, and performs the motion prediction / compensation processing with the decimal pixel accuracy of the target block based on the motion vector information of the integer pixel accuracy. Do.

- the obtained motion vector information is stored in the motion vector information storage buffer 83 and is also supplied to the motion vector information encoding unit 85 and the target motion vector accuracy determination unit 91. Further, the predicted image obtained by the compensation processing with decimal pixel accuracy is supplied to the mode determination unit 86 together with the original image and the reference frame information.

- step S53 the motion vector accuracy determination unit 76 performs a motion vector accuracy determination process. This motion vector accuracy determination process will be described later with reference to FIG.

- the accuracy flag indicating whether the accuracy of the motion vector information of the target block and the accuracy of the motion vector information of the adjacent block are the same or different is generated by the motion vector accuracy determination process in step S53.

- the generated accuracy flag is supplied to the prediction motion vector calculation unit 84 and the motion vector information encoding unit 85.

- the prediction motion vector calculation unit 84 and the motion vector information encoding unit 85 perform differential motion on the motion vectors determined for each of the eight types of inter prediction modes including 16 ⁇ 16 pixels to 4 ⁇ 4 pixels in step S54.

- Vector information mvd E is generated. At this time, the motion vector generation method described above with reference to FIG. 5 is used.

- the motion vector predictor calculating unit 84 calculates motion vector predictor information pmv E for the target block E by the median prediction of the above equation (5) using the adjacent block motion vector information.

- the motion vector information encoding unit 85 then calculates the motion vector information mv E from the decimal pixel precision motion prediction / compensation unit 82 and the calculated predicted motion vector information pmv E as shown in the above-described equation (6).

- the difference motion vector information mvd E is obtained from the difference between the two.

- the accuracy of motion vector information in adjacent blocks A, B, C, and D shown in FIG. 5 is mixed with 1/4 pixel accuracy and 1/8 pixel accuracy. There may be.

- the motion vector information of adjacent blocks is converted to 1/8 pixel accuracy, and median prediction is performed.

- median prediction is performed as in the following Expression (12).

- the motion vector information of the adjacent block is converted to 1 ⁇ 4 pixel accuracy, and median prediction is performed.

- the obtained difference motion vector information is supplied to the mode determination unit 86 together with the accuracy flag. This difference motion vector information is also used when calculating the cost function value in the next step S54.

- the difference motion vector information is output to the lossless encoding unit 66 together with the accuracy flag, the prediction mode information, and the reference frame information when the corresponding prediction image is finally selected by the prediction image selection unit 77.

- step S54 the mode determination unit 86 calculates the cost function value represented by the above equation (9) or (10) for each of the eight types of inter prediction modes including 16 ⁇ 16 pixels to 4 ⁇ 4 pixels. calculate.

- the mode determination unit 86 includes the predicted image, the original image, and the reference frame information from the decimal pixel accuracy motion prediction / compensation unit 82, and the difference motion vector information mvd E and the accuracy flag from the motion vector information encoding unit 85. Etc. are supplied.

- the mode determination unit 86 calculates cost function values for all candidate inter prediction modes using the supplied information as appropriate. The cost function value calculated here is used when determining the optimal inter prediction mode in step S34 of FIG. 8 described above.

- the target motion vector accuracy discriminating unit 91 determines curr_horizontal_mv_precision_param and curr_vertical_mv_precision_param in step S71. That is, the motion vector information of the target block is supplied from the decimal pixel accuracy motion prediction / compensation unit 82 to the target motion vector accuracy determination unit 91.

- the target motion vector accuracy determining unit 91 determines the accuracy of the motion vector information of the target block, and in step S71, determines the accuracy parameter of the horizontal component and the accuracy parameter of the vertical component for the motion vector information of the target block.

- the determined curr_horizontal_mv_precision_param and curr_vertical_mv_precision_param are supplied to the precision flag generator 93.

- the adjacent motion vector accuracy discriminating unit 92 determines pred_horizontal_mv_precision_param and pred_vertical_mv_precision_param. That is, the adjacent motion vector accuracy determination unit 92 reads the motion vector information of the adjacent block from the motion vector information accumulation buffer 83. The adjacent motion vector accuracy determining unit 92 determines the accuracy of the motion vector information of the adjacent block, and in step S72, determines the horizontal component accuracy parameter and the vertical component accuracy parameter for the motion vector information of the adjacent block. The determined pred_horizontal_mv_precision_param and pred_vertical_mv_precision_param are supplied to the precision flag generator 93.

- step S73 the precision flag generation unit 93 determines whether curr_horizontal_mv_precision_param and pred_horizontal_mv_precision_param match.

- step S73 If it is determined in step S73 that curr_horizontal_mv_precision_param matches pred_horizontal_mv_precision_param, the process proceeds to step S74.

- step S74 the accuracy flag generator 93 sets the value of the accuracy flag (horizontal_mv_precision_change_flag) of the horizontal component of the target block to 0. That is, the accuracy flag of the horizontal component of the target block whose value is 0 is generated.

- step S73 If it is determined in step S73 that curr_horizontal_mv_precision_param is different from pred_horizontal_mv_precision_param, the process proceeds to step S75.

- step S75 the precision flag generator 93 sets the value of the horizontal component precision flag (horizontal_mv_precision_change_flag) of the target block to 1. That is, the accuracy flag of the horizontal component of the target block whose value is 1 is generated.

- step S76 the precision flag generation unit 93 determines whether curr_vertical_mv_precision_param and pred_vertical_mv_precision_param match.

- step S76 If it is determined in step S76 that curr_vertical_mv_precision_param matches pred_vertical_mv_precision_param, the process proceeds to step S77.

- step S77 the accuracy flag generation unit 93 sets the value of the accuracy flag (vertical_mv_precision_change_flag) of the vertical component of the target block to 0. That is, the accuracy flag of the vertical component of the target block whose value is 0 is generated.

- step S76 If it is determined in step S76 that curr_vertical_mv_precision_param and pred_vertical_mv_precision_param are different, the process proceeds to step S78.

- step S78 the precision flag generation unit 93 sets the value of the precision flag (vertical_mv_precision_change_flag) of the vertical component of the target block to 1. That is, the accuracy flag of the vertical component of the target block whose value is 1 is generated.

- the generated accuracy flag of the horizontal component and the vertical component of the target block is supplied to the predicted motion vector calculation unit 84 and the motion vector information encoding unit 85. Then, when the prediction image of the optimal inter prediction mode is selected in step S22 of FIG. 8, the accuracy flag is stored in the lossless encoding unit 66 together with the difference motion vector information, the information indicating the optimal inter prediction mode, and the reference frame information. Supplied, encoded and transmitted to the decoding side.

- an accuracy flag indicating whether the accuracy of the motion vector information of the target block is the same as or different from the accuracy of the motion vector information of the adjacent block is added to the header of the compressed image. Send to the decryption side.

- an accuracy flag is defined for each motion prediction block in the compressed image information.

- the target block is a B block

- a series of processing is performed for each of List0 and List1.

- the value of the precision flag (horizontal_mv_precision_change_flag, vertical_mv_precision_change_flag) is assumed to be 0 and transmitted to the decoding side. Not.

- the encoded compressed image is transmitted via a predetermined transmission path and decoded by an image decoding device.

- FIG. 13 shows the configuration of an embodiment of an image decoding apparatus as an image processing apparatus to which is applied.

- the image decoding apparatus 101 includes a storage buffer 111, a lossless decoding unit 112, an inverse quantization unit 113, an inverse orthogonal transform unit 114, a calculation unit 115, a deblock filter 116, a screen rearrangement buffer 117, a D / A conversion unit 118, a frame

- the memory 119, the switch 120, the intra prediction unit 121, the motion prediction / compensation unit 122, the motion vector accuracy determination unit 123, and the switch 124 are configured.

- the accumulation buffer 111 accumulates the transmitted compressed image.

- the lossless decoding unit 112 decodes the information supplied from the accumulation buffer 111 and encoded by the lossless encoding unit 66 in FIG. 1 using a method corresponding to the encoding method of the lossless encoding unit 66.

- the inverse quantization unit 113 inversely quantizes the image decoded by the lossless decoding unit 112 by a method corresponding to the quantization method of the quantization unit 65 of FIG.

- the inverse orthogonal transform unit 114 performs inverse orthogonal transform on the output of the inverse quantization unit 113 by a method corresponding to the orthogonal transform method of the orthogonal transform unit 64 in FIG.

- the output subjected to inverse orthogonal transform is added to the prediction image supplied from the switch 124 by the arithmetic unit 115 and decoded.

- the deblocking filter 116 removes block distortion of the decoded image, and then supplies the frame to the frame memory 119 for storage and outputs it to the screen rearrangement buffer 117.

- the screen rearrangement buffer 117 rearranges images. That is, the order of frames rearranged for the encoding order by the screen rearrangement buffer 62 in FIG. 1 is rearranged in the original display order.

- the D / A conversion unit 118 performs D / A conversion on the image supplied from the screen rearrangement buffer 117, and outputs and displays the image on a display (not shown).

- the switch 120 reads the inter-processed image and the referenced image from the frame memory 119 and outputs them to the motion prediction / compensation unit 122, and also reads an image used for intra prediction from the frame memory 119, and sends it to the intra prediction unit 121. Supply.

- the information indicating the intra prediction mode obtained by decoding the header information is supplied from the lossless decoding unit 112 to the intra prediction unit 121.

- the intra prediction unit 121 generates a prediction image based on this information, and outputs the generated prediction image to the switch 124.

- the motion prediction / compensation unit 122 is supplied with prediction mode information, differential motion vector information, reference frame information, and the like from the lossless decoding unit 112.

- the motion prediction / compensation unit 122 refers to the accuracy parameter of the motion vector information of the target block from the motion vector accuracy determination unit 123 and uses the decoded difference motion vector information. Then, the motion vector information is reconstructed.

- the motion prediction / compensation unit 122 refers to the accuracy parameter of the motion vector information of the target block from the motion vector accuracy determination unit 123, and from the motion vector information of the adjacent block, predicts motion vector information of the target block. Is generated.

- the motion prediction / compensation unit 122 reconstructs the motion vector information of the target block from the difference motion vector information from the lossless decoding unit 112, the accuracy parameter of the motion vector information of the target block, and the predicted motion vector information of the target block.

- the motion prediction / compensation unit 122 performs compensation processing on the image based on the reference image of the frame memory 119 indicated by the reference frame information and the reconstructed motion vector information, and generates a predicted image.

- the generated prediction image is output to the switch 124.

- the accuracy flag is supplied from the lossless decoding unit 112 to the motion vector accuracy determination unit 123.