WO2009157340A1 - 高品質コンテンツ生成システムと、その方法及びプログラム - Google Patents

高品質コンテンツ生成システムと、その方法及びプログラム Download PDFInfo

- Publication number

- WO2009157340A1 WO2009157340A1 PCT/JP2009/060909 JP2009060909W WO2009157340A1 WO 2009157340 A1 WO2009157340 A1 WO 2009157340A1 JP 2009060909 W JP2009060909 W JP 2009060909W WO 2009157340 A1 WO2009157340 A1 WO 2009157340A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- content

- quality

- contents

- derived

- same

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/76—Television signal recording

- H04N5/91—Television signal processing therefor

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B27/00—Editing; Indexing; Addressing; Timing or synchronising; Monitoring; Measuring tape travel

- G11B27/02—Editing, e.g. varying the order of information signals recorded on, or reproduced from, record carriers

- G11B27/031—Electronic editing of digitised analogue information signals, e.g. audio or video signals

- G11B27/034—Electronic editing of digitised analogue information signals, e.g. audio or video signals on discs

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B27/00—Editing; Indexing; Addressing; Timing or synchronising; Monitoring; Measuring tape travel

- G11B27/02—Editing, e.g. varying the order of information signals recorded on, or reproduced from, record carriers

- G11B27/031—Electronic editing of digitised analogue information signals, e.g. audio or video signals

- G11B27/036—Insert-editing

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B27/00—Editing; Indexing; Addressing; Timing or synchronising; Monitoring; Measuring tape travel

- G11B27/10—Indexing; Addressing; Timing or synchronising; Measuring tape travel

- G11B27/102—Programmed access in sequence to addressed parts of tracks of operating record carriers

- G11B27/105—Programmed access in sequence to addressed parts of tracks of operating record carriers of operating discs

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/45—Management operations performed by the client for facilitating the reception of or the interaction with the content or administrating data related to the end-user or to the client device itself, e.g. learning user preferences for recommending movies, resolving scheduling conflicts

- H04N21/462—Content or additional data management, e.g. creating a master electronic program guide from data received from the Internet and a Head-end, controlling the complexity of a video stream by scaling the resolution or bit-rate based on the client capabilities

- H04N21/4622—Retrieving content or additional data from different sources, e.g. from a broadcast channel and the Internet

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/482—End-user interface for program selection

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/482—End-user interface for program selection

- H04N21/4828—End-user interface for program selection for searching program descriptors

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/60—Network structure or processes for video distribution between server and client or between remote clients; Control signalling between clients, server and network components; Transmission of management data between server and client, e.g. sending from server to client commands for recording incoming content stream; Communication details between server and client

- H04N21/61—Network physical structure; Signal processing

- H04N21/6106—Network physical structure; Signal processing specially adapted to the downstream path of the transmission network

- H04N21/6125—Network physical structure; Signal processing specially adapted to the downstream path of the transmission network involving transmission via Internet

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/80—Generation or processing of content or additional data by content creator independently of the distribution process; Content per se

- H04N21/83—Generation or processing of protective or descriptive data associated with content; Content structuring

- H04N21/845—Structuring of content, e.g. decomposing content into time segments

- H04N21/8456—Structuring of content, e.g. decomposing content into time segments by decomposing the content in the time domain, e.g. in time segments

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N7/00—Television systems

- H04N7/16—Analogue secrecy systems; Analogue subscription systems

- H04N7/173—Analogue secrecy systems; Analogue subscription systems with two-way working, e.g. subscriber sending a programme selection signal

- H04N7/17309—Transmission or handling of upstream communications

- H04N7/17318—Direct or substantially direct transmission and handling of requests

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B2220/00—Record carriers by type

- G11B2220/20—Disc-shaped record carriers

- G11B2220/25—Disc-shaped record carriers characterised in that the disc is based on a specific recording technology

- G11B2220/2508—Magnetic discs

- G11B2220/2516—Hard disks

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/79—Processing of colour television signals in connection with recording

- H04N9/7921—Processing of colour television signals in connection with recording for more than one processing mode

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/79—Processing of colour television signals in connection with recording

- H04N9/80—Transformation of the television signal for recording, e.g. modulation, frequency changing; Inverse transformation for playback

- H04N9/82—Transformation of the television signal for recording, e.g. modulation, frequency changing; Inverse transformation for playback the individual colour picture signal components being recorded simultaneously only

- H04N9/8205—Transformation of the television signal for recording, e.g. modulation, frequency changing; Inverse transformation for playback the individual colour picture signal components being recorded simultaneously only involving the multiplexing of an additional signal and the colour video signal

Definitions

- the present invention relates to a high-quality content generation system, method and program thereof.

- the first problem is that it is difficult to see high-quality content.

- the second problem is that it is difficult for the user to view high-quality content in all sections.

- the present invention has been invented in view of the above problems, and its purpose is to provide higher-quality content by using the same content or a plurality of content derived therefrom. It is an object to provide a high-quality content generation system, method, and program capable of generating the content.

- the present invention that solves the above-described problem is performed by comparing feature quantity extraction means for extracting content feature quantities from a plurality of contents, and feature quantities of the plurality of contents extracted by the feature quantity extraction means, Content grouping means for grouping the same content and the derived content produced using the content to calculate the same / derived content grouping information, and the content grouped by the same / derived content grouping information

- a high-quality content generation system comprising: a high-quality content generation unit that selects from the plurality of contents and generates content with better quality using the selected content.

- the present invention for solving the above-described problems is characterized in that a feature amount extraction step for extracting feature amounts from a plurality of contents and a feature amount of the extracted plurality of contents are collated, and the same contents included in the plurality of contents and A content grouping step of grouping derived content produced using the content and calculating the same / derived content grouping information, and content grouped by the same / derived content grouping information A high-quality content generation method including a high-quality content generation step of generating content with better quality using the selected content.

- the present invention that solves the above-described problems performs a comparison between a feature amount extraction process for extracting feature amounts of content from a plurality of contents and the feature amounts of the extracted plurality of contents, and the same content included in the plurality of contents and Content grouping processing for grouping derived content produced using the content and calculating the same / derived content grouping information, and content grouped by the same / derived content grouping information

- a high-quality content generation program that causes an information processing apparatus to execute a high-quality content generation process that selects content from among them and generates content with better quality using the selected content.

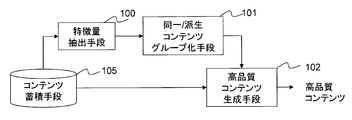

- FIG. 1 is a block diagram of a high-quality content generation system according to the first embodiment.

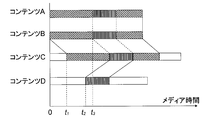

- FIG. 2 is a diagram illustrating an example of grouping between contents having a time axis.

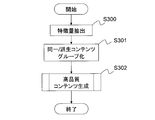

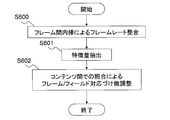

- FIG. 3 is a flowchart showing the overall processing flow of the high-quality content generation system according to the first embodiment.

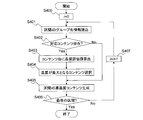

- FIG. 4 is a flowchart showing the flow of processing of the first form of the high quality content generation means 102.

- FIG. 5 is a flowchart showing the flow of processing of the second form of the high quality content generation means 102.

- FIG. 6 is a flowchart showing the flow of processing of the third form of the high quality content generation means 102.

- FIG. 7 is a flowchart showing the flow of processing of the fourth form of operation of the high quality content generation means 102.

- FIG. 1 is a block diagram of a high-quality content generation system according to the first embodiment.

- FIG. 2 is a diagram illustrating an example of grouping between contents having a time axis.

- FIG. 8 is a diagram illustrating a method for generating high-quality content when the frame rate differs between the contents.

- FIG. 9 is a diagram showing a method for generating high-quality content when the frame rate differs between the contents.

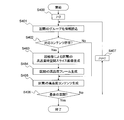

- FIG. 10 is a flowchart showing the operation of the embodiment of the inter-content frame / field association step S463 of FIG.

- FIG. 11 is a flowchart showing the operation of one embodiment of the inter-content frame / field association step S463 of FIG.

- FIG. 12 is a diagram illustrating a spatiotemporal slice image.

- FIG. 13 is a flowchart showing the flow of processing of the fifth form of the high quality content generation means 102.

- FIG. 14 is a block diagram of a high-quality content generation system according to the second embodiment.

- a high-quality content generation system includes a feature amount extraction unit (100 in FIG. 1) that extracts feature amounts of content from a plurality of contents, and a feature amount between the plurality of pieces of content extracted by the feature amount extraction unit.

- Content grouping means (101 in FIG. 1) that performs collation in order to obtain the same content included in a plurality of contents and derived content produced using the content, group them, and calculate the same / derived content grouping information

- a high-quality content generation unit (FIG. 1) that selects content grouped by the same / derived content grouping information from the plurality of contents and generates content of better quality using the selected content. 102).

- FIG. 1 is a block diagram of a high-quality content generation system according to the first embodiment.

- the high-quality content generation system includes a feature quantity extraction unit 100, an identical / derived content grouping unit 101, a high-quality content generation unit 102, and a content storage unit 105.

- the content storage unit 105 stores a plurality of contents, and is connected to the feature amount extraction unit 100 and the high-quality content generation unit 102.

- the feature amount extraction unit 100 receives content from the content storage unit 105, obtains a feature amount for the content, and outputs the feature amount to the same / derived content grouping unit 101.

- the same / derived content grouping unit 101 receives the feature amount of the content output from the feature amount extraction unit 100, obtains content link information representing a link relationship between the feature amounts, and generates high-quality content as grouping information. Output to the means 102.

- the high quality content generation unit 102 receives the grouping information from the identical / derived content grouping unit 101, receives the content from the content storage unit 105, and generates and outputs the high quality content.

- the content is stored in the content storage means 105.

- content refers to digitized multimedia content, for example, digitized photos, videos, music, or content that can be combined with them.

- the content may be not only content produced by a professional, but also so-called CGM (Consumer Generated Media), which is content produced by a consumer, such as a broadcast program.

- CGM Consumer Generated Media

- the content storage means 105 is written as if the content is stored in one place for convenience, but the content may be distributed and stored in a plurality of storages. For example, in a plurality of moving image posting sites on the Internet, moving image content may be accumulated for each site. In each site, content may be stored separately in a plurality of storages. The content stored in the content storage unit 105 is input to the feature amount extraction unit 100.

- Feature amount extraction means 100 performs feature amount extraction for each input content.

- the feature amount is a visual feature amount such as a color, a pattern, or a shape.

- a feature amount standardized by ISO / IEC 15938-3 can be used.

- music it is an acoustic feature quantity such as sound power or frequency component, and for example, a feature quantity standardized by ISO / IEC 15938-4 can be used.

- a visual feature amount that expresses movement can be used.

- a feature amount standardized by ISO / IEC 15938-3 can be used.

- the above-described acoustic feature amount may be used, or both the acoustic feature amount and the visual feature amount may be used.

- the extracted feature amount of each content is output to the same / derived content grouping means 101.

- the identical / derived content grouping means 101 collates the feature amounts of the input contents, and if the similarity between the feature amounts is sufficiently large, the content is regarded as the same content, and the group Turn into. Specifically, the similarity (or distance) is calculated between the feature quantities of two contents, and if the similarity is greater than or equal to a threshold (or less than the threshold in the case of distance), the two contents are grouped.

- the same photo in the case of photo content, the same photo can be grouped by comparing the feature quantities of the entire photo and calculating the similarity. Further, the similarity may be calculated by performing collation between some areas of the photo. In this case, another image that can be created using one photo (for example, an image that can be created by putting a frame on a photo or pasting it on another photo), that is, derived content can also be grouped. .

- content grouping is performed for each time section (section length is arbitrary). For example, if the contents A, B, C, and D are collated as shown in FIG. 2, the time intervals indicated by diagonal stripes and the time intervals indicated by vertical stripes are grouped. The grouping information obtained in this way is output to the high-quality content generation unit 102.

- the high quality content generation means 102 generates high quality content from the input grouping information and the corresponding content. For example, in the case of the example of FIG. 2, high-quality content is generated using the content A, B, C, and D. Details of this generation will be described later.

- FIG. 3 is a flowchart showing the overall processing flow of the high-quality content generation system according to the first embodiment.

- step S300 feature amount extraction for each content is performed. Details of the extraction are as described in the feature amount extraction means 100.

- step S301 the extracted feature values are collated between the contents, the contents are grouped, and grouping information is obtained. Details of the grouping are as described in the identical / derived content grouping means 101.

- step S302 high-quality content is generated from the grouping information and the content.

- FIG. 4 is a flowchart showing the flow of processing of the first form of the high-quality content generation unit 102.

- step S400 first, i, which is an index of a section, is set to 0 in step S400.

- step S401 grouping information related to the section i is read.

- the contents A, B, and C are associated with each other and the contents A and B are offset in the time direction.

- the content C can be obtained from the grouping information such that there is a t 1 offset in the time direction.

- step S402 it is checked whether or not the corresponding content exists. If there is no other corresponding content, it is necessary to generate high quality content that is output only from that content, and the process jumps to step S405. On the other hand, if the corresponding content exists as in the example of FIG. 2, the process proceeds to the next step S403.

- step S403 the quality evaluation value in the time interval corresponding to the interval i is calculated for each associated content.

- the quality evaluation value there are a plurality of methods for calculating the quality evaluation value, and details thereof will be described later.

- step S404 the quality evaluation value obtained in step S403 is compared between the contents, and the content with the highest quality is selected.

- step S405 the portion corresponding to the section i of the selected content is copied to the buffer for output. Then, encoding is performed with an appropriate output format. Note that the encoding into the output format may be performed after the high quality content is generated for a plurality of sections and then collectively into the output format.

- step S406 it is checked whether or not the section i is the last section. If the section i is not the last section, the section index i is incremented by 1, and the process returns to step S401. If it is the last section, the process is terminated.

- high-quality content can be generated.

- This section may include one frame. That is, high quality may be generated by evaluating quality for each frame.

- each frame may be divided into a plurality of regions, the quality for each region may be determined, and the content having the highest quality may be changed for each region.

- the frame may be divided into a plurality of blocks and the quality may be evaluated in units of blocks.

- the transition process may be performed so that both change smoothly in the vicinity of the boundary.

- the quality evaluation value is calculated from the bit amount allocated to the interval i and the encoding method.

- the amount of generated code in the time interval associated with the interval i of each corresponding content is examined.

- the quality evaluation value a value that increases as the generated code amount increases.

- the encoding structure of each content associated with the section i is different (for example, when the number of I pictures, P pictures, etc. is different), that amount is considered as the quality evaluation value.

- the generated code amount is different even if the quality is the same.

- H.264 is generally better even with the same generated code amount as compared with that encoded with MPEG-1.

- the quality evaluation value may reflect characteristics due to such a difference in encoding method. Note that how the quality evaluation value should be controlled depending on the difference in encoding and the difference in encoding structure can be determined by, for example, encoding the same content by a plurality of various methods and examining the relationship with the image quality. . Of course, a machine learning framework may be used in this process.

- the quality evaluation value is calculated by evaluating the magnitude of the coding distortion.

- the image quality of the image that is obtained by decoding the time interval associated with the interval i of each corresponding content is checked.

- encoding distortion can be quantified by using the method described in Document 1 (Japanese Patent Laid-Open No. 2005-159419, “Image processing apparatus and method, computer program and computer-readable storage medium”).

- the method for measuring the coding distortion is not limited to this, and any method can be used as long as the image quality can be determined using only the decoded image without using the original image.

- a quality evaluation value that decreases as the encoding distortion increases may be defined and used.

- image quality may be evaluated using quantization parameters. Since the image quality generally decreases when rough quantization is performed, the quality can be evaluated by extracting the encoding parameters relating to the quantization from the content. In this case, a quality evaluation value that decreases as the quantization parameter increases may be defined and used.

- the quality may be evaluated using the resolution.

- the quality may be evaluated using the frame rate. Since the higher the frame rate, the smoother the motion and the better the video quality, a quality evaluation value that increases as the frame rate increases may be defined and used.

- FIG. 5 is a flowchart showing the flow of processing of the second form of the high quality content generation means 102. Basically, step S423 is included instead of step S403 and step S404 in FIG. The other steps are the same as those in the flowchart of FIG. 4, and therefore step S423 will be described below.

- a pixel value is statistically processed between corresponding frames of the associated contents to generate a frame to be output.

- the pixel value at the pixel position of the output frame is calculated by averaging the values of the pixels existing at the same pixel position among the frames of the plurality of associated contents. By averaging in this way, noise components included in individual contents can be canceled out, and the quality of the output frame can be improved.

- pixel values may be obtained by excluding outlier as in M estimation. For example, if there is content with significantly different pixel values, the pixel value of the output frame may be obtained by averaging the pixel values of the content. In this case, for example, even when the derived content on which the telop is superimposed is associated, the output frame can be calculated without being affected by the telop.

- the quality evaluation value described in the description of step S403 in the flowchart of FIG. 3 may be calculated for each content, and statistical processing may be performed using only those satisfying a certain standard. Thereby, it is possible to eliminate the influence of content with extremely low quality.

- statistical processing may be performed after performing interpolation to match the resolution of the output frame.

- FIG. 6 is a flowchart showing a flow of processing of the third form of the high-quality content generation unit 102. Basically, step S443 is included instead of step S403 and step S404 in FIG. The other steps are the same as those in the flowchart of FIG. 4, and therefore step S443 will be described below.

- step S443 a super-resolution process is performed between corresponding frames of the associated content to generate an output frame. Specifically, after aligning pixels between frames, processing such as Blind deconvolution is performed to sharpen the frame and generate an output frame.

- FIG. 7 is a flowchart showing the processing flow of the operation of the fourth form of the high-quality content generation unit 102. Basically, steps S463 and S464 are included instead of steps S403 and S404 in FIG. The other steps are the same as those in the flowchart of FIG. 4, so steps S463 and S464 will be described below.

- step S463 the contents / frames are associated with each other.

- contents with different frame rates they do not completely match, so the correspondence between frames obtained by collation by the same / derived content grouping means 101 may be slightly shifted. For this reason, the correspondence is finely adjusted to increase the accuracy of collation. Details of this will be described later.

- FIG. 8 illustrates a case where content E and content F are grouped and output content is generated therefrom.

- the number of corresponding contents varies depending on the time position of the frame. Therefore, for an output frame at a time when a plurality of content frames are associated with each other, an output frame is generated using the plurality of frames.

- the generation method the above-described various methods can be used.

- frames / fields may not overlap at all between contents. In this case, as shown in FIG. 9, the frames / fields at the respective time positions are used as they are as output frames. In this way, a frame of high quality content is generated.

- step S463 details of the frame / field association processing in step S463 will be described using a flowchart.

- FIG. 10 is a flowchart showing the process flow of step S463.

- the frame rate between contents is adjusted by frame interpolation processing. Specifically, the frame rate is increased to the least common multiple (for example, 30 fps for 10 fps and 15 fps) of the frame rate between contents.

- a frame interpolation method at this time, a method of linear interpolation according to a temporal distance from the preceding and following frames, or an interpolation frame is generated from the preceding and following frames by compensating for the motion of the object.

- the covered area can only be associated with the previous frame in time, and conversely, the newly appearing area can only be associated with the later frame in time. In this case, the pixel value of one area

- the interpolation process is performed with a field structure.

- step S601 feature quantities of each frame / field are extracted.

- the feature quantity extracted at this time may be the same as that used in the feature quantity extraction unit 100 or may be different. Since it is necessary to perform fine alignment in the time axis direction, it is desirable that the feature amount be sensitive to a deviation in the time axis direction.

- step S602 feature amounts are collated between contents, and frame / field correspondence is determined. Originally, even if this processing is not performed, the position in the time direction is almost corresponding between the contents, so that the position with the best collation score may be selected by moving the position slightly back and forth. In this way, it is possible to associate frames / fields even between contents having different frame rates.

- step S463 Next, another method of frame / field association processing in step S463 will be described using a flowchart.

- FIG. 11 is a flowchart showing the process flow of step S463.

- a spatiotemporal slice image of each content is generated.

- a spatio-temporal slice image is a plane with a constant horizontal coordinate value or a fixed vertical coordinate value when video content is regarded as horizontal, vertical and temporal three-dimensional data. It is a flat surface that can be created when cut by a flat surface.

- FIG. 12 shows a plane cut at a constant coordinate value in the horizontal direction.

- a spatiotemporal slice image is interpolated. As in step S600, interpolation in the time direction is performed using the least common multiple of the frame rate between contents (for example, 30 fps for 10 fps and 15 fps).

- step S622 global motion estimation is performed on the spatiotemporal slice image after the interpolation processing only by parallel movement in the time direction between contents.

- a normal block matching-based method may be used, or a Hough transform-like method may be used.

- the amount of displacement in the time direction of the spatiotemporal image is obtained. According to this value, the frame / field association between contents may be performed.

- FIG. 13 is a flowchart showing the flow of processing of the fifth form of the high-quality content generation unit 102. Basically, steps S483 and S484 are included instead of steps S403 and S404 in FIG. The other steps are the same as those in the flowchart of FIG. 4, so steps S483 and S484 will be described below.

- step S483 a spatiotemporal slice image of each content is generated in the same manner as in step S620. Then, a super-resolution process is performed on the spatiotemporal image to generate a high-quality spatiotemporal slice image.

- step S484 an output frame is generated by sampling the high-quality spatiotemporal slice image at the time position of the output frame. From one high-quality spatio-temporal slice image, the pixel value of the output frame can be obtained only on a certain straight line corresponding to the cut end. Therefore, a high quality spatio-temporal slice image corresponding to an arbitrary straight line parallel to the straight line is generated, and the pixel value of the output frame is calculated. Thereby, an output frame of a high quality image is generated.

- the operation of the high-quality content generation unit 102 has been described above, but it goes without saying that the above methods may be used in combination.

- the best image quality may be selected by comparing the image quality of high quality content created by the above-described plurality of methods. Or you may change the system used for every area and every area

- the user can view high-quality content without searching for high-quality content by himself / herself.

- the quality of content determined to be the same is determined for each section, and the highest quality is selected or high quality content is generated. The user can view the high-quality content on the entire content without taking the trouble of switching to high-quality content one by one.

- the high-quality content generation system includes a feature amount extraction unit 100, an identical / derived content grouping unit 101, a high-quality content generation unit 102, a correspondence correction unit 150, and content storage.

- the content storage unit 105 stores a plurality of contents, and is connected to the feature amount extraction unit 100 and the high-quality content generation unit 102.

- the feature amount extraction unit 100 receives the content from the content storage unit 105, obtains the feature amount for the content, and outputs the feature amount to the same / derived content grouping unit 101.

- the same / derived content grouping unit 101 receives the feature amount of the content output from the feature amount extraction unit 100, obtains content link information representing the link relationship between the feature amounts, and obtains correspondence relationship adjustment unit as grouping information To 150.

- Correspondence correction unit 150 receives content from content storage unit 105, receives grouping information from identical / derived content grouping unit 101, corrects the content link information included in the grouping information, and The grouping information is output to the high-quality content generation unit 102.

- the high quality content generation unit 102 receives the grouping information from the identical / derived content grouping unit 101, receives the content from the content storage unit 105, and generates and outputs the high quality content.

- Correspondence relation correcting means 150 corrects the correspondence relation between contents output from the same / derived content grouping means 101. This is because the link relationship obtained by the comparison between the feature amounts may slightly deviate (about several frames) from the correct correspondence relationship. Specifically, based on the correspondence relationship between the contents output from the identical / derived content grouping means 101, the contents are collated again to correct this deviation. As this method, the method described in the description of step S463 in the flowchart of FIG. 7 can be used. The grouping information including the corrected correspondence relationship is output to the correspondence relationship correcting means 150.

- the high-quality content can be reliably generated by correcting the correspondence.

- each unit of the high-quality content generation system is configured by hardware, but may be configured by an information processing apparatus that operates by a program.

- the program causes the information processing apparatus to execute the operation of each unit described above.

- the user can view high-quality content from the beginning to the end of the content.

- the reason is that the quality of the content is judged for each section and the highest quality is selected, or the high quality is created from the same content to improve the quality of the content as a whole and provided to the user. It is to do. For this reason, the user can view the high-quality content with respect to the entire content without taking the trouble of switching to high-quality content one by one.

- the first aspect of the present invention is a feature amount extracting unit that extracts a feature amount of content from a plurality of contents, and a feature amount of a plurality of contents extracted by the feature amount extracting unit.

- Content grouping means for performing collation, grouping the same content included in the plurality of content and derived content produced using the content, and calculating the same / derived content grouping information, and the same / derived

- a high-quality content generation system comprising: high-quality content generation means for selecting content grouped by content grouping information from the plurality of contents and generating content with better quality using the selected content is there.

- the content is content having a time axis

- the content grouping unit performs grouping of the same / derived content for each time interval by the collation, and the same / Derived content grouping information is calculated, and the high-quality content generation means generates content with better quality for each time interval using the selected content.

- the content is music or video.

- the feature amount of the content includes at least one of a visual feature amount and an acoustic feature amount.

- the high-quality content generation unit evaluates the quality of the selected content for each time interval, and the time interval corresponding to the same interval between the selected contents. By comparing the quality of the content and selecting and joining the time intervals of the high-quality content, the content with better quality is generated.

- the high-quality content generation unit determines the evaluation of quality for each time interval based on an encoding bit amount and an encoding method assigned to the time interval. .

- the high-quality content generation unit determines the evaluation of quality for each time interval by an evaluation index for evaluating the magnitude of coding distortion.

- the high-quality content generation unit evaluates the quality of the selected content for each time interval and for each intra-frame region, and the same interval between the selected contents. By comparing the quality between the time intervals corresponding to, and selecting and connecting the time intervals and the intra-frame regions of the high-quality content, content with better quality is generated.

- the high-quality content generation means evaluates the quality of each intra-frame area according to the encoding bit amount and the encoding scheme assigned to the intra-frame area. judge.

- the high-quality content generation means determines the quality evaluation for each intra-frame region by using an evaluation index for evaluating the magnitude of coding distortion.

- the evaluation index for evaluating the magnitude of the coding distortion is a coding parameter that defines the roughness of quantization.

- the high-quality content generation unit generates content with better quality by using the highest-resolution content when the selected content has a different resolution.

- the high-quality content generation unit generates high-quality content by generating a high-quality frame by performing statistical processing of pixel values between corresponding frames. To do.

- the high-quality content generation means uses the super-resolution technique between corresponding frames when the resolution of the selected content is different. To generate content with better quality.

- the high-quality content generating means uses the content with the highest frame rate when the selected content has a different frame rate to obtain a content with better quality. Generate.

- the high-quality content generation unit includes a case where a plurality of corresponding frames or fields exist between the selected contents when the selected content has a different frame rate.

- the frame or field having the highest quality is selected or a frame or field is generated by performing statistical processing on the corresponding frame or field, and there are no corresponding frames or fields. In this case, by selecting the frame or field, content with better quality is generated.

- the high-quality content generation means determines the evaluation of quality for each frame or field based on an evaluation index for evaluating the magnitude of coding distortion.

- the high-quality content generation unit generates a spatiotemporal slice image for each of the selected contents when the selected content has a different frame rate, and the selection Content with better quality after adjusting the correspondence between frames or fields between the content by estimating motion components parallel to the time axis direction between corresponding spatio-temporal slice images between the corresponding content Generate.

- the high-quality content generation unit generates a spatiotemporal slice image for each selected content when the selected content has a different frame rate, and the selection A high-quality spatio-temporal slice image is generated by using a super-resolution technique between corresponding spatio-temporal slice images between the generated contents, and the high-quality spatio-temporal slice image is re-sampled to increase the frame rate Generate content.

- content grouped by the same / derived content grouping information output from the content grouping means is selected from the plurality of contents, and the same / derived Correspondence correction means for correcting the correspondence relationship between the selected contents based on the content grouping information and outputting the corrected identical / derived content grouping information, and generating the high quality content

- the means inputs the modified identical / derived content grouping information instead of the identical / derived content grouping information.

- a feature amount extraction step for extracting feature amounts of content from a plurality of contents and a feature amount of the extracted plurality of contents are collated, and the same content included in the plurality of contents and A content grouping step of grouping derived content produced using the content and calculating the same / derived content grouping information, and content grouped by the same / derived content grouping information

- a high-quality content generation method including a high-quality content generation step of generating content with better quality using the selected content.

- the content is content having a time axis

- the content grouping step performs grouping of the same / derived content for each time interval by the collation, and the same / Derived content grouping information is calculated, and the high-quality content generation step generates content with better quality for each time interval using the selected content.

- the content grouped by the same / derived content grouping information calculated in the content grouping step is selected from the plurality of contents, and the same / derived A correspondence correction step of correcting the correspondence relationship between the selected contents based on the content grouping information and calculating the corrected identical / derived content grouping information, and generating the high-quality content

- the step uses the modified identical / derived content grouping information instead of the identical / derived content grouping information.

- a feature amount extraction process for extracting a feature amount of content from a plurality of contents and a feature amount of the extracted plurality of contents are collated, and the same content included in the plurality of contents and Content grouping processing for determining derived content produced using the content and calculating the same / derived content grouping information, and content grouped by the same / derived content grouping information

- a high-quality content generation program that causes an information processing apparatus to execute high-quality content generation processing that selects content from content and generates content with better quality using the selected content.

- the content is content having a time axis

- the content grouping process groups the same / derived content for each time interval by the collation, and the same / Derived content grouping information is calculated, and the high-quality content generation processing generates content with better quality for each time interval using the selected content.

- content grouped by the same / derived content grouping information calculated in the content grouping process is selected from the plurality of contents, and the same / derived Correcting the correspondence of the sections between the selected contents based on the content grouping information, causing the information processing apparatus to execute a correspondence correction process for calculating the corrected identical / derived content grouping information,

- the high-quality content generation process uses the modified identical / derived content grouping information instead of the identical / derived content grouping information.

- the present invention can be applied to uses such as a system or a program that generates higher-quality content using content accessible from the network and provides it to the user. Further, the above uses are not limited to the network, and can be similarly applied to content stored in the same hard disk recorder when the same or derived content exists.

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Databases & Information Systems (AREA)

- Human Computer Interaction (AREA)

- Information Retrieval, Db Structures And Fs Structures Therefor (AREA)

- Two-Way Televisions, Distribution Of Moving Picture Or The Like (AREA)

- Information Transfer Between Computers (AREA)

- Television Signal Processing For Recording (AREA)

Abstract

Description

101 同一/派生コンテンツグループ化手段

102 高品質コンテンツ生成手段

105 コンテンツ蓄積手段

150 対応関係修正手段

Claims (26)

- 複数のコンテンツからコンテンツの特徴量を抽出する特徴量抽出手段と、

前記特徴量抽出手段で抽出した複数コンテンツの特徴量間で照合を行い、前記複数コンテンツ中に含まれる同一コンテンツおよびそのコンテンツを使って制作された派生コンテンツをグループ化し、同一/派生コンテンツグループ化情報を算出するコンテンツグループ化手段と、

前記同一/派生コンテンツグループ化情報でグループ化されるコンテンツを前記複数のコンテンツの中から選択し、選択されたコンテンツを用いて品質がよりよいコンテンツを生成する高品質コンテンツ生成手段と

を有する高品質コンテンツ生成システム。 - 前記コンテンツが時間軸を有するコンテンツであり、

前記コンテンツグループ化手段は、前記照合によって時間区間ごとに同一/派生コンテンツのグループ化を行い、前記同一/派生コンテンツグループ化情報を算出し、

前記高品質コンテンツ生成手段は、前記選択されたコンテンツを用いて、時間区間ごとに品質がよりよいコンテンツを生成する

請求項1に記載の高品質コンテンツ生成システム。 - 前記コンテンツが、音楽または映像である請求項2に記載の高品質コンテンツ生成システム。

- 前記コンテンツの特徴量が、視覚特徴量、又は音響特徴量の少なくとも1つを含む請求項3に記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、前記選択されたコンテンツの品質を時間区間ごとに評価し、前記選択されたコンテンツ同士の同一区間に対応する時間区間の間で品質を比較し、高品質なコンテンツの時間区間を選んでつなぎ合わせていくことによって品質がよりよいコンテンツを生成する請求項2から請求項4のいずれかに記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、時間区間ごとの品質の評価を、その時間区間に割り当てられている符号化ビット量と符号化方式とによって判定する請求項5に記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、時間区間ごとの品質の評価を、符号化歪みの大きさを評価する評価指標によって判定する請求項5に記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、前記選択されたコンテンツの品質を時間区間ごとおよびフレーム内領域ごとに評価し、前記選択されたコンテンツ同士の同一区間に対応する時間区間の間で品質を比較し、高品質なコンテンツの時間区間およびフレーム内領域を選んでつなぎ合わせていくことによって品質がよりよいコンテンツを生成する請求項2から4に記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、フレーム内領域ごとの品質の評価を、そのフレーム内領域に割り当てられている符号化ビット量と符号化方式とによって判定する請求項8に記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、フレーム内領域ごとの品質の評価を、符号化歪みの大きさを評価する評価指標によって判定する請求項8に記載の高品質コンテンツ生成システム。

- 前記符号化歪みの大きさを評価する評価指標が、量子化の粗さを規定する符号化パラメータである請求項7または請求項10に記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、前記選択されたコンテンツの解像度が異なる場合に、最も高い解像度のコンテンツを用いることによって品質がよりよいコンテンツを生成する請求項2から請求項4のいずれかに記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、対応するフレーム間で画素値の統計処理を行って高品質なフレームを生成することによって品質がよりよいコンテンツを生成する請求項2から請求項4のいずれかに記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、前記選択されたコンテンツの解像度が異なる場合に、対応するフレーム間で超解像技術を用いることによって高品質なフレームを生成することによって品質がよりよいコンテンツを生成する請求項2から請求項4のいずれかに記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、前記選択されたコンテンツのフレームレートが異なる場合に、最も高いフレームレートのコンテンツを用いることによって品質がよりよいコンテンツを生成する請求項2から請求項4のいずれかに記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、前記選択されたコンテンツのフレームレートが異なる場合、前記選択されたコンテンツ間で対応するフレームまたはフィールドが複数存在する場合にはその中でもっとも品質がよいフレームまたはフィールドを選択するか、あるいは前記対応するフレームまたはフィールドに対して統計処理を行うことによってフレームまたはフィールドを生成し、対応するフレームまたはフィールドが複数存在しない場合には、そのフレームまたはフィールドを選択することにより、品質がよりよいコンテンツを生成する請求項2から請求項4のいずれかに高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、フレームまたはフィールドごとの品質の評価を、符号化歪みの大きさを評価する評価指標によって判定する請求項16に記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、前記選択されたコンテンツのフレームレートが異なる場合、前記選択されたコンテンツごとに時空間スライス画像を生成し、前記選択されたコンテンツ間で対応する時空間スライス画像間で時間軸方向に平行な動き成分を推定することによって、前記コンテンツ間のフレームまたはフィールド間の対応付けを調整してから前記品質がよりよいコンテンツを生成する請求項16に記載の高品質コンテンツ生成システム。

- 前記高品質コンテンツ生成手段は、前記選択されたコンテンツのフレームレートが異なる場合、前記選択されたコンテンツごとに時空間スライス画像を生成し、前記選択されたコンテンツ間で対応する時空間スライス画像間で超解像技術を用いることによって高品質な時空間スライス画像を生成し、前記高品質な時空間スライス画像をサンプリングしなおすことによってフレームレートが高いコンテンツを生成する請求項2から請求項4のいずれかに記載の高品質コンテンツ生成システム。

- 前記コンテンツグループ化手段から出力される同一/派生コンテンツグループ化情報でグループ化されるコンテンツを前記複数のコンテンツの中から選択し、前記同一/派生コンテンツグループ化情報に基づいて前記選択されたコンテンツ間で区間の対応関係の修正を行って、修正された同一/派生コンテンツグループ化情報を出力する対応関係修正手段を有し、

前記高品質コンテンツ生成手段は、前記同一/派生コンテンツグループ化情報の代わりに前記修正された同一/派生コンテンツグループ化情報を入力とする

請求項2から請求項19に記載の高品質コンテンツ生成システム。 - 複数のコンテンツからコンテンツの特徴量を抽出する特徴量抽出ステップと、

前記抽出した複数コンテンツの特徴量間で照合を行い、前記複数コンテンツ中に含まれる同一コンテンツおよびそのコンテンツを使って制作された派生コンテンツをグループ化し、同一/派生コンテンツグループ化情報を算出するコンテンツグループ化ステップと、

前記同一/派生コンテンツグループ化情報でグループ化されるコンテンツを前記複数のコンテンツの中から選択し、選択されたコンテンツを用いて品質がよりよいコンテンツを生成する高品質コンテンツ生成ステップと

を有する高品質コンテンツ生成方法。 - 前記コンテンツが時間軸を有するコンテンツであり、

前記コンテンツグループ化ステップは、前記照合によって時間区間ごとに同一/派生コンテンツのグループ化を行い、前記同一/派生コンテンツグループ化情報を算出し、

前記高品質コンテンツ生成ステップは、前記選択されたコンテンツを用いて、時間区間ごとに品質がよりよいコンテンツを生成する

請求項21に記載の高品質コンテンツ生成方法。 - 前記コンテンツグループ化ステップで算出される同一/派生コンテンツグループ化情報でグループ化されるコンテンツを前記複数のコンテンツの中から選択し、前記同一/派生コンテンツグループ化情報に基づいて前記選択されたコンテンツ間で区間の対応関係の修正を行って、修正された同一/派生コンテンツグループ化情報を算出する対応関係修正ステップを有し、

前記高品質コンテンツ生成ステップは、前記同一/派生コンテンツグループ化情報の代わりに前記修正された同一/派生コンテンツグループ化情報を用いる

請求項21又は請求項22に記載の高品質コンテンツ生成方法。 - 複数のコンテンツからコンテンツの特徴量を抽出する特徴量抽出処理と、

前記抽出した複数コンテンツの特徴量間で照合を行い、前記複数コンテンツ中に含まれる同一コンテンツおよびそのコンテンツを使って制作された派生コンテンツを求めてグループ化し、同一/派生コンテンツグループ化情報を算出するコンテンツグループ化処理と、

前記同一/派生コンテンツグループ化情報でグループ化されるコンテンツを前記複数のコンテンツの中から選択し、選択されたコンテンツを用いて品質がよりよいコンテンツを生成する高品質コンテンツ生成処理と

を情報処理装置に実行させる高品質コンテンツ生成プログラム。 - 前記コンテンツが時間軸を有するコンテンツであり、

前記コンテンツグループ化処理は、前記照合によって時間区間ごとに同一/派生コンテンツのグループ化を行い、前記同一/派生コンテンツグループ化情報を算出し、

前記高品質コンテンツ生成処理は、前記選択されたコンテンツを用いて、時間区間ごとに品質がよりよいコンテンツを生成する

請求項24に記載の高品質コンテンツ生成プログラム。 - 前記コンテンツグループ化処理で算出される同一/派生コンテンツグループ化情報でグループ化されるコンテンツを前記複数のコンテンツの中から選択し、前記同一/派生コンテンツグループ化情報に基づいて前記選択されたコンテンツ間で区間の対応関係の修正を行って、修正された同一/派生コンテンツグループ化情報を算出する対応関係修正処理を情報処理装置に実行させ、

前記高品質コンテンツ生成処理は、前記同一/派生コンテンツグループ化情報の代わりに前記修正された同一/派生コンテンツグループ化情報を用いる

請求項24又は請求項25に記載の高品質コンテンツ生成プログラム。

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2010517913A JP5648800B2 (ja) | 2008-06-26 | 2009-06-16 | 高品質コンテンツ生成システムと、その方法及びプログラム |

| US13/001,378 US8879004B2 (en) | 2008-06-26 | 2009-06-16 | High-quality content generation system, method therefor, and program |

| CN200980124217.0A CN102077582B (zh) | 2008-06-26 | 2009-06-16 | 高品质内容生成系统及其方法和程序 |

| EP09770050A EP2306718A4 (en) | 2008-06-26 | 2009-06-16 | METHOD FOR PRODUCING QUALITY CONTENTS, METHOD THEREFOR AND PROGRAM |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2008-167345 | 2008-06-26 | ||

| JP2008167345 | 2008-06-26 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2009157340A1 true WO2009157340A1 (ja) | 2009-12-30 |

Family

ID=41444408

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2009/060909 WO2009157340A1 (ja) | 2008-06-26 | 2009-06-16 | 高品質コンテンツ生成システムと、その方法及びプログラム |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US8879004B2 (ja) |

| EP (1) | EP2306718A4 (ja) |

| JP (2) | JP5648800B2 (ja) |

| CN (1) | CN102077582B (ja) |

| WO (1) | WO2009157340A1 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2013157268A1 (ja) * | 2012-04-20 | 2013-10-24 | パナソニック株式会社 | コンテンツ管理装置、コンテンツ管理方法、プログラム、およびコンテンツの表示方法 |

Families Citing this family (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR101969583B1 (ko) | 2012-01-10 | 2019-08-20 | 삼성전자주식회사 | 컨텐츠 관리 방법과 장치 및 기록 매체 |

| US10078888B2 (en) * | 2016-01-15 | 2018-09-18 | Fluke Corporation | Through-focus image combination |

| JP6559870B1 (ja) * | 2018-11-30 | 2019-08-14 | 株式会社ドワンゴ | 動画合成装置、動画合成方法及び動画合成プログラム |

| KR102126514B1 (ko) * | 2019-04-10 | 2020-06-24 | 삼성전자주식회사 | 컨텐츠 관리 방법과 장치 및 기록 매체 |

Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2000259832A (ja) * | 1999-01-06 | 2000-09-22 | Nec Corp | 画像特徴量生成装置、画像検索装置、並びにその生成方法及び検索方法 |

| JP2000339474A (ja) * | 1999-05-27 | 2000-12-08 | Nec Corp | 動画像類似度算出装置および方法 |

| JP2003333484A (ja) * | 2002-05-15 | 2003-11-21 | Nec Corp | 番組録画再生システム、番組録画再生方法および番組録画再生プログラム |

| JP2005159419A (ja) | 2003-11-20 | 2005-06-16 | Canon Inc | 画像処理装置及び方法、並びにコンピュータプログラム及びコンピュータ可読記憶媒体 |

| JP2006115264A (ja) * | 2004-10-15 | 2006-04-27 | Xanavi Informatics Corp | デジタル放送の送出装置、受信装置およびデジタル放送システム |

| JP2008167345A (ja) | 2007-01-04 | 2008-07-17 | Nec Saitama Ltd | 音声信号の出力方法、スピーカシステム、携帯機器及びコンピュータプログラム |

Family Cites Families (14)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US5657402A (en) * | 1991-11-01 | 1997-08-12 | Massachusetts Institute Of Technology | Method of creating a high resolution still image using a plurality of images and apparatus for practice of the method |

| US5724453A (en) * | 1995-07-10 | 1998-03-03 | Wisconsin Alumni Research Foundation | Image compression system and method having optimized quantization tables |

| US5953506A (en) * | 1996-12-17 | 1999-09-14 | Adaptive Media Technologies | Method and apparatus that provides a scalable media delivery system |

| WO1999063760A1 (en) * | 1998-05-30 | 1999-12-09 | Sgs-Thomson Microelectronics Asia Pacific (Pte) Ltd. | Sequence adaptive bit allocation for pictures encoding |

| US6167084A (en) * | 1998-08-27 | 2000-12-26 | Motorola, Inc. | Dynamic bit allocation for statistical multiplexing of compressed and uncompressed digital video signals |

| WO2000045603A1 (fr) * | 1999-01-29 | 2000-08-03 | Sony Corporation | Procede de traitement des signaux et dispositif de traitement de signaux video/vocaux |

| JP4157340B2 (ja) * | 2002-08-27 | 2008-10-01 | 松下電器産業株式会社 | 送信装置、受信装置を含む放送システム、受信装置、及びプログラム。 |

| ATE397831T1 (de) * | 2003-01-06 | 2008-06-15 | Koninkl Philips Electronics Nv | Echtzeit-aufzeichnungssystem von datenströmen aus dem internet |

| EP1513353A3 (en) * | 2003-09-05 | 2008-10-08 | Matsushita Electric Industrial Co., Ltd. | Video stream processing apparatus and video stream processing method |

| JP4600209B2 (ja) * | 2005-08-18 | 2010-12-15 | ソニー株式会社 | 画像処理方法、画像処理装置、プログラムおよび記録媒体 |

| EP1990996A4 (en) * | 2006-03-01 | 2010-10-27 | Pioneer Corp | INFORMATION REPRODUCING DEVICE, METHOD AND PROGRAM, AND RECORDING MEDIUM |

| JP4490483B2 (ja) * | 2006-05-09 | 2010-06-23 | 日本電信電話株式会社 | 映像品質推定装置、方法、およびプログラム |

| CN101021857A (zh) * | 2006-10-20 | 2007-08-22 | 鲍东山 | 基于内容分析的视频搜索系统 |

| US20090320081A1 (en) * | 2008-06-24 | 2009-12-24 | Chui Charles K | Providing and Displaying Video at Multiple Resolution and Quality Levels |

-

2009

- 2009-06-16 CN CN200980124217.0A patent/CN102077582B/zh not_active Expired - Fee Related

- 2009-06-16 EP EP09770050A patent/EP2306718A4/en not_active Ceased

- 2009-06-16 US US13/001,378 patent/US8879004B2/en not_active Expired - Fee Related

- 2009-06-16 WO PCT/JP2009/060909 patent/WO2009157340A1/ja active Application Filing

- 2009-06-16 JP JP2010517913A patent/JP5648800B2/ja not_active Expired - Fee Related

-

2014

- 2014-07-23 JP JP2014149712A patent/JP5928747B2/ja not_active Expired - Fee Related

Patent Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2000259832A (ja) * | 1999-01-06 | 2000-09-22 | Nec Corp | 画像特徴量生成装置、画像検索装置、並びにその生成方法及び検索方法 |

| JP2000339474A (ja) * | 1999-05-27 | 2000-12-08 | Nec Corp | 動画像類似度算出装置および方法 |

| JP2003333484A (ja) * | 2002-05-15 | 2003-11-21 | Nec Corp | 番組録画再生システム、番組録画再生方法および番組録画再生プログラム |

| JP2005159419A (ja) | 2003-11-20 | 2005-06-16 | Canon Inc | 画像処理装置及び方法、並びにコンピュータプログラム及びコンピュータ可読記憶媒体 |

| JP2006115264A (ja) * | 2004-10-15 | 2006-04-27 | Xanavi Informatics Corp | デジタル放送の送出装置、受信装置およびデジタル放送システム |

| JP2008167345A (ja) | 2007-01-04 | 2008-07-17 | Nec Saitama Ltd | 音声信号の出力方法、スピーカシステム、携帯機器及びコンピュータプログラム |

Non-Patent Citations (1)

| Title |

|---|

| See also references of EP2306718A4 * |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2013157268A1 (ja) * | 2012-04-20 | 2013-10-24 | パナソニック株式会社 | コンテンツ管理装置、コンテンツ管理方法、プログラム、およびコンテンツの表示方法 |

| JPWO2013157268A1 (ja) * | 2012-04-20 | 2015-12-21 | パナソニック インテレクチュアル プロパティ コーポレーション オブアメリカPanasonic Intellectual Property Corporation of America | コンテンツ管理装置、コンテンツ管理方法、プログラム、およびコンテンツの表示方法 |

Also Published As

| Publication number | Publication date |

|---|---|

| EP2306718A4 (en) | 2012-08-08 |

| EP2306718A1 (en) | 2011-04-06 |

| CN102077582B (zh) | 2014-04-16 |

| JP5648800B2 (ja) | 2015-01-07 |

| JP2014220836A (ja) | 2014-11-20 |

| US20110149169A1 (en) | 2011-06-23 |

| JPWO2009157340A1 (ja) | 2011-12-08 |

| CN102077582A (zh) | 2011-05-25 |

| US8879004B2 (en) | 2014-11-04 |

| JP5928747B2 (ja) | 2016-06-01 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5928747B2 (ja) | 高品質コンテンツ生成システムと、その方法及びプログラム | |

| CN102326391B (zh) | 多视点图像编码装置及方法、多视点图像译码装置及方法 | |

| US10003768B2 (en) | Apparatus and methods for frame interpolation based on spatial considerations | |

| US9049420B1 (en) | Relative quality score for video transcoding | |

| CN110546953B (zh) | 复杂度自适应单程转码与双程转码 | |

| EP3176749A2 (en) | Efficient image processing on content-adaptive pq signal domain | |

| JP5144545B2 (ja) | 動画像コーデック装置及びその方法 | |

| US10354394B2 (en) | Dynamic adjustment of frame rate conversion settings | |

| JP2006174415A (ja) | 画像復号装置、画像復号プログラム、画像復号方法、画像符号化装置、画像符号化プログラム及び画像符号化方法 | |

| US7421129B2 (en) | Image compression and synthesis for video effects | |

| JP2014174834A (ja) | 情報処理装置、クラウドプラットフォーム、情報処理方法およびそのプログラム | |

| JP2003018603A (ja) | 動画像符号化方法及び装置 | |

| CN102265607A (zh) | 图像缩放曲线生成 | |

| JP4490374B2 (ja) | 映像品質評価装置および方法 | |

| US20030202780A1 (en) | Method and system for enhancing the playback of video frames | |

| JP5313326B2 (ja) | 画像復号装置、方法およびプログラム、並びに、画像符号化装置、方法およびプログラム | |

| EP3329678B1 (en) | Method and apparatus for compressing video data | |

| CN113748683A (zh) | 用于在压缩视频文件中保存带内元数据的系统和方法 | |

| US20160044328A1 (en) | Apparatus and method of compressing and restoring image using filter information | |

| US20210274231A1 (en) | Real-time latency measurement of video streams | |

| US9398314B2 (en) | Entropy coding efficiency enhancement utilizing energy distribution remapping | |

| US20030081679A1 (en) | Image interpolation | |

| EP2320663A1 (en) | Image display device, image recording and reproduction device, and image processing method | |

| JP6078431B2 (ja) | 映像品質推定装置、映像品質推定方法及びプログラム | |

| JP6071618B2 (ja) | 画像処理装置及びプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| WWE | Wipo information: entry into national phase |

Ref document number: 200980124217.0 Country of ref document: CN |

|

| 121 | Ep: the epo has been informed by wipo that ep was designated in this application |

Ref document number: 09770050 Country of ref document: EP Kind code of ref document: A1 |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 2010517913 Country of ref document: JP |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 2009770050 Country of ref document: EP |

|

| NENP | Non-entry into the national phase |

Ref country code: DE |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 13001378 Country of ref document: US |