KR20220161601A - 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정시스템 - Google Patents

딥러닝 모델을 이용한 영상검사 대상체의 결함 판정시스템 Download PDFInfo

- Publication number

- KR20220161601A KR20220161601A KR1020210068549A KR20210068549A KR20220161601A KR 20220161601 A KR20220161601 A KR 20220161601A KR 1020210068549 A KR1020210068549 A KR 1020210068549A KR 20210068549 A KR20210068549 A KR 20210068549A KR 20220161601 A KR20220161601 A KR 20220161601A

- Authority

- KR

- South Korea

- Prior art keywords

- defect

- deep learning

- image

- pattern

- learning model

- Prior art date

Links

- 230000007547 defect Effects 0.000 title claims abstract description 223

- 238000013136 deep learning model Methods 0.000 title claims abstract description 72

- 238000007689 inspection Methods 0.000 title claims abstract description 58

- 238000000034 method Methods 0.000 claims description 52

- 238000013135 deep learning Methods 0.000 claims description 19

- 238000012360 testing method Methods 0.000 claims description 12

- 238000012549 training Methods 0.000 claims description 12

- 230000002950 deficient Effects 0.000 claims description 9

- 238000013434 data augmentation Methods 0.000 claims description 6

- 230000003321 amplification Effects 0.000 claims description 3

- 238000003199 nucleic acid amplification method Methods 0.000 claims description 3

- 238000003384 imaging method Methods 0.000 claims description 2

- 230000006870 function Effects 0.000 description 26

- 238000010586 diagram Methods 0.000 description 22

- 238000007726 management method Methods 0.000 description 20

- 238000005516 engineering process Methods 0.000 description 18

- 230000008569 process Effects 0.000 description 17

- 238000013473 artificial intelligence Methods 0.000 description 13

- 210000004027 cell Anatomy 0.000 description 13

- 238000013527 convolutional neural network Methods 0.000 description 12

- 238000001514 detection method Methods 0.000 description 9

- 238000010801 machine learning Methods 0.000 description 9

- 238000007781 pre-processing Methods 0.000 description 9

- 238000012545 processing Methods 0.000 description 9

- 238000011161 development Methods 0.000 description 8

- 230000003287 optical effect Effects 0.000 description 7

- 241000282412 Homo Species 0.000 description 6

- 238000011179 visual inspection Methods 0.000 description 6

- 238000013528 artificial neural network Methods 0.000 description 5

- 230000008859 change Effects 0.000 description 5

- 239000000284 extract Substances 0.000 description 5

- 210000002569 neuron Anatomy 0.000 description 5

- 238000011160 research Methods 0.000 description 4

- 230000000694 effects Effects 0.000 description 3

- 238000000605 extraction Methods 0.000 description 3

- 238000003860 storage Methods 0.000 description 3

- 238000012384 transportation and delivery Methods 0.000 description 3

- 230000003416 augmentation Effects 0.000 description 2

- 230000006872 improvement Effects 0.000 description 2

- 238000004519 manufacturing process Methods 0.000 description 2

- 238000005457 optimization Methods 0.000 description 2

- 238000011176 pooling Methods 0.000 description 2

- 238000003908 quality control method Methods 0.000 description 2

- 238000012552 review Methods 0.000 description 2

- 239000000523 sample Substances 0.000 description 2

- 230000004913 activation Effects 0.000 description 1

- 239000008186 active pharmaceutical agent Substances 0.000 description 1

- 238000013459 approach Methods 0.000 description 1

- 230000008901 benefit Effects 0.000 description 1

- 239000003518 caustics Substances 0.000 description 1

- 238000006243 chemical reaction Methods 0.000 description 1

- 238000004891 communication Methods 0.000 description 1

- 230000006835 compression Effects 0.000 description 1

- 238000007906 compression Methods 0.000 description 1

- 238000010924 continuous production Methods 0.000 description 1

- 238000013480 data collection Methods 0.000 description 1

- 238000013523 data management Methods 0.000 description 1

- 238000013500 data storage Methods 0.000 description 1

- 230000007423 decrease Effects 0.000 description 1

- 238000009826 distribution Methods 0.000 description 1

- 238000002474 experimental method Methods 0.000 description 1

- 230000010354 integration Effects 0.000 description 1

- 238000013507 mapping Methods 0.000 description 1

- 238000012544 monitoring process Methods 0.000 description 1

- 239000010813 municipal solid waste Substances 0.000 description 1

- 210000001328 optic nerve Anatomy 0.000 description 1

- 230000008520 organization Effects 0.000 description 1

- 150000003071 polychlorinated biphenyls Chemical class 0.000 description 1

- 230000008439 repair process Effects 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

- 238000012706 support-vector machine Methods 0.000 description 1

- 210000000225 synapse Anatomy 0.000 description 1

- 230000000946 synaptic effect Effects 0.000 description 1

- 238000012546 transfer Methods 0.000 description 1

- 230000007306 turnover Effects 0.000 description 1

Images

Classifications

-

- G06K9/6267—

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/764—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using classification, e.g. of video objects

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01N—INVESTIGATING OR ANALYSING MATERIALS BY DETERMINING THEIR CHEMICAL OR PHYSICAL PROPERTIES

- G01N21/00—Investigating or analysing materials by the use of optical means, i.e. using sub-millimetre waves, infrared, visible or ultraviolet light

- G01N21/84—Systems specially adapted for particular applications

- G01N21/88—Investigating the presence of flaws or contamination

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01N—INVESTIGATING OR ANALYSING MATERIALS BY DETERMINING THEIR CHEMICAL OR PHYSICAL PROPERTIES

- G01N21/00—Investigating or analysing materials by the use of optical means, i.e. using sub-millimetre waves, infrared, visible or ultraviolet light

- G01N21/84—Systems specially adapted for particular applications

- G01N21/88—Investigating the presence of flaws or contamination

- G01N21/95—Investigating the presence of flaws or contamination characterised by the material or shape of the object to be examined

- G01N21/956—Inspecting patterns on the surface of objects

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/24—Classification techniques

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N20/00—Machine learning

- G06N20/20—Ensemble learning

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

- G06N3/096—Transfer learning

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T19/00—Manipulating 3D models or images for computer graphics

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T19/00—Manipulating 3D models or images for computer graphics

- G06T19/006—Mixed reality

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/98—Detection or correction of errors, e.g. by rescanning the pattern or by human intervention; Evaluation of the quality of the acquired patterns

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/98—Detection or correction of errors, e.g. by rescanning the pattern or by human intervention; Evaluation of the quality of the acquired patterns

- G06V10/987—Detection or correction of errors, e.g. by rescanning the pattern or by human intervention; Evaluation of the quality of the acquired patterns with the intervention of an operator

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/98—Detection or correction of errors, e.g. by rescanning the pattern or by human intervention; Evaluation of the quality of the acquired patterns

- G06V10/993—Evaluation of the quality of the acquired pattern

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Software Systems (AREA)

- General Engineering & Computer Science (AREA)

- Evolutionary Computation (AREA)

- Life Sciences & Earth Sciences (AREA)

- General Health & Medical Sciences (AREA)

- Data Mining & Analysis (AREA)

- Artificial Intelligence (AREA)

- Health & Medical Sciences (AREA)

- Computing Systems (AREA)

- Multimedia (AREA)

- Quality & Reliability (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Mathematical Physics (AREA)

- Molecular Biology (AREA)

- Computer Hardware Design (AREA)

- Computer Graphics (AREA)

- Biomedical Technology (AREA)

- Biophysics (AREA)

- Computational Linguistics (AREA)

- Analytical Chemistry (AREA)

- Immunology (AREA)

- Biochemistry (AREA)

- Pathology (AREA)

- Chemical & Material Sciences (AREA)

- Medical Informatics (AREA)

- Bioinformatics & Cheminformatics (AREA)

- Bioinformatics & Computational Biology (AREA)

- Evolutionary Biology (AREA)

- Databases & Information Systems (AREA)

- Image Analysis (AREA)

Abstract

본 발명에 따른 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템은 영상검사 대상체에 대한 이미지 정보를 획득하고, 상기 획득한 이미지 정보를 복수의 결함 패턴들 중 어느 하나의 결함 패턴으로 분류하는 이미지 패턴 분류기; 및 상기 복수의 결함 패턴들에 대응하는 각각의 딥러닝 모델들 중 상기 분류된 결함 패턴에 대응하는 YOLO(You Only Look Once) 알고리즘이 적용된 딥러닝 모델들에 상기 획득한 이미지 정보를 인가하여 상기 영상검사 대상체에 대한 결함 여부를 결정하는 결함 판정장치를 포함하는 것을 특징으로 한다.

Description

본 발명은 영상검사 대상체의 검사 기술에 관한 것으로, 보다 상세하게는 딥러닝 모델 방식을 이용하여 영상검사 대상체의 결함을 용이하게 판정할 수 있도록 하는 기술이다.

[이 발명을 지원한 연구개발사업]

[과제고유번호]Y2020007

[부처명] 경기도

[연구관리전문기관] 경기도경제과학진흥원

[연구사업명] 전략산업기술개발

[연구과제명] 인공지능 기술 기반 자동 결함 분류 시스템 개발

[기여율] 1/1

[주관기관] ㈜솔루션에이

[연구기간] 2020. 9. 1. ~ 2021.8. 31.

영상검사 대상체, PCB 등과 같은 제품의 이미지로부터 기계 학습을 이용하여 결함을 분류하는 기술은 Smart Factory에 필수적인 기술이다. 제품의 결함을 실시간으로 분석한 후 분석된 결함 종류에 따라서 생산 시스템에 피드백 함으로써 불량 원인을 제거할 수 있어서 결과적으로 연속 공정에서의 대량 불량을 획기적으로 감소시킬 수 있다. 또한 작업조건에 따른 불량 패턴을 분석함으로써 공정 최적화를 할 수 있다.

최근에, 광학 검사기를 이용하거나, 숙련된 작업자가 육안 검사를 통해 영상검사 대상체에 대한 결함 여부를 판정하고 있다.

그런데, 광학 검사기의 경우에는 렌즈 왜곡으로 인하여 영상에 Vignetting 현상 및 Moire 현상이 발생하게 되며, 이러한, 비정형 패턴 등에 의해 가성결함이 다량 발생하게 되며, 평균 10% 내지 15% 정도 발생하게 된다. 이에 따라, 가성결함을 줄이기 위해 Recipe를 느슨하게 유지하는 경우에는 가성 결함을 발생하지 않으나, 실제 결함이 있는 영상검사 대상체에 대한 검출에 실패할 수 있다.

한편, 작업자의 육안 검사에 의해 결함 여부를 판정할 경우에는, 작업자의 숙련도 및 컨디션에 따라 결함 판정의 품질 편차가 발생한다. 또한, 육안 검사에 따른 작업자의 피로도가 상당하여 작업자의 이직률이 지속적으로 발생되며, 이에 따라 숙련된 작업자의 확보가 어렵고, 새로운 작업자에 대한 채용 및 교육에 많은 자원이 추가로 소요된다는 점에서 문제점이 있다.

본 발명이 해결하고자 하는 기술적 과제는 영상검사 대상체의 결함을 용이하게 판정할 수 있도록 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템에 관한 것이다.

상기의 과제를 해결하기 위한 본 발명에 따른 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템은 영상검사 대상체에 대한 이미지 정보를 획득하고, 상기 획득한 이미지 정보를 복수의 결함 패턴들 중 어느 하나의 결함 패턴으로 분류하는 이미지 패턴 분류기; 및 상기 복수의 결함 패턴들에 대응하는 각각의 딥러닝 모델들 중 상기 분류된 결함 패턴에 대응하는 YOLO(You Only Look Once) 알고리즘이 적용된 딥러닝 모델들에 상기 획득한 이미지 정보를 인가하여 상기 영상검사 대상체에 대한 결함 여부를 결정하는 결함 판정장치를 포함하는 것을 특징으로 한다.

상기 복수의 결함 패턴들은 상기 영상검사 대상체의 포인트 결함 패턴, 라인 결함 패턴 및 무라(mura) 결함 패턴을 포함하고, 상기 이미지 패턴 분류기는 상기 이미지 정보에 대해 상기 포인트 결함 패턴, 상기 라인 결함 패턴 및 상기 무라(mura) 결함 패턴 중 어느 하나로 분류하는 것을 특징으로 한다.

상기 결함 판정장치는, 상기 딥러닝 모델들로서, 상기 포인트 결함 패턴에 따라 상기 YOLO(You Only Look Once) 알고리즘에 대응하는 제1 딥러닝 모델, 상기 라인 결함 패턴에 따라 상기 YOLO(You Only Look Once) 알고리즘에 대응하는 제2 딥러닝 모델 및 상기 무라(mura) 결함 패턴에 따라 상기 YOLO(You Only Look Once) 알고리즘에 대응하는 제3 딥러닝 모델을 각각 포함하는 것을 특징으로 한다.

상기 결함 판정장치는, 상기 이미지 정보에서 상기 무라 결함패턴의 증폭을 위한 설정값을 상기 무라 결함패턴이 선명해지는 값으로 자동 변경하면서 상기 무라 결함패턴을 판정하는 것을 특징으로 한다.

상기 결함 판정장치는, 결함패턴을 자동으로 판정하면서 판정에 사용된 이미지들을 지속적으로 저장하고, 상기 저장된 이미지들을 상기 딥러닝 모델들에 프로그램적으로 자동으로 인가해서 딥러닝 학습을 자동으로 반복적으로 수행하도록 하여, 상기 딥러닝 모델을 최적화하는 것을 특징으로 한다.

상기 결함 판정장치는, 결함패턴 판정에 대한 검수자의 최종 판단결과정보를 입력받고, 상기 입력된 최종 판단결과정보를 상기 딥러닝 모델들에 프로그램적으로 자동으로 인가해서 딥러닝 학습을 자동으로 반복적으로 수행하도록 하여, 상기 딥러닝 모델을 최적화하는 것을 특징으로 한다.

상기 결함 판정장치는, 상기 딥러닝 모델들에 대해, 앙상블(Ensemble) 모델을 적용하여 구현된 것을 특징으로 한다.

상기 결함 판정장치는, 상기 제1 딥러닝 모델, 상기 제2 딥러닝 모델 및 상기 제3 딥러닝 모델 각각의 학습을 위해 사용되는 학습 이미지에 대해 데이터 증강(Data Augmentation) 기법에 의해 획득한 정보를 사용하는 것을 특징으로 한다.

상기 데이터 증강(Data Augmentation) 기법은, 상기 학습 이미지의 회전, 확대, 좌우반전, 상하반전, 가로이동, 세로이동 및 그 조합 중 적어도 둘 이상을 통해 획득하는 것을 특징으로 한다.

상기 이미지 패턴 분류기의 검사 결과정보 및 상기 결함 판정장치의 판정 결과정보를 디스플레이 화면에 표시하고, 작업자의 명령을 입력받기 위한 유저 인터페이스를 제공하는 작업자 인터페이스 장치를 더 포함하는 것을 특징으로 한다.

상기 이미지 패턴 분류기의 검사 결과정보 및 상기 결함 판정장치의 판정 결과정보에 대한 저장 및 관리를 수행하는 정보 관리장치를 더 포함하는 것을 특징으로 한다.

본 발명에 의하면, 이미지 패턴 분류기에서 영상검사 대상체의 이미지 정보에 대해 포인트 결함 패턴, 라인 결함 패턴 및 무라(mura) 결함 패턴 중 어느 하나로 분류하고, 이를 각각의 YOLO(You Only Look Once) 알고리즘에 대응하는 딥러닝 모델들에 인가하여 영상검사 대상체의 결함 여부를 판정할 수 있도록 함으로써, 종래의 이미지 패턴 분류기의 결함 판정 오류를 개선하고, 작업자의 육안 검사 비율을 감시시킴에 따라 작업자의 피로도를 낮출 수 있는 효과가 있다.

구체적으로, 본 발명에 따르면, 딥러닝 모델들을 통해 제품의 영상을 학습하여 스스로 정형 및 비정형의 불량 판독을 용이하게 수행할 수 있다.

또한, 딥러닝 모델들을 통해 인간의 직관과 경험으로 판단하는 그레이존 불량을 사람보다 정확한 판정 및 분류 수행으로 가성 불량에 대해 5% 미만으로 최소화할 수 있다.

또한, 각기 다른 경험과 직관을 가진 작업자들에 의한 품질 관리를 대신하여 딥러닝 모델들을 이용함으로써, 외부 상황에 영향을 받지 않고 획일화된 품질 관리를 수행할 수 있다.

도 1은 본 발명에 따른 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템을 설명하기 위한 구성블록도이다.

도 2는 도 1에 도시된 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템의 전체 공정을 설명하기 위한 개념도이다.

도 3은 도 1에 도시된 결함 판정 시스템의 전체 공정을 설명하기 위한 절차도이다.

도 4a 및 도 4b는 이미지 패턴 분류기에 의해 검출된 이미지 정보를 예시하는 참조도이다.

도 5a 내지 도 5d는 이미지 패턴 분류기에 의해 분류되는 복수의 결함 패턴들을 예시하는 참조도이다.

도 6은 도 1에 도시된 결함 판정장치를 설명하기 위한 구성 블록도이다.

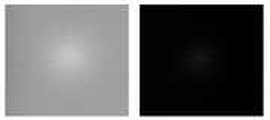

도 7은 결함 판정장치에서 설정값의 자동 변경에 따른 무라 결함 패턴을 판정하는 것을 설명하기 위한 일 예의 무라 패턴 이미지이다.

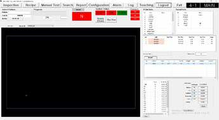

도 8은 도 1에 도시된 작업자 인터페이스 장치를 설명하기 위한 구성 블록도이다.

도 9a 내지 도 9c는 작업자 인터페이스 장치에 의해 표시되는 정보를 예시하는 참조도이다.

도 10은 도 1에 도시된 정보 관리장치를 설명하기 위한 구성 블록도이다.

도 11은 정보 관리장치에 의해 표시되는 정보를 예시하는 참조도이다.

도 12는 본 발명에 따른 결함 판정 시스템의 또 다른 기능을 설명하기 위한 구성블록도이다.

도 13은 도 12에 도시된 구성 블록도에 의해 수행되는 기능을 나타내는 참조도이다.

도 2는 도 1에 도시된 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템의 전체 공정을 설명하기 위한 개념도이다.

도 3은 도 1에 도시된 결함 판정 시스템의 전체 공정을 설명하기 위한 절차도이다.

도 4a 및 도 4b는 이미지 패턴 분류기에 의해 검출된 이미지 정보를 예시하는 참조도이다.

도 5a 내지 도 5d는 이미지 패턴 분류기에 의해 분류되는 복수의 결함 패턴들을 예시하는 참조도이다.

도 6은 도 1에 도시된 결함 판정장치를 설명하기 위한 구성 블록도이다.

도 7은 결함 판정장치에서 설정값의 자동 변경에 따른 무라 결함 패턴을 판정하는 것을 설명하기 위한 일 예의 무라 패턴 이미지이다.

도 8은 도 1에 도시된 작업자 인터페이스 장치를 설명하기 위한 구성 블록도이다.

도 9a 내지 도 9c는 작업자 인터페이스 장치에 의해 표시되는 정보를 예시하는 참조도이다.

도 10은 도 1에 도시된 정보 관리장치를 설명하기 위한 구성 블록도이다.

도 11은 정보 관리장치에 의해 표시되는 정보를 예시하는 참조도이다.

도 12는 본 발명에 따른 결함 판정 시스템의 또 다른 기능을 설명하기 위한 구성블록도이다.

도 13은 도 12에 도시된 구성 블록도에 의해 수행되는 기능을 나타내는 참조도이다.

이하에서는 도면을 참조하여 본 발명의 바람직한 실시예들을 상세히 설명한다. 이하 설명 및 첨부된 도면들에서 실질적으로 동일한 구성요소들은 각각 동일한 부호들로 나타냄으로써 중복 설명을 생략하기로 한다. 또한 본 발명을 설명함에 있어 관련된 공지기능 혹은 구성에 대한 구체적인 설명이 본 발명의 요지를 불필요하게 흐릴 수 있다고 판단되는 경우 그에 대한 상세한 설명은 생략하기로 한다.

본 발명과 관련하여, 인공지능(AI)은 인간의 직관과 경험으로 판단하는 그레이존에 해당하는 불량에 대해 사람보다 더 정밀하게 판정 및 분류를 수행한다. 이는 다수의 결함 데이터를 기반으로 결함을 비교하면서 영상 속에서 스스로 패턴을 찾아 기존의 Rule Based 방식처럼 정형화된 규칙 속에서 판정 및 분류를 하는 게 아니라 인간처럼 추상화하여 대상을 판정 및 분류를 할 수 있기에 기존의 광학 검사기와 인간보다 더 정밀한 판정 및 분류 수행이 가능하다. 검사 및 판정결과를 DB화하여 이후, 공정 개선에 활용할 수 있으며, 이를 바탕으로 자동 레시피 설정 가능하다.

개발하는 시스템은 TFT LCD, OLED 등 디스플레이 점등 검사에서 기존의 자동 이미지 패턴 분류기가 불량으로 판정한 제품에 대해 Deep Learning 및 Machine Learning 기술을 적용한 인공지능 결함 재분류 시스템을 개발하여, 불량 제품 중 가성 불량에 대해서만 작업자가 육안검사를 진행하도록 도와주는 시스템을 제공하고자 한다.

도 1은 본 발명에 따른 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템(이하, 결함 판정 시스템(100)이라 칭한다)을 설명하기 위한 구성블록도이고, 도 2는 도 1에 도시된 결함 판정 시스템(100)의 전체 공정을 설명하기 위한 개념도이다. 도 3은 도 1에 도시된 결함 판정 시스템(100)의 전체 공정을 설명하기 위한 절차도이다.

도 1을 참조하면, 결함 판정 시스템(100)은 이미지 패턴 분류기(110), 결함 판정장치(120), 작업자 인터페이스장치(130) 및 정보 관리장치(140)를 포함한다.

이미지 패턴 분류기(110)는 점등 검사 방식을 이용하여 영상검사 대상체의 결함 여부에 대한 이미지 정보를 획득한다. 일반적으로, 이미지 패턴 분류기(110)는 다양한 패턴을 인가하여 나타난 영상검사 대상체의 패턴에 따른 불량을 검사하는 장치이다. 다만, 이러한, 이미지 패턴 분류기(110)는렌즈 왜곡으로 인하여 영상에 Vignetting 현상 및 Moire 현상이 발생할 수 있다.

이미지 패턴 분류기(110)는 전기식 평면디스플레이 검사로 제조 공정에서 제품의 불량 여부를 검사하여 신뢰도를 향상하게 시키거나, 불량 제품에 대해 공정 중간에 검출해 부분적 수리를 통해 불량률을 감소시키는 목적을 갖는다. 이는 전기신호를 인가한 뒤, 대상물의 동작을 관찰하는 검사로, 검사 대상의 전극에 접촉하여 전기적 신호를 인가하는 프로브 유닛을 이용하여 검사한다.

기존의 디스플레이 점등 검사 방법은 검사 요청이 들어오면, AP(Auto Probe) 장비가 Cell을 점등 검사 할 수 있도록 Cell을 Contactor를 정렬(Align) 및 안착을 한 후 Data/Gate Line 전극에 일괄 접촉해 PG(Pattern Generator)와 BLU(Back Light Unit)를 이용해 Cell을 점등한 후 광학 검사를 하여, Cell의 불량을 검출한다.

이미지 패턴 분류기(110)는 미검출을 줄이기 위해 검사 레시피를 강하게 적용하게 되면, 정상 제품에 대해서도 불량이라고 검출하는 가성 불량이 많이 발생하게 되며, 이를 줄이기 위해 검사 레시피를 약하게 적용하게 되면, 실제 불량을 검출하지 못해 불량 제품이 정상 제품으로 나가는 경우가 있다.

이는, 자동 이미지 패턴 분류기의 Rule-Based 기반 알고리즘으로 인한 Trade-Off 현상으로, 인간이 작성한 정형화된 규칙을 기반으로 검사를 진행하다 보니, 정해진 규칙 내에서는 검사를 잘하지만 새로운 유형의 제품 혹은 불량에 대해서는 검사가 어려움이 있다.

이를 해소하기 위한 본 발명에 따른 이미지 패턴 분류기(110)에 대한 상세 내용은 다음과 같다.

도 4a 및 도 4b는 이미지 패턴 분류기(110)에 의해 검출된 이미지 정보를 예시하는 참조도이다.

이미지 패턴 분류기(110)는 데이터베이스에 저장되어 있는 데이터를 기반으로 광학 검사를 진행할 수 있다. 검사가 완료된 결함 영상은 데이터베이스에 저장하고, 결함 데이터는 결함 판정장치(120)에서 결함 판정을 위해 전송하고, 기타 다른 구성요소에서 테스트 할 수 있도록 지원한다.

본 발명에서의 이미지 패턴 분류기(110)는 상기 획득한 이미지 정보에 대해 복수의 결함 패턴들 중 어느 하나의 결함 패턴으로 분류한다. 상기 복수의 결함 패턴들은 상기 영상검사 대상체의 포인트 결함 패턴, 라인 결함 패턴 및 무라(mura) 결함 패턴을 포함한다.

도 5a 내지 도 5d는 이미지 패턴 분류기에 의해 분류되는 복수의 결함 패턴들을 예시하는 참조도이다.

이미지 패턴 분류기(110)는 상기 이미지 정보에 대해 상기 포인트 결함 패턴, 상기 라인 결함 패턴 및 상기 무라(mura) 결함 패턴 중 어느 하나로 분류한다.

결함 판정장치(120)는 상기 복수의 결함 패턴들에 대응하는 각각의 딥러닝 모델들 중 상기 분류된 결함 패턴에 대응하는 딥러닝 모델에 상기 획득한 이미지 정보를 인가하여 상기 영상검사 대상체에 대한 결함 여부를 결정한다.

도 6은 도 1에 도시된 결함 판정장치(120)를 설명하기 위한 구성 블록도이다.

결함 판정장치(120)는 자동 판정을 위해, 결함 정보 및 결함 영상을 데이터베이스로부터 로드한다. 결함 판정장치(120)는 효과적인 결함 판정을 위해 CNN방식의 Deep Learning 엔진과 Machine Learning 엔진을 적용할 수 있다.

결함 판정장치(120)는 판정의 정확도를 높이기 위해, Machine Learning 엔진과 Deep Learning 엔진 모두 Ensemble Model을 이용하여 판정 기능을 구현할 수 있다.

Machine Learning의 경우 분류에 해당하는 부분은 기계가 스스로 패턴을 찾아 규칙을 만들지만, 대상의 특징을 추출하는 과정은 사람이 직접 추출하게 된다.

Deep Learning의 경우는 분류 및 특징 추출하는 과정 모두 기계가 스스로 패턴을 찾아 규칙을 만들어 제시한다.

모델링 시 사람의 개입이 들어가게 되면 결함과 배경 구분을 위한 완벽한 모델링이 어려우며, 이로 인해 과결함이 발생할 수 있다.따라서 기계가 스스로 대상의 다수 케이스들간의 비교를 통해 특징 값을 추출하여 스스로 패턴에 대한 규칙을 찾아 모델링을 하게 되면, 그레이존에서의 판정이 인간보다 더 좋은 성능을 나타내며, 일관성 있는 결과를 얻을 수 있다.

CNN(Convolutional Neural Network)은 생물의 시신경이 동작하는 원리에서 영감을 얻어 이미지 데이터의 처리에 적합한 구조로 만들어진 신경망으로, 1990년대 후반부터 필기 숫자 인식, 얼굴 인식 등의 제한적인 어플리케이션에 활용되어왔다. 이후 딥러닝 기술이 본격 궤도에 오르면서, 2012년 ImageNet Challenge에서 딥 CNN이 기존의 컴퓨터 비전 기술을 크게 앞서는 성능을 냄으로써, 고해상도의 자연 이미지에서도 일반적인 사물을 인식할 수 있는 수준에 이르게 되었다.

현재 구글, 네이버를 비롯한 유수의 국내외 IT 기업에서 사진 자동 분류, 내용 기반 이미지 검색 등의 서비스에 널리 활용되고 있으며, 동영상 분류, 이미지-텍스트 멀티모달 학습 등으로 영역을 꾸준히 확장해나가고 있다.

CNN은 다음 그림과 같이 크게 convolution-pooling layer와 fully connected layer의 두 부분으로 구성되어 있다. 전자는 입력된 이미지로부터 계층적 구조의 feature를 추출하는 역할을, 후자는 추출된 feature를 입력받아 타겟 클래스로 분류하는 역할을 담당한다.

CNN layer는 아래와 같은 두 가지 특징을 통해 이미지 데이터의 특성을 반영하는 동시에 모델의 복잡도를 크게 단순화시킨다.

1) Local connectivity: 가장 일반적인 형태인 fully connected layer와 달리, 해당 convolution 필터의 크기인 NxN window 내의 인접한 뉴런들에만 연결이 되어있다. 이는 인접한 픽셀들끼리는 상관관계가 높지만 멀리 떨어진 픽셀들은 그렇지 않은 이미지의 특성(locality)을 반영한 것이다.

2) Shared weights: convolution 필터들은 적용되는 위치가 달라도 같은 weight값을 공유한다. 이는 픽셀값의 통계적 특성이 이미지상의 좌표와 무관하다는 이미지의 특성(stationarity)을 반영한 것이다. Pooling layer는 NxN 윈도 내의 입력값들을 그 최댓값 또는 평균값으로 매핑함으로써 이미지의 크기를 점차적으로 줄인다. 그 결과 상위 layer로 올라갈수록 같은 크기의 convolution 필터가 상대적으로 넓은 영역을 처리하게 되어, 상위 layer에서는 하위 layer의 저차원 feature를 조합한 고차원 feature를 학습하는 효과를 가져온다.

딥러닝의 핵심 아이디어는 기존에는 복잡한 문제를 풀기 위해서 특징 추출과 패턴 분류의 두 단계로 분리하여 문제를 해결하던 방식을 하나의 단계로 통합하여 해결하는 자동화로 볼 수 있다.

기존에는 먼저 데이터 전처리 및 가공을 통해서 문제 해결에 적합한 특징들을 추출한 다음, 이를 학습 데이터로 하여 패턴 분류기를 훈련하는 두 개의 단계로 문제를 해결하였다. 딥러닝 구조는 특징 추출을 위한 전처리 단계를 전체 학습 프로세스에 포함함으로써 가공되지 않은 원래 데이터를 직접 학습하도록 하는 통합된 문제 해결 방식을 취한다. 딥러닝 구조는 특히 영상 데이터와 같이 차원 수가 아주 크고 복잡한 데이터의 경우에 전처리 과정을 통해서 손실될 수도 있는 정보를 기계가 자동으로 추출해서 활용할 수 있다. 즉 기존의 전처리 방법이나 소위 feature engineering을 통해 배제되었던 해의 영역조차도 딥러닝은 탐색함으로써 더욱 유용한 정보를 추출하여 활용할 수 있다.

딥러닝과 같이 다층구조의 복잡한 신경망이 유용하리라는 것은 과거에도 알고 있었다. 뉴런의 수를 증가하거나 층의 수를 증가시킴으로써 더욱 복잡한 패턴 분류 경계면을 생성해 낼 수 있기 때문이다. 과거에도 다층구조의 신경망을 활용하려는 시도가 없었던 것은 아니다. 그러나 실험적으로 층의 수를 늘림으로써 학습 시간은 늘어나는 데 반해서 성능향상은 얻지 못하였었다. 또한, 이론적으로 한 개의 은닉층만을 사용하여도 무한히 많은 수의 뉴런을 사용하면 임의의 복잡한 함수도 근사할 수 있다는 Universal Function Approximator 정리가 1989년에 증명되었다. 또한, 1990년대에 Support Vector Machine이 등장하여 아주 빠른 학습이 가능한 shallow network로 많은 문제를 해결할 수 있었다.

근래에는, 컴퓨팅 파워가 좋아져서 예전에 할 수 없었던 아주 고난도의 학습 실험을 수행할 수 있기 때문이다. 또한, 가용한 학습 데이터가 무한히 많아져서 아주 많은 데이터를 학습시킴으로써 아무리 복잡한 모델구조도 과다학습을 하지 않게 만들 수 있기 때문이다. 여기에, 무엇보다도 대규모 데이터로 대규모 모델을 학습시키는 효율을 향상할 수 있는 여러 가지 학습 구조와 학습 알고리즘적 기술들이 개발되었다.

이러한 새로운 기술들이 차원 수의 저주 문제, 과다학습 문제, Vanishing Gradient 문제, Non-convex 최적화 문제, 느린 학습 속도 등의 이슈를 일부 해결하였다. 이 문제를 해결하는 데 핵심적으로 이바지한 혁신은 크게 세 가지를 들 수 있다. 첫 번째는, 많은 수의 층으로 구성된 다층신경망을 학습할 수 있는 기술을 개발한 것이다. 다층 망을 학습시키는 오류 역전파 알고리즘이 층을 많이 쌓으면 학습이 잘되지 않았다. 출력에 가까운 층에서는 오류의 값이 커서 교정이 되지만 아래층으로 오류가 역전파 되면서 에러의 값이 줄어들어 변경 효과가 희석되는 vanishing gradient 문제가 발생한다. 따라서 아주 많은 수의 층을 쓰는 딥 네트워크는 오류 역전파 알고리즘으로 학습이 어렵다. 최근에서야 이 문제를 극복하는 방안으로 층별 선훈련(layerwise pre-training) 방법이 제안되었다. 이는 상위층을 학습하기 전에 먼저 하위층의 시냅스를 학습시켜 둔다. 이렇게 차례대로 하위층부터 학습시킴으로써 Vanishing Gradient 문제로 인해서 하위층의 시냅스 학습이 잘 안 되는 문제점을 해결한다. 이 방법은 Deep Belief Network (DBN)에서 사용한다. 두 번째는 영상과 같이 차원 수가 아주 높은 데이터로부터 유용한 특징과 표현을 자동으로 추출하기 위해 컨볼루션 커널(convolution kernels)을 도입한 것이다. 이를 통해서 위치가 달라도 같은 파라미터 값을 갖도록 함으로써 파라미터의 수를 줄임으로써 학습해야 하는 차원의 수를 줄인다. 이 방법은 Convolutional Neural Network (CNN)에서 사용하는 방법이다. 이 방법은 과도학습을 방지하면서 유용한 특징을 추출할 수 있는 장점이 있다. 세 번째로, 학습 방법을 변경하는 대신에 새로운 뉴런 활성화 함수를 가진 유닛을 도입한 것이다. ReLU유닛(rectified linear units), 즉, 정류 선형유닛은 뉴런이 선형적으로 활성화되어 큰 값을 가질 수 있게 함으로써 경사도가 상수가 되도록 함으로써 오류 역전파를 해도 경사도가 사라지지 않도록 하는 효과가 있다.

결함 판정장치(120)는 학습 단계에서 적은 수의 영상으로 학습을 극대화 시키기 위해 Image Augmentation 수행 후 다수의 영상을 생성 기능을 구현할 수 있다.

결함 판정장치(120)는 상기 딥러닝 모델들로서, 상기 포인트 결함 패턴에 대응하는 제1 딥러닝 모델, 상기 라인 결함 패턴에 대응하는 제2 딥러닝 모델 및 상기 무라(mura) 결함 패턴에 대응하는 제3 딥러닝 모델을 각각 포함한다.

결함 판정장치(120)는 상기 딥러닝 모델들에 대해, CNN(Convolutional Neural Networks)방식의 딥러닝 모델로 구현된 것일 수 있다.

결함 판정장치(120)는 상기 딥러닝 모델들에 대해, 앙상블(Ensemble) 모델을 적용하여 구현된 것일 수 있다.

결함 판정장치(120)는 상기 제1 딥러닝 모델, 상기 제2 딥러닝 모델 및 상기 제3 딥러닝 모델 각각의 학습을 위해 사용되는 학습 이미지에 대해 데이터 증강(Data Augmentation) 기법에 의해 획득한 정보를 사용하는 것일 수 있다.

상기 데이터 증강(Data Augmentation) 기법은, 상기 학습 이미지의 회전, 확대, 좌우반전, 상하반전, 가로이동, 세로이동 및 그 조합 중 적어도 둘 이상을 통해 획득하는 것일 수 있다.

또한, 결함 판정장치(120)는 상기 복수의 결함 패턴들에 대응하는 각각의 딥러닝 모델들 중 상기 분류된 결함 패턴에 대응하는 YOLO(You Only Look Once) 알고리즘이 적용된 딥러닝 모델들에 상기 획득한 이미지 정보를 인가하여 상기 영상검사 대상체에 대한 결함 여부를 결정할 수 있다.

이때, 결함 판정장치(120)는 상기 딥러닝 모델들로서, 상기 포인트 결함 패턴에 따라 상기 YOLO(You Only Look Once) 알고리즘에 대응하는 제1 딥러닝 모델, 상기 라인 결함 패턴에 따라 상기 YOLO(You Only Look Once) 알고리즘에 대응하는 제2 딥러닝 모델 및 상기 무라(mura) 결함 패턴에 따라 상기 YOLO(You Only Look Once) 알고리즘에 대응하는 제3 딥러닝 모델을 각각 포함할 수 있다.

기존 Object Detection은 Classification 문제를 2단계를 나눠 검출(Two-shot-detection) 하여 정확도가 높았지만 네트워크를 여러번 호출 하였기에 속도는 빠르지 않다. 이에 따라, 결함 판정장치(120)는 YOLO알고리즘을 사용함으로써, One-stage 검출기를 이용하여 빠른 검출기를 구현할 수 있다. 즉, 하나의 이미지를 딱 한번만 신경망을 통과시켜 엄청나게 빠른 속도의 이미지 검출 방식을 사용한다.

또한, 결함 판정장치(120)는 상기 이미지 정보에서 상기 무라 결함패턴의 증폭을 위한 설정값을 상기 무라 결함패턴이 선명해지는 값으로 자동 변경하면서 상기 무라 결함패턴을 판정할 수 있다.

도 7은 결함 판정장치(120)에서 설정값의 자동 변경에 따른 무라 결함 패턴을 판정하는 것을 설명하기 위한 일 예의 무라 패턴 이미지이다. 도 7을 참조하면, 도 7의 (a)는 원본 이미지를 나타내고, 도 7의 (b), (c) 및 (d)는 각각 설정값의 변경에 따른 무라 결함패턴의 선명도가 증가하는 것을 예시하는 이미지이다. 도 7의 (d)는 설정값의 자동 변경에 따라 결함 판정장치(120)에서 가장 선명한 무라 결함패턴을 확인하고, 원본 이미지에 대한 결함을 판정한 예시이다.

또한, 결함 판정장치(120)는 결함패턴을 자동으로 판정하면서 판정에 사용된 이미지들을 지속적으로 저장하고, 상기 저장된 이미지들을 상기 딥러닝 모델들에 프로그램적으로 자동으로 인가해서 딥러닝 학습을 자동으로 반복적으로 수행하도록 하여, 상기 딥러닝 모델을 최적화할 수 있다.

또한, 결함 판정장치(120)는 결함패턴 판정에 대한 검수자의 최종 판단결과정보를 입력받고, 상기 입력된 최종 판단결과정보를 상기 딥러닝 모델들에 프로그램적으로 자동으로 인가해서 딥러닝 학습을 자동으로 반복적으로 수행하도록 하여,상기 딥러닝 모델을 최적화할 수 있다.

작업자 인터페이스장치(130)는 이미지 패턴 분류기(110)의 검사 결과정보 및 상기 결함 판정장치(120)의 판정 결과정보를 디스플레이 화면에 표시하고, 작업자의 명령을 입력받기 위한 유저 인터페이스를 제공한다.

도 8은 도 1에 도시된 작업자 인터페이스 장치를 설명하기 위한 구성 블록도이고, 도 9a 내지 도 9c는 작업자 인터페이스 장치에 의해 표시되는 정보를 예시하는 참조도이다.

작업자 인터페이스장치(130)는 각 판정 주체(AOI, S-ADJ, S-DRS)가 판정한 결과를 바탕으로 숙련자가 재판정할 수 있도록 하기 위한 UI 기능을 제공한다.

또한, 작업자 인터페이스장치(130)는 판정 주체(AOI, S-ADJ, S-DRS)의 교육용으로 활용할 수 있는 기능을 제공한다. 예를 들어, AOI 판정결과/ADJ 판정결과/작업자 판정결과를 비교하고, 판정 결과에 대한 통계 그래프를 통하여, 판정 주체의 취약점을 파악할 수 있도록 하고, AOI/ADJ 문제파악 및 작업자 재교육 여부 결정 및 재교육 기능을 수행할 수 있다.

정보 관리장치(140)는 이미지 패턴 분류기(110)의 검사 결과정보 및 상기 결함 판정장치(120)의 판정 결과정보에 대한 저장 및 관리를 수행한다.

도 10은 도 1에 도시된 정보 관리장치를 설명하기 위한 구성 블록도이고, 도 11은 정보 관리장치에 의해 표시되는 정보를 예시하는 참조도이다.

정보 관리장치(140)는 이미지 패턴 분류기(110)가 검사한 결함 영상을 수집하며, 관리하는 기능을 수행한다. 정보 관리장치(140)는 일정 주기가 지난 파일을 압축 및 삭제 기능 및 압축 주기 설정/변경 기능을 수행할 수 있다.

도 12는 본 발명에 따른 결함 판정 시스템의 또 다른 기능을 설명하기 위한 구성블록도이고, 도 13은 도 12에 도시된 구성 블록도에 의해 수행되는 기능을 나타내는 참조도이다.

AOI 판정 결과를 수신하여 S-ADJ 또는 S-DRS로 재판정을 위한 Job을 분배 + 결함 정보 관리 시스템을 제공한다. DB이용하여 결함 정보 및 판정 결과 관리 기능을 구현할 수 있다. 또한, 향후 빅데이터 시스템과 연계가 가능하다.

광학 검사 결과에 대하여 작업자가 육안으로 재검 및 재판정하는 시스템을 구현할 수 있다. 결함 영상에 대한 정보 표시, 및 AOI, ADJ 판정한 결과를 표시하여 작업자의 판정을 지원할 수 있다.

이하에서는 본 발명을 설계하기 위한 구체적인 내용을 개시한다.

제안하는 Smart ADJ Package는 아래와 같이 크게 4가지 시스템으로 구분할 수 있다.

ADJ System(Auto Defect Judgement)

AIJS(Again Inspection Judgement System)

DRS(Defect Review System)

DMS(Defect Management System)

AIJS(Again Inspection Judge System):

AOI/AI/작업자 간의 인터페이스 및 작업 관리 시스템

기존 자동 이미지 패턴 분류기와 인터페이스 역할을 해주는 관리 시스템 개발

자동 이미지 패턴 분류기, 제안 시스템, 작업자 판정한 결과에 대한 통계를 시각화하는 서비스 개발

AOI에 대한 정보를 TCP/IP 소켓 통신방법으로 AOI/ADJ간의 정보 전달 중계자 역할 수행

DRS Manager 기능으로 DRS에 작업을 분배

Data Collection 및 Defect Info & History Record 기능을 통해 결함에 대한 정보를 DB에 쌓아두며, 이를 통계형태로 활용하여 시각화하여 사용자에게 가시적으로 보여주는 기능 제공

ADJ System (Automatic Defect Judgement):

AI 자동 결함 판정 시스템

기존의 2차로 작업자가 육안검사를 하는 과정을 ADJ로 대체

Deep Learning 및 Machine Learning 기술을 활용하여 결함을 판정하는 시스템 개발

AI 자동 결함 판정 근거에 대한 누적된 Back Data를 Report형식으로 제공하여 판정결과 신뢰성 확보

요구기술: Machine Learning 및 Deep Learning 기술 (CNN) 기술, GPU 분산 처리 기술, 실시간 추론 기술

가공된 Training Dataset을 Image Processing 과정을 통해 영상들의 특징을 추출하는 동시에 이미지 처리된 영상을 획득

이미지 처리된 영상을 Image Augmentation 방법을 이용해 다수의 이미지를 생성

생성된 이미지를 다수의 CNN Model을 이용해 판정을 진행하고, 영상들의 특징을 추출한 데이터를 이용하여 Machine Learning Model을 이용하여 판정을 진행

모든 학습 모델의 판정이 완료되면 이를 한 번 더 Ensemble Model을 이용하여 최종 판정을 진행, 이렇게 판정된 결과를 바탕으로 판정 리포트를 작성

DRS (Defect Review System):

AOI/AI 결함 분류 결과 작업자 재판정 시스템

촬영된 영상에 대해 레이블링을 간편하게 할 수 있는 프로그램 개발

판정결과에 대한 DB를 활용하여, 숙련자를 양성하는 교육 시스템 개발

1) AIJS Manager로부터 받는 검사할 Cell 정보 및 작업자 정보 등을 표시.

2) 메인 화면에 Cell 전체 영상과 결함 위치를 표시. 각 Cell 영상은 확대 축소 및 이동이 가능

3) Defect Image List의 Image를 클릭하면 ④ 영역에 Defect Image에 대한 정보 표시

4) Defect Image에 대한 정보를 표시하며, 이미지 패턴 분류기, ADJ 및 작업자가 판정한 결과도 동시에 표시

5) 전체 Image에 대한 Pattern 변환

6) Defect과 Cell 재판정 버튼

AOI/ADJ/작업자 판정결과를 비교할 수 있으며, 해당 정보를 바탕으로 문제점 파악 및 작업자 재교육 여부 결정 및 재교육 가능

DMS (Defect Management System):

결함 데이터 저장 및 관리 시스템

자동 이미지 패턴 분류기에서 촬영된 영상을 수집하며, 관리하는 시스템 개발

History DB에서 압축/삭제 대상 파일 선정

대상 파일을 압축 및 삭제

파일 정리의 경우 1회/일 또는 사용자가 실행

쓰레기 파일을 정리하기 위해 1회/월 파일 Full Scan

관리 주기 등은 설정을 통해 변경 가능

가상 AOI

통합 테스트를 위한 가상의 검사 AOI

기존 AOI 일련의 과정을 가상의 검사 환경을 구성, 가상 AOI를 통하여 DMS에 저장된 결함 데이터를 기반으로 검사 진행 (기존에 DMS에 저장되어 있는 데이터를 기반으로 실제 AOI가 동작하는 일련의 과정을 동일하게 동작하는 기능 필요)

가상 AOI는 주관기관이 보유한 이미지 프로세싱 검사 기술과 결합하여 AI Model 학습을 위한 결함 데이터 전처리 기능이 추가되고 ADJ Mngr. 과 서로 통신이 가능한 가상 AOI 시뮬레이터 프로그램 임

지원하는 기능: 검사가 완료된 결함 데이터를 DMS에 저장, 검사가 완료된 결함 데이터를 ADJ의 DB에 전송, 검사가 완료된 결함 데이터를 ADJ System에서 테스트

Smart ADJ Package 데이터 흐름

1) 영상 촬영 지시

P-CIM에서 Cell에 대한 영상 촬영을 자동 이미지 패턴 분류기에 지시

2A) 영상 촬영 및 저장

자동 이미지 패턴 분류기기에서 Cell 대한 영상을 취득한 후 촬영된 원본 영상을 저장소에 저장

2B) 결함 검출

취득한 영상과 Rules-Based로 작성된 알고리즘을 바탕으로 결함 검출

검사 완료 후 검출된 결함 정보를 AIJS Manager에게 전송

2C) 재분류 지시

자동 이미지 패턴 분류기에서 결함 정보를 받으면 이에 대해 유효성 검사 및 관련 정보를 DB에 저장한 후, ADJ에게 결함 재분류 명령을 지시.

3) 이미지 로드

자동 이미지 패턴 분류기에서 전달받은 결함 정보를 바탕으로, 검사할 이미지를 찾아 로드

4) 이미지 전처리 및 결함 재분류

분류기에 전달하기 전에 결함 정보를 바탕으로 위치 및 결함 종류에 따른 이미지 전처리를 진행

전처리가 완료된 데이터를 분류기에 전달하여 각 결함에 대한 재분류를 수행

5) 결함 재분류 리포트 전달

결함에 대해 재분류가 완료되면, 도출된 정보에 대해서 리포트를 DB에 저장하고 완료 리포트를 AIJS Manager에게 전송

6) 결함 재분류 리포트 전달 및 등급 재산정

자동 이미지 패턴 분류기가 재분류 리포트를 받은 후, 제품의 등급을 재산정 함

7) 등급 재산정 정보 전달

제품 등급 재산정이 완료되면, AIJS Manager에 해당 정보를 전달

AIJS Manager는 전달받은 정보에 대해 DB에 저장

8) 작업 배분

등급 재산정이 완료된 Cell에 대해서 AIJS Manager는 작업자에게 업무를 배분

9) 작업자 검사

DRS를 이용하여 작업자가 배정받은 Cell에 대해서 검사한 후 결함 재분류 및 등급 재산정을 진행

작업자가 작업을 마친 Cell에 대해서는 AIJS Manager에 작업 정보가 전달되며, 해당 내용을 DB에 저장

UI:

일련의 과정에 대한 정보를 바탕으로 통계 내어 UI를 통해 시각화된 정보를 작업자와 관리자에게 제공

해당 데이터를 기반으로 신입 및 초보 작업자에 대한 교육이 가능

주 타깃 분야는 디스플레이 후 공정 점등 검사이지만 주요 기능별로 시스템을 나누어, 향후 디스플레이 전 공정 패턴 검사, 반도체 및 PCB 등 외관/패턴 검사에도 유연하게 적용할 수 있는 AI 공정 검사 솔루션을 개발

Smart ADJ-Package

향후 다양한 분야에서 간단하게 적용할 수 있게 각 주요 기능을 라이브러리 혹은 클래스 형태로 나누어 재활용할 수 있도록 설계

AIJS Framework는 Back-end에서 각종 정보 및 메시지를 수신하여 데이터를 저장 및 가공한 후 각 필요한 시스템에 전달하는 매개체 역할 및 관리 역할을 수행하게 되며, 이는 API 서버 역할과 유사

ADJ Core는 크게 영상 처리 알고리즘이 모아둔 Image Processing Library와 인공지능 알고리즘을 모아둔 AI Library로 나뉨

Image Processing Library는 기존의 자사가 보유하고 있던 영상 처리 기술 관련 기능을 모아둔 Library로 Deep Learning/Machine Learning 기술을 적용하기 전 성능을 극대화 시키기 위한 전처리 기술 혹은 비교적 간단하거나 효율성이 좋았던 검사 기능을 포함

AI Library는 검출, 분류, 군집화 등 인공지능 기술에 관련된 기능을 모아둔 Library로 전처리 과정이 완료된 데이터에 대해 결함에 대한 분류 혹은 검출 등을 수행하는 기능들을 포함

본 발명은 소프트웨어적인 프로그램으로 구현하여 컴퓨터로 읽을 수 있는 소정 기록매체에 기록해 둠으로써 다양한 재생장치에 적용할 수 있다. 다양한 재생장치는 PC, 노트북, 휴대용 단말 등일 수 있다. 예컨대, 기록매체는 각 재생장치의 내장형으로 하드디스크, 플래시 메모리, RAM, ROM 등이거나, 외장형으로 CD-R, CD-RW와 같은 광디스크, 콤팩트 플래시 카드, 스마트 미디어, 메모리 스틱, 멀티미디어 카드일 수 있다.

이상과 같이 본 발명의 실시예를 설명하였으나, 본 발명의 명세서에 개시된 실시예들은 본 발명을 한정하는 것이 아니다. 본 발명의 범위는 아래의 특허청구범위에 의해 해석되어야 하며, 그와 균등한 범위 내에 있는 모든 기술도 본 발명의 범위에 포함되는 것으로 해석해야 할 것이다.

100: 결함 판정 시스템

110: 이미지 패턴 분류기

120: 결함 판정장치

130: 작업자 인터페이스장치

140: 정보 관리장치

110: 이미지 패턴 분류기

120: 결함 판정장치

130: 작업자 인터페이스장치

140: 정보 관리장치

Claims (11)

- 영상검사 대상체에 대한 이미지 정보를 획득하고, 상기 획득한 이미지 정보를 복수의 결함 패턴들 중 어느 하나의 결함 패턴으로 분류하는 이미지 패턴 분류기; 및

상기 복수의 결함 패턴들에 대응하는 각각의 딥러닝 모델들 중 상기 분류된 결함 패턴에 대응하는 YOLO(You Only Look Once) 알고리즘이 적용된 딥러닝 모델들에 상기 획득한 이미지 정보를 인가하여 상기 영상검사 대상체에 대한 결함 여부를 결정하는 결함 판정장치를 포함하는 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템. - 청구항 1에 있어서,

상기 복수의 결함 패턴들은 상기 영상검사 대상체의 포인트 결함 패턴, 라인 결함 패턴 및 무라(mura) 결함 패턴을 포함하고,

상기 이미지 패턴 분류기는 상기 이미지 정보에 대해 상기 포인트 결함 패턴, 상기 라인 결함 패턴 및 상기 무라(mura) 결함 패턴 중 어느 하나로 분류하는 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템. - 청구항 2에 있어서,

상기 결함 판정장치는,

상기 딥러닝 모델들로서, 상기 포인트 결함 패턴에 따라 상기 YOLO(You Only Look Once) 알고리즘에 대응하는 제1 딥러닝 모델, 상기 라인 결함 패턴에 따라 상기 YOLO(You Only Look Once) 알고리즘에 대응하는 제2 딥러닝 모델 및 상기 무라(mura) 결함 패턴에 따라 상기 YOLO(You Only Look Once) 알고리즘에 대응하는 제3 딥러닝 모델을 각각 포함하는 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템. - 청구항 3에 있어서,

상기 결함 판정장치는,

상기 이미지 정보에서 상기 무라 결함패턴의 증폭을 위한 설정값을 상기 무라 결함패턴이 선명해지는 값으로 자동 변경하면서 상기 무라 결함패턴을 판정하는 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템. - 청구항 1에 있어서,

상기 결함 판정장치는,

결함패턴을 자동으로 판정하면서 판정에 사용된 이미지들을 지속적으로 저장하고,

상기 저장된 이미지들을 상기 딥러닝 모델들에 프로그램적으로 자동으로 인가해서 딥러닝 학습을 자동으로 반복적으로 수행하도록 하여, 상기 딥러닝 모델을 최적화하는 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템. - 청구항 1에 있어서,

상기 결함 판정장치는,

결함패턴 판정에 대한 검수자의 최종 판단결과정보를 입력받고, 상기 입력된 최종 판단결과정보를 상기 딥러닝 모델들에 프로그램적으로 자동으로 인가해서 딥러닝 학습을 자동으로 반복적으로 수행하도록 하여, 상기 딥러닝 모델을 최적화하는 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템. - 청구항 1에 있어서,

상기 결함 판정장치는,

상기 딥러닝 모델들에 대해, 앙상블(Ensemble) 모델을 적용하여 구현된 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템. - 청구항 3에 있어서,

상기 결함 판정장치는,

상기 제1 딥러닝 모델, 상기 제2 딥러닝 모델 및 상기 제3 딥러닝 모델 각각의 학습을 위해 사용되는 학습 이미지에 대해 데이터 증강(Data Augmentation) 기법에 의해 획득한 정보를 사용하는 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템. - 청구항 8에 있어서,

상기 데이터 증강(Data Augmentation) 기법은, 상기 학습 이미지의 회전, 확대, 좌우반전, 상하반전, 가로이동, 세로이동 및 그 조합 중 적어도 둘 이상을 통해 획득하는 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템. - 청구항 1에 있어서,

상기 이미지 패턴 분류기의 검사 결과정보 및 상기 결함 판정장치의 판정 결과정보를 디스플레이 화면에 표시하고, 작업자의 명령을 입력받기 위한 유저 인터페이스를 제공하는 작업자 인터페이스 장치를 더 포함하는 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템. - 청구항 1에 있어서,

상기 이미지 패턴 분류기의 검사 결과정보 및 상기 결함 판정장치의 판정 결과정보에 대한 저장 및 관리를 수행하는 정보 관리장치를 더 포함하는 것을 특징으로 하는 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정 시스템.

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020210068549A KR20220161601A (ko) | 2021-05-27 | 2021-05-27 | 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정시스템 |

| PCT/KR2021/006936 WO2022250190A1 (ko) | 2021-05-27 | 2021-06-03 | 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정시스템 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020210068549A KR20220161601A (ko) | 2021-05-27 | 2021-05-27 | 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정시스템 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20220161601A true KR20220161601A (ko) | 2022-12-07 |

Family

ID=84229934

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020210068549A KR20220161601A (ko) | 2021-05-27 | 2021-05-27 | 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정시스템 |

Country Status (2)

| Country | Link |

|---|---|

| KR (1) | KR20220161601A (ko) |

| WO (1) | WO2022250190A1 (ko) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN116168259B (zh) * | 2023-04-26 | 2023-08-08 | 厦门微图软件科技有限公司 | 一种应用于oled点灯系统的自动缺陷分类方法 |

Family Cites Families (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP3002325B2 (ja) * | 1992-04-27 | 2000-01-24 | 株式会社東芝 | 表面検査装置 |

| WO2019107614A1 (ko) * | 2017-11-30 | 2019-06-06 | 전자부품연구원 | 제조 공정에서 딥러닝을 활용한 머신 비전 기반 품질검사 방법 및 시스템 |

| KR102154393B1 (ko) * | 2018-06-20 | 2020-09-09 | 에임시스템 주식회사 | 기계 학습 기반의 자동 결함 분류 방법 |

| KR20200039047A (ko) * | 2018-10-01 | 2020-04-16 | 에스케이씨 주식회사 | 필름 결함 검출 방법 및 시스템 |

| JP7293842B2 (ja) * | 2019-04-24 | 2023-06-20 | 大日本印刷株式会社 | 生成方法、プログラム、生成装置、出力装置及び送信装置 |

-

2021

- 2021-05-27 KR KR1020210068549A patent/KR20220161601A/ko unknown

- 2021-06-03 WO PCT/KR2021/006936 patent/WO2022250190A1/ko unknown

Also Published As

| Publication number | Publication date |

|---|---|

| WO2022250190A1 (ko) | 2022-12-01 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR102321765B1 (ko) | 디스플레이 장치 품질 검사 방법, 장치, 전자 장치 및 저장 매체 | |

| Yun et al. | Automated defect inspection system for metal surfaces based on deep learning and data augmentation | |

| Xu et al. | Recognition of rust grade and rust ratio of steel structures based on ensembled convolutional neural network | |

| CN117115147B (zh) | 一种基于机器视觉的纺织品检测方法及系统 | |

| CN112070135B (zh) | 电力设备图像检测方法、装置、电力设备及存储介质 | |

| CN112966772A (zh) | 一种多人在线的图像半自动标注方法及系统 | |

| Zhou et al. | Review of vision-based defect detection research and its perspectives for printed circuit board | |

| Almufadda et al. | Artificial intelligence applications in the auditing profession: A literature review | |

| US20230048386A1 (en) | Method for detecting defect and method for training model | |

| CN114862832A (zh) | 缺陷检测模型的优化方法、装置、设备及存储介质 | |

| US20220120727A1 (en) | Detecting equipment defects using lubricant analysis | |

| KR20220105689A (ko) | 머신러닝 모델에 기반한 디스플레이 패널의 결함 판정 시스템 | |

| WO2023045038A1 (zh) | 一种融合云端的产品分拣系统及方法 | |

| Park et al. | Advanced cover glass defect detection and classification based on multi-DNN model | |

| CN110929032B (zh) | 一种软件系统的用户需求处理系统及处理方法 | |

| US20240046617A1 (en) | Machine Learning-Based Generation of Rule-Based Classification Recipes for Inspection System | |

| KR20220161601A (ko) | 딥러닝 모델을 이용한 영상검사 대상체의 결함 판정시스템 | |

| Revathy et al. | Fabric defect detection and classification via deep learning-based improved Mask RCNN | |

| Luo et al. | Design of Computer Recognition System Based on Graphic Image | |

| Lahoti et al. | Convolutional Neural Network-Assisted Adaptive Sampling for Sparse Feature Detection in Image and Video Data | |

| JP2001134763A (ja) | 撮像画像に基づく欠陥の分類方法、および、その結果の表示方法 | |

| Burra et al. | MobileNetV2-based Transfer Learning Model with Edge Computing for Automatic Fabric Defect Detection | |

| KR20220164099A (ko) | 딥러닝 신경망 모델을 이용한 검사대상 패널의 결함 판정장치 | |

| CN112115876A (zh) | 一种基于3d卷积神经网络的水溶法实验过程识别方法 | |

| JP7335658B2 (ja) | 情報処理装置 |