KR20170007764A - 방송 신호 송수신 방법 및 장치 - Google Patents

방송 신호 송수신 방법 및 장치 Download PDFInfo

- Publication number

- KR20170007764A KR20170007764A KR1020167033466A KR20167033466A KR20170007764A KR 20170007764 A KR20170007764 A KR 20170007764A KR 1020167033466 A KR1020167033466 A KR 1020167033466A KR 20167033466 A KR20167033466 A KR 20167033466A KR 20170007764 A KR20170007764 A KR 20170007764A

- Authority

- KR

- South Korea

- Prior art keywords

- subtitle

- metadata

- caption

- information

- dynamic range

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/488—Data services, e.g. news ticker

- H04N21/4886—Data services, e.g. news ticker for displaying a ticker, e.g. scrolling banner for news, stock exchange, weather data

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/20—Servers specifically adapted for the distribution of content, e.g. VOD servers; Operations thereof

- H04N21/23—Processing of content or additional data; Elementary server operations; Server middleware

- H04N21/234—Processing of video elementary streams, e.g. splicing of video streams, manipulating MPEG-4 scene graphs

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/20—Servers specifically adapted for the distribution of content, e.g. VOD servers; Operations thereof

- H04N21/23—Processing of content or additional data; Elementary server operations; Server middleware

- H04N21/235—Processing of additional data, e.g. scrambling of additional data or processing content descriptors

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/20—Servers specifically adapted for the distribution of content, e.g. VOD servers; Operations thereof

- H04N21/23—Processing of content or additional data; Elementary server operations; Server middleware

- H04N21/235—Processing of additional data, e.g. scrambling of additional data or processing content descriptors

- H04N21/2355—Processing of additional data, e.g. scrambling of additional data or processing content descriptors involving reformatting operations of additional data, e.g. HTML pages

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/434—Disassembling of a multiplex stream, e.g. demultiplexing audio and video streams, extraction of additional data from a video stream; Remultiplexing of multiplex streams; Extraction or processing of SI; Disassembling of packetised elementary stream

- H04N21/4348—Demultiplexing of additional data and video streams

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/435—Processing of additional data, e.g. decrypting of additional data, reconstructing software from modules extracted from the transport stream

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/439—Processing of audio elementary streams

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/488—Data services, e.g. news ticker

- H04N21/4884—Data services, e.g. news ticker for displaying subtitles

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/80—Generation or processing of content or additional data by content creator independently of the distribution process; Content per se

- H04N21/83—Generation or processing of protective or descriptive data associated with content; Content structuring

- H04N21/84—Generation or processing of descriptive data, e.g. content descriptors

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/80—Generation or processing of content or additional data by content creator independently of the distribution process; Content per se

- H04N21/85—Assembly of content; Generation of multimedia applications

- H04N21/854—Content authoring

- H04N21/8543—Content authoring using a description language, e.g. Multimedia and Hypermedia information coding Expert Group [MHEG], eXtensible Markup Language [XML]

Abstract

본 발명은 자막 서비스를 포함한 방송 신호를 송수신하는 장치 및 방법에 관한 것이다. 본 발명의 일 실시예는, 비디오 데이터 및 자막 데이터를 포함하는 방송 신호를 생성하는 단계, 및 상기 생성된 방송 신호를 전송하는 단계를 포함하는 방송 신호 송신 방법을 제공한다. 본 발명의 실시예에 따르면, XML 자막을 이용한 디지털 방송 자막 서비스를 제공하는 전송 스트림을 전송할 수 있다.

Description

본 발명은 방송 신호를 송수신하는 장치 및 방법에 관한 것이다.

디지털 기술 및 통신 기술의 발전으로 방송, 영화뿐만 아니라 인터넷 및 개인 미디어 등의 다양한 영역에서 오디오/비디오 중심의 멀티미디어 컨텐츠 보급 및 수요가 급속도로 확대되고 있다. 나아가 방송 및 영화를 통하여 입체감을 제공하는 실감미디어에 대한 소비자 요구가 증가되고 있다. 또한, 디스플레이 기술의 발전과 더불어 가정에서의 TV 화면이 대형화 됨에 따라 HD (High Definition)급 이상의 고화질에 실감나는 컨텐츠를 즐기고자 하는 소비가 증가되고 있다. 3DTV와 더불어 UHDTV (Ultra High Definition TV)와 같은 실감방송이 차세대 방송 서비스로 관심을 받고 있으며, 특히 UHD (Ultra High Definition) 방송 서비스에 대한 논의가 증가되고 있는 추세이다.

현재 방송 자막 서비스는 closed caption 혹은 DVB (Digital Video Broadcasting) subtitle의 형태로 제공되고 있다. 이 중 DVB subtitle의 경우 자막을 bitmap image 형태로 제공하기 때문에 다양한 크기의 영상에 대해 서로 다른 크기의 자막을 제공하거나, 단일 규격의 subtitle을 스케일링하는 식으로 서비스를 제공해야 한다. 이 때, 전자의 경우 대역폭 측면에서 효율성이 떨어지며 후자의 경우 스케일링에 의한 선예도가 떨어지는 문제가 발생한다. 특히 UHDTV를 통한 고해상도의 방송 서비스에 대한 논의가 활발한 요즈음, 이러한 문제를 해결하기 위한 새로운 방송 자막 서비스의 필요성이 대두되고 있다. 또한 UHD의 단계별 화질 요소 변화에 맞추어 하위 호환성을 갖는 고화질 자막 서비스도 요구되고 있다.

본 발명의 목적은, 방송 신호를 전송하는 방법 및 장치에 있어서 전송 효율을 높이는 것이다.

본 발명의 다른 목적은, 자막 서비스를 방송망에서 제공하기 위한 전송 장치 및 방법을 제공하는 것이다.

본 발명의 다른 목적은, 자막 서비스의 품질을 향상시키는 방송 장치 및 방법을 제공하는 것이다.

본 발명의 일 실시예에 따른 방송 신호 송신 방법은 비디오 데이터 및 자막 데이터를 포함하는 방송 신호를 생성하는 단계 및 상기 생성된 방송 신호를 전송하는 단계를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 송신 방법에서 상기 자막 데이터는 XML 자막 데이터를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 송신 방법에서 상기 XML 자막 데이터는 자막 텍스트 및 자막 메타 데이터를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 송신 방법에서 상기 자막 메타 데이터는 고화질 방송을 위한 확장 색상 영역 및 하이 다이내믹 레인지에 대응하는 정보를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 송신 방법에서 상기 자막 메타 데이터는 자막의 색 영역, 자막의 다이내믹 레인지, 자막의 비트 뎁스에 대한 기본 정보 및 추가 정보를 포함할 수 있다.

본 발명의 일 실시예에 따른 방송 신호 수신 방법은 비디오 데이터 및 자막 데이터를 포함하는 방송 신호를 수신하는 단계 및 상기 비디오 데이터 및 자막 데이터를 처리하여 출력하는 단계를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 수신 방법에서 상기 자막 데이터는 XML 자막 데이터를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 수신 방법에서 상기 XML 자막 데이터는 자막 텍스트 및 자막 메타 데이터를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 수신 방법에서 상기 자막 메타 데이터는 고화질 방송을 위한 확장 색상 영역 및 하이 다이내믹 레인지에 대응하는 정보를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 수신 방법에서 상기 자막 메타 데이터는 고화질 방송을 위한 확장 색상 영역 및 하이 다이내믹 레인지에 대응하는 정보를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 수신 방법에서 상기 자막 메타 데이터는 자막의 색 영역, 자막의 다이내믹 레인지, 자막의 비트 뎁스에 대한 기본 정보 및 추가 정보를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 수신 방법은 수신기 디스플레이 속성 및 상기 자막 메타 데이터 사이의 매칭 여부를 디텍트하는 단계를 더 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 수신 방법에서 상기 자막 메타 데이터는 복수의 서비스를 지원하는 적어도 하나 이상의 색 영역, 다이내믹 레인지 및 비트 뎁스에 대한 정보를 포함할 수 있다.

또한 본 발명의 일 실시예에 따른 방송 신호 수신 방법에서 상기 자막 메타 데이터는 색 영역, 다이내믹 레인지 및 비트 뎁스에 대한 정보 및 색상 변형 함수를 포함할 수 있다.

본 발명의 실시예에 따르면, 방송 시스템의 전송 효율을 높일 수 있다.

본 발명의 실시예에 따르면, 높은 품질의 자막 서비스를 방송망에서 제공할 수 있다.

본 발명의 실시예에 따르면, 하위 호환성을 갖는 자막 서비스를 방송망에서 제공할 수 있다.

본 발명의 실시예에 따르면, 방송 수신 장치는 방송 신호에 포함된 자막을 추출하여 디스플레이할 수 있다.

도 1은 본 발명의 일 실시예에 따른 XML 기반 방송 자막 서비스를 나타낸 도면이다.

도 2는 본 발명의 일 실시예에 따른 XML 기반 자막에 대한 수신기의 동작 실시예를 나타낸 도면이다.

도 3은 본 발명의 일 실시예에 따른 방송 수신기의 자막에 대한 전처리 과정을 나타낸다.

도 4는 본 발명의 일 실시예에 따른 밝기에 대한 다이내믹 레인지 매핑을 나타낸다.

도 5는 본 발명의 일 실시예에 따른 자막에 대한 정보를 포함하는 메타 데이터를 나타낸다.

도 6은 본 발명의 다른 실시예에 따른 자막에 대한 정보를 포함하는 메타 데이터를 나타낸다.

도 7은 본 발명의 일 실시예에 따른 자막의 메타 데이터의 요소에 대한 자세한 설명을 나타낸다.

도 8은 본 발명의 일 실시예에 따른 자막의 메타 데이터의 요소에 대한 자세한 설명을 나타낸다.

도 9는 본 발명의 일 실시예에 따른 자막의 메타 데이터의 요소에 대한 자세한 설명을 나타낸다.

도 10은 본 발명의 일 실시예에 따른 자막의 색상을 표현하는 방법을 나타낸다.

도 11은 본 발명의 다른 실시예에 따른 자막의 색상을 표현하는 방법을 나타낸다.

도 12는 본 발명의 다른 실시예에 따른 자막의 색상을 표현하는 방법을 나타낸다.

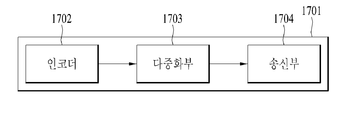

도 13은 본 발명의 일 실시예에 따른 방송 송신기를 나타낸 블록도이다.

도 14는 본 발명의 일 실시예에 따른 방송 수신기를 나타낸 블록도이다.

도 15는 본 발명의 일 실시예에 따른 방송 수신기의 상세 구성을 나타낸 도면이다.

도 16은 본 발명의 일 실시예에 따른 XML 자막을 포함하는 방송 신호를 전송하는 방법을 나타낸 도면이다.

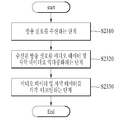

도 17은 본 발명의 일 실시예에 따른 XML 자막을 포함하는 방송 신호를 수신하는 방법을 나타낸 도면이다.

도 2는 본 발명의 일 실시예에 따른 XML 기반 자막에 대한 수신기의 동작 실시예를 나타낸 도면이다.

도 3은 본 발명의 일 실시예에 따른 방송 수신기의 자막에 대한 전처리 과정을 나타낸다.

도 4는 본 발명의 일 실시예에 따른 밝기에 대한 다이내믹 레인지 매핑을 나타낸다.

도 5는 본 발명의 일 실시예에 따른 자막에 대한 정보를 포함하는 메타 데이터를 나타낸다.

도 6은 본 발명의 다른 실시예에 따른 자막에 대한 정보를 포함하는 메타 데이터를 나타낸다.

도 7은 본 발명의 일 실시예에 따른 자막의 메타 데이터의 요소에 대한 자세한 설명을 나타낸다.

도 8은 본 발명의 일 실시예에 따른 자막의 메타 데이터의 요소에 대한 자세한 설명을 나타낸다.

도 9는 본 발명의 일 실시예에 따른 자막의 메타 데이터의 요소에 대한 자세한 설명을 나타낸다.

도 10은 본 발명의 일 실시예에 따른 자막의 색상을 표현하는 방법을 나타낸다.

도 11은 본 발명의 다른 실시예에 따른 자막의 색상을 표현하는 방법을 나타낸다.

도 12는 본 발명의 다른 실시예에 따른 자막의 색상을 표현하는 방법을 나타낸다.

도 13은 본 발명의 일 실시예에 따른 방송 송신기를 나타낸 블록도이다.

도 14는 본 발명의 일 실시예에 따른 방송 수신기를 나타낸 블록도이다.

도 15는 본 발명의 일 실시예에 따른 방송 수신기의 상세 구성을 나타낸 도면이다.

도 16은 본 발명의 일 실시예에 따른 XML 자막을 포함하는 방송 신호를 전송하는 방법을 나타낸 도면이다.

도 17은 본 발명의 일 실시예에 따른 XML 자막을 포함하는 방송 신호를 수신하는 방법을 나타낸 도면이다.

발명의 실시를 위한 최선의 형태

차세대 방송 서비스로써 IP를 통해 방송 서비스를 제공하기 시작하면서, 기존 방송 자막을 대신할 새로운 자막 서비스 표준이 제정되었다. 향후 방송 서비스는 기존 방송과 IP의 융합의 형태로 제공될 것으로 보이는데, 이 때 서로 다른 표준으로 만들어진 자막을 각각 서비스 하는 것은 비효율 적이다.

본 발명은 XML 자막 (TTML, SMPTE-TT, EBU-TT-D 등)을 이용한 디지털 영상 자막 서비스를 제공할 때, WCG, HDR, higher bit depth 등의 고화질 영상 요소를 기준으로 기존 및 신규 수신기에서의 자막 서비스를 제공하기 위한 방법에 대해 기술한다.

최근 TTML (time text markup language), EBU-TT (EBU time text) 등 XML 언어 기반의 자막에 대한 표준이 제정되었다. 이들의 목적은 media 및 IP streaming 환경에서의 자막 서비스를 목표로 하지만, 이를 방송 서비스에서도 이용하고자 하는 요구가 DVB 및 ATSC 등의 표준 단체에서 나타나고 있다. 이는 다양한 방송 환경에대해 통합된 자막 source를 이용할 수 있다는 장점 뿐 아니라, 동일 자막 소스를 기반으로 다양한 서비스 환경(예를 들어 HD, UHD 등)에 적응적으로 사용 가능하다는 장점을 이용하기 위한 것이다.

XML 기반 subtitle은 다양한 크기의 영상을 지원할 수 있으며, IP streaming 기반 서비스에 적합하다는 점에서 UHD 기반 차세대 subtitle 서비스 방법 중 하나로 고려되고 있다. 이는 HD에서 UHD로의 변화는 해상도 향상 뿐 아니라 dynamic range, color gamut, bit depth 등 다양한 화질 측면에서의 변화를 가져올 것으로 보이며, 차세대 subtitle 서비스에서는 이러한 영상 요소를 고려할 필요가 있다. 하지만 현재 TTML 기반의 XML subtitle 은 이러한 요소에 대한 고려가 없으며, 다양한 서비스 환경에 대응하기 위해 WCG, HDR 등의 요소를 고려할 필요가 있다.

아래에서는 XML 기반 방송 미디어 자막 서비스를 제공함에 있어서 색영역, 밝기 범위 등의 화질 요소 측면에서 자막 제작 환경과 디스플레이 환경이 다른 경우에도 적절한 자막 서비스를 제공를 할 수 있는 방법을 설명할 수 있다.

본 발명에서는 XML 기반으로 제작된 자막을 방송 미디어 서비스에서 사용하기 위한 방법으로써, HDR, WCG 측면에서 다양한 성능의 수신기 및 디스플레이를 지원하기 위해 XML subtitle의 제작 환경에 대한 정보를 전달할 수 있는 XML subtitle metadata 서비스 방법을 설명할 수 있다.

또한 본 발명에서는 XML subtitle의 bitdepth 표현이 8 bit로 제약이 있는 상황에서 기존 8bit 시스템에 대한 지원을 유지하면서 최대 16bit까지 확장하여 표현할 수 있는 방법을 제안할 수 있다.

또한 본 발명에서는 자막 제작 환경과 영상 재생 환경이 다른 경우에 대해 color gamut, dynamic range, bit depth 관점에서 수신기 동작을 설명할 수 있다.

본 발명의 이해와 설명의 편의를 위하여, 용어 및 약어에 대하여 아래와 같이 정의한다.

HEVC (High Efficiency Video Coding)은 기존 H.265/AVC 기술과 비교하여 약 2배 높은 압축률을 가지면서 동일한 비디오 품질을 제공하는 고효율 비디오 코딩 표준이다.

XML (Extensible Markup Language)은 HTML을 개선하여 만든 언어로써 보다 홈페이지 구축 기능, 검색 기능 등이 향상되었고 클라이언트 시스템의 복잡한 데이터 처리를 쉽게 할 수 있다. 본 발명에서는 자막 데이터를 구성하는 언어로써 사용되며 XML 자막은 헤드와 바디로 구성될 수 있다.

PTS (Presentation Time Stamp)는 디코딩 된 access unit 이 재생되는 시점을 나타내는 값을 의미할 수 있다. 본 발명에서 PTS는 비디오 ES와 자막 ES를 동기화하는데 사용될 수 있다.

ES(Elementary Stream)는 데이터 인코더의 출력을 의미할 수 있다. 즉, 비디오 인코더 및 오디오 인코더의 출력을 각각 비디오 ES 및 오디오 ES로 정의할 수 있다. 본 발명에서는 XML 자막 ES를 정의하고 사용할 수 있다.

TS (Transport Stream)는 MPEG-2 시스템에서 하나 또는 여러개의 프로그램을 포함한 전송용 스트림으로써 전송에러가 존재하는 전송 매체에 이용할 수 있다. 본 발명에서 TS는 비디오 ES, 오디오 ES 및 자막 ES 중 적어도 두 개가 다중화되어 전송되는 전송 스트림을 의미할 수 있다.

도 1은 본 발명의 일 실시예에 따른 XML 기반 방송 자막 서비스를 나타낸 도면이다. 도 1은 디지털 방송 서비스를 위한 송신단 및 수신단, 단대단 (end-to-end) 시스템에 대한 다이어그램을 나타낸다. 본 발명에서 사용하는 XML 기반 자막은 영상의 크기에 영향을 받지 않기 때문에 UHD/HD/SD 모두에 적용 가능하다.

전송단에서는 압축된 영상 및 전송을 위해 변형된(modified) XML 자막을 다중화기를 통해 전송할 수 있다. 또한 수신기에서는 수신된 신호를 역다중화한 후 영상 디코딩 및 XML parser를 통해 자막을 제공하며, graphic engine 에서는 수신기의 환경에 따라 자막 표현 방법을 변형한(modify) 후 디스플레이 프로세서로 출력할 수 있다. 디스플레이 프로세서는 디코딩된 영상 및 자막을 출력할 수 있다.

도 1에서 전송단은 비디오 데이터 및 자막 정보를 입력 받을 수 있다. 전송단에 입력되는 비디오 데이터의 해상도는 UHD, HD 또는 SD가 될 수 있다. 또한 전송단에 입력되는 자막 정보는 XML로 작성될 수 있다. 전송단에 입력된 비디오 데이터는 전송단에서 인코더에 의해 인코딩될 수 있다(101). 전송단은 비디오 데이터에 대한 인코딩 방식으로써 HEVC(High Efficiency Video Coding)를 사용할 수 있다. 전송단은 인코딩된 비디오 데이터와 XML 자막을 동기화하고 다중화부를 이용하여 다중화할 수 있다 (102). 여기서 XML 자막은 전송을 위해 변형될 수 있다. XML 자막에 대한 변형 방법 및 XML 자막에 대한 메타 데이터 생성 방법은 아래에서 자세히 설명하기로 한다. 전송단은 동기화되고 다중화된 데이터를 채널 코딩 및 변조한 후 방송 신호로써 전송할 수 있다.

수신단은 방송 신호를 수신하고 복조 및 전송 패킷 디코딩을 수행할 수 있다. 또한 수신단은 디코딩된 전송 패킷을 역다중화 후 비디오 디코딩 및 XML 파싱을 수행할 수 있다. XML 파싱은 XML parser를 통해 수행될 수 있다. 여기서 비디오 디코더와 XML 파서는 메타 데이터를 교환할 수 있다. 이러한 메타 데이터는 영상과 자막을 함께 디스플레이함에 있어서 부가 정보로 사용될 수 있다. 수신단에서는 수신된 방송 신호를 복조하고 트랜스포트 패킷 디코딩을 수행할 수 있다(104). 디코딩된 트랜스포트 패킷은 역다중화(105) 과정을 거친 후 비디오 디코더(106) 및 XML 파서(parser, 107)에 입력된다. 여기서 비디오 디코더(106)는 수신된 비디오 데이터의 해상도에 따라 UHD, HD 또는 SD 비디오 데이터를 디코딩할 수 있다. 또한 XML 파서(107)는 XML 자막을 추출할 수 있다. 이 과정에서 수신단은 메타 데이터를 이용하여 비디오 데이터와 XML 자막을 디스플레이함에 있어서 영상 요소를 고려할 수 있다. 여기서 영상 요소는 예를 들어 dynamic range, color gamut, bit depth 등을 포함할 수 있다. 특히 본 발명에서는 UHD 화질 요소 중 wide color gamut (WCG), high dynamic range (HDR)이 서비스에 포함되는 경우 (예를 들어, DVB UHD-1 phase 2 혹은 BD UHD-FE 등), 자막 제작의 기준이 되는 화질 요소에 대한 정보를 수신기에 제공할 수 있다. 이를 통해 자막 제작 환경과 디스플레이 환경이 다른 경우 수신기에서 디스플레이 환경에 맞게 자막의 색상 혹은 밝기를 적절하게 변형할 수 있다. 그래픽 엔진(108)은 상술한 영상 요소에 대응하여 XML 자막의 표현 방법을 변형할 수 있다. 디코딩된 비디오 데이터 및 표현 방법이 변형된 XML 자막은 디스플레이 프로세서(109)에 의해 처리되고 디스플레이될 수 있다.

도 2는 본 발명의 일 실시예에 따른 XML 기반 자막에 대한 수신기의 동작 실시예를 나타낸 도면이다. 본 발명에서는 DVB UHD-1 phase 1 과 phase 2와 같이 동일 컨텐츠에 대해서 서로 다른 화질의 서비스를 제공하는 경우에 대해 단일 자막을 기반으로 수신기의 환경에 적합한 자막 서비스를 제공할 수 있는 자막 서비스 및 수신기 구조에 대해 기술할 수 있다. 또한, 전송 환경에 따라 서로 다른 화질을 적응적으로 제공할 수 있는 IP streaming 기반 서비스 혹은 수신기의 환경에 따라 서로 다른 서비스를 제공할 수 있는 스토리지 미디어 기반 영상 서비스에 대해서도 제안하는 방법으로 서비스 및 유사한 구조의 수신기를 사용할 수 있다. 전송 환경에 따라 서로 다른 화질을 적응적으로 제공할 수 있는 IP streaming 기반 서비스는 MPEG-DASH (dynamic adaptive streaming over HTTP) 서비스를 예로 들 수 있다.

수신기는 XML 기반 자막에 대해 XML parser를 통해 내용을 분석할 수 있다. 또한 수신기는 자막의 내용, 자막을 표현하기 위한 정보를 그래픽 엔진으로 전달할 수 있다. 여기서, 자막을 표현하기 위한 정보는 컨텐츠의 화질을 구분 짓는 요소를 포함할 수 있다. 즉, 자막을 표현하기 위한 정보는 bitdepth, dynamic range, color gamut, MidTone 및/또는 colors 중 적어도 하나의 정보를 포함할 수 있다.

본 발명의 수신기는 자막 및 자막에 대한 정보를 그래픽 엔진으로 전달하기에 앞서 전처리 (preprocessing) 과정을 수행할 수 있다. 수신기는 수신 가능한 서비스의 종류에 따라 자막에서 제공되는 색상, 밝기, bitdepth 정보를 선택적으로 또는 자막 내에 주어지는 정보를 기반으로 상기 정보들을 변형(transform) 하여 사용할 수 있다.

수신기는 preprocessing 을 통해 선택되거나 변형된 자막 정보를 그래픽 엔진에 전달할 수 있다. 그래픽 엔진은 자막의 내용 및 변형된 자막에 대한 정보를 이용하여 자막을 생성하고 디스플레이 프로세서로 전달할 수 있다.

도 3은 본 발명의 일 실시예에 따른 방송 수신기의 자막에 대한 전처리 과정을 나타낸다. 수신된 자막이 DVB UHD-1 phase 1과 2를 모두 지원하는 경우 이에 대한 전처리 과정을 나타낸다. preprocessing 과정은 자막 제작 환경과 디스플레이 환경의 매칭 여부를 디텍트하는 단계 및 선택(selection) 또는 변형(transformation) 단계를 포함할 수 있다. 수신기는 preprocessing 과정에서 자막의 타겟 비디오 포맷에 대한 메타 데이터 및 수신기의 디스플레이에 대한 메타 데이터에 기초하여 매칭 여부를 디텍트하거나 판단할 수 있다. 자막의 타겟 비디오 포맷에 대한 메타 데이터는 bitdepth, dynamic range, color gamut, 자막 밝기 기준 값인 HighTone, LowTone, transformation function 정보를 포함할 수 있다. 이 때 판단 기준은 XML 내 metadata를 통해 전달될 수 있으며, EBU-TT-D에의 경우 ebuttm:Gamut, ebuttm:DynamicRange, ebuttm:EOTF, ebuttm:BitDepth를 통해 자막의 기본이 되는 화질 요소가 수신기에 전달될 수 있다. 추가적으로 지원되는 자막의 화질 요소는 ebuttm:SupplementaryGamut, ebuttm:SupplementaryDynamicRange, ebuttm:SupplementaryEOTF, ebuttm:SupplementaryBitDepth를 통해 수신기에 전달될 수 있다. 또는 자막의 기본이 되는 화질 요소 및 추가적으로 지원되는 화질 요소가 ebuttm:Gamuts, ebuttm:DynamicRanges, ebuttm:EOTFs, ebuttm:BitDepths 를 통해 함께 수신기에 전달될 수 있다. 위에서는 EBU-TT-D metadata 에 정의하는 경우에 대해 예를 들어 설명하였으나, 동일한 정보가 TTML metadata (ttm), parameter (ttp), style (tts)에 정의될 수 있다. 즉, 본 발명에서 새로 정의한 요소들은 TTML, EBU-TT, SMPTE-TT, CFF-TT, Youview, EBU-TT 등 XML 기반 자막 표준에 확장하여 적용할 수 있다. 본 발명에서의 비교 기준은 gamut, dynamic range, bitdepth 측면이며, resolution, aspect ratio 측면에서의 비교도 필요한 경우 수행할 수 있다. 또한 수신기의 디스플레이에 대한 메타 데이터는 디스플레이 환경 정보를 포함할 수 있으며, 수신기 디스플레이의 bitdepth, dynamic range, color gamut 정보를 포함할 수 있다.

매칭 단계에서 자막 제작 환경의 메타 데이터와 디스플레이 환경에 대한 메타 데이터가 매칭되는 경우, 자막 텍스트 데이터와 자막에 대한 메타 데이터는 UHD-1 Phase 1 수신기를 위한 그래픽 엔진으로 전달된다. 즉, UHD-1 Phase 1 수신기가 수신한 자막의 타겟 비디오 포맷이 비디오 혹은 디스플레이에 대한 메타 데이터와 일치하거나 수용 가능하다고 판단되는 경우 별다른 처리 없이 다음 단계로 진행한다. 그래픽 엔진은 전달받은 자막 텍스트 데이터와 자막에 대한 메타 데이터를 이용하여 자막을 생성하고 디스플레이 프로세서에 생성된 자막을 전달할 수 있다.

이와 달리 매칭 단계에서 자막의 메타 데이터와 디스플레이 환경이 매칭되지 않는 경우, 즉 자막의 표현 방법에 대한 선택 또는 변형(transformation)이 필요한 경우, 전처리 과정은 자막의 색상 및 밝기 측면에서 다른 자막 표현 방법을 선택하거나 자막 표현 방법을 변형하는 과정을 포함할 수 있다. 선택 또는 변형(transformation) 과정에서는 자막의 타겟 비디오 포맷에 대한 메타 데이터 및 수신기의 디스플레이에 대한 메타 데이터에 기초하여 자막의 메타 데이터에 포함된 자막 표현 방법을 선택하거나 변형할 수 있다. 선택 과정은 자막의 메타 데이터가 복수의 자막 표현 방법을 포함하는 경우에 수행될 수 있다. 즉, 수신기는 자막의 메타 데이터 내에 bitdepth, dynamic range, color gamut 등을 포함한 표현 방법이 복수 개 존재하는 경우, 이들 중 하나를 수신기 메타 데이터에 적합하도록 선택할 수 있다. 즉, 자막의 메타 데이터에 포함된 bitdepth, dynamic range, color gamut을 선택하거나 변형하여 selected bitdepth, selected dynamic range, selected color gamut을 그래픽 엔진에 전달하거나 transformed bitdepth, transformed dynamic range, transformed color gamut을 그래픽 엔진에 전달할 수 있다. 변형 또는 선택된 메타 데이터 및 자막 텍스트는 UHD-1 Phase 2 수신기를 위한 그래픽 엔진으로 전달될 수 있다. 그래픽 엔진은 전달받은 자막 텍스트 데이터와 자막에 대한 선택 또는 변형된 메타 데이터를 이용하여 자막을 생성하고 디스플레이 프로세서에 생성된 자막을 전달할 수 있다. 전처리 과정에서 자막의 메타 데이터와 디스플레이의 메타 데이터 사이에 color gamut, dynamic range, bitdepth 측면에서 차이가 있는 경우 각 요소에 대한 선택 또는 변형을 수행한다.

그래픽 엔진은 텍스트 정보를 영상 정보로 재생하기 위한 변형 작업이 일어나며, 수신기는 그래픽 엔진의 출력에 대해 디스플레이 프로세싱을 통해 영상과 자막, 기타 영상 구성을 위한 요소들을 합해 최종 디스플레이를 위한 영상을 구성한다.

본 발명에 의해 전달되는 자막은 지원하는 성능과 수신기의 성능을 비교한 후 적합한 format에 맞추어 color gamut, dynamic range, bitdepth 측면에서 적절한 값을 선택하여 사용할 수 있다. 이 때, ebuttm:Gamut, ebuttm:DynamicRange, ebuttm:EOTF, ebuttm:BitDepth를 통해 전달된 기본적인 color gamut, dynamic range, EOTF, bitdepth 정보 및 ebuttm:SupplementaryGamut, ebuttm:SupplementaryDynamicRange, ebuttm:SupplementaryEOTF, ebuttm:SupplementaryBitDepth을 통해 전달된 추가적인 olor gamut, dynamic range, EOTF, bitdepth 정보를 기반으로 비교 및 선택을 할 수 있다. 또한 다른 실시예로써 기본 정보 및 추가 정보를 함께 포함하는 ebuttm:Gamuts, ebuttm:DynamicRanges, ebuttm:EOTFs, ebuttm:BitDepths를 통해 전달된 color gamut, dynamic range, EOTF, bitdepth 정보를 기반으로 비교 및 선택을 할 수 있다. 수신 장치는 (1) 표현 정보 간의 차이를 무시하고 진행하거나 (2) metadata 내 주어진 정보에 기반하여 주어진 포맷에 적합한 값을 선택하거나 (3) 표현 정보에 대한 변환 식(function)이 주어지는 경우 color gamut 변환 혹은 dynamic range 변환을 수행할 수 있다. 아래에서는 (2)의 경우 표현 정보를 선택하는 방법에 대해 설명하고 또한 (3)경우 표현 정보를 변환하는 방법, 특히 Dynamic range을 변환하는 방법을 설명하도록 한다.

도 4는 본 발명의 일 실시예에 따른 밝기에 대한 다이내믹 레인지 매핑을 나타낸다. 즉, XML 기반 자막의 밝기(luminance)에 대한 다이내믹 레인지 매핑(dynamic range mapping)이 이뤄지는 경우를 나타낸다. 즉, SDR 영상을 대상으로 제작 된 XML subtitle을 수신기가 HDR 디스플레이에서 재생하는 경우에 대한 예이다. 이 경우 dynamic range mapping을 통해 영상의 밝기를 변화시키는데, 이 때 영상 밝기 범위에 대한 고려 없이 자막의 밝기를 영상과 동일하게 변화시키는 경우 필요 이상으로 자막이 밝게되는 문제가 발생한다. 예를 들어 HDR 영상의 최대 밝기는 high light와 같이 실제와 같은 눈부심 효과를 표현하기 위해 매우 높은 값으로 설정될 수 있는데, SDR에서 최대 밝기로 설정 된 자막을 HDR 영상에서도 동일하게 최대 밝기로 설정하는 경우 자막이 필요이상을 밝게 되는 문제가 발생할 수 있다.

이를 방지하기 위해 인코딩 당시에 타겟 영상 밝기 범위에 대한 적정 자막 밝기를 설정하여 전달할 수 있으며, 혹은 metadata에 자막 밝기 기준 값(HighTone, LowTone)을 전달하고 기준 밝기 내에서 HDR 영상을 위한 자막 밝기 변환을 수행할 수 있다. 예를 들어 HighTone은 주어진 밝기 범위에 대한 자막의 적정 최대 밝기로 이해할 수 있는데, dynamic range transformation을 수행할 때 영상의 dynamic range의 peak brightness를 기준으로 또는 목표로 하는 수신기에서 지원하는 dynamic range의 peak brightness를 기준으로 밝기 변경을 하는 것이 아니라 HighTone을 기준으로 자막의 dynamic range를 변경할 수 있다. 즉 자막의 밝기에 대한 threshold를 설정할 수 있다. 이와 유사하게 LowTone으로 주어진 밝기 범위에 대한 자막의 적정 최소 밝기로 설정될 수 있다. 이 때, HighTone, LowTone은 nit 단위로 주어질 수 있으며, 수신기에서는 주어진 정보를 기반으로 영상의 밝기와 독립적으로 자막의 dynamic range mapping이 수행될 수 있다. 이 때, HDR 영상의 밝기 범위와 자막의 밝기 범위가 다르기 때문에 자막의 밝기/색상 변환 시 영상의 밝기 범위에 대한 digital value 값으로 표현해야 할 필요가 있다.

도 5는 본 발명의 일 실시예에 따른 자막에 대한 정보를 포함하는 메타 데이터를 나타낸다. 즉, 본 발명이 제안하는 자막 메타 데이터에 대한 실시예를 EBU-TT-D 에 대해 표현한 것이다. 구체적으로 도시된 메타 데이터는 UHD phase 1에 대해 색상 영역 BT. 709, 최소 밝기 0.05nits 최대 밝기 100nits, EOTF BT1886, Bitdepth 8 bit를 설정하고, phase 2에 대해 색상 영역 BT.2020, 최소 밝기 0.01nits, 최대 밝기 2000nits EOTF SMPTE 2084 및 Bitdepth 12bit를 설정하는 실시예를 나타낸다.

자막에 대한 메타 데이터는 color gamut, dynamic range, EOTF, bitdepth 정보를 포함할 수 있다. 자막에 대한 메타 데이터는 UHD phase 1 & 2와 같이 화질에 대한 단계별 접근 방법이 적용되는 경우를 지원할 수 있다. 자막에 대한 메타 데이터는 UHD phase 1 및 phase 2 각각에 대한 지원 범위를 나타내기 위한 방법으로써 기본 color gamut, 기본 dynamic range, 기본 EOTF, 기본 bitdepth 정보를 포함할 수 있다. 예를 들어 자막에 대한 메타 데이터는 기본 정보로써 ebuttm:Gamut = “BT709”, ebuttm:DynamicRange = 100 500 2000 , ebuttm:EOTF = “BT1886”, ebuttm:BitDepth = 8와 같은 정보를 포함할 수 있다. 각 정보에 대한 의미는상술한 바와 같다.

또한 자막에 대한 메타 데이터는 scalable approach를 통한 최고 화질의 경우에 지원되는 정보를 나타내기 위한 각 기본 정보에 대한 추가 정보인 추가 color gamut, 추가 dynamic range, 추가 EOTF, 추가 bitdepth 정보를 포함할 수 있다. 예를 들어 자막에 대한 메타 데이터는 추가 정보로써 ebuttm:SupplementaryGamut = “BT2020” , ebuttm:SupplementaryDynamicRange = 2000 100 200000 500 100, ebuttm:SupplementaryEOTF = “SMPTE2084”, ebuttm:SupplementaryBitDepth = 12를 포함할 수 있다. 이는 타겟 영상의 최대 밝기 2,000 nit, 최소 밝기 0.01 nit, 고대비 200,000:1, 독립적인 자막 적정 최대 밝기가 500nit, 최소 밝기가 0.01 nit임을 나타낼 수 있다.

또한 자막의 색상에 대해 기본 정보로써 tts:color = “rrggbb”를 포함하고, 추가 정보로써 tts:colorSupplementary = “#RRRGGGBBB”를 포함할 수 있다. 또한 자막의 배경 색상에 대한 기본 정보로써 tts:backgroundColor = “r’r’g’g’b’b’”를 포함하고, 자막의 배경 색상에 대한 추가 정보로써 tts:backgroundColorSupplementary= “#-R’R’R’G’G’G’B’B’B’"를 포함할 수 있다. 이와 같이 메타 데이터는 자막 표현 방법에 대한 기본 정보 및 추가 정보를 각각 다른 필드를 통해 정의하고 수신기에 알려줄 수 있다.

도 6은 본 발명의 다른 실시예에 따른 자막에 대한 정보를 포함하는 메타 데이터를 나타낸다. 즉, 본 발명이 제안하는 자막 메타 데이터에 대한 실시예를 EBU-TT-D 에 대해 표현한 것이다. 구체적으로 도시된 메타 데이터는 UHD phase 1에 대해 색상 영역 BT. 709, 최소 밝기 0.05nits 최대 밝기 100nits, Bitdepth 8 bit를 설정하고, phase 2에 대해 색상 영역 BT.2020, 최소 밝기 0.01nits, 최대 밝기 2000nits 및 Bitdepth 12bit를 설정하는 실시예를 나타낸다.

자막에 대한 메타 데이터는 color gamut, dynamic range, EOTF, bitdepth 정보를 포함할 수 있다. 자막에 대한 메타 데이터는 UHD phase 1 & 2와 같이 화질에 대한 단계별 접근 방법이 적용되는 경우를 지원할 수 있다. 자막에 대한 메타 데이터는 UHD phase 1 및 phase 2 각각에 대한 지원 범위를 나타내기 위한 방법으로써 복수의 속성(attribute)를 갖는 color gamut, dynamic range, EOTF, bitdepth 정보를 포함할 수 있다. 예를 들어 자막에 대한 메타 데이터는 표현 정보로써 ebuttm:Gamuts = “BT709” “BT2020”, ebuttm:DynamicRanges = 100 500 2000 2000 100 200000 500 100, ebuttm:EOTFs = “BT1886” “SMPTE2084”, ebuttm:BitDepths = 8 10 12, ebuttm:ColorTransformation= “video” “function” “linear” 500 와 같은 정보를 포함할 수 있다. 여기서 ebuttm:ColorTransformation는 metadata에서 색상 변환 방법을 제공하는 경우에 대한 예시를 나타낼 수 있다. 전술한 바와 같이 각 정보는 각 phase를 지원하는 두 개의 값을 가질 수 있으며, 각 정보에 대한 의미는 상술한 바와 같다. 이와 같이 메타 데이터는 UHD phase 1 및 phase 2를 지원하기 위해 복수의 속성을 갖는 정보 필드를 이용하여 자막 표현 방법에 대한 정의하고 수신기에 알려줄 수 있다. 이러한 메타 데이터 생성 방법은 TTML, SMPTE-TT, CFF-TT, Youview, EBU-TT 등 XML 기반 자막 표준에 확장하여 적용할 수 있다.

도 7은 본 발명의 일 실시예에 따른 자막의 메타 데이터의 요소에 대한 자세한 설명을 나타낸다. (a) 및 (b)는 color gamut 필드를 나타낸다. 자막의 메타 데이터는 (a)와 같이 자막이 지원하는 기본 color gamut과 추가 지원할 수 있는 color gamut을 각각 ebuttm:Gamut와 ebuttm:SupplementaryGamut 엘리먼트를 지정하여 나타낼 수 있다. 각 엘리먼트에 대한 속성(attribute)은 BT.709 나 BT.2020과 같이 잘 알려진 color gamut을 지정하거나, CIExy 좌표를 직접 명시함으로써 임의의 color gamut에 대한 정보를 제공할 수 있다. 임의의 color gamut의 경우 자막의 메타 데이터는 도시된 바와 같이 red, green, blue 및 white point에 대한 CIExy 좌표(각각, xRed, yRed, xGreen, yGreen, xBlue, yBlue, xWhite, yWhite)를 전달할 수 있으며, 이 때 value = originalValue *10000 에 따라 원 좌표값에 10000배 값을 전달한다. 기존의 color gamut을 이용하는 경우 자막의 메타 데이터는 도시된 바와 같이 BT709나 BT2020 속성을 미리 지정해 놓고 사용할 수 있다. 실시 예에서는 BT. 709 기반으로 BT.2020을 추가적으로 지원 가능한 경우에 대해 <namedGamut> attribute를 이용해 표현하였다. 본 필드는 자막 제작과 디스플레이 환경(혹은 영상)의 색공간이 일치 여부에 대한 판단, 자막이 지원하는 서비스에 대한 판단, 필요시 color gamut mapping을 위한 정보로 사용할 수 있다.

자막의 메타 데이터는 (b)와 같이 자막에 대한 표현 정보 중 하나인 기준 color gamut과 추가 지원 가능한 color gamut을 하나의 element에 나타낼 수도 있다. 여기서 기준이 되는 속성을 먼저 기술하고, 추가 지원 가능한 속성을 그 다음에 기술할 수 있다.

도 8은 본 발명의 일 실시예에 따른 자막의 메타 데이터의 요소에 대한 자세한 설명을 나타낸다. (a) 및 (b)는 다이내믹 레인지를 나타낸다. 메타 데이터는 자막에서 고려하는 기본 dynamic range 및 추가 지원 dynamic range를 나타내기 위해 (a)에 도시된 바와 같이 ebuttm:DynamicRange와 ebuttm:AuxiliaryDynamicRange 엘리먼트(element)를 각각 사용할 수 있다. 각 엘리먼트에 대한 속성(attribute)은 dynamic range의 최대 밝기, 최소 밝기, 고대비를 각각 PeakBrightness, BlackLevel, ContrastRatio으로 나타낼 수 있다. 또한 메타 데이터는 비디오와 독립적인 dynamic range 처리에 대한 기준이 되는 자막 적정 최대 밝기 및 최소 밝기를 나타내는 HighTone, LowTone 속성을 포함할 수 있다. 이 때, ContrastRatio는 최대 밝기와 최소 밝기의 비율을 나타낼 수 있으며, 예를 들어 10,000:1의 경우 10,000 값을 전달할 수 있다. 나머지 값들은 nit (cd/m^2) 단위로, BlackLevel (및 LowTone)의 경우 1 이하의 값임을 감안하여 BlackLevel = OriginalValue *10000 에 해당하는 값을 전달할 수 있다.

만약 HD같이 표준화된 dynamic range가 있다면, 예를 들어 SMPTE reference HDTV 표준, namedDynamicRange 값으로 지정하여 아래와 같이 사용할 수 있다. 향후 HDR에 대한 표준이 나오는 경우 namedDynamicRange에 정의한 후 사용할 수 있다. 본 필드는 자막 제작과 디스플레이 환경(혹은 영상)의 밝기 범위의 일치 여부에 대한 판단과, 필요시 dynamic range mapping을 위한 정보로 사용할 수 있다.

다른 실시예로, 도시된 (b)와 같이 기준 dynamic range와 추가 지원 가능한 dynamic range를 하나의 엘리먼트에 나타낼 수도 있다. 즉 ebuttm:DynamicRanges 엘리먼트는 PeakBrightness, BlackLevel, ContrastRatio, PeakBrightness2, BlackLevel2, ContrastRatio2, HighTone, LowTone의 속성을 포함할 수 있다. 이와 같은 실시예에서도 자막의 독립적인 dynamic range를 HighTone, LowTone을 이용하여 추가적으로 기술할 수 있다. 전술한 실시예에서는 ebuttm:ColorTransformation 내에 HighTone, LowTone 을 전달하는 예를 들었지만, HighTone, LowTone에 대한 정보는 메타 데이터 내에 별도의 엘리먼트로 정의하거나 dynamic range 와 관련된 부분, 예를 들어 ebuttm:DynamicRanges, ebuttm:SupplementaryDynamicRange 등에도 정의할 수 있다. (b)의 실시예에서도 전술한 바와 같이 PeakBrightness, BlackLevel, ContrastRatio는 namedDynamicRange에 정의한 값을 사용할 수 있다. 또한 PeakBrightness2, BlackLevel2, ContrastRatio2도 namedDynamicRange에 정의한 후 사용될 수 있다.

도 9는 본 발명의 일 실시예에 따른 자막의 메타 데이터의 요소에 대한 자세한 설명을 나타낸다. (a)는 EOTF 필드를 나타내고, (b)는 BitDepth를 나타낸다.

메타 데이터는 각 dynamic range 에 따라 사용 된 EOTF 가 다른 경우 기본 EOTF에 대한 정보인 ebuttm:EOTF 와 함께 ebuttm:SupplementaryEOTF 를 통해 추가 EOTF에 대한 정보를 전달할 수 있다. 또는 Ebuttm:EOTFs를 통해 두개의 EOTF에 대한 정보를 하나의 엘리먼트에 묶어서 전달할 수도 있으며, 이 경우 앞에 위치하는 것이 기본 요소이다. 각각의 경우, BT.1886, SMPTE 2084와 같이 기존에 정의 된 EOTF 정보를 namedEOTF에서 정의하고 이를 사용할 수 있다. 본 필드는 dynamic range mapping 적용 전 luminance linearization을 을 위해 사용할 수 있다.

메타 데이터는 방송 서비스에 따라 서로 다른 종류의 bitdepth가 지원되는 경우 ebuttm:BitDepth와 ebuttm:SupplementaryBitDepth를 통해 각각의 bitdepth를 표시할 수 있다. 이전의 예와 같이 각각을 표현하는 기본 정보 엘리먼트 및 추가 정보 엘리먼트를 사용하거나 혹은 Ebuttm:BitDepths를 사용하여 지원되는 bitdepth를 동시에 표현할 수 있다. 이 경우 base가 되는 요소를 앞에 기술한다. 본 필드는 자막 자체의 bitdepth와 수신기 혹은 영상의 bitdepth를 비교하는 기준으로 사용될 수 있으며, 수신된 자막에 8bit bitdepth 이상의 bitdepth가 사용되었음을 알리거나 디텍트 하는 용도로 사용할 수 있다. ebuttm:RefBitDepth가 사용되고, 9 이상의 값을 갖는 경우 메타 데이터는 새로 정의되는 색상 표현 방법을 이용하여 색상을 표현할 수 있다.

전술한 바와 같이 본 발명을 통해 전달되는 자막의 메타데이터를 활용하는 경우의 수신기는 영상 특성 메타 데이터 중 기본 정보인 ebuttm:Gamut, ebuttm:DynamicRange, ebuttm:EOTF, ebuttm:BitDepth, 추가 정보인 ebuttm:SupplementaryGamut, ebuttm:SupplementaryDynamicRange, ebuttm:SupplementaryEOTF, ebuttm:SupplementaryBitDepth, 기본 및 추가 정보를 모두 포함하는 ebuttm:Gamuts, ebuttm:DynamicRanges, ebuttm:EOTFs, ebuttm:BitDepths를 통해 자막이 지원하는 비디오 요소와 수신기에서 지원하는 비디오 요소에 대한 비교를 수행할 수 있다. 또한 수신기가 추가 지원 요소를 사용하는 것으로 판단되는 경우, 적합한 format에 맞추어 color gamut, dynamic range, bitdepth 측면에서 적절한 값을 선택하여 사용할 수 있다.

또한 수신기는 메타 데이터 내의 정보를 기반으로 자막에서 지원하는 영상 특성을 표현함과 동시에, 각 특성에 대한 실제 색상 표현 값을 복수의 특성에 대해 모두 표현할 수 있다. 여기서 밝기, bit depth는 색상 표현에 포함될 수 있다. 본 발명에서 기술하는 XML subtitle은 하위 호환성을 갖는 것을 기본으로 가정하기 때문에, 기존 수신기 및 신규 수신기에서 모두 처리 가능한 방법으로 자막에 대한 정보를 표현하는 방법이 필요하다. 아래에서는 자막의 색상을 표현하는 방법에 대해 설명할 수 있다.

도 10은 본 발명의 일 실시예에 따른 자막의 색상을 표현하는 방법을 나타낸다. a)는 named color value를 사용하여 자막의 색상을 표현하는 방법이다. XML 자막에서의 색상 표현은 기본적으로 16진수로 표현하게 되지만, 잘 알려진 색상에 대해 색상의 이름으로 표현할 수 있다. 예를 들어 red를 8bit RGB 로 #FF0000으로 표현할 수 있으며, “red” 로 표현할 수도 있다. 이 때, 특정 색상에 대해 서로 다른 color gamut에서 서로 다른 digital 값을 갖는 경우에 하나의 digital 값에 대해 서로 다른 color가 표현될 수 있다. 하지만 색상의 이름으로 표현된 경우 서로 다른 color gamut이라도 동일한 색상을 표현할 수 있다. 예를 들어, 도시된 바와 같이 named color "red"로 표현하는 경우 BT. 709를 사용하는 수신기에서는 #FF0000값으로 BT.2020를 사용하는 수신기에서는 #C80000으로 각각 해석하여 적용할 수 있다. 이러한 named color에 대한 매핑은 표준 문서에 미리 정의될 수 있다.

b)는 matching color value를 전달하는 경우를 나타낸다. 수신기는 XML 자막이 지원하는 추가 영상 특성을 표현하는 색상 값을 직접 전달할 수도 있다. 즉, tts:color 와 같이 기존 EBU-TT-D 등에서 색상 표현 방법에서의 표현은 그대로 살리고, tts:colorSupplementary를 통해 추가적으로 지원되는 color gamut, dynamic range, bit depth에 대한 색상 값을 추가적으로 전달할 수 있다. 이 때, 기존 수신기는 해석 가능한 tts:color 만을 해석하게 되고, 추가 color gamut (및 bitdepth)에 대한 해석이 가능하고 기능상으로 지원되는 수신기에서는 tts:colorSupplementary에서 표현하는 색상을 사용하게 된다. 이 때, 추가 지원되는 color gamut, dynamic range등의 경우 높은 bit depth를 사용할 수 있다. 예를 들어 12 bit 혹은 16 bit 색상 표현 방법이 사용되는 경우, 도시된 바와 같이 <ebuttdt:distributionColorTypeExtension12> 혹은 <ebuttdt:distributionColorTypeExtension16>을 정의할 수 있다.

도 11은 본 발명의 다른 실시예에 따른 자막의 색상을 표현하는 방법을 나타낸다. 자막에 대한 메타 데이터는 전술한 실시예와 같이 추가 지원요소에 해당하는 값을 직접 전달할 수 있지만, bit 효율 등을 고려하여 base가 되는 값과의 차이를 추가 정보를 통해 전달할 수도 있다. 즉, “Supplementary color = base color + diff” 를 만족하는 diff 를 전달하는 개념으로써, 차이값에 대한 부호 및 크기를 표현하기 위해 도시된 바와 같은 color difference type을 정의할 수 있다.즉, tts:colorSupplementary 에 대해 지원하는 색상 표현 값 사이의 차이를 전달하기 위해 <ebuttdt:distributionColorDifferenceTypeExtension12> 또는 <ebuttdt:distributionColorDifferenceTypeExtension16>을 이용한 표현 방법에 대한 예시를 나타낼 수 있다. 각 차이 정보는 sign 및 차이값의 크기를 포함할 수 있으며 수신기는 색상에 대한 기본 정보에서 차이 정보를 가감하여 확장된 색상에 대한 정보를 획득할 수 있다.

도 12는 본 발명의 다른 실시예에 따른 자막의 색상을 표현하는 방법을 나타낸다. 메타 데이터는 전술한 실시예와 같이 추가 지원 서비스에 대해 대응되는 값을 직접적으로 전달하는 방법 뿐 아니라 base color로부터 변환하는 방법에 대한 정보를 제공함으로써 간접적으로 색상을 전달할 수 있다. 본 발명에서는 이를 transformation 방법 또는 conversion 방법으로 칭할 수 있다. conversion 방법은 메타 데이터의 타겟 서비스의 color gamut, dynamic range, 및 bitdepth, 추가적으로 자막의 밝기 범위인 HighTone 및 LowTone을 바탕으로 각 수신기에 맞게 자막의 색상을 구현할 수 있다. 또는 video에서 scalable approach를 제공하고, video의 base 및 target이 자막에서 제공하는 base 및 target과 일치할 때 video의 conversion 방법을 사용할 수도 있다. 본 발명은 video와 고려하는 서비스의 종류가 다른 상황, 또는 video와 수신기에서 제공하는 conversion 성능이 서로 다른 상황에서 각각의 수신기가 일정한 품질의 자막 서비스를 제공하는 방법을 설명할 수 있다. 본 발명에서는 ebuttm:ColorTransformation을 이용할 수 있다.

ebuttm:ColorTransformation에 대한 실시 예로써 다음을 고려할 수 있다. 자막에 대한 메타 데이터는 Color Transformation으로는 각각 color gamut scalability와 관련된 정보와 dynamic range scalability와 관련된 정보를 전달할 수 있다. 이를 지원하기 위한 방법으로는 (1) video의 transformation 함수를 사용하는 방법, (2) HighTone, LowTone 정보를 통해 별도 변환 식 없이 수신기 자율에 맞기는 방법, (3) LUT를 전달하는 방법, 및 (4) transformation function을 전달하는 방법을 사용할 수 있다. 방법 (1)은 ebuttm:ColorTransformation 내에서 “video”로 표현될 수 있으며 video의 transformation을 차용해서 쓰는 경우 메타데이터로 특별히 전달할 추가 정보는 필요하지 않을 수 있다. 방법 (2)는 ebuttm:ColorTransformation 내에서 “tone”으로 표현될 수 있으며 메타 데이터를 통해 전달되는 자막 적정 밝기 (HighTone, LowTone) 정보를 통해 수신기에서 선호하는 밝기 변환을 사용할 수 있다. 이 때, Linear mapping이 default로 지정될 수 있다. 방법 (3)은 ebuttm:ColorTransformation 내에서 “LUT”로 표현될 수 있으며 mapping 의 input/output에 해당하는 값을 전달할 수 있다. 방법 (4)는 ebuttm:ColorTransformation 내에서 “function”으로 표현될 수 있으며 별도의 변환 함수를 사용하는 경우로써 메타 데이터는 함수의 type 및 각각의 계수를 포함할 수 있다. Color gamut transformation을 위한 LUT의 경우 ebuttm:ColorTransformation는 RGB to RGB 변환을 위한 값을 전달할 수 있고, 별도 변환식이 주어지는 경우 transformation matrix의 계수를 전달할 수 있다. Dynamic range transformation은 Y 값에 대한 변화를 중심으로 생각하며, 변환식으로 주어지는 경우 linear, exponential, piecewise linear, log, s-curve 등의 함수로 나눌 수 있으며, 메타 데이터는 각 함수에 필요한 계수를 전달할 수 있다. 이 때, 자막 변환을 위한 적정 밝기 범위가 필요한데, ebuttm:ColorTransformation 내에 HighTone, LowTone 을 전달할 수 있다. 또한 메타 데이터 내에 별도 엘리먼트로 정의하거나 dynamic range 와 관련된 부분, 즉 ebuttm:DynamicRanges, ebuttm:SupplementaryDynamicRange 등에도 HighTone, LowTone을 정의할 수 있다.

본 실시예에서는 color gamut scaling과 dynamic range scaling 정보를 별도로 전달하는 경우를 고려하였지만, BT.709+SDR 로부터 BT.709+HDR, BT.2020+SDR, 또는 BT.2020+HDR 로의 변환을 하나의 function으로 합쳐서 전달할 수도 있다.

도 13은 본 발명의 일 실시예에 따른 방송 송신기를 나타낸 블록도이다. 본 발명에 따른 방송 송신기(1701)은 인코더(1702), 다중화부(1703) 및/또는 송신부(1704)를 포함할 수 있다.

방송 송신기(1701)에 입력되는 비디오 데이터의 해상도는 UHD, HD 또는 SD가 될 수 있다. 또한 방송 송신기(1701)에 입력되는 자막 정보는 XML로 작성될 수 있다. 방송 송신기(1701)에 입력된 비디오 데이터는 인코더(1702)에 의해 인코딩될 수 있다. 전송단은 비디오 데이터에 대한 인코딩 방식으로써 HEVC(High Efficiency Video Coding)를 사용할 수 있다. 전송단은 인코딩된 비디오 데이터와 XML 자막을 동기화하고 다중화부(1703)를 이용하여 다중화할 수 있다. 여기서 XML 자막은 전술한 바와 같이 자막에 대한 메타 데이터를 포함할 수 있으며, 자막의 color gamut, dynamic range, EOTF 및/또는 bitdepth에 대한 정보를 포함할 수 있다. 또한 자막에 대한 메타 데이터는 서로 다른 color gamut, dynamic range, EOTF 및/또는 bitdepth를 지원하는 서비스에 대응하는 자막 표현 정보를 포함할 수 있으며 동일 정보에 대해 복수의 값을 포함할 수도 있다. 이는 각 수신단에서 지원할 수 있는 서비스에 따라 선택적으로 자막 표현 정보를 결정하게 할 수 있다. 또한 실시예에 따라 자막 표현 정보는 기본 정보 및 변형 함수를 포함하여 수신기에 따라 기본 정보를 그대로 사용하거나 변형하여 사용할 수 있게 지원할 수 있다.

송신부(1704)는 다중화부(1703)로부터 출력된 트랜스포트 스트림을 방송 신호로써 전송할 수 있다. 여기서, 트랜스포트 스트림은 전송 전에 채널 코딩 및 변조된 후 방송 신호로써 전송될 수 있다.

도 14는 본 발명의 일 실시예에 따른 방송 수신기를 나타낸 블록도이다. 본 발명에 따른 방송 수신기(1801)은 수신부(1802), 역다중화부(1803) 및/또는 디코더(1804)를 포함할 수 있다.

수신부(1802)에 의해 수신된 방송 신호는 복조된 후 채널 디코딩될 수 있다. 채널 디코딩된 방송 신호는 역다중화부(103)에 입력되어 비디오 스트림 및 자막 스트림으로 역다중화될 수 있다. 역다중화부의 출력은 디코더(1804)에 입력될 수 있다. 디코더는 비디오 디코더 및 XML 파서를 포함할 수 있다. 즉 비디오 스트림은 비디오 디코더에 의해, 자막 스트림은 자막 디코더에 의해 디코딩되거나 또는 XML 파서에 의해 파싱되어 각각 비디오 데이터 및 자막 데이터로 출력될 수 있다. 여기서 비디오 디코더와 XML 파서는 상호 메타 데이터를 교환할 수 있다. 즉, XML 파서는 전술한 바와 같이 비디오에 대한 메타 데이터와 자막에 대한 메타 데이터를 비교할 수 있다. 여기서 비교 대상이 되는 메타 데이터는 영상 및 자막의 dynamic range, color gamut, bit depth 등을 포함할 수 있다. 또한 수신기의 디스플레이에 대한 메타 데이터와 자막에 대한 메타 데이터를 비교할 수도 있다. 여기서 비교 대상이 되는 메타 데이터는 디스플레이 환경 및 자막의 dynamic range, color gamut, bit depth 등을 포함할 수 있다.

특히 본 발명에서는 DVB UHD phase 2를 서비스하는 경우에도 phase 1 수신기가 자막을 제공 받을 수 있도록 메타 데이터를 생성하여 수신기에 제공할 수 있다. 즉, 하위 호환성을 갖는 자막 서비스를 제공할 수 있다. 수신기는 자막의 메타 데이터를 참고하여 수신기에 적합한 자막 표현 정보를 선택하거나 변형하여 자막을 디스플레이할 수 있다. 이에 대한 자세한 설명은 전술한 바와 같다. 비디오 데이터 및 자막 데이터는 동기화되어 수신기에 의해 디스플레이될 수 있다.

도 15는 본 발명의 일 실시예에 따른 방송 수신기의 상세 구성을 나타낸 도면이다. 방송 수신기는 수신부(1901), 복조부(1902), 역다중화부(1903), 비디오 디코더(1904), XML 자막 디코더(1905), 오디오 비디오 자막 동기화부(A/V/S sync, 1906), 시스템 정보 처리부(SI processor, 1907), 그래픽 엔진(1908) 및/또는 디스플레이 처리부(1909)를 포함할 수 있다.

수신부(1901)는 송신기에 의해 송신된 방송 신호를 수신할 수 있다. 수신된 방송 신호는 복조부(1902)에 입력될 수 있다.

복조부(1902)는 방송 신호를 복조하여 TS (transport stream)를 출력할 수 있다. TS는 역다중화부(1903)에 입력되어 역다중화될 수 있다. 역다중화된 TS는 HEVC bitstream, XML subtitle, SI(system information)을 포함할 수 있다. 여기서 XML subtitle은 메타 데이터를 포함할 수 있다.

비디오 디코더(1904)는 HEVC bitstream을 입력받아 디코딩하고 video frame을 출력할 수 있다.

XML 자막 디코더(1905)는 XML subtitle을 입력 받아 자막을 추출할 수 있다. XML 자막 디코더(1905)는 XML subtitle에 포함된 메타 데이터를 파싱하고 영상 또는 디스플레이 환경에 대한 메타 데이터와 비교할 수 있다. 여기서 비교 대상이 되는 메타 데이터는 dynamic range, color gamut, bit depth 등을 포함할 수 있다. XML 자막 디코더(1905)는 비교된 메타 데이터 간의 매칭 여부에 따라 자막의 메타 데이터에 대한 선택 또는 변형을 수행할 수 있다. XML 자막 디코더(1905)는 비교된 자막 데이터가 매칭되거나 DVB UHD phase 1 수신기를 지원하는 경우, 별도의 변형을 수행하지 않고 자막의 메타 데이터에 포함된 기본 정보와 자막을 그래픽 엔진으로 전달할 수 있다. 이와 달리 XML 자막 디코더(1905)는 비교된 자막 데이터가 영상 또는 디스플레이의 메타 데이터와 매칭되지 않는 경우 또는 DVB UHD phase 2 수신기를 지원하는 경우, 자막에 대한 메타 데이터 중 기본 정보 및 추가 정보를 선택하거나 기본 정보를 변형하고, 자막 데이터와 선택 또는 변형된 메타 데이터를 그래픽 엔진으로 전달할 수 있다. 이를 통해 수신기에 따라 적응적으로 자막의 품질을 지원할 수 있다. 이에 대한 자세한 설명은 전술한 바와 같다.

시스템 정보 처리부(1907)는 역다중화부로부터 출력된 SI(system information) 정보를 수신하여 OSD 정보를 추출할 수 있다.

그래픽 엔진(1908)은 XML 자막 디코더(1905)로부터 자막 및 자막의 메타 데이터를 수신하여 자막 영상을 출력할 수 있다. 자막 영상은 자막 및 자막의 메타 데이터에 기초하여 생성되며, 자막의 메타 데이터에 대한 컨버젼 여부에 따라 출력되는 자막 영상의 색상, 밝기 등이 달라질 수 있다.

디스플레이 처리부(1909)은 비디오 프레임 및 자막을 수신하여 디스플레이 프레임을 출력할 수 있다. 디스플레이 처리부(1909)은 비디오 프레임 및 자막에 추가적으로 OSD(On Screen Display)정보를 수신하여 디스플레이 프레임을 출력할 수도 있다. 출력된 디스플레이 프레임은 영상 출력 장치에 의해 디스플레이될 수 있으며, 본 발명에서 설명한 XML 자막과 비디오 프레임이 함께 디스플레이될 수 있다.

도 16은 본 발명의 일 실시예에 따른 XML 자막을 포함하는 방송 신호를 전송하는 방법을 나타낸 도면이다. XML 자막을 포함하는 방송 신호를 전송하는 방법은 비디오 스트림을 인코딩하여 비디오 데이터를 생성하는 단계(S2210), 생성된 비디오 데이터 및 자막 정보를 포함하는 방송신호를 생성하는 단계(S2220) 및 생성된 방송신호를 전송하는 단계(S2230)를 포함할 수 있다.

비디오 스트림을 인코딩하여 비디오 데이터를 생성하는 단계(S2210)는 UHD, HD 또는 SD의 해상도를 갖는 비디오 스트림을 입력 받고, 비디오 스트림을 인코딩하여 비디오 데이터를 생성할 수 있다. 여기서, 비디오 스트림은 HEVC(High Efficiency Video Coding)에 의해 인코딩될 수 있다. 이와 함께 XML 자막 데이터를 생성할 수 있다. 전술한 바와 같이, XML 자막 데이터는 메타 데이터를 포함할 수 있으며 메타 데이터는 UHD 방송에 적합한 XML 자막 관련 데이터를 포함할 수 있다. 즉, 메타 데이터는 dynamic range, color gamut, bit depth, EOTF 정보를 포함할 수 있으며, 이들 정보는 UHD 방송의 wide color gamut (WCG), high dynamic range (HDR)에 대응하는 값을 가질 수 있다. 또한 메타 데이터는 수신기 성능별 dynamic range, color gamut, bit depth, EOTF 정보를 포함함으로써 수신기 별로 선택적으로 상기 자막 표현 정보들을 선택함으로써 수신기 적응적인 자막 표현을 지원할 수 있다.

생성된 비디오 데이터 및 자막 데이터를 포함하는 방송신호를 생성하는 단계(S2220)는 방송 신호 프레임을 빌드하고 변조 과정을 이용하여 방송 신호를 생성할 수 있다.

생성된 방송신호를 전송하는 단계(S2230)는 트랜스포트 스트림을 방송 신호로써 전송할 수 있다.

도 17은 본 발명의 일 실시예에 따른 XML 자막을 포함하는 방송 신호를 수신하는 방법을 나타낸 도면이다. XML 자막을 포함하는 방송 신호를 수신하는 방법은 방송 신호를 수신하는 단계(S2310), 수신된 방송 신호를부터 비디오 데이터 및 자막 데이터로 역다중화하는 단계(S2320) 및 비디오 데이터 및 자막 데이터를 디코딩하는 단계(S2330)를 포함할 수 있다.

방송 신호를 수신하는 단계(S2310)는 수신부를 이용하여 수신된 방송 신호는 복조된 후 채널 디코딩될 수 있다.

수신된 방송 신호를 비디오 데이터 및 자막 데이터로 역다중화하는 단계(S2320)는 채널 디코딩된 방송 신호를 역다중화부를 이용하여 비디오 데이터 및 자막 데이터로 역다중화할 수 있다.

비디오 데이터 및 자막 데이터를 각각 디코딩하는 단계(S2330)는 비디오 디코더를 이용하여 비디오 데이터를 디코딩하고 비디오 데이터를 획득할 수 있다. 이 단계에서 자막 데이터에 대해서는 자막 디코더 또는 XML 파서를 이용하여 자막 데이터를 획득할 수 있다. 수신기는 XML subtitle을 입력 받아 자막을 추출할 수 있다. 수신기는 XML subtitle에 포함된 메타 데이터를 파싱하고 영상 또는 디스플레이 환경에 대한 메타 데이터와 비교할 수 있다. 여기서 비교 대상이 되는 메타 데이터는 dynamic range, color gamut, bit depth 등을 포함할 수 있다. 수신기는 비교된 메타 데이터 간의 매칭 여부에 따라 자막의 메타 데이터에 대한 선택 또는 변형을 수행할 수 있다. 수신기는 비교된 자막 데이터가 매칭된 경우 또는 수신기가 메타 데이터에 포함된 기본 정보를 지원하는 경우, 별도의 선택 또는 변형을 수행하지 않고 자막의 메타 데이터에 포함된 기본 정보와 자막을 그래픽 엔진으로 전달할 수 있다. 이와 달리 수신기는 비교된 자막 데이터가 영상 또는 디스플레이의 메타 데이터와 매칭되지 않는 경우 또는 수신기가 메타 데이터에 포함된 기본 정보 및 추가 정보를 지원하는 경우, 자막에 대한 메타 데이터를 선택 또는 변형하고, 자막 데이터와 선택 또는 변형된 메타 데이터를 출력할 수 있다. 이를 통해 자막과 영상의 정합성을 높이고 수신기에 따른 차별적인 자막 서비스를 지원할 수 있다. 또한 본 발명에서 설명한 자막에 대한 메타 데이터는 하위 호환성을 지원하는 자막 서비스를 지원할 수 있다.

UHD는 다양한 특성을 영상의 화질 요소로 고려하는 만큼 컨텐츠 및 수신기의 다양성이 확대될 가능성이 크다. 하지만 텍스트 기반 자막의 경우 다양한 비디오 혹은 수신기 종류에 대해 각각의 버전을 만드는 것은 비효율 적이다. XML 자막의 경우 영상 크기에 독립적으로 적용할 수 있다는 장점이 있지만, WCG, HDR 등의 요소가 변하는 경우에 대한 고려는 없는데, 본 발명의 방법을 통해 단일 XML 자막을 이용해 다양한 color gamut, dynamic range 환경에 대해 동일한 품질의 서비스를 제공할 수 있다. 본 발명은 수신기의 입장에서 기술하지만, production 혹은 자막 제작 환경에서도 사용할 수 있다. 또한, IP streaming 기반의 서비스 뿐 아니라 XML 기반 자막 서비스를 이용하는 모든 방송 서비스(e.g. DVB UHD-1 서비스)에서 이용 가능하다. 특히, DVB와 같은 경우 UHD-1 phase 2 서비스는 phase 1과의 하위 호환성을 만족시키도록 서비스가 이뤄질 것으로 보이며, 이 경우 기존 수신기에서의 동작을 동시에 만족시킬 수 있는 자막 서비스 방법으로써 본 제안을 사용할 수 있다. 또한, IP streaming service 혹은 storage media의 경우 다양한 화질의 영상을 제공할 수 있으며, 이 때 단일 자막 서비스로 다양한 화질의 영상을 지원하는데에도 제안하는 방법을 사용할 수 있다.

설명의 편의를 위하여 각 도면을 나누어 설명하였으나, 각 도면에 서술되어 있는 실시 예들을 병합하여 새로운 실시 예를 구현하도록 설계하는 것도 가능하다. 그리고, 당업자의 필요에 따라, 이전에 설명된 실시 예들을 실행하기 위한 프로그램이 기록되어 있는 컴퓨터에서 판독 가능한 기록 매체를 설계하는 것도 본 발명의 권리범위에 속한다.

본 발명에 따른 장치 및 방법은 상술한 바와 같이 설명된 실시 예들의 구성과 방법이 한정되게 적용될 수 있는 것이 아니라, 상술한 실시 예들은 다양한 변형이 이루어질 수 있도록 각 실시 예들의 전부 또는 일부가 선택적으로 조합되어 구성될 수도 있다.

한편, 본 발명의 영상 처리 방법은 네트워크 디바이스에 구비된 프로세서가 읽을 수 있는 기록매체에 프로세서가 읽을 수 있는 코드로서 구현하는 것이 가능하다. 프로세서가 읽을 수 있는 기록매체는 프로세서에 의해 읽혀질 수 있는 데이터가 저장되는 모든 종류의 기록장치를 포함한다. 프로세서가 읽을 수 있는 기록 매체의 예로는 ROM, RAM, CD-ROM, 자기 테이프, 플로피디스크, 광 데이터 저장장치 등이 있으며, 또한, 인터넷을 통한 전송 등과 같은 캐리어 웨이브의 형태로 구현되는 것도 포함한다. 또한, 프로세서가 읽을 수 있는 기록매체는 네트워크로 연결된 컴퓨터 시스템에 분산되어, 분산방식으로 프로세서가 읽을 수 있는 코드가 저장되고 실행될 수 있다.

또한, 이상에서는 본 발명의 바람직한 실시 예에 대하여 도시하고 설명하였지만, 본 발명은 상술한 특정의 실시 예에 한정되지 아니하며, 청구범위에서 청구하는 본 발명의 요지를 벗어남이 없이 당해 발명이 속하는 기술분야에서 통상의 지식을 가진 자에 의해 다양한 변형실시가 가능한 것은 물론이고, 이러한 변형실시들은 본 발명의 기술적 사상이나 전망으로부터 개별적으로 이해돼서는 안 될 것이다.

그리고, 당해 명세서에서는 물건 발명과 방법 발명이 모두 설명되고 있으며, 필요에 따라 양 발명의 설명은 보충적으로 적용될 수가 있다.

발명의 실시를 위한 형태

발명의 실시를 위한 형태는 위의 발명의 실시를 위한 최선의 형태에서 함께 기술되었다.

본원 발명은 방송 및 비디오 신호 처리 분야에서 사용 가능하고 반복 가능성이 있는 산업상 이용가능성이 있다.

Claims (15)

- 비디오 데이터 및 자막 데이터를 포함하는 방송 신호를 생성하는 단계; 및

상기 생성된 방송 신호를 전송하는 단계;를 포함하는 방송 신호 송신 방법. - 제 1 항에 있어서,

상기 자막 데이터는 XML 자막 데이터를 포함하는 방송 신호 송신 방법. - 제 2 항에 있어서,

상기 XML 자막 데이터는 자막 텍스트 및 자막 메타 데이터를 포함하는 방송 신호 송신 방법. - 제 3 항에 있어서,

상기 자막 메타 데이터는 고화질 방송을 위한 확장 색상 영역 및 하이 다이내믹 레인지에 대응하는 정보를 포함하는 방송 신호 송신 방법. - 제 3 항에 있어서,

상기 자막 메타 데이터는 자막의 색 영역, 자막의 다이내믹 레인지, 자막의 비트 뎁스에 대한 기본 정보 및 추가 정보를 포함하는 방송 신호 송신 방법. - 비디오 데이터 및 자막 데이터를 포함하는 방송 신호를 수신하는 단계; 및

상기 비디오 데이터 및 자막 데이터를 처리하여 출력하는 단계;를 포함하는 방송 신호 수신 방법. - 제 6 항에 있어서,

상기 자막 데이터는 XML 자막 데이터를 포함하는 방송 신호 수신 방법. - 제 7 항에 있어서,

상기 XML 자막 데이터는 자막 텍스트 및 자막 메타 데이터를 포함하는 방송 신호 수신 방법. - 제 8 항에 있어서,

상기 자막 메타 데이터는 고화질 방송을 위한 확장 색상 영역 및 하이 다이내믹 레인지에 대응하는 정보를 포함하는 방송 신호 수신 방법. - 제 8 항에 있어서,

상기 자막 메타 데이터는 자막의 색 영역, 자막의 다이내믹 레인지, 자막의 비트 뎁스에 대한 기본 정보 및 추가 정보를 포함하는 방송 신호 수신 방법. - 제 8 항에 있어서,

수신기 디스플레이 속성 및 상기 자막 메타 데이터 사이의 매칭 여부를 디텍트하는 단계를 더 포함하는 방송 신호 수신 방법. - 제 8 항에 있어서,

상기 자막 메타 데이터는 복수의 서비스를 지원하는 적어도 하나 이상의 색 영역, 다이내믹 레인지 및 비트 뎁스에 대한 정보를 포함하는 방송 신호 수신 방법. - 제 8 항에 있어서,

상기 자막 메타 데이터는 색 영역, 다이내믹 레인지 및 비트 뎁스에 대한 정보 및 색상 변형 함수를 포함하는 방송 신호 수신 방법. - 비디오 데이터 및 자막 데이터를 포함하는 방송 신호를 생성하는 인코더; 및

상기 생성된 방송 신호를 전송하는 송신부;를 포함하는 방송 신호 송신 장치. - 비디오 데이터 및 자막 데이터를 포함하는 방송 신호를 수신하는 수신부; 및

상기 비디오 데이터 및 상기 자막 데이터를 디코딩하는 디코더;를 포함하는 방송 신호 수신 장치.

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US201462030581P | 2014-07-29 | 2014-07-29 | |

| US62/030,581 | 2014-07-29 | ||

| PCT/KR2015/007202 WO2016017961A1 (ko) | 2014-07-29 | 2015-07-10 | 방송 신호 송수신 방법 및 장치 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20170007764A true KR20170007764A (ko) | 2017-01-20 |

Family

ID=55217795

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020167033466A KR20170007764A (ko) | 2014-07-29 | 2015-07-10 | 방송 신호 송수신 방법 및 장치 |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US10368144B2 (ko) |

| KR (1) | KR20170007764A (ko) |

| WO (1) | WO2016017961A1 (ko) |

Families Citing this family (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2015190044A1 (ja) | 2014-06-10 | 2015-12-17 | パナソニックIpマネジメント株式会社 | 表示システム、表示方法および表示装置 |

| US10362287B2 (en) * | 2014-09-12 | 2019-07-23 | Sony Corporation | Information processing apparatus, information processing method and program, and recording medium |

| WO2016163603A1 (ko) * | 2015-04-05 | 2016-10-13 | 엘지전자 주식회사 | Xml 자막에 기반한 방송 서비스를 위한 방송 신호 송수신 방법 및 장치 |

| US10735755B2 (en) * | 2015-04-21 | 2020-08-04 | Arris Enterprises Llc | Adaptive perceptual mapping and signaling for video coding |

| JP6519329B2 (ja) * | 2015-06-09 | 2019-05-29 | ソニー株式会社 | 受信装置、受信方法、送信装置および送信方法 |

| US10237591B2 (en) * | 2015-09-09 | 2019-03-19 | Lg Electronics Inc. | Broadcast signal transmission device, broadcast signal reception device, broadcast signal transmission method, and broadcast signal reception method |

| JP6844112B2 (ja) | 2016-03-17 | 2021-03-17 | ソニー株式会社 | 情報処理装置、情報記録媒体、および情報処理方法、並びにプログラム |

Family Cites Families (29)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR100939711B1 (ko) | 2002-12-12 | 2010-02-01 | 엘지전자 주식회사 | 텍스트 기반의 서브타이틀 재생장치 및 방법 |

| KR100739680B1 (ko) | 2004-02-21 | 2007-07-13 | 삼성전자주식회사 | 스타일 정보를 포함하는 텍스트 기반 서브타이틀을 기록한저장 매체, 재생 장치 및 그 재생 방법 |

| US7603620B2 (en) | 2004-12-20 | 2009-10-13 | Ricoh Co., Ltd. | Creating visualizations of documents |

| JP4980018B2 (ja) | 2006-09-21 | 2012-07-18 | パナソニック株式会社 | 字幕生成装置 |

| US8942289B2 (en) | 2007-02-21 | 2015-01-27 | Microsoft Corporation | Computational complexity and precision control in transform-based digital media codec |

| KR20080078217A (ko) | 2007-02-22 | 2008-08-27 | 정태우 | 영상에 포함된 객체 색인 방법과 그 색인 정보를 이용한부가 서비스 방법 및 그 영상 처리 장치 |

| JP5219183B2 (ja) * | 2007-03-01 | 2013-06-26 | 任天堂株式会社 | 映像コンテンツ表示プログラム、情報処理装置、映像コンテンツ表示方法および映像コンテンツ表示システム |

| US9013551B2 (en) * | 2008-12-01 | 2015-04-21 | Imax Corporation | Methods and systems for presenting three-dimensional motion pictures with content adaptive information |

| US8599242B2 (en) | 2008-12-02 | 2013-12-03 | Lg Electronics Inc. | Method for displaying 3D caption and 3D display apparatus for implementing the same |

| BRPI1008575A2 (pt) | 2009-02-17 | 2016-03-08 | Samsung Electronics Co Ltd | método de processamento de um fluxo gráfico, aparelho para processamento de um fluxo gráfico, e meio de armazenamento legível por computador |

| US8436918B2 (en) | 2009-02-27 | 2013-05-07 | Deluxe Laboratories, Inc. | Systems, apparatus and methods for subtitling for stereoscopic content |

| US20140009677A1 (en) | 2012-07-09 | 2014-01-09 | Caption Colorado Llc | Caption extraction and analysis |

| KR20100115845A (ko) | 2009-04-21 | 2010-10-29 | 문강환 | 동영상 데이터 스트리밍 상에 실시간 자막송출 시스템 |

| US8718367B1 (en) * | 2009-07-10 | 2014-05-06 | Intuit Inc. | Displaying automatically recognized text in proximity to a source image to assist comparibility |

| CN102065234B (zh) | 2009-11-12 | 2014-11-05 | 新奥特(北京)视频技术有限公司 | 基于分布式字幕处理系统的字幕制播方法及系统 |

| WO2011129631A2 (ko) | 2010-04-14 | 2011-10-20 | 삼성전자 주식회사 | 디지털 자막 방송을 위한 방송 비트스트림을 생성하는 방법 및 그 장치, 디지털 자막 방송을 위한 방송 비트스트림을 수신하는 방법 및 그 장치 |

| KR20110138151A (ko) * | 2010-06-18 | 2011-12-26 | 삼성전자주식회사 | 자막 서비스를 포함하는 디지털 방송 서비스를 제공하기 위한 비디오 데이터스트림 전송 방법 및 그 장치, 자막 서비스를 포함하는 디지털 방송 서비스를 제공하는 비디오 데이터스트림 수신 방법 및 그 장치 |

| JP6062363B2 (ja) * | 2011-07-29 | 2017-01-18 | サターン ライセンシング エルエルシーSaturn Licensing LLC | ストリーミング配信装置および方法、ストリーミング受信装置および方法、ストリーミングシステム、プログラム、並びに記録媒体 |

| CN103179093B (zh) | 2011-12-22 | 2017-05-31 | 腾讯科技(深圳)有限公司 | 视频字幕的匹配系统和方法 |

| JP6003992B2 (ja) | 2012-08-27 | 2016-10-05 | ソニー株式会社 | 受信装置および受信方法 |

| US10055866B2 (en) | 2013-02-21 | 2018-08-21 | Dolby Laboratories Licensing Corporation | Systems and methods for appearance mapping for compositing overlay graphics |

| US9161066B1 (en) | 2013-03-14 | 2015-10-13 | Google Inc. | Methods, systems, and media for generating and presenting supplemental content based on contextual information |

| JP2016518790A (ja) * | 2013-05-03 | 2016-06-23 | コファックス, インコーポレイテッド | モバイル装置を用いて取込まれたビデオにおけるオブジェクトを検出および分類するためのシステムおよび方法 |

| CN105359507B (zh) | 2013-07-12 | 2019-08-09 | 索尼公司 | 再现装置、再现方法和记录介质 |

| EP3022935A1 (en) * | 2013-07-19 | 2016-05-25 | Koninklijke Philips N.V. | Hdr metadata transport |

| CN103826114B (zh) | 2013-11-15 | 2017-04-19 | 青岛海信电器股份有限公司 | 一种立体显示方法及自由立体显示装置 |

| WO2015126223A1 (en) | 2014-02-24 | 2015-08-27 | Lg Electronics Inc. | Apparatus for transmitting broadcast signals, apparatus for receiving broadcast signals, method for transmitting broadcast signals and method for receiving broadcast signals |

| JP6217462B2 (ja) * | 2014-03-05 | 2017-10-25 | ソニー株式会社 | 画像処理装置及び画像処理方法、並びに画像処理システム |

| CN111510248B (zh) | 2014-06-09 | 2023-04-28 | Lg电子株式会社 | 发送和接收服务指南信息的方法及其装置 |

-

2015

- 2015-07-10 US US15/322,604 patent/US10368144B2/en active Active

- 2015-07-10 KR KR1020167033466A patent/KR20170007764A/ko not_active Application Discontinuation

- 2015-07-10 WO PCT/KR2015/007202 patent/WO2016017961A1/ko active Application Filing

Also Published As

| Publication number | Publication date |

|---|---|

| WO2016017961A1 (ko) | 2016-02-04 |

| US20170142499A1 (en) | 2017-05-18 |

| US10368144B2 (en) | 2019-07-30 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR101978222B1 (ko) | 방송 신호 송수신 방법 및 장치 | |

| US11871053B2 (en) | Method and device for transmitting and receiving broadcast signal on basis of color gamut resampling | |

| US11445228B2 (en) | Apparatus for transmitting broadcast signal, apparatus for receiving broadcast signal, method for transmitting broadcast signal and method for receiving broadcast signal | |

| US10291874B2 (en) | Method for generating control information based on characteristic data included in metadata | |

| JP6558599B2 (ja) | 再生装置、再生方法、及び、コンピュータプログラム | |

| US10136181B2 (en) | Playback method and playback device | |

| US10368144B2 (en) | Method and device for transmitting and receiving broadcast signal | |

| US10595099B2 (en) | Method and device for transmitting and receiving broadcast signal for broadcast service on basis of XML subtitle | |

| US9788020B2 (en) | File generation apparatus, file generating method, file reproduction apparatus, and file reproducing method | |

| US10582269B2 (en) | Method and device for transmitting and receiving broadcast signal | |

| US20150208024A1 (en) | Data generation apparatus, data generating method, data reproduction apparatus, and data reproducing method | |

| JP2016082498A (ja) | デジタル放送受信装置及び方法、並びにプログラム及び記録媒体 | |

| KR20160037903A (ko) | 디지털 방송 시스템에서 광역 밝기 표현을 위한 초고화질 방송 신호 송수신 방법 및 장치 | |

| JP2016537847A (ja) | Hevcベースのip放送サービスの提供のための放送信号送受信方法及び装置 | |

| US20210195254A1 (en) | Device for transmitting broadcast signal, device for receiving broadcast signal, method for transmitting broadcast signal, and method for receiving broadcast signal | |

| JP6643669B2 (ja) | 表示装置および表示方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination | ||

| E902 | Notification of reason for refusal | ||

| E601 | Decision to refuse application |