KR20140004022A - 비디오 시퀀스의 이미지들을 재구성하기 위한 방법, 및 비디오 시퀀스의 이미지들을 재구성하기 위한 장치 - Google Patents

비디오 시퀀스의 이미지들을 재구성하기 위한 방법, 및 비디오 시퀀스의 이미지들을 재구성하기 위한 장치 Download PDFInfo

- Publication number

- KR20140004022A KR20140004022A KR1020130075852A KR20130075852A KR20140004022A KR 20140004022 A KR20140004022 A KR 20140004022A KR 1020130075852 A KR1020130075852 A KR 1020130075852A KR 20130075852 A KR20130075852 A KR 20130075852A KR 20140004022 A KR20140004022 A KR 20140004022A

- Authority

- KR

- South Korea

- Prior art keywords

- bounding box

- video sequence

- determined

- sub

- parameters

- Prior art date

Links

- 238000000034 method Methods 0.000 title claims abstract description 37

- 230000002123 temporal effect Effects 0.000 claims description 23

- 238000001514 detection method Methods 0.000 claims description 6

- 238000010191 image analysis Methods 0.000 claims description 4

- 238000003672 processing method Methods 0.000 claims 3

- 238000009499 grossing Methods 0.000 claims 2

- 230000000007 visual effect Effects 0.000 abstract description 2

- 238000004364 calculation method Methods 0.000 description 6

- 238000010586 diagram Methods 0.000 description 5

- 230000006978 adaptation Effects 0.000 description 2

- 230000007613 environmental effect Effects 0.000 description 2

- 239000000284 extract Substances 0.000 description 2

- 230000000670 limiting effect Effects 0.000 description 2

- 238000007781 pre-processing Methods 0.000 description 2

- 208000019901 Anxiety disease Diseases 0.000 description 1

- 102100037812 Medium-wave-sensitive opsin 1 Human genes 0.000 description 1

- 230000036506 anxiety Effects 0.000 description 1

- 230000000295 complement effect Effects 0.000 description 1

- 230000001419 dependent effect Effects 0.000 description 1

- 230000000694 effects Effects 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 230000000750 progressive effect Effects 0.000 description 1

- 230000003068 static effect Effects 0.000 description 1

- 201000009032 substance abuse Diseases 0.000 description 1

- 238000006467 substitution reaction Methods 0.000 description 1

Images

Classifications

-

- G06T3/04—

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T1/00—General purpose image data processing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/14—Picture signal circuitry for video frequency region

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Compression Or Coding Systems Of Tv Signals (AREA)

- Image Processing (AREA)

- Television Signal Processing For Recording (AREA)

Abstract

재구성 애플리케이션(reframing application)은 그의 콘텐츠에 근거하여 비디오 소스의 하위-부분(sub-part)을 크롭한다. 재구성 애플리케이션은 현저한 맵(saliency map)을 생성하는 시주의 모델(visual attention model), 및 현저한 맵에 근거하여 크로핑 윈도우(cropping window)를 추정하는 전용 재구성 알고리즘을 수반한다. 그로핑 후에, 각 비디오 이미지의 단지 재구성된 부분만 계속 보인다. 비디오 시퀀스의 이미지들을 처리하기 위한 방법은, 비디오 시퀀스의 매개 변수들, 비디오 시퀀스의 이전에 디코드된 서브시퀀스의 매개 변수들 및 사용자 설정들을 결정하는 단계(21), 결정된 매개 변수들에 따라 크롭될 부분을 결정하는 단계(22), 및 재구성 단계에서 표시를 위해 결정된 부분을 크롭하는 단계(23)를 포함한다. 본 발명의 장점은, 비디오의 콘텐츠에 근거하여, 재구성 매개 변수들을 자동으로 튜닝하기 위한 선진의 자동적인 솔루션이 제공된다는 것이다.

Description

본 발명은 비디오 시퀀스의 이미지들을 처리하기 위한, 특히, 비디오 시퀀스의 이미지들을 재구성하기 위한 방법 및 장치에 관한 것이다.

예컨대, EP 1 956 550 A로부터 알려진, 재구성 애플리케이션(reframing application)은 처음에는 그의 콘텐츠에 근거하여 비디오 소스의 하위-부분(sub-part)을 크롭(crop)하도록 설계된다. 크로핑(cropping) 후에, 단지 각 비디오 이미지의 재구성된 부분만 계속 보인다. 재구성 애플리케이션은 시주의 모델(visual attention model)과 전용 재구성 알고리즘(dedicated reframing algorithm)을 수반한다. 시주의 모델은 현저한 맵(saliency map)을 생성하고, 재구성 알고리즘은 그 현저한 맵에 근거하여 크로핑 윈도우(cropping window)를 추정한다. 이러한 크로핑 윈도우는, 비디오 콘텐츠에 따라, 위치와 크기의 측면에서 가변적이다. 재구성 알고리즘은 인코딩 또는 디코딩 프로세스와 상호 보완적이다. 유스 케이스(use case)에 따라, 재구성 애플리케이션이 다르게 사용될 수 있다. 예를 들어, 재구성 애플리케이션은 모바일 비디오 인코딩 이전에 전처리(pre-processing)로서 사용될 수 있다. 또 다른 예에서, 재구성 애플리케이션은 비디오 디코딩 직후에 수행된다.

문제는, 비디오의 콘텐츠에 근거하여, 재구성 매개 변수들(reframing parameters)을 자동으로 튜닝하기 위해 사용가능한 진보적이거나 자동적인 솔루션이 현재 존재하지 않는다는 것이다.

본 발명은, 비디오 소스 데이터를 디코드할 때 사용가능한 정보를 활용하여, 재구성 애플리케이션의 설정들(settings)이나 입력 매개 변수들(input parameters)을 자동으로 튜닝하는 것을 가능하게 한다. 디코드된 비디오 시퀀스에 대한 설정들 또는 입력 매개 변수들을 자동으로 튜닝하기 위한 개시된 솔루션은 이전에 디코드된 시퀀스의 속성들을 활용한다.

본 발명에 따르면, 비디오 시퀀스의 이미지들을 처리하기 위한 방법은, 비디오 시퀀스의 매개 변수들과 비디오 시퀀스의 이전에 디코드된 GOP(Group Of Pictures)의 매개 변수들을 결정하는 단계와 사용자 설정들을 결정하는 단계, 결정된 매개 변수들에 따라 크롭될 부분을 결정하는 단계, 및 표시를 위해 결정된 부분을 크롭하는 단계를 포함한다.

GOP 크기, 시간적 서브샘플링 팩터(temporal subsampling factor), 최소 및 최대 줌 팩터(minimum and a maximum zoom factor) 또는 경계 상자 속도(bounding box velocity)와 같은, 비디오 시퀀스의 다양한 매개 변수가 결정되어 활용될 수 있다. 매개 변수들은, 예컨대, 하나의 실시예에서, 별도로 또는 조합되어 활용될 수 있는데, 결정되고 활용된 매개 변수들은 (위에서 언급한 매개 변수들로부터) 단지 경계 상자 속도만 포함한다.

하나의 실시예에서, 결정되고 활용된 파라미터들은 최소 및 최대 줌 팩터를 포함한다.

하나의 실시예에서, 결정되고 활용된 매개 변수들은 GOP 크기, 시간적 서브샘플링 팩터, 최소 및 최대 줌 팩터, 및 경계 상자 속도를 포함한다.

본 발명의 하나의 실시예에서, 비디오 시퀀스의 이미지들을 처리하기 위한 방법은,

이전 이미지에서, 재구성된 윈도우에 포함하기 위한, 이전 이미지의 가장 현저한 부분(salient portion)인 화소들의 하위-영역(sub-area) 또는 하위-집합(sub-set)을 결정하는 단계,

화소들의 상기 하위-영역 또는 하위-집합 주위에 제1 경계 상자를 결정하는 단계,

현재 이미지에서, 재구성된 윈도우에 포함하기 위한, 현재 이미지의 가장 현저한 부분인 화소들의 하위-영역 또는 하위-집합, 및 상기 영역 주위에 제2 경계 상자를 결정하는 단계,

연속 이미지들(successive images) 사이에서 경계 상자를 이동하기 위한 최대 경계 상자 속도를 결정하는 단계,

제1 및 제2 경계 상자와 경계 상자의 결정된 최대 속도로부터 새로운 경계 상자를 결정하는 단계, 및

결정된 새로운 경계 상자에 따라, 현재 이미지에서, 표시를 위한 하위-영역을 크롭하는 단계를 포함한다.

최대 경계 상자 속도는 비디오 시퀀스의 이전에 디코드된 GOP의 매개 변수들로부터 결정될 수 있다. 최대 경계 상자 속도는 또한 레지스터나 스토리지로부터 검색가능한 미리 정의된 값일 수 있고, 이는 또한 비디오 시퀀스의 이전에 디코드된 GOP에 대해 유효하다.

본 방법을 활용하는 장치는, 비디오 시퀀스의 매개 변수들을 결정하고, 비디오 시퀀스의 이전에 디코드된 GOP(Group Of Pictures)의 매개 변수들을 결정하고, 사용자 설정들(예컨대, 사용자 인터페이스 수단)을 결정하기 위한 이미지 분석 수단, 및 결정된 매개 변수들에 따라 크롭될 부분을 결정하고, 표시를 위해 결정된 부분을 크롭하기 위한 이미지 처리 수단을 포함한다. 위에서 설명한 바와 같이, 비디오 시퀀스의 다양한 매개 변수가 결정되어 별도로 또는 조합하여 활용될 수 있다.

본 발명의 하나의 실시예에서, 비디오 시퀀스의 이미지들을 처리하기 위한 장치는,

이전 이미지에서, 재구성된 윈도우에 포함하기 위한, 이전 이미지의 가장 현저한 부분인 화소의 하위-영역 또는 하위-집합을 결정하기 위한 수단, 화소들의 상기 하위-영역 또는 하위-집합 주위에 제1 경계 상자를 결정하기 위한 수단, 현재 이미지에서, 재구성된 윈도우에 포함하기 위한, 현재 이미지의 가장 현저한 부분인 화소의 하위-영역 또는 하위-집합, 및 상기 영역 주위에 제2 경계 상자를 결정하기 위한 수단,

비디오 시퀀스의 이전에 디코드된 GOP의 매개 변수들로부터, 연속 이미지 사이의 경계 상자를 이동하기 위한 최대 경계 상자 속도를 결정하기 위한 수단,

제1 및 제2 경계 상자와 경계 상자의 결정된 최대 속도로부터 새로운 경계 상자를 결정하기 위한 수단, 및

결정된 새로운 경계 상자에 따라, 현재 이미지에서, 표시를 위한 하위-영역을 크롭하기 위한 수단을 포함한다.

하나의 측면에서, 본 발명은 컴퓨터로 하여금 위에 개시된 바와 같은 방법을 수행하도록 하기 위해, 실행가능한 명령어들이 저장되어 있는 컴퓨터 판독가능한 매체에 관한 것이다. 하나의 실시예에서, 컴퓨터는 비디오 시퀀스의 이미지들을 처리하기 위한 방법을 수행하게 되고, 방법은, 비디오 시퀀스의 매개 변수들을 결정하는 단계, 비디오 시퀀스의 이전에 디코드된 GOP의 매개 변수들을 결정하고 사용자 설정들을 결정하는 단계, 결정된 매개 변수에 따라 크롭될 부분을 결정하는 단계, 및 표시를 위해 결정된 부분을 크롭하는 단계를 포함한다.

본 발명의 유익한 실시예들이 종속 청구항들, 다음 설명 및 도면들에 개시된다.

본 발명의 바람직한 실시예들이 첨부 도면을 참조하여 설명된다.

도 1은 재구성 애플리케이션을 갖는 비디오 디코더의 구조이고,

도 2는 비디오 시퀀스의 이미지들을 처리하기 위한 방법의 흐름도이고,

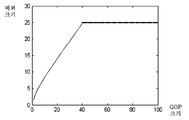

도 3은 GOP 크기의 함수로서 버퍼 크기의 진화(evolution)의 다이어그램이고,

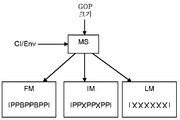

도 4는 계산 컨텍스트(computational context)와 실-시간 요구 사항(real-time requirements)에 관한 최적의 시간적 서브샘플링 모드/팩터의 선택이고,

도 5는 GOP 배치, 크기 및 환경 제약에 관한 모드 선택의 흐름도이고,

도 6은 상이한 비트 레이트에서 I-프레임들에 대한 예시적인 MB 비용 맵(cost maps)이고,

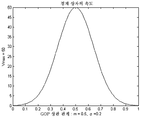

도 7은 완전한 GOP에 대한 프레임들 사이의 IntraMap 상관 관계의 함수로서 경계 상자 속도의 진화의 다이어그램이고,

도 8은 제한된 경계 상자 속도를 설명하는 다이어그램이고,

도 9는 제한된 경계 상자 줌 팩터를 설명하는 다이어그램이고,

도 10은 비디오 시퀀스의 이미지들을 처리하기 위한 장치의 구조이다.

도 1은 재구성 애플리케이션을 갖는 비디오 디코더의 구조이고,

도 2는 비디오 시퀀스의 이미지들을 처리하기 위한 방법의 흐름도이고,

도 3은 GOP 크기의 함수로서 버퍼 크기의 진화(evolution)의 다이어그램이고,

도 4는 계산 컨텍스트(computational context)와 실-시간 요구 사항(real-time requirements)에 관한 최적의 시간적 서브샘플링 모드/팩터의 선택이고,

도 5는 GOP 배치, 크기 및 환경 제약에 관한 모드 선택의 흐름도이고,

도 6은 상이한 비트 레이트에서 I-프레임들에 대한 예시적인 MB 비용 맵(cost maps)이고,

도 7은 완전한 GOP에 대한 프레임들 사이의 IntraMap 상관 관계의 함수로서 경계 상자 속도의 진화의 다이어그램이고,

도 8은 제한된 경계 상자 속도를 설명하는 다이어그램이고,

도 9는 제한된 경계 상자 줌 팩터를 설명하는 다이어그램이고,

도 10은 비디오 시퀀스의 이미지들을 처리하기 위한 장치의 구조이다.

도 1은 자동 재구성 유닛(AR)을 갖는 비디오 디코더(DEC)의 구조를 보여준다. 디코더(DEC)는 인코드된 입력 비디오 시퀀스(11)를 수신하고, 그것을 디코드하여 디코드된 비디오 시퀀스(12)를 얻는다. 매개 변수 추출기(PE)는 디코드된 비디오 시퀀스 및/또는 디코더 설정들(13)로부터 매개 변수들 및/또는 재구성 설정들(14)을 추출한다. 자동 재구성 유닛(AR)은, 디코드된 비디오(12)와 추출된 매개 변수들 및/또는 재구성 설정들(14)로부터, 재구성된(즉, 크롭된) 비디오 시퀀스(16)를 생성한다.

재구성 애플리케이션은, 본 발명에 따라, 디코드된 스트림 또는 디코딩 프로세스로부터 자동으로 튜닝되는 특정 수의 설정들(S)을 갖는다. 하나의 실시예에서, 설정들은 버퍼 크기, 시간적 서브샘플링 팩터, 2개의 줌 팩터(zmin 및 zmax), 및 경계 상자 속도를 포함한다. 설정들(s1, s2, s3, s4)은 아래에 설명되어 있다.

버퍼 크기(Buffer size)(s1)는 시간이 지남에 따라 크로핑 윈도우 매개 변수를 스무드하게 하기 위해 재구성 프로세스에서 사용되는 버퍼의 크기이다. 하나의 실시예에서, 버퍼 크기는 GOP의 크기에 따라 조정된다.

시간적 서브샘플링 팩터(Temporal subsampling factor)(s2)는, 재구성 프로세스가 적용되는 프레임의 수를 제한하여, 애플리케이션의 계산적 복잡도를 감소시키고 제어하는데 사용되는데; 예컨대, 단지 s2 위의 하나의 프레임 또는 s2 프레임들 밖의 하나의 프레임에만 재구성 프로세스를 적용한다. 하나의 실시예에서, 가능한 시간적 서브샘플링 팩터들/모드들은, GOP 길이 및 s2에 따라, "풀 모드(full mode)"(모든 프레임들), "중간 모드(intermediary mode)"(단지 I- 및 P-프레임들만), 및 "라이트 모드(light mode)"(단지 I-프레임만)이다.

줌 팩터(Zoom factors)(s3 = (zmin, zmax))는 크로핑 윈도우가 시간이 지남에 따라 달라질 수 있는 그들 사이의 경계를 정의한다. 이는 크로핑 윈도우의 크기에 있어서의 변경을 제한한다. 사용자가 너무 크거나 너무 작은 줌 효과를 피하기 위해 이러한 특징을 설정할 수 있다. 하나의 실시예에서, 장면 컷(scene cut) 이후의 첫 번째 픽처에서, MB 비용 맵은 가장 중요한 블록들을 찾기 위해 만들어진다. 그 다음, MB 비용 맵은 줌 팩터를 결정하는데 사용된다.

경계 상자 속도(Bounding box velocity)(s4)는 크로핑 윈도우가 픽처 내에서 이동할 수 있는 속도이다. 경계 상자는, 하나의 실시예에서, 재구성 윈도우에 포함하기 위한, 가장 현저한 것으로 선택된 화소의 하위-영역 또는 하위-집합을 지칭한다. 허용가능한 속도는 이미지 콘텐츠에 따라 다르고: 후속 이미지들의 내부-예측 MB들 사이의 상관 관계가 매우 낮거나 매우 높을 때 낮은 값으로 제한되고; 높은 상관 관계는 정적 이미지 또는 로우 모션(low motion)을 의미하여, 안정된 경계 상자 위치가 선호되고; 낮은 상관 관계는 장면 전환(scene change)(즉, 새로운 "샷(shot)")을 의미하는데, 이는 경계 상자 시프트에 의해 보상될 수 없으므로 알고리즘을 혹사시킨다. 따라서, 경계 상자 속도(s4)는, 콘텐츠에 따라, 카메라의 자연스러운 카메라 모션에 더 잘 맞도록 시퀀스에 적응될 수 있다. 하나의 실시예에서, 칼만 필터는 그들을 필터링하기 위해 경계 상자 좌표에 적용되고, 경계 상자 속도는 칼만 필터에 주입되는 노이즈 팩터이다.

도 2는 비디오 시퀀스의 이미지들을 처리하기 위한 방법의 흐름도를 보여준다. 본 방법은 비디오 시퀀스의 매개 변수들, 비디오 시퀀스의 이전에 디코드된 GOP(Group Of Pictures)의 매개 변수들, 및 사용자 설정들을 결정하는 단계(21), 결정된 매개 변수들에 따라 크롭될 부분을 결정하는 단계(22), 및 표시를 위해 결정된 부분을 크롭하는 단계(23)를 포함한다.

하나의 실시예에서, 디코딩 매개 변수들은 다음과 같이 결정된다.

버퍼 크기(Buffer size)(s1)는 GOP 크기(Gsize)에 따라 조정된다. 원칙적으로, 버퍼 크기는 작은 GOP들을 위해 감소되는 한편, 풀 버퍼(Sizemax)는 특정 한도 위의 GOP 크기를 위해 사용된다. GOP 크기는 디코더(DEC)가 스토리지로부터 검색하거나 인코드된 비트스트림으로부터 추출할 수 있는 미리 정의된 매개 변수이다. 다음 규칙이 적용될 수 있다:

예시적인 구체적 애플리케이션의 경우, Gsizemax는 40으로 설정되고, Sizemax는 25로 설정된다. 즉, GOP 사이즈가 40 이상인 경우에, Sizemax 이전 프레임들의 크로핑 윈도우 매개 변수들이 버퍼링되어 현재 프레임의 크로핑 윈도우 매개 변수들을 얻는데 고려된다. 이러한 방식으로, 크로핑 윈도우 매개 변수들에서 갑작스러운 변화는 피해지므로, 크로핑 윈도우 매개 변수들은 시간이 지남에 따라 스무드하게 된다. 그 다음, 도 3에 묘사된 바와 같은 버퍼 크기에 대한 곡선이 생긴다.

시간적 서브샘플링 팩터(Temporal subsampling factor)(s2)는 GOP 크기 및 스킴에 따라 설정될 수 있다. 철학은, I-프레임들이 최고의 품질을 갖고, 장면의 시작 부분(즉, 장면 컷의 직후)에 있을 가능성이 있기 때문에, 적어도 그들에서 재구성 프로세스의 (및 현저한 맵의) 계산을 유지하는 것이다. 그 다음, P-프레임들이 처리되는 것에는 관심이 덜할 것이다. 마지막으로, B-프레임들은 시간적 서브샘플링에 의해 프레임들을 제거할 필요가 있는 경우에, 생략될 첫 번째 프레임들이 될 것이다.

GOP 스킴을 사용하는 것에 의해, 이제, 어떤 프레임 유형과 어떤 프레임들이 영향을 받을 것인지를 선택할 수 있기 때문에, EP 1 956 550 A의 알려진 솔루션에 비해 훨씬 개선될 수 있다.

그 다음, 팩터를 정의하는 대신, 도 4에 묘사된 바와 같은, 3가지 모드 또는 유스 케이스들을 정의할 수 있다. 풀 모드(FM)에서, 시간적 서브샘플링이 존재하지 않으므로, 재구성 처리는 모든 프레임에서 수행된다. 중간 모드(IM)에서, 시퀀스의 B-프레임들의 일부 또는 전부는 계산에서 제외된다. 라이트 모드(LM)에서, 시퀀스의 B-프레임들 모두뿐만 아니라 P-프레임들의 일부 또는 모두가 계산에서 제외된다. 모드 선택은 컴퓨팅 이슈들, 또는 사용가능한 컴퓨팅 환경(CI/Env)에 의해 각각 제어된다. 이는, 컨텍스트(고/저 비트 레이트 또는 고/저 품질) 요구 사항에 따라, 3가지 모드 중 하나가 선택되었음을 의미한다: 고품질은 풀 모드(full mode)를 의미하고, 중간 품질은 중간 모드(intermediary mode)를 의미하며 저품질은 라이트 모드(light mode)를 의미한다.

도 5는 모드의 선택을 설명하는 상세한 흐름도를 보여준다. 기본적으로, B-프레임의 존재가 확인되고, 그 다음, 그들의 계산은 중간 모드(IM) 및 라이트 모드(LM)에서 스킵된다. 그 다음, 환경 제약에 따라, P-프레임들(또는 하위집합) 역시 폐기될 것이다. 도 5에 도시된 바와 같이, 모드 선택(MS)에서, 위에서 설명한 3가지 가능한 모드 중 하나가 선택될 수 있다.

풀 모드(FM)에서, 모든 프레임이 유지되고, 단계 50에서, 시간적 서브샘플링 팩터 매개 변수(s2)는, 그에 따라, 예컨대, 1로 설정된다. 즉, 모든 프레임들이 처리된다(59).

중간 모드(IM)에서, 임의의 B-프레임들이 있는지가 체크된다(51). 그렇지 않은 경우, 모든 프레임이 처리된다(59). 적어도 하나의 B-프레임이 있는 경우에, 다음 단계(52)는 NbB B-프레임들을 제거하고 s2=Gsize - NbB(GOP 크기인 Gsize로)에 따라 시간적 서브샘플링 팩터 매개 변수(s2)를 계산한다. 계산된 시간적 서브샘플링 팩터 매개 변수(s2)는, 예컨대, "s2 > Gsize/2 인가?"에 따라 소정의 임계값과 비교된다(53). 시간적 서브샘플링 팩터가 임계값 아래가 아닌 경우, 제거될 B-프레임의 수는 증가하고 계산이 반복된다. NbB는 1로 초기화되고 루프의 모든 실행마다 증가되는 변수이다. nbiter은 루프의 실행을 카운트하는 카운트 변수이고, 따라서 (중간 모드에서) 또한 스킵될 B-프레임의 수이다. 대안적으로, 결과로 얻은 s2가 임계값 아래인 한, s2,min = Gsize - NbBmax(GOP에서 B-프레임의 총 수인 NbBmax으로)를 계산하고 다시 단일 B-프레임들을 추가하여, 즉 NbBmax를 감소시키는 것이 가능하다. 임계화 단계(thresholding step; 53)에서, s2 > thrtSubs 인가?"에 따라, 시간적 서브샘플링 팩터 매개 변수와의 비교를 위해 다른 임계값(thrtSubs)이 사용될 수 있다. 바람직하게는, 임계값은 실질적으로 Gsize/2 근처이다.

라이트 모드(LM)에서, 임의의 B-프레임들이 있는지가 먼저 체크된다(54). 그렇다면, 모든 B-프레임은 다음 단계(55)에서 제거된다. 그 다음, s2=Gsize - NbB에 따라 얻은 시간적 서브샘플링 팩터 매개 변수(s2)가 계산되고(56), 예컨대, "s2 < Gsize/2 인가?"(또는 유사하게, 중간 모드에서와 같이)에 따라 소정의 임계값과 비교된다(57). 시간적 서브샘플링 팩터 매개 변수(s2)가 임계값 아래인 경우에, 나머지 모든 프레임이 처리된다(59). 그렇지 않으면, 다음 단계(58)는 NbP P-프레임들을 제거한다. 결과로 얻은 시간적 서브샘플링 팩터(s2)가 s2 = Gsize - NbP - NbB에 따라 다시 계산되고(56), 소정의 임계값과 다시 비교된다(57). 시간적 서브샘플링 팩터가 임계값보다 아직 아래이지 않은 경우에, 제거할 P-프레임의 수는 더 증가하고 계산이 반복된다. NbP는 1로 초기화되고 루프의 모든 실행마다 증가되는 변수이다. nbiter는 루프의 실행을 카운트하는 카운트 변수이고, 따라서 (라이트 모드에서) 또한 스킵될 P-프레임의 수이다. 대안적으로, 결과로 얻은 s2이 임계값 아래인 한, s2 , min = Gsize - NbPmax - NbB(GOP에서 P-프레임의 총 수인 NbPmax으로)를 계산하고 다시 단일 P-프레임을 추가하여, 즉 NbPmax를 감소시킬 수 있다.

마지막으로, 나머지 모든 프레임들에 대해, 크로핑 등을 포함하는, 처리가 행해진다(59).

또 다른 매개 변수는 최대 허용 줌 팩터(s3), 또는 줌 팩터 쌍(pair of Zoom factors)(s3 = (zmin, zmax))이다. 줌 팩터(s3)를 결정하기 위해, 하나의 실시예에서, 보통 I-프레임인, GOP 또는 장면의 첫 번째 프레임에 대응하는 매크로블록(MB) 비용 맵이 사용된다. MB 비용 맵은 각 MB의 코딩 비용을 나타낸다. 도 6은 상이한 비트 레이트와 상이한 장면에 대한 예시적인 4개의 상이한 MB 비용 맵을 보여준다. 각 MB 비용 맵은 오리지널 픽처의 오른쪽에 묘사된다. 가장 중요한 블록들이 분명히 식별될 수 있고(가장 높은 코딩 비용을 갖는 라이트 블록(light blocks)), 그 다음, 재구성 프로세스에서 사용될 최소 및 최대 줌 경계가 그로부터 도출될 수 있다. 본 발명의 하나의 실시예에서, 줌 팩터는 모든 장면 컷에서 재조정된다. 이 경우에, 장면 컷 검출은 처리 이전에 수행된다.

크로핑 윈도우의 줌 팩터(z)는 zmin ≤ z ≤ zmax에 따라 정의된 줌 팩터들 사이에서 시간이 지남에 따라 달라질 수 있다. 그러나, zmin, zmax 중 하나는 암시적으로 또는 명시적으로 주어질 수 있다.

하나의 실시예에서, s3 = (zmin, zmax)은 다음에 따라 정의될 수 있다.

nbMB는 픽처 내에서 MB의 총 수이고, nbMBcost0는 0과 동일한 비용을 갖는 MB의 수(도 6에서, 예컨대, 상단 및 하단 가장자리에서 어두운 MB들)로서, 반드시 서로 인접할 필요는 없고, nbMBadj는 높은 비용(> 최대 비용/2)을 갖는 MB의 수로서, 공간적으로 서로 인접한다. 하나의 실시예에서, 그것은 픽처에서 가장 높은 비용(> 최대 비용/2)을 갖는 인접하는 MB들의 큰 그룹이다.

또 다른 매개 변수는 경계 상자 속도(Bounding box velocity)(s4)이다. 줌 팩터와 동일한 방식으로, 경계 상자 속도는, 특히, 그것이 장면별로(per-scene basis) 튜닝되는 경우에, 스마트하게 튜닝될 수 있다. 하나의 실시예에서, 경계 상자 속도는, 현재 IntraMap과 인접한 픽처들의 IntraMap 사이의 상관 계수로 표현될 수 있는 인접한 픽처와의 유사성에 따라 설정되는데, 여기서, IntraMap은 P- 또는 B-픽처들에서 인트라-코딩된 MB들의 맵이다. 인접하는 픽처에서 인트라-코딩된 MB들의 평균 상관 계수가 그의 평균에서 더 많이 벗어날수록, 허용 경계 상자 속도는 낮아진다. 인코딩되기에 어려운 MB는 보통 인트라-코딩(intra-coded)되기 때문에, IntraMaps은 장면의 복잡도에 관한 정보를 제공한다. 이 정보로부터, 연이은 IntraMaps 사이의 상관 관계를 설명하는 값이 도출된다. 상관 관계가 높은 경우(즉, 글로벌 모션이 거의 없거나 없고, 로컬 모션이 거의 없거나 없는), 경계 상자 속도는 윈도우를 고정하기 위해 낮다는 것이 발견되었다. 반면에, 상관 관계가 매우 낮은 경우에, 이는 아마 강력한 카메라 모션이나 콘텐츠의 강력한 변화의 결과이다(예컨대, 누군가가 카메라 앞에서 이동). 이 경우에, 경계 상자 위치의 강력한 적응보다 더 바람직한 적응은 없는데, 이는 콘텐츠의 측면에서 알 수 없을 수 있고, 불안감을 줄 수 있다. 따라서, 또한, 낮은 상관 관계에 대해, 경계 상자 속도는 낮아야 한다. 매체 상관 관계에 대해, 콘텐츠에 있어서의 변화는 쉽게 처리될 수 있고, 더 높은 속도는 경계 상자의 빠른 리-포지셔닝을 허용하는데 사용될 수 있다.

하나의 실시예에서, 경계 상자 속도는 다음에 따라 계산될 수 있다.

예를 들면

여기서,

IntraMap은 P- 또는 B-픽처에서 인트라-코딩된 MB의 맵이고, CC는 현재 IntraMap과 인접한 것(즉, 다음 것이나 이전 것) 사이의 상관 계수이며, Vmax는 경계 상자의 최대 허용 속도이다. 수학식 6에서 x는 현재 및 이전 GOP를 지칭한다. 그 다음, 도 7에 묘사된 바와 같이, 경계 상자는 가우스 함수로서 시간이 지남에 따라 달라지고 있다. m와 σ는 각각 속도의 분포의 평균 및 표준 편차이다. 그들은 예컨대, m = 0.5 및 σ= 0.2로 튜닝될 수 있다. m, σ 및 Vmax는 시스템에서 최대 값으로 정의된 고정된 매개 변수들임에 주목한다. 위에서 설명한 바와 같이, 상관 관계가 중간 값을 가질 때 최대 경계 상자 속도가 허용된다.

도 8은, 예시적이고 간략화된 방식으로, 경계 상자 속도의 제한을 보여준다. 묘사된 스케일은 비현실적일 수 있고, 단지 명확하게 하기 위해 사용된다는 것에 주목한다. 위에서 설명한 바와 같이, 이전 이미지(imn -1)에서, 가장 현저한 영역(sa1) 주위에 제1 경계 상자(bb1)가 결정되고, 현재 이미지(imn)에서, 가장 현저한 영역(sa2) 주위에 제2 경계 상자(bb2)가 결정된다. 그 다음, 제1 및 제2 경계 상자 사이에 시프트 벡터 또는 시프트 거리(ddet)가 결정되고, 최대 허용 시프트 벡터 또는 시프트 거리(dmax)와 비교된다.

대안적으로, 이미지들(imn -1, imn) 사이의 시간적 거리(프레임 레이트(f)를 사용하여)를 고려할 때, 결정된 실제의 경계 상자 속도는 vdet = ddet*f에 따라 계산될 수 있다. 결정된 실제의 경계 상자 속도는 최대 허용 경계 상자 속도(vmax)와 비교된다.

결정된 경계 상자 시프트 벡터(ddet)가 최대 허용 경계 상자 시프트 벡터(dmax) 위(즉, 더 긴(longer than))인 경우에, 또는 결정된 경계 상자 속도(vdet)가 최대 허용 경계 상자 속도(vmax) 위인 경우에, 새로운 경계 상자의 위치 및/또는 크기가 결정되고, 결정된 새로운 경계 상자 위치에 따른 하위-영역이 표시를 위해 현재 이미지에서 크롭된다(즉, 단지 경계 상자에 의해 식별되는 이미지의 부분만 표시됨). 그렇지 않으면, 결정된 경계 상자 시프트 벡터(ddet)는 최대 허용 경계 상자 시프트 벡터(dmax) 위가 아닌 경우에, 또는 결정된 경계 상자 속도(vdet)가 최대 허용 경계 상자 속도(vmax) 위가 아닌 경우에, 제2 경계 상자가 그대로 사용될 수 있다. 마찬가지로, 줌 팩터가 설명될 수 있다. 도 9는, 예시적이고 간략화된 방식으로, 경계 상자 줌 팩터의 제한을 보여준다. 묘사된 스케일이 비현실적일 수도 있다는 것에 주목한다. 위에서 설명한 바와 같이, 이전 이미지(imn -1)에서, 가장 현저한 영역 주위에 제1 경계 상자(bb1)가 결정되고, 현재 이미지(imn)에서, 가장 현저한 영역 주위에 제2 경계 상자(bb2)가 결정된다. 이 예에서, 제2 경계 상자(bb2)는 제1 경계 상자(bb1)보다 상당히 더 작다. 그 다음, 줌 팩터가 계산된다. 원칙적으로, 줌 팩터는, 예컨대, z = nbb2/nbb1에 따라, 경계 상자들을 갖는 화소의 수로부터 계산될 수 있다. 계산된 줌 팩터가 최대 허용 줌 팩터(zmax)와 비교된다.

결정된 줌 팩터(zdet)가 최대 허용 줌 팩터(zmax) 위가 아닌 경우에, 제2 경계 상자는 그대로 사용될 수 있다. 그렇지 않으면, 결정된 줌 팩터(zdet)가 최대 허용 줌 팩터(zmax) 위인 경우에, 최대 허용 줌 팩터(zmax)가 충족되도록 새로운 경계 상자(bbdet)의 크기가 결정된다. 새로운 경계 상자(bbdet)는 제2 경계 상자(bb2)와 중심이 같다. 결정된 새로운 경계 상자(bbdet) 위치에 따른 하위-영역은 표시를 위해 현재 이미지에서 크롭된다.

도 8 및 도 9에 대하여 상기는 경계 상자 개념의 원칙에 대한 설명이라는 것에 주목해야 한다. 실제 구현에서, 예컨대, 경계 상자 속도에 대해, 필터(예컨대, 칼만 필터)는 경계 상자 좌표에 적용되고, 경계 상자 속도는 경계 상자 좌표와 경계 상자 크기의 궤적을 스무드하게 하기 위해 필터에 주입되는 노이즈 팩터이다.

경계 상자(또는 크로핑 윈도우)는, 윈도우에 포함될 가장 현저한 것으로서, 하나의 실시예에서, 선택되는 하위-영역 또는 하위-집합을 지칭한다. 하나의 실시예에서, 이러한 윈도우는 타겟이 된 미리 정의된 종횡비(예컨대, 사용자에 의해 정의된)로 설정된다. 그 다음, 하나의 실시예에서, 재구성 애플리케이션에서, 윈도우는 위치(x와 y 축) 및/또는 크기에 있어서 달라진다. 속도는 단지 박스의 위치, 즉, 경계 상자가 시간이 지남에 따라 그의 위치를 바꾸는 방식을 지칭한다. 따라서, 그것은, 예컨대, 카메라 모션에 의해 영향을 받는다. 실제로, 경계 상자 속도는, 프레임의 보이는 부분이 이동할 때 속도로 간주될 수 있다.

도 10은 본 발명에 따른 입력 비디오 시퀀스(seqin)의 이미지를 처리하기 위한 장치(100)의 원리 블록 다이어그램을 보여준다. 장치는 이미지 분석 모듈(102) 및 이미지 처리 모듈(110)을 포함한다. 이미지 분석 모듈은 비디오 시퀀스의 매개 변수들을 결정하기 위한 제1 매개 변수 결정 모듈(103), 비디오 시퀀스의 이전에 디코드된 GOP의 매개 변수들을 결정하기 위한 제2 매개 변수 결정 모듈(104), 및 사용자 설정들을 결정하기 위한 사용자 인터페이스 모듈(105)을 포함한다. 또한, 장치는 결정된 매개 변수들에 따라 크롭될 부분을 결정하기 위한 크롭 윈도우 포지셔닝 모듈(106), 및 표시를 위해 결정된 부분을 크롭하기 위한 크로핑 모듈(107)을 포함한다. 크롭된 이미지의 시퀀스(seqcr)는 출력에서 제공된다. 비디오 시퀀스의 다양한 매개 변수가 결정되어, 위에서 설명한 바와 같이, 개별적으로 또는 조합되어 활용될 수 있다. 위에서 언급한 모듈들은 하드웨어 모듈로서, 소프트웨어-지원 하드웨어 모듈로서, 또는 소프트웨어 모듈로서 구현될 수 있다.

하나의 실시예에서, 장치는 장면 전환 검출 모듈을 더 포함한다. 서브시퀀스가 장면(즉, "샷")인 경우에, 장면(또는 오히려: 장면 전환)은 장면 전환 검출 모듈에 의해 검출된다.

하나의 실시예에서, 장치는: 이전 이미지의 가장 현저한 부분인 화소들(sa1)의 하위-영역 또는 하위-집합을 이전 이미지(imn -1)에서 결정하기 위한 수단, 이전 이미지의 화소들의 상기 하위-영역 또는 하위-집합 주위에 제1 경계 상자(bb1)를 결정하기 위한 수단, 현재 이미지의 가장 현저한 부분인 화소들(sa2)의 하위-영역 또는 하위-집합을 현재 이미지(imn)에서 결정하기 위한 수단, 현재 이미지의 상기 영역 주위에 제2 경계 상자(bb2)를 결정하기 위한 수단, 제1 경계 상자(bb1)와 제2 경계 상자(bb2)의 위치들로부터 경계 상자 시프트(ddet)를 계산하거나, 제1 경계 상자(bb1)와 제2 경계 상자(bb2)의 위치들 및 비디오 프레임 레이트로부터 경계 상자 속도를 결정하기 위한 수단, 결정된 경계 상자 시프트(ddet) 또는 경계 상자 속도를 연속 이미지들 사이의 최대 허용 경계 상자 시프트 또는 경계 상자 속도와 비교하기 위한 수단, 및 새로운 경계 상자(bbdet)의 위치 및/또는 크기를 결정하여, 결정된 경계 상자 시프트가 최대 허용 경계 상자 시프트 위인 경우이거나, 결정된 경계 상자 속도가 최대 허용 경계 상자 속도 위인 경우에, 표시를 위해 결정된 새로운 경계 상자에 따라 현재 이미지에서 하위-영역을 크롭하고, 그렇지 않으면, 결정된 경계 상자 시프트(ddet) 또는 경계 상자 속도가 최대 허용 경계 상자 시프트 또는 경계 상자 속도이거나 그 아래인 경우에, 표시를 위해 결정된 제2 경계 상자(bb2)에 따라 현재 이미지에서 하위-영역을 크롭하기 위한 수단 중 적어도 하나를 더 포함한다.

본 발명의 이점은, 콘텐츠의 신뢰할 수 있고 유용한 디코딩 정보에 근거하여, 재구성 매개 변수들의 자동 튜닝을 수행한다는 것이다. 즉, 재구성 매개 변수들은 비디오를 디코딩할 때 사용 가능한 정보(특히, 이전에 디코드된 시퀀스의 속성들)를 사용하여 콘텐츠에 근거하여 자동으로 튜닝된다. 인코딩 동안 추가적인 정보가 삽입될 필요가 없기 때문에, 통상적으로, 인코드된 비디오 시퀀스가 사용될 수 있다. 재구성 애플리케이션의 일부 설정들(S)은 디코딩 프로세스 또는 디코드된 스트림으로부터 자동으로 튜닝될 수 있다. 이러한 매개 변수들은: 위에서 설명한 바와 같이, 버퍼 크기(s1), 시간적 서브샘플링 팩터(s2), 줌 팩터 s3=(zmin, zmax) 및 경계 상자 속도(s4) 중 하나 이상이다.

하나의 실시예에서, 디코드된 비디오 시퀀스에 대한 설정들 또는 입력 매개 변수들은 그의 직전에 디코드된 시퀀스의 속성에 따라 자동으로 튜닝된다.

본 발명의 하나의 실시예에서, 재구성 애플리케이션은 비디오 디코딩 후에 수행된다.

본 발명은 비디오를 표시할 수 있는 디바이스들, 또는 표시를 위한 전처리 비디오용 디바이스들로 구현될 수 있다. 본 발명은 작은 화면 크기를 갖는 비디오 표시 디바이스들에 특히 유용하다.

본 발명은 순수하게 예로서 설명되는 것으로, 본 발명의 범위에서 벗어나지 않고 상세한 수정이 실시될 수 있다는 것이 이해될 것이다. 그의 바람직한 실시예에 적용되는, 본 발명의 기본적인 신규한 특징들이 도시되고, 설명되고, 지적되었지만, 설명된 장치 및 방법에 있어서, 개시된 디바이스의 형태 및 상세에 있어서, 및 그들의 동작에 있어서, 본 발명의 의도에서 벗어나지 않고, 다양한 생략 및 대체 및 변경이 당업자에 의해 실시될 수 있다는 것이 이해될 것이다. 동일한 결과를 달성하기 위해 실질적으로 동일한 방식으로 실질적으로 동일한 기능을 수행하는 요소들의 모든 조합이 본 발명의 범위 내에 있도록 명백히 의도된다. 하나의 설명된 실시예로부터의 요소들을 또 다른 것으로 대체하는 것 또한 충분히 의도되고 고려된다.

설명 및 (적절한 경우에) 청구항들 및 도면들에서 개시된 각 특징은 독립적으로 또는 임의의 적절한 조합으로 제공될 수 있다. 특징들은, 적절한 경우에, 하드웨어, 소프트웨어 또는 두 가지의 조합으로 구현될 수 있다. 청구항들에 나타나는 참조 번호는 단지 예시로서, 청구항의 범위에 있어서 어떠한 제한 효과도 갖지 않는다.

Claims (15)

- 비디오 시퀀스의 이미지들을 처리하기 위한 방법으로서,

상기 비디오 시퀀스의 매개 변수들, 상기 비디오 시퀀스의 이전에 디코드된 서브시퀀스의 매개 변수들 및 사용자 설정들을 결정하는 단계;

결정된 매개 변수들에 따라 크롭될(cropped) 부분을 결정하는 단계 - 상기 크롭될 부분은 가변 위치와 가변 크기 중 적어도 하나를 갖는 경계 상자에 의해 정의되고, 상기 가변 위치는 상기 비디오 시퀀스에서 인접한 프레임들의 인트라-코딩된 매크로블록들 사이의 상관 관계에 의존하고, 상기 상관 관계의 제1 상관 값의 경우, 상기 제1 상관 값보다 더 높거나 더 낮은 상관 값보다 상기 경계 상자 위치가 더 빨리 달라지고, 상기 가변 크기는 현재 GOP 또는 장면의 제1 프레임의 매크로블록 비용 맵의 매개 변수들로부터 계산되는 최대 줌 팩터에 의존하고, 제로와 같은 비용을 갖는 매크로블록들의 퍼센트가 더 낮은 경우에 더 높은 최대 줌 팩터가 허용됨 - ; 및

재구성 단계에서, 표시를 위해 결정된 부분을 크롭하는 단계

를 포함하는 비디오 시퀀스의 이미지 처리 방법. - 제1항에 있어서, 상기 서브시퀀스는 GOP 또는 장면이고, 상기 장면은 장면 전환 검출(scene change detection)에 의해 검출되는 비디오 시퀀스의 이미지 처리 방법.

- 제1항 또는 제2항에 있어서, 상기 비디오 시퀀스의 매개 변수들 또는 이전에 디코드된 서브시퀀스의 매개 변수들은 GOP 크기, 장면 길이, 시간적 서브샘플링 팩터, 최소 및 최대 줌 팩터들 및 경계 상자 속도 중 적어도 하나를 포함하는 비디오 시퀀스의 이미지 처리 방법.

- 제1항 또는 제2항에 있어서, 상기 비디오 시퀀스의 매개 변수들을 결정하는 상기 단계는, 현재 이미지에 대해,

이전 이미지(imn-1)에서, 상기 이전 이미지의 가장 현저한 부분인 화소들(sa1)의 하위-영역(sub-area) 또는 하위-집합(sub-set))을 결정하는 단계;

상기 이전 이미지의 화소들의 상기 하위-영역 또는 하위-집합 주위에 제1 경계 상자(bb1)를 결정하는 단계;

상기 현재 이미지(imn)에서, 상기 현재 이미지의 가장 현저한 부분인 화소들(sa2)의 하위-영역 또는 하위-집합을 결정하는 단계;

상기 현재 이미지의 상기 영역 주위에 제2 경계 상자(bb2)를 결정하는 단계 - 상기 제2 경계 상자는 가변적인 경계 상자 위치를 가짐 - ;

상기 제1 경계 상자(bb1)와 상기 제2 경계 상자(bb2)의 위치들로부터 경계 상자 시프트(ddet)를 계산하거나, 상기 제1 경계 상자(bb1)와 상기 제2 경계 상자(bb2)의 위치 및 상기 비디오 프레임 레이트로부터 경계 상자 시프트(ddet) 및 경계 상자 속도를 계산하는 단계;

결정된 경계 상자 시프트(ddet) 또는 경계 상자 속도를, 연속 이미지들 사이의 최대 허용 경계 상자 시프트 또는 경계 상자 속도와 비교하는 단계; 및

결정된 경계 상자 시프트가 상기 최대 허용 경계 상자 시프트 위이거나, 결정된 경계 상자 속도가 상기 최대 허용 경계 상자 속도 위인 경우에는, 새로운 경계 상자(bbdet)의 위치 및/또는 크기를 결정하고, 결정된 새로운 경계 상자에 따라, 상기 현재 이미지에서, 표시를 위한 하위-영역을 크롭하고,

그렇지 않으면, 결정된 경계 상자 시프트(ddet) 또는 경계 상자 속도가 상기 최대 허용 경계 상자 시프트 또는 최대 허용 경계 상자 속도이거나 그 아래인 경우에는, 결정된 제2 경계 상자(bb2)에 따라, 상기 현재 이미지에서, 표시를 위한 하위-영역을 크롭하는 단계

를 포함하는 비디오 시퀀스의 이미지 처리 방법. - 제1항 또는 제2항에 있어서, 상기 최대 허용 경계 상자 시프트 또는 경계 상자 속도는 상기 비디오 시퀀스의 이전에 디코드된 서브시퀀스의 매개 변수들로부터 결정되는 비디오 시퀀스의 이미지 처리 방법.

- 제1항 또는 제2항에 있어서, 시간이 지남에 따라 크로핑 윈도우 매개 변수들(cropping window parameters)을 스무드하게 하는 단계를 더 포함하고, 시간이 지남에 따라 상기 크로핑 윈도우 매개 변수를 스무드하게 하기 위해 상기 재구성 단계에서 버퍼가 사용되고, 상기 버퍼 크기(s1)는 상기 GOP 크기에 따라 조정되는 비디오 시퀀스의 이미지 처리 방법.

- 제1항 또는 제2항에 있어서, 시간적 서브샘플링 팩터 또는 시간적 서브샘플링 스킴은 시간적 서브샘플링 모드에 따라 설정되고, 제1 서브샘플링 모드(FM)에서, 상기 재구성 단계가 모든 프레임들에 적용되고, 제2 서브샘플링 모드(IM)에서, 상기 재구성 단계가 모든 I-프레임들 및 P-프레임들에 적용되고 제로 이상의 B-프레임에는 적용되지 않으며, 제3 서브샘플링 모드(LM)에서, 상기 재구성 단계는 모든 I-프레임에 적용되고 임의의 B-프레임에는 적용되지 않고, 제로 이상의 P-프레임에는 적용되지 않는 비디오 시퀀스의 이미지 처리 방법.

- 제8항에 있어서, 상기 서브샘플링 모드들 중 하나는 비트레이트 요구 사항들과 이미지 품질 요구 사항들 중 적어도 하나에 따라 선택되는 비디오 시퀀스의 이미지 처리 방법.

- 제1항 또는 제2항에 있어서, 크롭될 부분은 크로핑 윈도우에 의해 정의되고, 최대 또는 최소 허용 줌 팩터 또는 줌 팩터 쌍을 결정하는 단계를 더 포함하며, 상기 최대 또는 최소 허용 줌 팩터는 크로핑 윈도우가 시간이 지남에 따라 달라질 수 있는 최대 경계를 정의하고, 또는 상기 줌 팩터 쌍은 상기 크로핑 윈도우가 시간이 지남에 따라 달라질 수 있는 그들 사이의 2개의 경계를 정의하는 비디오 시퀀스의 이미지 처리 방법.

- 제10항에 있어서, 상기 줌 팩터 쌍은 현재 GOP 또는 장면의 제1 프레임의 매크로블록 비용 맵의 상기 매개 변수들로부터 계산되는 비디오 시퀀스의 이미지 처리 방법.

- 비디오 시퀀스의 이미지들을 처리하기 위한 장치로서,

상기 비디오 시퀀스의 매개 변수들을 결정하고, 상기 비디오 시퀀스의 이전에 디코드된 서브시퀀스의 매개 변수들을 결정하고, 사용자 설정들을 결정하기 위한 이미지 분석 수단; 및

결정된 매개 변수들에 따라 크롭될 부분을 결정하고, 표시를 위해 결정된 부분을 크롭하기 위한 이미지 처리 수단 - 상기 크롭될 부분은 가변 위치와 가변 크기 중 적어도 하나를 갖는 경계 상자에 의해 정의되고, 상기 가변 위치는 상기 비디오 시퀀스에서 인접한 프레임들의 인트라-코딩된 매크로블록들 사이의 상관 관계에 의존하고, 상기 상관 관계의 제1 상관 값의 경우에, 상기 제1 상관 값보다 더 높거나 더 낮은 상관 값보다 상기 경계 상자 위치가 더 빨리 달라지고, 상기 가변 크기는 현재 GOP 또는 장면의 제1 프레임의 매크로블록 비용 맵의 매개 변수들로부터 계산되는 줌 팩터에 의존하고, 제로와 같은 비용을 갖는 매크로블록들의 퍼센트가 더 낮은 경우에 더 높은 최대 줌 팩터가 허용됨 -

을 포함하는 비디오 시퀀스의 이미지 처리 장치. - 제13항에 있어서, 장면 전환 검출 모듈을 더 포함하고, 상기 서브시퀀스는 GOP 또는 장면이고, 상기 장면은 상기 장면 전환 검출 모듈에 의해 검출되는 비디오 시퀀스의 이미지 처리 장치.

- 제13항 또는 제14항에 있어서,

이전 이미지(imn -1)에서, 상기 이전 이미지의 가장 현저한 부분인 화소들(sa1)의 하위-영역 또는 하위-집합을 결정하기 위한 수단;

상기 이전 이미지의 상기 하위-영역 또는 하위-집합 주위에 제1 경계 상자(bb1)를 결정하기 위한 수단;

현재 이미지(imn)에서, 상기 현재 이미지의 가장 현저한 부분인 화소들(sa2)의 하위-영역 또는 하위-집합을 결정하기 위한 수단;

상기 현재 이미지의 상기 영역 주위에 제2 경계 상자(bb2)를 결정하기 위한 수단;

상기 제1 경계 상자(bb1)와 상기 제2 경계 상자(bb2)의 위치들로부터 경계 상자 시프트(ddet)를 계산하거나, 상기 제1 경계 상자(bb1)와 상기 제2 경계 상자(bb2)의 위치들 및 상기 비디오 프레임 레이트로부터 경계 상자 속도를 계산하기 위한 수단;

결정된 경계 상자 시프트(ddet) 또는 경계 상자 속도를, 연속 이미지들 사이의 최대 허용 경계 상자 시프트 또는 경계 상자 속도와 비교하기 위한 수단; 및

새로운 경계 상자(bbdet)의 위치 및/또는 크기를 결정하고, 결정된 경계 상자 시프트가 상기 최대 허용 경계 상자 시프트 위이거나, 결정된 경계 상자 속도가 상기 최대 허용 경계 상자 속도 위인 경우에, 결정된 새로운 경계 상자에 따라, 상기 현재 이미지에서, 표시를 위한 하위-영역을 크롭하고, 그렇지 않으면, 결정된 경계 상자 시프트(ddet) 또는 경계 상자 속도가 상기 최대 허용 경계 상자 시프트 또는 경계 상자 속도이거나 그 아래인 경우, 결정된 제2 경계 상자(bb2)에 따라, 상기 현재 이미지에서 표시를 위한 하위-영역을 크롭하기 위한 수단

을 더 포함하는 비디오 시퀀스의 이미지 처리 장치.

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP12305779.6A EP2680219A1 (en) | 2012-06-29 | 2012-06-29 | Method for reframing images of a video sequence, and apparatus for reframing images of a video sequence |

| EP12305779.6 | 2012-06-29 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20140004022A true KR20140004022A (ko) | 2014-01-10 |

Family

ID=48655986

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020130075852A KR20140004022A (ko) | 2012-06-29 | 2013-06-28 | 비디오 시퀀스의 이미지들을 재구성하기 위한 방법, 및 비디오 시퀀스의 이미지들을 재구성하기 위한 장치 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US8891016B2 (ko) |

| EP (2) | EP2680219A1 (ko) |

| JP (1) | JP6198484B2 (ko) |

| KR (1) | KR20140004022A (ko) |

| CN (1) | CN103533370B (ko) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11038365B2 (en) | 2014-09-29 | 2021-06-15 | Scramoge Technology Limited | Composite magnetic sheet and wireless charging module comprising same |

Families Citing this family (11)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP2582134A1 (en) * | 2011-10-12 | 2013-04-17 | Thomson Licensing | Saliency value determination of predictively encoded video streams |

| US8994838B2 (en) * | 2013-04-16 | 2015-03-31 | Nokia Corporation | Motion adaptive cropping for video stabilization |

| US10051281B2 (en) * | 2014-05-22 | 2018-08-14 | Apple Inc. | Video coding system with efficient processing of zooming transitions in video |

| JP6672305B2 (ja) * | 2014-12-22 | 2020-03-25 | インターデジタル シーイー パテント ホールディングス | オブジェクト検出に基づき外挿画像を生成する方法及び装置 |

| CN104702968B (zh) * | 2015-02-17 | 2019-06-11 | 华为技术有限公司 | 一种视频帧丢帧方法及视频发送装置 |

| JP6724904B2 (ja) * | 2015-04-14 | 2020-07-15 | ソニー株式会社 | 画像処理装置、画像処理方法、および画像処理システム |

| EP3371974B1 (en) * | 2015-11-06 | 2024-05-01 | Microsoft Technology Licensing, LLC | Flexible reference picture management for video encoding |

| CN105721851A (zh) * | 2016-02-02 | 2016-06-29 | 福建天晴数码有限公司 | 光屏障式3d显示设备的视频残影优化方法及系统 |

| CN110418195B (zh) * | 2019-08-09 | 2020-08-18 | 华南理工大学 | 一种基于最佳裁剪的实时视频缩略方法 |

| US11195039B2 (en) * | 2020-03-10 | 2021-12-07 | International Business Machines Corporation | Non-resource-intensive object detection |

| CN112907617B (zh) * | 2021-01-29 | 2024-02-20 | 深圳壹秘科技有限公司 | 一种视频处理方法及其装置 |

Family Cites Families (12)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2001015459A1 (en) * | 1999-08-24 | 2001-03-01 | Fujitsu Limited | Time-varying image processor, its method, and recorded medium |

| US7266771B1 (en) * | 2000-04-21 | 2007-09-04 | Vulcan Patents Llc | Video stream representation and navigation using inherent data |

| US7428338B2 (en) * | 2002-01-10 | 2008-09-23 | Ricoh Co., Ltd. | Header-based processing of images compressed using multi-scale transforms |

| US7609947B2 (en) * | 2004-09-10 | 2009-10-27 | Panasonic Corporation | Method and apparatus for coordinating playback from multiple video sources |

| WO2007093780A2 (en) * | 2006-02-13 | 2007-08-23 | Snell & Wilcox Limited | Method and apparatus for modifying a moving image sequence |

| JP4714039B2 (ja) * | 2006-02-27 | 2011-06-29 | 株式会社東芝 | 映像再生装置及び映像再生方法 |

| US20100027622A1 (en) * | 2006-10-25 | 2010-02-04 | Gokce Dane | Methods and apparatus for efficient first-pass encoding in a multi-pass encoder |

| FR2912237A1 (fr) | 2007-02-07 | 2008-08-08 | Thomson Licensing Sas | Procede de traitement d'image |

| WO2009154033A1 (ja) * | 2008-06-18 | 2009-12-23 | 三菱電機株式会社 | 三次元映像変換記録装置、三次元映像変換記録方法、記録媒体、三次元映像変換装置、及び三次元映像伝送装置 |

| US8237771B2 (en) * | 2009-03-26 | 2012-08-07 | Eastman Kodak Company | Automated videography based communications |

| JP2012002683A (ja) * | 2010-06-17 | 2012-01-05 | Fuji Electric Co Ltd | ステレオ画像処理方法およびステレオ画像処理装置 |

| EP2549754A1 (en) * | 2011-07-19 | 2013-01-23 | Thomson Licensing | Method and apparatus for reframing and encoding an original video signal |

-

2012

- 2012-06-29 EP EP12305779.6A patent/EP2680219A1/en not_active Withdrawn

-

2013

- 2013-06-18 EP EP13172393.4A patent/EP2680220B1/en not_active Not-in-force

- 2013-06-26 US US13/928,146 patent/US8891016B2/en not_active Expired - Fee Related

- 2013-06-28 KR KR1020130075852A patent/KR20140004022A/ko not_active Application Discontinuation

- 2013-06-28 JP JP2013136263A patent/JP6198484B2/ja not_active Expired - Fee Related

- 2013-07-01 CN CN201310270910.7A patent/CN103533370B/zh not_active Expired - Fee Related

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11038365B2 (en) | 2014-09-29 | 2021-06-15 | Scramoge Technology Limited | Composite magnetic sheet and wireless charging module comprising same |

Also Published As

| Publication number | Publication date |

|---|---|

| EP2680219A1 (en) | 2014-01-01 |

| EP2680220A2 (en) | 2014-01-01 |

| US8891016B2 (en) | 2014-11-18 |

| CN103533370B (zh) | 2018-05-18 |

| JP6198484B2 (ja) | 2017-09-20 |

| CN103533370A (zh) | 2014-01-22 |

| EP2680220A3 (en) | 2015-04-29 |

| EP2680220B1 (en) | 2018-08-08 |

| JP2014011807A (ja) | 2014-01-20 |

| US20140002742A1 (en) | 2014-01-02 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US8891016B2 (en) | Method for reframing images of a video sequence, and apparatus for reframing images of a video sequence | |

| US10977809B2 (en) | Detecting motion dragging artifacts for dynamic adjustment of frame rate conversion settings | |

| AU2011352102B2 (en) | Video coding | |

| US8983175B2 (en) | Video processing method and device for depth extraction | |

| US9942557B2 (en) | Method and system of video encoding optimization | |

| US9681125B2 (en) | Method and system for video coding with noise filtering | |

| US9729870B2 (en) | Video coding efficiency with camera metadata | |

| US10354394B2 (en) | Dynamic adjustment of frame rate conversion settings | |

| JP2018201189A (ja) | ビデオストリームを形成するための方法および画像処理ユニット | |

| KR20120114263A (ko) | 객체-인식 비디오 인코딩 전략 | |

| US20130003846A1 (en) | Frame encoding selection based on frame similarities and visual quality and interests | |

| EP3796655B1 (en) | Video privacy mask in forward predicted video frame | |

| US8165217B2 (en) | Image decoding apparatus and method for decoding prediction encoded image data | |

| JP5950605B2 (ja) | 画像処理システム、及び、画像処理方法 | |

| US20150249829A1 (en) | Method, Apparatus and Computer Program Product for Video Compression | |

| US20070104382A1 (en) | Detection of local visual space-time details in a video signal | |

| CN114157870A (zh) | 编码方法、介质及电子设备 | |

| US11290735B1 (en) | Visual element encoding parameter tuning | |

| US20130251045A1 (en) | Method and device for determining a motion vector for a current block of a current video frame | |

| CN112714336B (zh) | 视频分割方法和装置、电子设备、计算机可读存储介质 | |

| Feng et al. | Fast prediction unit selection method for HEVC intra prediction based on salient regions | |

| CN110324636B (zh) | 用于对视频流中的帧序列进行编码的方法、设备和系统 | |

| JP2003061112A (ja) | カメラワーク検出装置およびカメラワーク検出方法 | |

| JPH118854A (ja) | カット点検出方法及び装置 | |

| US9860567B2 (en) | Image processing apparatus, image processing method, and storage medium |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| WITB | Written withdrawal of application |