JP7701774B2 - 教育vr用コンテンツ提供プログラム及び医療教育vr用コンテンツ提供システム - Google Patents

教育vr用コンテンツ提供プログラム及び医療教育vr用コンテンツ提供システム Download PDFInfo

- Publication number

- JP7701774B2 JP7701774B2 JP2021127931A JP2021127931A JP7701774B2 JP 7701774 B2 JP7701774 B2 JP 7701774B2 JP 2021127931 A JP2021127931 A JP 2021127931A JP 2021127931 A JP2021127931 A JP 2021127931A JP 7701774 B2 JP7701774 B2 JP 7701774B2

- Authority

- JP

- Japan

- Prior art keywords

- image

- educational

- instructor

- pointer

- learner

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Landscapes

- Electrically Operated Instructional Devices (AREA)

- Management, Administration, Business Operations System, And Electronic Commerce (AREA)

Description

従来は、危険性の高い緊急時の状況を、学習を目的に実際に再現することは困難であったが、VR(Virtual Reality)を応用すれば、安全に再現することが可能となり、様々なシーンを想定して学習されている。

従って、VRによる疑似体験を重ねることで医療関係の学習者の経験値もあがり、実際の緊急事態でも冷静に初期対応を実施することが期待でき、例えば歯科治療の安全性の向上に貢献できる可能性があると考えられている。

手術の安全は、かかわっている医療スタッフ全員で守るものであり、そのためには自分の職種の役割だけではなく、広い視野を持って様々なことを調整していきながら対応していくことが重要である。

従って、治療中においては、どこを常に注目して治療を進めていけばよいかを一目で把握できていく学習が望ましい。

コンピュータを、

(A).教育VR用画像を記憶手段に記憶する手段、

(B).前記医療の指導者又は学習者に装着された前記ヘッドマウントディスプレィの動き情報を一定間隔で読み込む手段と、

(C).前記ヘッドマウントディスプレィの動き情報に基づいて前記教育VR用画像に視線中心を定めて視野範囲を決定する手段、

(D).決定した視野範囲の視野画像を前記指導者又は学習者の端末の画面に表示する手段、

(E).前記医療の指導者又は前記学習者の端末により、前記ポインタアイコンの終点となる位置を前記注目点としてこの視野画像に定義させる手段、

(F).前記終点の定義に伴って、この視野画像の中心に始点を定め、この始点の座標及び前記終点の座標を求める手段、

(G).前記視野画像の始点の座標を起点とし、この始点の座標と前記終点の座標との間に、前記起点から前記終点に向かって次第に幅が広がる縞状の三角状のアイコンをポインタアイコンとして前記視野画像に重ね、これを前記医療の指導者又は学習者のポインタ付注視画像として前記記憶手段に生成する手段、

(H).前記医療の指導者のポインタ付注視画像を学習者端末に送信して表示させる手段、

としての機能を実行させる。

前記学習者の端末は、ヘッドマウントディスプレィ、コントローラ、高速大容量の通信機能を有するスマートフォン、パソコンを有して、前記スマートフォンで通信ネットワークを介して前記教育用VR用コンテンツサイトのサーバに接続されており、

前記サーバを、

前記(A)~(H)の手段としての機能を実行させる。

このため、治療中においては、どこを常に注目して治療を進めていけばよいかを一目で把握できていく学習ができる。

本発明は、(A)歯科の診療環境や歯科口腔外科の麻酔管理、(B)医学教育とVRの応用、(C)VRコンテンツを応用した学習と評価方法等に適用できる。

厚生労働省の2017年の調査では、歯科診療所の35%に当たる24,014施設でインプラント治療が行われていると言われている。

2007年5月には東京都内の歯科診療所でインプラント治療の受けた70歳の女性が手術中の動脈損傷がもとで死亡するという事故が起きた。これにより、歯科医師の救命能力に関する歯科模型に対して診療器具を作用させて模擬診療する問題が提言され、医療安全及び救命医療の技術取得のための体制が確保されてきた。

しかし、実際にこういった緊急事態に遭遇した場合、歯科医師自身が狼狽してしまう可能性も考えられる。

手術の安全は、かかわっている医療スタッフ全員で守るものであり、そのためには自分の職種の役割だけではなく、広い視野を持って様々なことを調整していきながら対応していくことが重要である。

すなわち、本発明は歯科の診療環境や歯科口腔外科の麻酔管理のための学習に適用させることができる。

従来では学生を一か所に集めて講義をするという教育様式が一般的であったが、コロナ渦の現在ではオンラインによる教育が推進している状況であり、オンラインによる講義では座学が中心となってきている。

医療という専門的で高度な技術や知識を要する職種では、体験を伴う訓練が重要であると考えられ、オンラインによる座学中心の講義では臨床学習と比較して医療件の経験不足するという懸念がある。

実際の臨床学習では、タイミングや地域によって病例が偏ったり、専門的すぎる病例になってしまうと行った場合もあり、医学教育の標準化といった観点からもVRは教育ツールの有効な手段の一つとして考えられる。

すなわち、HMDを用いたVR医学教育を学習者のレベルに応じて学習させる。

<(C)VRコンテンツを応用した学習と評価方法>

360度カメラを用いて緊急時を想定したVRコンテンツを試作し、HMD等を装着した学習者が映像を閲覧しながら研修をするようにする。

その際用いた評価シートには、それぞれの行動に対して注意すべきチェックポインタが記載されており、評価者が均一的な評価が行えるようになる。

次に、本発明に用いるVRコンテンツの概要を説明する。

(1)歯科治療中の偶発症に関する対応

(2)口腔外科での静脈内鎮静化での麻酔管理

の2つをテーマにVRコンテンツを制作した(図10)。

(1)の映像に関しては、過換気病候群とアナフイラルシーショックについて作成した。過換気病候群は、軽病な偶発病で致死的な転機は迎えないが、患者が激しい呼吸苦等を訴えるなどするために歯科医師が狼狽してしまい。敏速に適切な対応ができない場合もあると考えられる。

そこで、両者とも診断のポインタや処置内容を確認できるチェックポインタを映像に組み込みながらVRコンテンツを作成した。

ポインタとしては、血管迷走神経性反射との鑑別診断や、そのために重要となる皮膚症状について察知できているか、また理解できているかを問うシナリオ構成となっている。

学習者が視線を送れていれば、そこから何を検知したか、もしくは理解したかを筆記試験や口頭試問で評価者が確認できるようにする。

ドレーディングすることによって、通常の歯科診療とは異なる患者の表情や様子を即座に把握しづらいといった状況は、通常の歯科診療の官業とは大幅に異なるため、歯科医師のみならず歯科生成等の歯科医療スタッフも患者の状況に配慮したりバイタルサインのモニタリングなどに精通することが重要である。

歯科医療スタッフに対して行った研究では、経験が少ない歯科医療スタッフはVRコンテンツ内での視野が狭く、患者の顔周辺に視線が集まりがちなのに対し、普段からモニタリングや全身状態に配慮している歯科医療スタッフは視野が広く、全体的に視線を送る傾向があった。

映像の制作上の注意点としては、HMDの中で学習者が視線を動かした場合では、評価者はどこに注視しているかがわかり難い、どこを注視しているか学習者、評価者ともにわかるポインタを画面上に表示するようにプログラムするか(図6)、あえて離れた位置に生体モニタなどを配置して、首を振るような形で意識的に見ないと学習者が生体モニタを見ることができないような場所に配置するようにした。

そこで、VRコンテンツの映像を元に2Dの映像を作成し、画面上に状況、知識を整理するのに必要な解説を加えた教育用コンテンツを別に作成した。

通常こういうコンテンツを制作する場合では複数台のカメラやカメラマンが必要となるが、360度カメラの場合では少ない台数で済むので、必要なスペースや人員が少なくてすみ、手術室という清潔環境に適していると考えられる。

360度カメラの機材に関しては、現在さまざまない機種が流通している。4Kの高解像度をもっていても、実際には拡大して視聴するために解像度が低くなったり、映像編集の際にPCを使うことができず、スマートフォンのみの編集となる機種もあり、用途に応じて選択することが重要である。

そして、再生するときには、その逆に変形(伸長、デコード)させ、元々の全方向映像を仮想的に再現する。

また、カメラの正面を主に見せたい被写体にできるだけ近づけて設置することで、見るときに拡大する比率を下げて画質の低下を避ける配置が必要である。

編集に際しては撮影に使用したメーカー、機種の方式に対応していることが重要である。

医療情報であるので、配信におけるセキュリティは重要である。歯科における教育用コンテンツの配信サイトはいくつか存在する。

また、HMDにダウンロードする方法もある。より強い没入感を得ることができるので、より臨場感のある体験がきたいされる。しかし、デバイスが高額なために、コストがかかることが懸念される。

今後の課題であるが、VRにより医療現場と教育現場の場をリアルタイムで結びつけることで、現任訓練(OJT)に近い形での教育が可能となると考えられる。

医療現場で使われる高精度な画像を送受信するためには、大容量で高速な通信環境が不可欠であり、そのあめには5G(第5世代移動通信システム)のような遅延がない通信方法を用いる。

以下に、実施の形態を説明する。

本実施の形態は、学習者は医療関係者(歯科医師、医師、助産師、看護師、歯科衛生士、歯科技工士、理学療法士、作業療法士、救急救命士、等)の内で経験が浅い歯科医師へのVR学習を一例として説明する。また、本実施の形態では表示部等の画面に表示されたコンテンツを映像と称し、コンピュータ内で処理されるものは画像と称して説明する。

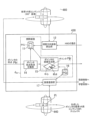

医療現場側300は、VR用カメラ(360度カメラ:ドームカメラ)310で医療現場を撮影し、図示しないパソコン、サーバでこの撮影画像をサイト400に送信している。

学習者側200は、5G対応のスマートフォン(以下、スマフォ270という)と、パソコン280(モニタでも構わない)等で構成されている。

さらに、学習者用HMD240に学習者注視画像生成処理部230と、HMD画像表示処理部220と、メモリ250等を備えている。メモリ250には、教育VR用コンテンツ等が読み込まれる。

HMD画像表示処理部220は、メモリ250の教育VR用コンテンツ(画像)を3D表示処理する。学習者注視画像生成処理部230は、後述するポインタ定義プログラムであり、学習者用HMDコントローラ260が示すポインタPiを3D表示する画像に定義する。なお、スマフォをマウントする形式のHMDの場合は、学習者注視画像生成処理部230及びHMD画像表示処理部220は不要である。

視野方向画像読込部12は、学習者側200又は指導者側100からのHMDの動き(姿勢、位置を含む)を読み込み、このHMDの動きに基づいて視線方向を求めてサイト側メモリ440の教育VR用コンテンツに視野範囲Siを定義する。

ポインタ始点終始定義部14は、学習者側200又は指導者側100からのアクセスによってポインタ定義プログラム(ポインタの終点定義用)を送信してダウンロードさせる。

そして、学習者側200又は指導者側100からのポインタ終点Pbiを受信する毎に画像メモリ11の視野画像(KGi、LGi、又はEGi)の上にフレームを定め、このフレームの中心座標をポインタ始点Pai(視野画像の中心座標)として定義すると共に、フレームにポインタ終点Pbiを定義(視野画像の座標)する。

そして、画像メモリ11の視野画像に注視方向ポインタ画像PWiを重ね、これをポインタ付注視画像PGi(HGi、PWi)としてサイト側メモリ440に記憶して、送信させる。

そして、学習者側200(受験者側)又は評価者側からのポインタ付教育VR用コンテンツMPiの要求に伴って、ポインタ付教育VR用コンテンツMPiをその端末に送信する。

初めに指導者側教育VR画像の生成について説明する。

図3は指導者側でのポイント付注視画像を生成する場合のシーケンス図である。なお、本実施の形態では、指導者側パソコン110、指導者側MDIコントローラ120、指導者側MDI130を総称して指導者側端末と称する。

図3に示すように、学習者側200は、スマフォ270又はパソコン(本実施の形態ではスマフォとする)を操作してサイト400のサイト側サーバ410にアクセス(ID、パスワード)して(d10)、学習者基本情報をサイト側メモリ440に記憶する(d11)。

具体的には、学習者側200のスマフォ270とサイト側サーバ410とが通信ネットワーク500を介して通信接続し、サイト側サーバ410の送受信処理部420がサイト側メモリ440に記憶する。

医療現場側(教育用演技)300は、パソコンを操作して教育VR用コンテンツ(教育VR画像)をサイト側サーバ410に送信する(d20)。この教育VR用コンテンツには、撮影現場名、教育VR用コンテンツ名(歯科治療における偶発症、麻酔、・・)、患者年齢、性別、患者身長、患者名、持病・・)、撮影時刻、カメラ番号等が関連付けられている。

教育VR用コンテンツ(教育VR画像)は、例えば歯科治療中の偶発症に関する対応のコンテンツ、口腔外科での静脈内鎮静化での麻酔管理のコンテンツ等である。

前述の教育VR用コンテンツの取得には、具体的には、指導者名、指導者コード、教育用コンテンツ名、コンテンツ種類、撮影年月日時刻等(以下、総称して指導者教育VR用要求情報という)と、ポインタ生成の有無を入力するための画面をサイト側サーバ410より送信させて入力する。

そして、登録されている指導者の場合は、指導者教育VR用要求情報を教育画像生成処理部430に出力して起動させる。

サイト側サーバ410の送受処理部420は、この指導者側HMD動き情報Eiを教育画像生成処理部430に出力する。

指導者側パソコン110は、指導者側視野画像KGiを受信する毎に、指導者側HMD130に出力してそのディスプレイに表示(2D又は3D用でも構わない)させる(d36)。

ポインタ付注視画像生成処理については図2を用いて説明する。

図2に示すポインタ始点終点定義部14は、ポインタPiを生成するためのフレームレイヤ(視野範囲のサイズに相当する)を画像メモリ11の指導者側視野画像KGiに上に定めると共に視野方向画像読込部12に対して現在の指導者側視野画像KGiを画像メモリ11に読み込みさせる(記憶)。

そして、ポインタ終点Pbiが指導者MDiによって指定されたかどうかを判定している。

ポインタ終点Pbiは、指導者側HMDコント―ラ120によって、指定させるのが好ましい。具体的にはカーソルを指導者が注視する方向とする所定の終点位置に移動させ、マウスクリックで十字マーク等(星印、〇印等)を表示する。これをポインタ終点Pbiの定義と称する。

例えば、指導者側視野画像KG11が指導者注視画像HG1とされて、指導者注視方向ポインタアイコンPiが定義されて指導者注視方向ポインタ画像PW1となりポインタ付注視画像PG1とされ、・・・指導者側視野画像KG51が指導者注視画像HG10とされて、指導者注視方向ポインタアイコンPiが定義されて指導者注視方向ポインタ画像PW10となりポインタ付注視画像PG10とされた例である。

なお、図6等においては、アイコンは縞状にして示している。縞状にしないで単にベタ塗り的なアイコンでもよい。

また、教育画像生成処理部430の画像登録部17は、ポインタ付注視画像PGiに関連付けられている教育VR用コンテンツ(教育VR画像:360度)をサイト側メモリ440に複写(登録)すると共に、メモリ16にポインタ付注視画像PGiを複写(登録)する(d41)。

次に学習者側のHMDを用いての学習を図4のシーケンス図を用いて説明する。

学習側200については、教育コンテンツを学習コンテンツと称して説明する。

図4に示すように、学習者はスマフォ270を操作して、サイト400にアクセスして学習者コンテンツ入手画面(図示せず)を取得する。

学習者側HMD240は、この学習者HMDの動きFiを検出する毎に、スマフォ270に出力する(d55)。

サイト側サーバ410は、学習者HMDの動きFi(姿勢、位置)に該当するの送受処理部420は、サイト側メモリ440に登録されているポインタ付教育VR用コンテンツMPiにおける視野を求め(d42の処理と同様)、この視野のポインタ付注視画像PGi(PG1、PG2、・・)、指導者側視野画像KGi(KG1、KG2、・・・)を読み出し(d58)、スマフォ270に送信する(d60)。

スマフォ270は、送信された画像を受信し、これを学習者側HMD240に出力する(d62)。

次に、学習者を試験(評価ともいう)する場合について図5のシーケンス図を用いて説明する。本実施の形態では、試験官を評価者と称し、評価される学習者を受験者と称する。

図5に示すように、評価者は端末(以下、指導者端末という)を操作してサイト400(サイト側サーバ410)にアクセス(ID、パスワード)して、評価者基本情報をサイト側メモリ440に記憶する(d70)。教育VR用コンテンツを評価試験VR用コンテンツと称する。

評価を受ける学習者側のスマフォ270は、この初期画像を学習者側HMD240に出力して3D表示させる(d78)。

スマフォ270は、受験者側HMDの動きLEi(姿勢、位置)の情報をサイト側サーバ410に送信(5G)する(d82)。

受験者視野画像LGiの決定処理は、受験者側HMDの動きLEi(姿勢、位置)に該当する評価試験VR用コンテンツにおける視野を求め、この視野の視野画像KGi(KG1、KG2、・・・)を、評価試験を受ける学習者への評価画像TPiとして決定する。

スマフォ270は、評価用画像TPi(評価試験VR用コンテンツ)を受信し、HMD240に出力する(d88)。

評価を受ける学習者は、この評価用画像TGiに注視する部分がある場合は、HMDコントローラ260を操作してポインタの終点を決定させるために所定位置にカーソルを移動させて、終点Pbiを定義する(d92)。

そして、ポインタ終点Pbiを画像メモリ11のフレームにポインタ終点Pbiを定義する(図11(a)参照)。そして、レイヤに、中心Paiとポインタ終点Pbiとを結ぶ評価受験者側注視方向ポインタLPi(アイコン)を定義する(図11(b)参照)。このポインタとフレームとからなる画像を注視方向ポインタ画像PWiと称している。

スマフォ270は、このポインタ付注視画像PGi(教育用コンテンツ情報の番号、コンテンツ名、Pai、Pbi、ポインタコード、年月日時刻、端末アドレス・・・)を学習者側HMD240に出力する(d112)。

そして、指導者側HMD130、スマフォ240は前述のd79に戻って(d116)、学習者側HMD130の動きに対応した画像を表示させて上記のようにポインタPi(画像中心を始点として終点側に広がる三角状のアイコン)を定義して表示させる(d116)。

例えば、患者が過度に緊張した状態で三叉神経領域である口腔内に強い痛み刺激を与えると、血管迷走神経性反射を起こす可能性があることや、アナフイラキシーショックを疑う場合、他にどのような症状が起こり得るか、また、映像中ではエピペントレーナなのでシリンジの色が白いがエピペンの成人用のシリンジの色は黄色と緑のどちらか、など周辺知識についても問うようにできる。

映像の制作上の注意点としては、HMDの中で学習者が視線を動かした場合では、評価者はどこに注視しているかがわかり難い、どこを注視しているか学習者、評価者ともにわかるポインタを画面上に表示するようにプログラムが必要とした例を示したが(図6、図7参照)、このプログラムを用意しなくても評価できるVRコンテンツであってもよい。

また、コメントBiとして例えば「奇異呼吸は、吸気時に胸部が陥没し、吸気時に突出する自然な呼吸とは逆のパターンとなる呼吸であり、上気道閉塞で発生する。」と表示する。

200 学習者側

300 医療現場側

400 サイト

500 通信ネットワーク

110 指導者端末

410 サイト側サーバ

430 教育画像生成処理部

430 教育画像生成処理部

Claims (2)

- 医療の指導者又は学習者に装着されたヘッドマウントディスプレィの動きに基づいて、

前記ヘッドマウントディスプレィに表示された患者の治療用の教育VR用画像に、医療の指導者の患者に対する注目点までの視線を示すポインタアイコンで前記教育VR用画像に表示するプログラムであって、

コンピュータを、

(A).教育VR用画像を記憶手段に記憶する手段、

(B).前記医療の指導者又は学習者に装着された前記ヘッドマウントディスプレィの動き情報を一定間隔で読み込む手段と、

(C).前記ヘッドマウントディスプレィの動き情報に基づいて前記教育VR用画像に視線中心を定めて視野範囲を決定する手段、

(D).決定した視野範囲の視野画像を前記指導者又は学習者の端末の画面に表示する手段、

(E).前記医療の指導者又は前記学習者の端末により、前記ポインタアイコンの終点となる位置を前記注目点としてこの視野画像に定義させる手段、

(F).前記終点の定義に伴って、この視野画像の中心に始点を定め、この始点の座標及び前記終点の座標を求める手段、

(G).前記視野画像の始点の座標を起点とし、この始点の座標と前記終点の座標との間に、前記起点から前記終点に向かって次第に幅が広がる縞状の三角状のアイコンをポインタアイコンとして前記視野画像に重ね、これを前記医療の指導者又は学習者のポインタ付注視画像として前記記憶手段に生成する手段、

(H).前記医療の指導者のポインタ付注視画像を学習者端末に送信して表示させる手段、としての機能を実行させる教育VR用コンテンツ提供プログラム。 - 前記指導者の端末は、ヘッドマウントディスプレィ、コントローラ、モニタ、パソコンを有して、通信ネットワークを介して教育VR用コンテンツサイトのサーバに接続されており、

前記サーバを、

前記学習者の端末は、ヘッドマウントディスプレィ、コントローラ、高速大容量の通信機能を有するスマートフォン、パソコンを有して、前記スマートフォンで通信ネットワークを介して前記教育VR用コンテンツサイトのサーバに接続されており、

前記(A)~(H)の手段としての機能を実行させる、請求項1記載の教育VR用コン テンツ提供プログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2021127931A JP7701774B2 (ja) | 2021-08-04 | 2021-08-04 | 教育vr用コンテンツ提供プログラム及び医療教育vr用コンテンツ提供システム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2021127931A JP7701774B2 (ja) | 2021-08-04 | 2021-08-04 | 教育vr用コンテンツ提供プログラム及び医療教育vr用コンテンツ提供システム |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2023022877A JP2023022877A (ja) | 2023-02-16 |

| JP7701774B2 true JP7701774B2 (ja) | 2025-07-02 |

Family

ID=85203979

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2021127931A Active JP7701774B2 (ja) | 2021-08-04 | 2021-08-04 | 教育vr用コンテンツ提供プログラム及び医療教育vr用コンテンツ提供システム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP7701774B2 (ja) |

Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2016081339A (ja) | 2014-10-17 | 2016-05-16 | セイコーエプソン株式会社 | 頭部装着型表示装置、頭部装着型表示装置を制御する方法、コンピュータープログラム |

| US20170053545A1 (en) | 2015-08-19 | 2017-02-23 | Htc Corporation | Electronic system, portable display device and guiding device |

| JP2018528496A (ja) | 2015-05-27 | 2018-09-27 | グーグル エルエルシー | 仮想現実旅行のためのリーダーデバイスおよび参加者デバイスを含むシステム |

| JP2019506922A (ja) | 2015-12-29 | 2019-03-14 | コーニンクレッカ フィリップス エヌ ヴェKoninklijke Philips N.V. | ロボット手術のために仮想現実デバイスを使用するシステム、コントローラ、及び方法 |

| JP2019537459A (ja) | 2016-09-29 | 2019-12-26 | シンバイオニクス リミテッド | 仮想現実環境または拡張現実環境の中の手術室内での医療シミュレーションのための方法およびシステム |

| US10810899B1 (en) | 2016-12-05 | 2020-10-20 | Google Llc | Virtual instruction tool |

-

2021

- 2021-08-04 JP JP2021127931A patent/JP7701774B2/ja active Active

Patent Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2016081339A (ja) | 2014-10-17 | 2016-05-16 | セイコーエプソン株式会社 | 頭部装着型表示装置、頭部装着型表示装置を制御する方法、コンピュータープログラム |

| JP2018528496A (ja) | 2015-05-27 | 2018-09-27 | グーグル エルエルシー | 仮想現実旅行のためのリーダーデバイスおよび参加者デバイスを含むシステム |

| US20170053545A1 (en) | 2015-08-19 | 2017-02-23 | Htc Corporation | Electronic system, portable display device and guiding device |

| JP2019506922A (ja) | 2015-12-29 | 2019-03-14 | コーニンクレッカ フィリップス エヌ ヴェKoninklijke Philips N.V. | ロボット手術のために仮想現実デバイスを使用するシステム、コントローラ、及び方法 |

| JP2019537459A (ja) | 2016-09-29 | 2019-12-26 | シンバイオニクス リミテッド | 仮想現実環境または拡張現実環境の中の手術室内での医療シミュレーションのための方法およびシステム |

| US10810899B1 (en) | 2016-12-05 | 2020-10-20 | Google Llc | Virtual instruction tool |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2023022877A (ja) | 2023-02-16 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US11195340B2 (en) | Systems and methods for rendering immersive environments | |

| US20250017656A1 (en) | Sensory enhanced environments for injection aid and social training | |

| TW202103646A (zh) | 用於遠距監督手術程序之擴增實境系統及方法 | |

| KR20180058656A (ko) | 현실-증강된 형태학적 방법 | |

| CN103732297A (zh) | 增强现实活动范围的治疗系统及其操作方法 | |

| US12183215B2 (en) | Simulated reality technologies for enhanced medical protocol training | |

| Tien et al. | Measuring situation awareness of surgeons in laparoscopic training | |

| Dicheva et al. | Digital transformation in nursing education: A systematic review on Computer-Aided nursing education pedagogies, recent advancements and outlook on the Post-COVID-19 era | |

| US11270597B2 (en) | Simulated reality technologies for enhanced medical protocol training | |

| McBain et al. | Scoping review: the use of augmented reality in clinical anatomical education and its assessment tools | |

| Komizunai et al. | An interactive endotracheal suctioning simulator which exhibits vital reactions: ESTE-SIM | |

| Jani et al. | Virtual reality and its transformation in forensic education and research practices | |

| Fleet et al. | Current clinical and educational uses of immersive reality in anesthesia: narrative review | |

| Cai et al. | Towards supporting adaptive training of injection procedures: Detecting differences in the visual attention of nursing students and experts | |

| Jain et al. | Design and Development of an Integrated Virtual Reality (VR)-based Training System for Difficult Airway Management | |

| Riva et al. | Virtual reality as telemedicine tool: technology, ergonomics and actual applications | |

| JP7701774B2 (ja) | 教育vr用コンテンツ提供プログラム及び医療教育vr用コンテンツ提供システム | |

| WO2024154647A1 (ja) | 学習方法、及び、学習システム | |

| Anscombe | A different view: in Europe, virtual and immersive technologies are starting to change the landscape of medical simulation | |

| Yeon-Hee | Necessity of anatomy education for dental school students utilizing 3D and virtual reality technologies: a narrative review | |

| US20190347959A1 (en) | Devices and methods for interactive augmented reality | |

| Demidova et al. | Technologies of Virtual and Augmented Reality in Biomedical Engineering | |

| Brunzini | Effectiveness analysis of traditional and mixed reality simulations in medical training: a methodological approach for the assessment of stress, cognitive load and performance | |

| Agarwal et al. | Virtual Reality: An Arsenal For Modern Dentistry In The Era Of COVID-19 | |

| Rani et al. | A Review of Augmented Reality |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A80 | Written request to apply exceptions to lack of novelty of invention |

Free format text: JAPANESE INTERMEDIATE CODE: A80 Effective date: 20210824 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20240403 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20250123 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20250213 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20250325 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20250515 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20250519 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20250619 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20250619 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7701774 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |