JP7640672B2 - ポインティングジェスチャ認識を用いるクロスデバイス対話のアクティブ化 - Google Patents

ポインティングジェスチャ認識を用いるクロスデバイス対話のアクティブ化 Download PDFInfo

- Publication number

- JP7640672B2 JP7640672B2 JP2023508055A JP2023508055A JP7640672B2 JP 7640672 B2 JP7640672 B2 JP 7640672B2 JP 2023508055 A JP2023508055 A JP 2023508055A JP 2023508055 A JP2023508055 A JP 2023508055A JP 7640672 B2 JP7640672 B2 JP 7640672B2

- Authority

- JP

- Japan

- Prior art keywords

- motion

- electronic device

- handheld electronic

- based gesture

- predetermined

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/017—Gesture based interaction, e.g. based on a set of recognized hand gestures

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/033—Pointing devices displaced or positioned by the user, e.g. mice, trackballs, pens or joysticks; Accessories therefor

- G06F3/0346—Pointing devices displaced or positioned by the user, e.g. mice, trackballs, pens or joysticks; Accessories therefor with detection of the device orientation or free movement in a three-dimensional [3D] space, e.g. 3D mice, 6-DOF [six degrees of freedom] pointers using gyroscopes, accelerometers or tilt-sensors

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0487—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser

- G06F3/0488—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/20—Movements or behaviour, e.g. gesture recognition

- G06V40/28—Recognition of hand or arm movements, e.g. recognition of deaf sign language

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04W—WIRELESS COMMUNICATION NETWORKS

- H04W4/00—Services specially adapted for wireless communication networks; Facilities therefor

- H04W4/80—Services using short range communication, e.g. near-field communication [NFC], radio-frequency identification [RFID] or low energy communication

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- General Engineering & Computer Science (AREA)

- Human Computer Interaction (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Health & Medical Sciences (AREA)

- Computer Vision & Pattern Recognition (AREA)

- General Health & Medical Sciences (AREA)

- Psychiatry (AREA)

- Social Psychology (AREA)

- Multimedia (AREA)

- User Interface Of Digital Computer (AREA)

- Telephone Function (AREA)

Description

本発明について出願された最初の出願である。

本発明は、電子デバイスとリモートに対話することに関し、特に、ユーザのジェスチャを認識し、次いで、これらのジェスチャを電子デバイスとのリモート対話に適用するために使用される方法及び装置に関する。

Claims (10)

- ハンドヘルド電子デバイスによる、第2デバイスとリモートに対話するための方法であって、当該方法は、

前記ハンドヘルド電子デバイスの1つ以上の運動センサによって生成された信号に基づいて、前記ハンドヘルド電子デバイスの動きを感知するステップと、

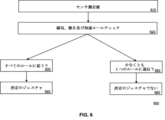

前記感知された動きが、前記ハンドヘルド電子デバイスの移動を含むモーションベースのジェスチャであることを認識するステップと、

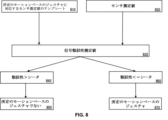

前記1つ以上の運動センサ、前記ハンドヘルド電子デバイスの1つ以上の他の構成要素又はそれらの組合せからの更なる信号に基づいて、前記第2デバイスを識別するステップであって、前記更なる信号は、前記ハンドヘルド電子デバイスが前記モーションベースのジェスチャの終わりに指している方向を示す、ステップと、

所定の条件が満たされ、かつ前記第2デバイスが識別された後に、前記第2デバイスとリモートに対話するためのユーザ対話を開始するステップであって、前記所定の条件は、前記認識されたモーションベースのジェスチャが、前記第2デバイスと対話するための所定のモーションベースのジェスチャであるときに少なくとも部分的に満たされる、ステップと、

を含み、前記第2デバイスを識別するステップは、前記第2デバイスが識別されたことを示すフィードバックを提供することを含み、前記所定の条件は、前記フィードバックに応答するユーザからの確認入力を認識することを更に含み、前記確認入力を認識することは、

(i)前記感知された動きが、前記所定のモーションベースのジェスチャに続いて、前記ハンドヘルド電子デバイスを動かす第2の所定のモーションベースのジェスチャを更に含むことを認識することと、

(ii)前記1つ以上の運動センサを使用して、前記ハンドヘルド電子デバイスが所定の位置で回転されることを認識することと、

(iii)前記1つ以上の運動センサを使用して、前記所定のモーションベースのジェスチャに続いて、所定の時間の間、更なる動きなしに、前記ハンドヘルド電子デバイスが所定の場所に保持されることを認識することと、

のうちの少なくとも1つを含む、方法。 - 前記モーションベースのジェスチャが所定のモーションベースのジェスチャであることを認識した後、前記第2デバイスが識別された後、前記確認入力を検出する前に、前記第2デバイスと対話する意図を確認するために前記確認入力を提供するように前記ユーザに促すことを更に含む、

請求項1に記載の方法。 - 前記所定の条件は、前記ハンドヘルド電子デバイスの物理ボタン又は前記ハンドヘルド電子デバイスのタッチスクリーンに表示される仮想ボタンの押下を示す信号の存在を検出することを更に含む、

請求項1に記載の方法。 - 前記所定の条件は、前記モーションベースのジェスチャの開始時に、前記物理ボタン又は前記仮想ボタンの押下を示す前記信号の存在を検出することを含む、

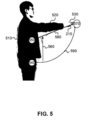

請求項3に記載の方法。 - 前記モーションベースのジェスチャが前記所定のモーションベースのジェスチャであることを認識することは、前記1つ以上の運動センサによって生成された、上向きの弧を描く動きによる第1位置から第2位置への前記ハンドヘルド電子デバイスの移動を示す信号を認識することを含み、前記第1位置は、ユーザの腰に近く、下方を向いている前記ハンドヘルド電子デバイスに対応し、前記第2位置は、伸ばした腕の端に保持され、前記第2デバイスの方を向いている前記ハンドヘルド電子デバイスに対応する、

請求項1に記載の方法。 - ハンドヘルド電子デバイスであって、

当該ハンドヘルド電子デバイスの動きを示す信号を生成するように構成される1つ以上の運動センサと、

処理エレクトロニクスであって、

前記1つ以上の運動センサによって生成された前記信号に基づいて、当該ハンドヘルド電子デバイスの動きを感知し、

前記感知された動きが、当該ハンドヘルド電子デバイスの移動を含むモーションベースのジェスチャであることを認識し、

前記1つ以上の運動センサ、当該ハンドヘルド電子デバイスの1つ以上の他の構成要素又はそれらの組合せからの更なる信号に基づいて、第2デバイスを識別し、ここで、前記更なる信号は、当該ハンドヘルド電子デバイスが前記モーションベースのジェスチャの終わりに指している方向を示し、

所定の条件が満たされ、かつ前記第2デバイスが識別された後に、前記第2デバイスとリモートに対話するためのユーザ対話を開始し、ここで、前記所定の条件は、前記認識されたモーションベースのジェスチャが、前記第2デバイスと対話するための所定のモーションベースのジェスチャであるときに少なくとも部分的に満たされる、

ように構成される処理エレクトロニクスと、

を備え、前記第2デバイスを識別することは、前記第2デバイスが識別されたことを示すフィードバックを提供することを含み、前記所定の条件は、前記フィードバックに応答するユーザからの確認入力を認識することを更に含み、前記確認入力を認識することは、

(i)前記感知された動きが、前記所定のモーションベースのジェスチャに続く、当該ハンドヘルド電子デバイスの移動を含む第2の所定のモーションベースのジェスチャを更に含むことを認識することと、

(ii)前記1つ以上の運動センサ及び前記処理エレクトロニクスを使用して、当該ハンドヘルド電子デバイスが所定の位置で回転されることを認識することと、

(iii)前記1つ以上の運動センサ及び前記処理エレクトロニクスを使用して、前記所定のモーションベースのジェスチャに続いて、所定の時間の間、更なる動きなしに、当該ハンドヘルド電子デバイスが所定の場所に保持されることを認識することと、

のうちの少なくとも1つを含む、ハンドヘルド処理デバイス。 - 前記モーションベースのジェスチャが所定のモーションベースのジェスチャであることを認識した後、前記第2デバイスが識別された後、前記確認入力を検出する前に、前記第2デバイスと対話する意図を確認するために前記確認入力を提供するように前記ユーザに促すように更に構成される、

請求項6に記載のハンドヘルド処理デバイス。 - 前記所定の条件は、当該ハンドヘルド電子デバイスの物理ボタン又は当該ハンドヘルド電子デバイスのタッチスクリーンに表示される仮想ボタンの押下を示す信号の存在を検出することを更に含む、

請求項6に記載のハンドヘルド処理デバイス。 - 前記所定の条件は、前記モーションベースのジェスチャの開始時に、前記物理ボタン又は前記仮想ボタンの押下を示す前記信号の存在を検出することを含む、

請求項8に記載のハンドヘルド処理デバイス。 - ハンドヘルド電子デバイスのプロセッサによって実行されると、前記ハンドヘルド電子デバイスに請求項1に記載の方法を実行させる命令を含む、コンピュータ読取可能媒体。

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/CN2020/107405 WO2022027435A1 (en) | 2020-08-06 | 2020-08-06 | Activating cross-device interaction with pointing gesture recognition |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2023537028A JP2023537028A (ja) | 2023-08-30 |

| JP7640672B2 true JP7640672B2 (ja) | 2025-03-05 |

Family

ID=80118801

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2023508055A Active JP7640672B2 (ja) | 2020-08-06 | 2020-08-06 | ポインティングジェスチャ認識を用いるクロスデバイス対話のアクティブ化 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US20230038499A1 (ja) |

| EP (1) | EP4185939A4 (ja) |

| JP (1) | JP7640672B2 (ja) |

| CN (1) | CN115812188B (ja) |

| WO (1) | WO2022027435A1 (ja) |

Families Citing this family (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2023106640A1 (ko) | 2021-12-10 | 2023-06-15 | 삼성전자주식회사 | 전자 장치 및 상기 전자 장치에서 제스처의 오인식을 방지하는 방법 |

| WO2025203058A1 (en) * | 2024-03-28 | 2025-10-02 | Ultrahuman Healthcare Pvt Ltd | Wearable device for 3d positional tracking and gesture recognition |

Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20110312311A1 (en) | 2010-06-16 | 2011-12-22 | Qualcomm Incorporated | Methods and apparatuses for gesture based remote control |

| JP2013506385A (ja) | 2009-10-02 | 2013-02-21 | クアルコム,インコーポレイテッド | ファイル共有機能のための、デバイス移動ユーザインターフェイスジェスチャ |

| US20150346834A1 (en) | 2014-06-02 | 2015-12-03 | Samsung Electronics Co., Ltd. | Wearable device and control method using gestures |

| JP2016504652A (ja) | 2012-11-12 | 2016-02-12 | オブロング・インダストリーズ・インコーポレーテッド | ジェスチャ制御と、複数クライアント装置、ディスプレイ、及び、ユーザを有する動作環境 |

| JP2017516242A (ja) | 2015-02-26 | 2017-06-15 | シャオミ・インコーポレイテッド | スマート機器の操作制御方法、装置、プログラム及び記憶媒体 |

| JP2018045313A (ja) | 2016-09-12 | 2018-03-22 | マクセルホールディングス株式会社 | テレビ受像器の操作システム、操作装置、および、テレビ受像器 |

| JP2019510296A (ja) | 2016-02-04 | 2019-04-11 | アップル インコーポレイテッドApple Inc. | 無線測距に基づいた電子デバイスの制御及び情報の表示 |

| US20200104038A1 (en) | 2018-09-28 | 2020-04-02 | Apple Inc. | System and method of controlling devices using motion gestures |

Family Cites Families (20)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8031172B2 (en) * | 2007-10-12 | 2011-10-04 | Immersion Corporation | Method and apparatus for wearable remote interface device |

| CN101344816B (zh) * | 2008-08-15 | 2010-08-11 | 华南理工大学 | 基于视线跟踪和手势识别的人机交互方法及装置 |

| RU2455676C2 (ru) * | 2011-07-04 | 2012-07-10 | Общество с ограниченной ответственностью "ТРИДИВИ" | Способ управления устройством с помощью жестов и 3d-сенсор для его осуществления |

| US9164579B2 (en) * | 2011-11-15 | 2015-10-20 | Lg Electronics Inc. | Electronic device for granting authority based on context awareness information |

| US9746926B2 (en) * | 2012-12-26 | 2017-08-29 | Intel Corporation | Techniques for gesture-based initiation of inter-device wireless connections |

| KR102124178B1 (ko) * | 2013-06-17 | 2020-06-17 | 삼성전자주식회사 | 웨어러블 기기 및 웨어러블 기기를 이용한 통신 방법 |

| CN103581174B (zh) * | 2013-10-15 | 2014-11-12 | 国家电网公司 | 一种手持机与服务器信息交互装置 |

| CN105528057B (zh) * | 2014-09-28 | 2019-01-15 | 联想(北京)有限公司 | 控制响应方法和电子设备 |

| CN105807903A (zh) * | 2014-12-30 | 2016-07-27 | Tcl集团股份有限公司 | 一种智能设备的控制方法及装置 |

| US20170083101A1 (en) | 2015-09-17 | 2017-03-23 | International Business Machines Corporation | Gesture recognition data transfer |

| US10295972B2 (en) * | 2016-04-29 | 2019-05-21 | Brain Corporation | Systems and methods to operate controllable devices with gestures and/or noises |

| WO2017218363A1 (en) | 2016-06-17 | 2017-12-21 | Pcms Holdings, Inc. | Method and system for selecting iot devices using sequential point and nudge gestures |

| WO2018023042A1 (en) | 2016-07-29 | 2018-02-01 | Pcms Holdings, Inc. | Method and system for creating invisible real-world links to computer-aided tasks with camera |

| EP3538975B1 (en) * | 2017-02-17 | 2023-01-04 | Samsung Electronics Co., Ltd. | Electronic device and methods for determining orientation of the device |

| US10453451B2 (en) * | 2017-07-05 | 2019-10-22 | Comcast Cable Communications, Llc | Methods and systems for using voice to control multiple devices |

| US10586434B1 (en) | 2017-10-25 | 2020-03-10 | Amazon Technologies, Inc. | Preventing unauthorized access to audio/video recording and communication devices |

| WO2020086692A1 (en) * | 2018-10-23 | 2020-04-30 | Exciting Technology LLC | System, method and apparatus for non-mechanical optical and photonic beam steering |

| WO2020139413A1 (en) * | 2018-12-27 | 2020-07-02 | Google Llc | Expanding physical motion gesture lexicon for an automated assistant |

| US10852915B1 (en) * | 2019-05-06 | 2020-12-01 | Apple Inc. | User interfaces for sharing content with other electronic devices |

| US11410541B1 (en) * | 2020-06-22 | 2022-08-09 | Amazon Technologies, Inc. | Gesture-based selection of devices |

-

2020

- 2020-08-06 JP JP2023508055A patent/JP7640672B2/ja active Active

- 2020-08-06 WO PCT/CN2020/107405 patent/WO2022027435A1/en not_active Ceased

- 2020-08-06 EP EP20948629.9A patent/EP4185939A4/en active Pending

- 2020-08-06 CN CN202080103011.6A patent/CN115812188B/zh active Active

-

2022

- 2022-10-14 US US17/966,332 patent/US20230038499A1/en active Pending

Patent Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2013506385A (ja) | 2009-10-02 | 2013-02-21 | クアルコム,インコーポレイテッド | ファイル共有機能のための、デバイス移動ユーザインターフェイスジェスチャ |

| US20110312311A1 (en) | 2010-06-16 | 2011-12-22 | Qualcomm Incorporated | Methods and apparatuses for gesture based remote control |

| JP2013532338A (ja) | 2010-06-16 | 2013-08-15 | クアルコム,インコーポレイテッド | ジェスチャーベースの遠隔制御のための方法および装置 |

| JP2016504652A (ja) | 2012-11-12 | 2016-02-12 | オブロング・インダストリーズ・インコーポレーテッド | ジェスチャ制御と、複数クライアント装置、ディスプレイ、及び、ユーザを有する動作環境 |

| US20150346834A1 (en) | 2014-06-02 | 2015-12-03 | Samsung Electronics Co., Ltd. | Wearable device and control method using gestures |

| JP2017516242A (ja) | 2015-02-26 | 2017-06-15 | シャオミ・インコーポレイテッド | スマート機器の操作制御方法、装置、プログラム及び記憶媒体 |

| JP2019510296A (ja) | 2016-02-04 | 2019-04-11 | アップル インコーポレイテッドApple Inc. | 無線測距に基づいた電子デバイスの制御及び情報の表示 |

| JP2018045313A (ja) | 2016-09-12 | 2018-03-22 | マクセルホールディングス株式会社 | テレビ受像器の操作システム、操作装置、および、テレビ受像器 |

| US20200104038A1 (en) | 2018-09-28 | 2020-04-02 | Apple Inc. | System and method of controlling devices using motion gestures |

Also Published As

| Publication number | Publication date |

|---|---|

| CN115812188B (zh) | 2026-04-21 |

| EP4185939A4 (en) | 2023-08-30 |

| CN115812188A (zh) | 2023-03-17 |

| JP2023537028A (ja) | 2023-08-30 |

| EP4185939A1 (en) | 2023-05-31 |

| US20230038499A1 (en) | 2023-02-09 |

| WO2022027435A1 (en) | 2022-02-10 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US10222868B2 (en) | Wearable device and control method using gestures | |

| KR102181588B1 (ko) | 동작-음성의 다중 모드 명령에 기반한 최적 제어 방법 및 이를 적용한 전자 장치 | |

| US10983603B2 (en) | Devices and methods for generating input | |

| CN106104424B (zh) | 可训练的基于传感器的姿势识别 | |

| EP3007030B1 (en) | Portable device and control method via gestures | |

| US10599823B2 (en) | Systems and methods for coordinating applications with a user interface | |

| US20070139370A1 (en) | Motion recognition system and method for controlling electronic devices | |

| CN109828672B (zh) | 一种用于确定智能设备的人机交互信息的方法与设备 | |

| EP2815292A1 (en) | Engagement-dependent gesture recognition | |

| KR100916836B1 (ko) | 지시형 제스처를 인식하는 방법 및 장치 | |

| CN113569635B (zh) | 一种手势识别方法及系统 | |

| US20230038499A1 (en) | Activating cross-device interaction with pointing gesture recognition | |

| CN105930072A (zh) | 电子设备和电子设备的控制方法 | |

| CN111670004B (zh) | 用于测量心率的电子装置和方法 | |

| KR20230012368A (ko) | 청소 로봇을 제어하는 전자 장치 및 그 동작 방법 | |

| EP4505277A1 (en) | Gesture-based application invocation | |

| WO2024220086A1 (en) | Smart home platform integrating gestural control with context determination | |

| US20150077322A1 (en) | Translation and scale invariant features for gesture recognition | |

| KR102794335B1 (ko) | 전자 장치 및 이의 제어 방법 | |

| US20250172999A1 (en) | Pinch state detection system and methods | |

| US20260072586A1 (en) | Viewfinder in head-wearable device display | |

| US20260064188A1 (en) | System status user interface for extended reality | |

| US11295172B1 (en) | Object detection in non-perspective images |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20230327 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20230327 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20240327 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20240402 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20240621 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20240820 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20241216 |

|

| A911 | Transfer to examiner for re-examination before appeal (zenchi) |

Free format text: JAPANESE INTERMEDIATE CODE: A911 Effective date: 20241224 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20250121 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20250220 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7640672 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |