JP6476608B2 - 動作処理装置、動作処理方法及びプログラム - Google Patents

動作処理装置、動作処理方法及びプログラム Download PDFInfo

- Publication number

- JP6476608B2 JP6476608B2 JP2014133722A JP2014133722A JP6476608B2 JP 6476608 B2 JP6476608 B2 JP 6476608B2 JP 2014133722 A JP2014133722 A JP 2014133722A JP 2014133722 A JP2014133722 A JP 2014133722A JP 6476608 B2 JP6476608 B2 JP 6476608B2

- Authority

- JP

- Japan

- Prior art keywords

- face

- unit

- main part

- image

- feature

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/174—Facial expression recognition

- G06V40/176—Dynamic expression

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/168—Feature extraction; Face representation

- G06V40/171—Local features and components; Facial parts ; Occluding parts, e.g. glasses; Geometrical relationships

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/178—Human faces, e.g. facial parts, sketches or expressions estimating age from face image; using age information for improving recognition

Description

このようなバーチャルマネキンの顔の表情を豊かにするために、写真やイラストや漫画などの画像中の顔を構成する主要部(例えば、目や口等)を変形させて動きを表現する技術が知られている。具体的には、意識的な動作や無意識的な動作を行うように3次元形状モデルを変形してアニメーションを生成する手法(例えば、特許文献2参照)や、発音される言葉の母音や子音毎に口の形状を変えてリップシンクさせる手法(例えば、特許文献3参照)などがある。

一方、例えば、顔領域の大きさと、顔領域に対する主要部の大きさから当該主要部の変形量等の動作態様を決定する手法も考えられるが、主要部を一律的に変形させると、不自然な変形を招いて視認者に違和感を生じさせてしまうといった問題がある。

顔を含む画像から顔に関連する特徴を検出する検出手段と、

前記検出手段による検出結果に基づいて、前記画像に含まれる顔を有する物体の特徴を特定する特定手段と、

前記特定手段により特定された前記物体の特徴に基づいて、前記画像に含まれる顔を構成する主要部を変形させて動作させる際の動作速度を含む制御条件を設定する設定手段と、

を備えたことを特徴としている。

図1は、本発明を適用した一実施形態の動作処理装置100の概略構成を示すブロック図である。

また、中央制御部1、メモリ2、記憶部3、動作処理部5及び表示制御部7は、バスライン8を介して接続されている。

具体的には、中央制御部1は、動作処理装置100の各部を制御するCPU(Central Processing Unit;図示略)、RAM(Random Access Memory)、ROM(Read Only Memory)を備え、動作処理装置100用の各種処理プログラム(図示略)に従って各種の制御動作を行う。

顔画像データ3aは、顔を含む二次元の顔画像のデータである。また、顔画像データ3aは、少なくとも顔を含む画像の画像データであれば良く、例えば、顔のみの画像データであっても良いし、胸から上の部分の画像データであっても良い。また、顔画像は、例えば、写真画像であっても良いし、漫画やイラスト等で描かれたものであっても良い。

なお、顔画像データ3aに係る顔画像は、一例であってこれらに限られるものではなく、適宜任意に変更可能である。

基準動作データ3bは、顔の各主要部(例えば、目、口等)の動きを表現する際の基準となる動きを示す情報を含んでいる。具体的には、基準動作データ3bは、各主要部毎に規定され、所定空間内における複数の制御点の動きを示す情報を含み、例えば、複数の制御点の所定空間での位置座標(x, y)を示す情報や変形ベクトル等が時間軸に沿って並べられている。

すなわち、例えば、口の基準動作データ3bは、上唇や下唇や左右の口角に対応する複数の制御点が設定され、これら制御点の変形ベクトルが規定されている。

条件設定用テーブル3cは、顔動作処理における制御条件の設定に用いられるテーブルである。具体的には、条件設定用テーブル3cは、各主要部毎に規定されている。また、条件設定用テーブル3cは、物体の特徴(例えば、笑顔度、年齢、性別、人種等)毎に規定され、特徴の内容(例えば、笑顔度等)と動き基準データの補正度合(例えば、口の開閉動作における開閉量の補正度合等)とが対応付けられている。

なお、動作処理部5の各部は、例えば、所定のロジック回路から構成されているが、当該構成は一例であってこれに限られるものではない。

すなわち、画像取得部(取得手段)5aは、顔動作処理の処理対象となる顔を含む二次元の画像の顔画像データ3aを取得する。具体的には、画像取得部5aは、例えば、記憶部3に記憶されている所定数の顔画像データ3aの中で、ユーザによる操作入力部4の所定操作に基づいて指定されたユーザ所望の顔画像データ3aを顔動作処理の処理対象として取得する。

なお、画像取得部5aは、図示しない通信制御部を介して接続された外部機器(図示略)から顔画像データを取得しても良いし、図示しない撮像部により撮像されることで生成された顔画像データを取得しても良い。

すなわち、顔主要部検出部5bは、画像取得部5aにより取得された顔画像データの顔画像から、例えば、AAM(Active Appearance Model)を用いた処理により、左右各々の目、鼻、口、眉、顔輪郭等の主要部を検出する。

ここで、AAMとは、視覚的事象のモデル化の一手法であり、任意の顔領域の画像のモデル化を行う処理である。例えば、顔主要部検出部5bは、複数のサンプル顔画像における所定の特徴部位(例えば、目尻や鼻頭やフェイスライン等)の位置や画素値(例えば、輝度値)の統計的分析結果を所定の登録手段に登録しておく。そして、顔主要部検出部5bは、上記の特徴部位の位置を基準として、顔の形状を表す形状モデルや平均的な形状における「Appearance」を表すテクスチャーモデルを設定し、これらのモデルを用いて顔画像をモデル化する。これにより、顔画像内で、例えば、目、鼻、口、眉、顔輪郭等の主要部がモデル化される。

なお、主要部の検出においてAAMを用いて行うようにしたが、一例であってこれに限られるものではなく、例えば、エッジ抽出処理、非等方拡散処理、テンプレートマッチング等適宜任意に変更可能である。

すなわち、顔特徴検出部(検出手段)5cは、画像取得部5aにより取得された顔画像から顔に関連する特徴を検出する。

ここで、顔に関連する特徴とは、例えば、顔を構成する主要部の特徴等の直接的に顔に関連する特徴であっても良いし、顔を有する物体の特徴等の間接的に顔に関連する特徴であっても良い。

例えば、顔特徴検出部5cは、顔主要部検出部5bにより主要部として検出された口の左右の口角の上がり具合いや口の開き具合い等の口の特徴や、目の黒目(虹彩領域)の顔全体に対する大きさ等の目の特徴等に応じて所定の演算を行うことで、処理対象の顔画像に含まれる顔の笑顔の評価値を算出する。

また、例えば、顔特徴検出部5cは、処理対象となる顔画像の色彩や明度の平均や分散、強度分布、周囲画像との色彩差や明度差などの特徴量を抽出し、当該特徴量から公知の推定理論(例えば、特開2007−280291号公報参照)を適用して、顔を有する物体の年齢、性別、人種等の評価値をそれぞれ算出する。また、年齢の評価値を算出する場合に、顔特徴検出部5cは、顔の皺等を考慮しても良い。

また、顔に関連する特徴として例示した笑顔、年齢、性別、人種等は、一例であってこれに限られるものではなく、適宜任意に変更可能である。例えば、顔画像データとして、眼鏡や帽子等を装着したヒトの顔の画像データを処理対象とした場合には、これらの装着物を顔に関連する特徴としても良いし、また、胸から上の部分の画像データを処理対象とした場合には、服装の特徴を顔に関連する特徴としても良いし、また、女性の場合には、顔の化粧についても顔に関連する特徴としても良い。

すなわち、特徴特定部(特定手段)5cは、顔特徴検出部5cによる検出結果に基づいて、顔画像に含まれる顔を有する物体(例えば、ヒト)の特徴を特定する。

ここで、物体の特徴としては、例えば、当該物体の笑顔度、年齢、性別、人種等が挙げられ、物体特徴特定部5dは、これらの中で少なくとも何れか一を特定する。

また、例えば、年齢の場合、物体特徴特定部5dは、顔特徴検出部5cにより検出された年齢の評価値と複数の閾値とを比較して、例えば、10代、20代、30代などの年齢層や幼児、少年、青年、成年、老人などの該当年齢の属する区分等を特定する。

また、例えば、性別の場合、物体特徴特定部5dは、顔特徴検出部5cにより検出された性別の評価値と所定の閾値とを比較して、例えば、女性、男性等を特定する。

また、例えば、人種の場合、物体特徴特定部5dは、顔特徴検出部5cにより検出された人種の評価値と複数の閾値とを比較して、例えば、コーカソイド(白人)、モンゴロイド(黄色人)、ニグロイド(黒人)等を特定する。また、物体特徴特定部5dは、特定された人種から出生地(国や地域)などを推定して特定しても良い。

すなわち、動作条件設定部(設定手段)5fは、物体特徴特定部5dにより特定された物体の特徴に基づいて、顔主要部検出部5bにより検出された主要部を動作させる際の制御条件を設定する。

具体的には、動作条件設定部5eは、顔主要部検出部5bにより検出された主要部の動作態様(例えば、動作速度や動作方向等)を調整する条件を制御条件として設定する。すなわち、例えば、動作条件設定部5eは、記憶部3から処理対象となる主要部の基準動作データ3bを読み出して取得し、物体特徴特定部5dにより特定された物体の特徴に基づいて、基準動作データ3bに含まれる当該主要部を動作させるための複数の制御点の動きを示す情報の補正内容を制御条件として設定する。このとき、動作条件設定部5eは、顔主要部検出部5bにより検出された主要部を含む顔全体の動作態様(例えば、動作速度や動作方向等)を調整する条件を制御条件として設定しても良い。この場合、動作条件設定部5eは、例えば、顔の全ての主要部に対応する基準動作データ3bを取得して、これらの基準動作データ3bに含まれる各主要部に対応する複数の制御点の動きを示す情報の補正内容を設定する。

具体的には、例えば、物体特徴特定部5dにより物体の特徴として笑顔度が特定された場合、動作条件設定部5eは、笑顔度が高いほど口の開閉量が相対的に大きくなるように(図4(a)参照)、基準動作データ3bに含まれる上唇や下唇に対応する複数の制御点の動きを示す情報の補正内容を設定する。

また、例えば、物体特徴特定部5dにより物体の特徴として年齢が特定された場合、動作条件設定部5eは、年齢の属する区分に従って、年齢(年齢層)が高いほど口の開閉量が相対的に小さくなるように(図4(b)参照)、基準動作データ3bに含まれる上唇や下唇に対応する複数の制御点の動きを示す情報の補正内容を設定する。このとき、動作条件設定部5eは、年齢が高いほど顔の表情を変化させる際の動作速度が相対的に遅くなるように、例えば、顔の全ての主要部に対応する基準動作データ3bに含まれる複数の制御点の動きを示す情報の補正内容をそれぞれ設定する。

また、例えば、物体特徴特定部5dにより物体の特徴として性別が特定された場合、動作条件設定部5eは、女性の場合には口の開閉量が相対的に小さくなるように、一方、男性の場合には口の開閉量が相対的に大きくなるように、基準動作データ3bに含まれる上唇や下唇に対応する複数の制御点の動きを示す情報の補正内容を設定する。

また、例えば、物体特徴特定部5dにより物体の特徴として出生地が推定されて特定された場合、動作条件設定部5eは、出生地に応じて口の開閉量を変化させる(例えば、英語圏の場合には口の開閉量が相対的に大きく、また、日本語圏の場合には口の開閉量が相対的に小さくなる等)ように、基準動作データ3bに含まれる上唇や下唇に対応する複数の制御点の動きを示す情報の補正内容を設定する。このとき、出生地毎に複数の基準動作データ3bを用意しておき、動作条件設定部5eは、出生地に応じた基準動作データ3bを取得して、当該基準動作データ3bに含まれる上唇や下唇に対応する複数の制御点の動きを示す情報の補正内容を設定しても良い。

また、上記した口を動作させる際の制御内容は、一例であってこれに限られるものではなく、適宜任意に変更可能である。

さらに、主要部として口を例示して、その制御条件を設定するようにしたが、一例であってこれに限られるものではなく、例えば、目、鼻、眉、顔輪郭等の他の主要部であっても良い。このとき、例えば、口を動作させる際の制御条件を考慮して、他の主要部の制御条件を設定するようにしても良い。すなわち、例えば、口を開閉動作させる際の制御条件を考慮して、鼻や顔輪郭等の口の周辺の主要部を関連して動作させるような制御条件を設定しても良い。

具体的には、動作生成部5fは、処理対象となる主要部の基準動作データ3bと、動作条件設定部5eにより設定された基準動作データ3bの補正内容とに基づいて、複数の制御点の動きを示す情報を補正して、補正後のデータを当該主要部の動作データとして生成する。また、顔全体の動作態様を調整する場合、動作条件設定部5eは、例えば、顔の全ての主要部に対応する基準動作データ3bを取得して、動作条件設定部5eにより設定された基準動作データ3bの補正内容に基づいて、各基準動作データ3b毎に複数の制御点の動きを示す情報を補正して、補正後のデータを顔全体用の動作データとして生成する。

なお、動作生成部5fにより生成された動作データは、所定の格納手段(例えば、メモリ2等)に出力されて一時的に格納されても良い。

すなわち、動作制御部(動作制御手段)5hは、画像取得部5aにより取得された顔画像内で、動作条件設定部5eにより設定された制御条件に従って主要部を動作させる。具体的には、動作制御部5gは、処理対象となる主要部の所定位置に複数の制御点を設定するとともに、動作生成部5fにより生成された処理対象となる主要部の動作データを取得する。そして、動作制御部5gは、取得された動作データに規定されている複数の制御点の動きを示す情報に基づいて複数の制御点を変位させることで、当該主要部を動作させる変形処理を行う。

また、顔全体を動作させる場合にも、上記と略同様に、動作制御部5gは、処理対象となる全ての主要部の所定位置に複数の制御点を設定するとともに、動作生成部5fにより生成された顔全体用の動作データを取得する。そして、動作制御部5gは、取得された動作データに規定されている各主要部毎の複数の制御点の動きを示す情報に基づいて複数の制御点を変位させることで、顔全体を動作させる変形処理を行う。

具体的には、表示制御部7は、例えば、GPU(Graphics Processing Unit)やVRAM(Video Random Access Memory)等を具備するビデオカード(図示略)を備えている。そして、表示制御部7は、中央制御部1からの表示指示に従って、顔動作処理にて主要部を動作させるための各種画面の表示用データをビデオカードによる描画処理によって生成し、表示部6に出力する。これにより、表示部6は、例えば、顔動作処理にて顔画像の主要部(例えば、目や口等)を動作させたり顔の表情を変化させるように変形させたコンテンツを表示する。

<顔動作処理>

次に、顔動作処理について図2〜図4を参照して説明する。

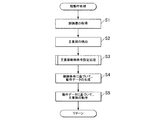

図2は、顔動作処理に係る動作の一例を示すフローチャートである。

次に、顔主要部検出部5bは、画像取得部5aにより取得された顔画像データの顔画像から、例えば、AAMを用いた処理により、左右各々の目、鼻、口、眉、顔輪郭等の主要部を検出する(ステップS2)。

例えば、動作生成部5fは、主要部制御条件設定処理にて設定された制御条件に基づいて、目や口等の主要部を動作させるための動作データを生成し、動作制御部5gは、動作生成部5fにより生成された動作データに規定されている各主要部の複数の制御点の動きを示す情報に基づいて複数の制御点を変位させることで、顔画像内で目や口等の主要部を動作させたり、顔全体を動作させて表情を変化させる処理を行う。

次に、主要部制御条件設定処理について図3及び図4を参照して説明する。

図3は、主要部制御条件設定処理に係る動作の一例を示すフローチャートである。また、図4(a)及び図4(b)は、主要部制御条件設定処理を説明するための図である。

次に、顔特徴検出部5cは、画像取得部5aにより取得された顔画像から顔に関連する特徴を検出する(ステップS12)。例えば、顔特徴検出部5cは、口の左右の口角の上がり具合いや口の開き具合い等に応じて所定の演算を行って顔の笑顔の評価値を算出したり、顔画像から特徴量を抽出し、当該特徴量から公知の推定理論を適用して物体(例えば、ヒト)の年齢、性別、人種等の評価値をそれぞれ算出する。

ここで、笑顔の評価値の信頼性が高いと判定されると(ステップS13;YES)、物体特徴特定部5dは、顔特徴検出部5cによる笑顔の検出結果に基づいて、顔画像に含まれる顔を有する物体の笑顔度を特定する(ステップS14)。例えば、物体特徴特定部5dは、顔特徴検出部5cにより検出された笑顔の評価値と複数の閾値とを比較して、笑顔度を相対的に評価して特定する。

そして、動作条件設定部5eは、物体特徴特定部5dにより特定された笑顔度が高いほど口の開閉量が相対的に大きくなるように(図4(a)参照)、基準動作データ3bに含まれる上唇や下唇に対応する複数の制御点の動きを示す情報の補正内容を制御条件として設定する(ステップS15)。

ここで、年齢の評価値の信頼性が高いと判定されると(ステップS16;YES)、物体特徴特定部5dは、顔特徴検出部5cによる年齢の検出結果に基づいて、顔画像に含まれる顔を有する物体の年齢の属する区分を特定する(ステップS17)。例えば、物体特徴特定部5dは、顔特徴検出部5cにより検出された年齢の評価値と複数の閾値とを比較して、幼児、少年、青年、成年、老人などの該当年齢の属する区分を特定する。

そして、動作条件設定部5eは、物体特徴特定部5dにより特定された区分に従って、年齢が高いほど口の開閉量が相対的に小さくなるように(図4(b)参照)、基準動作データ3bに含まれる上唇や下唇に対応する複数の制御点の動きを示す情報の補正内容を制御条件として設定するとともに、顔の表情を変化させる際の動作速度が相対的に遅くなるように、顔の全ての主要部に対応する複数の制御点の動きを示す情報の補正内容を制御条件として設定する(ステップS18)。

ここで、性別の評価値の信頼性が高いと判定されると(ステップS19;YES)、物体特徴特定部5dは、顔特徴検出部5cによる性別の検出結果に基づいて、顔画像に含まれる顔を有する物体の女性、男性等の性別を特定する(ステップS20)。

そして、動作条件設定部5eは、物体特徴特定部5dにより特定された性別に従って、女性の場合には口の開閉量が相対的に小さくなるように、一方、男性の場合には口の開閉量が相対的に大きくなるように、基準動作データ3bに含まれる上唇や下唇に対応する複数の制御点の動きを示す情報の補正内容を制御条件として設定する(ステップS21)。

ここで、人種の評価値の信頼性が高いと判定されると(ステップS22;YES)、物体特徴特定部5dは、顔特徴検出部5cによる人種の検出結果に基づいて、顔画像に含まれる顔を有する物体の出生地を推定する(ステップS23)。例えば、物体特徴特定部5dは、顔特徴検出部5cにより検出された人種の評価値と複数の閾値とを比較して、例えば、コーカソイド、モンゴロイド、ニグロイド等を特定し、その特定結果から出生地(国や地域)を推定して特定する。

そして、動作条件設定部5eは、物体特徴特定部5dにより特定された出生地に従って、例えば、英語圏の場合には口の開閉量が相対的に大きく、また、日本語圏の場合には口の開閉量が相対的に小さくなるように、基準動作データ3bに含まれる上唇や下唇に対応する複数の制御点の動きを示す情報の補正内容を制御条件として設定する(ステップS24)。

また、上記実施形態にあっては、動作処理装置100単体から構成するようにしたが、一例であってこれに限られるものではなく、例えば、人物、キャラクタ、動物等の投影対象物が商品等の説明を行う映像コンテンツをスクリーンに投影する投影システム(図示略)に適用した構成であっても良い。

すなわち、例えば、年齢層が多岐にわたる様々なモデルの画像を切り替えながら当該モデルの顔の主要部を動作させる場合等には、年齢に対応する制御条件に大きな重みを与えるようにすることで、モデルの年齢による違いをさらに強調させることができる。

また、動作条件設定部5eにより設定された制御条件に従って主要部や顔全体を動作させるようにしたが、一例であってこれに限られるものではなく、必ずしも動作制御部5gを具備する必要はなく、例えば、動作条件設定部5eにより設定された制御条件を外部機器(図示略)に出力して、当該外部機器にて制御条件に従って主要部や顔全体を動作させるようにしても良い。

すなわち、プログラムを記憶するプログラムメモリに、取得処理ルーチン、検出処理ルーチン、特定処理ルーチン、設定処理ルーチンを含むプログラムを記憶しておく。そして、取得処理ルーチンにより中央制御部1のCPUを、顔を含む画像を取得する手段として機能させるようにしても良い。また、検出処理ルーチンにより中央制御部1のCPUを、取得された顔を含む画像から顔に関連する特徴を検出する手段として機能させるようにしても良い。また、特定処理ルーチンにより中央制御部1のCPUを、顔に関連する特徴の検出結果に基づいて、画像に含まれる顔を有する物体の特徴を特定する手段として機能させるようにしても良い。また、設定処理ルーチンにより中央制御部1のCPUを、特定された物体の特徴に基づいて、画像に含まれる顔を構成する主要部を動作させる際の制御条件を設定する手段として機能させるようにしても良い。

以下に、この出願の願書に最初に添付した特許請求の範囲に記載した発明を付記する。付記に記載した請求項の項番は、この出願の願書に最初に添付した特許請求の範囲の通りである。

〔付記〕

<請求項1>

顔を含む画像を取得する取得手段と、

前記取得手段により取得された顔を含む画像から顔に関連する特徴を検出する検出手段と、

前記検出手段による検出結果に基づいて、前記画像に含まれる顔を有する物体の特徴を特定する特定手段と、

前記特定手段により特定された前記物体の特徴に基づいて、前記画像に含まれる顔を構成する主要部を動作させる際の制御条件を設定する設定手段と、

を備えたことを特徴とする動作処理装置。

<請求項2>

前記特定手段は、更に、前記物体の特徴として、当該物体の笑顔度、年齢、性別及び人種のうち、少なくとも何れか一を特定することを特徴とする請求項1に記載の動作処理装置。

<請求項3>

前記設定手段は、更に、前記主要部としての口を開閉動作させる際の制御条件を設定することを特徴とする請求項2に記載の動作処理装置。

<請求項4>

前記設定手段は、更に、前記制御条件として、前記主要部の動作態様を調整する条件を設定することを特徴とする請求項1〜3の何れか一項に記載の動作処理装置。

<請求項5>

前記取得手段により取得された顔を含む画像内で、前記設定手段により設定された制御条件に従って前記主要部を動作させる動作制御手段を更に備えることを特徴とする請求項1〜4の何れか一項に記載の動作処理装置。

<請求項6>

前記設定手段は、更に、前記主要部を含む顔の表情を変化させる際の制御条件を設定することを特徴とする請求項1又は2に記載の動作処理装置。

<請求項7>

前記設定手段は、更に、前記制御条件として、前記主要部を含む顔全体の動作態様を調整する条件を設定することを特徴とする請求項6に記載の動作処理装置。

<請求項8>

前記取得手段により取得された顔を含む画像内で、前記設定手段により設定された制御条件に従って前記主要部を含む顔全体を動作させる動作制御手段を更に備えることを特徴とする請求項6又は7に記載の動作処理装置。

<請求項9>

前記特定手段は、前記物体の特徴を複数特定し、

前記設定手段は、前記特定手段により特定された前記複数の物体の特徴の各々について前記制御条件の重み付けを行なう重み付け手段を含むことを特徴とする請求項1〜8の何れか一項に記載の動作処理装置。

<請求項10>

動作処理装置を用いた動作処理方法であって、

顔を含む画像を取得する処理と、

取得された顔を含む画像から顔に関連する特徴を検出する処理と、

顔に関連する特徴の検出結果に基づいて、画像に含まれる顔を有する物体の特徴を特定する処理と、

特定された前記物体の特徴に基づいて、前記画像に含まれる顔を構成する主要部を動作させる際の制御条件を設定する処理と、

を含むことを特徴とする動作処理方法。

<請求項11>

動作処理装置のコンピュータを、

顔を含む画像を取得する取得手段、

前記取得手段により取得された顔を含む画像から顔に関連する特徴を検出する検出手段、

前記検出手段による検出結果に基づいて、前記画像に含まれる顔を有する物体の特徴を特定する特定手段、

前記特定手段により特定された前記物体の特徴に基づいて、前記画像に含まれる顔を構成する主要部を動作させる際の制御条件を設定する設定手段、

として機能させることを特徴とするプログラム。

1 中央制御部

5 動作処理部

5a 画像取得部

5c 顔特徴検出部

5d 物体特徴特定部

5e 動作条件設定部

5g 動作制御部

Claims (11)

- 顔を含む画像から顔に関連する特徴を検出する検出手段と、

前記検出手段による検出結果に基づいて、前記画像に含まれる顔を有する物体の特徴を特定する特定手段と、

前記特定手段により特定された前記物体の特徴に基づいて、前記画像に含まれる顔を構成する主要部を変形させて動作させる際の動作速度を含む制御条件を設定する設定手段と、

を備えたことを特徴とする動作処理装置。 - 前記特定手段は、更に、前記物体の特徴として、当該物体の笑顔度、年齢、性別及び人種のうち、少なくとも何れか一を特定することを特徴とする請求項1に記載の動作処理装置。

- 前記設定手段は、更に、前記主要部としての口を開閉動作させる際の制御条件を設定することを特徴とする請求項2に記載の動作処理装置。

- 前記設定手段は、更に、前記制御条件として、前記主要部の動作態様を調整する条件を設定することを特徴とする請求項1〜3の何れか一項に記載の動作処理装置。

- 前記画像内で、前記設定手段により設定された制御条件に従って前記主要部を動作させる動作制御手段を更に備えることを特徴とする請求項1〜4の何れか一項に記載の動作処理装置。

- 前記設定手段は、更に、前記主要部を含む顔の表情を変化させる際の制御条件を設定することを特徴とする請求項1又は2に記載の動作処理装置。

- 前記設定手段は、更に、前記制御条件として、前記主要部を含む顔全体の動作態様を調整する条件を設定することを特徴とする請求項6に記載の動作処理装置。

- 前記画像内で、前記設定手段により設定された制御条件に従って前記主要部を含む顔全体を動作させる動作制御手段を更に備えることを特徴とする請求項6又は7に記載の動作処理装置。

- 前記特定手段は、前記物体の特徴を複数特定し、

前記設定手段は、前記特定手段により特定された前記複数の物体の特徴の各々について前記制御条件の重み付けを行なう重み付け手段を含むことを特徴とする請求項1〜8の何れか一項に記載の動作処理装置。 - 動作処理装置を用いた動作処理方法であって、

顔を含む画像から顔に関連する特徴を検出する処理と、

顔に関連する特徴の検出結果に基づいて、前記画像に含まれる顔を有する物体の特徴を特定する処理と、

特定された前記物体の特徴に基づいて、前記画像に含まれる顔を構成する主要部を変形させて動作させる際の動作速度を含む制御条件を設定する処理と、

を含むことを特徴とする動作処理方法。 - 動作処理装置のコンピュータを、

顔を含む画像から顔に関連する特徴を検出する検出手段、

前記検出手段による検出結果に基づいて、前記画像に含まれる顔を有する物体の特徴を特定する特定手段、

前記特定手段により特定された前記物体の特徴に基づいて、前記画像に含まれる顔を構成する主要部を変形させて動作させる際の動作速度を含む制御条件を設定する設定手段、

として機能させることを特徴とするプログラム。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2014133722A JP6476608B2 (ja) | 2014-06-30 | 2014-06-30 | 動作処理装置、動作処理方法及びプログラム |

| CN201510119359.5A CN105303596A (zh) | 2014-06-30 | 2015-03-18 | 动作处理装置及动作处理方法 |

| US14/666,288 US20150379329A1 (en) | 2014-06-30 | 2015-03-23 | Movement processing apparatus, movement processing method, and computer-readable medium |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2014133722A JP6476608B2 (ja) | 2014-06-30 | 2014-06-30 | 動作処理装置、動作処理方法及びプログラム |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2016012253A JP2016012253A (ja) | 2016-01-21 |

| JP2016012253A5 JP2016012253A5 (ja) | 2017-07-20 |

| JP6476608B2 true JP6476608B2 (ja) | 2019-03-06 |

Family

ID=54930883

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2014133722A Active JP6476608B2 (ja) | 2014-06-30 | 2014-06-30 | 動作処理装置、動作処理方法及びプログラム |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US20150379329A1 (ja) |

| JP (1) | JP6476608B2 (ja) |

| CN (1) | CN105303596A (ja) |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2017054241A (ja) * | 2015-09-08 | 2017-03-16 | 株式会社東芝 | 表示制御装置、方法及びプログラム |

| JP6753276B2 (ja) * | 2016-11-11 | 2020-09-09 | ソニー株式会社 | 情報処理装置、および情報処理方法、並びにプログラム |

| JP2023053734A (ja) * | 2021-10-01 | 2023-04-13 | パナソニックIpマネジメント株式会社 | 顔タイプ診断装置、顔タイプ診断方法及びプログラム |

Family Cites Families (12)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US6147692A (en) * | 1997-06-25 | 2000-11-14 | Haptek, Inc. | Method and apparatus for controlling transformation of two and three-dimensional images |

| WO1999054015A1 (en) * | 1998-04-16 | 1999-10-28 | Creator Ltd. | Interactive toy |

| US6545682B1 (en) * | 2000-05-24 | 2003-04-08 | There, Inc. | Method and apparatus for creating and customizing avatars using genetic paradigm |

| JP2004023225A (ja) * | 2002-06-13 | 2004-01-22 | Oki Electric Ind Co Ltd | 情報通信装置およびその信号生成方法、ならびに情報通信システムおよびそのデータ通信方法 |

| JP4760349B2 (ja) * | 2005-12-07 | 2011-08-31 | ソニー株式会社 | 画像処理装置および画像処理方法、並びに、プログラム |

| AU2009330607B2 (en) * | 2008-12-04 | 2015-04-09 | Cubic Corporation | System and methods for dynamically injecting expression information into an animated facial mesh |

| JP5361528B2 (ja) * | 2009-05-15 | 2013-12-04 | キヤノン株式会社 | 撮像装置およびプログラム |

| JP5423379B2 (ja) * | 2009-08-31 | 2014-02-19 | ソニー株式会社 | 画像処理装置および画像処理方法、並びにプログラム |

| JP2011053942A (ja) * | 2009-09-02 | 2011-03-17 | Seiko Epson Corp | 画像処理装置、画像処理方法および画像処理プログラム |

| TWI443601B (zh) * | 2009-12-16 | 2014-07-01 | Ind Tech Res Inst | 擬真臉部動畫系統及其方法 |

| KR20120005587A (ko) * | 2010-07-09 | 2012-01-17 | 삼성전자주식회사 | 컴퓨터 시스템에서 얼굴 애니메이션 생성 방법 및 장치 |

| EP2678820A4 (en) * | 2011-02-27 | 2014-12-03 | Affectiva Inc | VIDEO RECOMMENDATION BASED ON AN AFFECT |

-

2014

- 2014-06-30 JP JP2014133722A patent/JP6476608B2/ja active Active

-

2015

- 2015-03-18 CN CN201510119359.5A patent/CN105303596A/zh active Pending

- 2015-03-23 US US14/666,288 patent/US20150379329A1/en not_active Abandoned

Also Published As

| Publication number | Publication date |

|---|---|

| US20150379329A1 (en) | 2015-12-31 |

| JP2016012253A (ja) | 2016-01-21 |

| CN105303596A (zh) | 2016-02-03 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US10540757B1 (en) | Method and system for generating combined images utilizing image processing of multiple images | |

| WO2016161553A1 (en) | Avatar generation and animations | |

| CN107610202B (zh) | 人脸图像替换方法、设备及存储介质 | |

| CN107507217B (zh) | 证件照的制作方法、装置及存储介质 | |

| US20150262403A1 (en) | Makeup support apparatus and method for supporting makeup | |

| CN111435433B (zh) | 信息处理装置、信息处理方法以及存储介质 | |

| JP2018538593A (ja) | 表情検出機能を備えたヘッドマウントディスプレイ | |

| US11238569B2 (en) | Image processing method and apparatus, image device, and storage medium | |

| WO2022143645A1 (zh) | 三维人脸重建的方法、装置、设备和存储介质 | |

| US10558849B2 (en) | Depicted skin selection | |

| US11069089B2 (en) | Information processing apparatus, information processing method, and computer program product | |

| JP2009020761A (ja) | 画像処理装置及びその方法 | |

| US20140085330A1 (en) | Image processing device, image processing method, computer readable medium | |

| US11093030B2 (en) | Operation determination device and operation determination method | |

| JP5935849B2 (ja) | 画像処理装置、画像処理方法及びプログラム | |

| JP6476608B2 (ja) | 動作処理装置、動作処理方法及びプログラム | |

| JP6547244B2 (ja) | 動作処理装置、動作処理方法及びプログラム | |

| JP7273752B2 (ja) | 表情制御プログラム、記録媒体、表情制御装置、表情制御方法 | |

| KR20200071008A (ko) | 2차원 이미지 처리 방법 및 이 방법을 실행하는 디바이스 | |

| WO2024029600A1 (ja) | 肌状態推定方法 | |

| JP6390210B2 (ja) | 画像処理装置、画像処理方法及びプログラム | |

| KR102358145B1 (ko) | 표준 이미지 생성을 이용한 아이 얼굴 변환 방법 | |

| JP2024022462A (ja) | 肌状態推定方法 | |

| JP6326808B2 (ja) | 顔画像処理装置、投影システム、画像処理方法及びプログラム | |

| Brown et al. | Faster upper body pose estimation and recognition using cuda |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20170607 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20170607 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20180718 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20180724 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20180918 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20190108 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20190121 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6476608 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |