JP6023324B2 - 外科手術支援システム、外科手術支援装置、外科手術支援方法、外科手術支援プログラムおよび情報処理装置 - Google Patents

外科手術支援システム、外科手術支援装置、外科手術支援方法、外科手術支援プログラムおよび情報処理装置 Download PDFInfo

- Publication number

- JP6023324B2 JP6023324B2 JP2015522825A JP2015522825A JP6023324B2 JP 6023324 B2 JP6023324 B2 JP 6023324B2 JP 2015522825 A JP2015522825 A JP 2015522825A JP 2015522825 A JP2015522825 A JP 2015522825A JP 6023324 B2 JP6023324 B2 JP 6023324B2

- Authority

- JP

- Japan

- Prior art keywords

- bone

- marker

- data

- target bone

- target

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/20—Surgical navigation systems; Devices for tracking or guiding surgical instruments, e.g. for frameless stereotaxis

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B17/00—Surgical instruments, devices or methods, e.g. tourniquets

- A61B2017/00526—Methods of manufacturing

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/10—Computer-aided planning, simulation or modelling of surgical operations

- A61B2034/108—Computer aided selection or customisation of medical implants or cutting guides

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/20—Surgical navigation systems; Devices for tracking or guiding surgical instruments, e.g. for frameless stereotaxis

- A61B2034/2046—Tracking techniques

- A61B2034/2055—Optical tracking systems

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/20—Surgical navigation systems; Devices for tracking or guiding surgical instruments, e.g. for frameless stereotaxis

- A61B2034/2046—Tracking techniques

- A61B2034/2055—Optical tracking systems

- A61B2034/2057—Details of tracking cameras

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/20—Surgical navigation systems; Devices for tracking or guiding surgical instruments, e.g. for frameless stereotaxis

- A61B2034/2046—Tracking techniques

- A61B2034/2065—Tracking using image or pattern recognition

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B2090/364—Correlation of different images or relation of image positions in respect to the body

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B2090/364—Correlation of different images or relation of image positions in respect to the body

- A61B2090/365—Correlation of different images or relation of image positions in respect to the body augmented reality, i.e. correlating a live optical image with another image

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B2090/364—Correlation of different images or relation of image positions in respect to the body

- A61B2090/367—Correlation of different images or relation of image positions in respect to the body creating a 3D dataset from 2D images using position information

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B90/37—Surgical systems with images on a monitor during operation

- A61B2090/372—Details of monitor hardware

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/39—Markers, e.g. radio-opaque or breast lesions markers

- A61B2090/3983—Reference marker arrangements for use with image guided surgery

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/39—Markers, e.g. radio-opaque or breast lesions markers

- A61B2090/3991—Markers, e.g. radio-opaque or breast lesions markers having specific anchoring means to fixate the marker to the tissue, e.g. hooks

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/50—Supports for surgical instruments, e.g. articulated arms

- A61B2090/502—Headgear, e.g. helmet, spectacles

Description

外科手術を行なう対象骨の3次元データとマーカの位置データとを関連付けて記憶する記憶手段と、

前記対象骨のマーカを撮像する撮像手段と、

前記記憶手段に記憶されたデータを用いて、撮像された前記マーカの位置の変化に応じて前記対象骨の表示を変化させる表示手段と、

を備え、

前記記憶手段は、2つに分かれた手術対象骨の一方である第1対象骨の3次元データ、および前記第1対象骨と一部が重なる参照骨の3次元データを、前記第1対象骨に固定される第1マーカの位置データと関連付けて記憶し、前記2つに分かれた手術対象骨の他方である第2対象骨の3次元データを、前記第2対象骨に固定される第2マーカの位置データと関連付けて記憶し、

前記撮像手段は、前記第1対象骨に固定された前記第1マーカと前記第2対象骨に固定された前記第2マーカとを撮像し、

前記表示手段は、前記第2対象骨が前記参照骨の一部に重なるように、前記記憶手段に記憶されたデータを用いて、前記第1マーカと前記第2マーカとの相対位置の変化に応じて前記第1対象骨および前記第2対象骨の表示を変化させ、

前記参照骨の3次元データは、前記手術対象骨と左右対称位置に存在する非罹患骨の鏡像データである。

外科手術を行なう対象骨の3次元データとマーカの位置データとを関連付けて記憶する記憶手段と、

前記対象骨のマーカを撮像する撮像手段と、

前記記憶手段に記憶されたデータを用いて、撮像された前記マーカの位置の変化に応じて前記対象骨の表示を変化させる表示手段と、

を備え、

前記記憶手段は、2つに分かれた手術対象骨の一方である第1対象骨の3次元データ、および前記第1対象骨と一部が重なる参照骨の3次元データを、前記第1対象骨に固定される第1マーカの位置データと関連付けて記憶し、前記2つに分かれた手術対象骨の他方である第2対象骨の3次元データを、前記第2対象骨に固定される第2マーカの位置データと関連付けて記憶し、

前記撮像手段は、前記第1対象骨に固定された前記第1マーカと前記第2対象骨に固定された前記第2マーカとを撮像し、

前記表示手段は、前記第2対象骨が前記参照骨の一部に重なるように、前記記憶手段に記憶されたデータを用いて、前記第1マーカと前記第2マーカとの相対位置の変化に応じて前記第1対象骨および前記第2対象骨の表示を変化させ、

前記参照骨の3次元データは、前記手術対象骨と左右対称位置に存在する非罹患骨の鏡像データである。

外科手術を行なう対象骨の3次元データとマーカの位置データとを関連付けて記憶手段に記憶する記憶ステップと、

前記対象骨のマーカを撮像する撮像ステップと、

前記記憶手段に記憶されたデータを用いて、撮像された前記マーカの位置の変化に応じて前記対象骨の表示を変化させる表示ステップと、

を含み、

前記記憶ステップにおいては、2つに分かれた手術対象骨の一方である第1対象骨の3次元データ、および前記第1対象骨と一部が重なる参照骨の3次元データを、前記第1対象骨に固定される第1マーカの位置データと関連付けて前記記憶手段に記憶し、前記2つに分かれた手術対象骨の他方である第2対象骨の3次元データを、前記第2対象骨に固定される第2マーカの位置データと関連付けて前記記憶手段に記憶し、

前記撮像ステップにおいては、前記第1対象骨に固定された前記第1マーカと前記第2対象骨に固定された前記第2マーカとを撮像し、

前記表示ステップにおいては、前記第2対象骨が前記参照骨の一部に重なるように、前記記憶手段に記憶されたデータを用いて、前記第1マーカと前記第2マーカとの相対位置の変化に応じて前記第1対象骨および前記第2対象骨の表示を変化させ、

前記参照骨の3次元データは、前記手術対象骨と左右対称位置に存在する非罹患骨の鏡像データである。

外科手術を行なう対象骨の3次元データとマーカの位置データとを関連付けて記憶手段に記憶する記憶ステップと、

前記対象骨のマーカを撮像する撮像ステップと、

前記記憶手段に記憶されたデータを用いて、撮像された前記マーカの位置の変化に応じて前記対象骨の表示を変化させる表示ステップと、

をコンピュータに実行させる外科手術支援プログラムであって、

前記記憶ステップにおいては、2つに分かれた手術対象骨の一方である第1対象骨の3次元データ、および前記第1対象骨と一部が重なる参照骨の3次元データを、前記第1対象骨に固定される第1マーカの位置データと関連付けて前記記憶手段に記憶し、前記2つに分かれた手術対象骨の他方である第2対象骨の3次元データを、前記第2対象骨に固定される第2マーカの位置データと関連付けて前記記憶手段に記憶し、

前記撮像ステップにおいては、前記第1対象骨に固定された前記第1マーカと前記第2対象骨に固定された前記第2マーカとを撮像し、

前記表示ステップにおいては、前記第2対象骨が前記参照骨の一部に重なるように、前記記憶手段に記憶されたデータを用いて、前記第1マーカと前記第2マーカとの相対位置の変化に応じて前記第1対象骨および前記第2対象骨の表示を変化させ、

前記参照骨の3次元データは、前記手術対象骨と左右対称位置に存在する非罹患骨の鏡像データである。

外科手術を行なう対象骨の3次元データとマーカの位置データとを関連付けて記憶する記憶手段と、

撮像手段が撮像した前記対象骨のマーカの画像を前記撮像手段から受信する受信手段と、

前記記憶手段に記憶されたデータを用いて、撮像された前記マーカの位置の変化に応じて変化する前記対象骨の表示画像を生成する表示画像生成手段と、

を備え、

前記記憶手段は、2つに分かれた手術対象骨の一方である第1対象骨の3次元データ、および前記第1対象骨と一部が重なる参照骨の3次元データを、前記第1対象骨に固定される第1マーカの位置データと関連付けて記憶し、前記2つに分かれた手術対象骨の他方である第2対象骨の3次元データを、前記第2対象骨に固定される第2マーカの位置データと関連付けて記憶し、

前記撮像手段は、前記第1対象骨に固定された前記第1マーカと前記第2対象骨に固定された前記第2マーカとを撮像し、

前記表示画像生成手段は、前記第2対象骨が前記参照骨の一部に重なるように、前記記憶手段に記憶されたデータを用いて、前記第1マーカと前記第2マーカとの相対位置の変化に応じて前記第1対象骨および前記第2対象骨の表示を変化させる表示画像を生成し、

前記参照骨の3次元データは、前記手術対象骨と左右対称位置に存在する非罹患骨の鏡像データである。

本発明の第1実施形態としての外科手術支援システム100について、図1を用いて説明する。外科手術支援システム100は、画像処理により外科手術を支援するシステムである。

次に、本発明の第2実施形態に係る外科手術支援システムについて説明する。本実施形態に係る外科手術支援システムは、あらかじめ手術対象骨の配置の基準となる手術対象骨の一方の第1対象骨の3次元データと参照骨の3次元データとを生成して、第1対象骨に固定された第1マーカ(例えば2次元コード)と関連付けて記憶する。また、手術対象骨の他方の第2対象骨の3次元データを生成して、第2対象骨に固定された第2マーカ(例えば2次元コード)と関連付けて記憶する。手術時には、AR(Augmented reality)技術を利用して、撮像した第1マーカおよび第2マーカから、第1対象骨および第2対象骨の3次元位置を判定して、記憶された3次元データに基づいて表示する。そして、第2対象骨と参照骨とが適正に重なったか否かを判定することで、手術対象骨の適切な配置を決定する。このような処理によって、医師による手術対象骨の適切な配置の決定を支援する。

以下、図2〜図7を参照して、本実施形態の外科手術支援システムの構成と処理の概要を説明する。外科手術支援システムは、大きく分けて、術前準備データ生成システムと術中画像処理システムとを含む。術前準備データ生成システムは、術前に第1対象骨、第2対象骨および参照骨の3次元データを生成、表示して、術中に使用するデータを生成し記憶するシステムである。術中画像処理システムは、マーカ撮像に基づいて対象骨画像および参照骨画像を生成し表示して、手術対象骨の配置決定を支援するシステムである。しかしながら、術前準備データ生成システムと術中画像処理システムとを、統合された1つのシステムとして構成してもよい。

図2は、本実施形態に係る外科手術全体の概要を説明する図である。図2は、変形治癒した罹患骨(手術対象骨)の骨切矯正手術の例を示している。骨切矯正手術は、準備段階201と、手術対象骨の位置決め段階202と、手術対象骨の位置固定段階203とを含む。本実施形態においては、橈骨遠位部変形治癒手術を例に説明するが、これに限定されない。他の部位や他の骨の変形治癒、あるいは、骨折治療手術にも同様に適用される。

図3Aは、マーカ用ピン(以下、ピン)の骨への挿入処理の概要を説明する図である。図3Aは、手術対象骨311に対して、骨切平面が存在すると推定される領域を挟んだ2箇所に2本ずつピン211、212を固定する例を示す。ピン固定用菅体312を皮膚に載せる位置決めステージ301と、ピン固定用菅体312にピンを挿入して骨に固定するピン固定ステージ302と、菅体取り外しステージ303とを示す。

図3Bは、術前準備データ生成システム320の構成を示すブロック図である。

図4は、情報処理装置324を用いた術前準備データ生成処理の概要を説明する図である。画像401〜406は、情報処理装置324の表示画面に表示されるCG(Computer Graphics)画像であり、それぞれ、術前準備データ生成処理の各ステージに対応している。

412を生成する。

から選べるものとする。第1のマーカ取り付けタイプは、2本のピンが形成するピン平面に対して、平行にマーカを取り付けるタイプである。第2のマーカ取り付けタイプは、ピンの軸方向に平行で、ピン平面に垂直をなす平面にマーカを取り付けるタイプである。第3のマーカ取り付けタイプは、ピンの軸方向に平行で、ピン平面に45度をなす平面にマーカを取り付けるタイプである。第4のマーカ取り付けタイプは、ピンの軸方向に平行で、ピン平面に135度をなす平面にマーカを取り付けるタイプである。その他、ピンの軸方向に垂直な平面にマーカを取り付けてもよい。実際のピンにどのようにマーカを取り付けるかに応じて、そのマーカと表示すべき手術対象骨や参照骨との相対位置関係を変更すればよい。

図5Aは、本実施形態に係る術中画像処理システム500の概略構成を示す図である。

図5Bは、術中における手術対象骨の骨切作業および位置決め作業の概要を説明する画面遷移図である。手術前に、ピン211、212にマーカ221、222を固定する。

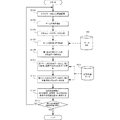

図6は、術前準備データ生成システム320と術中画像処理システム500とを含む外科手術支援システム全体の処理手順を示すフローチャートである。

次に、術中画像処理システム500は、ステップS605において、手術対象骨に固定したマーカを撮像する。

図7は、本実施形態に係る外科手術支援システムで使用される外科手術支援器具を示す図である。なお、図7には、検査や手術に通常使用される器具については図示されていない。

図8は、情報処理装置324の機能構成例324Aを示すブロック図である。なお、図8においては、断層画像データとしてCTデータを示し、3次元骨表面モデルデータとしてSTLデータを示すが、これらに限定されない。情報処理装置324Aの各機能部は、CPUによりメモリを使用しながらプログラムを実行することにより画像データを処理することで実現される。

図10は、本実施形態に係るSTLデータDB814の構成を示す図である。STLデータDB814には、本実施形態における3次元骨表面モデルを表わすSTLデータが検索可能に蓄積されている。なお、STLデータDB814の構成は図10に限定されない。

図11は、本実施形態に係る術前準備データDB819の構成を示す図である。術前準備データDB819には、本実施形態における3次元骨画像を表わすSTLデータが検索可能に蓄積されている。なお、術前準備データDB819の構成は図11に限定されない。

図12は、本実施形態に係る参照骨データ生成テーブル1200の構成を示す図である。参照骨データ生成テーブル1200は、図8または図9の参照骨データ生成部816が参照骨データを生成するために使用するテーブルである。

図13は、情報処理装置324内の処理手順を示すフローチャートである。このフローチャートは、情報処理装置324のCPUがRAMを使用しながら術前準備データ生成プログラムとして実行し、図8または図9の機能構成部を実現する。

図14は、本実施形態に係る術中画像処理システム500におけるタブレット型コンピュータ501の機能構成を示すブロック図である。タブレット型コンピュータ501の各機能部は、不図示のCPUによりメモリを使用しながらプログラムを実行することにより実現される。なお、本実施形態ではタブレット型コンピュータ501を用いているが本発明はこれに限定されるものではなく、ディスプレイとカメラを備えた可搬性の情報処理端末であればよい。また、カメラや表示部/操作部が、情報処理装置と分離して、互いにデータ通信するものであってもよい。

図15は、本実施形態に係るマーカDB1412の構成を示す図である。マーカDB1412は、マーカ解析部1411が、カメラ512が撮像した画像データからマーカの3次元の位置および向き(すなわち、2本で対のピンの位置および向き)を解析するために使用される。

図16Aは、マーカ解析部1411が用いるマーカ解析テーブル1601の構成を示す図である。マーカ解析テーブル1601は、カメラ512が撮像したマーカの画像から、マーカ上の2次元データや、マーカの位置、大きさおよび向き、あるいはマーカ支持器具の3次元データを求めて、対象骨画像や参照骨画像の3次元表示データ生成に使用するテーブルである。

図16Bは、CG画像生成部1414が用いる術中対象骨位置決めテーブル1602、1603の構成を示す図である。術中対象骨位置決めテーブル1602は、第1対象骨および参照骨ID1621に対応付けて、解析された第1マーカの3次元位置データ1622と、術前準備データDB819に記憶されている第1マーカの3次元位置データ1623とを記憶する。そして、第1マーカの3次元位置データ1623を、3次元位置データ1622に変換する変換ベクトルを用いて、術前準備データDB819に記憶されている第1対象骨の3次元データを座標変換する。その座標変換によって生成された、表示用の第1対象骨の3次元データ1624を記憶する。また、同じ変換ベクトルを用いて術前準備データDB819に記憶されている参照骨の3次元データを座標変換して、表示用の参照骨の3次元データ1625を生成し、記憶する。

図17は、本実施形態に係るタブレット型コンピュータ501の処理手順を示すフローチャートである。このフローチャートは、タブレット型コンピュータ501のCPUがRAMを使用しながら術中画像生成プログラムとして実行し、図14の機能構成部を実現する。

次に、本発明の第3実施形態に係る外科手術支援システムについて説明する。本実施形態に係る外科手術支援システムは、上記第2実施形態と比べると、ヘッドマウントディスプレイ(Eye-Trek)を使用することにより患部と表示画面とを重ね合わせて観察できる点で異なる。その他の構成および動作は、第2実施形態または第3実施形態と同様であるため、同じ構成および動作については同じ符号を付してその詳しい説明を省略する。なお、本実施形態においては、両眼式ヘッドマウントディスプレイ1801には、ステレオカメラが配備されて3次元撮像が可能である。また、両眼式ヘッドマウントディスプレイ1801は両眼式オプティカルシースルー型で、ステレオ3次元表示が可能な例を示す。しかしながら、カメラが1つで2次元表示であってもよい。また、ヘッドマウントディスプレイは片眼式であってもビデオシースルー型であってもよい。

図18は、本実施形態に係る術中画像処理システム1800の構成を示す図である。なお、図18において、図5Aと同様の構成要素には同じ参照番号を付して、説明は省略する。

図19は、本実施形態に係る術中画像処理システム1800の情報処理装置1802の処理を説明する図である。なお、図19において、図5Aと同様の構成要素は、図示および説明を省くか、あるいは、同じ参照番号を付して説明を省略する。

図20は、本実施形態に係る術中画像処理システムにおける情報処理装置2110の機能構成を示すブロック図である。なお、図20において、図14と同様の機能構成部には同じ参照番号を付して、説明を省略する。

次に、本発明の第4実施形態に係る外科手術支援システムについて説明する。本実施形態に係る外科手術支援システムは、上記第2実施形態および第3実施形態と比べると、骨画像の表示画面に手術対象骨と参照骨との重畳程度(マッチング率)および患部を曲げる方向や引っ張る方向や距離などを表示する点で異なる。その他の構成および動作は、第2実施形態と同様であるため、同じ構成および動作については同じ符号を付してその詳しい説明を省略する。なお、本実施形態においては、パーセンテージでマッチング率を表示したが、色の違いによる表示や棒グラフの長さなどの他の表示方法であってもよい。

図21は、本実施形態に係る参照骨と手術対象骨とのマッチング率の表示例を示す図である。図21は、第2実施形態の図5Bに示した画像522〜526に対応している。

次に、本発明の第5実施形態に係る外科手術支援システムについて説明する。本実施形態に係る外科手術支援システムは、上記第2実施形態乃至第4実施形態と比べると、術前準備データ生成時に対象骨に実際のマーカを配置することなく、仮想的な3次元マーカを画面上で生成して、3次元プリンタにより作成する点で異なる。なお、上記実施形態と同様の構成および動作については同じ符号を付してその詳しい説明を省略する。

図22Aおよび図22Bは、本実施形態に係る外科手術支援システム2200の処理概要を説明する図である。図22Aは、人工関節置換術の全体の流れを示す図であり、図22Bは、本実施形態における各処理を具体的に示す図である。なお、図22Aおよび図22Bにおいては、肘における上腕骨と尺骨との関節を人工関節に置換する手術について説明する。また、図22Aおよび図22Bにおいて、画面は表示部の表示画面である場合も、オプティカルスルーにおける目視が画面と表示画面との重ね合わせである場合も、含んでいる。

本実施形態の人工関節置換術においては、まず術前準備として、患部のCT撮像を行ないCTデータに基づきSTLデータを生成する。このSTLデータにより上腕骨と尺骨との画像を表示しながら、仮想的な3次元マーカを生成して上腕骨と尺骨とに配置する。なお、配置位置は、上腕骨と尺骨との人工関節埋込位置の近傍で、形状が特徴的な位置であり3次元マーカのマーカ面が手術中にカメラにより撮像容易な(カメラの視界から消えない)向きが望ましい。なお、図22Aの下方に図示したように、カメラにより撮像容易とするため、3次元マーカにおける骨に設置するベースブロック(台)とマーカ面との向きを変更することができる。この時に、骨切りが必要であれば骨切り面、本手術で使用する人工関節のインプラント、そのインプラントを設置するための骨の面(削るため)、あるいは、インプラントを固定するための骨孔、などの位置と方向とが、3次元マーカの位置と向きとが設定され、3次元データにより関連付けて記憶される。

術中には、画面2213、2214のように、上腕骨用3次元マーカのベースブロックが骨の形状にマッチングするよう設置される。そして、この3次元マーカをカメラで撮像することにより、3次元マーカの位置と向きから上腕骨の位置と向きとを判断し、上腕骨2210の骨切り面2211を手術対象の上腕骨に重ねて表示しながら、骨切りを実行する。次に、インプラントに合致する形状を有する上腕骨のSTLデータの画像を手術対象の上腕骨に重ねて表示ながら、骨を削る。また、インプラントを固定するための骨孔を手術対象の上腕骨に重ねて表示ながら、骨に孔を開ける。そして、インプラントの上腕骨コンポーネント2212を設置する。

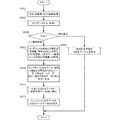

図23は、本実施形態に係る外科手術支援システム2200の処理手順を示すフローチャートである。

図24は、本実施形態に係る術前準備データ生成システム2400における情報処理装置2410の機能構成を示すブロック図である。なお、図24において、図8と同様の機能構成部には同じ参照番号を付して、説明を省略する。

図25は、本実施形態に係る術前準備データDB2419の構成を示す図である。図25は、本実施形態に特有の術式でプラニングされる準備データの構成を示している。なお、図25には、図11に図示した構成も含まれる。

図26は、本実施形態に係る術前準備データ生成システム2400における情報処理装置2410の処理手順を示すフローチャートである。このフローチャートは、情報処理装置2410のCPUがRAMを使用しながら実行して、図24の機能構成部を実現する。なお、図26においても、人工関節置換術の場合を説明するが、他の術式においても適応される。

図27は、本実施形態に係る術中画像処理システム2700におけるタブレット型コンピュータ2710の機能構成を示すブロック図である。図27において、図5または図14と同様の機能構成部には同じ参照番号を付して、説明を省略する。

図28は、本実施形態に係る術中画像処理システム2700におけるタブレット型コンピュータ2710の処理手順を示すフローチャートである。このフローチャートは、図27のタブレット型コンピュータ2710のCPUがRAMを使用しながら実行して、図27の機能構成部を実現する。なお、図28においても、人工関節置換術の場合を説明するが、他の術式においても適応される。

次に、本発明の第6実施形態に係る外科手術支援システムについて説明する。本実施形態に係る外科手術支援システムは、上記第2実施形態乃至第5実施形態と比べると、マーカとして対象骨の外科手術を行なう部位の3次元データを使用して、術中画像処理においては深度センサにより対象骨の3次元データを取得する点で異なる。なお、上記実施形態と同様の構成および動作については同じ符号を付してその詳しい説明を省略する。

図29は、本実施形態に係る術中画像処理システム2900における情報処理装置2910の機能構成を示すブロック図である。

なお、図29において、図14または図14または図20と同様の機能構成部には同じ参照番号を付して、説明を省略する。

図30は、本実施形態に係る骨画像照合部2912において使用されるデータテーブル3000を示す図である。データテーブル3000は、深度センサが患者の患部の手術対象骨の表面から取得した深度画像(距離画像)と、術前準備データ1419として格納された手術対象骨とを照合して、現在の手術対象骨の位置と向きとを決定する。

図31は、本実施形態に係る術中画像処理システム2900における情報処理装置2910の処理手順を示すフローチャートである。このフローチャートは、図29の情報処理装置2910のCPUがRAMを使用しながら実行して、図29の機能構成部を実現する。なお、図28と同様のステップには同じステップ番号を付して、説明を省略する。また、図31においても、人工関節置換術の場合を説明するが、他の術式においても適応される。

なお、上記実施形態においては、マーカ用器具を固定した患部を断層撮影し、術前準備画像生成処理において、2つの分かれた手術対象骨である第1対象骨と参照骨の組みを第1マーカに関連付けて記憶し、第2対象骨を第2マーカに関連付けて記憶することにより、術中の手術対象骨の配置の決定を支援した。しかしながら、マーカ用器具の固定は固定位置を正確に決定できる場合には、断層撮影後あるいは術中に行なってもよい。この場合には、術中に、第1対象骨と第1マーカとの関連付け、第2対象骨と第2マーカとの関連付けを行なう。また、第1対象骨と参照骨の組みを第1マーカに関係付けて記憶せずに、術中に、参照骨に第1対象骨および第2対象骨をそれぞれ合致させてもよい。その場合には、例えば、術中に、第1対象骨を参照骨に合致させて、第1対象骨と参照骨の組みを第1マーカに関係付けて記憶してから、第2対象骨を参照骨に合致するように操作してもよい。

Claims (16)

- 外科手術を行なう対象骨の3次元データとマーカの位置データとを関連付けて記憶する記憶手段と、

前記対象骨のマーカを撮像する撮像手段と、

前記記憶手段に記憶されたデータを用いて、撮像された前記マーカの位置の変化に応じて前記対象骨の表示を変化させる表示手段と、

を備え、

前記記憶手段は、2つに分かれた手術対象骨の一方である第1対象骨の3次元データ、および前記第1対象骨と一部が重なる参照骨の3次元データを、前記第1対象骨に固定される第1マーカの位置データと関連付けて記憶し、前記2つに分かれた手術対象骨の他方である第2対象骨の3次元データを、前記第2対象骨に固定される第2マーカの位置データと関連付けて記憶し、

前記撮像手段は、前記第1対象骨に固定された前記第1マーカと前記第2対象骨に固定された前記第2マーカとを撮像し、

前記表示手段は、前記第2対象骨が前記参照骨の一部に重なるように、前記記憶手段に記憶されたデータを用いて、前記第1マーカと前記第2マーカとの相対位置の変化に応じて前記第1対象骨および前記第2対象骨の表示を変化させ、

前記参照骨の3次元データは、前記手術対象骨と左右対称位置に存在する非罹患骨の鏡像データである、外科手術支援システム。 - 前記表示手段は、前記第1マーカと前記第2マーカとの相対位置の変化に応じて、前記第1対象骨の骨画像と前記第2対象骨の骨画像との相対位置が変化するように、前記第1対象骨の骨画像と前記第2対象骨の骨画像と前記参照骨の骨画像を表示する請求項1に記載の外科手術支援システム。

- 前記第1対象骨の3次元データ、および前記第1対象骨と一部が重なる前記参照骨の3次元データを、前記第1マーカの位置データに関連付けて、前記記憶手段に記憶し、

前記第2対象骨の3次元データを、前記第2マーカの位置データに関連付けて、前記記憶手段に記憶する術前準備手段を、さらに備えた請求項1または2に記載の外科手術支援システム。 - 前記術前準備手段は、前記第1対象骨および前記第2対象骨を前記参照骨と重ね合わせた状態での、前記第1、第2マーカの支持部材の目標相対位置データを前記記憶手段に記憶し、

前記表示手段は、前記目標相対位置データに基づいて前記第2マーカの支持部材の目標位置を表示する請求項3に記載の外科手術支援システム。 - 前記記憶手段は、前記第1、第2対象骨に前記第1、第2マーカの支持部材が固定された状態で内部撮影することによって取得された前記第1、第2対象骨および前記支持部材の3次元データを記憶し、

前記記憶手段に記憶された前記第1マーカの支持部材の3次元データに基づいて、該支持部材に取り付けられるべき前記第1マーカの位置データを生成し、前記記憶手段に記憶された前記第2マーカの支持部材の3次元データに基づいて、前記第2マーカの位置データを生成し、それらの位置データを前記記憶手段に記憶する位置データ生成手段をさらに有する請求項1乃至4のいずれか1項に記載の外科手術支援システム。 - 前記表示手段は、前記第2対象骨と前記参照骨との重畳の程度をさらに表示する請求項1乃至5のいずれか1項に記載の外科手術支援システム。

- 前記撮像手段は、前記手術対象骨を内部に有する患部を撮像し、

前記表示手段は、前記患部の画像に、前記第1対象骨の骨画像および前記参照骨の骨画像と、前記第2対象骨の骨画像とを重ねて表示する請求項1乃至6のいずれか1項に記載の外科手術支援システム。 - 前記表示手段は、ヘッドマウントディスプレイを含む請求項1乃至7のいずれか1項に記載の外科手術支援システム。

- 前記ヘッドマウントディスプレイは両眼式ヘッドマウントディスプレイであり、

前記表示手段は、右眼用表示データと左眼用表示データとを生成して、前記両眼式ヘッドマウントディスプレイに3次元表示を行なう請求項8に記載の外科手術支援システム。 - 前記対象骨の特徴部分に設置された3次元のマーカを画面上で仮想的に生成するマーカ生成手段と、

前記3次元のマーカを作成する3次元プリンタと、

をさらに備える請求項1に記載の外科手術支援システム。 - 前記記憶手段は、前記マーカとして、前記対象骨の外科手術を行なう部位の3次元データを記憶し、

前記撮像手段は、前記対象骨の外科手術を行なう部位の3次元データを撮像する深度センサである、請求項1に記載の外科手術支援システム。 - 請求項1乃至11のいずれか1項に記載の外科手術支援システムにおいて使用される、前記第1、第2マーカの支持部材としてのピンに対して、前記マーカを固定するために使用される外科手術支援器具。

- 外科手術を行なう対象骨の3次元データとマーカの位置データとを関連付けて記憶する記憶手段と、

前記対象骨のマーカを撮像する撮像手段と、

前記記憶手段に記憶されたデータを用いて、撮像された前記マーカの位置の変化に応じて前記対象骨の表示を変化させる表示手段と、

を備え、

前記記憶手段は、2つに分かれた手術対象骨の一方である第1対象骨の3次元データ、および前記第1対象骨と一部が重なる参照骨の3次元データを、前記第1対象骨に固定される第1マーカの位置データと関連付けて記憶し、前記2つに分かれた手術対象骨の他方である第2対象骨の3次元データを、前記第2対象骨に固定される第2マーカの位置データと関連付けて記憶し、

前記撮像手段は、前記第1対象骨に固定された前記第1マーカと前記第2対象骨に固定された前記第2マーカとを撮像し、

前記表示手段は、前記第2対象骨が前記参照骨の一部に重なるように、前記記憶手段に記憶されたデータを用いて、前記第1マーカと前記第2マーカとの相対位置の変化に応じて前記第1対象骨および前記第2対象骨の表示を変化させ、

前記参照骨の3次元データは、前記手術対象骨と左右対称位置に存在する非罹患骨の鏡像データである、外科手術支援装置。 - 外科手術を行なう対象骨の3次元データとマーカの位置データとを関連付けて記憶手段に記憶する記憶ステップと、

前記対象骨のマーカを撮像する撮像ステップと、

前記記憶手段に記憶されたデータを用いて、撮像された前記マーカの位置の変化に応じて前記対象骨の表示を変化させる表示ステップと、

を含み、

前記記憶ステップにおいては、2つに分かれた手術対象骨の一方である第1対象骨の3次元データ、および前記第1対象骨と一部が重なる参照骨の3次元データを、前記第1対象骨に固定される第1マーカの位置データと関連付けて前記記憶手段に記憶し、前記2つに分かれた手術対象骨の他方である第2対象骨の3次元データを、前記第2対象骨に固定される第2マーカの位置データと関連付けて前記記憶手段に記憶し、

前記撮像ステップにおいては、前記第1対象骨に固定された前記第1マーカと前記第2対象骨に固定された前記第2マーカとを撮像し、

前記表示ステップにおいては、前記第2対象骨が前記参照骨の一部に重なるように、前記記憶手段に記憶されたデータを用いて、前記第1マーカと前記第2マーカとの相対位置の変化に応じて前記第1対象骨および前記第2対象骨の表示を変化させ、

前記参照骨の3次元データは、前記手術対象骨と左右対称位置に存在する非罹患骨の鏡像データである、外科手術支援方法。 - 外科手術を行なう対象骨の3次元データとマーカの位置データとを関連付けて記憶手段に記憶する記憶ステップと、

前記対象骨のマーカを撮像する撮像ステップと、

前記記憶手段に記憶されたデータを用いて、撮像された前記マーカの位置の変化に応じて前記対象骨の表示を変化させる表示ステップと、

をコンピュータに実行させる外科手術支援プログラムであって、

前記記憶ステップにおいては、2つに分かれた手術対象骨の一方である第1対象骨の3次元データ、および前記第1対象骨と一部が重なる参照骨の3次元データを、前記第1対象骨に固定される第1マーカの位置データと関連付けて前記記憶手段に記憶し、前記2つに分かれた手術対象骨の他方である第2対象骨の3次元データを、前記第2対象骨に固定される第2マーカの位置データと関連付けて前記記憶手段に記憶し、

前記撮像ステップにおいては、前記第1対象骨に固定された前記第1マーカと前記第2対象骨に固定された前記第2マーカとを撮像し、

前記表示ステップにおいては、前記第2対象骨が前記参照骨の一部に重なるように、前記記憶手段に記憶されたデータを用いて、前記第1マーカと前記第2マーカとの相対位置の変化に応じて前記第1対象骨および前記第2対象骨の表示を変化させ、

前記参照骨の3次元データは、前記手術対象骨と左右対称位置に存在する非罹患骨の鏡像データである、外科手術支援プログラム。 - 外科手術を行なう対象骨の3次元データとマーカの位置データとを関連付けて記憶する記憶手段と、

撮像手段が撮像した前記対象骨のマーカの画像を前記撮像手段から受信する受信手段と、

前記記憶手段に記憶されたデータを用いて、撮像された前記マーカの位置の変化に応じて変化する前記対象骨の表示画像を生成する表示画像生成手段と、

を備え、

前記記憶手段は、2つに分かれた手術対象骨の一方である第1対象骨の3次元データ、および前記第1対象骨と一部が重なる参照骨の3次元データを、前記第1対象骨に固定される第1マーカの位置データと関連付けて記憶し、前記2つに分かれた手術対象骨の他方である第2対象骨の3次元データを、前記第2対象骨に固定される第2マーカの位置データと関連付けて記憶し、

前記撮像手段は、前記第1対象骨に固定された前記第1マーカと前記第2対象骨に固定された前記第2マーカとを撮像し、

前記表示画像生成手段は、前記第2対象骨が前記参照骨の一部に重なるように、前記記憶手段に記憶されたデータを用いて、前記第1マーカと前記第2マーカとの相対位置の変化に応じて前記第1対象骨および前記第2対象骨の表示を変化させる表示画像を生成し、

前記参照骨の3次元データは、前記手術対象骨と左右対称位置に存在する非罹患骨の鏡像データである、情報処理装置。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2013123209 | 2013-06-11 | ||

| JP2013123209 | 2013-06-11 | ||

| PCT/JP2014/065447 WO2014200016A1 (ja) | 2013-06-11 | 2014-06-11 | 外科手術支援システム、外科手術支援装置、外科手術支援方法、外科手術支援プログラムおよび情報処理装置 |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2016197895A Division JP6257728B2 (ja) | 2013-06-11 | 2016-10-06 | 外科手術支援システム、外科手術支援システムの作動方法、情報処理プログラムおよび情報処理装置 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP6023324B2 true JP6023324B2 (ja) | 2016-11-09 |

| JPWO2014200016A1 JPWO2014200016A1 (ja) | 2017-02-23 |

Family

ID=52022307

Family Applications (2)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2015522825A Active JP6023324B2 (ja) | 2013-06-11 | 2014-06-11 | 外科手術支援システム、外科手術支援装置、外科手術支援方法、外科手術支援プログラムおよび情報処理装置 |

| JP2016197895A Active JP6257728B2 (ja) | 2013-06-11 | 2016-10-06 | 外科手術支援システム、外科手術支援システムの作動方法、情報処理プログラムおよび情報処理装置 |

Family Applications After (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2016197895A Active JP6257728B2 (ja) | 2013-06-11 | 2016-10-06 | 外科手術支援システム、外科手術支援システムの作動方法、情報処理プログラムおよび情報処理装置 |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US10070929B2 (ja) |

| JP (2) | JP6023324B2 (ja) |

| WO (1) | WO2014200016A1 (ja) |

Families Citing this family (38)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| GB2534359A (en) * | 2015-01-15 | 2016-07-27 | Corin Ltd | System and method for patient implant alignment |

| GB2536650A (en) | 2015-03-24 | 2016-09-28 | Augmedics Ltd | Method and system for combining video-based and optic-based augmented reality in a near eye display |

| US20180140362A1 (en) * | 2015-04-07 | 2018-05-24 | King Abdullah University Of Science And Technology | Method, apparatus, and system for utilizing augmented reality to improve surgery |

| CN107613897B (zh) * | 2015-10-14 | 2021-12-17 | 外科手术室公司 | 扩增实境的外科导航 |

| JP6712453B2 (ja) * | 2015-10-16 | 2020-06-24 | 富士フイルム株式会社 | 拡張現実提供システム及び方法、情報処理装置、並びにプログラム |

| CN109310476B (zh) | 2016-03-12 | 2020-04-03 | P·K·朗 | 用于手术的装置与方法 |

| US10085708B2 (en) * | 2016-05-11 | 2018-10-02 | Toshiba Medical Systems Corporation | Medical image processing apparatus, medical image diagnostic apparatus, and image processing method |

| EP3471646B1 (en) * | 2016-06-17 | 2023-07-05 | Zimmer, Inc. | System for intraoperative surgical planning |

| JP2019534717A (ja) * | 2016-08-16 | 2019-12-05 | インサイト メディカル システムズ インコーポレイテッド | 医療処置における感覚増強のためのシステム |

| WO2018078723A1 (ja) * | 2016-10-25 | 2018-05-03 | 株式会社 レキシー | 手術支援システム |

| WO2018085694A1 (en) | 2016-11-04 | 2018-05-11 | Intuitive Surgical Operations, Inc. | Reconfigurable display in computer-assisted tele-operated surgery |

| US10499997B2 (en) | 2017-01-03 | 2019-12-10 | Mako Surgical Corp. | Systems and methods for surgical navigation |

| FR3062297B1 (fr) * | 2017-02-01 | 2022-07-15 | Laurent Cazal | Procede et dispositif d'assistance a la pose d'une prothese, notamment de hanche, par un chirurgien suivant differents protocoles chirurgicaux |

| US10010379B1 (en) * | 2017-02-21 | 2018-07-03 | Novarad Corporation | Augmented reality viewing and tagging for medical procedures |

| CN110621253A (zh) * | 2017-03-17 | 2019-12-27 | 智能联合外科公司 | 用于导航手术中的增强现实显示的系统和方法 |

| EP3384832A1 (en) * | 2017-04-06 | 2018-10-10 | Koninklijke Philips N.V. | Method and apparatus for providing guidance for placement of a wearable device |

| JP6803826B2 (ja) * | 2017-12-01 | 2020-12-23 | パナソニック株式会社 | 骨接合部品と骨接合部品形成方法 |

| CN112584791A (zh) * | 2018-06-19 | 2021-03-30 | 托尼尔公司 | 用于诊断肩部疾患的神经网络 |

| DE102018116558A1 (de) * | 2018-07-09 | 2020-01-09 | Aesculap Ag | Medizintechnisches Instrumentarium und Verfahren |

| US11259793B2 (en) | 2018-07-16 | 2022-03-01 | Cilag Gmbh International | Operative communication of light |

| US11287874B2 (en) | 2018-11-17 | 2022-03-29 | Novarad Corporation | Using optical codes with augmented reality displays |

| US11766296B2 (en) | 2018-11-26 | 2023-09-26 | Augmedics Ltd. | Tracking system for image-guided surgery |

| EP3977196A1 (en) * | 2019-05-29 | 2022-04-06 | Stephen B. Murphy | Systems and methods for utilizing augmented reality in surgery |

| US11382712B2 (en) * | 2019-12-22 | 2022-07-12 | Augmedics Ltd. | Mirroring in image guided surgery |

| US11832996B2 (en) | 2019-12-30 | 2023-12-05 | Cilag Gmbh International | Analyzing surgical trends by a surgical system |

| US11219501B2 (en) | 2019-12-30 | 2022-01-11 | Cilag Gmbh International | Visualization systems using structured light |

| US11759283B2 (en) | 2019-12-30 | 2023-09-19 | Cilag Gmbh International | Surgical systems for generating three dimensional constructs of anatomical organs and coupling identified anatomical structures thereto |

| US11648060B2 (en) | 2019-12-30 | 2023-05-16 | Cilag Gmbh International | Surgical system for overlaying surgical instrument data onto a virtual three dimensional construct of an organ |

| US11284963B2 (en) * | 2019-12-30 | 2022-03-29 | Cilag Gmbh International | Method of using imaging devices in surgery |

| US11744667B2 (en) | 2019-12-30 | 2023-09-05 | Cilag Gmbh International | Adaptive visualization by a surgical system |

| US11896442B2 (en) | 2019-12-30 | 2024-02-13 | Cilag Gmbh International | Surgical systems for proposing and corroborating organ portion removals |

| US11776144B2 (en) | 2019-12-30 | 2023-10-03 | Cilag Gmbh International | System and method for determining, adjusting, and managing resection margin about a subject tissue |

| US11237627B2 (en) | 2020-01-16 | 2022-02-01 | Novarad Corporation | Alignment of medical images in augmented reality displays |

| JPWO2022045043A1 (ja) * | 2020-08-24 | 2022-03-03 | ||

| EP4277560A1 (en) * | 2021-01-12 | 2023-11-22 | Howmedica Osteonics Corp. | Computer-assisted lower-extremity surgical guidance |

| US11562661B2 (en) * | 2021-01-14 | 2023-01-24 | Sheila Hall | Absolute teaching device |

| CN113681895B (zh) * | 2021-08-20 | 2023-03-10 | 宜宾显微智能科技有限公司 | 一种导针定位导向板定制及模拟验证系统及其方法 |

| US11948265B2 (en) | 2021-11-27 | 2024-04-02 | Novarad Corporation | Image data set alignment for an AR headset using anatomic structures and data fitting |

Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2001507614A (ja) * | 1997-10-28 | 2001-06-12 | カール−ツアイス−スチフツング | 骨セグメントナビゲーションシステム |

| JP2009172124A (ja) * | 2008-01-24 | 2009-08-06 | Osaka Univ | 手術ナビゲーションシステム、画像表示方法、コンピュータプログラム及び記録媒体 |

Family Cites Families (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4056791B2 (ja) | 2002-05-22 | 2008-03-05 | 策雄 米延 | 骨折整復誘導装置 |

| EP1615577A2 (en) | 2003-02-04 | 2006-01-18 | Orthosoft, Inc. | Cas modular bone reference assembly and limb position measurement system |

| AU2005231404B9 (en) * | 2004-03-31 | 2012-04-26 | Smith & Nephew, Inc. | Methods and apparatuses for providing a reference array input device |

| JP2008526422A (ja) | 2005-01-13 | 2008-07-24 | メイザー サージカル テクノロジーズ リミテッド | 鍵穴脳神経外科用画像ガイドロボットシステム |

| US20060176242A1 (en) | 2005-02-08 | 2006-08-10 | Blue Belt Technologies, Inc. | Augmented reality device and method |

-

2014

- 2014-06-11 US US14/897,964 patent/US10070929B2/en active Active

- 2014-06-11 WO PCT/JP2014/065447 patent/WO2014200016A1/ja active Application Filing

- 2014-06-11 JP JP2015522825A patent/JP6023324B2/ja active Active

-

2016

- 2016-10-06 JP JP2016197895A patent/JP6257728B2/ja active Active

Patent Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2001507614A (ja) * | 1997-10-28 | 2001-06-12 | カール−ツアイス−スチフツング | 骨セグメントナビゲーションシステム |

| JP2009172124A (ja) * | 2008-01-24 | 2009-08-06 | Osaka Univ | 手術ナビゲーションシステム、画像表示方法、コンピュータプログラム及び記録媒体 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20160143699A1 (en) | 2016-05-26 |

| WO2014200016A1 (ja) | 2014-12-18 |

| JP6257728B2 (ja) | 2018-01-10 |

| JPWO2014200016A1 (ja) | 2017-02-23 |

| US10070929B2 (en) | 2018-09-11 |

| JP2017056212A (ja) | 2017-03-23 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6257728B2 (ja) | 外科手術支援システム、外科手術支援システムの作動方法、情報処理プログラムおよび情報処理装置 | |

| JP6122495B2 (ja) | 骨切支援システム、情報処理装置、画像処理方法、および画像処理プログラム | |

| US10258427B2 (en) | Mixed reality imaging apparatus and surgical suite | |

| US10939961B2 (en) | System and methods for positioning bone cut guide | |

| CN109069208B (zh) | 用于无线超声跟踪和通信的超宽带定位 | |

| Gsaxner et al. | The HoloLens in medicine: A systematic review and taxonomy | |

| JP2019534717A (ja) | 医療処置における感覚増強のためのシステム | |

| EP2554103A1 (en) | Endoscope observation supporting system and method, and device and programme | |

| TW201717837A (zh) | 強化實境之外科導航 | |

| KR102105974B1 (ko) | 의료 영상 시스템 | |

| JP6510301B2 (ja) | 医療支援システム、医療支援方法、画像処理装置およびその制御方法と制御プログラム | |

| JP2008188400A (ja) | 人工股関節置換術支援補助部材および製造方法 | |

| JP5934070B2 (ja) | 仮想内視鏡画像生成装置およびその作動方法並びにプログラム | |

| KR20190108923A (ko) | 증강현실을 이용한 성형외과 진료/수술 지원시스템 | |

| Wang et al. | Real-time marker-free patient registration and image-based navigation using stereovision for dental surgery | |

| Bruns et al. | An image guidance system for positioning robotic cochlear implant insertion tools | |

| WO2023036848A1 (en) | Augmented reality surgical navigation system | |

| US20220354579A1 (en) | Systems and methods for planning and simulation of minimally invasive therapy | |

| JP2024508126A (ja) | 拡張現実を使用して整形外科手術用の脊椎ロッドを提案するための方法およびシステム | |

| US20220361960A1 (en) | Tracking surgical pin | |

| JP2022526540A (ja) | 整形外科的固定制御及び可視化 | |

| CN113081273A (zh) | 打孔辅助系统及手术机器人系统 | |

| De Leon-Cuevas et al. | Tool calibration with an optical tracker for skull milling | |

| JP5383842B2 (ja) | 人工股関節置換術支援補助部材の製造方法 | |

| CN116019571A (zh) | 用于在手术期间定位患者身体并跟踪患者位置的装置和方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20160906 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20161006 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6023324 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |